دسمبر 2020 میں، AWS نے Amazon SageMaker JumpStart کی عام دستیابی کا اعلان کیا۔کی صلاحیت ایمیزون سیج میکر جو آپ کو مشین لرننگ (ML) کے ساتھ جلدی اور آسانی سے شروع کرنے میں مدد کرتا ہے۔ سیج میکر جمپ اسٹارٹ مشہور ML ٹاسک میں پہلے سے تربیت یافتہ ماڈلز کی وسیع اقسام کی ون کلک فائن ٹیوننگ اور تعیناتی فراہم کرتا ہے، نیز عام کاروباری مسائل کو حل کرنے والے اینڈ ٹو اینڈ سلوشنز کا انتخاب۔ یہ خصوصیات ML عمل کے ہر مرحلے سے بھاری لفٹنگ کو ہٹا دیتی ہیں، جس سے اعلیٰ معیار کے ماڈل تیار کرنا آسان ہو جاتا ہے اور تعیناتی میں وقت کم ہوتا ہے۔

تمام جمپ سٹارٹ مواد پہلے صرف کے ذریعے دستیاب تھا۔ ایمیزون سیج میکر اسٹوڈیو، جو ایک فراہم کرتا ہے صارف دوست گرافیکل انٹرفیس خصوصیت کے ساتھ تعامل کرنے کے لیے۔ حال ہی میں، ہم بھی لانچ کا اعلان استعمال میں آسان جمپ اسٹارٹ APIs SageMaker Python SDK کی توسیع کے طور پر، آپ کو اپنے ڈیٹا سیٹس پر جمپ سٹارٹ سے تعاون یافتہ پہلے سے تربیت یافتہ ماڈلز کے ایک وسیع انتخاب کو پروگرامی طور پر تعینات کرنے اور ٹھیک کرنے کی اجازت دیتا ہے۔ یہ لانچ آپ کے کوڈ ورک فلوز، MLOps پائپ لائنز، اور کہیں بھی آپ SageMaker کے ساتھ SDK کے ذریعے بات چیت کر رہے ہیں میں جمپ سٹارٹ کی صلاحیتوں کے استعمال کو کھول دیتا ہے۔

اس پوسٹ میں، ہمیں یہ اعلان کرتے ہوئے خوشی ہو رہی ہے کہ تمام تربیت کے قابل جمپ سٹارٹ ماڈل اب اضافی تربیت کی حمایت کرتے ہیں۔ اضافی تربیت آپ کو ایک ایسے ماڈل کو تربیت دینے کی اجازت دیتی ہے جو آپ نے پہلے ہی ایک توسیع شدہ ڈیٹاسیٹ کا استعمال کرتے ہوئے ٹھیک ٹیون کر لیا ہے جس میں ایک بنیادی نمونہ شامل ہے جس کا پچھلے فائن ٹیوننگ رنز میں حساب نہیں کیا گیا ہے، جس کے نتیجے میں ماڈل کی کارکردگی خراب ہے۔ اضافی تربیت سے وقت اور وسائل دونوں کی بچت ہوتی ہے کیونکہ آپ کو ماڈل کو شروع سے دوبارہ تربیت دینے کی ضرورت نہیں ہے۔ اگر آپ جمپ اسٹارٹ API کوڈ میں براہ راست کودنا چاہتے ہیں جس کی ہم اس پوسٹ میں وضاحت کرتے ہیں، تو آپ اس کا حوالہ دے سکتے ہیں۔ نمونہ نوٹ بک.

جمپ اسٹارٹ کا جائزہ

JumpStart ایک کثیر جہتی پروڈکٹ ہے جس میں SageMaker پر ML کے ساتھ جلدی شروع کرنے میں مدد کرنے کے لیے مختلف صلاحیتیں شامل ہیں۔ لکھنے کے وقت، جمپ اسٹارٹ آپ کو درج ذیل کام کرنے کے قابل بناتا ہے:

- عام ایم ایل کاموں کے لیے پہلے سے تربیت یافتہ ماڈلز کا تعین کریں۔ - جمپ سٹارٹ آپ کو بڑے، عوامی طور پر دستیاب ڈیٹا سیٹس پر پہلے سے تربیت یافتہ ماڈلز کی آسانی سے تعیناتی فراہم کرکے بغیر کسی ترقیاتی کوشش کے عام ML کاموں کو حل کرنے کے قابل بناتا ہے۔ ایم ایل ریسرچ کمیونٹی نے حال ہی میں تیار کردہ زیادہ تر ماڈلز کو عوامی طور پر استعمال کے لیے دستیاب کرنے کے لیے بہت زیادہ کوششیں کی ہیں۔ جمپ سٹارٹ 300 سے زیادہ ماڈلز کے مجموعے کی میزبانی کرتا ہے، جس میں 15 مقبول ترین ML کاموں جیسے آبجیکٹ کا پتہ لگانا، ٹیکسٹ کی درجہ بندی، اور ٹیکسٹ جنریشن شامل ہے، جس سے ابتدائی افراد کے لیے انہیں استعمال کرنا آسان ہو جاتا ہے۔ یہ ماڈل مشہور ماڈل ہب، جیسے TensorFlow، PyTorch، Hugging Face، اور MXNet Hub سے تیار کیے گئے ہیں۔

- پہلے سے تربیت یافتہ ماڈلز کو ٹھیک بنائیں - جمپ سٹارٹ آپ کو پہلے سے تربیت یافتہ ماڈلز کو ٹھیک کرنے کی اجازت دیتا ہے اور آپ کو اپنا تربیتی الگورتھم لکھنے کی ضرورت نہیں ہے۔ ایم ایل میں، ایک ڈومین میں سیکھے گئے علم کو دوسرے میں منتقل کرنے کی صلاحیت کو کہا جاتا ہے۔ منتقلی سیکھنے. آپ اپنے چھوٹے ڈیٹا سیٹس پر درست ماڈل تیار کرنے کے لیے ٹرانسفر لرننگ کا استعمال کر سکتے ہیں، اصل ماڈل کی تربیت میں شامل افراد کی نسبت بہت کم تربیتی لاگت کے ساتھ۔ JumpStart میں LightGBM، CatBoost، XGBoost، اور Scikit-learn پر مبنی مشہور ٹریننگ الگورتھم بھی شامل ہیں جنہیں آپ ٹیبلر ریگریشن اور درجہ بندی کے لیے شروع سے تربیت دے سکتے ہیں۔

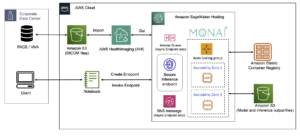

- پہلے سے تیار کردہ حل استعمال کریں۔ - جمپ سٹارٹ عام ML استعمال کے معاملات کے لیے 17 حل فراہم کرتا ہے جیسے کہ ڈیمانڈ کی پیشن گوئی اور صنعتی اور مالیاتی ایپلی کیشنز، جنہیں آپ صرف چند کلکس کے ساتھ تعینات کر سکتے ہیں۔ سولیوشنز اینڈ ٹو اینڈ ایم ایل ایپلی کیشنز ہیں جو مختلف AWS سروسز کو ایک ساتھ جوڑ کر کسی خاص کاروباری استعمال کے معاملے کو حل کرتی ہیں۔ وہ استعمال کرتے ہیں AWS کلاؤڈ فارمیشن فوری تعیناتی کے لیے ٹیمپلیٹس اور ریفرنس آرکیٹیکچرز، جس کا مطلب ہے کہ وہ مکمل طور پر حسب ضرورت ہیں۔

- SageMaker الگورتھم کے لیے نوٹ بک کی مثالیں استعمال کریں۔ - SageMaker ڈیٹا سائنسدانوں اور ML پریکٹیشنرز کو ML ماڈلز کو تیزی سے تربیت اور تعینات کرنے کے ساتھ شروع کرنے میں مدد کرنے کے لیے پہلے سے موجود الگورتھم کا ایک مجموعہ فراہم کرتا ہے۔ جمپ سٹارٹ نمونہ نوٹ بک فراہم کرتا ہے جسے آپ ان الگورتھم کو تیزی سے لاگو کرنے کے لیے استعمال کر سکتے ہیں۔

- تربیتی ویڈیوز اور بلاگز کا جائزہ لیں۔ - جمپ سٹارٹ متعدد بلاگ پوسٹس اور ویڈیوز بھی فراہم کرتا ہے جو آپ کو سیج میکر کے اندر مختلف فنکشنلٹیز کو استعمال کرنے کا طریقہ سکھاتے ہیں۔

جمپ سٹارٹ اپنی مرضی کے مطابق VPC ترتیبات کو قبول کرتا ہے اور AWS کلیدی انتظام کی خدمت (AWS KMS) انکرپشن کیز، تاکہ آپ اپنے انٹرپرائز ماحول میں دستیاب ماڈلز اور حل محفوظ طریقے سے استعمال کر سکیں۔ آپ اپنی حفاظتی ترتیبات کو اسٹوڈیو کے اندر یا SageMaker Python SDK کے ذریعے جمپ اسٹارٹ پر منتقل کر سکتے ہیں۔

تصویر کی درجہ بندی

تصویری درجہ بندی سے مراد تربیتی ڈیٹاسیٹ میں کسی تصویر کو کلاس لیبلز میں سے کسی ایک میں درجہ بندی کرنا ہے۔ آپ کسی بھی ڈیٹاسیٹ کے ساتھ ماڈل کو ٹھیک ٹیون کر سکتے ہیں جس میں کسی بھی کلاسز کی تصاویر شامل ہیں۔ جمپ سٹارٹ پر فائن ٹیوننگ کے لیے دستیاب ماڈل متعلقہ فیچر ایکسٹریکٹر ماڈل کے ساتھ درجہ بندی کی پرت کو جوڑتا ہے اور پرت کے پیرامیٹرز کو بے ترتیب اقدار سے شروع کرتا ہے۔ درجہ بندی کی پرت کی آؤٹ پٹ ڈائمینشن کا تعین ان پٹ ڈیٹا میں کلاسوں کی تعداد کی بنیاد پر کیا جاتا ہے۔ فائن ٹیوننگ مرحلہ درجہ بندی کی تہہ کے پیرامیٹرز کو ٹیون کرتا ہے، جبکہ فیچر ایکسٹریکٹر ماڈل کے پیرامیٹرز کو منجمد رکھتا ہے، اور فائن ٹیونڈ ماڈل کو واپس کرتا ہے۔ مقصد ان پٹ ڈیٹا پر پیشین گوئی کی غلطی کو کم کرنا ہے۔

ہمارے ڈیٹاسیٹ کے لیے، ان پٹ ایک ڈائرکٹری ہے جس میں کلاسز کی تعداد جتنی ذیلی ڈائرکٹری ہیں۔ ہر ذیلی ڈائرکٹری میں .jpg فارمیٹ میں اس کلاس سے تعلق رکھنے والی تصاویر ہونی چاہئیں۔ ان پٹ ڈائرکٹری کو درج ذیل درجہ بندی کی طرح نظر آنا چاہئے اگر تربیتی ڈیٹا میں دو کلاسوں کی تصاویر شامل ہوں: roses اور dandelion:

فولڈرز کے نام، کلاسز، اور .jpg فائل کے نام کچھ بھی ہو سکتے ہیں۔

ہم فراہم کرتے ہیں tf_flowers1 ماڈل کو ٹھیک کرنے کے لیے بطور ڈیفالٹ ڈیٹا سیٹ۔ اس ڈیٹاسیٹ میں پھولوں کی پانچ اقسام کی تصاویر شامل ہیں۔ ڈیٹا سیٹ سے ڈاؤن لوڈ کیا گیا ہے۔ TensorFlow.

واک تھرو کا جائزہ

درج ذیل حصے اسٹوڈیو UI اور JumpStart APIs دونوں کے ذریعے جمپ اسٹارٹ کے ساتھ تصویر کی درجہ بندی کرنے کے لیے مرحلہ وار ڈیمو فراہم کرتے ہیں۔

ہم درج ذیل مراحل سے گزرتے ہیں:

- اسٹوڈیو UI کے ذریعے جمپ اسٹارٹ تک رسائی حاصل کریں:

- پہلے سے تربیت یافتہ ماڈل کو ٹھیک بنائیں۔

- ٹھیک ٹیون ماڈل تعینات کریں۔

- بتدریج ٹھیک ٹیون شدہ ماڈل کی تربیت کریں اور دوبارہ تعینات کریں۔

- SageMaker Python SDK کے ساتھ JumpStart پروگرام کے مطابق استعمال کریں:

- پہلے سے تربیت یافتہ ماڈل کو ٹھیک بنائیں۔

- ٹھیک ٹیون ماڈل تعینات کریں۔

- بتدریج ٹھیک ٹیون شدہ ماڈل کی تربیت کریں اور دوبارہ تعینات کریں۔

اسٹوڈیو UI کے ذریعے جمپ اسٹارٹ تک رسائی حاصل کریں۔

اس سیکشن میں، ہم اسٹوڈیو UI کے ذریعے جمپ سٹارٹ ماڈلز کو ٹھیک کرنے اور تعینات کرنے کا طریقہ دکھاتے ہیں۔ مزید برآں، ہم یہ بتاتے ہیں کہ کس طرح ایک ماڈل کو بتدریج تربیت دینا ہے جسے آپ نے پہلے ٹھیک بنایا ہے۔

پہلے سے تربیت یافتہ ماڈل کو ٹھیک بنائیں

درج ذیل ویڈیو آپ کو دکھاتی ہے کہ جمپ سٹارٹ پر پہلے سے تربیت یافتہ تصویری درجہ بندی کا ماڈل کیسے تلاش کیا جائے اور اسے ٹھیک بنایا جائے۔ ماڈل پیج میں ماڈل کے بارے میں قیمتی معلومات، اسے استعمال کرنے کا طریقہ، متوقع ڈیٹا فارمیٹ، اور کچھ ٹھیک ٹیوننگ تفصیلات شامل ہیں۔

مظاہرے کے مقاصد کے لیے، ہم بطور ڈیفالٹ فراہم کردہ ڈیٹاسیٹ کا استعمال کرتے ہوئے ماڈل کو ٹھیک کرتے ہیں، جو کہ tf_flowers ڈیٹاسیٹ، پھولوں کی مختلف اقسام پر مشتمل ہے۔ آپ کے اپنے ڈیٹاسیٹ پر فائن ٹیوننگ میں ڈیٹا کی درست فارمیٹنگ لینا شامل ہے (جیسا کہ ماڈل پیج پر بیان کیا گیا ہے)، اسے اپ لوڈ کرنا ایمیزون سادہ اسٹوریج سروس (Amazon S3)، اور ڈیٹا سورس کنفیگریشن میں اس کے مقام کی وضاحت کرنا۔

ہم وہی ہائپر پیرامیٹر قدریں استعمال کرتے ہیں جو بطور ڈیفالٹ سیٹ کی جاتی ہیں (ایپوچز کی تعداد، سیکھنے کی شرح، اور بیچ کا سائز)۔ ہم اپنے SageMaker ٹریننگ مثال کے طور پر GPU کی حمایت یافتہ ml.p3.2xlarge مثال بھی استعمال کرتے ہیں۔

آپ اسٹوڈیو کنسول پر اپنے تربیتی کام کی نگرانی کر سکتے ہیں، اور اس کے مکمل ہونے پر مطلع کیا جاتا ہے۔

ٹھیک ٹیون ماڈل تعینات کریں۔

ٹریننگ مکمل ہونے کے بعد، آپ ٹھیک ٹیون ماڈل کو اسی صفحہ سے تعینات کر سکتے ہیں جس میں تربیتی ملازمت کی تفصیلات موجود ہیں۔ اپنے ماڈل کو تعینات کرنے کے لیے، ہم ایک مختلف مثال کی قسم منتخب کرتے ہیں، ml.p2.xlarge۔ یہ اب بھی GPU ایکسلریشن فراہم کرتا ہے جو کم تخمینہ میں تاخیر کے لیے درکار ہے، لیکن کم قیمت پر۔ سیج میکر ہوسٹنگ مثال کو ترتیب دینے کے بعد، منتخب کریں۔ تعینات. اس میں 5-10 منٹ لگ سکتے ہیں جب تک کہ آپ کا مستقل اختتامی نقطہ تیار نہ ہو اور چلتا ہو۔

پھر آپ کا اختتامی نقطہ آپریشنل ہے اور تخمینہ کی درخواستوں کا جواب دینے کے لیے تیار ہے!

اندازہ لگانے کے لیے اپنے وقت کو تیز کرنے کے لیے، جمپ سٹارٹ ایک نمونہ نوٹ بک فراہم کرتا ہے جو آپ کو دکھاتا ہے کہ آپ کے تازہ تعینات کردہ اختتامی نقطہ پر اندازہ کیسے چلانا ہے۔ منتخب کریں۔ نوٹ بک کھولیں۔ کے تحت اختتامی نقطہ استعمال کریں۔ سٹوڈیو سے

بتدریج ٹھیک ٹیونڈ ماڈل کو تربیت دیں اور تعینات کریں۔

ٹھیک ٹیوننگ مکمل ہونے پر، آپ کارکردگی کو بڑھانے کے لیے ماڈل کو مزید تربیت دے سکتے ہیں۔ یہ مرحلہ ابتدائی فائن ٹیوننگ کے عمل سے بہت مشابہت رکھتا ہے، سوائے اس کے کہ ہم پہلے سے ٹھیک ٹیون شدہ ماڈل کو نقطہ آغاز کے طور پر استعمال کرتے ہیں۔ آپ نیا ڈیٹا استعمال کر سکتے ہیں، لیکن ڈیٹا سیٹ کی شکل ایک جیسی ہونی چاہیے (کلاسوں کا ایک ہی سیٹ)۔

SageMaker SDK کے ساتھ JumpStart پروگرام کے مطابق استعمال کریں۔

پچھلے حصوں میں، ہم نے دکھایا کہ آپ جمپ سٹارٹ UI کا استعمال کیسے کر سکتے ہیں، چند کلکس کے معاملے میں ایک ماڈل کو انٹرایکٹو طریقے سے بہتر بنانے، تعینات کرنے اور بتدریج تربیت دینے کے لیے۔ آپ SageMaker SDK میں مربوط APIs کا استعمال کرتے ہوئے JumpStart کے ماڈلز اور پروگرام کے لحاظ سے آسان فائن ٹیوننگ بھی استعمال کر سکتے ہیں۔ اب ہم اس کی ایک فوری مثال دیکھتے ہیں کہ آپ پچھلے عمل کو کیسے نقل کر سکتے ہیں۔ اس ڈیمو کے تمام مراحل ساتھ والی نوٹ بک میں دستیاب ہیں۔ جمپ اسٹارٹ کا تعارف - تصویری درجہ بندی.

پہلے سے تربیت یافتہ ماڈل کو ٹھیک بنائیں

کسی منتخب ماڈل کو ٹھیک کرنے کے لیے، ہمیں اس ماڈل کا URI، ساتھ ہی ٹریننگ اسکرپٹ اور ٹریننگ کے لیے استعمال ہونے والی کنٹینر امیج حاصل کرنے کی ضرورت ہے۔ شکر ہے، یہ تینوں ان پٹ مکمل طور پر ماڈل کے نام، ورژن پر منحصر ہیں (دستیاب ماڈلز کی فہرست کے لیے، دیکھیں جمپ سٹارٹ دستیاب ماڈل ٹیبل) اور مثال کی قسم جس کی آپ تربیت کرنا چاہتے ہیں۔ یہ درج ذیل کوڈ کے ٹکڑوں میں ظاہر ہوتا ہے:

ہم بازیافت کرتے ہیں۔ model_id اسی ماڈل کے مطابق جو ہم نے پہلے استعمال کیا تھا۔ شناخت کنندہ میں موجود ic تصویر کی درجہ بندی سے مطابقت رکھتا ہے۔

اب آپ SageMaker SDK کا استعمال کرتے ہوئے اس جمپ سٹارٹ ماڈل کو اپنی مرضی کے مطابق ڈیٹا سیٹ پر ٹھیک کر سکتے ہیں۔ ہم وہی استعمال کرتے ہیں۔ tf_flowers ڈیٹاسیٹ جو عوامی طور پر Amazon S3 پر ہوسٹ کیا جاتا ہے، آسانی سے جذبات کے تجزیہ پر توجہ مرکوز کرتا ہے۔ جیسا کہ پچھلے حصے میں بیان کیا گیا ہے، آپ کے ڈیٹاسیٹ کو فائن ٹیوننگ کے لیے تشکیل دیا جانا چاہیے۔ مندرجہ ذیل مثال کوڈ دیکھیں:

ہم اپنے منتخب کردہ ماڈل کے لیے وہی ڈیفالٹ ہائپرپیرامیٹر حاصل کرتے ہیں جو ہم نے پچھلے حصے میں دیکھے تھے، sagemaker.hyperparameters.retrieve_default(). اس کے بعد ہم SageMaker کا تخمینہ لگانے والے کو شروع کرتے ہیں اور اپنے ماڈل کو ٹھیک کرنے کے لیے .fit طریقہ کو کال کرتے ہیں، اسے ہمارے تربیتی ڈیٹا کے لیے Amazon S3 URI پاس کرتے ہیں۔ جیسا کہ آپ دیکھ سکتے ہیں، entry_point فراہم کردہ اسکرپٹ کا نام ہے۔ transfer_learning.py (دوسرے کاموں اور ماڈلز کے لیے وہی)، اور ان پٹ ڈیٹا چینل کو پاس کیا گیا۔ .fit نام ہونا ضروری ہے training.

ٹھیک ٹیونڈ ماڈل کو تعینات کرنا

ٹریننگ مکمل ہونے پر، آپ اپنا عمدہ ماڈل تعینات کر سکتے ہیں۔ ایسا کرنے کے لیے، ہمیں صرف inference اسکرپٹ URI حاصل کرنے کی ضرورت ہے (وہ کوڈ جو اس بات کا تعین کرتا ہے کہ ماڈل کو ایک بار تعینات کرنے کے بعد تخمینہ کے لیے کس طرح استعمال کیا جاتا ہے) اور inference کنٹینر امیج URI، جس میں ہمارے منتخب کردہ ماڈل کی میزبانی کے لیے ایک مناسب ماڈل سرور شامل ہے۔ درج ذیل کوڈ دیکھیں:

چند منٹوں کے بعد، ہمارا ماڈل تعینات ہو جاتا ہے اور ہم اس سے حقیقی وقت میں پیشین گوئیاں حاصل کر سکتے ہیں!

اگلا، ہم مثال کے طور پر تصویر میں کس قسم کے پھول موجود ہیں اس کی پیشین گوئی کرنے کے لیے اختتامی نقطہ کو استعمال کرتے ہیں۔ ہم استعمال کرتے ہیں query_endpoint اور parse_response مددگار افعال، جو ساتھ میں بیان کیے گئے ہیں۔ نوٹ بک.

بتدریج ٹھیک ٹیون شدہ ماڈل کی تربیت کریں اور دوبارہ تعینات کریں۔

ہم ایک عمدہ ماڈل کو نئی امیجز پر مزید تربیت دے کر اس کی کارکردگی کو بڑھا سکتے ہیں۔ آپ اس کے لیے کسی بھی تعداد میں نئی یا پرانی تصاویر استعمال کر سکتے ہیں، تاہم ڈیٹاسیٹ فارمیٹ ایک ہی رہنا چاہیے (کلاسوں کا ایک ہی سیٹ)۔ انکریمنٹل ٹریننگ کا مرحلہ فائن ٹیوننگ کے عمل سے ملتا جلتا ہے، ایک اہم فرق کے ساتھ: ابتدائی فائن ٹیوننگ میں ہم پہلے سے تربیت یافتہ ماڈل سے شروع کرتے ہیں، جب کہ انکریمنٹل ٹریننگ میں ہم موجودہ فائن ٹیوننگ ماڈل سے شروع کرتے ہیں۔ درج ذیل کوڈ دیکھیں:

تربیت مکمل ہونے پر، ہم ماڈل کو تعینات کرنے کے لیے وہی اقدامات استعمال کر سکتے ہیں جو پچھلے حصے میں بیان کیے گئے ہیں۔

نتیجہ

جمپ اسٹارٹ سیج میکر میں ایک صلاحیت ہے جو آپ کو ایم ایل کے ساتھ تیزی سے شروع کرنے کی اجازت دیتی ہے۔ جمپ سٹارٹ عام ML مسائل جیسے تصویر کی درجہ بندی، آبجیکٹ کا پتہ لگانے، متن کی درجہ بندی، جملے کے جوڑے کی درجہ بندی، اور سوالوں کے جوابات کو حل کرنے کے لیے اوپن سورس کے پہلے سے تربیت یافتہ ماڈلز کا استعمال کرتا ہے۔

اس پوسٹ میں، ہم نے آپ کو پہلے سے تربیت یافتہ امیج کی درجہ بندی کے ماڈل کو ٹھیک کرنے اور تعینات کرنے کا طریقہ دکھایا ہے۔ ہم نے یہ بھی دکھایا کہ تصویر کی درجہ بندی کے لیے ایک باریک ٹیون ماڈل کو کس طرح بڑھایا جائے۔ جمپ سٹارٹ کے ساتھ، آپ کوڈ کی ضرورت کے بغیر یہ عمل آسانی سے انجام دے سکتے ہیں۔ اپنے طور پر حل آزمائیں اور ہمیں بتائیں کہ یہ تبصرے میں کیسے جاتا ہے۔ جمپ اسٹارٹ کے بارے میں مزید جاننے کے لیے، AWS re:Invent 2020 ویڈیو دیکھیں ایمیزون سیج میکر جمپ اسٹارٹ کے ساتھ منٹوں میں ایم ایل کے ساتھ شروع کریں۔.

حوالہ جات

- ٹینسر فلو ٹیم، 2019

مصنفین کے بارے میں

ڈاکٹر وویک مدن Amazon SageMaker جمپ سٹارٹ ٹیم کے ساتھ ایک اپلائیڈ سائنٹسٹ ہے۔ اس نے پی ایچ ڈی کر لی۔ Urbana-Champaign میں الینوائے یونیورسٹی سے اور جارجیا ٹیک میں پوسٹ ڈاکٹریٹ محقق تھے۔ وہ مشین لرننگ اور الگورتھم ڈیزائن میں ایک فعال محقق ہے اور اس نے EMNLP، ICLR، COLT، FOCS، اور SODA کانفرنسوں میں مقالے شائع کیے ہیں۔

ڈاکٹر وویک مدن Amazon SageMaker جمپ سٹارٹ ٹیم کے ساتھ ایک اپلائیڈ سائنٹسٹ ہے۔ اس نے پی ایچ ڈی کر لی۔ Urbana-Champaign میں الینوائے یونیورسٹی سے اور جارجیا ٹیک میں پوسٹ ڈاکٹریٹ محقق تھے۔ وہ مشین لرننگ اور الگورتھم ڈیزائن میں ایک فعال محقق ہے اور اس نے EMNLP، ICLR، COLT، FOCS، اور SODA کانفرنسوں میں مقالے شائع کیے ہیں۔

جواؤ مورا ایمیزون ویب سروسز میں ایک AI/ML ماہر حل آرکیٹیکٹ ہے۔ وہ زیادہ تر NLP کے استعمال کے معاملات پر توجہ مرکوز کرتا ہے اور صارفین کو گہری سیکھنے کے ماڈل کی تربیت اور تعیناتی کو بہتر بنانے میں مدد کرتا ہے۔ وہ کم کوڈ ایم ایل سلوشنز اور ایم ایل اسپیشلائزڈ ہارڈ ویئر کا ایک فعال حامی بھی ہے۔

جواؤ مورا ایمیزون ویب سروسز میں ایک AI/ML ماہر حل آرکیٹیکٹ ہے۔ وہ زیادہ تر NLP کے استعمال کے معاملات پر توجہ مرکوز کرتا ہے اور صارفین کو گہری سیکھنے کے ماڈل کی تربیت اور تعیناتی کو بہتر بنانے میں مدد کرتا ہے۔ وہ کم کوڈ ایم ایل سلوشنز اور ایم ایل اسپیشلائزڈ ہارڈ ویئر کا ایک فعال حامی بھی ہے۔

ڈاکٹر آشیش کھیتان کے ساتھ ایک سینئر اپلائیڈ سائنٹسٹ ہے۔ ایمیزون سیج میکر جمپ اسٹارٹ اور ایمیزون سیج میکر بلٹ ان الگورتھم اور مشین لرننگ الگورتھم تیار کرنے میں مدد کرتا ہے۔ وہ مشین لرننگ اور شماریاتی اندازہ میں ایک فعال محقق ہے اور اس نے NeurIPS، ICML، ICLR، JMLR، ACL، اور EMNLP کانفرنسوں میں بہت سے مقالے شائع کیے ہیں۔

ڈاکٹر آشیش کھیتان کے ساتھ ایک سینئر اپلائیڈ سائنٹسٹ ہے۔ ایمیزون سیج میکر جمپ اسٹارٹ اور ایمیزون سیج میکر بلٹ ان الگورتھم اور مشین لرننگ الگورتھم تیار کرنے میں مدد کرتا ہے۔ وہ مشین لرننگ اور شماریاتی اندازہ میں ایک فعال محقق ہے اور اس نے NeurIPS، ICML، ICLR، JMLR، ACL، اور EMNLP کانفرنسوں میں بہت سے مقالے شائع کیے ہیں۔

- '

- "

- 100

- 2020

- a

- کی صلاحیت

- ہمارے بارے میں

- رفتار کو تیز تر

- درست

- کے پار

- فعال

- پتہ

- یلگورتم

- یلگوردمز

- تمام

- اجازت دے رہا ہے

- کی اجازت دیتا ہے

- پہلے ہی

- ایمیزون

- ایمیزون ویب سروسز

- رقم

- تجزیہ

- اعلان کریں

- کا اعلان کیا ہے

- ایک اور

- کہیں

- اے پی آئی

- APIs

- ایپلی کیشنز

- اطلاقی

- کا اطلاق کریں

- مناسب

- دستیابی

- دستیاب

- AWS

- کیونکہ

- بلاگ

- بلاگ مراسلات

- تعمیر میں

- کاروبار

- فون

- حاصل کر سکتے ہیں

- صلاحیتوں

- کیس

- مقدمات

- میں سے انتخاب کریں

- طبقے

- کلاس

- درجہ بندی

- کوڈ

- مجموعہ

- تبصروں

- کامن

- کمیونٹی

- مکمل

- پر مشتمل

- کانفرنسوں

- ترتیب

- کنسول

- کنٹینر

- پر مشتمل ہے

- مواد

- کنٹرول

- اسی کے مطابق

- اخراجات

- تخلیق

- اپنی مرضی کے

- گاہکوں

- مرضی کے مطابق

- اعداد و شمار

- گہری

- ڈیمانڈ

- مظاہرہ

- demonstrated,en

- تعیناتی

- تعینات

- تعینات

- تعیناتی

- بیان کیا

- ڈیزائن

- تفصیلات

- کھوج

- ترقی

- ترقی یافتہ

- ترقی

- فرق

- مختلف

- طول و عرض

- براہ راست

- میں Docker

- ڈومین

- ہر ایک

- آسانی سے

- استعمال میں آسان

- کوشش

- کے قابل بناتا ہے

- خفیہ کاری

- آخر سے آخر تک

- اختتام پوائنٹ

- انٹرپرائز

- ماحولیات

- مثال کے طور پر

- مثال کے طور پر

- اس کے علاوہ

- بہت پرجوش

- موجودہ

- توسیع

- توقع

- چہرہ

- نمایاں کریں

- خصوصیات

- مالی

- فٹ

- توجہ مرکوز

- کے بعد

- فارمیٹ

- سے

- افعال

- مزید

- جنرل

- نسل

- جارجیا

- GPU

- ہارڈ ویئر

- مدد

- مدد

- مدد کرتا ہے

- درجہ بندی

- اعلی معیار کی

- کی ڈگری حاصل کی

- میزبانی کی

- ہوسٹنگ

- کس طرح

- کیسے

- تاہم

- HTTPS

- حب

- ایلی نوائے

- تصویر

- تصاویر

- اہم

- شامل ہیں

- اضافہ

- صنعتی

- معلومات

- ان پٹ

- مثال کے طور پر

- ضم

- بات چیت

- ملوث

- IT

- ایوب

- کودنے

- رکھتے ہوئے

- کلیدی

- چابیاں

- جان

- علم

- لیبل

- لیبل

- بڑے

- شروع

- پرت

- جانیں

- سیکھا ہے

- سیکھنے

- اٹھانے

- لسٹ

- محل وقوع

- دیکھو

- مشین

- مشین لرننگ

- اکثریت

- بنانا

- انتظام

- معاملہ

- کا مطلب ہے کہ

- ML

- ماڈل

- ماڈل

- کی نگرانی

- زیادہ

- سب سے زیادہ

- سب سے زیادہ مقبول

- نام

- نوٹ بک

- تعداد

- متعدد

- کی اصلاح کریں

- دیگر

- خود

- خاص طور پر

- پاسنگ

- پاٹرن

- کارکردگی

- پوائنٹ

- غریب

- مقبول

- مراسلات

- پیشن گوئی

- کی پیشن گوئی

- پیشن گوئی

- پچھلا

- قیمت

- مسائل

- عمل

- پیدا

- مصنوعات

- فراہم

- فراہم

- فراہم کرتا ہے

- فراہم کرنے

- مقاصد

- سوال

- فوری

- جلدی سے

- RE

- حال ہی میں

- کو کم کرنے

- مراد

- رہے

- تحقیق

- وسائل

- واپسی

- رن

- چل رہا ہے

- اسی

- سائنسدان

- سائنسدانوں

- sdk

- محفوظ طریقے سے

- سیکورٹی

- منتخب

- انتخاب

- جذبات

- سروسز

- مقرر

- اسی طرح

- سادہ

- سائز

- So

- حل

- حل

- حل

- کچھ

- ماہر

- شروع کریں

- شروع

- شماریات

- ابھی تک

- ذخیرہ

- منظم

- سٹوڈیو

- حمایت

- لینے

- کاموں

- ٹیم

- ٹیک

- سانچے

- ۔

- تین

- کے ذریعے

- وقت

- مل کر

- ٹریننگ

- منتقل

- اقسام

- ui

- کے تحت

- یونیورسٹی

- غیر مقفل ہے

- us

- استعمال کی شرائط

- مختلف اقسام کے

- مختلف

- ورژن

- ویڈیو

- ویڈیوز

- ویب

- ویب خدمات

- کیا

- جبکہ

- کے اندر

- کام کے بہاؤ

- تحریری طور پر

- اور

- یو ٹیوب پر