نومبر 2022 میں، ہم کا اعلان کیا ہے جس کے ساتھ AWS صارفین متن سے تصاویر بنا سکتے ہیں۔ مستحکم بازی ماڈلز کا استعمال کرتے ہوئے ایمیزون سیج میکر جمپ اسٹارٹ. آج، ہم ایک نئی خصوصیت متعارف کرانے کے لیے پرجوش ہیں جو صارفین کو اس قابل بناتا ہے کہ وہ اسٹیبل ڈفیوژن ماڈلز کے ساتھ تصاویر کو پینٹ کر سکیں۔ مصوری سے مراد متنی اشارے پر مبنی تصویر کے کسی حصے کو دوسری تصویر سے تبدیل کرنے کا عمل ہے۔ اصل تصویر فراہم کرکے، ایک ماسک امیج جو بدلے جانے والے حصے کا خاکہ پیش کرتا ہے، اور ایک ٹیکسٹول پرامپٹ، اسٹیبل ڈفیوژن ماڈل ایک نئی امیج تیار کر سکتا ہے جو ٹیکسٹول پرامپٹ میں بیان کردہ آبجیکٹ، موضوع یا ماحول سے نقاب پوش علاقے کی جگہ لے لے۔

آپ انحطاط شدہ تصاویر کو بحال کرنے یا کچھ حصوں میں نئے مضامین یا طرز کے ساتھ نئی تصاویر بنانے کے لیے ان پینٹنگ کا استعمال کر سکتے ہیں۔ آرکیٹیکچرل ڈیزائن کے دائرے میں، تعمیراتی عملے کے لیے درست معلومات فراہم کرتے ہوئے، عمارت کے بلیو پرنٹس کے نامکمل یا تباہ شدہ علاقوں کی مرمت کے لیے مستحکم ڈفیوژن انپینٹنگ کا اطلاق کیا جا سکتا ہے۔ کلینکل ایم آر آئی امیجنگ کے معاملے میں، مریض کے سر کو روکا جانا چاہیے، جو کہ کراپنگ آرٹفیکٹ کی وجہ سے اعداد و شمار کے نقصان یا تشخیصی درستگی کو کم کرنے کی وجہ سے ذیلی نتائج کا باعث بن سکتا ہے۔ تصویر کی پینٹنگ ان سب سے زیادہ بہتر نتائج کو کم کرنے میں مؤثر طریقے سے مدد کر سکتی ہے۔

اس پوسٹ میں، ہم اسٹیبل ڈفیوژن ان پینٹنگ ماڈل کو دو طریقوں سے استعمال کرتے ہوئے اندازہ لگانے اور چلانے کے بارے میں ایک جامع گائیڈ پیش کرتے ہیں: جمپ اسٹارٹ کے یوزر انٹرفیس (UI) کے ذریعے۔ ایمیزون سیج میکر اسٹوڈیو، اور پروگرام کے ذریعے جمپ اسٹارٹ APIs میں دستیاب ہے SageMaker Python SDK.

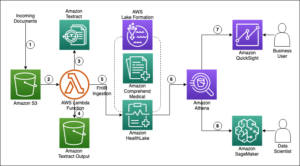

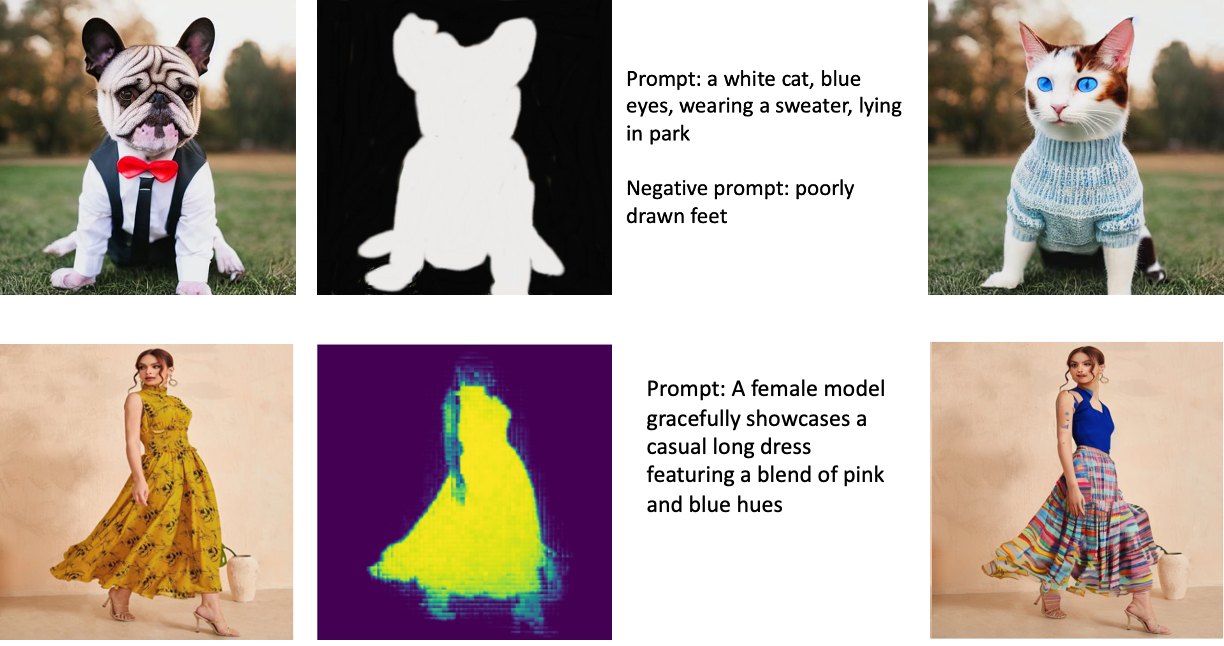

حل جائزہ

درج ذیل تصاویر پینٹنگ کی مثالیں ہیں۔ اصل تصاویر بائیں طرف ہیں، ماسک کی تصویر مرکز میں ہے، اور ماڈل کی طرف سے تیار کردہ پینٹ شدہ تصویر دائیں طرف ہے۔ پہلی مثال کے طور پر، ماڈل کو اصل تصویر، ایک ماسک امیج، اور ٹیکسٹول پرامپٹ "ایک سفید بلی، نیلی آنکھیں، سویٹر پہنے، پارک میں لیٹی ہوئی" کے ساتھ ساتھ منفی پرامپٹ "خراب طریقے سے کھینچے ہوئے پاؤں" کے ساتھ فراہم کیا گیا تھا۔ " دوسری مثال کے طور پر، متن کا اشارہ تھا "ایک خاتون ماڈل خوبصورتی سے ایک آرام دہ اور پرسکون لمبے لباس کی نمائش کرتی ہے جس میں گلابی اور نیلے رنگوں کا امتزاج ہوتا ہے،"

Stable Diffusion جیسے بڑے ماڈلز کو چلانے کے لیے حسب ضرورت انفرنس اسکرپٹس کی ضرورت ہوتی ہے۔ اس بات کو یقینی بنانے کے لیے کہ اسکرپٹ، ماڈل، اور مطلوبہ مثال ایک ساتھ موثر طریقے سے کام کرتے ہیں، آپ کو آخر سے آخر تک ٹیسٹ چلانے ہوں گے۔ جمپ اسٹارٹ استعمال کے لیے تیار اسکرپٹ فراہم کرکے اس عمل کو آسان بناتا ہے جن کا مضبوطی سے تجربہ کیا گیا ہے۔ آپ اسٹوڈیو UI کے ذریعے ایک کلک کے ساتھ یا کوڈ کی بہت کم لائنوں کے ساتھ ان اسکرپٹس تک رسائی حاصل کر سکتے ہیں۔ جمپ اسٹارٹ APIs.

مندرجہ ذیل حصے آپ کو ماڈل کی تعیناتی اور اسٹوڈیو UI یا JumpStart APIs کا استعمال کرتے ہوئے اندازہ لگانے میں رہنمائی کرتے ہیں۔

نوٹ کریں کہ اس ماڈل کو استعمال کرکے، آپ اس سے اتفاق کرتے ہیں۔ CreativeML اوپن RAIL++-M لائسنس.

اسٹوڈیو UI کے ذریعے جمپ اسٹارٹ تک رسائی حاصل کریں۔

اس سیکشن میں، ہم اسٹوڈیو UI کا استعمال کرتے ہوئے جمپ اسٹارٹ ماڈلز کی تعیناتی کی مثال دیتے ہیں۔ ساتھ والی ویڈیو جمپ سٹارٹ پر پہلے سے تربیت یافتہ اسٹیبل ڈفیوژن ان پینٹنگ ماڈل کو تلاش کرنے اور اسے تعینات کرنے کا مظاہرہ کرتی ہے۔ ماڈل صفحہ ماڈل اور اس کے استعمال کے بارے میں ضروری تفصیلات پیش کرتا ہے۔ اندازہ لگانے کے لیے، ہم ml.p3.2xlarge مثال کی قسم کو استعمال کرتے ہیں، جو سستی قیمت پر کم تاخیر کے تخمینے کے لیے مطلوبہ GPU ایکسلریشن فراہم کرتا ہے۔ سیج میکر ہوسٹنگ مثال ترتیب دینے کے بعد، منتخب کریں۔ تعینات. اختتامی نقطہ آپریشنل ہو جائے گا اور تقریباً 10 منٹ کے اندر اندراج کی درخواستوں کو سنبھالنے کے لیے تیار ہو جائے گا۔

جمپ سٹارٹ ایک نمونہ نوٹ بک فراہم کرتا ہے جو نئے بنائے گئے اختتامی نقطہ پر اندازہ لگانے میں لگنے والے وقت کو تیز کرنے میں مدد کر سکتا ہے۔ اسٹوڈیو میں نوٹ بک تک رسائی کے لیے، منتخب کریں۔ نوٹ بک کھولیں۔ میں اسٹوڈیو سے اینڈ پوائنٹ کا استعمال کریں۔ ماڈل اینڈ پوائنٹ پیج کا سیکشن۔

SageMaker SDK کے ساتھ JumpStart پروگرام کے مطابق استعمال کریں۔

جمپ اسٹارٹ UI کا استعمال آپ کو پہلے سے تربیت یافتہ ماڈل کو صرف چند کلکس کے ساتھ انٹرایکٹو طور پر تعینات کرنے کے قابل بناتا ہے۔ متبادل طور پر، آپ SageMaker Python SDK کے اندر مربوط APIs کا استعمال کر کے پروگرام کے مطابق جمپ سٹارٹ ماڈلز کو استعمال کر سکتے ہیں۔

اس سیکشن میں، ہم جمپ سٹارٹ میں ایک مناسب پہلے سے تربیت یافتہ ماڈل کا انتخاب کرتے ہیں، اس ماڈل کو سیج میکر اینڈ پوائنٹ پر تعینات کرتے ہیں، اور تعینات کیے گئے اختتامی نقطہ پر اندازہ لگاتے ہیں، یہ سب SageMaker Python SDK کا استعمال کرتے ہوئے کرتے ہیں۔ درج ذیل مثالیں کوڈ کے ٹکڑوں پر مشتمل ہیں۔ اس مظاہرے میں شامل تمام مراحل کے ساتھ مکمل کوڈ تک رسائی حاصل کرنے کے لیے، ملاحظہ کریں۔ جمپ اسٹارٹ امیج ایڈیٹنگ کا تعارف – مستحکم ڈفیوژن انپینٹنگ مثال کے طور پر نوٹ بک.

پہلے سے تربیت یافتہ ماڈل تعینات کریں۔

سیج میکر ڈوکر کنٹینرز کو مختلف تعمیراتی اور رن ٹائم کاموں کے لیے استعمال کرتا ہے۔ جمپ اسٹارٹ استعمال کرتا ہے۔ سیج میکر ڈیپ لرننگ کنٹینرز (DLCs) جو فریم ورک کے لیے مخصوص ہیں۔ ہم سب سے پہلے کسی بھی اضافی پیکج کے ساتھ ساتھ منتخب کردہ کام کے لیے تربیت اور تخمینہ کو سنبھالنے کے لیے اسکرپٹس لاتے ہیں۔ پھر پہلے سے تربیت یافتہ ماڈل کے نمونے الگ سے لائے جاتے ہیں۔ model_uris، جو پلیٹ فارم کو لچک فراہم کرتا ہے۔ یہ ایک ہی انفرنس اسکرپٹ کے ساتھ متعدد پہلے سے تربیت یافتہ ماڈلز کو استعمال کرنے کی اجازت دیتا ہے۔ مندرجہ ذیل کوڈ اس عمل کی وضاحت کرتا ہے:

اگلا، ہم ان وسائل کو a کو فراہم کرتے ہیں۔ سیج میکر ماڈل مثال کے طور پر اور ایک اختتامی نقطہ تعینات کریں:

ماڈل کے تعینات ہونے کے بعد، ہم اس سے حقیقی وقت کی پیشن گوئیاں حاصل کر سکتے ہیں!

ان پٹ

ان پٹ بنیادی تصویر، ایک ماسک امیج، اور پرامپٹ ہے جو موضوع، آبجیکٹ، یا ماحول کو بیان کرتا ہے جسے ماسک آؤٹ والے حصے میں تبدیل کیا جانا ہے۔ پینٹنگ کے اثرات کے لیے کامل ماسک امیج بنانے میں کئی بہترین طریقے شامل ہیں۔ ایک مخصوص پرامپٹ کے ساتھ شروع کریں، اور مطلوبہ نتائج حاصل کرنے کے لیے مختلف Stable Diffusion ترتیبات کے ساتھ تجربہ کرنے میں ہچکچاہٹ محسوس نہ کریں۔ ایک ماسک امیج کا استعمال کریں جو اس تصویر سے مشابہت رکھتا ہو جس کا آپ پینٹ کرنا چاہتے ہیں۔ یہ نقطہ نظر تصویر کے گمشدہ حصوں کو مکمل کرنے میں پینٹنگ الگورتھم کی مدد کرتا ہے، جس کے نتیجے میں زیادہ قدرتی ظاہر ہوتا ہے۔ اعلیٰ کوالٹی کی تصاویر عام طور پر بہتر نتائج دیتی ہیں، اس لیے یقینی بنائیں کہ آپ کی بیس اور ماسک کی تصاویر اچھے معیار کی ہیں اور ایک دوسرے سے مشابہت رکھتی ہیں۔ مزید برآں، تفصیل کو محفوظ رکھنے اور نمونے کو کم سے کم کرنے کے لیے ایک بڑی اور ہموار ماسک تصویر کا انتخاب کریں۔

اختتامی نقطہ بنیادی تصویر اور ماسک کو خام RGB اقدار یا ایک base64 انکوڈ شدہ تصویر کے طور پر قبول کرتا ہے۔ انفرنس ہینڈلر اس کی بنیاد پر تصویر کو ڈی کوڈ کرتا ہے۔ content_type:

- کے لئے

content_type = “application/json”, ان پٹ پے لوڈ خام RGB اقدار، ٹیکسٹول پرامپٹ، اور دیگر اختیاری پیرامیٹرز کے ساتھ JSON ڈکشنری ہونا چاہیے - کے لئے

content_type = “application/json;jpeg”، ان پٹ پے لوڈ بنیادی 64 انکوڈ شدہ امیج کے ساتھ JSON لغت، ایک ٹیکسٹول پرامپٹ، اور دیگر اختیاری پیرامیٹرز ہونا ضروری ہے

آؤٹ پٹ

اختتامی نقطہ دو قسم کی آؤٹ پٹ پیدا کر سکتا ہے: ایک Base64-encoded RGB امیج یا تخلیق کردہ تصاویر کی JSON لغت۔ آپ سیٹ کر کے بتا سکتے ہیں کہ آپ کون سا آؤٹ پٹ فارمیٹ چاہتے ہیں۔ accept کو ہیڈر "application/json" or "application/json;jpeg" بالترتیب JPEG امیج یا base64 کے لیے۔

- کے لئے

accept = “application/json”، اختتامی نقطہ تصویر کے لیے RGB اقدار کے ساتھ JSON لغت لوٹاتا ہے۔ - کے لئے

accept = “application/json;jpeg”، اختتامی نقطہ JPEG امیج کے ساتھ ایک JSON لغت واپس کرتا ہے کیونکہ base64.b64 انکوڈنگ کے ساتھ انکوڈ شدہ بائٹس

نوٹ کریں کہ خام RGB قدروں کے ساتھ پے لوڈ بھیجنا یا وصول کرنا ان پٹ پے لوڈ اور رسپانس سائز کے لیے پہلے سے طے شدہ حد تک پہنچ سکتا ہے۔ لہذا، ہم سیٹنگ کے ذریعہ بیس 64 انکوڈ شدہ تصویر کو استعمال کرنے کی تجویز کرتے ہیں۔ content_type = “application/json;jpeg” اور قبول کریں = "application/json;jpeg"۔

مندرجہ ذیل کوڈ ایک مثال استدلال کی درخواست ہے:

تائید شدہ پیرامیٹرز

مستحکم ڈفیوژن انپینٹنگ ماڈل تصویر بنانے کے لیے بہت سے پیرامیٹرز کی حمایت کرتے ہیں:

- تصویر - اصل تصویر۔

- ماسک - ایک ایسی تصویر جہاں تصویر بنانے کے دوران بلیک آؤٹ حصہ تبدیل نہیں ہوتا ہے اور سفید حصہ بدل دیا جاتا ہے۔

- پرامپٹ - امیج جنریشن کی رہنمائی کے لیے ایک اشارہ۔ یہ تار یا تاروں کی فہرست ہو سکتی ہے۔

- num_inference_steps (اختیاری) - تصویر بنانے کے دوران ڈینوائزنگ اقدامات کی تعداد۔ مزید اقدامات اعلی معیار کی تصویر کی طرف لے جاتے ہیں۔ اگر بیان کیا جائے تو یہ ایک مثبت عدد ہونا چاہیے۔ نوٹ کریں کہ مزید قیاس کے اقدامات سے جوابی وقت کا طویل وقت ہوگا۔

- رہنمائی_پیمانہ (اختیاری) - اعلی رہنمائی کے پیمانے کے نتیجے میں تصویر کے معیار کی قیمت پر، پرامپٹ سے زیادہ قریب سے تعلق رکھنے والی تصویر سامنے آتی ہے۔ اگر بیان کیا گیا ہے، تو یہ ایک فلوٹ ہونا چاہیے۔

guidance_scale<=1نظر انداز کیا جاتا ہے۔ - منفی_پرامپٹ (اختیاری) - یہ اس پرامپٹ کے خلاف امیج جنریشن کی رہنمائی کرتا ہے۔ اگر متعین کیا گیا ہو، تو یہ سٹرنگ یا تاروں کی فہرست ہونی چاہیے اور اس کے ساتھ استعمال کی جائے۔

guidance_scale. اگرguidance_scaleغیر فعال ہے، یہ بھی غیر فعال ہے۔ مزید یہ کہ، اگر پرامپٹ تاروں کی فہرست ہے، تو پھرnegative_promptتاروں کی فہرست بھی ہونی چاہیے۔ - بیج (اختیاری) - یہ تولیدی صلاحیت کے لیے بے ترتیب حالت کو ٹھیک کرتا ہے۔ اگر متعین کیا جائے تو یہ ایک عدد عدد ہونا چاہیے۔ جب بھی آپ ایک ہی بیج کے ساتھ ایک ہی پرامپٹ کا استعمال کرتے ہیں، نتیجہ کی تصویر ہمیشہ ایک جیسی ہوگی۔

- بیچ_سائز (اختیاری) - ایک ہی فارورڈ پاس میں تخلیق کرنے والی تصاویر کی تعداد۔ اگر چھوٹی مثال استعمال کر رہے ہیں یا بہت سی تصاویر تیار کر رہے ہیں تو کم کریں۔

batch_sizeایک چھوٹی تعداد (1-2) ہونا۔ تصاویر کی تعداد = اشارے کی تعداد*num_images_per_prompt.

حدود اور تعصبات

اگرچہ Stable Diffusion inpainting میں متاثر کن کارکردگی رکھتا ہے، لیکن یہ کئی حدود اور تعصبات کا شکار ہے۔ ان میں شامل ہیں لیکن ان تک محدود نہیں ہیں:

- ماڈل درست چہرے یا اعضاء نہیں بنا سکتا کیونکہ تربیتی ڈیٹا میں ان خصوصیات کے ساتھ کافی تصاویر شامل نہیں ہیں۔

- ماڈل کو تربیت دی گئی۔ LAION-5B ڈیٹاسیٹ، جس میں بالغوں کا مواد ہے اور ہو سکتا ہے کہ مزید غور و فکر کے بغیر پروڈکٹ کے استعمال کے لیے موزوں نہ ہو۔

- ہو سکتا ہے کہ ماڈل غیر انگریزی زبانوں کے ساتھ اچھی طرح کام نہ کرے کیونکہ ماڈل کو انگریزی زبان کے متن پر تربیت دی گئی تھی۔

- ماڈل تصاویر کے اندر اچھا متن نہیں بنا سکتا۔

- مستحکم ڈفیوژن ان پینٹنگ عام طور پر کم ریزولیوشن کی تصاویر کے ساتھ بہترین کام کرتی ہے، جیسے کہ 256×256 یا 512×512 پکسلز۔ ہائی ریزولوشن امیجز (768×768 یا اس سے زیادہ) کے ساتھ کام کرتے وقت، طریقہ معیار اور تفصیل کی مطلوبہ سطح کو برقرار رکھنے کے لیے جدوجہد کر سکتا ہے۔

- اگرچہ بیج کے استعمال سے تولیدی صلاحیت کو کنٹرول کرنے میں مدد مل سکتی ہے، لیکن مستحکم ڈفیوژن ان پینٹنگ اب بھی ان پٹ یا پیرامیٹرز میں معمولی تبدیلیوں کے ساتھ مختلف نتائج پیدا کر سکتی ہے۔ اس سے مخصوص ضروریات کے لیے آؤٹ پٹ کو ٹھیک کرنا مشکل ہو سکتا ہے۔

- یہ طریقہ پیچیدہ بناوٹ اور نمونوں کو پیدا کرنے کے ساتھ جدوجہد کر سکتا ہے، خاص طور پر جب وہ تصویر کے اندر بڑے حصے پر محیط ہوں یا پینٹ شدہ علاقے کی مجموعی ہم آہنگی اور معیار کو برقرار رکھنے کے لیے ضروری ہوں۔

حدود اور تعصب کے بارے میں مزید معلومات کے لیے، ملاحظہ کریں۔ مستحکم بازی انپینٹنگ ماڈل کارڈ.

پرامپٹ کے ذریعے تیار کردہ ماسک کے ساتھ پینٹنگ کا حل

CLIPSeq ایک اعلی درجے کی گہری سیکھنے کی تکنیک ہے جو ان پٹ امیجز سے ماسک تیار کرنے کے لیے پہلے سے تربیت یافتہ CLIP (Contrastive Language-Image Pretraining) ماڈلز کی طاقت کو استعمال کرتی ہے۔ یہ نقطہ نظر امیج سیگمنٹیشن، پینٹنگ، اور ہیرا پھیری جیسے کاموں کے لیے ماسک بنانے کا ایک موثر طریقہ فراہم کرتا ہے۔ CLIPSeq ان پٹ امیج کی ٹیکسٹ تفصیل تیار کرنے کے لیے CLIP کا استعمال کرتا ہے۔ اس کے بعد ٹیکسٹ ڈسکرپشن کا استعمال ایک ماسک بنانے کے لیے کیا جاتا ہے جو تصویر میں موجود پکسلز کی شناخت کرتا ہے جو ٹیکسٹ ڈسکرپشن سے متعلق ہیں۔ اس کے بعد ماسک کو مزید پروسیسنگ کے لیے تصویر کے متعلقہ حصوں کو الگ کرنے کے لیے استعمال کیا جا سکتا ہے۔

CLIPSeq کے ان پٹ امیجز سے ماسک بنانے کے دوسرے طریقوں کے مقابلے میں بہت سے فوائد ہیں۔ سب سے پہلے، یہ ایک زیادہ کارآمد طریقہ ہے، کیونکہ اس کی ضرورت نہیں ہے کہ تصویر کو الگ الگ امیج سیگمنٹیشن الگورتھم کے ذریعے پروسیس کیا جائے۔ دوسرا، یہ زیادہ درست ہے، کیونکہ یہ ایسے ماسک تیار کر سکتا ہے جو تصویر کے متن کی تفصیل کے ساتھ زیادہ قریب سے منسلک ہوں۔ تیسرا، یہ زیادہ ورسٹائل ہے، کیونکہ آپ اسے مختلف قسم کی تصاویر سے ماسک بنانے کے لیے استعمال کر سکتے ہیں۔

تاہم، CLIPSeq کے کچھ نقصانات بھی ہیں۔ سب سے پہلے، تکنیک میں موضوع کے لحاظ سے حدود ہو سکتی ہیں، کیونکہ یہ پہلے سے تربیت یافتہ CLIP ماڈلز پر انحصار کرتی ہے جو مخصوص ڈومینز یا مہارت کے شعبوں کو شامل نہیں کر سکتے۔ دوسرا، یہ ایک حساس طریقہ ہو سکتا ہے، کیونکہ یہ تصویر کے متن کی وضاحت میں غلطیوں کے لیے حساس ہے۔

مزید معلومات کے لئے ملاحظہ کریں Amazon SageMaker کا استعمال کرتے ہوئے جنریٹیو AI کے ساتھ ورچوئل فیشن اسٹائلنگ.

صاف کرو

نوٹ بک چلانے کے بعد، اس بات کو یقینی بنانے کے لیے کہ بلنگ روک دی گئی ہے اس عمل میں بنائے گئے تمام وسائل کو حذف کرنا یقینی بنائیں۔ اختتامی نقطہ کو صاف کرنے کا کوڈ متعلقہ میں دستیاب ہے۔ نوٹ بک.

نتیجہ

اس پوسٹ میں، ہم نے دکھایا کہ جمپ اسٹارٹ کا استعمال کرتے ہوئے پہلے سے تربیت یافتہ اسٹیبل ڈفیوژن ان پینٹنگ ماڈل کو کیسے تعینات کیا جائے۔ ہم نے اس پوسٹ میں کوڈ کے ٹکڑوں کو دکھایا — اس ڈیمو کے تمام مراحل کے ساتھ مکمل کوڈ اس میں دستیاب ہے۔ جمپ سٹارٹ کا تعارف - تصویر کے معیار کو پرامپٹ کے ذریعے بہتر بنائیں مثال کے طور پر نوٹ بک. خود ہی حل آزمائیں اور ہمیں اپنی رائے بھیجیں۔

ماڈل کے بارے میں مزید جاننے کے لیے اور یہ کیسے کام کرتا ہے، درج ذیل وسائل دیکھیں:

جمپ اسٹارٹ کے بارے میں مزید جاننے کے لیے، درج ذیل پوسٹس کو چیک کریں:

مصنفین کے بارے میں

ڈاکٹر وویک مدن Amazon SageMaker جمپ سٹارٹ ٹیم کے ساتھ ایک اپلائیڈ سائنٹسٹ ہے۔ انہوں نے Urbana-Champaign میں یونیورسٹی آف الینوائے سے پی ایچ ڈی کی اور جارجیا ٹیک میں پوسٹ ڈاکٹریٹ ریسرچر تھے۔ وہ مشین لرننگ اور الگورتھم ڈیزائن میں ایک فعال محقق ہے اور اس نے EMNLP، ICLR، COLT، FOCS، اور SODA کانفرنسوں میں مقالے شائع کیے ہیں۔

ڈاکٹر وویک مدن Amazon SageMaker جمپ سٹارٹ ٹیم کے ساتھ ایک اپلائیڈ سائنٹسٹ ہے۔ انہوں نے Urbana-Champaign میں یونیورسٹی آف الینوائے سے پی ایچ ڈی کی اور جارجیا ٹیک میں پوسٹ ڈاکٹریٹ ریسرچر تھے۔ وہ مشین لرننگ اور الگورتھم ڈیزائن میں ایک فعال محقق ہے اور اس نے EMNLP، ICLR، COLT، FOCS، اور SODA کانفرنسوں میں مقالے شائع کیے ہیں۔

الفریڈ شین AWS میں ایک سینئر AI/ML ماہر ہے۔ وہ سلیکون ویلی میں کام کر رہے ہیں، صحت کی دیکھ بھال، فنانس اور ہائی ٹیک سمیت مختلف شعبوں میں تکنیکی اور انتظامی عہدوں پر فائز ہیں۔ وہ ایک سرشار اطلاق شدہ AI/ML محقق ہے، جو CV، NLP، اور ملٹی موڈیلیٹی پر توجہ مرکوز کرتا ہے۔ ان کے کام کو EMNLP، ICLR، اور پبلک ہیلتھ جیسی اشاعتوں میں دکھایا گیا ہے۔

الفریڈ شین AWS میں ایک سینئر AI/ML ماہر ہے۔ وہ سلیکون ویلی میں کام کر رہے ہیں، صحت کی دیکھ بھال، فنانس اور ہائی ٹیک سمیت مختلف شعبوں میں تکنیکی اور انتظامی عہدوں پر فائز ہیں۔ وہ ایک سرشار اطلاق شدہ AI/ML محقق ہے، جو CV، NLP، اور ملٹی موڈیلیٹی پر توجہ مرکوز کرتا ہے۔ ان کے کام کو EMNLP، ICLR، اور پبلک ہیلتھ جیسی اشاعتوں میں دکھایا گیا ہے۔

- SEO سے چلنے والا مواد اور PR کی تقسیم۔ آج ہی بڑھا دیں۔

- پلیٹو بلاک چین۔ Web3 Metaverse Intelligence. علم میں اضافہ۔ یہاں تک رسائی حاصل کریں۔

- ماخذ: https://aws.amazon.com/blogs/machine-learning/inpaint-images-with-stable-diffusion-using-amazon-sagemaker-jumpstart/

- : ہے

- $UP

- 10

- 100

- 2022

- 7

- a

- ہمارے بارے میں

- رفتار کو تیز تر

- قبول کریں

- قبول کرتا ہے

- تک رسائی حاصل

- درستگی

- درست

- حاصل

- فعال

- ایڈیشنل

- اس کے علاوہ

- بالغ

- اعلی درجے کی

- فوائد

- سستی

- کے بعد

- کے خلاف

- AI

- AI / ML

- ایڈز

- یلگورتم

- منسلک

- تمام

- کی اجازت دیتا ہے

- ہمیشہ

- ایمیزون

- ایمیزون سیج میکر

- ایمیزون سیج میکر جمپ اسٹارٹ

- اور

- ایک اور

- اے پی آئی

- APIs

- اطلاقی

- نقطہ نظر

- مناسب

- تقریبا

- ارکیٹیکچرل

- کیا

- رقبہ

- علاقوں

- AS

- At

- خود کار طریقے سے

- دستیاب

- AWS

- بیس

- کی بنیاد پر

- BE

- کیونکہ

- BEST

- بہترین طریقوں

- بہتر

- تعصب

- بلنگ

- مرکب

- بلیو

- تعمیر

- عمارت

- by

- کر سکتے ہیں

- کیس

- انیت

- CAT

- باعث

- سینٹر

- کچھ

- چیلنج

- چیک کریں

- میں سے انتخاب کریں

- طبقے

- کلک کریں

- کلینکل

- قریب سے

- کوڈ

- تبصروں

- مکمل

- مکمل کرنا

- وسیع

- کانفرنسوں

- خیالات

- تعمیر

- پر مشتمل ہے

- کنٹینر

- کنٹینر

- مواد

- کنٹرول

- تخلیق

- بنائی

- تخلیق

- اپنی مرضی کے

- گاہکوں

- اعداد و شمار

- ڈیٹا کے نقصان

- وقف

- گہری

- گہری سیکھنے

- پہلے سے طے شدہ

- فراہم کرتا ہے

- ثبوت

- تعیناتی

- تعینات

- تعینات

- تعیناتی

- بیان کیا

- تفصیل

- ڈیزائن

- مطلوبہ

- تفصیل

- تفصیلات

- براڈ کاسٹننگ

- غیر فعال کر دیا

- متنوع

- میں Docker

- نہیں کرتا

- ڈومینز

- نہیں

- کے دوران

- ہر ایک

- مؤثر طریقے

- اثرات

- ہنر

- مؤثر طریقے سے

- یا تو

- کے قابل بناتا ہے

- آخر سے آخر تک

- اختتام پوائنٹ

- انگریزی

- کو یقینی بنانے کے

- اندراج

- ماحولیات

- نقائص

- خاص طور پر

- ضروری

- مثال کے طور پر

- مثال کے طور پر

- بہت پرجوش

- تجربہ

- مہارت

- آنکھیں

- چہرے

- فیشن

- نمایاں کریں

- خصوصیات

- خاصیت

- فٹ

- خواتین

- بازیافت

- چند

- فائل

- کی مالی اعانت

- پہلا

- فٹ

- لچک

- فلوٹ

- کے بعد

- کے لئے

- فارمیٹ

- آگے

- سے

- مکمل

- مزید

- عام طور پر

- پیدا

- پیدا

- پیدا کرنے والے

- نسل

- پیداواری

- پیداواری AI۔

- جارجیا

- اچھا

- GPU

- رہنمائی

- رہنمائی

- ہدایات

- ہینڈل

- ہے

- سر

- صحت

- صحت کی دیکھ بھال

- مدد

- اعلی معیار کی

- بهترین ریزولوشن

- اعلی

- مارو

- انعقاد

- ہوسٹنگ

- کس طرح

- کیسے

- HTML

- HTTPS

- شناخت

- ایلی نوائے

- تصویر

- تصاویر

- امیجنگ

- متاثر کن

- in

- شامل

- شامل

- سمیت

- معلومات

- ان پٹ

- مثال کے طور پر

- ضم

- انٹرفیس

- متعارف کرانے

- IT

- میں

- فوٹو

- JSON

- زبان

- زبانیں

- بڑے

- قیادت

- جانیں

- سیکھنے

- سطح

- کی طرح

- حدود

- لمیٹڈ

- حدود

- لائنوں

- لسٹ

- لانگ

- اب

- بند

- مشین

- مشین لرننگ

- برقرار رکھنے کے

- برقرار رکھنے

- بنا

- انتظامیہ

- ہیرا پھیری

- بہت سے

- ماسک

- ماسک

- معاملہ

- مئی..

- طریقہ

- طریقوں

- شاید

- منٹ

- لاپتہ

- تخفیف کریں

- ML

- ماڈل

- ماڈل

- زیادہ

- زیادہ موثر

- اس کے علاوہ

- یمآرآئ

- ایک سے زیادہ

- قدرتی

- ضرورت ہے

- منفی

- نئی

- ویزا

- نوٹ بک

- ناول

- نومبر

- تعداد

- اعتراض

- حاصل

- of

- تجویز

- on

- ایک

- کھول

- آپریشنل

- حکم

- اصل

- دیگر

- خطوط

- پیداوار

- مجموعی طور پر

- خود

- پیکجوں کے

- صفحہ

- کاغذات

- پیرامیٹرز

- پارک

- حصے

- منظور

- پیٹرن

- کامل

- انجام دیں

- کارکردگی

- پلیٹ فارم

- پلاٹا

- افلاطون ڈیٹا انٹیلی جنس

- پلیٹو ڈیٹا

- پوائنٹ

- پوزیشنوں

- مثبت

- پوسٹ

- مراسلات

- طاقت

- طریقوں

- عین مطابق

- پیشن گوئی

- پیش گو

- تیار

- حال (-)

- قیمت

- عمل

- عملدرآمد

- پروسیسنگ

- پیدا

- مصنوعات

- فراہم

- فراہم

- فراہم کرتا ہے

- فراہم کرنے

- عوامی

- صحت عامہ

- مطبوعات

- شائع

- ازگر

- معیار

- بے ترتیب

- خام

- اصل وقت

- دائرے میں

- وصول کرنا

- سفارش

- کو کم

- کم

- مراد

- خطے

- متعلقہ

- متعلقہ

- باقی

- مرمت

- کی جگہ

- درخواست

- درخواستوں

- کی ضرورت

- ضرورت

- ضروریات

- کی ضرورت ہے

- محقق

- اسی طرح

- وسائل

- جواب

- بحال

- نتیجے

- نتائج کی نمائش

- واپسی

- واپسی

- RGB

- رن

- چل رہا ہے

- sagemaker

- اسی

- پیمانے

- سائنسدان

- سکرپٹ

- sdk

- دوسری

- سیکشن

- سیکشنز

- سیکٹر

- بیج

- انقطاع

- منتخب

- بھیجنا

- سینئر

- حساس

- علیحدہ

- قائم کرنے

- ترتیبات

- کئی

- سلیکن

- سلیکن ویلی

- ایک

- سائز

- چھوٹے

- چھوٹے

- So

- حل

- کچھ

- دورانیہ

- ماہر

- مخصوص

- مخصوص

- مستحکم

- شروع کریں

- حالت

- مراحل

- ابھی تک

- بند کر دیا

- سلک

- جدوجہد

- سٹوڈیو

- موضوع

- اس طرح

- تکلیفیں

- کافی

- حمایت

- مناسب

- لیتا ہے

- ٹاسک

- کاموں

- ٹیم

- ٹیک

- ٹیکنیکل

- شرائط

- ٹیسٹ

- کہ

- ۔

- لہذا

- یہ

- تھرڈ

- کے ذریعے

- وقت

- کرنے کے لئے

- آج

- مل کر

- تربیت یافتہ

- ٹریننگ

- اقسام

- عام طور پر

- ui

- یونیورسٹی

- us

- استعمال

- استعمال کی شرائط

- رکن کا

- صارف مواجہ

- صارفین

- استعمال

- استعمال کرتا ہے

- وادی

- اقدار

- مختلف اقسام کے

- مختلف

- ورسٹائل

- کی طرف سے

- ویڈیو

- راستہ..

- اچھا ہے

- جس

- سفید

- وسیع

- گے

- ساتھ

- کے اندر

- بغیر

- کام

- مل کے کام کرو

- کام کر

- کام کرتا ہے

- پیداوار

- تم

- اور

- زیفیرنیٹ