پچھلے کچھ سالوں میں، آن لائن ایجوکیشن پلیٹ فارمز کو اپنانے میں اضافہ ہوا ہے اور ویڈیو پر مبنی سیکھنے کی مانگ میں اضافہ دیکھا گیا ہے کیونکہ یہ سیکھنے والوں کو مشغول کرنے کا ایک مؤثر ذریعہ پیش کرتا ہے۔ بین الاقوامی منڈیوں تک پھیلنے اور ثقافتی اور لسانی اعتبار سے متنوع آبادی کو حل کرنے کے لیے، کاروبار بھی متعدد زبانوں میں مواد کو مقامی بنا کر اپنی سیکھنے کی پیشکش کو متنوع بنانے پر غور کر رہے ہیں۔ یہ کاروبار اپنے لوکلائزیشن کے استعمال کے معاملات کو حل کرنے کے لیے قابل بھروسہ اور لاگت سے موثر طریقے تلاش کر رہے ہیں۔

مواد کو مقامی بنانے میں بنیادی طور پر اصل آوازوں کا نئی زبانوں میں ترجمہ کرنا اور سب ٹائٹلز جیسی بصری امداد شامل کرنا شامل ہے۔ روایتی طور پر، یہ عمل لاگت سے ممنوع، دستی، اور بہت زیادہ وقت لیتا ہے، بشمول لوکلائزیشن کے ماہرین کے ساتھ کام کرنا۔ AWS مشین لرننگ (ML) خدمات کی طاقت کے ساتھ جیسے ایمیزون نقل, ایمیزون ترجمہ، اور ایمیزون پولی، آپ ایک قابل عمل اور لاگت سے موثر لوکلائزیشن حل تشکیل دے سکتے ہیں۔ آپ اپنے موجودہ آڈیو اور ویڈیو اسٹریمز کا ٹرانسکرپٹ بنانے کے لیے Amazon ٹرانسکرپٹ کا استعمال کر سکتے ہیں، اور پھر Amazon Translate کا استعمال کرتے ہوئے اس ٹرانسکرپٹ کا متعدد زبانوں میں ترجمہ کر سکتے ہیں۔ اس کے بعد آپ ایمیزون پولی، ایک ٹیکسٹ ٹو اسپیچ سروس کا استعمال کر سکتے ہیں، تاکہ ترجمہ شدہ متن کو قدرتی آواز والی انسانی تقریر میں تبدیل کیا جا سکے۔

لوکلائزیشن کا اگلا مرحلہ مواد میں سب ٹائٹلز شامل کرنا ہے، جو رسائی اور فہم کو بہتر بنا سکتا ہے، اور ناظرین کو ویڈیوز کو بہتر طور پر سمجھنے میں مدد کرتا ہے۔ ویڈیو مواد پر سب ٹائٹل بنانا مشکل ہو سکتا ہے کیونکہ ترجمہ شدہ تقریر اصل اسپیچ ٹائمنگ سے مماثل نہیں ہے۔ آڈیو اور سب ٹائٹلز کے درمیان اس مطابقت پذیری پر غور کرنا ایک اہم کام ہے کیونکہ یہ سامعین کو آپ کے مواد سے منقطع کر سکتا ہے اگر وہ مطابقت پذیر نہیں ہیں۔ ایمیزون پولی کو فعال کرنے کے ذریعے اس چیلنج کا حل پیش کرتا ہے۔ تقریر کے نشانات، جسے آپ ایک سب ٹائٹل فائل بنانے کے لیے استعمال کر سکتے ہیں جسے تخلیق کردہ اسپیچ آؤٹ پٹ کے ساتھ ہم آہنگ کیا جا سکتا ہے۔

اس پوسٹ میں، ہم AWS ML سروسز کا استعمال کرتے ہوئے ایک لوکلائزیشن حل کا جائزہ لیتے ہیں جہاں ہم ایک اصل انگریزی ویڈیو استعمال کرتے ہیں اور اسے ہسپانوی میں تبدیل کرتے ہیں۔ ہم ہسپانوی میں مطابقت پذیر سب ٹائٹل فائل بنانے کے لیے اسپیچ مارکس کے استعمال پر بھی توجہ مرکوز کرتے ہیں۔

حل جائزہ

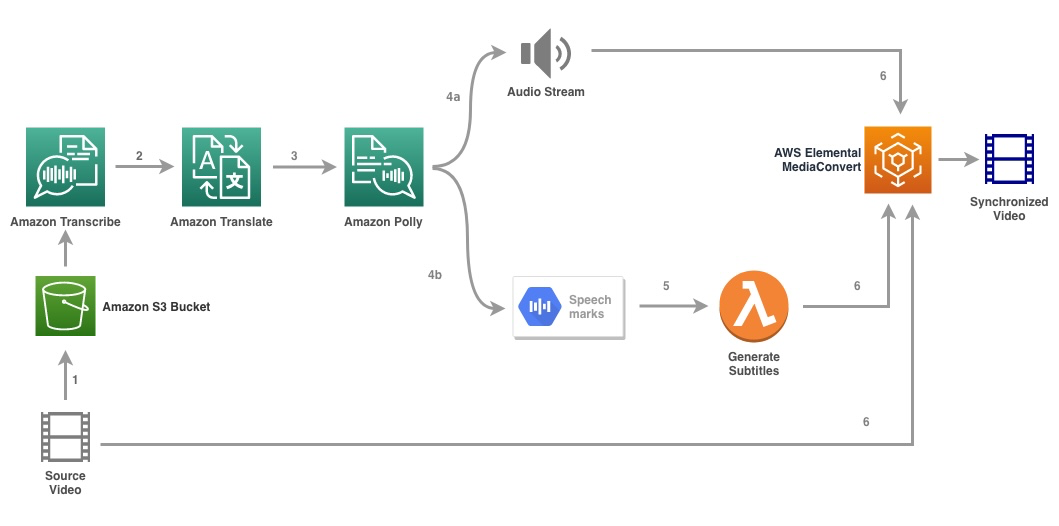

مندرجہ ذیل خاکہ حل کے فن تعمیر کی وضاحت کرتا ہے۔

حل ایک ویڈیو فائل اور ٹارگٹ لینگوئج سیٹنگز کو بطور ان پٹ لیتا ہے اور ویڈیو کا ٹرانسکرپشن بنانے کے لیے ایمیزون ٹرانسکرائب کا استعمال کرتا ہے۔ اس کے بعد ہم نقل کو ہدف کی زبان میں ترجمہ کرنے کے لیے Amazon Translate کا استعمال کرتے ہیں۔ ترجمہ شدہ متن ایمیزون پولی کو ایک ان پٹ کے طور پر فراہم کیا جاتا ہے تاکہ ہدف کی زبان میں آڈیو سٹریم اور اسپیچ مارکس تیار کیا جا سکے۔ ایمیزون پولی کی واپسی۔ اسپیچ مارک آؤٹ پٹ ایک لائن سے الگ کردہ JSON سٹریم میں، جس میں وقت، قسم، آغاز، اختتام، اور قدر جیسے فیلڈز شامل ہیں۔ قیمت ان پٹ میں درخواست کردہ اسپیچ مارک کی قسم کے لحاظ سے مختلف ہو سکتی ہے، جیسے ایس ایس ایم ایل, viseme، لفظ، یا جملہ۔ ہماری مثال کے مقصد کے لیے، ہم نے درخواست کی۔ تقریر کے نشان کی قسم as word. اس اختیار کے ساتھ، Amazon Polly ایک جملے کو جملے میں اپنے انفرادی الفاظ اور آڈیو سٹریم میں ان کے شروع اور اختتام کے اوقات میں توڑ دیتا ہے۔ اس میٹا ڈیٹا کے ساتھ، امیزون پولی کے ذریعہ تیار کردہ متعلقہ آڈیو سٹریم کے لیے ذیلی عنوانات تیار کرنے کے لیے اسپیچ مارکس پر کارروائی کی جاتی ہے۔

آخر میں، ہم استعمال کرتے ہیں AWS عنصری میڈیاکونورٹ ترجمہ شدہ آڈیو اور متعلقہ سب ٹائٹلز کے ساتھ حتمی ویڈیو رینڈر کرنے کے لیے۔

مندرجہ ذیل ویڈیو حل کے حتمی نتائج کو ظاہر کرتی ہے:

AWS سٹیپ فنکشنز ورک فلو

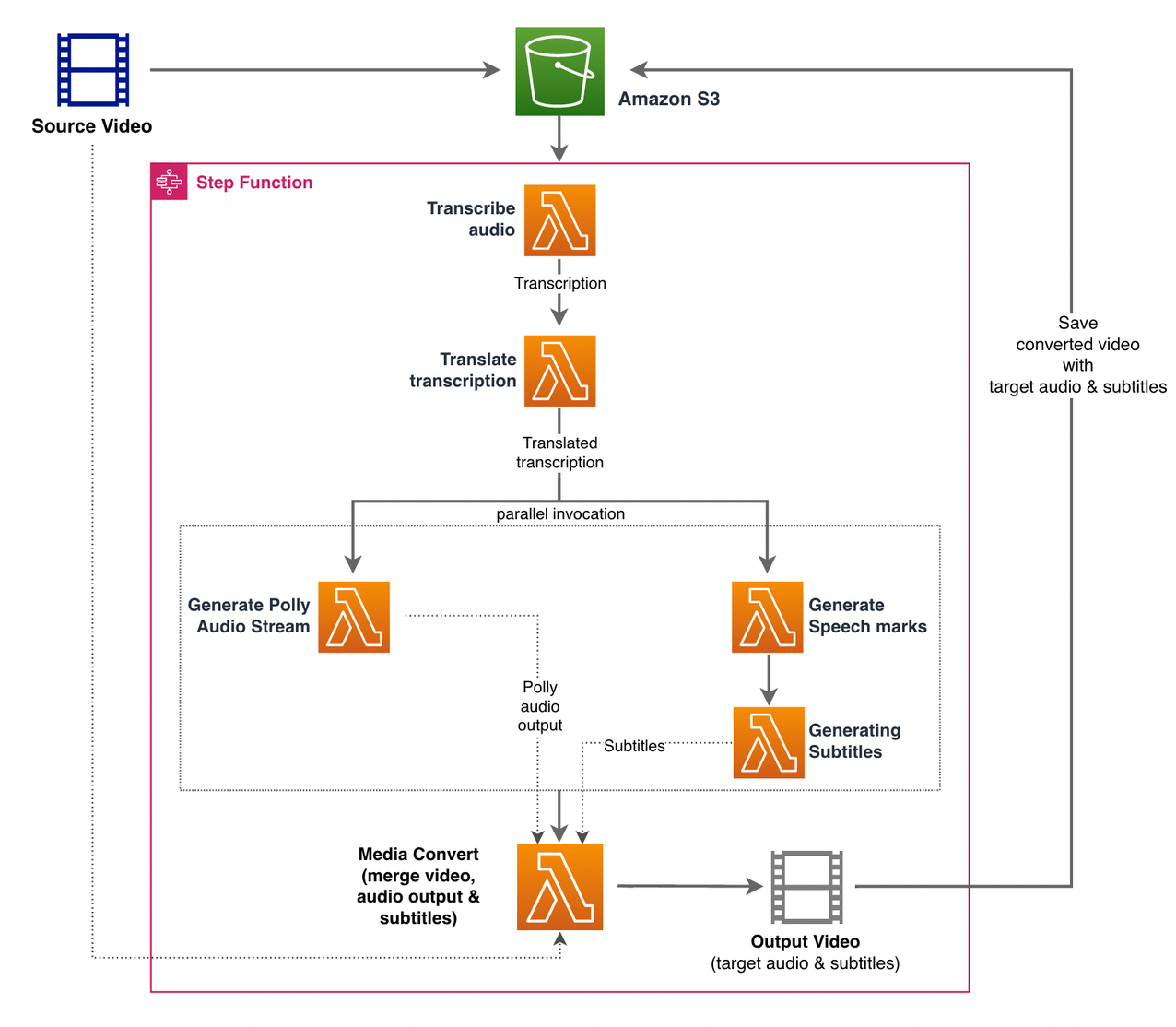

ہم استعمال کرتے ہیں AWS اسٹیپ فنکشنز اس عمل کو ترتیب دینے کے لیے۔ مندرجہ ذیل اعداد و شمار سٹیپ فنکشنز ورک فلو کا ایک اعلیٰ سطحی منظر دکھاتا ہے (بہتر وضاحت کے لیے خاکہ سے کچھ مراحل کو خارج کر دیا گیا ہے)۔

ورک فلو کے مراحل درج ذیل ہیں:

- ایک صارف سورس ویڈیو فائل کو ایک پر اپ لوڈ کرتا ہے۔ ایمیزون سادہ اسٹوریج سروس (ایمیزون S3) بالٹی۔

- ۔ S3 ایونٹ کی اطلاع کو متحرک کرتا ہے۔ او ڈبلیو ایس لامبڈا۔ تقریب state_machine.py (ڈائیگرام میں نہیں دکھایا گیا)، جو سٹیپ فنکشنز سٹیٹ مشین کو طلب کرتا ہے۔

- پہلا قدم، آڈیو کو نقل کریں۔، لیمبڈا فنکشن کا مطالبہ کرتا ہے۔ transscribe.py، جو ماخذ ویڈیو سے آڈیو کی نقل تیار کرنے کے لیے Amazon ٹرانسکرائب کا استعمال کرتا ہے۔

مندرجہ ذیل نمونہ کوڈ یہ ظاہر کرتا ہے کہ ایمیزون ٹرانسکرائب کا استعمال کرتے ہوئے ٹرانسکرپشن جاب کیسے بنایا جائے۔ بوٹو 3 Python SDK:

کام مکمل ہونے کے بعد، آؤٹ پٹ فائلیں S3 بالٹی میں محفوظ ہو جاتی ہیں اور یہ عمل مواد کا ترجمہ کرنے کے اگلے مرحلے تک جاری رہتا ہے۔

- ۔ نقل کا ترجمہ کریں۔ قدم لیمبڈا فنکشن کو طلب کرتا ہے۔ translate.py جو نقل کو ہدف کی زبان میں ترجمہ کرنے کے لیے Amazon Translate کا استعمال کرتا ہے۔ یہاں، ہم استعمال کرتے ہوئے ہم وقت ساز/ریئل ٹائم ترجمہ استعمال کرتے ہیں۔ ترجمہ_متن فنکشن:

ہم وقت ساز ترجمے کی دستاویز کے سائز کی حد ہوتی ہے جس کا وہ ترجمہ کر سکتا ہے۔ اس تحریر کے مطابق، یہ 5,000 بائٹس پر سیٹ ہے۔ دستاویز کے بڑے سائز کے لیے، استعمال کرتے ہوئے جاب تخلیق کرنے کا ایک غیر مطابقت پذیر راستہ استعمال کرنے پر غور کریں۔ شروع_متن_ترجمہ_کام اور اس کے ذریعے اسٹیٹس چیک کر رہا ہے۔ describe_text_translation_job.

- اگلا مرحلہ ایک سٹیپ فنکشنز ہے۔ متوازی ریاست، جہاں ہم اپنی ریاستی مشین میں متوازی شاخیں بناتے ہیں۔

- پہلی شاخ میں، ہم لیمبڈا فنکشن کو لیمبڈا فنکشن کہتے ہیں۔ generate_polly_audio.py ہمارا ایمیزون پولی آڈیو سٹریم بنانے کے لیے:

یہاں ہم استعمال کرتے ہیں۔ شروع_تقریر_سنتھیسس_ٹاسک Amazon Polly Python SDK کا طریقہ تقریر کی ترکیب کے کام کو متحرک کرنے کے لیے جو ایمیزون پولی آڈیو تخلیق کرتا ہے۔ ہم نے سیٹ کیا۔

OutputFormatکرنے کے لئےmp3، جو ایمیزون پولی کو اس API کال کے لیے ایک آڈیو اسٹریم بنانے کے لیے کہتا ہے۔ - دوسری شاخ میں، ہم لیمبڈا فنکشن کو استعمال کرتے ہیں۔ generate_speech_marks.py اسپیچ مارکس آؤٹ پٹ پیدا کرنے کے لیے:

- پہلی شاخ میں، ہم لیمبڈا فنکشن کو لیمبڈا فنکشن کہتے ہیں۔ generate_polly_audio.py ہمارا ایمیزون پولی آڈیو سٹریم بنانے کے لیے:

- ہم دوبارہ استعمال کرتے ہیں۔ شروع_تقریر_سنتھیسس_ٹاسک طریقہ لیکن وضاحت کریں

OutputFormatکرنے کے لئےjson، جو ایمیزون پولی کو اس API کال کے لیے اسپیچ مارکس بنانے کے لیے کہتا ہے۔

دوسری شاخ کے اگلے مرحلے میں، ہم لیمبڈا فنکشن کو استعمال کرتے ہیں۔ generate_subtitles.py، جو اسپیچ مارکس آؤٹ پٹ سے سب ٹائٹل فائل بنانے کے لیے منطق کو لاگو کرتا ہے۔

یہ فائل میں Python ماڈیول استعمال کرتا ہے۔ webvtt_utils.py. اس ماڈیول میں سب ٹائٹل فائل بنانے کے لیے متعدد یوٹیلیٹی فنکشنز ہیں۔ ایک ایسا طریقہ get_phrases_from_speechmarks اسپیچ مارکس فائل کو پارس کرنے کا ذمہ دار ہے۔ اسپیچ مارکس JSON ڈھانچہ ہر لفظ کے لیے انفرادی طور پر صرف آغاز کا وقت فراہم کرتا ہے۔ SRT فائل کے لیے ضروری سب ٹائٹل ٹائمنگ بنانے کے لیے، ہم پہلے اسپیچ مارکس فائل میں الفاظ کی فہرست سے تقریباً n (جہاں n=10) الفاظ کے جملے بناتے ہیں۔ پھر ہم انہیں SRT فائل فارمیٹ میں لکھتے ہیں، جملے کے پہلے لفظ سے آغاز کا وقت لیتے ہیں، اور اختتامی وقت کے لیے ہم (n+1) لفظ کے آغاز کا وقت استعمال کرتے ہیں اور ترتیب وار اندراج بنانے کے لیے اسے 1 سے گھٹا دیتے ہیں۔ . درج ذیل فنکشن فقروں کو ایس آر ٹی فائل میں لکھنے کی تیاری میں تیار کرتا ہے۔

- آخری مرحلہ، میڈیا کنورٹ، لیمبڈا فنکشن کا مطالبہ کرتا ہے۔ create_mediaconvert_job.py حتمی آؤٹ پٹ فائل بنانے کے لیے ایمیزون پولی سے آڈیو سٹریم اور سب ٹائٹل فائل کو سورس ویڈیو فائل کے ساتھ ملانا، جو کہ پھر S3 بالٹی میں محفوظ ہو جاتی ہے۔ یہ مرحلہ استعمال کرتا ہے۔

MediaConvert، براڈکاسٹ گریڈ کی خصوصیات کے ساتھ فائل پر مبنی ویڈیو ٹرانس کوڈنگ سروس۔ یہ آپ کو آسانی سے ویڈیو آن ڈیمانڈ مواد بنانے کی اجازت دیتا ہے اور ایک سادہ ویب انٹرفیس کے ساتھ جدید ویڈیو اور آڈیو صلاحیتوں کو یکجا کرتا ہے۔ یہاں پھر ہم ازگر کا استعمال کرتے ہیں۔ بوٹو 3 SDK بنانے کے لیے aMediaConvertنوکری:

شرائط

شروع کرنے سے پہلے، آپ کو درج ذیل شرائط کا ہونا ضروری ہے:

حل تعینات کریں۔

AWS CDK کا استعمال کرتے ہوئے حل کو تعینات کرنے کے لیے، درج ذیل مراحل کو مکمل کریں:

- کلون ذخیرہ:

- یہ یقینی بنانے کے لیے کہ AWS CDK ہے۔ بوٹسٹریپڈ، کمانڈ چلائیں۔

cdk bootstrapذخیرہ کی جڑ سے: - ورکنگ ڈائرکٹری کو ریپوزٹری کی جڑ میں تبدیل کریں اور درج ذیل کمانڈ کو چلائیں:

پہلے سے طے شدہ طور پر، ہدف آڈیو سیٹنگز یو ایس ہسپانوی (es-US)۔ اگر آپ اسے مختلف ہدف کی زبان کے ساتھ جانچنے کا ارادہ رکھتے ہیں تو درج ذیل کمانڈ کا استعمال کریں:

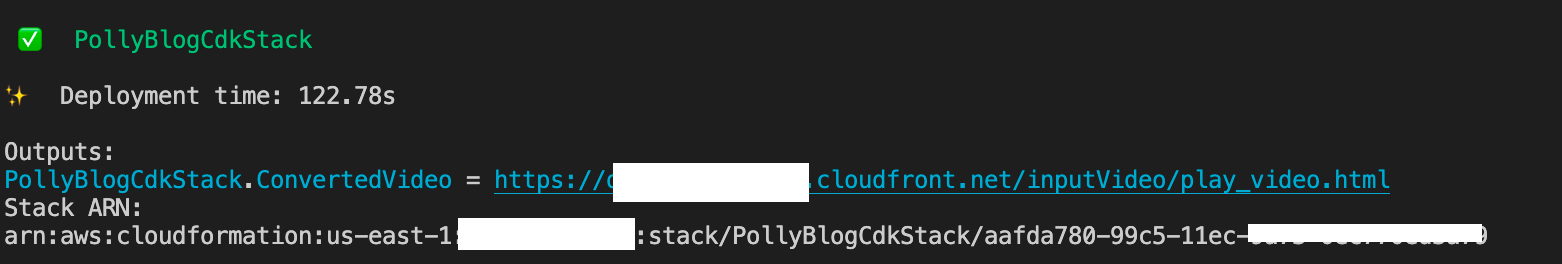

اس عمل کو مکمل ہونے میں چند منٹ لگتے ہیں، جس کے بعد یہ ایک لنک دکھاتا ہے جسے آپ ترجمہ شدہ آڈیو اور ترجمہ شدہ سب ٹائٹلز کے ساتھ ٹارگٹ ویڈیو فائل دیکھنے کے لیے استعمال کر سکتے ہیں۔

حل کی جانچ کریں۔

اس حل کو جانچنے کے لیے، ہم نے درج ذیل میں سے ایک چھوٹا سا حصہ استعمال کیا۔ AWS re: Invent 2017 ویڈیو یوٹیوب سے، جہاں ایمیزون ٹرانسکرائب سب سے پہلے متعارف کرایا گیا تھا۔ آپ حل کو اپنی ویڈیو کے ساتھ بھی جانچ سکتے ہیں۔ ہمارے ٹیسٹ ویڈیو کی اصل زبان انگریزی ہے۔ جب آپ اس حل کو متعین کرتے ہیں، تو آپ ٹارگٹ آڈیو سیٹنگز بتا سکتے ہیں یا آپ ڈیفالٹ ٹارگٹ آڈیو سیٹنگز استعمال کر سکتے ہیں، جو آڈیو اور سب ٹائٹلز بنانے کے لیے ہسپانوی استعمال کرتی ہے۔ حل ایک S3 بالٹی بناتا ہے جسے ویڈیو فائل کو اپ لوڈ کرنے کے لیے استعمال کیا جا سکتا ہے۔

- Amazon S3 کنسول پر، بالٹی پر جائیں۔

PollyBlogBucket.

- بالٹی کا انتخاب کریں، پر تشریف لے جائیں۔

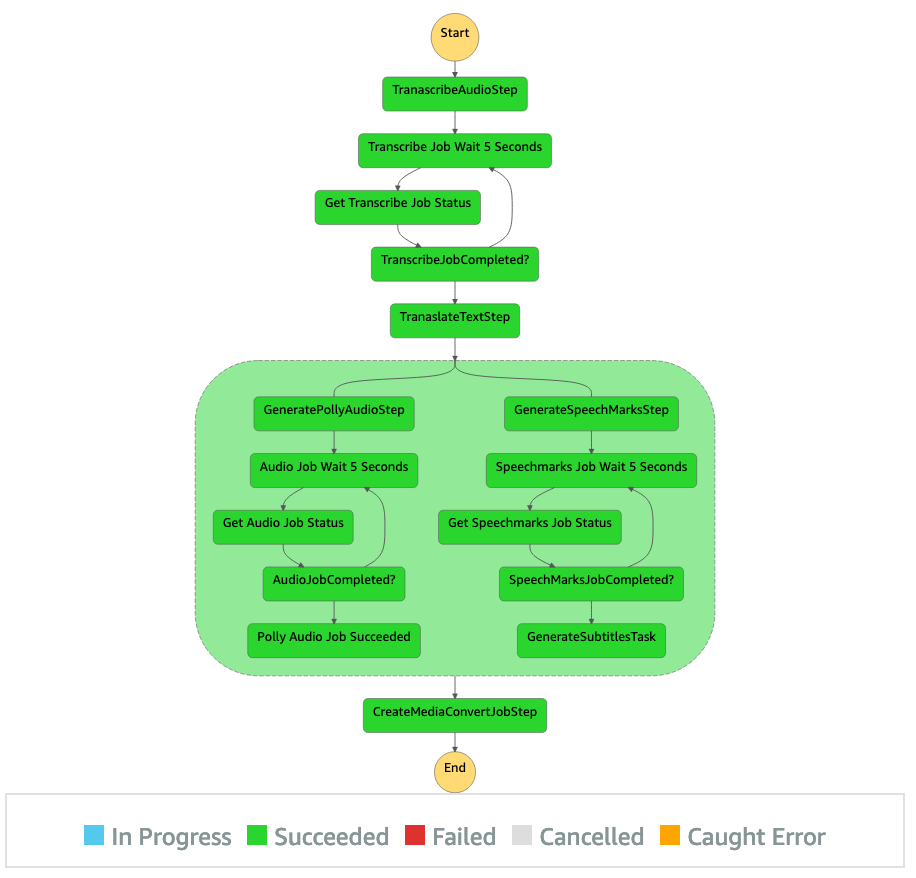

/inputVideoڈائرکٹری، اور ویڈیو فائل اپ لوڈ کریں (حل mp4 قسم کی ویڈیوز کے ساتھ آزمایا جاتا ہے)۔ اس مقام پر، ایک S3 ایونٹ کی اطلاع لیمبڈا فنکشن کو متحرک کرتی ہے، جو ریاستی مشین کو شروع کرتی ہے۔ - اسٹیپ فنکشنز کنسول پر، اسٹیٹ مشین کو براؤز کریں (

ProcessAudioWithSubtitles). - کو تلاش کرنے کے لیے ریاستی مشین کے رن میں سے ایک کا انتخاب کریں۔ گراف انسپکٹر.

یہ ہر ریاست کے رن کے نتائج دکھاتا ہے۔ سٹیپ فنکشنز ورک فلو کو مکمل ہونے میں چند منٹ لگتے ہیں، جس کے بعد آپ تصدیق کر سکتے ہیں کہ آیا تمام مراحل کامیابی سے مکمل ہو گئے ہیں۔

آؤٹ پٹ کا جائزہ لیں۔

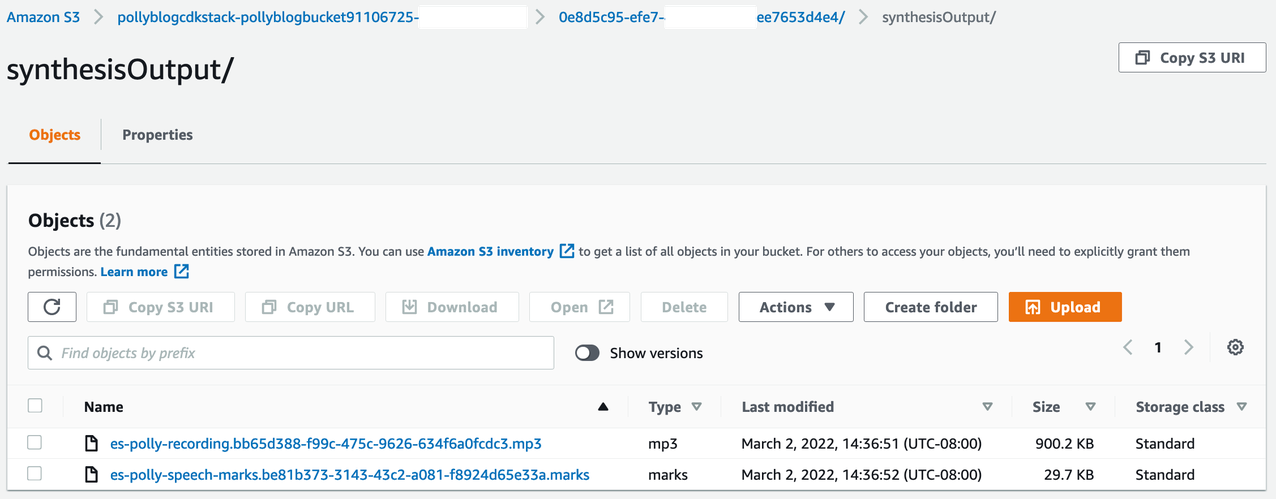

آؤٹ پٹ کا جائزہ لینے کے لیے، Amazon S3 کنسول کھولیں اور چیک کریں کہ آیا آڈیو فائل (.mp3) اور اسپیچ مارک فائل (.marks) S3 بالٹی کے نیچے محفوظ ہیں۔ <ROOT_S3_BUCKET>/<UID>/synthesisOutput/.

ترجمہ شدہ متن سے تیار کردہ اسپیچ مارک فائل کا نمونہ درج ذیل ہے۔

اس آؤٹ پٹ میں، متن کے ہر حصے کو اسپیچ مارکس کے لحاظ سے توڑا جاتا ہے:

- وقت - متعلقہ آڈیو اسٹریم کے آغاز سے ملی سیکنڈ میں ٹائم اسٹیمپ

- قسم - تقریر کے نشان کی قسم (جملہ، لفظ، ویزیم، یا SSML)

- شروع کریں - ان پٹ ٹیکسٹ میں آبجیکٹ کے آغاز کے بائٹس میں آفسیٹ (حروف نہیں) (جس میں وسیم مارکس شامل نہیں)

- آخر - ان پٹ ٹیکسٹ میں آبجیکٹ کے آخر کا بائٹس میں آفسیٹ (حروف نہیں) (وسیم مارکس شامل نہیں)

- قیمت - جملے میں انفرادی الفاظ

تیار کردہ سب ٹائٹل فائل کو S3 بالٹی میں واپس لکھا جاتا ہے۔ آپ نیچے فائل تلاش کر سکتے ہیں۔ <ROOT_S3_BUCKET>/<UID>/subtitlesOutput/. سب ٹائٹل فائل کا معائنہ کریں؛ مواد مندرجہ ذیل متن کی طرح ہونا چاہئے:

سب ٹائٹلز فائل اور آڈیو فائل تیار ہونے کے بعد، فائنل سورس ویڈیو فائل MediaConvert کا استعمال کرتے ہوئے بنائی جاتی ہے۔ MediaConvert کنسول کو چیک کریں کہ آیا ملازمت کی حیثیت ہے یا نہیں۔ COMPLETE.

جب MediaConvert کام مکمل ہو جاتا ہے، تو حتمی ویڈیو فائل تیار ہو جاتی ہے اور S3 بالٹی میں واپس محفوظ ہو جاتی ہے، جو اس کے نیچے مل سکتی ہے۔ <ROOT_S3_BUCKET>/<UID>/convertedAV/.

اس تعیناتی کے حصے کے طور پر، حتمی ویڈیو ایک کے ذریعے تقسیم کی جاتی ہے۔ ایمیزون CloudFront (CDN) لنک اور ٹرمینل میں یا میں دکھایا گیا ہے۔ AWS کلاؤڈ فارمیشن کنسول.

آڈیو اور سب ٹائٹلز کے اضافی اختیارات کے ساتھ اصل ویڈیو دیکھنے کے لیے یو آر ایل کو براؤزر میں کھولیں۔ آپ تصدیق کر سکتے ہیں کہ ترجمہ شدہ آڈیو اور سب ٹائٹلز مطابقت پذیر ہیں۔

نتیجہ

اس پوسٹ میں، ہم نے دستی مداخلت کی ضرورت کے بغیر ویڈیو فائلوں کے نئے لینگوئج ورژن بنانے کے طریقہ پر تبادلہ خیال کیا۔ مواد کے تخلیق کار اس عمل کو اپنے ویڈیوز کے آڈیو اور سب ٹائٹلز کو سنکرونائز کرنے اور عالمی سامعین تک پہنچنے کے لیے استعمال کر سکتے ہیں۔

آپ اس نقطہ نظر کو آسانی سے اپنی پروڈکشن پائپ لائنوں میں ضم کر سکتے ہیں تاکہ بڑی مقدار کو سنبھال سکیں اور اپنی ضروریات کے مطابق پیمانے پر۔ ایمیزون پولی استعمال کرتا ہے۔ اعصابی TTS (NTTS) قدرتی اور انسان جیسی متن سے تقریر کی آوازیں پیدا کرنے کے لیے۔ یہ بھی سپورٹ کرتا ہے۔ SSML سے تقریر پیدا کرنا، جو آپ کو اضافی کنٹرول فراہم کرتا ہے کہ ایمیزون پولی فراہم کردہ متن سے تقریر کیسے تیار کرتی ہے۔ ایمیزون پولی بھی فراہم کرتا ہے۔ مختلف قسم کی آوازیں آپ کی ضروریات کو پورا کرنے کے لیے متعدد زبانوں میں۔

پر جا کر AWS مشین لرننگ سروسز کے ساتھ شروعات کریں۔ پروڈکٹ کا صفحہ، یا رجوع کریں۔ ایمیزون مشین لرننگ سلوشنز لیب صفحہ جہاں آپ اپنی تنظیم میں مشین لرننگ کے حل لانے کے لیے ماہرین کے ساتھ تعاون کر سکتے ہیں۔

اضافی وسائل

اس حل میں استعمال ہونے والی خدمات کے بارے میں مزید معلومات کے لیے، درج ذیل سے رجوع کریں:

مصنفین کے بارے میں

ریگن روزاریو تعلیمی ٹیکنالوجی کمپنیوں پر توجہ مرکوز کرتے ہوئے AWS میں ایک حل آرکیٹیکٹ کے طور پر کام کرتا ہے۔ اسے AWS کلاؤڈ میں قابل توسیع، انتہائی دستیاب اور محفوظ حل بنانے میں صارفین کی مدد کرنا پسند ہے۔ اس کے پاس سافٹ ویئر انجینئرنگ اور فن تعمیر پر توجہ کے ساتھ ٹیکنالوجی کے مختلف کرداروں میں کام کرنے کا ایک دہائی سے زیادہ کا تجربہ ہے۔

ریگن روزاریو تعلیمی ٹیکنالوجی کمپنیوں پر توجہ مرکوز کرتے ہوئے AWS میں ایک حل آرکیٹیکٹ کے طور پر کام کرتا ہے۔ اسے AWS کلاؤڈ میں قابل توسیع، انتہائی دستیاب اور محفوظ حل بنانے میں صارفین کی مدد کرنا پسند ہے۔ اس کے پاس سافٹ ویئر انجینئرنگ اور فن تعمیر پر توجہ کے ساتھ ٹیکنالوجی کے مختلف کرداروں میں کام کرنے کا ایک دہائی سے زیادہ کا تجربہ ہے۔

انیل کوڈالی ایمیزون ویب سروسز کے ساتھ ایک حل آرکیٹیکٹ ہے۔ وہ AWS EdTech صارفین کے ساتھ کام کرتا ہے، موجودہ کام کے بوجھ کو کلاؤڈ پر منتقل کرنے اور کلاؤڈ فرسٹ اپروچ کے ساتھ نئے کام کے بوجھ کو ڈیزائن کرنے کے لیے تعمیراتی بہترین طریقوں سے ان کی رہنمائی کرتا ہے۔ AWS میں شامل ہونے سے پہلے، اس نے بڑے خوردہ فروشوں کے ساتھ کام کیا تاکہ ان کی کلاؤڈ ہجرت میں ان کی مدد کی جا سکے۔

انیل کوڈالی ایمیزون ویب سروسز کے ساتھ ایک حل آرکیٹیکٹ ہے۔ وہ AWS EdTech صارفین کے ساتھ کام کرتا ہے، موجودہ کام کے بوجھ کو کلاؤڈ پر منتقل کرنے اور کلاؤڈ فرسٹ اپروچ کے ساتھ نئے کام کے بوجھ کو ڈیزائن کرنے کے لیے تعمیراتی بہترین طریقوں سے ان کی رہنمائی کرتا ہے۔ AWS میں شامل ہونے سے پہلے، اس نے بڑے خوردہ فروشوں کے ساتھ کام کیا تاکہ ان کی کلاؤڈ ہجرت میں ان کی مدد کی جا سکے۔

پرسنا سرسوتی کرشنن ایڈ ٹیک صارفین کے ساتھ کام کرنے والے ایمیزون ویب سروسز کے ساتھ ایک حل آرکیٹیکٹ ہے۔ وہ بہترین طریقوں کا استعمال کرتے ہوئے اپنے کلاؤڈ فن تعمیر اور ڈیٹا کی حکمت عملی کو چلانے میں ان کی مدد کرتا ہے۔ اس کا پس منظر تقسیم شدہ کمپیوٹنگ، بڑے ڈیٹا اینالیٹکس، اور ڈیٹا انجینئرنگ میں ہے۔ وہ مشین لرننگ اور قدرتی زبان کی پروسیسنگ کے بارے میں پرجوش ہے۔

پرسنا سرسوتی کرشنن ایڈ ٹیک صارفین کے ساتھ کام کرنے والے ایمیزون ویب سروسز کے ساتھ ایک حل آرکیٹیکٹ ہے۔ وہ بہترین طریقوں کا استعمال کرتے ہوئے اپنے کلاؤڈ فن تعمیر اور ڈیٹا کی حکمت عملی کو چلانے میں ان کی مدد کرتا ہے۔ اس کا پس منظر تقسیم شدہ کمپیوٹنگ، بڑے ڈیٹا اینالیٹکس، اور ڈیٹا انجینئرنگ میں ہے۔ وہ مشین لرننگ اور قدرتی زبان کی پروسیسنگ کے بارے میں پرجوش ہے۔

- AI

- ai آرٹ

- AI آرٹ جنریٹر

- عی روبوٹ

- ایمیزون ایم ایل حل لیب

- ایمیزون پولی

- ایمیزون نقل

- ایمیزون ترجمہ

- مصنوعی ذہانت

- مصنوعی ذہانت کا سرٹیفیکیشن

- بینکنگ میں مصنوعی ذہانت

- مصنوعی ذہانت والا روبوٹ

- مصنوعی ذہانت والے روبوٹ

- مصنوعی ذہانت سافٹ ویئر

- AWS مشین لرننگ

- blockchain

- بلاکچین کانفرنس

- coingenius

- بات چیت مصنوعی ذہانت

- crypto کانفرنس ai

- dall-e

- گہری سیکھنے

- گوگل عی

- مشین لرننگ

- پلاٹا

- افلاطون اے

- افلاطون ڈیٹا انٹیلی جنس

- افلاطون گیم

- پلیٹو ڈیٹا

- پلیٹو گیمنگ

- پیمانہ ai

- نحو

- زیفیرنیٹ