تمام صنعتوں میں بظاہر نہ رکنے والے LLMs کو اپنانے کے باوجود، یہ ایک وسیع تر ٹیکنالوجی ماحولیاتی نظام کا ایک جزو ہیں جو نئی AI لہر کو طاقت دے رہا ہے۔ بہت سے بات چیت کے AI استعمال کے معاملات میں صارف کے سوالات کا جواب دینے کے لیے Llama 2، Flan T5، اور Bloom جیسے LLMs کی ضرورت ہوتی ہے۔ یہ ماڈل سوالات کا جواب دینے کے لیے پیرامیٹرک علم پر انحصار کرتے ہیں۔ ماڈل اس علم کو تربیت کے دوران سیکھتا ہے اور اسے ماڈل پیرامیٹرز میں انکوڈ کرتا ہے۔ اس علم کو اپ ڈیٹ کرنے کے لیے، ہمیں ایل ایل ایم کی دوبارہ تربیت کرنی چاہیے، جس میں بہت زیادہ وقت اور پیسہ لگتا ہے۔

خوش قسمتی سے، ہم اپنے LLMs کو مطلع کرنے کے لیے ماخذ علم کا بھی استعمال کر سکتے ہیں۔ ماخذ علم ایک ان پٹ پرامپٹ کے ذریعے LLM میں فراہم کی جانے والی معلومات ہے۔ ماخذ علم فراہم کرنے کے لیے ایک مقبول نقطہ نظر Retrieval Augmented Generation (RAG) ہے۔ RAG کا استعمال کرتے ہوئے، ہم ایک بیرونی ڈیٹا سورس سے متعلقہ معلومات بازیافت کرتے ہیں اور اس معلومات کو LLM میں فیڈ کرتے ہیں۔

اس بلاگ پوسٹ میں، ہم Amazon Sagemaker JumpStart کا استعمال کرتے ہوئے Llama-2 جیسے LLMs کو کیسے تعینات کریں اور AI Hallucination کو روکنے کے لیے Pinecone ویکٹر ڈیٹا بیس کا استعمال کرتے ہوئے Retrieval Augmented Generation (RAG) کے ذریعے متعلقہ معلومات کے ساتھ اپنے LLMs کو اپ ٹو ڈیٹ رکھیں۔ .

ایمیزون سیج میکر میں بازیافت اگمینٹڈ جنریشن (آر اے جی)

Pinecone RAG کے بازیافت جزو کو سنبھالے گا، لیکن آپ کو دو اور اہم اجزاء کی ضرورت ہے: کہیں LLM تخمینہ چلانے کے لیے اور کہیں ایمبیڈنگ ماڈل کو چلانے کے لیے۔

ایمیزون سیج میکر اسٹوڈیو ایک مربوط ترقیاتی ماحول (IDE) جو ایک واحد ویب پر مبنی بصری انٹرفیس فراہم کرتا ہے جہاں آپ تمام مشین لرننگ (ML) کی ترقی کو انجام دینے کے لیے مقصد سے بنائے گئے ٹولز تک رسائی حاصل کرسکتے ہیں۔ یہ SageMaker JumpStart فراہم کرتا ہے جو ایک ماڈل ہب ہے جہاں صارف اپنے SageMaker اکاؤنٹ میں کسی خاص ماڈل کو تلاش، پیش نظارہ اور لانچ کر سکتے ہیں۔ یہ فاؤنڈیشن ماڈلز سمیت مسائل کی وسیع اقسام کے لیے پہلے سے تربیت یافتہ، عوامی طور پر دستیاب اور ملکیتی ماڈل فراہم کرتا ہے۔

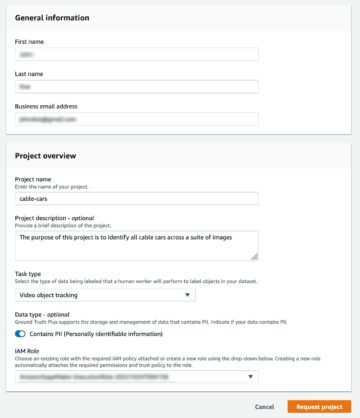

Amazon SageMaker سٹوڈیو RAG سے چلنے والی LLM پائپ لائنوں کو تیار کرنے کے لیے مثالی ماحول فراہم کرتا ہے۔ سب سے پہلے، AWS کنسول کا استعمال کرتے ہوئے، Amazon SageMaker پر جائیں اور SageMaker Studio کا ڈومین بنائیں اور Jupyter Studio کی نوٹ بک کھولیں۔

شرائط

درج ذیل ضروری مراحل کو مکمل کریں:

- ایمیزون سیج میکر اسٹوڈیو مرتب کریں۔

- ایمیزون سیج میکر ڈومین پر آن بورڈ۔

- مفت درجے کے پنیکون ویکٹر ڈیٹا بیس کے لیے سائن اپ کریں۔

- لازمی لائبریریاں: SageMaker Python SDK، Pinecone کلائنٹ

حل واک تھرو

سیج میکر اسٹوڈیو نوٹ بک کا استعمال کرتے ہوئے، ہمیں سب سے پہلے لازمی لائبریریوں کو انسٹال کرنے کی ضرورت ہے:

ایل ایل ایم کی تعیناتی

اس پوسٹ میں، ہم ایل ایل ایم کی تعیناتی کے لیے دو طریقوں پر بات کرتے ہیں۔ سب سے پہلے کے ذریعے ہے HuggingFaceModel چیز. آپ اسے LLMs (اور ایمبیڈنگ ماڈلز) کو براہ راست Hugging Face ماڈل حب سے تعینات کرتے وقت استعمال کر سکتے ہیں۔

مثال کے طور پر، آپ اس کے لیے قابل تعیناتی تشکیل دے سکتے ہیں۔ google/flan-t5-xl مندرجہ ذیل اسکرین کیپچر میں دکھایا گیا ماڈل:

ہگنگ فیس سے براہ راست ماڈلز کی تعیناتی کرتے وقت، شروع کریں۔ my_model_configuration مندرجہ ذیل کے ساتھ:

- An

envconfig ہمیں بتاتا ہے کہ ہم کون سا ماڈل استعمال کرنا چاہتے ہیں اور کس کام کے لیے۔ - ہمارے سیج میکر پر عمل درآمد

roleہمیں اپنے ماڈل کو تعینات کرنے کی اجازت دیتا ہے۔ - An

image_uriخاص طور پر Hugging Face سے LLMs کی تعیناتی کے لیے ایک تصویری ترتیب ہے۔

متبادل طور پر، SageMaker کے پاس ماڈلز کا ایک سیٹ ہے جو ایک سادہ سے براہ راست مطابقت رکھتا ہے۔ JumpStartModel چیز. بہت سے مشہور LLMs جیسے Llama 2 کو اس ماڈل سے تعاون حاصل ہے، جس کی ابتدا کی جا سکتی ہے جیسا کہ درج ذیل اسکرین کیپچر میں دکھایا گیا ہے۔

کے دونوں ورژن کے لیے my_model، ان کو تعینات کریں جیسا کہ درج ذیل اسکرین کیپچر میں دکھایا گیا ہے:

ہمارے ابتدائی LLM اختتامی نقطہ کے ساتھ، آپ استفسار شروع کر سکتے ہیں۔ ہمارے سوالات کا فارمیٹ مختلف ہو سکتا ہے (خاص طور پر بات چیت اور غیر بات چیت والے LLMs کے درمیان)، لیکن عمل عام طور پر ایک جیسا ہوتا ہے۔ گلے لگانے والے چہرے کے ماڈل کے لیے، درج ذیل کام کریں:

آپ اس میں حل تلاش کرسکتے ہیں۔ GitHub ذخیرہ.

جو جواب ہمیں یہاں موصول ہو رہا ہے وہ زیادہ معنی نہیں رکھتا - یہ ایک فریب ہے۔

ایل ایل ایم کو اضافی سیاق و سباق فراہم کرنا

Llama 2 صرف اندرونی پیرامیٹرک علم کی بنیاد پر ہمارے سوال کا جواب دینے کی کوشش کرتا ہے۔ واضح طور پر، ماڈل کے پیرامیٹرز اس بارے میں علم کو ذخیرہ نہیں کرتے ہیں کہ ہم SageMaker میں منظم اسپاٹ ٹریننگ کے ساتھ کون سی مثالیں حاصل کر سکتے ہیں۔

اس سوال کا صحیح جواب دینے کے لیے، ہمیں ماخذ علم کا استعمال کرنا چاہیے۔ یعنی، ہم پرامپٹ کے ذریعے LLM کو اضافی معلومات دیتے ہیں۔ آئیے اس معلومات کو براہ راست ماڈل کے اضافی سیاق و سباق کے طور پر شامل کریں۔

اب ہم سوال کا صحیح جواب دیکھتے ہیں۔ یہ آسان تھا! تاہم، صارف کے اپنے اشارے میں سیاق و سباق داخل کرنے کا امکان نہیں ہے، وہ اپنے سوال کا جواب پہلے ہی جان لیں گے۔

ایک سیاق و سباق کو دستی طور پر داخل کرنے کے بجائے، معلومات کے زیادہ وسیع ڈیٹا بیس سے متعلقہ معلومات کی خود بخود شناخت کریں۔ اس کے لیے، آپ کو Retrieval Augmented Generation کی ضرورت ہوگی۔

بازیافت اگمینٹڈ جنریشن

Retrieval Augmented Generation کے ساتھ، آپ معلومات کے ڈیٹا بیس کو ایک ویکٹر اسپیس میں انکوڈ کر سکتے ہیں جہاں ویکٹرز کے درمیان قربت ان کی مطابقت/معنی مماثلت کی نمائندگی کرتی ہے۔ علم کی بنیاد کے طور پر اس ویکٹر اسپیس کے ساتھ، آپ ایک نئے صارف کے استفسار کو تبدیل کر سکتے ہیں، اسے اسی ویکٹر اسپیس میں انکوڈ کر سکتے ہیں، اور پہلے سے انڈیکس کیے گئے انتہائی متعلقہ ریکارڈز کو بازیافت کر سکتے ہیں۔

ان متعلقہ ریکارڈز کو بازیافت کرنے کے بعد، ان میں سے کچھ کو منتخب کریں اور انہیں اضافی سیاق و سباق کے طور پر LLM پرامپٹ میں شامل کریں، LLM کو انتہائی متعلقہ ماخذ کی معلومات فراہم کریں۔ یہ ایک دو قدمی عمل ہے جہاں:

- انڈیکسنگ ویکٹر انڈیکس کو ڈیٹاسیٹ سے معلومات کے ساتھ آباد کرتی ہے۔

- بازیافت ایک استفسار کے دوران ہوتی ہے اور جہاں ہم ویکٹر انڈیکس سے متعلقہ معلومات حاصل کرتے ہیں۔

دونوں مراحل میں ہمارے انسانی پڑھنے کے قابل سادہ متن کو سیمنٹک ویکٹر اسپیس میں ترجمہ کرنے کے لیے ایمبیڈنگ ماڈل کی ضرورت ہوتی ہے۔ Hugging Face سے انتہائی موثر MiniLM جملے کا ٹرانسفارمر استعمال کریں جیسا کہ درج ذیل اسکرین کیپچر میں دکھایا گیا ہے۔ یہ ماڈل LLM نہیں ہے اور اس لیے اس کی ابتدا ہمارے Llama 2 ماڈل کی طرح نہیں کی گئی ہے۔

میں hub_config، ماڈل ID کی وضاحت کریں جیسا کہ اوپر اسکرین کیپچر میں دکھایا گیا ہے لیکن اس کام کے لیے، فیچر ایکسٹریکشن کا استعمال کریں کیونکہ ہم ویکٹر ایمبیڈنگز تیار کر رہے ہیں نہ کہ اپنے LLM کی طرح ٹیکسٹ۔ اس کے بعد، ماڈل کی تشکیل کو شروع کریں۔ HuggingFaceModel پہلے کی طرح، لیکن اس بار LLM تصویر کے بغیر اور کچھ ورژن پیرامیٹرز کے ساتھ۔

آپ ماڈل کو دوبارہ اس کے ساتھ تعینات کر سکتے ہیں۔ deploy, چھوٹی (صرف CPU) مثال کا استعمال کرتے ہوئے ml.t2.large. MiniLM ماڈل چھوٹا ہے، لہذا اسے زیادہ میموری کی ضرورت نہیں ہے اور اسے GPU کی ضرورت نہیں ہے کیونکہ یہ CPU پر بھی تیزی سے ایمبیڈنگز بنا سکتا ہے۔ اگر ترجیح دی جائے تو، آپ GPU پر ماڈل کو تیزی سے چلا سکتے ہیں۔

ایمبیڈنگ بنانے کے لیے، استعمال کریں۔ predict طریقہ اور کے ذریعے انکوڈ کرنے کے لیے سیاق و سباق کی ایک فہرست پاس کریں۔ inputs کلید جیسا کہ دکھایا گیا ہے:

دو ان پٹ سیاق و سباق کو پاس کیا گیا ہے، جیسا کہ دکھایا گیا ہے دو سیاق و سباق ویکٹر ایمبیڈنگز واپس کر رہے ہیں:

len(out)

2

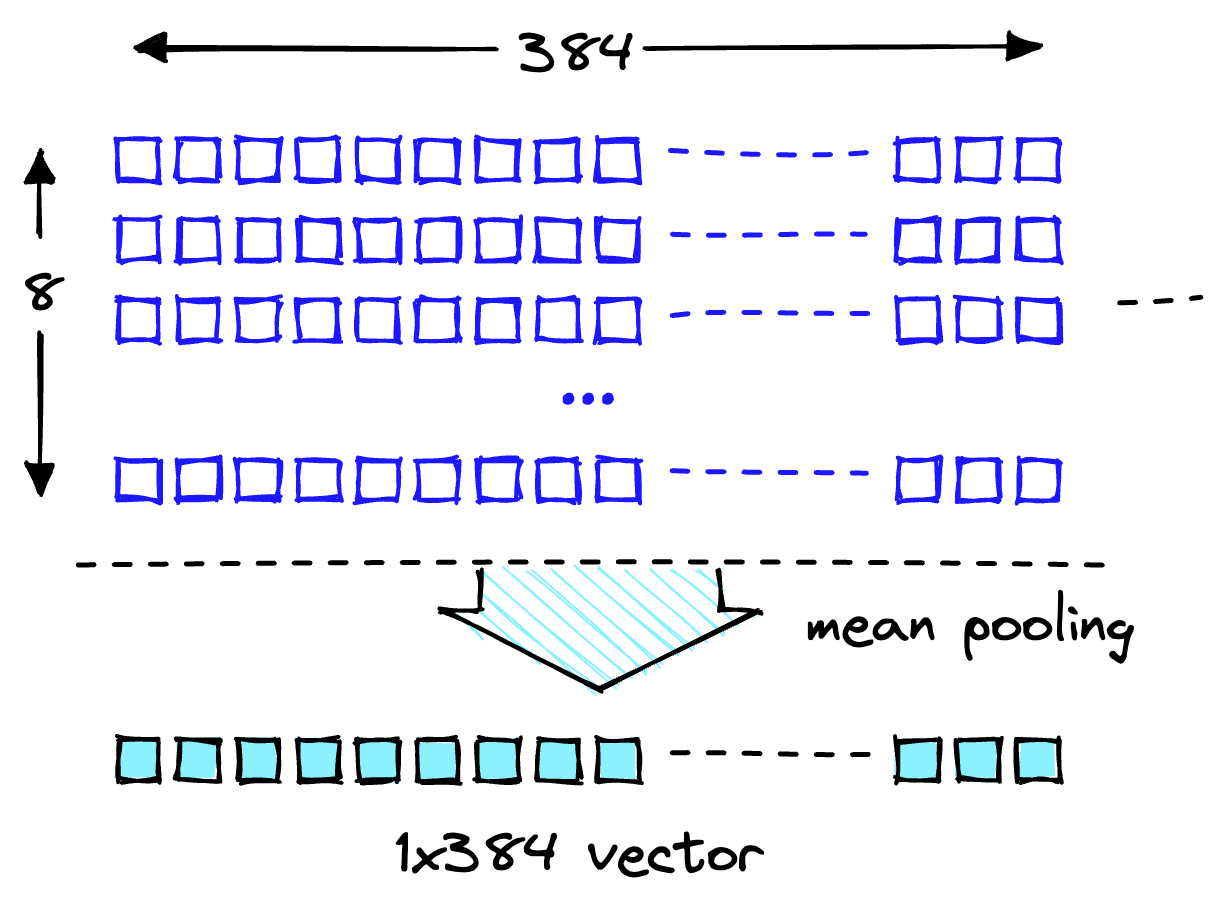

MiniLM ماڈل کی ایمبیڈنگ جہت ہے۔ 384 جس کا مطلب ہے کہ ہر ایک ویکٹر کو سرایت کرنے والے MiniLM آؤٹ پٹس کی جہت ہونی چاہیے۔ 384. تاہم، ہماری سرایت کی لمبائی کو دیکھتے ہوئے، آپ کو درج ذیل نظر آئے گا:

len(out[0]), len(out[1])

(8, 8)

دو فہرستوں میں آٹھ آئٹمز شامل ہیں۔ MiniLM پہلے ٹوکنائزیشن مرحلے میں ٹیکسٹ پر کارروائی کرتا ہے۔ یہ ٹوکنائزیشن ہمارے انسانی پڑھنے کے قابل سادہ متن کو ماڈل کے پڑھنے کے قابل ٹوکن IDs کی فہرست میں بدل دیتی ہے۔ ماڈل کی آؤٹ پٹ خصوصیات میں، آپ ٹوکن لیول ایمبیڈنگز دیکھ سکتے ہیں۔ ان میں سے ایک سرایت کی متوقع جہت کو ظاہر کرتا ہے۔ 384 جیسے دکھایا گیا ہے:

len(out[0][0])

384

ان ٹوکن لیول ایمبیڈنگز کو ہر ویکٹر ڈائمینشن میں اوسط قدروں کا استعمال کرتے ہوئے دستاویز لیول ایمبیڈنگز میں تبدیل کریں، جیسا کہ مندرجہ ذیل مثال میں دکھایا گیا ہے۔

ایک واحد 384 جہتی ویکٹر حاصل کرنے کے لیے پولنگ آپریشن کا مطلب۔

دو 384 جہتی ویکٹر ایمبیڈنگ کے ساتھ، ہر ان پٹ ٹیکسٹ کے لیے ایک۔ ہماری زندگیوں کو آسان بنانے کے لیے، انکوڈنگ کے عمل کو ایک فنکشن میں لپیٹیں جیسا کہ درج ذیل اسکرین کیپچر میں دکھایا گیا ہے:

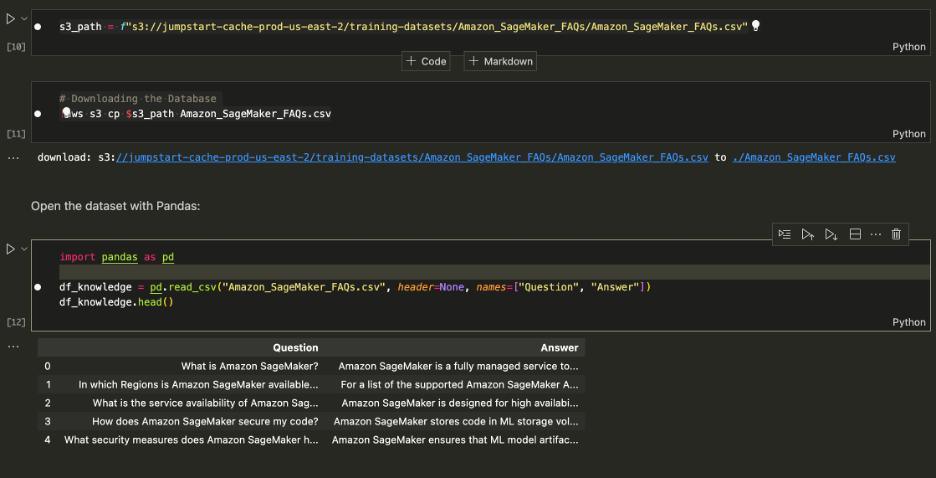

ڈیٹا سیٹ ڈاؤن لوڈ کرنا

ڈیٹا حاصل کرنے کے لیے Amazon SageMaker FAQs کو علمی بنیاد کے طور پر ڈاؤن لوڈ کریں جس میں سوال اور جواب دونوں کالم ہوں۔

Amazon SageMaker FAQs ڈاؤن لوڈ کریں۔

تلاش کرتے وقت، صرف جوابات تلاش کریں، تاکہ آپ سوال کا کالم چھوڑ سکیں۔ تفصیلات کے لیے نوٹ بک دیکھیں.

ہمارا ڈیٹاسیٹ اور سرایت کرنے والی پائپ لائن تیار ہے۔ اب ہمیں صرف ان ایمبیڈنگز کو ذخیرہ کرنے کی ضرورت ہے۔

انڈیکسنگ

Pinecone ویکٹر ڈیٹا بیس ویکٹر ایمبیڈنگز کو اسٹور کرتا ہے اور پیمانے پر انہیں موثر طریقے سے تلاش کرتا ہے۔ ڈیٹا بیس بنانے کے لیے، آپ کو Pinecone سے ایک مفت API کلید کی ضرورت ہوگی۔

پائنیکون ویکٹر ڈیٹا بیس سے منسلک ہونے کے بعد، ایک واحد ویکٹر انڈیکس بنائیں (روایتی DBs میں ٹیبل کی طرح)۔ انڈیکس کا نام دیں۔ retrieval-augmentation-aws اور انڈیکس کو سیدھ میں رکھیں dimension اور metric ایمبیڈنگ ماڈل کے لیے مطلوبہ پیرامیٹرز (اس معاملے میں MiniLM)۔

ڈیٹا داخل کرنا شروع کرنے کے لیے، درج ذیل کو چلائیں:

آپ اس پوسٹ میں پہلے سے سوال کے ساتھ انڈیکس سے استفسار کرنا شروع کر سکتے ہیں۔

مندرجہ بالا آؤٹ پٹ سے پتہ چلتا ہے کہ ہم اپنے سوال کا جواب دینے میں ہماری مدد کے لیے متعلقہ سیاق و سباق واپس کر رہے ہیں۔ چونکہ ہم top_k = 1, index.query میٹا ڈیٹا کے ساتھ ساتھ سب سے اوپر کا نتیجہ واپس کر دیا جو پڑھتا ہے۔ Managed Spot Training can be used with all instances supported in Amazon.

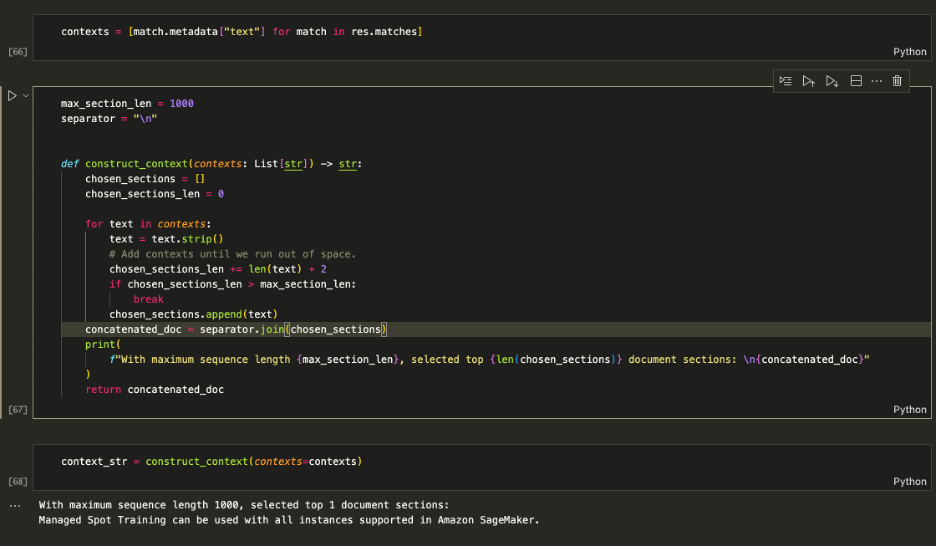

پرامپٹ کو بڑھانا

پرامپٹ کو بڑھانے کے لیے بازیافت شدہ سیاق و سباق کا استعمال کریں اور LLM میں فیڈ کرنے کے لیے زیادہ سے زیادہ سیاق و سباق کا فیصلہ کریں۔ کا استعمال کرتے ہیں 1000 حروف اس وقت تک محدود کرتے ہیں جب تک کہ آپ مواد کی لمبائی سے زیادہ نہ ہو جائیں تب تک ہر واپس کیے گئے سیاق و سباق کو پرامپٹ میں شامل کریں۔

پرامپٹ کو بڑھانا

کھانا کھلانا context_str LLM پرامپٹ میں جیسا کہ درج ذیل اسکرین کیپچر میں دکھایا گیا ہے:

[ان پٹ]: میں سیج میکر میں مینیجڈ اسپاٹ ٹریننگ کے ساتھ کون سی مثالیں استعمال کرسکتا ہوں؟ [آؤٹ پٹ]: فراہم کردہ سیاق و سباق کی بنیاد پر، آپ Amazon SageMaker میں تعاون یافتہ تمام مثالوں کے ساتھ Managed Spot Training استعمال کر سکتے ہیں۔ لہذا، جواب ہے: تمام مثالیں ایمیزون سیج میکر میں معاون ہیں۔

منطق کام کرتی ہے، لہذا چیزوں کو صاف رکھنے کے لیے اسے ایک فنکشن میں لپیٹ دیں۔

اب آپ مندرجہ ذیل میں دکھائے گئے سوالات جیسے سوالات پوچھ سکتے ہیں:

صاف کرو

کسی بھی ناپسندیدہ چارجز کو روکنے کے لیے، ماڈل اور اینڈ پوائنٹ کو حذف کریں۔

نتیجہ

اس پوسٹ میں، ہم نے آپ کو سیج میکر پر اوپن ایکسیس ایل ایل ایم کے ساتھ RAG سے متعارف کرایا ہے۔ ہم نے یہ بھی دکھایا کہ Amazon SageMaker جمپ سٹارٹ ماڈلز کو Llama 2 کے ساتھ، Huging Face LLMs Flan T5 کے ساتھ، اور MiniLM کے ساتھ ایمبیڈنگ ماڈلز کو کیسے تعینات کیا جائے۔

ہم نے اپنے اوپن ایکسیس ماڈلز اور ایک Pinecone ویکٹر انڈیکس کا استعمال کرتے ہوئے ایک مکمل اختتام سے آخر تک RAG پائپ لائن کو نافذ کیا۔ اس کا استعمال کرتے ہوئے، ہم نے یہ دکھایا کہ فریب کو کیسے کم کیا جائے، اور ایل ایل ایم کے علم کو تازہ ترین رکھا جائے، اور بالآخر صارف کے تجربے اور اپنے سسٹمز پر اعتماد کو بڑھایا جائے۔

اس مثال کو اپنے طور پر چلانے کے لیے، اس GitHub کے ذخیرے کو کلون کریں اور پچھلے مراحل کا استعمال کرتے ہوئے واک تھرو کریں۔ GitHub پر سوال کا جواب دینے والی نوٹ بک.

مصنفین کے بارے میں

ویدانت جین ایک Sr. AI/ML ماہر ہے، جو تزویراتی جنریٹو AI اقدامات پر کام کر رہا ہے۔ AWS میں شامل ہونے سے پہلے، ویدانت نے مختلف کمپنیوں جیسے ڈیٹابرکس، ہارٹن ورکس (اب کلاؤڈرا) اور جے پی مورگن چیس میں ایم ایل/ڈیٹا سائنس اسپیشلٹی کے عہدوں پر فائز ہیں۔ اپنے کام کے علاوہ، ویدانت کو موسیقی بنانے، راک چڑھنے، بامعنی زندگی گزارنے کے لیے سائنس کا استعمال کرنے اور دنیا بھر کے کھانوں کی تلاش کا شوق ہے۔

ویدانت جین ایک Sr. AI/ML ماہر ہے، جو تزویراتی جنریٹو AI اقدامات پر کام کر رہا ہے۔ AWS میں شامل ہونے سے پہلے، ویدانت نے مختلف کمپنیوں جیسے ڈیٹابرکس، ہارٹن ورکس (اب کلاؤڈرا) اور جے پی مورگن چیس میں ایم ایل/ڈیٹا سائنس اسپیشلٹی کے عہدوں پر فائز ہیں۔ اپنے کام کے علاوہ، ویدانت کو موسیقی بنانے، راک چڑھنے، بامعنی زندگی گزارنے کے لیے سائنس کا استعمال کرنے اور دنیا بھر کے کھانوں کی تلاش کا شوق ہے۔

جیمز بریگز Pinecone میں اسٹاف ڈیولپر ایڈووکیٹ ہے، ویکٹر کی تلاش اور AI/ML میں مہارت رکھتا ہے۔ وہ آن لائن تعلیم کے ذریعے اپنے GenAI حل تیار کرنے میں ڈویلپرز اور کاروبار کی رہنمائی کرتا ہے۔ پینکون سے پہلے جیمز نے قائم کردہ فنانس کارپوریشنوں کے لیے چھوٹے ٹیک اسٹارٹ اپس کے لیے AI پر کام کیا۔ کام سے باہر، جیمز کو سرفنگ اور سکوبا سے لے کر Muay Thai اور BJJ تک سفر کرنے اور نئی مہم جوئیوں کو اپنانے کا جنون ہے۔

جیمز بریگز Pinecone میں اسٹاف ڈیولپر ایڈووکیٹ ہے، ویکٹر کی تلاش اور AI/ML میں مہارت رکھتا ہے۔ وہ آن لائن تعلیم کے ذریعے اپنے GenAI حل تیار کرنے میں ڈویلپرز اور کاروبار کی رہنمائی کرتا ہے۔ پینکون سے پہلے جیمز نے قائم کردہ فنانس کارپوریشنوں کے لیے چھوٹے ٹیک اسٹارٹ اپس کے لیے AI پر کام کیا۔ کام سے باہر، جیمز کو سرفنگ اور سکوبا سے لے کر Muay Thai اور BJJ تک سفر کرنے اور نئی مہم جوئیوں کو اپنانے کا جنون ہے۔

ژن ہوانگ ایمیزون سیج میکر جمپ اسٹارٹ اور ایمیزون سیج میکر بلٹ ان الگورتھم کے سینئر اپلائیڈ سائنٹسٹ ہیں۔ وہ اسکیل ایبل مشین لرننگ الگورتھم تیار کرنے پر توجہ مرکوز کرتا ہے۔ اس کی تحقیقی دلچسپیاں قدرتی لینگویج پروسیسنگ، ٹیبلر ڈیٹا پر قابل وضاحت گہرائی سے سیکھنے، اور نان پیرامیٹرک اسپیس ٹائم کلسٹرنگ کے مضبوط تجزیہ کے شعبے میں ہیں۔ انہوں نے ACL، ICDM، KDD کانفرنسوں، اور رائل شماریاتی سوسائٹی: سیریز A میں بہت سے مقالے شائع کیے ہیں۔

ژن ہوانگ ایمیزون سیج میکر جمپ اسٹارٹ اور ایمیزون سیج میکر بلٹ ان الگورتھم کے سینئر اپلائیڈ سائنٹسٹ ہیں۔ وہ اسکیل ایبل مشین لرننگ الگورتھم تیار کرنے پر توجہ مرکوز کرتا ہے۔ اس کی تحقیقی دلچسپیاں قدرتی لینگویج پروسیسنگ، ٹیبلر ڈیٹا پر قابل وضاحت گہرائی سے سیکھنے، اور نان پیرامیٹرک اسپیس ٹائم کلسٹرنگ کے مضبوط تجزیہ کے شعبے میں ہیں۔ انہوں نے ACL، ICDM، KDD کانفرنسوں، اور رائل شماریاتی سوسائٹی: سیریز A میں بہت سے مقالے شائع کیے ہیں۔

- SEO سے چلنے والا مواد اور PR کی تقسیم۔ آج ہی بڑھا دیں۔

- پلیٹو ڈیٹا ڈاٹ نیٹ ورک ورٹیکل جنریٹو اے آئی۔ اپنے آپ کو بااختیار بنائیں۔ یہاں تک رسائی حاصل کریں۔

- پلیٹوآئ اسٹریم۔ ویب 3 انٹیلی جنس۔ علم میں اضافہ۔ یہاں تک رسائی حاصل کریں۔

- پلیٹو ای ایس جی۔ کاربن، کلین ٹیک، توانائی ، ماحولیات، شمسی، ویسٹ مینجمنٹ یہاں تک رسائی حاصل کریں۔

- پلیٹو ہیلتھ۔ بائیوٹیک اینڈ کلینیکل ٹرائلز انٹیلی جنس۔ یہاں تک رسائی حاصل کریں۔

- ماخذ: https://aws.amazon.com/blogs/machine-learning/mitigate-hallucinations-through-retrieval-augmented-generation-using-pinecone-vector-database-llama-2-from-amazon-sagemaker-jumpstart/

- : ہے

- : ہے

- : نہیں

- :کہاں

- $UP

- 1

- 10

- 100

- 11

- 12

- 14

- 15٪

- 16

- 17

- 19

- 23

- 32

- 7

- 8

- 9

- a

- ہمارے بارے میں

- اوپر

- تک رسائی حاصل

- کے مطابق

- اکاؤنٹ

- کے پار

- شامل کریں

- ایڈیشنل

- اضافی معلومات

- منہ بولابیٹا بنانے

- مہم جوئی

- وکیل

- پھر

- AI

- AI استعمال کے معاملات

- AI / ML

- یلگوردمز

- سیدھ کریں

- تمام

- ساتھ

- پہلے ہی

- بھی

- ایمیزون

- ایمیزون سیج میکر

- ایمیزون سیج میکر جمپ اسٹارٹ

- ایمیزون سیج میکر اسٹوڈیو

- ایمیزون ویب سروسز

- رقم

- an

- تجزیہ

- اور

- جواب

- جواب

- کوئی بھی

- اے پی آئی

- اپلی کیشن

- اطلاقی

- نقطہ نظر

- نقطہ نظر

- کیا

- رقبہ

- ارد گرد

- AS

- پوچھنا

- At

- کوششیں

- اضافہ

- اضافہ

- آٹو

- خود کار طریقے سے

- دستیاب

- AWS

- بیس

- کی بنیاد پر

- BE

- کیونکہ

- اس سے پہلے

- شروع کریں

- کے درمیان

- بلاگ

- بلوم

- دونوں

- وسیع

- تعمیر

- تعمیر میں

- کاروبار

- لیکن

- by

- کر سکتے ہیں

- قبضہ

- کیس

- مقدمات

- حروف

- بوجھ

- پیچھا

- صاف

- واضح طور پر

- چڑھنا

- کلوڈیرہ

- clustering کے

- کالم

- کالم

- کمپنیاں

- ہم آہنگ

- مکمل

- جزو

- اجزاء

- کانفرنسوں

- منسلک

- کنسول

- پر مشتمل ہے

- پر مشتمل ہے

- مواد

- سیاق و سباق

- سیاق و سباق

- سنوادی

- بات چیت AI

- تبدیل

- کارپوریشنز

- درست

- صحیح طریقے سے

- تخلیق

- اہم

- اس وقت

- اعداد و شمار

- ڈیٹا بیس

- تاریخ

- ڈی بی ایس

- فیصلہ کرنا

- گہری

- گہری سیکھنے

- تعیناتی

- تعینات

- ڈیولپر

- ڈویلپرز

- ترقی

- ترقی

- طول و عرض

- براہ راست

- بات چیت

- do

- کرتا

- نہیں

- نہیں کرتا

- ڈومین

- ڈان

- چھوڑ

- کے دوران

- ہر ایک

- اس سے قبل

- آسان

- ماحول

- تعلیم

- ہنر

- مؤثر طریقے سے

- سرایت کرنا

- منحصر ہے

- انکوڈنگ

- آخر

- آخر سے آخر تک

- اختتام پوائنٹ

- بڑھانے کے

- ماحولیات

- قائم

- بھی

- مثال کے طور پر

- حد سے تجاوز

- پھانسی

- توقع

- تجربہ

- تلاش

- ایکسپلور

- وسیع

- بیرونی

- نکالنے

- چہرہ

- تیز تر

- خصوصیات

- فیڈ

- چند

- کی مالی اعانت

- مل

- ختم

- پہلا

- فلوٹ

- توجہ مرکوز

- کے بعد

- کے لئے

- فارمیٹ

- فاؤنڈیشن

- مفت

- سے

- تقریب

- عام طور پر

- پیدا

- پیدا کرنے والے

- نسل

- پیداواری

- پیداواری AI۔

- حاصل

- GitHub کے

- دے دو

- دی

- فراہم کرتا ہے

- Go

- جاتا ہے

- GPU

- ہدایات

- ہینڈل

- ہوتا ہے

- ہے

- he

- Held

- مدد

- یہاں

- انتہائی

- ان

- کس طرح

- کیسے

- تاہم

- HTTPS

- ہانگ

- حب

- گلے لگانے والا چہرہ

- انسانی پڑھنے کے قابل

- i

- ID

- مثالی

- شناخت

- شناخت

- if

- تصویر

- عملدرآمد

- درآمد

- in

- شامل

- سمیت

- اضافہ

- انڈکس

- انڈیکس شدہ

- صنعتوں

- مطلع

- معلومات

- اقدامات

- ان پٹ

- آدانوں

- انسٹال

- مثال کے طور پر

- ضم

- مفادات

- انٹرفیس

- اندرونی

- میں

- متعارف

- IT

- اشیاء

- جیمز

- شمولیت

- jp

- جی پی مورگن

- جے پی مورگن چیز

- فوٹو

- رکھیں

- کلیدی

- جان

- علم

- زبان

- بڑے

- بڑے

- شروع

- قیادت

- سیکھنے

- سیکھتا ہے

- لمبائی

- لائبریریوں

- زندگی

- کی طرح

- LIMIT

- لسٹ

- فہرستیں

- زندگی

- لاما

- ایل ایل ایم

- منطق

- دیکھو

- تلاش

- بہت

- مشین

- مشین لرننگ

- بنا

- بنانا

- میں کامیاب

- دستی طور پر

- بہت سے

- میچ

- میچ

- زیادہ سے زیادہ

- زیادہ سے زیادہ رقم

- مئی..

- مطلب

- بامعنی

- کا مطلب ہے کہ

- یاد داشت

- میٹا ڈیٹا

- طریقہ

- تخفیف کریں

- ML

- ماڈل

- ماڈل

- قیمت

- زیادہ

- مورگن

- سب سے زیادہ

- بہت

- ایک سے زیادہ

- موسیقی

- ضروری

- نام

- قدرتی

- قدرتی زبان عملیات

- ضرورت ہے

- ضروریات

- نئی

- اگلے

- ویزا

- نوٹ بک

- اب

- عجیب

- اعتراض

- of

- on

- ایک

- آن لائن

- صرف

- کھول

- آپریشن

- or

- حکم

- OS

- دوسری صورت میں

- ہمارے

- باہر

- پیداوار

- نتائج

- باہر

- خود

- کاغذات

- پیرامیٹرز

- خاص طور پر

- خاص طور پر

- منظور

- منظور

- جذبہ

- جذباتی

- انجام دیں

- کارکردگی کا مظاہرہ

- اجازتیں

- تصویر

- پائپ لائن

- سادہ

- پلاٹا

- افلاطون ڈیٹا انٹیلی جنس

- پلیٹو ڈیٹا

- مقبول

- پوزیشنوں

- پوسٹ

- طاقتور

- کی پیشن گوئی

- پیشن گوئی

- پیش گو

- کو ترجیح دی

- کی روک تھام

- پیش نظارہ

- پچھلا

- پہلے

- پہلے

- مسئلہ

- عمل

- عمل

- پروسیسنگ

- پروفائل

- اشارہ کرتا ہے

- ملکیت

- فراہم

- فراہم کرتا ہے

- فراہم کرنے

- عوامی طور پر

- شائع

- ازگر

- pytorch

- سوالات

- سوال

- سوالات

- جلدی سے

- رینج

- لے کر

- تیار

- وصول کرنا

- ریکارڈ

- خطوں

- متعلقہ

- انحصار کرو

- ذخیرہ

- کی نمائندگی کرتا ہے

- کی ضرورت

- ضرورت

- تحقیق

- جواب

- نتیجہ

- نتائج کی نمائش

- واپسی

- واپس لوٹنے

- مضبوط

- پتھر

- کردار

- شاہی

- رن

- چلتا ہے

- sagemaker

- اسی

- کا کہنا ہے کہ

- توسیع پذیر

- پیمانے

- سائنس

- سائنسدان

- سکور

- سکرین

- sdk

- تلاش کریں

- تلاش

- دیکھنا

- بظاہر

- منتخب

- سینئر

- احساس

- سزا

- سیریز

- سیریز اے

- سروسز

- مقرر

- ہونا چاہئے

- دکھائیں

- سے ظاہر ہوا

- دکھایا گیا

- شوز

- کی طرف

- اسی طرح

- سادہ

- بعد

- ایک

- سائز

- چھوٹے

- چھوٹے

- So

- سوسائٹی

- مکمل طور پر

- حل

- حل

- کچھ

- کہیں

- ماخذ

- خلا

- ماہر

- مہارت

- خاص

- خاص طور پر

- کمرشل

- سٹاف

- سترٹو

- شماریات

- مرحلہ

- مراحل

- بند کرو

- ذخیرہ

- پردہ

- حکمت عملی

- سلک

- سٹوڈیو

- اس طرح

- حمایت

- تائید

- کی حمایت کرتا ہے

- کے نظام

- سسٹمز

- ٹیبل

- لیتا ہے

- ٹاسک

- ٹیک

- ٹیک اسٹارپس

- ٹیکنالوجی

- بتاتا ہے

- متن

- تھائی

- سے

- کہ

- ۔

- علاقہ

- دنیا

- ان

- ان

- لہذا

- یہ

- وہ

- چیزیں

- اس

- ان

- کے ذریعے

- وقت

- کرنے کے لئے

- ٹوکن

- ٹوکن بنانا

- بھی

- اوزار

- سب سے اوپر

- روایتی

- ٹریننگ

- ٹرانسفارمر

- ٹرانسفارمرز

- تبادلوں

- ترجمہ کریں

- سفر

- بھروسہ رکھو

- دو

- اقسام

- آخر میں

- امکان نہیں

- رک نہیں سکتا۔

- جب تک

- ناپسندیدہ

- اپ ڈیٹ کریں

- us

- استعمال کی شرائط

- استعمال کیا جاتا ہے

- رکن کا

- صارف کا تجربہ

- صارفین

- کا استعمال کرتے ہوئے

- اقدار

- مختلف

- ورژن

- ورژن

- کی طرف سے

- بصری

- انتظار

- واک تھرو

- چاہتے ہیں

- تھا

- لہر

- راستہ..

- we

- ویب

- ویب خدمات

- ویب پر مبنی ہے

- کیا

- جب

- جس

- جبکہ

- وسیع

- وسیع رینج

- گے

- ساتھ

- بغیر

- کام

- کام کیا

- کام کر

- کام کرتا ہے

- دنیا

- گا

- لپیٹو

- X

- جی ہاں

- تم

- اور

- زیفیرنیٹ