Các mô hình ngôn ngữ là các phương pháp thống kê dự đoán sự kế tiếp của các mã thông báo theo trình tự, sử dụng văn bản tự nhiên. Các mô hình ngôn ngữ lớn (LLM) là các mô hình ngôn ngữ dựa trên mạng thần kinh với hàng trăm triệu (Chứng nhận) đến hơn một nghìn tỷ tham số (MiCS) và kích thước của nó khiến cho việc đào tạo một GPU trở nên không thực tế. Khả năng tạo của LLM khiến chúng trở nên phổ biến để tổng hợp văn bản, tóm tắt, dịch máy, v.v.

Kích thước của LLM và dữ liệu đào tạo của nó là con dao hai lưỡi: nó mang lại chất lượng mô hình hóa, nhưng kéo theo những thách thức về cơ sở hạ tầng. Bản thân mô hình thường quá lớn để vừa với bộ nhớ của một thiết bị GPU hoặc trên nhiều thiết bị của một phiên bản nhiều GPU. Những yếu tố này yêu cầu đào tạo LLM trên các cụm lớn phiên bản máy học (ML) tăng tốc. Trong vài năm qua, nhiều khách hàng đã sử dụng Đám mây AWS để đào tạo LLM.

Trong bài đăng này, chúng tôi đi sâu vào các mẹo và phương pháp hay nhất để đào tạo LLM thành công trên Đào tạo Amazon SageMaker. Đào tạo SageMaker là một dịch vụ tính toán ML hàng loạt được quản lý giúp giảm thời gian và chi phí đào tạo cũng như điều chỉnh các mô hình trên quy mô lớn mà không cần quản lý cơ sở hạ tầng. Trong vòng một lệnh khởi chạy, Amazon SageMaker khởi chạy một cụm điện toán tạm thời, đầy đủ chức năng chạy tác vụ bạn chọn và với các tính năng ML nâng cao như kho dữ liệu di động, I/O được quản lý và phân phối. Bài đăng bao gồm tất cả các giai đoạn của khối lượng công việc đào tạo LLM và mô tả các tính năng cơ sở hạ tầng liên quan cũng như các phương pháp hay nhất. Một số phương pháp hay nhất trong bài đăng này đề cập cụ thể đến các phiên bản ml.p4d.24xlarge nhưng hầu hết đều có thể áp dụng cho mọi loại phiên bản. Những phương pháp hay nhất này cho phép bạn đào tạo LLM trên SageMaker ở quy mô từ hàng chục đến hàng trăm triệu tham số.

Về phạm vi của bài đăng này, lưu ý những điều sau:

- Chúng tôi không đề cập đến thiết kế khoa học mạng thần kinh và các tối ưu hóa liên quan. Amazon.Science có nhiều ấn phẩm khoa học, bao gồm và không giới hạn ở LLM.

- Mặc dù bài đăng này tập trung vào LLM, nhưng hầu hết các phương pháp hay nhất của nó đều phù hợp với bất kỳ loại hình đào tạo mô hình lớn nào, bao gồm thị giác máy tính và mô hình đa phương thức, chẳng hạn như Khuếch tán ổn định.

Các phương pháp hay nhất

Chúng tôi thảo luận về các phương pháp hay nhất sau đây trong bài đăng này:

- Tính – Đào tạo SageMaker là một API tuyệt vời để khởi chạy các công việc chuẩn bị tập dữ liệu CPU và các công việc GPU quy mô hàng nghìn lần.

- Kho – Chúng tôi thấy việc tải và kiểm tra dữ liệu được thực hiện theo hai cách, tùy thuộc vào kỹ năng và sở thích: với một Amazon FSx ánh hệ thống tập tin, hoặc Dịch vụ lưu trữ đơn giản của Amazon (Amazon S3) mà thôi.

- Song song – Lựa chọn thư viện đào tạo phân tán của bạn là rất quan trọng để sử dụng GPU phù hợp. Chúng tôi khuyên bạn nên sử dụng thư viện được tối ưu hóa cho đám mây, chẳng hạn như tính song song của dữ liệu phân mảnh SageMaker, nhưng các thư viện nguồn mở và tự quản lý cũng có thể hoạt động.

- mạng – Đảm bảo đã bật EFA và NVIDIA GPUDirectRDMA để giao tiếp giữa các máy nhanh chóng.

- Khả năng phục hồi – Ở quy mô lớn, lỗi phần cứng có thể xảy ra. Chúng tôi khuyên bạn nên kiểm tra thường xuyên. Cứ vài giờ là chuyện thường.

Lựa chọn khu vực

Loại phiên bản và dung lượng mong muốn là yếu tố quyết định việc lựa chọn Khu vực. Đối với các Khu vực được hỗ trợ bởi SageMaker và Đám mây điện toán đàn hồi Amazon (Amazon EC2) các loại phiên bản có sẵn ở mỗi Khu vực, hãy xem Amazon SageMaker Giá. Trong bài đăng này, chúng tôi giả sử loại phiên bản đào tạo là ml.p4d.24xlarge do SageMaker quản lý.

Chúng tôi khuyên bạn nên làm việc với nhóm tài khoản AWS của mình hoặc liên hệ với Doanh số AWS để xác định Khu vực thích hợp cho khối lượng công việc LLM của bạn.

Chuẩn bị dữ liệu

Các nhà phát triển LLM đào tạo các mô hình của họ trên các tập dữ liệu lớn về văn bản xuất hiện tự nhiên. Các ví dụ phổ biến về các nguồn dữ liệu đó bao gồm Thu thập thông tin chung và Đống. Văn bản xuất hiện tự nhiên có thể chứa các sai lệch, không chính xác, lỗi ngữ pháp và các biến thể cú pháp. Chất lượng cuối cùng của LLM phụ thuộc đáng kể vào việc lựa chọn và quản lý dữ liệu đào tạo. Chuẩn bị dữ liệu đào tạo LLM là một lĩnh vực nghiên cứu và đổi mới tích cực trong ngành LLM. Việc chuẩn bị bộ dữ liệu xử lý ngôn ngữ tự nhiên (NLP) có rất nhiều cơ hội song song không chia sẻ. Nói cách khác, có những bước có thể được áp dụng cho các đơn vị tác phẩm—tệp nguồn, đoạn văn, câu, từ—mà không yêu cầu đồng bộ hóa giữa các nhân viên.

API công việc SageMaker, cụ thể là Đào tạo SageMaker và Xử lý SageMaker, vượt trội cho loại nhiệm vụ này. Chúng cho phép các nhà phát triển chạy một bộ chứa Docker tùy ý trên một nhóm nhiều máy. Trong trường hợp API đào tạo SageMaker, nhóm máy tính có thể được không đồng nhất. Nhiều khung máy tính phân tán đã được sử dụng trên SageMaker, bao gồm bảng điều khiển, cá đuối, Và cũng PySpark, có một chuyên dụng Vùng chứa do AWS quản lý và SDK trong Xử lý SageMaker.

Khi bạn khởi chạy một công việc với nhiều máy, Quá trình đào tạo và xử lý SageMaker sẽ chạy mã của bạn một lần trên mỗi máy. Bạn không cần sử dụng một khung điện toán phân tán cụ thể để viết một ứng dụng phân tán: bạn có thể viết mã theo lựa chọn của mình, mã này sẽ chạy một lần trên mỗi máy, để nhận ra tính song song không chia sẻ. Bạn cũng có thể viết hoặc cài đặt logic giao tiếp giữa các nút mà bạn chọn.

Tải dữ liệu

Có nhiều cách để lưu trữ dữ liệu đào tạo và di chuyển dữ liệu đó từ bộ lưu trữ của nó sang các nút điện toán được tăng tốc. Trong phần này, chúng tôi thảo luận về các tùy chọn và phương pháp hay nhất để tải dữ liệu.

Tùy chọn lưu trữ và tải SageMaker

Kích thước tập dữ liệu LLM điển hình là hàng trăm triệu mã thông báo văn bản, đại diện cho vài trăm gigabyte. Các cụm phiên bản ml.p4d.24xlarge do SageMaker quản lý đề xuất một số tùy chọn để lưu trữ và tải tập dữ liệu:

- SSD NVMe trên nút – phiên bản ml.P4d.24xlarge được trang bị NVMe 8TB, có sẵn trong

/opt/ml/input/data/<channel>nếu bạn dùng Chế độ tệp SageMakervà tại/tmp. Nếu bạn đang tìm kiếm sự đơn giản và hiệu suất của việc đọc cục bộ, bạn có thể sao chép dữ liệu của mình vào SSD NVMe. Việc sao chép có thể được thực hiện bằng chế độ Tệp SageMaker hoặc bằng mã của riêng bạn, chẳng hạn như sử dụng đa xử lý boto3 or S5cmd. - FSx cho Lustre – SSD NVMe trên nút có kích thước giới hạn và yêu cầu nhập từ Amazon S3 ở mỗi tác vụ hoặc tạo cụm ấm. Nếu bạn đang tìm cách mở rộng quy mô thành tập dữ liệu lớn hơn trong khi vẫn duy trì quyền truy cập ngẫu nhiên có độ trễ thấp, bạn có thể sử dụng FSx cho Lustre. Amazon FSx là một hệ thống tệp song song mã nguồn mở, phổ biến trong điện toán hiệu năng cao (HPC). FSx để sử dụng Lustre lưu trữ tệp phân tán (tước) và phân tách vật lý siêu dữ liệu tệp khỏi nội dung tệp để đạt được hiệu suất đọc/ghi cao.

- Chế độ tệp nhanh của SageMaker – Chế độ FastFile (FFM) là một tính năng chỉ dành cho SageMaker, trình bày các đối tượng S3 từ xa trong các phiên bản điện toán do SageMaker quản lý trong giao diện tuân thủ POSIX và chỉ truyền phát chúng khi đọc, sử dụng FUSE. FFM đọc kết quả trong lệnh gọi S3 truyền các tệp từ xa theo từng khối. Là phương pháp hay nhất để tránh các lỗi liên quan đến lưu lượng truy cập Amazon S3, các nhà phát triển FFM nên đặt mục tiêu giữ cho số lượng lệnh gọi S3 cơ bản ở mức hợp lý, chẳng hạn như bằng cách đọc các tệp tuần tự và với số lượng song song được kiểm soát.

- Tải dữ liệu tự quản lý – Tất nhiên, bạn cũng có thể quyết định triển khai logic tải dữ liệu hoàn toàn tùy chỉnh của riêng mình, sử dụng mã độc quyền hoặc mã nguồn mở. Một số lý do để sử dụng tải dữ liệu tự quản lý là để tạo điều kiện thuận lợi cho việc di chuyển bằng cách sử dụng lại mã đã được phát triển, để triển khai logic xử lý lỗi tùy chỉnh hoặc để có nhiều quyền kiểm soát hơn đối với hiệu suất cơ bản và phân đoạn. Ví dụ về các thư viện bạn có thể sử dụng để tải dữ liệu tự quản lý bao gồm torchdata.datapipes (trước đây Trình cắm AWS PyTorch S3) Và tập dữ liệu web. AWS Python SDK boto3 cũng có thể được kết hợp với Bộ dữ liệu ngọn đuốc các lớp để tạo mã tải dữ liệu tùy chỉnh. Các lớp tải dữ liệu tùy chỉnh cũng cho phép sử dụng sáng tạo các cụm không đồng nhất trong Đào tạo SageMaker, để điều chỉnh cân bằng CPU và GPU một cách tinh vi với một khối lượng công việc nhất định.

Để biết thêm thông tin về các tùy chọn đó và cách chọn chúng, hãy tham khảo Chọn nguồn dữ liệu tốt nhất cho công việc đào tạo Amazon SageMaker của bạn.

Các phương pháp hay nhất để tương tác quy mô lớn với Amazon S3

Amazon S3 có khả năng xử lý khối lượng công việc LLM, cho cả việc đọc và kiểm tra dữ liệu. Nó hỗ trợ một tỷ lệ yêu cầu trong số 3,500 yêu cầu PUT/COPY/POST/DELETE hoặc 5,500 GET/HEAD mỗi giây mỗi tiền tố trong một nhóm. Tuy nhiên, tỷ lệ này không nhất thiết phải có sẵn theo mặc định. Thay vào đó, khi tỷ lệ yêu cầu tiền tố tăng lên, Amazon S3 sẽ tự động thay đổi quy mô để xử lý tỷ lệ tăng lên. Để biết thêm thông tin, hãy tham khảo Tại sao tôi nhận được lỗi 503 Slow Down từ Amazon S3 khi các yêu cầu nằm trong tỷ lệ yêu cầu được hỗ trợ trên mỗi tiền tố.

Nếu bạn muốn tương tác với Amazon S3 với tần suất cao, chúng tôi khuyên bạn nên thực hiện các phương pháp hay nhất sau:

- Cố gắng đọc và ghi từ nhiều nhóm S3 và tiền tố. Ví dụ: bạn có thể phân vùng dữ liệu đào tạo và điểm kiểm tra trên các tiền tố khác nhau.

- Kiểm tra số liệu Amazon S3 trong amazoncloudwatch để theo dõi tỷ lệ yêu cầu.

- Cố gắng giảm thiểu số lượng PUT/GET đồng thời:

- Có ít quy trình hơn khi sử dụng Amazon S3 cùng một lúc. Ví dụ: nếu tám quy trình trên mỗi nút cần điểm kiểm tra tới Amazon S3, thì bạn có thể giảm lưu lượng PUT xuống 8 lần bằng cách điểm kiểm tra theo thứ bậc: đầu tiên trong nút, sau đó từ nút tới Amazon S3.

- Đọc nhiều bản ghi đào tạo từ một tệp hoặc S3 GET, thay vì sử dụng S3 GET cho mọi bản ghi đào tạo.

- Nếu bạn sử dụng Amazon S3 thông qua SageMaker FFM, thì SageMaker FFM thực hiện lệnh gọi S3 để tìm nạp tệp theo từng đoạn. Để giới hạn lưu lượng Amazon S3 do FFM tạo ra, chúng tôi khuyến khích bạn đọc các tệp theo trình tự và giới hạn số lượng tệp được mở song song.

Nếu bạn có một thẻ học sinh Kế hoạch hỗ trợ nhà phát triển, doanh nghiệp hoặc doanh nghiệp, bạn có thể mở trường hợp hỗ trợ kỹ thuật về lỗi S3 503 Làm chậm. Nhưng trước tiên hãy chắc chắn rằng bạn đã tuân theo các phương pháp hay nhất và lấy ID yêu cầu cho các yêu cầu không thành công.

Đào tạo song song

LLM thường có hàng chục đến hàng trăm tỷ tham số, khiến chúng quá lớn để vừa với một thẻ GPU NVIDIA. Các học viên LLM đã phát triển một số thư viện nguồn mở tạo điều kiện thuận lợi cho việc tính toán phân tán đào tạo LLM, bao gồm FSDP, Tốc độ sâu và Megatron. Bạn có thể chạy các thư viện đó trong chương trình Đào tạo SageMaker, nhưng bạn cũng có thể sử dụng các thư viện đào tạo phân tán của SageMaker đã được tối ưu hóa cho Đám mây AWS và mang lại trải nghiệm đơn giản hơn cho nhà phát triển. Các nhà phát triển có hai lựa chọn để đào tạo phân tán LLM của họ trên SageMaker: thư viện phân tán hoặc tự quản lý.

Thư viện phân phối của SageMaker

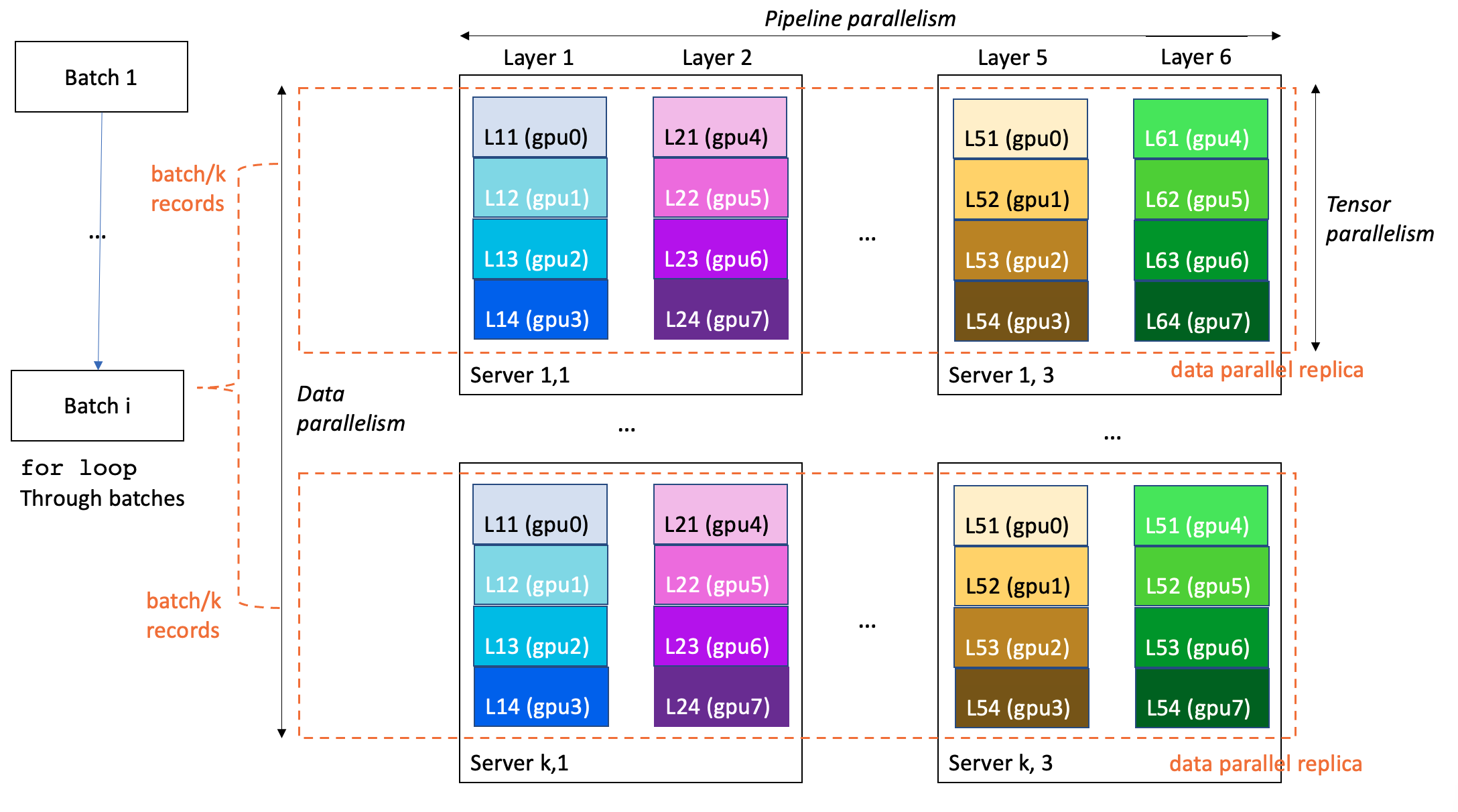

Để cung cấp cho bạn hiệu suất đào tạo phân tán được cải thiện và khả năng sử dụng, Đào tạo SageMaker đề xuất một số tiện ích mở rộng độc quyền để mở rộng quy mô mã đào tạo TensorFlow và PyTorch. Đào tạo LLM thường được tiến hành theo kiểu song song 3D:

- Song song dữ liệu chia nhỏ và cung cấp các lô nhỏ đào tạo thành nhiều bản sao giống hệt nhau của mô hình, để tăng tốc độ xử lý

- song song đường ống gán các lớp khác nhau của mô hình cho các GPU hoặc thậm chí các phiên bản khác nhau, để mở rộng kích thước mô hình ra ngoài một GPU và một máy chủ

- Tensor song song chia một lớp thành nhiều GPU, thường là trong cùng một máy chủ, để chia tỷ lệ các lớp riêng lẻ thành các kích thước vượt quá một GPU

Trong ví dụ sau, mô hình 6 lớp được đào tạo trên một cụm k*3 máy chủ với 8*k*3 GPU (8 GPU trên mỗi máy chủ). Mức độ song song dữ liệu là k, song song đường ống 6 và song song tensor 4. Mỗi GPU trong cụm chứa 24/XNUMX lớp mô hình và một mô hình đầy đủ được phân vùng trên ba máy chủ (tổng cộng XNUMX GPU).

Những điều sau đây có liên quan cụ thể đối với LLM:

- SageMaker phân phối mô hình song song – Thư viện này sử dụng phân vùng biểu đồ để tạo phân vùng mô hình thông minh được tối ưu hóa cho tốc độ hoặc bộ nhớ. Song song mô hình phân tán của SageMaker cho thấy khả năng tối ưu hóa đào tạo mô hình lớn mới nhất và lớn nhất, bao gồm song song dữ liệu, song song đường ống, song song tensor, phân đoạn trạng thái trình tối ưu hóa, điểm kiểm tra kích hoạt và giảm tải. Với thư viện song song mô hình phân tán SageMaker, chúng tôi đã ghi lại quá trình đào tạo mô hình 175 tỷ tham số trên 920 GPU NVIDIA A100. Để biết thêm thông tin, hãy tham khảo Đào tạo hơn 175 tỷ mô hình NLP tham số với các bổ sung song song mô hình và Ôm mặt trên Amazon SageMaker.

- SageMaker phân đoạn dữ liệu song song - Trong MiCS: Tỷ lệ gần tuyến tính để đào tạo mô hình khổng lồ trên đám mây công cộng, Zhang và cộng sự. giới thiệu một chiến lược song song mô hình giao tiếp thấp chỉ phân vùng các mô hình trên một nhóm song song dữ liệu, thay vì toàn bộ cụm. Với MiCS, các nhà khoa học AWS có thể đạt được 176 teraflop trên mỗi GPU (56.4% mức cao nhất theo lý thuyết) để đào tạo mô hình 210 lớp 1.06 nghìn tỷ tham số trên các phiên bản EC2 P4de. MiCS hiện có sẵn cho khách hàng của SageMaker Training dưới dạng SageMaker phân đoạn dữ liệu song song.

Các thư viện đào tạo phân tán của SageMaker cung cấp hiệu suất cao và trải nghiệm đơn giản hơn cho nhà phát triển. Đặc biệt, các nhà phát triển không cần viết và duy trì trình khởi chạy quy trình song song tùy chỉnh hoặc sử dụng công cụ khởi chạy dành riêng cho khung vì trình khởi chạy song song được tích hợp vào SDK khởi chạy công việc.

Tự quản lý

Với chương trình Đào tạo SageMaker, bạn có quyền tự do sử dụng khuôn khổ và mô hình khoa học mà mình lựa chọn. Đặc biệt, nếu bạn muốn tự quản lý đào tạo phân tán, bạn có hai tùy chọn để viết mã tùy chỉnh của mình:

- Sử dụng AWS Deep Learning Container (DLC) – AWS phát triển và duy trì DLC, cung cấp môi trường dựa trên Docker được AWS tối ưu hóa cho các khung ML nguồn mở hàng đầu. SageMaker Training có tích hợp độc đáo cho phép bạn lấy và chạy AWS DLC với điểm vào bên ngoài, do người dùng xác định. Đối với đào tạo LLM nói riêng, DLC AWS dành cho TensorFlow, PyTorch, Hugging Face và MXNet đặc biệt phù hợp. Sử dụng DLC khung cho phép bạn sử dụng song song gốc khung, chẳng hạn như PyTorch Distributed, mà không phải phát triển và quản lý hình ảnh Docker của riêng bạn. Ngoài ra, DLC của chúng tôi có tính năng tích hợp MPI, cho phép bạn khởi chạy mã song song một cách dễ dàng.

- Viết hình ảnh Docker tương thích với SageMaker tùy chỉnh – Bạn có thể mang theo hình ảnh (BYO) của chính mình (xem Sử dụng các thuật toán đào tạo của riêng bạn và Vùng chứa đào tạo tùy chỉnh của Amazon SageMaker), bắt đầu từ đầu hoặc mở rộng hình ảnh DLC hiện có. Khi sử dụng hình ảnh tùy chỉnh để đào tạo LLM trên SageMaker, điều đặc biệt quan trọng là phải xác minh những điều sau:

- Hình ảnh của bạn chứa EFA với các cài đặt phù hợp (thảo luận thêm sau trong bài đăng này)

- Hình ảnh của bạn chứa thư viện giao tiếp NVIDIA NCCL, được bật bằng GPUDirectRDMA

Khách hàng đã có thể sử dụng một số thư viện đào tạo phân tán tự quản lý, bao gồm cả DeepSpeed.

Truyền thông

Do tính chất phân tán của công việc đào tạo LLM, giao tiếp giữa các máy rất quan trọng đối với tính khả thi, hiệu suất và chi phí của khối lượng công việc. Trong phần này, chúng tôi trình bày các tính năng chính để giao tiếp giữa các máy và kết luận với các mẹo cài đặt và điều chỉnh.

Bộ điều hợp vải đàn hồi

Để tăng tốc các ứng dụng ML và cải thiện hiệu suất bằng cách đạt được tính linh hoạt, khả năng mở rộng và tính linh hoạt do đám mây cung cấp, bạn có thể tận dụng lợi thế của Bộ điều hợp vải đàn hồi (EFA) với SageMaker. Theo kinh nghiệm của chúng tôi, việc sử dụng EFA là một yêu cầu để có được hiệu suất đào tạo LLM đa nút đạt yêu cầu.

Thiết bị EFA là một giao diện mạng được gắn với các phiên bản EC2 do SageMaker quản lý trong quá trình chạy công việc đào tạo. EFA khả dụng trên các dòng phiên bản cụ thể, bao gồm cả P4d. Các mạng EFA có khả năng đạt được thông lượng hàng trăm Gbps.

Liên kết với EFA, AWS đã giới thiệu Datagram đáng tin cậy có thể mở rộng (SRD), một phương thức vận chuyển dựa trên ethernet lấy cảm hứng từ Gói dữ liệu đáng tin cậy của InfiniBand, được phát triển với ràng buộc đặt hàng gói thoải mái. Để biết thêm thông tin về EFA và SRD, hãy tham khảo Trong quá trình tìm kiếm hiệu suất, có nhiều cách để xây dựng mạng lưới, video Cách thức hoạt động của EFA và lý do tại sao chúng tôi không sử dụng infiniband trên đám mây, và bài nghiên cứu Giao thức vận chuyển được tối ưu hóa trên đám mây cho HPC linh hoạt và có thể mở rộng từ Shalev et al.

Bạn có thể thêm tích hợp EFA trên các phiên bản tương thích vào bộ chứa Docker hiện có của SageMaker hoặc bộ chứa tùy chỉnh có thể được sử dụng để đào tạo các mô hình ML bằng cách sử dụng công việc SageMaker. Để biết thêm thông tin, hãy tham khảo Chạy đào tạo với EFA. EFA được hiển thị thông qua mã nguồn mở thư viện gói truyền thông. Tuy nhiên, các nhà phát triển LLM hiếm khi trực tiếp lập trình nó với Libfabric và thay vào đó thường dựa vào Thư viện truyền thông tập thể NVIDIA (NCCL).

Trình cắm AWS-OFI-NCCL

Trong ML phân tán, EFA thường được sử dụng nhiều nhất với Thư viện truyền thông tập thể NVIDIA (NCCL). NCCL là một thư viện nguồn mở do NVIDIA phát triển triển khai các thuật toán giao tiếp giữa các GPU. Giao tiếp giữa các GPU là nền tảng của đào tạo LLM xúc tác cho khả năng mở rộng và hiệu suất. Điều quan trọng đối với đào tạo DL là NCCL thường được tích hợp trực tiếp dưới dạng phụ trợ giao tiếp trong các thư viện đào tạo deep learning, để các nhà phát triển LLM sử dụng nó—đôi khi không nhận thấy—từ khung phát triển Python DL ưa thích của họ. Để sử dụng NCCL trên EFA, nhà phát triển LLM sử dụng công cụ do AWS phát triển Phần bổ trợ AWS OFI NCCL, ánh xạ lệnh gọi NCCL tới giao diện Libfabric được EFA sử dụng. Chúng tôi khuyên bạn nên sử dụng phiên bản AWS OFI NCCL mới nhất để hưởng lợi từ những cải tiến gần đây.

Để xác minh rằng NCCL sử dụng EFA, bạn nên đặt biến môi trường NCCL_DEBUG đến INFOvà kiểm tra trong nhật ký rằng EFA được NCCL tải:

Để biết thêm thông tin về cấu hình NCCL và EFA, hãy tham khảo Kiểm tra cấu hình EFA và NCCL của bạn. Bạn có thể tùy chỉnh thêm NCCL với một số biến môi trường. Lưu ý rằng có hiệu lực trong NCCL 2.12 trở lên, AWS đã đóng góp logic lựa chọn thuật toán giao tiếp tự động cho các mạng EFA (NCCL_ALGO có thể không được đặt).

NVIDIA GPUDirect RDMA qua EFA

Với loại phiên bản P4d, chúng tôi giới thiệu GPUDirect RDMA (GDR) trên kết cấu EFA. Nó cho phép các thẻ giao diện mạng (NIC) truy cập trực tiếp vào bộ nhớ GPU, giúp giao tiếp giữa GPU với GPU từ xa trên các phiên bản EC2 dựa trên GPU NVIDIA nhanh hơn, giảm chi phí điều phối trên CPU và ứng dụng người dùng. GDR được NCCL sử dụng bí mật, khi khả thi.

Việc sử dụng GDR xuất hiện trong giao tiếp giữa các GPU khi mức nhật ký được đặt thành THÔNG TIN, như trong đoạn mã sau:

Sử dụng EFA trong AWS Deep Learning Containers

AWS duy trì Bộ chứa Deep Learning (DLC), nhiều trong số đó đi kèm với Dockerfiles do AWS quản lý và được xây dựng có chứa EFA, AWS OFI NCCL và NCCL. Các repo GitHub sau đây cung cấp các ví dụ với Kim tự tháp và TensorFlow. Bạn không cần phải tự cài đặt các thư viện đó.

Sử dụng EFA trong vùng chứa Đào tạo SageMaker của riêng bạn

Nếu bạn tạo bộ chứa Đào tạo SageMaker của riêng mình và muốn sử dụng NCCL qua EFA để tăng tốc giao tiếp giữa các nút, thì bạn cần cài đặt EFA, NCCL và AWS OFI NCCL. Để biết thêm thông tin, hãy tham khảo Chạy đào tạo với EFA. Ngoài ra, bạn nên đặt các biến môi trường sau trong vùng chứa hoặc trong mã điểm nhập của mình:

FI_PROVIDER="efa"chỉ định nhà cung cấp giao diện vảiNCCL_PROTO=simplehướng dẫn NCCL sử dụng một giao thức đơn giản để liên lạc (hiện tại, nhà cung cấp EFA không hỗ trợ các giao thức LL; việc kích hoạt chúng có thể dẫn đến hỏng dữ liệu)FI_EFA_USE_DEVICE_RDMA=1sử dụng chức năng RDMA của thiết bị để chuyển một phía và hai phíaNCCL_LAUNCH_MODE="PARALLEL"NCCL_NET_SHARED_COMMS="0"

Dàn nhạc

Việc quản lý vòng đời và khối lượng công việc của hàng chục đến hàng trăm phiên bản điện toán cần có phần mềm điều phối. Trong phần này, chúng tôi cung cấp các phương pháp hay nhất để điều phối LLM

Phối hợp trong công việc

Các nhà phát triển phải viết cả mã đào tạo phía máy chủ và mã trình khởi chạy phía máy khách trong hầu hết các khung phân tán. Mã đào tạo chạy trên máy đào tạo, trong khi mã trình khởi chạy phía máy khách khởi chạy khối lượng công việc phân tán từ máy khách. Ngày nay có rất ít tiêu chuẩn hóa, ví dụ:

- Trong PyTorch, các nhà phát triển có thể khởi chạy các tác vụ nhiều máy bằng cách sử dụng

torchrun,torchx,torch.distributed.launch(đường dẫn không dùng nữa) hoặctorch.multiprocessing.spawn - DeepSpeed đề xuất trình khởi chạy CLI tốc độ sâu của riêng mình và cũng hỗ trợ khởi chạy MPI

- MPI là một khung tính toán song song phổ biến có lợi ích là không phụ thuộc vào ML và được sử dụng hợp lý, do đó ổn định và được ghi lại, đồng thời ngày càng được thấy nhiều trong các khối lượng công việc ML phân tán

Trong cụm Đào tạo SageMaker, vùng chứa đào tạo được khởi chạy một lần trên mỗi máy. Do đó, bạn có ba lựa chọn:

- Trình khởi chạy gốc – Bạn có thể sử dụng trình khởi chạy gốc của một khung DL cụ thể làm điểm vào, ví dụ:

torchruncuộc gọi, chính nó sẽ tạo ra nhiều quy trình cục bộ và thiết lập liên lạc giữa các phiên bản. - Tích hợp SageMaker MPI – Bạn có thể sử dụng tích hợp SageMaker MPI, có sẵn trong AWS DLC của chúng tôi hoặc có thể tự cài đặt qua sagemaker-đào tạo-bộ công cụ, để chạy trực tiếp mã điểm vào của bạn N lần trên mỗi máy. Điều này có lợi là tránh sử dụng các tập lệnh trình khởi chạy trung gian, dành riêng cho khung trong mã của riêng bạn.

- Thư viện phân phối của SageMaker – Nếu bạn sử dụng các thư viện được phân phối của SageMaker, bạn có thể tập trung vào mã đào tạo và hoàn toàn không phải viết mã trình khởi chạy! Mã trình khởi chạy phân tán SageMaker được tích hợp vào SDK SageMaker.

Phối hợp liên công việc

Các dự án LLM thường bao gồm nhiều công việc: tìm kiếm tham số, thử nghiệm mở rộng quy mô, khôi phục lỗi, v.v. Để bắt đầu, dừng và song song hóa các nhiệm vụ đào tạo, điều quan trọng là phải sử dụng bộ điều phối công việc. SageMaker Training là một công cụ điều phối công việc ML không cần máy chủ, cung cấp các phiên bản điện toán tạm thời ngay lập tức theo yêu cầu. Bạn chỉ trả tiền cho những gì bạn sử dụng và các cụm sẽ ngừng hoạt động ngay khi mã của bạn kết thúc. Với Bể bơi ấm đào tạo SageMaker, bạn có tùy chọn xác định thời gian tồn tại trên các cụm đào tạo để sử dụng lại cơ sở hạ tầng giống nhau trong các công việc. Điều này làm giảm thời gian lặp lại và sự thay đổi vị trí giữa các công việc. Công việc SageMaker có thể được khởi chạy từ nhiều ngôn ngữ lập trình, bao gồm Python và CLI.

Có SDK Python dành riêng cho SageMaker được gọi là SDK Python của SageMaker và được thực hiện thông qua nhà làm hiền triết Thư viện Python, nhưng việc sử dụng nó là tùy chọn.

Tăng chỉ tiêu nghề đào tạo với cụm đào tạo lớn và dài

SageMaker có hạn ngạch mặc định đối với tài nguyên, được thiết kế để ngăn chi phí và việc sử dụng ngoài ý muốn. Để đào tạo LLM bằng cách sử dụng một nhóm lớn các phiên bản cao cấp chạy trong thời gian dài, bạn có thể cần phải tăng hạn ngạch trong bảng sau.

| tên hạn ngạch | Giá trị mặc định |

| Thời gian chạy dài nhất cho một công việc đào tạo | 432,000 giây |

| Số lượng trường hợp trên tất cả các công việc đào tạo | 4 |

| Số lượng phiên bản tối đa cho mỗi công việc đào tạo | 20 |

| ml.p4d.24xlarge để sử dụng công việc đào tạo | 0 |

| ml.p4d.24xlarge để đào tạo cách sử dụng hồ nước ấm | 0 |

Xem Định mức dịch vụ AWS cách xem các giá trị hạn ngạch của bạn và yêu cầu tăng hạn ngạch. Theo yêu cầu, Phiên bản dùng ngay và hạn ngạch nhóm ấm đào tạo được theo dõi và sửa đổi riêng.

Nếu bạn quyết định tiếp tục kích hoạt Trình cấu hình SageMaker, hãy lưu ý rằng mọi công việc đào tạo đều khởi chạy một công việc Xử lý SageMaker, mỗi công việc tiêu tốn một phiên bản ml.m5.2xlarge. Xác nhận rằng hạn ngạch Xử lý SageMaker của bạn đủ cao để đáp ứng đồng thời công việc đào tạo dự kiến. Ví dụ: nếu bạn muốn khởi chạy đồng thời 50 tác vụ đào tạo hỗ trợ Profiler, bạn sẽ cần tăng giới hạn sử dụng ml.m5.2xlarge cho xử lý tác vụ lên 50.

Ngoài ra, để khởi chạy một công việc dài hạn, bạn sẽ cần đặt rõ ràng Người định giá max_run tham số thành thời lượng tối đa mong muốn cho công việc đào tạo tính bằng giây, tối đa giá trị hạn ngạch của thời gian chạy dài nhất cho công việc đào tạo.

Giám sát và khả năng phục hồi

Lỗi phần cứng là cực kỳ hiếm ở quy mô của một phiên bản và ngày càng trở nên thường xuyên hơn khi số lượng phiên bản được sử dụng đồng thời tăng lên. Ở quy mô LLM điển hình—hàng trăm đến hàng nghìn GPU được sử dụng 24/7 trong nhiều tuần đến nhiều tháng—lỗi phần cứng gần như chắc chắn sẽ xảy ra. Do đó, khối lượng công việc LLM phải triển khai các cơ chế giám sát và phục hồi thích hợp. Đầu tiên, điều quan trọng là phải giám sát chặt chẽ cơ sở hạ tầng LLM, để hạn chế tác động của lỗi và tối ưu hóa việc sử dụng tài nguyên điện toán. Đào tạo SageMaker đề xuất một số tính năng cho mục đích này:

- Nhật ký được tự động gửi đến CloudWatch Logs. Nhật ký bao gồm kịch bản đào tạo của bạn

stdoutvàstderr. Trong đào tạo phân tán dựa trên MPI, tất cả nhân viên MPI gửi nhật ký của họ tới quy trình của người lãnh đạo. - Các chỉ số sử dụng tài nguyên hệ thống như bộ nhớ, mức sử dụng CPU và mức sử dụng GPU sẽ tự động được gửi tới CloudWatch.

- Bạn có thể xác định số liệu đào tạo tùy chỉnh sẽ được gửi tới CloudWatch. Các số liệu được thu thập từ nhật ký dựa trên các biểu thức chính quy mà bạn đã đặt. Các gói thử nghiệm của bên thứ ba như Đối tác AWS cung cấp Trọng số & Xu hướng có thể được sử dụng với Đào tạo SageMaker (ví dụ: xem Tối ưu hóa Siêu tham số CIFAR-10 với W&B và SageMaker).

- Hồ sơ SageMaker cho phép bạn kiểm tra việc sử dụng cơ sở hạ tầng và nhận các đề xuất tối ưu hóa.

- Sự kiện Amazon và AWS Lambda cho phép bạn tạo logic máy khách tự động phản ứng với các sự kiện như lỗi công việc, thành công, tải lên tệp S3, v.v.

- Trình trợ giúp SageMaker SSH là một thư viện nguồn mở do cộng đồng duy trì cho phép bạn kết nối với các máy chủ đào tạo công việc thông qua SSH. Có thể hữu ích khi kiểm tra và khắc phục sự cố mã chạy trên các nút cụ thể.

Ngoài giám sát, SageMaker còn mang đến thiết bị phục vụ công việc:

- Kiểm tra sức khỏe cụm – Trước khi công việc của bạn bắt đầu, SageMaker chạy kiểm tra tình trạng GPU và xác minh giao tiếp NCCL trên các phiên bản GPU, thay thế mọi phiên bản bị lỗi nếu cần để đảm bảo tập lệnh đào tạo của bạn bắt đầu chạy trên một cụm phiên bản khỏe mạnh. Kiểm tra tình trạng hiện được bật cho các loại phiên bản dựa trên GPU P và G.

- Thử lại tích hợp và cập nhật cụm – Bạn có thể định cấu hình SageMaker để tự động thử lại công việc đào tạo không thành công với lỗi máy chủ nội bộ SageMaker (ISE). Là một phần của việc thử lại công việc, SageMaker sẽ thay thế bất kỳ phiên bản nào gặp phải lỗi GPU không thể khôi phục bằng các phiên bản mới, khởi động lại tất cả các phiên bản khỏe mạnh và bắt đầu lại công việc. Điều này dẫn đến khởi động lại nhanh hơn và hoàn thành khối lượng công việc. Cập nhật cụm hiện được bật cho các loại phiên bản dựa trên GPU P và G. Bạn có thể thêm vào của riêng bạn cơ chế thử lại ứng dụng xung quanh mã máy khách gửi công việc, để xử lý các loại lỗi khởi chạy khác, chẳng hạn như vượt quá hạn ngạch tài khoản của bạn.

- Tự động điểm kiểm tra tới Amazon S3 – Điều này giúp bạn trạm kiểm soát tiến trình của bạn và tải lại trạng thái trong quá khứ cho các công việc mới.

Để hưởng lợi từ việc thay thế cấp độ nút, mã của bạn phải có lỗi. Tập thể có thể bị treo, thay vì bị lỗi, khi một nút bị lỗi. Do đó, để có biện pháp khắc phục kịp thời, hãy đặt đúng thời gian chờ cho tập thể của bạn và yêu cầu mã đưa ra lỗi khi đạt đến.

Một số khách hàng thiết lập ứng dụng khách giám sát để theo dõi và hành động trong trường hợp treo công việc hoặc dừng hội tụ ứng dụng, bằng cách theo dõi nhật ký và chỉ số CloudWatch để biết các mẫu bất thường như không ghi nhật ký hoặc mức sử dụng GPU 0% để gợi ý treo, dừng hội tụ và tự động dừng/thử lại công việc.

Tìm hiểu sâu về điểm kiểm tra

Sản phẩm Điểm kiểm tra SageMaker tính năng sao chép mọi thứ bạn viết trên đó /opt/ml/checkpoints quay lại Amazon S3 dưới dạng URI được chỉ định trong checkpoint_s3_uri tham số SDK. Khi một công việc bắt đầu hoặc khởi động lại, mọi thứ được viết tại URI đó sẽ được gửi trở lại tất cả các máy, tại /opt/ml/checkpoints. Điều này thuận tiện nếu bạn muốn tất cả các nút có quyền truy cập vào tất cả các điểm kiểm tra, nhưng ở quy mô lớn—khi bạn có nhiều máy hoặc nhiều điểm kiểm tra lịch sử, điều này có thể dẫn đến thời gian tải xuống lâu và lưu lượng truy cập quá cao trên Amazon S3. Ngoài ra, trong mô hình tensor và đường ống song song, công nhân chỉ cần một phần của mô hình điểm kiểm tra, không phải tất cả. Nếu bạn gặp phải những hạn chế đó, chúng tôi đề xuất các tùy chọn sau:

- Điểm kiểm tra FSx cho Lustre – Nhờ có I/O ngẫu nhiên hiệu suất cao, bạn có thể xác định lược đồ phân bổ tệp và phân bổ tệp theo lựa chọn của mình

- Điểm kiểm tra Amazon S3 tự quản lý – Để biết ví dụ về các hàm Python có thể được sử dụng để lưu và đọc các điểm kiểm tra theo kiểu không chặn, hãy tham khảo Lưu điểm kiểm tra

Chúng tôi đặc biệt khuyên bạn nên kiểm tra mô hình của mình vài giờ một lần, chẳng hạn như 1–3 giờ, tùy thuộc vào tổng chi phí và chi phí liên quan.

Giao diện người dùng và quản lý người dùng

Quản lý người dùng là điểm mạnh về khả năng sử dụng chính của SageMaker so với cơ sở hạ tầng HPC dùng chung cũ. Quyền đào tạo SageMaker được quản lý bởi một số Quản lý truy cập và nhận dạng AWS (IAM) tóm tắt:

- Hiệu trưởng—người dùng và hệ thống—được cấp quyền khởi chạy tài nguyên

- Bản thân các công việc đào tạo mang các vai trò, cho phép chúng có quyền riêng, ví dụ như liên quan đến truy cập dữ liệu và gọi dịch vụ

Ngoài ra, vào năm 2022, chúng tôi đã thêm Người quản lý vai trò SageMaker để tạo điều kiện thuận lợi cho việc tạo các quyền theo hướng cá nhân.

Kết luận

Với Đào tạo SageMaker, bạn có thể giảm chi phí và tăng tốc độ lặp lại trên khối lượng công việc đào tạo mô hình lớn của mình. Chúng tôi đã ghi lại những câu chuyện thành công trong nhiều bài đăng và nghiên cứu điển hình, bao gồm:

Nếu bạn đang tìm cách cải thiện thời gian đưa LLM ra thị trường đồng thời giảm chi phí, hãy xem API đào tạo SageMaker và cho chúng tôi biết những gì bạn xây dựng!

Xin đặc biệt cảm ơn Amr Ragab, Rashika Kheria, Zmnako Awrahman, Arun Nagarajan, Gal Oshri vì những nhận xét và lời dạy hữu ích của họ.

Về các tác giả

Anastasia Tzeveleka là Kiến trúc sư giải pháp chuyên gia về máy học và trí tuệ nhân tạo tại AWS. Cô làm việc với các khách hàng ở EMEA và giúp họ thiết kế các giải pháp máy học trên quy mô lớn bằng các dịch vụ AWS. Cô ấy đã làm việc cho các dự án trong các lĩnh vực khác nhau bao gồm Xử lý ngôn ngữ tự nhiên (NLP), MLOps và các công cụ Low Code No Code.

Anastasia Tzeveleka là Kiến trúc sư giải pháp chuyên gia về máy học và trí tuệ nhân tạo tại AWS. Cô làm việc với các khách hàng ở EMEA và giúp họ thiết kế các giải pháp máy học trên quy mô lớn bằng các dịch vụ AWS. Cô ấy đã làm việc cho các dự án trong các lĩnh vực khác nhau bao gồm Xử lý ngôn ngữ tự nhiên (NLP), MLOps và các công cụ Low Code No Code.

Gili Nachum là một Kiến trúc sư giải pháp chuyên gia AI / ML cấp cao, người làm việc như một phần của nhóm Học máy Amazon của EMEA. Gili đam mê những thách thức của việc đào tạo mô hình học sâu và cách học máy đang thay đổi thế giới như chúng ta đã biết. Khi rảnh rỗi, Gili thích chơi bóng bàn.

Gili Nachum là một Kiến trúc sư giải pháp chuyên gia AI / ML cấp cao, người làm việc như một phần của nhóm Học máy Amazon của EMEA. Gili đam mê những thách thức của việc đào tạo mô hình học sâu và cách học máy đang thay đổi thế giới như chúng ta đã biết. Khi rảnh rỗi, Gili thích chơi bóng bàn.

Olivier Cruchant là Kiến trúc sư giải pháp chuyên gia về máy học chính tại AWS, có trụ sở tại Pháp. Olivier giúp các khách hàng của AWS – từ các công ty mới thành lập nhỏ đến các doanh nghiệp lớn – phát triển và triển khai các ứng dụng machine learning cấp sản xuất. Khi rảnh rỗi, anh ấy thích đọc các tài liệu nghiên cứu và khám phá vùng hoang dã với bạn bè và gia đình.

Olivier Cruchant là Kiến trúc sư giải pháp chuyên gia về máy học chính tại AWS, có trụ sở tại Pháp. Olivier giúp các khách hàng của AWS – từ các công ty mới thành lập nhỏ đến các doanh nghiệp lớn – phát triển và triển khai các ứng dụng machine learning cấp sản xuất. Khi rảnh rỗi, anh ấy thích đọc các tài liệu nghiên cứu và khám phá vùng hoang dã với bạn bè và gia đình.

Bruno Pistone là Kiến trúc sư Giải pháp Chuyên gia về AI / ML cho AWS có trụ sở tại Milan. Anh ấy làm việc với khách hàng ở mọi quy mô để giúp họ hiểu sâu sắc nhu cầu kỹ thuật của họ và thiết kế các giải pháp AI và Học máy để tận dụng tốt nhất Đám mây AWS và ngăn xếp Học máy của Amazon. Lĩnh vực chuyên môn của ông là Học máy từ đầu đến cuối, Công nghiệp hóa Học máy và MLOps. Anh ấy thích dành thời gian với bạn bè và khám phá những địa điểm mới, cũng như đi du lịch đến những điểm đến mới.

Bruno Pistone là Kiến trúc sư Giải pháp Chuyên gia về AI / ML cho AWS có trụ sở tại Milan. Anh ấy làm việc với khách hàng ở mọi quy mô để giúp họ hiểu sâu sắc nhu cầu kỹ thuật của họ và thiết kế các giải pháp AI và Học máy để tận dụng tốt nhất Đám mây AWS và ngăn xếp Học máy của Amazon. Lĩnh vực chuyên môn của ông là Học máy từ đầu đến cuối, Công nghiệp hóa Học máy và MLOps. Anh ấy thích dành thời gian với bạn bè và khám phá những địa điểm mới, cũng như đi du lịch đến những điểm đến mới.

- Phân phối nội dung và PR được hỗ trợ bởi SEO. Được khuếch đại ngay hôm nay.

- Platoblockchain. Web3 Metaverse Intelligence. Khuếch đại kiến thức. Truy cập Tại đây.

- nguồn: https://aws.amazon.com/blogs/machine-learning/training-large-language-models-on-amazon-sagemaker-best-practices/

- :là

- ][P

- $ LÊN

- 000

- 1

- 100

- 2022

- 7

- 8

- a

- khả năng

- Có khả năng

- Giới thiệu

- ở trên

- đẩy nhanh tiến độ

- tăng tốc

- truy cập

- chứa

- Tài khoản

- Đạt được

- đạt được

- ngang qua

- Hành động

- kích hoạt

- hoạt động

- thích ứng

- thêm

- Ngoài ra

- Ngoài ra

- bổ sung

- Lợi thế

- AI

- AI / ML

- AL

- thuật toán

- thuật toán

- Tất cả

- Cho phép

- cho phép

- đàn bà gan dạ

- Amazon EC2

- Amazon FSx

- Học máy Amazon

- Amazon SageMaker

- số lượng

- và

- api

- API

- áp dụng

- Các Ứng Dụng

- các ứng dụng

- áp dụng

- thích hợp

- LÀ

- KHU VỰC

- xung quanh

- AS

- liên kết

- At

- thuộc tính

- tự động

- Tự động

- tự động

- có sẵn

- tránh

- AWS

- trở lại

- Backend

- Cân đối

- dựa

- BE

- bởi vì

- trở thành

- trước

- được

- hưởng lợi

- BEST

- thực hành tốt nhất

- Ngoài

- lớn

- Tỷ

- tỷ

- Chặn

- mang lại

- Mang lại

- xây dựng

- xây dựng

- kinh doanh

- by

- cuộc gọi

- gọi là

- Cuộc gọi

- CAN

- có khả năng

- Sức chứa

- thẻ

- Thẻ

- mang

- trường hợp

- Nghiên cứu điển hình

- chất xúc tác

- thách thức

- thay đổi

- Kênh

- kiểm tra

- Séc

- sự lựa chọn

- lựa chọn

- Chọn

- các lớp học

- khách hàng

- chặt chẽ

- đám mây

- cụm

- mã

- Tập thể

- kết hợp

- Đến

- Chung

- thông thường

- Giao tiếp

- Truyền thông

- so

- tương thích

- hoàn thành

- tính toán

- Tính

- máy tính

- Tầm nhìn máy tính

- máy tính

- kết luận

- thực hiện

- Cấu hình

- Xác nhận

- Kết nối

- hậu quả là

- chứa

- Container

- Container

- chứa

- nội dung

- đóng góp

- điều khiển

- kiểm soát

- Tiện lợi

- Hội tụ

- tham nhũng

- Phí Tổn

- Chi phí

- có thể

- Khóa học

- che

- Covers

- tạo

- tạo

- Sáng tạo

- quan trọng

- quan trọng

- sự giám tuyển

- Hiện nay

- khách hàng

- khách hàng

- tùy chỉnh

- dữ liệu

- truy cập dữ liệu

- Chuẩn bị dữ liệu

- bộ dữ liệu

- quyết định

- dành riêng

- sâu

- học kĩ càng

- Mặc định

- Bằng cấp

- Tùy

- phụ thuộc

- triển khai

- Thiết kế

- thiết kế

- mong muốn

- khu

- Xác định

- xác định

- phát triển

- phát triển

- Nhà phát triển

- phát triển

- Phát triển

- phát triển

- thiết bị

- Thiết bị (Devices)

- khác nhau

- Lôi thôi

- trực tiếp

- thảo luận

- thảo luận

- phân phối

- phân phối máy tính

- đào tạo phân tán

- phân phối

- phu bến tàu

- Không

- lĩnh vực

- dont

- xuống

- tải về

- hàng chục

- suốt trong

- mỗi

- dễ dàng

- Hiệu quả

- hay

- EMEA

- cho phép

- kích hoạt

- cho phép

- cho phép

- khuyến khích

- kết thúc

- nâng cao

- thưởng thức

- đủ

- đảm bảo

- Doanh nghiệp

- doanh nghiệp

- nhập

- Môi trường

- môi trường

- Trang thiết bị

- đã trang bị

- lôi

- lỗi

- thành lập

- Ngay cả

- sự kiện

- cuối cùng

- Mỗi

- tất cả mọi thứ

- phát triển

- ví dụ

- ví dụ

- Excel

- hiện tại

- mong đợi

- dự kiến

- kinh nghiệm

- thử nghiệm

- Khám phá

- tiếp xúc

- biểu thức

- mở rộng

- mở rộng

- ngoài

- cực kỳ

- vải

- Đối mặt

- tạo điều kiện

- tạo điều kiện

- các yếu tố

- thất bại

- không

- Không

- gia đình

- gia đình

- Thời trang

- NHANH

- nhanh hơn

- bị lỗi

- khả thi

- Đặc tính

- Tính năng

- vài

- lĩnh vực

- Tập tin

- Các tập tin

- Tên

- phù hợp với

- VÒI

- Linh hoạt

- Tập trung

- tập trung

- sau

- tiếp theo

- Trong

- phân số

- Khung

- khung

- Nước pháp

- Freedom

- thường xuyên

- tươi

- bạn bè

- từ

- Full

- đầy đủ

- chức năng

- chức năng

- chức năng

- xa hơn

- GAL

- tạo ra

- thế hệ

- được

- nhận được

- GitHub

- được

- GPU

- GPU

- đồ thị

- tuyệt vời

- lớn nhất

- Nhóm

- Phát triển

- xử lý

- Xử lý

- Treo

- xảy ra

- phần cứng

- Có

- có

- cho sức khoẻ

- khỏe mạnh

- hữu ích

- giúp đỡ

- giúp

- Cao

- Tân sô cao

- hiệu suất cao

- lịch sử

- mui xe

- host

- GIỜ LÀM VIỆC

- Độ đáng tin của

- Hướng dẫn

- Tuy nhiên

- hpc

- HTML

- http

- HTTPS

- Hàng trăm

- hàng trăm triệu

- i

- giống hệt nhau

- Bản sắc

- hình ảnh

- hình ảnh

- ngay

- Va chạm

- thực hiện

- thực hiện

- thực hiện

- quan trọng

- nâng cao

- cải thiện

- cải tiến

- in

- Mặt khác

- bao gồm

- Bao gồm

- Tăng lên

- tăng

- Tăng

- lên

- hệ thống riêng biệt,

- ngành công nghiệp

- Thông tin

- thông tin

- Cơ sở hạ tầng

- sự đổi mới

- lấy cảm hứng từ

- cài đặt, dựng lên

- ví dụ

- thay vì

- tích hợp

- hội nhập

- Thông minh

- tương tác

- Giao thức

- người Trung gian

- nội bộ

- giới thiệu

- giới thiệu

- IT

- sự lặp lại

- ITS

- chính nó

- Việc làm

- việc làm

- jpg

- Giữ

- Key

- Loại

- Biết

- Ngôn ngữ

- Ngôn ngữ

- lớn

- quy mô lớn

- lớn hơn

- mới nhất

- phóng

- phát động

- ra mắt

- lớp

- lớp

- dẫn

- lãnh đạo

- học tập

- Legacy

- Cấp

- thư viện

- Thư viện

- vòng đời

- Lượt thích

- Có khả năng

- LIMIT

- hạn chế

- Hạn chế

- ít

- LLM

- tải

- địa phương

- dài

- thời gian dài

- Xem

- tìm kiếm

- Thấp

- máy

- học máy

- Máy móc

- duy trì

- Duy trì

- duy trì

- làm cho

- LÀM CHO

- Làm

- quản lý

- quản lý

- quản lý

- nhiều

- Maps

- tối đa

- Bộ nhớ

- Siêu dữ liệu

- phương pháp

- Metrics

- di cư

- MILAN

- hàng triệu

- ML

- MLOps

- Chế độ

- kiểu mẫu

- mô hình

- sửa đổi

- Màn Hình

- giám sát

- chi tiết

- hầu hết

- di chuyển

- nhiều

- cụ thể là

- tự nhiên

- Tự nhiên

- Xử lý ngôn ngữ tự nhiên

- Thiên nhiên

- nhất thiết

- cần thiết

- Cần

- nhu cầu

- mạng

- dựa trên mạng

- mạng

- mạng lưới thần kinh

- Mới

- nlp

- nút

- các nút

- con số

- nhiều

- Nvidia

- đối tượng

- of

- cung cấp

- cung cấp

- Ôliu

- on

- Theo yêu cầu

- ONE

- mở

- mã nguồn mở

- mã nguồn mở

- mở

- Cơ hội

- tối ưu hóa

- Tối ưu hóa

- tối ưu hóa

- Tùy chọn

- Các lựa chọn

- dàn nhạc

- gọi món

- Nền tảng khác

- riêng

- gói

- gói

- Giấy

- giấy tờ

- mô hình

- Song song

- tham số

- thông số

- một phần

- riêng

- đặc biệt

- đam mê

- qua

- con đường

- mô hình

- Trả

- Đỉnh

- hiệu suất

- biểu diễn

- cho phép

- quyền

- Thể chất

- đường ống dẫn

- Nơi

- plato

- Thông tin dữ liệu Plato

- PlatoDữ liệu

- chơi

- Điểm

- hồ bơi

- Hồ bơi

- Phổ biến

- Bài đăng

- bài viết

- thực hành

- thực hành

- dự đoán

- ưu đãi

- ưa thích

- trình bày

- quà

- ngăn chặn

- trước đây

- Hiệu trưởng

- quá trình

- Quy trình

- xử lý

- sản xuất

- chương trình

- Lập trình

- ngôn ngữ lập trình

- Tiến độ

- dự án

- đúng

- đề xuất

- đề xuất

- độc quyền

- giao thức

- giao thức

- cho

- cung cấp

- nhà cung cấp dịch vụ

- cung cấp

- công khai

- ấn phẩm

- mục đích

- đặt

- Python

- ngọn đuốc

- chất lượng

- nâng cao

- ngẫu nhiên

- HIẾM HOI

- Tỷ lệ

- Giá

- đạt

- Đọc

- Reading

- nhận ra

- hợp lý

- lý do

- nhận

- gần đây

- giới thiệu

- khuyến nghị

- ghi

- hồ sơ

- phục hồi

- giảm

- làm giảm

- giảm

- về

- khu

- vùng

- đều đặn

- thường xuyên

- liên quan

- có liên quan

- đáng tin cậy

- xa

- thay thế

- đại diện

- yêu cầu

- yêu cầu

- yêu cầu

- yêu cầu

- đòi hỏi

- nghiên cứu

- Nghiên cứu và đổi mới

- tài nguyên

- Thông tin

- Kết quả

- Đánh giá

- Vai trò

- vai trò

- chạy

- chạy

- nhà làm hiền triết

- tương tự

- Lưu

- khả năng mở rộng

- khả năng mở rộng

- Quy mô

- quy mô

- mở rộng quy mô

- Đề án

- khoa học

- các nhà khoa học

- phạm vi

- kịch bản

- sdk

- Tìm kiếm

- Thứ hai

- giây

- Phần

- tìm kiếm

- chọn

- lựa chọn

- cao cấp

- Không có máy chủ

- Các máy chủ

- dịch vụ

- DỊCH VỤ

- định

- thiết lập

- một số

- mảnh vụn

- sharding

- chia sẻ

- nên

- đáng kể

- Đơn giản

- đơn giản

- đồng thời

- duy nhất

- Kích thước máy

- kích thước

- kỹ năng

- chậm

- nhỏ

- So

- Phần mềm

- Giải pháp

- một số

- nguồn

- nguồn

- chuyên gia

- riêng

- đặc biệt

- quy định

- tốc độ

- Chi

- Tách

- Spot

- ổn định

- ngăn xếp

- Bắt đầu

- Bắt đầu

- bắt đầu

- Startups

- Tiểu bang

- thống kê

- Các bước

- Dừng

- dừng lại

- là gắn

- hàng

- Những câu chuyện

- Chiến lược

- dòng

- dòng

- sức mạnh

- tước bỏ

- mạnh mẽ

- nghiên cứu

- thành công

- Câu chuyện thành công

- thành công

- như vậy

- hỗ trợ

- Hỗ trợ

- Hỗ trợ

- đồng bộ hóa

- cú pháp

- hệ thống

- bàn

- Hãy

- Nhiệm vụ

- nhiệm vụ

- nhóm

- Kỹ thuật

- tensorflow

- Cảm ơn

- việc này

- Sản phẩm

- thế giới

- cung cấp their dịch

- Them

- tự

- lý thuyết

- vì thế

- Kia là

- của bên thứ ba

- hàng ngàn

- số ba

- Thông qua

- thông lượng

- thời gian

- thời gian

- lời khuyên

- đến

- bây giờ

- Tokens

- quá

- công cụ

- công cụ

- hàng đầu

- Tổng số:

- theo dõi

- giao thông

- Train

- đào tạo

- Hội thảo

- Dịch

- vận chuyển

- Nghìn tỷ

- loại

- điển hình

- Dưới

- cơ bản

- hiểu

- độc đáo

- các đơn vị

- Cập nhật

- us

- khả năng sử dụng

- Sử dụng

- sử dụng

- người sử dang

- thường

- giá trị

- Các giá trị

- nhiều

- khác nhau

- xác minh

- phiên bản

- thông qua

- Video

- Xem

- tầm nhìn

- ấm

- Đường..

- cách

- tuần

- TỐT

- Điều gì

- cái nào

- trong khi

- CHÚNG TÔI LÀ

- toàn bộ

- sẽ

- với

- ở trong

- không có

- từ

- Công việc

- làm việc

- công nhân

- đang làm việc

- công trinh

- thế giới

- viết

- viết

- năm

- Bạn

- trên màn hình

- mình

- youtube

- zephyrnet