Thế giới trí tuệ nhân tạo (AI) và máy học (ML) đã và đang chứng kiến sự thay đổi mô hình với sự gia tăng của các mô hình AI tổng quát có thể tạo ra văn bản, hình ảnh, mã và âm thanh giống con người. So với các mô hình ML cổ điển, các mô hình AI tổng quát lớn hơn và phức tạp hơn đáng kể. Tuy nhiên, độ phức tạp ngày càng tăng của chúng cũng đi kèm với chi phí suy luận cao và nhu cầu ngày càng tăng về tài nguyên điện toán mạnh mẽ. Chi phí suy luận cao đối với các mô hình AI tổng quát có thể là rào cản gia nhập đối với các doanh nghiệp và nhà nghiên cứu có nguồn lực hạn chế, dẫn đến nhu cầu về các giải pháp hiệu quả và tiết kiệm chi phí hơn. Hơn nữa, phần lớn các trường hợp sử dụng AI tổng quát liên quan đến tương tác của con người hoặc các tình huống trong thế giới thực, đòi hỏi phần cứng có thể mang lại hiệu suất có độ trễ thấp. AWS đã và đang đổi mới với các chip chuyên dụng để giải quyết nhu cầu ngày càng tăng về phần cứng điện toán mạnh mẽ, hiệu quả và tiết kiệm chi phí.

Hôm nay, chúng tôi vui mừng thông báo rằng Amazon SageMaker hỗ trợ Suy luận AWS2 (ml.inf2) và Đào tạo AWS (ml.trn1) dựa trên các phiên bản SageMaker để lưu trữ các mô hình AI tổng quát để suy luận theo thời gian thực và không đồng bộ. Các phiên bản ml.inf2 có sẵn để triển khai mô hình trên SageMaker ở Miền Đông Hoa Kỳ (Ohio) và các phiên bản ml.trn1 ở Miền Đông Hoa Kỳ (Bắc Virginia).

Bạn có thể sử dụng các phiên bản này trên SageMaker để đạt được hiệu suất cao với chi phí thấp cho các mô hình AI tổng quát, bao gồm các mô hình ngôn ngữ lớn (LLM), Khuếch tán ổn định và biến hình ảnh. Ngoài ra, bạn có thể sử dụng Người đề xuất suy luận của Amazon SageMaker để giúp bạn chạy thử nghiệm tải và đánh giá lợi ích hiệu suất giá khi triển khai mô hình của bạn trên các phiên bản này.

Bạn có thể sử dụng các phiên bản ml.inf2 và ml.trn1 để chạy các ứng dụng ML của mình trên SageMaker để tóm tắt văn bản, tạo mã, tạo video và hình ảnh, nhận dạng giọng nói, cá nhân hóa, phát hiện gian lận, v.v. Bạn có thể dễ dàng bắt đầu bằng cách chỉ định các phiên bản ml.trn1 hoặc ml.inf2 khi định cấu hình điểm cuối SageMaker của mình. Bạn có thể sử dụng Bộ chứa AWS Deep Learning (DLC) tương thích ml.trn1 và ml.inf2 cho PyTorch, TensorFlow, Hugging Face và suy luận mô hình lớn (LMI) để dễ dàng bắt đầu. Để biết danh sách đầy đủ với các phiên bản, hãy xem Hình ảnh các thùng chứa Deep Learning có sẵn.

Trong bài đăng này, chúng tôi trình bày quy trình triển khai mô hình ngôn ngữ lớn trên AWS Inferentia2 bằng SageMaker mà không yêu cầu viết mã thêm bằng cách tận dụng bộ chứa LMI. chúng tôi sử dụng GPT4ALL-J, một mẫu GPT-J 7B được tinh chỉnh để cung cấp tương tác kiểu chatbot.

Tổng quan về phiên bản ml.trn1 và ml.inf2

Các phiên bản ml.trn1 được hỗ trợ bởi trình tăng tốc Trainium, được xây dựng chủ yếu nhằm mục đích đào tạo deep learning hiệu suất cao cho các mô hình AI tổng quát, bao gồm cả LLM. Tuy nhiên, những phiên bản này cũng hỗ trợ khối lượng công việc suy luận cho các mô hình thậm chí còn lớn hơn khối lượng công việc phù hợp với Inf2. Kích thước phiên bản lớn nhất, phiên bản trn1.32xlarge, có 16 tính năng Máy gia tốc Trainium với bộ nhớ tăng tốc 512 GB trong một phiên bản duy nhất cung cấp tới 3.4 petaflop sức mạnh tính toán FP16/BF16. 16 máy gia tốc Trainium được kết nối với NeuronLinkv2 tốc độ cực cao để liên lạc tập thể được sắp xếp hợp lý.

ml.Inf2 phiên bản được cung cấp bởi Trình tăng tốc AWS Inferentia2, một máy gia tốc được xây dựng có mục đích cho suy luận. Nó mang lại hiệu suất điện toán cao hơn gấp ba lần, thông lượng cao hơn tới bốn lần và độ trễ thấp hơn tới 10 lần so với AWS Inferentia thế hệ đầu tiên. Kích thước phiên bản lớn nhất, Inf2.48xlarge, có 12 bộ tăng tốc AWS Inferentia2 với bộ nhớ tăng tốc 384 GB trong một phiên bản duy nhất cho sức mạnh điện toán kết hợp là 2.3 petaflop đối với BF16/FP16. Nó cho phép bạn triển khai mô hình lên tới 175 tỷ tham số trong một phiên bản duy nhất. Inf2 là phiên bản được tối ưu hóa suy luận duy nhất cung cấp tính năng kết nối này, một tính năng chỉ khả dụng trong các phiên bản đào tạo đắt tiền hơn. Đối với các mô hình cực lớn không phù hợp với một máy gia tốc duy nhất, dữ liệu sẽ truyền trực tiếp giữa các máy gia tốc bằng NeuronLink, hoàn toàn bỏ qua CPU. Với NeuronLink, Inf2 hỗ trợ suy luận phân tán nhanh hơn, đồng thời cải thiện thông lượng và độ trễ.

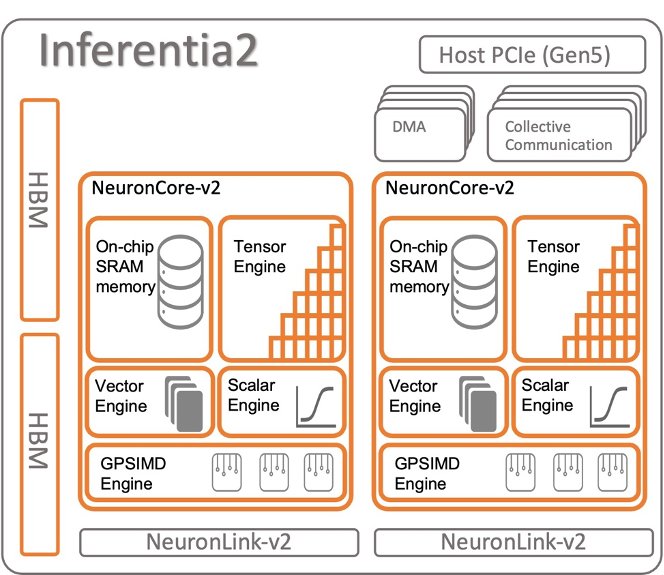

Cả hai trình tăng tốc AWS Inferentia2 và Trainium đều có hai NeuronCores-v2, ngăn xếp bộ nhớ HBM 32 GB và các công cụ tính toán tập thể chuyên dụng, tự động tối ưu hóa thời gian chạy bằng cách chồng chéo tính toán và giao tiếp khi thực hiện suy luận đa máy gia tốc. Để biết thêm chi tiết về kiến trúc, hãy tham khảo Thiết bị Trainium và Inferentia.

Sơ đồ sau đây cho thấy một kiến trúc ví dụ sử dụng AWS Inferentia2.

SDK thần kinh AWS

Tế bào thần kinh AWS là SDK dùng để chạy khối lượng công việc học sâu trên các phiên bản dựa trên AWS Inferentia và Trainium. AWS Neuron bao gồm một trình biên dịch deep learning, thời gian chạy và các công cụ được tích hợp sẵn vào TensorFlow và PyTorch. Với Neuron, bạn có thể phát triển, lập cấu hình và triển khai khối lượng công việc ML hiệu suất cao trên ml.trn1 và ml.inf2.

Sản phẩm Trình biên dịch nơ-ron chấp nhận các mô hình ML ở nhiều định dạng khác nhau (TensorFlow, PyTorch, XLA HLO) và tối ưu hóa chúng để chạy trên các thiết bị Neuron. Trình biên dịch Neuron được gọi trong khung ML, trong đó các mô hình ML được gửi đến trình biên dịch bằng plugin khung Neuron. Tạo tác trình biên dịch kết quả được gọi là tệp NEFF (Định dạng tệp thực thi của nơ-ron) đến lượt nó được thời gian chạy nơ-ron tải vào thiết bị nơ-ron.

Sản phẩm Thời gian chạy nơron bao gồm trình điều khiển nhân và thư viện C/C++, cung cấp API để truy cập các thiết bị AWS Inferentia và Trainium Neuron. Các plugin khung Neuron ML cho TensorFlow và PyTorch sử dụng thời gian chạy Neuron để tải và chạy các mô hình trên NeuronCore. Thời gian chạy Neuron tải các mô hình học sâu (NEFF) đã biên dịch cho các thiết bị Neuron và được tối ưu hóa để có thông lượng cao và độ trễ thấp.

Lưu trữ các mô hình NLP bằng phiên bản SageMaker ml.inf2

Trước khi chúng tôi đi sâu vào phục vụ LLM với máy biến áp-neuronx, là một thư viện mã nguồn mở để phân chia các ma trận trọng lượng lớn của mô hình thành nhiều Lõi thần kinh, chúng ta hãy xem nhanh quy trình triển khai điển hình cho một mô hình có thể vừa với một Lõi thần kinh duy nhất.

Kiểm tra danh sách các mô hình được hỗ trợ để đảm bảo mô hình được hỗ trợ trên AWS Inferentia2. Tiếp theo, mô hình cần được biên dịch trước bởi Trình biên dịch Neuron. Bạn có thể sử dụng sổ ghi chép SageMaker hoặc Đám mây điện toán đàn hồi Amazon (Amazon EC2) để biên dịch mô hình. Bạn có thể sử dụng SageMaker Python SDK để triển khai các mô hình bằng cách sử dụng các khung học sâu phổ biến như PyTorch, như được minh họa trong đoạn mã sau. Bạn có thể triển khai mô hình của mình cho các dịch vụ lưu trữ SageMaker và nhận một điểm cuối có thể được sử dụng để suy luận. Các điểm cuối này được quản lý hoàn toàn và hỗ trợ tự động thay đổi quy mô.

Tham khảo Quy trình dành cho nhà phát triển để biết thêm chi tiết về các quy trình phát triển điển hình của Inf2 trên SageMaker với các tập lệnh mẫu.

Lưu trữ LLM bằng phiên bản SageMaker ml.inf2

Các mô hình ngôn ngữ lớn với hàng tỷ tham số thường quá lớn để phù hợp với một máy gia tốc duy nhất. Điều này đòi hỏi phải sử dụng các kỹ thuật song song mô hình để lưu trữ LLM trên nhiều máy gia tốc. Một yêu cầu quan trọng khác để lưu trữ LLM là triển khai giải pháp cung cấp mô hình hiệu suất cao. Giải pháp này sẽ tải mô hình một cách hiệu quả, quản lý phân vùng và phục vụ liền mạch các yêu cầu thông qua các điểm cuối HTTP.

SageMaker bao gồm các thùng chứa học sâu (DLC), thư viện và công cụ chuyên dụng cho tính song song của mô hình và suy luận mô hình lớn. Để biết các tài nguyên bắt đầu với LMI trên SageMaker, hãy tham khảo Mô hình song song và suy luận mô hình lớn. SageMaker duy trì các DLC với các thư viện nguồn mở phổ biến để lưu trữ các mô hình lớn như GPT, T5, OPT, BLOOM và Khuếch tán ổn định trên cơ sở hạ tầng AWS. Các DLC chuyên dụng này được gọi là bộ chứa SageMaker LMI.

Bộ chứa SageMaker LMI sử dụng DJLServing, một máy chủ mô hình được tích hợp với thư viện transformers-neuronx để hỗ trợ tính song song tensor trên các NeuronCore. Để tìm hiểu thêm về cách hoạt động của DJLServing, hãy tham khảo Triển khai các mô hình lớn trên Amazon SageMaker bằng cách sử dụng suy luận song song của mô hình DJLServing và DeepSpeed. Máy chủ mô hình DJL và thư viện transformers-neuronx đóng vai trò là các thành phần cốt lõi của bộ chứa, cũng bao gồm SDK Neuron. Thiết lập này tạo điều kiện thuận lợi cho việc tải các mô hình lên bộ tăng tốc AWS Inferentia2, song song hóa mô hình trên nhiều Lõi thần kinh và cho phép phân phát qua các điểm cuối HTTP.

Bộ chứa LMI hỗ trợ tải các mô hình từ một Dịch vụ lưu trữ đơn giản của Amazon (Amazon S3) hoặc Hugging Face Hub. Tập lệnh xử lý mặc định tải mô hình, biên dịch và chuyển đổi nó thành định dạng được tối ưu hóa cho Neuron và tải nó. Để sử dụng bộ chứa LMI để lưu trữ LLM, chúng tôi có hai tùy chọn:

- Không có mã (ưu tiên) – Đây là cách dễ nhất để triển khai LLM bằng cách sử dụng bộ chứa LMI. Trong phương pháp này, bạn có thể sử dụng được cung cấp trình xử lý mặc định và chỉ cần chuyển tên kiểu máy và các tham số cần thiết trong

serving.propertiestệp để tải và lưu trữ mô hình. Để sử dụng trình xử lý mặc định, chúng tôi cung cấpentryPointtham số nhưdjl_python.transformers-neuronx. - Mang theo kịch bản của riêng bạn – Theo phương pháp này, bạn có tùy chọn tạo tệp model.py của riêng mình, tệp này chứa mã cần thiết để tải và phục vụ mô hình. Tệp này đóng vai trò trung gian giữa

DJLServingAPI vàtransformers-neuronxAPI. Để tùy chỉnh quy trình tải mô hình, bạn có thể cung cấpserving.propertiesvới các thông số có thể cấu hình. Để biết danh sách đầy đủ các tham số có thể định cấu hình có sẵn, hãy tham khảo Tất cả các tùy chọn cấu hình DJL. Đây là một ví dụ về một model.py tập tin.

kiến trúc thời gian chạy

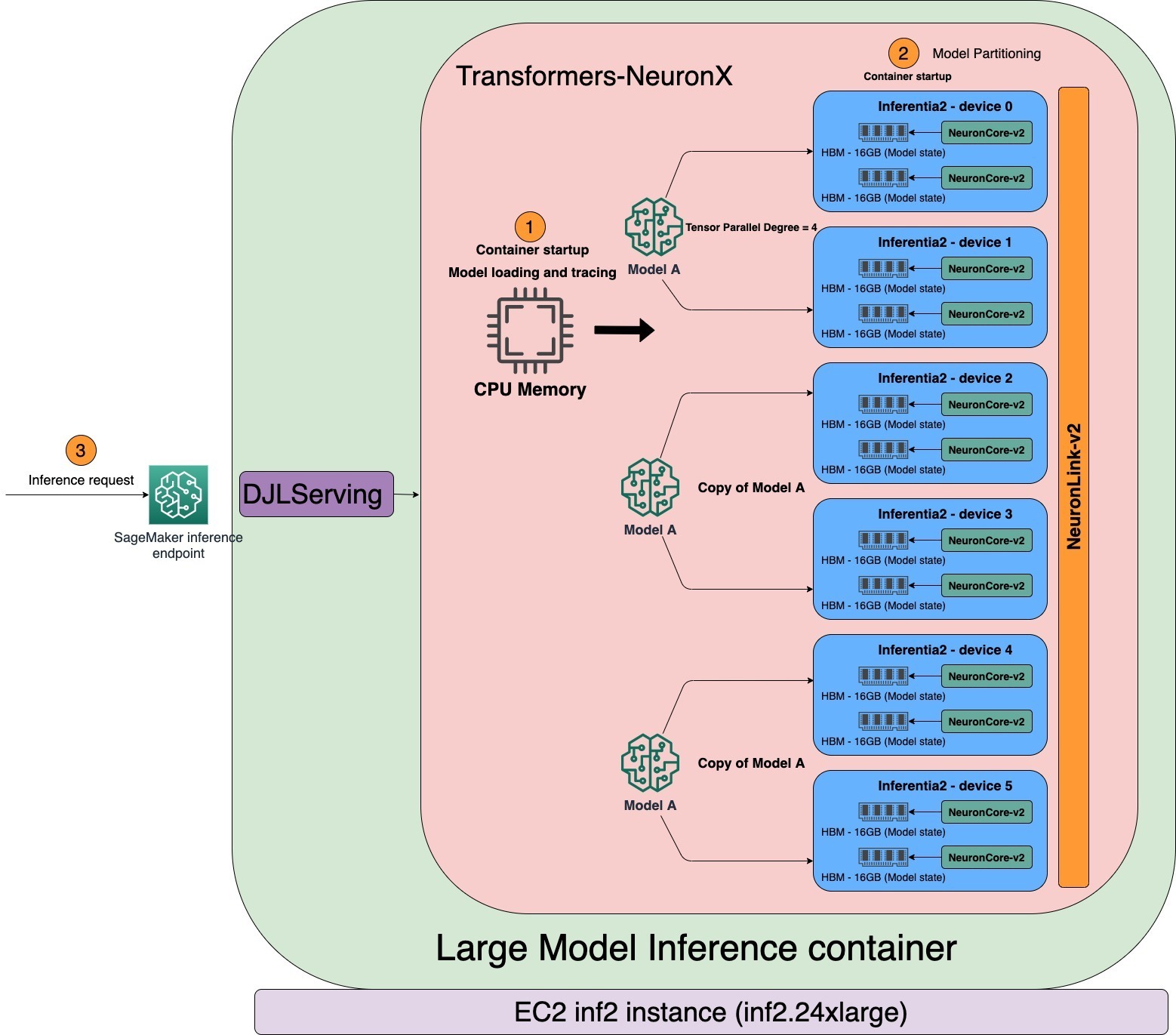

Sản phẩm tensor_parallel_degree giá trị thuộc tính xác định sự phân bố của các mô-đun tensor song song trên nhiều NeuronCore. Chẳng hạn, inf2.24xlarge có sáu bộ tăng tốc AWS Inferentia2. Mỗi máy gia tốc AWS Inferentia2 có hai Lõi thần kinh. Mỗi NeuronCore có một bộ nhớ băng thông cao chuyên dụng (HBM) 16 GB lưu trữ các mô-đun tensor song song. Với độ song song tensor là 4, LMI sẽ phân bổ ba bản sao mô hình của cùng một mô hình, mỗi bản sử dụng bốn Lõi thần kinh. Như thể hiện trong sơ đồ sau, khi bộ chứa LMI khởi động, mô hình sẽ được tải và theo dõi đầu tiên trong bộ nhớ có thể định địa chỉ của CPU. Khi quá trình theo dõi hoàn tất, mô hình được phân vùng trên các Lõi thần kinh dựa trên mức độ song song của tensor.

LMI sử dụng DJLServing làm ngăn xếp phục vụ mô hình của mình. Sau khi quá trình kiểm tra tình trạng của vùng chứa được thực hiện trong SageMaker, vùng chứa đã sẵn sàng phục vụ yêu cầu suy luận. DJLServing khởi chạy nhiều quy trình Python tương đương với TOTAL NUMBER OF NEURON CORES/TENSOR_PARALLEL_DEGREE. Mỗi quy trình Python chứa các luồng trong C++ tương đương với TENSOR_PARALLEL_DEGREE. Mỗi luồng C++ chứa một phân đoạn của mô hình trên một NeuronCore.

Nhiều học viên (quy trình Python) có xu hướng chạy suy luận tuần tự khi máy chủ được gọi với nhiều yêu cầu độc lập. Mặc dù việc thiết lập dễ dàng hơn, nhưng thường không phải là cách tốt nhất để tận dụng sức mạnh tính toán của máy gia tốc. Để giải quyết vấn đề này, DJLServing cung cấp tính năng tối ưu hóa tích hợp sẵn của tính năng tạo khối động để kết hợp các yêu cầu suy luận độc lập này ở phía máy chủ để tạo thành một khối lớn hơn một cách linh hoạt nhằm tăng thông lượng. Trước tiên, tất cả các yêu cầu đến bộ xử lý động trước khi vào hàng đợi công việc thực tế để chờ suy luận. Bạn có thể đặt kích thước lô ưa thích của mình cho lô động bằng cách sử dụng batch_size cài đặt trong serving.properties. Bạn cũng có thể cấu hình max_batch_delay để chỉ định thời gian trễ tối đa trong bộ xử lý theo đợt để chờ các yêu cầu khác tham gia theo đợt dựa trên các yêu cầu về độ trễ của bạn. Thông lượng cũng phụ thuộc vào số lượng bản sao mô hình và các nhóm quy trình Python được khởi chạy trong vùng chứa. Như thể hiện trong sơ đồ sau, với độ song song tensor được đặt thành 4, bộ chứa LMI khởi chạy ba nhóm quy trình Python, mỗi nhóm chứa bản sao đầy đủ của mô hình. Điều này cho phép bạn tăng kích thước lô và nhận được thông lượng cao hơn.

Sổ ghi chép SageMaker để triển khai LLM

Trong phần này, chúng tôi cung cấp hướng dẫn từng bước triển khai GPT4All-J, một mô hình 6 tỷ tham số có dung lượng 24 GB trong FP32. GPT4All-J là một chatbot phổ biến đã được đào tạo về rất nhiều nội dung tương tác như bài toán đố, hội thoại, mã, bài thơ, bài hát và câu chuyện. GPT4all-J là một mẫu GPT-J được tinh chỉnh để tạo ra các phản hồi tương tự như tương tác của con người.

Sổ tay hoàn chỉnh cho ví dụ này được cung cấp trên GitHub. Chúng ta có thể sử dụng SageMaker Python SDK để triển khai mô hình cho phiên bản Inf2. Chúng tôi sử dụng được cung cấp trình xử lý mặc định để tải mô hình. Với điều này, chúng ta chỉ cần cung cấp một phần ăn.properties tài liệu. Tệp này có các cấu hình cần thiết để máy chủ mô hình DJL tải xuống và lưu trữ mô hình. Chúng ta có thể chỉ định tên của mô hình Hugging Face bằng cách sử dụng model_id tham số để tải xuống mô hình trực tiếp từ repo Hugging Face. Ngoài ra, bạn có thể tải xuống mô hình từ Amazon S3 bằng cách cung cấp s3url tham số. Các entryPoint tham số được cấu hình để trỏ đến thư viện để tải mô hình. Để biết thêm chi tiết về djl_python.fastertransformer, Tham khảo đến Mã GitHub.

Sản phẩm tensor_parallel_degree giá trị thuộc tính xác định sự phân bố của các mô-đun tensor song song trên nhiều thiết bị. Ví dụ: với 12 Lõi thần kinh và độ song song tensor là 4, LMI sẽ phân bổ ba bản sao mô hình, mỗi bản sao sử dụng bốn Lõi thần kinh. Bạn cũng có thể xác định loại chính xác bằng cách sử dụng thuộc tính dtype. n_position tham số xác định tổng chiều dài trình tự đầu vào và đầu ra tối đa cho mô hình. Xem đoạn mã sau:

Xây dựng tarball chứa serving.properties và tải nó lên thùng S3. Mặc dù trình xử lý mặc định được sử dụng trong ví dụ này, nhưng bạn có thể phát triển một model.py tệp để tùy chỉnh quá trình tải và phục vụ. Nếu có bất kỳ gói nào cần cài đặt, hãy đưa chúng vào requirements.txt tài liệu. Xem đoạn mã sau:

Truy xuất hình ảnh vùng chứa DJL và tạo mô hình SageMaker:

Tiếp theo, chúng tôi tạo điểm cuối SageMaker với cấu hình mô hình được xác định trước đó. Container tải mô hình vào /tmp không gian vì SageMaker ánh xạ /tmp đến Cửa hàng đàn hồi Amazon (Amazon EBS). Chúng ta cần thêm một volume_size tham số để đảm bảo /tmp thư mục có đủ dung lượng để tải xuống và biên dịch mô hình. chúng tôi đặt container_startup_health_check_timeout đến 3,600 giây để đảm bảo quá trình kiểm tra tình trạng bắt đầu sau khi mô hình sẵn sàng. Chúng tôi sử dụng phiên bản ml.inf2.8xlarge. Xem đoạn mã sau:

Sau khi điểm cuối SageMaker được tạo, chúng tôi có thể đưa ra dự đoán theo thời gian thực đối với điểm cuối SageMaker bằng cách sử dụng Predictor vật:

Làm sạch

Xóa các điểm cuối để tiết kiệm chi phí sau khi bạn hoàn thành các bài kiểm tra của mình:

Kết luận

Trong bài đăng này, chúng tôi đã giới thiệu khả năng mới ra mắt của SageMaker, hiện hỗ trợ các phiên bản ml.inf2 và ml.trn1 để lưu trữ các mô hình AI tổng quát. Chúng tôi đã trình bày cách triển khai GPT4ALL-J, một mô hình AI tổng quát, trên AWS Inferentia2 bằng cách sử dụng SageMaker và bộ chứa LMI mà không cần viết bất kỳ mã nào. Chúng tôi cũng giới thiệu cách bạn có thể sử dụng DJLServing và transformers-neuronx để tải một mô hình, phân vùng nó và phục vụ.

Các phiên bản Inf2 cung cấp cách tiết kiệm chi phí nhất để chạy các mô hình AI tổng quát trên AWS. Để biết chi tiết về hiệu suất, hãy tham khảo Hiệu suất Inf2.

Kiểm tra các GitHub repo cho sổ ghi chép ví dụ. Hãy dùng thử và cho chúng tôi biết nếu bạn có bất kỳ câu hỏi nào!

Về các tác giả

Vivek Gangasani là Kiến trúc sư giải pháp máy học cao cấp tại Amazon Web Services. Anh làm việc với Machine Learning Startups để xây dựng và triển khai các ứng dụng AI/ML trên AWS. Anh ấy hiện đang tập trung vào việc cung cấp các giải pháp cho MLOps, ML Inference và ML mã thấp. Anh ấy đã làm việc cho các dự án trong các lĩnh vực khác nhau, bao gồm Xử lý ngôn ngữ tự nhiên và Thị giác máy tính.

Vivek Gangasani là Kiến trúc sư giải pháp máy học cao cấp tại Amazon Web Services. Anh làm việc với Machine Learning Startups để xây dựng và triển khai các ứng dụng AI/ML trên AWS. Anh ấy hiện đang tập trung vào việc cung cấp các giải pháp cho MLOps, ML Inference và ML mã thấp. Anh ấy đã làm việc cho các dự án trong các lĩnh vực khác nhau, bao gồm Xử lý ngôn ngữ tự nhiên và Thị giác máy tính.

Hiroshi Tokoyo là Kiến trúc sư giải pháp tại AWS Annapurna Labs. Có trụ sở tại Nhật Bản, anh ấy đã gia nhập Annapurna Labs ngay cả trước khi AWS mua lại và đã liên tục hỗ trợ khách hàng về công nghệ của Annapurna Labs. Trọng tâm gần đây của anh ấy là về các giải pháp Máy học dựa trên silicon chuyên dụng, AWS Inferentia và Trainium.

Hiroshi Tokoyo là Kiến trúc sư giải pháp tại AWS Annapurna Labs. Có trụ sở tại Nhật Bản, anh ấy đã gia nhập Annapurna Labs ngay cả trước khi AWS mua lại và đã liên tục hỗ trợ khách hàng về công nghệ của Annapurna Labs. Trọng tâm gần đây của anh ấy là về các giải pháp Máy học dựa trên silicon chuyên dụng, AWS Inferentia và Trainium.

Dhawal Patel là một Kiến trúc sư chính về Học máy tại AWS. Ông đã làm việc với các tổ chức khác nhau, từ các doanh nghiệp lớn đến các công ty khởi nghiệp quy mô trung bình về các vấn đề liên quan đến máy tính phân tán và Trí tuệ nhân tạo. Ông tập trung vào Học sâu bao gồm các lĩnh vực NLP và Thị giác máy tính. Anh ấy giúp khách hàng đạt được khả năng suy luận mô hình hiệu suất cao trên SageMaker.

Dhawal Patel là một Kiến trúc sư chính về Học máy tại AWS. Ông đã làm việc với các tổ chức khác nhau, từ các doanh nghiệp lớn đến các công ty khởi nghiệp quy mô trung bình về các vấn đề liên quan đến máy tính phân tán và Trí tuệ nhân tạo. Ông tập trung vào Học sâu bao gồm các lĩnh vực NLP và Thị giác máy tính. Anh ấy giúp khách hàng đạt được khả năng suy luận mô hình hiệu suất cao trên SageMaker.

Thanh Lan là Kỹ sư phát triển phần mềm trong AWS. Anh ấy đã làm việc trên một số sản phẩm đầy thử thách ở Amazon, bao gồm các giải pháp suy luận ML hiệu suất cao và hệ thống ghi nhật ký hiệu suất cao. Nhóm của Qing đã khởi chạy thành công mô hình Tỷ tham số đầu tiên trong Quảng cáo Amazon với độ trễ yêu cầu rất thấp. Qing có kiến thức chuyên sâu về tối ưu hóa cơ sở hạ tầng và tăng tốc Deep Learning.

Thanh Lan là Kỹ sư phát triển phần mềm trong AWS. Anh ấy đã làm việc trên một số sản phẩm đầy thử thách ở Amazon, bao gồm các giải pháp suy luận ML hiệu suất cao và hệ thống ghi nhật ký hiệu suất cao. Nhóm của Qing đã khởi chạy thành công mô hình Tỷ tham số đầu tiên trong Quảng cáo Amazon với độ trễ yêu cầu rất thấp. Qing có kiến thức chuyên sâu về tối ưu hóa cơ sở hạ tầng và tăng tốc Deep Learning.

Thanh Vĩ là Chuyên gia Máy học tại Amazon Web Services. Ông nhận bằng Tiến sĩ. trong Nghiên cứu Hoạt động sau khi ông phá vỡ tài khoản tài trợ nghiên cứu của cố vấn và không thực hiện được giải Nobel mà ông đã hứa. Hiện anh đang giúp khách hàng trong ngành dịch vụ tài chính và bảo hiểm xây dựng các giải pháp máy học trên AWS. Khi rảnh rỗi, anh ấy thích đọc sách và dạy học.

Thanh Vĩ là Chuyên gia Máy học tại Amazon Web Services. Ông nhận bằng Tiến sĩ. trong Nghiên cứu Hoạt động sau khi ông phá vỡ tài khoản tài trợ nghiên cứu của cố vấn và không thực hiện được giải Nobel mà ông đã hứa. Hiện anh đang giúp khách hàng trong ngành dịch vụ tài chính và bảo hiểm xây dựng các giải pháp máy học trên AWS. Khi rảnh rỗi, anh ấy thích đọc sách và dạy học.

Alan Tấn là Giám đốc Sản phẩm Cấp cao với nỗ lực hàng đầu của SageMaker về suy luận mô hình lớn. Anh ấy đam mê áp dụng Học máy vào lĩnh vực Phân tích. Ngoài công việc, anh ấy thích hoạt động ngoài trời.

Alan Tấn là Giám đốc Sản phẩm Cấp cao với nỗ lực hàng đầu của SageMaker về suy luận mô hình lớn. Anh ấy đam mê áp dụng Học máy vào lĩnh vực Phân tích. Ngoài công việc, anh ấy thích hoạt động ngoài trời.

Varun Syal là Kỹ sư phát triển phần mềm của AWS Sagemaker làm việc trên các tính năng quan trọng hướng tới khách hàng cho nền tảng ML Inference. Anh ấy đam mê làm việc trong Hệ thống phân tán và không gian AI. Trong thời gian rảnh rỗi, anh ấy thích đọc sách và làm vườn.

Varun Syal là Kỹ sư phát triển phần mềm của AWS Sagemaker làm việc trên các tính năng quan trọng hướng tới khách hàng cho nền tảng ML Inference. Anh ấy đam mê làm việc trong Hệ thống phân tán và không gian AI. Trong thời gian rảnh rỗi, anh ấy thích đọc sách và làm vườn.

- Phân phối nội dung và PR được hỗ trợ bởi SEO. Được khuếch đại ngay hôm nay.

- PlatoAiStream. Thông minh dữ liệu Web3. Kiến thức khuếch đại. Truy cập Tại đây.

- Đúc kết tương lai với Adryenn Ashley. Truy cập Tại đây.

- Mua và bán cổ phần trong các công ty PRE-IPO với PREIPO®. Truy cập Tại đây.

- nguồn: https://aws.amazon.com/blogs/machine-learning/achieve-high-performance-with-lowest-cost-for-generative-ai-inference-using-aws-inferentia2-and-aws-trainium-on-amazon-sagemaker/

- : có

- :là

- :không phải

- :Ở đâu

- $ LÊN

- 10

- 100

- 12

- 13

- 14

- 15%

- 22

- 24

- 7

- 8

- 9

- a

- Giới thiệu

- gia tốc

- máy gia tốc

- Chấp nhận

- truy cập

- Tài khoản

- Đạt được

- mua lại

- ngang qua

- hành vi

- thêm vào

- Ngoài ra

- địa chỉ

- có thể giải quyết

- Lợi thế

- Quảng cáo

- Sau

- chống lại

- AI

- trường hợp sử dụng ai

- AI / ML

- Tất cả

- cho phép

- Ngoài ra

- Mặc dù

- đàn bà gan dạ

- Amazon EC2

- Amazon SageMaker

- Amazon Web Services

- an

- phân tích

- và

- Thông báo

- Một

- bất kì

- API

- các ứng dụng

- Nộp đơn

- phương pháp tiếp cận

- kiến trúc

- LÀ

- KHU VỰC

- nhân tạo

- trí tuệ nhân tạo

- Trí tuệ nhân tạo (AI)

- AS

- At

- âm thanh

- tự động

- tự động

- có sẵn

- AWS

- Suy luận AWS

- banh

- Băng thông

- rào cản

- dựa

- BE

- bởi vì

- được

- trước

- Lợi ích

- BEST

- giữa

- lớn

- lớn hơn

- tỷ

- Chặn

- Blog

- Hoa

- một thời gian ngắn

- Broke

- xây dựng

- xây dựng

- được xây dựng trong

- các doanh nghiệp

- by

- C + +

- gọi là

- CAN

- trường hợp

- thách thức

- chatbot

- kiểm tra

- Snacks

- mã

- Lập trình

- Tập thể

- kết hợp

- kết hợp

- đến

- Giao tiếp

- Truyền thông

- so

- tương thích

- hoàn thành

- hoàn toàn

- phức tạp

- phức tạp

- các thành phần

- toàn diện

- tính toán

- Tính

- máy tính

- Tầm nhìn máy tính

- máy tính

- Cấu hình

- kết nối

- Container

- Container

- chứa

- nội dung

- Trung tâm

- Phí Tổn

- chi phí-hiệu quả

- Chi phí

- tạo

- tạo ra

- quan trọng

- quan trọng

- Hiện nay

- khách hàng

- khách hàng

- tùy chỉnh

- dữ liệu

- dành riêng

- sâu

- học kĩ càng

- Mặc định

- xác định

- Xác định

- Bằng cấp

- chậm trễ

- cung cấp

- phân phối

- cung cấp

- chứng minh

- phụ thuộc

- triển khai

- triển khai

- triển khai

- chi tiết

- Phát hiện

- xác định

- phát triển

- Phát triển

- thiết bị

- Thiết bị (Devices)

- khác nhau

- Lôi thôi

- trực tiếp

- phân phối

- phân phối máy tính

- hệ thống phân phối

- phân phối

- làm

- lĩnh vực

- dont

- tải về

- Tải xuống

- trình điều khiển

- năng động

- năng động

- mỗi

- Sớm hơn

- dễ dàng hơn

- dễ nhất

- dễ dàng

- Đông

- hiệu quả

- hiệu quả

- những nỗ lực

- cho phép

- cuối

- Điểm cuối

- ky sư

- Động cơ

- đủ

- đảm bảo

- vào

- doanh nghiệp

- nhập

- Tương đương

- đánh giá

- Ngay cả

- ví dụ

- kích thích

- đắt tiền

- thêm

- Đối mặt

- tạo điều kiện

- phải đối mặt với

- thất bại

- nhanh hơn

- Đặc tính

- Tính năng

- Tập tin

- tài chính

- dịch vụ tài chính

- hoàn thành

- Tên

- phù hợp với

- dòng chảy

- Chảy

- Tập trung

- tập trung

- tập trung

- tiếp theo

- Trong

- hình thức

- định dạng

- 4

- Khung

- khung

- gian lận

- phát hiện gian lận

- từ

- Full

- đầy đủ

- Hơn nữa

- tạo

- thế hệ

- thế hệ

- Trí tuệ nhân tạo

- được

- Go

- cấp

- Các nhóm

- Phát triển

- phần cứng

- Có

- he

- cho sức khoẻ

- giúp đỡ

- đã giúp

- giúp

- tại đây

- Cao

- hiệu suất cao

- cao hơn

- của mình

- tổ chức

- giữ

- chủ nhà

- lưu trữ

- dịch vụ lưu trữ

- House

- Độ đáng tin của

- Hướng dẫn

- Tuy nhiên

- HTML

- http

- HTTPS

- Hub

- Nhân loại

- if

- hình ảnh

- hình ảnh

- thực hiện

- nhập khẩu

- in

- sâu

- bao gồm

- bao gồm

- Bao gồm

- Tăng lên

- tăng

- độc lập

- ngành công nghiệp

- Cơ sở hạ tầng

- đổi mới

- đầu vào

- đầu vào

- cài đặt

- ví dụ

- bảo hiểm

- tích hợp

- Sự thông minh

- tương tác

- tương tác

- người Trung gian

- trong

- viện dẫn

- liên quan

- IT

- ITS

- Nhật Bản

- Việc làm

- tham gia

- gia nhập

- jpg

- json

- chỉ

- Biết

- kiến thức

- Phòng thí nghiệm

- Ngôn ngữ

- lớn

- Doanh nghiệp lớn

- lớn hơn

- lớn nhất

- Độ trễ

- phát động

- ra mắt

- hàng đầu

- LEARN

- học tập

- Chiều dài

- cho phép

- thư viện

- Thư viện

- Lượt thích

- Lượt thích

- Hạn chế

- Danh sách

- LLM

- tải

- tải

- tải

- khai thác gỗ

- Thấp

- thấp hơn

- thấp nhất

- máy

- học máy

- phần lớn

- duy trì

- Đa số

- làm cho

- quản lý

- quản lý

- giám đốc

- Maps

- tối đa

- tối đa

- Bộ nhớ

- phương pháp

- ML

- MLOps

- kiểu mẫu

- mô hình

- Modules

- chi tiết

- hiệu quả hơn

- hầu hết

- nhiều

- tên

- Tự nhiên

- Xử lý ngôn ngữ tự nhiên

- cần thiết

- Cần

- nhu cầu

- Mới

- Newyork

- tiếp theo

- nlp

- giải thưởng Nobel

- máy tính xách tay

- tại

- con số

- vật

- of

- cung cấp

- Cung cấp

- thường

- Ohio

- on

- ONE

- có thể

- mã nguồn mở

- Hoạt động

- tối ưu hóa

- Tối ưu hóa

- tối ưu hóa

- Tối ưu hóa

- Tùy chọn

- Các lựa chọn

- or

- tổ chức

- Nền tảng khác

- vfoXNUMXfipXNUMXhfpiXNUMXufhpiXNUMXuf

- ra

- ngoài trời

- đầu ra

- bên ngoài

- riêng

- gói

- mô hình

- Song song

- tham số

- thông số

- vượt qua

- vượt qua

- đam mê

- hiệu suất

- cá nhân

- nền tảng

- plato

- Thông tin dữ liệu Plato

- PlatoDữ liệu

- Plugin

- bổ sung

- Điểm

- Phổ biến

- Bài đăng

- quyền lực

- -

- mạnh mẽ

- thực hành

- Độ chính xác

- Dự đoán

- Predictor

- ưa thích

- Hiệu trưởng

- giải thưởng

- vấn đề

- quá trình

- Quy trình

- xử lý

- Sản phẩm

- giám đốc sản xuất

- Sản phẩm

- Hồ sơ

- dự án

- hứa

- tài sản

- tài sản

- cho

- cung cấp

- cung cấp

- cung cấp

- mục đích

- Python

- ngọn đuốc

- khác nhau,

- đạt

- Reading

- sẵn sàng

- thế giới thực

- thời gian thực

- nhận

- gần đây

- công nhận

- gọi

- liên quan

- yêu cầu

- yêu cầu

- cần phải

- yêu cầu

- Yêu cầu

- nghiên cứu

- nhà nghiên cứu

- Thông tin

- phản ứng

- kết quả

- Tăng lên

- chạy

- nhà làm hiền triết

- Suy luận của SageMaker

- tương tự

- Lưu

- mở rộng quy mô

- kịch bản

- kịch bản

- sdk

- liền mạch

- giây

- Phần

- xem

- cao cấp

- Trình tự

- phục vụ

- dịch vụ

- DỊCH VỤ

- phục vụ

- định

- thiết lập

- thiết lập

- một số

- thay đổi

- nên

- hiển thị

- giới thiệu

- thể hiện

- Chương trình

- bên

- đáng kể

- Silicon

- tương tự

- Đơn giản

- duy nhất

- Six

- Kích thước máy

- kích thước

- So

- Phần mềm

- phát triển phần mềm

- giải pháp

- Giải pháp

- Không gian

- chuyên gia

- chuyên nghành

- phát biểu

- Speech Recognition

- ổn định

- ngăn xếp

- Stacks

- Bắt đầu

- bắt đầu

- bắt đầu

- Startups

- là gắn

- Những câu chuyện

- lưu trữ

- sắp xếp hợp lý

- phong cách

- Thành công

- như vậy

- hỗ trợ

- Hỗ trợ

- Hỗ trợ

- hệ thống

- hệ thống

- dùng

- Giảng dạy

- nhóm

- kỹ thuật

- Công nghệ

- tensorflow

- kiểm tra

- hơn

- việc này

- Sản phẩm

- Khu vực

- cung cấp their dịch

- Them

- Đó

- Kia là

- điều này

- số ba

- Thông qua

- thông lượng

- thời gian

- thời gian

- đến

- quá

- công cụ

- Truy tìm

- đào tạo

- Hội thảo

- máy biến áp

- XOAY

- hai

- kiểu

- điển hình

- tải lên

- us

- sử dụng

- đã sử dụng

- sử dụng

- thường

- sử dụng

- Bằng cách sử dụng

- giá trị

- nhiều

- khác nhau

- Lớn

- rất

- thông qua

- Video

- virginia

- tầm nhìn

- chờ đợi

- hương

- Đường..

- we

- web

- các dịch vụ web

- trọng lượng

- Điều gì

- khi nào

- cái nào

- sẽ

- với

- ở trong

- không có

- chứng kiến

- Từ

- Công việc

- làm việc

- đang làm việc

- công trinh

- thế giới

- viết

- viết

- york

- Bạn

- trên màn hình

- zephyrnet