OpenAI, cùng với các công ty hàng đầu trong ngành bao gồm Amazon, Anthropic, Civitai, Google, Meta, Metaphysical, Microsoft, Mistral AI và Stability AI, đã cam kết thực hiện các biện pháp an toàn mạnh mẽ cho trẻ em trong quá trình phát triển, triển khai và bảo trì các công nghệ AI tổng hợp như đã nêu rõ trong nguyên tắc An toàn theo Thiết kế. Sáng kiến này, dẫn đầu bởi gai, một tổ chức phi lợi nhuận chuyên bảo vệ trẻ em khỏi bị lạm dụng tình dục và Tất cả công nghệ đều là con người, một tổ chức chuyên giải quyết các vấn đề phức tạp của công nghệ và xã hội, nhằm mục đích giảm thiểu rủi ro mà AI tạo ra gây ra cho trẻ em. Bằng cách áp dụng các nguyên tắc An toàn theo Thiết kế toàn diện, OpenAI và các đồng nghiệp của chúng tôi đang đảm bảo rằng an toàn cho trẻ em được ưu tiên ở mọi giai đoạn trong quá trình phát triển AI. Cho đến nay, chúng tôi đã nỗ lực đáng kể để giảm thiểu khả năng các mô hình của chúng tôi tạo ra nội dung gây hại cho trẻ em, đặt giới hạn độ tuổi cho ChatGPT và tích cực tương tác với Trung tâm Quốc gia về Trẻ em Mất tích và Bị bóc lột (NCMEC), Liên minh Công nghệ và các chính phủ khác. và các bên liên quan trong ngành về các vấn đề bảo vệ trẻ em và cải tiến cơ chế báo cáo.

Là một phần của nỗ lực An toàn theo Thiết kế này, chúng tôi cam kết:

-

Phát triển, xây dựng: Phát triển, xây dựng và đào tạo các mô hình AI sáng tạo

chủ động giải quyết các rủi ro về an toàn cho trẻ em.-

Cung cấp nguồn dữ liệu đào tạo của chúng tôi một cách có trách nhiệm, phát hiện và loại bỏ các nội dung khiêu dâm trẻ em

tài liệu lạm dụng (CSAM) và tài liệu khai thác tình dục trẻ em (CSEM) từ

dữ liệu đào tạo và báo cáo mọi nội dung xâm hại tình dục đã được xác nhận cho cơ quan có liên quan

Chính quyền. -

Kết hợp các vòng phản hồi và các chiến lược kiểm tra căng thẳng lặp đi lặp lại trong

quá trình phát triển của chúng tôi. - Triển khai các giải pháp để giải quyết tình trạng lạm dụng đối nghịch.

-

Cung cấp nguồn dữ liệu đào tạo của chúng tôi một cách có trách nhiệm, phát hiện và loại bỏ các nội dung khiêu dâm trẻ em

-

Triển khai: Phát hành và phân phối các mô hình AI tổng quát sau

họ đã được đào tạo và đánh giá về sự an toàn của trẻ em, cung cấp các biện pháp bảo vệ

trong suốt quá trình.-

Đấu tranh và ứng phó với nội dung và hành vi lạm dụng, đồng thời kết hợp

nỗ lực phòng ngừa. - Khuyến khích quyền sở hữu của nhà phát triển về an toàn theo thiết kế.

-

Đấu tranh và ứng phó với nội dung và hành vi lạm dụng, đồng thời kết hợp

-

Duy trì: Duy trì sự an toàn của mô hình và nền tảng bằng cách tiếp tục

chủ động hiểu và ứng phó với các rủi ro về an toàn cho trẻ em.-

Cam kết loại bỏ AIG-CSAM mới do kẻ xấu tạo ra khỏi chúng tôi

nền tảng. - Đầu tư vào nghiên cứu và giải pháp công nghệ trong tương lai.

- Chống CSAM, AIG-CSAM và CSEM trên nền tảng của chúng tôi.

-

Cam kết loại bỏ AIG-CSAM mới do kẻ xấu tạo ra khỏi chúng tôi

Cam kết này đánh dấu một bước quan trọng trong việc ngăn chặn việc lạm dụng công nghệ AI để tạo ra hoặc truyền bá tài liệu lạm dụng tình dục trẻ em (AIG-CSAM) và các hình thức xâm hại tình dục khác đối với trẻ em. Là một phần của nhóm làm việc, chúng tôi cũng đã đồng ý phát hành bản cập nhật tiến độ hàng năm.

- Phân phối nội dung và PR được hỗ trợ bởi SEO. Được khuếch đại ngay hôm nay.

- PlatoData.Network Vertical Generative Ai. Trao quyền cho chính mình. Truy cập Tại đây.

- PlatoAiStream. Thông minh Web3. Kiến thức khuếch đại. Truy cập Tại đây.

- Trung tâmESG. Than đá, công nghệ sạch, Năng lượng, Môi trường Hệ mặt trời, Quản lý chất thải. Truy cập Tại đây.

- PlatoSức khỏe. Tình báo thử nghiệm lâm sàng và công nghệ sinh học. Truy cập Tại đây.

- nguồn: https://openai.com/blog/child-safety-adopting-sbd-principles

- : có

- :là

- 39

- 40

- a

- lạm dụng

- tích cực

- diễn viên

- địa chỉ

- Nhận nuôi

- đối thủ

- Sau

- chống lại

- tuổi

- đồng ý

- AI

- Mô hình AI

- Mục tiêu

- bên cạnh

- Ngoài ra

- đàn bà gan dạ

- an

- và

- nhân loại

- bất kì

- LÀ

- AS

- At

- Thẩm quyền

- Bad

- được

- xây dựng

- by

- Trung tâm

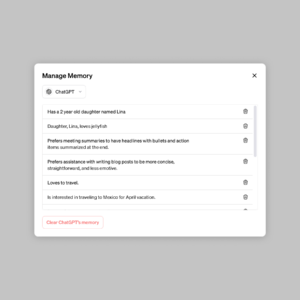

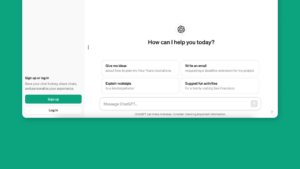

- ChatGPT

- trẻ em

- bảo vệ trẻ em

- Trẻ em

- liên minh

- chống lại

- cam kết

- cam kết

- cam kết

- phức tạp

- toàn diện

- Tiến hành

- XÁC NHẬN

- nội dung

- tiếp tục

- tạo

- dữ liệu

- bộ dữ liệu

- Ngày

- dành riêng

- Bảo vệ

- triển khai

- Thiết kế

- nguyên tắc thiết kế

- phát hiện

- phát triển

- Nhà phát triển

- Phát triển

- phân phát

- nỗ lực

- những nỗ lực

- thuê

- cải tiến

- đảm bảo

- đánh giá

- Mỗi

- khai thác

- khai thác

- thông tin phản hồi

- Trong

- các hình thức

- từ

- tương lai

- Công nghệ tương lai

- tạo ra

- tạo ra

- thế hệ

- Trí tuệ nhân tạo

- Chính phủ

- Nhóm

- làm hại

- tác hại

- Có

- http

- HTTPS

- thực hiện

- quan trọng

- in

- Bao gồm

- kết hợp

- ngành công nghiệp

- Sáng kiến

- các vấn đề

- các nhà lãnh đạo

- Led

- thực hiện

- bảo trì

- vật liệu

- các biện pháp

- cơ chế

- Siêu dữ liệu

- microsoft

- giảm thiểu

- mất tích

- sử dụng sai

- Giảm nhẹ

- kiểu mẫu

- mô hình

- quốc dân

- Mới

- Phi lợi nhuận

- of

- on

- OpenAI

- or

- cơ quan

- Nền tảng khác

- vfoXNUMXfipXNUMXhfpiXNUMXufhpiXNUMXuf

- quyền sở hữu

- một phần

- đồng nghiệp

- nền tảng

- Nền tảng

- plato

- Thông tin dữ liệu Plato

- PlatoDữ liệu

- đặt ra

- tiềm năng

- ngăn chặn

- Phòng chống

- nguyên tắc

- ưu tiên

- vấn đề

- quá trình

- Tiến độ

- bảo vệ

- cung cấp

- phát hành

- có liên quan

- tẩy

- loại bỏ

- báo cáo

- Báo cáo

- nghiên cứu

- Trả lời

- có trách nhiệm

- hạn chế

- rủi ro

- mạnh mẽ

- s

- Sự An Toàn

- định

- Tình dục

- có ý nghĩa

- Xã hội

- Giải pháp

- nguồn

- lan tràn

- Tính ổn định

- Traineeship

- các bên liên quan

- Bước

- chiến lược

- giải quyết

- công nghệ cao

- Công nghệ

- Công nghệ

- việc này

- Sản phẩm

- họ

- điều này

- khắp

- đến

- Train

- đào tạo

- Hội thảo

- hiểu

- Cập nhật

- we

- với

- đang làm việc

- Tổ công tác

- năm

- zephyrnet