Kể từ khi ChatGPT bùng nổ trong lĩnh vực công nghệ vào tháng XNUMX năm ngoái, nó đã giúp mọi người viết tất cả các loại tài liệu, tạo mã và tìm thông tin. Nó và các mô hình ngôn ngữ lớn (LLM) khác đã tạo điều kiện thuận lợi cho các nhiệm vụ từ thực hiện các cuộc gọi dịch vụ khách hàng đến nhận đơn đặt hàng thức ăn nhanh. Dựa vào mức độ hữu ích của các LLM đối với con người trong thời gian ngắn chúng xuất hiện, ChatGPT dành cho rô-bốt có thể ảnh hưởng như thế nào đến khả năng học hỏi và làm những điều mới của chúng? Các nhà nghiên cứu tại Google DeepMind đã quyết định tìm hiểu và công bố phát hiện của họ trong một blog đăng bài và giấy phát hành tuần trước.

Họ gọi hệ thống của họ là RT-2. Nó là viết tắt của robot transformer 2, và nó là sự kế thừa của robot biến áp 1, mà công ty đã phát hành vào cuối năm ngoái. RT-1 dựa trên một chương trình ngôn ngữ và tầm nhìn nhỏ và được huấn luyện đặc biệt để thực hiện nhiều nhiệm vụ. Phần mềm này đã được sử dụng trong Alphabet X's Robot hàng ngày, cho phép họ thực hiện hơn 700 nhiệm vụ khác nhau với tỷ lệ thành công 97%. Nhưng khi được yêu cầu thực hiện các nhiệm vụ mới mà chúng chưa được đào tạo, rô-bốt sử dụng RT-1 chỉ thành công 32% thời gian.

RT-2 gần như tăng gấp đôi tỷ lệ này, thực hiện thành công các nhiệm vụ mới 62% thời gian được yêu cầu. Các nhà nghiên cứu gọi RT-2 là mô hình hành động ngôn ngữ hình ảnh (VLA). Nó sử dụng văn bản và hình ảnh mà nó nhìn thấy trực tuyến để học các kỹ năng mới. Điều đó không đơn giản như nó có vẻ; nó yêu cầu phần mềm trước tiên phải “hiểu” một khái niệm, sau đó áp dụng sự hiểu biết đó vào một lệnh hoặc tập hợp các hướng dẫn, sau đó thực hiện các hành động đáp ứng các hướng dẫn đó.

Một ví dụ mà các tác giả của bài báo đưa ra là xử lý rác. Trong các mô hình trước đó, phần mềm của robot trước tiên phải được đào tạo để xác định thùng rác. Ví dụ: nếu có một quả chuối đã bóc vỏ trên bàn với vỏ bên cạnh, bot sẽ được hiển thị rằng vỏ là rác trong khi chuối thì không. Sau đó, nó sẽ được dạy cách nhặt vỏ, bỏ vào thùng rác và bỏ vào đó.

Tuy nhiên, RT-2 hoạt động hơi khác một chút. Vì mô hình đã được đào tạo về vô số thông tin và dữ liệu từ internet, nên nó có hiểu biết chung về rác là gì và mặc dù không được đào tạo về cách vứt rác, nhưng nó có thể ghép các bước lại với nhau để hoàn thành nhiệm vụ này.

Các LLM mà các nhà nghiên cứu sử dụng để đào tạo RT-2 là PaLI-X (một mô hình ngôn ngữ và tầm nhìn với 55 tỷ tham số), và PaLM-E (cái mà Google gọi là mô hình ngôn ngữ đa phương thức được thể hiện, được phát triển riêng cho rô-bốt, với 12 tỷ tham số). “Tham số” dùng để chỉ một thuộc tính mà mô hình máy học xác định dựa trên dữ liệu đào tạo của nó. Trong trường hợp của LLM, họ mô hình hóa mối quan hệ giữa các từ trong một câu và cân nhắc khả năng một từ nhất định sẽ được đặt trước hoặc theo sau bởi một từ khác.

Thông qua việc tìm kiếm các mối quan hệ và mẫu giữa các từ trong tập dữ liệu khổng lồ, các mô hình học hỏi từ những suy luận của chính chúng. Cuối cùng, họ có thể tìm ra cách các khái niệm khác nhau liên quan với nhau và phân biệt ngữ cảnh. Trong trường hợp của RT-2, nó chuyển kiến thức đó thành các hướng dẫn tổng quát cho các hành động của robot.

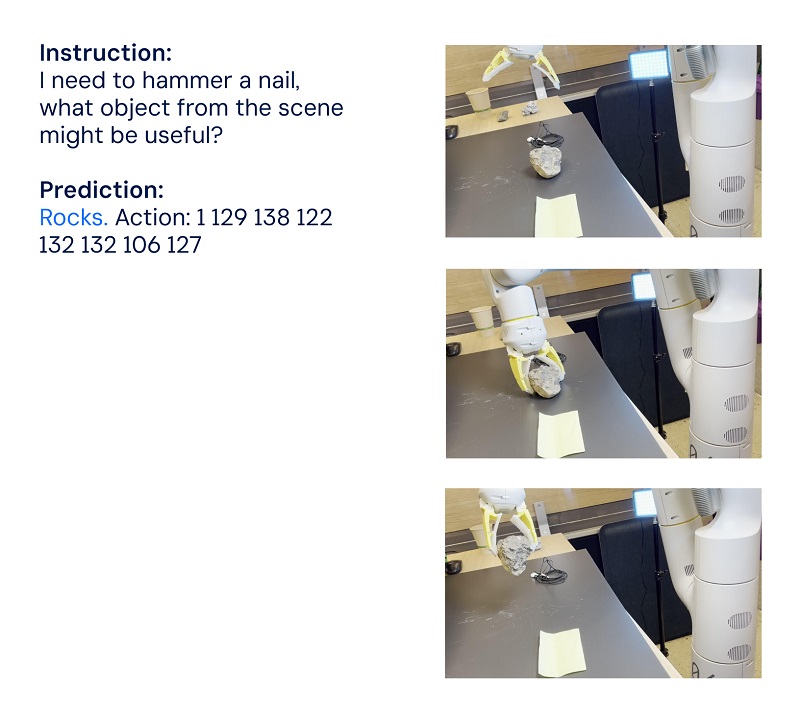

Những hành động đó được biểu thị cho robot dưới dạng mã thông báo, thường được sử dụng để biểu thị văn bản ngôn ngữ tự nhiên ở dạng các đoạn từ. Trong trường hợp này, mã thông báo là một phần của hành động và phần mềm xâu chuỗi nhiều mã thông báo lại với nhau để thực hiện một hành động. Cấu trúc này cũng cho phép phần mềm thực hiện suy luận theo chuỗi suy nghĩ, nghĩa là phần mềm có thể trả lời các câu hỏi hoặc lời nhắc yêu cầu một số mức độ suy luận.

Các ví dụ mà nhóm đưa ra bao gồm chọn một vật dùng làm búa khi không có búa (rô-bốt chọn một viên đá) và chọn đồ uống tốt nhất cho một người mệt mỏi (rô-bốt chọn nước tăng lực).

“RT-2 cho thấy khả năng khái quát hóa được cải thiện cũng như sự hiểu biết về ngữ nghĩa và hình ảnh ngoài dữ liệu robot mà nó tiếp xúc,” các nhà nghiên cứu đã viết trong Google blog đăng bài. “Điều này bao gồm diễn giải các lệnh mới và phản hồi các lệnh của người dùng bằng cách thực hiện suy luận thô sơ, chẳng hạn như suy luận về danh mục đối tượng hoặc mô tả cấp cao.”

Ước mơ của robot đa năng điều đó có thể giúp con người với bất cứ điều gì có thể xảy ra—dù là trong nhà, môi trường thương mại hay môi trường công nghiệp—sẽ không thể đạt được cho đến khi rô-bốt có thể học khi đang di chuyển. Điều dường như là bản năng cơ bản nhất đối với chúng ta, đối với robot, là sự kết hợp phức tạp giữa việc hiểu bối cảnh, khả năng suy luận thông qua nó và thực hiện các hành động để giải quyết các vấn đề không lường trước được sẽ xuất hiện. Lập trình cho chúng phản ứng phù hợp với nhiều tình huống ngoài dự kiến là không thể, vì vậy chúng cần có khả năng khái quát hóa và học hỏi kinh nghiệm, giống như con người.

RT-2 là một bước đi theo hướng này. Tuy nhiên, các nhà nghiên cứu thừa nhận rằng mặc dù RT-2 có thể khái quát hóa các khái niệm ngữ nghĩa và hình ảnh, nhưng nó vẫn chưa thể tự học các hành động mới. Thay vào đó, nó áp dụng các hành động mà nó đã biết cho các tình huống mới. Có lẽ RT-3 hoặc 4 sẽ có thể đưa những kỹ năng này lên một tầm cao mới. Trong khi chờ đợi, khi nhóm kết luận trong blog đăng bài, “Mặc dù vẫn còn rất nhiều việc phải làm để tạo điều kiện cho rô bốt hữu ích trong môi trường lấy con người làm trung tâm, nhưng RT-2 cho chúng ta thấy một tương lai thú vị cho ngành rô bốt chỉ trong tầm tay.”

Ảnh: Google DeepMind

- Phân phối nội dung và PR được hỗ trợ bởi SEO. Được khuếch đại ngay hôm nay.

- PlatoData.Network Vertical Generative Ai. Trao quyền cho chính mình. Truy cập Tại đây.

- PlatoAiStream. Thông minh Web3. Kiến thức khuếch đại. Truy cập Tại đây.

- Trung tâmESG. Ô tô / Xe điện, Than đá, công nghệ sạch, Năng lượng, Môi trường Hệ mặt trời, Quản lý chất thải. Truy cập Tại đây.

- BlockOffsets. Hiện đại hóa quyền sở hữu bù đắp môi trường. Truy cập Tại đây.

- nguồn: https://singularityhub.com/2023/08/02/deepminds-chatgpt-like-brain-for-robots-lets-them-learn-from-the-internet/

- : có

- :là

- :không phải

- $ LÊN

- 12

- 32

- 700

- a

- có khả năng

- Có khả năng

- Giới thiệu

- công nhận

- Hoạt động

- hành động

- Tất cả

- Bảng chữ cái

- Đã

- Ngoài ra

- số lượng

- an

- và

- Một

- Dự đoán

- Đăng Nhập

- thích hợp

- LÀ

- xung quanh

- AS

- At

- tác giả

- có sẵn

- xa

- Trái chuối

- dựa

- cơ bản

- BE

- được

- được

- BEST

- giữa

- Ngoài

- Tỷ

- Bot

- Brain

- nhưng

- by

- cuộc gọi

- Cuộc gọi

- CAN

- khả năng

- mang

- trường hợp

- đố

- ChatGPT

- lựa chọn

- mã

- kết hợp

- Đến

- thương gia

- công ty

- hoàn thành

- phức tạp

- khái niệm

- khái niệm

- bối cảnh

- tín dụng

- khách hàng

- Dịch Vụ CSKH

- dữ liệu

- quyết định

- Deepmind

- Xác định

- Bằng cấp

- nạp tiền

- phát triển

- khác nhau

- hướng

- do

- thực hiện

- Tăng gấp đôi

- giấc mơ

- Đồ Uống

- mỗi

- cho phép

- cho phép

- cho phép

- cuối

- năng lượng

- môi trường

- cuối cùng

- ví dụ

- thú vị

- kinh nghiệm

- tiếp xúc

- tạo điều kiện

- NHANH

- Hình

- Tìm kiếm

- tìm kiếm

- phát hiện

- Tên

- sau

- thực phẩm

- Trong

- hình thức

- từ

- tương lai

- Tổng Quát

- tạo ra

- khổng lồ

- Cho

- được

- cho

- Go

- sự hiểu biết

- búa

- Có

- giúp đỡ

- hữu ích

- giúp đỡ

- cấp độ cao

- Trang Chủ

- Độ đáng tin của

- Hướng dẫn

- HTML

- HTTPS

- Con người

- xác định

- if

- hình ảnh

- Va chạm

- không thể

- cải thiện

- in

- bao gồm

- bao gồm

- công nghiệp

- thông tin

- hướng dẫn

- Internet

- trong

- IT

- ITS

- jpg

- chỉ

- kiến thức

- Ngôn ngữ

- lớn

- Họ

- Năm ngoái

- LEARN

- học tập

- cho phép

- Cấp

- Lượt thích

- Có khả năng

- ít

- tải

- máy

- học máy

- nhiều

- vật liệu

- max-width

- Có thể..

- có nghĩa là

- trong khi đó

- Might

- kiểu mẫu

- mô hình

- hầu hết

- di chuyển

- nhiều

- Tự nhiên

- Cần

- Mới

- tiếp theo

- Không

- Tháng mười một

- vật

- of

- on

- Trực tuyến

- có thể

- trên

- or

- đơn đặt hàng

- Nền tảng khác

- ra

- kết thúc

- riêng

- Giấy

- thông số

- các bộ phận

- mô hình

- người

- phần trăm

- Thực hiện

- biểu diễn

- có lẽ

- người

- chọn

- mảnh

- plato

- Thông tin dữ liệu Plato

- PlatoDữ liệu

- bật

- trước

- vấn đề

- chương trình

- Lập trình

- công bố

- Câu hỏi

- Tỷ lệ

- hơn

- Phản ứng

- lý do

- đề cập

- Mối quan hệ

- phát hành

- đại diện

- đại diện

- yêu cầu

- đòi hỏi

- nhà nghiên cứu

- Trả lời

- đáp ứng

- Robot

- robotics

- robot

- Đá

- s

- kịch bản

- bối cảnh

- dường như

- nhìn

- kết án

- dịch vụ

- định

- thiết lập

- ngắn

- thể hiện

- Chương trình

- Đơn giản

- kể từ khi

- kỹ năng

- nhỏ

- So

- Phần mềm

- động SOLVE

- một số

- đặc biệt

- Bước

- Các bước

- Vẫn còn

- cấu trúc

- thành công

- thành công

- Thành công

- như vậy

- hệ thống

- bàn

- Hãy

- dùng

- Nhiệm vụ

- nhiệm vụ

- đã dạy

- nhóm

- công nghệ cao

- việc này

- Sản phẩm

- cung cấp their dịch

- Them

- sau đó

- Đó

- Kia là

- họ

- điều

- điều này

- những

- Tuy nhiên?

- Thông qua

- thời gian

- mệt mỏi

- đến

- bên nhau

- Tokens

- Train

- đào tạo

- Hội thảo

- biến áp

- kinh hai

- sự hiểu biết

- cho đến khi

- us

- sử dụng

- đã sử dụng

- người sử dang

- sử dụng

- sử dụng

- thường

- nhiều

- tầm nhìn

- là

- tuần

- cân

- là

- Điều gì

- bất cứ điều gì

- khi nào

- cái nào

- trong khi

- sẽ

- với

- ở trong

- Từ

- từ

- Công việc

- công trinh

- sẽ

- viết

- đã viết

- Của X

- năm

- nhưng

- zephyrnet