Amazon SageMaker cung cấp nhiều lựa chọn cơ sở hạ tầng máy học (ML) và các tùy chọn triển khai mô hình để giúp đáp ứng nhu cầu suy luận ML của bạn. Đó là dịch vụ được quản lý hoàn toàn và tích hợp với các công cụ MLOps để bạn có thể làm việc để mở rộng quy mô triển khai mô hình của mình, giảm chi phí suy luận, quản lý mô hình hiệu quả hơn trong sản xuất và giảm gánh nặng vận hành. SageMaker cung cấp nhiều tùy chọn suy luận để bạn có thể chọn tùy chọn phù hợp nhất với khối lượng công việc của mình.

Các thế hệ CPU mới mang đến sự cải thiện hiệu suất đáng kể trong suy luận ML nhờ các hướng dẫn tích hợp chuyên biệt. Trong bài đăng này, chúng tôi tập trung vào cách bạn có thể tận dụng lợi thế của AWS Graviton3-dựa trên Amazon Elastic Compute Cloud (EC2) phiên bản C7g để giúp giảm tới 50% chi phí suy luận so với các phiên bản EC2 tương đương cho suy luận thời gian thực trên Amazon SageMaker. Chúng tôi trình bày cách bạn có thể đánh giá hiệu suất suy luận và chuyển khối lượng công việc ML sang phiên bản AWS Graviton chỉ trong vài bước.

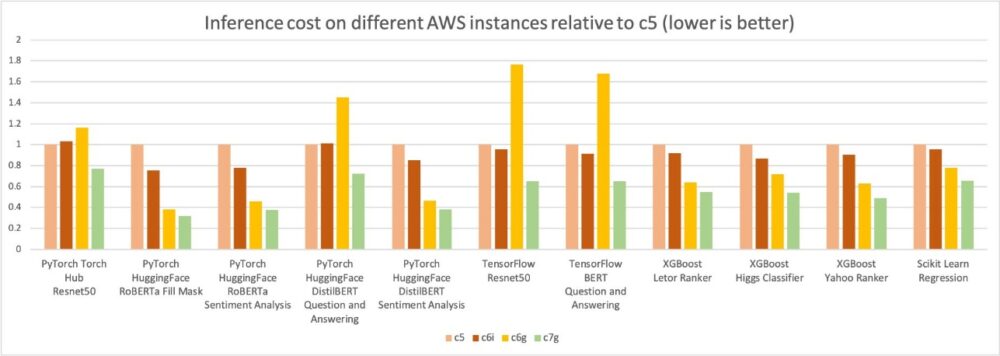

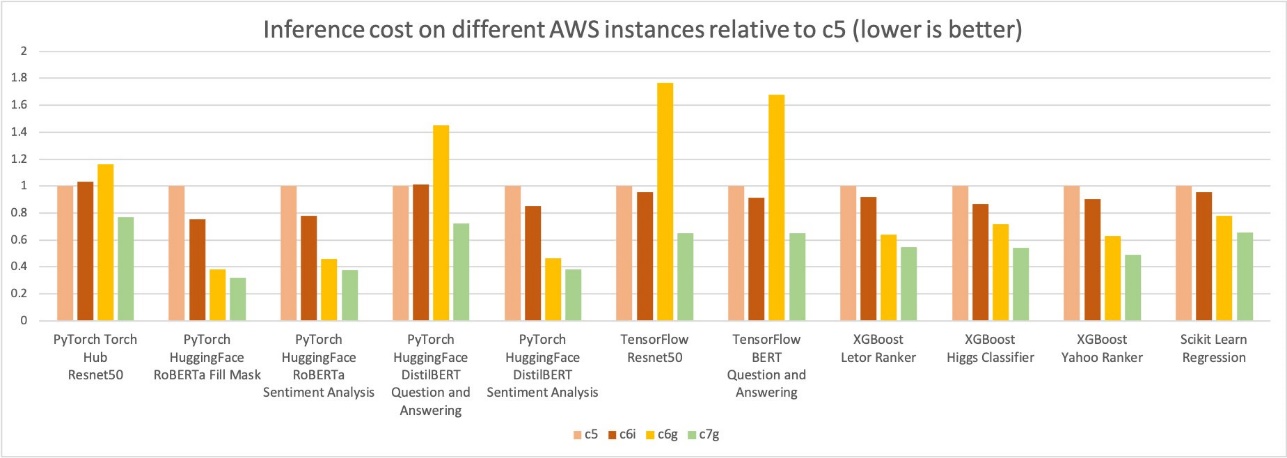

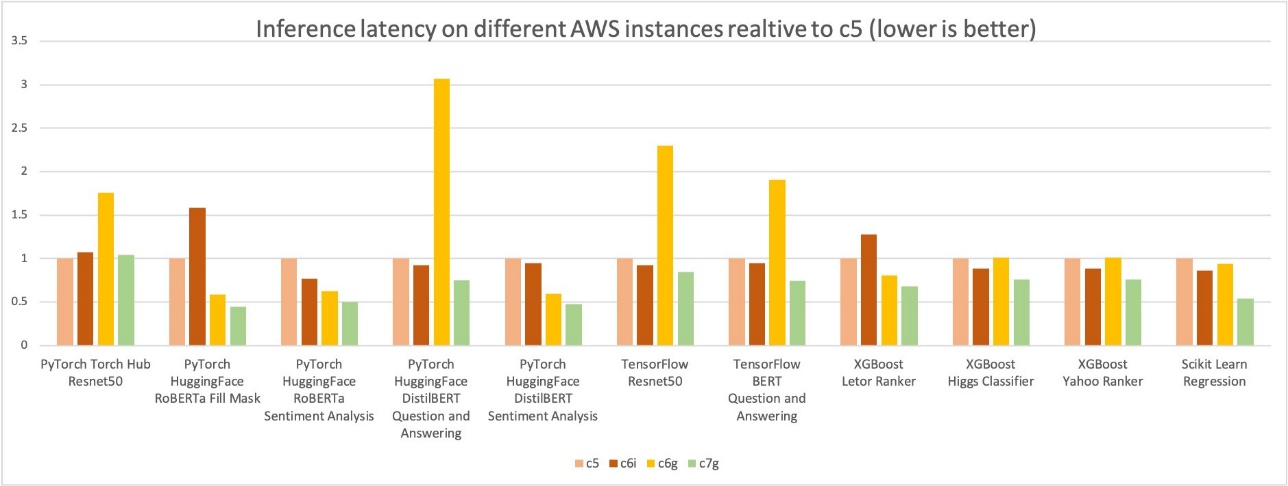

Để đề cập đến phạm vi ứng dụng phổ biến và rộng rãi của khách hàng, trong bài đăng này, chúng tôi thảo luận về hiệu suất suy luận của các khung PyTorch, TensorFlow, XGBoost và scikit-learning. Chúng tôi đề cập đến các tình huống về thị giác máy tính (CV), xử lý ngôn ngữ tự nhiên (NLP), phân loại và xếp hạng cho các mô hình và các phiên bản ml.c6g, ml.c7g, ml.c5 và ml.c6i SageMaker để đo điểm chuẩn.

Kết quả đo điểm chuẩn

AWS đã đo lường mức tiết kiệm chi phí lên tới 50% đối với suy luận mô hình PyTorch, TensorFlow, XGBoost và scikit-learning với các phiên bản EC3 C2g dựa trên AWS Graviton7 so với các phiên bản EC2 tương đương trên Amazon SageMaker. Đồng thời, độ trễ của suy luận cũng giảm.

Để so sánh, chúng tôi đã sử dụng bốn loại phiên bản khác nhau:

Cả bốn phiên bản đều có 16 vCPU và 32 GiB bộ nhớ.

Trong biểu đồ sau, chúng tôi đã đo lường chi phí trên một triệu lần suy luận cho bốn loại phiên bản. Chúng tôi tiếp tục chuẩn hóa chi phí trên một triệu kết quả suy luận thành phiên bản c5.4xlarge, được đo bằng 1 trên trục Y của biểu đồ. Bạn có thể thấy rằng đối với các mẫu XGBoost, chi phí trên một triệu lần suy luận cho c7g.4xlarge (AWS Graviton3) bằng khoảng 50% của c5.4xlarge và 40% của c6i.4xlarge; đối với các mô hình NLP của PyTorch, mức tiết kiệm chi phí là khoảng 30–50% so với các phiên bản c5 và c6i.4xlarge. Đối với các mô hình và khuôn khổ khác, chúng tôi đo lường được mức tiết kiệm chi phí ít nhất là 30% so với các phiên bản c5 và c6i.4xlarge.

Tương tự như biểu đồ so sánh chi phí suy luận trước đó, biểu đồ sau đây cho thấy độ trễ p90 của mô hình đối với bốn loại phiên bản giống nhau. Chúng tôi đã chuẩn hóa thêm kết quả độ trễ cho phiên bản c5.4xlarge, được đo bằng 1 trong trục Y của biểu đồ. Độ trễ suy luận của mô hình c7g.4xlarge (AWS Graviton3) tốt hơn tới 50% so với độ trễ được đo trên c5.4xlarge và c6i.4xlarge.

Di chuyển sang các phiên bản AWS Graviton

Để triển khai các mô hình của bạn lên các phiên bản AWS Graviton, bạn có thể sử dụng AWS Deep Learning Container (DLC) hoặc mang theo thùng chứa của riêng bạn tương thích với kiến trúc ARMv8.2.

Quá trình di chuyển (hoặc triển khai mới) các mô hình của bạn sang các phiên bản AWS Graviton rất đơn giản vì AWS không chỉ cung cấp các bộ chứa để lưu trữ các mô hình bằng PyTorch, TensorFlow, scikit-learning và XGBoost, mà các mô hình này còn có tính bất khả tri về mặt kiến trúc. Bạn cũng có thể mang theo thư viện của riêng mình nhưng hãy đảm bảo rằng bộ chứa của bạn được xây dựng với môi trường hỗ trợ kiến trúc ARMv8.2. Để biết thêm thông tin, xem Xây dựng bộ chứa thuật toán của riêng bạn.

Bạn sẽ cần hoàn thành ba bước để triển khai mô hình của mình:

- Tạo mô hình SageMaker. Điều này sẽ chứa, trong số các tham số khác, thông tin về vị trí tệp mô hình, vùng chứa sẽ được sử dụng để triển khai và vị trí của tập lệnh suy luận. (Nếu bạn đã triển khai một mô hình hiện có trong phiên bản suy luận được tối ưu hóa bằng điện toán, thì bạn có thể bỏ qua bước này.)

- Tạo một cấu hình điểm cuối. Điều này sẽ chứa thông tin về loại phiên bản bạn muốn cho điểm cuối (ví dụ: ml.c7g.xlarge cho AWS Graviton3), tên của mô hình bạn đã tạo ở bước trước và số lượng phiên bản trên mỗi điểm cuối.

- Khởi chạy điểm cuối với cấu hình điểm cuối được tạo ở bước trước.

Để được hướng dẫn chi tiết, hãy tham khảo Chạy khối lượng công việc suy luận bằng máy học trên các phiên bản dựa trên AWS Graviton với Amazon SageMaker

phương pháp đo điểm chuẩn

Chúng tôi đã sử dụng Người đề xuất suy luận của Amazon SageMaker để tự động hóa điểm chuẩn hiệu suất trên các phiên bản khác nhau. Dịch vụ này so sánh hiệu suất của mô hình ML của bạn về độ trễ và chi phí trên các phiên bản khác nhau, đồng thời đề xuất phiên bản và cấu hình mang lại hiệu suất tốt nhất với chi phí thấp nhất. Chúng tôi đã thu thập dữ liệu hiệu suất nói trên bằng Trình đề xuất suy luận. Để biết thêm chi tiết, hãy tham khảo Repo GitHub.

Bạn có thể sử dụng mẫu máy tính xách tay để chạy điểm chuẩn và tái tạo kết quả. Chúng tôi đã sử dụng các mô hình sau để đo điểm chuẩn:

Kết luận

AWS đã đo lường mức tiết kiệm chi phí lên tới 50% đối với suy luận mô hình PyTorch, TensorFlow, XGBoost và scikit-learning với các phiên bản EC3 C2g dựa trên AWS Graviton7 so với các phiên bản EC2 tương đương trên Amazon SageMaker. Bạn có thể di chuyển các trường hợp sử dụng suy luận hiện có của mình hoặc triển khai các mô hình ML mới trên AWS Graviton bằng cách làm theo các bước được cung cấp trong bài đăng này. Bạn cũng có thể tham khảo các Hướng dẫn kỹ thuật AWS Graviton, cung cấp danh sách các thư viện được tối ưu hóa và các phương pháp hay nhất sẽ giúp bạn đạt được lợi ích về chi phí với các phiên bản AWS Graviton trên các khối lượng công việc khác nhau.

Nếu bạn thấy các trường hợp sử dụng không đạt được mức tăng hiệu suất tương tự trên AWS Graviton, vui lòng liên hệ với chúng tôi. Chúng tôi sẽ tiếp tục bổ sung thêm nhiều cải tiến về hiệu suất để AWS Graviton trở thành bộ xử lý đa năng hiệu quả và tiết kiệm chi phí nhất dành cho suy luận ML.

Giới thiệu về tác giả

Sunita Nadampalli là Giám đốc phát triển phần mềm tại AWS. Cô lãnh đạo việc tối ưu hóa hiệu suất phần mềm Graviton cho khối lượng công việc học máy, HPC và đa phương tiện. Cô đam mê phát triển nguồn mở và cung cấp các giải pháp phần mềm tiết kiệm chi phí với Arm SoC.

Sunita Nadampalli là Giám đốc phát triển phần mềm tại AWS. Cô lãnh đạo việc tối ưu hóa hiệu suất phần mềm Graviton cho khối lượng công việc học máy, HPC và đa phương tiện. Cô đam mê phát triển nguồn mở và cung cấp các giải pháp phần mềm tiết kiệm chi phí với Arm SoC.

Jaymin Desai là Kỹ sư phát triển phần mềm của nhóm Amazon SageMaker Inference. Anh ấy đam mê đưa AI đến với đại chúng và cải thiện khả năng sử dụng của các tài sản AI tiên tiến nhất bằng cách sản xuất chúng thành các tính năng và dịch vụ. Trong thời gian rảnh rỗi, anh ấy thích khám phá âm nhạc và đi du lịch.

Jaymin Desai là Kỹ sư phát triển phần mềm của nhóm Amazon SageMaker Inference. Anh ấy đam mê đưa AI đến với đại chúng và cải thiện khả năng sử dụng của các tài sản AI tiên tiến nhất bằng cách sản xuất chúng thành các tính năng và dịch vụ. Trong thời gian rảnh rỗi, anh ấy thích khám phá âm nhạc và đi du lịch.

Mike Schneider là Nhà phát triển hệ thống, có trụ sở tại Phoenix AZ. Anh ấy là thành viên của bộ chứa Deep Learning, hỗ trợ nhiều hình ảnh bộ chứa Framework khác nhau, bao gồm Suy luận Graviton. Ông tận tụy với hiệu quả và sự ổn định của cơ sở hạ tầng.

Mike Schneider là Nhà phát triển hệ thống, có trụ sở tại Phoenix AZ. Anh ấy là thành viên của bộ chứa Deep Learning, hỗ trợ nhiều hình ảnh bộ chứa Framework khác nhau, bao gồm Suy luận Graviton. Ông tận tụy với hiệu quả và sự ổn định của cơ sở hạ tầng.

Mohan Gandhi là Kỹ sư phần mềm cao cấp tại AWS. Anh ấy đã làm việc với AWS trong 10 năm qua và đã làm việc trên nhiều dịch vụ AWS khác nhau như EMR, EFA và RDS. Hiện tại, anh ấy đang tập trung vào việc cải thiện Trải nghiệm suy luận của SageMaker. Trong thời gian rảnh rỗi, anh ấy thích đi bộ đường dài và chạy marathon.

Mohan Gandhi là Kỹ sư phần mềm cao cấp tại AWS. Anh ấy đã làm việc với AWS trong 10 năm qua và đã làm việc trên nhiều dịch vụ AWS khác nhau như EMR, EFA và RDS. Hiện tại, anh ấy đang tập trung vào việc cải thiện Trải nghiệm suy luận của SageMaker. Trong thời gian rảnh rỗi, anh ấy thích đi bộ đường dài và chạy marathon.

Thanh Vĩ là Chuyên gia Máy học tại Amazon Web Services. Anh ấy đã nhận bằng Tiến sĩ. trong Nghiên cứu hoạt động sau khi anh ta phá vỡ tài khoản tài trợ nghiên cứu của cố vấn và không trao được giải thưởng Nobel mà anh ta đã hứa. Hiện tại, anh ấy đang giúp các khách hàng trong ngành dịch vụ tài chính và bảo hiểm xây dựng các giải pháp máy học trên AWS. Trong thời gian rảnh rỗi, anh ấy thích đọc sách và giảng dạy.

Thanh Vĩ là Chuyên gia Máy học tại Amazon Web Services. Anh ấy đã nhận bằng Tiến sĩ. trong Nghiên cứu hoạt động sau khi anh ta phá vỡ tài khoản tài trợ nghiên cứu của cố vấn và không trao được giải thưởng Nobel mà anh ta đã hứa. Hiện tại, anh ấy đang giúp các khách hàng trong ngành dịch vụ tài chính và bảo hiểm xây dựng các giải pháp máy học trên AWS. Trong thời gian rảnh rỗi, anh ấy thích đọc sách và giảng dạy.

Wayne Toh là Kiến trúc sư giải pháp chuyên gia cho Graviton tại AWS. Ông tập trung vào việc giúp khách hàng áp dụng kiến trúc ARM cho khối lượng công việc bộ chứa quy mô lớn. Trước khi gia nhập AWS, Wayne đã làm việc cho một số nhà cung cấp phần mềm lớn, bao gồm cả IBM và Red Hat.

Wayne Toh là Kiến trúc sư giải pháp chuyên gia cho Graviton tại AWS. Ông tập trung vào việc giúp khách hàng áp dụng kiến trúc ARM cho khối lượng công việc bộ chứa quy mô lớn. Trước khi gia nhập AWS, Wayne đã làm việc cho một số nhà cung cấp phần mềm lớn, bao gồm cả IBM và Red Hat.

Lauren Mullennex là Kiến trúc sư Giải pháp có trụ sở tại Denver, CO. Cô ấy làm việc với khách hàng để giúp họ kiến trúc các giải pháp trên AWS. Khi rảnh rỗi, cô thích đi bộ đường dài và nấu các món ăn Hawaii.

Lauren Mullennex là Kiến trúc sư Giải pháp có trụ sở tại Denver, CO. Cô ấy làm việc với khách hàng để giúp họ kiến trúc các giải pháp trên AWS. Khi rảnh rỗi, cô thích đi bộ đường dài và nấu các món ăn Hawaii.

- Phân phối nội dung và PR được hỗ trợ bởi SEO. Được khuếch đại ngay hôm nay.

- PlatoAiStream. Thông minh dữ liệu Web3. Kiến thức khuếch đại. Truy cập Tại đây.

- Đúc kết tương lai với Adryenn Ashley. Truy cập Tại đây.

- Mua và bán cổ phần trong các công ty PRE-IPO với PREIPO®. Truy cập Tại đây.

- nguồn: https://aws.amazon.com/blogs/machine-learning/reduce-amazon-sagemaker-inference-cost-with-aws-graviton/

- : có

- :là

- :không phải

- :Ở đâu

- $ LÊN

- 1

- 10

- 100

- 7

- 98

- a

- Giới thiệu

- Tài khoản

- Đạt được

- ngang qua

- thêm vào

- nhận nuôi

- Lợi thế

- Sau

- AI

- thuật toán

- Đã

- Ngoài ra

- đàn bà gan dạ

- Amazon SageMaker

- Amazon Web Services

- trong số

- an

- và

- các ứng dụng

- kiến trúc

- LÀ

- ARM

- AS

- Tài sản

- At

- tự động hóa

- AWS

- dựa

- BE

- bởi vì

- được

- điểm chuẩn

- Điểm chuẩn

- Lợi ích

- BEST

- thực hành tốt nhất

- Hơn

- mang lại

- rộng

- Broke

- xây dựng

- xây dựng

- được xây dựng trong

- gánh nặng

- nhưng

- by

- CAN

- trường hợp

- Biểu đồ

- phân loại

- đám mây

- CO

- so sánh

- so

- sự so sánh

- tương thích

- hoàn thành

- Tính

- máy tính

- Tầm nhìn máy tính

- Cấu hình

- chứa

- Container

- Container

- tiếp tục

- Phí Tổn

- tiết kiệm chi phí

- chi phí-hiệu quả

- Chi phí

- che

- tạo ra

- Hiện nay

- khách hàng

- khách hàng

- dữ liệu

- dành riêng

- sâu

- học kĩ càng

- cung cấp

- phân phối

- Denver

- triển khai

- triển khai

- triển khai

- chi tiết

- chi tiết

- Nhà phát triển

- Phát triển

- khác nhau

- thảo luận

- làm

- hai

- hiệu quả

- hiệu quả

- hiệu quả

- hay

- Điểm cuối

- ky sư

- Môi trường

- đánh giá

- ví dụ

- hiện tại

- kinh nghiệm

- Khám phá

- thất bại

- Tính năng

- vài

- Tập tin

- tài chính

- dịch vụ tài chính

- Tìm kiếm

- Tập trung

- tập trung

- tập trung

- tiếp theo

- Trong

- 4

- Khung

- khung

- Miễn phí

- xa hơn

- thu nhập

- mục đích chung

- các thế hệ

- cho

- cấp

- đồ thị

- mũ

- Có

- he

- giúp đỡ

- giúp đỡ

- giúp

- cô

- của mình

- chủ nhà

- Độ đáng tin của

- hpc

- HTML

- HTTPS

- IBM

- if

- hình ảnh

- cải thiện

- cải tiến

- cải thiện

- in

- bao gồm

- Bao gồm

- ngành công nghiệp

- thông tin

- Cơ sở hạ tầng

- ví dụ

- hướng dẫn

- bảo hiểm

- Tích hợp

- trong

- tham gia

- jpg

- chỉ

- Ngôn ngữ

- lớn

- Họ

- Độ trễ

- Dẫn

- học tập

- ít nhất

- thư viện

- Lượt thích

- Lượt thích

- Danh sách

- địa điểm thư viện nào

- thấp nhất

- máy

- học máy

- làm cho

- quản lý

- giám đốc

- quần chúng

- Gặp gỡ

- hội viên

- Bộ nhớ

- di chuyển

- di cư

- triệu

- ML

- MLOps

- kiểu mẫu

- mô hình

- chi tiết

- hầu hết

- đa phương tiện

- nhiều

- Âm nhạc

- tên

- Tự nhiên

- Xử lý ngôn ngữ tự nhiên

- Cần

- nhu cầu

- Mới

- nlp

- giải thưởng Nobel

- con số

- of

- cung cấp

- on

- có thể

- mã nguồn mở

- hoạt động

- Hoạt động

- tối ưu hóa

- Tùy chọn

- Các lựa chọn

- or

- gọi món

- Nền tảng khác

- ra

- riêng

- thông số

- đam mê

- hiệu suất

- phượng hoàng

- chọn

- plato

- Thông tin dữ liệu Plato

- PlatoDữ liệu

- xin vui lòng

- Phổ biến

- Bài đăng

- thực hành

- trước

- Trước khi

- giải thưởng

- xử lý

- Bộ xử lý

- Sản lượng

- hứa

- cho

- cung cấp

- cung cấp

- ngọn đuốc

- phạm vi

- Xếp hạng

- đạt

- Reading

- nhận

- đề nghị

- đỏ

- Red Hat

- giảm

- Giảm

- nghiên cứu

- Kết quả

- chạy

- nhà làm hiền triết

- Suy luận của SageMaker

- tương tự

- Tiết kiệm

- Quy mô

- kịch bản

- học hỏi

- xem

- lựa chọn

- cao cấp

- dịch vụ

- DỊCH VỤ

- một số

- chị ấy

- hiển thị

- Chương trình

- có ý nghĩa

- tương tự

- So

- Phần mềm

- phát triển phần mềm

- Kỹ sư phần mềm

- Giải pháp

- chuyên gia

- chuyên nghành

- Tính ổn định

- nhà nước-of-the-art

- Bước

- Các bước

- đơn giản

- Hỗ trợ

- Hỗ trợ

- Công tắc điện

- hệ thống

- Hãy

- dùng

- Giảng dạy

- nhóm

- Kỹ thuật

- tensorflow

- về

- hơn

- việc này

- Sản phẩm

- thông tin

- Them

- điều này

- số ba

- thời gian

- đến

- công cụ

- Đi du lịch

- kiểu

- loại

- us

- khả năng sử dụng

- sử dụng

- đã sử dụng

- sử dụng

- khác nhau

- nhà cung cấp

- tầm nhìn

- muốn

- we

- web

- các dịch vụ web

- TỐT

- cái nào

- sẽ

- với

- Công việc

- làm việc

- công trinh

- XGBoost

- năm

- Bạn

- trên màn hình

- zephyrnet