Giới thiệu

Tôi chắc chắn rằng hầu hết các bạn đã nghe nói về ChatGPT và đã dùng thử để trả lời các câu hỏi của mình! Bao giờ tự hỏi những gì xảy ra dưới mui xe? Nó được hỗ trợ bởi Mô hình ngôn ngữ lớn GPT-3 do Open AI phát triển. Những mô hình ngôn ngữ lớn này, thường được gọi là LLM đã mở ra nhiều khả năng trong Xử lý ngôn ngữ tự nhiên.

Mô hình Ngôn ngữ Lớn là gì?

Các mô hình LLM được đào tạo trên một lượng lớn dữ liệu văn bản, cho phép chúng hiểu ngôn ngữ của con người với ý nghĩa và ngữ cảnh. Trước đây, hầu hết các mô hình được đào tạo bằng cách sử dụng phương pháp được giám sát, trong đó chúng tôi cung cấp các tính năng đầu vào và nhãn tương ứng. Không giống như điều này, các LLM được đào tạo thông qua học tập không giám sát, nơi chúng được cung cấp một lượng dữ liệu văn bản khổng lồ mà không có bất kỳ nhãn và hướng dẫn nào. Do đó, các LLM học nghĩa và mối quan hệ giữa các từ của một ngôn ngữ một cách hiệu quả. Chúng có thể được sử dụng cho nhiều tác vụ khác nhau như tạo văn bản, trả lời câu hỏi, dịch từ ngôn ngữ này sang ngôn ngữ khác, v.v.

Ngoài ra, các mô hình ngôn ngữ lớn này có thể được tinh chỉnh trên tập dữ liệu tùy chỉnh của bạn cho các tác vụ dành riêng cho miền. Trong bài viết này, tôi sẽ nói về nhu cầu tinh chỉnh, các LLM khác nhau hiện có và cũng đưa ra một ví dụ.

Hiểu tinh chỉnh LLM

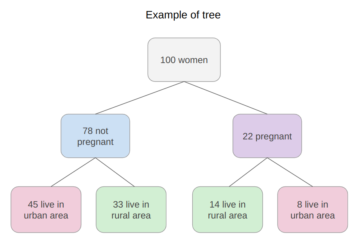

Giả sử bạn điều hành một cộng đồng hỗ trợ bệnh tiểu đường và muốn thiết lập một đường dây trợ giúp trực tuyến để trả lời các câu hỏi. LLM được đào tạo trước được đào tạo tổng quát hơn và sẽ không thể cung cấp câu trả lời tốt nhất cho các câu hỏi cụ thể về lĩnh vực cũng như hiểu các thuật ngữ và từ viết tắt y tế. Điều này có thể được giải quyết bằng cách tinh chỉnh.

Chúng ta có ý nghĩa gì khi tinh chỉnh? Nói một cách ngắn gọn, chuyển khoản

học tập! Các mô hình ngôn ngữ lớn được đào tạo trên các bộ dữ liệu khổng lồ bằng cách sử dụng nhiều tài nguyên và có hàng triệu tham số. Các biểu diễn và mẫu ngôn ngữ mà LLM học được trong quá trình đào tạo trước được chuyển sang nhiệm vụ hiện tại của bạn. Về mặt kỹ thuật, chúng tôi khởi tạo một mô hình với các trọng số được đào tạo trước, sau đó huấn luyện mô hình đó trên dữ liệu dành riêng cho nhiệm vụ của chúng tôi để đạt được các trọng số được tối ưu hóa cho nhiệm vụ hơn cho các tham số. Bạn cũng có thể thực hiện các thay đổi trong kiến trúc của mô hình và sửa đổi các lớp theo nhu cầu của mình.

Tại sao bạn nên tinh chỉnh các mô hình?

- Tiết kiệm thời gian và nguồn lực: Tinh chỉnh có thể giúp bạn giảm thời gian đào tạo và nguồn lực cần thiết hơn là đào tạo từ đầu.

- Yêu cầu dữ liệu giảm: Nếu bạn muốn đào tạo một mô hình từ đầu, bạn sẽ cần một lượng lớn dữ liệu được gắn nhãn mà thường không có sẵn cho các cá nhân và doanh nghiệp nhỏ. Tinh chỉnh có thể giúp bạn đạt được hiệu suất tốt ngay cả với lượng dữ liệu nhỏ hơn.

- Tùy chỉnh theo nhu cầu của bạn: LLM được đào tạo trước có thể không nắm bắt được thuật ngữ và từ viết tắt dành riêng cho miền của bạn. Ví dụ: một LLM bình thường sẽ không nhận ra rằng “Loại 1” và “Loại 2” biểu thị các loại bệnh tiểu đường, trong khi một LLM tinh chỉnh có thể.

- Cho phép học liên tục: Giả sử chúng tôi tinh chỉnh mô hình của mình trên dữ liệu thông tin về bệnh tiểu đường và triển khai nó. Điều gì sẽ xảy ra nếu có một kế hoạch ăn kiêng hoặc phương pháp điều trị mới mà bạn muốn đưa vào? Bạn có thể sử dụng trọng số của mô hình đã tinh chỉnh trước đó và điều chỉnh nó để bao gồm dữ liệu mới của mình. Điều này có thể giúp các tổ chức luôn cập nhật mô hình của họ một cách hiệu quả.

Chọn một mô hình LLM nguồn mở

Bước tiếp theo sẽ là chọn một mô hình ngôn ngữ lớn cho nhiệm vụ của bạn. lựa chọn của bạn là gì? Các mô hình ngôn ngữ lớn tiên tiến nhất hiện có bao gồm GPT-3, Bloom, BERT, T5 và XLNet. Trong số này, GPT-3 (Generative Pretraining Transformers) đã thể hiện hiệu suất tốt nhất vì nó được đào tạo trên 175 tỷ tham số và có thể xử lý các tác vụ NLU khác nhau. Tuy nhiên, tính năng tinh chỉnh GPT-3 chỉ có thể được truy cập thông qua đăng ký trả phí và tương đối đắt hơn các tùy chọn khác.

Mặt khác, BERT là một mô hình ngôn ngữ lớn mã nguồn mở và có thể được tinh chỉnh miễn phí. Chứng nhận là viết tắt của Máy biến áp giải mã bộ mã hóa hai chiều. BERT thực hiện một công việc tuyệt vời là hiểu các biểu diễn từ theo ngữ cảnh.

Bạn chọn như thế nào?

Nếu nhiệm vụ của bạn thiên về tạo văn bản, các mô hình GPT-3 (trả phí) hoặc GPT-2 (nguồn mở) sẽ là lựa chọn tốt hơn. Nếu nhiệm vụ của bạn thuộc phân loại văn bản, trả lời câu hỏi hoặc Nhận dạng thực thể, bạn có thể sử dụng BERT. Đối với trường hợp Trả lời câu hỏi về bệnh tiểu đường của tôi, tôi sẽ tiếp tục với mô hình BERT.

Chuẩn bị và xử lý trước Tập dữ liệu của bạn

Đây là bước tinh chỉnh quan trọng nhất, vì định dạng dữ liệu thay đổi tùy theo mô hình và nhiệm vụ. Đối với trường hợp này, tôi đã tạo một tài liệu văn bản mẫu với thông tin về bệnh tiểu đường mà tôi đã mua từ Viện Y tế Quốc gia trang mạng. Bạn có thể sử dụng dữ liệu của riêng bạn.

Để tinh chỉnh BERT nhiệm vụ Trả lời câu hỏi, nên chuyển đổi dữ liệu của bạn sang định dạng SQuAD. SQuAD là Bộ dữ liệu trả lời câu hỏi của Stanford và định dạng này được áp dụng rộng rãi để đào tạo các mô hình NLP cho các nhiệm vụ trả lời câu hỏi. Dữ liệu phải ở định dạng JSON, trong đó mỗi trường bao gồm:

context: Câu hoặc đoạn văn bản dựa vào đó mô hình sẽ tìm kiếm câu trả lời cho câu hỏiquestion: Truy vấn chúng tôi muốn BERT trả lời. Bạn sẽ cần sắp xếp các câu hỏi này dựa trên cách người dùng cuối sẽ tương tác với mô hình QA.answers: Bạn cần cung cấp câu trả lời mong muốn trong trường này. Có hai thành phần phụ dưới đây,textvàanswer_start. Cáctextsẽ có chuỗi câu trả lời. Trong khi,answer_startbiểu thị chỉ mục, từ đó câu trả lời bắt đầu trong đoạn ngữ cảnh.

Như bạn có thể tưởng tượng, sẽ mất rất nhiều thời gian để tạo dữ liệu này cho tài liệu của bạn nếu bạn thực hiện thủ công. Đừng lo lắng, tôi sẽ chỉ cho bạn cách thực hiện dễ dàng với công cụ chú thích Haystack.

Làm cách nào để tạo dữ liệu ở định dạng SQuAD với Haystack?

Sử dụng công cụ chú thích Haystack, bạn có thể nhanh chóng tạo tập dữ liệu được gắn nhãn cho các tác vụ trả lời câu hỏi. Bạn có thể truy cập công cụ bằng cách tạo một tài khoản trên website. Tạo một dự án mới và tải lên tài liệu của bạn. Bạn có thể xem nó trong tab “Tài liệu”, chuyển đến “Hành động” và bạn có thể thấy tùy chọn để tạo câu hỏi của mình. Bạn có thể viết câu hỏi của mình và đánh dấu câu trả lời trong tài liệu, Haystack sẽ tự động tìm chỉ mục bắt đầu của nó. Tôi đã chỉ ra cách tôi đã làm điều đó trên tài liệu của mình trong hình ảnh bên dưới.

Hình 1: Tạo tập dữ liệu được gắn nhãn cho Hỏi-Trả lời bằng Haystack

Khi bạn hoàn tất việc tạo đủ các cặp Câu hỏi-câu trả lời để tinh chỉnh, bạn sẽ có thể xem tóm tắt về chúng như hình bên dưới. Trong tab “Xuất nhãn”, bạn có thể tìm thấy nhiều tùy chọn cho định dạng mà bạn muốn xuất. Chúng tôi chọn định dạng nhóm cho trường hợp của mình. Nếu bạn cần thêm trợ giúp trong việc sử dụng công cụ này, bạn có thể kiểm tra tài liệu hướng dẫn. Bây giờ chúng tôi có tệp JSON chứa các cặp QA để tinh chỉnh.

Làm thế nào để tinh chỉnh?

Python cung cấp nhiều gói nguồn mở mà bạn có thể sử dụng để tinh chỉnh. Tôi đã sử dụng gói Pytorch và Transformers cho trường hợp của mình. Bắt đầu bằng cách nhập các mô-đun gói bằng pip, trình quản lý gói. Các transformers thư viện cung cấp một BERTTokenizer, đặc biệt để mã hóa các đầu vào cho mô hình BERT.

!pip install torch

!pip install transformers import json

import torch

from transformers import BertTokenizer, BertForQuestionAnswering

from torch.utils.data import DataLoader, Dataset

Xác định tập dữ liệu tùy chỉnh để tải và tiền xử lý

Bước tiếp theo là tải và xử lý trước dữ liệu. Bạn có thể dùng Dataset lớp từ pytorch's utils.data module để xác định một lớp tùy chỉnh cho tập dữ liệu của bạn. Tôi đã tạo một lớp tập dữ liệu tùy chỉnh diabetes như bạn có thể thấy trong đoạn mã dưới đây. Các init chịu trách nhiệm khởi tạo các biến. Các file_path là một đối số sẽ nhập đường dẫn của tệp đào tạo JSON của bạn và sẽ được sử dụng để khởi tạo data. Chúng tôi khởi tạo BertTokenizer cũng ở đây.

Tiếp theo, chúng tôi xác định một load_data() chức năng. Hàm này sẽ đọc tệp JSON thành một đối tượng dữ liệu JSON và trích xuất ngữ cảnh, câu hỏi, câu trả lời và chỉ mục của chúng từ đó. Nó nối thêm các trường được trích xuất vào một danh sách và trả về nó.

Sản phẩm getitem sử dụng mã thông báo BERT để mã hóa câu hỏi và ngữ cảnh thành các thang đo đầu vào được input_ids và attention_mask. Các encode_plus sẽ mã hóa văn bản và thêm các mã thông báo đặc biệt (chẳng hạn như [CLS] và [SEP]). Lưu ý rằng chúng tôi sử dụng squeeze() phương pháp để loại bỏ bất kỳ kích thước đơn nào trước khi nhập vào BERT. Cuối cùng, nó trả về các tenxơ đầu vào đã xử lý.

class diabetes(Dataset): def __init__(self, file_path): self.data = self.load_data(file_path) self.tokenizer = BertTokenizer.from_pretrained('bert-base-uncased') def load_data(self, file_path): with open(file_path, 'r') as f: data = json.load(f) paragraphs = data['data'][0]['paragraphs'] extracted_data = [] for paragraph in paragraphs: context = paragraph['context'] for qa in paragraph['qas']: question = qa['question'] answer = qa['answers'][0]['text'] start_pos = qa['answers'][0]['answer_start'] extracted_data.append({ 'context': context, 'question': question, 'answer': answer, 'start_pos': start_pos, }) return extracted_data def __len__(self): return len(self.data) def __getitem__(self, index): example = self.data[index] question = example['question'] context = example['context'] answer = example['answer'] inputs = self.tokenizer.encode_plus(question, context, add_special_tokens=True, padding='max_length', max_length=512, truncation=True, return_tensors='pt') input_ids = inputs['input_ids'].squeeze() attention_mask = inputs['attention_mask'].squeeze() start_pos = torch.tensor(example['start_pos']) return input_ids, attention_mask, start_pos, end_pos

Sau khi bạn định nghĩa nó, bạn có thể tiếp tục và tạo một thể hiện của lớp này bằng cách chuyển file_path lập luận với nó.

file_path = 'diabetes.json'

dataset = diabetes(file_path)

Đào tạo người mẫu

tôi sẽ sử dụng BertForQuestionAnswering mô hình vì nó phù hợp nhất cho các nhiệm vụ QA. Bạn có thể khởi tạo các trọng số được đào tạo trước của bert-base-uncased mô hình bằng cách gọi from_pretrained chức năng trên mô hình. Bạn cũng nên chọn chức năng giảm đánh giá và trình tối ưu hóa mà bạn sẽ sử dụng để đào tạo.

Xem hướng dẫn thực hành, thực tế của chúng tôi để học Git, với các phương pháp hay nhất, các tiêu chuẩn được ngành công nghiệp chấp nhận và bảng lừa đảo đi kèm. Dừng lệnh Googling Git và thực sự học nó!

Tôi đang sử dụng trình tối ưu hóa Adam và chức năng mất entropy chéo. Bạn có thể sử dụng lớp Pytorch DataLoader để tải dữ liệu theo các đợt khác nhau và cũng xáo trộn chúng để tránh mọi sai lệch.

device = torch.device('cuda' if torch.cuda.is_available() else 'cpu') model = BertForQuestionAnswering.from_pretrained('bert-base-uncased')

model.to(device) optimizer = torch.optim.AdamW(model.parameters(), lr=2e-5)

loss_fn = torch.nn.CrossEntropyLoss()

batch_size = 8

num_epochs = 50 data_loader = DataLoader(dataset, batch_size=batch_size, shuffle=True)

Khi trình tải dữ liệu được xác định, bạn có thể tiếp tục và viết vòng lặp huấn luyện cuối cùng. Trong mỗi lần lặp, mỗi lô thu được từ data_loader chứa batch_size số ví dụ, trên đó thực hiện truyền xuôi và truyền ngược. Đoạn mã này cố gắng tìm ra tập trọng số tốt nhất cho các tham số, tại đó tổn thất sẽ là nhỏ nhất.

for epoch in range(num_epochs): model.train() total_loss = 0 for batch in data_loader: input_ids = batch[0].to(device) attention_mask = batch[1].to(device) start_positions = batch[2].to(device) optimizer.zero_grad() outputs = model(input_ids, attention_mask=attention_mask, start_positions=start_positions) loss = outputs.loss loss.backward() optimizer.step() total_loss += loss.item() avg_loss = total_loss / len(data_loader) print(f"Epoch {epoch+1}/{num_epochs} - Average Loss: {avg_loss:.4f}")

Điều này hoàn thành tinh chỉnh của bạn! Bạn có thể kiểm tra mô hình bằng cách đặt nó thành model.eval(). Bạn cũng có thể sử dụng tinh chỉnh tốc độ học tập và không có tham số epoch nào để thu được kết quả tốt nhất trên dữ liệu của mình.

Mẹo và Thực tiễn Tốt nhất

Dưới đây là một số điểm cần lưu ý khi tinh chỉnh bất kỳ mô hình ngôn ngữ lớn nào trên dữ liệu tùy chỉnh:

- Tập dữ liệu của bạn cần đại diện cho miền mục tiêu hoặc nhiệm vụ mà bạn muốn mô hình ngôn ngữ vượt trội. Làm sạch và dữ liệu có cấu trúc tốt là điều cần thiết.

- Đảm bảo rằng bạn có đủ ví dụ đào tạo trong dữ liệu của mình để mô hình học các mẫu. Mặt khác, mô hình có thể ghi nhớ các ví dụ và khớp quá mức, mà không có khả năng khái quát đến những ví dụ chưa từng thấy.

- Chọn một mô hình được đào tạo trước đã được đào tạo trên kho ngữ liệu có liên quan đến nhiệm vụ của bạn trong tầm tay. Để trả lời câu hỏi, chúng tôi chọn một mô hình được đào tạo trước được đào tạo trên bộ dữ liệu Trả lời câu hỏi của Stanford. Tương tự như vậy, có nhiều mô hình khác nhau có sẵn cho các tác vụ như phân tích tình cảm, tạo văn bản, tóm tắt, phân loại văn bản, v.v.

- Thử tích lũy gradient nếu bạn có bộ nhớ GPU hạn chế. Trong phương pháp này, thay vì cập nhật trọng số của mô hình sau mỗi đợt, độ dốc được tích lũy qua nhiều đợt nhỏ trước khi thực hiện cập nhật.

- Nếu bạn gặp phải vấn đề overfitting trong khi tinh chỉnh, hãy sử dụng chính quy technqiues. Một số phương pháp thường được sử dụng bao gồm thêm các lớp bỏ học vào kiến trúc mô hình, triển khai phân rã trọng lượng và chuẩn hóa lớp.

Kết luận

Các mô hình ngôn ngữ lớn có thể giúp bạn tự động hóa nhiều tác vụ một cách nhanh chóng và hiệu quả. Các LLM tinh chỉnh giúp bạn tận dụng sức mạnh của học chuyển đổi và tùy chỉnh nó cho miền cụ thể của bạn. Việc tinh chỉnh có thể cần thiết nếu tập dữ liệu của bạn thuộc các lĩnh vực như y tế, ngách kỹ thuật, tập dữ liệu tài chính, v.v.

Trong bài viết này, chúng tôi đã sử dụng BERT vì nó là nguồn mở và hoạt động tốt cho mục đích sử dụng cá nhân. Nếu bạn đang làm việc trên một dự án quy mô lớn, bạn có thể chọn các LLM mạnh hơn, như GPT3 hoặc các giải pháp thay thế nguồn mở khác. Hãy nhớ rằng, việc tinh chỉnh các mô hình ngôn ngữ lớn có thể tốn kém về mặt tính toán và thời gian. Đảm bảo bạn có đủ tài nguyên tính toán, bao gồm GPU hoặc TPU dựa trên tỷ lệ.

- Phân phối nội dung và PR được hỗ trợ bởi SEO. Được khuếch đại ngay hôm nay.

- PlatoData.Network Vertical Generative Ai. Trao quyền cho chính mình. Truy cập Tại đây.

- PlatoAiStream. Thông minh Web3. Kiến thức khuếch đại. Truy cập Tại đây.

- Trung tâmESG. Ô tô / Xe điện, Than đá, công nghệ sạch, Năng lượng, Môi trường Hệ mặt trời, Quản lý chất thải. Truy cập Tại đây.

- BlockOffsets. Hiện đại hóa quyền sở hữu bù đắp môi trường. Truy cập Tại đây.

- nguồn: https://stackabuse.com/guide-to-fine-tuning-open-source-llms-on-custom-data/

- : có

- :là

- :không phải

- :Ở đâu

- $ LÊN

- 1

- 12

- 20

- 8

- a

- Có khả năng

- Giới thiệu

- truy cập

- truy cập

- Tài khoản

- Tích lũy

- Đạt được

- hành động

- thực sự

- Adam

- thêm

- Thêm

- con nuôi

- Sau

- trước

- AI

- Ngoài ra

- lựa chọn thay thế

- am

- trong số

- số lượng

- số lượng

- an

- phân tích

- và

- Một

- trả lời

- câu trả lời

- bất kì

- phương pháp tiếp cận

- kiến trúc

- LÀ

- đối số

- bài viết

- AS

- At

- Nỗ lực

- tự động hóa

- tự động

- có sẵn

- Trung bình cộng

- tránh

- dựa

- BE

- được

- trước

- phía dưới

- BEST

- Hơn

- giữa

- thiên vị

- Tỷ

- Hoa

- biên giới

- các doanh nghiệp

- nhưng

- by

- gọi

- CAN

- Sức chứa

- trường hợp

- Catch

- Những thay đổi

- ChatGPT

- kiểm tra

- sự lựa chọn

- Chọn

- tốt nghiệp lớp XNUMX

- phân loại

- mã

- thông thường

- cộng đồng

- Hoàn thành

- phần kết luận

- bao gồm

- chứa

- bối cảnh

- theo ngữ cảnh

- chuyển đổi

- Tương ứng

- tạo

- tạo ra

- Tạo

- Vượt qua

- quan trọng

- Current

- Hiện nay

- khách hàng

- tùy chỉnh

- dữ liệu

- bộ dữ liệu

- xác định

- triển khai

- mong muốn

- phát triển

- thiết bị

- Bệnh tiểu đường

- ĐÃ LÀM

- Chế độ ăn uống

- khác nhau

- kích thước

- khác nhau

- do

- tài liệu

- tài liệu

- làm

- miền

- lĩnh vực

- don

- thực hiện

- suốt trong

- mỗi

- dễ dàng

- hiệu quả

- hiệu quả

- khác

- cho phép

- cuối

- đủ

- đảm bảo

- thực thể

- kỷ nguyên

- kỷ nguyên

- thiết yếu

- đánh giá

- Ngay cả

- BAO GIỜ

- ví dụ

- ví dụ

- Excel

- tuyệt vời

- đắt tiền

- xuất khẩu

- trích xuất

- Đối mặt

- Ngã

- Tính năng

- Fed

- lĩnh vực

- Lĩnh vực

- Tập tin

- cuối cùng

- Cuối cùng

- tài chính

- Tìm kiếm

- Tập trung

- Trong

- định dạng

- Forward

- FRAME

- Miễn phí

- từ

- chức năng

- nói chung

- thế hệ

- thế hệ

- đi

- Go

- tốt

- GPU

- GPU

- gradients

- hướng dẫn

- tay

- xử lý

- hands-on

- xảy ra

- Có

- cho sức khoẻ

- nghe

- nặng

- giúp đỡ

- vì thế

- tại đây

- Đánh dấu

- mui xe

- di chuột

- Độ đáng tin của

- Hướng dẫn

- HTTPS

- lớn

- Nhân loại

- khổng lồ

- i

- if

- hình ảnh

- hình ảnh

- thực hiện

- nhập khẩu

- in

- bao gồm

- bao gồm

- Bao gồm

- chỉ số

- các cá nhân

- thông tin

- đầu vào

- đầu vào

- cài đặt, dựng lên

- ví dụ

- hướng dẫn

- tương tác

- trong

- Giới thiệu

- IT

- sự lặp lại

- Việc làm

- json

- Giữ

- Nhãn

- Ngôn ngữ

- lớn

- quy mô lớn

- lớp

- lớp

- LEARN

- học

- học tập

- cho phép

- Tỉ lệ đòn bẩy

- LG

- Thư viện

- Lượt thích

- Hạn chế

- Danh sách

- ll

- LLM

- tải

- loader

- tải

- sự mất

- Rất nhiều

- làm cho

- giám đốc

- cách thức

- thủ công

- nhiều

- lớn

- Có thể..

- nghĩa là

- có nghĩa là

- y khoa

- Bộ nhớ

- phương pháp

- phương pháp

- Might

- hàng triệu

- tối thiểu

- kiểu mẫu

- mô hình

- sửa đổi

- Mô-đun

- Modules

- chi tiết

- hầu hết

- nhiều

- nhiều

- my

- quốc dân

- Cần

- cần thiết

- nhu cầu

- Mới

- tiếp theo

- NIH

- nlp

- Không

- bình thường

- tại

- con số

- vật

- được

- thu được

- of

- Cung cấp

- thường

- on

- ONE

- Trực tuyến

- có thể

- mở

- mã nguồn mở

- Tùy chọn

- Các lựa chọn

- or

- tổ chức

- Nền tảng khác

- vfoXNUMXfipXNUMXhfpiXNUMXufhpiXNUMXuf

- ra

- kết thúc

- riêng

- gói

- gói

- thanh toán

- cặp

- thông số

- riêng

- Đi qua

- con đường

- mô hình

- mỗi

- hiệu suất

- thực hiện

- biểu diễn

- riêng

- kế hoạch

- plato

- Thông tin dữ liệu Plato

- PlatoDữ liệu

- điểm

- khả năng

- quyền lực

- -

- mạnh mẽ

- Thực tế

- trước đây

- Vấn đề

- Xử lý

- dự án

- cho

- cung cấp

- ngọn đuốc

- Q & A

- câu hỏi

- Câu hỏi

- Nhanh chóng

- Mau

- Tỷ lệ

- hơn

- đạt

- Đọc

- công nhận

- công nhận

- đề nghị

- giảm

- gọi

- Mối quan hệ

- tương đối

- có liên quan

- nhớ

- tẩy

- đại diện

- Yêu cầu

- Thông tin

- chịu trách nhiệm

- Kết quả

- Trả về

- Nhẫn

- chạy

- s

- nói

- Quy mô

- xước

- Tìm kiếm

- xem

- TỰ

- kết án

- tình cảm

- định

- thiết lập

- Bóng tối

- tấm

- nên

- hiển thị

- thể hiện

- Shuffle

- biểu thị

- tương tự

- nhỏ

- Tiểu thương

- nhỏ hơn

- một số

- nguồn

- đặc biệt

- riêng

- đặc biệt

- xếp chồng lên nhau

- tiêu chuẩn

- đứng

- stanford

- Bắt đầu

- Bắt đầu

- nhà nước-of-the-art

- Bước

- Dừng

- Chuỗi

- đăng ký

- như vậy

- đủ

- TÓM TẮT

- hỗ trợ

- chắc chắn

- Hãy

- Thảo luận

- Mục tiêu

- Nhiệm vụ

- nhiệm vụ

- Kỹ thuật

- thuật ngữ

- về

- thử nghiệm

- Phân loại văn bản

- hơn

- việc này

- Sản phẩm

- cung cấp their dịch

- Them

- sau đó

- Đó

- Kia là

- họ

- điều này

- Thông qua

- thời gian

- mất thời gian

- lời khuyên

- đến

- token hóa

- token hóa

- Tokens

- công cụ

- hàng đầu

- ngọn đuốc

- đối với

- Train

- đào tạo

- Hội thảo

- chuyển

- chuyển

- máy biến áp

- quá trình chuyển đổi

- Dịch

- điều trị

- cố gắng

- hai

- kiểu

- loại

- Dưới

- hiểu

- sự hiểu biết

- không giống

- up-to-date

- Cập nhật

- cập nhật

- sử dụng

- đã sử dụng

- người sử dang

- sử dụng

- sử dụng

- nhiều

- Xem

- muốn

- we

- trọng lượng

- TỐT

- là

- Điều gì

- trong khi

- cái nào

- trong khi

- rộng

- rộng rãi

- sẽ

- với

- không có

- Từ

- từ

- đang làm việc

- công trinh

- lo

- sẽ

- sẽ

- viết

- Bạn

- trên màn hình

- zephyrnet