Các nhà nghiên cứu tiếp tục phát triển các kiến trúc mô hình mới cho các tác vụ máy học (ML) phổ biến. Một nhiệm vụ như vậy là phân loại hình ảnh, trong đó hình ảnh được chấp nhận làm đầu vào và mô hình cố gắng phân loại toàn bộ hình ảnh với đầu ra nhãn đối tượng. Với nhiều mô hình hiện có thực hiện nhiệm vụ phân loại hình ảnh này, một học viên ML có thể đặt câu hỏi như: “Tôi nên tinh chỉnh và sau đó triển khai mô hình nào để đạt được hiệu suất tốt nhất trên tập dữ liệu của mình?” Và một nhà nghiên cứu ML có thể hỏi những câu hỏi như: “Làm cách nào tôi có thể tạo ra sự so sánh công bằng của riêng mình về nhiều kiến trúc mô hình với một tập dữ liệu cụ thể trong khi kiểm soát các siêu tham số đào tạo và thông số kỹ thuật của máy tính, chẳng hạn như GPU, CPU và RAM?” Câu hỏi trước đề cập đến việc lựa chọn mô hình trên các kiến trúc mô hình, trong khi câu hỏi sau liên quan đến đo điểm chuẩn các mô hình được đào tạo dựa trên tập dữ liệu thử nghiệm.

Trong bài đăng này, bạn sẽ thấy cách Phân loại hình ảnh TensorFlow thuật toán của Khởi động Amazon SageMaker có thể đơn giản hóa việc triển khai cần thiết để giải quyết những câu hỏi này. Cùng với các chi tiết thực hiện trong một tương ứng ví dụ máy tính xách tay Jupyter, bạn sẽ có sẵn các công cụ để thực hiện lựa chọn mô hình bằng cách khám phá các giới hạn pareto, nơi không thể cải thiện một chỉ số hiệu suất, chẳng hạn như độ chính xác, nếu không làm xấu đi một chỉ số khác, chẳng hạn như thông lượng.

Tổng quan về giải pháp

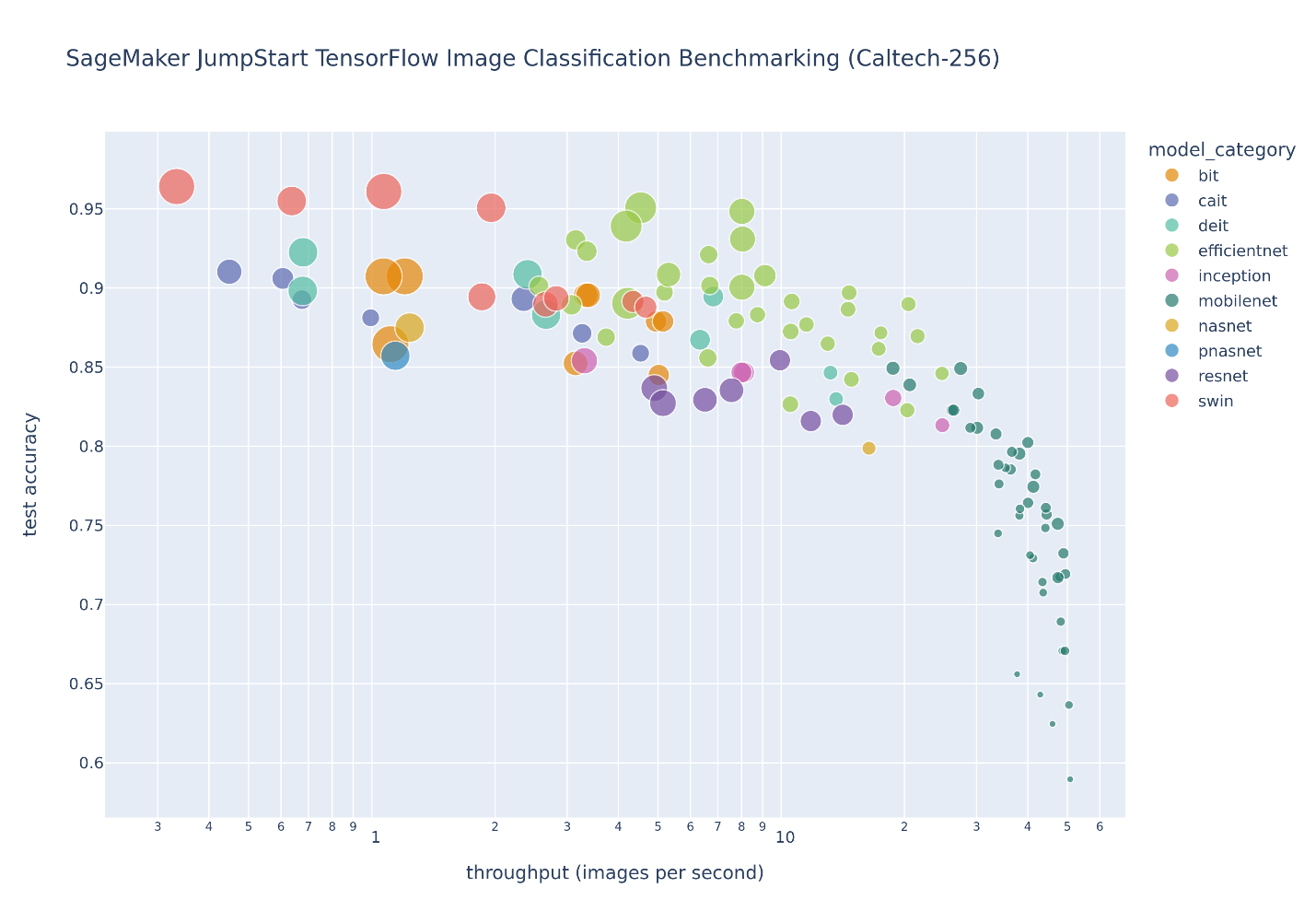

Hình dưới đây minh họa sự đánh đổi lựa chọn mô hình cho một số lượng lớn các mô hình phân loại hình ảnh được tinh chỉnh trên Caltech-256 bộ dữ liệu, là một bộ đầy thách thức gồm 30,607 hình ảnh trong thế giới thực bao gồm 256 danh mục đối tượng. Mỗi điểm đại diện cho một mô hình duy nhất, kích thước điểm được chia tỷ lệ tương ứng với số lượng tham số bao gồm mô hình và các điểm được mã hóa màu dựa trên kiến trúc mô hình của chúng. Ví dụ: các điểm màu lục nhạt thể hiện kiến trúc EfficientNet; mỗi điểm màu xanh lục nhạt là một cấu hình khác nhau của kiến trúc này với các phép đo hiệu suất mô hình được tinh chỉnh độc đáo. Hình vẽ cho thấy sự tồn tại của đường biên pareto để lựa chọn mô hình, trong đó độ chính xác cao hơn được đổi lấy thông lượng thấp hơn. Cuối cùng, việc lựa chọn một mô hình dọc theo đường biên pareto hoặc tập hợp các giải pháp hiệu quả pareto, tùy thuộc vào các yêu cầu về hiệu suất triển khai mô hình của bạn.

Nếu bạn quan sát độ chính xác kiểm tra và giới hạn thông lượng kiểm tra quan tâm, tập hợp các giải pháp hiệu quả pareto trên hình trước được trích xuất trong bảng sau. Các hàng được sắp xếp sao cho thông lượng thử nghiệm tăng lên và độ chính xác của thử nghiệm giảm xuống.

| Tên Model | Số tham số | Kiểm tra độ chính xác | Kiểm tra độ chính xác hàng đầu 5 | Thông lượng (hình ảnh/s) | Thời lượng mỗi Kỷ nguyên |

| swin-big-patch4-window12-384 | 195.6M | 96.4% | 99.5% | 0.3 | 2278.6 |

| swin-big-patch4-window7-224 | 195.4M | 96.1% | 99.5% | 1.1 | 698.0 |

| hiệu quảnet-v2-imagenet21k-ft1k-l | 118.1M | 95.1% | 99.2% | 4.5 | 1434.7 |

| hiệu quảnet-v2-imagenet21k-ft1k-m | 53.5M | 94.8% | 99.1% | 8.0 | 769.1 |

| hiệu quảnet-v2-imagenet21k-m | 53.5M | 93.1% | 98.5% | 8.0 | 765.1 |

| hiệu quả-b5 | 29.0M | 90.8% | 98.1% | 9.1 | 668.6 |

| hiệu quảnet-v2-imagenet21k-ft1k-b1 | 7.3M | 89.7% | 97.3% | 14.6 | 54.3 |

| hiệu quảnet-v2-imagenet21k-ft1k-b0 | 6.2M | 89.0% | 97.0% | 20.5 | 38.3 |

| hiệu quảnet-v2-imagenet21k-b0 | 6.2M | 87.0% | 95.6% | 21.5 | 38.2 |

| Mobilenet-v3-large-100-224 | 4.6M | 84.9% | 95.4% | 27.4 | 28.8 |

| Mobilenet-v3-large-075-224 | 3.1M | 83.3% | 95.2% | 30.3 | 26.6 |

| Mobilenet-v2-100-192 | 2.6M | 80.8% | 93.5% | 33.5 | 23.9 |

| Mobilenet-v2-100-160 | 2.6M | 80.2% | 93.2% | 40.0 | 19.6 |

| Mobilenet-v2-075-160 | 1.7M | 78.2% | 92.8% | 41.8 | 19.3 |

| Mobilenet-v2-075-128 | 1.7M | 76.1% | 91.1% | 44.3 | 18.3 |

| Mobilenet-v1-075-160 | 2.0M | 75.7% | 91.0% | 44.5 | 18.2 |

| Mobilenet-v1-100-128 | 3.5M | 75.1% | 90.7% | 47.4 | 17.4 |

| Mobilenet-v1-075-128 | 2.0M | 73.2% | 90.0% | 48.9 | 16.8 |

| Mobilenet-v2-075-96 | 1.7M | 71.9% | 88.5% | 49.4 | 16.6 |

| Mobilenet-v2-035-96 | 0.7M | 63.7% | 83.1% | 50.4 | 16.3 |

| Mobilenet-v1-025-128 | 0.3M | 59.0% | 80.7% | 50.8 | 16.2 |

Bài đăng này cung cấp chi tiết về cách triển khai quy mô lớn Amazon SageMaker nhiệm vụ đo điểm chuẩn và lựa chọn mô hình. Đầu tiên, chúng tôi giới thiệu JumpStart và thuật toán phân loại hình ảnh TensorFlow tích hợp sẵn. Sau đó, chúng tôi thảo luận về các cân nhắc triển khai cấp cao, chẳng hạn như cấu hình siêu tham số JumpStart, trích xuất số liệu từ Nhật ký Amazon CloudWatchvà khởi chạy các công việc điều chỉnh siêu tham số không đồng bộ. Cuối cùng, chúng tôi đề cập đến môi trường triển khai và tham số hóa dẫn đến các giải pháp hiệu quả pareto trong bảng và hình trước.

Giới thiệu về phân loại hình ảnh JumpStart TensorFlow

JumpStart cung cấp khả năng tinh chỉnh chỉ bằng một cú nhấp chuột và triển khai nhiều mô hình được đào tạo trước trên các tác vụ ML phổ biến, cũng như tuyển chọn các giải pháp đầu cuối để giải quyết các vấn đề kinh doanh phổ biến. Các tính năng này loại bỏ công việc nặng nhọc khỏi từng bước của quy trình ML, giúp phát triển các mô hình chất lượng cao dễ dàng hơn và giảm thời gian triển khai. Các API JumpStart cho phép bạn triển khai theo chương trình và tinh chỉnh nhiều lựa chọn mô hình được đào tạo trước trên bộ dữ liệu của riêng bạn.

Trung tâm mô hình JumpStart cung cấp quyền truy cập vào một số lượng lớn Mô hình phân loại hình ảnh TensorFlow cho phép học chuyển giao và tinh chỉnh trên các bộ dữ liệu tùy chỉnh. Khi viết bài này, trung tâm mô hình JumpStart chứa 135 mô hình phân loại hình ảnh TensorFlow trên nhiều kiến trúc mô hình phổ biến từ Trung tâm TensorFlow, để bao gồm các mạng còn lại (ResNet), Mạng di động, E enoughNet, Inception, Mạng tìm kiếm kiến trúc thần kinh (NASNet), Chuyển nhượng lớn (Chút), cửa sổ đã dịch chuyển (đánh đu) máy biến áp, Class-Attention trong Image Transformers (CaiT) và Bộ chuyển đổi hình ảnh hiệu quả dữ liệu (DeiT).

Cấu trúc bên trong rất khác nhau bao gồm mỗi kiến trúc mô hình. Chẳng hạn, các mô hình ResNet sử dụng các kết nối bỏ qua để cho phép các mạng sâu hơn đáng kể, trong khi các mô hình dựa trên máy biến áp sử dụng các cơ chế tự chú ý để loại bỏ vị trí nội tại của các hoạt động tích chập để có lợi cho các trường tiếp nhận toàn cầu hơn. Ngoài các bộ tính năng đa dạng mà các cấu trúc khác nhau này cung cấp, mỗi kiến trúc mô hình có một số cấu hình điều chỉnh kích thước, hình dạng và độ phức tạp của mô hình trong kiến trúc đó. Điều này dẫn đến hàng trăm mô hình phân loại hình ảnh độc đáo có sẵn trên trung tâm mô hình JumpStart. Được kết hợp với các tập lệnh suy luận và học chuyển được tích hợp sẵn bao gồm nhiều tính năng của SageMaker, API JumpStart là điểm khởi đầu tuyệt vời để các học viên ML bắt đầu đào tạo và triển khai các mô hình một cách nhanh chóng.

Tham khảo Chuyển giao việc học cho các mô hình phân loại hình ảnh TensorFlow trong Amazon SageMaker và sau đây ví dụ máy tính xách tay để tìm hiểu sâu hơn về phân loại hình ảnh SageMaker TensorFlow, bao gồm cách chạy suy luận trên mô hình được đào tạo trước cũng như tinh chỉnh mô hình được đào tạo trước trên tập dữ liệu tùy chỉnh.

Cân nhắc lựa chọn mô hình quy mô lớn

Lựa chọn mô hình là quá trình lựa chọn mô hình tốt nhất từ một tập hợp các mô hình ứng viên. Quá trình này có thể được áp dụng trên các mô hình cùng loại với các trọng số tham số khác nhau và trên các mô hình thuộc các loại khác nhau. Các ví dụ về lựa chọn mô hình giữa các mô hình cùng loại bao gồm khớp cùng một mô hình với các siêu tham số khác nhau (ví dụ: tốc độ học tập) và dừng sớm để ngăn việc lắp quá nhiều trọng số mô hình vào tập dữ liệu đào tạo. Lựa chọn mô hình giữa các mô hình thuộc các loại khác nhau bao gồm chọn kiến trúc mô hình tốt nhất (ví dụ: Swin so với MobileNet) và chọn cấu hình mô hình tốt nhất trong một kiến trúc mô hình duy nhất (ví dụ: mobilenet-v1-025-128 vs. mobilenet-v3-large-100-224).

Các cân nhắc được nêu trong phần này cho phép tất cả các quy trình lựa chọn mô hình này trên tập dữ liệu xác thực.

Chọn cấu hình siêu tham số

Phân loại hình ảnh TensorFlow trong JumpStart có sẵn một số lượng lớn siêu tham số có thể điều chỉnh các hành vi tập lệnh học chuyển một cách thống nhất cho tất cả các kiến trúc mô hình. Các siêu tham số này liên quan đến tăng cường và tiền xử lý dữ liệu, đặc điểm kỹ thuật của trình tối ưu hóa, điều khiển trang bị quá mức và các chỉ báo lớp có thể đào tạo. Bạn được khuyến khích điều chỉnh các giá trị mặc định của các siêu tham số này khi cần thiết cho ứng dụng của mình:

Đối với phân tích này và sổ ghi chép được liên kết, tất cả các siêu tham số được đặt thành giá trị mặc định ngoại trừ tốc độ học tập, số lượng kỷ nguyên và thông số kỹ thuật dừng sớm. Tỷ lệ học tập được điều chỉnh như một tham số phân loại bởi SageMaker điều chỉnh mô hình tự động công việc. Bởi vì mỗi mô hình có các giá trị siêu tham số mặc định duy nhất, nên danh sách riêng biệt về tốc độ học có thể bao gồm tốc độ học mặc định cũng như 10/XNUMX tốc độ học mặc định. Điều này khởi chạy hai công việc đào tạo cho một công việc điều chỉnh siêu tham số và công việc đào tạo có hiệu suất được báo cáo tốt nhất trên tập dữ liệu xác thực được chọn. Do số lượng kỷ nguyên được đặt thành XNUMX, lớn hơn cài đặt siêu tham số mặc định nên công việc đào tạo tốt nhất được chọn không phải lúc nào cũng tương ứng với tốc độ học tập mặc định. Cuối cùng, một tiêu chí dừng sớm được sử dụng với sự kiên nhẫn, hoặc số lượng kỷ nguyên để tiếp tục đào tạo mà không cải thiện, trong ba kỷ nguyên.

Một cài đặt siêu tham số mặc định có tầm quan trọng đặc biệt là train_only_on_top_layer, ở đâu, nếu được đặt thành True, các lớp trích xuất tính năng của mô hình không được tinh chỉnh trên tập dữ liệu huấn luyện được cung cấp. Trình tối ưu hóa sẽ chỉ huấn luyện các tham số trong lớp phân loại được kết nối đầy đủ trên cùng với thứ nguyên đầu ra bằng với số lượng nhãn lớp trong tập dữ liệu. Theo mặc định, siêu tham số này được đặt thành True, đây là một cài đặt được nhắm mục tiêu để học chuyển giao trên các bộ dữ liệu nhỏ. Bạn có thể có tập dữ liệu tùy chỉnh trong đó việc trích xuất tính năng từ đào tạo trước trên tập dữ liệu ImageNet là không đủ. Trong những trường hợp này, bạn nên đặt train_only_on_top_layer đến False. Mặc dù cài đặt này sẽ tăng thời gian đào tạo, nhưng bạn sẽ trích xuất các tính năng có ý nghĩa hơn cho vấn đề bạn quan tâm, do đó tăng độ chính xác.

Trích xuất số liệu từ Nhật ký CloudWatch

Thuật toán phân loại hình ảnh TensorFlow của JumpStart ghi nhật ký một cách đáng tin cậy nhiều chỉ số khác nhau trong quá trình đào tạo mà SageMaker có thể truy cập được Estimator và các đối tượng HyperparameterTuner. Hàm tạo của SageMaker Estimator có một metric_definitions đối số từ khóa, có thể được sử dụng để đánh giá công việc đào tạo bằng cách cung cấp danh sách từ điển có hai khóa: Tên cho tên của chỉ số và Regex cho biểu thức chính quy được sử dụng để trích xuất số liệu từ nhật ký. Các đính kèm máy tính xách tay hiển thị các chi tiết thực hiện. Bảng sau đây liệt kê các số liệu có sẵn và các biểu thức chính quy được liên kết cho tất cả các mô hình phân loại hình ảnh JumpStart TensorFlow.

| Tên chỉ số | Regular Expression |

| số lượng thông số | “- Số tham số: ([0-9\.]+)” |

| số tham số có thể huấn luyện | “- Số tham số có thể huấn luyện: ([0-9\.]+)” |

| số lượng tham số không thể đào tạo | “- Số tham số không thể huấn luyện: ([0-9\.]+)” |

| đào tạo số liệu tập dữ liệu | f”- {số liệu}: ([0-9\.]+)” |

| chỉ số tập dữ liệu xác thực | f”- val_{metric}: ([0-9\.]+)” |

| chỉ số tập dữ liệu thử nghiệm | f”- Kiểm tra {số liệu}: ([0-9\.]+)” |

| thời gian đào tạo | “- Tổng thời lượng đào tạo: ([0-9\.]+)” |

| thời gian đào tạo mỗi kỷ nguyên | “- Thời lượng đào tạo trung bình mỗi kỷ nguyên: ([0-9\.]+)” |

| thử nghiệm đánh giá độ trễ | “- Độ trễ đánh giá thử nghiệm: ([0-9\.]+)” |

| độ trễ kiểm tra trên mỗi mẫu | “- Độ trễ kiểm tra trung bình trên mỗi mẫu: ([0-9\.]+)” |

| kiểm tra thông lượng | “- Thông lượng kiểm tra trung bình: ([0-9\.]+)” |

Tập lệnh học chuyển giao được tích hợp sẵn cung cấp nhiều chỉ số tập dữ liệu đào tạo, xác thực và kiểm tra trong các định nghĩa này, như được biểu thị bằng các giá trị thay thế chuỗi f. Các số liệu chính xác có sẵn khác nhau dựa trên loại phân loại đang được thực hiện. Tất cả các mô hình được biên dịch đều có một loss số liệu, được biểu thị bằng tổn thất entropy chéo cho vấn đề phân loại nhị phân hoặc phân loại. Cái trước được sử dụng khi có một nhãn lớp; cái sau được sử dụng nếu có hai hoặc nhiều nhãn lớp. Nếu chỉ có một nhãn lớp duy nhất, thì các chỉ số sau đây được tính toán, ghi nhật ký và có thể trích xuất thông qua các biểu thức chính quy chuỗi f trong bảng trước: số lượng dương thực (true_pos), số lượng dương tính giả (false_pos), số trường hợp âm tính thực sự (true_neg), số lượng âm tính giả (false_neg), precision, recall, diện tích dưới đường cong đặc tính hoạt động của máy thu (ROC) (auc) và diện tích dưới đường cong thu hồi độ chính xác (PR) (prc). Tương tự, nếu có từ sáu nhãn lớp trở lên, số liệu về độ chính xác của top 5 (top_5_accuracy) cũng được tính toán, ghi nhật ký và có thể trích xuất thông qua các biểu thức chính quy trước đó.

Trong quá trình đào tạo, các chỉ số được chỉ định cho một SageMaker Estimator được phát ra Nhật ký CloudWatch. Khi quá trình đào tạo hoàn tất, bạn có thể gọi SageMaker Mô tảTrainingJob API và kiểm tra FinalMetricDataList key trong phản hồi JSON:

API này chỉ yêu cầu cung cấp tên công việc cho truy vấn, vì vậy, sau khi hoàn thành, bạn có thể thu được các số liệu trong các phân tích trong tương lai miễn là tên công việc đào tạo được ghi lại và có thể phục hồi một cách thích hợp. Đối với tác vụ lựa chọn mô hình này, tên công việc điều chỉnh siêu tham số được lưu trữ và các phân tích tiếp theo sẽ gắn lại một HyperparameterTuner đối tượng được cung cấp tên công việc điều chỉnh, trích xuất tên công việc đào tạo tốt nhất từ bộ điều chỉnh siêu tham số được đính kèm, sau đó gọi lệnh DescribeTrainingJob API như được mô tả trước đó để có được số liệu liên quan đến công việc đào tạo tốt nhất.

Khởi chạy các công việc điều chỉnh siêu tham số không đồng bộ

Tham khảo tương ứng máy tính xách tay để biết chi tiết triển khai về khởi chạy không đồng bộ các công việc điều chỉnh siêu tham số, sử dụng thư viện chuẩn của Python tương lai đồng thời mô-đun, giao diện cấp cao cho các cuộc gọi có thể chạy không đồng bộ. Một số cân nhắc liên quan đến SageMaker được triển khai trong giải pháp này:

- Mỗi tài khoản AWS được liên kết với Hạn ngạch dịch vụ SageMaker. Bạn nên xem giới hạn hiện tại của mình để tận dụng tối đa tài nguyên của mình và có khả năng yêu cầu tăng giới hạn tài nguyên khi cần.

- Các lệnh gọi API thường xuyên để tạo nhiều tác vụ điều chỉnh siêu tham số đồng thời có thể vượt quá tốc độ SDK Python và đưa ra các ngoại lệ điều tiết. Giải pháp cho vấn đề này là tạo ứng dụng khách SageMaker Boto3 với cấu hình thử lại tùy chỉnh.

- Điều gì xảy ra nếu tập lệnh của bạn gặp lỗi hoặc tập lệnh bị dừng trước khi hoàn thành? Đối với một nghiên cứu điểm chuẩn hoặc lựa chọn mô hình lớn như vậy, bạn có thể ghi tên công việc điều chỉnh và cung cấp các chức năng tiện lợi để gắn lại công việc điều chỉnh siêu tham số đã tồn tại:

Phân tích chi tiết và thảo luận

Phân tích trong bài đăng này thực hiện học chuyển giao cho ID mô hình trong thuật toán phân loại hình ảnh JumpStart TensorFlow trên bộ dữ liệu Caltech-256. Tất cả các công việc đào tạo đã được thực hiện trên phiên bản đào tạo SageMaker ml.g4dn.xlarge, phiên bản này chứa một GPU NVIDIA T4 duy nhất.

Tập dữ liệu thử nghiệm được đánh giá trên phiên bản đào tạo khi kết thúc đào tạo. Lựa chọn mô hình được thực hiện trước khi đánh giá tập dữ liệu thử nghiệm để đặt trọng số mô hình cho kỷ nguyên có hiệu suất tập hợp xác thực tốt nhất. Thông lượng thử nghiệm không được tối ưu hóa: kích thước lô tập dữ liệu được đặt thành kích thước lô siêu tham số đào tạo mặc định, kích thước này không được điều chỉnh để tối đa hóa mức sử dụng bộ nhớ GPU; thông lượng kiểm tra được báo cáo bao gồm thời gian tải dữ liệu vì tập dữ liệu không được lưu trước trong bộ nhớ cache; và suy luận phân tán trên nhiều GPU không được sử dụng. Vì những lý do này, thông lượng này là một phép đo tương đối tốt, nhưng thông lượng thực tế sẽ phụ thuộc nhiều vào cấu hình triển khai điểm cuối suy luận của bạn cho mô hình được đào tạo.

Mặc dù trung tâm mô hình JumpStart chứa nhiều loại kiến trúc phân loại hình ảnh, ranh giới pareto này bị chi phối bởi các mô hình Swin, EfficientNet và MobileNet được chọn. Các mô hình Swin lớn hơn và tương đối chính xác hơn, trong khi các mô hình MobileNet nhỏ hơn, tương đối kém chính xác hơn và phù hợp với các hạn chế về tài nguyên của thiết bị di động. Điều quan trọng cần lưu ý là ranh giới này phụ thuộc vào nhiều yếu tố, bao gồm tập dữ liệu chính xác được sử dụng và siêu đường kính tinh chỉnh được chọn. Bạn có thể thấy rằng tập dữ liệu tùy chỉnh của mình tạo ra một tập hợp các giải pháp pareto hiệu quả khác và bạn có thể muốn thời gian đào tạo lâu hơn với các siêu đường kính khác nhau, chẳng hạn như tăng thêm dữ liệu hoặc tinh chỉnh nhiều thứ hơn là chỉ lớp phân loại trên cùng của mô hình.

Kết luận

Trong bài đăng này, chúng tôi đã trình bày cách chạy các tác vụ đo điểm chuẩn hoặc lựa chọn mô hình quy mô lớn bằng cách sử dụng trung tâm mô hình JumpStart. Giải pháp này có thể giúp bạn chọn mô hình tốt nhất cho nhu cầu của bạn. Chúng tôi khuyến khích bạn thử và khám phá điều này giải pháp trên tập dữ liệu của riêng bạn.

dự án

Thông tin thêm có sẵn tại các nguồn sau:

Giới thiệu về tác giả

Tiến sĩ Kyle Ulrich là một nhà khoa học ứng dụng với Các thuật toán tích hợp sẵn của Amazon SageMaker đội. Lĩnh vực nghiên cứu của ông bao gồm các thuật toán học máy có thể mở rộng, thị giác máy tính, chuỗi thời gian, phi tham số Bayesian và quy trình Gaussian. Tiến sĩ của anh ấy đến từ Đại học Duke và anh ấy đã xuất bản các bài báo trên NeurIPS, Cell và Neuron.

Tiến sĩ Kyle Ulrich là một nhà khoa học ứng dụng với Các thuật toán tích hợp sẵn của Amazon SageMaker đội. Lĩnh vực nghiên cứu của ông bao gồm các thuật toán học máy có thể mở rộng, thị giác máy tính, chuỗi thời gian, phi tham số Bayesian và quy trình Gaussian. Tiến sĩ của anh ấy đến từ Đại học Duke và anh ấy đã xuất bản các bài báo trên NeurIPS, Cell và Neuron.

Tiến sĩ Ashish Khetan là một nhà khoa học ứng dụng cao cấp với Các thuật toán tích hợp sẵn của Amazon SageMaker và giúp phát triển các thuật toán học máy. Ông lấy bằng Tiến sĩ tại Đại học Illinois Urbana Champaign. Ông là một nhà nghiên cứu tích cực về học máy và suy luận thống kê và đã xuất bản nhiều bài báo trong các hội nghị NeurIPS, ICML, ICLR, JMLR, ACL và EMNLP.

Tiến sĩ Ashish Khetan là một nhà khoa học ứng dụng cao cấp với Các thuật toán tích hợp sẵn của Amazon SageMaker và giúp phát triển các thuật toán học máy. Ông lấy bằng Tiến sĩ tại Đại học Illinois Urbana Champaign. Ông là một nhà nghiên cứu tích cực về học máy và suy luận thống kê và đã xuất bản nhiều bài báo trong các hội nghị NeurIPS, ICML, ICLR, JMLR, ACL và EMNLP.

- Phân phối nội dung và PR được hỗ trợ bởi SEO. Được khuếch đại ngay hôm nay.

- Platoblockchain. Web3 Metaverse Intelligence. Khuếch đại kiến thức. Truy cập Tại đây.

- nguồn: https://aws.amazon.com/blogs/machine-learning/image-classification-model-selection-using-amazon-sagemaker-jumpstart/

- 10

- 100

- 7

- 9

- a

- Giới thiệu

- truy cập

- có thể truy cập

- Tài khoản

- chính xác

- chính xác

- Đạt được

- ngang qua

- hoạt động

- Ngoài ra

- địa chỉ

- địa chỉ

- Điều chỉnh

- Liên kết

- chống lại

- thuật toán

- thuật toán

- Tất cả

- Đã

- Mặc dù

- luôn luôn

- đàn bà gan dạ

- Amazon SageMaker

- Khởi động Amazon SageMaker

- phân tích

- phân tích

- và

- Một

- api

- Các Ứng Dụng

- áp dụng

- thích hợp

- kiến trúc

- KHU VỰC

- đối số

- liên kết

- đính kèm

- Nỗ lực

- Tự động

- có sẵn

- Trung bình cộng

- AWS

- dựa

- Bayesian

- bởi vì

- trước

- được

- điểm chuẩn

- BEST

- lớn

- được xây dựng trong

- kinh doanh

- Cuộc gọi

- ứng cử viên

- trường hợp

- đố

- thách thức

- đặc trưng

- Chọn

- tốt nghiệp lớp XNUMX

- phân loại

- Phân loại

- khách hàng

- kết hợp

- Chung

- sự so sánh

- hoàn thành

- Hoàn thành

- hoàn thành

- phức tạp

- máy tính

- Tầm nhìn máy tính

- Mối quan tâm

- hội nghị

- Cấu hình

- kết nối

- Kết nối

- sự cân nhắc

- khó khăn

- chứa

- tiếp tục

- kiểm soát

- điều khiển

- thuận tiện

- Tương ứng

- che

- tạo

- Current

- đường cong

- khách hàng

- dữ liệu

- bộ dữ liệu

- sâu sắc hơn

- Mặc định

- phụ thuộc

- triển khai

- triển khai

- triển khai

- chiều sâu

- mô tả

- Mô tả

- chi tiết

- phát triển

- Thiết bị (Devices)

- khác nhau

- thảo luận

- phân phối

- khác nhau

- Không

- Duke

- đại học công tước

- suốt trong

- mỗi

- Sớm hơn

- Đầu

- dễ dàng hơn

- hiệu quả

- hay

- loại bỏ

- cho phép

- khuyến khích

- khuyến khích

- Cuối cùng đến cuối

- Điểm cuối

- Môi trường

- kỷ nguyên

- kỷ nguyên

- lôi

- đánh giá

- đánh giá

- đánh giá

- ví dụ

- ví dụ

- Trừ

- khám phá

- Khám phá

- biểu thức

- trích xuất

- các yếu tố

- công bằng

- ủng hộ

- Đặc tính

- Tính năng

- Lĩnh vực

- Hình

- Cuối cùng

- Tìm kiếm

- Tên

- vừa vặn

- tiếp theo

- Cựu

- từ

- Frontier

- Biên giới

- đầy đủ

- chức năng

- tương lai

- Futures

- tạo ra

- được

- được

- Toàn cầu

- tốt

- GPU

- GPU

- tuyệt vời

- lớn hơn

- màu xanh lá

- xảy ra

- nặng nề

- giúp đỡ

- giúp

- cấp độ cao

- chất lượng cao

- cao hơn

- Độ đáng tin của

- Hướng dẫn

- HTML

- HTTPS

- Hub

- Hàng trăm

- Điều chỉnh siêu tham số

- Illinois

- hình ảnh

- Phân loại hình ảnh

- hình ảnh

- thực hiện

- thực hiện

- thực hiện

- tầm quan trọng

- quan trọng

- cải thiện

- cải thiện

- in

- bao gồm

- bao gồm

- Bao gồm

- Tăng lên

- Tăng

- tăng

- Các chỉ số

- thông tin

- đầu vào

- ví dụ

- quan tâm

- lợi ích

- Giao thức

- nội bộ

- nội tại

- giới thiệu

- IT

- Việc làm

- việc làm

- json

- Key

- phím

- nhãn

- Nhãn

- lớn

- quy mô lớn

- lớn hơn

- Độ trễ

- ra mắt

- ra mắt

- lớp

- lớp

- hàng đầu

- LEARN

- học tập

- nâng

- ánh sáng

- LIMIT

- giới hạn

- Danh sách

- Chức năng

- tải

- dài

- còn

- sự mất

- máy

- học máy

- Làm

- nhiều

- Tối đa hóa

- có ý nghĩa

- đo

- Bộ nhớ

- số liệu

- Metrics

- ML

- di động

- thiết bị di động

- kiểu mẫu

- mô hình

- Mô-đun

- chi tiết

- nhiều

- tên

- tên

- cần thiết

- nhu cầu

- mạng

- Mới

- máy tính xách tay

- con số

- Nvidia

- vật

- đối tượng

- tuân theo

- được

- thu được

- ONE

- hoạt động

- Hoạt động

- tối ưu hóa

- nêu

- riêng

- giấy tờ

- tham số

- thông số

- riêng

- Kiên nhẫn

- Thực hiện

- hiệu suất

- thực hiện

- plato

- Thông tin dữ liệu Plato

- PlatoDữ liệu

- Điểm

- điểm

- Phổ biến

- có thể

- Bài đăng

- có khả năng

- pr

- ngăn chặn

- Trước khi

- Vấn đề

- vấn đề

- quá trình

- Quy trình

- cho

- cung cấp

- cung cấp

- cung cấp

- công bố

- Python

- câu hỏi

- Câu hỏi

- Mau

- RAM

- Tỷ lệ

- Giá

- thế giới thực

- lý do

- giảm

- đều đặn

- tương đối

- tẩy

- Báo cáo

- đại diện

- đại diện

- đại diện cho

- yêu cầu

- cần phải

- Yêu cầu

- đòi hỏi

- nghiên cứu

- nhà nghiên cứu

- Độ phân giải

- tài nguyên

- Thông tin

- phản ứng

- Kết quả

- chạy

- chạy

- nhà làm hiền triết

- tương tự

- khả năng mở rộng

- Nhà khoa học

- kịch bản

- sdk

- Tìm kiếm

- Phần

- chọn

- lựa chọn

- lựa chọn

- cao cấp

- Loạt Sách

- dịch vụ

- Phiên

- định

- bộ

- thiết lập

- một số

- Hình dạng

- nên

- Chương trình

- Tương tự

- đơn giản hóa

- duy nhất

- Six

- Kích thước máy

- kích thước

- nhỏ

- nhỏ hơn

- So

- giải pháp

- Giải pháp

- động SOLVE

- đặc điểm kỹ thuật

- thông số kỹ thuật

- quy định

- Tiêu chuẩn

- bắt đầu

- thống kê

- Bước

- dừng lại

- dừng lại

- lưu trữ

- Học tập

- tiếp theo

- như vậy

- đủ

- phù hợp

- bàn

- nhắm mục tiêu

- Nhiệm vụ

- nhiệm vụ

- nhóm

- tensorflow

- thử nghiệm

- Sản phẩm

- cung cấp their dịch

- bằng cách ấy

- số ba

- thông lượng

- thời gian

- Chuỗi thời gian

- thời gian

- đến

- bây giờ

- bên nhau

- công cụ

- hàng đầu

- top 5

- Tổng số:

- Train

- đào tạo

- Hội thảo

- chuyển

- máy biến áp

- đúng

- loại

- Cuối cùng

- Dưới

- độc đáo

- trường đại học

- Sử dụng

- sử dụng

- sử dụng

- tận dụng

- xác nhận

- Các giá trị

- nhiều

- Lớn

- thông qua

- Xem

- tầm nhìn

- cái nào

- trong khi

- toàn bộ

- rộng

- sẽ

- ở trong

- không có

- sẽ

- viết

- Bạn

- trên màn hình

- zephyrnet