Các thuật toán trí tuệ nhân tạo được thiết kế để học phù hợp và bắt đầu. Thay vì liên tục cập nhật cơ sở tri thức của chúng với thông tin mới theo thời gian như con người, các thuật toán chỉ có thể học trong giai đoạn đào tạo. Sau đó, kiến thức của họ vẫn bị đóng băng; họ thực hiện nhiệm vụ mà họ đã được đào tạo mà không thể tiếp tục học hỏi khi họ làm việc đó. Để học dù chỉ một điều mới, các thuật toán phải được đào tạo lại từ đầu. Cứ như thể mỗi lần bạn gặp một người mới, cách duy nhất để bạn có thể biết được tên của cô ấy là khởi động lại bộ não của bạn.

Đào tạo từ đầu có thể dẫn đến một hành vi được gọi là sự lãng quên thảm khốc, trong đó một cỗ máy kết hợp kiến thức mới với cái giá phải trả là quên gần như mọi thứ nó đã học. Tình huống này phát sinh do cách mà các thuật toán AI mạnh nhất hiện nay, được gọi là mạng lưới thần kinh, học những điều mới.

Các thuật toán này dựa trên bộ não của chúng ta một cách lỏng lẻo, nơi việc học tập liên quan đến việc thay đổi cường độ kết nối giữa các nơ-ron. Nhưng quá trình này trở nên phức tạp. Các kết nối thần kinh cũng đại diện cho kiến thức trong quá khứ, vì vậy việc thay đổi chúng quá nhiều sẽ gây ra sự lãng quên.

Mạng thần kinh sinh học đã phát triển các chiến lược qua hàng trăm triệu năm để đảm bảo rằng thông tin quan trọng vẫn ổn định. Nhưng các mạng thần kinh nhân tạo ngày nay phải vật lộn để đạt được sự cân bằng tốt giữa kiến thức mới và kiến thức cũ. Các kết nối của chúng quá dễ bị ghi đè khi mạng nhìn thấy dữ liệu mới, điều này có thể dẫn đến lỗi đột ngột và nghiêm trọng trong việc nhận dạng thông tin trước đây.

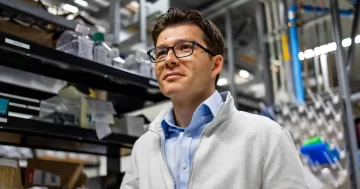

Để giúp chống lại điều này, Christopher Kanan, một nhà khoa học máy tính 41 tuổi tại Đại học Rochester, đã giúp thiết lập một lĩnh vực nghiên cứu AI mới được gọi là học tập liên tục. Mục tiêu của anh ấy là để AI tiếp tục học những điều mới từ các luồng dữ liệu liên tục và làm như vậy mà không quên mọi thứ trước đó.

Kanan đã chơi đùa với trí thông minh máy móc gần như cả cuộc đời mình. Khi còn là một đứa trẻ ở vùng nông thôn Oklahoma, người chỉ muốn vui vẻ với máy móc, anh ấy đã dạy các bot chơi các trò chơi máy tính nhiều người chơi thời kỳ đầu. Điều đó khiến anh băn khoăn về khả năng của trí thông minh nhân tạo nói chung - một cỗ máy có khả năng suy nghĩ giống con người về mọi mặt. Điều này khiến anh ấy quan tâm đến cách thức hoạt động của trí óc, và anh ấy đã theo học chuyên ngành triết học và khoa học máy tính tại Đại học bang Oklahoma trước khi học cao học đưa anh ấy đến Đại học California, San Diego.

Giờ đây, Kanan tìm thấy nguồn cảm hứng không chỉ trong các trò chơi điện tử mà còn khi xem cô con gái gần 2 tuổi của mình tìm hiểu về thế giới, với mỗi trải nghiệm học tập mới được xây dựng từ trải nghiệm cuối cùng. Vì công việc của anh ấy và những người khác, sự lãng quên thảm khốc không còn là thảm họa nữa.

Quanta đã nói chuyện với Kanan về bộ nhớ máy, phá vỡ các quy tắc đào tạo mạng thần kinh và liệu AI có bao giờ đạt được trình độ học tập của con người hay không. Cuộc phỏng vấn đã được cô đọng và chỉnh sửa cho rõ ràng.

Quá trình đào tạo triết học của bạn tác động như thế nào đến cách bạn suy nghĩ về công việc của mình?

Nó đã phục vụ tôi rất tốt với tư cách là một học giả. Triết học dạy bạn, “Làm thế nào để bạn lập luận hợp lý,” và “Làm thế nào để bạn phân tích lập luận của người khác?” Đó là rất nhiều những gì bạn làm trong khoa học. Tôi vẫn còn những bài luận từ hồi đó về những thất bại trong bài kiểm tra Turing, và những thứ tương tự. Và vì vậy những điều đó tôi vẫn nghĩ về rất nhiều.

Phòng thí nghiệm của tôi đã được truyền cảm hứng bằng cách đặt câu hỏi: Chà, nếu chúng ta không thể làm X, thì làm sao chúng ta có thể làm Y? Chúng ta học theo thời gian, nhưng nói chung mạng lưới thần kinh thì không. Bạn đào tạo họ một lần. Nó là một thực thể cố định sau đó. Và đó là điều cơ bản mà bạn phải giải quyết nếu một ngày nào đó bạn muốn tạo ra trí thông minh nhân tạo nói chung. Nếu nó không thể học mà không xáo trộn bộ não và bắt đầu lại từ đầu, thì bạn sẽ không thực sự đạt được điều đó, phải không? Đó là khả năng tiên quyết đối với tôi.

Cho đến nay, các nhà nghiên cứu đã đối phó với sự lãng quên thảm khốc như thế nào?

Phương pháp thành công nhất, được gọi là phát lại, lưu trữ các trải nghiệm trong quá khứ và sau đó phát lại chúng trong quá trình đào tạo với các ví dụ mới để chúng không bị mất. Nó lấy cảm hứng từ việc củng cố trí nhớ trong não của chúng ta, nơi mà trong khi ngủ, các mã hóa cấp cao của các hoạt động trong ngày được “phát lại” khi các tế bào thần kinh kích hoạt lại.

Nói cách khác, đối với các thuật toán, quá trình học mới không thể xóa bỏ hoàn toàn quá trình học trong quá khứ vì chúng ta đang trộn lẫn các trải nghiệm đã lưu trữ trong quá khứ.

Có ba phong cách để làm điều này. Phong cách phổ biến nhất là “phát lại xác thực”, trong đó các nhà nghiên cứu lưu trữ một tập hợp con các đầu vào thô — ví dụ: hình ảnh gốc cho tác vụ nhận dạng đối tượng — sau đó trộn các hình ảnh đã lưu trữ đó từ quá khứ với các hình ảnh mới để học. Cách tiếp cận thứ hai phát lại các biểu diễn nén của hình ảnh. Phương pháp thứ ba ít phổ biến hơn nhiều là “phát lại tổng quát”. Ở đây, một mạng thần kinh nhân tạo thực sự tạo ra một phiên bản tổng hợp của trải nghiệm trong quá khứ và sau đó trộn ví dụ tổng hợp đó với các ví dụ mới. Phòng thí nghiệm của tôi đã tập trung vào hai phương pháp sau.

Tuy nhiên, thật không may, phát lại không phải là một giải pháp rất thỏa mãn.

Tại sao không?

Để học một cái gì đó mới, mạng lưới thần kinh phải lưu trữ ít nhất một số thông tin về mọi khái niệm mà nó đã học được trong quá khứ. Và từ góc độ khoa học thần kinh, giả thuyết là bạn và tôi đã phát lại một trải nghiệm tương đối gần đây - không phải điều gì đó đã xảy ra trong thời thơ ấu của chúng ta - để tránh quên trải nghiệm gần đây đó. Trong khi theo cách chúng ta làm trong các mạng thần kinh sâu, điều đó không đúng. Nó không nhất thiết phải lưu trữ mọi thứ nó đã xem, nhưng nó phải lưu trữ một cái gì đó về mọi tác vụ mà nó đã học được trong quá khứ để sử dụng tính năng phát lại. Và không rõ những gì nó nên lưu trữ. Vì vậy, việc phát lại như đã hoàn thành ngày hôm nay có vẻ như vẫn chưa hoàn thành.

Nếu chúng ta có thể giải quyết triệt để tình trạng lãng quên thảm khốc, điều đó có nghĩa là AI có thể học những điều mới liên tục theo thời gian?

Không chính xác. Tôi nghĩ rằng những câu hỏi mở lớn, lớn, lớn trong lĩnh vực học tập liên tục không phải là sự lãng quên thảm khốc. Điều tôi thực sự quan tâm là: Làm thế nào để việc học trong quá khứ giúp việc học trong tương lai hiệu quả hơn? Và làm thế nào để học một cái gì đó trong tương lai sửa chữa những gì đã học trong quá khứ? Đó là những thứ mà không nhiều người đo lường được, và tôi nghĩ làm như vậy là một phần quan trọng trong việc thúc đẩy lĩnh vực này tiến lên bởi vì thực sự, đó không chỉ là việc quên đi mọi thứ. Đó là về việc trở thành một người học tốt hơn.

Đó là nơi mà tôi nghĩ rằng cánh đồng đang thiếu rừng cho cây cối. Phần lớn cộng đồng đang thiết lập vấn đề theo những cách không phù hợp với các câu hỏi sinh học thú vị hoặc các ứng dụng kỹ thuật thú vị. Chúng ta không thể để mọi người làm cùng một vấn đề về đồ chơi mãi được. Bạn phải nói: Nhiệm vụ găng tay của chúng ta là gì? Làm thế nào để chúng ta đẩy mọi thứ về phía trước?

Vậy thì bạn nghĩ tại sao hầu hết mọi người lại tập trung vào những vấn đề đơn giản đó?

Tôi chỉ có thể suy đoán. Hầu hết công việc được thực hiện bởi những sinh viên đang làm theo công việc trước đây. Họ đang sao chép thiết lập của những gì người khác đã làm và cho thấy một số cải thiện nhỏ về hiệu suất với cùng các phép đo. Việc tạo ra các thuật toán mới có nhiều khả năng dẫn đến một ấn phẩm hơn, ngay cả khi các thuật toán đó không thực sự giúp chúng ta đạt được tiến bộ đáng kể trong việc học liên tục. Điều làm tôi ngạc nhiên là cùng một loại công việc được tạo ra bởi các công ty lớn không có cùng động cơ khuyến khích, ngoại trừ công việc do thực tập sinh tạo ra.

Ngoài ra, công việc này là không cần thiết. Chúng ta cần thiết lập thử nghiệm và thiết lập thuật toán chính xác để đo lường xem việc học trong quá khứ có giúp ích cho việc học trong tương lai hay không. Vấn đề lớn là hiện tại chúng ta không có bộ dữ liệu tốt để nghiên cứu về học tập liên tục. Ý tôi là, về cơ bản, chúng tôi lấy các tập dữ liệu hiện có được sử dụng trong máy học truyền thống và tái sử dụng chúng.

Về cơ bản, trong giáo điều về máy học (hoặc ít nhất là bất cứ khi nào tôi bắt đầu dạy máy học), chúng tôi có một tập huấn luyện, chúng tôi có một tập kiểm tra - chúng tôi huấn luyện trên tập huấn luyện, chúng tôi kiểm tra trên tập kiểm tra. Học tập liên tục phá vỡ các quy tắc đó. Sau đó, bộ đào tạo của bạn trở thành thứ phát triển khi người học học. Nhưng chúng tôi vẫn bị giới hạn trong các tập dữ liệu hiện có. Chúng ta cần phải làm việc trên này. Chúng ta cần một môi trường học tập liên tục thực sự tốt, trong đó chúng ta có thể thực sự thúc đẩy bản thân.

Môi trường học tập liên tục lý tưởng sẽ như thế nào?

Nó dễ dàng hơn để cho bạn biết nó không phải là gì hơn nó là gì. Tôi đã tham gia một hội thảo nơi chúng tôi xác định đây là một vấn đề nghiêm trọng, nhưng đó không phải là vấn đề mà tôi nghĩ rằng bất kỳ ai cũng có ngay câu trả lời.

Tôi có thể cho bạn biết các thuộc tính mà nó có thể có. Vì vậy, hiện tại, hãy giả sử rằng các thuật toán AI không đại lý hiện thân trong các mô phỏng. Sau đó, ít nhất, lý tưởng nhất là chúng tôi đang học hỏi từ các video hoặc thứ gì đó tương tự, chẳng hạn như các luồng video đa phương thức và hy vọng sẽ làm được nhiều việc hơn là chỉ phân loại [các hình ảnh tĩnh].

Có rất nhiều câu hỏi mở về điều này. Cách đây vài năm, tôi đã tham gia một hội thảo về học tập liên tục và một số người giống như tôi đã nói: “Chúng ta phải ngừng sử dụng bộ dữ liệu có tên là MNIST, nó quá đơn giản.” Và rồi ai đó nói, “Được rồi, chúng ta hãy học dần về [trò chơi điện tử dựa trên chiến lược] StarCraft.” Và bây giờ tôi cũng đang làm điều đó vì nhiều lý do, nhưng tôi cũng không nghĩ rằng điều đó thực sự hiệu quả. Cuộc sống là một thứ phong phú hơn nhiều so với việc học chơi StarCraft.

Phòng thí nghiệm của bạn đã cố gắng thiết kế các thuật toán có thể tiếp tục học theo thời gian như thế nào?

Cùng với học trò cũ của tôi là Tyler Hayes, tôi đi tiên phong trong một nhiệm vụ học tập liên tục cho suy luận tương tự. Chúng tôi nghĩ rằng đó sẽ là một lĩnh vực tốt để nghiên cứu ý tưởng học tập chuyển giao, nơi bạn có được các kỹ năng và bây giờ cần sử dụng các kỹ năng phức tạp hơn để giải quyết các vấn đề phức tạp hơn. Cụ thể, chúng tôi đã đo lường sự chuyển giao ngược lại - việc học một điều gì đó trong quá khứ sẽ giúp ích cho bạn như thế nào trong tương lai và ngược lại. Và chúng tôi đã tìm thấy bằng chứng tốt cho việc chuyển đổi, quan trọng hơn nhiều so với một nhiệm vụ đơn giản như nhận dạng đối tượng.

Phòng thí nghiệm của bạn cũng tập trung vào đào tạo các thuật toán để học liên tục từ một ví dụ tại một thời điểm hoặc từ các tập hợp ví dụ rất nhỏ. Điều đó giúp ích như thế nào?

Rất nhiều cơ chế học tập liên tục vẫn sử dụng rất nhiều ví dụ. Vì vậy, về cơ bản, họ sẽ nói với thuật toán, “Đây là 100,000 thứ; học chúng. Đây là 100,000 thứ tiếp theo; học chúng." Điều đó không thực sự phù hợp với những gì tôi muốn nói là ứng dụng trong thế giới thực, đó là, “Đây là một điều mới; học nó. Đây là một điều mới; học nó."

Nếu chúng ta muốn AI học nhiều hơn như chúng ta, chúng ta có nên nhắm đến việc tái tạo cách con người học những thứ khác nhau ở các độ tuổi khác nhau, luôn trau dồi kiến thức của chúng ta không?

Tôi nghĩ đó là một con đường rất hiệu quả để đạt được tiến bộ trong lĩnh vực này. Mọi người nói với tôi rằng tôi chỉ bị ám ảnh bởi sự phát triển khi bây giờ tôi có một đứa con, nhưng tôi có thể thấy rằng con gái tôi có khả năng học một lần, nơi cô ấy thấy tôi làm điều gì đó một lần và cô ấy có thể bắt chước ngay lập tức. Và các thuật toán học máy ngày nay không thể làm bất cứ điều gì như vậy.

Nó thực sự đã mở rộng tầm mắt của tôi. Phải có nhiều thứ đang diễn ra trong đầu chúng ta hơn là trong các mạng thần kinh hiện đại của chúng ta. Đó là lý do tại sao tôi nghĩ rằng lĩnh vực này cần hướng tới ý tưởng học hỏi theo thời gian, nơi các thuật toán trở thành người học tốt hơn bằng cách xây dựng dựa trên kinh nghiệm trong quá khứ.

Bạn có nghĩ rằng AI sẽ thực sự học giống như con người không?

Tôi nghĩ họ sẽ làm được. Chắc chắn. Ngày nay nó hứa hẹn hơn rất nhiều vì có rất nhiều người làm việc trong lĩnh vực này. Nhưng chúng ta vẫn cần sáng tạo hơn nữa. Vì vậy, phần lớn văn hóa trong cộng đồng máy học là cách tiếp cận theo người dẫn đầu.

Tôi nghĩ chúng ta chỉ là những cỗ máy sinh hóa, và cuối cùng chúng ta sẽ tìm ra cách tạo ra các thuật toán của chúng ta cho những kiến trúc chính xác mà tôi nghĩ sẽ có nhiều khả năng của chúng ta hơn so với hiện nay. Đối với tôi, không có lý lẽ thuyết phục nào nói rằng điều đó là không thể.