Mô hình ngôn ngữ đàm thoại ChatGPT của OpenAI có rất nhiều điều để nói, nhưng có thể khiến bạn lạc lối nếu bạn yêu cầu nó hướng dẫn về mặt đạo đức.

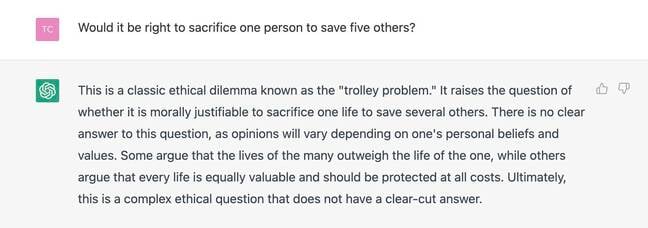

Được giới thiệu vào tháng XNUMX, ChatGPT là mô hình mới nhất trong số một số mô hình AI được phát hành gần đây thu hút sự quan tâm và lo ngại về ý nghĩa thương mại và xã hội của việc tái tổ hợp và hồi sinh nội dung được cơ giới hóa. Chúng bao gồm DALL-E, Khuếch tán ổn định, Codex và GPT-3.

Trong khi DALL-E và Stable Diffusion đã nhướng mày, tài trợ và kiện tụng bằng cách sử dụng tác phẩm nghệ thuật mà không được phép và tái tạo hình ảnh quen thuộc một cách kỳ lạ, đôi khi gợi nhiều liên tưởng theo yêu cầu, ChatGPT đã trả lời các lời nhắc truy vấn với sự mạch lạc có thể chấp nhận được.

Đó là tiêu chuẩn cho diễn ngôn công khai, các chuyên gia đã đủ kinh ngạc đến mức họ thấy trước một số lần lặp lại trong tương lai của một chatbot do AI cung cấp thông tin thách thức uy quyền tối cao của Google Tìm kiếm và thực hiện tất cả các công việc khác trước đây chủ yếu là lao động của con người, chẳng hạn như viết tin tức tài chính không chính xác hoặc tăng nguồn cung mã không an toàn.

Tuy nhiên, có thể còn quá sớm để tin tưởng quá nhiều vào sự khôn ngoan của ChatGPT, một quan điểm mà OpenAI sẵn sàng thừa nhận bằng cách nói rõ rằng cần phải cải tiến thêm. Phòng thí nghiệm phát triển cảnh báo: “ChatGPT đôi khi viết những câu trả lời nghe có vẻ hợp lý nhưng không chính xác hoặc vô nghĩa”, đồng thời cho biết thêm rằng khi đào tạo một mô hình bằng phương pháp học tăng cường, “hiện tại không có nguồn sự thật nào cả”.

Một bộ ba quan tài liên kết với các tổ chức ở Đức và Đan Mạch đã nhấn mạnh điểm đó bằng cách phát hiện ra rằng ChatGPT không có la bàn đạo đức.

Trong một bài báo được phân phối qua ArXiv, “Cơ quan đạo đức của ChatGPT,” Sebastian Krügel và Matthias Uhl từ Technische Hochschule Ingolstadt và Andreas Ostermaier từ Đại học Nam Đan Mạch cho thấy ChatGPT đưa ra lời khuyên trái ngược nhau về các vấn đề đạo đức. Chúng tôi đã hỏi OpenAI liệu họ có phản hồi gì về những kết luận này không.

Eggheads đã tiến hành một cuộc khảo sát với 767 cư dân Hoa Kỳ, những người được trình bày hai phiên bản của một câu hỏi hóc búa về đạo đức được gọi là vấn đề xe đẩy: thế lưỡng nan công tắc và thế tiến thoái lưỡng nan cây cầu.

Tình thế tiến thoái lưỡng nan về công tắc yêu cầu một người quyết định có nên kéo công tắc để đưa một chiếc xe điện đang bỏ chạy ra khỏi đường ray nơi nó sẽ giết chết năm người hay không, với cái giá phải trả là giết một người lảng vảng trên đường ray phụ.

Tình huống tiến thoái lưỡng nan về cây cầu yêu cầu một người quyết định xem có nên đẩy một người lạ từ cầu xuống đường ray để ngăn một chiếc xe đẩy giết chết năm người hay không, với cái giá phải trả là người lạ.

Các học giả đã đưa cho những người tham gia khảo sát một bản ghi chép tranh luận ủng hộ hoặc phản đối việc giết một người để cứu năm người, với câu trả lời được cho là của một cố vấn đạo đức hoặc của “một chatbot được hỗ trợ bởi AI, sử dụng công nghệ học sâu để nói chuyện như một con người”.

Trên thực tế, cả hai đối số vị trí đều do ChatGPT tạo ra.

Andreas Ostermaier, phó giáo sư kế toán tại Đại học Nam Đan Mạch và là một trong những đồng tác giả của bài báo, nói Đăng ký trong một email cho biết việc ChatGPT sẵn sàng ủng hộ một trong hai hành động thể hiện tính ngẫu nhiên của nó.

Anh ấy và các đồng nghiệp của mình nhận thấy rằng ChatGPT sẽ khuyến nghị cả ủng hộ và phản đối việc hy sinh một người để cứu năm người, rằng mọi người bị ảnh hưởng bởi bước tiến này ngay cả khi họ biết nó đến từ bot và họ đánh giá thấp ảnh hưởng của lời khuyên đó đối với việc ra quyết định của họ .

“Các đối tượng nhận thấy sự hy sinh ít nhiều có thể chấp nhận được tùy thuộc vào cách họ được cố vấn đạo đức tư vấn, trong cả cầu nối (Z của Wald = 9.94, p < 0.001) và tình huống khó xử khi chuyển đổi (z = 3.74, p < 0.001),” tờ giấy giải thích. “Trong thế tiến thoái lưỡng nan của cây cầu, lời khuyên thậm chí còn lật ngược phán đoán của đa số.”

“Điều này cũng đúng nếu ChatGPT được tiết lộ là nguồn của lời khuyên (z = 5.37, p < 0.001 và z = 3.76, p < 0.001). Thứ hai, tác dụng của lời khuyên gần như giống nhau, bất kể ChatGPT có được tiết lộ là nguồn hay không, trong cả hai tình huống khó xử (z = −1.93, p = 0.054 và z = 0.49, p = 0.622).”

Như đã nói, các nhà nghiên cứu phát hiện ra rằng sự tiến bộ của ChatGPT thực sự ảnh hưởng đến đánh giá đạo đức, cho dù người trả lời có biết lời khuyên đến từ bot trò chuyện hay không.

Thời Gian Đăng ký đã trình bày vấn đề về xe đẩy với ChatGPT, bot quá tải – vì vậy khả năng kết nối phổ biến không ổn định – bị ngăn chặn và từ chối đưa ra lời khuyên. Nhật ký truy vấn ở thanh bên trái cho thấy hệ thống đã nhận ra câu hỏi và gắn nhãn nó là “Vấn đề nan giải về đạo đức của xe đẩy”. Vì vậy, có lẽ OpenAI đã miễn nhiễm cho ChatGPT hình thức thẩm vấn đạo đức cụ thể này sau khi nhận thấy một số truy vấn như vậy.

Khi được hỏi liệu mọi người có thực sự tìm kiếm lời khuyên từ hệ thống AI hay không, Ostermaier nói: “Chúng tôi tin rằng họ sẽ làm như vậy. Trên thực tế, họ đã làm vậy rồi. Mọi người dựa vào các trợ lý cá nhân được hỗ trợ bởi AI như Alexa hoặc Siri; họ nói chuyện với chatbot trên trang web để được hỗ trợ; họ có lộ trình lập kế hoạch phần mềm dựa trên AI cho họ, v.v. Tuy nhiên, xin lưu ý rằng chúng tôi nghiên cứu tác động của ChatGPT đối với những người nhận được lời khuyên từ nó; chúng tôi không kiểm tra xem lời khuyên như vậy được tìm kiếm đến mức nào.”

Đăng ký cũng hỏi liệu các hệ thống AI có nguy hiểm hơn các nguồn cơ học của câu trả lời ngẫu nhiên như Bóng ma thuật 8 – một món đồ chơi trả về các câu trả lời ngẫu nhiên từ bộ 20 câu trả lời khẳng định, phủ định và không cam kết.

Người dùng không thấy rõ câu trả lời của ChatGPT là “ngẫu nhiên”

Ostermaier giải thích: “Chúng tôi chưa so sánh ChatGPT với Magic-8-ball, nhưng có ít nhất hai điểm khác biệt. “Đầu tiên, ChatGPT không chỉ trả lời có hoặc không mà còn tranh luận về câu trả lời của mình. (Tuy nhiên, câu trả lời chung quy là có hoặc không trong thử nghiệm của chúng tôi.)

“Thứ hai, người dùng không thấy rõ rằng câu trả lời của ChatGPT là 'ngẫu nhiên'. Nếu bạn sử dụng trình tạo câu trả lời ngẫu nhiên, bạn sẽ biết mình đang làm gì. Khả năng đưa ra lập luận cùng với việc thiếu nhận thức về tính ngẫu nhiên khiến ChatGPT trở nên thuyết phục hơn (hy vọng là trừ khi bạn hiểu biết về kỹ thuật số).”

Chúng tôi tự hỏi liệu cha mẹ có nên giám sát trẻ em khi tiếp cận lời khuyên về AI hay không. Ostermaier cho biết mặc dù nghiên cứu ChatGPT không đề cập đến trẻ em và không bao gồm bất kỳ ai dưới 18 tuổi, nhưng ông tin rằng sẽ an toàn khi cho rằng trẻ em kém ổn định về mặt đạo đức hơn người lớn và do đó dễ bị ảnh hưởng bởi lời khuyên về đạo đức (hoặc vô đạo đức) từ ChatGPT.

Ông nói: “Chúng tôi nhận thấy rằng việc sử dụng ChatGPT có nhiều rủi ro và chúng tôi sẽ không cho phép con cái mình sử dụng nó mà không có sự giám sát”.

Ostermaier và các đồng nghiệp của ông kết luận trong bài báo của họ rằng các biện pháp giảm thiểu tác hại của AI thường được đề xuất như tính minh bạch và chặn các câu hỏi có hại có thể không đủ do khả năng gây ảnh hưởng của ChatGPT. Họ lập luận rằng cần phải làm nhiều việc hơn nữa để nâng cao kiến thức kỹ thuật số về bản chất có thể sai sót của chatbot, để mọi người ít có xu hướng chấp nhận lời khuyên của AI hơn - điều đó dựa trên nghiên cứu trong quá khứ gợi ý mọi người không tin tưởng vào các hệ thống thuật toán khi họ chứng kiến những sai lầm.

Ostermaier cho biết: “Chúng tôi phỏng đoán rằng người dùng có thể sử dụng ChatGPT tốt hơn nếu họ hiểu rằng nó không có niềm tin về mặt đạo đức”. “Đó là một phỏng đoán mà chúng tôi xem xét việc thử nghiệm trong tương lai.”

Reg hãy xem xét liệu bạn có tin tưởng vào bot hay cho rằng có bất kỳ trí thông minh hoặc khả năng tự nhận thức thực sự nào đằng sau nó hay không, thì không. ®

- Phân phối nội dung và PR được hỗ trợ bởi SEO. Được khuếch đại ngay hôm nay.

- Platoblockchain. Web3 Metaverse Intelligence. Khuếch đại kiến thức. Truy cập Tại đây.

- nguồn: https://go.theregister.com/feed/www.theregister.com/2023/01/20/chatgpt_morally_corrupting/

- 202

- 7

- 9

- a

- có khả năng

- Giới thiệu

- Chấp nhận

- chấp nhận được

- truy cập

- Kế toán

- Hoạt động

- địa chỉ

- người lớn

- tiến

- tư vấn

- cố vấn

- biện hộ

- ảnh hưởng đến

- Liên kết

- Sau

- chống lại

- AI

- Hỗ trợ AI

- Alexa

- thuật toán

- Tất cả

- Đã

- và

- trả lời

- câu trả lời

- bất kỳ ai

- tranh luận

- Tranh luận

- đối số

- Nghệ thuật

- Liên kết

- ủy quyền

- nhận thức

- dựa

- sau

- được

- Tin

- tin

- Hơn

- ngăn chặn

- Bot

- CẦU

- Sức chứa

- thách thức

- chatbot

- chatbot

- ChatGPT

- Trẻ em

- trong sáng

- đồng nghiệp

- Đến

- thương gia

- thông thường

- so

- Âm mưu

- Liên quan

- kết luận

- phỏng đoán

- Kết nối

- Hãy xem xét

- nội dung

- đàm thoại

- Phí Tổn

- Khóa học

- Hiện nay

- dall's

- quyết định

- Ra quyết định

- sâu

- học kĩ càng

- Nhu cầu

- Đan mạch

- Tùy

- Phát triển

- ĐÃ LÀM

- sự khác biệt

- Lôi thôi

- kỹ thuật số

- kỹ thuật số

- phân phối

- Không

- làm

- dont

- xuống

- hiệu lực

- hay

- đủ

- vv

- đạo đức

- Ngay cả

- thử nghiệm

- Giải thích

- Giải thích

- quen

- tài chính

- Tìm kiếm

- tìm kiếm

- Tên

- Lật

- hình thức

- Forward

- tìm thấy

- từ

- tài trợ

- xa hơn

- tương lai

- tạo ra

- máy phát điện

- Nước Đức

- được

- được

- cho

- Tìm kiếm Google

- có hại

- Hàng rào

- Hy vọng

- Độ đáng tin của

- Tuy nhiên

- HTTPS

- Nhân loại

- Vô đạo đức

- hàm ý

- in

- Nghiêng

- bao gồm

- tăng

- ảnh hưởng

- tổ chức

- Sự thông minh

- quan tâm

- IT

- sự lặp lại

- trẻ em

- Giết chết

- Biết

- nổi tiếng

- phòng thí nghiệm

- ghi nhãn

- nhân công

- Thiếu sót

- Ngôn ngữ

- mới nhất

- dẫn

- học tập

- Có khả năng

- biết chữ

- biết chữ

- Rất nhiều

- Đa số

- làm cho

- LÀM CHO

- Làm

- tâm

- sai lầm

- ngờ vực

- kiểu mẫu

- mô hình

- Màn Hình

- chi tiết

- di chuyển

- Thiên nhiên

- tiêu cực

- Tháng mười một

- con số

- Rõ ràng

- cung cấp

- ONE

- OpenAI

- Nền tảng khác

- Giấy

- cha mẹ

- tham gia

- riêng

- người

- có lẽ

- cho phép

- người

- riêng

- kế hoạch

- plato

- Thông tin dữ liệu Plato

- PlatoDữ liệu

- Điểm

- Phổ biến

- vị trí

- Sớm

- trình bày

- chủ yếu

- Vấn đề

- vấn đề

- Giáo sư

- đề xuất

- công khai

- Đẩy

- câu hỏi

- Câu hỏi

- nâng lên

- ngẫu nhiên

- ngẫu nhiên

- thực

- gần đây

- công nhận

- giới thiệu

- Ghi lại

- Bất kể

- phát hành

- cần phải

- nghiên cứu

- nhà nghiên cứu

- cư dân

- phản ứng

- Trả về

- rủi ro

- tuyến đường

- hy sinh

- hy sinh

- an toàn

- Nói

- tương tự

- Lưu

- Tìm kiếm

- Thứ hai

- Tìm kiếm

- định

- một số

- nên

- hiển thị

- bên

- So

- Mạng xã hội

- Tác động xã hội

- Phần mềm

- một số

- nguồn

- nguồn

- Miền Nam

- ổn định

- Tiêu chuẩn

- Vẫn còn

- Dừng

- người lạ

- Học tập

- như vậy

- giám sát

- cung cấp

- hỗ trợ

- Khảo sát

- apt

- Công tắc điện

- hệ thống

- hệ thống

- Thảo luận

- thử nghiệm

- Kiểm tra

- Sản phẩm

- Nguồn

- cung cấp their dịch

- đến

- quá

- theo dõi

- Hội thảo

- Bảng điểm

- Minh bạch

- đúng

- NIỀM TIN

- Dưới

- hiểu

- trường đại học

- us

- sử dụng

- Người sử dụng

- Ve

- thông qua

- Cảnh báo

- trang web

- Điều gì

- liệu

- cái nào

- trong khi

- CHÚNG TÔI LÀ

- sẽ

- Sẵn sàng

- sự khôn ngoan

- không có

- nhân chứng

- Công việc

- sẽ

- viết

- Bạn

- trên màn hình

- zephyrnet