DeepMind đã làm điều đó một lần nữa.

Sau khi giải quyết một thách thức cơ bản trong sinh học—dự đoán cấu trúc proteinGiáo sư gỡ rối toán học của lý thuyết nút, nó hướng đến một quy trình tính toán cơ bản được nhúng bên trong hàng nghìn ứng dụng hàng ngày. Từ phân tích cú pháp hình ảnh đến mô hình thời tiết hoặc thậm chí thăm dò hoạt động bên trong của các mạng nơ-ron nhân tạo, về mặt lý thuyết, AI có thể tăng tốc độ tính toán trên nhiều lĩnh vực, tăng hiệu quả trong khi cắt giảm chi phí và sử dụng năng lượng.

Nhưng ấn tượng hơn là làm thế nào họ đã làm nó. Thuật toán phá kỷ lục, được gọi là AlphaTensor, là một phần phụ của alphazero, vốn nổi tiếng đã đánh bại những kỳ thủ của con người trong cờ vua và cờ vây.

"Các thuật toán đã được sử dụng khắp các nền văn minh trên thế giới để thực hiện các hoạt động cơ bản trong hàng nghìn năm" đã viết đồng tác giả Drs. Matej Balog và Alhussein Fawzi tại DeepMind. “Tuy nhiên, việc khám phá các thuật toán rất khó khăn.”

AlphaTensor mở ra một con đường dẫn đến một thế giới mới, nơi AI thiết kế các chương trình vượt trội hơn bất kỳ thứ gì con người thiết kế, đồng thời cải thiện “bộ não” máy của chính nó.

Tiến sĩ Federico Levi, biên tập viên cấp cao tại Thiên nhiên, Mà công bố nghiên cứu.

Nhập phép nhân ma trận

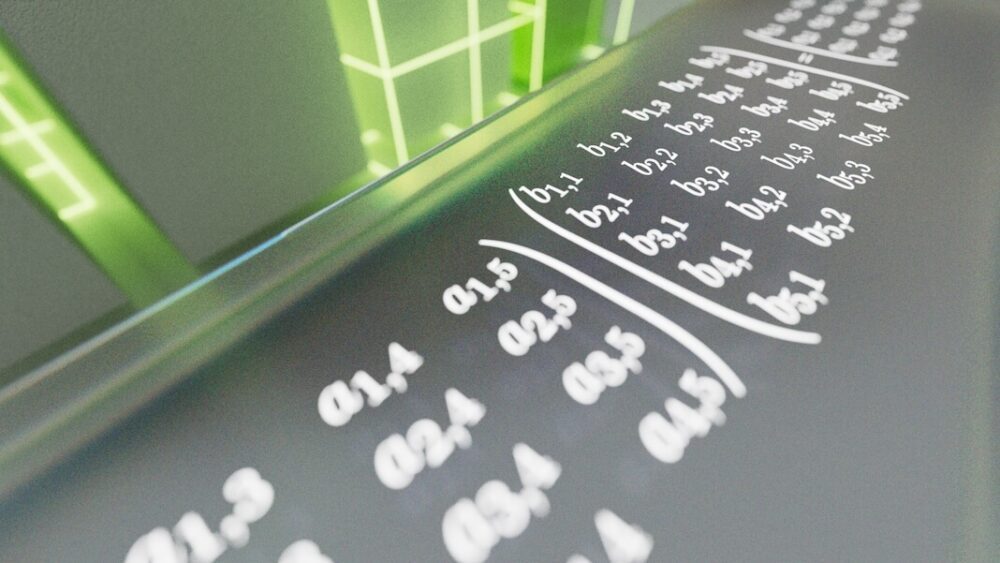

Vấn đề mà AlphaTensor phải đối mặt là phép nhân ma trận. Nếu bạn đột nhiên hình dung ra các hàng và cột số màu xanh lá cây cuộn xuống màn hình, bạn không đơn độc. Nói một cách đại khái, ma trận là loại như vậy — một mạng lưới các số đại diện cho dữ liệu do bạn chọn. Nó có thể là pixel trong hình ảnh, tần số của clip âm thanh hoặc giao diện và hành động của các nhân vật trong trò chơi điện tử.

Phép nhân ma trận nhận hai lưới số và nhân một với nhau. Đó là một phép tính thường được dạy ở trường trung học nhưng cũng rất quan trọng đối với các hệ thống máy tính. Ở đây, các hàng số trong một ma trận được nhân với các cột trong ma trận khác. Kết quả tạo ra một kết quả — ví dụ: lệnh phóng to hoặc nghiêng chế độ xem của bạn về một cảnh trò chơi điện tử. Mặc dù các phép tính này hoạt động ngầm, nhưng bất kỳ ai sử dụng điện thoại hoặc máy tính đều phụ thuộc vào kết quả của họ mỗi ngày.

Bạn có thể thấy vấn đề có thể trở nên cực kỳ khó khăn, cực kỳ nhanh chóng. Việc nhân các ma trận lớn tốn rất nhiều năng lượng và thời gian. Mỗi cặp số phải được nhân riêng lẻ để tạo ra một ma trận mới. Khi các ma trận phát triển, vấn đề nhanh chóng trở nên không thể giải quyết được — thậm chí còn hơn cả việc dự đoán nước cờ hay cờ vây tốt nhất. Một số chuyên gia ước tính có nhiều cách hơn để giải quyết phép nhân ma trận hơn số nguyên tử trong vũ trụ.

Trở lại năm 1969, Volker Strassen, một nhà toán học người Đức, đã chỉ ra có nhiều cách để cắt các góc, cắt một vòng của phép nhân ma trận hai nhân hai từ tổng cộng từ tám đến bảy. Nghe có vẻ không ấn tượng, nhưng phương pháp của Strassen cho thấy có thể đánh bại các tiêu chuẩn lâu nay của các phép toán — tức là các thuật toán — cho phép nhân ma trận. Cách tiếp cận của ông, thuật toán Strassen, đã trở thành cách tiếp cận hiệu quả nhất trong hơn 50 năm.

Nhưng điều gì sẽ xảy ra nếu có những phương pháp thậm chí còn hiệu quả hơn? “Không ai biết thuật toán tốt nhất để giải nó,” Tiến sĩ François Le Gall tại Đại học Nagoya ở Nhật Bản, người không tham gia vào công việc này, nói với MIT Technology Review. "Đó là một trong những vấn đề mở lớn nhất trong khoa học máy tính."

Thuật toán đuổi theo AI

Nếu trực giác của con người đang chùn bước, tại sao không khai thác một bộ óc máy móc?

Trong nghiên cứu mới, nhóm DeepMind đã biến phép nhân ma trận thành một trò chơi. Tương tự như người tiền nhiệm AlphaZero, AlphaTensor sử dụng phương pháp học tăng cường sâu, một phương pháp học máy được lấy cảm hứng từ cách bộ não sinh học học hỏi. Tại đây, một tác nhân AI (thường là một mạng nơ-ron nhân tạo) tương tác với môi trường của nó để giải quyết một vấn đề nhiều bước. Nếu thành công, nó sẽ kiếm được “phần thưởng” — nghĩa là, các thông số mạng của AI được cập nhật để có nhiều khả năng thành công trở lại trong tương lai.

Nó giống như học cách lật một cái bánh kếp. Ban đầu sẽ có rất nhiều vật rơi trên sàn, nhưng cuối cùng mạng lưới thần kinh của bạn sẽ học các chuyển động của cánh tay và bàn tay để có một cú lật hoàn hảo.

Sân tập cho AlphaTensor là một loại trò chơi hội đồng 3D. Về cơ bản nó là một câu đố một người chơi gần giống với Sudoku. AI phải nhân các lưới số trong vài bước nhỏ nhất có thể, đồng thời chọn từ vô số các bước di chuyển được phép — hơn một nghìn tỷ trong số đó.

Những bước di chuyển cho phép này đã được thiết kế tỉ mỉ vào AlphaTensor. Tại một cuộc họp báo, đồng tác giả, Tiến sĩ Hussain Fawzi giải thích: “Việc hình thành không gian khám phá thuật toán rất phức tạp… thậm chí còn khó hơn, làm thế nào chúng ta có thể điều hướng trong không gian này”.

Nói cách khác, khi đối mặt với một loạt các lựa chọn hoang mang, làm thế nào chúng ta có thể thu hẹp chúng để cải thiện cơ hội mò kim đáy bể? Và làm thế nào chúng ta có thể lập chiến lược tốt nhất để đi tới kim mà không cần đào bới toàn bộ đống cỏ khô?

Một thủ thuật mà nhóm đã kết hợp vào AlphaTensor là một phương pháp được gọi là tìm kiếm trên cây. Thay vì nói một cách ẩn dụ, ngẫu nhiên đào bới đống cỏ khô, ở đây AI thăm dò “những con đường” có thể dẫn đến kết quả tốt hơn. Các bài học trung gian sau đó giúp AI lên kế hoạch cho bước đi tiếp theo của nó để tăng cơ hội thành công. Nhóm nghiên cứu cũng đưa ra các mẫu thuật toán của các trò chơi thành công, như dạy một đứa trẻ các nước đi mở đầu của cờ vua. Cuối cùng, một khi AI phát hiện ra các bước di chuyển có giá trị, nhóm đã cho phép nó sắp xếp lại các hoạt động đó để học tập phù hợp hơn nhằm tìm kiếm một kết quả tốt hơn.

Đột phá mặt bằng mới

AlphaTensor đã chơi tốt. Trong một loạt các thử nghiệm, nhóm đã thách thức AI để tìm ra các giải pháp hiệu quả nhất cho các ma trận lên đến năm phần năm — nghĩa là với năm số ở mỗi hàng hoặc cột.

Thuật toán nhanh chóng phát hiện lại vụ hack ban đầu của Strassen, nhưng sau đó đã vượt qua tất cả các giải pháp do trí óc con người nghĩ ra trước đó. Thử nghiệm AI với các kích thước ma trận khác nhau, AlphaTensor đã tìm ra các giải pháp hiệu quả hơn cho hơn 70. “Trên thực tế, AlphaTensor thường phát hiện ra hàng nghìn thuật toán cho mỗi kích thước của ma trận,” nhóm nghiên cứu cho biết. "Đó là tâm trí của boggling."

Trong một trường hợp, nhân ma trận 80 nhân 76 với 919 nhân một, AI đã cắt kỷ lục trước đó của 896 phép nhân riêng lẻ xuống chỉ còn XNUMX. Nó cũng chiếu sáng trên các ma trận lớn hơn, giảm số lượng phép tính cần thiết cho hai ma trận XNUMX x XNUMX từ XNUMX đến XNUMX.

Trong tay bằng chứng về khái niệm, nhóm nghiên cứu đã chuyển sang sử dụng thực tế. Các chip máy tính thường được thiết kế để tối ưu hóa các tính toán khác nhau — ví dụ: GPU cho đồ họa, hoặc Chip AI cho máy học—Và kết hợp thuật toán với phần cứng phù hợp nhất sẽ tăng hiệu quả.

Tại đây, nhóm đã sử dụng AlphaTensor để tìm ra thuật toán cho hai loại chip phổ biến trong máy học: GPU NVIDIA V100 và Google TPU. Nhìn chung, các thuật toán do AI phát triển đã tăng tốc độ tính toán lên tới 20%.

Thật khó để nói liệu AI cũng có thể tăng tốc điện thoại thông minh, máy tính xách tay hoặc các thiết bị hàng ngày khác hay không. Tuy nhiên, “sự phát triển này sẽ rất thú vị nếu nó có thể được sử dụng trong thực tế,” Tiến sĩ Virginia Williams của MIT cho biết. “Việc tăng hiệu suất sẽ cải thiện rất nhiều ứng dụng.”

Trí tuệ của một AI

Mặc dù AlphaTensor đang phá vỡ kỷ lục mới nhất của con người về phép nhân ma trận, nhóm DeepMind vẫn chưa thể giải thích lý do tại sao.

Nhà khoa học và đồng tác giả của DeepMind, Tiến sĩ Pushmeet Kohli cho biết tại một cuộc họp báo.

Các thuật toán phát triển cũng không nhất thiết phải là con người so với máy móc.

Trong khi AlphaTensor là một bước đệm để hướng tới các thuật toán nhanh hơn, thậm chí những thuật toán nhanh hơn cũng có thể tồn tại. Balog và Fawzi viết: “Bởi vì nó cần giới hạn tìm kiếm của mình trong các thuật toán có dạng cụ thể, nó có thể bỏ sót các loại thuật toán khác có thể hiệu quả hơn.

Có lẽ một con đường hấp dẫn hơn sẽ kết hợp trực giác của con người và máy móc. “Sẽ rất tuyệt nếu bạn tìm hiểu xem liệu phương pháp mới này có thực sự thay thế tất cả các phương pháp trước đó hay không, hay liệu bạn có thể kết hợp chúng lại và có được thứ gì đó tốt hơn hay không”. nói Williams. Các chuyên gia khác đồng ý. Với vô số thuật toán tùy ý sử dụng, các nhà khoa học có thể bắt đầu mổ xẻ chúng để tìm manh mối về điều gì đã khiến các giải pháp của AlphaTensor trở nên đáng chú ý, mở đường cho bước đột phá tiếp theo.

Tín dụng hình ảnh: DeepMind