Bài đăng này được đồng viết với Stanislav Yeshchenko từ Q4 Inc.

Các doanh nghiệp chuyển sang Thế hệ tăng cường truy xuất (RAG) như một cách tiếp cận chủ đạo để xây dựng các chatbot hỏi đáp. Chúng tôi tiếp tục nhận thấy những thách thức mới nổi xuất phát từ bản chất của việc phân loại các bộ dữ liệu có sẵn. Các bộ dữ liệu này thường là sự kết hợp của dữ liệu số và văn bản, đôi khi có cấu trúc, không có cấu trúc hoặc bán cấu trúc.

Công ty cổ phần Q4 cần thiết để giải quyết một số thách thức này ở một trong nhiều trường hợp sử dụng AI được xây dựng trên AWS. Trong bài đăng này, chúng tôi thảo luận về trường hợp sử dụng bot Hỏi & Đáp mà Q4 đã triển khai, những thách thức mà các bộ dữ liệu số và cấu trúc đưa ra cũng như cách Q4 kết luận rằng việc sử dụng SQL có thể là một giải pháp khả thi. Cuối cùng, chúng ta xem xét kỹ hơn cách nhóm Q4 sử dụng nền tảng Amazon và SQLDatabaseChain để triển khai giải pháp dựa trên RAG với việc tạo SQL.

Tổng quan về ca sử dụng

Q4 Inc., có trụ sở chính tại Toronto, có văn phòng tại New York và London, là nền tảng tiếp cận thị trường vốn hàng đầu đang thay đổi cách các tổ chức phát hành, nhà đầu tư và người bán kết nối, giao tiếp và tương tác với nhau một cách hiệu quả. Nền tảng Q4 tạo điều kiện cho sự tương tác trên các thị trường vốn thông qua các sản phẩm trang web IR, giải pháp sự kiện ảo, phân tích tương tác, quan hệ nhà đầu tư Quản lý quan hệ khách hàng (CRM), cổ đông và phân tích thị trường, giám sát và các công cụ ESG.

Trong bối cảnh tài chính dựa trên dữ liệu và nhịp độ nhanh ngày nay, Cán bộ quan hệ nhà đầu tư (IRO) đóng một vai trò quan trọng trong việc thúc đẩy giao tiếp giữa công ty với các cổ đông, nhà phân tích và nhà đầu tư. Là một phần nhiệm vụ hàng ngày của mình, IRO phân tích các bộ dữ liệu đa dạng, bao gồm CRM, hồ sơ quyền sở hữu và dữ liệu thị trường chứng khoán. Tổng hợp dữ liệu này được sử dụng để tạo báo cáo tài chính, đặt mục tiêu quan hệ nhà đầu tư và quản lý liên lạc với các nhà đầu tư hiện tại và tiềm năng.

Để đáp ứng nhu cầu ngày càng tăng về truy xuất dữ liệu năng động và hiệu quả, Q4 nhằm mục đích tạo ra một công cụ Hỏi & Đáp chatbot cung cấp phương pháp trực quan và đơn giản để IRO truy cập thông tin cần thiết mà họ cần ở định dạng thân thiện với người dùng.

Mục tiêu cuối cùng là tạo ra một chatbot có thể tích hợp liền mạch dữ liệu có sẵn công khai, cùng với dữ liệu Q4 dành riêng cho khách hàng, đồng thời duy trì mức độ bảo mật và quyền riêng tư dữ liệu cao nhất. Về hiệu suất, mục tiêu là duy trì thời gian phản hồi truy vấn tính bằng giây để đảm bảo trải nghiệm tích cực cho người dùng cuối.

Thị trường tài chính là một ngành được quản lý với mức độ rủi ro cao. Việc cung cấp thông tin không chính xác hoặc lỗi thời có thể ảnh hưởng đến niềm tin của nhà đầu tư và cổ đông, bên cạnh những rủi ro có thể xảy ra về quyền riêng tư dữ liệu. Hiểu rõ ngành và các yêu cầu, Q4 đặt quyền riêng tư của dữ liệu và độ chính xác của phản hồi làm nguyên tắc chỉ đạo trong việc đánh giá bất kỳ giải pháp nào trước khi đưa giải pháp đó ra thị trường.

Để chứng minh khái niệm, Q4 đã quyết định sử dụng tập dữ liệu về quyền sở hữu tài chính. Tập dữ liệu bao gồm các điểm dữ liệu chuỗi thời gian biểu thị số lượng tài sản sở hữu; lịch sử giao dịch giữa tổ chức đầu tư, cá nhân và công ty đại chúng; và nhiều yếu tố khác.

Vì Q4 muốn đảm bảo có thể đáp ứng tất cả các yêu cầu chức năng và phi chức năng mà chúng ta đã thảo luận nên dự án cũng cần duy trì tính khả thi về mặt thương mại. Điều này được tôn trọng trong suốt quá trình quyết định cách tiếp cận, kiến trúc, lựa chọn công nghệ và các yếu tố dành riêng cho giải pháp.

Thử nghiệm và thử thách

Rõ ràng ngay từ đầu rằng để hiểu câu hỏi bằng ngôn ngữ của con người và đưa ra câu trả lời chính xác, Q4 sẽ cần sử dụng các mô hình ngôn ngữ lớn (LLM).

Sau đây là một số thử nghiệm được nhóm thực hiện, cùng với những thách thức được xác định và bài học kinh nghiệm:

- Tập huấn trước – Q4 hiểu sự phức tạp và thách thức khi đào tạo trước LLM bằng cách sử dụng tập dữ liệu của chính nó. Rõ ràng là cách tiếp cận này tốn nhiều tài nguyên với nhiều bước không hề tầm thường, chẳng hạn như tiền xử lý dữ liệu, đào tạo và đánh giá. Ngoài những nỗ lực liên quan, nó sẽ rất tốn kém. Xem xét bản chất của tập dữ liệu chuỗi thời gian, Q4 cũng nhận ra rằng họ sẽ phải liên tục thực hiện đào tạo trước tăng dần khi có dữ liệu mới. Điều này đòi hỏi một nhóm liên ngành tận tâm có chuyên môn về khoa học dữ liệu, học máy và miền kiến thức.

- Tinh chỉnh – Tinh chỉnh mô hình nền tảng được huấn luyện trước (FM) liên quan đến việc sử dụng một số ví dụ được gắn nhãn. Cách tiếp cận này cho thấy một số thành công ban đầu, nhưng trong nhiều trường hợp, ảo giác mô hình là một thách thức. Mô hình gặp khó khăn trong việc hiểu các tín hiệu theo ngữ cảnh có sắc thái khác nhau và trả về kết quả không chính xác.

- RAG với tìm kiếm ngữ nghĩa – RAG thông thường với tìm kiếm ngữ nghĩa là bước cuối cùng trước khi chuyển sang tạo SQL. Nhóm đã thử nghiệm sử dụng tìm kiếm, tìm kiếm ngữ nghĩa và nhúng để trích xuất ngữ cảnh. Trong quá trình thử nghiệm nhúng, tập dữ liệu đã được chuyển đổi thành các phần nhúng, được lưu trữ trong cơ sở dữ liệu vectơ và sau đó khớp với các phần nhúng của câu hỏi để trích xuất ngữ cảnh. Sau đó, bối cảnh được truy xuất trong bất kỳ thử nghiệm nào trong số ba thử nghiệm được sử dụng để tăng thêm lời nhắc ban đầu làm đầu vào cho LLM. Cách tiếp cận này hoạt động tốt đối với nội dung dựa trên văn bản, trong đó dữ liệu bao gồm ngôn ngữ tự nhiên với các từ, câu và đoạn văn. Xem xét bản chất của tập dữ liệu Q4, chủ yếu là dữ liệu tài chính bao gồm các con số, giao dịch tài chính, báo giá chứng khoán và ngày tháng, kết quả trong cả ba trường hợp đều dưới mức tối ưu. Ngay cả khi sử dụng phần nhúng, phần nhúng được tạo từ các con số vẫn gặp khó khăn với xếp hạng tương tự và trong nhiều trường hợp dẫn đến việc truy xuất thông tin không chính xác.

Kết luận của Q4: Tạo SQL là con đường phía trước

Xem xét những thách thức phải đối mặt khi sử dụng phương pháp RAG thông thường, nhóm bắt đầu xem xét việc tạo SQL. Ý tưởng là sử dụng LLM để tạo câu lệnh SQL đầu tiên từ câu hỏi của người dùng, được trình bày cho LLM bằng ngôn ngữ tự nhiên. Truy vấn được tạo sau đó sẽ được chạy trên cơ sở dữ liệu để tìm nạp ngữ cảnh liên quan. Ngữ cảnh cuối cùng được sử dụng để tăng thêm lời nhắc đầu vào cho bước tóm tắt.

Giả thuyết của Q4 là để có được khả năng thu hồi cao hơn cho bước truy xuất, đặc biệt đối với tập dữ liệu số, trước tiên họ cần tạo SQL từ câu hỏi của người dùng. Điều này được cho là không chỉ tăng độ chính xác mà còn giữ được bối cảnh trong lĩnh vực kinh doanh cho một câu hỏi nhất định. Để tạo truy vấn và tạo SQL chính xác, Q4 cần làm cho LLM nhận biết đầy đủ ngữ cảnh về cấu trúc tập dữ liệu của chúng. Điều này có nghĩa là lời nhắc cần thiết để bao gồm lược đồ cơ sở dữ liệu, một vài hàng dữ liệu mẫu và phần giải thích trường mà con người có thể đọc được đối với các trường không dễ hiểu.

Dựa trên các thử nghiệm ban đầu, phương pháp này cho thấy kết quả tuyệt vời. LLM được trang bị tất cả thông tin cần thiết có thể tạo ra SQL chính xác, sau đó chạy trên cơ sở dữ liệu để truy xuất ngữ cảnh chính xác. Sau khi thử nghiệm ý tưởng, Q4 quyết định rằng việc tạo SQL là hướng đi tiếp theo để giải quyết các thách thức trích xuất ngữ cảnh cho tập dữ liệu cụ thể của riêng họ.

Hãy bắt đầu bằng việc mô tả cách tiếp cận giải pháp tổng thể, chia nhỏ nó thành các thành phần và sau đó ghép các phần lại với nhau.

Tổng quan về giải pháp

LLM là các mô hình lớn với hàng tỷ tham số được đào tạo trước bằng cách sử dụng lượng dữ liệu rất lớn từ nhiều nguồn khác nhau. Do phạm vi rộng của các tập dữ liệu đào tạo, LLM dự kiến sẽ có kiến thức chung trong nhiều lĩnh vực khác nhau. LLM cũng được biết đến với khả năng suy luận, khả năng này khác nhau tùy theo từng mô hình. Hành vi chung này có thể được tối ưu hóa cho một miền hoặc ngành cụ thể bằng cách tối ưu hóa hơn nữa mô hình nền tảng bằng cách sử dụng dữ liệu đào tạo trước bổ sung cho từng miền cụ thể hoặc bằng cách tinh chỉnh bằng cách sử dụng dữ liệu được gắn nhãn. Với bối cảnh, siêu dữ liệu và hướng dẫn phù hợp, LLM có mục đích chung được lựa chọn tốt có thể tạo ra SQL chất lượng tốt miễn là nó có quyền truy cập vào ngữ cảnh cụ thể của miền phù hợp.

Trong trường hợp sử dụng của Q4, chúng tôi bắt đầu bằng việc dịch câu hỏi của khách hàng sang SQL. Chúng tôi thực hiện điều này bằng cách kết hợp câu hỏi của người dùng, lược đồ cơ sở dữ liệu, một số hàng cơ sở dữ liệu mẫu và hướng dẫn chi tiết dưới dạng lời nhắc LLM tạo SQL. Sau khi có SQL, chúng tôi có thể chạy bước xác thực nếu thấy cần thiết. Khi hài lòng với chất lượng của SQL, chúng tôi chạy truy vấn dựa trên cơ sở dữ liệu để truy xuất ngữ cảnh liên quan mà chúng tôi cần cho bước tiếp theo. Bây giờ chúng tôi có ngữ cảnh liên quan, chúng tôi có thể gửi câu hỏi ban đầu của người dùng, ngữ cảnh được truy xuất và một bộ hướng dẫn quay lại LLM để tạo ra phản hồi tóm tắt cuối cùng. Mục tiêu của bước cuối cùng là yêu cầu LLM tóm tắt kết quả và đưa ra câu trả lời chính xác và theo ngữ cảnh để sau đó có thể chuyển cho người dùng.

Việc lựa chọn LLM được sử dụng ở mọi giai đoạn của quy trình sẽ ảnh hưởng lớn đến độ chính xác, chi phí và hiệu suất. Việc chọn nền tảng hoặc công nghệ có thể cho phép bạn chuyển đổi linh hoạt giữa các LLM trong cùng một trường hợp sử dụng (nhiều chuyến đi LLM cho các tác vụ khác nhau) hoặc giữa các trường hợp sử dụng khác nhau, có thể mang lại lợi ích trong việc tối ưu hóa chất lượng đầu ra, độ trễ và chi phí . Chúng tôi sẽ đề cập đến việc lựa chọn LLM sau trong bài đăng này.

Khối xây dựng giải pháp

Bây giờ chúng ta đã nêu bật cách tiếp cận ở cấp độ cao, hãy đi sâu vào chi tiết, bắt đầu với các khối xây dựng giải pháp.

nền tảng Amazon

Amazon Bedrock là dịch vụ được quản lý toàn phần cung cấp nhiều lựa chọn FM hiệu suất cao từ các công ty hàng đầu, bao gồm AI21 Labs, Anthropic, Cohere, Meta, Stability AI và Amazon. Amazon Bedrock cũng cung cấp một bộ công cụ phong phú cần thiết để xây dựng các ứng dụng AI tổng quát, đơn giản hóa quy trình phát triển cũng như duy trì quyền riêng tư và bảo mật. Ngoài ra, với Amazon Bedrock, bạn có thể chọn từ nhiều tùy chọn FM khác nhau và có thể tinh chỉnh thêm các mô hình một cách riêng tư bằng cách sử dụng dữ liệu của riêng mình để điều chỉnh phản hồi của mô hình cho phù hợp với yêu cầu trường hợp sử dụng của bạn. Amazon Bedrock hoàn toàn không có máy chủ, không có cơ sở hạ tầng cơ bản để quản lý việc mở rộng quyền truy cập vào các mô hình có sẵn thông qua một API duy nhất. Cuối cùng, Amazon Bedrock hỗ trợ một số yêu cầu về bảo mật và quyền riêng tư, bao gồm cả tính đủ điều kiện của HIPAA và tuân thủ GDPR.

Trong giải pháp của Q4, chúng tôi sử dụng Amazon Bedrock làm khối xây dựng mô hình đa nền tảng, dựa trên API, không có máy chủ. Bởi vì chúng tôi dự định thực hiện nhiều chuyến đi tới LLM trong cùng một trường hợp sử dụng, nên dựa trên loại nhiệm vụ, chúng tôi có thể chọn mô hình tối ưu nhất cho một nhiệm vụ cụ thể, có thể là tạo, xác thực hoặc tóm tắt SQL.

LangChain

LangChain là một khung điều phối và tích hợp nguồn mở với một tập hợp các mô-đun dựng sẵn (I/O, truy xuất, chuỗi và tác nhân) mà bạn có thể sử dụng để tích hợp và điều phối các tác vụ giữa FM, nguồn dữ liệu và công cụ. Khung này tạo điều kiện thuận lợi cho việc xây dựng các ứng dụng AI tổng quát yêu cầu phối hợp nhiều bước để tạo ra kết quả mong muốn mà không cần phải viết mã từ đầu. LangChain hỗ trợ Amazon Bedrock dưới dạng API mô hình đa nền tảng.

Cụ thể đối với trường hợp sử dụng của Q4, chúng tôi sử dụng LangChain để điều phối và sắp xếp các nhiệm vụ trong quy trình làm việc của mình, bao gồm kết nối với các nguồn dữ liệu và LLM. Cách tiếp cận này đã đơn giản hóa mã của chúng tôi vì chúng tôi có thể sử dụng các mô-đun LangChain hiện có.

Chuỗi cơ sở dữ liệu SQL

Chuỗi cơ sở dữ liệu SQL là chuỗi LangChain có thể được nhập từ langchain_experimental. SLDatabaseChain giúp việc tạo, triển khai và chạy các truy vấn SQL trở nên đơn giản bằng cách sử dụng các hoạt động triển khai và chuyển đổi văn bản sang SQL hiệu quả.

Trong trường hợp sử dụng của chúng tôi, chúng tôi sử dụng SQLDatabaseChain trong quá trình tạo SQL, đơn giản hóa và điều phối các tương tác giữa cơ sở dữ liệu và LLM.

Bộ dữ liệu

Tập dữ liệu có cấu trúc của chúng tôi có thể nằm trong cơ sở dữ liệu SQL, hồ dữ liệu hoặc kho dữ liệu miễn là chúng tôi có hỗ trợ cho SQL. Trong giải pháp của chúng tôi, chúng tôi có thể sử dụng bất kỳ loại tập dữ liệu nào có hỗ trợ SQL; điều này phải được trừu tượng hóa khỏi giải pháp và không được thay đổi giải pháp theo bất kỳ cách nào.

Chi tiết triển khai

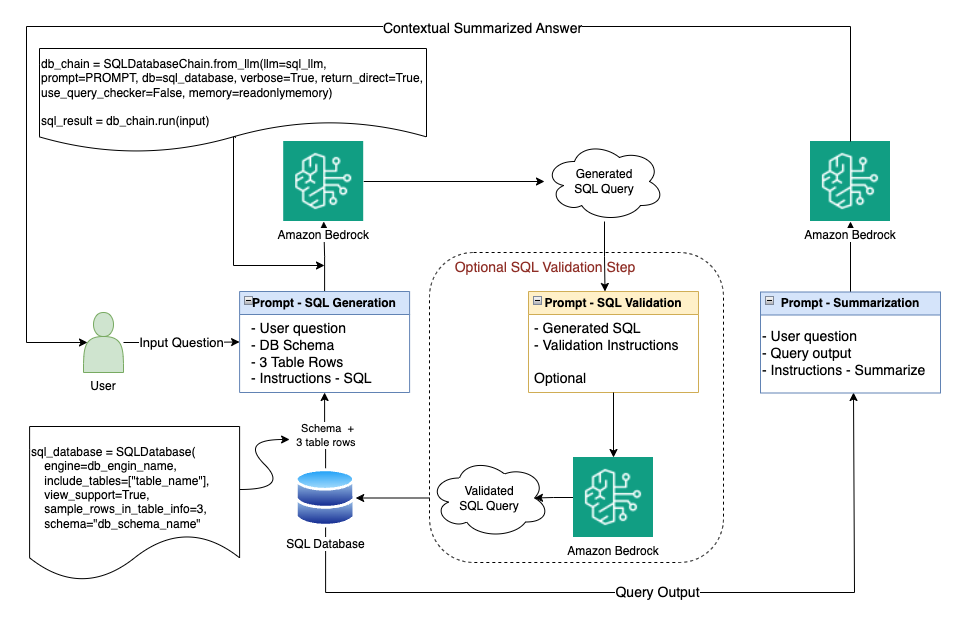

Bây giờ chúng ta đã khám phá cách tiếp cận giải pháp, các thành phần giải pháp, lựa chọn công nghệ và công cụ, chúng ta có thể ghép các phần lại với nhau. Sơ đồ sau đây nêu bật giải pháp toàn diện.

Hãy xem qua chi tiết triển khai và quy trình.

Tạo truy vấn SQL

Để đơn giản hóa việc mã hóa, chúng tôi sử dụng các khuôn khổ hiện có. Chúng tôi sử dụng LangChain làm khung điều phối. Chúng tôi bắt đầu với giai đoạn đầu vào, nơi chúng tôi nhận được câu hỏi của người dùng bằng ngôn ngữ tự nhiên.

Trong giai đoạn đầu tiên này, chúng tôi lấy thông tin đầu vào này và tạo một SQL tương đương mà chúng tôi có thể chạy trên cơ sở dữ liệu để trích xuất ngữ cảnh. Để tạo SQL, chúng tôi sử dụng SQLDatabaseChain, dựa trên Amazon Bedrock để truy cập vào LLM mong muốn của chúng tôi. Với Amazon Bedrock, bằng cách sử dụng một API duy nhất, chúng tôi có quyền truy cập vào một số LLM cơ bản và có thể chọn LLM phù hợp cho mỗi chuyến đi LLM mà chúng tôi thực hiện. Trước tiên, chúng tôi thiết lập kết nối tới cơ sở dữ liệu và truy xuất lược đồ bảng được yêu cầu cùng với một số hàng mẫu từ các bảng mà chúng tôi định sử dụng.

Trong quá trình thử nghiệm, chúng tôi nhận thấy 2–5 hàng dữ liệu trong bảng là đủ để cung cấp đủ thông tin cho mô hình mà không cần thêm quá nhiều chi phí không cần thiết. Ba hàng vừa đủ để cung cấp ngữ cảnh mà không làm mô hình choáng ngợp với quá nhiều thông tin đầu vào. Trong trường hợp sử dụng của chúng tôi, chúng tôi đã bắt đầu với Anthropic Claude V2. Mô hình này được biết đến với khả năng suy luận nâng cao và phản hồi theo ngữ cảnh rõ ràng khi được cung cấp ngữ cảnh và hướng dẫn phù hợp. Là một phần của hướng dẫn, chúng tôi có thể đưa thêm các chi tiết làm rõ hơn vào LLM. Ví dụ: chúng ta có thể mô tả cột đó Comp_NAME là viết tắt của tên công ty. Bây giờ chúng ta có thể xây dựng lời nhắc bằng cách kết hợp nguyên câu hỏi của người dùng, lược đồ cơ sở dữ liệu, ba hàng mẫu từ bảng mà chúng ta định sử dụng và một bộ hướng dẫn để tạo SQL cần thiết ở định dạng SQL rõ ràng mà không cần nhận xét hoặc bổ sung.

Tất cả các phần tử đầu vào được kết hợp lại được coi là dấu nhắc đầu vào của mô hình. Lời nhắc đầu vào được thiết kế tốt, phù hợp với cú pháp ưa thích của mô hình sẽ tác động lớn đến cả chất lượng và hiệu suất của đầu ra. Việc lựa chọn mô hình để sử dụng cho một nhiệm vụ cụ thể cũng rất quan trọng, không chỉ vì nó ảnh hưởng đến chất lượng đầu ra mà còn vì nó liên quan đến chi phí và hiệu suất.

Chúng tôi sẽ thảo luận về việc lựa chọn mô hình cũng như kỹ thuật và tối ưu hóa nhanh chóng ở phần sau của bài đăng này, nhưng cần lưu ý rằng đối với giai đoạn tạo truy vấn, chúng tôi nhận thấy rằng Claude Instant có thể tạo ra các kết quả có thể so sánh được, đặc biệt là khi câu hỏi của người dùng được diễn đạt rõ ràng và không phức tạp bằng. Tuy nhiên, Claude V2 tạo ra kết quả tốt hơn ngay cả với thông tin đầu vào gián tiếp và phức tạp hơn của người dùng. Chúng tôi đã học được rằng mặc dù trong một số trường hợp Claude tức thì có thể cung cấp đủ độ chính xác ở độ trễ và mức giá tốt hơn, trường hợp tạo truy vấn của chúng tôi phù hợp hơn với Claude V2.

Xác minh truy vấn SQL

Bước tiếp theo của chúng tôi là xác minh rằng LLM đã tạo thành công cú pháp truy vấn đúng và truy vấn đó có ý nghĩa theo ngữ cảnh khi xem xét các lược đồ cơ sở dữ liệu và các hàng ví dụ được cung cấp. Đối với bước xác minh này, chúng tôi có thể hoàn nguyên về xác thực truy vấn gốc trong SQLDatabaseChain hoặc chúng tôi có thể chạy chuyến đi thứ hai tới LLM bao gồm truy vấn được tạo cùng với hướng dẫn xác thực.

Nếu chúng tôi sử dụng LLM cho bước xác thực, chúng tôi có thể sử dụng LLM tương tự như trước (Claude V2) hoặc LLM nhỏ hơn, hiệu suất cao hơn cho tác vụ đơn giản hơn, chẳng hạn như Claude Instant. Vì chúng tôi đang sử dụng Amazon Bedrock nên việc điều chỉnh này rất đơn giản. Bằng cách sử dụng cùng một API, chúng tôi có thể thay đổi tên mô hình trong lệnh gọi API của mình, việc này sẽ đảm nhận việc thay đổi. Điều quan trọng cần lưu ý là trong hầu hết các trường hợp, LLM nhỏ hơn có thể mang lại hiệu quả tốt hơn cả về chi phí và độ trễ và cần được xem xét—miễn là bạn đạt được độ chính xác như mong muốn. Trong trường hợp của chúng tôi, quá trình kiểm tra đã chứng minh rằng truy vấn được tạo luôn chính xác và đúng cú pháp. Biết được điều đó, chúng tôi có thể bỏ qua bước xác thực này và tiết kiệm độ trễ cũng như chi phí.

Chạy truy vấn SQL

Bây giờ chúng ta đã có truy vấn SQL được xác minh, chúng ta có thể chạy truy vấn SQL dựa trên cơ sở dữ liệu và truy xuất ngữ cảnh liên quan. Đây phải là một bước đơn giản.

Chúng tôi lấy bối cảnh đã tạo, cung cấp nó cho LLM mà chúng tôi lựa chọn cùng với câu hỏi ban đầu của người dùng và một số hướng dẫn, đồng thời yêu cầu mô hình tạo một bản tóm tắt theo ngữ cảnh và rõ ràng. Sau đó, chúng tôi trình bày bản tóm tắt đã tạo cho người dùng dưới dạng câu trả lời cho câu hỏi ban đầu, tất cả đều phù hợp với bối cảnh được trích xuất từ tập dữ liệu của chúng tôi.

Đối với LLM liên quan đến bước tóm tắt, chúng ta có thể sử dụng Titan Text Express hoặc Claude Instant. Cả hai đều đưa ra những lựa chọn tốt cho nhiệm vụ tóm tắt.

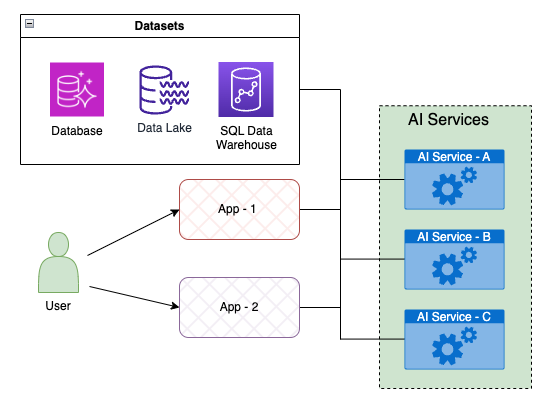

Tích hợp ứng dụng

Tính năng Q&A chatbot là một trong những dịch vụ AI của Q4. Để đảm bảo tính mô-đun và khả năng mở rộng, Q4 xây dựng các dịch vụ AI dưới dạng dịch vụ vi mô mà các ứng dụng Q4 có thể truy cập thông qua API. Cách tiếp cận dựa trên API này cho phép tích hợp liền mạch với hệ sinh thái Nền tảng Q4 và tạo điều kiện thể hiện khả năng của dịch vụ AI với bộ ứng dụng nền tảng đầy đủ.

Mục tiêu chính của dịch vụ AI là cung cấp khả năng truy xuất dữ liệu đơn giản từ bất kỳ nguồn dữ liệu công cộng hoặc độc quyền nào bằng cách sử dụng ngôn ngữ tự nhiên làm đầu vào. Ngoài ra, các dịch vụ AI còn cung cấp các lớp trừu tượng bổ sung để đảm bảo đáp ứng các yêu cầu chức năng và phi chức năng, chẳng hạn như quyền riêng tư và bảo mật dữ liệu. Sơ đồ sau đây thể hiện khái niệm tích hợp.

Thách thức triển khai

Ngoài những thách thức do bản chất của tập dữ liệu số có cấu trúc mà chúng ta đã thảo luận trước đó, Q4 còn phải đối mặt với một số thách thức triển khai khác cần được giải quyết.

Lựa chọn và hiệu suất LLM

Việc chọn LLM phù hợp cho nhiệm vụ là rất quan trọng vì nó ảnh hưởng trực tiếp đến chất lượng đầu ra cũng như hiệu suất (độ trễ khứ hồi). Dưới đây là một số yếu tố ảnh hưởng đến quá trình lựa chọn LLM:

- Loại LLM – Cách cấu trúc FM và dữ liệu ban đầu mà mô hình đã được đào tạo trước sẽ xác định loại nhiệm vụ mà LLM sẽ làm tốt và mức độ tốt của nó. Ví dụ: LLM văn bản sẽ tốt trong việc tạo và tóm tắt văn bản, trong khi mô hình chuyển văn bản thành hình ảnh hoặc hình ảnh thành văn bản sẽ hướng tới các nhiệm vụ tạo và phân tích hình ảnh nhiều hơn.

- kích thước LLM – Kích thước FM được đo bằng số lượng tham số mô hình mà một mô hình cụ thể có, thường tính bằng tỷ đối với LLM hiện đại. Thông thường, mô hình càng lớn thì việc huấn luyện ban đầu hoặc tinh chỉnh sau đó càng tốn kém. Mặt khác, nói chung, đối với cùng một kiến trúc mô hình, mô hình càng lớn thì chúng ta mong đợi nó sẽ càng thông minh hơn trong việc thực hiện loại nhiệm vụ mà nó hướng tới.

- Hiệu suất LLM – Thông thường, mô hình càng lớn thì càng mất nhiều thời gian để tạo đầu ra, giả sử bạn đang sử dụng cùng các tham số tính toán và I/O (kích thước lời nhắc và đầu ra). Ngoài ra, đối với cùng một kích thước mô hình, hiệu suất bị ảnh hưởng nhiều bởi mức độ tối ưu hóa lời nhắc của bạn, kích thước của mã thông báo I/O cũng như độ rõ ràng và cú pháp của lời nhắc. Lời nhắc được thiết kế tốt cùng với kích thước mã thông báo I/O được tối ưu hóa có thể cải thiện thời gian phản hồi của mô hình.

Do đó, khi tối ưu hóa nhiệm vụ của bạn, hãy xem xét các phương pháp hay nhất sau:

- Chọn một mô hình phù hợp với nhiệm vụ hiện tại

- Chọn kích thước mô hình nhỏ nhất có thể mang lại độ chính xác mà bạn đang tìm kiếm

- Tối ưu hóa cấu trúc lời nhắc của bạn và đưa ra hướng dẫn cụ thể nhất có thể theo cách mà mô hình dễ hiểu

- Sử dụng lời nhắc đầu vào nhỏ nhất có thể cung cấp đủ hướng dẫn và ngữ cảnh để tạo ra mức độ chính xác mà bạn đang tìm kiếm

- Giới hạn kích thước đầu ra ở kích thước nhỏ nhất có thể có ý nghĩa đối với bạn và đáp ứng yêu cầu đầu ra của bạn

Khi tính đến các yếu tố lựa chọn mô hình và tối ưu hóa hiệu suất, chúng tôi đã bắt tay vào tối ưu hóa trường hợp sử dụng tạo SQL của mình. Sau một số thử nghiệm, chúng tôi nhận thấy rằng, miễn là chúng tôi có ngữ cảnh và hướng dẫn phù hợp, Claude Instant, với cùng dữ liệu nhanh chóng, sẽ tạo ra chất lượng SQL tương đương với Claude V2 với hiệu suất và mức giá tốt hơn nhiều. Điều này đúng khi đầu vào của người dùng có tính chất trực tiếp và đơn giản hơn. Đối với đầu vào phức tạp hơn, Claude V2 là cần thiết để tạo ra độ chính xác mong muốn.

Việc áp dụng logic tương tự cho nhiệm vụ tóm tắt khiến chúng tôi kết luận rằng việc sử dụng Claude Instant hoặc Titan Text Express sẽ tạo ra độ chính xác cần thiết ở điểm hiệu suất tốt hơn nhiều so với khi chúng tôi sử dụng mô hình lớn hơn như Claude V2. Titan Text Expressed cũng cung cấp hiệu suất giá tốt hơn, như chúng tôi đã thảo luận trước đó.

Thử thách phối hợp

Chúng tôi nhận thấy rằng có rất nhiều điều cần phải sắp xếp trước khi có thể nhận được phản hồi đầu ra có ý nghĩa cho câu hỏi của người dùng. Như được trình bày trong phần tổng quan về giải pháp, quy trình này bao gồm nhiều chuyến đi cơ sở dữ liệu và nhiều chuyến đi LLM đan xen với nhau. Nếu chúng tôi xây dựng từ đầu, chúng tôi sẽ phải đầu tư đáng kể vào công việc nặng nhọc không phân biệt chỉ để chuẩn bị sẵn mã cơ bản. Chúng tôi nhanh chóng chuyển sang sử dụng LangChain làm khung điều phối, tận dụng sức mạnh của cộng đồng nguồn mở và sử dụng lại các mô-đun hiện có mà không cần phát minh lại bánh xe.

Thử thách SQL

Chúng tôi cũng nhận ra rằng việc tạo SQL không đơn giản như các cơ chế trích xuất ngữ cảnh như tìm kiếm ngữ nghĩa hoặc sử dụng các phần nhúng. Trước tiên, chúng ta cần lấy lược đồ cơ sở dữ liệu và một số hàng mẫu để đưa vào lời nhắc tới LLM. Ngoài ra còn có giai đoạn xác thực SQL, nơi chúng tôi cần tương tác với cả cơ sở dữ liệu và LLM. SQLDatabaseChain là sự lựa chọn công cụ hiển nhiên. Bởi vì nó là một phần của LangChain nên việc thích ứng rất đơn giản và giờ đây chúng tôi có thể quản lý việc tạo và xác minh SQL được hỗ trợ bằng chuỗi, giảm thiểu khối lượng công việc chúng tôi cần làm.

Thử thách về hiệu suất

Với việc sử dụng Claude V2 và sau kỹ thuật nhanh chóng phù hợp (mà chúng ta sẽ thảo luận trong phần tiếp theo), chúng tôi đã có thể tạo ra SQL chất lượng cao. Xem xét chất lượng của SQL được tạo ra, chúng tôi bắt đầu xem xét giai đoạn xác thực thực sự mang lại bao nhiêu giá trị. Sau khi phân tích sâu hơn các kết quả, rõ ràng là chất lượng của SQL được tạo ra luôn chính xác theo cách khiến chi phí/lợi ích của việc thêm giai đoạn xác thực SQL trở nên không thuận lợi. Cuối cùng, chúng tôi đã loại bỏ giai đoạn xác thực SQL mà không ảnh hưởng tiêu cực đến chất lượng đầu ra của mình và giảm bớt thời gian xác thực SQL.

Ngoài việc tối ưu hóa LLM tiết kiệm chi phí và hiệu suất hơn cho bước tóm tắt, chúng tôi còn có thể sử dụng Titan Text Express để có hiệu suất và hiệu quả chi phí tốt hơn.

Tối ưu hóa hiệu suất hơn nữa bao gồm việc tinh chỉnh quy trình tạo truy vấn bằng cách sử dụng các kỹ thuật kỹ thuật nhanh chóng hiệu quả. Thay vì cung cấp nhiều mã thông báo, trọng tâm là cung cấp số lượng mã thông báo đầu vào ít nhất, theo đúng cú pháp mà mô hình được đào tạo để hiểu và với bộ hướng dẫn tối thiểu nhưng tối ưu. Chúng ta sẽ thảo luận thêm về vấn đề này trong phần tiếp theo—đây là một chủ đề quan trọng không chỉ có thể áp dụng ở đây mà còn trong các trường hợp sử dụng khác.

Kỹ thuật nhanh chóng và tối ưu hóa

Bạn có thể điều chỉnh Claude trên Amazon Bedrock cho các trường hợp sử dụng kinh doanh khác nhau nếu áp dụng đúng kỹ thuật kỹ thuật kịp thời. Claude chủ yếu hoạt động như một trợ lý đàm thoại sử dụng định dạng con người/trợ lý. Claude được đào tạo để điền văn bản cho vai trò trợ lý. Dựa trên các hướng dẫn và hoàn thành nhanh chóng như mong muốn, chúng tôi có thể tối ưu hóa lời nhắc dành cho Claude bằng cách sử dụng một số kỹ thuật.

Chúng tôi bắt đầu với một mẫu lời nhắc được định dạng phù hợp để hoàn thành hợp lệ, sau đó chúng tôi có thể tối ưu hóa hơn nữa các phản hồi thử nghiệm bằng lời nhắc với nhiều bộ đầu vào đại diện cho dữ liệu trong thế giới thực. Bạn nên lấy nhiều thông tin đầu vào trong khi phát triển mẫu lời nhắc. Bạn cũng có thể sử dụng các bộ dữ liệu phát triển nhanh chóng và dữ liệu thử nghiệm riêng biệt.

Một cách khác để tối ưu hóa phản hồi của Claude là thử nghiệm và lặp lại bằng cách thêm các quy tắc, hướng dẫn và tối ưu hóa hữu ích. Từ những tối ưu hóa này, bạn có thể xem các kiểu hoàn thành khác nhau, chẳng hạn như yêu cầu Claude đề cập đến “Tôi không biết” để tránh ảo giác, suy nghĩ từng bước, sử dụng chuỗi nhắc nhở, nhường chỗ cho “suy nghĩ” khi nó tạo ra phản hồi và kiểm tra kỹ để hiểu và chính xác.

Hãy sử dụng tác vụ tạo truy vấn của chúng tôi và thảo luận về một số kỹ thuật mà chúng tôi đã sử dụng để tối ưu hóa lời nhắc của mình. Có một số yếu tố cốt lõi mang lại lợi ích cho nỗ lực tạo truy vấn của chúng tôi:

- Sử dụng cú pháp con người/trợ lý thích hợp

- Sử dụng các thẻ XML (Claude tôn trọng và hiểu các thẻ XML)

- Thêm hướng dẫn rõ ràng cho mô hình để tránh ảo giác

Ví dụ chung sau đây cho thấy cách chúng tôi sử dụng cú pháp con người/trợ lý, thẻ XML được áp dụng và hướng dẫn bổ sung để hạn chế đầu ra ở dạng SQL và hướng dẫn mô hình nói “xin lỗi, tôi không thể trợ giúp” nếu nó không thể tạo ra SQL có liên quan . Các thẻ XML được sử dụng để đóng khung các hướng dẫn, gợi ý bổ sung, lược đồ cơ sở dữ liệu, giải thích bảng bổ sung và các hàng ví dụ.

Giải pháp làm việc cuối cùng

Sau khi giải quyết tất cả các thách thức được xác định trong quá trình chứng minh khái niệm, chúng tôi đã đáp ứng tất cả các yêu cầu về giải pháp. Q4 hài lòng với chất lượng SQL do LLM tạo ra. Điều này đúng với các tác vụ đơn giản chỉ yêu cầu mệnh đề WHERE để lọc dữ liệu và cả với các tác vụ phức tạp hơn yêu cầu tổng hợp dựa trên ngữ cảnh với GROUP BY và các hàm toán học. Độ trễ toàn diện của giải pháp tổng thể nằm trong mức được xác định là có thể chấp nhận được đối với trường hợp sử dụng—giây có một chữ số. Tất cả là nhờ vào việc lựa chọn LLM tối ưu ở mọi giai đoạn, kỹ thuật nhanh chóng phù hợp, loại bỏ bước xác minh SQL và sử dụng LLM hiệu quả cho bước tóm tắt (Titan Text Express hoặc Claude Instant).

Điều đáng lưu ý là việc sử dụng Amazon Bedrock làm dịch vụ được quản lý hoàn toàn và khả năng truy cập vào một bộ LLM thông qua cùng một API cho phép thử nghiệm và chuyển đổi liền mạch giữa các LLM bằng cách thay đổi tên mô hình trong lệnh gọi API. Với mức độ linh hoạt này, Q4 có thể chọn LLM hiệu quả nhất cho mỗi cuộc gọi LLM dựa trên tính chất của nhiệm vụ, có thể là tạo truy vấn, xác minh hoặc tóm tắt.

Kết luận

Không có một giải pháp nào phù hợp với mọi trường hợp sử dụng. Theo cách tiếp cận RAG, chất lượng đầu ra phụ thuộc nhiều vào việc cung cấp bối cảnh phù hợp. Trích xuất đúng ngữ cảnh là điều quan trọng và mỗi tập dữ liệu đều khác nhau với những đặc điểm riêng.

Trong bài đăng này, chúng tôi đã chứng minh rằng đối với các tập dữ liệu số và có cấu trúc, việc sử dụng SQL để trích xuất bối cảnh được sử dụng để tăng cường có thể dẫn đến kết quả thuận lợi hơn. Chúng tôi cũng chứng minh rằng các khung như LangChain có thể giảm thiểu nỗ lực viết mã. Ngoài ra, chúng tôi đã thảo luận về nhu cầu có thể chuyển đổi giữa các LLM trong cùng một trường hợp sử dụng để đạt được độ chính xác, hiệu suất và chi phí tối ưu nhất. Cuối cùng, chúng tôi đã nhấn mạnh cách Amazon Bedrock, không có máy chủ và có nhiều LLM bên trong, mang lại sự linh hoạt cần thiết để xây dựng các ứng dụng an toàn, hiệu quả và tối ưu hóa chi phí với khối lượng công việc nặng nhọc ít nhất.

Bắt đầu hành trình xây dựng các ứng dụng hỗ trợ AI tổng quát bằng cách xác định trường hợp sử dụng có giá trị cho doanh nghiệp của bạn. Việc tạo SQL, như nhóm Q4 đã học, có thể là yếu tố thay đổi cuộc chơi trong việc xây dựng các ứng dụng thông minh tích hợp với kho dữ liệu của bạn, khai thác tiềm năng doanh thu.

Giới thiệu về tác giả

Tamer Soliman là Kiến trúc sư giải pháp cấp cao tại AWS. Anh giúp khách hàng của Nhà cung cấp phần mềm độc lập (ISV) đổi mới, xây dựng và mở rộng quy mô trên AWS. Ông có hơn hai mươi năm kinh nghiệm trong ngành về tư vấn, đào tạo và dịch vụ chuyên nghiệp. Ông là nhà phát minh có nhiều bằng sáng chế với ba bằng sáng chế được cấp và kinh nghiệm của ông trải rộng trên nhiều lĩnh vực công nghệ bao gồm viễn thông, mạng, tích hợp ứng dụng, AI/ML và triển khai đám mây. Anh ấy chuyên về Mạng AWS và có niềm đam mê sâu sắc với máy học, AI và AI sáng tạo.

Tamer Soliman là Kiến trúc sư giải pháp cấp cao tại AWS. Anh giúp khách hàng của Nhà cung cấp phần mềm độc lập (ISV) đổi mới, xây dựng và mở rộng quy mô trên AWS. Ông có hơn hai mươi năm kinh nghiệm trong ngành về tư vấn, đào tạo và dịch vụ chuyên nghiệp. Ông là nhà phát minh có nhiều bằng sáng chế với ba bằng sáng chế được cấp và kinh nghiệm của ông trải rộng trên nhiều lĩnh vực công nghệ bao gồm viễn thông, mạng, tích hợp ứng dụng, AI/ML và triển khai đám mây. Anh ấy chuyên về Mạng AWS và có niềm đam mê sâu sắc với máy học, AI và AI sáng tạo.

Mani Khanuja là Trưởng nhóm công nghệ – Chuyên gia AI sáng tạo, tác giả cuốn sách – Học máy ứng dụng và tính toán hiệu năng cao trên AWS, đồng thời là thành viên Ban Giám đốc dành cho Phụ nữ trong Ban Tổ chức Giáo dục Sản xuất. Cô lãnh đạo các dự án học máy (ML) trong nhiều lĩnh vực khác nhau như thị giác máy tính, xử lý ngôn ngữ tự nhiên và AI tổng quát. Cô giúp khách hàng xây dựng, đào tạo và triển khai các mô hình máy học lớn trên quy mô lớn. Cô phát biểu trong các hội nghị nội bộ và bên ngoài như re:Invent, Women in Manufacturing West, hội thảo trực tuyến trên YouTube và GHC 23. Khi rảnh rỗi, cô thích chạy bộ dài dọc bãi biển.

Mani Khanuja là Trưởng nhóm công nghệ – Chuyên gia AI sáng tạo, tác giả cuốn sách – Học máy ứng dụng và tính toán hiệu năng cao trên AWS, đồng thời là thành viên Ban Giám đốc dành cho Phụ nữ trong Ban Tổ chức Giáo dục Sản xuất. Cô lãnh đạo các dự án học máy (ML) trong nhiều lĩnh vực khác nhau như thị giác máy tính, xử lý ngôn ngữ tự nhiên và AI tổng quát. Cô giúp khách hàng xây dựng, đào tạo và triển khai các mô hình máy học lớn trên quy mô lớn. Cô phát biểu trong các hội nghị nội bộ và bên ngoài như re:Invent, Women in Manufacturing West, hội thảo trực tuyến trên YouTube và GHC 23. Khi rảnh rỗi, cô thích chạy bộ dài dọc bãi biển.

Stanislav Yeshchenko là Kiến trúc sư phần mềm tại Q4 Inc.. Ông có hơn một thập kỷ kinh nghiệm trong ngành về phát triển phần mềm và kiến trúc hệ thống. Nền tảng đa dạng của anh ấy bao gồm các vai trò như Trưởng nhóm kỹ thuật và Nhà phát triển Full Stack cấp cao, giúp anh ấy đóng góp vào việc thúc đẩy đổi mới Nền tảng Q4. Stanislav tận tâm thúc đẩy đổi mới kỹ thuật và định hình các giải pháp chiến lược trong lĩnh vực này.

Stanislav Yeshchenko là Kiến trúc sư phần mềm tại Q4 Inc.. Ông có hơn một thập kỷ kinh nghiệm trong ngành về phát triển phần mềm và kiến trúc hệ thống. Nền tảng đa dạng của anh ấy bao gồm các vai trò như Trưởng nhóm kỹ thuật và Nhà phát triển Full Stack cấp cao, giúp anh ấy đóng góp vào việc thúc đẩy đổi mới Nền tảng Q4. Stanislav tận tâm thúc đẩy đổi mới kỹ thuật và định hình các giải pháp chiến lược trong lĩnh vực này.

- Phân phối nội dung và PR được hỗ trợ bởi SEO. Được khuếch đại ngay hôm nay.

- PlatoData.Network Vertical Generative Ai. Trao quyền cho chính mình. Truy cập Tại đây.

- PlatoAiStream. Thông minh Web3. Kiến thức khuếch đại. Truy cập Tại đây.

- Trung tâmESG. Than đá, công nghệ sạch, Năng lượng, Môi trường Hệ mặt trời, Quản lý chất thải. Truy cập Tại đây.

- PlatoSức khỏe. Tình báo thử nghiệm lâm sàng và công nghệ sinh học. Truy cập Tại đây.

- nguồn: https://aws.amazon.com/blogs/machine-learning/how-q4-inc-used-amazon-bedrock-rag-and-sqldatabasechain-to-address-numerical-and-structured-dataset-challenges-building-their-qa-chatbot/

- : có

- :là

- :không phải

- :Ở đâu

- $ LÊN

- 100

- 118

- 125

- 15%

- 23

- 7

- a

- khả năng

- có khả năng

- Có khả năng

- sự trừu tượng

- sự phong phú

- chấp nhận được

- truy cập

- có thể truy cập

- Tài khoản

- chính xác

- chính xác

- Đạt được

- ngang qua

- hành vi

- thực sự

- thích ứng

- thêm

- thêm

- Ngoài ra

- thêm vào

- Ngoài ra

- bổ sung

- địa chỉ

- giải quyết

- Điều chỉnh

- tiên tiến

- thăng tiến

- Lợi thế

- Sau

- chống lại

- đại lý

- tổng hợp

- AI

- Dịch vụ AI

- trường hợp sử dụng ai

- AI / ML

- nhằm vào

- sắp xếp

- căn chỉnh

- Tất cả

- cho phép

- cho phép

- dọc theo

- Ngoài ra

- Mặc dù

- am

- đàn bà gan dạ

- Amazon Web Services

- số lượng

- số lượng

- an

- phân tích

- Các nhà phân tích

- phân tích

- phân tích

- phân tích

- và

- Một

- trả lời

- câu trả lời

- nhân loại

- bất kì

- bất cứ điều gì

- api

- API

- áp dụng

- Các Ứng Dụng

- các ứng dụng

- áp dụng

- phương pháp tiếp cận

- kiến trúc

- LÀ

- AS

- xin

- Tài sản

- Trợ lý

- hỗ trợ

- các loại

- At

- tăng

- tăng cường

- tác giả

- có sẵn

- nhận thức

- AWS

- trở lại

- lý lịch

- dựa

- cơ bản

- BE

- bờ biển

- đã trở thành

- bởi vì

- được

- trước

- Bắt đầu

- hành vi

- được

- tin

- mang lại lợi ích

- BEST

- thực hành tốt nhất

- Hơn

- giữa

- tỷ

- Chặn

- Khối

- bảng

- ban giám đốc

- cuốn sách

- Bot

- cả hai

- bề rộng

- Nghỉ giải lao

- rộng

- xây dựng

- Xây dựng

- xây dựng

- xây dựng

- kinh doanh

- nhưng

- by

- cuộc gọi

- đến

- CAN

- Có thể có được

- khả năng

- khả năng

- vốn

- Thị trường vốn

- mà

- trường hợp

- trường hợp

- chuỗi

- chuỗi

- thách thức

- thách thức

- thách thức xây dựng

- thay đổi

- Changer

- thay đổi

- đặc điểm

- chatbot

- chatbot

- sự lựa chọn

- Chọn

- lựa chọn

- rõ ràng

- giống cá lăng

- trong sáng

- gần gũi hơn

- đám mây

- mã

- Lập trình

- Cột

- kết hợp

- kết hợp

- Đến

- Bình luận

- thương mại

- giao tiếp

- Giao tiếp

- cộng đồng

- Các công ty

- công ty

- so sánh

- hoàn thành

- phức tạp

- phức tạp

- tuân thủ

- các thành phần

- hiểu

- Tính

- máy tính

- Tầm nhìn máy tính

- máy tính

- khái niệm

- kết luận

- kết luận

- phần kết luận

- thực hiện

- hội nghị

- Kết nối

- Kết nối

- liên quan

- Hãy xem xét

- xem xét

- xem xét

- nhất quán

- Bao gồm

- bao gồm

- xây dựng

- tư vấn

- nội dung

- bối cảnh

- theo ngữ cảnh

- tiếp tục

- liên tục

- đóng góp

- thông thường

- đàm thoại

- chuyển đổi

- chuyển đổi

- điều phối

- Trung tâm

- sửa chữa

- Phí Tổn

- có thể

- tạo

- quan trọng

- CRM

- quan trọng

- khách hàng

- khách hàng

- tiền thưởng

- dữ liệu

- Hồ dữ liệu

- điểm dữ liệu

- dữ liệu riêng tư

- Bảo mật và bảo mật dữ liệu

- khoa học dữ liệu

- hướng dữ liệu

- Cơ sở dữ liệu

- bộ dữ liệu

- Ngày

- thập kỷ

- thập kỷ

- quyết định

- Quyết định

- dành riêng

- coi

- xác định

- Nhu cầu

- chứng minh

- chứng minh

- phụ thuộc

- triển khai

- triển khai

- mô tả

- miêu tả

- mong muốn

- chi tiết

- chi tiết

- xác định

- Nhà phát triển

- phát triển

- Phát triển

- khác nhau

- trực tiếp

- trực tiếp

- Giám đốc

- thảo luận

- thảo luận

- bổ nhào

- khác nhau

- do

- miền

- lĩnh vực

- dont

- kiểm tra hai lần

- xuống

- lái xe

- hai

- suốt trong

- năng động

- mỗi

- Sớm hơn

- dễ dàng

- hệ sinh thái

- Đào tạo

- Hiệu quả

- hiệu quả

- hiệu quả

- hiệu quả

- nỗ lực

- những nỗ lực

- hay

- các yếu tố

- đủ điều kiện

- loại bỏ

- mới nổi

- việc làm

- cho phép

- cuối

- Cuối cùng đến cuối

- kết thúc

- thuê

- Tham gia

- Kỹ Sư

- đủ

- đảm bảo

- đã trang bị

- Tương đương

- ESG

- đặc biệt

- thành lập

- đánh giá

- đánh giá

- Ngay cả

- sự kiện

- Mỗi

- ví dụ

- ví dụ

- hiện tại

- mong đợi

- dự kiến

- đắt tiền

- kinh nghiệm

- thử nghiệm

- thí nghiệm

- chuyên gia

- chuyên môn

- Khám phá

- thể hiện

- bày tỏ

- mở rộng

- ngoài

- trích xuất

- khai thác

- phải đối mặt

- tạo điều kiện

- các yếu tố

- nhịp độ nhanh

- thuận tiện

- khả thi

- vài

- lĩnh vực

- Lĩnh vực

- điền

- lọc

- cuối cùng

- Cuối cùng

- tài chính

- dữ liệu tài chính

- Tên

- Linh hoạt

- dòng chảy

- Tập trung

- theo

- tiếp theo

- Trong

- định dạng

- Forward

- bồi dưỡng

- tìm thấy

- Nền tảng

- FRAME

- Khung

- khung

- Miễn phí

- từ

- Full

- Đầy đủ ngăn xếp

- đầy đủ

- chức năng

- chức năng

- xa hơn

- trò chơi

- thay đổi cuộc chơi

- GDPR

- Tuân thủ GDPR

- bánh răng

- Tổng Quát

- tạo ra

- tạo ra

- tạo

- tạo ra

- thế hệ

- thế hệ

- Trí tuệ nhân tạo

- được

- nhận được

- Cho

- được

- cho

- Cho

- Go

- mục tiêu

- Các mục tiêu

- tốt

- cấp

- tuyệt vời

- Nhóm

- Phát triển

- có

- tay

- vui mừng

- Có

- có

- he

- có trụ sở chính

- nặng

- nâng nặng

- giúp đỡ

- giúp

- cô

- tại đây

- Cao

- hiệu suất cao

- chất lượng cao

- cao hơn

- cao nhất

- Nhấn mạnh

- nổi bật

- cao

- gợi ý

- của mình

- lịch sử

- mui xe

- Độ đáng tin của

- Tuy nhiên

- HTTPS

- Nhân loại

- người có thể đọc được

- i

- ý tưởng

- xác định

- xác định

- if

- hình ảnh

- Va chạm

- tác động

- tác động

- Tác động

- thực hiện

- thực hiện

- triển khai

- thực hiện

- hàm ý

- quan trọng

- nâng cao

- in

- Mặt khác

- Inc.

- bao gồm

- Bao gồm

- Tăng lên

- gia tăng

- độc lập

- các cá nhân

- ngành công nghiệp

- thông tin

- Cơ sở hạ tầng

- ban đầu

- ban đầu

- đổi mới

- sự đổi mới

- đầu vào

- đầu vào

- ngay lập tức

- tổ chức

- hướng dẫn

- tích hợp

- hội nhập

- ý định

- tương tác

- tương tác

- nội bộ

- đan xen

- trong

- trực quan

- đầu tư

- nhà đầu tư

- Các nhà đầu tư

- tham gia

- tổ chức phát hành

- isv

- IT

- ITS

- cuộc hành trình

- jpg

- chỉ

- Giữ

- Key

- Biết

- kiến thức

- nổi tiếng

- Phòng thí nghiệm

- hồ

- cảnh quan

- Ngôn ngữ

- lớn

- lớn hơn

- Họ

- cuối cùng

- Độ trễ

- một lát sau

- lớp

- dẫn

- hàng đầu

- Dẫn

- học

- học tập

- ít nhất

- Led

- Bài học

- Bài học kinh nghiệm

- Cấp

- nâng

- Lượt thích

- Lượt thích

- LLM

- logic

- London

- dài

- Xem

- tìm kiếm

- Rất nhiều

- máy

- học máy

- thực hiện

- Chủ yếu

- phần lớn

- Mainstream

- duy trì

- Duy trì

- làm cho

- LÀM CHO

- quản lý

- quản lý

- quản lý

- sản xuất

- nhiều

- thị trường

- Phân tích thị trường

- Dữ liệu thị trường

- thị trường

- phù hợp

- toán học

- Có thể..

- có ý nghĩa

- có nghĩa là

- cơ chế

- Gặp gỡ

- hội viên

- hoàn tất

- Siêu dữ liệu

- Siêu dữ liệu

- phương pháp

- Phương pháp luận

- microservices

- tối thiểu

- giảm thiểu

- pha

- ML

- kiểu mẫu

- mô hình

- hiện đại

- Modules

- chi tiết

- hầu hết

- chủ yếu

- di chuyển

- nhiều

- đa

- nhiều

- tên

- tự nhiên

- Tự nhiên

- Xử lý ngôn ngữ tự nhiên

- Thiên nhiên

- cần thiết

- Cần

- cần thiết

- tiêu cực

- mạng lưới

- Mới

- Newyork

- tiếp theo

- Không

- ghi

- Lưu ý

- tại

- con số

- số

- Mục tiêu

- Rõ ràng

- of

- off

- cung cấp

- Cung cấp

- cán bộ

- văn phòng

- thường

- on

- ONE

- có thể

- mở

- mã nguồn mở

- tối ưu

- tối ưu hóa

- Tối ưu hóa

- tối ưu hóa

- tối ưu hóa

- Các lựa chọn

- or

- điều phối

- dàn nhạc

- gọi món

- nguyên

- Nền tảng khác

- vfoXNUMXfipXNUMXhfpiXNUMXufhpiXNUMXuf

- đầu ra

- kết thúc

- tổng thể

- tổng quan

- áp đảo

- riêng

- sở hữu

- quyền sở hữu

- thông số

- một phần

- riêng

- thông qua

- niềm đam mê

- bằng sáng chế

- Bằng sáng chế

- con đường

- Thực hiện

- hiệu suất

- biểu diễn

- chọn

- miếng

- nền tảng

- plato

- Thông tin dữ liệu Plato

- PlatoDữ liệu

- Play

- Điểm

- điểm

- tích cực

- có thể

- Bài đăng

- tiềm năng

- quyền lực

- quyền hạn

- thực hành

- ưa thích

- trình bày

- trình bày

- ngăn chặn

- giá

- nguyên tắc

- riêng tư

- Bảo mật và An ninh

- quá trình

- xử lý

- sản xuất

- Sản xuất

- Sản phẩm

- chuyên nghiệp

- thâm thúy

- dự án

- dự án

- nhắc nhở

- bằng chứng

- bằng chứng về khái niệm

- đúng

- độc quyền

- chứng minh

- cho

- cung cấp

- cung cấp

- cung cấp

- công khai

- Công ty đại chúng

- công khai

- mục đích

- đặt

- Q & A

- chất lượng

- truy vấn

- câu hỏi

- Mau

- dấu ngoặc kép

- Xếp hạng

- hơn

- RE

- sẵn sàng

- thế giới thực

- nhận ra

- nhận

- đề nghị

- hồ sơ

- tham khảo

- quy định

- quan hệ

- mối quan hệ

- có liên quan

- Báo cáo

- đại diện

- đại diện

- đại diện cho

- yêu cầu

- cần phải

- Yêu cầu

- tài nguyên

- tôn trọng

- tôn trọng

- phản ứng

- phản ứng

- hạn chế

- Kết quả

- doanh thu

- trở lại

- xem xét

- ngay

- rủi ro

- Vai trò

- vai trò

- Phòng

- tròn

- quy tắc

- chạy

- chạy

- tương tự

- hài lòng

- hài lòng với

- Lưu

- nói

- khả năng mở rộng

- Quy mô

- Khoa học

- xước

- liền mạch

- liền mạch

- Tìm kiếm

- Thứ hai

- giây

- Phần

- an toàn

- an ninh

- xem

- lựa chọn

- Người bán

- gửi

- cao cấp

- ý nghĩa

- riêng biệt

- Loạt Sách

- Không có máy chủ

- dịch vụ

- DỊCH VỤ

- định

- bộ

- một số

- định hình

- cổ đông

- cổ đông

- chị ấy

- nên

- cho thấy

- thể hiện

- Chương trình

- có ý nghĩa

- Đơn giản

- đơn giản

- đơn giản hóa

- đơn giản hóa

- đơn giản hóa

- duy nhất

- Kích thước máy

- kích thước

- nhỏ hơn

- thông minh

- thông minh hơn

- Phần mềm

- phát triển phần mềm

- giải pháp

- Giải pháp

- một số

- tinh vi

- nguồn

- nguồn

- Vôn

- nhịp

- Nói

- chuyên gia

- chuyên

- riêng

- đặc biệt

- Tính ổn định

- ngăn xếp

- Traineeship

- cổ phần

- đứng

- đứng

- Bắt đầu

- bắt đầu

- Bắt đầu

- Tuyên bố

- ở lại

- Bước

- Các bước

- cổ phần

- thị trường chứng khoán

- lưu trữ

- cửa hàng

- đơn giản

- Chiến lược

- cấu trúc

- cấu trúc

- Sau đó

- thành công

- Thành công

- như vậy

- đủ

- phù hợp

- bộ

- tóm tắt

- TÓM TẮT

- hỗ trợ

- Hỗ trợ

- giám sát

- Công tắc điện

- cú pháp

- hệ thống

- bàn

- phù hợp

- Hãy

- Lấy

- mất

- dùng

- Nhiệm vụ

- nhiệm vụ

- nhóm

- công nghệ cao

- Kỹ thuật

- kỹ thuật

- Công nghệ

- viễn thông

- nói

- mẫu

- thử nghiệm

- Kiểm tra

- kiểm tra

- văn bản

- hơn

- Cảm ơn

- việc này

- Sản phẩm

- Thủ đô

- cung cấp their dịch

- sau đó

- Đó

- Kia là

- họ

- Suy nghĩ

- điều này

- số ba

- Thông qua

- khắp

- thời gian

- Chuỗi thời gian

- thời gian

- titan

- đến

- hôm nay

- bên nhau

- mã thông báo

- Tokens

- quá

- công cụ

- công cụ

- chủ đề

- toronto

- đối với

- Train

- đào tạo

- Hội thảo

- giao dịch

- Giao dịch

- biến đổi

- chuyến đi

- đúng

- NIỀM TIN

- XOAY

- hai

- kiểu

- loại

- thường

- không thể

- Dưới

- cơ bản

- hiểu

- sự hiểu biết

- hiểu

- hiểu

- độc đáo

- mở khóa

- không cần thiết

- us

- sử dụng

- ca sử dụng

- đã sử dụng

- người sử dang

- sử dụng

- sử dụng

- sử dụng

- hợp lệ

- xác nhận

- giá trị

- nhiều

- khác nhau

- nhà cung cấp

- Xác minh

- xác minh

- xác minh

- rất

- khả thi

- Xem

- ảo

- tầm nhìn

- đi bộ

- muốn

- là

- Đường..

- we

- web

- các dịch vụ web

- Hội thảo

- Website

- TỐT

- đi

- là

- hướng Tây

- Điều gì

- Wheel

- khi nào

- trong khi

- cái nào

- trong khi

- sẽ

- với

- ở trong

- không có

- Dành cho Nữ

- từ

- Công việc

- làm việc

- quy trình làm việc

- đang làm việc

- giá trị

- sẽ

- viết

- viết mã

- XML

- nhưng

- york

- Bạn

- trên màn hình

- youtube

- zephyrnet