人工智能 (AI) 是一个快速发展的领域,有潜力改善和改变社会的许多方面。 2023 年,随着强大的基础模型 (FM) 的开发以及生成式人工智能能力的进步,人工智能技术的采用步伐将进一步加快。

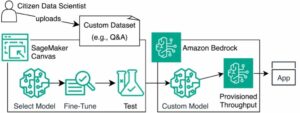

在亚马逊,我们推出了多项生成式人工智能服务,例如 亚马逊基岩 和 亚马逊 CodeWhisperer,并通过以下方式提供了一系列高性能的生成模型 亚马逊SageMaker JumpStart。 这些服务旨在支持我们的客户释放生成式人工智能的新兴功能,包括增强创造力、个性化和动态内容创建以及创新设计。 它们还可以让人工智能从业者以前所未有的方式理解世界——解决语言障碍、气候变化、加速科学发现等等。

然而,为了充分发挥生成式人工智能的潜力,仔细反思任何潜在风险非常重要。 首先,这通过促进负责任和安全的开发和部署,并鼓励采取积极措施来解决潜在影响,使人工智能系统的利益相关者受益。 因此,建立评估和管理风险的机制是人工智能从业者需要考虑的重要过程,并已成为许多新兴人工智能行业标准的核心组成部分(例如, ISO 42001 , ISO 23894 及 NIST RMF)和立法(例如 欧盟人工智能法案).

在这篇文章中,我们讨论如何评估人工智能系统的潜在风险。

不同级别的风险是什么?

虽然开始单独查看单个机器学习 (ML) 模型和相关风险可能更容易,但重要的是要考虑此类模型的特定应用的细节以及作为完整 AI 系统一部分的相应用例。 事实上,典型的人工智能系统可能基于多个不同的机器学习模型一起工作,并且组织可能希望构建多个不同的人工智能系统。 因此,可以针对每个用例和不同级别评估风险,即模型风险、人工智能系统风险和企业风险。

企业风险涵盖组织可能面临的广泛风险,包括财务、运营和战略风险。 人工智能系统风险侧重于与人工智能系统的实施和操作相关的影响,而机器学习模型风险具体涉及机器学习模型固有的漏洞和不确定性。

在这篇文章中,我们主要关注人工智能系统风险。 然而,值得注意的是,组织内所有不同级别的风险管理都应该得到考虑和协调。

AI系统风险如何定义?

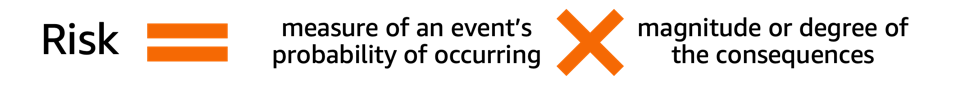

人工智能系统背景下的风险管理可以成为最大限度地减少不确定性或潜在负面影响的途径,同时也提供了最大化积极影响的机会。 风险本身并不是潜在的危害,而是不确定性对目标的影响。 根据 NIST 风险管理框架 (NIST RMF),风险可以被估计为事件发生概率的乘法测量,该概率与相应事件的后果的大小有关。

风险有两个方面:固有风险和剩余风险。 固有风险代表人工智能系统在缺乏缓解或控制的情况下表现出的风险量。 剩余风险捕获了考虑缓解策略后的剩余风险。

始终记住,风险评估是一项以人为本的活动,需要整个组织的努力; 这些努力的范围包括确保所有相关利益相关者都参与评估过程(例如产品、工程、科学、销售和安全团队),以及评估社会观点和规范如何影响某些事件的感知可能性和后果。

为什么您的组织应该关心风险评估?

建立人工智能系统的风险管理框架可以通过促进人工智能系统的安全和负责任的设计、开发和运行来造福整个社会。 风险管理框架还可以通过以下方式使组织受益:

- 改进的决策 – 通过了解与人工智能系统相关的风险,组织可以就如何减轻这些风险并以安全和负责任的方式使用人工智能系统做出更好的决策

- 增加合规规划 – 风险评估框架可以帮助组织为相关法律法规中的风险评估要求做好准备

- 建立信任 – 通过证明他们正在采取措施降低人工智能系统的风险,组织可以向客户和利益相关者表明他们致力于以安全和负责任的方式使用人工智能

如何评估风险?

作为第一步,组织应考虑描述需要评估的人工智能用例并确定所有相关利益相关者。 用例是描述用户如何与人工智能系统交互以实现特定目标的特定场景或情况。 创建用例描述时,指定要解决的业务问题、列出所涉及的利益相关者、描述工作流程并提供有关系统关键输入和输出的详细信息会很有帮助。

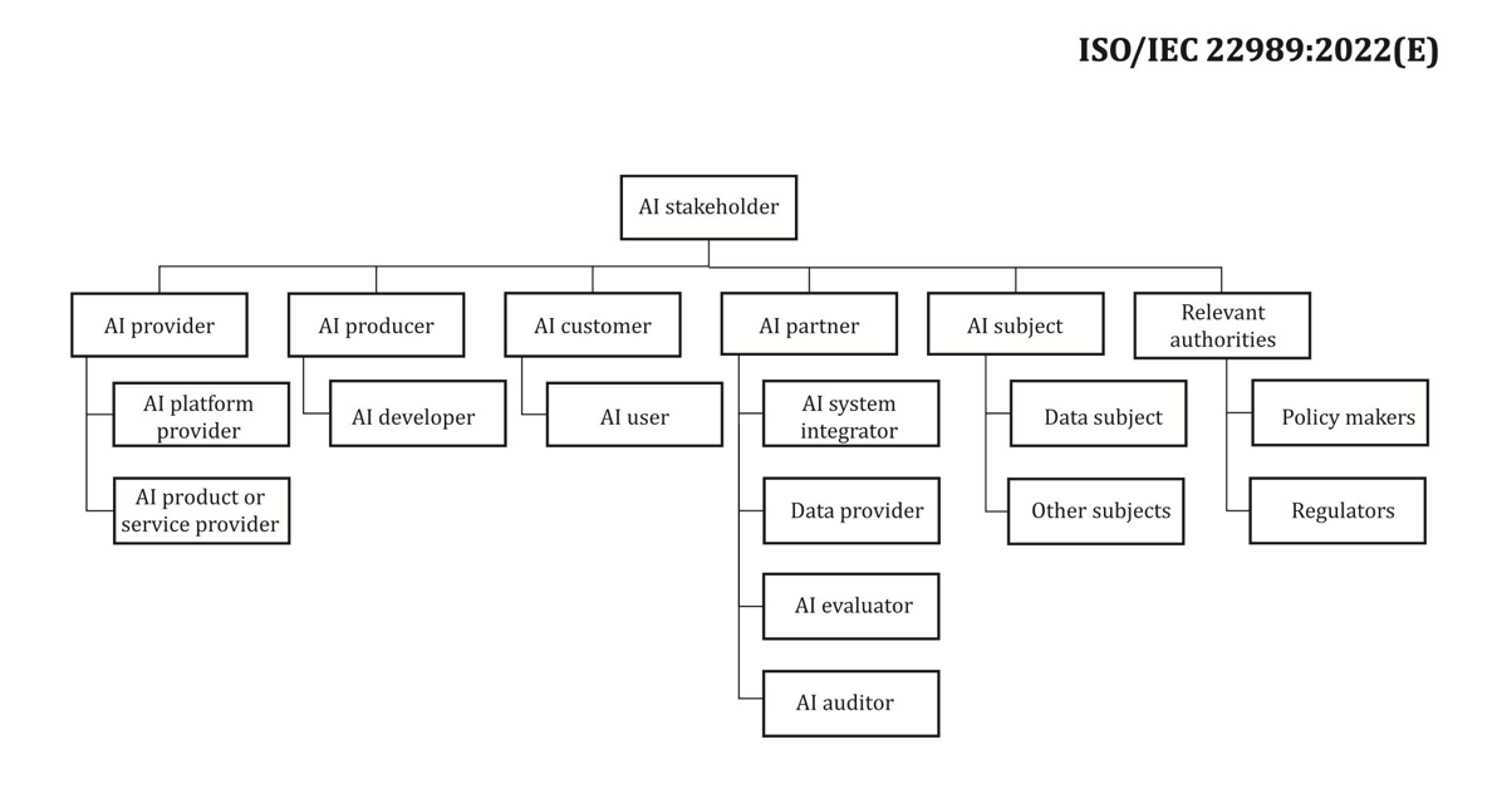

当谈到利益相关者时,很容易忽视一些利益相关者。 下图是规划人工智能利益相关者角色的一个很好的起点。

资料来源:《信息技术-人工智能-人工智能概念和术语》。

人工智能系统风险评估的重要下一步是识别与用例相关的潜在有害事件。 在考虑这些事件时,反思负责任的人工智能的不同维度(例如公平性和鲁棒性)可能会有所帮助。 不同的利益相关者在不同的维度上可能会受到不同程度的影响。 例如,最终用户的低鲁棒性风险可能是由于人工智能系统表现出轻微的干扰而导致的,而低公平性风险可能是由于人工智能系统为不同人口群体产生的输出可以忽略不计而导致的。

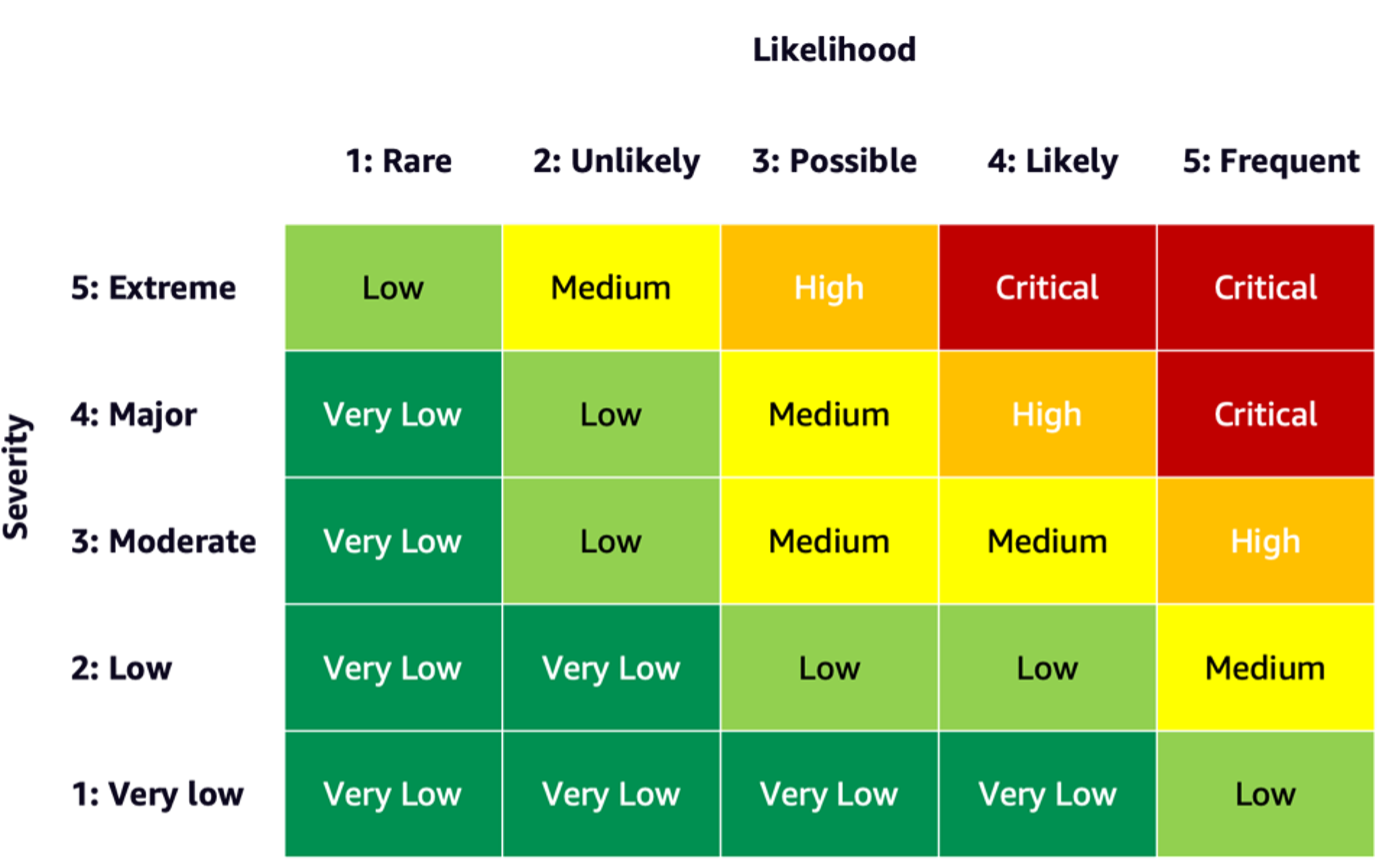

要估计事件的风险,您可以结合使用似然量表和严重程度量表来衡量发生的概率以及后果的程度。 制定这些量表时一个有用的起点可能是 NIST RMF,它建议使用从极低到极高风险的定性非数字类别或半定量评估原则,例如量表(例如 1-10)、分档或其他代表数。 定义所有相关维度的可能性和严重性等级后,您可以使用风险矩阵方案来量化每个相关维度上每个利益相关者的总体风险。 下图显示了风险矩阵示例。

使用此风险矩阵,我们可以将严重程度低且发生可能性极低的事件视为风险极低。 请记住,初始评估将是对固有风险的估计,风险缓解策略可以帮助进一步降低风险水平。 然后可以重复该过程以生成每个事件的任何剩余残余风险的评级。 如果沿着同一维度识别出多个事件,则在所有事件中选择最高风险级别以创建最终评估摘要可能会有所帮助。

使用最终的评估摘要,组织必须定义其人工智能系统可接受的风险级别,并考虑相关法规和政策。

AWS 承诺

通过与 白宫 和 UN等等,我们致力于分享我们的知识和专业知识,以促进人工智能的负责任和安全的使用。 沿着这些思路,亚马逊的 Adam Selipsky 最近代表 AWS 参加了 人工智能安全峰会 各国元首和行业领袖出席,进一步表明我们致力于合作负责任地推进人工智能的发展。

结论

随着人工智能的不断发展,风险评估对于寻求负责任地构建和部署人工智能的组织来说变得越来越重要和有用。 通过建立风险评估框架和风险缓解计划,组织可以降低潜在的人工智能相关事件的风险,赢得客户的信任,并获得诸如提高可靠性、提高不同人群的公平性等好处。

继续开始在您的组织中开发风险评估框架的旅程,并在评论中分享您的想法。

另请查看 Amazon Science 上发布的生成式 AI 风险概述: 生成时代的负责任的人工智能,并探索可以为您的风险评估和缓解之旅提供支持的 AWS 服务范围: 亚马逊SageMaker澄清, Amazon SageMaker模型监控器, AWS 云跟踪,以及 模型治理框架.

作者简介

米娅·C·梅耶尔 是 AWS 机器学习大学的应用科学家和机器学习教育者; 她研究并教授机器学习和人工智能系统的安全性、可解释性和公平性。 在她的职业生涯中,米娅建立了多个大学外展项目,担任客座讲师和主讲人,并在许多大型学习会议上发表演讲。 她还帮助内部团队和 AWS 客户开始负责任的 AI 之旅。

米娅·C·梅耶尔 是 AWS 机器学习大学的应用科学家和机器学习教育者; 她研究并教授机器学习和人工智能系统的安全性、可解释性和公平性。 在她的职业生涯中,米娅建立了多个大学外展项目,担任客座讲师和主讲人,并在许多大型学习会议上发表演讲。 她还帮助内部团队和 AWS 客户开始负责任的 AI 之旅。

丹尼斯诉巴塔洛夫 作为在亚马逊工作 17 年的资深人士和机器学习博士,Denis 参与了诸如书内搜索、亚马逊移动应用程序和 Kindle Direct Publishing 等激动人心的项目。 自 2013 年以来,他作为解决方案架构师帮助 AWS 客户采用 AI/ML 技术。 目前,Denis 是 AI/ML 的全球技术负责人,负责 AWS ML 专家解决方案架构师在全球的运作。 Denis 是一位经常公开演讲的人,您可以在 Twitter @dbatalov 上关注他。

丹尼斯诉巴塔洛夫 作为在亚马逊工作 17 年的资深人士和机器学习博士,Denis 参与了诸如书内搜索、亚马逊移动应用程序和 Kindle Direct Publishing 等激动人心的项目。 自 2013 年以来,他作为解决方案架构师帮助 AWS 客户采用 AI/ML 技术。 目前,Denis 是 AI/ML 的全球技术负责人,负责 AWS ML 专家解决方案架构师在全球的运作。 Denis 是一位经常公开演讲的人,您可以在 Twitter @dbatalov 上关注他。

刘莎拉博士 是 AWS Responsible AI 团队的高级技术项目经理。 她与由科学家、数据集负责人、机器学习工程师、研究人员以及其他跨职能团队组成的团队合作,提高 AWS AI 服务中负责任的 AI 标准。 她目前的项目包括开发人工智能服务卡、对负责任的人工智能进行风险评估、创建高质量的评估数据集以及实施质量计划。 她还帮助内部团队和客户满足不断发展的人工智能行业标准。

刘莎拉博士 是 AWS Responsible AI 团队的高级技术项目经理。 她与由科学家、数据集负责人、机器学习工程师、研究人员以及其他跨职能团队组成的团队合作,提高 AWS AI 服务中负责任的 AI 标准。 她目前的项目包括开发人工智能服务卡、对负责任的人工智能进行风险评估、创建高质量的评估数据集以及实施质量计划。 她还帮助内部团队和客户满足不断发展的人工智能行业标准。

- :具有

- :是

- :不是

- :在哪里

- 100

- 118

- 150

- 2013

- 2023

- 33

- 7

- a

- 关于

- 加速

- 加速

- 可接受

- 根据

- 横过

- 活动

- Adam

- 地址

- 采用

- 采用

- 推进

- 进步

- 影响

- 后

- 向前

- AI

- 人工智能风险

- 人工智能服务

- 人工智能系统

- AI / ML

- 对齐的

- 所有类型

- 沿

- 还

- Amazon

- 亚马逊网络服务

- 其中

- 量

- an

- 和

- 任何

- 应用领域

- 应用的

- 应用

- 建筑师

- 保健

- 人造的

- 人工智能

- AS

- 方面

- 评估

- 评估

- 评估

- 评定

- 评估

- 相关

- At

- 勤

- 可使用

- AWS

- AWS机器学习

- 酒吧

- 障碍

- 基于

- BE

- 成为

- 成为

- 作为

- 得益

- 好处

- 更好

- 垃圾箱

- 书

- 广阔

- 建立

- 商业

- 但是

- by

- CAN

- 能力

- 能力

- 捕获

- 牌

- 关心

- 寻找工作

- 小心

- 案件

- 类别

- 造成

- 一定

- 更改

- 特点

- 查

- 气候

- 气候变化

- 合作

- 组合

- 购买的订单均

- 注释

- 提交

- 完成

- 符合

- 元件

- 概念

- 开展

- 会议

- 后果

- 所以

- 考虑

- 考虑

- 考虑

- 内容

- 内容创造

- 上下文

- 继续

- 控制

- 核心

- 相应

- 可以

- 创建信息图

- 创造

- 创建

- 创造力

- 跨职能团队

- 电流

- 目前

- 合作伙伴

- 数据集

- 决定

- 贡献

- 定义

- 定义

- 学位

- 人口统计学

- 人口统计

- 示范

- 部署

- 部署

- 描述

- 描述

- 设计

- 设计

- 详情

- 发展

- 研发支持

- 不同

- 尺寸

- 尺寸

- 直接

- 讨论

- 中断

- 动态

- 每

- 赚

- 更容易

- 易

- 效果

- 工作的影响。

- 新兴经济体的新市场。

- enable

- 包含

- 鼓励

- 订婚

- 工程师

- 工程师

- 增强

- 保证

- 企业

- 成熟

- 建立

- 评估

- 估计

- 评估

- 评估

- 活动

- 事件

- 演变

- 例子

- 令人兴奋的

- 展览中

- 展品

- 专门知识

- 探索

- 面部彩妆

- 事实

- 保理

- 公平

- 部分

- 数字

- 最后

- 金融

- (名字)

- 专注焦点

- 重点

- 遵循

- 以下

- 针对

- 最重要的

- 基金会

- 骨架

- 框架

- 频繁

- 止

- ,

- 运作

- 进一步

- 生成

- 生成的

- 生成式人工智能

- 得到

- 在全球范围内

- 目标

- 非常好

- 治理

- 组的

- 客人

- 伤害

- 有害

- 有

- he

- 元首

- 帮助

- 帮助

- 有帮助

- 帮助

- 这里

- 高

- 高品质

- 最高

- 高度

- 他

- 创新中心

- How To

- 但是

- HTML

- HTTPS

- 确定

- 鉴定

- if

- 影响力故事

- 影响

- 履行

- 实施

- 重要

- 改善

- 改善

- in

- 包括

- 包含

- 日益

- 个人

- 行业中的应用:

- 行业标准

- 影响

- 固有

- 初始

- 创新

- 输入

- 内

- 房源搜索

- 相互作用

- 内部

- 涉及

- 参与

- ISO

- 隔离

- IT

- 本身

- 旅程

- JPG

- 保持

- 键

- 主题演讲

- 主讲人

- 知识

- 语言

- 大

- 推出

- 法律

- 领导者

- 领导人

- 信息

- 学习用品

- 学习

- 立法

- Level

- 各级

- 可能性

- 容易

- 线

- 清单

- 寻找

- 低

- 降低

- 机

- 机器学习

- 制成

- 使

- 管理

- 颠覆性技术

- 经理

- 许多

- 地图

- 矩阵

- 生产力

- 可能..

- 衡量

- 措施

- 机制

- 满足

- 可能

- 介意

- 未成年人

- 减轻

- 减轻

- ML

- 联络号码

- 移动应用

- 模型

- 模型

- 更多

- 多

- 亦即

- 需要

- 负

- 决不要

- 下页

- NIST

- 规范

- 注意

- 数字

- 众多

- 目标

- 发生

- 发生

- of

- on

- 操作

- 操作

- 机会

- or

- 组织

- 组织

- 其他名称

- 其它

- 除此以外

- 我们的

- 输出

- 输出

- 推广

- 最划算

- 简介

- 步伐

- 部分

- 特别

- 径

- 为

- 感知

- 个性化你的

- 观点

- 博士学位

- 挑

- 计划

- 柏拉图

- 柏拉图数据智能

- 柏拉图数据

- 点

- 政策

- 积极

- 帖子

- 潜力

- 可能

- 强大

- Prepare

- 呈现

- 主要

- 原则

- 主动

- 市场问题

- 过程

- 生产

- 产品

- 曲目

- 训练课程

- 项目

- 促进

- 提供

- 优

- 国家

- 出版

- 出版

- 定性

- 质量

- 提高

- 范围

- 范围

- 急速

- 罕见

- 等级

- 实现

- 收割

- 最近

- 减少

- 反映

- 关于

- 法规

- 相应

- 可靠性

- 其余

- 重复

- 代表

- 代表

- 代表

- 岗位要求

- 需要

- 研究人员

- 研究

- 提供品牌战略规划

- 负责任

- 导致

- 导致

- 风险

- 风险评估

- 变更管理

- 风险

- 稳健性

- 角色

- 安全

- 实现安全

- sagemaker

- 销售

- 同

- 鳞片

- 秤

- 脚本

- 方案

- 科学

- .

- 科学家

- 科学家

- 搜索

- 安全

- 保安

- 前辈

- 感

- 服务

- 特色服务

- 几个

- Share

- 共享

- 她

- 应该

- 显示

- 作品

- 自

- 情况

- 社会

- 社会

- 解决方案

- 一些

- 喇叭

- 专家

- 具体的

- 特别是

- 光谱

- 利益相关者

- 利益相关者

- 标准

- 开始

- 开始

- 开始

- 州/领地

- 步

- 步骤

- 善用

- 策略

- 这样

- 提示

- 概要

- SUPPORT

- 系统

- 产品

- 服用

- 团队

- 队

- 科技

- 文案

- 技术

- 专业技术

- 这

- 世界

- 其

- 然后

- 那里。

- 博曼

- 他们

- Free Introduction

- 那些

- 通过

- 始终

- 时控

- 至

- 一起

- 改造

- 信任

- 二

- 普遍

- 不确定性

- 不确定

- 理解

- 大学

- 解锁

- 使用

- 用例

- 用户

- 运用

- 非常

- 老将

- 漏洞

- we

- 卷筒纸

- Web服务

- 井

- 什么是

- ,尤其是

- 而

- 这

- 而

- 将

- 中

- 工作

- 工作流程

- 加工

- 合作

- 世界

- 全世界

- 完全

- 您一站式解决方案

- 和风网