近年来,由于生成式人工智能的快速发展,尤其是指令微调和来自人类反馈的强化学习等训练技术带来的大型语言模型(LLM)的性能改进,对话式人工智能取得了长足的进步。 当提示正确时,这些模型可以进行连贯的对话,而无需任何特定于任务的训练数据。 然而,它们不能很好地概括企业特定的问题,因为为了生成答案,它们依赖于在预训练期间接触到的公共数据。 此类数据通常缺乏现代企业内部文档中包含的专业知识,而这些知识通常是在药物研究、财务调查和客户支持等领域获得准确答案所必需的。

为了创建能够基于专业企业知识进行讨论的人工智能助手,我们需要将这些强大但通用的法学硕士连接到文档的内部知识库。 这种利用从内部数据源检索的信息丰富 LLM 生成上下文的方法称为检索增强生成 (RAG),并生成特定于领域且更值得信赖的助手,如下所示 知识密集型NLP任务的检索增强生成。 RAG 受欢迎的另一个驱动因素是其易于实施以及成熟的向量搜索解决方案的存在,例如由 亚马逊肯德拉 (见 Amazon Kendra 推出检索 API) 以及 亚马逊开放搜索服务 (见 Amazon OpenSearch Service 中的 k-最近邻 (k-NN) 搜索)等等。

然而,带有语义搜索的流行 RAG 设计模式无法回答文档中可能出现的所有类型的问题。 对于需要跨多个文档进行分析推理的问题尤其如此。 例如,假设您正在规划一家投资公司明年的战略。 一个重要的步骤是分析和比较候选公司的财务业绩和潜在风险。 这项任务涉及回答分析推理问题。 例如,查询“给我过去两年收入最高的前 5 家公司并确定其主要风险”需要多个推理步骤,其中一些可以使用语义搜索检索,而另一些则需要分析能力。

在这篇文章中,我们将分三个部分展示如何设计一个能够回答分析和多步骤推理问题的智能文档助手。 在第 1 部分中,我们回顾了 RAG 设计模式及其在分析问题上的局限性。 然后我们向您介绍一种可以克服这些限制的更通用的架构。 第 2 部分帮助您更深入地了解用于准备结构化数据的实体提取管道,这是分析问答的关键要素。 第 3 部分将引导您了解如何使用 亚马逊基岩 LLM 来查询该数据并构建一个 LLM 代理,以增强 RAG 的分析功能,从而使您能够构建智能文档助理,可以跨多个文档回答复杂的特定领域问题。

第 1 部分:RAG 限制和解决方案概述

在本节中,我们回顾 RAG 设计模式并讨论其在分析问题上的局限性。 我们还提出了一种更通用的架构来克服这些限制。

RAG概述

RAG 解决方案的灵感来自 表征学习 和 语义搜索 自 2010 年以来,这些想法逐渐被应用于排名问题(例如推荐和搜索)和自然语言处理(NLP)任务。

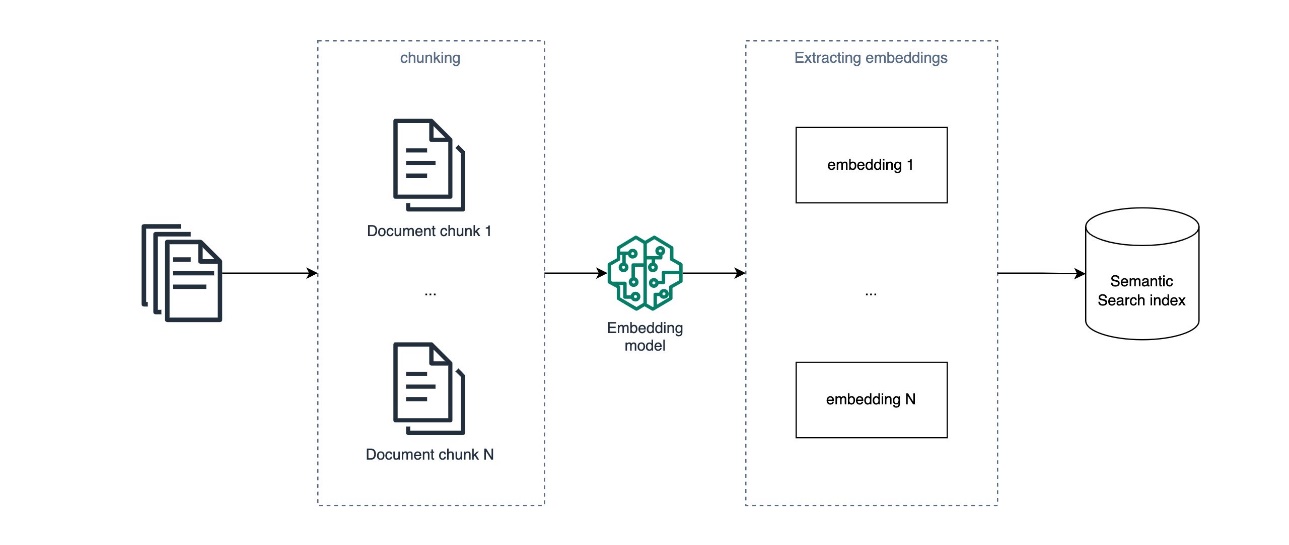

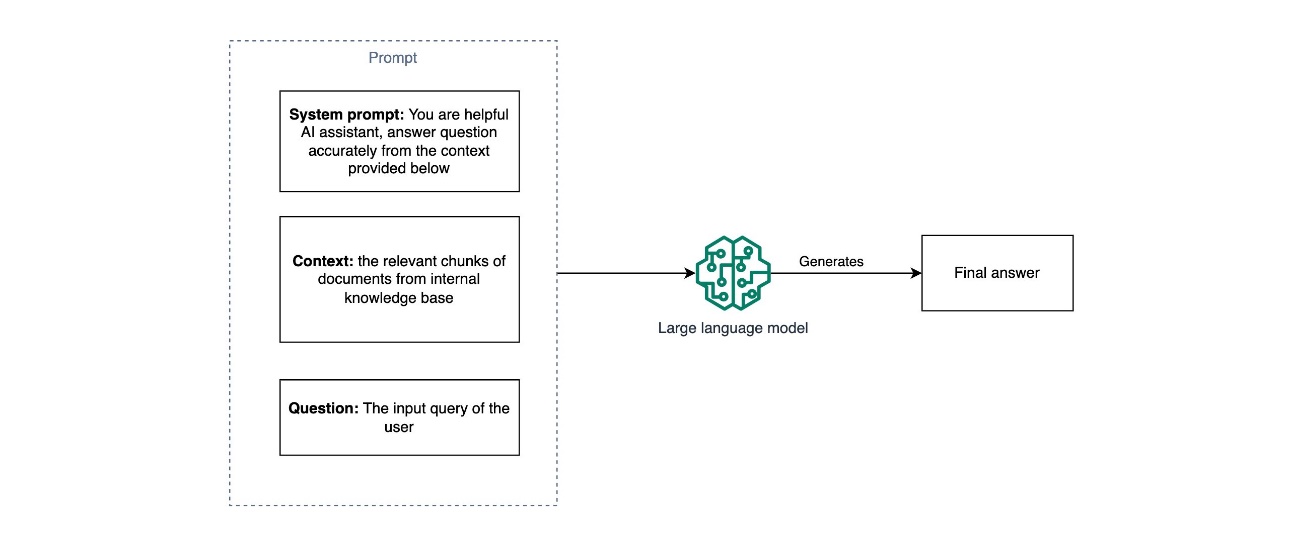

当今流行的方法由三个步骤组成:

- 离线批处理作业从输入知识库中提取文档,将它们分成块,为每个块创建一个嵌入,以使用预先训练的嵌入模型来表示其语义,例如 亚马逊泰坦 嵌入模型,然后使用这些嵌入作为输入来创建语义搜索索引。

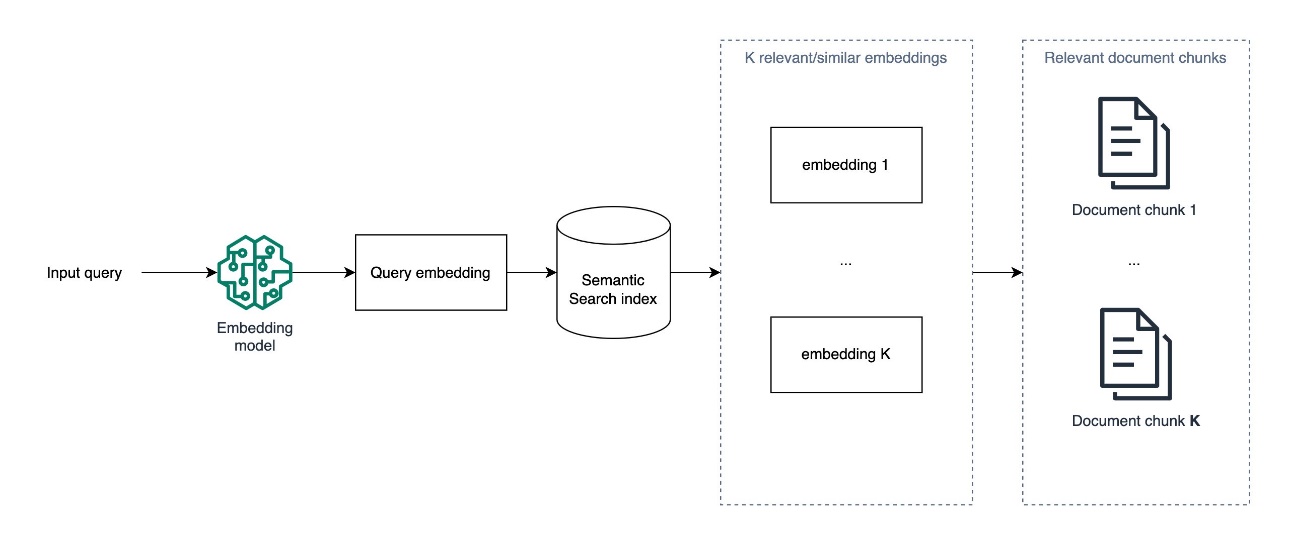

- 当实时回答新问题时,输入问题将转换为嵌入,用于使用相似性度量(例如余弦相似度)和近似最近邻算法来搜索和提取最相似的文档块。 通过元数据过滤还可以提高搜索精度。

- 提示是由系统消息与上下文(由步骤 2 中提取的相关文档块组成)以及输入问题本身的串联构成的。 然后将此提示提交给 LLM 模型,以根据上下文生成问题的最终答案。

借助正确的底层嵌入模型,能够生成输入文档块和输入问题的准确语义表示,以及高效的语义搜索模块,该解决方案能够回答需要检索文档数据库中现有信息的问题。 例如,如果您有一项服务或产品,您可以首先索引其常见问题解答部分或文档,并根据您的特定产品定制初始对话式人工智能。

基于语义搜索的RAG的局限性

尽管 RAG 是现代特定领域人工智能助手的重要组成部分,也是围绕专业知识库构建对话式人工智能的明智起点,但它无法回答需要扫描、比较和推理知识库中所有文档的问题同时,特别是当增强仅基于语义搜索时。

为了理解这些限制,让我们再次考虑根据财务报告决定投资方向的示例。 如果我们使用 RAG 与这些报告进行交互,我们可以提出诸如“X 公司在 2022 年面临哪些风险”或“Y 公司在 2022 年的净收入是多少?”之类的问题。 对于每个问题,都会使用相应的嵌入向量(对问题的语义进行编码)来检索搜索索引中可用的前 K 个语义相似的文档块。 这通常是通过采用近似最近邻解决方案来完成的,例如 FAISS、NMSLIB、pgvector 或其他,力求在检索速度和召回率之间取得平衡,以实现实时性能,同时保持令人满意的准确性。

然而,上述方法无法准确回答所有文档中的分析问题,例如“5 年净收入最高的 2022 家公司是哪家?”

这是因为语义搜索检索试图找到与输入问题最相似的 K 个文档块。 但由于没有一份文件包含全面的收入摘要,因此它将返回仅包含“净收入”和可能的“2022”提及的大量文件,而不满足关注收入最高的公司的基本条件。 如果我们将这些检索结果呈现给法学硕士作为回答输入问题的上下文,它可能会制定误导性答案或拒绝回答,因为缺少所需的正确信息。

这些限制是设计造成的,因为语义搜索不会对所有嵌入向量进行彻底扫描以查找相关文档。 相反,它使用近似最近邻方法来保持合理的检索速度。 这些方法提高效率的一个关键策略是在索引过程中将嵌入空间分割成组。 这允许在检索期间快速识别哪些组可能包含相关嵌入,而不需要成对比较。 此外,即使是像 KNN 这样扫描所有文档的传统最近邻技术,也只能计算基本的距离度量,并不适合分析推理所需的复杂比较。 因此,具有语义搜索的 RAG 不适用于回答涉及所有文档的分析推理的问题。

为了克服这些限制,我们提出了一种将 RAG 与元数据和实体提取、SQL 查询和 LLM 代理相结合的解决方案,如以下各节所述。

使用元数据、SQL 和 LLM 代理克服 RAG 限制

让我们更深入地研究 RAG 失败的问题,以便我们可以追溯有效回答该问题所需的推理。 此分析应该为我们指明可以在整体解决方案中补充 RAG 的正确方法。

考虑这个问题: “5年营收最高的前2022家公司是哪些?”

为了能够回答这个问题,我们需要:

- 确定每家公司的收入。

- 向下筛选以保留每个人 2022 年的收入。

- 按降序排列收入。

- 将收入最高的 5 名与公司名称一起切出。

通常,这些分析操作是使用 pandas 或 SQL 引擎等工具对结构化数据完成的。 如果我们可以访问包含列的 SQL 表 company, revenue及 year,我们可以通过运行 SQL 查询轻松回答我们的问题,类似于以下示例:

SELECT company, revenue FROM table_name WHERE year = 2022 ORDER BY revenue DESC LIMIT 5;将结构化元数据存储在包含相关实体信息的 SQL 表中,使您能够通过编写正确的 SQL 查询来回答多种类型的分析问题。 这就是为什么我们在我们的解决方案中通过针对 SQL 表的实时 SQL 查询模块来补充 RAG,该模块由离线过程中提取的元数据填充。

但我们如何实施这种方法并将其集成到基于法学硕士的对话式人工智能中呢?

能够添加SQL分析推理需要三个步骤:

- 元数据提取 – 将非结构化文档中的元数据提取到 SQL 表中

- 文本到 SQL – 使用 LLM 根据输入问题准确制定 SQL 查询

- 工具选择 – 确定是否必须使用 RAG 或 SQL 查询来回答问题

为了实现这些步骤,首先我们认识到从非结构化文档中提取信息是一项传统的 NLP 任务,法学硕士有望通过零样本或少样本学习实现高精度。 其次,这些模型从自然语言生成 SQL 查询的能力已被证明多年,如 2020发布 of 亚马逊 QuickSight Q。 最后,针对特定问题自动选择正确的工具可以增强用户体验,并能够通过多步骤推理回答复杂的问题。 为了实现此功能,我们将在后面的部分中深入研究 LLM 代理。

总而言之,我们提出的解决方案由以下核心组件组成:

- 语义搜索检索以增强生成上下文

- 使用 SQL 进行结构化元数据提取和查询

- 能够使用正确的工具来回答问题的代理

解决方案概述

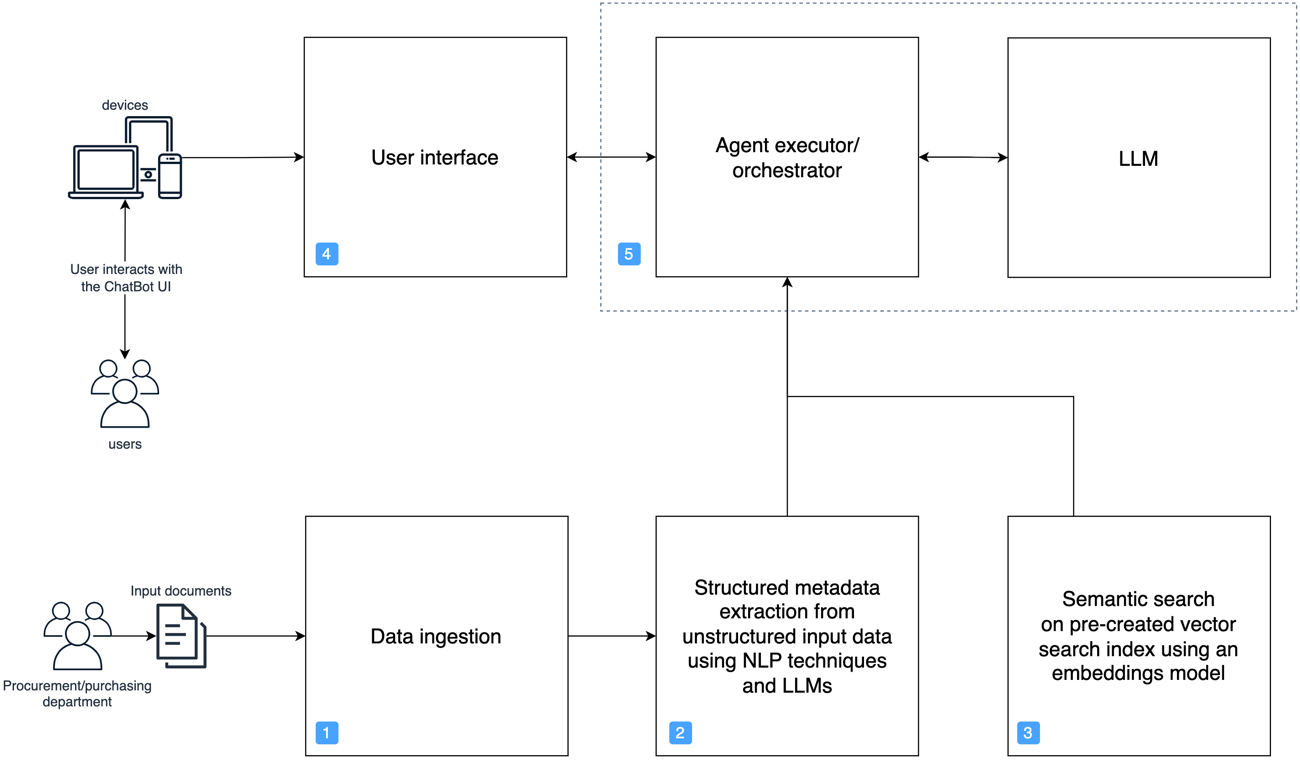

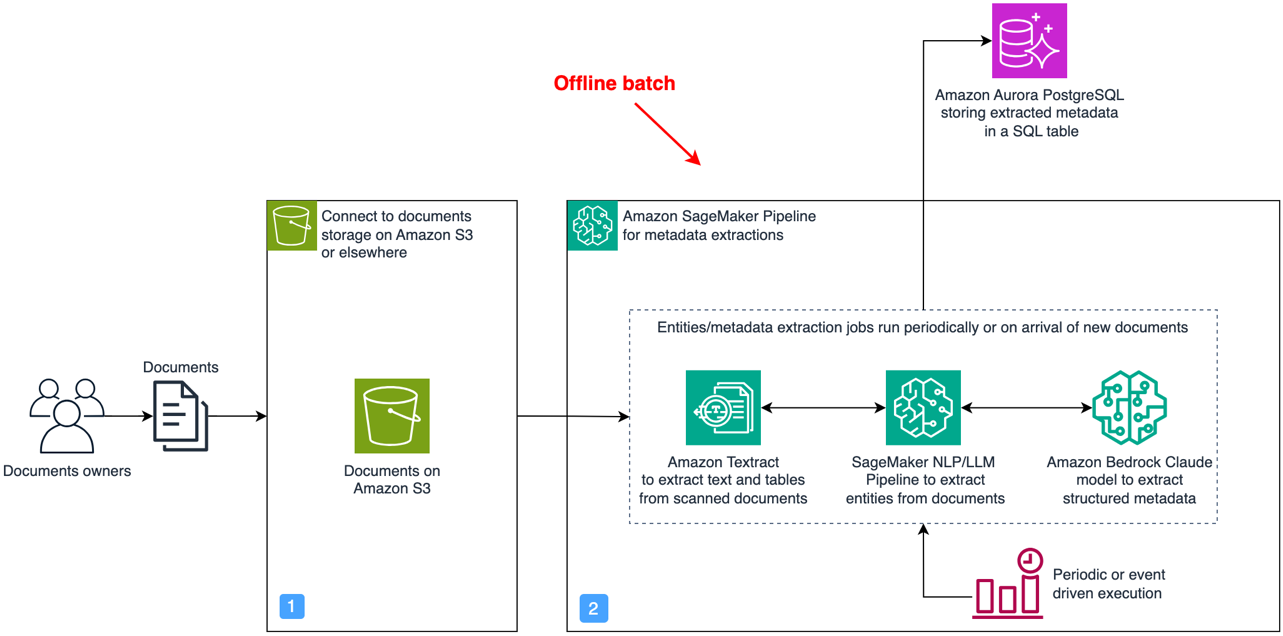

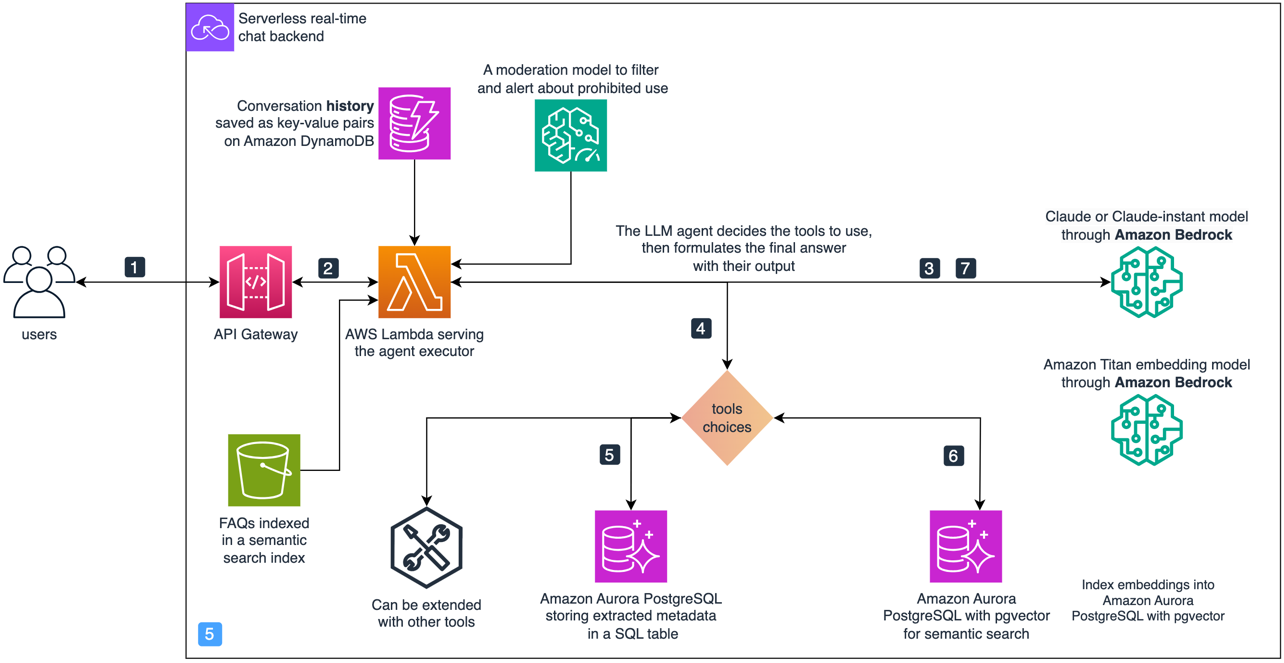

下图描述了该解决方案的简化架构。 它可以帮助您识别和理解核心组件的作用以及它们如何交互以实现完整的法学硕士助理行为。 编号与实施此解决方案时的操作顺序一致。

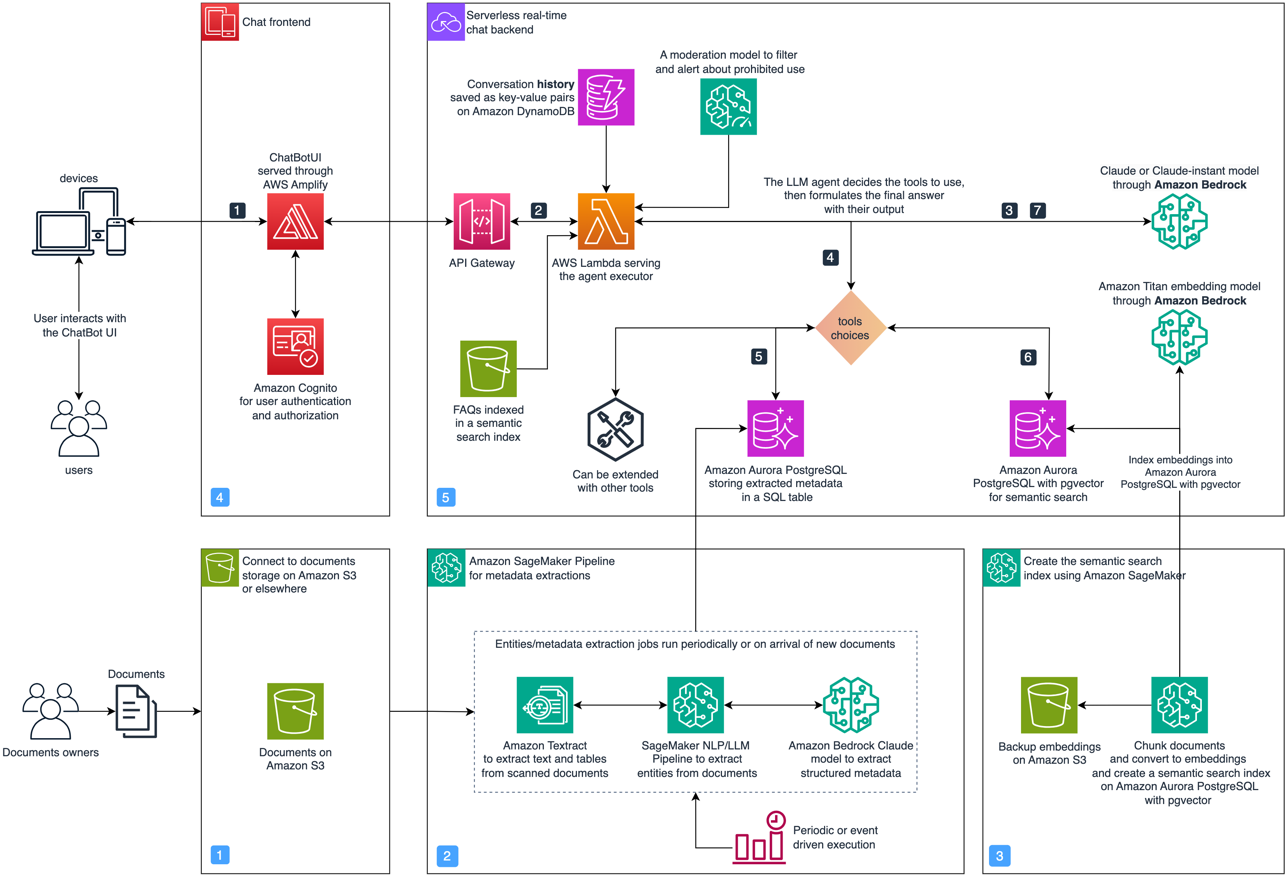

在实践中,我们按照以下详细架构中的概述实施了该解决方案。

对于这个架构,我们提出了一个实现 GitHub上,具有松散耦合的组件,其中后端 (5)、数据管道 (1、2、3) 和前端 (4) 可以单独发展。 这是为了在定制和改进生产解决方案时简化跨能力的协作。

部署解决方案

要在您的 AWS 账户中安装此解决方案,请完成以下步骤:

- 克隆 GitHub上的存储库.

- 安装后端 AWS云开发套件 (AWS CDK) 应用:

- 打开

backend文件夹中。 - 运行

npm install安装依赖项。 - 如果您从未在当前账户和区域中使用过 AWS CDK,请运行 引导

npx cdk bootstrap. - 运行

npx cdk deploy部署堆栈。

- 打开

- (可选)运行

streamlit-ui如下:- 我们建议将此存储库克隆到 亚马逊SageMaker Studio 环境。 欲了解更多信息,请参阅 使用快速设置加入 Amazon SageMaker 域.

- 里面的

frontend/streamlit-ui文件夹,运行bash run-streamlit-ui.sh. - 选择以下格式的链接来打开演示:

https://{domain_id}.studio.{region}.sagemaker.aws/jupyter/default/proxy/{port_number}/.

- 最后,您可以运行 亚马逊SageMaker 管道中定义的

data-pipelines/04-sagemaker-pipeline-for-documents-processing.ipynb笔记本来处理输入的 PDF 文档并准备 LLM 助手使用的 SQL 表和语义搜索索引。

在这篇文章的其余部分中,我们重点解释最重要的组件和设计选择,希望能在您基于内部知识库设计自己的人工智能助手时给您带来启发。 我们假设组件 1 和 4 很容易理解,并重点关注核心组件 2、3 和 5。

第 2 部分:实体提取管道

在本节中,我们将深入研究用于准备结构化数据的实体提取管道,这是分析问答的关键要素。

文字提取

文档通常以 PDF 格式或扫描图像存储。 它们可能由简单的段落布局或复杂的表格组成,并包含数字或手写文本。 为了正确提取信息,我们需要将这些原始文档转换为纯文本,同时保留其原始结构。 为此,您可以使用 亚马逊Textract,这是一项机器学习 (ML) 服务,提供成熟的 API,用于从数字和手写输入中提取文本、表格和表单。

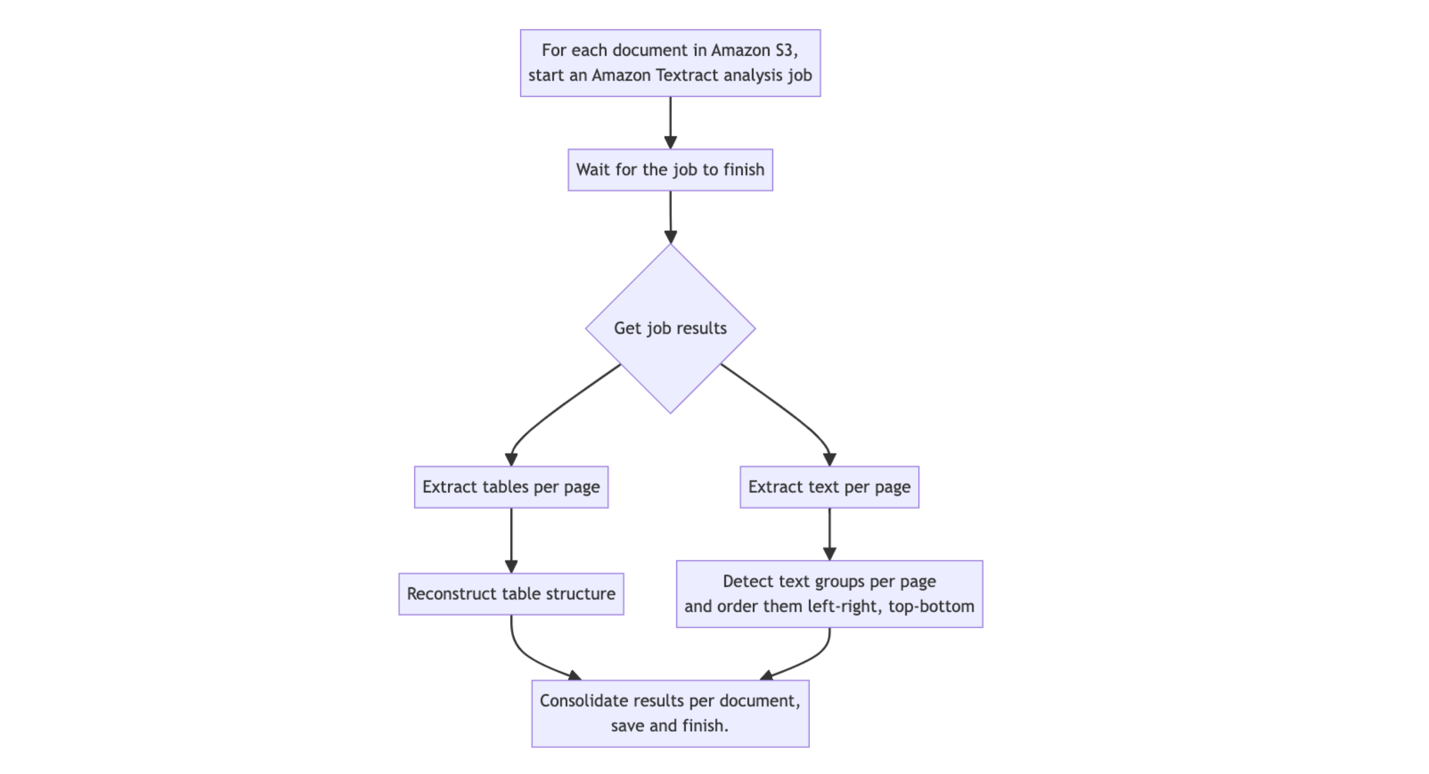

在组件 2 中,我们提取文本和表格如下:

- 对于每个文档,我们调用 Amazon Textract 来提取文本和表格。

- 我们使用以下 Python脚本 将表重新创建为 pandas DataFrame。

- 我们将结果合并到一个文档中,并以降价形式插入表格。

该过程由以下流程图概述,并在中具体演示 notebooks/03-pdf-document-processing.ipynb.

使用 LLM 进行实体提取和查询

为了有效地回答分析问题,您需要从文档的知识库中将相关元数据和实体提取为可访问的结构化数据格式。 由于 SQL 的流行、易用性和可扩展性,我们建议使用 SQL 来存储此信息并检索答案。 这种选择还受益于经过验证的语言模型从自然语言生成 SQL 查询的能力。

在本节中,我们将深入探讨以下可实现分析问题的组件:

- 使用 LLM 从非结构化数据中提取结构化数据的批处理过程

- 一个实时模块,可将自然语言问题转换为 SQL 查询并从 SQL 数据库检索结果

您可以提取相关元数据来支持分析问题,如下所示:

- 为需要提取的信息定义 JSON 架构,其中包含每个字段及其数据类型的描述,并包括预期值的示例。

- 对于每个文档,使用 JSON 模式提示 LLM 并要求其准确提取相关数据。

- 当文档长度超出上下文长度时,为了降低 LLM 的提取成本,您可以使用语义搜索在提取过程中检索相关文档块并将其呈现给 LLM。

- 解析 JSON 输出并验证 LLM 提取。

- (可选)将结果备份到 Amazon S3 上作为 CSV 文件。

- 加载到SQL数据库中供以后查询。

此过程由以下架构管理,其中文本格式的文档使用在以下环境中运行的 Python 脚本加载: Amazon SageMaker处理 执行提取的作业。

对于每组实体,我们动态构建一个提示,其中包含信息提取任务的清晰描述,并包含定义预期输出并包含相关文档块作为上下文的 JSON 模式。 我们还添加了一些输入和正确输出的示例,以通过少样本学习提高提取性能。 这体现在 notebooks/05-entities-extraction-to-structured-metadata.ipynb.

第 3 部分:使用 Amazon Bedrock 构建代理文档助手

在本部分中,我们将演示如何使用 Amazon Bedrock LLM 来查询数据并构建一个 LLM 代理来增强 RAG 的分析功能,从而使您能够构建智能文档助理来跨多个文档回答复杂的特定领域问题。 您可以参考 GitHub 上的 Lambda 函数 本部分介绍的代理和工具的具体实现。

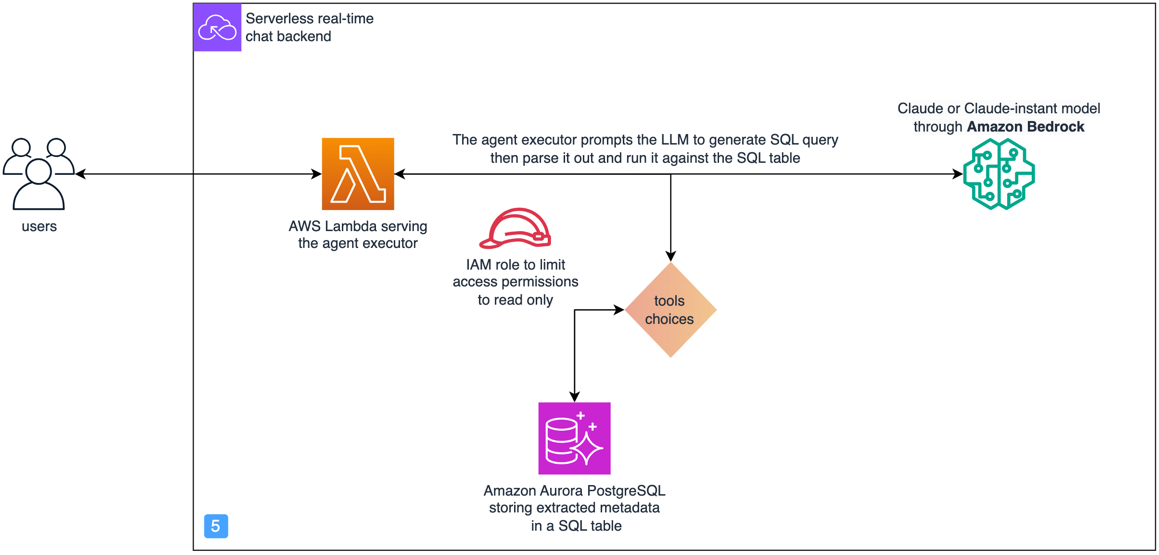

制定 SQL 查询并回答分析问题

现在我们有了一个结构化元数据存储,其中提取了相关实体并将其加载到我们可以查询的 SQL 数据库中,剩下的问题是如何从输入的自然语言问题生成正确的 SQL 查询?

现代法学硕士擅长生成 SQL。 例如,如果您通过 Anthropic Claude LLM 请求 亚马逊基岩 生成 SQL 查询,您将看到看似合理的答案。 但是,我们在编写提示时需要遵守一些规则,以达到更准确的 SQL 查询。 这些规则对于复杂查询尤其重要,可以减少幻觉和语法错误:

- 在提示中准确描述任务

- 在提示中包含 SQL 表的架构,同时描述表的每一列并指定其数据类型

- 明确告诉 LLM 仅使用现有的列名称和数据类型

- 添加 SQL 表的几行

您还可以使用以下命令对生成的 SQL 查询进行后处理 短绒 如 sqlfluff 纠正格式,或解析器,例如 sqlglot 检测语法错误并优化查询。 此外,当性能不满足要求时,您可以在提示中提供一些示例,以引导模型通过少量学习来生成更准确的 SQL 查询。

从实现的角度来看,我们使用 AWS Lambda 函数来协调以下过程:

- 使用输入问题调用 Amazon Bedrock 中的 Anthropic Claude 模型以获取相应的 SQL 查询。 在这里,我们使用 SQL数据库 LangChain 中的类来添加相关 SQL 表的模式描述,并使用自定义提示。

- 解析、验证并运行 SQL 查询 Amazon Aurora PostgreSQL 兼容版 数据库。

下图中突出显示了这部分解决方案的架构。

防止 SQL 注入攻击的安全考虑

当我们启用 AI 助手查询 SQL 数据库时,我们必须确保这不会引入安全漏洞。 为此,我们提出以下安全措施来防止 SQL 注入攻击:

- 应用最小权限 IAM 权限 – 使用以下命令限制运行 SQL 查询的 Lambda 函数的权限 AWS身份和访问管理 (IAM) 遵循的政策和角色 最小特权原则。 在这种情况下,我们授予只读访问权限。

- 限制数据访问 – 仅提供对最少表和列的访问,以防止信息泄露攻击。

- 添加调节层 – 引入一个调节层,该层可以尽早检测即时注入尝试并防止它们传播到系统的其余部分。 它可以采用基于规则的过滤器、针对已知提示注入示例数据库的相似性匹配或 ML 分类器的形式。

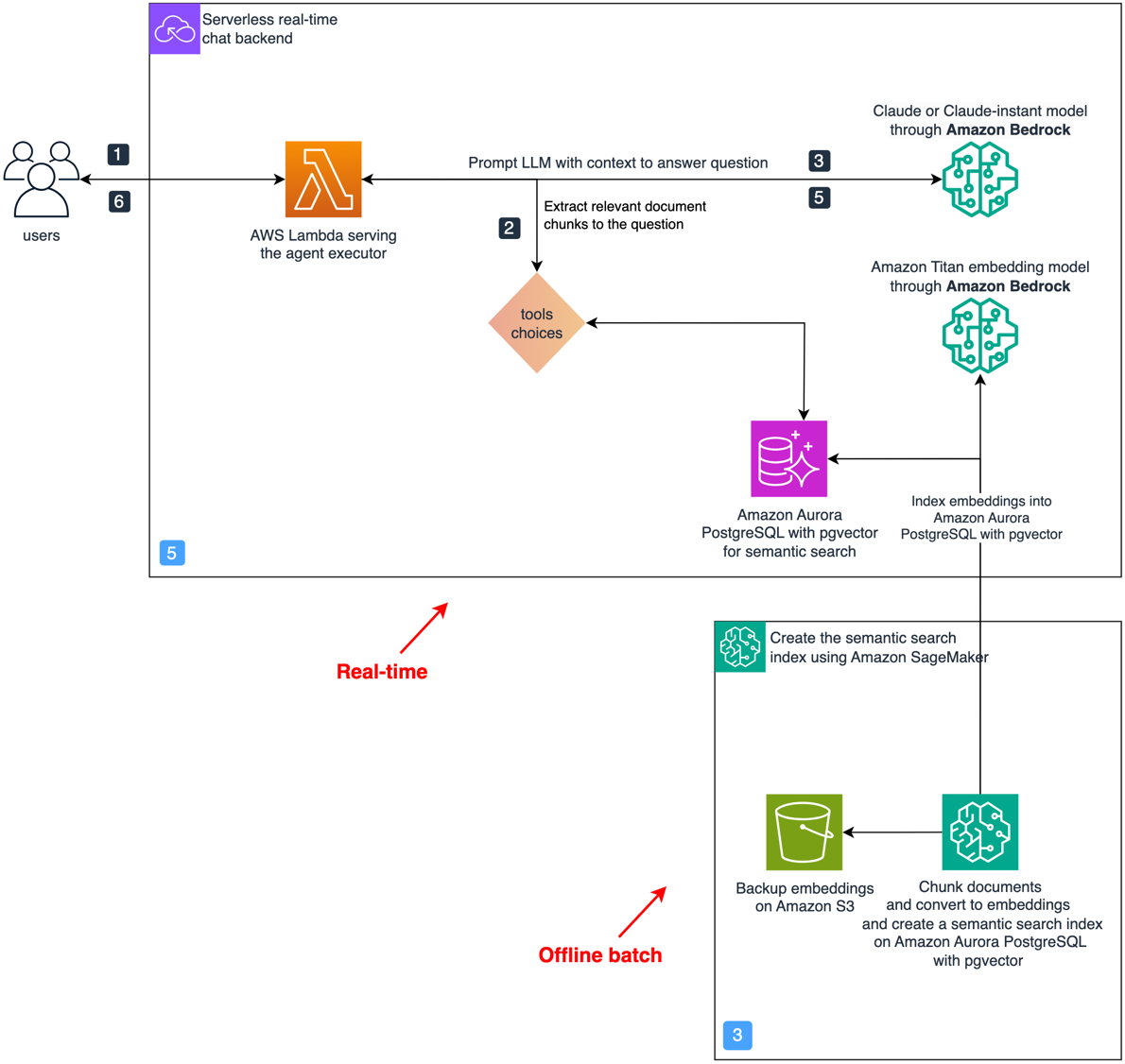

语义搜索检索以增强生成上下文

我们提出的解决方案在组件 3 中使用 RAG 和语义搜索。您可以使用以下方式实现此模块 Amazon Bedrock 知识库。 此外,还有多种其他选项来实现 RAG,例如 Amazon Kendra 检索 API, Amazon OpenSearch 矢量数据库及 带有 pgvector 的 Amazon Aurora PostgreSQL等。 开源包 aws-genai-llm-聊天机器人 演示如何使用许多矢量搜索选项来实现 LLM 支持的聊天机器人。

在此解决方案中,由于我们需要 SQL 查询和矢量搜索,因此我们决定使用 Amazon Aurora PostgreSQL 和 PG向量 扩展,支持这两种功能。 因此,我们使用以下架构实现语义搜索 RAG 组件。

使用前述架构回答问题的过程分两个主要阶段完成。

首先,作为 SageMaker 处理作业运行的离线批处理进程会创建语义搜索索引,如下所示:

- SageMaker 作业会定期运行或在收到新文档后运行。

- 它从 Amazon S3 加载文本文档并将它们分割成重叠的块。

- 对于每个块,它使用 Amazon Titan 嵌入模型来生成嵌入向量。

- 它使用 PG向量 来自 LangChain 的类,将嵌入及其文档块和元数据提取到 Amazon Aurora PostgreSQL 中,并在所有嵌入向量上创建语义搜索索引。

其次,对于每个新问题,我们实时构建一个答案,如下所示:

- 该问题由在 Lambda 函数上运行的协调器接收。

- 协调器使用相同的嵌入模型嵌入问题。

- 它从 PostgreSQL 语义搜索索引中检索前 K 个最相关的文档块。 它可以选择使用元数据过滤来提高精度。

- 这些块会与输入问题一起动态插入到 LLM 提示中。

- 该提示会呈现给 Amazon Bedrock 上的 Anthropic Claude,指示其根据可用上下文回答输入问题。

- 最后,生成的答案被发送回编排器。

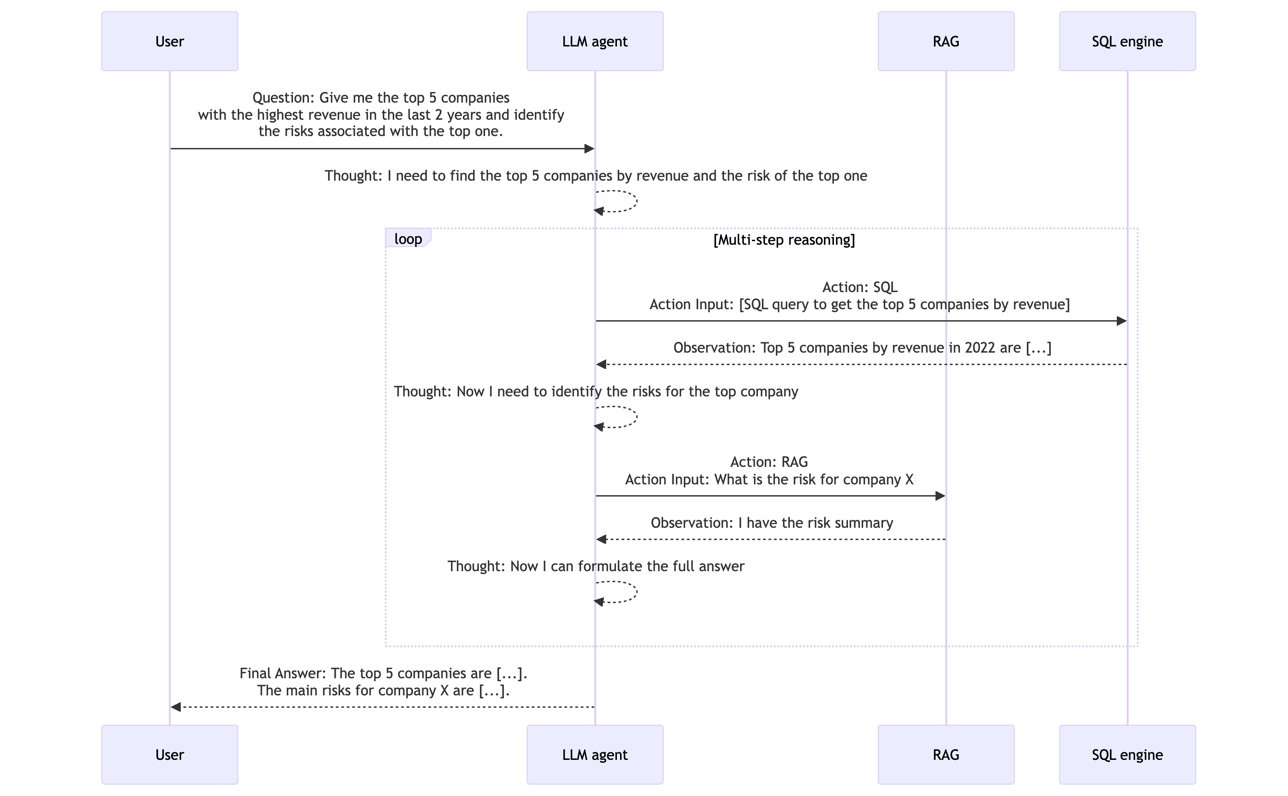

能够使用工具进行推理和行动的智能体

到目前为止,在这篇文章中,我们已经讨论了分别处理需要 RAG 或分析推理的问题。 然而,许多现实世界的问题需要这两种能力,有时需要经过多个推理步骤才能得出最终答案。 为了支持这些更复杂的问题,我们需要引入代理的概念。

LLM 代理,例如 亚马逊基岩代理,最近出现作为一种有前途的解决方案,能够使用法学硕士使用当前上下文进行推理和适应,并从选项列表中选择适当的操作,这提供了一个通用的问题解决框架。 正如中所讨论的 LLM 支持的自主代理,支持复杂推理的LLM智能体有多种提示策略和设计模式。

其中一种设计模式是 Reason and Act (ReAct),在 ReAct:在语言模型中协同推理和行动。 在 ReAct 中,代理将目标(可以是问题)作为输入,识别回答该目标时缺少的信息,并根据可用工具的描述迭代地提出正确的工具来收集信息。 从给定工具收到答案后,法学硕士会重新评估其是否拥有完全回答问题所需的所有信息。 如果没有,它会进行另一步推理,并使用相同或其他工具来收集更多信息,直到准备好最终响应或达到限制。

以下序列图解释了 ReAct 代理如何回答以下问题:“给我过去 5 年内收入最高的 2 家公司,并确定与排名前 XNUMX 的公司相关的风险。”

在 Python 中实现此方法的详细信息描述于 定制LLM代理。 在我们的解决方案中,代理和工具是通过以下突出显示的部分架构来实现的。

为了回答输入问题,我们使用 AWS 服务,如下所示:

- 用户通过 UI 输入问题,UI 调用 API Amazon API网关.

- API Gateway 将问题发送到实现代理执行器的 Lambda 函数。

- 代理通过提示调用 LLM,其中包含可用工具的描述、ReAct 指令格式和输入问题,然后解析要完成的下一个操作。

- 该操作包含要调用哪个工具以及操作输入是什么。

- 如果使用的工具是 SQL,则代理执行器调用 SQLQA 将问题转换为 SQL 并运行。 然后,它将结果添加到提示中,并再次调用 LLM 以查看是否可以回答原始问题或是否需要采取更多操作。

- 同样,如果使用的工具是语义搜索,则操作输入将被解析并用于从 PostgreSQL 语义搜索索引中检索。 它将结果添加到提示中,并检查 LLM 是否能够回答或需要其他操作。

- 在获得回答问题的所有信息后,LLM 代理会制定最终答案并将其发送回用户。

您可以使用更多工具来扩展代理。 在可用的实现中 GitHub上,我们演示了如何添加搜索引擎和计算器作为上述 SQL 引擎和语义搜索工具的额外工具。 为了存储正在进行的对话历史记录,我们使用 Amazon DynamoDB 表。

根据迄今为止的经验,我们发现以下是成功代理的关键:

- 能够使用 ReAct 格式进行推理的底层 LLM

- 对可用工具、何时使用它们的清晰描述,以及对其输入参数的描述,可能包括输入和预期输出的示例

- 法学硕士必须遵循的 ReAct 格式的清晰轮廓

- 为 LLM 代理提供解决业务问题的正确工具

- 正确解析 LLM 代理响应的输出,因为它的原因

为了优化成本,我们建议缓存最常见的问题及其答案,并定期更新此缓存以减少对底层 LLM 的调用。 例如,您可以按照前面的说明创建包含最常见问题的语义搜索索引,并在调用 LLM 之前首先将新用户问题与索引进行匹配。 要探索其他缓存选项,请参阅 LLM 缓存集成.

支持视频、图像、音频和3D文件等其他格式

您可以将相同的解决方案应用于各种类型的信息,例如图像、视频、音频以及 CAD 或网格文件等 3D 设计文件。 这涉及使用已建立的机器学习技术以文本形式描述文件内容,然后可以将其引入到我们之前探索的解决方案中。 这种方法使您能够对这些不同的数据类型进行 QA 对话。 例如,您可以通过创建图像、视频或音频内容的文本描述来扩展文档数据库。 您还可以通过对这些格式中的元素进行分类或对象检测来识别属性,从而增强元数据表。 在将提取的数据在元数据存储或文档的语义搜索索引中建立索引之后,所提出的系统的整体架构在很大程度上保持一致。

结论

在这篇文章中,我们展示了如何使用法学硕士和 RAG 设计模式来构建特定领域的人工智能助手,但不足以达到产生业务价值所需的可靠性水平。 因此,我们提出用代理和工具的概念来扩展流行的 RAG 设计模式,其中工具的灵活性使我们能够同时使用传统的 NLP 技术和现代的 LLM 能力,使 AI 助手有更多的选择来寻求信息和协助用户有效解决业务问题。

该解决方案演示了法学硕士助理的设计过程,该助理能够回答所有知识库中各种类型的检索、分析推理和多步骤推理问题。 我们还强调了从法学硕士助理预计帮助用户解决的问题和任务类型中进行逆向思考的重要性。 在本例中,设计之旅引导我们构建了一个包含三个组件的架构:语义搜索、元数据提取和 SQL 查询,以及 LLM 代理和工具,我们认为该架构对于多个用例来说足够通用和灵活。 我们还相信,通过从该解决方案中获得灵感并深入了解用户的需求,您将能够进一步扩展该解决方案,以获得最适合您的解决方案。

关于作者

穆罕默德·阿里·贾马维 是一位高级 ML 原型架构师,在生产机器学习领域拥有 10 年经验。 他喜欢通过机器学习和软件工程解决业务问题,并帮助客户通过 ML 获取业务价值。 作为 AWS EMEA 原型和云工程的一部分,他帮助客户构建利用 MLOP、NLP、CV 和 LLM 创新的业务解决方案。

穆罕默德·阿里·贾马维 是一位高级 ML 原型架构师,在生产机器学习领域拥有 10 年经验。 他喜欢通过机器学习和软件工程解决业务问题,并帮助客户通过 ML 获取业务价值。 作为 AWS EMEA 原型和云工程的一部分,他帮助客户构建利用 MLOP、NLP、CV 和 LLM 创新的业务解决方案。

朱塞佩·汉南 是 ProServe 副顾问。 Giuseppe 将他的分析技能与人工智能和机器学习相结合,为客户开发清晰有效的解决方案。 他喜欢为复杂的问题提出简单的解决方案,尤其是那些涉及最新技术发展和研究的问题。

朱塞佩·汉南 是 ProServe 副顾问。 Giuseppe 将他的分析技能与人工智能和机器学习相结合,为客户开发清晰有效的解决方案。 他喜欢为复杂的问题提出简单的解决方案,尤其是那些涉及最新技术发展和研究的问题。

劳伦斯十凯特 是一名高级数据科学家。 Laurens 与 EMEA 的企业客户合作,帮助他们使用 AWS AI/ML 技术加速实现业务成果。 他专注于 NLP 解决方案,并专注于供应链和物流行业。 在空闲时间,他喜欢阅读和艺术。

劳伦斯十凯特 是一名高级数据科学家。 Laurens 与 EMEA 的企业客户合作,帮助他们使用 AWS AI/ML 技术加速实现业务成果。 他专注于 NLP 解决方案,并专注于供应链和物流行业。 在空闲时间,他喜欢阅读和艺术。

伊琳娜·拉杜 是原型设计参与经理,隶属于 AWS EMEA 原型和云工程。 她正在帮助客户充分利用最新技术、更快地创新并思考更大的问题。

伊琳娜·拉杜 是原型设计参与经理,隶属于 AWS EMEA 原型和云工程。 她正在帮助客户充分利用最新技术、更快地创新并思考更大的问题。

- SEO 支持的内容和 PR 分发。 今天得到放大。

- PlatoData.Network 垂直生成人工智能。 赋予自己力量。 访问这里。

- 柏拉图爱流。 Web3 智能。 知识放大。 访问这里。

- 柏拉图ESG。 碳, 清洁科技, 能源, 环境, 太阳能, 废物管理。 访问这里。

- 柏拉图健康。 生物技术和临床试验情报。 访问这里。

- Sumber: https://aws.amazon.com/blogs/machine-learning/boosting-rag-based-intelligent-document-assistants-using-entity-extraction-sql-querying-and-agents-with-amazon-bedrock/

- :具有

- :是

- :不是

- :在哪里

- $UP

- 1

- 10

- 100

- 2022

- 3d

- 7

- a

- 对,能力--

- Able

- 关于

- 加快

- ACCESS

- 无障碍

- 完成

- 账号管理

- 精准的

- 准确

- 实现

- 横过

- 法案

- 演戏

- 操作

- 行动

- 适应

- 加

- 另外

- 添加

- 采用

- 后

- 再次

- 驳

- 经纪人

- 中介代理

- AI

- AI助手

- AI / ML

- 算法

- 对齐

- 所有类型

- 允许

- 靠

- 还

- Amazon

- 亚马逊SageMaker

- 亚马逊Textract

- 亚马逊网络服务

- 其中

- an

- 分析

- 分析

- 分析

- 和

- 另一个

- 回答

- 答案

- 人类的

- 任何

- API

- APIs

- 适用

- 使用

- 的途径

- 适当

- 近似

- 架构

- 保健

- 参数

- 围绕

- 艺术

- AS

- 问

- 协助

- 助理

- 助理

- 律师

- 相关

- 承担

- At

- 攻击

- 尝试

- 音频

- 增加

- 增强

- Aurora

- 自动

- 自主性

- 可使用

- AWS

- 背部

- 后端

- 当前余额

- 基地

- 基于

- 基本包

- BE

- 因为

- 很

- before

- 行为

- 背后

- 相信

- 好处

- 最佳

- 之间

- 超越

- 大

- 提高

- 都

- 建立

- 建筑物

- 商业

- 企业

- 但是

- by

- 缓存

- CAD

- 呼叫

- 被称为

- 调用

- 呼叫

- CAN

- 候选人

- 能力

- 能力

- 携带

- 案件

- 例

- 链

- 聊天机器人

- 支票

- 选择

- 选择

- 程

- 分类

- 清除

- 云端技术

- 相干

- 合作

- 柱

- 列

- 组合

- 结合

- 如何

- 相当常见

- 公司

- 公司

- 比较

- 比较

- 比较

- 补充

- 完成

- 复杂

- 复杂

- 元件

- 组件

- 由

- 全面

- 计算

- 概念

- 具体

- 流程条件

- 进行

- 分享链接

- 考虑

- 注意事项

- 一贯

- 巩固

- 建设

- 顾问

- 包含

- 包含

- 包含

- 内容

- 上下文

- 谈话

- 听起来像对话

- 会话AI

- 对话

- 兑换

- 转换

- 核心

- 正确

- 正确地

- 相应

- 价格

- 成本

- 可以

- 再加

- 创建信息图

- 创建

- 创造

- 电流

- 习俗

- 顾客

- 客户支持

- 合作伙伴

- data

- 数据访问

- 数据科学家

- 数据库

- 决定

- 决定

- 深

- 更深

- 定义

- 定义

- 钻研

- 需求

- 演示

- 演示

- 证明

- 演示

- 依赖

- 部署

- 描述

- 描述

- 描述

- 描述

- 设计

- 设计模式

- 设计过程

- 设计

- 详细

- 详情

- 检测

- 检测

- 开发

- 研发支持

- 发展

- 数字

- 泄露

- 讨论

- 讨论

- 讨论

- 距离

- 潜水

- 不同

- 跳水

- do

- 文件

- 文件

- 文件

- 不

- 不会

- 域

- 域名

- 完成

- 向下

- 司机

- 两

- ,我们将参加

- 动态

- 每

- 此前

- 早

- 缓解

- 使用方便

- 容易

- 有效

- 只

- 效率

- 高效

- 有效

- 或

- 分子

- 嵌入

- 欧洲与中东地区

- 出现

- 雇用

- enable

- 使

- 使

- 结束

- 订婚

- 发动机

- 工程师

- 引擎

- 提高

- 增强

- 更多

- 充实

- 企业

- 实体

- 实体

- 环境

- 故障

- 特别

- 必要

- 成熟

- 甚至

- 发展

- 检查

- 例子

- 例子

- 存在

- 现有

- 扩大

- 预期

- 体验

- 解释

- 说明

- 介绍

- 探索

- 探讨

- 裸露

- 延长

- 延长

- 延期

- 额外

- 提取

- 萃取

- 提取物

- 面临

- 失败

- 常见问题

- 远

- 快

- 专栏

- 特征

- 反馈

- 少数

- 部分

- 文件

- 档

- 过滤

- 过滤器

- 最后

- 终于

- 金融

- 找到最适合您的地方

- (名字)

- 高度灵活

- 柔软

- 流

- 专注焦点

- 聚焦

- 以下

- 如下

- 针对

- 申请

- 格式

- 形成

- 形式

- 骨架

- 自由的

- 止

- 前

- 前端

- 履行

- ,

- 充分

- 功能

- 进一步

- 网关

- 收集

- 其他咨询

- 生成

- 产生

- 发电

- 代

- 生成的

- 生成式人工智能

- 得到

- 越来越

- GitHub上

- 特定

- 目标

- 非常好

- 渐渐

- 授予

- 团队

- 组的

- 民政事务总署

- 有

- 有

- he

- 帮助

- 帮助

- 帮助

- 相关信息

- 高

- 最高

- 突出

- 他的

- 历史

- 希望

- 创新中心

- How To

- 但是

- HTML

- HTTPS

- 人

- 思路

- 识别

- 鉴定

- 确定

- 身分

- if

- 图片

- 图片

- 想像

- 实施

- 履行

- 实施

- 实施

- 重要性

- 重要

- 改善

- 改善

- 改善

- 改善

- in

- 包括

- 指数

- 索引

- 行业中的应用:

- 信息

- 信息提取

- 初始

- 创新

- 创新

- 输入

- 输入

- 专题

- 启发

- 灵感

- 安装

- 例

- 代替

- 整合

- 智能化

- 相互作用

- 内部

- 成

- 介绍

- 介绍

- 投资

- 调查

- 投资

- 涉及

- IT

- 它的

- 本身

- 工作

- 旅程

- JPG

- JSON

- 保持

- 键

- 键

- 知识

- 已知

- 语言

- 大

- 在很大程度上

- (姓氏)

- 后来

- 最新

- 启动

- 层

- 学习

- 最少

- 导致

- 长度

- Level

- 杠杆作用

- 喜欢

- 极限

- 限制

- 友情链接

- 清单

- LLM

- 负载

- 物流

- 物流业

- 长

- 爱

- 机

- 机器学习

- 制成

- 主要

- 保持

- 维护

- 使

- 管理

- 经理

- 许多

- 匹配

- 匹配

- 成熟

- 可能..

- me

- 意

- 措施

- 满足

- 提到

- 仅仅

- 网格

- 的话

- 元数据

- 方法

- 方法

- 公

- 指标

- 最低限度

- 误导

- 失踪

- ML

- 多播

- 模型

- 模型

- 适度

- 现代

- 模块

- 更多

- 此外

- 最先进的

- 多

- 必须

- 名称

- 自然

- 自然语言处理

- 必要

- 需求

- 打印车票

- 需要

- 邻居

- 净

- 净收入

- 决不要

- 全新

- 下页

- NLP

- 不包含

- 笔记本

- 概念

- 对象

- 物体检测

- of

- 最多线路

- 提供

- 这一点在线下监测数字化产品的影响方面尤为明显。

- 经常

- on

- 一

- 正在进行

- 仅由

- 打开

- 开放源码

- 运营

- 优化

- 附加选项

- or

- 秩序

- 原版的

- 其他名称

- 其它

- 我们的

- 输出

- 结果

- 轮廓

- 概述

- 产量

- 输出

- 超过

- 最划算

- 克服

- 己

- 包

- 大熊猫

- 部分

- 部分

- 模式

- 模式

- 演出

- 性能

- 允许

- 透视

- 制药

- 件

- 管道

- 朴素

- 规划行程

- 柏拉图

- 柏拉图数据智能

- 柏拉图数据

- 似是而非

- 点

- 政策

- 热门

- 声望

- 人口稠密

- 可能

- 或者

- 帖子

- PostgreSQL的

- 潜力

- 可能

- 供电

- 强大

- 在练习上

- 平台精度

- Prepare

- 当下

- 呈现

- 礼物

- 保存

- 防止

- 防止

- 先前

- 特权

- 问题解决

- 问题

- 过程

- 处理

- 产生

- 生产

- 产品

- 生产

- 承诺

- 有希望

- 提供

- 建议

- 建议

- 原型

- 成熟

- 提供

- 提供

- 国家

- 蟒蛇

- Q&A

- 查询

- 题

- 有疑问吗?

- 快速

- 很快

- 排行

- 快

- 原

- 达到

- 达到

- 应对

- 阅读

- 准备

- 真实

- 真实的世界

- 实时的

- 原因

- 合理

- 收到

- 接收

- 最近

- 最近

- 承认

- 建议

- 推荐

- 减少

- 参考

- 地区

- 相应

- 可靠性

- 依靠

- 遗迹

- 业务报告

- 知识库

- 代表

- 请求

- 要求

- 必须

- 需求

- 需要

- 研究

- 响应

- 回复

- REST的

- 导致

- 成果

- 回报

- 收入

- 收入

- 检讨

- 右

- 风险

- 角色

- 定位、竞价/采购和分析/优化数字媒体采购,但算法只不过是解决问题的操作和规则。

- 运行

- 运行

- 运行

- sagemaker

- 同

- 可扩展性

- 浏览

- 扫描

- 科学家

- 脚本

- 搜索

- 搜索引擎

- 其次

- 部分

- 部分

- 保安

- 保安措施

- 看到

- 寻找

- 看到

- 选择

- 选择

- 语义

- 发送

- 前辈

- 发送

- 序列

- 服务

- 特色服务

- 她

- 应该

- 显示

- 显示

- 如图

- 类似

- 简易

- 简

- 简化

- 同时

- 自

- 单

- 技能

- So

- 至今

- 软件

- 软件工程

- 独自

- 方案,

- 解决方案

- 解决

- 一些

- 有时

- 来源

- 来源

- 太空

- 专门

- 专业

- 具体的

- 速度

- 拆分

- 堆

- 实习

- 开始

- 开始

- 驾驶

- 步

- 步骤

- 商店

- 存储

- 简单的

- 策略

- 策略

- 罢工

- 努力

- 结构体

- 结构化

- 工作室

- 成功

- 这样

- 建议

- 合适的

- 总结

- 供应

- 供应链

- SUPPORT

- 支持

- 肯定

- 句法

- 系统

- 表

- 量身定制

- 采取

- 需要

- 任务

- 任务

- 科技

- 技术

- 技术性

- 技术

- 展示

- 十

- 文本

- 文字的

- 谢谢

- 这

- 信息

- 其

- 他们

- 然后

- 那里。

- 从而

- 因此

- 博曼

- 他们

- 认为

- 思维

- Free Introduction

- 那些

- 三

- 通过

- 次

- 泰坦

- 至

- 今晚

- 工具

- 工具

- 最佳

- 前5名

- 对于

- 向

- 追踪

- 传统

- 产品培训

- 改造

- 治疗

- true

- 可靠

- 二

- 类型

- 类型

- 一般

- ui

- 相关

- 理解

- 直到

- 更新

- 上

- us

- 使用

- 用过的

- 用户

- 用户体验

- 用户

- 使用

- 运用

- 验证

- 折扣值

- 价值观

- 各种

- 各个

- 多才多艺

- 视频

- 视频

- 漏洞

- 走

- 方法..

- we

- 卷筒纸

- Web服务

- 井

- 为

- 什么是

- ,尤其是

- 而

- 是否

- 这

- 而

- 为什么

- 维基百科上的数据

- 将

- 中

- 也完全不需要

- 合作

- 将

- 写作

- X

- 年

- 年

- 完全

- 您一站式解决方案

- 和风网