亚马逊SageMaker 提供广泛的机器学习 (ML) 基础架构和模型部署选项,以帮助满足您的 ML 推理需求。 它是一项完全托管的服务,并与 MLOps 工具集成,因此您可以扩展模型部署、降低推理成本、在生产中更有效地管理模型并减轻运营负担。 SageMaker 提供多种 推理选项 因此您可以选择最适合您工作量的选项。

由于专门的内置指令,新一代 CPU 在 ML 推理方面提供了显着的性能改进。 在这篇文章中,我们重点介绍如何利用 AWS Graviton3基于 Amazon Elastic Compute Cloud (EC2) C7g实例 与同类 EC50 实例相比,有助于将推理成本降低高达 2% 实时推理 在亚马逊 SageMaker 上。 我们展示了如何通过几个步骤评估推理性能并将您的 ML 工作负载切换到 AWS Graviton 实例。

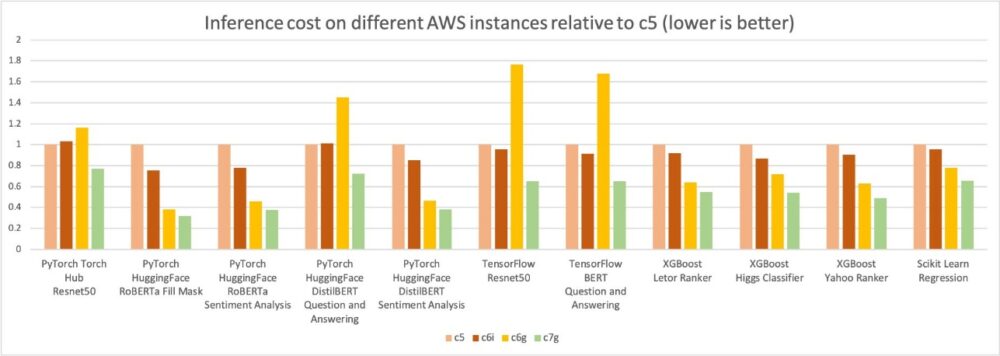

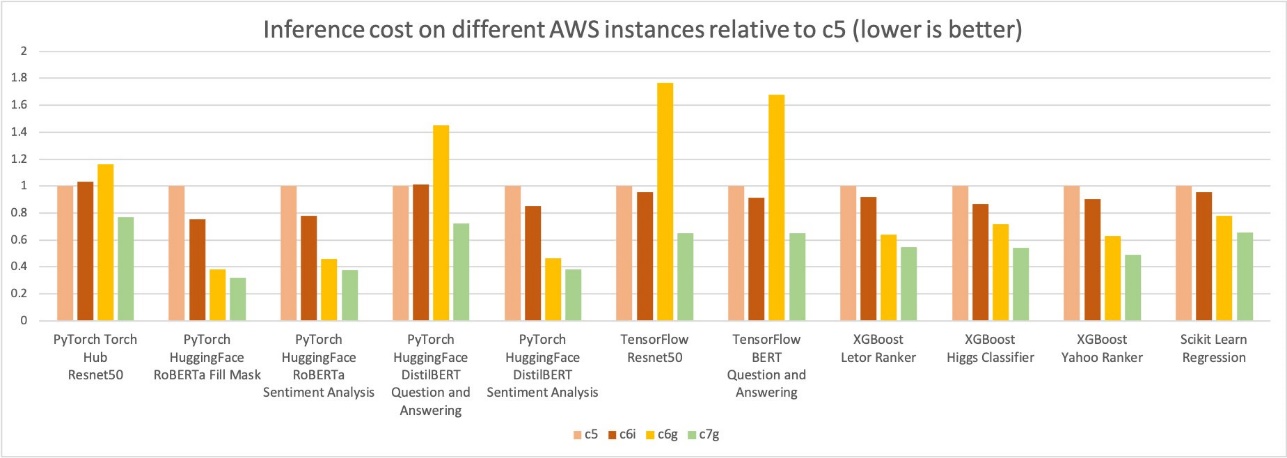

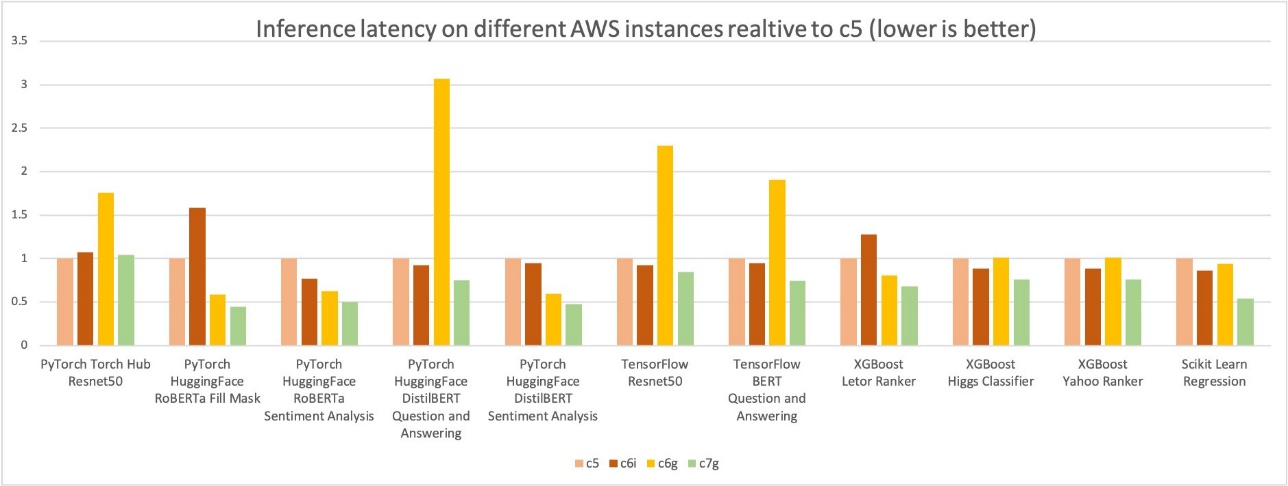

为了涵盖流行和广泛的客户应用程序,在这篇文章中,我们讨论了 PyTorch、TensorFlow、XGBoost 和 scikit-learn 框架的推理性能。 我们涵盖了模型的计算机视觉 (CV)、自然语言处理 (NLP)、分类和排名场景,以及用于基准测试的 ml.c6g、ml.c7g、ml.c5 和 ml.c6i SageMaker 实例。

基准测试结果

AWS 测得,与 Amazon SageMaker 上的可比 EC50 实例相比,使用基于 AWS Graviton3 的 EC2 C7g 实例进行 PyTorch、TensorFlow、XGBoost 和 scikit-learn 模型推理可节省高达 2% 的成本。 同时,推理的延迟也降低了。

为了比较,我们使用了四种不同的实例类型:

所有四个实例都有 16 个 vCPU 和 32 GiB 内存。

在下图中,我们测量了四种实例类型的每百万推理成本。 我们进一步将每百万推理结果的成本标准化为 c5.4xlarge 实例,在图表的 Y 轴上测量为 1。 您可以看到,对于 XGBoost 模型,c7g.4xlarge (AWS Graviton3) 的每百万推理成本约为 c50xlarge 的 5.4% 和 c40i.6xlarge 的 4%; 对于 PyTorch NLP 模型,与 c30 和 c50i.5xlarge 实例相比,成本节省约为 6-4%。 对于其他模型和框架,我们测得与 c30 和 c5i.6xlarge 实例相比至少节省了 4% 的成本。

与前面的推理成本比较图类似,下图显示了相同四种实例类型的模型 p90 延迟。 我们进一步将延迟结果标准化为 c5.4xlarge 实例,在图表的 Y 轴上测量为 1。 c7g.4xlarge (AWS Graviton3) 模型推理延迟比在 c50xlarge 和 c5.4i.6xlarge 上测得的延迟高 4%。

迁移到 AWS Graviton 实例

要将模型部署到 AWS Graviton 实例,您可以使用 AWS深度学习容器 (DLC)或 自带容器 与 ARMv8.2 架构兼容。

将模型迁移(或新部署)到 AWS Graviton 实例非常简单,因为 AWS 不仅提供容器来托管带有 PyTorch、TensorFlow、scikit-learn 和 XGBoost 的模型,而且这些模型在架构上也是不可知的。 您也可以自带库,但请确保您的容器是使用支持 ARMv8.2 架构的环境构建的。 有关详细信息,请参阅 构建自己的算法容器.

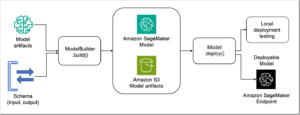

您需要完成三个步骤才能部署您的模型:

- 创建 SageMaker 模型。 除其他参数外,这将包含有关模型文件位置的信息、将用于部署的容器以及推理脚本的位置。 (如果您已经在计算优化推理实例中部署了现有模型,则可以跳过此步骤。)

- 创建端点配置。 这将包含有关端点所需实例类型的信息(例如,AWS Graviton7 的 ml.c3g.xlarge)、您在上一步中创建的模型的名称以及每个端点的实例数。

- 使用在上一步中创建的端点配置启动端点。

有关详细说明,请参阅 使用 Amazon SageMaker 在基于 AWS Graviton 的实例上运行机器学习推理工作负载

基准方法

我们用了 Amazon SageMaker 推理推荐器 跨不同实例自动化性能基准测试。 此服务会比较您的 ML 模型在不同实例上的延迟和成本方面的性能,并推荐能够以最低成本提供最佳性能的实例和配置。 我们使用 Inference Recommender 收集了上述性能数据。 有关详细信息,请参阅 GitHub回购.

您可以使用 样本笔记本 运行基准测试并重现结果。 我们使用以下模型进行基准测试:

结论

AWS 测得,与 Amazon SageMaker 上的可比 EC50 实例相比,使用基于 AWS Graviton3 的 EC2 C7g 实例进行 PyTorch、TensorFlow、XGBoost 和 scikit-learn 模型推理可节省高达 2% 的成本。 您可以按照本文中提供的步骤迁移现有推理用例或在 AWS Graviton 上部署新的 ML 模型。 您也可以参考 AWS Graviton 技术指南,其中提供了优化库列表和最佳实践,可帮助您使用 AWS Graviton 实例跨不同工作负载实现成本效益。

如果您发现在 AWS Graviton 上没有观察到类似性能提升的用例,请联系我们。 我们将继续添加更多性能改进,使 AWS Graviton 成为最具成本效益和最高效的 ML 推理通用处理器。

关于作者

苏妮塔·纳达帕利 是 AWS 的软件开发经理。 她领导机器学习、高性能计算和多媒体工作负载的 Graviton 软件性能优化。 她热衷于开源开发和使用 Arm SoC 提供具有成本效益的软件解决方案。

苏妮塔·纳达帕利 是 AWS 的软件开发经理。 她领导机器学习、高性能计算和多媒体工作负载的 Graviton 软件性能优化。 她热衷于开源开发和使用 Arm SoC 提供具有成本效益的软件解决方案。

杰明·德赛 是 Amazon SageMaker 推理团队的一名软件开发工程师。 他热衷于将 AI 推向大众,并通过将最先进的 AI 资产产品化为功能和服务来提高它们的可用性。 在空闲时间,他喜欢探索音乐和旅行。

杰明·德赛 是 Amazon SageMaker 推理团队的一名软件开发工程师。 他热衷于将 AI 推向大众,并通过将最先进的 AI 资产产品化为功能和服务来提高它们的可用性。 在空闲时间,他喜欢探索音乐和旅行。

迈克·施耐德 是亚利桑那州凤凰城的一名系统开发人员。 他是 Deep Learning container 的成员,支持各种 Framework 容器镜像,包括 Graviton Inference。 他致力于基础设施的效率和稳定性。

迈克·施耐德 是亚利桑那州凤凰城的一名系统开发人员。 他是 Deep Learning container 的成员,支持各种 Framework 容器镜像,包括 Graviton Inference。 他致力于基础设施的效率和稳定性。

莫汉甘地 是 AWS 的高级软件工程师。 在过去的 10 年里,他一直在 AWS 工作,并从事过各种 AWS 服务,例如 EMR、EFA 和 RDS。 目前,他专注于改进 SageMaker 推理体验。 在业余时间,他喜欢远足和马拉松。

莫汉甘地 是 AWS 的高级软件工程师。 在过去的 10 年里,他一直在 AWS 工作,并从事过各种 AWS 服务,例如 EMR、EFA 和 RDS。 目前,他专注于改进 SageMaker 推理体验。 在业余时间,他喜欢远足和马拉松。

李庆伟 是Amazon Web Services的机器学习专家。 他获得了博士学位。 在他打破了顾问的研究补助金帐户并未能兑现他所承诺的诺贝尔奖之后,他在运筹学获得了博士学位。 目前,他帮助金融服务和保险行业的客户在AWS上构建机器学习解决方案。 在业余时间,他喜欢阅读和教学。

李庆伟 是Amazon Web Services的机器学习专家。 他获得了博士学位。 在他打破了顾问的研究补助金帐户并未能兑现他所承诺的诺贝尔奖之后,他在运筹学获得了博士学位。 目前,他帮助金融服务和保险行业的客户在AWS上构建机器学习解决方案。 在业余时间,他喜欢阅读和教学。

韦恩杜 是 AWS Graviton 的专家解决方案架构师。 他专注于帮助客户采用 ARM 架构来处理大规模容器工作负载。 在加入 AWS 之前,Wayne 曾在多家大型软件供应商工作,包括 IBM 和 Red Hat。

韦恩杜 是 AWS Graviton 的专家解决方案架构师。 他专注于帮助客户采用 ARM 架构来处理大规模容器工作负载。 在加入 AWS 之前,Wayne 曾在多家大型软件供应商工作,包括 IBM 和 Red Hat。

劳伦·穆伦内克斯 是科罗拉多州丹佛市的一名解决方案架构师。她与客户合作,帮助他们在 AWS 上构建解决方案。 在业余时间,她喜欢远足和烹饪夏威夷美食。

劳伦·穆伦内克斯 是科罗拉多州丹佛市的一名解决方案架构师。她与客户合作,帮助他们在 AWS 上构建解决方案。 在业余时间,她喜欢远足和烹饪夏威夷美食。

- SEO 支持的内容和 PR 分发。 今天得到放大。

- 柏拉图爱流。 Web3 数据智能。 知识放大。 访问这里。

- 与 Adryenn Ashley 一起铸造未来。 访问这里。

- 使用 PREIPO® 买卖 PRE-IPO 公司的股票。 访问这里。

- Sumber: https://aws.amazon.com/blogs/machine-learning/reduce-amazon-sagemaker-inference-cost-with-aws-graviton/

- :具有

- :是

- :不是

- :在哪里

- $UP

- 1

- 10

- 100

- 7

- 98

- a

- 关于

- 账号管理

- 横过

- 加

- 采用

- 优点

- 后

- AI

- 算法

- 已经

- 还

- Amazon

- 亚马逊SageMaker

- 亚马逊网络服务

- 其中

- an

- 和

- 应用领域

- 架构

- 保健

- ARM

- AS

- 办公室文员:

- At

- 自动化

- AWS

- 基于

- BE

- 因为

- 很

- 标杆

- 基准

- 好处

- 最佳

- 最佳实践

- 更好

- 带来

- 广阔

- 布罗克

- 建立

- 建

- 内建的

- 负担

- 但是

- by

- CAN

- 例

- 图表

- 分类

- 云端技术

- CO

- 可比

- 相比

- 对照

- 兼容

- 完成

- 计算

- 一台

- 计算机视觉

- 配置

- 包含

- 容器

- 集装箱

- 继续

- 价格

- 节约成本

- 经济有效

- 成本

- 外壳

- 创建

- 目前

- 顾客

- 合作伙伴

- data

- 专用

- 深

- 深入学习

- 交付

- 交付

- 丹佛

- 部署

- 部署

- 部署

- 详细

- 详情

- 开发商

- 研发支持

- 不同

- 讨论

- 不

- 两

- 只

- 效率

- 高效

- 或

- 端点

- 工程师

- 环境

- 评估

- 例子

- 现有

- 体验

- 探索

- 失败

- 特征

- 少数

- 文件

- 金融

- 金融服务

- 找到最适合您的地方

- 专注焦点

- 重点

- 重点

- 以下

- 针对

- 四

- 骨架

- 框架

- 自由的

- 进一步

- 收益

- 一般用途

- 代

- 给

- 授予

- 图形

- 帽子

- 有

- he

- 帮助

- 帮助

- 帮助

- 这里

- 他的

- 主持人

- 创新中心

- HPC

- HTML

- HTTPS

- IBM

- if

- 图片

- 改进

- 改善

- 改善

- in

- 包括

- 包含

- 行业中的应用:

- 信息

- 基础设施

- 例

- 说明

- 保险

- 集成

- 成

- 加盟

- JPG

- 只是

- 语言

- 大

- (姓氏)

- 潜伏

- 信息

- 学习

- 最少

- 库

- 喜欢

- 喜欢

- 清单

- 圖書分館的位置

- 最低

- 机

- 机器学习

- 使

- 管理

- 经理

- 群众

- 满足

- 会员

- 内存

- 迁移

- 移民

- 百万

- ML

- 多播

- 模型

- 模型

- 更多

- 最先进的

- 多媒体

- 多

- 音乐

- 姓名

- 自然

- 自然语言处理

- 需求

- 需要

- 全新

- NLP

- 诺贝尔奖

- 数

- of

- 提供

- on

- 仅由

- 开放源码

- 操作

- 运营

- 优化

- 附加选项

- 附加选项

- or

- 秩序

- 其他名称

- 输出

- 己

- 参数

- 多情

- 性能

- 凤凰

- 挑

- 柏拉图

- 柏拉图数据智能

- 柏拉图数据

- 请

- 热门

- 帖子

- 做法

- 以前

- 先

- 奖金

- 处理

- 处理器

- 生产

- 许诺

- 提供

- 提供

- 提供

- pytorch

- 范围

- 排行

- 达到

- 阅读

- 收到

- 建议

- 红色

- 红帽

- 减少

- 减少

- 研究

- 成果

- 运行

- sagemaker

- SageMaker 推理

- 同

- 储

- 鳞片

- 情景

- scikit学习

- 看到

- 选择

- 前辈

- 服务

- 特色服务

- 几个

- 她

- 显示

- 作品

- 显著

- 类似

- So

- 软件

- 软件开发

- 软件工程师

- 解决方案

- 专家

- 专门

- 稳定性

- 国家的最先进的

- 步

- 步骤

- 简单的

- 支持

- 支持

- Switch 开关

- 产品

- 采取

- 服用

- 教诲

- 团队

- 文案

- tensorflow

- 条款

- 比

- 这

- 信息

- 他们

- Free Introduction

- 三

- 次

- 至

- 工具

- 旅游

- 类型

- 类型

- us

- 可用性

- 使用

- 用过的

- 运用

- 各个

- 厂商

- 愿景

- 想

- we

- 卷筒纸

- Web服务

- 井

- 这

- 将

- 工作

- 工作

- 合作

- XGBoost

- 年

- 完全

- 您一站式解决方案

- 和风网