内容审核在维护在线安全以及维护网站和社交媒体平台的价值观和标准方面发挥着关键作用。 它可以保护用户免遭不当内容的侵害,从而保障他们在数字空间中的福祉,这凸显了其重要性。 例如,在广告行业,内容审核可以保护品牌免受不利的联想,从而有助于品牌提升和收入增长。 广告商优先考虑其品牌与适当内容的一致性,以维护其声誉并避免负面宣传。 内容审核在金融和医疗保健领域也至关重要,它具有多种功能。 它在识别和保护敏感的个人身份信息和健康信息(PII、PHI)方面发挥着重要作用。 通过遵守内部标准和实践以及外部法规,内容审核可以增强用户的数字安全。 这样可以防止机密数据无意中在公共平台上共享,确保保护用户隐私和数据安全。

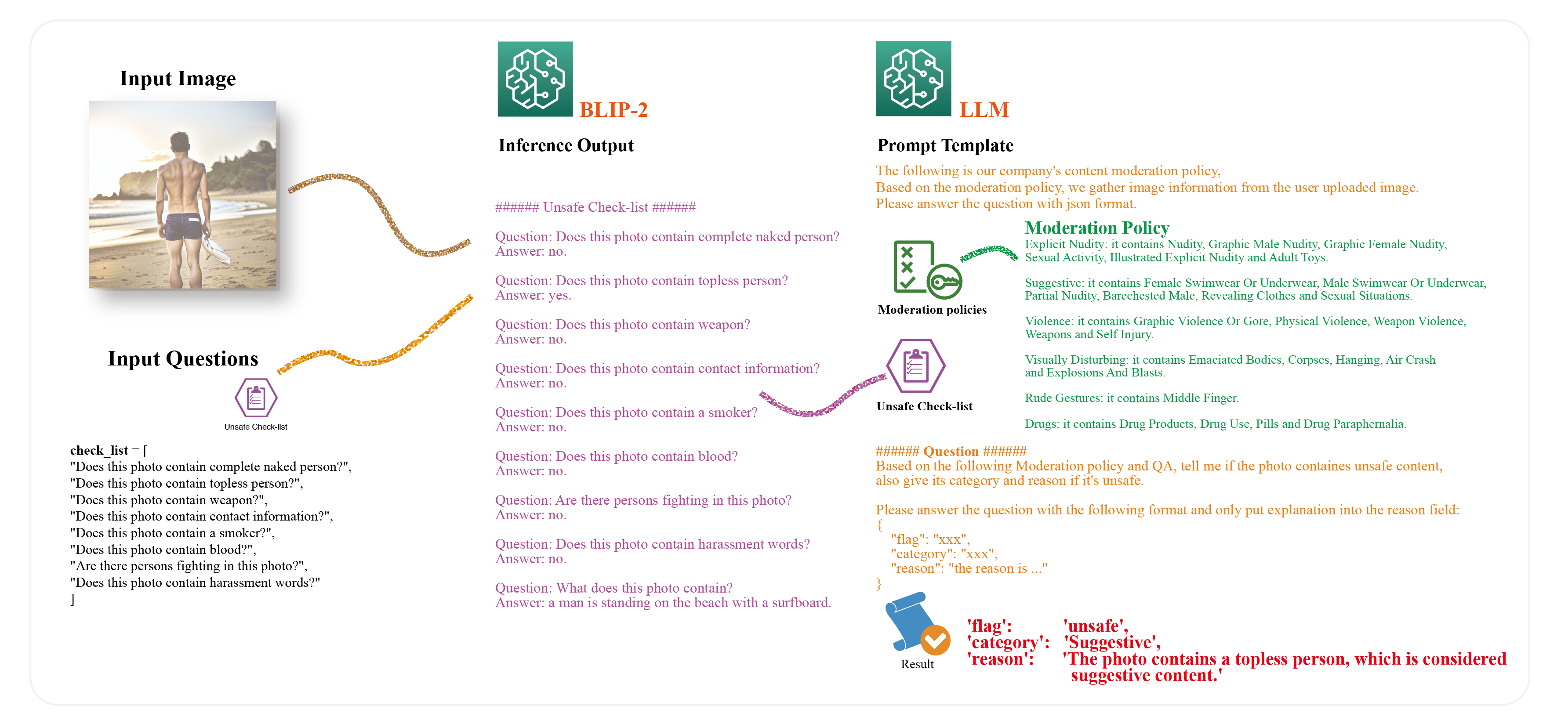

在这篇文章中,我们介绍了一种利用多模态预训练和大型语言模型(LLM)对图像数据进行内容审核的新颖方法。 通过多模态预训练,我们可以根据一组感兴趣的问题直接查询图像内容,并且模型将能够回答这些问题。 这使用户能够与图像聊天,以确认它是否包含任何违反组织政策的不当内容。 我们利用法学硕士强大的生成能力来生成最终决策,包括安全/不安全标签和类别类型。 另外,通过设计提示,我们可以让LLM生成定义的输出格式,例如JSON格式。 设计的提示模板允许法学硕士确定图像是否违反审核政策,识别违规类别,解释原因,并以结构化 JSON 格式提供输出。

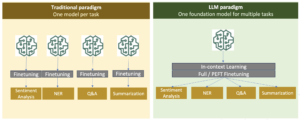

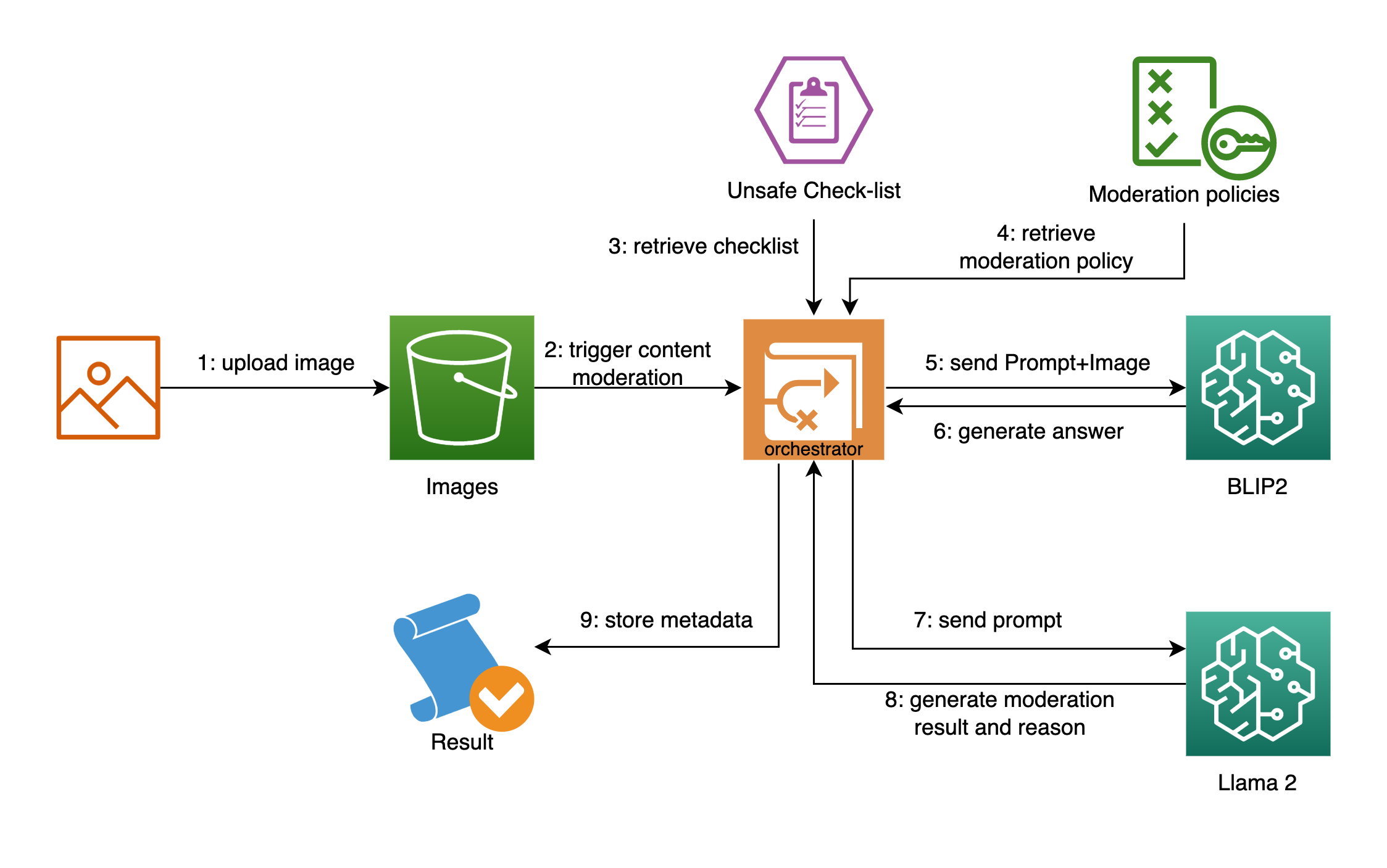

我们使用 BLIP-2 作为多模态预训练方法。 BLIP-2 是多模态预训练中最先进的模型之一,在视觉问答、图像字幕和图像文本检索方面优于大多数现有方法。 对于我们的法学硕士,我们使用 骆驼2,下一代开源法学硕士, 在许多基准测试上都优于现有的开源语言模型,包括推理、编码、熟练程度和知识测试。 下图说明了解决方案的组件。

内容审核的挑战

传统的内容审核方法(例如基于人工的审核)无法跟上用户生成内容 (UGC) 数量的增长。 随着 UGC 数量的增加,人工审核员可能会不知所措,难以有效地审核内容。 这会导致糟糕的用户体验、高昂的审核成本和品牌风险。 基于人的审核也容易出错,这可能导致不一致的审核和有偏见的决策。 为了应对这些挑战,由机器学习 (ML) 驱动的内容审核作为一种解决方案应运而生。 ML 算法可以分析大量 UGC 并识别违反组织政策的内容。 可以训练 ML 模型来识别模式并识别有问题的内容,例如仇恨言论、垃圾邮件和不当材料。 根据研究 通过人工智能驱动的内容审核保护您的用户、品牌和预算,基于 ML 的内容审核可以帮助组织节省团队手动审核内容所花费的高达 95% 的时间。 这使得组织可以将资源集中在更具战略性的任务上,例如社区建设和内容创建。 机器学习驱动的内容审核还可以降低审核成本,因为它比人工审核更有效。

尽管机器学习驱动的内容审核具有优势,但它仍有进一步改进的空间。 机器学习算法的有效性在很大程度上依赖于训练它们的数据的质量。 当使用有偏见或不完整的数据训练模型时,它们可能会做出错误的审核决策,使组织面临品牌风险和潜在的法律责任。 采用基于机器学习的内容审核方法会带来一些挑战,需要仔细考虑。 这些挑战包括:

- 获取标记数据 – 这可能是一个成本高昂的过程,特别是对于需要培训标签人员的复杂内容审核任务。 这种成本使得收集足够大的数据集来轻松训练有监督的机器学习模型变得具有挑战性。 此外,模型的准确性在很大程度上依赖于训练数据的质量,有偏见或不完整的数据可能会导致不准确的审核决策,从而导致品牌风险和法律责任。

- 模型泛化 – 这对于采用基于机器学习的方法至关重要。 在一个数据集上训练的模型可能无法很好地推广到另一个数据集,特别是当数据集具有不同的分布时。 因此,必须确保模型在多样化且具有代表性的数据集上进行训练,以确保其能够很好地推广到新数据。

- 运营效率 – 这是使用传统的基于机器学习的内容审核方法时的另一个挑战。 添加新类别时不断添加新标签并重新训练模型可能非常耗时且成本高昂。 此外,必须确保定期更新模型以跟上所审核内容的变化。

- 可解释性 – 如果内容被无理标记或删除,最终用户可能会认为平台有偏见或不公正,从而导致糟糕的用户体验。 同样,缺乏清晰的解释可能会导致内容审核过程效率低下、耗时且审核者成本高昂。

- 对抗性 – 基于图像的内容审核的对抗性对传统的基于机器学习的方法提出了独特的挑战。 不良行为者可以尝试通过以各种方式更改内容来逃避内容审核机制,例如使用图像的同义词或将其实际内容嵌入到更大的非违规内容中。 这需要不断监控和更新模型,以检测和响应此类对抗策略。

使用 BLIP-2 进行多模态推理

多模态机器学习模型是指能够处理和集成来自多个来源或模态的数据的模型,例如图像、文本、音频、视频和其他形式的结构化或非结构化数据。 流行的多模态模型之一是视觉语言模型,例如 BLIP-2,它结合了计算机视觉和自然语言处理 (NLP) 来理解和生成视觉和文本信息。 这些模型使计算机能够以模仿人类理解的方式解释图像和文本的含义。 视觉语言模型可以处理各种任务,包括图像字幕、图像文本检索、视觉问答等。 例如,图像字幕模型可以生成图像的自然语言描述,图像文本检索模型可以基于文本查询搜索图像。 视觉问答模型可以回答有关图像的自然语言问题,多模式聊天机器人可以使用视觉和文本输入来生成响应。 在内容审核方面,您可以使用此功能来查询问题列表。

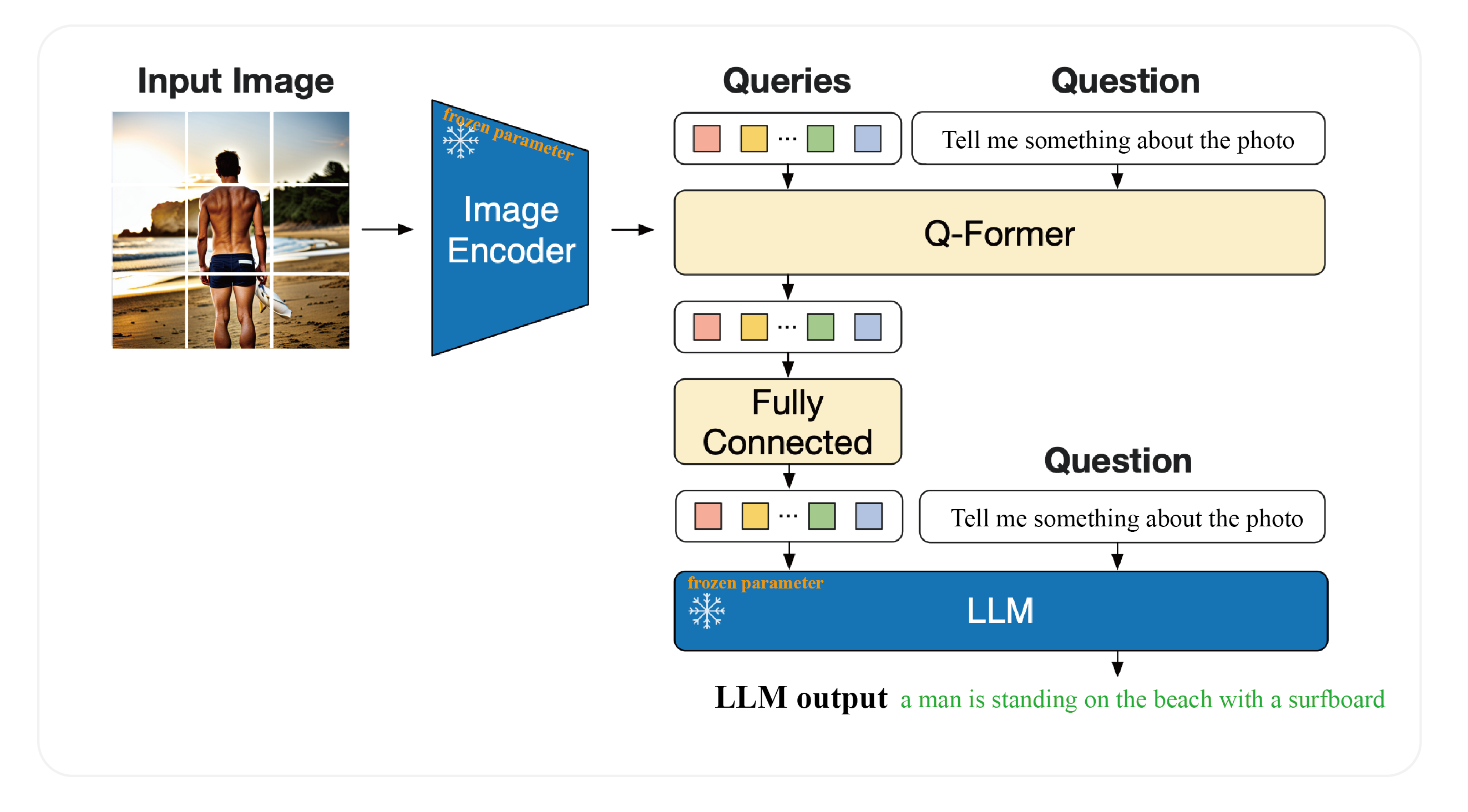

BLIP-2 包含三个部分。 第一个组件是来自 CLIP 的冻结图像编码器 ViT-L/14,它将图像数据作为输入。 第二个组件是冻结的 LLM FlanT5,它输出文本。 第三个组件是一个名为 Q-Former 的可训练模块,它是一个轻量级转换器,将冻结图像编码器与冻结 LLM 连接起来。 Q-Former 采用可学习的查询向量从冻结图像编码器中提取视觉特征,并将最有用的视觉特征提供给 LLM 以输出所需的文本。

预训练过程涉及两个阶段。 在第一阶段,进行视觉语言表示学习,以教导 Q-Former 学习与文本最相关的视觉表示。 在第二阶段,通过将 Q-Former 的输出连接到冻结的 LLM 并训练 Q-Former 以输出可由 LLM 解释的视觉表示来执行视觉到语言的生成学习。

尽管可训练参数比现有方法少得多,但 BLIP-2 在各种视觉语言任务上实现了最先进的性能。 该模型还展示了可以遵循自然语言指令的零样本图像到文本生成的新兴功能。 下图是根据原图修改的 原始研究论文.

解决方案概述

下图说明了解决方案体系结构。

在以下部分中,我们将演示如何将 BLIP-2 部署到 亚马逊SageMaker 端点,并使用 BLIP-2 和 LLM 进行内容审核。

先决条件

您需要一个 AWS 账户 AWS身份和访问管理 (IAM) 角色,有权管理作为解决方案的一部分创建的资源。 详情请参阅 创建独立的 AWS 账户.

如果这是您第一次与 亚马逊SageMaker Studio,你首先需要创建一个 SageMaker 域。 此外,您可能需要请求增加相应 SageMaker 托管实例的服务配额。 对于 BLIP-2 模型,我们使用 ml.g5.2xlarge SageMaker 托管实例。 对于 Llama 2 13B 型号,我们使用 ml.g5.12xlarge SageMaker 托管实例。

将 BLIP-2 部署到 SageMaker 端点

您可以使用以下方式在 SageMaker 上托管 LLM: 大模型推理 (LMI) 容器,针对使用 DJLServing 托管大型模型进行了优化。 DJLServing 是一种高性能通用模型服务解决方案,由与编程语言无关的 Deep Java Library (DJL) 提供支持。 要了解有关 DJL 和 DJLServing 的更多信息,请参阅 使用 DJLServing 和 DeepSpeed 模型并行推理在 Amazon SageMaker 上部署大型模型。 借助 SageMaker LMI 容器,可以使用 Hugging Face 库轻松实现 BLIP-2 模型并托管在 SageMaker 上。 你可以运行 blip2-sagemaker.ipynb 对于这一步。

为了准备Docker镜像和模型文件,您需要检索DJLServing的Docker镜像,将推理脚本和配置文件打包为 model.tar.gz 文件,并将其上传到 亚马逊简单存储服务 (亚马逊 S3)存储桶。 您可以参考 推理脚本和配置文件 以获得更多细节。

inference_image_uri = image_uris.retrieve( framework="djl-deepspeed", region=sess.boto_session.region_name, version="0.22.1"

)

! tar czvf model.tar.gz blip2/

s3_code_artifact = sess.upload_data("model.tar.gz", bucket, s3_code_prefix)当 Docker 映像和推理相关文件准备就绪后,您可以创建模型、端点的配置和端点:

from sagemaker.utils import name_from_base

blip_model_version = "blip2-flan-t5-xl"

model_name = name_from_base(blip_model_version)

model = Model( image_uri=inference_image_uri, model_data=s3_code_artifact, role=role, name=model_name,

)

model.deploy( initial_instance_count=1, instance_type="ml.g5.2xlarge", endpoint_name=model_name

)当端点状态变为可用时,您可以调用端点进行图像字幕和指示的零镜头视觉到语言生成任务。 对于图像字幕任务,您只需将图像传递到端点:

import base64

import json

from PIL import Image smr_client = boto3.client("sagemaker-runtime") def encode_image(img_file): with open(img_file, "rb") as image_file: img_str = base64.b64encode(image_file.read()) base64_string = img_str.decode("latin1") return base64_string def run_inference(endpoint_name, inputs): response = smr_client.invoke_endpoint( EndpointName=endpoint_name, Body=json.dumps(inputs) ) print(response["Body"].read()) test_image = "carcrash-ai.jpeg"

base64_string = encode_image(test_image)

inputs = {"image": base64_string}

run_inference(endpoint_name, inputs)对于指导的零样本视觉到语言生成任务,除了输入图像之外,您还需要将问题定义为提示:

base64_string = encode_image(test_image)

inputs = {"prompt": "Question: what happened in this photo? Answer:", "image": base64_string}

run_inference(endpoint_name, inputs)使用 BLIP-2 和 LLM 进行内容审核

在此阶段,您可以对给定图像进行查询并检索隐藏信息。 使用 LLM,您可以组织查询并检索信息以生成 JSON 格式的结果。 您可以粗略地将这个任务分为以下两个子任务:

- 使用 BLIP-2 模型从图像中提取信息。

- 与法学硕士一起生成最终结果和解释。

使用 BLIP-2 模型从图像中提取信息

要从给定图像中检索足够有用的隐藏信息,您需要定义查询。 由于每个查询都会调用一次端点,因此许多查询将导致更长的处理时间。 因此,我们建议进行高质量的查询并覆盖所有策略,但不要重复。 在我们的示例代码中,我们定义查询如下:

check_list = [ "Does this photo contain complete naked person?", "Does this photo contain topless person?", "Does this photo contain weapon?", "Does this photo contain contact information?", "Does this photo contain a smoker?", "Does this photo contain blood?", "Are there persons fighting in this photo?", "Does this photo contain harassment words?"

]通过前面的查询,调用 BLIP-2 的端点以使用以下代码检索信息:

test_image = "./surf_swimwear.png"

raw_image = Image.open(test_image).convert('RGB') base64_string = encode_image(test_image)

conversations = """"""

for question in check_list: inputs = {"prompt": f"Question: {question}? Answer:", "image": base64_string} response = run_inference(endpoint_name, inputs) conversations += f"""

Question: {question}

Answer: {response}. """除了通过查询检索的信息之外,您还可以通过调用端点来获取图像字幕任务的信息,而无需 prompt 有效负载中的字段:

inputs = {"image": base64_string}

response = smr_client.invoke_endpoint(

EndpointName=endpoint_name, Body=json.dumps(inputs)

)

image_caption = response["Body"].read().decode('utf-8')您可以将查询和答案的内容与图像标题相结合,并将检索到的信息用于下游任务,如下一节所述。

与 LLM 一起生成最终结果和解释

Llama 2 等大型语言模型 (LLM) 可以使用正确的提示模板生成高质量的结果。 使用 亚马逊SageMaker JumpStart,ML 从业者可以从多种公开的基础模型中进行选择。 只需在 SageMaker Studio 中点击几下,您现在就可以 发现并部署 Llama 2.

最终结果取决于具有特定提示模板的法学硕士。 此类提示包括: 基于不当或攻击性类别的审核政策 审核类别; 从BLIP-2中提取的图像信息; 法学硕士的问题模板,询问照片是否包含不安全内容,如果不安全,则要求其类别和原因; 以及以 JSON 格式输出结果的说明。 设计的提示模板允许法学硕士确定图像是否违反审核政策,识别违规类别,解释原因,并以结构化 JSON 格式提供输出。

核心源码如下:

prompt_template = f"""

The following is our company's content moderation policy, based on the moderation policy, we gather image information from the user uploaded image. Please answer the question with json format. ###### moderation policy ######

{moderation_policy} ###### Image information ######

{conversations} ###### Question ######

Based on the following Moderation policy and QA, tell me if the photo containes unsafe content, also give its category and reason if it's unsafe. Please anwser the question with the following format and only put explanation into the reason field: """ prompt_template += """

{ "flag": "xxx", "category": "xxx", "reason": "the reason is ..."

} """ dialog = [ {"role": "user", "content": prompt_template}

]您可以根据自己的用例自定义提示。 请参阅 笔记本 更多细节。 当提示准备就绪时,您可以调用 LLM 端点来生成结果:

endpoint_name = "jumpstart-dft-meta-textgeneration-llama-2-70b-f" def query_endpoint(payload): client = boto3.client("sagemaker-runtime") response = client.invoke_endpoint( EndpointName=endpoint_name, ContentType="application/json", Body=json.dumps(payload), CustomAttributes="accept_eula=true", ) response = response["Body"].read().decode("utf8") response = json.loads(response) return response payload = { "inputs": [dialog], "parameters": {"max_new_tokens": 256, "top_p": 0.9, "temperature": 0.5}

}

result = query_endpoint(payload)[0]生成的部分输出如下:

有时,Llama 2 除了助理的回答之外还会附上额外的解释。 您可以使用解析代码从原始生成的结果中提取 JSON 数据:

answer = result['generation']['content'].split('}')[0]+'}'

json.loads(answer)

生成方法的优点

前面几节介绍了如何实现模型推理的核心部分。 在本节中,我们将介绍生成方法的各个方面,包括与传统方法和观点的比较。

下表对每种方法进行了比较。

| . | 生成法 | 分类法 |

| 获取标记数据 | 在大量图像上预训练模型,零样本推理 | 需要所有类别的数据 |

| 模型泛化 | 具有各种类型图像的预训练模型 | 需要大量内容审核相关数据来提高模型泛化能力 |

| 运营效率 | 零射击能力 | 需要训练模型来识别不同的模式,并在添加标签时重新训练 |

| 可解释性 | 推理即文本输出,用户体验极佳 | 推理难,解释解释难 |

| 对抗性 | 安全性 | 高频再训练 |

内容审核之外的多模态推理的潜在用例

BLIP-2 模型可以应用于多种用途,无论是否进行微调,其中包括:

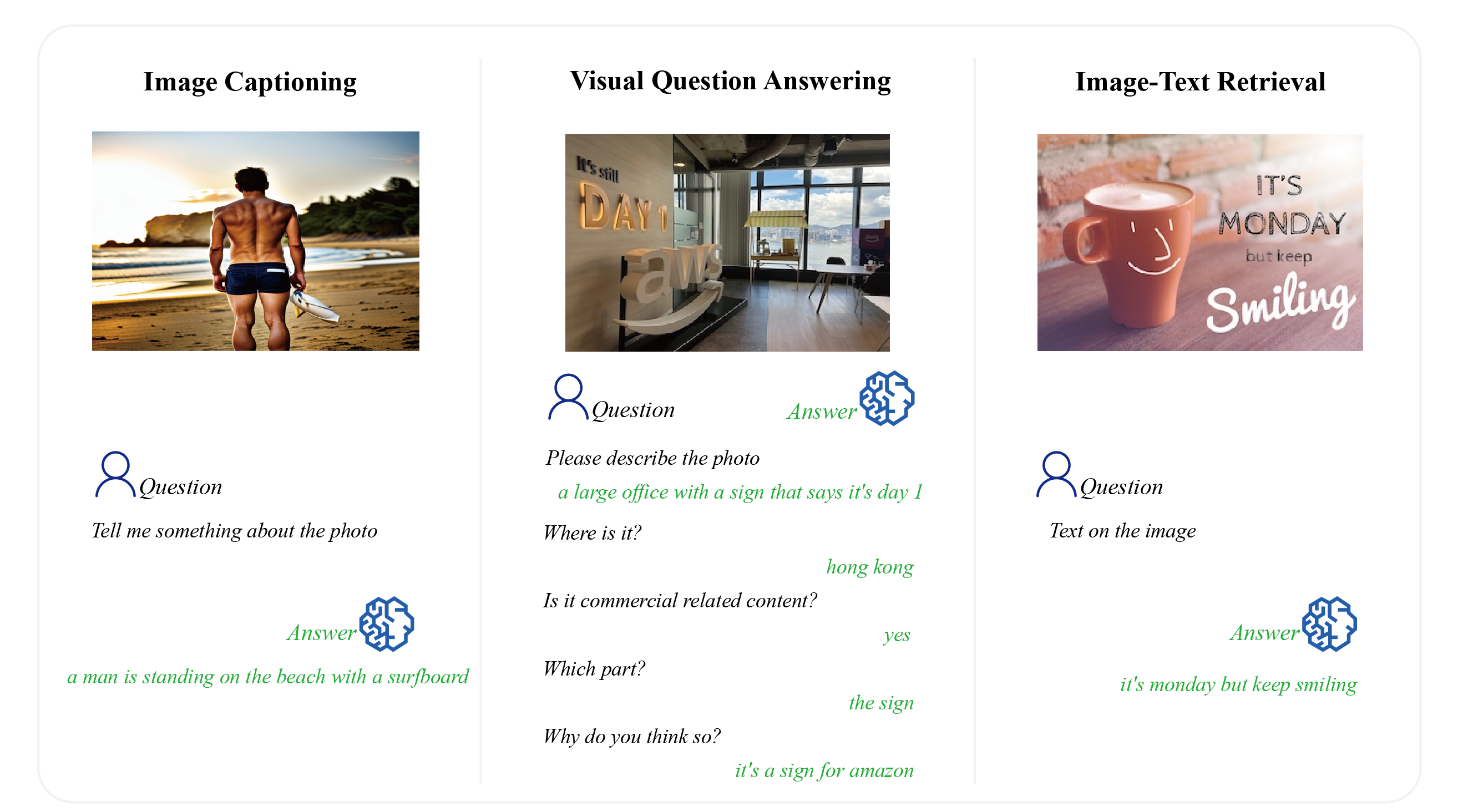

- 图片字幕 – 这要求模型为图像的视觉内容生成文本描述。 如下例图(左)所示,我们可以有 “一个男人拿着冲浪板站在海滩上” 如图像描述。

- 视觉问答 – 正如中间的示例图片所示,我们可以问 “是否是商业相关内容” 我们有 “是” 作为答案。 此外,BLIP-2支持多轮对话并输出以下问题: “你为什么这么认为?” 基于视觉提示和 LLM 功能,BLIP-2 输出 “这是亚马逊的标志。”

- 图片文字检索 – 鉴于问题为 “图像上的文字”,我们可以提取图像文本 “今天是星期一,但请保持微笑” 如右图所示。

下图展示了展示视觉知识推理的零样本图像到文本能力的示例。

正如我们从上面的各种例子中看到的,多模态模型为解决传统单模态模型难以解决的复杂问题提供了新的机会。

清理

为了避免将来产生费用,请删除作为本文一部分创建的资源。 您可以按照笔记本清理部分中的说明执行此操作,或通过 SageMaker 控制台删除创建的终端节点和存储在 S3 存储桶中的资源。

结论

在这篇文章中,我们讨论了数字世界中内容审核的重要性并强调了其挑战。 我们提出了一种新方法来帮助改进图像数据的内容审核,并对图像进行问答以自动提取有用信息。 我们还进一步讨论了与传统的基于分类的方法相比,使用基于生成人工智能的方法的优势。 最后,我们说明了视觉语言模型在内容审核之外的潜在用例。

我们鼓励您通过探索 SageMaker 并使用本文中提供的多模态解决方案以及与您的业务相关的数据集构建解决方案来了解更多信息。

作者简介

高登王 是 AWS 的高级 AI/ML 专家 TAM。 他通过跨多个行业的 AI/ML 最佳实践为战略客户提供支持。 他对计算机视觉、NLP、生成式 AI 和 MLOps 充满热情。 业余时间,他喜欢跑步和徒步旅行。

高登王 是 AWS 的高级 AI/ML 专家 TAM。 他通过跨多个行业的 AI/ML 最佳实践为战略客户提供支持。 他对计算机视觉、NLP、生成式 AI 和 MLOps 充满热情。 业余时间,他喜欢跑步和徒步旅行。

崔艳伟博士,是 AWS 的高级机器学习专家解决方案架构师。 他在 IRISA(计算机科学与随机系统研究所)开始了机器学习研究,并在计算机视觉、自然语言处理和在线用户行为预测方面拥有多年构建人工智能驱动的工业应用程序的经验。 在 AWS,他分享了他的领域专业知识,帮助客户释放业务潜力并通过大规模机器学习推动可行的成果。 工作之余,他喜欢阅读和旅行。

崔艳伟博士,是 AWS 的高级机器学习专家解决方案架构师。 他在 IRISA(计算机科学与随机系统研究所)开始了机器学习研究,并在计算机视觉、自然语言处理和在线用户行为预测方面拥有多年构建人工智能驱动的工业应用程序的经验。 在 AWS,他分享了他的领域专业知识,帮助客户释放业务潜力并通过大规模机器学习推动可行的成果。 工作之余,他喜欢阅读和旅行。

李梅兰妮博士,是澳大利亚悉尼 AWS 的高级 AI/ML 专家 TAM。 她帮助企业客户使用 AWS 上最先进的 AI/ML 工具构建解决方案,并提供有关通过最佳实践构建和实施 ML 解决方案的指导。 在业余时间,她喜欢探索大自然并与家人和朋友共度时光。

李梅兰妮博士,是澳大利亚悉尼 AWS 的高级 AI/ML 专家 TAM。 她帮助企业客户使用 AWS 上最先进的 AI/ML 工具构建解决方案,并提供有关通过最佳实践构建和实施 ML 解决方案的指导。 在业余时间,她喜欢探索大自然并与家人和朋友共度时光。

- SEO 支持的内容和 PR 分发。 今天得到放大。

- PlatoData.Network 垂直生成人工智能。 赋予自己力量。 访问这里。

- 柏拉图爱流。 Web3 智能。 知识放大。 访问这里。

- 柏拉图ESG。 汽车/电动汽车, 碳, 清洁科技, 能源, 环境, 太阳能, 废物管理。 访问这里。

- 柏拉图健康。 生物技术和临床试验情报。 访问这里。

- 图表Prime。 使用 ChartPrime 提升您的交易游戏。 访问这里。

- 块偏移量。 现代化环境抵消所有权。 访问这里。

- Sumber: https://aws.amazon.com/blogs/machine-learning/build-a-generative-ai-based-content-moderation-solution-on-amazon-sagemaker-jumpstart/

- :具有

- :是

- :不是

- :在哪里

- $UP

- 1

- 10

- 100

- 20

- 22

- 7

- 9

- 95%

- a

- Able

- 关于

- 以上

- ACCESS

- 根据

- 账号管理

- 实现

- 演员

- 实际

- 添加

- 添加

- 增加

- 额外

- 另外

- 地址

- 坚持

- 采用

- 采用

- 优点

- 对抗

- 广告

- 广告

- 驳

- AI

- AI供电

- AI / ML

- 算法

- 对准

- 所有类型

- 允许

- 还

- Amazon

- 亚马逊SageMaker

- 亚马逊SageMaker JumpStart

- 亚马逊网络服务

- an

- 分析

- 和

- 另一个

- 回答

- 答案

- 任何

- 应用领域

- 应用的

- 的途径

- 方法

- 适当

- 架构

- 保健

- AS

- 问

- 方面

- 助理

- 协会

- 假设

- At

- 音频

- 澳大利亚

- 自动

- 可使用

- 避免

- AWS

- 坏

- 基于

- BE

- 海滩

- 因为

- 成为

- 成为

- 行为

- 作为

- 如下。

- 基准

- 除了

- 最佳

- 最佳实践

- 超越

- 偏

- 血液

- 身体

- 都

- 品牌

- 品牌

- 带来

- 广阔

- 预算

- 建立

- 建筑物

- 商业

- 但是

- by

- 被称为

- CAN

- 可以得到

- 能力

- 能力

- 小心

- 案件

- 例

- 类别

- 产品类别

- 挑战

- 挑战

- 挑战

- 更改

- 收费

- 聊天机器人

- 类

- 清除

- 客户

- 衣服

- 码

- 编码

- 结合

- 结合

- 商业的

- 社体的一部分

- 社区建设

- 公司

- 相比

- 完成

- 复杂

- 元件

- 组件

- 一台

- 计算机科学

- 计算机视觉

- 电脑

- 配置

- 确认

- 连接

- 所连接

- 考虑

- 考虑

- 由

- 安慰

- 常数

- 经常

- CONTACT

- 包含

- 容器

- 包含

- 内容

- 内容创造

- Contents

- 贡献

- 常规

- 谈话

- 对话

- 核心

- 相应

- 价格

- 昂贵

- 成本

- 可以

- 外壳

- 创建信息图

- 创建

- 创建

- 危急

- USB和Thunderbolt Cross

- 合作伙伴

- 定制

- data

- 数据安全

- 数据集

- 决定

- 决定

- 深

- 定义

- 定义

- 演示

- 证明

- 演示

- 部署

- 描述

- 描述

- 设计

- 设计

- 期望

- 尽管

- 详情

- 检测

- 确定

- 对话框

- 不同

- 数字

- 数字世界

- 直接

- 讨论

- 讨论

- 分布

- 不同

- do

- 码头工人

- 不

- 域

- 驾驶

- 每

- 缓解

- 容易

- 只

- 效用

- 高效

- 嵌入

- 出现

- 新兴经济体的新市场。

- 员工

- enable

- 使

- 鼓励

- 结束

- 端点

- 增强

- 更多

- 确保

- 保证

- 企业

- 故障

- 特别

- 必要

- 例子

- 例子

- 现有

- 体验

- 专门知识

- 说明

- 解释

- 探索

- 探索

- 曝光

- 外部

- 提取

- 面部彩妆

- 下降

- 家庭

- 专栏

- 特征

- 女

- 少数

- 少

- 部分

- 战斗

- 文件

- 档

- 最后

- 金融

- (名字)

- 第一次

- 适合

- 已标记

- 专注焦点

- 遵循

- 以下

- 如下

- 针对

- 格式

- 形式

- 基金会

- 频率

- 朋友

- 止

- 冻结

- 功能

- 进一步

- 未来

- 收集

- 生成

- 产生

- 发电

- 代

- 生成的

- 生成式人工智能

- 得到

- 给

- 特定

- 大

- 成长

- 事业发展

- 指导

- 处理

- 发生

- 硬

- 有

- 有

- he

- 健康管理

- 健康资讯

- 医疗保健

- 严重

- 帮助

- 帮助

- 这里

- 老旧房屋

- 高

- 高性能

- 高品质

- 突出

- 他的

- 主持人

- 托管

- 托管

- 创新中心

- How To

- HTML

- HTTP

- HTTPS

- 人

- 鉴定

- 确定

- 身分

- if

- 说明

- 图片

- 图片

- 实施

- 实施

- 实施

- 进口

- 重要性

- 重要

- 改善

- 改进

- in

- 不准确

- 包括

- 包括

- 包含

- 增加

- 增加

- 产业

- 行业

- 行业中的应用:

- 低效

- 信息

- 输入

- 输入

- 例

- 研究所

- 说明

- 整合

- 兴趣

- 内部

- 成

- 介绍

- IT

- 它的

- 爪哇岛

- JPG

- JSON

- 只是

- 保持

- 知识

- 标签

- 语言

- 大

- 大

- 铅

- 领导

- 学习用品

- 学习

- 左

- 法律咨询

- 负债

- 自学资料库

- 轻巧

- 清单

- 骆驼

- LLM

- 不再

- 爱

- 机

- 机器学习

- 维护

- 使

- 制作

- 男子

- 管理

- 手动

- 许多

- 材料

- 可能..

- me

- 意

- 机制

- 媒体

- 元

- 方法

- 方法

- 中间

- ML

- 多播

- 模型

- 模型

- 适度

- 改性

- 模块

- 周一

- 监控

- 更多

- 更高效

- 最先进的

- 多

- 自然

- 自然语言处理

- 自然

- 需求

- 负

- 全新

- 下页

- NLP

- 笔记本

- 小说

- 现在

- 数

- of

- 进攻

- on

- 一旦

- 一

- 在线

- 仅由

- 打开

- 开放源码

- 机会

- 优化

- or

- 组织

- 原版的

- 其他名称

- 我们的

- 公司简介

- 结果

- 性能优于

- 产量

- 学校以外

- 不堪重负

- 己

- 包

- 并行

- 参数

- 部分

- 尤其

- 部分

- 通过

- 多情

- 模式

- 演出

- 性能

- 执行

- 权限

- 人

- 个人

- 人

- 观点

- 博士学位

- 照片

- 关键的

- 平台

- 平台

- 柏拉图

- 柏拉图数据智能

- 柏拉图数据

- 扮演

- 请

- 政策

- 政策

- 贫困

- 热门

- 帖子

- 潜力

- 潜力

- 供电

- 强大

- 做法

- 预测

- Prepare

- 礼物

- 保存

- 防止

- 优先

- 隐私

- 问题

- 过程

- 处理

- 代码编程

- 建议

- 保护

- 提供

- 提供

- 提供

- 国家

- 公开

- 公然

- 目的

- 放

- Q&A

- 质量

- 查询

- 题

- 有疑问吗?

- 随机

- 阅读

- 准备

- 原因

- 承认

- 认识

- 减少

- 经常

- 法规

- 有关

- 相应

- 依靠

- 去除

- 表示

- 代表

- 声誉

- 请求

- 要求

- 需要

- 研究

- 资源

- 回应

- 响应

- 回复

- 导致

- 导致

- 成果

- 回报

- 揭示

- 收入

- 收入增长

- RGB

- 右

- 风险

- 风险

- 角色

- περίπου

- 第

- 运行

- 运行

- s

- 保护

- 实现安全

- sagemaker

- 鳞片

- 科学

- 搜索

- 其次

- 部分

- 部分

- 行业

- 保安

- 看到

- 选择

- 前辈

- 敏感

- 服务

- 服务

- 特色服务

- 服务

- 集

- 几个

- 有性

- 分享

- 共享

- 她

- Shield

- 显示

- 显示

- 作品

- 签署

- 意义

- 显著

- 同样

- 简易

- 情况

- So

- 社会

- 社会化媒体

- 社会化媒体平台

- 方案,

- 解决方案

- 解决

- 来源

- 源代码

- 来源

- 太空

- 剩余名额

- 垃圾邮件

- 专家

- 具体的

- 言语

- 花

- 分裂

- 阶段

- 实习

- 独立

- 标准

- 开始

- 国家的最先进的

- 州

- Status

- 步

- 仍

- 存储

- 存储

- 善用

- 结构化

- 奋斗

- 工作室

- 学习

- 这样

- 建议

- 支持

- 悉尼

- 产品

- 表

- 滑车

- 策略

- 需要

- 任务

- 任务

- 队

- 展示

- 模板

- 条款

- 文本

- 文字的

- 比

- 这

- 信息

- 其

- 那里。

- 从而

- 因此

- 博曼

- 他们

- 认为

- 第三

- Free Introduction

- 三

- 次

- 耗时的

- 至

- 工具

- 传统

- 培训

- 熟练

- 产品培训

- 变压器

- 旅游

- 二

- 类型

- 类型

- 下

- 理解

- 理解

- 独特

- 普遍

- 开锁

- 更新

- 更新

- 坚持

- 上传

- 使用

- 用例

- 用户

- 用户体验

- 用户隐私

- 用户

- 运用

- 价值观

- 各种

- 各个

- 通过

- 视频

- 违反

- 愿景

- 体积

- 卷

- 方法..

- 方法

- we

- 卷筒纸

- Web服务

- 网站

- 井

- 什么是

- ,尤其是

- 这

- 为什么

- 将

- 中

- 也完全不需要

- 话

- 工作

- 加工

- 世界

- 将

- 年

- 完全

- 您一站式解决方案

- 和风网