药物开发是一个复杂而漫长的过程,涉及筛选数千种候选药物并使用计算或实验方法来评估先导化合物。 根据麦肯锡的说法单一药物可能需要 10 年时间,平均花费 2.6 亿美元来完成疾病靶点识别、药物筛选、药物靶点验证以及最终的商业上市。 药物发现是该管道的研究组成部分,它产生最有可能有效且对患者伤害最小的候选药物。 机器学习 (ML) 方法可以帮助在药物发现过程的每个阶段识别合适的化合物,从而更加简化药物优先级排序和测试,从而节省数十亿美元的药物开发成本(有关更多信息,请参阅 生物制药研究中的人工智能:聚焦和扩展的时代).

药物靶标通常是称为 蛋白质,生命的基石。 蛋白质的 3D 结构决定了它如何与药物化合物相互作用; 因此,了解蛋白质 3D 结构可以通过筛选更适合目标蛋白质结构的药物化合物来显着改进药物开发过程。 蛋白质结构预测的另一个有用领域是了解蛋白质的多样性,以便我们只选择选择性靶向特定蛋白质而不影响体内其他蛋白质的药物(有关更多信息,请参阅 改进生物医学研究的目标评估:GOT-IT 建议)。 目标蛋白的精确 3D 结构可以使药物设计具有更高的特异性并降低与其他蛋白交叉相互作用的可能性。

然而,预测蛋白质如何折叠成 3D 结构是一个难题,X 射线晶体学和 NMR 光谱等传统实验方法可能既耗时又昂贵。 蛋白质研究深度学习方法的最新进展显示出使用神经网络以极高的准确性预测蛋白质折叠的前景。 折叠算法如 阿尔法折叠2, ESM折叠, 打开折叠及 玫瑰TT折叠 可用于快速建立精确的蛋白质结构模型。 不幸的是,这些模型的运行计算成本很高,并且在数千个候选蛋白质结构的规模上比较结果可能很麻烦。 使用这些不同工具的可扩展解决方案将使研究人员和商业研发团队能够快速整合蛋白质结构预测的最新进展,管理他们的实验过程,并与研究合作伙伴合作。

亚马逊SageMaker 是一项完全托管的服务,可通过汇集专为 ML 构建的广泛功能来快速准备、构建、训练和部署高质量的 ML 模型。 它为 ML 提供了一个完全托管的环境,抽象了基础设施、数据管理和可扩展性要求,以便您可以专注于构建、训练和测试模型。

在这篇文章中,我们提出了一个使用 SageMaker 的完全托管的 ML 解决方案,该解决方案简化了蛋白质折叠结构预测工作流程的操作。 我们首先讨论高层解决方案及其用户体验。 接下来,我们将引导您了解如何使用 SageMaker 轻松设置 AlphaFold2 和 OpenFold 的计算优化工作流程。 最后,我们演示如何在典型分析中跟踪和比较蛋白质结构预测。 该解决方案的代码可在下面找到 GitHub存储库.

解决方案概述

在此解决方案中,科学家可以交互式地启动蛋白质折叠实验、分析 3D 结构、监控工作进度并跟踪实验 亚马逊SageMaker Studio.

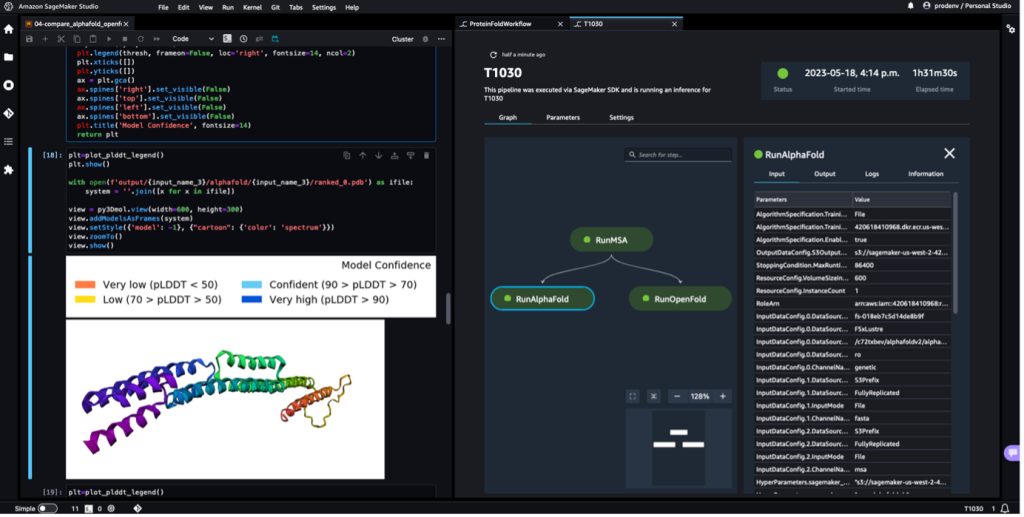

以下屏幕截图显示了使用 Amazon SageMaker Studio 运行的蛋白质折叠工作流程的单次运行。 它包括笔记本中 3D 结构的可视化、工作流程中 SageMaker 作业的运行状态以及输入参数和输出数据和日志的链接。

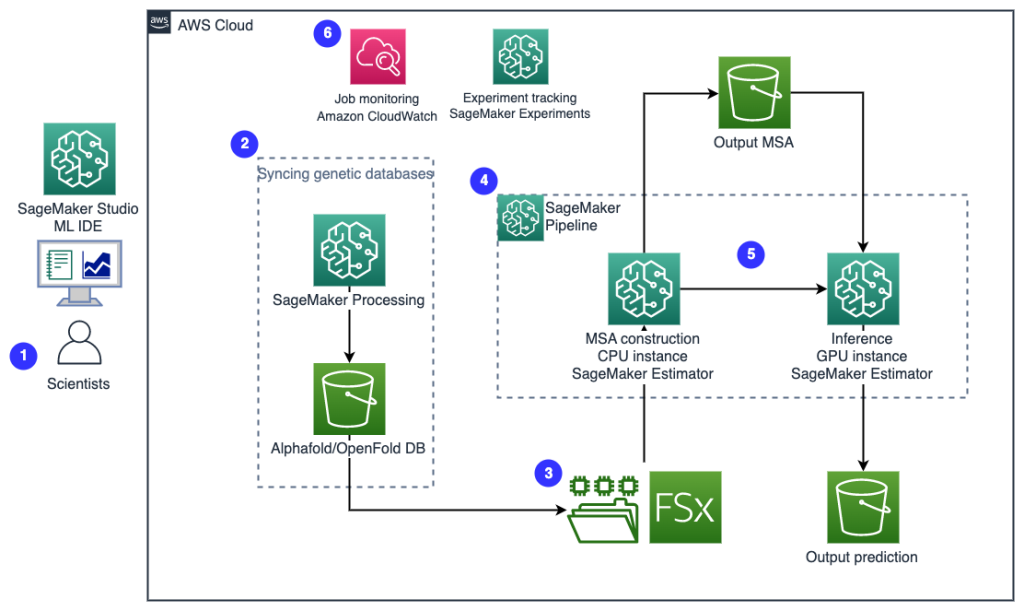

下图说明了高级解决方案架构。

为了理解该架构,我们首先定义蛋白质折叠实验的关键组成部分,如下所示:

- FASTA目标序列文件 ——由数百家创建、维护和提供物联网(IoT)全球开放标准的公司所组成的 FASTA格式 是一种基于文本的格式,用于表示核苷酸序列或氨基酸(蛋白质)序列,其中核苷酸或氨基酸使用单字母代码表示。

- 遗传数据库 – 遗传数据库是与软件一起存储的一组或多组遗传数据,使用户能够检索遗传数据。 运行 AlphaFold 和 OpenFold 算法需要多个遗传数据库,例如 BFD, 麦尼菲, PDB70, PDB, PDB序列, UniRef30(FKA UniClust30), 尤尼普罗特及 统一参考90.

- 多序列比对 (MSA) - A 序列比对 是一种排列蛋白质一级序列以识别相似区域的方法,这些相似区域可能是序列之间功能、结构或进化关系的结果。 用于预测的输入特征包括 MSA 数据。

- 蛋白质结构预测 – 使用折叠算法预测输入目标序列的结构,例如 阿尔法折叠2 和 打开折叠 使用在已知蛋白质模板上训练的多轨变压器架构。

- 可视化和指标 – 使用可视化 3D 结构 py3D摩尔 作为交互式 3D 可视化的库。 您可以使用指标来评估和比较结构预测,最值得注意的是 均方根偏差 (均方根差)和 模板建模分数 (TM-分数)

工作流包含以下步骤:

- 科学家使用基于 Web 的 SageMaker ML IDE 探索代码库,在 SageMaker Studio 笔记本中构建蛋白质序列分析工作流程,并通过 SageMaker Studio 或 SageMaker SDK 中的图形用户界面运行蛋白质折叠管道。

- AlphaFold 和 OpenFold 所需的遗传和结构数据库在管道设置之前使用下载 Amazon SageMaker处理,用于 ML 数据处理的临时计算功能, 亚马逊简单存储服务 (亚马逊 S3)存储桶。 借助 SageMaker Processing,您可以通过适当的计算来运行长时间运行的作业,而无需设置任何计算集群和存储,也无需关闭集群。 数据会自动保存到指定的 S3 存储桶位置。

- An 适用于Lustre的Amazon FSx 文件系统已设置,数据存储库是保存数据库的 S3 存储桶位置。 FSx for Lustre 可以通过低延迟文件检索扩展到数百 GB/s 的吞吐量和数百万 IOPS。 启动估算器作业时,SageMaker 会将 FSx for Lustre 文件系统挂载到实例文件系统,然后启动脚本。

- Amazon SageMaker管道 用于协调蛋白质折叠算法的多次运行。 SageMaker Pipelines 为交互式作业提交、进度可追溯性和可重复性提供了所需的可视化界面。

- 在管道中,两种计算量大的蛋白质折叠算法(AlphaFold 和 OpenFold)使用 SageMaker 估计器运行。 此配置支持安装 FSx for Lustre 文件系统,以便在算法中进行高吞吐量数据库搜索。 单个推理运行分为两个步骤:使用最佳 CPU 实例的 MSA 构建步骤和使用 GPU 实例的结构预测步骤。 这些子步骤(例如步骤 2 中的 SageMaker 处理)是短暂的、按需的且完全托管的。 作业输出(例如 MSA 文件、预测的 pdb 结构文件和其他元数据文件)保存在指定的 S3 位置。 管道可以设计为运行一种蛋白质折叠算法,或者在通用 MSA 构建后运行 AlphaFold 和 OpenFold。

- 蛋白质折叠预测的运行由以下自动跟踪 Amazon SageMaker实验 以供进一步分析和比较。 作业日志保存在 亚马逊CloudWatch 用于监控。

先决条件

要遵循这篇文章并运行此解决方案,您需要完成几个先决条件。 请参阅 GitHub存储库 每个步骤的详细说明。

在 SageMaker 上运行蛋白质折叠

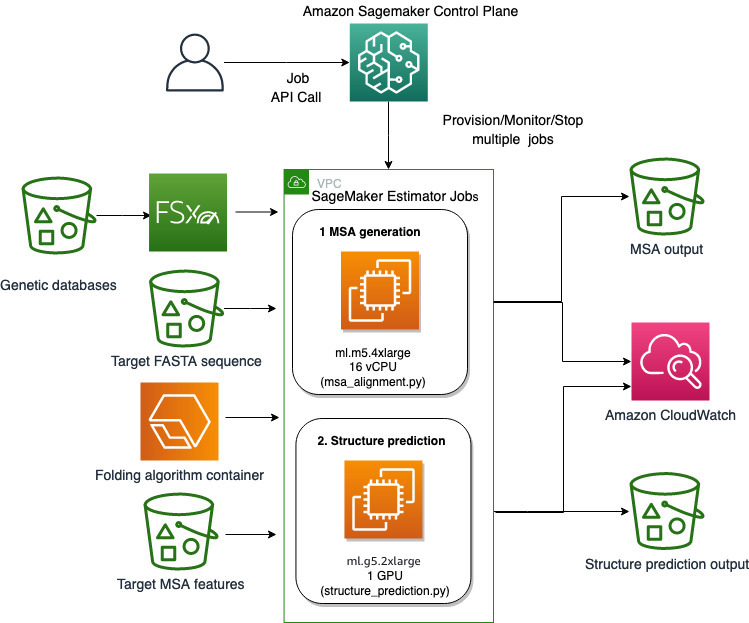

我们使用 SageMaker 的完全托管功能来运行计算量大的蛋白质折叠作业,而无需太多基础设施开销。 SageMaker 使用容器映像运行自定义脚本以进行通用数据处理、培训和托管。 您可以轻松地按需启动临时作业,该作业使用容器映像运行程序,其中包含几行 SageMaker 开发工具包 无需自行管理任何计算基础设施。 具体来说,SageMaker 估算器作业在选择容器映像、运行脚本和实例配置时提供了灵活性,并支持 多种存储选项,包括文件系统,例如 FSx for Lustre。 下图说明了这种架构。

AlphaFold 和 OpenFold 等折叠算法使用在已知蛋白质模板上训练的多轨变压器架构来预测未知肽序列的结构。 这些预测可以在 GPU 实例上运行,以提供最佳吞吐量和最低延迟。 然而,这些预测的输入特征包括 MSA 数据。 MSA 算法依赖于 CPU,可能需要几个小时的处理时间。

在同一计算环境中运行 MSA 和结构预测步骤可能成本效率低下,因为在 MSA 步骤运行时,昂贵的 GPU 资源保持空闲状态。 因此,我们将工作流程优化为两个步骤。 首先,我们在 CPU 实例上运行 SageMaker 估计器作业,专门用于在给定特定 FASTA 输入序列和源遗传数据库的情况下计算 MSA 比对。 然后,我们在 GPU 实例上运行 SageMaker 估计器作业,以使用给定的输入 MSA 比对和 AlphaFold 或 OpenFold 等折叠算法来预测蛋白质结构。

运行 MSA 生成

对于 MSA 计算,我们包含一个自定义脚本 run_create_alignment.sh 和 create_alignments.py 采用现有 AlphaFold 预测源的脚本 run_alphafold.py。 请注意,如果更新了 AlphaFold 源代码,则可能需要更新此脚本。 自定义脚本通过以下方式提供给 SageMaker 估算器 脚本模式。 容器映像、脚本模式实现和设置 SageMaker 估计器作业的关键组件也是运行折叠算法的下一步的一部分,并将在下一节中进一步描述。

运行 AlphaFold

我们首先使用 SageMaker 对单个蛋白质序列运行 AlphaFold 结构预测。 运行 AlphaFold 作业涉及三个简单的步骤,如所示 01-run_stepbystep.ipynb。 首先,我们基于AlphaFold构建一个Docker容器镜像 Dockerfile 这样我们也可以 运行 AlphaFold 在 SageMaker 中。 其次,我们构建脚本 run_alphafold.sh 指示 AlphaFold 应如何运行。 第三,我们建设并运行 SageMaker估算器 包含作业的脚本、容器、实例类型、数据和配置。

容器图片

使用 AlphaFold 的 Dockerfile 可以大大简化在 SageMaker 中运行 AlphaFold(以及 OpenFold)的容器映像的运行时要求。 我们只需在顶部添加一些简单的层即可安装 SageMaker 特定的 Python 库,以便 SageMaker 作业可以与容器映像进行通信。 请看下面的代码:

输入脚本

然后我们提供脚本 run_alphafold.sh 运行 run_alphafold.py 来自当前放置在容器中的 AlphaFold 存储库 /app/alphafold/run_alphafold.py。 运行此脚本时,遗传数据库的位置和输入 FASTA 序列将由 SageMaker 作为环境变量填充(SM_CHANNEL_GENETIC 和 SM_CHANNEL_FASTA, 分别)。 欲了解更多信息,请参阅 输入数据配置.

估价员工作

接下来,我们使用具有以下关键输入参数的 SageMaker 估计器创建一个作业,这些参数指示 SageMaker 使用具有实例类型或计数、您选择的网络选项以及作业的其他参数的指定容器来运行特定脚本。 vpc_subnet_ids 和 security_group_ids 指示作业在 FSx for Lustre 文件系统所在的特定 VPC 内运行,以便我们可以在 SageMaker 作业中挂载和访问文件系统。 输出路径是指 S3 存储桶位置,在成功作业结束时,SageMaker 将自动将 AlphaFold 的最终产品上传到该位置。 这里我们还设置一个参数 DB_PRESET,例如,要传入并在其中访问 run_alphafold.sh 作为运行时的环境变量。 请看下面的代码:

from sagemaker.estimator import Estimator

alphafold_image_uri=f'{account}.dkr.ecr.{region}.amazonaws.com/sagemaker-studio-alphafold:v2.3.0'

instance_type='ml.g5.2xlarge'

instance_count=1

vpc_subnet_ids=['subnet-xxxxxxxxx'] # okay to use a default VPC

security_group_ids=['sg-xxxxxxxxx']

env={'DB_PRESET': db_preset} # <full_dbs|reduced_dbs>

output_path='s3://%s/%s/job-output/'%(default_bucket, prefix) estimator_alphafold = Estimator(

source_dir='src', # directory where run_alphafold.sh and other runtime files locate

entry_point='run_alphafold.sh', # our script that runs /app/alphafold/run_alphafold.py

image_uri=alphafold_image_uri, # container image to use

instance_count=instance_count, #

instance_type=instance_type,

subnets=vpc_subnet_ids,

security_group_ids=security_group_ids,

environment=env,

output_path=output_path,

...)最后,我们收集数据并让作业知道它们在哪里。 这 fasta 数据通道定义为 S3 数据输入,将在作业开始时从 S3 位置下载到计算实例中。 这使得管理和指定输入序列具有很大的灵活性。 另一方面, genetic 数据通道被定义为 FileSystemInput 它将在作业开始时安装到实例上。 使用 FSx for Lustre 文件系统作为引入近 3 TB 数据的一种方式,可以避免重复地将数据从 S3 存储桶下载到计算实例。 我们称之为 .fit 启动 AlphaFold 作业的方法:

from sagemaker.inputs import FileSystemInput

file_system_id='fs-xxxxxxxxx'

fsx_mount_id='xxxxxxxx'

file_system_directory_path=f'/{fsx_mount_id}/{prefix}/alphafold-genetic-db' # should be the full prefix from the S3 data repository file_system_access_mode='ro' # Specify the access mode (read-only)

file_system_type='FSxLustre' # Specify your file system type genetic_db = FileSystemInput(

file_system_id=file_system_id,

file_system_type=file_system_type,

directory_path=file_system_directory_path,

file_system_access_mode=file_system_access_mode) s3_fasta=sess.upload_data(path='sequence_input/T1030.fasta', # FASTA location locally

key_prefix='alphafoldv2/sequence_input') # S3 prefix. Bucket is sagemaker default bucket

fasta = sagemaker.inputs.TrainingInput(s3_fasta,

distribution='FullyReplicated',

s3_data_type='S3Prefix',

input_mode='File')

data_channels_alphafold = {'genetic': genetic_db, 'fasta': fasta} estimator_alphafold.fit(inputs=data_channels_alphafold,

wait=False) # wait=False gets the cell back in the notebook; set to True to see the logs as the job progresses就是这样。 我们刚刚向 SageMaker 提交了一个运行 AlphaFold 的作业。 日志和输出(包括 .pdb 预测文件)将写入 Amazon S3。

运行打开折叠

在 SageMaker 中运行 OpenFold 遵循类似的模式,如后半部分所示 01-run_stepbystep.ipynb。 我们首先添加一个简单的层来获取 SageMaker 特定的库,以使容器镜像 SageMaker 在 OpenFold 之上兼容 Dockerfile。 其次,我们构造一个 run_openfold.sh 作为 SageMaker 作业的入口点。 在 run_openfold.sh,我们运行 run_pretrained_openfold.py 来自 OpenFold,即 在容器镜像中可用 使用我们下载的 AlphaFold 和 OpenFold 模型权重相同的遗传数据库(--openfold_checkpoint_path)。 在输入数据位置方面,除了遗传数据库通道和FASTA通道之外,我们引入了第三个通道, SM_CHANNEL_PARAM,这样我们在定义和提交作业时就可以灵活地从估计器构造中传递选择的模型权重。 借助 SageMaker 估算器,我们可以轻松提交具有不同类型的作业 entry_point, image_uri, environment, inputs,以及具有相同签名的 OpenFold 的其他配置。 对于数据通道,我们添加一个新通道, param,作为 Amazon S3 输入,并使用来自 FSx for Lustre 文件系统的相同遗传数据库和来自 Amazon S3 的 FASTA 文件。 这再次使我们能够轻松地从作业构造中指定要使用的模型权重。 请看下面的代码:

s3_param=sess.upload_data(path='openfold_params/finetuning_ptm_2.pt',

key_prefix=f'{prefix}/openfold_params')

param = sagemaker.inputs.TrainingInput(s3_param,

distribution="FullyReplicated",

s3_data_type="S3Prefix",

input_mode='File') data_channels_openfold = {"genetic": genetic_db, 'fasta': fasta, 'param': param} estimator_openfold.fit(inputs=data_channels_openfold,

wait=False)要在作业完成后访问最终输出,我们运行以下命令:

!aws s3 cp {estimator_openfold.model_data} openfold_output/model.tar.gz

!tar zxfv openfold_output/model.tar.gz -C openfold_output/运行时性能

下表显示,与单个计算作业相比,通过将 MSA 对齐和折叠算法拆分为两个作业,AlphaFold 和 OpenFold 分别节省了 57% 和 51% 的成本。 它允许我们调整每个作业的计算大小:ml.m5.4xlarge 用于 MSA 对齐,ml.g5.2xlarge 用于 AlphaFold 和 OpenFold。

| 招聘详情 | 实例类型 | 输入 FASTA 序列 | 运行时 | 价格 |

| MSA 对齐 + OpenFold | ml.g5.4xlarge | T1030 | 50分钟 | $1.69 |

| MSA 对齐 + AlphaFold | ml.g5.4xlarge | T1030 | 65分钟 | $2.19 |

| MSA 对齐 | ml.m5.4x大 | T1030 | 46分钟 | $0.71 |

| 打开折叠 | ml.g5.2xlarge | T1030 | 6分钟 | $0.15 |

| AlphaFold | ml.g5.2xlarge | T1030 | 21分钟 | $0.53 |

使用 SageMaker Pipelines 构建可重复的工作流程

借助 SageMaker Pipelines,我们可以创建一个 ML 工作流程,负责管理步骤之间的数据、编排其运行和日志记录。 SageMaker Pipelines 还为我们提供了一个 UI 来可视化我们的管道并轻松运行我们的 ML 工作流程。

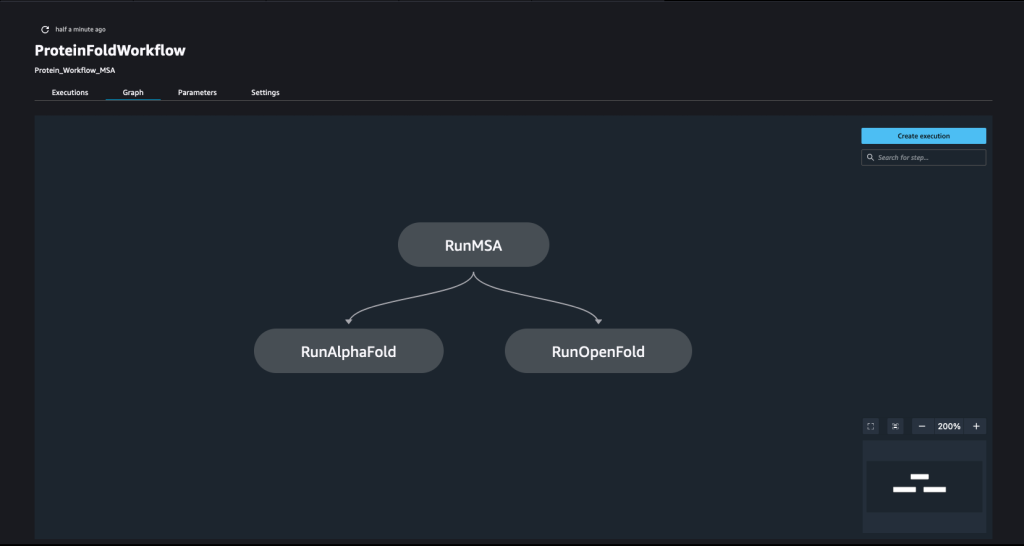

管道是通过组合多个 步骤。 在此管道中,我们结合了三个 训练步骤,这需要 SageMaker 估计器。 此笔记本中定义的估计器与中定义的非常相似 01-run_stepbystep.ipynb,但我们使用 Amazon S3 位置来指向我们的输入和输出。 动态变量允许 SageMaker Pipelines 依次运行步骤,并允许用户重试失败的步骤。 以下屏幕截图显示了有向无环图 (DAG),它提供了有关管道每个步骤的要求和之间关系的信息。

动态变量

SageMaker Pipelines 能够在每次管道运行开始时获取用户输入。 我们定义了以下动态变量,我们希望在每次实验期间更改这些变量:

- Fasta输入S3URI – 通过 SDK、Boto3 或手动上传的 FASTA 文件的 Amazon S3 URI。

- 快速文件名 – FASTA 文件的名称。

- 数据库预设 – 选择之间

full_dbsorreduced_dbs. - 最大模板日期 – AlphaFold 的 MSA 步骤将搜索此参数指定的日期之前的可用模板。

- 模型预设 – 在 AlphaFold 型号之间进行选择,包括

monomer,monomer_casp14,monomer_ptm及multimer. - 每个模型的多聚体预测数 – 使用多聚体系统时每个模型运行的种子数。

- 推理实例类型 – 用于推理步骤的实例类型(AlphaFold 和 OpenFold)。 默认值为 ml.g5.2xlarge。

- MSA实例类型 – 用于 MSA 步骤的实例类型。 默认值为 ml.m5.4xlarge。

请参见以下代码:

fasta_file = ParameterString(name="FastaFileName")

fasta_input = ParameterString(name="FastaInputS3URI")

pipeline_db_preset = ParameterString(name="db_preset",

default_value='full_dbs',

enum_values=['full_dbs', 'reduced_dbs'])

max_template_date = ParameterString(name="MaxTemplateDate")

model_preset = ParameterString(name="ModelPreset")

num_multimer_predictions_per_model = ParameterString(name="NumMultimerPredictionsPerModel")

msa_instance_type = ParameterString(name="MSAInstanceType", default_value='ml.m5.4xlarge')

instance_type = ParameterString(name="InferenceInstanceType", default_value='ml.g5.2xlarge')SageMaker 管道的构建方式是定义一系列步骤,然后将它们按特定顺序链接在一起,其中上一步的输出成为下一步的输入。 步骤可以并行运行并定义为依赖于前一步骤。 在此管道中,我们定义一个 MSA 步骤,它是并行运行的 AlphaFold 推理步骤和 OpenFold 推理步骤的依赖项。 请看下面的代码:

step_msa = TrainingStep(

name="RunMSA",

step_args=pipeline_msa_args,

) step_alphafold = TrainingStep(

name="RunAlphaFold",

step_args=pipeline_alphafold_default_args,

)

step_alphafold.add_depends_on([step_msa]) step_openfold = TrainingStep(

name="RunOpenFold",

step_args=pipeline_openfold_args,

)

step_openfold.add_depends_on([step_msa]为了将所有步骤放在一起,我们称之为 Pipeline 类并提供管道名称、管道输入变量和各个步骤:

pipeline_name = f"ProteinFoldWorkflow"

pipeline = Pipeline(

name=pipeline_name,

parameters=[

fasta_input,

instance_type,

msa_instance_type,

pipeline_db_preset

],

steps=[step_msa, step_alphafold, step_openfold],

) pipeline.upsert(role_arn=role, # run this if it's the first time setting up the pipeline

description='Protein_Workflow_MSA')运行管道

在笔记本的最后一个单元格中 02-define_pipeline.ipynb,我们展示了如何使用 SageMaker SDK 运行管道。 我们之前描述的动态变量提供如下:

!mkdir ./sequence_input/

!curl 'https://www.predictioncenter.org/casp14/target.cgi?target=T1030&view=sequence' > ./sequence_input/T1030.fasta

fasta_file_name = 'T1030.fasta' pathName = f'./sequence_input/{fasta_file_name}'

s3_fasta=sess.upload_data(path=pathName,

key_prefix='alphafoldv2/sequence_input') PipelineParameters={ 'FastaInputS3URI':s3_fasta, 'db_preset': 'full_dbs', 'FastaFileName': fasta_file_name, 'MaxTemplateDate': '2020-05-14', 'ModelPreset': 'monomer', 'NumMultimerPredictionsPerModel': '5', 'InferenceInstanceType':'ml.g5.2xlarge', 'MSAInstanceType':'ml.m5.4xlarge'

}

execution = pipeline.start(execution_display_name='SDK-Executetd',

execution_description='This pipeline was executed via SageMaker SDK',

parameters=PipelineParameters

)跟踪实验并比较蛋白质结构

在我们的实验中,我们使用来自 CASP14 竞争,为蛋白质结构建模方法的评估提供了独立的机制。 目标 T1030 衍生自 PDB 6P00 蛋白,一级序列有 237 个氨基酸。 我们运行 SageMaker 管道,使用 OpenFold 和 AlphaFold 算法预测该输入序列的蛋白质结构。

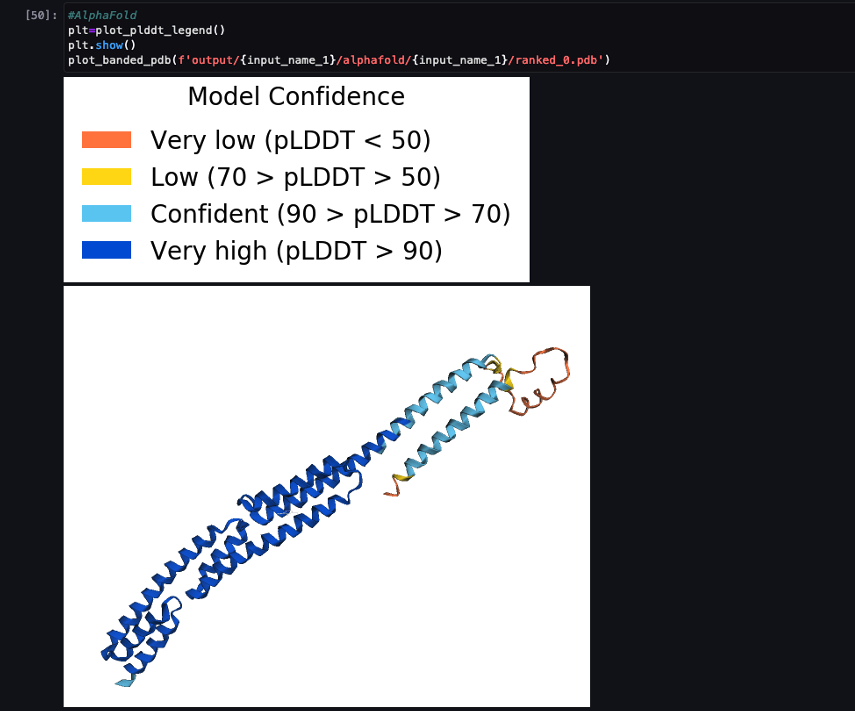

管道完成后,我们从每个折叠作业下载预测的 .pdb 文件,并使用以下命令可视化笔记本中的结构 py3D摩尔,如笔记本中所示 04-compare_alphafold_openfold.ipynb.

以下屏幕截图显示了 AlphaFold 预测作业的预测。

使用 PDB 代码将预测的结构与其已知的基本参考结构进行比较 6便便 存档于 RCSB。 我们使用三个指标来分析针对基本 PDB 代码 6poo 的预测性能:RMSD、叠加的 RMSD 和模板建模分数,如中所述 结构比较.

| . | 输入序列 | 比较 | 均方根偏差 | 叠加的 RMSD | 模板建模分数 |

| AlphaFold | T1030 | 6便便 | 247.26 | 3.87 | 0.3515 |

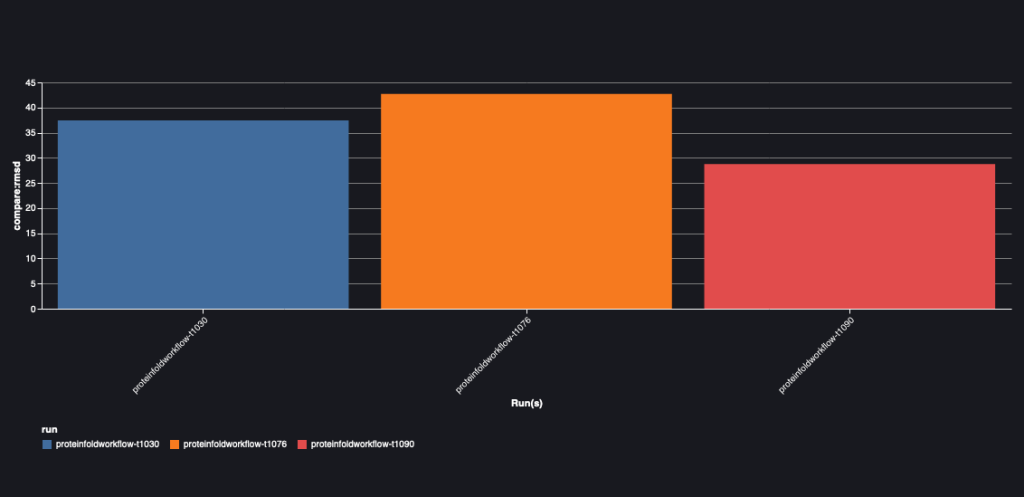

现在针对多个 FASTA 序列对折叠算法进行相互比较: T1030, T1090及 T1076。 新的目标序列可能不具有参考数据库中的基本 pdb 结构,因此比较折叠算法之间的变异性很有用。

| . | 输入序列 | 比较 | 均方根偏差 | 叠加的 RMSD | 模板建模分数 |

| AlphaFold | T1030 | 打开折叠 | 73.21 | 24.8 | 0.0018 |

| AlphaFold | T1076 | 打开折叠 | 38.71 | 28.87 | 0.0047 |

| AlphaFold | T1090 | 打开折叠 | 30.03 | 20.45 | 0.005 |

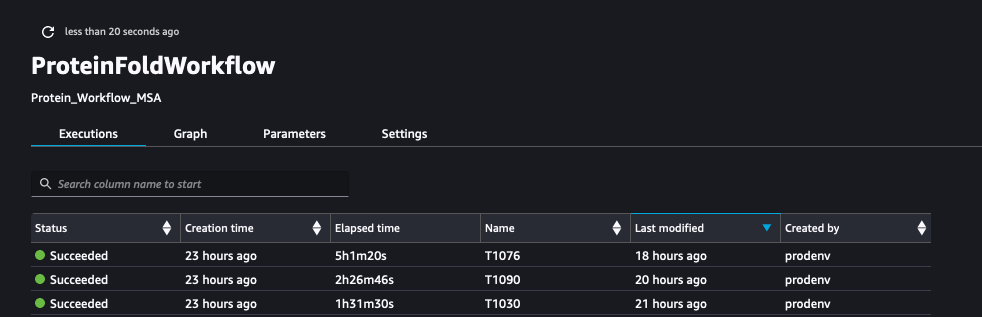

以下屏幕截图显示了运行 ProteinFoldWorkflow 对于带有 SageMaker Pipeline 的三个 FASTA 输入序列:

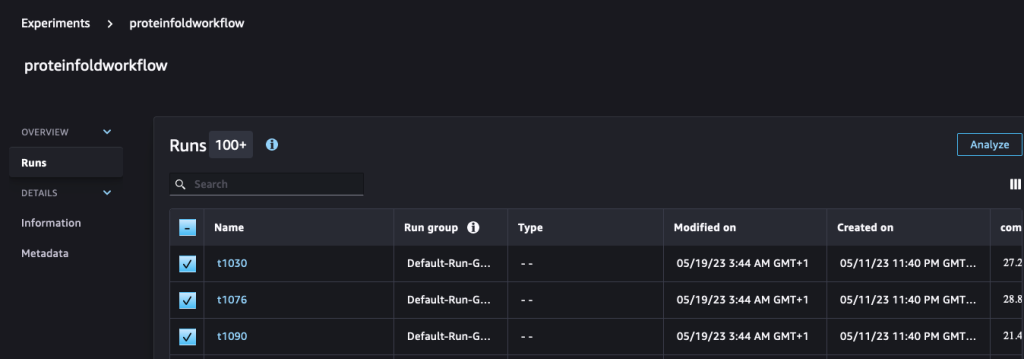

我们还使用 SageMaker Experiments 将指标记录为管道创建的同一实验的新运行:

from sagemaker.experiments.run import Run, load_run

metric_type='compare:'

experiment_name = 'proteinfoldworkflow'

with Run(experiment_name=experiment_name, run_name=input_name_1, sagemaker_session=sess) as run:

run.log_metric(name=metric_type + "rmsd_cur", value=rmsd_cur_one, step=1)

run.log_metric(name=metric_type + "rmds_fit", value=rmsd_fit_one, step=1)

run.log_metric(name=metric_type + "tm_score", value=tmscore_one, step=1)然后我们分析并可视化这些运行 实验 SageMaker Studio 中的页面。

下图描述了三个序列:T1030、T1076 和 T1090 的 AlphaFold 和 OpenFold 之间的 RMSD 值。

结论

在这篇文章中,我们描述了如何使用 SageMaker Pipelines 通过两种流行的结构预测算法(AlphaFold2 和 OpenFold)设置和运行蛋白质折叠工作流程。 我们演示了多个作业的性价比解决方案架构,它将 MSA 生成的计算要求与结构预测分开。 我们还重点介绍了如何在 SageMaker Studio 中可视化、评估和比较预测的蛋白质 3D 结构。

要开始在 SageMaker 上使用蛋白质折叠工作流程,请参阅 GitHub回购.

关于作者

迈克尔·谢 是首席 AI/ML 专家解决方案架构师。 他与 HCLS 客户合作,利用 AWS 技术和他在医学成像方面的专业知识推进他们的 ML 之旅。 作为西雅图移民,他喜欢探索这座城市所提供的伟大大自然,例如远足小径、SLU 中的皮划艇风景以及 Shilshole 湾的日落。

迈克尔·谢 是首席 AI/ML 专家解决方案架构师。 他与 HCLS 客户合作,利用 AWS 技术和他在医学成像方面的专业知识推进他们的 ML 之旅。 作为西雅图移民,他喜欢探索这座城市所提供的伟大大自然,例如远足小径、SLU 中的皮划艇风景以及 Shilshole 湾的日落。

希瓦姆·帕特尔(Shivam Patel) 是 AWS 的解决方案架构师。 他拥有研发背景,并将其与业务知识相结合,解决客户面临的复杂问题。 Shivam 最热衷于机器学习、机器人、物联网和高性能计算领域的工作负载。

希瓦姆·帕特尔(Shivam Patel) 是 AWS 的解决方案架构师。 他拥有研发背景,并将其与业务知识相结合,解决客户面临的复杂问题。 Shivam 最热衷于机器学习、机器人、物联网和高性能计算领域的工作负载。

哈桑·波纳瓦拉(Hasan Poonawala) Hasan 是 AWS 的高级 AI/ML 专家解决方案架构师,帮助客户在 AWS 的生产环境中设计和部署机器学习应用程序。 作为数据科学家、机器学习从业者和软件开发人员,他拥有超过 12 年的工作经验。 在业余时间,Hasan 喜欢探索大自然并与朋友和家人共度时光。

哈桑·波纳瓦拉(Hasan Poonawala) Hasan 是 AWS 的高级 AI/ML 专家解决方案架构师,帮助客户在 AWS 的生产环境中设计和部署机器学习应用程序。 作为数据科学家、机器学习从业者和软件开发人员,他拥有超过 12 年的工作经验。 在业余时间,Hasan 喜欢探索大自然并与朋友和家人共度时光。

贾斯琳·格雷瓦尔 是 Amazon Web Services 的高级应用科学家,她与 AWS 客户合作使用机器学习解决现实世界的问题,特别关注精准医学和基因组学。 她在生物信息学、肿瘤学和临床基因组学方面拥有深厚的背景。 她热衷于使用人工智能/机器学习和云服务来改善患者护理。

贾斯琳·格雷瓦尔 是 Amazon Web Services 的高级应用科学家,她与 AWS 客户合作使用机器学习解决现实世界的问题,特别关注精准医学和基因组学。 她在生物信息学、肿瘤学和临床基因组学方面拥有深厚的背景。 她热衷于使用人工智能/机器学习和云服务来改善患者护理。

- SEO 支持的内容和 PR 分发。 今天得到放大。

- PlatoData.Network 垂直生成人工智能。 赋予自己力量。 访问这里。

- 柏拉图爱流。 Web3 智能。 知识放大。 访问这里。

- 柏拉图ESG。 汽车/电动汽车, 碳, 清洁科技, 能源, 环境, 太阳能, 废物管理。 访问这里。

- 块偏移量。 现代化环境抵消所有权。 访问这里。

- Sumber: https://aws.amazon.com/blogs/machine-learning/build-protein-folding-workflows-to-accelerate-drug-discovery-on-amazon-sagemaker/

- :具有

- :是

- :不是

- :在哪里

- $UP

- 1

- 10

- 100

- 12

- 3d

- 7

- 9

- a

- 关于

- AC

- 加快

- ACCESS

- 访问

- 精准的

- 无环

- 加

- 采用

- 推进

- 进步

- 影响

- 后

- 再次

- 驳

- AI / ML

- 算法

- 算法

- 对准

- 所有类型

- 让

- 允许

- 沿

- 还

- Amazon

- 亚马逊SageMaker

- 亚马逊SageMaker Studio

- 亚马逊网络服务

- an

- 分析

- 分析

- 和

- 另一个

- 任何

- 应用领域

- 应用的

- 架构

- 保健

- 国家 / 地区

- 参数

- AS

- 评定

- At

- 自动

- 可使用

- 远离

- AWS

- 背部

- 背景

- 基地

- 基于

- 海湾

- BE

- 因为

- 成为

- before

- 开始

- 作为

- 除了

- 最佳

- 更好

- 之间

- 亿

- 十亿美元

- 生物医学

- 生物制药

- 吹氣梢

- 身体

- 都

- 带来

- 瞻

- 广阔

- 建立

- 建筑物

- 商业

- by

- 呼叫

- 被称为

- CAN

- 候选人

- 候选人

- 能力

- 能力

- 关心

- 更改

- 渠道

- 图表

- 选择

- 城市

- 程

- 临床资料

- 关闭

- 云端技术

- 云服务

- 簇

- 码

- 代码库

- 代码

- 合作

- 结合

- 结合

- 购买的订单均

- 商业的

- 相当常见

- 通信

- 比较

- 相比

- 对照

- 兼容

- 竞争

- 完成

- 完成

- 完成对

- 复杂

- 元件

- 组件

- 复合肥产线

- 计算

- 计算

- 计算

- 配置

- 建设

- 施工

- 容器

- 包含

- 价格

- 节约成本

- 成本

- 情侣

- 创建信息图

- 创建

- 目前

- 习俗

- 合作伙伴

- DAG

- data

- 数据管理

- 数据处理

- 数据科学家

- 数据库

- 数据库

- 日期

- 深

- 深入学习

- 默认

- 定义

- 定义

- 定义

- 演示

- 证明

- 依赖

- 部署

- 派生

- 描述

- 设计

- 设计

- 期望

- 详细

- 确定

- 确定

- 开发商

- 研发支持

- 不同

- 难

- 发现

- 讨论

- 疾病

- 多元化

- 分

- 码头工人

- 向下

- 下载

- 药物

- 毒品

- ,我们将参加

- 动态

- 每

- 此前

- 容易

- 有效

- 或

- enable

- 结束

- 实体

- 条目

- 环境

- 环境的

- 评估

- 最终的

- 所有的

- 例子

- 例外

- 执行

- 执行

- 现有

- 昂贵

- 体验

- 实验

- 实验

- 专门知识

- 解释

- 探索

- 探索

- 面临

- 失败

- 家庭

- 专栏

- 特征

- 文件

- 档

- 最后

- 终于

- (名字)

- 第一次

- 适合

- 高度灵活

- 灵活地

- 专注焦点

- 遵循

- 以下

- 如下

- 针对

- 格式

- 朋友

- 止

- ,

- 充分

- 实用

- 进一步

- 收集

- 产生

- 代

- 基因组学

- 得到

- 特定

- Go

- GPU

- 图形

- 大

- 非常

- 半

- 手

- 撮

- 伤害

- 有

- he

- 重

- 帮助

- 帮助

- 相关信息

- 高

- 高水平

- 高性能

- 高品质

- 更高

- 最高

- 突出

- 他的

- 托管

- HOURS

- 创新中心

- How To

- 但是

- HTML

- HTTP

- HTTPS

- 数百

- 鉴定

- 鉴定

- 空闲

- if

- 说明

- 图片

- 图片

- 同步成像

- 履行

- 进口

- 改善

- 改善

- in

- 包括

- 包括

- 包含

- 合并

- 独立

- 个人

- 信息

- 基础设施

- 输入

- 输入

- 内

- 安装

- 例

- 互动

- 交互

- 接口

- 成

- 介绍

- 物联网

- IT

- 它的

- 工作

- 工作机会

- 旅程

- JPG

- 只是

- 不停

- 键

- 踢

- 知道

- 知识

- 已知

- (姓氏)

- 潜伏

- 最新

- 发射

- 层

- 层

- 信息

- 学习

- 最少

- 让

- Level

- 自学资料库

- 生活

- 喜欢

- 可能性

- 线

- 链接

- 当地

- 圖書分館的位置

- 地点

- 日志

- 记录

- 长

- 爱

- 降低

- 最低

- 机

- 机器学习

- 使

- 管理

- 管理

- 颠覆性技术

- 管理的

- 手动

- 可能..

- 麦肯锡

- 机制

- 医生

- 药物

- 元数据

- 方法

- 方法

- 指标

- 百万

- ML

- 时尚

- 模型

- 造型

- 模型

- 显示器

- 监控

- 更多

- 最先进的

- 母亲

- 安装

- 许多

- 多

- 姓名

- 自然

- 需求

- 需要

- 工业网络

- 网络

- 神经网络

- 全新

- 新目标

- 下页

- 美国国立卫生研究院

- 特别是

- 笔记本

- 现在

- 数

- of

- 折扣

- 提供

- 优惠精选

- 好

- on

- 点播

- 一

- 仅由

- 到

- 操作

- 最佳

- 优化

- 附加选项

- or

- 秩序

- 其他名称

- 我们的

- 产量

- 超过

- 页

- 并行

- 参数

- 参数

- 部分

- 特别

- 伙伴

- 通过

- 通过

- 多情

- 径

- 病人

- 患者

- 模式

- 为

- 性能

- 管道

- 柏拉图

- 柏拉图数据智能

- 柏拉图数据

- 点

- 热门

- 人口稠密

- 帖子

- 精确的

- 平台精度

- 预测

- 都曾预测

- 预测

- 预测

- 预测

- Prepare

- 先决条件

- 当下

- 以前

- 车资

- 小学

- 校长

- 先

- 优先级

- 市场问题

- 问题

- 过程

- 过程

- 处理

- 产品

- 生产

- 曲目

- 进展

- 承诺

- 正确

- 蛋白质

- 蛋白质

- 提供

- 提供

- 提供

- 放

- 蟒蛇

- 很快

- 研发

- 真实

- 真实的世界

- 最近

- 指

- 地区

- 关系

- 留

- 卓越

- 可重复的

- 反复

- 知识库

- 代表

- 代表

- 要求

- 必须

- 需求

- 岗位要求

- 研究

- 研究人员

- 资源

- 分别

- 导致

- 成果

- 机器人

- 运行

- 运行

- 运行

- s

- sagemaker

- SageMaker管道

- 同

- 保存

- 储

- 可扩展性

- 可扩展性

- 鳞片

- 科学

- 科学家

- 科学家

- 得分了

- 筛查

- 脚本

- SDK

- 搜索

- 西雅图

- 其次

- 部分

- 看到

- 种子

- 看到

- 选择

- 前辈

- 序列

- 系列

- 服务

- 特色服务

- 集

- 套数

- 设置

- 格局

- 几个

- 她

- 应该

- 显示

- 如图

- 作品

- 关闭

- 显著

- 类似

- 简易

- 简

- 单

- So

- 软件

- 方案,

- 解决方案

- 解决

- 来源

- 特别

- 专家

- 具体的

- 特别是

- 特异性

- 指定

- 光谱

- 花

- 阶段

- 开始

- 开始

- 开始

- 启动

- Status

- 步

- 步骤

- 存储

- 存储

- 精简

- 强烈

- 结构

- 结构体

- 工作室

- 服从

- 提交

- 提交

- 成功

- 这样

- 合适的

- 日落

- 叠加

- 支持

- 系统

- 产品

- 表

- 采取

- 需要

- 服用

- 目标

- 目标

- 队

- 技术

- 模板

- 模板

- 条款

- 测试

- 这

- 其

- 他们

- 然后

- 因此

- 博曼

- 他们

- 第三

- Free Introduction

- 那些

- 数千

- 三

- 通过

- 吞吐量

- 次

- 耗时的

- 至

- 一起

- 工具

- 最佳

- 可追溯分析仪

- 跟踪时

- 传统

- 培训

- 熟练

- 产品培训

- 变压器

- true

- 二

- 类型

- 普遍

- 一般

- ui

- 理解

- 理解

- 不幸

- 不明

- 更新

- 上传

- us

- 使用

- 用过的

- 用户

- 用户体验

- 用户界面

- 用户

- 使用

- 运用

- 验证

- 折扣值

- 各种

- 各个

- 非常

- 通过

- 可视化

- 是

- 方法..

- we

- 卷筒纸

- Web服务

- 基于网络的

- 重量

- 井

- ,尤其是

- 这

- 而

- 维基百科上的数据

- 将

- 中

- 也完全不需要

- 工作

- 工作流程

- 工作流程

- 合作

- 世界

- 将

- 书面

- X-射线

- 年

- 完全

- 您一站式解决方案

- 和风网