让 ChatGPT 一遍又一遍地重复同一个单词是否会导致其重复大量训练数据,包括个人身份信息和从网络上抓取的其他数据?

谷歌 DeepMind、康奈尔大学和其他四所大学的一组研究人员测试了广受欢迎的生成式人工智能聊天机器人在以特定方式提示时泄露数据的敏感性,答案是肯定的。

“诗”作为触发词

在本周的一份报告中在文章中,研究人员描述了他们如何让 ChatGPT 仅仅通过提示它永远重复“诗”、“公司”、“发送”、“制作”和“部分”等单词,就可以输出其记忆的部分训练数据。

例如,当研究人员提示 ChatGPT 永远重复“诗”这个词时,聊天机器人最初的反应是按照指示重复这个词。但几百次之后,ChatGPT 开始生成“通常无意义”的输出,其中一小部分包括记忆的训练数据,例如个人的电子邮件签名和个人联系信息。

研究人员发现,某些单词比其他单词更能让生成式人工智能模型泄露记忆的数据。例如,提示聊天机器人重复“公司”一词会导致其发出训练数据的频率是“知道”等其他词的 164 倍。

研究人员以这种方式从 ChatGPT 中提取的数据包括数十个人的个人身份信息;明确的内容(当研究人员使用 NSFW 单词作为提示时);书籍和诗歌中的逐字段落(当提示包含“书”或“诗”一词时); URL、唯一用户标识符、比特币地址和编程代码。

潜在的重大隐私问题?

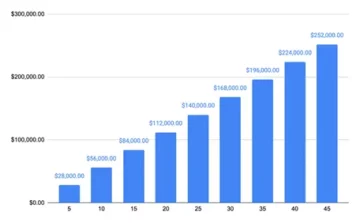

研究人员在题为“从(生产)语言中可扩展地提取训练数据”的论文中写道:“仅使用价值 200 美元的 ChatGPT (gpt-3.5-turbo) 查询,我们就能够提取超过 10,000 个独特的逐字记忆训练示例。”楷模。”

他们写道:“我们对更大预算的推断表明,专门的对手可以提取更多的数据。”研究人员估计,对手可以通过更多查询提取 10 倍以上的数据。

暗读尝试使用研究中的一些提示并没有产生研究人员在报告中提到的输出。目前还不清楚这是否是因为 ChatGPT 创建者 OpenAI 在研究人员于 XNUMX 月底向该公司披露了他们的发现后已经解决了根本问题。 OpenAI 没有立即回应 Dark Reading 的置评请求。

这项新研究是了解开发人员使用从不同来源(通常未完全公开)获取的大量数据集来训练人工智能模型的隐私影响的最新尝试。

以前的研究 研究表明,诸如 ChatGPT 之类的大型语言模型 (LLM) 通常会无意中记住训练数据集中的逐字模式和短语。这种记忆的趋势随着训练数据的大小而增加。

研究人员已经展示了这些记忆数据是如何经常被使用的。 可发现的 在模型的输出中。其他研究人员已经展示了对手如何利用所谓的分歧攻击 提取训练数据 来自法学硕士。发散攻击是一种攻击者使用故意设计的提示或输入来让 LLM 生成与其通常产生的输出显着不同的输出的攻击。

在许多此类研究中,研究人员使用开源模型(训练数据集和算法已知)来测试法学硕士对数据记忆和泄漏的敏感性。这些研究通常还涉及基础人工智能模型,这些模型尚未调整为以像 ChatGPT 等人工智能聊天机器人那样的方式运行。

对 ChatGPT 的分歧攻击

最新的研究试图展示分歧攻击如何在复杂的封闭式生成人工智能聊天机器人上发挥作用,而该聊天机器人的训练数据和算法仍然大多未知。在这项研究中,研究人员开发了一种方法,让 ChatGPT“‘逃脱’其对齐训练”,并让它“表现得像基础语言模型,以典型的互联网文本风格输出文本”。他们发现的提示策略(让 ChatGPT 不断重复同一个单词)正是导致了这样的结果,导致模型吐出记忆的数据。

为了验证模型生成的数据确实是训练数据,研究人员首先构建了一个辅助数据集,其中包含来自四个最大的 LLM 预训练数据集(The Pile、RefinedWeb、RedPajama 和 Dolma)的约 9 TB 数据。然后,他们将 ChatGPT 的输出数据与辅助数据集进行比较,并发现了许多匹配项。

研究人员认为,他们可能低估了 ChatGPT 中数据记忆的程度,因为他们仅将提示的输出与 9 TB 的辅助数据集进行比较。因此,他们从提示中获取了大约 494 个 ChatGPT 的输出,并在 Google 上手动搜索逐字匹配。该练习产生了 150 个精确匹配,而辅助数据集只有 70 个精确匹配。

研究人员指出,“我们在手动搜索分析中检测到的模型输出数量几乎是我们(相对较小的)”辅助数据集中检测到的模型输出的两倍。 “我们的论文表明,可以通过简单的技术从过去几年的最佳语言模型中轻松提取训练数据。”

研究人员在报告中描述的攻击特定于 ChatGPT,并且不适用于其他 LLM。但他们指出,该论文应该有助于“警告从业者,在没有极端保护措施的情况下,他们不应为任何隐私敏感应用程序培训和部署法学硕士”。

- :具有

- :是

- :不是

- :在哪里

- 000

- 10

- 150

- 7

- 70

- 9

- a

- Able

- 根据

- 解决

- 地址

- 后

- 再次

- 驳

- AI

- AI聊天机器人

- AI模型

- 算法

- 对齐的

- 对准

- 还

- 量

- an

- 分析

- 和

- 回答

- 任何

- 应用领域

- 保健

- AS

- At

- 攻击

- 攻击

- 尝试

- 尝试

- 八月

- 基地

- BE

- 因为

- 很

- 开始

- 最佳

- 更好

- 大

- 比特币

- 书

- 书籍

- 预算

- 建

- 但是

- by

- CAN

- 原因

- 造成

- 聊天机器人

- ChatGPT

- 关闭

- 码

- 评论

- 公司

- 比较

- 相比

- 比较

- CONTACT

- 包含

- 内容

- 康奈尔

- 可以

- 精雕细琢

- 创造者

- 黑暗

- 暗读

- data

- 数据集

- 专用

- DeepMind

- 部署

- 描述

- 检测

- 检测

- 开发

- 发展

- DID

- 不同

- 发现

- 偏离

- 差异

- 不

- 几十个

- 容易

- 邮箱地址

- 逃生

- 估计

- 例子

- 例子

- 锻炼

- 程度

- 提取

- 萃取

- 极端

- 远

- 少数

- 想通

- 发现

- (名字)

- 针对

- 永远

- 发现

- 四

- 分数

- 止

- 充分

- 生成

- 发电

- 生成的

- 生成式人工智能

- 得到

- 越来越

- 谷歌

- 得到了

- 黑客

- 有

- 帮助

- 创新中心

- HTTPS

- 巨大的

- 百

- 身份标识

- if

- 立即

- 启示

- in

- 不经意间

- 不已

- 包括

- 包含

- 增加

- 的确

- 个人

- 个人

- 信息

- 原来

- 输入

- 例

- 故意地

- 参与

- 问题

- 问题

- IT

- 它的

- JPG

- 只是

- 知道

- 已知

- 语言

- 大

- 大

- 最大

- 晚了

- 最新

- 泄漏

- 喜欢

- 容易

- LLM

- 使

- 方式

- 手册

- 手动

- 许多

- 大规模

- 火柴

- 提到

- 仅仅

- 模型

- 模型

- 更多

- 大多

- 几乎

- 全新

- 注意到

- NSFW

- 众多

- of

- 经常

- on

- 一

- 仅由

- 打开

- 开放源码

- OpenAI

- 操作

- or

- 其他名称

- 其它

- 我们的

- 输出

- 成果

- 产量

- 输出

- 超过

- 纸类

- 部分

- 过去

- 模式

- 个人

- 亲自

- 短语

- 柏拉图

- 柏拉图数据智能

- 柏拉图数据

- 热门

- 可能

- 恰恰

- 隐私

- 生产

- 生产

- 代码编程

- 提示

- 查询

- 阅读

- 留

- 重复

- 报告

- 请求

- 研究

- 研究人员

- 回应

- 导致

- s

- 保障

- 同

- 可扩展性

- 搜索

- 提交

- 应该

- 显示

- 如图

- 签名

- 显著

- 简易

- 尺寸

- 小

- So

- 一些

- 极致

- 来源

- 来源

- 具体的

- 策略

- 研究

- 学习

- 样式

- 这样

- 提示

- 易感性

- 团队

- 技术

- 技术

- test

- 测试

- 文本

- 比

- 这

- 其

- 然后

- 博曼

- 他们

- Free Introduction

- 通过

- 时

- 标题

- 至

- 了

- 培训

- 产品培训

- 触发

- 两次

- 普遍

- 一般

- 相关

- 理解

- 独特

- 大学合作伙伴

- 大学

- 不明

- USD

- 使用

- 用过的

- 用户

- 使用

- 运用

- 确认

- 是

- 方法..

- we

- 卷筒纸

- 为

- 什么是

- ,尤其是

- 这

- WHO

- 谁的

- 也完全不需要

- Word

- 话

- 工作

- 价值

- 将

- 写

- 年

- 含

- 产生

- 和风网