大型语言模型(或 LLM)已成为日常对话的话题。 它们的快速采用从达到 100 亿用户所需的时间可见一斑,该时间已从“Facebook 的 4.5 年”缩短到“ChatGPT 的 2 个月”的历史最低水平。 生成式预训练 Transformer (GPT) 使用因果自回归更新来进行预测。 这些模型架构证明了语音识别、文本生成和问答等各种任务具有惊人的性能。 最近的几个型号,例如 NeoX, 鹘, 骆驼 使用GPT架构作为骨干。 培训法学硕士需要大量的计算时间,这需要花费数百万美元。 在这篇文章中,我们将总结 GPT 的训练过程 NeoX on AWS 培训,一款专为深度学习训练而优化的机器学习 (ML) 加速器。 我们将概述如何使用 AWS Trainium 经济高效地(3.2 万个代币/美元)训练此类模型,而不损失任何模型质量。

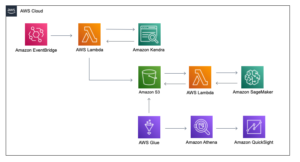

解决方案概述

GPT NeoX 和 Pythia 模型

GPT NeoX 和 皮提亚 是 Eleuther-AI 的开源因果语言模型,NeoX 中有大约 20 亿个参数,Pythia 中有 6.9 亿个参数。 两者都是遵循与 Chat GPT3 类似的架构设计的解码器模型。 然而,它们还添加了一些附加功能,这些附加功能也广泛应用于 Llama 等最新型号中。 特别是,它们具有旋转位置嵌入 (ROPE),可在头部尺寸上部分旋转。 原始模型(NeoX 和 Pythia 6.9B)是在公开可用的模型上进行训练的 桩数据集 具有重复数据删除功能并使用 Megatron 和 Deepspeed 后端。

我们使用以下方法在基于 AWS Trainium 的 Trn1 实例上演示了这些模型的预训练和微调 神经元尼莫 图书馆。 为了建立概念验证和快速复制,我们将使用一个较小的维基百科数据集子集,并使用 GPT2 字节对编码 (BPE) 标记器进行标记。

演练

下载预标记化的维基百科数据集,如下所示:

NeoX 20B 和 Pythia 6.9B 都使用带有部分旋转的 ROPE,例如,旋转头部尺寸的 25% 并保持其余部分不旋转。 为了在 AWS Trainium 加速器上高效实现部分旋转,我们不是串联旋转维度和非旋转维度,而是为非旋转维度附加零频率,然后旋转完整的头部维度集。 这个简单的技巧帮助我们提高了 AWS Trainium 上的吞吐量(每秒处理的序列)。

训练步骤

为了运行训练,我们使用 SLURM 托管的多节点 Amazon Elastic Compute Cloud (Amazon EC2) Trn1 集群,每个节点包含一个 trn1.32xl 实例。 每个 trn1.32xl 有 16 个加速器,每个加速器有 XNUMX 名工作人员。 下载最新的后 神经元尼莫 包,使用提供的 新氧 和 PYTHIA 使用优化的超参数预训练和微调脚本,并执行以下四节点训练。

- 编译:通过三个训练迭代预编译模型以生成并保存图形:

- 运行:通过加载第一步中的缓存图表来执行训练

- 监控结果

运行 Pythia 6.9B 模型需要遵循相同的步骤,并替换 neox_20B_slurm.sh by pythia_6.9B_slurm.sh.

预训练和微调实验

我们使用 AWS Trainium 演示了 GPT-NeoX 和 Pythia 模型的预训练 神经元尼莫 10k 次迭代的库,并且还展示了这些模型 1k 步的微调。 对于预训练,我们使用 NeMo 内部的 GPT2 BPE 分词器并遵循相同的方法 配置 与原始模型中使用的一样。 在 AWS Trainium 上进行微调需要更改几个参数(例如 词汇大小划分因子),在微调脚本中提供,以适应 Megatron 与 NeMo 的差异以及 GPU 与 AWS Trainium 的变化。 不同节点数的多节点分布式训练吞吐量如表1所示。

| 型号 | 张量平行 | 管道并行 | 实例数 | 成本(美元/小时) | 序列长度 | 全局批量大小 | 吞吐量(序列/秒) | 成本吞吐量比(代币/美元) |

| 皮提亚6.9B | 8 | 1 | 1 | 7.59 | 2048 | 256 | 10.4 | 10,102,387 |

| 8 | 1 | 4 | 30.36 | 2048 | 256 | 35.8 | 8,693,881 | |

| 新X 20B | 8 | 4 | 4 | 30.36 | 2048 | 16384 | 13.60 | 3,302,704 |

| 8 | 4 | 8 | 60.72 | 2048 | 16384 | 26.80 | 3,254,134 | |

| 8 | 4 | 16 | 121.44 | 2048 | 16384 | 54.30 | 3,296,632 | |

| 8 | 4 | 32 | 242.88 | 2048 | 16384 | 107.50 | 3,263,241 | |

| 8 | 4 | 64 | 485.76 | 2048 | 16384 | 212.00 | 3,217,708 |

表1。 比较 GPT NeoX 和 Pythia 模型在节点数量变化的情况下训练最多 500 个步骤的平均吞吐量。 这 trn1.32xl 的定价 基于 3 年预留有效每小时费率。

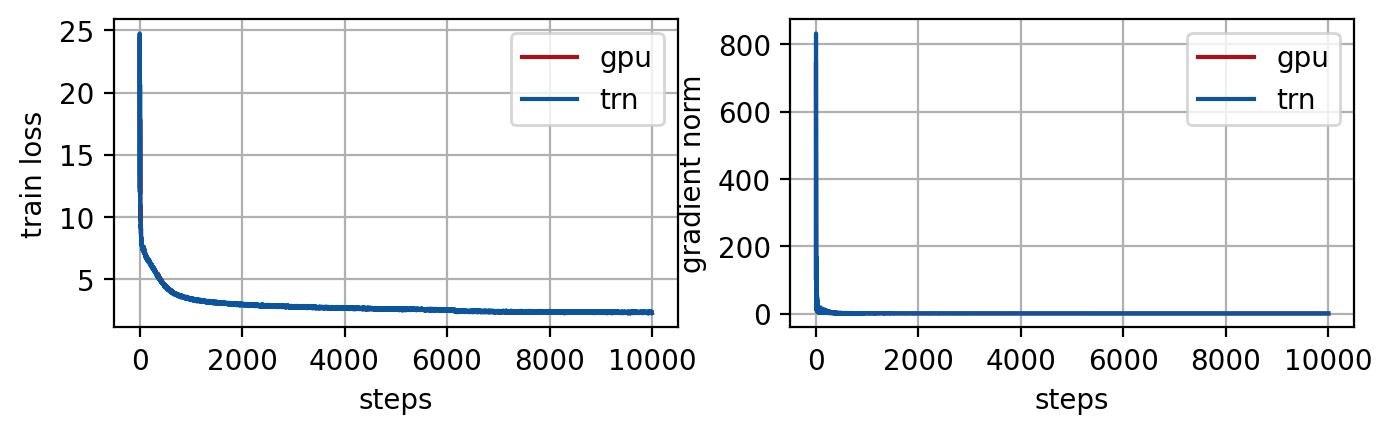

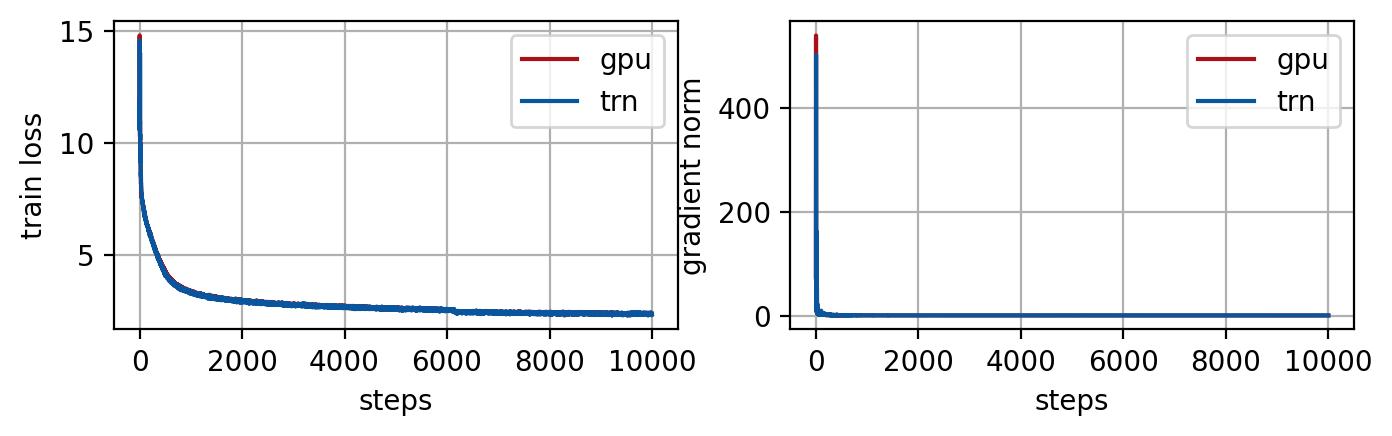

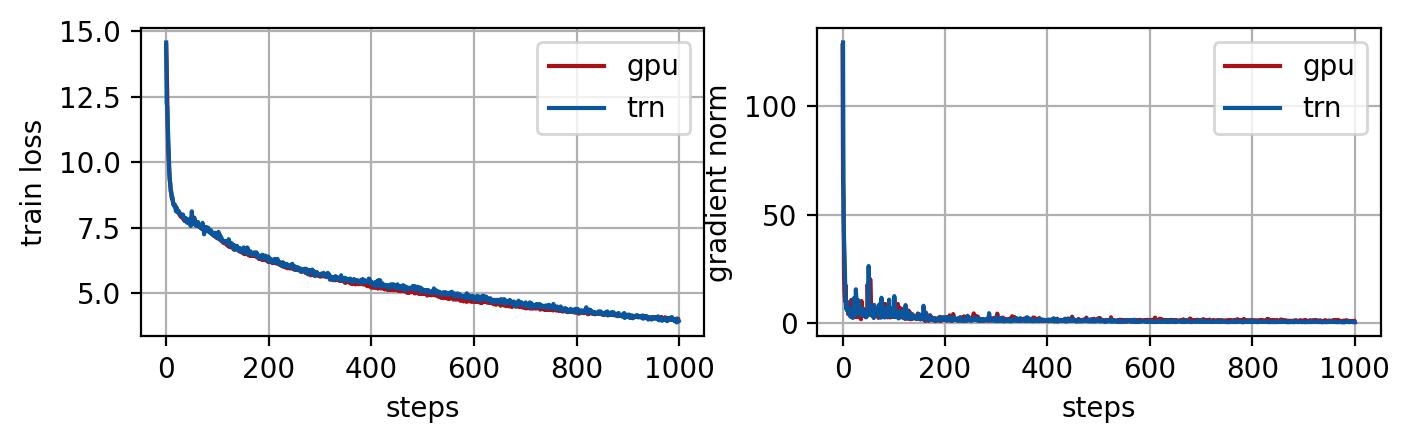

接下来,我们还评估了 AWS Trainium 上模型训练的损失轨迹,并将其与 P4d(Nvidia A100 GPU 核心)集群上的相应运行进行比较。 除了训练损失之外,我们还比较有用的指标,例如梯度范数,它是每次训练迭代时计算的模型梯度的 2-范数,用于监控训练进度。 NeoX 1B 的训练结果如图 2、图 20 所示,微调结果如图 3 所示。

图1。 所有工人的训练损失平均值(左)和训练每一步的梯度范数(右)。 NeoX 20B 在 GPU 和 Trainium 上使用小型 wiki 数据集在 4 个节点上进行训练,具有相同的训练超参数(全局批量大小 = 256)。 GPU 使用 BF16 和默认混合精度,而 AWS Trainium 使用带有随机舍入的完整 BF16。 GPU 和 AWS Trainium 的损失和梯度范数轨迹匹配。

图2。 所有工人的训练损失平均值(左)和训练每一步的梯度范数(右)。 与图 1 中的 GPT NeoX 类似,Pythia 6.9B 在 GPU 和 Trainium 上具有小型 wiki 数据集的 4 个节点上进行训练,具有相同的训练超参数(全局批量大小 = 256)。 GPU 和 Trainium 的损失和梯度范数轨迹匹配。

图3。 在 GPU 和 AWS Trainium 上微调 GPT NeoX 20B 模型,使用所有工作人员的平均训练损失(左)和梯度范数(右)。 一个小型 wiki 数据集用于微调演示。 GPU 和 AWS Trainium 的损失和梯度范数轨迹匹配。

在这篇文章中,我们展示了在 AWS 深度学习硬件上对法学硕士进行经济高效的培训。 我们使用 Neuron NeMo 库在 AWS Trn20 上训练了 GPT NeoX 6.9B 和 Pythia 1B 模型。 使用 AWS Trainium 的 20 亿个模型的标准化吞吐量成本约为 3.2 万个代币/花费的美元。 除了在 AWS Trainium 上进行经济高效的训练之外,我们还获得了类似的模型准确性,这从训练步骤损失和梯度范数轨迹中可以明显看出。 我们还微调了 AWS Trainium 上 NeoX 20B 模型的可用检查点。 有关 AWS Trainium 上的 NeMo Megatron 分布式训练的更多信息,请参阅 NeMo Megatron 的 AWS Neuron 参考。 可以在这里找到开始微调 Llama 模型的好资源, Llama2 微调。 开始使用托管 AWS Trainium 亚马逊SageMaker,请参阅 使用 AWS Trainium 和 Amazon SageMaker 训练您的 ML 模型.

作者简介

高拉夫·古普塔(Gaurav Gupta) 目前是 Amazon Web Services (AWS) AI 实验室的应用科学家。 Gupta 博士在南加州大学维特比分校获得了博士学位。 他的研究兴趣涵盖序列数据建模、学习偏微分方程、机器学习信息论、分数动力学模型和复杂网络等领域。 他目前正在研究法学硕士训练行为、偏微分方程视觉模型、信息论多模态模型的应用和数学问题。 Gupta 博士在 Neurips、ICLR、ICML、Nature、IEEE Control Society、ACM cyber-physical Society 等顶级期刊/会议上发表过论文。

高拉夫·古普塔(Gaurav Gupta) 目前是 Amazon Web Services (AWS) AI 实验室的应用科学家。 Gupta 博士在南加州大学维特比分校获得了博士学位。 他的研究兴趣涵盖序列数据建模、学习偏微分方程、机器学习信息论、分数动力学模型和复杂网络等领域。 他目前正在研究法学硕士训练行为、偏微分方程视觉模型、信息论多模态模型的应用和数学问题。 Gupta 博士在 Neurips、ICLR、ICML、Nature、IEEE Control Society、ACM cyber-physical Society 等顶级期刊/会议上发表过论文。

本·斯奈德 是一位使用 AWS 深度学习的应用科学家。 他的研究兴趣包括基础模型、强化学习和异步优化。 工作之余,他喜欢骑自行车和野外露营。

本·斯奈德 是一位使用 AWS 深度学习的应用科学家。 他的研究兴趣包括基础模型、强化学习和异步优化。 工作之余,他喜欢骑自行车和野外露营。

阿米斯 (R) 马米达拉 是 AWS Annapurna Labs 的高级机器学习应用工程师。 Mamidala 博士在俄亥俄州立大学获得了高性能计算和通信博士学位。 在 IBM 研究部门任职期间,Mamidala 博士为 BlueGene 类计算机做出了贡献,该类计算机经常在最强大、最节能的超级计算机 Top500 排名中名列前茅。 该项目荣获2009年度国家科技创新奖章。 在金融对冲基金担任短暂的人工智能工程师后,Mamidala 博士加入了安纳普尔纳实验室,专注于大语言模型训练。

阿米斯 (R) 马米达拉 是 AWS Annapurna Labs 的高级机器学习应用工程师。 Mamidala 博士在俄亥俄州立大学获得了高性能计算和通信博士学位。 在 IBM 研究部门任职期间,Mamidala 博士为 BlueGene 类计算机做出了贡献,该类计算机经常在最强大、最节能的超级计算机 Top500 排名中名列前茅。 该项目荣获2009年度国家科技创新奖章。 在金融对冲基金担任短暂的人工智能工程师后,Mamidala 博士加入了安纳普尔纳实验室,专注于大语言模型训练。

俊焕 是 AWS AI 实验室的首席科学家。 欢博士致力于人工智能和数据科学。 他在领先的会议和期刊上发表了 180 多篇经过同行评审的论文。 他于 2009 年获得 NSF 教师早期职业发展奖。在加入 AWS 之前,他曾在百度研究部门工作,担任杰出科学家和百度大数据实验室负责人。 他创立了人工智能初创公司StylingAI Inc.,并于2019-2021年担任首席执行官兼首席科学家。 在加入行业之前,他是堪萨斯大学 EECS 系的 Charles E. 和 Mary Jane Spahr 教授。

俊焕 是 AWS AI 实验室的首席科学家。 欢博士致力于人工智能和数据科学。 他在领先的会议和期刊上发表了 180 多篇经过同行评审的论文。 他于 2009 年获得 NSF 教师早期职业发展奖。在加入 AWS 之前,他曾在百度研究部门工作,担任杰出科学家和百度大数据实验室负责人。 他创立了人工智能初创公司StylingAI Inc.,并于2019-2021年担任首席执行官兼首席科学家。 在加入行业之前,他是堪萨斯大学 EECS 系的 Charles E. 和 Mary Jane Spahr 教授。

斯鲁蒂·科帕卡 是 AWS 的高级产品营销经理。 她帮助客户探索、评估和采用 Amazon EC2 加速计算基础设施来满足他们的机器学习需求。

斯鲁蒂·科帕卡 是 AWS 的高级产品营销经理。 她帮助客户探索、评估和采用 Amazon EC2 加速计算基础设施来满足他们的机器学习需求。

- SEO 支持的内容和 PR 分发。 今天得到放大。

- PlatoData.Network 垂直生成人工智能。 赋予自己力量。 访问这里。

- 柏拉图爱流。 Web3 智能。 知识放大。 访问这里。

- 柏拉图ESG。 碳, 清洁科技, 能源, 环境, 太阳能, 废物管理。 访问这里。

- 柏拉图健康。 生物技术和临床试验情报。 访问这里。

- Sumber: https://aws.amazon.com/blogs/machine-learning/frugality-meets-accuracy-cost-efficient-training-of-gpt-neox-and-pythia-models-with-aws-trainium/

- :具有

- :是

- $UP

- 1

- 10

- 100

- 10

- 120

- 16

- 160

- 180

- 20

- 500

- 7

- 9

- a

- 加速

- 加速器

- 加速器

- 容纳

- ACM

- 横过

- 额外

- 附加信息

- 增加

- 采用

- 采用

- 采用

- 后

- AI

- 所有类型

- 历来最低点

- 沿

- 还

- Amazon

- Amazon EC2

- 亚马逊网络服务

- 亚马逊网络服务(AWS)

- 量

- an

- 和

- 任何

- 应用领域

- 应用的

- 约

- 建筑的

- 架构

- 保健

- 围绕

- AS

- At

- 可使用

- 奖

- 世界原声音乐

- AWS

- 骨干

- 后端

- 百度

- 基于

- BE

- 成为

- before

- 行为

- 大

- 大数据运用

- 亿

- BIN

- 都

- by

- 寻找工作

- CD

- CEO

- 更改

- 更改

- 改变

- 查尔斯

- ChatGPT

- 首席

- 程

- 云端技术

- 簇

- 沟通

- 比较

- 比较

- 完成

- 完成

- 复杂

- 计算

- 电脑

- 计算

- 会议

- 贡献

- 控制

- 对话

- 相应

- 价格

- 成本

- 可以

- 目前

- 合作伙伴

- 每天

- data

- 数据科学

- 深

- 深入学习

- 默认

- 演示

- 证明

- 问题类型

- 设计

- 研发支持

- 差异

- 尺寸

- 杰出的

- 分布

- 分布式培训

- 您所属的事业部

- 美元

- 域

- 下载

- dr

- 古普塔博士

- ,我们将参加

- e

- 每

- 早

- 有效

- 有效

- 嵌入

- 编码

- 工程师

- 工程师

- 方程

- 建立

- 评估

- 明显

- 例子

- 执行

- 探索

- 少数

- 金融

- (名字)

- 第一步

- 聚焦

- 遵循

- 其次

- 以下

- 针对

- 发现

- 基础

- 公司成立

- 四

- 部分的

- 止

- ,

- 基金

- 生成

- 代

- 生成的

- 得到

- 全球

- 走了

- 非常好

- GPU

- 渐变

- 图表

- 古普塔

- 硬件

- 有

- he

- 头

- 树篱

- 对冲基金

- 帮助

- 帮助

- 相关信息

- 高

- 他的

- 小时

- 创新中心

- 但是

- HTML

- HTTPS

- 拥抱脸

- IBM

- IDX

- IEEE

- 实施

- 改善

- in

- 公司

- 包括

- 指示符

- 行业中的应用:

- 信息

- 基础设施

- 創新

- 内

- 例

- 代替

- 利益

- IT

- 迭代

- 迭代

- 简

- 加盟

- 加盟

- JPG

- JSON

- 堪萨斯州

- 保持

- 实验室

- 实验室

- 语言

- 大

- 最新

- 领导

- 学习

- 导致

- 左

- 长度

- 自学资料库

- 骆驼

- 装载

- 失去

- 离

- 低

- 机

- 机器学习

- 使

- 管理

- 经理

- 营销

- 匹配

- 数学的

- 意味着

- 会见

- 聚体

- 元

- 百万

- 百万

- ML

- 模型

- 造型

- 模型

- 显示器

- 个月

- 更多

- 最先进的

- National

- 自然

- 需要

- 网络

- 节点

- 节点

- 美国国家科学基金会

- 数

- Nvidia公司

- 获得

- of

- 经常

- 俄亥俄州

- on

- 开放源码

- 公然

- 优化

- 优化

- or

- 原版的

- 轮廓

- 学校以外

- 包

- 文件

- 参数

- 尤其

- 同行评审

- 为

- 性能

- 博士学位

- 柏拉图

- 柏拉图数据智能

- 柏拉图数据

- 帖子

- 强大

- 预测

- 校长

- 问题

- 程序

- 处理

- 产品

- 教授

- 进展

- 项目

- 提供

- 出版物

- 出版

- 质量

- 题

- 快速

- R

- 排行

- 率

- 比

- 达到

- 最近

- 承认

- 参考

- 复制

- 必须

- 需要

- 研究

- 保留的

- 资源

- REST的

- 成果

- 右

- 四舍五入

- 运行

- 运行

- 同

- 保存

- 科学

- 科学家

- 脚本

- 证券交易委员会

- 看到

- 前辈

- 特色服务

- 集

- 几个

- 她

- 显示

- 显示

- 如图

- 类似

- 简易

- 尺寸

- 小

- 小

- 社会

- 跨度

- 言语

- 语音识别

- 花费

- 开始

- 启动

- 开始

- 州/领地

- 步

- 步骤

- 这样

- 总结

- 任务

- 专业技术

- 文本

- 比

- 其

- 然后

- 理论

- 博曼

- 他们

- Free Introduction

- 三

- 吞吐量

- 次

- 至

- 符号化

- 最佳

- 主题

- 向

- 培训

- 熟练

- 产品培训

- 轨道

- 变压器

- 二

- 大学

- 最新动态

- us

- 使用

- 用过的

- 用户

- 使用

- 运用

- 各种

- 变化

- 与

- 愿景

- 是

- we

- 卷筒纸

- Web服务

- 这

- 而

- 广泛

- 维基百科上的数据

- 也完全不需要

- 工作

- 工作

- 工人

- 加工

- 合作

- 您一站式解决方案

- 和风网

- 零