今天,我们很高兴地宣布 芽 型号现已可供客户使用 亚马逊SageMaker JumpStart。杰玛是一个家庭 语言模型 基于 Google 的 Gemini 模型,接受多达 6 万亿个文本标记的训练。 Gemma 系列由两种规模组成:7 亿参数模型和 2 亿参数模型。现在,您可以在其中使用 Gemma 2B 和 Gemma 7B 预训练和指令调整模型 SageMaker 快速启动. JumpStart 是 SageMaker 的机器学习 (ML) 中心,除了内置算法和端到端解决方案模板外,它还提供对基础模型的访问,以帮助您快速开始使用 ML。

在这篇文章中,我们将介绍如何在 SageMaker JumpStart 中部署 Gemma 模型并根据您的用例对其进行微调。完整的笔记本可在 GitHub上.

杰玛模型

芽 是一个轻量级、最先进的系列 模型 采用与创建相同的研究和技术而构建 双子座 楷模。 Gemma 由 Google DeepMind 和 Google 的其他团队开发,其灵感来自 Gemini。 Gemma 在文本领域展现了强大的通才能力以及最先进的大规模理解和推理能力。与跨不同领域(包括问答、常识推理、数学和科学以及编码)的其他类似或更大规模的公开模型相比,它实现了更好的性能。 Gemma 发布了模型权重,以支持开发人员使用 Gemma 模型进行创新。 Gemma 推出了新产品 负责任的生成式人工智能工具包 为使用 Gemma 创建更安全的人工智能应用程序提供指导和基本工具。

SageMaker 中的基础模型

JumpStart 提供对来自流行模型中心的一系列模型的访问,包括 Hugging Face、PyTorch Hub 和 TensorFlow Hub,您可以在 SageMaker 的 ML 开发工作流程中使用它们。 机器学习的最新进展催生了一类新的模型,称为 基础模型,它们通常经过数十亿个参数的训练,适用于广泛的用例类别,例如文本摘要、生成数字艺术和语言翻译。 由于这些模型的训练成本很高,因此客户希望使用现有的预训练基础模型并根据需要对其进行微调,而不是自己训练这些模型。 SageMaker 提供了精选的模型列表,您可以在 SageMaker 控制台上从中进行选择。

现在,您可以在 JumpStart 中找到来自不同模型提供商的基础模型,使您能够快速开始使用基础模型。您可以根据不同的任务或模型提供者找到基础模型,并查看模型特征和使用条款。您还可以使用测试 UI 小部件来尝试这些模型。当您想要大规模使用基础模型时,您可以使用模型提供商提供的预构建笔记本,而无需离开 SageMaker。由于模型是在 AWS 上托管和部署的,因此无论是用于评估模型还是大规模使用模型,您的数据都不会与第三方共享。

让我们探讨如何在 JumpStart 中使用 Llama Guard 模型。

在 Jumpstart 中探索 Gemma 模型

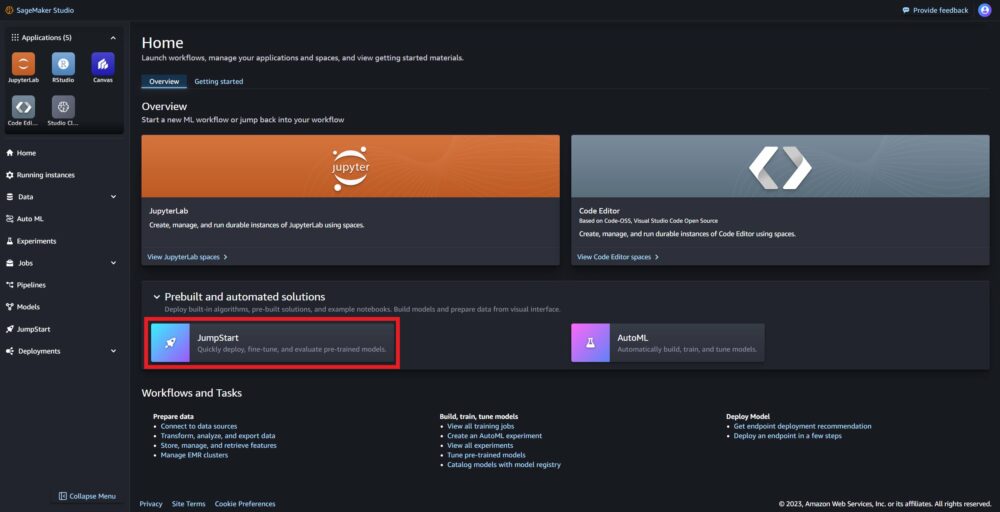

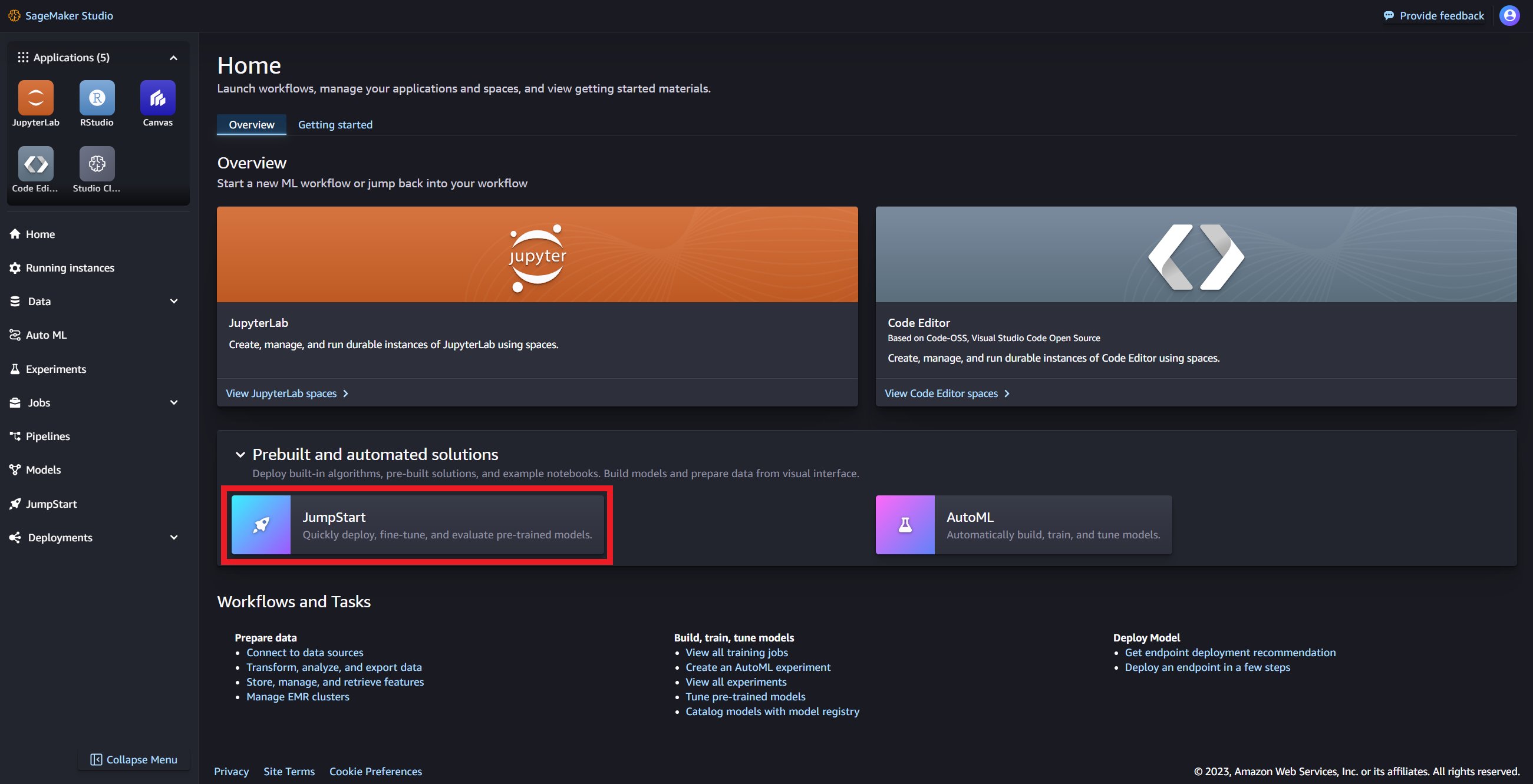

您可以通过 SageMaker Studio UI 和 SageMaker Python SDK 中的 SageMaker JumpStart 访问 Gemma 基础模型。在本节中,我们将介绍如何在 SageMaker Studio 中发现模型。

SageMaker Studio 是一个集成开发环境 (IDE),提供基于 Web 的单一可视化界面,您可以在其中访问专用工具来执行所有 ML 开发步骤,从准备数据到构建、训练和部署 ML 模型。有关如何开始和设置 SageMaker Studio 的更多详细信息,请参阅 亚马逊SageMaker Studio.

在 SageMaker Studio 的 AWS 管理控制台中,转到下面的 SageMaker JumpStart 预构建和自动化解决方案。 Jumpstart 包含预先训练的模型、笔记本和预先构建的解决方案。

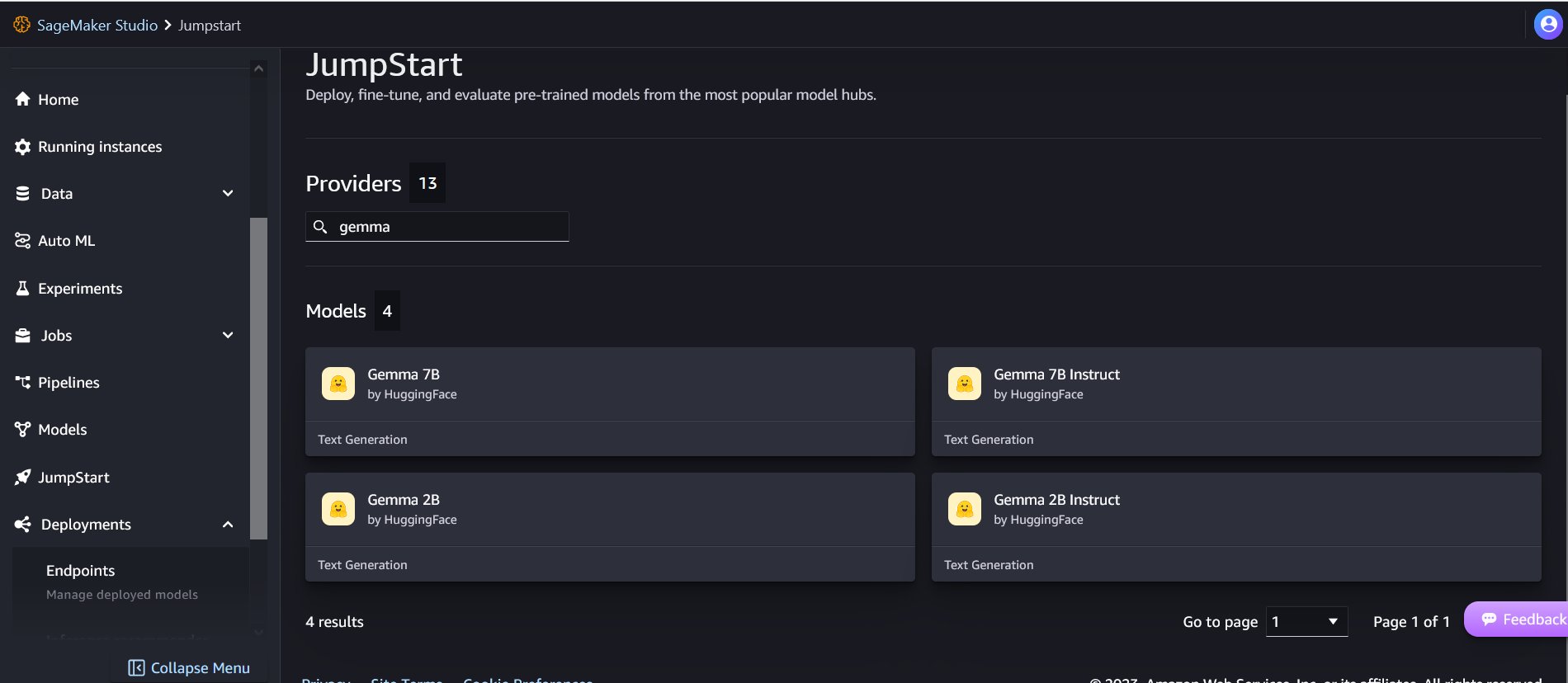

在 SageMaker JumpStart 登录页面上,您可以通过搜索 Gemma 找到 Gemma 模型。

然后,您可以从各种 Gemma 型号变体中进行选择,包括 Gemma 2B、Gemma 7B、Gemma 2B instruct 和 Gemma 7B instruct。

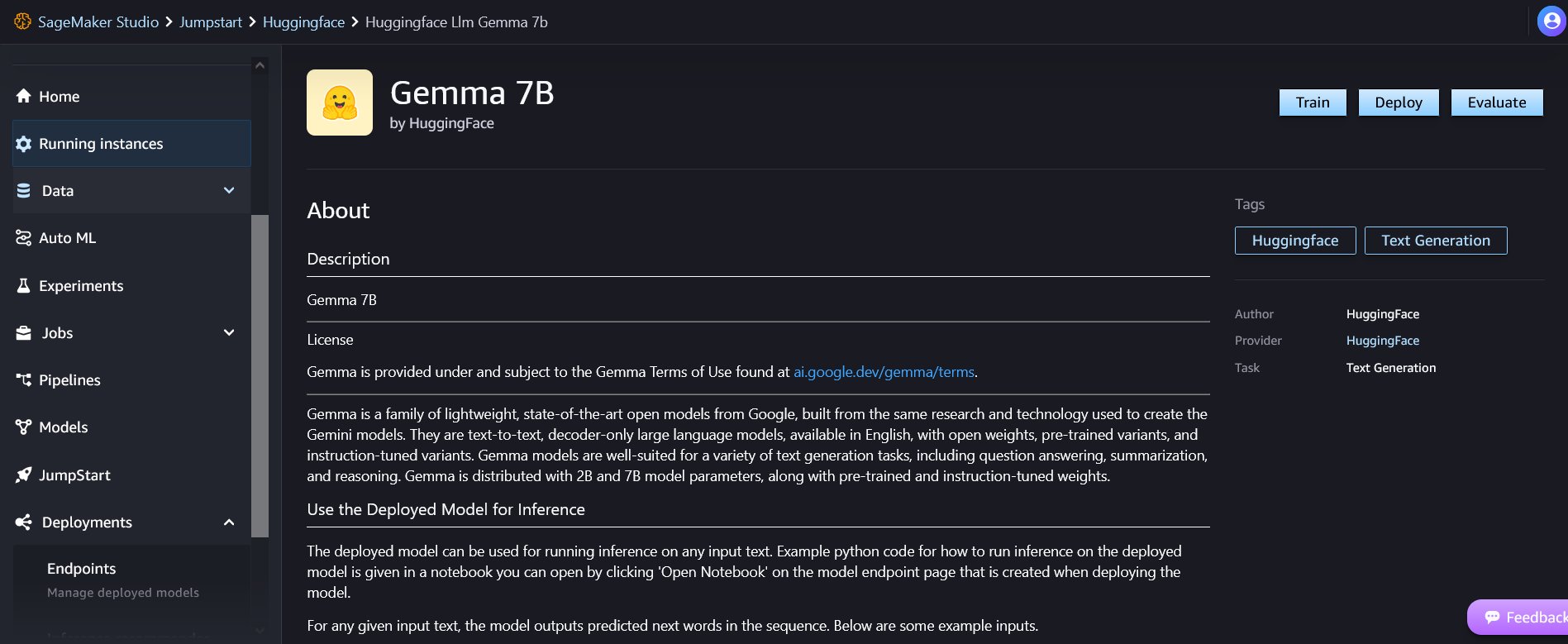

选择模型卡可查看有关模型的详细信息,例如许可证、用于训练的数据以及如何使用模型。您还会发现一个 部署 按钮,它将带您进入登录页面,您可以在其中使用示例有效负载测试推理。

使用 SageMaker Python SDK 部署 Gemma

您可以在 JumpStart 上找到显示 Gemma 部署的代码以及如何使用已部署模型的示例 这个 GitHub 笔记本。

首先选择部署 Gemma 时要使用的 SageMaker Model Hub 模型 ID 和模型版本。

从下表中选择一个型号 ID,该表详细介绍了 JumpStart 部署的默认配置选项。由于 256 个 token 的词汇量很大,Gemma 7B 在支持 10 个上下文长度时只能安装在单个 A1G GPU 上。因此,JumpStart 对 Gemma 7B 使用更大的默认实例。

| 型号ID | 默认推理实例 | 张量平行度 | 支持的上下文长度 |

| 拥抱脸-llm-gemma-2b | 毫升.g5.xlarge | 1 | 8k |

| Huggingface-llm-gemma-2b-指示 | 毫升.g5.xlarge | 1 | 8k |

| 拥抱脸-llm-gemma-7b | ml.g5.12xlarge | 4 | 8k |

| Huggingface-llm-gemma-7b-指示 | ml.g5.12xlarge | 4 | 8k |

您现在可以使用 SageMaker JumpStart 部署模型。以下代码使用默认实例 ml.g5.12xlarge 对于推理端点,您可以通过传递将模型部署在其他实例类型上 instance_type ,在 JumpStartModel 班级。部署可能需要 5-10 分钟。

为了成功部署,您必须手动更改 accept_eula 模型部署方法中的参数 True。该模型使用文本生成推理 (TGI) 深度学习容器进行部署。

调用端点

您可以通过编程方式从以下位置检索示例有效负载 JumpStartModel 目的。这将帮助您通过观察 Gemma 可以摄取的预先格式化的指令提示来开始。

在查看具体提示之前,我们先考虑一下 Gemma Instruct 模型的聊天模板。

在这里,您将提示符放在 [USER_PROMPT] 地点。不支持系统指令;相反,您可以将所需的指令添加到用户提示符之前。此外,如果您进行多轮对话,则模型提示可以根据需要在用户和助理之间交替。

现在考虑一些指令示例提示。在这里,您要求 Gemma 编写一个 Hello World 程序。

以下是预期输出:

接下来,调用 Gemma 来完成写诗的创造性任务。

以下是输出:

这看起来不错!

现在,让我们看看使用默认 JumpStart 部署配置的模型服务的延迟和吞吐量性能基准测试。在这里,我们展示了模型性能对于典型端点工作负载可能有何不同。在下表中,您可以观察到小型查询(256 个输入单词和 256 个输出令牌)在大量并发用户下性能相当好,达到每秒 XNUMX 到 XNUMX 个令牌的令牌吞吐量。然而,当输入单词的数量接近 Gemma 支持的最大上下文长度(八千个令牌)时,由于实例内存限制,端点的批处理能力(允许同时处理的并发请求数量)饱和。

有关如何考虑此信息并针对您的特定用例调整部署配置的更多信息,请参阅 在 Amazon SageMaker JumpStart 中进行基准测试并优化终端节点部署.

| . | 吞吐量(令牌/秒) | ||||||||||

| 并发用户 | 1 | 2 | 4 | 8 | 16 | 32 | 64 | 128 | |||

| 模型 | 实例类型 | 输入单词 | 输出代币 | . | . | . | . | . | . | . | . |

| gemma-2b-指令 | 毫升.g5.xlarge | 256 | 256 | 73 | 137 | 262 | 486 | 829 | 1330 | 1849 | 1834 |

| 2048 | 256 | 69 | 126 | 227 | 373 | 537 | 704 | 764 | - | ||

| 7936 | 256 | 60 | 100 | 147 | 195 | 226 | 230 | - | - | ||

| gemma-7b-指令 | ml.g5.12xlarge | 256 | 256 | 62 | 119 | 227 | 413 | 601 | 811 | 937 | 962 |

| 2048 | 256 | 56 | 100 | 172 | 245 | 267 | 273 | - | - | ||

| 7936 | 256 | 44 | 67 | 77 | 77 | 78 | - | - | - | ||

| . | P50 延迟(毫秒/令牌) | ||||||||||

| 并发用户 | 1 | 2 | 4 | 8 | 16 | 32 | 64 | 128 | |||

| 模型 | 实例类型 | 输入单词 | 输出代币 | . | . | . | . | . | . | . | . |

| gemma-2b-指令 | 毫升.g5.xlarge | 256 | 256 | 13 | 14 | 15 | 16 | 19 | 23 | 33 | 49 |

| 2048 | 256 | 14 | 15 | 17 | 20 | 28 | 43 | 79 | - | ||

| 7936 | 256 | 16 | 19 | 26 | 39 | 68 | 136 | - | - | ||

| Gemma-7b-指令 | ml.g5.12xlarge | 256 | 256 | 16 | 16 | 17 | 19 | 26 | 38 | 57 | 110 |

| 2048 | 256 | 17 | 19 | 23 | 32 | 52 | 119 | - | - | ||

| 7936 | 256 | 22 | 29 | 45 | 105 | 197 | - | - | - | ||

使用 SageMaker Python SDK 微调 Gemma

接下来,我们将向您展示如何使用对话格式数据集微调 Gemma 7B 指令模型 QLoRA 技术。如前所述,由于 256 个词汇量和 8 个上下文长度,JumpStart 为 QLoRA 微调提供以下默认配置。

| 型号ID | 默认训练实例 | 最大输入序列长度 | 每台设备的训练批量大小 | 梯度累积步骤 |

| 拥抱脸-llm-gemma-2b | ml.g5.2xlarge | 1024 | 1 | 4 |

| Huggingface-llm-gemma-2b-指示 | ml.g5.2xlarge | 1024 | 1 | 4 |

| 拥抱脸-llm-gemma-7b | ml.g5.12xlarge | 2048 | 1 | 4 |

| Huggingface-llm-gemma-7b-指示 | ml.g5.12xlarge | 2048 | 1 | 4 |

让我们以会话格式加载和处理数据集。本演示的示例数据集是 OpenAssistant 的 TOP-1 对话主题.

训练数据应以 JSON 行形式表示(.jsonl) 格式,其中每一行都是代表一组对话的字典。 JSON 行文件中的一个示例如下所示。有关如何处理数据集的详细信息,请参阅中的笔记本 GitHub上.

JumpStart 在训练脚本的基础上使用 HuggingFace SFT训练器 QLoRA 和 闪光灯。 Flash Attention 可提高效率,从而加快训练和推理速度。除了基于聊天的微调之外,JumpStart 还支持使用 QLoRA 进行指令和域适应微调。有关详细信息,请参阅笔记本中 GitHub上.

微调后,您可以将微调后的模型部署到 SageMaker 终端节点。

您可以选择部署针对 SageMaker 端点中的对话数据进行微调的模型 HuggingFace 消息 API 功能 作为一种替代方法。使用消息 API 功能的好处是,它允许用户以原始格式传递查询示例,如下表所示,并且端点内的 chat_template 会将查询示例转换为正确的格式,然后再将其发送到模型中。详情请参见微调后的部署部分 笔记本.

在端点中部署微调模型后,您可以比较预训练模型和微调 Gemma 模型的输出响应。这些示例是从测试数据中收集的,测试数据是训练数据的保留集。推理参数为 max_tokens 为 512, top_p 为 0.9, temperature 0.4岁,和 top_k 为50。

正如您在微调结果中看到的那样,代理的答案更加准确。

要进一步评估您的微调模型,您可以探索 使用 Amazon SageMaker Clarify 进行 FM 评估 查看微调后的模型与基本模型相比的表现如何。

| 输入 | 地面真相 | 来自的回应 基地 模型 | 微调模型的响应 | |

| 1 |

用户:我想提高我的词汇量,你能给我一些简单的方法,让我可以找到新单词来增加句子的多样性吗? 助理:当然可以!提高词汇量是一个持续的过程,但这里有一些简单的方法可以找到新单词并增加句子的多样性: 1.广泛阅读:阅读不同类型和主题的书籍、文章和博客可以让你接触到新单词和短语。记下您遇到的任何不熟悉的单词并查找它们的含义。 2. 使用同义词库:每当您写作或阅读时,请使用同义词库查找常用单词的同义词。这不仅可以帮助您学习新单词,还可以增强您对它们的细微含义差异的理解。 3. 每日单词日历或应用程序:订阅每日单词电子邮件或下载词汇构建应用程序。这些工具每天都会向您介绍一个新单词及其含义、发音和用法示例。 4. 加入读书俱乐部或讨论组:参与有关书籍、文章或任何其他主题的对话和讨论可以让您接触到不同的观点和新词汇。专心倾听别人的讲话,并尝试在上下文中使用新单词。 5. 玩文字游戏:拼字游戏、Boggle 和填字游戏等游戏可以挑战您的词汇技能,并帮助您以有趣的方式学习新单词。 6.观看电影、电视节目或纪录片:视觉媒体经常使用不同的语言、俚语和行话。观看带字幕的电影、电视节目或纪录片可以帮助您更好地理解和记住新单词。 7. 练习写作:定期写故事、论文或日记可以鼓励您使用新单词和短语。尝试不同的写作风格和体裁来扩大你的词汇量。 8.学习新单词的词源:了解单词的起源和历史可以使其更容易记住和正确使用。研究词源还可以让您了解相关的单词和概念。 9. 使用抽认卡或间隔复读软件:用新单词、其含义和例句创建抽认卡。定期复习或使用 Anki 等间隔重复软件来优化您的学习。 10.设定个人目标:设定可实现的目标,例如每周学习五个新单词。跟踪您的进展并奖励自己实现目标。 通过不断地将这些策略融入您的日常生活中,您将逐渐建立多样化且强大的词汇量。 用户:嗯,我真的很喜欢读书。你能给我推荐一本我可以读的很酷的科幻惊悚小说吗? |

助理:当然可以!以下是一些您可能会喜欢的科幻惊悚片的推荐: 1.刘慈欣的《三体》——这部获奖小说探讨了人类与外星文明的第一次接触,以及由此产生的政治和个人后果。这是一本扣人心弦、发人深省的读物,深入探讨了有关存在本质和宇宙的深刻问题。 2.杰夫·范德米尔的《湮灭》——这部小说讲述了一群科学家冒险进入一个被称为“X区域”的神秘区域,在那里他们遇到了奇怪和令人不安的现象。随着他们深入研究该地区,他们开始揭开有关现实本质和周围世界的黑暗秘密。 3.布莱克·克劳奇的《暗物质》——这部小说讲述了一位名叫杰森·德森的杰出物理学家被绑架并传送到平行宇宙的故事。当他试图找到回到自己现实的道路时,他必须面对自己的选择和行为的后果。 4. 迈克尔·克莱顿(Michael Crichton)的《仙女座菌株》——这部经典小说讲述了一群科学家试图遏制和研究登陆地球的致命外星微生物的故事。当他们与时间赛跑寻找消灭微生物的方法时,他们还必须应对政治阴谋和个人冲突。 5. 欧内斯特·克莱恩(Ernest Cline)的《头号玩家》(Ready Player One)——这部小说以反乌托邦的未来为背景,大多数人在被称为“绿洲”的虚拟现实世界中度过时光。当绿洲的创造者去世并留下寻找隐藏的复活节彩蛋的挑战时,一位年轻的主角开始了一场激动人心的探索,这将永远改变他的生活。 我希望这些建议之一能引起您的兴趣! |

助理:文字中不包含您的阅读偏好或兴趣的信息,因此我无法提供书籍推荐。 |

助理:当然,这里有一些您可能会喜欢的科幻惊悚片推荐: ——弗兰克·赫伯特的《沙丘》:这部史诗般的科幻小说以阿拉基斯沙漠星球为背景,在那里,一位名叫保罗·阿崔迪的年轻王子必须面对敌对环境和危险政治环境的挑战。 安迪·威尔的《火星救援》:这部扣人心弦的科幻惊悚片讲述了宇航员马克·沃特尼在沙尘暴后被困在火星上的故事,他利用自己的聪明才智和足智多谋生存下来,并最终返回地球。 – HG Wells 的《时间机器》:这部经典科幻小说采用哲学方法探讨时间旅行的概念,探索改变过去和未来的后果。 – 菲利普·K·迪克的《银翼杀手》:这部新黑色科幻小说以未来的洛杉矶为背景,探讨了人类与人工智能的交叉点,及其对社会和现实本质的影响。 ——艾萨克·阿西莫夫的《机器人》:这部科幻小说探讨了人工智能的概念及其潜在后果,特别是当人类开发出挑战传统人类价值观和信仰的先进机器人时。 这些只是一些建议,最终最适合您的书将取决于您的个人喜好以及您在科幻惊悚片中寻找什么样的体验。但我希望这些建议能为您探索该类型提供一个良好的起点。 如果您还有任何其他问题或有什么我可以帮助您的,请告诉我。 |

| 2 |

用户:在 VB.NET 中编写 Hello World 程序 助理: 给你: “`vbnet 用户:让它从 $ 获取输入,然后说“Hello, $”而不是“Hello, World!” |

助手:公共模块HelloWorld 公共子主() System.Console.WriteLine(“你叫什么名字?”) 暗淡名称 As String = System.Console.ReadLine() System.Console.WriteLine(“你好,”&姓名&“!”) END SUB 结束模块 |

助理:“`vbnet 公共模块HelloWorld 公共子主() 暗淡名称 As String = Console.ReadLine() Console.WriteLine(“你好,”&名字) END SUB 结束模块 |

助理:当然可以!这是一个例子: “`vbnet |

| 3 |

用户:在开始一个项目来训练一个能够理解和回答人类问题的大型语言模型时,请给我一份待办事项列表 助理:以下步骤是启动一个项目来训练能够理解和响应人类查询的大型语言模型时要采取的步骤的简要列表: 1. 确定项目范围和目标、目标受众。 这应该让您对所需步骤有一个基本的了解。我应该对其中一点进行更详细的说明吗? 用户:这些任务需要进一步细分,您能否提供一份更新的待办事项列表,其中包含对未来任务的更详细的细分 |

助理:以下是每个步骤的更详细的分解: 1. 建立项目范围和目标:明确定义项目的目标以及目标受众是什么非常重要。这将帮助您决定要收集什么类型的数据以及什么模型架构是合适的。 2. 收集和预处理数据:这是重要的一步,因为数据的质量和多样性将直接影响模型的性能。预处理可能涉及清理数据、标记文本以及将单词转换为数字表示。 3. 选择模型架构:有许多不同类型的模型可供选择,包括循环神经网络(RNN)、Transformer 模型和卷积神经网络(CNN)。选择将取决于项目的具体要求和可用数据量。 4. 划分数据集并实现数据增强:将数据划分为训练、验证和测试子集对于在训练期间监控模型的性能非常重要。数据增强可用于人为地增加数据集的大小并提高模型的鲁棒性。 5. 训练模型并监控进度:此步骤涉及在训练数据上训练模型,使用验证集监控进度并根据需要调整超参数。可能需要多次重复此过程,直到模型在验证集上表现良好。 6. 在测试集上评估模型:模型经过训练后,在单独的测试集上评估其性能以了解其泛化能力非常重要。这可以通过将模型的预测与实际结果进行比较并分析错误来完成。 7.针对特定任务或领域进行微调:此步骤涉及根据特定任务的数据进一步训练模型,以提高其在特定领域的性能。这可以通过迁移学习来完成,其中预训练的模型根据新数据进行微调,或者通过微调来完成,其中模型根据新数据从头开始训练。 8. 创建用户输入界面:这涉及设计一个允许用户输入问题或请求并接收模型响应的界面。 9. 在受控环境中进行测试:在实际环境中部署模型之前,在受控环境中对其进行测试并收集用户的反馈非常重要。这将有助于识别模型中的任何错误或偏差并提供改进的机会。 10.持续监控和改进性能:最后,持续监控模型的性能并根据需要进行更新和改进也很重要。这可能涉及根据新数据重新训练模型、微调超参数或更新架构。 |

助理:## 训练大型问答语言模型的待办事项列表 **1.项目范围和目标:** * 定义项目目标和所需的功能。 **2.数据采集和预处理:** * 确定训练数据的来源并收集不同的文本数据集。 **3.选型及配置:** * 根据任务复杂度和所需性能选择合适的模型架构。 **4.培训与评估:** * 将训练数据分为训练、验证和测试子集。 **5.微调和界面开发:** * 通过迁移学习针对特定任务或领域微调模型。 **6。测试和改进:** * 在具有各种输入场景的受控环境中测试模型。 **其他注意事项:** * 为项目设定时间表和预算。 **注意:** 此列表并不详尽,可能需要根据具体项目要求进行调整。 |

助理:当然,这里是训练大型语言模型以理解和回答人类问题所涉及的任务的更详细的细分: **1.确定项目范围和目标** **2.收集并预处理全面/多样化的文本数据集** **3.选择合适的模型架构,调整超参数以提高准确性/速度** **4.将数据集划分为训练、验证、测试子集,实施数据增强** **5.训练模型,监控验证集的进度,根据需要进行调整** **6。在测试集上评估模型,与基准进行比较,分析错误和偏差** **7.通过迁移学习或微调对特定任务或领域进行微调** **8.为用户输入和模型响应创建接口** **9.在受控环境中进行测试,收集反馈以进行改进** **10.通过再培训和微调持续监控和提高绩效** 这些是训练大型语言模型以理解和回答人类问题所涉及的步骤。如果您有疑问,请告诉我。 |

清理

测试端点后,删除 SageMaker 推理端点和模型以避免产生费用。

结论

在这篇文章中,我们向您展示了如何在 SageMaker Studio 中开始使用 Gemma 并部署模型进行推理。我们还向您展示了如何在 SageMaker Jumpstart 上微调 Gemma 模型。

由于基础模型是预先训练的,因此它们可以帮助降低培训和基础设施成本,并支持针对您的用例进行定制。立即访问 SageMaker Studio 中的 SageMaker JumpStart 以开始使用。

本指南仅供参考。 您仍应执行自己的独立评估,并采取措施确保您遵守自己的特定质量控制实践和标准,以及适用于您、您的内容和和的当地规则、法律、法规、许可和使用条款本指南中引用的第三方模型。 AWS 对本指南中引用的第三方模型没有控制权或权限,也不对第三方模型安全、无病毒、可操作或与您的生产环境和标准兼容做出任何陈述或保证。 AWS 不就本指南中的任何信息将导致特定的结果或结果作出任何陈述、保证或担保。

关于作者

凯尔乌尔里希博士 是一名应用科学家 Amazon SageMaker 内置算法 团队。 他的研究兴趣包括可扩展机器学习算法、计算机视觉、时间序列、贝叶斯非参数和高斯过程。 他在杜克大学获得博士学位,并在 NeurIPS、Cell 和 Neuron 上发表了论文。

凯尔乌尔里希博士 是一名应用科学家 Amazon SageMaker 内置算法 团队。 他的研究兴趣包括可扩展机器学习算法、计算机视觉、时间序列、贝叶斯非参数和高斯过程。 他在杜克大学获得博士学位,并在 NeurIPS、Cell 和 Neuron 上发表了论文。

黄鑫博士 是 Amazon SageMaker JumpStart 和 Amazon SageMaker 内置算法的高级应用科学家。 他专注于开发可扩展的机器学习算法。 他的研究兴趣是自然语言处理、表格数据的可解释深度学习以及非参数时空聚类的稳健分析。 他在 ACL、ICDM、KDD 会议和 Royal Statistical Society: Series A 上发表了多篇论文。

黄鑫博士 是 Amazon SageMaker JumpStart 和 Amazon SageMaker 内置算法的高级应用科学家。 他专注于开发可扩展的机器学习算法。 他的研究兴趣是自然语言处理、表格数据的可解释深度学习以及非参数时空聚类的稳健分析。 他在 ACL、ICDM、KDD 会议和 Royal Statistical Society: Series A 上发表了多篇论文。

拉奇纳查达 是 AWS 战略客户部门的首席 AI/ML 解决方案架构师。 Rachna 是一位乐观主义者,他相信以道德和负责任的方式使用人工智能可以改善未来社会,带来经济和社会繁荣。在业余时间,Rachna 喜欢与家人共度时光、徒步旅行和听音乐。

拉奇纳查达 是 AWS 战略客户部门的首席 AI/ML 解决方案架构师。 Rachna 是一位乐观主义者,他相信以道德和负责任的方式使用人工智能可以改善未来社会,带来经济和社会繁荣。在业余时间,Rachna 喜欢与家人共度时光、徒步旅行和听音乐。

埃文·克拉维茨 是 Amazon Web Services 的一名软件工程师,致力于 SageMaker JumpStart。 他喜欢烹饪和在纽约市跑步。

埃文·克拉维茨 是 Amazon Web Services 的一名软件工程师,致力于 SageMaker JumpStart。 他喜欢烹饪和在纽约市跑步。

Ashish Khetan 博士 是 Amazon SageMaker 内置算法的高级应用科学家,帮助开发机器学习算法。 他在伊利诺伊大学香槟分校获得博士学位。 他是机器学习和统计推理领域的活跃研究者,在 NeurIPS、ICML、ICLR、JMLR、ACL 和 EMNLP 会议上发表了多篇论文。

Ashish Khetan 博士 是 Amazon SageMaker 内置算法的高级应用科学家,帮助开发机器学习算法。 他在伊利诺伊大学香槟分校获得博士学位。 他是机器学习和统计推理领域的活跃研究者,在 NeurIPS、ICML、ICLR、JMLR、ACL 和 EMNLP 会议上发表了多篇论文。

- :具有

- :是

- :不是

- :在哪里

- $UP

- 1

- 10

- 100

- 11

- 13

- 135

- 17

- 19

- 1900

- 250

- 28

- 29

- 31

- 39

- 41

- 50

- 7

- 8

- 9

- a

- 对,能力--

- 关于

- 以上

- 接受

- ACCESS

- 访问

- 账号管理

- 账户

- 积累

- 精准的

- 可实现

- 实现

- 获得

- 横过

- 行动

- 要积极。

- 实际

- 适应

- 增加

- 另外

- 调整

- 高级

- 进步

- 后

- 驳

- 经纪人

- AI

- AI / ML

- 飞机

- 算法

- 外侨

- 所有类型

- 让

- 允许

- 允许

- 沿

- 还

- 替代

- Amazon

- 亚马逊SageMaker

- 亚马逊SageMaker JumpStart

- 亚马逊网络服务

- 量

- an

- 分析

- 分析

- 分析

- 分析

- 和

- 和基础设施

- 仙女星座

- 洛杉矶

- 宣布

- 回答

- 回答

- 答案

- 任何

- 什么

- API

- 应用

- 应用领域

- 应用的

- 使用

- 的途径

- 方法

- 适当

- 应用

- 架构

- 保健

- 国家 / 地区

- 地区

- 论点

- 围绕

- 艺术

- 刊文

- 人造的

- 人工智能

- AS

- 问

- 评定

- 助理

- 宇航员

- At

- 听众

- 权威

- 自动化

- 可使用

- 避免

- 屡获殊荣

- AWS

- AWS管理控制台

- 背部

- 均衡

- 基地

- 基于

- 基本包

- 配料

- 贝叶斯

- BE

- 因为

- before

- 开始

- 背后

- 作为

- 信仰

- 相信

- 如下。

- 标杆

- 基准

- 得益

- 除了

- 最佳

- 更好

- 之间

- 偏见

- 偏见

- 亿

- 十亿美元

- BLADE

- 阻止

- 博客

- 博客

- Bloom

- 身体

- 书

- 书籍

- 击穿

- 光芒万丈

- 带来

- 瞻

- 带来

- 破

- 预算

- 建立

- 建筑物

- 建

- 内建的

- 但是

- 按键

- by

- 日历

- 呼叫

- 被称为

- CAN

- 不能

- 帆布

- 能力

- 能力

- 卡

- 案件

- 例

- 产品类别

- 警告

- 细胞

- 挑战

- 挑战

- 更改

- 特点

- 收费

- 即时通话

- 支票

- 选择

- 选择

- 城市

- 文明

- 程

- 经典

- 清洁

- 清洁

- 明确地

- 点击

- 俱乐部

- 集群

- 码

- 编码

- 合作

- 购买的订单均

- 常用

- 比较

- 相比

- 比较

- 对照

- 兼容

- 完成

- 复杂性

- 复杂

- 执行

- 一台

- 计算机视觉

- 概念

- 概念

- 并发

- 会议

- 配置

- 冲突

- 后果

- 考虑

- 注意事项

- 考虑

- 始终如一

- 由

- 安慰

- 常数

- 约束

- CONTACT

- 包含

- 容器

- 包含

- 抗衡

- 内容

- 上下文

- 一直

- 控制

- 受控

- 谈话

- 听起来像对话

- 对话

- 兑换

- 转换

- Cool

- 正确地

- 成本

- 可以

- 创建信息图

- 创造

- 创意奖学金

- 创造者

- 填字游戏

- 策划

- 好奇

- 电流

- 合作伙伴

- 定制

- 每天

- 舞蹈

- 黑暗

- data

- 数据集

- 天

- 决定

- 深

- 深入学习

- 更深

- DeepMind

- 默认

- 定义

- 定义

- 钻研

- 再往

- 线上演示

- 依赖

- 部署

- 部署

- 部署

- 部署

- 沙漠

- 设计

- 设计

- 期望

- 细节

- 详细

- 详情

- 确定

- 开发

- 发达

- 开发商

- 发展

- 研发支持

- 设备

- 诊断

- 对话框

- 不同

- 差异

- 不同

- 数字

- 数码艺术

- 直接

- 目录

- 通过各种方式找到

- 讨论

- 讨论

- 疾病

- 潜水

- 不同

- 多元化

- 分

- do

- 文件

- 纪录片

- 不

- 域

- 域名

- 完成

- 向下

- 下载

- 两

- 公爵

- 杜克大学

- ,我们将参加

- 灰尘

- 反乌托邦

- 每

- 地球

- 更容易

- 效率

- 八

- 邮箱地址

- 帝国

- enable

- 使

- 使

- 遭遇

- 鼓励

- 端至端

- 端点

- 从事

- 工程师

- 增强

- 享受

- 愉快的

- 确保

- 环境

- EPIC

- 故障

- 必要

- 建立

- 伦理

- 评估

- 评估

- 评估

- 终于

- 所有的

- 例子

- 例子

- 兴奋

- 全面

- 展品

- 存在

- 现有

- 扩大

- 预期

- 昂贵

- 体验

- 实验

- 专家

- 探索

- 探讨

- 探索

- 面部彩妆

- 公平

- false

- 家庭

- 快

- 专栏

- 反馈

- 脚

- 少数

- 部分

- 战斗

- 文件

- 终于

- 找到最适合您的地方

- 发现

- 结束

- 姓氏:

- 第一次接触

- 适合

- 五

- Flash

- 飞行

- 重点

- 以下

- 如下

- 针对

- 永远

- 格式

- 基金会

- 骨架

- 坦率

- 止

- 功能

- 功能

- 功能

- 运作

- 进一步

- 未来

- 未来

- Games

- 收集

- 双子座

- 发电

- 生成的

- 生成式人工智能

- 类型

- 流派

- 得到

- GitHub上

- 给

- 特定

- Go

- 理想中

- 去

- 非常好

- 谷歌

- 谷歌的

- 得到了

- GPU

- 恩典

- 渐渐

- 大

- 强大的力量

- 团队

- 担保

- 守卫

- 指导

- 指南

- 指导

- 手

- 马具

- 有

- he

- 高度

- hello

- 帮助

- 帮助

- 这里

- 此处

- 老旧房屋

- 他的

- 历史

- 抱有希望

- 托管

- 创新中心

- How To

- 但是

- HTML

- HTTPS

- 中心

- 集线器

- 拥抱脸

- 人

- 人类

- 人类

- i

- ID

- 主意

- 鉴定

- if

- 伊利诺伊州

- 图片

- 影响力故事

- 实施

- 履行

- 进口

- 重要

- 改善

- 改进

- 改善

- 改善

- in

- 包括

- 包含

- 结合

- 增加

- 独立

- 行业中的应用:

- 行业标准

- 影响

- 信息

- 信息化

- 基础设施

- 创造力

- 創新

- 输入

- 输入

- 咨询内容

- 可行的洞见

- 灵感

- 例

- 代替

- 整合

- 集成

- 房源搜索

- 意图

- 相互作用

- 利益

- 接口

- 路口

- 成

- 介绍

- 直观的

- 涉及

- 参与

- 涉及

- IT

- 项目

- 它的

- 行话

- 加入

- 日志

- 旅程

- JPG

- JSON

- 只是

- 保持

- 类

- 知道

- 知识

- 已知

- 凯尔

- 着陆

- 景观

- 语言

- 大

- 大

- 潜伏

- 推出

- 法律

- 领导

- 学习用品

- 学习

- 可以学习

- 离开

- 长度

- 让

- Level

- 杠杆作用

- 执照

- 许可证

- 生活

- 闪电

- 闪电般的速度

- 轻巧

- 喜欢

- 喜欢

- Line

- 线

- 清单

- 听

- 听力

- 监听

- 骆驼

- 加载

- 本地

- 圖書分館的位置

- 看

- 寻找

- LOOKS

- 该

- 洛杉矶

- 降低

- 机

- 机器学习

- 多数

- 使

- 恶意

- 颠覆性技术

- 手动

- 许多

- 标记

- 火星

- 数学

- 最多

- 可能..

- me

- 意

- 含义

- 措施

- 媒体

- 药物

- 会议

- 提到

- 的话

- 条未读消息

- 方法

- Michael (中国)

- 可能

- 介意

- 分钟

- ML

- 模型

- 模型

- 模块

- 显示器

- 监控

- 更多

- 最先进的

- 电影

- 音乐

- 必须

- my

- 神秘

- 姓名

- 命名

- 自然

- 自然语言处理

- 自然

- 必要

- 需求

- 打印车票

- 需要

- 网络

- 神经

- 神经网络

- 决不要

- 全新

- 纽约

- 纽约市

- 夜

- 没有

- 注意

- 笔记本

- 小说

- 现在

- 数

- 绿洲

- 对象

- 目标

- 观察

- of

- 优惠精选

- 经常

- on

- 一旦

- 一

- 正在进行

- 仅由

- 操作

- 机会

- 优化

- 优化

- 附加选项

- or

- 秩序

- 起源

- OS

- 其他名称

- 其它

- 输出

- 成果

- 结果

- 产量

- 超过

- 己

- 页

- 文件

- 并行

- 参数

- 参数

- 特别

- 尤其

- 各方

- 通过

- 通过

- 过去

- 径

- 模式

- 保罗

- 员工

- 为

- 演出

- 性能

- 执行

- 施行

- 个人

- 观点

- 博士学位

- 短语

- 物理学家

- 飞行员

- 地方

- 行星

- 计划

- 柏拉图

- 柏拉图数据智能

- 柏拉图数据

- 播放

- 播放机

- 请

- 点

- 点

- 政治

- 热门

- 人口

- 帖子

- 潜力

- 功率

- 在练习上

- 做法

- 预测

- 预报器

- 喜好

- 准备

- 漂亮

- 先前

- 王子

- 校长

- 打印

- 过程

- 处理

- 过程

- 处理

- 生产

- 曲目

- 进展

- 项目

- 提示

- 正确

- 繁荣

- 提供

- 供应商

- 提供

- 国家

- 公然

- 出版

- 目的

- 拼图

- 蟒蛇

- pytorch

- 质量

- 查询

- 询问

- 探索

- 题

- 有疑问吗?

- 很快

- 相当

- 种族

- 后果

- 范围

- 宁

- 原

- 达

- 阅读

- 阅读

- 真实的世界

- 现实

- 真

- 境界

- 原因

- 接收

- 最近

- 推荐

- 建议

- 建议

- 经常性的

- 参考

- 引用

- 反映

- 经常

- 法规

- 有关

- 发布

- 相应

- 纪念

- 重复

- 代表

- 要求

- 必须

- 岗位要求

- 研究

- 研究员

- 回应

- 回应

- 响应

- 回复

- 责任

- 提供品牌战略规划

- 导致

- 成果

- 检讨

- 积分

- 上升

- 健壮

- 稳健性

- 角色

- 常规

- 皇族

- 定位、竞价/采购和分析/优化数字媒体采购,但算法只不过是解决问题的操作和规则。

- 运行

- 运行

- s

- 更安全

- sagemaker

- SageMaker 推理

- 同

- 保存

- 对工资盗窃

- 可扩展性

- 鳞片

- 秤

- 缩放

- 情景

- 科幻

- 科学

- 科学家

- 科学家

- 范围

- 划伤

- 脚本

- 脚本

- SDK

- 无缝的

- 搜索

- 其次

- 秘密

- 部分

- 安全

- 看到

- 选择

- 选

- 选择

- 选择

- 发送

- 前辈

- 分开

- 序列

- 系列

- A系列

- 特色服务

- 服务

- 会议

- 集

- 套数

- 设置

- 几个

- 共用的,

- 应该

- 显示

- 显示

- 显示

- 如图

- 作品

- 侧

- 类似

- 简易

- 单

- 尺寸

- 尺寸

- 技能

- So

- 社会

- 社会

- 软件

- 软件工程师

- 方案,

- 解决方案

- 一些

- 来源

- 火花

- 具体的

- 速度

- 花费

- 花

- 站

- 标准

- 开始

- 开始

- 州/领地

- 国家的最先进的

- 个人陈述

- 统计

- 步

- 步骤

- 仍

- 故事

- 风暴

- 故事

- 奇怪

- 善用

- 策略

- 串

- 强烈

- 工作室

- 学习

- 订阅

- 字幕

- 成功

- 这样

- 合适的

- SUPPORT

- 支持

- 支持

- 支持

- 肯定

- 生存

- 系统

- 表

- 采取

- 需要

- 故事

- 目标

- 目标

- 任务

- 任务

- 团队

- 队

- 技术

- 技术

- 专业技术

- 模板

- 模板

- tensorflow

- 条款

- test

- 测试

- 测试

- 文本

- 比

- 这

- 区域

- 未来

- 世界

- 其

- 他们

- 他们自己

- 然后

- 那里。

- 因此

- 博曼

- 他们

- 第三

- 第三者

- 第三方

- Free Introduction

- 那些

- 思想

- 发人深省的

- 千

- 惊险

- 通过

- 吞吐量

- 次

- 时间序列

- 时间旅行

- 时间表

- 时

- 至

- 象征

- 符号化

- 令牌

- 告诉

- 工具

- 工具

- 主题

- 合计

- 跟踪时

- 传统

- 培训

- 熟练

- 产品培训

- 转让

- 传输

- 变压器

- 翻译

- 旅行

- 兆

- true

- 尝试

- 调

- 调整

- 调音

- tv

- 二

- 类型

- 类型

- 普遍

- 一般

- ui

- 最终

- 揭露

- 下

- 理解

- 理解

- 陌生

- 宇宙

- 大学

- 无与伦比

- 直到

- 揭幕

- 更新

- 最新动态

- 更新

- us

- 可用性

- 用法

- 使用

- 用例

- 用过的

- 用户

- 用户友好

- 用户

- 使用

- 运用

- 验证

- 价值观

- 各种

- 各个

- 冒险

- 版本

- 查看

- 在线会议

- 虚拟现实

- 愿景

- 参观

- 视觉

- 视觉媒体

- 体积

- 走

- 想

- 担保

- 是

- 了解

- 观看

- 方法..

- 方法

- we

- 卷筒纸

- Web服务

- 基于网络的

- 周

- 井

- 井

- 什么是

- 什么是

- ,尤其是

- 每当

- 是否

- 这

- WHO

- 宽

- 广泛

- 小部件

- 将

- 智慧

- 中

- 也完全不需要

- Word

- 话

- 工作

- 工作流程

- 加工

- 世界

- 写

- 写作

- X

- 纽约

- 完全

- 年轻

- 您一站式解决方案

- 你自己

- 和风网