随着生成式人工智能应用程序的快速采用,这些应用程序需要及时响应,以减少感知延迟并提高吞吐量。基础模型 (FM) 通常是在参数范围从数百万到数十亿甚至更多的大量数据集上进行预训练的。大语言模型 (LLM) 是一种 FM,它生成文本作为用户推理的响应。使用不同的推理参数配置来推理这些模型可能会导致不一致的延迟。不一致可能是因为您期望从模型获得的响应令牌数量不同或部署模型的加速器类型不同。

在任何一种情况下,您都可以采用响应流的方法进行推理,而不是等待完整的响应,该方法在生成信息块后立即将其发送回。这通过允许您查看实时流式传输的部分响应而不是延迟的完整响应来创建交互式体验。

随着官方宣布 Amazon SageMaker 实时推理现在支持响应流,您现在可以在使用时连续地将推理响应流回客户端 亚马逊SageMaker 通过响应流进行实时推理。该解决方案将帮助您为各种生成式 AI 应用程序(例如聊天机器人、虚拟助手和音乐生成器)构建交互式体验。这篇文章向您展示如何以首字节时间 (TTFB) 的形式实现更快的响应时间,并在推理 Llama 2 模型时减少总体感知延迟。

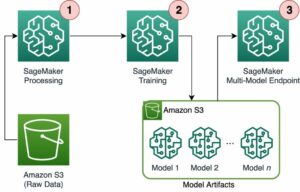

为了实施该解决方案,我们使用完全托管的服务 SageMaker 来准备数据,并通过完全托管的基础设施、工具和工作流程为任何用例构建、训练和部署机器学习 (ML) 模型。有关 SageMaker 提供的各种部署选项的更多信息,请参阅 Amazon SageMaker 模型托管常见问题解答。让我们了解如何使用响应流的实时推理来解决延迟问题。

解决方案概述

因为我们想要解决上述与 LLM 实时推理相关的延迟问题,所以我们首先了解如何使用响应流支持来进行 Llama 2 的实时推理。但是,任何 LLM 都可以利用响应流支持来实现实时推理。 -时间推理。

Llama 2 是预先训练和微调的生成文本模型的集合,参数范围从 7 亿到 70 亿个参数不等。 Llama 2 模型是仅具有解码器架构的自回归模型。当提供提示和推理参数时,Llama 2 模型能够生成文本响应。这些模型可用于翻译、摘要、问答和聊天。

在这篇文章中,我们部署了 Llama 2 Chat 模型 meta-llama/Llama-2-13b-chat-hf 在 SageMaker 上通过响应流进行实时推理。

在 SageMaker 端点上部署模型时,您可以使用专门的容器化模型 AWS 深度学习容器 (DLC) 图像可用于流行的开源库。 Llama 2 模型是文本生成模型;你可以使用 SageMaker 上的 Hugging Face LLM 推理容器 由拥抱脸供电 文本生成推理 (TGI) 或 AWS DLC 大模型推理 (LMI)。

在这篇文章中,我们使用 SageMaker Hosting 上的 DLC 部署 Llama 2 13B Chat 模型,以实现由 G5 实例支持的实时推理。 G5 实例是基于 GPU 的高性能实例,适用于图形密集型应用程序和 ML 推理。您还可以使用受支持的实例类型 p4d、p3、g5 和 g4dn,并根据实例配置进行适当更改。

先决条件

要实施此解决方案,您应该具备以下条件:

- 一个 AWS 账户 AWS身份和访问管理 (IAM) 角色,有权管理作为解决方案的一部分创建的资源。

- 如果这是您第一次与 亚马逊SageMaker Studio,你首先需要创建一个 SageMaker 域.

- 一个拥抱脸帐户。 注册 如果您还没有帐户,请使用您的电子邮件。

- 为了无缝访问 Hugging Face 上可用的模型,尤其是 Llama 等门控模型,以进行微调和推理目的,您应该拥有 Hugging Face 帐户来获取读取访问令牌。注册 Hugging Face 帐户后, 登录 参观 https://huggingface.co/settings/tokens 创建读取访问令牌。

- 使用您注册 Hugging Face 时使用的同一电子邮件 ID 访问 Llama 2。

- 通过 Hugging Face 提供的 Llama 2 型号是门控型号。 Llama 模型的使用受 Meta 许可证的约束。要下载模型权重和分词器, 请求访问 Llama 并接受他们的许可。

- 获得访问权限后(通常在几天内),您将收到一封确认电子邮件。对于这个例子,我们使用模型

Llama-2-13b-chat-hf,但您也应该能够访问其他变体。

方法一:抱脸TGI

在本节中,我们将向您展示如何部署 meta-llama/Llama-2-13b-chat-hf 使用 Hugging Face TGI 将模型传输到 SageMaker 实时端点,并具有响应流。下表概述了此部署的规格。

| 规格 | 值 |

| 容器 | 抱脸TGI |

| 型号名称 | 元骆驼/Llama-2-13b-chat-hf |

| 机器学习实例 | ml.g5.12xlarge |

| 推理 | 实时响应流 |

部署模型

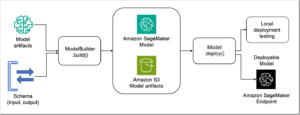

首先,您检索要部署的 LLM 的基础映像。然后,您可以在基础图像上构建模型。最后,您将模型部署到 SageMaker Hosting 的 ML 实例以进行实时推理。

我们来看看如何以编程方式实现部署。为简洁起见,本节仅讨论有助于部署步骤的代码。笔记本中提供了完整的部署源代码 llama-2-hf-tgi/llama-2-13b-chat-hf/1-deploy-llama-2-13b-chat-hf-tgi-sagemaker.ipynb.

通过预建检索由 TGI 提供支持的最新 Hugging Face LLM DLC SageMaker DLC。您使用此映像来部署 meta-llama/Llama-2-13b-chat-hf SageMaker 上的模型。请看下面的代码:

使用如下定义的配置参数定义模型的环境:

更换 <YOUR_HUGGING_FACE_READ_ACCESS_TOKEN> 对于配置参数 HUGGING_FACE_HUB_TOKEN 以及从您的 Hugging Face 个人资料中获取的令牌值,如本文先决条件部分所述。在配置中,您将模型的每个副本使用的 GPU 数量定义为 4 SM_NUM_GPUS。然后您可以部署 meta-llama/Llama-2-13b-chat-hf 在配备 5.12 个 GPU 的 ml.g4xlarge 实例上进行模型建模。

现在您可以构建实例 HuggingFaceModel 与上述环境配置:

最后,通过向模型上可用的部署方法提供具有各种参数值的参数来部署模型,例如 endpoint_name, initial_instance_count及 instance_type:

执行推理

Hugging Face TGI DLC 能够传输响应,无需对模型进行任何自定义或代码更改。您可以使用 invoke_endpoint_with_response_stream 如果您使用 Boto3 或 带响应流的调用端点 使用 SageMaker Python SDK 进行编程时。

InvokeEndpointWithResponseStream SageMaker 的 API 允许开发人员从 SageMaker 模型流式传输响应,这可以通过减少感知延迟来帮助提高客户满意度。这对于使用生成式人工智能模型构建的应用程序尤其重要,其中立即处理比等待整个响应更重要。

对于本示例,我们使用 Boto3 来推断模型并使用 SageMaker API invoke_endpoint_with_response_stream 如下:

论据 CustomAttributes 被设置为值 accept_eula=false. accept_eula 参数必须设置为 true 成功获得 Llama 2 模型的响应。成功调用后使用 invoke_endpoint_with_response_stream,该方法将返回字节响应流。

下图说明了此工作流程。

您需要一个迭代器来循环字节流并将它们解析为可读文本。这 LineIterator 实施可以在以下位置找到 llama-2-hf-tgi/llama-2-13b-chat-hf/utils/LineIterator.py。现在您已准备好准备提示和说明,以便在推理模型时将它们用作有效负载。

准备提示和说明

在此步骤中,您将为您的法学硕士准备提示和说明。要提示 Llama 2,您应该具有以下提示模板:

您构建在方法中以编程方式定义的提示模板 build_llama2_prompt,它与前面提到的提示模板一致。然后,您可以根据用例定义说明。在本例中,我们指示模型为营销活动生成一封电子邮件,如 get_instructions 方法。这些方法的代码位于 llama-2-hf-tgi/llama-2-13b-chat-hf/2-sagemaker-realtime-inference-llama-2-13b-chat-hf-tgi-streaming-response.ipynb 笔记本。结合要执行的任务构建指令,详细信息请参见 user_ask_1 如下:

我们传递指令以根据 build_llama2_prompt 生成的提示模板构建提示。

我们将推理参数和提示与密钥结合起来 stream 有价值 True 形成最终的有效负载。将有效负载发送至 get_realtime_response_stream,它将用于通过响应流调用端点:

LLM 生成的文本将流式传输到输出,如以下动画所示。

方法 2:LMI 与 DJL 服务

在本节中,我们将演示如何部署 meta-llama/Llama-2-13b-chat-hf 使用 LMI 和 DJL Serving 将模型传输到具有响应流的 SageMaker 实时端点。下表概述了此部署的规格。

| 规格 | 值 |

| 容器 | 带有 DJL Serving 的 LMI 容器映像 |

| 型号名称 | 元骆驼/Llama-2-13b-chat-hf |

| 机器学习实例 | ml.g5.12xlarge |

| 推理 | 实时响应流 |

您首先下载模型并将其存储在 亚马逊简单存储服务 (亚马逊 S3)。然后,您可以在 S3 URI 中指定指示模型的 S3 前缀 serving.properties 文件。接下来,您检索要部署的 LLM 的基础映像。然后,您可以在基础图像上构建模型。最后,您将模型部署到 SageMaker Hosting 的 ML 实例以进行实时推理。

让我们观察如何以编程方式实现上述部署步骤。为简洁起见,本节仅详细介绍有助于部署步骤的代码。此部署的完整源代码可在笔记本中找到 llama-2-lmi/llama-2-13b-chat/1-deploy-llama-2-13b-chat-lmi-response-streaming.ipynb.

从 Hugging Face 下载模型快照并将模型工件上传到 Amazon S3

满足上述先决条件后,在 SageMaker 笔记本实例上下载模型,然后将其上传到 S3 存储桶以进行进一步部署:

请注意,即使您没有提供有效的访问令牌,模型也会下载。但是当你部署这样的模型时,模型服务将不会成功。因此,建议更换 <YOUR_HUGGING_FACE_READ_ACCESS_TOKEN> 为了论证 token 以及从您的 Hugging Face 个人资料中获取的令牌值(如先决条件中详述)。在这篇文章中,我们指定了 Llama 2 的官方模型名称,如 Hugging Face 上标识的值所示 meta-llama/Llama-2-13b-chat-hf。未压缩的模型将下载到 local_model_path 运行上述代码的结果。

将文件上传到Amazon S3并获取URI,稍后将使用该URI serving.properties.

您将包装 meta-llama/Llama-2-13b-chat-hf 使用 DJL Serving 使用指定的配置在 LMI 容器映像上建立模型 serving.properties。然后,您将模型以及打包在 SageMaker ML 实例 ml.g5.12xlarge 上的容器映像上的模型工件一起部署。然后,您可以将此 ML 实例用于 SageMaker Hosting 进行实时推理。

为 DJL Serving 准备模型工件

通过创建一个来准备您的模型工件 serving.properties 配置文件:

我们在此配置文件中使用以下设置:

- 发动机 – 这指定 DJL 使用的运行时引擎。可能的值包括

Python,DeepSpeed,FasterTransformer及MPI。在本例中,我们将其设置为MPI。模型并行化和推理 (MPI) 有助于在所有可用 GPU 上对模型进行分区,从而加速推理。 - 选项.入口点 – 此选项指定您想要使用 DJL Serving 提供的处理程序。可能的值为

djl_python.huggingface,djl_python.deepspeed及djl_python.stable-diffusion。 我们用djl_python.huggingface用于拥抱脸部加速。 - 选项.tensor_parallel_ Degree – 此选项指定在模型上执行的张量并行分区的数量。您可以设置 Accelerate 需要对模型进行分区的 GPU 设备的数量。此参数还控制 DJL 服务运行时将启动的每个模型的工作线程数量。例如,如果我们有一台 4 GPU 机器,并且要创建四个分区,那么每个模型将有一个工作线程来服务请求。

- 选项.low_cpu_mem_usage – 这可以减少加载模型时的 CPU 内存使用量。我们建议您将其设置为

TRUE. - 选项.rolling_batch – 这可以使用支持的策略之一进行迭代级批处理。值包括

auto,scheduler及lmi-dist。 我们用lmi-dist用于打开 Llama 2 的连续批处理。 - option.max_rolling_batch_size – 这限制了连续批处理中的并发请求数。该值默认为 32。

- 选项.model_id – 你应该更换

{{model_id}}与托管在一个预训练模型的模型 ID Hugging Face 上的模型存储库 或模型工件的 S3 路径。

更多配置选项可以在 配置和设置.

由于 DJL Serving 希望将模型构件打包并格式化为 .tar 文件,因此请运行以下代码片段来压缩 .tar 文件并将其上传到 Amazon S3:

使用 DJL Serving 检索最新的 LMI 容器映像

接下来,您使用 SageMaker for LMI 提供的 DLC 来部署模型。检索 SageMaker 图像 URI djl-deepspeed 使用以下代码以编程方式容器:

您可以使用上述镜像来部署 meta-llama/Llama-2-13b-chat-hf SageMaker 上的模型。现在您可以继续创建模型。

创建模型

您可以使用以下命令创建其容器构建的模型 inference_image_uri 以及位于 S3 URI 指示的模型服务代码 s3_code_artifact:

现在,您可以使用端点配置的所有详细信息创建模型配置。

创建模型配置

使用以下代码为由以下标识的模型创建模型配置 model_name:

模型配置定义为 ProductionVariants 参数 InstanceType 对于 ML 实例 ml.g5.12xlarge。您还提供 ModelName 使用您在前面步骤中创建模型时使用的相同名称,从而在模型和端点配置之间建立关系。

现在您已经定义了模型和模型配置,您可以创建 SageMaker 终端节点。

创建 SageMaker 端点

使用以下代码片段创建端点以部署模型:

您可以使用以下代码片段查看部署进度:

部署成功后,端点状态为 InService。现在端点已准备就绪,让我们通过响应流进行推理。

通过响应流进行实时推理

正如我们在之前的 Hugging Face TGI 方法中介绍的那样,您可以使用相同的方法 get_realtime_response_stream 从 SageMaker 端点调用响应流。使用 LMI 方法进行推理的代码位于 llama-2-lmi/llama-2-13b-chat/2-inference-llama-2-13b-chat-lmi-response-streaming.ipynb 笔记本。这 LineIterator 实施位于 llama-2-lmi/utils/LineIterator.py。 请注意 LineIterator 部署在 LMI 容器上的 Llama 2 Chat 模型与 LineIterator 参见“Hugging Face TGI”部分。这 LineIterator 循环来自 Llama 2 Chat 模型的字节流,该模型是使用 LMI 容器推断的 djl-deepspeed 版本 0.25.0。以下辅助函数将解析从通过发出的推理请求收到的响应流 invoke_endpoint_with_response_stream API:

上述方法打印读取的数据流 LineIterator 以人类可读的格式。

让我们探讨如何准备提示和说明,以在推理模型时将它们用作有效负载。

因为您在 Hugging Face TGI 和 LMI 中推理相同的模型,所以准备提示和说明的过程是相同的。因此,您可以使用以下方法 get_instructions 和 build_llama2_prompt 用于推理。

get_instructions 方法返回指令。构建与要执行的任务相结合的指令,详细信息参见 user_ask_2 如下:

传递指令以根据生成的提示模板构建提示 build_llama2_prompt:

我们将推理参数与提示结合起来形成最终的有效负载。然后您将有效负载发送到 get_realtime_response_stream, 它用于通过响应流调用端点:

LLM 生成的文本将流式传输到输出,如以下动画所示。

清理

为避免产生不必要的费用,请使用 AWS管理控制台 删除在运行帖子中提到的方法时创建的端点及其关联资源。对于这两种部署方法,请执行以下清理例程:

更换 <SageMaker_Real-time_Endpoint_Name> 对于变量 endpoint_name 与实际端点。

对于第二种方法,我们将模型和代码工件存储在 Amazon S3 上。您可以使用以下代码清理 S3 存储桶:

结论

在这篇文章中,我们讨论了不同数量的响应令牌或不同的推理参数集如何影响与 LLM 相关的延迟。我们展示了如何借助响应流来解决该问题。然后,我们确定了两种使用 AWS DLC 部署和推理 Llama 2 Chat 模型的方法 - LMI 和 Hugging Face TGI。

您现在应该了解流响应的重要性以及它如何减少感知延迟。流式响应可以改善用户体验,否则您将需要等待 LLM 构建整个响应。此外,部署带有响应流的 Llama 2 Chat 模型可以改善用户体验并让您的客户满意。

可以参考官方的aws-samples 亚马逊-sagemaker-llama2-响应-流媒体-食谱 涵盖其他 Llama 2 型号变体的部署。

参考资料

作者简介

帕万·库马尔·拉奥·纳武勒 是 Amazon Web Services 的解决方案架构师。他与印度的 ISV 合作,帮助他们在 AWS 上进行创新。他是《V 编程入门》一书的出版作者。他在海得拉巴印度理工学院 (IIT) 攻读数据科学高级管理硕士学位。他还获得了印度工商管理学院 IT 专业的高级 MBA 学位,并拥有 Vaagdevi 技术与科学研究所的电子和通信工程学士学位。 Pavan 是 AWS 认证解决方案架构师专家,并拥有 AWS 认证机器学习专业人士、Microsoft 认证专家 (MCP) 和 Microsoft 认证技术专家 (MCTS) 等其他认证。他也是一位开源爱好者。在空闲时间,他喜欢聆听 Sia 和 Rihanna 伟大而神奇的声音。

帕万·库马尔·拉奥·纳武勒 是 Amazon Web Services 的解决方案架构师。他与印度的 ISV 合作,帮助他们在 AWS 上进行创新。他是《V 编程入门》一书的出版作者。他在海得拉巴印度理工学院 (IIT) 攻读数据科学高级管理硕士学位。他还获得了印度工商管理学院 IT 专业的高级 MBA 学位,并拥有 Vaagdevi 技术与科学研究所的电子和通信工程学士学位。 Pavan 是 AWS 认证解决方案架构师专家,并拥有 AWS 认证机器学习专业人士、Microsoft 认证专家 (MCP) 和 Microsoft 认证技术专家 (MCTS) 等其他认证。他也是一位开源爱好者。在空闲时间,他喜欢聆听 Sia 和 Rihanna 伟大而神奇的声音。

苏丹舒仇恨 是 AWS 的首席 AI/ML 专家,与客户合作,为他们的 MLOps 和生成式 AI 之旅提供建议。在加入 Amazon 之前,他构思、创建并领导团队构建基于开源的人工智能和游戏化平台,并成功为 100 多个客户将其商业化。 Sudhanshu 拥有多项专利,撰写了两本书以及多篇论文和博客,并在各种技术论坛上发表了自己的观点。他一直是思想领袖和演讲家,在该行业工作了近 25 年。他曾与全球财富 1000 强客户合作,最近又与印度的数字原生客户合作。

苏丹舒仇恨 是 AWS 的首席 AI/ML 专家,与客户合作,为他们的 MLOps 和生成式 AI 之旅提供建议。在加入 Amazon 之前,他构思、创建并领导团队构建基于开源的人工智能和游戏化平台,并成功为 100 多个客户将其商业化。 Sudhanshu 拥有多项专利,撰写了两本书以及多篇论文和博客,并在各种技术论坛上发表了自己的观点。他一直是思想领袖和演讲家,在该行业工作了近 25 年。他曾与全球财富 1000 强客户合作,最近又与印度的数字原生客户合作。

- SEO 支持的内容和 PR 分发。 今天得到放大。

- PlatoData.Network 垂直生成人工智能。 赋予自己力量。 访问这里。

- 柏拉图爱流。 Web3 智能。 知识放大。 访问这里。

- 柏拉图ESG。 碳, 清洁科技, 能源, 环境, 太阳能, 废物管理。 访问这里。

- 柏拉图健康。 生物技术和临床试验情报。 访问这里。

- Sumber: https://aws.amazon.com/blogs/machine-learning/inference-llama-2-models-with-real-time-response-streaming-using-amazon-sagemaker/

- :具有

- :是

- :在哪里

- $UP

- 1

- 10

- 100

- 11

- 12

- 14

- 15%

- 150

- 16

- 19

- 1

- 25

- 32

- 385

- 50

- 7

- 70

- 8

- 9

- a

- 对,能力--

- Able

- 关于

- 加快

- 加速

- 加速器

- 接受

- ACCESS

- 账号管理

- 横过

- 操作

- 实际

- 另外

- 地址

- 管理

- 采用

- 采用

- 优点

- 劝

- 影响

- 后

- AI

- AI模型

- AI / ML

- 爱丽丝

- 对齐

- 所有类型

- 允许

- 允许

- 沿

- 已经

- 还

- Amazon

- 亚马逊SageMaker

- 亚马逊网络服务

- an

- 和

- 动画

- 公布

- 公告

- 任何

- API

- 应用领域

- 的途径

- 方法

- 适当

- 建筑的

- 架构

- 保健

- 论点

- 参数

- AS

- 助理

- 相关

- At

- 作者

- 可使用

- 避免

- AWS

- 背部

- 基地

- 配料

- BE

- 因为

- 很

- before

- 之间

- 超越

- 亿

- 十亿美元

- BIN

- 博客

- 身体

- 书

- 书籍

- 都

- 建立

- 建立

- 建

- 商业

- 但是

- by

- 呼叫

- 营销活动

- CAN

- 能力

- 案件

- 认证

- 认证

- 更改

- 收费

- 即时通话

- 聊天机器人

- 清洁

- 客户

- 客户

- 俱乐部

- 码

- 采集

- COM的

- 结合

- 购买的订单均

- 沟通

- 并发

- 配置

- 确认

- 容器

- 集装箱

- 连续

- 一直

- 控制

- 可以

- 情侣

- 优惠券

- 覆盖

- 盖

- 创建信息图

- 创建

- 创建

- 创造

- 信用

- 顾客

- 客户满意度

- 合作伙伴

- data

- 数据科学

- 一年中的

- 深

- 深入学习

- 默认

- 定义

- 定义

- 延迟

- 演示

- 部署

- 部署

- 部署

- 部署

- 详细

- 详情

- 开发

- 设备

- 不同

- 数字

- 讨论

- 别

- 下载

- ,我们将参加

- 此前

- 或

- 电子

- 邮箱地址

- 使

- 端点

- 发动机

- 工程师

- 爱好者

- 整个

- 环境

- 特别

- 建立

- 甚至

- 例子

- 执行

- 期待

- 预计

- 体验

- 体验

- 探索

- 面部彩妆

- 功能有助于

- false

- 快

- 文件

- 档

- 最后

- 终于

- (名字)

- 第一次

- 以下

- 如下

- 针对

- 申请

- 格式

- 运气

- 论坛

- 发现

- 基金会

- 四

- 自由的

- 止

- ,

- 充分

- 功能

- 进一步

- 游戏化

- 门控

- 生成

- 产生

- 发电

- 代

- 生成的

- 生成式人工智能

- 发电机

- 得到

- GIF

- 地球

- Go

- 治理

- GPU

- 图形处理器

- 授予

- 大

- 快乐

- 恨

- 有

- he

- 帮助

- 帮助

- 高性能

- 更高

- 他的

- 持有

- 托管

- 托管

- 创新中心

- How To

- 但是

- HTML

- HTTP

- HTTPS

- 拥抱脸

- 人类可读

- ID

- 确定

- 身分

- if

- 说明

- 图片

- 图片

- 即时

- 实施

- 履行

- 进口

- 重要性

- 重要

- 改善

- 提高

- in

- 包括

- 包含

- 印度

- 印度

- 表示

- 行业中的应用:

- 信息

- 基础设施

- 创新

- 输入

- 输入

- 内

- 例

- 代替

- 研究所

- 说明

- 互动

- 网络

- 问题

- IT

- 它的

- 旅程

- JSON

- 键

- 库马尔

- 语言

- 大

- 潜伏

- 延迟问题

- 后来

- 最新

- 发射

- 铅

- 领导者

- 学习

- 导致

- 长度

- 库

- 执照

- 喜欢

- 范围

- Line

- 听

- 骆驼

- LLM

- 装载

- 位于

- 爱

- 机

- 机器学习

- 制成

- 使

- 制作

- 管理

- 管理

- 颠覆性技术

- 营销

- 最大

- 可能..

- MCP

- 内存

- 提到

- 元

- 方法

- 方法

- 微软

- 百万

- ML

- 多播

- 模型

- 模型

- 个月

- 更多

- 最先进的

- 音乐

- 必须

- 姓名

- 命名

- 本地人

- 几乎

- 需求

- 需要

- 全新

- 下页

- 注意

- 笔记本

- 现在

- 数

- 对象

- 观察

- 获得

- 获得

- of

- 最多线路

- 官方

- 经常

- on

- 一

- 仅由

- 打开

- 开放源码

- 附加选项

- 附加选项

- or

- 其他名称

- 除此以外

- 大纲

- 产量

- 超过

- 最划算

- συσκευάζονται

- 包装

- 文件

- 并行

- 参数

- 参数

- 部分

- 通过

- 专利

- 径

- 为

- 感知

- 演出

- 执行

- 权限

- 平台

- 柏拉图

- 柏拉图数据智能

- 柏拉图数据

- 点

- 热门

- 可能

- 帖子

- 供电

- 前

- Prepare

- 准备

- 先决条件

- 呈现

- 以前

- 校长

- 打印

- 市场问题

- 继续

- 过程

- 处理

- 处理

- 产品

- 产品发布会

- 所以专业

- 本人简介

- 代码编程

- 进展

- 提供

- 提供

- 提供

- 优

- 出版

- 目的

- 蟒蛇

- pytorch

- 题

- 范围

- 快

- 宁

- 阅读

- 准备

- 真实

- 实时的

- 实现

- 接收

- 收到

- 最近

- 建议

- 建议

- 减少

- 减少

- 减少

- 参考

- 关系

- 更换

- 回复

- 知识库

- 请求

- 要求

- 资源

- 回应

- 响应

- 回复

- 导致

- 回报

- 回报

- 角色

- 常规

- 运行

- 运行

- 运行

- 运行

- sagemaker

- 同

- 满意

- 鳞片

- 学校

- 科学

- SDK

- 无缝的

- 其次

- 部分

- 看到

- 提交

- 发送

- 服务

- 服务

- 特色服务

- 服务

- 集

- 设置

- 几个

- 短

- 应该

- 显示

- 显示

- 如图

- 作品

- 签署

- 简易

- 快照

- 片段

- 方案,

- 解决方案

- 或很快需要,

- 来源

- 源代码

- 喇叭

- 专家

- 专门

- 其他

- 规格

- 指定

- 开始

- Status

- 步

- 步骤

- Stop 停止

- 存储

- 商店

- 存储

- 策略

- 流

- 流

- 流

- 流媒体服务

- 走向成功

- 成功

- 顺利

- 这样

- SUPPORT

- 支持

- 支持

- 表

- 采取

- 任务

- 队

- 科技

- 文案

- 专业技术

- 模板

- 文本

- 比

- 这

- 其

- 他们

- 然后

- 那里。

- 从而

- 因此

- 博曼

- 他们

- Free Introduction

- 虽然?

- 思想

- 吞吐量

- 次

- 时

- 至

- 象征

- 令牌

- 工具

- 培训

- 翻译

- true

- 谈到

- 二

- 类型

- 类型

- 一般

- 理解

- 不必要

- 直到

- 用法

- 使用

- 用例

- 用过的

- 用户

- 用户体验

- 运用

- 有效

- 折扣值

- 价值观

- 变量

- 各个

- 变化

- 广阔

- 版本

- 通过

- 查看

- 在线会议

- 参观

- VOICES

- 等待

- 等候

- 想

- we

- 卷筒纸

- Web服务

- 井

- 为

- ,尤其是

- 这

- 而

- 全

- 谁的

- 将

- 中

- 也完全不需要

- 工作

- 工人

- 工人

- 工作流程

- 工作流程

- 加工

- 合作

- 将

- 写

- 书面

- 年

- 完全

- 您一站式解决方案

- 和风网