在当今的信息时代,无数文档中包含的大量数据对企业来说既是挑战也是机遇。 传统的文档处理方法往往在效率和准确性方面存在不足,为创新、成本效益和优化留下了空间。 随着智能文档处理 (IDP) 的出现,文档处理取得了显着进步。 借助 IDP,企业可以将各种文档类型的非结构化数据转换为结构化、可操作的见解,从而显着提高效率并减少人工工作。 然而,潜力并不止于此。 通过将生成人工智能(AI)集成到流程中,我们可以进一步增强IDP能力。 生成式人工智能不仅引入了文档处理方面的增强功能,还引入了对不断变化的数据模式的动态适应性。 这篇文章将带您了解 IDP 和生成式 AI 的协同作用,揭示它们如何代表文档处理的下一个前沿领域。

我们在使用 AWS AI 服务进行智能文档处理系列中详细讨论了 IDP(部分1 和 部分2)。 在这篇文章中,我们讨论如何使用大型语言模型 (LLM) 扩展新的或现有的 IDP 架构。 更具体地说,我们讨论如何整合 亚马逊Textract 浪链 作为文档加载器和 亚马逊基岩 从文档中提取数据并在各个 IDP 阶段中使用生成式 AI 功能。

Amazon Textract 是一项机器学习 (ML) 服务,可自动从扫描文档中提取文本、手写内容和数据。 Amazon Bedrock 是一项完全托管的服务,通过易于使用的 API 提供高性能基础模型 (FM) 的选择。

下图是一个高级参考架构,解释了如何使用基础模型进一步增强 IDP 工作流程。 您可以根据用例和期望的结果在 IDP 的一个或所有阶段使用法学硕士。

在以下部分中,我们将深入探讨如何使用 LangChain 将 Amazon Textract 集成到生成式 AI 工作流程中,以处理每个特定任务的文档。 为简洁起见,此处提供的代码块已被精简。 请参阅我们的 GitHub存储库 详细的 Python 笔记本和分步演练。

在使用法学硕士处理文档时,从文档中提取文本是一个至关重要的方面。 您可以使用 Amazon Textract 从文档中提取非结构化原始文本,并保留文档中存在的原始半结构化或结构化对象,例如键值对和表格。 医疗保健和保险索赔或抵押贷款等文档包由复杂的表单组成,其中包含结构化、半结构化和非结构化格式的大量信息。 文档提取是这里的一个重要步骤,因为法学硕士受益于丰富的内容,可以生成更准确和相关的响应,否则可能会影响法学硕士输出的质量。

LangChain 是一个强大的开源框架,用于与法学硕士集成。 一般来说,法学硕士是多才多艺的,但可能会在需要更深入的背景和细致入微的反应的特定领域任务中遇到困难。 LangChain使开发人员能够在此类场景中构建能够将复杂任务分解为更小的子任务的代理。 然后,子任务可以通过连接和链接 LLM 提示将上下文和记忆引入 LLM。

浪链优惠 文件装载机 可以从文档加载和转换数据。 您可以使用它们将文档构建为法学硕士可以处理的首选格式。 这 AmazonTextractPDFLoader 是一种服务加载器类型的文档加载器,它提供了通过结合使用 Amazon Textract 和 LangChain 来自动化文档处理的快速方法。 欲了解更多详情 AmazonTextractPDFLoader,参考 浪链 文档。 要使用 Amazon Textract 文档加载器,您首先需要从 LangChain 库导入它:

from langchain.document_loaders import AmazonTextractPDFLoaderhttps_loader = AmazonTextractPDFLoader("https://sample-website.com/sample-doc.pdf")

https_document = https_loader.load() s3_loader = AmazonTextractPDFLoader("s3://sample-bucket/sample-doc.pdf")

s3_document = s3_loader.load()您还可以将文档存储在 Amazon S3 中并使用 s3:// URL 模式引用它们,如中所述 使用 S3:// 访问存储桶,并将此 S3 路径传递给 Amazon Textract PDF 加载器:

import boto3

textract_client = boto3.client('textract', region_name='us-east-2') file_path = "s3://amazon-textract-public-content/langchain/layout-parser-paper.pdf"

loader = AmazonTextractPDFLoader(file_path, client=textract_client)

documents = loader.load()多页文档将包含多页文本,然后可以通过文档对象(页面列表)访问这些文本。 以下代码循环遍历文档对象中的页面并打印文档文本,该文本可通过 page_content 属性:

print(len(documents)) for document in documents: print(document.page_content)Amazon Comprehend 和 LLM 可以有效地用于文档分类。 Amazon Comprehend 是一项自然语言处理 (NLP) 服务,它使用 ML 从文本中提取见解。 Amazon Comprehend 还支持对 PDF、Word 和图像格式等文档进行布局感知的自定义分类模型训练。 有关使用 Amazon Comprehend 文档分类器的更多信息,请参阅 Amazon Comprehend 文档分类器添加了布局支持以提高准确性.

与法学硕士结合使用时,文档分类成为管理大量文档的强大方法。 法学硕士对于文档分类很有帮助,因为他们可以使用自然语言理解来分析文档中的文本、模式和上下文元素。 您还可以针对特定文档类别对它们进行微调。 当 IDP 管道中引入的新文档类型需要分类时,LLM 可以处理文本并根据给定的一组类对文档进行分类。 以下是使用 Amazon Textract 支持的 LangChain 文档加载器从文档中提取文本并使用它对文档进行分类的示例代码。 我们使用 人类克劳德 v2 通过 Amazon Bedrock 模型来执行分类。

在下面的示例中,我们首先从患者出院报告中提取文本,并使用 LLM 对给定的三种不同文档类型的列表进行分类 -DISCHARGE_SUMMARY, RECEIPT及 PRESCRIPTION。 以下屏幕截图显示了我们的报告。

from langchain.document_loaders import AmazonTextractPDFLoader

from langchain.llms import Bedrock

from langchain.prompts import PromptTemplate

from langchain.chains import LLMChain loader = AmazonTextractPDFLoader("./samples/document.png")

document = loader.load() template = """ Given a list of classes, classify the document into one of these classes. Skip any preamble text and just give the class name. <classes>DISCHARGE_SUMMARY, RECEIPT, PRESCRIPTION</classes>

<document>{doc_text}<document>

<classification>""" prompt = PromptTemplate(template=template, input_variables=["doc_text"])

bedrock_llm = Bedrock(client=bedrock, model_id="anthropic.claude-v2") llm_chain = LLMChain(prompt=prompt, llm=bedrock_llm)

class_name = llm_chain.run(document[0].page_content) print(f"The provided document is = {class_name}")

摘要涉及将给定的文本或文档压缩为较短的版本,同时保留其关键信息。 该技术有利于高效的信息检索,使用户无需阅读整个内容即可快速掌握文档的要点。 尽管 Amazon Textract 不直接执行文本摘要,但它提供了从文档中提取整个文本的基本功能。 提取的文本将作为我们的 LLM 模型的输入,用于执行文本摘要任务。

使用相同的排放报告样本,我们使用 AmazonTextractPDFLoader 从此文档中提取文本。 和以前一样,我们通过 Amazon Bedrock 使用 Claude v2 模型,并使用提示对其进行初始化,其中包含有关如何处理文本的说明(在本例中为摘要)。 最后,我们通过传入从文档加载器中提取的文本来运行 LLM 链。 这会在 LLM 上运行推理操作,提示包含要总结的说明以及标记为的文档文本 Document。 请参见以下代码:

该代码生成患者出院总结报告的摘要:

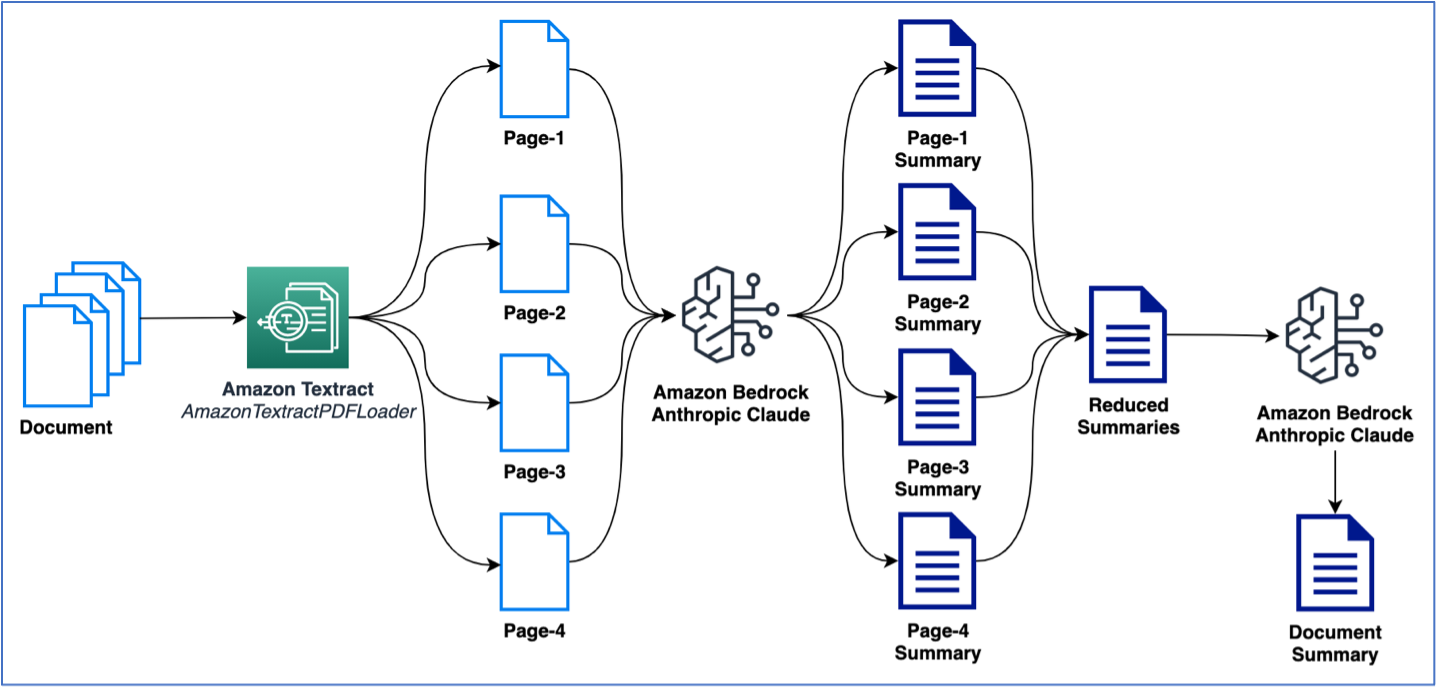

前面的示例使用单页文档来执行摘要。 但是,您可能会处理包含需要摘要的多个页面的文档。 在多个页面上执行摘要的常见方法是首先对较小的文本块生成摘要,然后组合较小的摘要以获得文档的最终摘要。 请注意,此方法需要多次调用 LLM。 其逻辑很容易设计; 然而,LangChain提供了一个内置的摘要链,可以摘要大文本(来自多页文档)。 总结可以通过以下方式进行 map_reduce 或 stuff 选项,可用作管理对 LLM 的多次调用的选项。 在下面的例子中,我们使用 map_reduce 总结多页文档。 下图说明了我们的工作流程。

我们首先从提取文档开始,查看每页的总令牌数和总页数:

接下来我们使用LangChain内置的 load_summarize_chain 总结整个文档:

from langchain.chains.summarize import load_summarize_chain summary_chain = load_summarize_chain(llm=bedrock_llm, chain_type='map_reduce')

output = summary_chain.run(document)

print(output.strip())标准化和问答

在本节中,我们讨论标准化和问答任务。

标准化

输出标准化是一项文本生成任务,其中 LLM 用于提供输出文本的一致格式。 此任务对于要求输出与所需格式一致的关键实体提取的自动化特别有用。 例如,我们可以遵循及时的工程最佳实践来微调LLM,将日期格式化为MM/DD/YYYY格式,这可能与数据库DATE列兼容。 以下代码块显示了如何使用 LLM 和提示工程来完成此操作的示例。 我们不仅标准化了日期值的输出格式,还提示模型以 JSON 格式生成最终输出,以便在下游应用程序中轻松使用。 我们用 浪链表达语言 (LCEL) 将两个动作链接在一起。 第一个操作提示 LLM 生成仅包含文档日期的 JSON 格式输出。 第二个操作采用 JSON 输出并标准化日期格式。 请注意,这两个步骤的操作也可以通过适当的提示工程在一个步骤中执行,正如我们将在规范化和模板化中看到的那样。

上述代码示例的输出是一个 JSON 结构,日期为 07/09/2020 和 08/09/2020,格式为 DD/MM/YYYY,分别是患者的入院日期和出院日期。到出院总结报告。

检索增强生成的问答

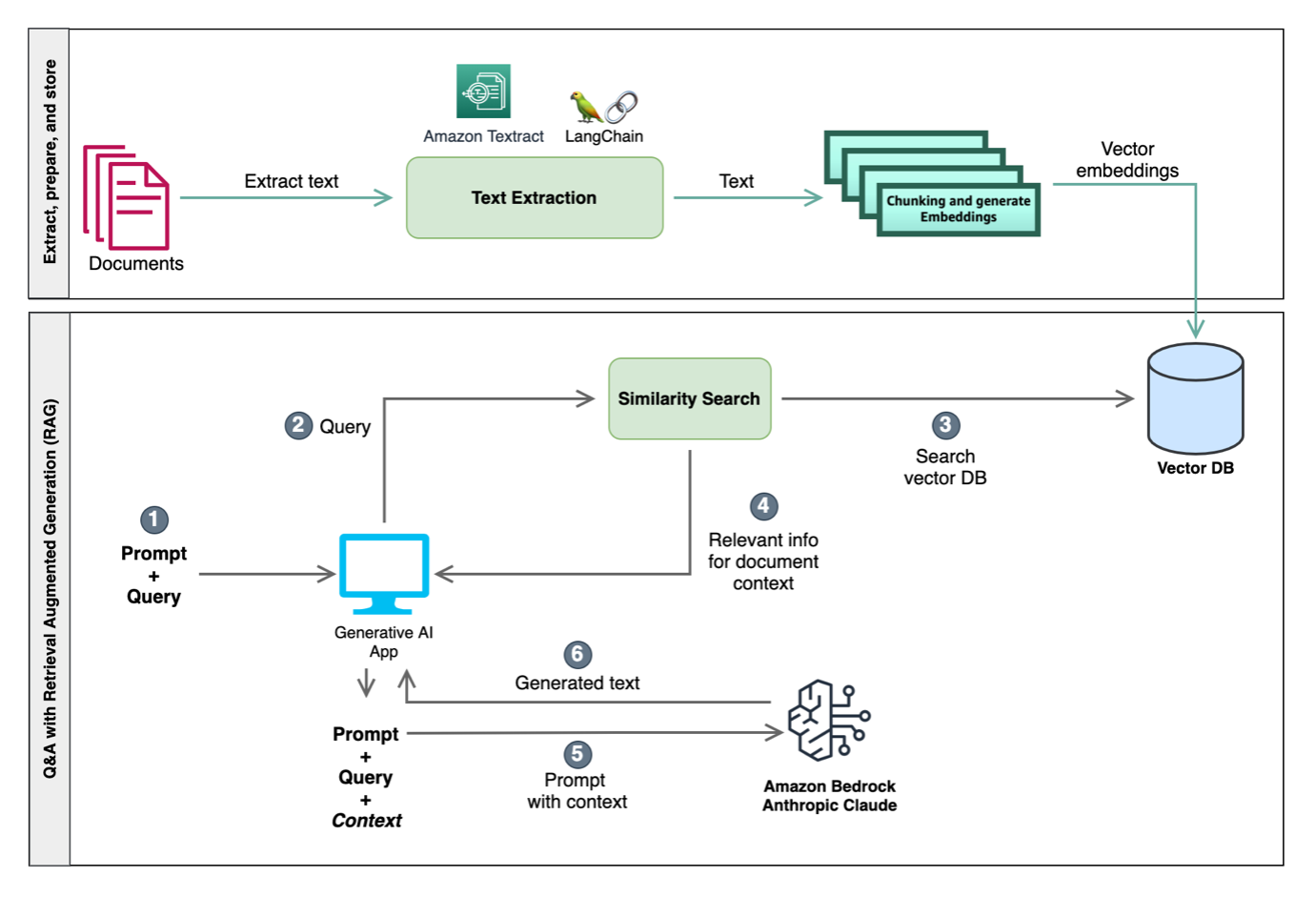

众所周知,法学硕士能够保留事实信息,通常被称为他们的世界知识或世界观。 经过微调后,它们可以产生最先进的结果。 然而,法学硕士如何有效地获取和运用这些知识存在一些限制。 因此,在严重依赖特定知识的任务中,它们的性能对于某些用例可能不是最佳的。 例如,在问答场景中,模型必须严格遵守文档中提供的上下文,而不能仅依赖其世界知识。 偏离这一点可能会导致虚假陈述、不准确,甚至不正确的反应。 解决这个问题最常用的方法是 检索增强生成 (抹布)。 这种方法协同了检索模型和语言模型的优势,提高了生成响应的精度和质量。

由于内存限制和运行硬件的限制,LLM 也会施加令牌限制。 为了解决这个问题,使用分块等技术将大型文档划分为适合法学硕士令牌限制的较小部分。 另一方面,嵌入在 NLP 中主要用于捕获单词的语义及其在高维空间中与其他单词的关系。 这些嵌入将单词转换为向量,使模型能够有效地处理和理解文本数据。 通过理解单词和短语之间的语义细微差别,嵌入使法学硕士能够生成连贯且上下文相关的输出。 请注意以下关键术语:

- 分块 – 此过程将文档中的大量文本分解为较小的、有意义的文本块。

- 的嵌入 – 这些是每个块的固定维度向量变换,保留来自块的语义信息。 这些嵌入随后被加载到向量数据库中。

- 矢量数据库 – 这是表示单词上下文的单词嵌入或向量的数据库。 它充当知识源,帮助文档处理管道中的 NLP 任务。 这里矢量数据库的好处是,它只允许在文本生成过程中向法学硕士提供必要的上下文,正如我们在下一节中解释的那样。

RAG 在检索阶段利用嵌入的力量来理解和获取相关文档片段。 通过这样做,RAG 可以在法学硕士的令牌限制内工作,确保选择最相关的信息进行生成,从而产生更准确和上下文相关的输出。

下图说明了这些技术的集成,以制作法学硕士的输入,增强他们的上下文理解并实现更相关的上下文响应。 一种方法涉及利用向量数据库和分块进行相似性搜索。 矢量数据库存储表示语义信息的嵌入,并且分块将文本划分为可管理的部分。 利用相似性搜索中的上下文,法学硕士可以运行问答等任务以及分类和丰富等特定领域的操作。

在这篇文章中,我们使用基于 RAG 的方法对文档执行上下文问答。 在以下代码示例中,我们从文档中提取文本,然后将文档拆分为更小的文本块。 需要分块,因为我们可能有大量的多页文档,并且我们的法学硕士可能有令牌限制。 然后将这些块加载到向量数据库中,以便在后续步骤中进行相似性搜索。 在以下示例中,我们使用 Amazon Titan Embed Text v1 模型,该模型执行文档块的矢量嵌入:

该代码使用向量数据库中相似性搜索操作返回的文本块为法学硕士创建相关上下文。 对于这个例子,我们使用一个开源的 FAISS矢量商店 作为示例向量数据库来存储每个文本块的向量嵌入。 然后我们将向量数据库定义为 LangChain 寻回犬,它被传递到 RetrievalQA 链。 这会在向量数据库上内部运行相似性搜索查询,返回与问题相关的前 n 个(在我们的示例中 n=3)文本块。 最后,LLM 链使用相关上下文(一组相关的文本块)和 LLM 需要回答的问题来运行。 有关 RAG 问答的分步代码演练,请参阅 Python 笔记本 GitHub上.

作为 FAISS 的替代方案,您还可以使用 Amazon OpenSearch Service 矢量数据库功能, 适用于 PostgreSQL 的 Amazon 关系数据库服务 (Amazon RDS) 与 PG向量 扩展为矢量数据库或开源 Chroma 数据库。

表格数据问答

由于其结构复杂性,文档中的表格数据对于法学硕士来说处理起来可能具有挑战性。 Amazon Textract 可以通过 LLM 进行增强,因为它能够以页面、表格和单元格等元素的嵌套格式从文档中提取表格。 使用表格数据执行问答是一个多步骤的过程,可以通过以下方式实现 自问。 以下是步骤概述:

- 使用 Amazon Textract 从文档中提取表格。 使用 Amazon Textract,可以从文档中提取表格结构(行、列、标题)。

- 将表格数据与元数据信息(例如标题名称和每个标题的描述)一起存储到矢量数据库中。

- 使用 LLM 根据提示构建结构化查询,以从表中导出数据。

- 使用查询从向量数据库中提取相关表数据。

例如,在银行对账单中,给出提示“存款超过 1000 美元的交易是什么”,LLM 将完成以下步骤:

- 设计一个查询,例如

“Query: transactions” , “filter: greater than (Deposit$)”. - 将查询转换为结构化查询。

- 将结构化查询应用于存储表数据的矢量数据库。

有关表格问答的分步示例代码演练,请参阅中的 Python 笔记本 GitHub上.

模板化和规范化

在本节中,我们将了解如何使用即时工程技术和 LangChain 的内置机制来从指定模式的文档中提取内容来生成输出。 我们还使用前面讨论的技术对提取的数据进行一些标准化。 我们首先为所需的输出定义一个模板。 这将用作模式并封装我们想要从文档文本中提取的每个实体的详细信息。

请注意,对于每个实体,我们使用描述来解释该实体是什么,以帮助法学硕士从文档文本中提取值。 在下面的示例代码中,我们使用此模板来制作 LLM 的提示以及使用从文档中提取的文本 AmazonTextractPDFLoader 然后用模型进行推理:

正如你所看到的, {keys} 提示的一部分是我们模板中的键,并且 {details} 是按键及其描述。 在这种情况下,除了在指令中指定生成 JSON 格式的输出之外,我们不会显式提示模型输出的格式。 这在大多数情况下都有效; 但是,由于 LLM 的输出是不确定的文本生成,因此我们希望将格式明确指定为提示中指令的一部分。 为了解决这个问题,我们可以使用LangChain的 结构化输出解析器 模块利用自动提示工程,帮助将我们的模板转换为格式指令提示。 我们使用前面定义的模板来生成格式指令提示,如下:

然后,我们在原始提示中使用此变量作为 LLM 的指令,以便通过对提示进行小修改来提取所需模式中的输出并格式化输出:

到目前为止,我们仅以所需的模式从文档中提取了数据。 但是,我们仍然需要进行一些标准化。 例如,我们希望以 DD/MM/YYYY 格式提取患者的入院日期和出院日期。 在这种情况下,我们增加 description 带有格式化指令的密钥:

请参阅 Python 笔记本 GitHub上 完整的分步演练和解释。

拼写检查和更正

法学硕士在理解和生成类人文本方面表现出了非凡的能力。 法学硕士较少被讨论但非常有用的应用之一是它们在文档中的语法检查和句子纠正方面的潜力。 与依赖一组预定义规则的传统语法检查器不同,法学硕士使用从大量文本数据中识别出的模式来确定什么构成正确或流畅的语言。 这意味着他们可以检测基于规则的系统可能错过的细微差别、上下文和微妙之处。

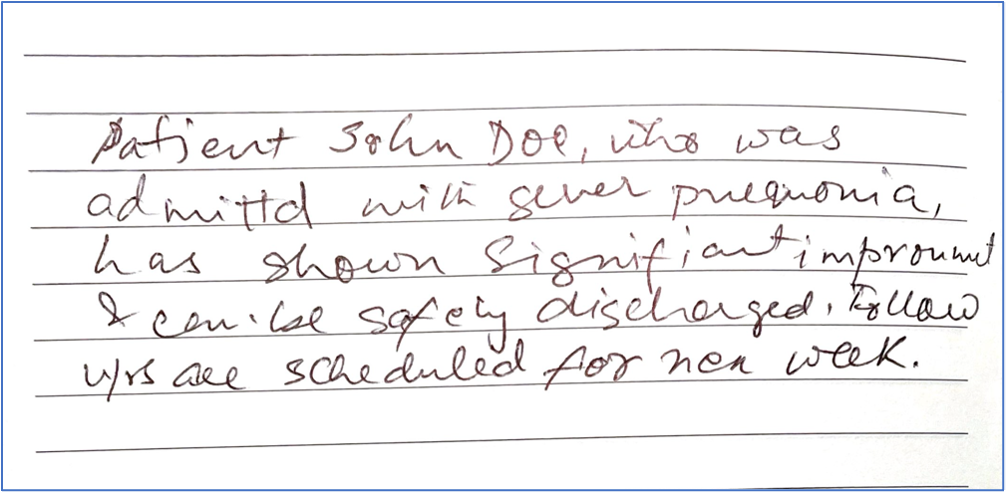

想象一下从患者出院摘要中提取的文本,内容如下:“因严重肺炎入院的患者乔恩·多伊(Jon Doe)已表现出显着改善,可以安全出院。 后续行动定于下周进行。” 传统的拼写检查器可能会将“admittd”、“pneumonia”、“improvement”和“nex”识别为错误。 然而,这些错误的上下文可能会导致进一步的错误或一般性建议。 经过广泛培训的法学硕士可能会建议:“因严重肺炎入院的患者约翰·多伊(John Doe)已表现出显着改善,可以安全出院。 后续行动定于下周进行。”

以下是一份手写不佳的示例文档,其文本与前面所解释的相同。

我们使用 Amazon Textract 文档加载器提取文档,然后通过提示工程指示 LLM 纠正提取的文本以纠正任何拼写和/或语法错误:

上述代码的输出显示了文档加载器提取的原始文本,后面是 LLM 生成的更正文本:

请记住,尽管法学硕士很强大,但必须将他们的建议仅仅视为建议。 尽管它们很好地捕捉了语言的复杂性,但它们也并非绝对正确。 有些建议可能会改变原文的意图或语气。 因此,对于人工审稿人来说,使用 LLM 生成的更正作为指导而不是绝对至关重要。 人类直觉与法学硕士能力的协作预示着未来我们的书面交流不仅没有错误,而且更加丰富和细致。

结论

生成式 AI 正在改变您使用 IDP 处理文档以获取见解的方式。 在文中 利用生成式 AI 增强 AWS 智能文档处理中,我们讨论了管道的各个阶段以及 AWS 客户理光如何通过法学硕士增强其 IDP 管道。 在这篇文章中,我们讨论了通过 Amazon Bedrock、Amazon Textract 和流行的 LangChain 框架使用 LLM 增强 IDP 工作流程的各种机制。 您可以立即使用我们的 LangChain 中提供的示例笔记本开始使用新的 Amazon Textract 文档加载器 GitHub存储库。 有关在 AWS 上使用生成式 AI 的更多信息,请参阅 宣布推出用于在 AWS 上使用生成式 AI 进行构建的新工具.

作者简介

索纳利萨胡 与 AWS 的 AI/ML 服务团队一起领导智能文档处理。 她是一位作家、思想领袖和充满热情的技术专家。 她的核心关注领域是人工智能和机器学习,她经常在世界各地的人工智能和机器学习会议和聚会上发表演讲。 她在技术和技术行业拥有广泛而深入的经验,在医疗保健、金融部门和保险领域拥有行业专业知识。

索纳利萨胡 与 AWS 的 AI/ML 服务团队一起领导智能文档处理。 她是一位作家、思想领袖和充满热情的技术专家。 她的核心关注领域是人工智能和机器学习,她经常在世界各地的人工智能和机器学习会议和聚会上发表演讲。 她在技术和技术行业拥有广泛而深入的经验,在医疗保健、金融部门和保险领域拥有行业专业知识。

安扬·比斯瓦斯 是一名高级 AI 服务解决方案架构师,专注于 AI/ML 和数据分析。 Anjan 是全球 AI 服务团队的一员,与客户合作,帮助他们理解和开发 AI 和 ML 业务问题的解决方案。 Anjan 拥有超过 14 年的与全球供应链、制造和零售组织合作的经验,并积极帮助客户开始使用 AWS AI 服务并进行扩展。

安扬·比斯瓦斯 是一名高级 AI 服务解决方案架构师,专注于 AI/ML 和数据分析。 Anjan 是全球 AI 服务团队的一员,与客户合作,帮助他们理解和开发 AI 和 ML 业务问题的解决方案。 Anjan 拥有超过 14 年的与全球供应链、制造和零售组织合作的经验,并积极帮助客户开始使用 AWS AI 服务并进行扩展。

钦马伊兰 是 Amazon Web Services 的 AI/ML 专家解决方案架构师。 她热衷于应用数学和机器学习。 她专注于为 AWS 客户设计智能文档处理和生成式 AI 解决方案。 工作之余,她喜欢萨尔萨舞和巴恰塔舞。

钦马伊兰 是 Amazon Web Services 的 AI/ML 专家解决方案架构师。 她热衷于应用数学和机器学习。 她专注于为 AWS 客户设计智能文档处理和生成式 AI 解决方案。 工作之余,她喜欢萨尔萨舞和巴恰塔舞。

- SEO 支持的内容和 PR 分发。 今天得到放大。

- PlatoData.Network 垂直生成人工智能。 赋予自己力量。 访问这里。

- 柏拉图爱流。 Web3 智能。 知识放大。 访问这里。

- 柏拉图ESG。 碳, 清洁科技, 能源, 环境, 太阳能, 废物管理。 访问这里。

- 柏拉图健康。 生物技术和临床试验情报。 访问这里。

- Sumber: https://aws.amazon.com/blogs/machine-learning/intelligent-document-processing-with-amazon-textract-amazon-bedrock-and-langchain/

- :具有

- :是

- :不是

- :在哪里

- .nex

- $1000

- $UP

- 1

- 10

- 100

- 11

- 12

- 13

- 14

- 15%

- 16

- 22

- 23

- 33

- 35%

- 7

- 9

- a

- 能力

- 关于

- 绝对

- ACCESS

- 访问

- 根据

- 精准的

- 实现

- 横过

- 操作

- 行动

- 积极地

- 活动

- 行为

- Ad

- 地址

- 添加

- 坚持

- 承认

- 承认

- 进步

- 优点

- 来临

- 年龄

- 中介代理

- AI

- 人工智能服务

- AI / ML

- 对齐的

- 所有类型

- 允许

- 允许

- 沿

- 还

- 替代

- 尽管

- Amazon

- 亚马逊领悟

- 亚马逊RDS

- 亚马逊Textract

- 亚马逊网络服务

- 量

- an

- 分析

- 分析

- 和

- 回答

- 人类的

- 任何

- APIs

- 应用领域

- 应用的

- 约会

- 的途径

- 架构

- 保健

- 国家 / 地区

- 围绕

- 艺术

- 人造的

- 人工智能

- 人工智能(AI)

- AS

- 方面

- 协助

- 助理

- At

- 增加

- 增强

- 作者

- 自动化

- 自动化

- 自动

- 自动化和干细胞工程

- 可使用

- 意识

- AWS

- AWS 客户

- 银行

- BE

- 因为

- 成为

- 很

- before

- 有利

- 得益

- 最佳

- 最佳实践

- 之间

- 阻止

- 吹氣梢

- 都

- 宽度

- 午休

- 休息

- 建立

- 建筑物

- 内建的

- 商业

- 企业

- 但是

- by

- 呼叫

- CAN

- 可以得到

- 能力

- 捕获

- 案件

- 例

- 细胞

- 一定

- 链

- 链

- 挑战

- 挑战

- 更改

- 更改

- 改变

- 支票

- 选择

- 索赔

- 程

- 类

- 分类

- 分类

- 码

- 相干

- 合作

- 柱

- 列

- 组合

- 结合

- 购买的订单均

- 相当常见

- 常用

- 沟通

- 兼容

- 完成

- 复杂

- 复杂

- 理解

- 简洁

- 会议

- 连接

- 一贯

- 由

- 约束

- 建设

- 包含

- 包含

- 包含

- 内容

- 上下文

- 上下文

- 兑换

- 核心

- 正确

- 更正

- 矫正

- 可以

- 手艺

- 精雕细琢

- 创建

- 关键

- 习俗

- 顾客

- 合作伙伴

- 跳舞

- data

- 数据分析

- 数据库

- 数据库

- 日期

- 重要日期

- 处理

- 深

- 更深

- 定义

- 定义

- 定义

- 证明

- 根据

- 存款

- 深度

- 描述

- 描述

- 设计

- 期望

- 细节

- 详细

- 详情

- 检测

- 确定

- 开发

- 开发

- 饮食

- 不同

- 直接

- 讨论

- 讨论

- 潜水

- 分

- 分歧

- do

- 医生

- 文件

- 文件

- 文件

- 母鹿

- 不会

- 做

- 不

- 完成

- 别

- 向下

- 显着

- 两

- ,我们将参加

- 动态

- e

- 每

- 此前

- 容易

- 易于使用

- 只

- 效率

- 高效

- 有效

- 工作的影响。

- 或

- 分子

- 嵌

- 就业

- 如虎添翼

- enable

- 使

- 使

- 结束

- 工程师

- 提高

- 增强

- 加强

- 确保

- 保证

- 整个

- 实体

- 实体

- 配备

- 故障

- 必要

- 甚至

- 例子

- 除

- 例外

- 现有

- 体验

- 专门知识

- 说明

- 解释

- 介绍

- 解释

- 明确地

- 表达

- 延长

- 延期

- 广泛

- 提取

- 萃取

- 提取物

- 秋季

- false

- 远

- 疲劳

- 字段

- 数字

- 最后

- 终于

- 金融

- 金融部门

- (名字)

- 适合

- 专注焦点

- 重点

- 遵循

- 其次

- 以下

- 如下

- 针对

- 格式

- 形式

- 发现

- 基金会

- 骨架

- 自由的

- 频繁

- 止

- 边疆

- ,

- 充分

- 进一步

- 未来

- 其他咨询

- 生成

- 产生

- 产生

- 发电

- 代

- 生成的

- 生成式人工智能

- 得到

- 给

- 特定

- 全球

- 语法

- 把握

- 更大的

- 团队

- 指南

- 手

- 处理

- 发生

- 事件

- 硬件

- 有

- 头

- 医疗保健

- 严重

- 帮助

- 有帮助

- 帮助

- 帮助

- 这里

- 相关信息

- 高水平

- 高绩效

- 更高

- 持有

- 医院

- 创新中心

- How To

- 但是

- HTML

- HTTPS

- 人

- i

- ID

- 确定

- if

- 说明

- 图片

- 非常

- 影响力故事

- 进口

- 重要

- 输入

- 征收

- 改进

- in

- 包含

- 指数

- 行业中的应用:

- 信息

- 信息时代

- 創新

- 输入

- 可行的洞见

- 例

- 说明

- 保险

- 整合

- 集成

- 整合

- 积分

- 房源搜索

- 智能化

- 智能文档处理

- 拟

- 内部

- 成

- 错综复杂

- 介绍

- 介绍

- 推出

- IT

- 它的

- 杰克逊

- John

- 约翰DOE

- 乔恩

- JPG

- JSON

- 只是

- 键

- 键

- 知道

- 知识

- 已知

- 语言

- 大

- 布局

- 铅

- 领导者

- 领导

- 学习

- 离开

- 自学资料库

- 喜欢

- 容易

- 限制

- 范围

- 清单

- LLM

- 加载

- 装载机

- 逻辑

- 看

- 占地

- 机

- 机器学习

- 制作

- 管理

- 管理

- 管理

- 管理的

- 手册

- 制造业

- 标

- 数学

- 可能..

- me

- 意

- 有意义的

- 手段

- 机制

- 机制

- 聚会

- 内存

- 元

- 元数据

- 方法

- 方法

- 可能

- 介意

- 错过

- 错误

- ML

- 模型

- 模型

- 模块

- 更多

- 抵押贷款

- 最先进的

- 多

- 姓名

- 名称

- 自然

- 自然语言处理

- 必要

- 需求

- 打印车票

- 需要

- 全新

- 下页

- 下周

- NLP

- 笔记本

- 现在

- 细微之处

- 数

- 对象

- 对象

- of

- 优惠精选

- 经常

- on

- 一

- 仅由

- 开放源码

- 运营

- ZAP优势

- 最佳

- 附加选项

- or

- 组织

- 原版的

- 其他名称

- 除此以外

- 我们的

- 输出

- 成果

- 产量

- 输出

- 学校以外

- 超过

- 简介

- 包

- 页

- 网页

- 面包

- 配对

- 对

- 部分

- 尤其

- 通过

- 通过

- 通过

- 多情

- 径

- 病人

- 模式

- 模式

- 为

- 演出

- 性能

- 执行

- 执行

- 施行

- 相

- 博士学位

- 短语

- 管道

- 计划

- 柏拉图

- 柏拉图数据智能

- 柏拉图数据

- 请

- 肺炎

- 点

- 热门

- 可能

- 帖子

- 潜力

- 功率

- 供电

- 强大

- 做法

- 恰恰

- 平台精度

- 首选

- 当下

- 先前

- 主要

- 打印

- 打印

- 市场问题

- 问题

- 过程

- 处理

- 处理

- 生产

- 承诺

- 正确

- 提供

- 提供

- 提供者

- 提供

- 蟒蛇

- Q&A

- 质量

- 题

- 快速

- 很快

- 原

- 阅读

- 承认

- 减少

- 参考

- 参考

- 简称

- 关系

- 相应

- 依靠

- 依托

- 卓越

- 报告

- 代表

- 代表

- 必须

- 需要

- 分别

- 回复

- 限制

- 导致

- 导致

- 成果

- 零售

- 保留

- 护

- 回报

- 丰富

- Room

- 定位、竞价/采购和分析/优化数字媒体采购,但算法只不过是解决问题的操作和规则。

- 运行

- 运行

- s

- 安然

- 同

- 对工资盗窃

- 鳞片

- 情景

- 预定

- 搜索

- 其次

- 部分

- 部分

- 扇形

- 看到

- 中模板

- 选

- 前辈

- 句子

- 系列

- 服务

- 服务

- 服务

- 特色服务

- 集

- 严重

- 她

- 短

- 应该

- 如图

- 作品

- 显著

- 单

- 小

- 小

- 片段

- So

- 独自

- 解决方案

- 解决

- 一些

- 来源

- 太空

- 说

- 专家

- 具体的

- 特别是

- 指定

- 拼字

- 分裂

- 实习

- 标准化

- 开始

- 开始

- 国家的最先进的

- 个人陈述

- 步

- 步骤

- 仍

- 商店

- 存储

- 商店

- 优势

- 串

- 结构

- 结构体

- 结构化

- 奋斗

- 随后

- 后来

- 这样

- 建议

- 总结

- 概要

- 供应

- 供应链

- SUPPORT

- 支持

- 协同

- 产品

- 表

- 采取

- 需要

- 任务

- 任务

- 团队

- 技术

- 技术

- 技术专家

- 专业技术

- 模板

- 条款

- 文本

- 文字的

- 比

- 这

- 世界

- 其

- 他们

- 然后

- 那里。

- 因此

- 博曼

- 他们

- Free Introduction

- 思想

- 三

- 通过

- 泰坦

- 至

- 今晚

- 今天的

- 一起

- 象征

- 令牌

- TONE

- 工具

- 最佳

- 合计

- 传统

- 尾随

- 产品培训

- 交易

- 改造

- 转换

- true

- 尝试

- 二

- 类型

- 类型

- 理解

- 理解

- 不像

- 揭幕

- 网址

- 使用

- 用例

- 用过的

- 用户

- 使用

- 运用

- 利用

- 利用

- v1

- 折扣值

- 价值观

- 变量

- 各个

- 广阔

- 多才多艺

- 版本

- 通过

- 查看

- 卷

- 演练

- 想

- 是

- 方法..

- we

- 卷筒纸

- Web服务

- 周

- 井

- 什么是

- ,尤其是

- 这

- 而

- WHO

- 将

- 中

- 也完全不需要

- 目击

- Word

- 话

- 工作

- 工作流程

- 工作流程

- 加工

- 合作

- 世界

- 将

- 书面

- X

- 年

- 完全

- 和风网