什么是文件处理?

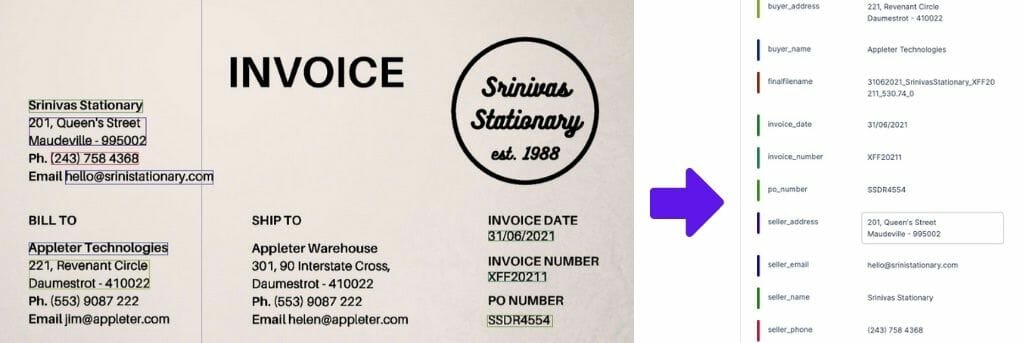

文档处理是从文档中自动提取结构化数据的过程。这可以适用于任何文档,例如发票、简历、身份证等。这里的挑战性部分不仅仅是 OCR。有许多低成本的选项可以提取文本并为您提供位置。真正的挑战是准确、自动地标记这些文本片段。

文档处理的业务影响

一些行业的日常运营严重依赖文档处理。金融组织需要访问 SEC 文件、保险文件,电子商务或供应链公司可能需要访问正在使用的发票,这样的例子不胜枚举。这些信息的准确性与节省时间一样重要,这就是为什么我们总是建议使用概括性更强、更准确的高级深度学习方法。

根据普华永道的这份报告,[链接] 即使是最基本的结构化数据提取也可以帮助员工节省 30-50% 的员工时间,这些时间花在手动将数据从 PDF 复制和粘贴到 Excel 电子表格上。像 LayoutLM 这样的模型当然不是初级的,它们已经被构建为极其智能的代理,能够跨不同的用例大规模准确地提取数据。即使对于我们自己的许多客户,我们也已将手动提取数据所需的时间从每个文档 20 分钟缩短到 10 秒以下。这是一个巨大的转变,使工人能够提高工作效率,并提高总体吞吐量。

那么类似LayoutLM的AI可以应用在哪里呢?在 Nanonets,我们已将此类技术用于

以及许多其他用例。

为什么选择 LayoutLM?

深度学习模型如何理解给定的文本是发票中的项目描述还是发票编号?简而言之,模型如何学习如何正确分配标签?

一种方法是使用来自大规模语言模型(如 BERT 或 GPT-3)的文本嵌入,并通过分类器运行它 - 尽管这不是很有效。有很多信息无法仅通过文本来衡量。或者,可以利用基于图像的信息。这是通过使用 R-CNN 和 Faster R-CNN 模型实现的。然而,这仍然没有充分利用文档中提供的信息。使用的另一种方法是图卷积神经网络,它结合了位置和文本信息,但没有考虑图像信息。

那么我们如何使用所有三个维度的信息,即文本、图像以及给定文本的位置?这就是像 LayoutLM 这样的模型的用武之地。尽管 LayoutLM 多年来一直是一个活跃的研究领域,但它是第一个成功地将各个部分组合起来创建单一模型的模型之一,该模型使用位置信息、基于文本的信息、还有图像信息。

LayoutLM 教程

本文假设您了解什么是语言模型。如果没有,别担心, 我们也就此写了一篇文章! 如果您想了解更多关于 Transformer 模型是什么以及注意事项是什么,请点击这里 是 Jay Alammar 撰写的一篇精彩文章.

假设我们已经解决了这些问题,让我们开始本教程。我们将使用原始的 LayoutLM 论文作为主要参考。

OCR文本提取

我们对文档所做的第一件事是从文档中提取基于文本的信息,并找到它们各自的位置。对于位置,我们指的是“边界框”。边界框是一个封装页面上文本片段的矩形。

在大多数情况下,假设边界框的原点位于左上角,正 x 轴从原点指向页面右侧,正 y 轴从原点指向页面右侧。页面底部,以一个像素为测量单位。

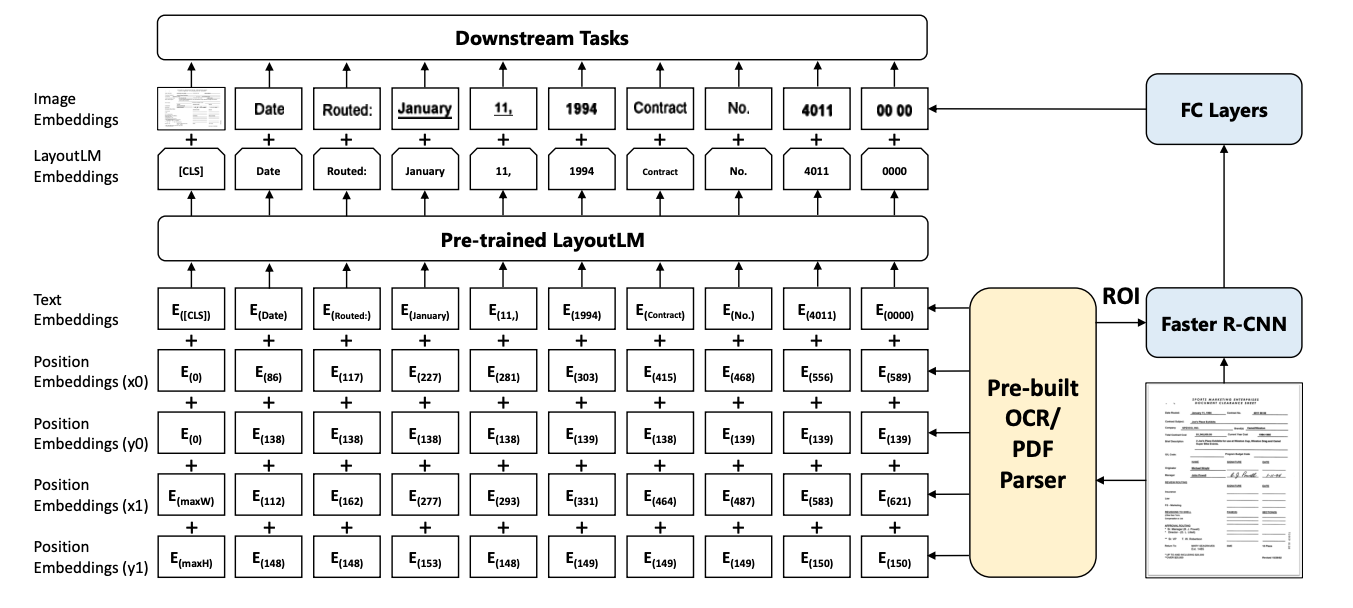

语言和位置嵌入

接下来,我们使用五个不同的嵌入层。一是对语言相关信息进行编码——即文本嵌入。

其他四个保留用于位置嵌入。假设我们知道 xmin、ymin、xmax 和 ymax 的值,我们可以确定整个边界框 (如果你无法想象它, 这是给你的链接). 这些坐标通过各自的嵌入层来编码位置信息。

然后将五个嵌入(一个用于文本,四个用于坐标)相加,以创建通过 LayoutLM 传递的嵌入的最终值。输出称为 LayoutLM 嵌入。

图像嵌入

好的,我们已经通过组合嵌入并将其传递到语言模型来设法找到文本和位置相关信息。现在我们如何解决在其中组合图像相关信息的过程呢?

在对文本和布局信息进行并行编码的同时,我们使用 Faster R-CNN 提取与文档相关的文本区域。 Faster R-CNN 是一种用于目标检测的图像模型。在我们的例子中,我们使用它来检测不同的文本片段(假设每个短语都是一个对象),然后将分割的图像传递到完全连接的层,以帮助生成图像的嵌入。

LayoutLM 嵌入以及图像嵌入相结合以创建最终嵌入,然后可用于执行下游处理。

预训练LayoutLM

只有当我们了解 LayoutLM 的训练方法时,上述所有内容才有意义。毕竟,无论我们在神经网络中建立什么样的连接,除非以正确的学习目标进行训练,否则它都不是很聪明。 LayoutLM 的作者想要寻求一种类似于预训练 BERT 所使用的方法。

屏蔽视觉语言模型 (MVLM)

为了帮助模型了解某个位置可能存在哪些文本,作者随机屏蔽了一些文本标记,同时保留位置相关信息和嵌入。这使得 LayoutLM 能够超越简单的掩码语言建模,并帮助将文本嵌入与位置相关的模式关联起来。

多标签文档分类 (MDC)

使用文档中的所有信息将其分类有助于模型了解哪些信息与特定类别的文档相关。然而,作者指出,对于较大的数据集,文档类的数据可能不容易获得。因此,他们提供了单独 MVLM 训练和 MVLM + MDC 训练的结果基础。

针对下游任务微调 LayoutLM

有几个下游任务可以使用 LayoutLM 执行。我们将讨论作者所做的那些。

形式理解

此任务需要将标签类型链接到给定的文本片段。使用它,我们可以从任何类型的文档中提取结构化数据。给定最终输出,即 LayouLM 嵌入 + 图像嵌入,它们将通过全连接层,然后通过 softmax 来预测给定文本片段的标签的类概率。

收据理解

在此任务中,收据上的多个信息槽留空,模型必须将文本片段正确放置到各自的槽中。

文档图像分类

将来自文档文本和图像的信息组合起来,只需将其传递到 softmax 层即可帮助理解文档的类别。

拥抱脸布局LM

LayoutLM 受到如此多讨论的主要原因之一是该模型不久前开源了。这是 可以在拥抱脸上找到,因此现在使用 LayoutLM 变得更加容易。

在我们深入了解如何根据自己的需求微调 LayoutLM 的细节之前,有一些事情需要考虑。

安装库

要运行 LayoutLM,您将需要 Hugging Face 中的转换器库,而该库又依赖于 PyTorch 库。要安装它们(如果尚未安装),请运行以下命令

在边界框上

为了创建统一的嵌入方案(无论图像大小如何),边界框坐标均按 1000 的比例进行归一化

配置

使用 Transformers.LayoutLMConfig 类,您可以设置模型的大小以最适合您的要求,因为这些模型通常很重并且需要相当多的计算能力。将其设置为较小的模型可能会帮助您在本地运行它。你可以 在这里了解有关该课程的更多信息.

用于文档分类的 LayoutLM (链接)

如果要执行文档分类,则需要类 Transformers.LayoutLMForSequenceClassification。这里的序列是您从文档中提取的文本序列。这是 Hugging Face.co 的一个小代码示例,它将解释如何使用它

用于文本标签的 LayoutLM (链接)

要执行语义标记,即为文档中文本的不同部分分配标签,您将需要类 Transformers.LayoutLMForTokenClassification。您可能会找到更多详细信息 同样在这里.这是一个小代码示例,您可以了解它如何为您工作

Hugging Face LayoutLM 的一些注意点

- 目前Hugging Face LayoutLM模型利用Tesseract开源库进行文本提取,精度不太高。您可能需要考虑使用不同的付费 OCR 工具,例如 AWS Textract 或 Google Cloud Vision

- 现有模型仅提供语言模型,即LayoutLM嵌入,而不提供结合视觉特征的最终层。布局LMv2 (下一节讨论)也使用 Detectron 库来启用视觉特征嵌入。

- 标签的分类发生在单词级别,因此实际上由 OCR 文本提取引擎来确保字段中的所有单词都处于连续序列中,否则一个字段可能会被预测为两个字段。

布局LMv2

LayoutLM 的出现是一场从文档中提取数据方式的革命。然而,就深度学习研究而言,模型只会随着时间的推移而不断改进。 LayoutLMv2 类似地继承了 LayoutLM,其中作者对模型的训练方式进行了一些重大更改。

包括一维空间嵌入和视觉令牌嵌入

LayoutLMv2 包含有关一维相对位置的信息以及整体图像相关信息。这之所以重要是因为我们现在将讨论新的培训目标

新的培训目标

LayoutLMv2 包括一些修改的训练目标。具体如下:

- 屏蔽视觉语言建模:这与 LayoutLM 中的相同

- 文本图像对齐:文本从图像中随机覆盖,而文本标记则提供给模型。对于每个标记,模型必须了解给定文本是否被覆盖。通过这一点,该模型能够结合视觉和文本模式的信息

- 文本图像匹配:要求模型检查给定图像是否对应于给定文本。负样本要么作为虚假图像提供,要么根本不提供图像嵌入。这样做是为了确保模型更多地了解文本和图像的关联方式。

使用这些新方法和嵌入,该模型能够在几乎所有测试数据集上与 LayoutLM 一样获得更高的 F1 分数。

- 关于

- ACCESS

- 账号管理

- 精准的

- 实现

- 横过

- 要积极。

- 高级

- 中介代理

- AI

- 所有类型

- 已经

- 尽管

- 量

- 另一个

- 的途径

- 国家 / 地区

- 围绕

- 刊文

- 作者

- 可使用

- AWS

- 基础

- 作为

- 最佳

- 位

- 盒子

- 牌

- 例

- 挑战

- 分类

- 云端技术

- 码

- 结合

- 公司

- 计算

- 配置

- 连接

- 考虑

- 成本

- 可以

- 合作伙伴

- data

- 天

- 尽管

- 检测

- DID

- 不同

- 文件

- 向下

- 电子商务行业

- 有效

- 使

- 建立

- Excel

- 面部彩妆

- 快

- 专栏

- 特征

- 美联储

- 金融

- 姓氏:

- 以下

- 生成

- GitHub上

- 谷歌

- 帮助

- 帮助

- 此处

- 创新中心

- How To

- HTTPS

- 图片

- 影响力故事

- 重要

- 改善

- 包括

- 行业

- 信息

- 保险

- 智能化

- IT

- 标签

- 标签

- 语言

- 大

- 学习用品

- 学习

- Level

- 自学资料库

- 友情链接

- 清单

- 当地

- 圖書分館的位置

- 地点

- 手动

- 大规模

- 匹配

- 问题

- 模型

- 模型

- 最先进的

- 网络

- 网络

- 打开

- 开放源码

- 运营

- 附加选项

- 秩序

- 组织

- 其他名称

- 支付

- 纸类

- 片

- 功率

- 过程

- 提供

- 普华永道

- 原因

- 建议

- 报告

- 必须

- 岗位要求

- 研究

- 成果

- 简历

- 运行

- 鳞片

- 方案

- 证券交易委员会

- 感

- 集

- 设置

- 转移

- 显著

- 类似

- 简易

- 尺寸

- 小

- 智能

- So

- 东西

- 开始

- 成功

- 供应

- 供应链

- 任务

- 专业技术

- test

- 通过

- 次

- 象征

- 令牌

- 最佳

- 产品培训

- 理解

- 使用

- 利用

- 折扣值

- 什么是

- 是否

- 话

- 工作

- 工人

- 年