生成式 AI 工作负载最有用的应用模式之一是检索增强生成 (RAG)。在 RAG 模式中,我们通过对嵌入执行相似性搜索来查找与输入提示相关的参考内容。嵌入捕获文本正文中的信息内容,允许自然语言处理 (NLP) 模型以数字形式处理语言。嵌入只是浮点数的向量,因此我们可以分析它们以帮助回答三个重要问题:我们的参考数据是否随时间变化?用户提出的问题是否随着时间的推移而改变?最后,我们的参考数据在多大程度上涵盖了所提出的问题?

在这篇文章中,您将了解嵌入矢量分析和检测嵌入漂移信号的一些注意事项。由于嵌入是一般 NLP 模型(特别是生成式 AI 解决方案)的重要数据源,因此我们需要一种方法来衡量嵌入是否随时间变化(漂移)。在这篇文章中,您将看到一个使用集群技术对嵌入向量执行漂移检测的示例,其中大型语言模型 (LLMS) 部署于 亚马逊SageMaker JumpStart。您还可以通过提供的两个示例来探索这些概念,包括端到端示例应用程序或应用程序的子集(可选)。

RAG概述

RAG图案 让您可以从外部来源(例如 PDF 文档、wiki 文章或通话记录)检索知识,然后使用该知识来增强发送给法学硕士的说明提示。这使得法学硕士可以在生成回复时参考更多相关信息。例如,如果您询问法学硕士如何制作巧克力饼干,它可以包含您自己的食谱库中的信息。在此模式中,使用嵌入模型将菜谱文本转换为嵌入向量,并存储在向量数据库中。传入的问题被转换为嵌入,然后向量数据库运行相似性搜索来查找相关内容。然后问题和参考数据进入法学硕士的提示。

让我们仔细看看创建的嵌入向量以及如何对这些向量执行漂移分析。

嵌入向量分析

嵌入向量是我们数据的数字表示,因此对这些向量的分析可以深入了解我们的参考数据,这些数据稍后可用于检测潜在的漂移信号。嵌入向量表示 n 维空间中的项目,其中 n 通常很大。例如,本文中使用的 GPT-J 6B 模型创建大小为 4096 的向量。为了测量漂移,假设我们的应用程序捕获参考数据和传入提示的嵌入向量。

我们首先使用主成分分析 (PCA) 执行降维。 PCA 尝试减少维数,同时保留数据中的大部分方差。在这种情况下,我们尝试找到保留 95% 方差的维数,这应该捕获两个标准差内的任何内容。

然后我们使用 K-Means 来识别一组聚类中心。 K-Means 尝试将点组合成簇,使得每个簇相对紧凑,并且簇之间的距离尽可能远。

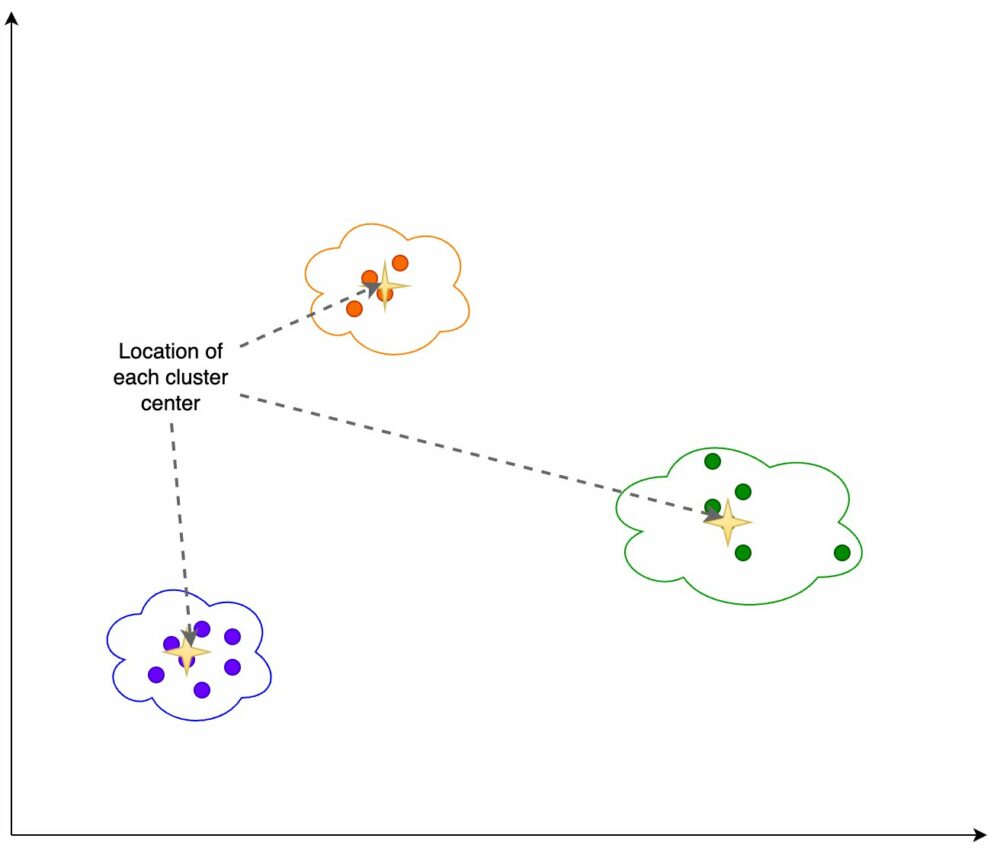

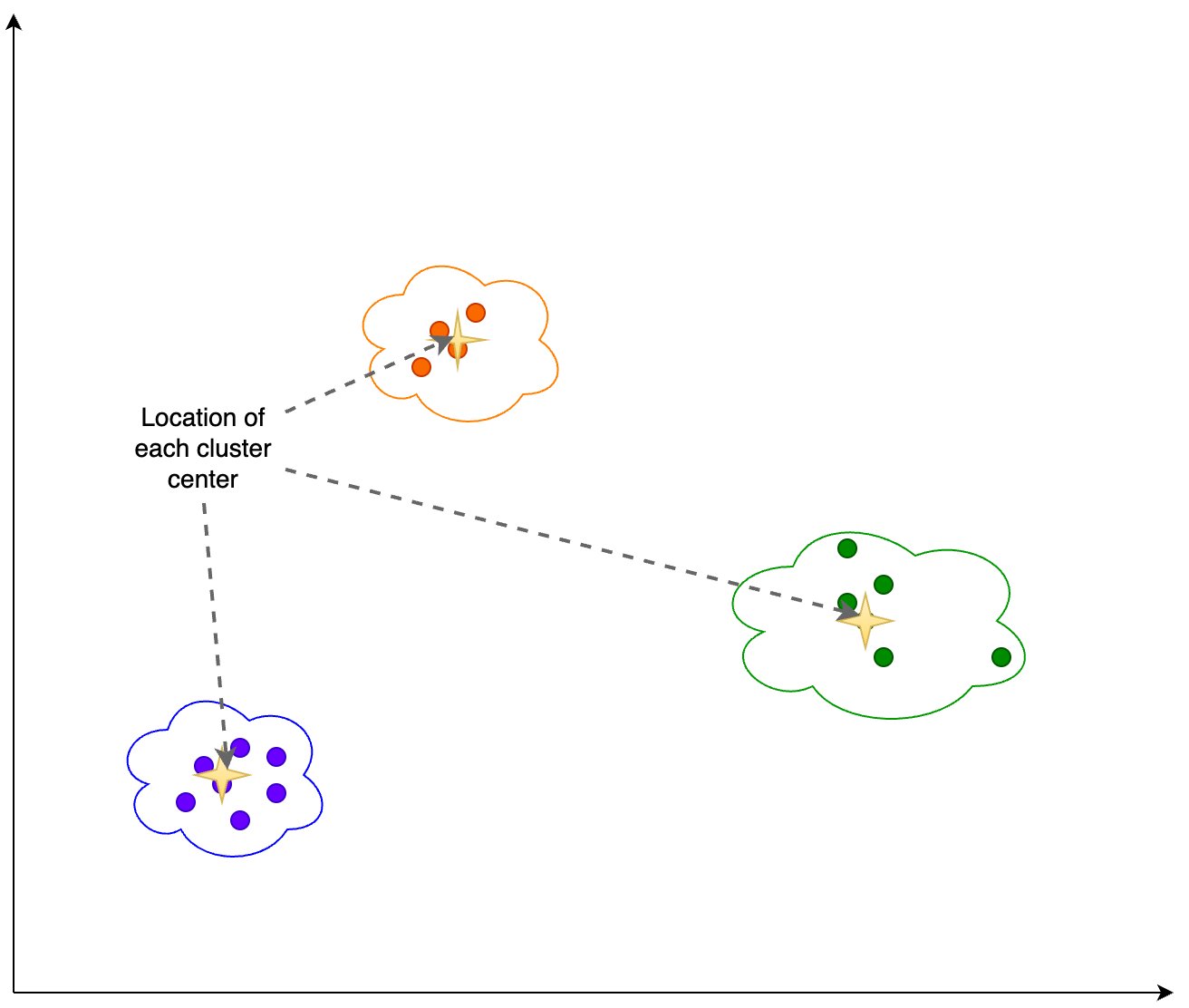

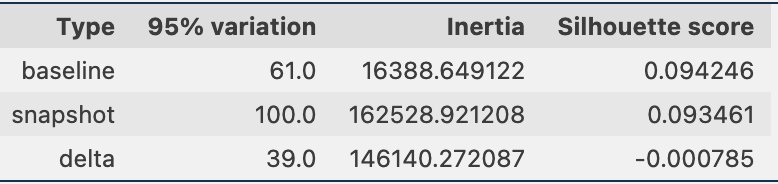

我们根据下图所示的聚类输出计算出以下信息:

- PCA 中解释 95% 方差的维数

- 每个聚类中心或质心的位置

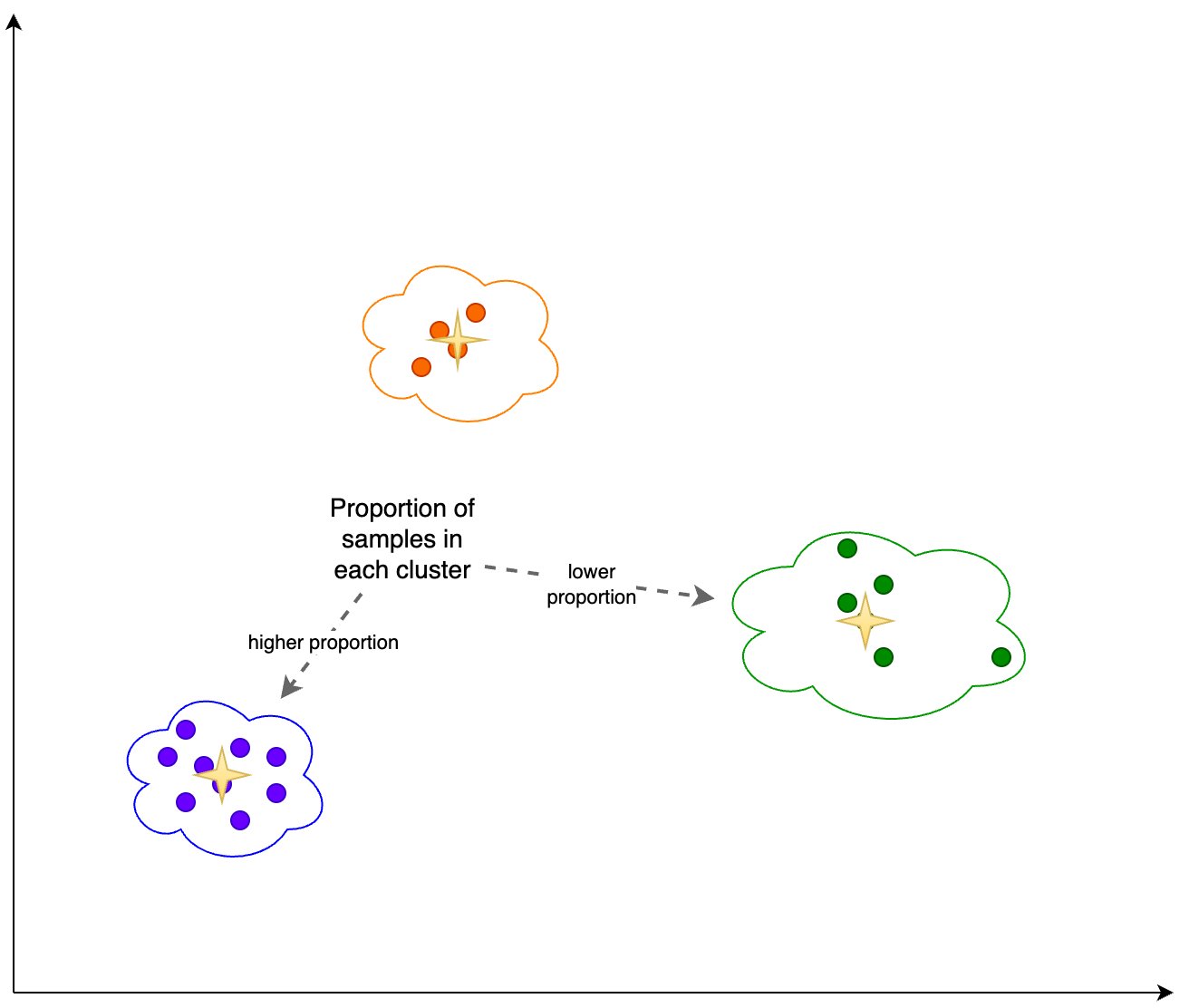

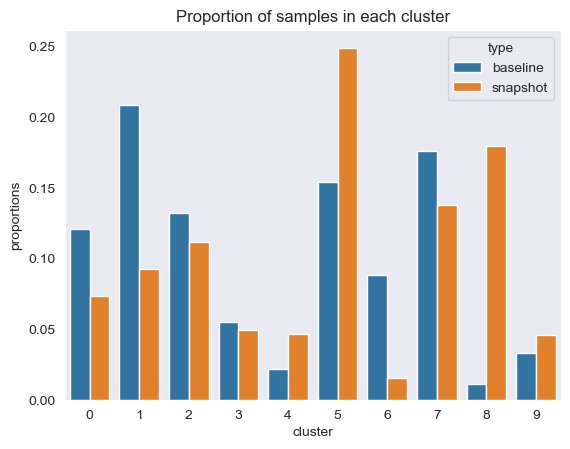

此外,我们还会查看每个簇中样本的比例(较高或较低),如下图所示。

最后,我们使用此分析来计算以下内容:

- 惯性 – 惯性是到聚类质心的平方距离之和,它衡量使用 K 均值聚类数据的效果。

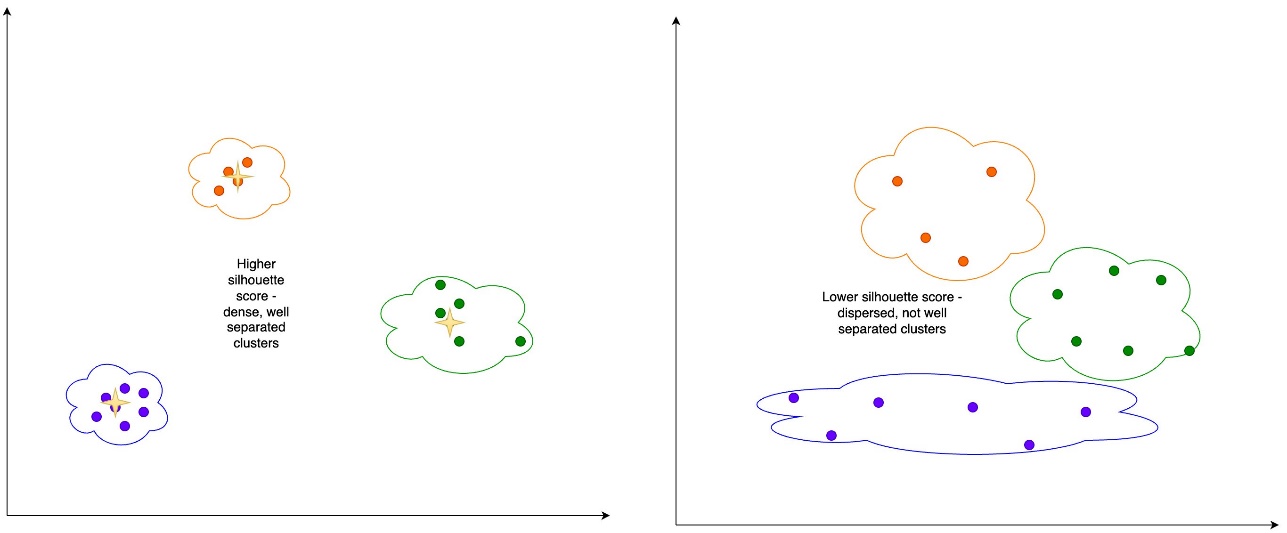

- 剪影得分 – 轮廓分数是簇内一致性验证的度量,范围从-1到1。接近1的值意味着簇中的点与同一簇中的其他点接近并且远离其他簇的点。轮廓分数的直观表示如下图所示。

我们可以定期捕获此信息,以获取源参考数据和提示的嵌入快照。捕获这些数据使我们能够分析嵌入漂移的潜在信号。

检测嵌入漂移

我们可以定期通过数据快照来比较聚类信息,其中包括参考数据嵌入和提示嵌入。首先,我们可以比较解释嵌入数据中 95% 的变化所需的维数、惯性以及聚类作业的轮廓分数。如下表所示,与基线相比,嵌入的最新快照需要多 39 个维度来解释方差,这表明我们的数据更加分散。惯性增加了,表明样本总体上离它们的聚类中心更远了。此外,轮廓分数下降了,表明聚类的定义不明确。对于提示数据,这可能表明进入系统的问题类型涵盖了更多主题。

接下来,在下图中,我们可以看到每个簇中的样本比例如何随时间变化。这可以向我们展示新的参考数据是否与之前的数据集大致相似,或者涵盖新的领域。

最后,我们可以看到聚类中心是否发生移动,这将显示聚类中信息的漂移,如下表所示。

传入问题的参考数据覆盖范围

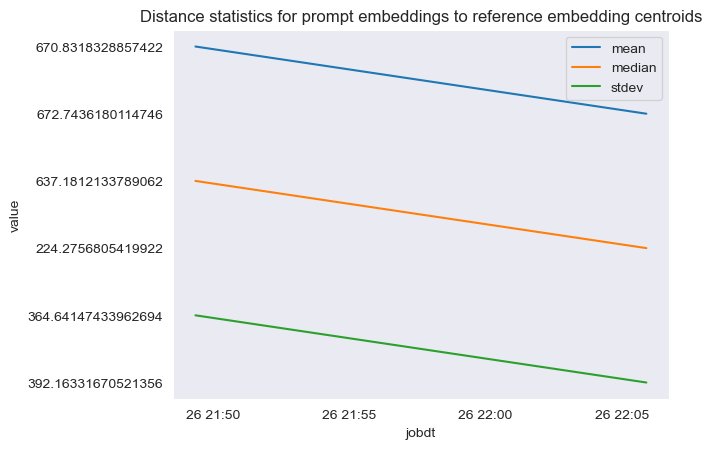

我们还可以评估我们的参考数据与传入问题的匹配程度。为此,我们将每个提示嵌入分配给一个参考数据集群。我们计算每个提示到其相应中心的距离,并查看这些距离的平均值、中位数和标准差。我们可以存储该信息并查看它如何随时间变化。

下图显示了分析提示嵌入与参考数据中心之间的距离随时间变化的示例。

正如您所看到的,提示嵌入和参考数据中心之间的平均值、中位数和标准差距离统计数据在初始基线和最新快照之间正在减小。尽管距离的绝对值很难解释,但我们可以使用趋势来确定参考数据和传入问题之间的语义重叠是否随着时间的推移变得更好或更差。

示例应用程序

为了收集上一节中讨论的实验结果,我们构建了一个示例应用程序,该应用程序使用通过 SageMaker JumpStart 部署并托管在 亚马逊SageMaker 实时端点。

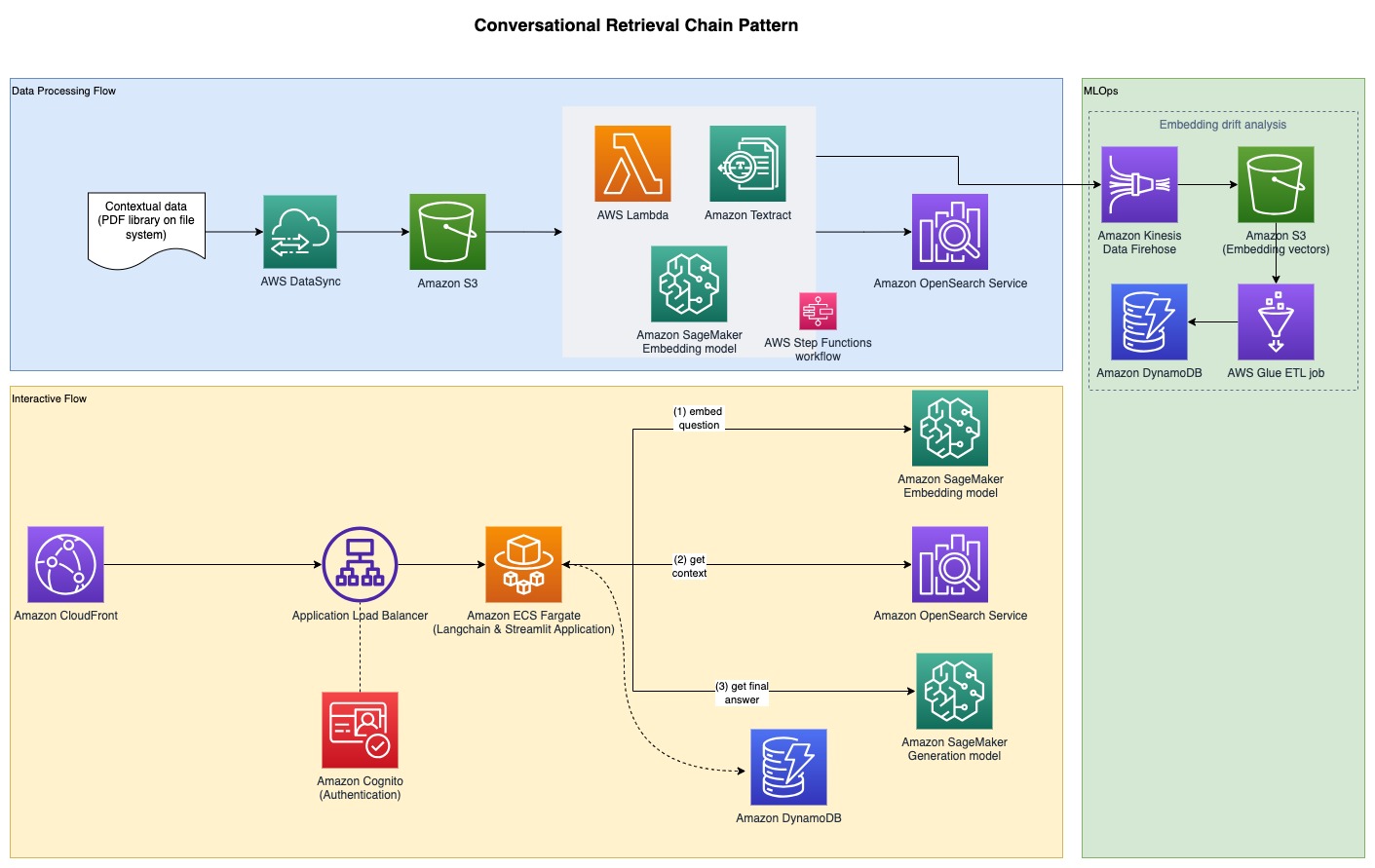

该应用程序具有三个核心组件:

- 我们使用交互式流程,其中包括用于捕获提示的用户界面,并使用 LangChain 与 RAG 编排层相结合。

- 数据处理流程从 PDF 文档中提取数据并创建存储在中的嵌入 亚马逊开放搜索服务。我们还在应用程序的最终嵌入漂移分析组件中使用这些。

- 嵌入被捕获在 亚马逊简单存储服务 (亚马逊 S3)通过 亚马逊 Kinesis 数据流水线,我们运行一个组合 AWS胶水 提取、转换和加载 (ETL) 作业和 Jupyter 笔记本来执行嵌入分析。

下图说明了端到端架构。

完整的示例代码可在 GitHub上。提供的代码有两种不同的模式:

- 具有 Streamlit 前端的示例全栈应用程序 – 这提供了一个端到端的应用程序,包括使用 Streamlit 捕获提示的用户界面,与 RAG 编排层相结合,使用运行在 亚马逊弹性容器服务 (Amazon ECS) 与 AWS 法门

- 后端应用 – 对于那些不想部署完整应用程序堆栈的人,您可以选择仅部署后端 AWS云开发套件 (AWS CDK)堆栈,然后使用提供的Jupyter Notebook使用LangChain进行RAG编排

要创建提供的模式,以下各节详细介绍了几个先决条件,从部署生成模型和文本嵌入模型开始,然后继续讨论其他先决条件。

通过 SageMaker JumpStart 部署模型

两种模式都假设部署嵌入模型和生成模型。为此,您将从 SageMaker JumpStart 部署两个模型。第一个模型 GPT-J 6B 用作嵌入模型,第二个模型 Falcon-40b 用于文本生成。

您可以通过 SageMaker JumpStart 从 AWS管理控制台, 亚马逊SageMaker Studio,或以编程方式。欲了解更多信息,请参阅 如何使用 JumpStart 基础模型。为了简化部署,您可以使用 提供笔记本 源自 SageMaker JumpStart 自动创建的笔记本。该笔记本从 SageMaker JumpStart ML 中心提取模型并将其部署到两个独立的 SageMaker 实时端点。

示例笔记本还有一个清理部分。暂时不要运行该部分,因为它将删除刚刚部署的端点。您将在演练结束时完成清理工作。

确认端点部署成功后,您就可以部署完整的示例应用程序了。但是,如果您只对探索后端和分析笔记本更感兴趣,则可以选择仅部署后端和分析笔记本,这将在下一节中介绍。

选项 1:仅部署后端应用程序

此模式允许您仅部署后端解决方案并使用 Jupyter 笔记本与该解决方案进行交互。如果您不想构建完整的前端界面,请使用此模式。

先决条件

您应该具备以下先决条件:

- 已部署 SageMaker JumpStart 模型端点 – 如前所述,使用 SageMaker JumpStart 将模型部署到 SageMaker 实时端点

- 部署参数 – 记录以下内容:

- 文本模型端点名称 – 使用 SageMaker JumpStart 部署的文本生成模型的端点名称

- 嵌入模型端点名称 – 使用 SageMaker JumpStart 部署的嵌入模型的端点名称

使用 AWS CDK 部署资源

使用上一节中提到的部署参数来部署 AWS CDK 堆栈。有关AWS CDK安装的更多信息,请参阅 开始使用 AWS CDK.

确保 Docker 已安装并在将用于 AWS CDK 部署的工作站上运行。参考 获取 Docker 有关其他指导。

或者,您可以在名为的文件中输入上下文值 cdk.context.json ,在 pattern1-rag/cdk 目录并运行 cdk deploy BackendStack --exclusively.

部署将打印输出,其中一些输出将需要运行笔记本。在开始问答之前,请嵌入参考文档,如下一节所示。

嵌入参考文档

对于这种 RAG 方法,参考文档首先嵌入文本嵌入模型并存储在向量数据库中。在此解决方案中,构建了一个摄取 PDF 文档的摄取管道。

An 亚马逊弹性计算云 (Amazon EC2) 实例已创建用于 PDF 文档摄取,并且 亚马逊弹性文件系统 (Amazon EFS) 文件系统安装在 EC2 实例上,用于保存 PDF 文档。一个 AWS 数据同步 该任务每小时运行一次,以获取在 EFS 文件系统路径中找到的 PDF 文档并将其上传到 S3 存储桶以启动文本嵌入过程。此过程嵌入参考文档并将嵌入内容保存在 OpenSearch 服务中。它还通过 Kinesis Data Firehose 将嵌入存档保存到 S3 存储桶,以供以后分析。

要获取参考文档,请完成以下步骤:

- 检索已创建的示例 EC2 实例 ID(请参阅 AWS CDK 输出

JumpHostId)并使用连接 会话管理器, 的能力 AWS系统经理. 有关说明,请参阅 使用 AWS Systems Manager 会话管理器连接到您的 Linux 实例. - 进入目录

/mnt/efs/fs1,这是挂载 EFS 文件系统的位置,并创建一个名为的文件夹ingest: - 将您的参考 PDF 文档添加到

ingest目录。

DataSync 任务配置为将此目录中找到的所有文件上传到 Amazon S3 以启动嵌入过程。

DataSync 任务按小时计划运行;您可以选择手动启动任务,以立即为您添加的 PDF 文档启动嵌入过程。

- 要启动任务,请从 AWS CDK 输出中找到任务 ID

DataSyncTaskID和 开始任务 使用默认值。

创建嵌入后,您可以通过 Jupyter 笔记本启动 RAG 问题和回答,如下一节所示。

使用 Jupyter 笔记本进行问答

完成以下步骤:

- 从 AWS CDK 输出中检索 SageMaker 笔记本实例名称

NotebookInstanceName并从 SageMaker 控制台连接到 JupyterLab。 - 进入目录

fmops/full-stack/pattern1-rag/notebooks/. - 打开并运行笔记本

query-llm.ipynb在笔记本实例中使用 RAG 执行问答。

确保使用 conda_python3 笔记本的内核。

此模式对于探索后端解决方案非常有用,而无需提供全堆栈应用程序所需的其他先决条件。下一节将介绍全栈应用程序的实现,包括前端和后端组件,以提供与生成式 AI 应用程序交互的用户界面。

选项 2:使用 Streamlit 前端部署全栈示例应用程序

此模式允许您使用用于问答的用户前端界面来部署解决方案。

先决条件

要部署示例应用程序,您必须满足以下先决条件:

- 已部署 SageMaker JumpStart 模型端点 – 如上一节所述,使用提供的笔记本,使用 SageMaker JumpStart 将模型部署到 SageMaker 实时端点。

- Amazon Route 53 托管区域 – 创建一个 亚马逊路线53 公共托管区 用于此解决方案。您还可以使用现有的 Route 53 公共托管区域,例如

example.com. - AWS 证书管理器证书 – 提供 AWS证书管理器 (ACM) Route 53 托管区域域名及其适用子域的 TLS 证书,例如

example.com和*.example.com对于所有子域。有关说明,请参阅 请求公共证书。该证书用于配置 HTTPS 亚马逊的CloudFront的 和原始负载均衡器。 - 部署参数 – 记录以下内容:

- 前端应用自定义域名 – 用于访问前端示例应用程序的自定义域名。提供的域名用于创建指向前端 CloudFront 分配的 Route 53 DNS 记录;例如,

app.example.com. - 负载均衡器源自定义域名 – 用于 CloudFront 分发负载均衡器源的自定义域名。提供的域名用于创建指向源负载均衡器的 Route 53 DNS 记录;例如,

app-lb.example.com. - Route 53 托管区域 ID – 用于托管所提供的自定义域名的 Route 53 托管区域 ID;例如,

ZXXXXXXXXYYYYYYYYY. - Route 53 托管区域名称 – 用于托管所提供的自定义域名的 Route 53 托管区域的名称;例如,

example.com. - ACM 证书 ARN – 与提供的自定义域一起使用的 ACM 证书的 ARN。

- 文本模型端点名称 – 使用 SageMaker JumpStart 部署的文本生成模型的端点名称。

- 嵌入模型端点名称 – 使用 SageMaker JumpStart 部署的嵌入模型的端点名称。

- 前端应用自定义域名 – 用于访问前端示例应用程序的自定义域名。提供的域名用于创建指向前端 CloudFront 分配的 Route 53 DNS 记录;例如,

使用 AWS CDK 部署资源

使用您在先决条件中记下的部署参数来部署 AWS CDK 堆栈。欲了解更多信息,请参阅 开始使用 AWS CDK.

确保 Docker 已安装并在将用于 AWS CDK 部署的工作站上运行。

在前面的代码中,-c 表示上下文值,采用输入时提供的所需先决条件的形式。或者,您可以在名为的文件中输入上下文值 cdk.context.json ,在 pattern1-rag/cdk 目录并运行 cdk deploy --all.

请注意,我们在文件中指定了 Region bin/cdk.ts。配置ALB访问日志需要指定Region。您可以在部署之前更改此区域。

部署将打印出用于访问 Streamlit 应用程序的 URL。在开始问答之前,您需要嵌入参考文档,如下一节所示。

嵌入参考文档

对于 RAG 方法,参考文档首先嵌入文本嵌入模型并存储在向量数据库中。在此解决方案中,构建了一个摄取 PDF 文档的摄取管道。

正如我们在第一个部署选项中讨论的那样,已为 PDF 文档摄取创建了一个示例 EC2 实例,并在 EC2 实例上安装了 EFS 文件系统以保存 PDF 文档。 DataSync 任务每小时运行一次,以获取在 EFS 文件系统路径中找到的 PDF 文档,并将其上传到 S3 存储桶以启动文本嵌入过程。此过程嵌入参考文档并将嵌入内容保存在 OpenSearch 服务中。它还通过 Kinesis Data Firehose 将嵌入存档保存到 S3 存储桶,以供以后分析。

要获取参考文档,请完成以下步骤:

- 检索已创建的示例 EC2 实例 ID(请参阅 AWS CDK 输出

JumpHostId)并使用会话管理器进行连接。 - 进入目录

/mnt/efs/fs1,这是挂载 EFS 文件系统的位置,并创建一个名为的文件夹ingest: - 将您的参考 PDF 文档添加到

ingest目录。

DataSync 任务配置为将此目录中找到的所有文件上传到 Amazon S3 以启动嵌入过程。

DataSync 任务按小时计划运行。您可以选择手动启动任务,以立即为您添加的 PDF 文档启动嵌入过程。

- 要启动任务,请从 AWS CDK 输出中找到任务 ID

DataSyncTaskID和 开始任务 使用默认值。

提问与回答

嵌入参考文档后,您可以通过访问 Streamlit 应用程序的 URL 来启动 RAG 问答。一个 亚马逊Cognito 使用身份验证层,因此需要在通过 AWS CDK 部署的 Amazon Cognito 用户池中创建用户账户(请参阅 AWS CDK 输出以获取用户池名称),以便首次访问应用程序。有关创建 Amazon Cognito 用户的说明,请参阅 在 AWS 管理控制台中创建新用户.

嵌入漂移分析

在本节中,我们将向您展示如何执行漂移分析,方法是首先创建参考数据嵌入和提示嵌入的基线,然后创建嵌入随时间变化的快照。这允许您将基线嵌入与快照嵌入进行比较。

为参考数据和提示创建嵌入基线

要创建参考数据的嵌入基线,请打开 AWS Glue 控制台并选择 ETL 作业 embedding-drift-analysis。设置ETL作业参数如下并运行作业:

- 在

--job_type至BASELINE. - 在

--out_table到 Amazon DynamoDB 参考嵌入数据表。 (请参阅 AWS CDK 输出DriftTableReference为表名。) - 在

--centroid_table到 DynamoDB 表以获取参考质心数据。 (请参阅 AWS CDK 输出CentroidTableReference为表名。) - 在

--data_path到具有前缀的 S3 存储桶;例如,s3:///embeddingarchive/。 (请参阅 AWS CDK 输出BucketName为存储桶名称。)

同样,使用 ETL 作业 embedding-drift-analysis,创建提示的嵌入基线。设置ETL作业参数如下并运行作业:

- 在

--job_type至BASELINE - 在

--out_table到 DynamoDB 表以快速嵌入数据。 (请参阅 AWS CDK 输出DriftTablePromptsName为表名。) - 在

--centroid_table到 DynamoDB 表以获取提示质心数据。 (请参阅 AWS CDK 输出CentroidTablePrompts为表名。) - 在

--data_path到具有前缀的 S3 存储桶;例如,s3:///promptarchive/。 (请参阅 AWS CDK 输出BucketName为存储桶名称。)

为参考数据和提示创建嵌入快照

将附加信息引入 OpenSearch 服务后,运行 ETL 作业 embedding-drift-analysis 再次对参考数据嵌入进行快照。这些参数将与您运行以创建参考数据的嵌入基线(如上一节中所示)的 ETL 作业相同,但设置 --job_type 参数 SNAPSHOT.

同样,要对提示嵌入进行快照,请运行 ETL 作业 embedding-drift-analysis 再次。这些参数将与您运行的为提示创建嵌入基线(如上一节中所示)的 ETL 作业相同,但设置 --job_type 参数 SNAPSHOT.

将基线与快照进行比较

要比较嵌入基线和快照以获取参考数据和提示,请使用提供的笔记本 pattern1-rag/notebooks/drift-analysis.ipynb.

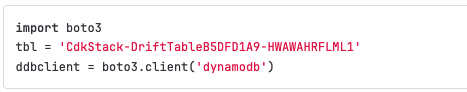

要查看参考数据或提示的嵌入比较,请更改 DynamoDB 表名称变量 (tbl 和 c_tbl) 将笔记本中的内容添加到笔记本每次运行的相应 DynamoDB 表中。

笔记本变量 tbl 应更改为适当的漂移表名称。以下是在笔记本中配置变量的示例。

可以按如下方式检索表名:

- 对于参考嵌入数据,从 AWS CDK 输出中检索漂移表名称

DriftTableReference - 对于提示嵌入数据,从 AWS CDK 输出中检索漂移表名称

DriftTablePromptsName

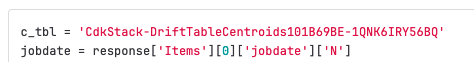

此外,笔记本变量 c_tbl 应更改为适当的质心表名称。以下是在笔记本中配置变量的示例。

可以按如下方式检索表名:

- 对于参考嵌入数据,从 AWS CDK 输出中检索质心表名称

CentroidTableReference - 对于提示嵌入数据,从 AWS CDK 输出中检索质心表名称

CentroidTablePrompts

分析与参考数据的提示距离

首先,运行 AWS Glue 作业 embedding-distance-analysis。该作业将从参考数据嵌入的 K-Means 评估中找出每个提示属于哪个集群。然后,它计算从每个提示到相应簇中心的距离的平均值、中位数和标准差。

您可以运行笔记本 pattern1-rag/notebooks/distance-analysis.ipynb 查看距离指标随时间变化的趋势。这将使您了解提示嵌入距离分布的总体趋势。

笔记本 pattern1-rag/notebooks/prompt-distance-outliers.ipynb 是一个用于查找异常值的 AWS Glue 笔记本,它可以帮助您确定是否收到更多与参考数据无关的提示。

监控相似度分数

来自 OpenSearch 服务的所有相似度分数均已登录 亚马逊CloudWatch 在下面 rag 命名空间。仪表板 RAG_Scores 显示平均分数和摄取的分数总数。

清理

为避免将来产生费用,请删除您创建的所有资源。

删除已部署的 SageMaker 模型

参考清理部分 提供示例笔记本 删除已部署的 SageMaker JumpStart 模型,或者您可以 在 SageMaker 控制台上删除模型.

删除 AWS CDK 资源

如果您在 cdk.context.json 文件,清理如下:

如果您在命令行中输入参数并且仅部署后端应用程序(后端 AWS CDK 堆栈),请按如下方式进行清理:

如果您在命令行中输入参数并部署了完整的解决方案(前端和后端 AWS CDK 堆栈),请按如下方式进行清理:

结论

在这篇文章中,我们提供了一个应用程序的工作示例,该应用程序捕获用于生成 AI 的 RAG 模式中的参考数据和提示的嵌入向量。我们展示了如何执行聚类分析来确定参考数据或提示数据是否随着时间的推移而发生漂移,以及参考数据在多大程度上涵盖了用户提出的问题类型。如果您检测到漂移,它可以提供一个信号,表明环境已发生变化,并且您的模型正在获取可能无法优化处理的新输入。这允许根据不断变化的输入对当前模型进行主动评估。

作者简介

阿卜杜拉希·奥拉耶 是 Amazon Web Services (AWS) 的高级解决方案架构师。 Abdullahi 拥有威奇托州立大学计算机网络硕士学位,是一位出版作家,曾在 DevOps、基础设施现代化和人工智能等多个技术领域担任过职务。他目前专注于生成式人工智能,并在协助企业架构和构建由生成式人工智能支持的尖端解决方案方面发挥着关键作用。除了技术领域之外,他还在探索的艺术中找到了乐趣。在制定人工智能解决方案之余,他喜欢与家人一起旅行探索新的地方。

阿卜杜拉希·奥拉耶 是 Amazon Web Services (AWS) 的高级解决方案架构师。 Abdullahi 拥有威奇托州立大学计算机网络硕士学位,是一位出版作家,曾在 DevOps、基础设施现代化和人工智能等多个技术领域担任过职务。他目前专注于生成式人工智能,并在协助企业架构和构建由生成式人工智能支持的尖端解决方案方面发挥着关键作用。除了技术领域之外,他还在探索的艺术中找到了乐趣。在制定人工智能解决方案之余,他喜欢与家人一起旅行探索新的地方。

兰迪·德福 是 AWS 的高级首席解决方案架构师。 他拥有密歇根大学电子工程硕士学位,在那里从事自动驾驶汽车的计算机视觉研究。 他还拥有科罗拉多州立大学的 MBA 学位。 Randy 在技术领域担任过多种职位,从软件工程到产品管理。 In 于 2013 年进入大数据领域,并继续探索该领域。 他积极致力于 ML 领域的项目,并在包括 Strata 和 GlueCon 在内的众多会议上发表过演讲。

兰迪·德福 是 AWS 的高级首席解决方案架构师。 他拥有密歇根大学电子工程硕士学位,在那里从事自动驾驶汽车的计算机视觉研究。 他还拥有科罗拉多州立大学的 MBA 学位。 Randy 在技术领域担任过多种职位,从软件工程到产品管理。 In 于 2013 年进入大数据领域,并继续探索该领域。 他积极致力于 ML 领域的项目,并在包括 Strata 和 GlueCon 在内的众多会议上发表过演讲。

谢尔比本征桥 是 Amazon Web Services (AWS) 的首席 AI 和机器学习专家解决方案架构师。 她从事技术工作 24 年,涉及多个行业、技术和角色。 她目前专注于将她的 DevOps 和 ML 背景结合到 MLOps 领域,以帮助客户大规模交付和管理 ML 工作负载。 她在各个技术领域拥有超过 35 项专利,对持续创新和使用数据推动业务成果充满热情。 Shelbee 是 Coursera 实用数据科学专业的共同创建者和讲师。 她还是丹佛分会女性大数据 (WiBD) 的联合主任。 在业余时间,她喜欢与家人、朋友和过度活跃的狗共度时光。

谢尔比本征桥 是 Amazon Web Services (AWS) 的首席 AI 和机器学习专家解决方案架构师。 她从事技术工作 24 年,涉及多个行业、技术和角色。 她目前专注于将她的 DevOps 和 ML 背景结合到 MLOps 领域,以帮助客户大规模交付和管理 ML 工作负载。 她在各个技术领域拥有超过 35 项专利,对持续创新和使用数据推动业务成果充满热情。 Shelbee 是 Coursera 实用数据科学专业的共同创建者和讲师。 她还是丹佛分会女性大数据 (WiBD) 的联合主任。 在业余时间,她喜欢与家人、朋友和过度活跃的狗共度时光。

- :具有

- :是

- :不是

- :在哪里

- $UP

- 1

- 10

- 100

- 2013

- 24

- 35%

- 39

- 7

- 9

- 95%

- a

- Able

- 关于

- 绝对

- ACCESS

- 账号管理

- ACM

- 横过

- 积极地

- 添加

- 增加

- 额外

- 附加信息

- 另外

- 再次

- 驳

- 骨料

- AI

- 对齐

- 所有类型

- 允许

- 允许

- 还

- 尽管

- Amazon

- 亚马逊Cognito

- Amazon EC2

- 亚马逊SageMaker

- 亚马逊SageMaker JumpStart

- 亚马逊网络服务

- 亚马逊网络服务(AWS)

- an

- 分析

- 分析

- 分析

- 和

- 回答

- 回答

- 什么

- 相应

- 应用领域

- 的途径

- 适当

- 架构

- 档案

- 保健

- 国家 / 地区

- 地区

- 艺术

- 刊文

- AS

- 问

- 问

- 协助

- 承担

- At

- 增加

- 增强

- 认证

- 作者

- 自动

- 自主性

- 自主车辆

- 可使用

- 避免

- 远离

- AWS

- AWS胶水

- 后端

- 背景

- 摆动

- 基于

- 底线

- BE

- 因为

- 很

- before

- 作为

- 属于

- 更好

- 之间

- 超越

- 大

- 大数据运用

- 机构

- 都

- 宽广地

- 建立

- 建

- 商业

- by

- 计算

- 计算

- 呼叫

- 被称为

- CAN

- 能力

- 捕获

- 捕获

- 捕获

- 捕获

- 案件

- CD

- Center

- 中心

- 证书

- 更改

- 变

- 更改

- 改变

- 章节

- 收费

- 芯片

- 巧克力

- 清洁

- 关闭

- 接近

- 云端技术

- 簇

- 集群

- 码

- 科罗拉多州

- 组合

- 结合

- 结合

- 未来

- 紧凑

- 比较

- 相比

- 对照

- 完成

- 元件

- 组件

- 计算

- 一台

- 计算机视觉

- 概念

- 会议

- 配置

- 配置

- 分享链接

- 注意事项

- 安慰

- 容器

- 内容

- 上下文

- 继续

- 连续

- 转换

- 曲奇饼

- 核心

- 相应

- 覆盖

- 覆盖

- 覆盖

- 盖

- 创建信息图

- 创建

- 创建

- 创造

- 电流

- 目前

- 习俗

- 合作伙伴

- 前沿

- XNUMX月XNUMX日

- data

- 数据中心

- 数据处理

- 数据科学

- 数据库

- 默认

- 定义

- 交付

- 丹佛

- 部署

- 部署

- 部署

- 部署

- 部署

- 派生

- 摧毁

- 详细

- 检测

- 检测

- 确定

- 研发支持

- 偏差

- 图表

- 不同

- 难

- 尺寸

- 尺寸

- 讨论

- 分散

- 距离

- 遥远

- 分配

- DNS

- do

- 码头工人

- 文件

- 文件

- 域

- 域名

- 网站域名

- 域名

- 别

- 向下

- 驾驶

- 每

- 嵌

- 嵌入式

- 嵌入

- 结束

- 端至端

- 端点

- 工程师

- 输入

- 进入

- 企业

- 环境

- 评估

- 评估

- 所有的

- 例子

- 例子

- 例外

- 现有

- 试验

- 说明

- 勘探

- 探索

- 探索

- 外部

- 提取

- 提取物

- 家庭

- 远

- 数字

- 文件

- 档

- 最后

- 终于

- 找到最适合您的地方

- 发现

- 姓氏:

- 漂浮的

- 流

- 重点

- 聚焦

- 以下

- 如下

- 针对

- 申请

- 发现

- 基金会

- 朋友

- 止

- 前端

- ,

- 未来

- 收集

- 其他咨询

- 发电

- 代

- 生成的

- 生成式人工智能

- 得到

- 越来越

- 给

- Go

- 走了

- 授予

- 团队

- 指导

- 处理

- 有

- he

- 保持

- 帮助

- 这里

- 更高

- 他的

- 持有

- 主持人

- 托管

- 小时

- 创新中心

- How To

- 但是

- HTML

- HTTP

- HTTPS

- 中心

- ID

- 鉴定

- if

- 说明

- 立即

- 履行

- 器物

- 重要

- in

- 包括

- 包括

- 包含

- 来电

- 表明

- 行业

- 惯性

- 信息

- 基础设施

- 初始

- 創新

- 输入

- 输入

- 洞察

- 安装

- 安装

- 例

- 说明

- 相互作用

- 互动

- 互动

- 有兴趣

- 接口

- 成

- IT

- 它的

- 工作

- 工作机会

- 喜悦

- JPG

- 只是

- 键

- Kinesis 数据流水线

- 知识

- 语言

- 大

- 后来

- 最新

- 层

- 学习用品

- 学习

- 让

- 自学资料库

- 喜欢

- Line

- Linux的

- LLM

- 加载

- 圖書分館的位置

- 记录

- 看

- LOOKS

- 降低

- 机

- 机器学习

- 使

- 管理

- 颠覆性技术

- 经理

- 手动

- 可能..

- 意味着

- 手段

- 衡量

- 措施

- 指标

- 密歇根州

- 可能

- ML

- 多播

- 模型

- 模型

- 显示器

- 更多

- 最先进的

- 移动

- 多

- 必须

- 姓名

- 名称

- 自然

- 自然语言处理

- 需求

- 打印车票

- 需要

- 工业网络

- 全新

- 较新

- 下页

- NLP

- 笔记本

- 注意到

- 数

- 数字

- 众多

- of

- 经常

- on

- 仅由

- 打开

- 优化

- 附加选项

- or

- 管弦乐编曲

- 秩序

- 起源

- 其他名称

- 我们的

- 输出

- 结果

- 概述

- 产量

- 输出

- 超过

- 最划算

- 交叠

- 己

- 参数

- 参数

- 特别

- 情

- 专利

- 径

- 模式

- 模式

- 演出

- 执行

- 件

- 管道

- 地方

- 柏拉图

- 柏拉图数据智能

- 柏拉图数据

- 扮演

- 点

- 点

- 池

- 职位

- 可能

- 帖子

- 潜力

- 供电

- 实用

- 前

- 先决条件

- 呈现

- 保存

- 以前

- 先前

- 校长

- 打印

- 主动

- 过程

- 处理

- 产品

- 产品管理

- 项目

- 提示

- 比例

- 提供

- 提供

- 提供

- 规定

- 国家

- 出版

- 拉

- 题

- 有疑问吗?

- 抹布

- 范围

- 范围

- 准备

- 实时的

- 境界

- 食谱

- 记录

- 减少

- 减少

- 参考

- 参考

- 地区

- 有关

- 相对

- 相应

- 代表

- 表示

- 代表

- 必须

- 需要

- 资源

- 响应

- 成果

- 恢复

- 角色

- 角色

- 路线

- 运行

- 运行

- 运行

- sagemaker

- 同

- 保存

- 鳞片

- 始你

- 科学

- 得分了

- 搜索

- 搜索

- 其次

- 部分

- 部分

- 看到

- 看到

- 选择

- 语义

- 前辈

- 感

- 发送

- 分开

- 服务

- 特色服务

- 会议

- 集

- 设置

- 几个

- 她

- 应该

- 显示

- 显示

- 如图

- 作品

- 信号

- 信号

- 类似

- 简易

- 简化

- 尺寸

- 快照

- So

- 软件

- 软件工程

- 方案,

- 解决方案

- 一些

- 来源

- 来源

- 太空

- 张力

- 专家

- 指定

- 花

- 平方

- 堆

- 堆栈

- 标准

- 开始

- 开始

- 开始

- 州/领地

- 统计

- 步骤

- 存储

- 商店

- 存储

- 成功

- 这样

- 肯定

- 系统

- 产品

- 表

- 采取

- 任务

- 技术

- 技术

- 专业技术

- 文本

- 这

- 信息

- 其

- 他们

- 然后

- 那里。

- 博曼

- Free Introduction

- 那些

- 三

- 通过

- 次

- 至

- 一起

- Topics

- 合计

- 改造

- 旅游

- 趋势

- 趋势

- 尝试

- 二

- 类型

- 下

- 大学

- 网址

- us

- 使用

- 用过的

- 有用

- 用户

- 用户界面

- 用户

- 运用

- 验证

- 折扣值

- 价值观

- 变量

- 各种

- 各个

- 车辆

- 通过

- 愿景

- 视觉

- 演练

- 想

- 是

- 方法..

- we

- 卷筒纸

- Web服务

- 井

- ,尤其是

- 是否

- 这

- 而

- 将

- 中

- 也完全不需要

- 女性

- 工作

- 工作

- 加工

- 工作站

- 更坏

- 将

- 年

- 但

- 完全

- 您一站式解决方案

- 和风网

- 区