是的..我说的是人工智能应用程序——我们无数的人工智能应用程序和即将到来的人工智能应用程序正在悄悄地告诉人类该做什么…… 如何去做……但不是关于与 AI 聊天机器人互动的窃窃私语者。

根据 IDC 据预测,到 500 年,全球 AI 市场可能达到 2024 亿美元以上,比 50 年增长 2021% 以上。这表明我们已经从商业实验转向接受它是各种规模企业战略不可或缺的一部分。 它是将数据转化为洞察力以激发基于更好决策的行动的必要工具。 没有人在争论人工智能在降低业务风险和通过创新提高投资回报率方面的好处。 但是,一如既往,有一个......但是......无偏见的人工智能说起来容易做起来难。

这些 AI 模型对业务至关重要,需要以可见性和问责制可靠地运行。 否则,在这种情况下,失败会产生可怕的后果,影响任何公司的现金流,甚至可能导致法律问题。 避免这种情况的唯一方法是自动化和透明地回答一个问题“你能证明这个 AI 应用程序/工作负载是合乎道德的构建的吗?” 又名......你如何管理? 你能证明它一直在被治理吗?

这是公司喜欢的地方 IBM 投资于人工智能治理,以协调指导、管理和监控组织人工智能活动的整个过程。 主要工作是确保所有业务部门保持积极主动,并将治理框架融入举措中,以加强满足道德原则和法规的能力。 特别是,法律要求银行和金融服务等受监管行业提供证据以满足监管机构的要求。

由于数字化转型的巨大压力,人工智能在金融服务领域的影响力呈指数级增长。 如前所述,说起来容易做起来难,因为:

1. 自信地运行 AI 应用程序:

在某些情况下,模型的构建没有清晰度和分类; 不用说,监控会从所有事物中溜走,以跟踪端到端的生命周期。 虽然银行正在努力处理遗留应用程序,但自动化流程以创建透明度和可解释性变得更加困难,进而成为一个黑匣子。 没有人知道为什么/如何做出决定。 尽管由于质量和不可察觉的风险而带来巨大的投资回报率,但与遗留应用程序纠缠在一起的新应用程序永远不会出现。

这就引出了我们的第二点——管理声誉风险

2. 将声誉风险与整体风险一起管理

我问过 #chatGPT 和 #诗人 – 谁是 Padma Chukka。 #ChatGPT 即使我以多种方式更改问题,也拒绝回答。 尽管如此,巴德还是给了我一个详细的答案,包括我的 LinkedIn 个人资料……但数据来自各个网站,我的旧个人资料仍然作为演讲者简历的一部分存在。 从那时起,我还没有打开巴德。 很快,我就被关闭了,又名 - 声誉风险。 假设当我意识到数据可能不一致时,我可以关闭一个简单的聊天机器人。 在决定购买注入 AI 的应用程序以开展关键业务之前,我怎么能不确定呢? 声誉风险是企业有时会忘记的一个重要因素。 如果您量化声誉风险,就会发现如果一个人不积极主动,就会对业务产生巨大影响。

为了增加复杂性,第三个是……

3. 公司如何应对不断变化的 AI 法规?

为了避免声誉风险,一个成功且负责任的 AI 团队应该了解每一个地方和全球法规,像滴答视频一样随时通知。 不合规最终可能会使组织因拟议的欧盟 AI 法案等工作而被处以数百万美元的罚款。 它可能高达 30 万欧元或公司全球收入的 6% – OUCH。

好吧,并不是所有的事情一开始都必须是美好的……只要我们知道如何从可怕的情况转变为美好的情况。

毫不奇怪……它始终是人、流程和技术。 因此,首先,创建一个跨职能的管理机构来根据目标对计划进行教育、指导和监督。 然后对当前的 AI 技术和流程进行基准测试,了解差距,然后进行补救以适应未来的需要。 然后求助于一组符合合规性要求的自动化治理工作流。 最后,建立一个监控系统,在接近可接受的阈值时提醒所有者。从技术方面来说,一个架构良好、执行良好且连接良好的人工智能需要多个构建块。 并确保它具有部分或全部功能:

· 跨不同部署的数据完整性

· 使用遵循 AI 治理的开放、灵活的现有工具

· 确保提供带有隐私控制的自助访问——一种跟踪方式

· 设计时考虑自动化和 AI 治理

· 可以通过可定制的工作流程为多个利益相关者进行连接和定制

一旦我们将应用程序从可怕改造成玫瑰色……那么下一个问题就是您如何证明……

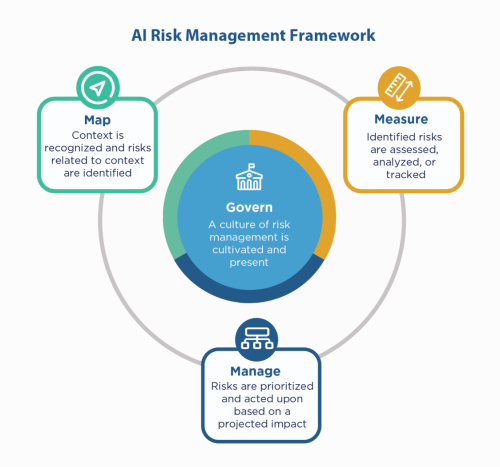

首先,依靠公司的 AI 原则——与它们一起构建,但你仍然需要“表明”你是合规的,尤其是在金融服务等受监管的环境中。 由于金融服务必须向 NIST 800-53 投诉,他们可以查看 NIST AI 风险管理框架 (AI RMF). NIST 建议在四个系列中进行控制——治理、地图、测量和管理。 使用它作为指导因素并对应用程序进行压力测试,以确定要补救和监控的差距。

IBM 可以在您将模型投入生产之前对其进行验证,并且可以对其公平性、质量和漂移进行监控。 它还可以提供解释模型行为和预测的文档,以满足监管机构和审计师的要求。 这些解释可以提供可见性并减轻审计的痛苦,并提高透明度和确定可能风险的能力。

自信地聆听 AI 的窃窃私语!

#金融服务 #responsibleai #ethicalai #NISTAIRMF

- SEO 支持的内容和 PR 分发。 今天得到放大。

- 柏拉图区块链。 Web3 元宇宙智能。 知识放大。 访问这里。

- 与 Adryenn Ashley 一起铸造未来。 访问这里。

- Sumber: https://www.finextra.com/blogposting/24053/the-costly-consequences-of-unethical-ai-whisperer?utm_medium=rssfinextra&utm_source=finextrablogs

- :是

- $UP

- 2021

- 2024

- 7

- a

- 对,能力--

- 关于

- 可接受

- ACCESS

- 问责制

- 横过

- 法案

- 操作

- 活动

- 坚持

- AI

- 人工智能法

- 人工智能治理

- 又名

- 警惕

- 所有类型

- 时刻

- 和

- 回答

- 应用

- 应用领域

- 应用领域

- 应用

- 保健

- 围绕

- AS

- 相关

- At

- 审计

- 核数师

- 自动化

- 自动化

- 自动化和干细胞工程

- 背部

- 银行业

- 银行

- 基于

- BE

- 因为

- before

- 作为

- 基准

- 好处

- 更好

- 亿

- 黑色

- 吹氣梢

- 身体

- 盒子

- 带来

- 建立

- 建筑物

- 建

- 商业

- 购买

- by

- CAN

- 能力

- 案件

- 例

- 现金

- 现金周转

- 改变

- 聊天机器人

- 聊天机器人

- 明晰

- 关闭

- 公司

- 公司

- 复杂

- 符合

- 兼容

- 进行

- 信心十足地

- 分享链接

- 后果

- 一直

- 控制

- 价格

- 可以

- 创建信息图

- 危急

- 电流

- 定制

- 周期

- data

- 辩论

- 决定

- 决定

- 减少

- 设计

- 详细

- 确定

- 数字

- 数字化改造

- 可怕的

- 直接

- 导演

- 不同

- 文件

- 美元

- 删除

- 更容易

- 教育

- 端至端

- 确保

- 企业

- 环境中

- 特别

- 必要

- 伦理

- EU

- 欧元

- 甚至

- 所有的

- 一切

- 证据

- 现有

- 存在

- 说明

- 成倍

- 失败

- 公平

- 秋季

- 家庭

- 终于

- 金融

- 金融服务

- 结束

- Finextra

- (名字)

- 柔软

- 流

- 针对

- 骨架

- 止

- 从2021

- 未来

- 给

- 全球

- 治理

- 成长

- 有

- 创新中心

- How To

- HTTPS

- 巨大

- 人类

- i

- 鉴定

- 影响力故事

- in

- 包含

- 增加

- 表示

- 行业

- 影响

- 项目

- 創新

- 可行的洞见

- 积分

- 诚信

- 相互作用

- 投资

- IT

- 它的

- 工作

- 知道

- 遗产

- 法律咨询

- 法律事项

- 生活

- 喜欢

- Line

- 本地

- 长

- 看

- 制成

- 使

- 管理

- 颠覆性技术

- 管理的

- 地图

- 市场

- 事项

- 可能..

- 衡量

- 满足

- 可能

- 百万

- 百万

- 模型

- 模型

- 时刻

- 显示器

- 监控

- 监控

- 更多

- 多

- 必要

- 需求

- 不必要

- 全新

- 下页

- NIST

- 目标

- of

- 提供

- 老

- on

- 一

- 打开

- 操作

- 组织

- 除此以外

- 最划算

- 业主

- 面包

- 部分

- 员工

- 柏拉图

- 柏拉图数据智能

- 柏拉图数据

- 点

- 可能

- 预测

- 压力

- 小学

- 原则

- 隐私

- 主动

- 过程

- 过程

- 生产

- 本人简介

- 证明

- 建议

- 证明

- 提供

- 放

- 质量

- 题

- 很快

- 达到

- 实现

- 监管

- 受管制行业

- 税法法规

- 法规

- 稳压器

- 声誉

- 必须

- 岗位要求

- 需要

- 回应

- 提供品牌战略规划

- 导致

- 收入

- 风险

- 变更管理

- 风险

- 投资回报率

- 红润

- s

- 说

- 其次

- 扇形

- 自助服务

- 特色服务

- 集

- 应该

- 显示

- 侧

- 简易

- 自

- 网站

- 情况

- 尺寸

- So

- 一些

- 火花

- 喇叭

- 利益相关者

- 留

- 仍

- 策略

- 加强

- 应力

- 奋斗的

- 成功

- 系统

- 说

- 团队

- 专业技术

- test

- 这

- 他们

- 博曼

- 第三

- 门槛

- 通过

- 至

- 工具

- 工具

- 跟踪时

- 转型

- 用户评论透明

- 巨大

- 转

- 转身

- 最终

- 理解

- 单位

- 即将上市

- us

- 使用

- 验证

- 各个

- 视频

- 能见度

- 方法..

- 方法

- 什么是

- 而

- WHO

- 也完全不需要

- 工作

- 工作流程

- 完全

- 您一站式解决方案

- 和风网