我们相信,随着时间的推移,生成式人工智能有潜力改变我们所知道的几乎所有客户体验。 在 AWS 上推出生成式 AI 应用程序的公司数量庞大且增长迅速,其中包括 adidas、Booking.com、Bridgewater Associates、Clariant、Cox Automotive、GoDaddy 和 LexisNexis Legal & Professional 等。 像 Perplexity AI 这样的创新初创公司正在全力投入 AWS 来实现生成式 AI。 Anthropic 等领先的人工智能公司选择 AWS 作为其关键任务工作负载的主要云提供商,以及训练其未来模型的地方。 像埃森哲这样的全球服务和解决方案提供商正在从定制的生成式人工智能应用程序中获益,因为他们为内部开发人员提供了 亚马逊 CodeWhisperer.

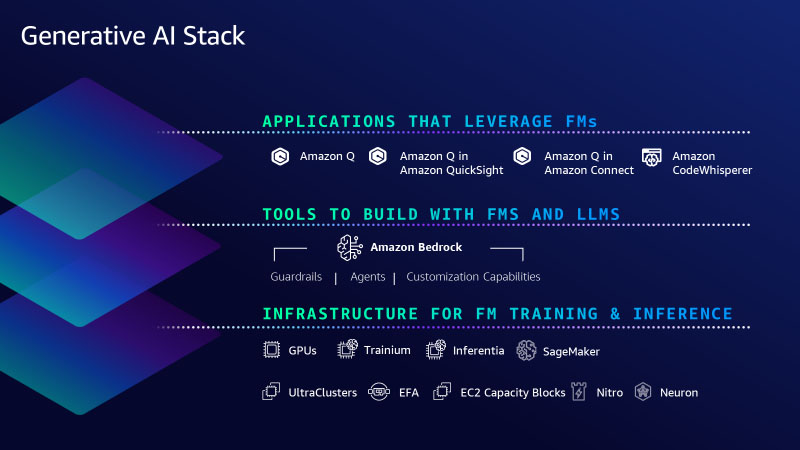

这些客户选择 AWS 是因为我们专注于做我们一直在做的事情——采用复杂且昂贵的技术来改变客户体验和业务,并为各种规模和技术能力的客户实现民主化。 为此,我们正在投资并快速创新,以在生成式 AI 堆栈的三个层中提供最全面的功能集。 底层是训练大型语言模型(LLM)和其他基础模型(FM)并产生推理或预测的基础设施。 中间层可以轻松访问客户构建和扩展生成式 AI 应用程序所需的所有模型和工具,并具有客户期望从 AWS 服务获得的相同安全性、访问控制和其他功能。 在顶层,我们一直在基于人工智能的生成编码等关键领域投资改变游戏规则的应用程序。 除了为他们提供选择以及(正如他们对我们的期望)跨所有层的能力的广度和深度之外,客户还告诉我们,他们欣赏我们的数据优先方法,并相信我们从头开始与企业一起构建了一切 -等级安全和隐私。

本周,我们向前迈出了一大步,宣布了跨越堆栈所有三层的许多重要新功能,使我们的客户能够轻松实用地在其业务中普遍使用生成式人工智能。

堆栈底层:AWS Trainium2 是最新的补充,为生成 AI 提供最先进的云基础设施

该堆栈的底层是训练和运行法学硕士和其他 FM 所需的基础设施——计算、网络、框架、服务。 AWS 不断创新,为 ML 提供最先进的基础设施。 通过我们与 NVIDIA 的长期合作,AWS 在 12 年前率先将 GPU 引入云中,最近我们成为第一家在我们的 P100 实例中提供 NVIDIA H5 GPU 的主要云提供商。 我们继续投资于独特的创新,使 AWS 成为运行 GPU 的最佳云,包括最先进的虚拟化系统 (AWS Nitro) 的性价比优势、具有 Elastic Fabric Adapter (EFA) 的强大拍比特级网络以及超使用 Amazon EC2 UltraClusters(数千个加速实例共同位于可用区并在无阻塞网络中互连,可为大规模 ML 训练提供高达 3,200 Gbps 的速度)扩展集群。 我们还让任何客户能够更轻松地通过适用于 ML 的 Amazon EC2 容量块来访问备受追捧的用于生成 AI 的 GPU 计算能力,这是业内第一个也是唯一一个允许客户预留 GPU 以供将来使用的消费模型(最多 500 个)部署在 EC2 UltraClusters 中)用于短期 ML 工作负载。

几年前,我们意识到,为了不断突破性价比的极限,我们需要一直创新到芯片,因此我们开始投资自己的芯片。 具体来说,对于 ML,我们从 AWS Inferentia 开始,这是我们专门构建的推理芯片。 今天,我们使用第二代 AWS Inferentia 和 Amazon EC2 Inf2 实例,这些实例专门针对模型包含数千亿个参数的大规模生成型 AI 应用程序进行了优化。 与 Inf2 实例相比,Inf1 实例提供最低的云推理成本,同时吞吐量提高了四倍,延迟降低了十倍。 Inf12 由多达 2 个 Inferentia2 芯片提供支持,是唯一在加速器之间具有高速连接的推理优化 EC2 实例,因此客户可以更快、更高效(以更低的成本)运行推理,而不会因分布超大型模型而牺牲性能或延迟跨多个加速器。 Adobe、德国电信和 Leonardo.ai 等客户已经看到了出色的早期成果,并且很高兴能够在 Inf2 上大规模部署他们的模型。

在训练方面,Trn1 实例由 AWS 专门构建的 ML 训练芯片 AWS Trainium 提供支持,经过优化,可在与 EFA 网络连接的多个服务器之间分发训练。 像理光这样的客户在短短几天内就用数十亿个参数培训了一位日本法学硕士。 Databricks 通过基于 Trainium 的实例来训练大规模深度学习模型,性价比提高了 40%。 但随着几乎每周都会推出新的、功能更强大的模型,我们将继续突破性能和规模的界限,我们很高兴地宣布 AWS 培训2,旨在为具有数千亿至数万亿参数的训练模型提供更好的性价比。 Trainium2 的训练性能应比第一代 Trainium 快四倍,并且在 EC2 UltraCluster 中使用时应提供高达 65 exaflops 的聚合计算。 这意味着客户将能够在数周而不是数月内培训 300 亿参数的 LLM。 Trainium2 的性能、规模和能源效率是 Anthropic 选择在 AWS 上训练其模型的部分原因,并将在其未来的模型中使用 Trainium2。 我们正在与 Anthropic 合作,通过 Trainium 和 Inferentia 进行持续创新。 我们预计第一个 Trainium2 实例将于 2024 年向客户提供。

我们还加倍努力开发 ML 芯片的软件工具链,特别是推进 AWS Neuron,这是一款软件开发套件 (SDK),可帮助客户从 Trainium 和 Inferentia 获得最大性能。 自 2019 年推出 Neuron 以来,我们在编译器和框架技术方面进行了大量投资,如今 Neuron 支持许多最流行的公开可用模型,包括 Meta 的 Llama 2、Databricks 的 MPT 和 Stability AI 的 Stable Diffusion,以及流行模型存储库 Hugging Face 上排名前 93 的模型中的 100 个。 Neuron 可插入 PyTorch 和 TensorFlow 等流行的 ML 框架,并且将于明年初推出对 JAX 的支持。 客户告诉我们,Neuron 让他们只需几行代码即可轻松地将现有模型训练和推理管道切换到 Trainium 和 Inferentia。

没有其他公司能够提供同样的最佳机器学习芯片选择、超高速网络、虚拟化和超大规模集群的组合。 因此,一些最知名的生成式 AI 初创公司(例如 AI21 Labs、Anthropic、Hugging Face、Perplexity AI、Runway 和 Stability AI)在 AWS 上运行也就不足为奇了。 但是,您仍然需要正确的工具来有效地利用这种计算来高效且经济高效地构建、训练和运行 LLM 和其他 FM。 对于许多这样的初创公司来说, 亚马逊SageMaker 就是答案。 无论是从头开始构建和训练新的专有模型,还是从许多流行的公开模型开始,训练都是一项复杂且昂贵的工作。 经济高效地运行这些模型也并不容易。 客户必须获取大量数据并进行准备。 这通常涉及大量的手动工作,清理数据、删除重复项、丰富和转换数据。 然后,他们必须创建和维护大型 GPU/加速器集群,编写代码以跨集群有效地分配模型训练,频繁检查点、暂停、检查和优化模型,并手动干预和修复集群中的硬件问题。 其中许多挑战并不新鲜,它们是我们六年前推出 SageMaker 的部分原因 - 打破模型训练和部署中涉及的许多障碍,为开发人员提供更简单的方法。 数以万计的客户使用 Amazon SageMaker,其中越来越多的客户(例如 LG AI Research、Perplexity AI、AI21、Hugging Face 和 Stability AI)正在 SageMaker 上培训法学硕士和其他 FM。 就在最近,技术创新研究所(流行的 Falcon LLM 的创建者)在 SageMaker 上训练了最大的公开可用模型 - Falcon 180B。 随着模型大小和复杂性的增加,SageMaker 的范围也随之扩大。

多年来,我们为 Amazon SageMaker 添加了 380 多项改变游戏规则的特性和功能,例如自动模型调优、分布式训练、灵活的模型部署选项、ML OP 工具、数据准备工具、特征存储、笔记本、无缝集成在整个机器学习生命周期中进行人机循环评估,以及负责任的人工智能的内置功能。 我们不断快速创新,以确保 SageMaker 客户能够持续为所有模型(包括法学硕士和其他 FM)构建、训练和运行推理。 我们正在使客户能够更轻松、更具成本效益地训练和部署具有两项新功能的大型模型。 首先,为了简化训练,我们 介绍 亚马逊 SageMaker HyperPod 它自动化了大规模容错分布式训练所需的更多流程 (例如,配置分布式训练库、在数千个加速器上扩展训练工作负载、检测和修复故障实例),将训练速度提高多达 40%。 因此,Perplexity AI、Hugging Face、Stability、Hippocratic、Alkaid 等客户正在使用 SageMaker HyperPod 来构建、训练或演化模型。 第二, 我们正在引入新功能,使推理更具成本效益,同时减少延迟。 SageMaker 现在帮助客户将多个模型部署到同一实例,以便他们可以共享计算资源,从而将推理成本降低 50%(平均)。 SageMaker 还主动监控正在处理推理请求的实例,并根据可用实例智能地路由请求,从而将推理延迟平均降低 20%。 由于这些推理优化,Conjecture、Salesforce 和 Slack 已经在使用 SageMaker 来托管模型。

堆栈的中间层:Amazon Bedrock 添加了新模型和一系列新功能,使客户能够更轻松地安全地构建和扩展生成式 AI 应用程序

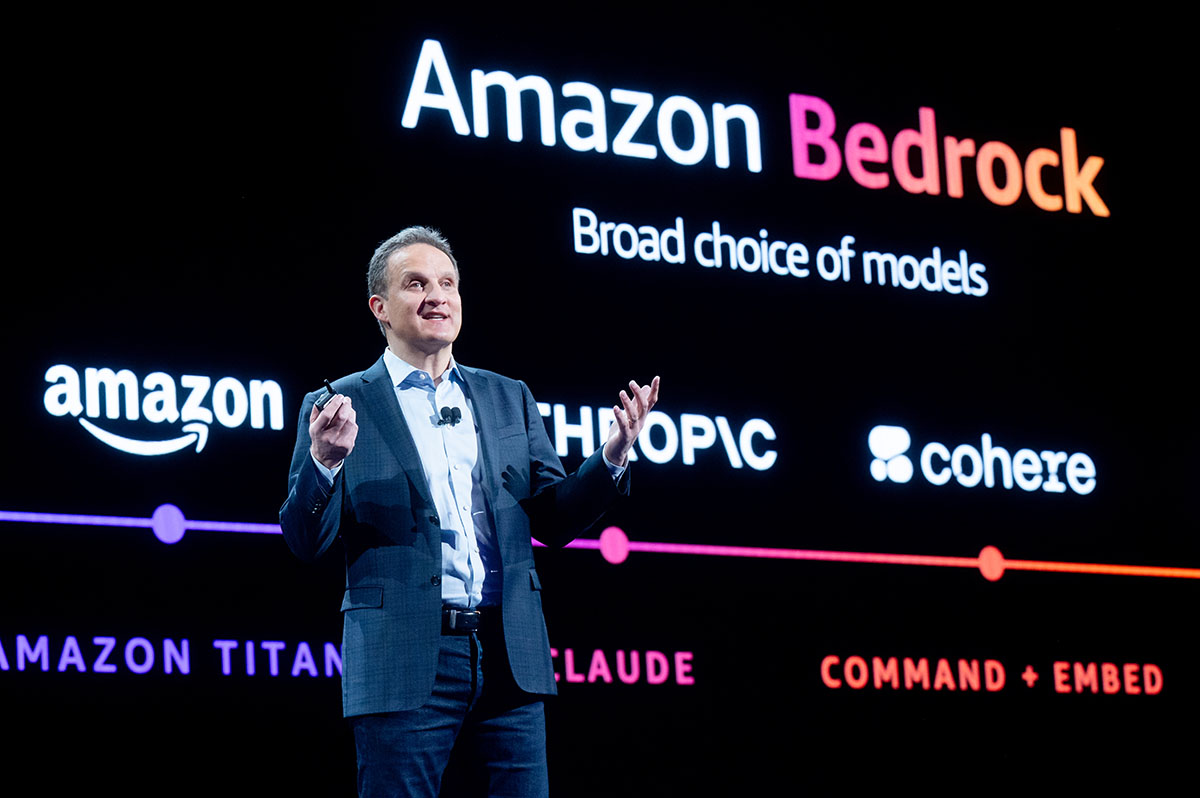

虽然许多客户将建立自己的法学硕士和其他 FM,或发展任意数量的公开可用选项,但许多客户不想花费资源和时间来做到这一点。 对于他们来说,堆栈的中间层将这些模型作为服务提供。 我们的解决方案在这里, 亚马逊基岩,允许客户从 Anthropic、Stability AI、Meta、Cohere、AI21 和 Amazon 的行业领先模型中进行选择,使用自己的数据对其进行定制,并利用他们习惯的所有相同的领先安全性、访问控制和功能在 AWS 中——全部通过托管服务实现。 我们于 XNUMX 月下旬全面推出 Amazon Bedrock,客户反应非常积极。 来自世界各地和几乎每个行业的客户都对使用 Amazon Bedrock 感到兴奋。 阿迪达斯使开发人员能够快速获得从“入门”信息到更深层次的技术问题的所有问题的答案。 Booking.com 打算使用生成式人工智能为每位客户编写量身定制的旅行建议。 Bridgewater Associates 正在开发由法学硕士支持的投资分析师助理,以帮助生成图表、计算财务指标和总结结果。 开利正在为客户提供更精确的能源分析和见解,以便他们减少能源消耗并减少碳排放。 科莱恩正在为其团队成员提供内部生成式人工智能聊天机器人,以加速研发流程、支持销售团队准备会议以及自动化客户电子邮件。 GoDaddy 正在帮助客户通过使用生成式 AI 来构建网站、寻找供应商、与客户建立联系等轻松在线建立业务。 Lexis Nexis Legal & Professional 正在通过 Lexis+ AI 对话式搜索、摘要以及文档起草和分析功能改变律师的法律工作并提高他们的工作效率。 纳斯达克正在帮助自动化可疑交易的调查工作流程,并加强其反金融犯罪和监控能力。 所有这些以及更多多样化的生成式 AI 应用程序都在 AWS 上运行。

我们对 Amazon Bedrock 的发展势头感到兴奋,但现在还处于早期阶段。 在与客户合作的过程中,我们发现每个人都在快速发展,但生成式人工智能仍在快速发展,新的选择和创新几乎每天都在发生。 客户发现有不同的模型更适合不同的用例或不同的数据集。 有些模型非常适合总结,其他模型非常适合推理和集成,还有一些模型具有非常出色的语言支持。 然后是图像生成、搜索用例等等——所有这些都来自专有模型和任何人都可以公开使用的模型。 在有太多事情不可知的时代,适应能力可以说是最有价值的工具。 不会有一种模式能够统治所有这些。 当然不仅仅是一家科技公司提供每个人都使用的模型。 客户需要尝试不同的模型。 他们需要能够在它们之间切换或将它们组合在同一用例中。 这意味着他们需要真正选择模型提供商(过去 10 天的事件已经更加清楚地表明了这一点)。 这就是我们发明 Amazon Bedrock 的原因,为什么它能与客户产生如此深刻的共鸣,以及为什么我们不断创新和快速迭代,使一系列模型的构建(以及在模型之间移动)像 API 调用一样简单,将最新技术融入其中让所有开发人员都能进行模型定制,并确保客户的安全及其数据的私密性。 我们很高兴推出几项新功能,使客户能够更轻松地构建和扩展生成式 AI 应用程序:

- Anthropic Claude 2.1、Meta Llama 2 70B 以及 Amazon Titan 系列的新成员扩大了型号选择。 在早期,客户仍在学习和试验不同的模型,以确定他们想要将哪些模型用于不同的目的。 他们希望能够轻松尝试最新模型,并进行测试以了解哪些功能和特性将为他们的用例带来最佳结果和成本特征。 借助 Amazon Bedrock,客户只需调用一次 API 即可获得新模型。 客户在过去几个月中经历的一些最令人印象深刻的结果来自法学硕士,例如 Anthropic 的克劳德模型,它擅长从复杂的对话和内容生成到复杂的推理等广泛的任务,同时保持高度的可靠性和可预测性。 客户报告说,与其他 FM 相比,Claude 产生有害输出的可能性要小得多,更容易与人交谈,并且更易于操纵,因此开发人员可以轻松地获得他们想要的输出。 Anthropic 的最先进模型 Claude 2 在 GRE 阅读和写作考试以及定量推理方面的得分均高于 90%。 和 现在,新发布的 Claude 2.1 模型已在 Amazon Bedrock 中提供。 Claude 2.1 为企业提供了关键功能,例如行业领先的 200K 令牌上下文窗口(Claude 2 上下文的 2.0 倍)、降低幻觉率以及显着提高准确性(即使在上下文长度很长的情况下)。 Claude 2.1 还包括改进的系统提示——这是为最终用户提供更好体验的模型指令——同时还将提示和完成的成本降低了 25%。

对于越来越多想要使用 Meta 公开提供的 Llama 2 模型托管版本的客户,Amazon Bedrock 提供了 Llama 2 13B,以及 我们正在添加 Llama 2 70B。 Llama 2 70B 适用于语言建模、文本生成、对话系统等大规模任务。 公开提供的 Llama 模型的下载量已超过 30 万次,客户喜欢 Amazon Bedrock 将它们作为托管服务的一部分提供,这样他们无需担心基础设施或团队拥有深厚的 ML 专业知识。 此外,对于图像生成,Stability AI 提供了一套流行的文本到图像模型。 Stable Diffusion XL 1.0 (SDXL 1.0) 是其中最先进的,现在在 Amazon Bedrock 中普遍可用。 这种流行图像模型的最新版本提高了准确性、更好的真实感和更高的分辨率。

客户也在使用 亚马逊泰坦 模型,这些模型由 AWS 创建和预训练,为各种用例提供强大的功能和巨大的经济效益。 亚马逊在机器学习和人工智能(我们在整个业务中使用的技术)方面拥有 25 年的业绩记录,并且我们在构建和部署模型方面学到了很多东西。 我们仔细选择了训练模型的方式以及用于训练模型的数据。 如果我们的模型或其输出侵犯任何人的版权,我们将对客户进行赔偿。 我们于今年四月推出了第一款 Titan 型号。 泰坦文本精简版——现在普遍可用——是一个简洁、经济高效的模型,适用于聊天机器人、文本摘要或文案写作等用例,而且也很容易进行微调。 Titan Text Express——现已全面上市- 更广泛,可用于更广泛的基于文本的任务,例如开放式文本生成和对话式聊天。 我们提供这些文本模型选项,使客户能够根据其用例和业务需求优化准确性、性能和成本。 Nexxiot、PGA Tour 和 Ryanair 等客户正在使用我们的两款 Titan Text 型号。 我们还有一个嵌入模型,Titan Text Embeddings,用于搜索用例和个性化。 像纳斯达克这样的客户正在使用 Titan Text Embeddings 来增强 Nasdaq IR Insight 的能力,从而获得巨大的成果,从而从 9,000 多家全球公司的文件中为可持续发展、法律和会计团队生成见解。 随着时间的推移,我们将继续为 Titan 系列添加更多型号。 我们正在引入一种新的嵌入模型,Titan Multimodal Embeddings,为使用图像和文本(或两者的组合)作为输入的用户提供多模式搜索和推荐体验。 我们是 引入新的文本到图像模型:Amazon Titan Image Generator。 借助 Titan Image Generator,广告、电子商务、媒体和娱乐等行业的客户可以使用文本输入以低成本大量生成逼真的工作室质量图像。 我们对客户对 Titan Models 的反应感到兴奋,您可以期待我们将继续在这里创新。

- 使用您的专有数据安全地定制生成人工智能应用程序的新功能:Amazon Bedrock 最重要的功能之一是自定义模型非常容易。 这对客户来说确实令人兴奋,因为这是生成式人工智能满足他们的核心差异化因素——数据的地方。 然而,非常重要的是,他们的数据保持安全,他们可以一直控制数据,并且模型改进对他们来说是私有的。 您可以通过多种方法来实现此目的,并且 Amazon Bedrock 提供跨多种型号的最广泛的自定义选项选择)。 首先是微调。 在 Amazon Bedrock 中微调模型很容易。 您只需选择模型,Amazon Bedrock 就会为其创建一个副本。 然后,您指向存储在 Amazon Simple Storage Service (Amazon S3) 中的一些带标签的示例(例如,一系列好的问答对),Amazon Bedrock 会“增量训练”(使用新信息增强复制的模型)在这些示例上,结果是一个私人的、更准确的微调模型,可以提供更相关、定制的响应。 我们很高兴地宣布,微调已普遍适用于 Cohere Command、Meta Llama 2、Amazon Titan Text(Lite 和 Express)、Amazon Titan Multimodal Embeddings 以及 Amazon Titan Image Generator 的预览版。 而且,通过与 Anthropic 的合作,我们很快将让 AWS 客户尽早获得模型定制和微调其最先进模型 Claude 的独特功能。

为您的业务定制 LLM 和其他 FM 的第二种技术是检索增强生成 (RAG),它允许您通过使用来自多个源(包括文档存储库、数据库和 API)的数据增强提示来定制模型的响应。 XNUMX 月,我们推出了 RAG 功能,即 Amazon Bedrock 知识库,可将模型安全地连接到您的专有数据源,以用更多信息补充您的提示,以便您的应用程序提供更相关、更符合上下文的准确响应。 知识库 现在通常可以使用执行整个 RAG 工作流程的 API 从获取增强提示所需的文本,到将提示发送到模型,再到返回响应。 知识库支持具有矢量功能的数据库,这些数据库存储数据的数字表示(嵌入),模型用于访问 RAG 的数据,包括 Amazon OpenSearch Service,以及其他流行的数据库,如 Pinecone 和 Redis Enterprise Cloud(Amazon Aurora 和 MongoDB 矢量支持即将推出)很快)。

在 Amazon Bedrock 中自定义模型的第三种方法是持续预训练。 通过这种方法,该模型建立在其原始的一般语言理解预训练的基础上,学习特定领域的语言和术语。 这种方法适用于拥有大量未标记的特定领域信息并希望其法学硕士能够理解其世界(和业务)特有的语言、短语、缩写、概念、定义和行话的客户。 与需要相当少量数据的微调不同,持续预训练是在大型数据集(例如,数千个文本文档)上执行的。 现在,Amazon Bedrock 中提供了 Titan Text Lite 和 Titan Text Express 的预训练功能。

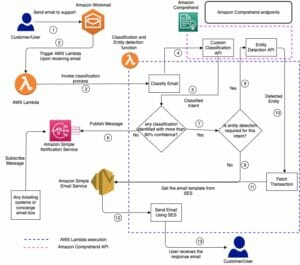

- 一般可用性 亚马逊基岩代理 使用系统、数据源和公司知识帮助执行多步骤任务。 法学硕士擅长对话和生成内容,但客户希望他们的应用程序能够 do 甚至更多,例如采取行动、解决问题并与一系列系统交互以完成多步骤任务,例如预订旅行、提交保险索赔或订购替换零件。 Amazon Bedrock 可以帮助应对这一挑战。 对于代理,开发人员选择一个模型,编写一些基本说明,例如“您是一个开朗的客户服务代理”和“检查库存系统中的产品可用性”,将所选模型指向正确的数据源和企业系统(例如,CRM)或 ERP 应用程序),并编写一些 AWS Lambda 函数来执行 API(例如,检查 ERP 库存中项目的可用性)。 Amazon Bedrock 自动分析请求,并使用所选模型的推理功能将其分解为逻辑序列,以确定需要哪些信息、要调用哪些 API 以及何时调用它们来完成步骤或解决任务。 现在普遍可用,代理可以规划和执行大多数业务任务——从回答客户有关产品可用性的问题到接受订单——开发人员不需要熟悉机器学习、工程师提示、训练模型或手动连接系统。 Bedrock 安全且私密地完成了所有这些工作,Druva 和 Athene 等客户已经在使用它们来提高其生成式 AI 应用程序的开发准确性和速度。

- 系统—— 亚马逊基岩护栏 因此您可以根据您的用例要求和负责任的人工智能政策应用保护措施。 客户希望确保与人工智能应用程序的交互是安全的,避免有毒或冒犯性语言,与他们的业务保持相关性,并符合他们负责任的人工智能政策。 借助护栏,客户可以指定要避免的主题,Amazon Bedrock 将仅向用户提供对属于这些受限类别的问题的经批准的答复。 例如,可以设置在线银行应用程序来避免提供投资建议,并删除不适当的内容(例如仇恨言论和暴力)。 2024 年初,客户还可以在模型响应中编辑个人身份信息 (PII)。 例如,在客户与呼叫中心代理交互后,通常会对客户服务对话进行汇总以保存记录,而护栏可以从这些汇总中删除 PII。 Guardrails 可跨 Amazon Bedrock 中的模型(包括微调模型)使用,并可与 Amazon Bedrock 代理一起使用,以便客户可以为其所有生成式 AI 应用程序提供一致级别的保护。

堆栈顶层:持续创新使更多用户可以使用生成式人工智能

该堆栈的顶层是利用 LLM 和其他 FM 的应用程序,以便您可以在工作中利用生成式 AI。 生成人工智能已经改变游戏规则的一个领域是编码。 去年,我们推出了 Amazon CodeWhisperer,它通过近乎实时地生成代码建议和推荐来帮助您更快、更安全地构建应用程序。 Accenture、Boeing、Bundesliga、The Cigna Group、Kone 和 Warner Music Group 等客户正在使用 CodeWhisperer 来提高开发人员的工作效率,而 Accenture 正在为多达 50,000 名软件开发人员和 IT 专业人员提供 Amazon CodeWhisperer。 我们希望尽可能多的开发人员能够获得生成式 AI 的生产力优势,这就是 CodeWhisperer 向所有个人免费提供建议的原因。

然而,虽然人工智能编码工具在让开发人员的生活变得更轻松方面做了很多工作,但由于缺乏对内部代码库、内部 API、库、包和类的了解,它们的生产力优势受到限制。 思考这个问题的一种方法是,如果您雇用了一位新开发人员,即使他们是世界一流的,在他们了解您的最佳实践和代码之前,他们在您的公司也不会那么高效。 今天的人工智能编码工具就像新聘的开发人员。 为了帮助解决这个问题,我们最近预览了一个新的 定制能力 Amazon CodeWhisperer 可以安全地利用客户的内部代码库来提供更相关、更有用的代码建议。 凭借此功能,CodeWhisperer 成为以下方面的专家: 选择您 代码并提供更相关的建议,以节省更多时间。 在我们与全球数字工程和企业现代化公司 Persistent 进行的一项研究中,我们发现自定义功能可帮助开发人员完成任务的速度比使用 CodeWhisperer 的一般功能快 28%。 现在,医疗保健技术公司的开发人员可以要求 CodeWhisperer“导入与客户 ID 相关的 MRI 图像,并通过图像分类器运行它们”以检测异常情况。 由于 CodeWhisperer 可以访问代码库,因此它可以提供更多相关建议,包括 MRI 图像和客户 ID 的导入位置。 CodeWhisperer 使定制完全保密,底层 FM 不会将它们用于培训,从而保护客户宝贵的知识产权。 AWS 是唯一一家向所有人提供此类功能的主要云提供商。

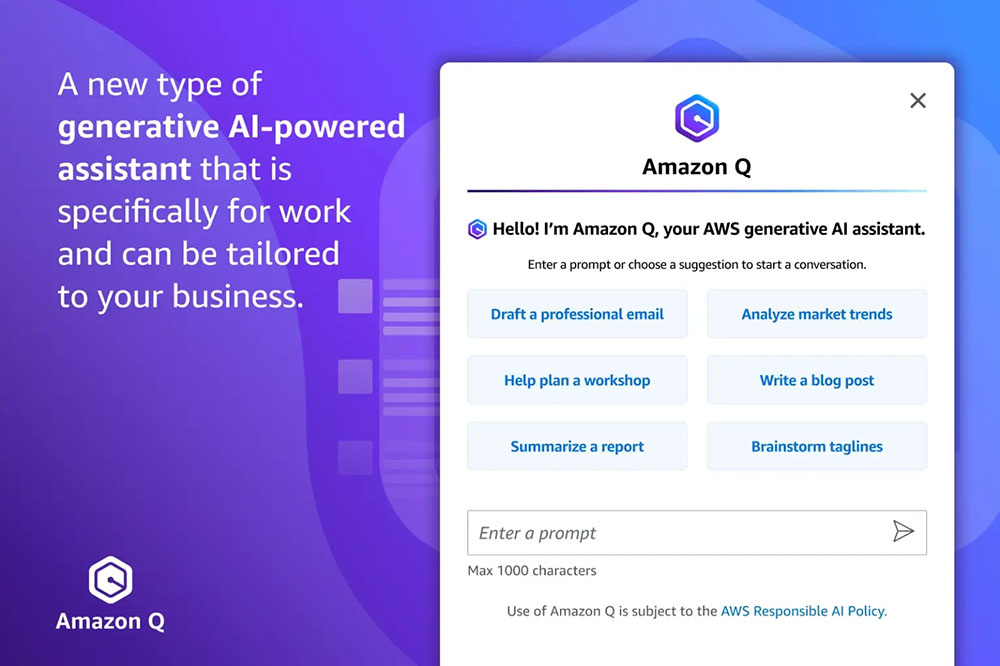

系统—— 亚马逊Q,专为工作量身定制的生成式人工智能助手

开发人员当然不是唯一接触生成式人工智能的人——数百万人正在使用生成式人工智能聊天应用程序。 早期提供商在这个领域所做的事情令人兴奋,并且对消费者来说非常有用,但在很多方面,他们在工作中并不太“有效”。 他们的常识和能力很好,但他们不了解您的公司、您的数据、您的客户、您的运营或您的业务。 这限制了他们可以帮助你的程度。 他们也不太了解你的角色——你做什么工作、和谁一起工作、你使用什么信息以及你可以访问什么。 这些限制是可以理解的,因为这些助理无权访问公司的私人信息,而且它们的设计初衷并不是为了满足公司授予他们这种访问权限所需的数据隐私和安全要求。 事后很难确保安全性并期望它能正常工作。 我们认为我们有更好的方法,可以让每个组织中的每个人在日常工作中安全地使用生成式人工智能。

W我们很高兴地介绍 Amazon Q 是一种新型生成式人工智能助手,专门用于工作,可以根据您的业务量身定制。 Q 可以帮助您快速获得紧迫问题的相关答案,解决问题,生成内容,并利用公司信息存储库、代码和企业系统中的数据和专业知识采取行动。 当您与 Amazon Q 聊天时,它会提供即时的相关信息和建议,以帮助简化任务、加快决策速度并帮助激发工作中的创造力和创新。 我们将 Amazon Q 构建为安全且私密的,它可以理解并尊重您现有的身份、角色和权限,并使用这些信息来个性化其交互。 如果用户在没有 Q 的情况下无权访问某些数据,则他们也无法使用 Q 访问该数据。 我们设计 Amazon Q 的目的是从第一天起就满足企业客户的严格要求——他们的任何内容都不会用于改进底层模型。

Amazon Q 是您的专家助手 用于在 AWS 上构建:我们利用 17 年的 AWS 知识和经验对 Amazon Q 进行了培训,因此它可以改变您在 AWS 上构建、部署和操作应用程序及工作负载的方式。 Amazon Q 在 AWS 管理控制台和文档、您的 IDE(通过 CodeWhisperer)以及 Slack 或其他聊天应用程序上的团队聊天室中拥有聊天界面。 Amazon Q 可以帮助您探索新的 AWS 功能、更快地入门、学习不熟悉的技术、构建解决方案、排除故障、升级等等 — 它是 AWS 架构良好的模式、最佳实践、文档和解决方案实施方面的专家。 以下是您可以使用新的 AWS 专家助理执行的操作的一些示例:

- 获取有关 AWS 功能、服务和解决方案的清晰答案和指导: 让 Amazon Q“告诉我有关 Amazon Bedrock 代理的信息”,Q 将为您提供该功能的描述以及相关材料的链接。 您还可以向 Amazon Q 询问几乎任何有关 AWS 服务如何工作的问题(例如,“DynamoDB 表的扩展限制是什么?”“什么是 Redshift 托管存储?”),或者如何最好地构建任意数量的解决方案( “构建事件驱动架构的最佳实践是什么?”)。 Amazon Q 将汇集简洁的答案,并始终引用(并链接到)其来源。

- 选择最适合您的使用案例的 AWS 服务并快速开始: 询问 Amazon Q“在 AWS 上构建 Web 应用程序的方法有哪些? ”并且它将提供潜在服务的列表,例如 AWS放大, AWS Lambda及 Amazon EC2 各有优点。 从那里,您可以通过帮助 Q 了解您的要求、偏好和约束来缩小选项范围(例如,“如果我想使用容器,哪一个最好?”或“我应该使用关系数据库还是非关系数据库? ”)。 以“我如何开始?”结束。 Amazon Q 将概述一些基本步骤,并为您提供其他资源。

- 优化您的计算资源: Amazon Q 可以帮助您选择 Amazon EC2 实例。 如果您要求它“帮我找到合适的 EC2 实例,为我的游戏应用程序部署具有最高性能的视频编码工作负载”,Q 将为您提供一个实例系列列表,并附有每个建议的理由。 而且,您可以提出任意数量的后续问题,以帮助找到适合您工作负载的最佳选择。

- 获取调试、测试和优化代码方面的帮助: 如果您在 IDE 中编码时遇到错误,您可以通过说“我的代码有 IO 错误,您能提供修复吗?”来请求 Amazon Q 提供帮助。 Q 将为您生成代码。 如果您喜欢该建议,您可以要求 Amazon Q 将修复添加到您的应用程序中。 由于 Amazon Q 位于您的 IDE 中,因此它可以理解您正在处理的代码并知道在哪里插入修复程序。 Amazon Q 还可以创建单元测试(“为所选函数编写单元测试”),并将其插入到您的代码中并运行。 最后,Amazon Q 可以告诉您优化代码以获得更高性能的方法。 让 Q“优化我选择的 DynamoDB 查询”,它将利用其对代码的理解来提供关于要修复的内容的自然语言建议以及您可以一键实施的随附代码。

- 诊断和解决问题: 如果您在 AWS 管理控制台中遇到问题,例如 EC2 权限错误或 Amazon S3 配置错误,您只需按“使用 Amazon Q 进行故障排除”按钮,它将利用其对错误类型和错误所在服务的理解为您提供修复建议。 您甚至可以要求 Amazon Q 对您的网络进行故障排除(例如,“为什么我无法使用 SSH 连接到我的 EC2 实例?”),Q 将分析您的端到端配置并提供诊断(例如,“此实例似乎位于私有子网中,因此可能需要建立公共可访问性”)。

- 立即建立新的代码库: 当您在 IDE 中与 Amazon Q 聊天时,它会将其在构建软件方面的专业知识与对您的代码的理解结合起来 — 一对强大的组合! 以前,如果您从其他人那里接手了一个项目,或者您是团队的新成员,您可能需要花费数小时手动检查代码和文档,以了解它的工作原理和用途。 现在,由于 Amazon Q 可以理解您 IDE 中的代码,因此您只需要求 Amazon Q 解释该代码(“向我提供此应用程序的功能及其工作原理的描述”),Q 就会为您提供详细信息,例如哪些服务代码使用以及不同函数的作用(例如,Q 可能会回答“此应用程序正在使用 Python Flask 和 AWS Lambda 构建基本支持票证系统”,然后继续描述其每个核心功能及其实现方式,以及更多)。

- 更快地清除积压的功能: 您甚至可以要求 Amazon Q 指导您完成向应用程序添加功能的大部分端到端流程并实现自动化 亚马逊代码催化剂,我们为团队提供的统一软件开发服务。 为此,您只需从问题列表中为 Q 分配一个积压任务(就像您为队友分配任务一样),Q 会生成一个关于如何构建和实现该功能的分步计划。 一旦您批准该计划,Q 将编写代码并向您提供建议的更改作为代码审查。 您可以请求返工(如有必要)、批准和/或部署!

- 只需一小部分时间即可升级您的代码: 大多数开发人员实际上只花费一小部分时间编写新代码和构建新应用程序。 他们将更多的时间花在痛苦、麻烦的领域,比如维护和升级。 采取语言版本升级。 许多客户继续使用旧版本的 Java,因为升级需要数月甚至数年以及数千小时的开发时间。 推迟这样做会带来实际成本和风险——您会错过性能改进的机会,并且容易受到安全问题的影响。 我们认为 Amazon Q 可以改变游戏规则,并且对此感到兴奋 亚马逊Q码转型,该功能可以消除大量繁重的工作,并将应用程序升级所需的时间从几天缩短到几分钟。 您只需在 IDE 中打开要更新的代码,然后要求 Amazon Q “/transform”您的代码。 Amazon Q 将分析应用程序的整个源代码,生成目标语言和版本的代码并执行测试,帮助您实现最新语言版本的安全性和性能增强。 最近,一个非常小的 Amazon 开发人员团队使用 Amazon Q Code Transformation 在短短两天内将 1,000 个生产应用程序从 Java 8 升级到 Java 17。 每次申请的平均时间不到10分钟。 今天,Amazon Q Code Transformation 执行从 Java 8 或 Java 11 到 Java 17 的 Java 语言升级。接下来(很快)将能够将 .NET Framework 转换为跨平台 .NET(将来还会进行更多转换) 。

Amazon Q 是您的业务专家:您可以将 Amazon Q 连接到您的业务数据、信息和系统,以便它可以综合所有内容并提供量身定制的帮助,帮助人们解决问题、生成内容并采取与您的业务相关的操作。 将 Amazon Q 引入您的企业非常简单。 它具有 40 多个内置连接器,可连接流行的企业系统,例如 Amazon S3、Microsoft 365、Salesforce、ServiceNow、Slack、Atlassian、Gmail、Google Drive 和 Zendesk。 它还可以连接到您的内部 Intranet、wiki 和运行手册,并且通过 Amazon Q SDK,您可以建立与您想要的任何内部应用程序的连接。 将 Amazon Q 指向这些存储库,它将“加速”您的业务,捕获并理解使您的公司独一无二的语义信息。 然后,您将获得自己友好且简单的 Amazon Q Web 应用程序,以便公司内的员工可以与对话界面进行交互。 Amazon Q 还连接到您的身份提供商以了解用户、他们的角色以及他们被允许访问哪些系统,以便用户可以提出详细、细致的问题并获得量身定制的结果,其中仅包括他们有权查看的信息。 Amazon Q 生成准确且忠实于您提供的材料和知识的答案和见解,并且您可以限制敏感主题、阻止关键字或过滤掉不适当的问题和答案。 以下是您可以使用企业的新专家助理执行哪些操作的一些示例:

- 根据您的业务数据和信息获得清晰、超级相关的答案: 员工可以向 Amazon Q 询问他们以前可能需要通过各种来源搜索的任何内容。 询问“徽标使用的最新指南是什么?”或“如何申请公司信用卡?”,Amazon Q 将综合其找到的所有相关内容,并提供快速答案以及相关链接的链接来源(例如,品牌门户和徽标存储库、公司 T&E 政策和卡应用程序)。

- 简化日常沟通: 只要提出要求,Amazon Q 就可以生成内容(“创建一篇博客文章和三个社交媒体标题,宣布本文档中描述的产品”),创建执行摘要(“用项目符号列表编写我们的会议记录摘要”) ),提供电子邮件更新(“起草一封电子邮件,重点介绍我们为印度客户提供的第三季度培训计划”),并帮助组织会议(“创建会议议程来讨论最新的客户满意度报告”)。

- 完成任务: Amazon Q 可以帮助完成某些任务,减少员工花在提交票据等重复性工作上的时间。 要求 Amazon Q “总结客户对 Slack 中新定价优惠的反馈”,然后要求 Q 获取该信息并在 Jira 中开立票证以更新营销团队。 您可以要求 Q“总结此通话记录”,然后“在 Salesforce 中为客户 A 打开一个新案例”。 Amazon Q 支持其他流行的工作自动化工具,例如 Zendesk 和 Service Now。

Amazon Q 位于 Amazon QuickSight 中: QuickSight 中的 Amazon QAWS 的商业智能服务,用户可以向仪表板提出问题,例如“为什么上个月订单数量增加?” 并获得影响增长的因素的可视化和解释。 而且,分析师可以使用 Amazon Q 将构建仪表板所需的时间从几天缩短到几分钟,并提供简单的提示(例如“以堆积条形图的形式显示按地区按月的销售额”)。 Q 立即返回该图表,您可以轻松地将其添加到仪表板或与 Q 进一步聊天以完善可视化(例如,“将条形图更改为桑基图”或“显示国家/地区而不是地区”)。 QuickSight 中的 Amazon Q 还可以更轻松地使用现有仪表板向业务利益相关者提供信息、提取关键见解并使用数据故事简化决策。 例如,用户可能会提示 Amazon Q“构建一个关于上个月业务发生变化的故事,以便与高级领导层进行业务审查”,几秒钟内,Amazon Q 就会提供一个视觉上引人注目且易于理解的数据驱动故事。完全可定制。 这些故事可以在整个组织内安全地共享,以帮助协调利益相关者并推动更好的决策。

Amazon Q 位于 Amazon Connect 中: 在我们的联络中心服务 Amazon Connect 中,Amazon Q 可以帮助您的客户服务代理提供更好的客户服务。 Amazon Q 利用代理通常用来获取客户信息的知识存储库,然后代理可以直接在 Connect 中与 Amazon Q 聊天以获得答案,从而帮助他们更快地响应客户请求,而无需自己搜索文档。 而且,虽然与 Amazon Q 聊天以获得超快答案很棒,但在客户服务中没有什么太快了。 这就是为什么 亚马逊 Q 连接 将客户与客服人员的实时对话转化为提示,并自动向客服人员提供可能的响应、建议的操作以及资源链接。 例如,Amazon Q 可以检测到客户正在联系租车公司更改其预订,为代理生成响应以快速传达该公司的变更费用政策如何适用,并指导代理完成更新预订所需的步骤。预订。

Amazon Q 已加入 AWS 供应链(即将推出): 在我们的供应链洞察服务 AWS Supply Chain 中,Amazon Q 通过总结和突出潜在缺货或库存过剩风险以及可视化解决问题的场景,帮助供需规划人员、库存经理和贸易合作伙伴优化供应链。 用户可以向 Amazon Q 询问有关其供应链数据的“什么”、“为什么”和“如果”等问题,并通过复杂的场景以及不同供应链决策之间的权衡进行聊天。 例如,客户可能会问:“是什么导致我的发货延迟?我怎样才能加快速度?” Amazon Q 可能会回复:“您 90% 的订单都在东海岸,东南部的一场大风暴导致了 24 小时的延误。 如果您运送到纽约港而不是迈阿密,您将加快交货速度并降低 50% 的成本。”

我们的客户正在快速采用生成式 AI - 他们在 AWS 上训练突破性的模型,他们正在使用 Amazon Bedrock 以创纪录的速度开发生成式 AI 应用程序,并且他们正在整个组织中部署改变游戏规则的应用程序(例如 Amazon Q)。根据我们的最新公告,AWS为客户在堆栈的每一层带来更多的性能、选择和创新。 我们在 re:Invent 提供的所有功能的综合影响标志着实现令人兴奋且有意义的目标的一个重要里程碑:我们正在使各种规模和技术能力的客户都可以使用生成式人工智能,以便他们能够重新发明和改变什么是可能的。

资源

关于作者

斯瓦米·西瓦苏布拉马尼安 是 AWS 数据和机器学习副总裁。 在此职位上,Swami 负责监督所有 AWS 数据库、分析以及 AI 和机器学习服务。 他的团队的使命是帮助组织使用完整的端到端数据解决方案将他们的数据用于存储、访问、分析、可视化和预测。

斯瓦米·西瓦苏布拉马尼安 是 AWS 数据和机器学习副总裁。 在此职位上,Swami 负责监督所有 AWS 数据库、分析以及 AI 和机器学习服务。 他的团队的使命是帮助组织使用完整的端到端数据解决方案将他们的数据用于存储、访问、分析、可视化和预测。

- :具有

- :是

- :不是

- :在哪里

- $UP

- 000

- 1

- 10

- 100

- 11

- 12

- 17

- 200

- 2019

- 2024

- 25

- 30

- 35%

- 40

- 50

- 500

- 7

- 8

- 9

- a

- 能力

- 对,能力--

- Able

- 关于

- 以上

- 加快

- 加速

- 加速器

- Accenture

- ACCESS

- 访问

- 无障碍

- 基本会计和财务报表

- 精准的

- 获得

- 横过

- 操作

- 行动

- 积极地

- 通

- 适应

- 加

- 添加

- 添加

- 增加

- 额外

- 另外

- 增加

- 添加

- Adidas

- 土砖

- 采用

- 高级

- 前进

- 优点

- 优点

- 广告

- 忠告

- 后

- 驳

- 议程

- 经纪人

- 中介代理

- 骨料

- 前

- AI

- 人工智能与机器学习

- AI聊天机器人

- 研究

- AI供电

- 对齐

- 所有类型

- 让

- 允许

- 沿

- 已经

- 还

- 时刻

- Amazon

- 亚马逊 CodeWhisperer

- Amazon EC2

- 亚马逊开放搜索服务

- 亚马逊QuickSight

- 亚马逊SageMaker

- 亚马逊网络服务

- 量

- 量

- an

- 分析

- 分析人士

- 分析师

- 分析

- 分析

- 分析

- 和

- 宣布

- 最新公告

- 宣布

- 异常

- 回答

- 答案

- 人类的

- 任何

- 任何人

- 什么

- API

- APIs

- 应用

- 出现

- 应用领域

- 应用领域

- 使用

- 欣赏

- 的途径

- 批准

- 批准

- 应用

- 四月

- 保健

- 国家 / 地区

- 地区

- 按理说

- 围绕

- AS

- 问

- 帮助

- 助理

- 助理

- 相关

- 联营公司

- At

- 增加

- 增强

- 增强

- Aurora

- 授权

- 自动化

- 自动化

- 自动表

- 自动

- 自动化和干细胞工程

- 汽车

- 可用性

- 可使用

- 避免

- 远离

- AWS

- AWS 推理

- AWS Lambda

- AWS管理控制台

- 背部

- 银行业

- 酒吧

- 障碍

- 基地

- 基于

- 基本包

- BE

- 因为

- 成为

- 很

- 开始

- 相信

- 好处

- 最佳

- 最佳实践

- 更好

- 之间

- 大

- 亿

- 十亿美元

- 阻止

- 吹氣梢

- 博客

- 波音

- 博尔特

- 预订

- Booking.com

- 书籍

- 都

- 半身裙/裤

- 边界

- 品牌

- 午休

- 休息

- 带来

- 瞻

- 建立

- 建筑物

- 建立

- 建

- 内建的

- 商业

- 商业智能

- 企业

- 但是

- 按键

- by

- 呼叫

- 呼叫中心

- CAN

- 可以得到

- 能力

- 能力

- 能力

- 容量

- 捕获

- 汽车

- 碳

- 碳排放量

- 卡

- 小心

- 案件

- 例

- 类别

- 造成

- Center

- 一定

- 当然

- 链

- 挑战

- 挑战

- 更改

- 变

- 换

- 更改

- 改变

- 特点

- 图表

- 图表

- 聊天室

- 聊天机器人

- 聊天机器人

- 聊天的

- 查

- 芯片

- 碎屑

- 选择

- 选择

- 选择

- 索赔

- 类

- 清洁

- 清除

- 点击

- 云端技术

- 云基础设施

- 簇

- 集群

- 滨

- 码

- 代码库

- 代码审查

- 编码

- 合作

- 合作

- COM的

- 组合

- 结合

- 结合

- 结合

- 如何

- 购买的订单均

- 未来

- 即将公开信息

- 通信

- 通信

- 公司

- 公司

- 公司的

- 相比

- 引人注目

- 完成

- 完全

- 复杂

- 复杂

- 全面

- 计算

- 概念

- 配置

- 配置

- 推测

- 分享链接

- 已联繫

- 地都

- 连接方式

- 所连接

- 一贯

- 安慰

- 约束

- 消费者

- 消费

- CONTACT

- 联络中心

- 集装箱

- 内容

- 内容生成

- 上下文

- 上下文

- 继续

- 持续

- 继续

- 继续

- 控制

- 控制

- 谈话

- 听起来像对话

- 对话

- 版权

- 文案

- 核心

- 价格

- 经济有效

- 成本

- 国家

- 考克斯

- 创建信息图

- 创建

- 创造力

- 创作者

- 信用

- 信用卡

- 犯罪

- 客户关系管理

- 顾客

- 客户体验

- 客户满意度

- 客户服务

- 合作伙伴

- 定制

- 定制

- 定制

- 定制

- 切

- 周期

- 每天

- XNUMX月XNUMX日

- 仪表板

- data

- 资料准备

- 数据隐私

- 数据隐私与安全

- 数据集

- 数据驱动

- 数据库

- 数据库

- 天

- 日复一日

- 一年中的

- 决策

- 决定

- 深

- 深入学习

- 更深

- 定义

- 学位

- 延迟

- 交付

- 交付

- 交付

- 提供

- 需求

- 民主化

- 根据

- 部署

- 部署

- 部署

- 部署

- 深度

- 描述

- 描述

- 描述

- 设计

- 期望

- 详细

- 详情

- 检测

- 确定

- 德意志电信

- 开发商

- 开发

- 发展

- 研发支持

- 诊断

- 对话框

- 对话

- DID

- 不同

- 扩散

- 数字

- 直接

- 分发

- 分布

- 分布式培训

- 分布

- do

- 文件

- 文件

- 文件

- 不

- 不会

- 做

- 完成

- 别

- 加倍

- 向下

- 驾驶

- 两

- 重复

- 为期

- e

- 电子商务行业

- 每

- 早

- 更容易

- 容易

- 东部

- 易

- 经济学

- 版

- 只

- 效率

- 有效

- 努力

- 或

- 其他

- 邮箱地址

- 电子邮件

- 排放

- 员工

- 授权

- 授权

- enable

- 使

- 编码

- 结束

- 端至端

- 能源

- 能源消费

- 工程师

- 工程师

- 提高

- 增强

- 充实

- 企业

- 企业级

- 企业

- 娱乐

- 整个

- 信封

- 时代

- ERP

- 错误

- 故障

- 评价

- 甚至

- 事件

- EVER

- 所有的

- 每个人

- 一切

- 进化

- 发展

- 例子

- 例子

- 兴奋

- 令人兴奋的

- 执行

- 执行

- 现有

- 膨胀

- 期望

- 促进

- 昂贵

- 体验

- 有经验

- 体验

- 技术专家

- 专门知识

- 说明

- 探索

- 特快

- 布

- 面部彩妆

- 事实

- 因素

- 相当

- 忠实

- 秋季

- 熟悉

- 家庭

- 家庭

- 高效率

- 快

- 故障

- 专栏

- 特征

- 费

- 反馈

- 少数

- 备案

- 过滤

- 终于

- 金融

- 找到最适合您的地方

- 寻找

- 发现

- 结束

- 完

- 姓氏:

- 固定

- 柔软

- 重点

- 遵循

- 针对

- 对于消费者

- 向前

- 发现

- 基金会

- 四

- 分数

- 骨架

- 框架

- Free

- 频繁

- 友好

- 止

- 功能

- 进一步

- 未来

- 游戏

- 改变游戏规则

- 赌博

- 其他咨询

- 通常

- 生成

- 产生

- 发电

- 代

- 生成的

- 生成式人工智能

- 发电机

- 得到

- 越来越

- 给

- 全球

- 全球数字

- Go

- 目标

- 去

- 非常好

- 谷歌

- GPU

- 图形处理器

- 大

- 陆运

- 奠基

- 团队

- 成长

- 长大的

- 指导

- 指南

- 方针

- 民政事务总署

- 手

- 事件

- 硬

- 硬件

- 有害

- 恨

- 有

- 有

- 头条新闻

- 医疗保健

- 重

- 举重

- 帮助

- 帮助

- 帮助

- 相关信息

- 高

- 更高

- 最高

- 突出

- 高度

- 聘请

- 他的

- 托管

- HOURS

- 创新中心

- How To

- 但是

- HTTPS

- 数百

- i

- ID

- 身份

- 身分

- IDS

- if

- 图片

- 图片

- 即时

- 影响力故事

- 实施

- 实现

- 实施

- 进口

- 重要

- 有声有色

- 改善

- 改善

- 改善

- in

- 包括

- 包括

- 包含

- 增加

- 增加

- 增加

- 指标

- 个人

- 行业

- 行业中的应用:

- 行业领先

- 影响

- info

- 通知

- 信息

- 基础设施

- 创新

- 创新

- 創新

- 创新

- 创新

- 输入

- 输入

- 洞察

- 可行的洞见

- 例

- 代替

- 研究所

- 说明

- 保险

- 积分

- 知识分子

- 知识产权

- 房源搜索

- 拟

- 相互作用

- 互动

- 交互

- 互联

- 接口

- 内部

- 干预

- 成

- 介绍

- 介绍

- 介绍

- 发明

- 库存

- 投资

- 研究

- 投资

- 投资

- 投资

- 参与

- 问题

- IT

- 它的

- 日文

- 行话

- 爪哇岛

- JPG

- 只是

- 只有一个

- 保持

- 保持

- 保持

- 键

- 重点领域

- 关键词

- 套件 (SDK)

- 知道

- 知识

- 知道

- 实验室

- 缺乏

- 语言

- 大

- 大规模

- 最大

- 名:

- 去年

- 晚了

- 潜伏

- 最新

- 推出

- 发射

- 律师

- 层

- 层

- 领导团队

- 领导

- 学习用品

- 知道

- 学习

- 法律咨询

- 减

- 让

- Level

- 杠杆作用

- 杠杆

- LexisNexis(律商联讯)

- LG

- 库

- 生命周期

- 翻新

- 喜欢

- 容易

- 限制

- 有限

- 范围

- 线

- 友情链接

- 链接

- 清单

- 生活

- 生活

- 骆驼

- LLM

- 位于

- 地点

- 合乎逻辑的

- 商标

- 长

- 由来已久

- 占地

- 爱

- 低

- 降低

- 最低

- 机

- 机器学习

- 制成

- 保持

- 维护

- 保养

- 主要

- 使

- 制作

- 制作

- 管理

- 颠覆性技术

- 经理

- 手册

- 体力劳动

- 手动

- 许多

- 营销

- 材料

- 物料

- 最多

- 可能..

- me

- 有意义的

- 手段

- 媒体

- 满足

- 会议

- 会议

- 会见

- 成员

- 聚体

- 元

- 方法

- 迈阿密

- 微软

- 中间

- 可能

- 里程碑

- 分钟

- 错过

- 使命

- ML

- 模型

- 造型

- 模型

- 动力泉源

- MongoDB的

- 显示器

- 月

- 个月

- 更多

- 最先进的

- 最受欢迎的产品

- 移动

- MRI

- 许多

- 多

- 音乐

- 必须

- my

- 姓名

- 狭窄

- 纳斯达克

- 自然

- 近

- 必要

- 需求

- 打印车票

- 需要

- 净

- 网络

- 工业网络

- 全新

- 纽约

- 新

- 下页

- 硝基

- 没有

- 现在

- 数

- Nvidia公司

- of

- 折扣

- 进攻

- 提供

- 提供

- 优惠精选

- 经常

- 老年人

- on

- 一旦

- 一

- 那些

- 在线

- 网上银行

- 仅由

- 打开

- 操作

- 运营

- 优化

- 优化

- 追求项目的积极优化

- 附加选项

- or

- 订单

- 组织

- 组织

- 原版的

- 其他名称

- 其它

- 我们的

- 输出

- 轮廓

- 产量

- 输出

- 超过

- 积压

- 压倒性

- 己

- 步伐

- 包

- 痛苦

- 对

- 参数

- 参数

- 部分

- 伙伴

- 部分

- 过去

- 模式

- 暂停

- 员工

- 为

- 演出

- 性能

- 执行

- 施行

- 允许

- 权限

- 人

- 个性化

- 个性化

- 亲自

- PGA巡回赛

- 短语

- 地方

- 计划

- 柏拉图

- 柏拉图数据智能

- 柏拉图数据

- 加

- 点

- 政策

- 热门

- 积极

- 可能

- 帖子

- 潜力

- 功率

- 供电

- 强大

- 实用

- 几乎

- 做法

- 精确的

- 预测

- 预测

- 喜好

- 准备

- Prepare

- 当下

- 总统

- express

- 紧迫

- 预览

- 先前

- 车资

- 价格

- 小学

- 隐私

- 隐私和安全

- 私立

- 私人信息

- 市场问题

- 问题

- 过程

- 过程

- 处理

- 生产

- 产品

- 生产

- 生产力

- 生产率

- 所以专业

- 专业人士

- 训练课程

- 项目

- 提示

- 财产

- 所有权

- 保护

- 保护

- 提供

- 提供者

- 供应商

- 提供

- 优

- 国家

- 公然

- 目的

- 推

- 推动

- 放

- 把

- 蟒蛇

- pytorch

- Q3

- 量

- 题

- 有疑问吗?

- 快速

- 很快

- 相当

- 研发

- 范围

- 快

- 急速

- 价格表

- RE

- 阅读

- 真实

- 实时的

- 现实

- 实现

- 实现

- 真

- 收割

- 原因

- 最近

- 推荐

- 建议

- 记录

- 减少

- 减少

- 减少

- 提炼

- 地区

- 发布

- 相应

- 可靠性

- 遗迹

- 去掉

- 删除

- 修复

- 重复的

- 替代

- 一个回复

- 报告

- 知识库

- 请求

- 要求

- 必须

- 岗位要求

- 研究

- 预订

- 保留区(Reserve)

- 分辨率

- 共振

- 资源

- 尊重

- 回应

- 回应

- 响应

- 回复

- 提供品牌战略规划

- 限制

- 受限

- 导致

- 成果

- 返回

- 检讨

- 回顾

- 右

- 风险

- 角色

- 角色

- 房间数

- 路线

- 第

- 运行

- 运行

- 跑道

- 牺牲

- 安全

- 保障

- 安然

- sagemaker

- 销售

- Salesforce的

- 同

- 满意

- 保存

- 说

- 鳞片

- 缩放

- 情景

- 范围

- 划伤

- SDK

- 无缝的

- 搜索

- 其次

- 第二代

- 秒

- 安全

- 安全

- 保安

- 看到

- 看到

- 看到

- 选择

- 选

- 选择

- 发送

- 前辈

- 高层领导

- 敏感

- 九月

- 序列

- 系列

- 服务器

- 服务

- 特色服务

- 集

- 套数

- 几个

- Share

- 共用的,

- 船

- 短

- 应该

- 侧

- 显著

- 硅

- 同样

- 简易

- 简化

- 只是

- 自

- SIX

- 尺寸

- 松弛

- 小

- So

- 社会

- 社会化媒体

- 软件

- 软件开发者

- 软件开发

- 软件开发工具包

- 方案,

- 解决方案

- 解决

- 一些

- 有人

- 东西

- 或很快需要,

- 极致

- 来源

- 源代码

- 来源

- 东南

- 太空

- 火花

- 特别是

- 言语

- 速度

- 花

- 稳定性

- 稳定

- 堆

- 堆叠

- 利益相关者

- 开始

- 开始

- 初创企业

- 国家的最先进的

- 留

- 步

- 步骤

- 仍

- 存储

- 商店

- 商店

- 故事

- 风暴

- 故事

- 精简

- 加强

- 严格

- 结构体

- 学习

- 子网

- 大量

- 这样

- 合适的

- 套房

- 总结

- 概要

- 超级

- 补充

- 供销商

- 供应

- 供需平衡

- 供应链

- SUPPORT

- 支持

- 肯定

- 奇怪

- 监控

- 可疑

- 永续发展

- Switch 开关

- 综合

- 系统

- 产品

- 表

- 量身定制

- 采取

- 需要

- 服用

- 谈论

- 目标

- 任务

- 任务

- 团队

- 团队成员

- 队

- 文案

- 技术

- 技术

- 技术

- 专业技术

- 技术创新

- 展示

- 告诉

- 十

- HAST

- tensorflow

- 术语

- test

- 测试

- 测试

- 文本

- 比

- 这

- 未来

- 世界

- 其

- 他们

- 他们自己

- 然后

- 那里。

- 博曼

- 他们

- 事

- 事

- 认为

- 第三

- Free Introduction

- 今年

- 那些

- 数千

- 三

- 通过

- 始终

- 吞吐量

- 票

- 门票

- 次

- 时

- 泰坦

- 至

- 今晚

- 今天的

- 一起

- 象征

- 也有

- 了

- 工具

- 工具

- 最佳

- Topics

- 教程

- 对于

- 向

- 跟踪时

- 跟踪记录

- 交易

- 培训

- 熟练

- 产品培训

- 交易

- 成绩单

- 改造

- 转型

- 转换

- 转型

- 旅行

- 万亿

- 旅

- 真正

- 信任

- 尝试

- 试图

- 调音

- 原来

- 二

- 类型

- 一般

- 相关

- 理解

- 可理解的

- 理解

- 理解

- 陌生

- 统一

- 独特

- 单元

- 不像

- 直到

- 更新

- 最新动态

- 升级

- 升级

- us

- 用法

- 使用

- 用例

- 用过的

- 用户

- 用户

- 使用

- 运用

- 有价值

- 各种

- 各个

- 版本

- 版本

- 与

- 非常

- 通过

- 副

- 副总裁

- 视频

- 暴力

- 实质上

- 可视化

- 想像

- 视觉

- 卷

- 脆弱

- 想

- 华纳

- 华纳音乐集团

- 是

- 波

- 方法..

- 方法

- we

- 卷筒纸

- Web应用程序

- Web服务

- 网站

- 周

- 周

- 欢迎进入

- 井

- 知名

- 为

- 什么是

- 什么是

- ,尤其是

- 是否

- 这

- 而

- WHO

- 为什么

- 宽

- 大范围

- 更宽

- 将

- 窗口

- 中

- 也完全不需要

- 工作

- 工作

- 工作流程

- 加工

- 合作

- 世界

- 世界级

- 担心

- 价值

- 将

- 写

- 写代码

- 写作

- 年

- 年

- 纽约

- 完全

- 您一站式解决方案

- Zendesk

- 和风网