لقد قطع الذكاء الاصطناعي للمحادثة شوطا طويلا في السنوات الأخيرة بفضل التطورات السريعة في الذكاء الاصطناعي التوليدي، وخاصة تحسينات أداء نماذج اللغات الكبيرة (LLMs) التي قدمتها تقنيات التدريب مثل ضبط التعليمات والتعلم المعزز من ردود الفعل البشرية. عند المطالبة بشكل صحيح، يمكن لهذه النماذج إجراء محادثات متماسكة دون أي بيانات تدريب خاصة بالمهمة. ومع ذلك، لا يمكنهم تعميم الأسئلة الخاصة بالمؤسسة بشكل جيد، لأنهم يعتمدون، للحصول على إجابة، على البيانات العامة التي تعرضوا لها أثناء التدريب المسبق. غالبًا ما تفتقر مثل هذه البيانات إلى المعرفة المتخصصة الواردة في المستندات الداخلية المتوفرة في الشركات الحديثة، والتي تكون مطلوبة عادةً للحصول على إجابات دقيقة في مجالات مثل الأبحاث الصيدلانية والتحقيق المالي ودعم العملاء.

لإنشاء مساعدين للذكاء الاصطناعي قادرين على إجراء مناقشات ترتكز على المعرفة المؤسسية المتخصصة، نحتاج إلى ربط برامج LLM القوية ولكن العامة بقواعد المعرفة الداخلية للمستندات. تُسمى هذه الطريقة لإثراء سياق إنشاء LLM بالمعلومات المستردة من مصادر البيانات الداخلية الخاصة بك بـ Retrieval Augmented Generation (RAG)، وتنتج مساعدين خاصين بالمجال وأكثر جدارة بالثقة، كما هو موضح بواسطة الاسترجاع المعزز لمهام البرمجة اللغوية العصبية المكثفة بالمعرفة. الدافع الآخر وراء شعبية RAG هو سهولة التنفيذ ووجود حلول بحث متجهة ناضجة، مثل تلك التي تقدمها أمازون كندرا (انظر تطلق Amazon Kendra واجهة برمجة تطبيقات الاسترجاع) و خدمة Amazon OpenSearch (انظر k-أقرب جار (k-NN) للبحث في Amazon OpenSearch Service)، من بين أمور أخرى.

ومع ذلك، فإن نمط تصميم RAG الشائع مع البحث الدلالي لا يمكنه الإجابة على جميع أنواع الأسئلة المحتملة في المستندات. وينطبق هذا بشكل خاص على الأسئلة التي تتطلب تفكيرًا تحليليًا عبر مستندات متعددة. على سبيل المثال، تخيل أنك تخطط لاستراتيجية العام المقبل لشركة استثمارية. وتتمثل إحدى الخطوات الأساسية في تحليل ومقارنة النتائج المالية والمخاطر المحتملة للشركات المرشحة. تتضمن هذه المهمة الإجابة على أسئلة التفكير التحليلي. على سبيل المثال، يتطلب الاستعلام "أعطني أفضل 5 شركات ذات أعلى إيرادات في العامين الماضيين وحدد مخاطرها الرئيسية" خطوات متعددة للاستدلال، يمكن لبعضها استخدام استرجاع البحث الدلالي، بينما يتطلب البعض الآخر قدرات تحليلية.

نعرض في هذا المنشور كيفية تصميم مساعد مستندات ذكي قادر على الإجابة على الأسئلة التحليلية والاستدلالية متعددة الخطوات في ثلاثة أجزاء. في الجزء الأول، نراجع نمط تصميم RAG وقيوده على الأسئلة التحليلية. ثم نقدم لك بنية أكثر تنوعًا تتغلب على هذه القيود. يساعدك الجزء الثاني على التعمق أكثر في مسار استخراج الكيانات المستخدم لإعداد البيانات المنظمة، وهو عنصر أساسي للإجابة على الأسئلة التحليلية. الجزء 1 يرشدك إلى كيفية الاستخدام أمازون بيدروك LLM للاستعلام عن تلك البيانات وإنشاء وكيل LLM الذي يعزز RAG بقدرات تحليلية، وبالتالي يمكّنك من إنشاء مساعدي مستندات أذكياء يمكنهم الإجابة على الأسئلة المعقدة الخاصة بالمجال عبر مستندات متعددة.

الجزء 1: قيود RAG ونظرة عامة على الحلول

في هذا القسم، نراجع نمط تصميم RAG ونناقش قيوده على الأسئلة التحليلية. نقدم أيضًا بنية أكثر تنوعًا تتغلب على هذه القيود.

نظرة عامة على RAG

حلول RAG مستوحاة من التعلم التمثيل و البحث الدلالي الأفكار التي تم اعتمادها تدريجيًا في مشاكل التصنيف (على سبيل المثال، التوصية والبحث) ومهام معالجة اللغة الطبيعية (NLP) منذ عام 2010.

يتكون النهج الشائع المستخدم اليوم من ثلاث خطوات:

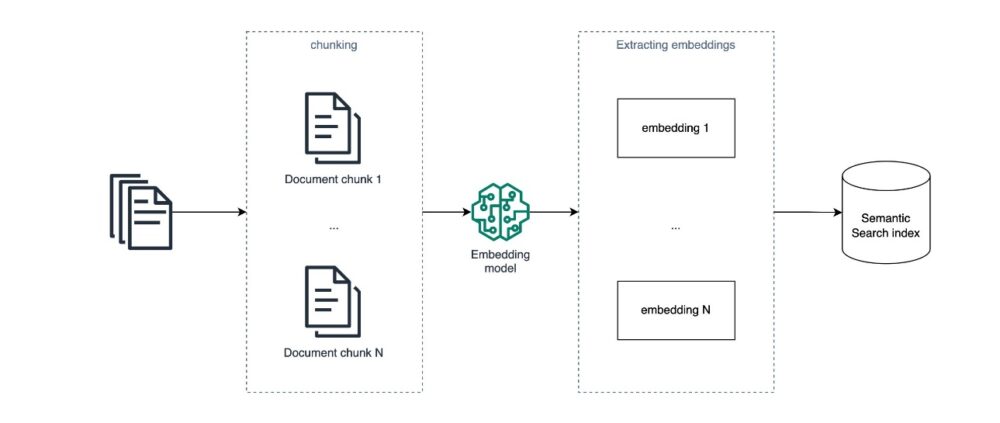

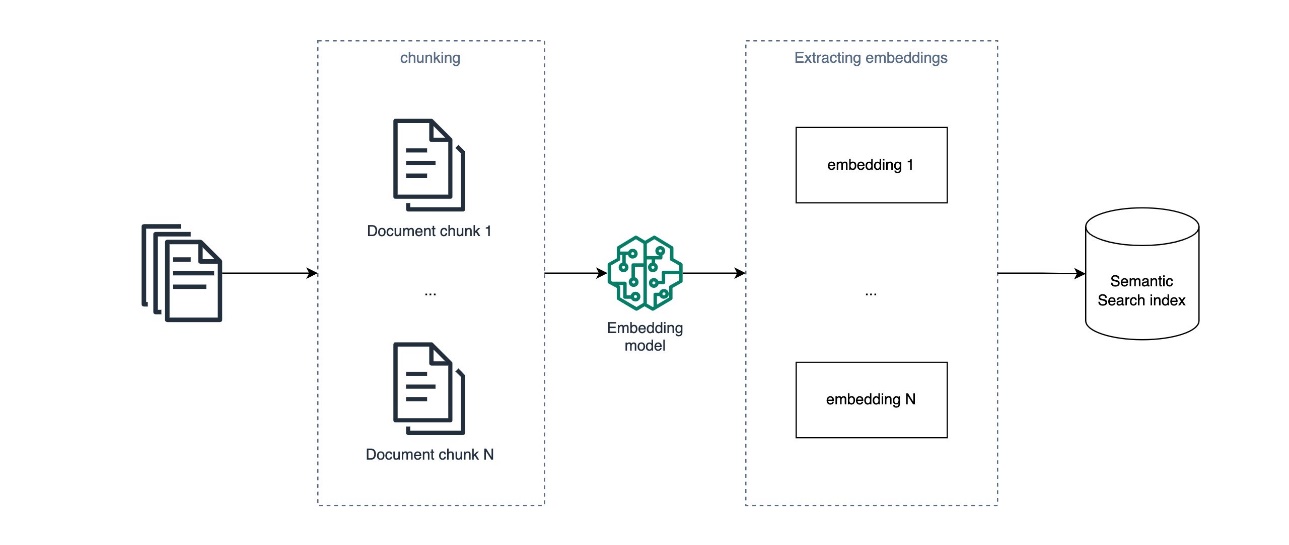

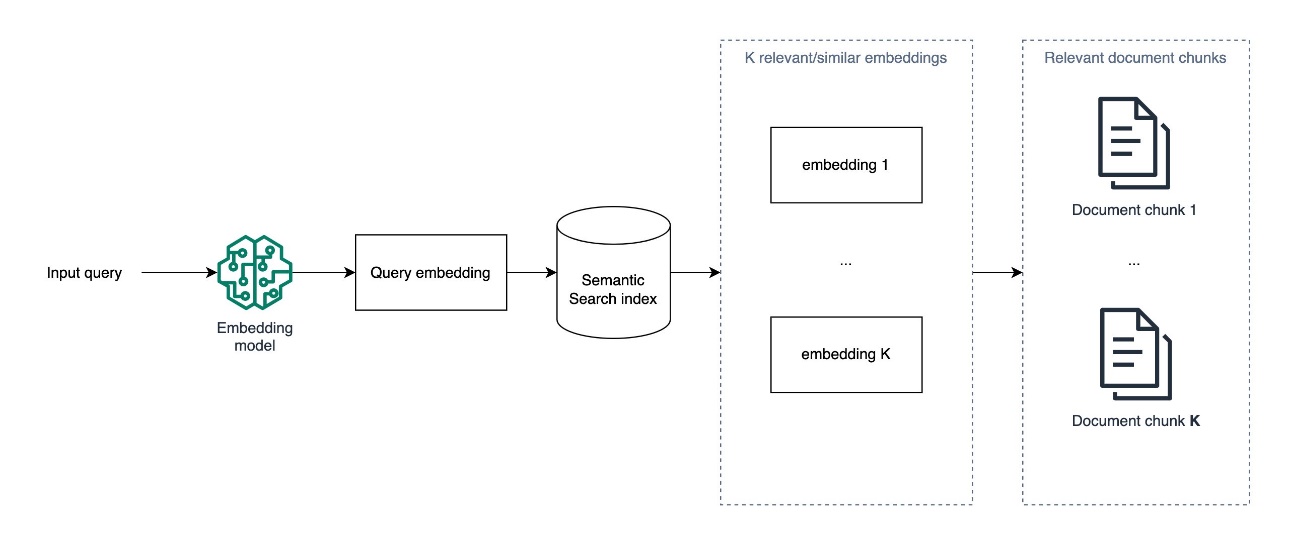

- تقوم مهمة المعالجة المجمعة دون الاتصال بالإنترنت باستيعاب المستندات من قاعدة معارف الإدخال، وتقسيمها إلى أجزاء، وإنشاء تضمين لكل جزء لتمثيل دلالاته باستخدام نموذج تضمين تم تدريبه مسبقًا، مثل أمازون تيتان نماذج التضمين، ثم يستخدم هذه التضمينات كمدخل لإنشاء فهرس بحث دلالي.

- عند الإجابة على سؤال جديد في الوقت الفعلي، يتم تحويل سؤال الإدخال إلى تضمين، والذي يُستخدم للبحث عن أجزاء المستندات الأكثر تشابهًا واستخراجها باستخدام مقياس التشابه، مثل تشابه جيب التمام، وخوارزمية أقرب جيران تقريبية. يمكن أيضًا تحسين دقة البحث من خلال تصفية البيانات الوصفية.

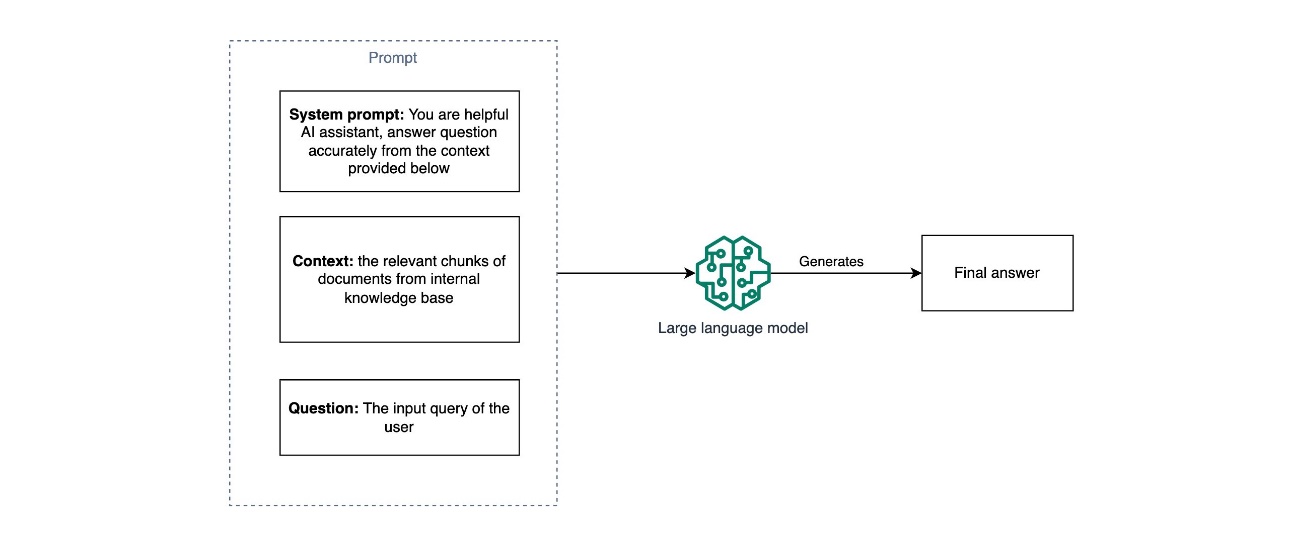

- يتم إنشاء المطالبة من سلسلة رسائل النظام مع سياق يتكون من أجزاء المستندات ذات الصلة المستخرجة في الخطوة 2، وسؤال الإدخال نفسه. يتم بعد ذلك تقديم هذه المطالبة إلى نموذج LLM لإنشاء الإجابة النهائية على السؤال من السياق.

باستخدام نموذج التضمين الأساسي الصحيح، القادر على إنتاج تمثيلات دلالية دقيقة لأجزاء مستند الإدخال وأسئلة الإدخال، ووحدة البحث الدلالي الفعالة، فإن هذا الحل قادر على الإجابة على الأسئلة التي تتطلب استرجاع المعلومات الموجودة في قاعدة بيانات المستندات. على سبيل المثال، إذا كان لديك خدمة أو منتج، فيمكنك البدء بفهرسة قسم الأسئلة الشائعة أو الوثائق والحصول على ذكاء اصطناعي أولي للمحادثة مصمم خصيصًا لعرضك المحدد.

حدود RAG على أساس البحث الدلالي

على الرغم من أن RAG يعد مكونًا أساسيًا في مساعدي الذكاء الاصطناعي الحديثين الخاصين بالمجال ونقطة بداية معقولة لبناء ذكاء اصطناعي للمحادثة حول قاعدة معرفية متخصصة، إلا أنه لا يمكنه الإجابة على الأسئلة التي تتطلب المسح الضوئي والمقارنة والتفكير عبر جميع المستندات في قاعدة المعرفة الخاصة بك في وقت واحد، خاصة عندما يعتمد التعزيز فقط على البحث الدلالي.

لفهم هذه القيود، دعونا نفكر مرة أخرى في مثال تحديد مكان الاستثمار بناءً على التقارير المالية. إذا أردنا استخدام RAG للتحدث مع هذه التقارير، فيمكننا طرح أسئلة مثل "ما هي المخاطر التي واجهت الشركة X في عام 2022"، أو "ما هو صافي إيرادات الشركة Y في عام 2022؟" بالنسبة لكل سؤال من هذه الأسئلة، يتم استخدام متجه التضمين المقابل، الذي يشفر المعنى الدلالي للسؤال، لاسترداد أجزاء المستندات المتشابهة من الناحية الدلالية المتوفرة في فهرس البحث. يتم تحقيق ذلك عادةً من خلال استخدام حل تقريبي لأقرب الجيران مثل FAISS أو NMSLIB أو pgvector أو غيرهم، والتي تسعى جاهدة لتحقيق التوازن بين سرعة الاسترجاع والاستدعاء لتحقيق الأداء في الوقت الحقيقي مع الحفاظ على دقة مرضية.

ومع ذلك، فإن النهج السابق لا يمكنه الإجابة بدقة على الأسئلة التحليلية عبر جميع المستندات، مثل "ما هي أكبر 5 شركات ذات أعلى صافي إيرادات في عام 2022؟"

وذلك لأن استرجاع البحث الدلالي يحاول العثور على أجزاء المستندات الأكثر تشابهًا مع سؤال الإدخال. ولكن لأن أيا من الوثائق لا تحتوي على ملخصات شاملة للإيرادات، فإنها ستعيد أجزاء من الوثائق التي تحتوي فقط على إشارات إلى "صافي الإيرادات" وربما "2022"، دون استيفاء الشرط الأساسي المتمثل في التركيز على الشركات ذات الإيرادات الأعلى. إذا قدمنا نتائج الاسترجاع هذه إلى LLM كسياق للإجابة على سؤال الإدخال، فقد يقوم بصياغة إجابة مضللة أو رفض الإجابة، لأن المعلومات الصحيحة المطلوبة مفقودة.

تأتي هذه القيود حسب التصميم لأن البحث الدلالي لا يجري فحصًا شاملاً لجميع المتجهات المضمنة للعثور على المستندات ذات الصلة. بدلاً من ذلك، فإنه يستخدم أساليب الجوار الأقرب التقريبية للحفاظ على سرعة استرجاع معقولة. إحدى الإستراتيجيات الرئيسية لتحقيق الكفاءة في هذه الأساليب هي تقسيم مساحة التضمين إلى مجموعات أثناء الفهرسة. وهذا يسمح بتحديد المجموعات التي قد تحتوي على التضمينات ذات الصلة أثناء الاسترجاع بسرعة، دون الحاجة إلى إجراء مقارنات زوجية. بالإضافة إلى ذلك، حتى تقنيات أقرب الجيران التقليدية مثل KNN، التي تقوم بمسح جميع المستندات، تحسب فقط مقاييس المسافة الأساسية وليست مناسبة للمقارنات المعقدة اللازمة للتفكير التحليلي. لذلك، لم يتم تصميم RAG مع البحث الدلالي للإجابة على الأسئلة التي تتضمن تفكيرًا تحليليًا عبر جميع المستندات.

للتغلب على هذه القيود، نقترح حلاً يجمع بين RAG وبيانات التعريف واستخراج الكيانات واستعلام SQL ووكلاء LLM، كما هو موضح في الأقسام التالية.

التغلب على قيود RAG باستخدام بيانات التعريف ووكلاء SQL وLLM

دعونا نتفحص بشكل أعمق السؤال الذي فشل فيه فريق RAG، حتى نتمكن من تتبع الأسباب المطلوبة للإجابة عليه بشكل فعال. يجب أن يوجهنا هذا التحليل نحو النهج الصحيح الذي يمكن أن يكمل الفريق الاستشاري في الحل الشامل.

خذ بعين الاعتبار السؤال: “ما هي أفضل 5 شركات تحقق أعلى الإيرادات في عام 2022؟”

لكي نتمكن من الإجابة على هذا السؤال، علينا أن:

- تحديد الإيرادات لكل شركة.

- قم بالتصفية للأسفل للحفاظ على إيرادات 2022 لكل منهم.

- فرز الإيرادات بالترتيب التنازلي.

- قم بتقطيع أعلى 5 إيرادات إلى جانب أسماء الشركات.

عادةً، يتم إجراء هذه العمليات التحليلية على بيانات منظمة، باستخدام أدوات مثل الباندا أو محركات SQL. إذا كان لدينا الوصول إلى جدول SQL يحتوي على الأعمدة company, revenueو yearيمكننا بسهولة الإجابة على سؤالنا عن طريق تشغيل استعلام SQL، على غرار المثال التالي:

SELECT company, revenue FROM table_name WHERE year = 2022 ORDER BY revenue DESC LIMIT 5;يتيح لك تخزين بيانات التعريف المنظمة في جدول SQL الذي يحتوي على معلومات حول الكيانات ذات الصلة الإجابة على العديد من أنواع الأسئلة التحليلية عن طريق كتابة استعلام SQL الصحيح. ولهذا السبب فإننا نكمل RAG في حلنا بوحدة استعلام SQL في الوقت الفعلي مقابل جدول SQL، يتم ملؤه بالبيانات التعريفية المستخرجة في عملية غير متصلة بالإنترنت.

ولكن كيف يمكننا تنفيذ ودمج هذا النهج في الذكاء الاصطناعي للمحادثة القائم على LLM؟

هناك ثلاث خطوات لتتمكن من إضافة المنطق التحليلي لـ SQL:

- استخراج البيانات الوصفية – استخراج البيانات الوصفية من المستندات غير المنظمة إلى جدول SQL

- النص إلى SQL – صياغة استعلامات SQL من أسئلة الإدخال بدقة باستخدام LLM

- اختيار الأداة – تحديد ما إذا كان يجب الإجابة على السؤال باستخدام RAG أو استعلام SQL

لتنفيذ هذه الخطوات، ندرك أولاً أن استخراج المعلومات من المستندات غير المنظمة هي مهمة البرمجة اللغوية العصبية التقليدية التي يُظهر ماجستير إدارة الأعمال فيها وعدًا بتحقيق دقة عالية من خلال التعلم بدون طلقة أو طلقة قليلة. ثانيًا، لقد تم إثبات قدرة هذه النماذج على إنشاء استعلامات SQL من اللغة الطبيعية لسنوات، كما هو موضح في 2020 الإفراج of أمازون QuickSight Q. وأخيرًا، يؤدي التحديد التلقائي للأداة المناسبة لسؤال معين إلى تحسين تجربة المستخدم وتمكين الإجابة على الأسئلة المعقدة من خلال التفكير متعدد الخطوات. لتنفيذ هذه الميزة، سنتعمق في وكلاء LLM في قسم لاحق.

لتلخيص ذلك، يتكون الحل الذي نقترحه من المكونات الأساسية التالية:

- استرجاع البحث الدلالي لزيادة سياق التوليد

- استخراج البيانات التعريفية المنظمة والاستعلام عنها باستخدام SQL

- وكيل قادر على استخدام الأدوات المناسبة للإجابة على سؤال

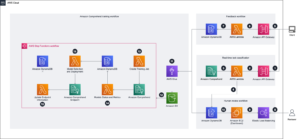

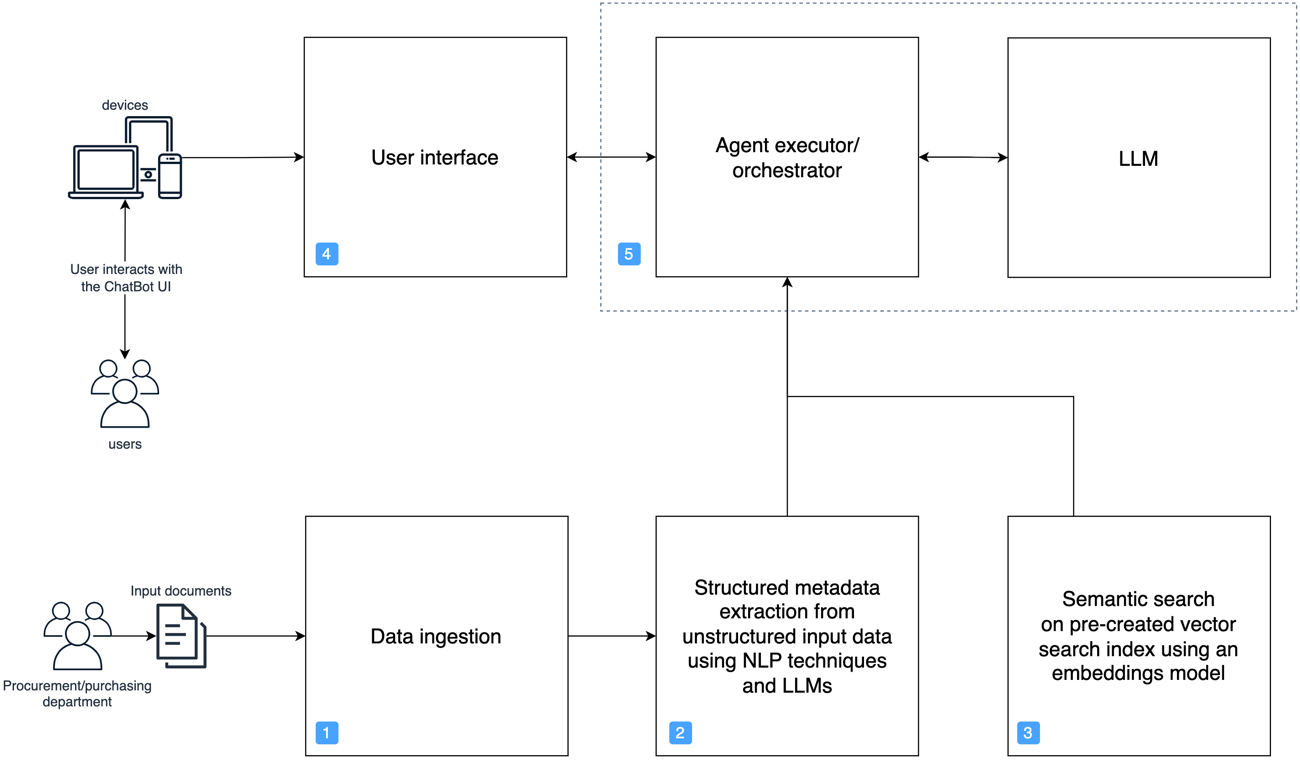

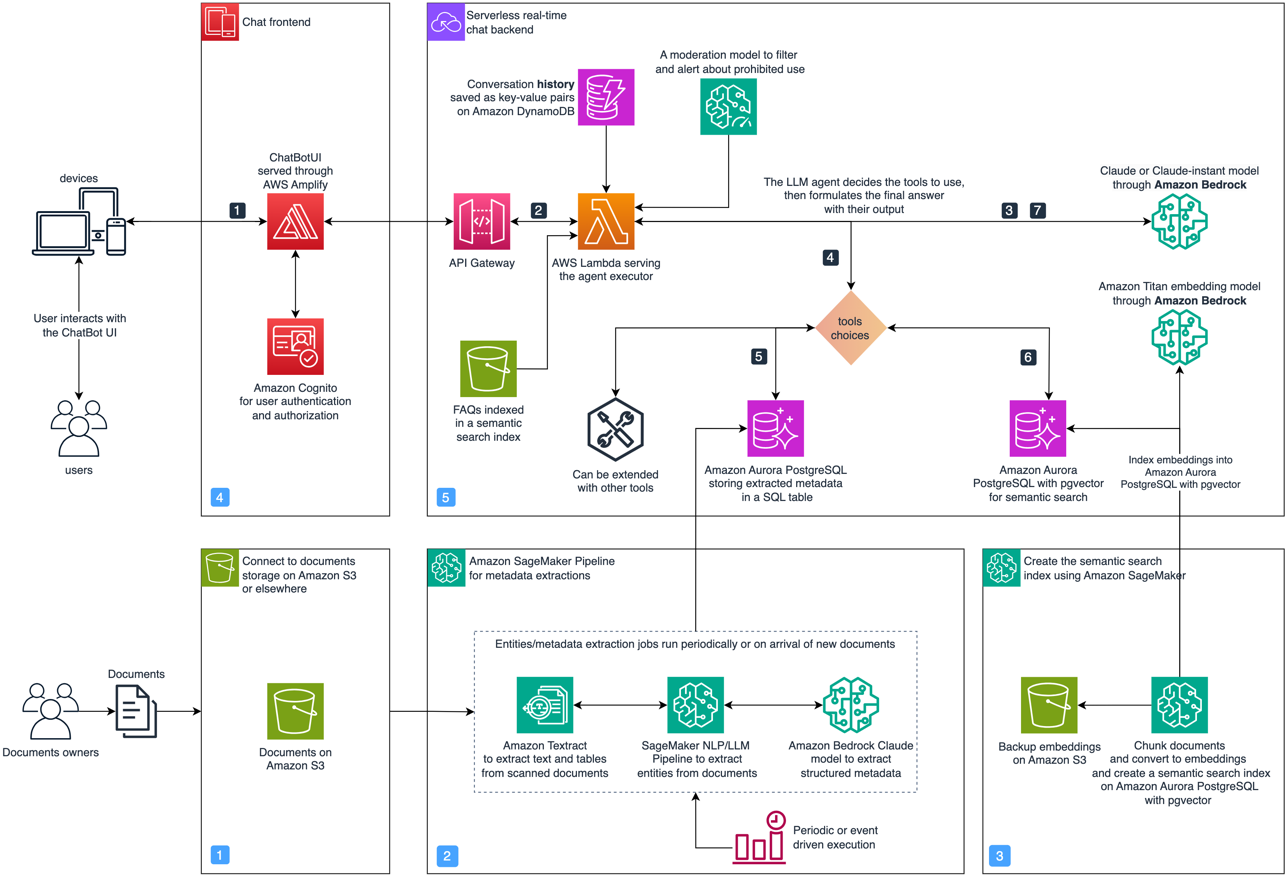

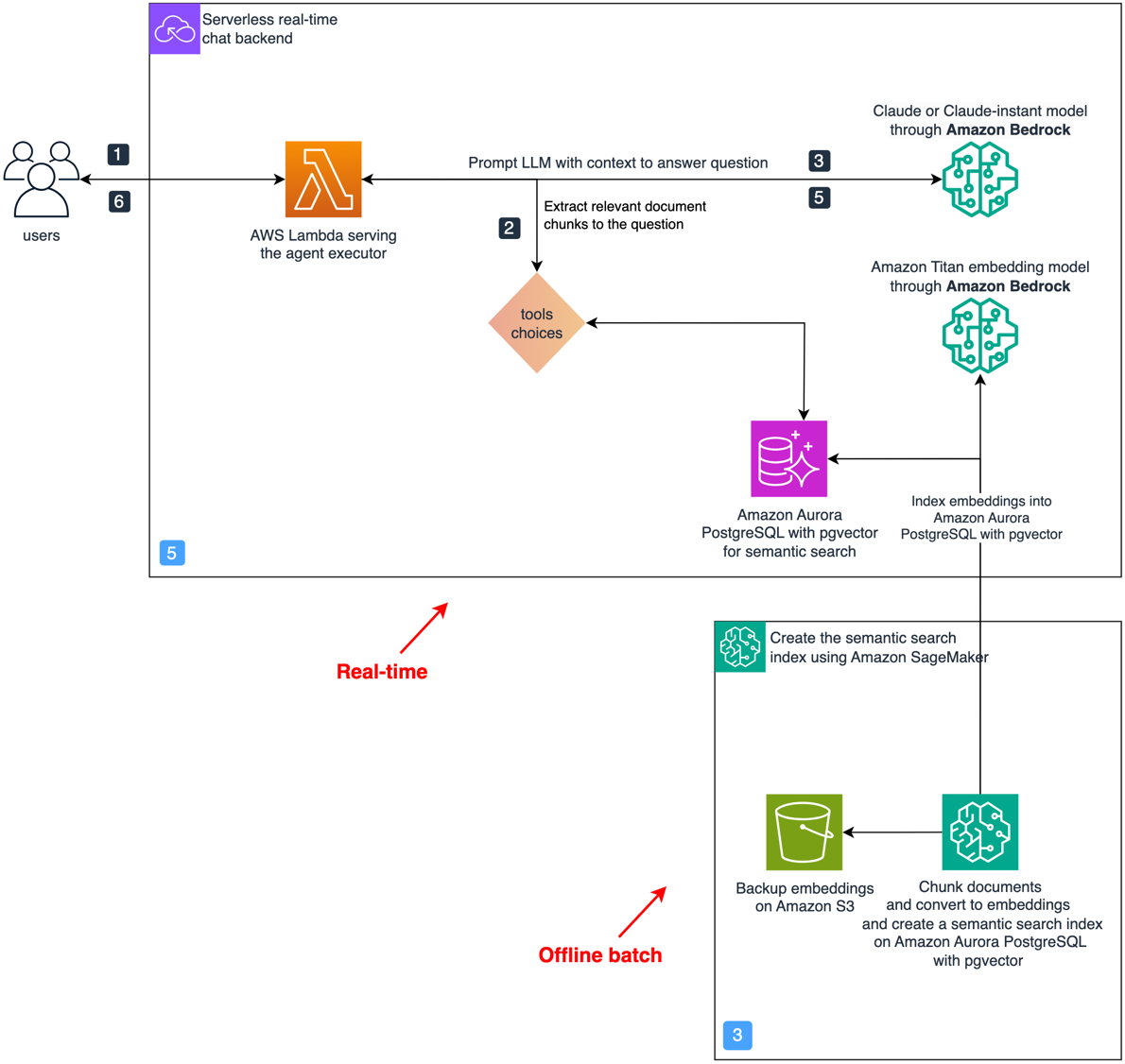

حل نظرة عامة

ويصور الرسم البياني التالي بنية مبسطة للحل. يساعدك على تحديد وفهم دور المكونات الأساسية وكيفية تفاعلها لتنفيذ السلوك الكامل لمساعد LLM. يتوافق الترقيم مع ترتيب العمليات عند تنفيذ هذا الحل.

ومن الناحية العملية، قمنا بتنفيذ هذا الحل كما هو موضح في البنية التفصيلية التالية.

بالنسبة لهذه البنية، نقترح التنفيذ GitHub جيثب:، مع مكونات مترابطة بشكل غير محكم حيث يمكن للواجهة الخلفية (5)، وخطوط أنابيب البيانات (1، 2، 3) والواجهة الأمامية (4) أن تتطور بشكل منفصل. وذلك لتبسيط التعاون عبر الكفاءات عند تخصيص الحل الخاص بالإنتاج وتحسينه.

انشر الحل

لتثبيت هذا الحل في حساب AWS الخاص بك، أكمل الخطوات التالية:

- استنساخ مستودع على جيثب.

- قم بتثبيت الواجهة الخلفية مجموعة تطوير سحابة AWS (أوس سي دي كيه) التطبيق:

- فتح

backendالمجلد. - يجري

npm installلتثبيت التبعيات. - إذا لم تستخدم AWS CDK مطلقًا في الحساب الحالي والمنطقة، فقم بتشغيل إلباس الحذاء مع

npx cdk bootstrap. - يجري

npx cdk deployلنشر المكدس.

- فتح

- اختياريًا، قم بتشغيل

streamlit-uiكما يلي:- نوصي باستنساخ هذا المستودع في ملف أمازون ساجميكر ستوديو بيئة. لمزيد من المعلومات، راجع الانضمام إلى Amazon SageMaker Domain باستخدام الإعداد السريع.

- داخل

frontend/streamlit-uiالمجلد، تشغيلbash run-streamlit-ui.sh. - اختر الرابط بالتنسيق التالي لفتح العرض التوضيحي:

https://{domain_id}.studio.{region}.sagemaker.aws/jupyter/default/proxy/{port_number}/.

- وأخيرا، يمكنك تشغيل الأمازون SageMaker خط الأنابيب المحدد في

data-pipelines/04-sagemaker-pipeline-for-documents-processing.ipynbدفتر ملاحظات لمعالجة مستندات PDF المدخلة وإعداد جدول SQL وفهرس البحث الدلالي الذي يستخدمه مساعد LLM.

في بقية هذه التدوينة، سنركز على شرح أهم المكونات وخيارات التصميم، لنأمل أن نلهمك عند تصميم مساعد الذكاء الاصطناعي الخاص بك على قاعدة معرفية داخلية. نحن نفترض أن المكونات 1 و4 سهلة الفهم، ونركز على المكونات الأساسية 2 و3 و5.

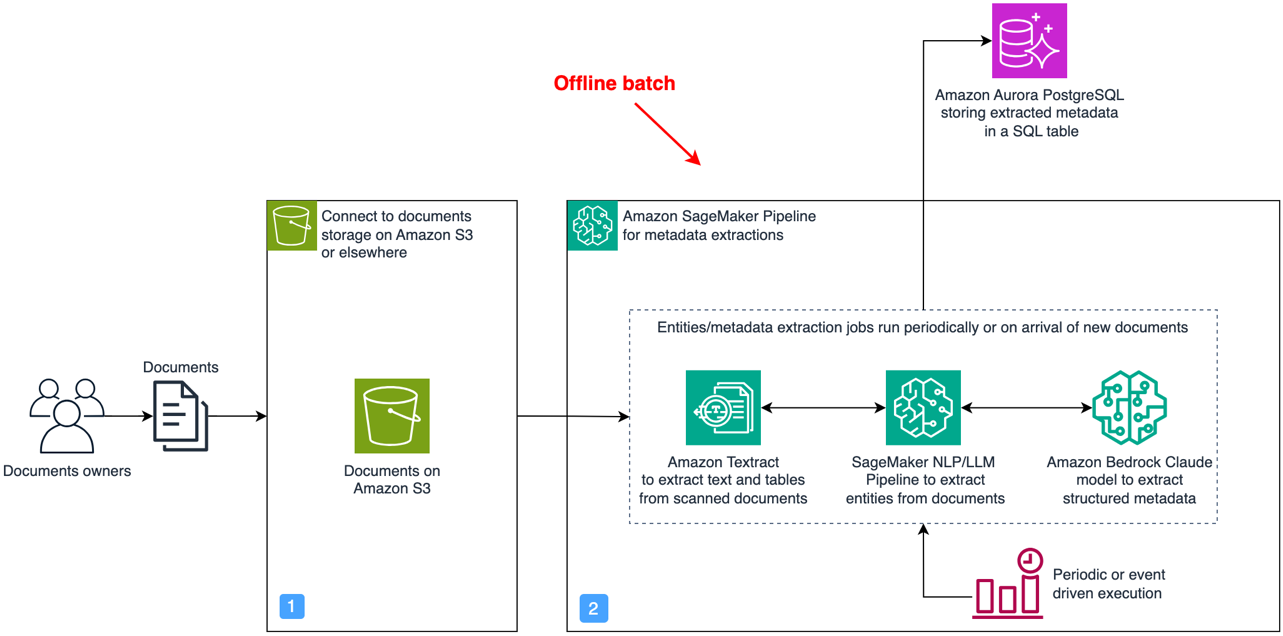

الجزء 2: خط أنابيب استخراج الكيان

في هذا القسم، نتعمق أكثر في عملية استخراج الكيانات المستخدمة لإعداد البيانات المنظمة، والتي تعد عنصرًا رئيسيًا للإجابة على الأسئلة التحليلية.

استخراج النص

عادةً ما يتم تخزين المستندات بتنسيق PDF أو كصور ممسوحة ضوئيًا. وقد تتكون من تخطيطات فقرات بسيطة أو جداول معقدة، وتحتوي على نص رقمي أو مكتوب بخط اليد. لاستخراج المعلومات بشكل صحيح، نحتاج إلى تحويل هذه المستندات الأولية إلى نص عادي، مع الحفاظ على بنيتها الأصلية. للقيام بذلك، يمكنك استخدام أمازون تيكستراك، وهي خدمة تعلم آلي (ML) توفر واجهات برمجة تطبيقات ناضجة لاستخراج النصوص والجداول والنماذج من المدخلات الرقمية والمكتوبة بخط اليد.

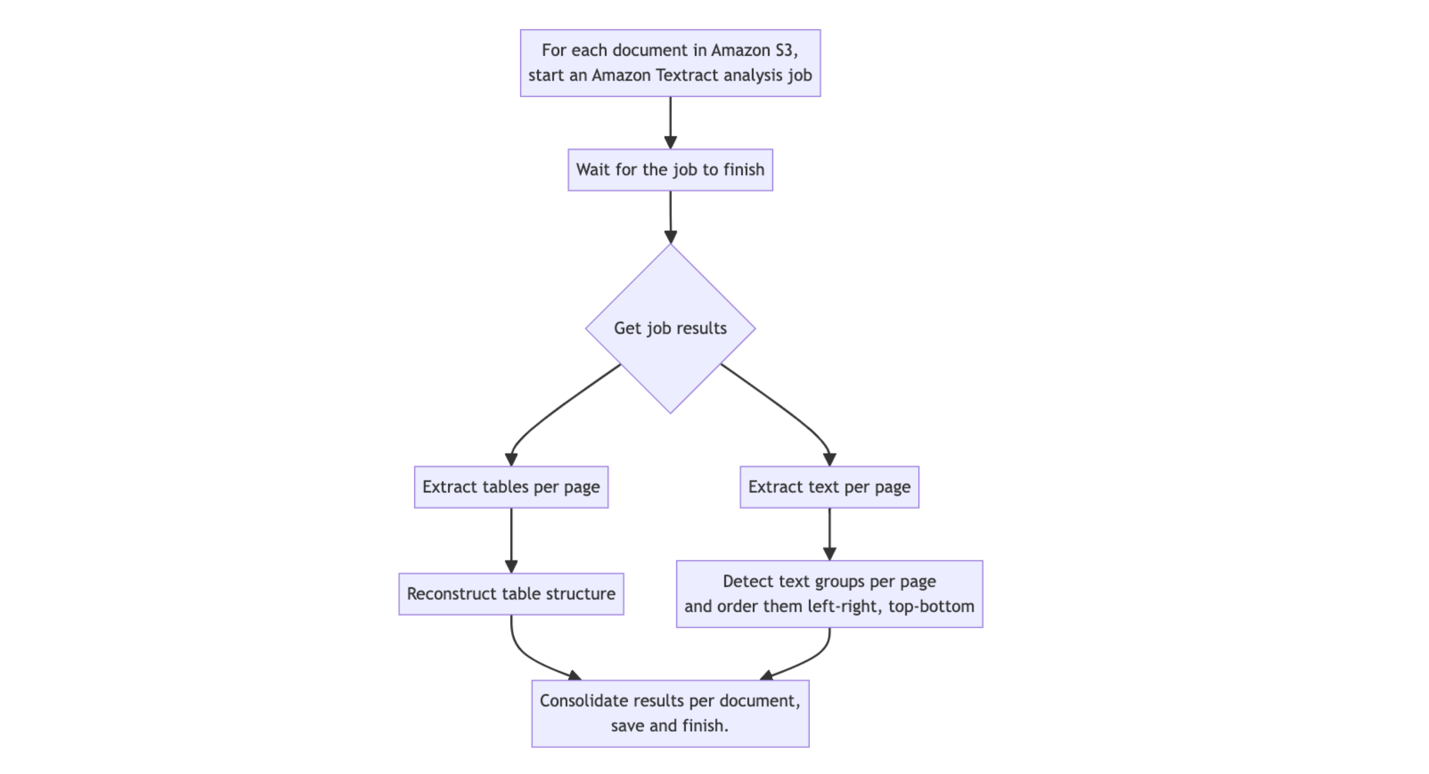

في المكون الثاني، نقوم باستخراج النص والجداول على النحو التالي:

- بالنسبة لكل مستند، نتصل بـ Amazon Textract لاستخراج النص والجداول.

- نستخدم ما يلي بيثون النصي لإعادة إنشاء الجداول مثل DataFrames الباندا.

- نقوم بدمج النتائج في مستند واحد وإدراج الجداول كتخفيض.

تم توضيح هذه العملية من خلال مخطط التدفق التالي وتم توضيحها بشكل ملموس في notebooks/03-pdf-document-processing.ipynb.

استخراج الكيان والاستعلام عنه باستخدام LLMs

للإجابة على الأسئلة التحليلية بشكل فعال، تحتاج إلى استخراج البيانات التعريفية والكيانات ذات الصلة من قاعدة معارف وثيقتك إلى تنسيق بيانات منظمة يمكن الوصول إليه. نقترح استخدام SQL لتخزين هذه المعلومات واسترداد الإجابات نظرًا لشعبيتها وسهولة استخدامها وقابلية التوسع. يستفيد هذا الاختيار أيضًا من قدرة نماذج اللغة المثبتة على إنشاء استعلامات SQL من اللغة الطبيعية.

في هذا القسم، نتعمق أكثر في المكونات التالية التي تمكننا من طرح الأسئلة التحليلية:

- عملية دفعية تستخرج البيانات المنظمة من البيانات غير المنظمة باستخدام LLMs

- وحدة نمطية في الوقت الفعلي تقوم بتحويل أسئلة اللغة الطبيعية إلى استعلامات SQL واسترداد النتائج من قاعدة بيانات SQL

يمكنك استخراج البيانات الوصفية ذات الصلة لدعم الأسئلة التحليلية على النحو التالي:

- حدد مخطط JSON للمعلومات التي تحتاج إلى استخراجها، والذي يحتوي على وصف لكل حقل ونوع بياناته، ويتضمن أمثلة للقيم المتوقعة.

- بالنسبة لكل مستند، قم بمطالبة LLM باستخدام مخطط JSON واطلب منه استخراج البيانات ذات الصلة بدقة.

- عندما يتجاوز طول المستند طول السياق، ولتقليل تكلفة الاستخراج باستخدام LLM، يمكنك استخدام البحث الدلالي لاسترداد أجزاء المستندات ذات الصلة وتقديمها إلى LLM أثناء الاستخراج.

- تحليل إخراج JSON والتحقق من صحة استخراج LLM.

- اختياريًا، قم بعمل نسخة احتياطية من النتائج على Amazon S3 كملفات CSV.

- تحميل في قاعدة بيانات SQL للاستعلام لاحقا.

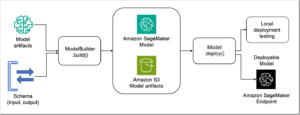

تتم إدارة هذه العملية من خلال البنية التالية، حيث يتم تحميل المستندات بتنسيق نصي باستخدام برنامج Python النصي الذي يتم تشغيله في ملف أمازون SageMaker معالجة مهمة إجراء عملية الاستخراج.

بالنسبة لكل مجموعة من الكيانات، نقوم بشكل ديناميكي بإنشاء موجه يتضمن وصفًا واضحًا لمهمة استخراج المعلومات، ويتضمن مخطط JSON الذي يحدد المخرجات المتوقعة ويتضمن أجزاء المستند ذات الصلة كسياق. نضيف أيضًا بعض الأمثلة على المدخلات والمخرجات الصحيحة لتحسين أداء الاستخراج من خلال تعلم لقطات قليلة. ويتجلى هذا في notebooks/05-entities-extraction-to-structured-metadata.ipynb.

الجزء 3: إنشاء مساعد مستندات وكيل باستخدام Amazon Bedrock

في هذا القسم، نوضح كيفية استخدام Amazon Bedrock LLMs للاستعلام عن البيانات وإنشاء وكيل LLM يعزز RAG بالإمكانات التحليلية، وبالتالي يمكّنك من إنشاء مساعدي مستندات أذكياء يمكنهم الإجابة على الأسئلة المعقدة الخاصة بالمجال عبر مستندات متعددة. يمكنك الرجوع إلى وظيفة Lambda على جيثب للتنفيذ الملموس للعامل والأدوات الموضحة في هذا الجزء.

صياغة استعلامات SQL والإجابة على الأسئلة التحليلية

الآن بعد أن أصبح لدينا مخزن بيانات تعريف منظم مع استخراج الكيانات ذات الصلة وتحميلها في قاعدة بيانات SQL التي يمكننا الاستعلام عنها، فإن السؤال الذي يبقى هو كيفية إنشاء استعلام SQL الصحيح من أسئلة اللغة الطبيعية المدخلة؟

تعتبر شهادات LLM الحديثة جيدة في إنشاء SQL. على سبيل المثال، إذا طلبت من Anthropic Claude LLM من خلال أمازون بيدروك لإنشاء استعلام SQL، سترى إجابات معقولة. ومع ذلك، نحتاج إلى الالتزام ببعض القواعد عند كتابة الموجه للوصول إلى استعلامات SQL أكثر دقة. تعتبر هذه القواعد مهمة بشكل خاص للاستعلامات المعقدة لتقليل الهلوسة والأخطاء النحوية:

- صف المهمة بدقة ضمن الموجه

- قم بتضمين مخطط جداول SQL ضمن الموجه، مع وصف كل عمود في الجدول وتحديد نوع البيانات الخاص به

- اطلب بوضوح من LLM استخدام أسماء الأعمدة وأنواع البيانات الموجودة فقط

- أضف بضعة صفوف من جداول SQL

يمكنك أيضًا إجراء المعالجة اللاحقة لاستعلام SQL الذي تم إنشاؤه باستخدام ملف اللنت مثل com.sqlfluff لتصحيح التنسيق، أو محلل مثل com.sqlglot لاكتشاف الأخطاء النحوية وتحسين الاستعلام. علاوة على ذلك، عندما لا يفي الأداء بالمتطلبات، يمكنك تقديم بعض الأمثلة ضمن الموجه لتوجيه النموذج من خلال تعلم لقطات قليلة نحو إنشاء استعلامات SQL أكثر دقة.

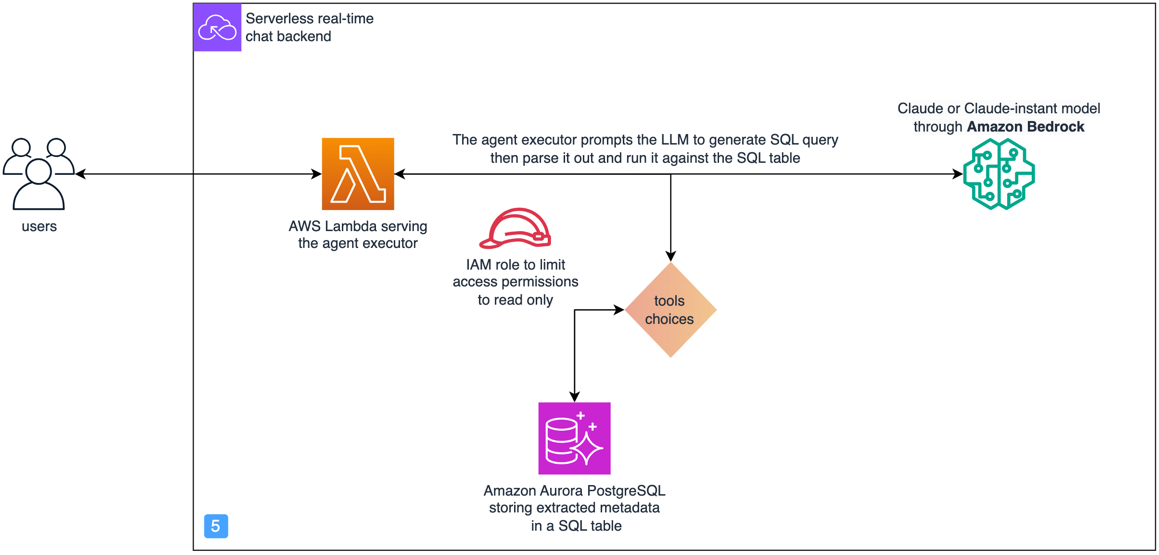

من منظور التنفيذ، نستخدم AWS لامدا وظيفة لتنظيم العملية التالية:

- اتصل بنموذج Anthropic Claude في Amazon Bedrock باستخدام سؤال الإدخال للحصول على استعلام SQL المقابل. وهنا نستخدم قاعدة بيانات SQL فئة من LangChain لإضافة أوصاف مخطط لجداول SQL ذات الصلة، واستخدام موجه مخصص.

- تحليل والتحقق من صحة وتشغيل استعلام SQL مقابل إصدار متوافق مع Amazon Aurora PostgreSQL قاعدة البيانات.

يتم تسليط الضوء على بنية هذا الجزء من الحل في الرسم البياني التالي.

الاعتبارات الأمنية لمنع هجمات حقن SQL

نظرًا لأننا نقوم بتمكين مساعد الذكاء الاصطناعي من الاستعلام عن قاعدة بيانات SQL، فيجب علينا التأكد من أن هذا لا يؤدي إلى ثغرات أمنية. ولتحقيق ذلك، نقترح الإجراءات الأمنية التالية لمنع هجمات حقن SQL:

- تطبيق أذونات IAM الأقل امتيازًا – الحد من إذن وظيفة Lambda التي تقوم بتشغيل استعلامات SQL باستخدام إدارة الهوية والوصول AWS (IAM) السياسة والدور الذي يتبع مبدأ الامتياز الأقل. في هذه الحالة، نمنح حق الوصول للقراءة فقط.

- تقييد الوصول إلى البيانات – توفير الوصول فقط إلى الحد الأدنى من الجداول والأعمدة لمنع هجمات الكشف عن المعلومات.

- أضف طبقة الاعتدال – تقديم طبقة اعتدال تكتشف محاولات الحقن السريع في وقت مبكر وتمنعها من الانتشار إلى بقية النظام. يمكن أن يأخذ شكل مرشحات قائمة على القواعد، أو مطابقة التشابه مع قاعدة بيانات لأمثلة الحقن الفوري المعروفة، أو مصنف تعلم الآلة.

استرجاع البحث الدلالي لزيادة سياق التوليد

الحل الذي نقترحه يستخدم RAG مع البحث الدلالي في المكون 3. يمكنك تنفيذ هذه الوحدة باستخدام القواعد المعرفية لأمازون بيدروك. بالإضافة إلى ذلك، هناك مجموعة متنوعة من الخيارات الأخرى لتنفيذ RAG، مثل واجهة برمجة تطبيقات استرجاع أمازون كيندرا, قاعدة بيانات متجهات Amazon OpenSearchو أمازون أورورا PostgreSQL مع pgvector، من بين أمور أخرى. الحزمة مفتوحة المصدر aws-genai-llm-chatbot يوضح كيفية استخدام العديد من خيارات البحث المتجهية هذه لتنفيذ برنامج الدردشة الآلي الذي يعمل بنظام LLM.

في هذا الحل، نظرًا لأننا نحتاج إلى استعلام SQL والبحث عن المتجهات، قررنا استخدام Amazon Aurora PostgreSQL مع com.pgvector الامتداد الذي يدعم كلتا الميزتين. لذلك، نقوم بتنفيذ مكون RAG للبحث الدلالي بالبنية التالية.

تتم عملية الإجابة على الأسئلة باستخدام البنية السابقة على مرحلتين رئيسيتين.

أولاً، تقوم عملية غير متصلة بالإنترنت، والتي يتم تشغيلها كمهمة معالجة SageMaker، بإنشاء فهرس البحث الدلالي على النحو التالي:

- يتم تشغيل مهمة SageMaker إما بشكل دوري، أو عند استلام مستندات جديدة.

- يقوم بتحميل المستندات النصية من Amazon S3 ويقسمها إلى أجزاء متداخلة.

- بالنسبة لكل قطعة، يستخدم نموذج التضمين Amazon Titan لإنشاء متجه التضمين.

- ويستخدم PGVector فئة من LangChain لاستيعاب التضمينات، مع مجموعات المستندات والبيانات التعريفية الخاصة بها، في Amazon Aurora PostgreSQL وإنشاء فهرس بحث دلالي على جميع متجهات التضمين.

ثانيا، في الوقت الحقيقي ولكل سؤال جديد، نقوم ببناء إجابة على النحو التالي:

- يتم تلقي السؤال من قبل المنسق الذي يعمل على وظيفة Lambda.

- يقوم المنسق بتضمين السؤال بنفس نموذج التضمين.

- يقوم باسترداد قطع المستندات الأكثر صلة بأعلى K من فهرس البحث الدلالي PostgreSQL. ويستخدم بشكل اختياري تصفية البيانات التعريفية لتحسين الدقة.

- يتم إدراج هذه القطع ديناميكيًا في موجه LLM بجانب سؤال الإدخال.

- يتم تقديم المطالبة إلى Anthropic Claude على Amazon Bedrock، لتوجيهه للإجابة على سؤال الإدخال بناءً على السياق المتاح.

- وأخيرا، يتم إرسال الإجابة التي تم إنشاؤها مرة أخرى إلى المنسق.

وكيل قادر على استخدام الأدوات للتفكير والتصرف

لقد ناقشنا حتى الآن في هذا المنشور معالجة الأسئلة التي تتطلب إما RAG أو التفكير التحليلي بشكل منفصل. ومع ذلك، فإن العديد من الأسئلة الواقعية تتطلب كلتا الإمكانيتين، وأحيانًا عبر خطوات متعددة من التفكير، من أجل الوصول إلى إجابة نهائية. لدعم هذه الأسئلة الأكثر تعقيدًا، نحتاج إلى تقديم فكرة الفاعل.

وكلاء LLM، مثل وكلاء لشركة أمازون بيدروك، ظهرت مؤخرًا كحل واعد قادر على استخدام LLMs للتفكير والتكيف باستخدام السياق الحالي واختيار الإجراءات المناسبة من قائمة الخيارات، والتي تقدم إطارًا عامًا لحل المشكلات. كما نوقش في وكلاء مستقلين مدعومين من LLM، هناك العديد من استراتيجيات التحفيز وأنماط التصميم لوكلاء LLM التي تدعم التفكير المعقد.

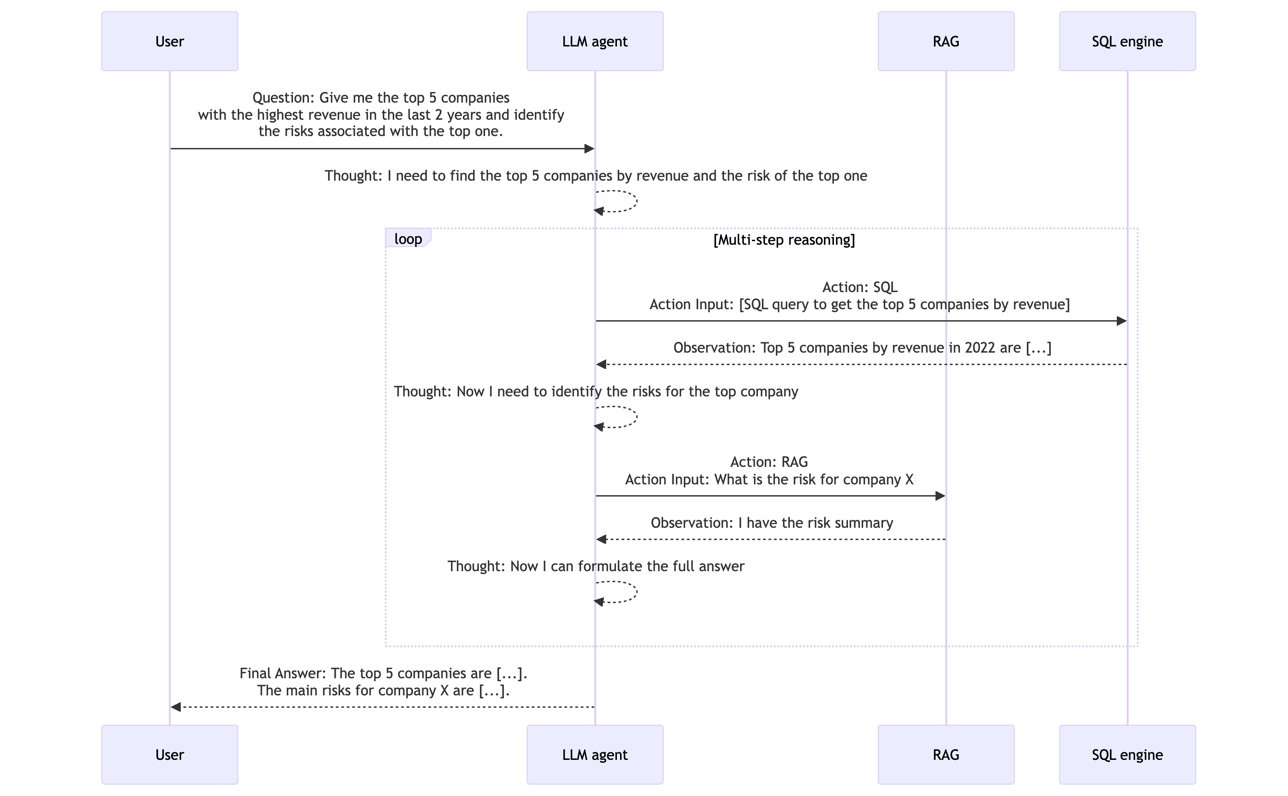

أحد أنماط التصميم هذه هو السبب والفعل (ReAct)، الذي تم تقديمه في ReAct: التآزر في التفكير والتصرف في نماذج اللغة. في ReAct، يأخذ الوكيل هدفًا يمكن أن يكون سؤالاً كمدخل، ويحدد أجزاء المعلومات المفقودة للإجابة عليه، ويقترح بشكل متكرر الأداة الصحيحة لجمع المعلومات بناءً على أوصاف الأدوات المتاحة. بعد تلقي الإجابة من أداة معينة، تقوم LLM بإعادة تقييم ما إذا كانت لديها كل المعلومات التي تحتاجها للإجابة بشكل كامل على السؤال. إذا لم يكن الأمر كذلك، فإنه يقوم بخطوة أخرى من الاستدلال ويستخدم نفس الأداة أو أداة أخرى لجمع المزيد من المعلومات، حتى يصبح الرد النهائي جاهزًا أو يتم الوصول إلى الحد الأقصى.

يشرح الرسم البياني التسلسلي التالي كيف يعمل وكيل ReAct للإجابة على السؤال "أعطني أفضل 5 شركات ذات أعلى إيرادات في العامين الماضيين وحدد المخاطر المرتبطة بالشركة الأولى."

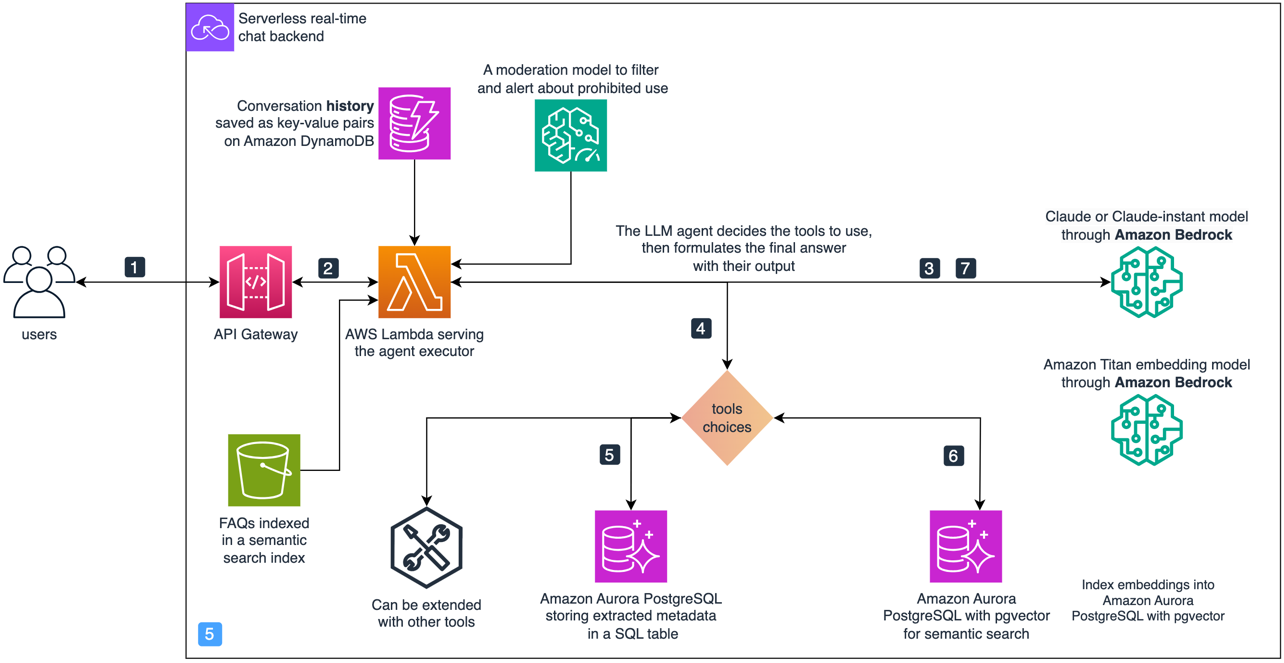

تم توضيح تفاصيل تنفيذ هذا النهج في بايثون في وكيل LLM مخصص. في الحل الذي نقدمه، يتم تنفيذ الوكيل والأدوات باستخدام البنية الجزئية المميزة التالية.

للإجابة على سؤال الإدخال، نستخدم خدمات AWS على النحو التالي:

- يقوم المستخدم بإدخال سؤاله من خلال واجهة المستخدم، التي تستدعي واجهة برمجة التطبيقات (API). بوابة أمازون API.

- ترسل بوابة API السؤال إلى وظيفة Lambda التي تقوم بتنفيذ الوكيل المنفذ.

- يستدعي الوكيل LLM بمطالبة تحتوي على وصف للأدوات المتاحة، وتنسيق تعليمات ReAct، وسؤال الإدخال، ثم يقوم بتحليل الإجراء التالي لإكماله.

- يحتوي الإجراء على الأداة التي سيتم الاتصال بها وما هو إدخال الإجراء.

- إذا كانت الأداة المستخدمة هي SQL، فسيقوم منفذ الوكيل باستدعاء SQLQA لتحويل السؤال إلى SQL وتشغيله. ثم يضيف النتيجة إلى الموجه ويتصل بـ LLM مرة أخرى لمعرفة ما إذا كان يمكنه الإجابة على السؤال الأصلي أو ما إذا كانت هناك حاجة إلى مزيد من الإجراءات.

- وبالمثل، إذا كانت الأداة المستخدمة هي البحث الدلالي، فسيتم تحليل إدخال الإجراء واستخدامه للاسترداد من فهرس البحث الدلالي PostgreSQL. فهو يضيف النتائج إلى الموجه ويتحقق مما إذا كان LLM قادرًا على الإجابة أو يحتاج إلى إجراء آخر.

- بعد توفر جميع المعلومات اللازمة للإجابة على السؤال، يقوم وكيل LLM بصياغة إجابة نهائية وإرسالها مرة أخرى إلى المستخدم.

يمكنك تمديد الوكيل بأدوات إضافية. في التنفيذ متاح على GitHub جيثب:، نوضح كيف يمكنك إضافة محرك بحث وآلة حاسبة كأدوات إضافية لمحرك SQL المذكور أعلاه وأدوات البحث الدلالي. لتخزين سجل المحادثات الجارية، نستخدم الأمازون DynamoDB الجدول.

من تجربتنا حتى الآن، رأينا أن ما يلي هو مفاتيح الوكيل الناجح:

- LLM أساسي قادر على التفكير باستخدام تنسيق ReAct

- وصف واضح للأدوات المتاحة، ومتى يتم استخدامها، ووصف لوسائط الإدخال الخاصة بها مع مثال على المدخلات والمخرجات المتوقعة

- مخطط واضح لتنسيق ReAct الذي يجب أن يتبعه LLM

- الأدوات المناسبة لحل مسألة الأعمال متاحة لوكيل LLM لاستخدامها

- تحليل المخرجات من استجابات وكيل LLM بشكل صحيح حسب الأسباب

لتحسين التكاليف، نوصي بالتخزين المؤقت للأسئلة الأكثر شيوعًا مع إجاباتها وتحديث ذاكرة التخزين المؤقت هذه بشكل دوري لتقليل الاستدعاءات إلى LLM الأساسي. على سبيل المثال، يمكنك إنشاء فهرس بحث دلالي يحتوي على الأسئلة الأكثر شيوعًا كما هو موضح سابقًا، ومطابقة سؤال المستخدم الجديد مع الفهرس أولاً قبل الاتصال بـ LLM. لاستكشاف خيارات التخزين المؤقت الأخرى، راجع LLM تكامل التخزين المؤقت.

دعم التنسيقات الأخرى مثل ملفات الفيديو والصور والصوت وثلاثية الأبعاد

يمكنك تطبيق نفس الحل على أنواع مختلفة من المعلومات، مثل الصور ومقاطع الفيديو والصوت وملفات التصميم ثلاثية الأبعاد مثل CAD أو ملفات الشبكة. يتضمن ذلك استخدام تقنيات ML المعمول بها لوصف محتوى الملف في النص، والذي يمكن بعد ذلك استيعابه في الحل الذي استكشفناه سابقًا. يمكّنك هذا الأسلوب من إجراء محادثات ضمان الجودة على أنواع البيانات المتنوعة هذه. على سبيل المثال، يمكنك توسيع قاعدة بيانات المستندات الخاصة بك عن طريق إنشاء أوصاف نصية للصور أو مقاطع الفيديو أو المحتوى الصوتي. يمكنك أيضًا تحسين جدول بيانات التعريف عن طريق تحديد الخصائص من خلال التصنيف أو اكتشاف الكائنات على العناصر الموجودة في هذه التنسيقات. بعد فهرسة هذه البيانات المستخرجة إما في مخزن البيانات الوصفية أو في فهرس البحث الدلالي للوثائق، تظل البنية العامة للنظام المقترح متسقة إلى حد كبير.

وفي الختام

في هذا المنشور، أظهرنا كيف أن استخدام LLMs مع نمط تصميم RAG ضروري لبناء مساعد ذكاء اصطناعي خاص بالمجال، ولكنه غير كافٍ للوصول إلى المستوى المطلوب من الموثوقية لتوليد قيمة الأعمال. ولهذا السبب، اقترحنا توسيع نمط تصميم RAG الشائع بمفاهيم الوكلاء والأدوات، حيث تسمح لنا مرونة الأدوات باستخدام كل من تقنيات البرمجة اللغوية العصبية التقليدية وإمكانيات LLM الحديثة لتمكين مساعد الذكاء الاصطناعي مع المزيد من الخيارات للبحث عن المعلومات والمساعدة المستخدمين في حل مشاكل العمل بكفاءة.

يوضح الحل عملية التصميم لمساعد LLM قادر على الإجابة على أنواع مختلفة من أسئلة الاسترجاع والتفكير التحليلي والأسئلة المنطقية متعددة الخطوات عبر جميع قاعدة المعرفة الخاصة بك. لقد سلطنا الضوء أيضًا على أهمية التفكير بشكل عكسي في أنواع الأسئلة والمهام التي من المتوقع أن يساعد مساعد LLM المستخدمين بها. في هذه الحالة، قادتنا رحلة التصميم إلى بنية مكونة من ثلاثة مكونات: البحث الدلالي، واستخراج البيانات الوصفية واستعلام SQL، ووكيل LLM وأدواته، والتي نعتقد أنها عامة ومرنة بدرجة كافية لحالات الاستخدام المتعددة. ونعتقد أيضًا أنه من خلال الحصول على الإلهام من هذا الحل والتعمق في احتياجات المستخدمين، ستتمكن من توسيع هذا الحل بشكل أكبر نحو ما يناسبك بشكل أفضل.

عن المؤلفين

محمد علي الجموي هو أحد كبار مهندسي النماذج الأولية لتعلم الآلة ويتمتع بخبرة 10 سنوات في إنتاج التعلم الآلي. وهو يستمتع بحل مشاكل العمل من خلال التعلم الآلي وهندسة البرمجيات، ومساعدة العملاء على استخلاص قيمة الأعمال باستخدام تعلم الآلة. وكجزء من النماذج الأولية لـ AWS EMEA والهندسة السحابية، فهو يساعد العملاء على بناء حلول الأعمال التي تستفيد من الابتكارات في MLOPs وNLP وCV وLLMs.

محمد علي الجموي هو أحد كبار مهندسي النماذج الأولية لتعلم الآلة ويتمتع بخبرة 10 سنوات في إنتاج التعلم الآلي. وهو يستمتع بحل مشاكل العمل من خلال التعلم الآلي وهندسة البرمجيات، ومساعدة العملاء على استخلاص قيمة الأعمال باستخدام تعلم الآلة. وكجزء من النماذج الأولية لـ AWS EMEA والهندسة السحابية، فهو يساعد العملاء على بناء حلول الأعمال التي تستفيد من الابتكارات في MLOPs وNLP وCV وLLMs.

جوزيبي هانين هو مستشار مشارك في ProServe. يطبق جوزيبي مهاراته التحليلية بالاشتراك مع الذكاء الاصطناعي والتعلم الآلي لتطوير حلول واضحة وفعالة لعملائه. يحب التوصل إلى حلول بسيطة للمشكلات المعقدة، خاصة تلك التي تتضمن أحدث التطورات والأبحاث التكنولوجية.

جوزيبي هانين هو مستشار مشارك في ProServe. يطبق جوزيبي مهاراته التحليلية بالاشتراك مع الذكاء الاصطناعي والتعلم الآلي لتطوير حلول واضحة وفعالة لعملائه. يحب التوصل إلى حلول بسيطة للمشكلات المعقدة، خاصة تلك التي تتضمن أحدث التطورات والأبحاث التكنولوجية.

لورينز تن كيت هو عالم بيانات كبير. يعمل Laurens مع عملاء المؤسسات في أوروبا والشرق الأوسط وأفريقيا لمساعدتهم على تسريع نتائج أعمالهم باستخدام تقنيات AWS AI/ML. وهو متخصص في حلول البرمجة اللغوية العصبية ويركز على صناعة سلسلة التوريد والخدمات اللوجستية. يستمتع في أوقات فراغه بالقراءة والفن.

لورينز تن كيت هو عالم بيانات كبير. يعمل Laurens مع عملاء المؤسسات في أوروبا والشرق الأوسط وأفريقيا لمساعدتهم على تسريع نتائج أعمالهم باستخدام تقنيات AWS AI/ML. وهو متخصص في حلول البرمجة اللغوية العصبية ويركز على صناعة سلسلة التوريد والخدمات اللوجستية. يستمتع في أوقات فراغه بالقراءة والفن.

ايرينا رادو هو مدير مشاركة النماذج الأولية، وهو جزء من النماذج الأولية لـ AWS EMEA والهندسة السحابية. إنها تساعد العملاء على تحقيق أقصى استفادة من أحدث التقنيات والابتكار بشكل أسرع والتفكير بشكل أكبر.

ايرينا رادو هو مدير مشاركة النماذج الأولية، وهو جزء من النماذج الأولية لـ AWS EMEA والهندسة السحابية. إنها تساعد العملاء على تحقيق أقصى استفادة من أحدث التقنيات والابتكار بشكل أسرع والتفكير بشكل أكبر.

- محتوى مدعوم من تحسين محركات البحث وتوزيع العلاقات العامة. تضخيم اليوم.

- PlatoData.Network Vertical Generative Ai. تمكين نفسك. الوصول هنا.

- أفلاطونايستريم. ذكاء Web3. تضخيم المعرفة. الوصول هنا.

- أفلاطون كربون، كلينتك ، الطاقة، بيئة، شمسي، إدارة المخلفات. الوصول هنا.

- أفلاطون هيلث. التكنولوجيا الحيوية وذكاء التجارب السريرية. الوصول هنا.

- المصدر https://aws.amazon.com/blogs/machine-learning/boosting-rag-based-intelligent-document-assistants-using-entity-extraction-sql-querying-and-agents-with-amazon-bedrock/

- :لديها

- :يكون

- :ليس

- :أين

- $ UP

- 1

- 10

- 100

- 2022

- 3d

- 7

- a

- القدرة

- ماهرون

- من نحن

- تسريع

- الوصول

- يمكن الوصول

- إنجاز

- حسابي

- دقة

- دقيق

- بدقة

- التأهيل

- تحقيق

- في

- عمل

- التمثيل

- اكشن

- الإجراءات

- تكيف

- تضيف

- وبالإضافة إلى ذلك

- يضيف

- اعتمد

- بعد

- مرة أخرى

- ضد

- الوكيل

- عملاء

- AI

- مساعد AI

- AI / ML

- خوارزمية

- يحاذي

- الكل

- يسمح

- جنبا إلى جنب

- أيضا

- أمازون

- الأمازون SageMaker

- أمازون تيكستراك

- أمازون ويب سيرفيسز

- من بين

- an

- تحليل

- تحليلية

- تحليل

- و

- آخر

- إجابة

- الأجوبة

- أنثروبي

- أي وقت

- API

- واجهات برمجة التطبيقات

- ينطبق

- التقديم

- نهج

- مناسب

- تقريبي

- هندسة معمارية

- هي

- الحجج

- حول

- فنـون

- AS

- تطلب

- مساعدة

- المساعد

- مساعدين

- محام

- أسوشيتد

- افترض

- At

- الهجمات

- محاولات

- سمعي

- زيادة

- المعزز

- فجر

- تلقائيا

- مستقل

- متاح

- AWS

- الى الخلف

- الخلفية

- الرصيد

- قاعدة

- على أساس

- الأساسية

- BE

- لان

- كان

- قبل

- سلوك

- وراء

- اعتقد

- الفوائد

- أفضل

- ما بين

- Beyond

- أكبر

- تعزيز

- على حد سواء

- نساعدك في بناء

- ابني

- الأعمال

- الأعمال

- لكن

- by

- مخبأ

- CAD

- دعوة

- تسمى

- دعوة

- دعوات

- CAN

- مرشح

- قدرات

- قادر على

- حمل

- حقيبة

- الحالات

- سلسلة

- chatbot

- الشيكات

- خيار

- الخيارات

- اختار

- فئة

- تصنيف

- واضح

- سحابة

- متماسك

- للاتعاون

- عمود

- الأعمدة

- مجموعة

- يجمع بين

- تأتي

- مشترك

- الشركات

- حول الشركة

- قارن

- مقارنة

- مقارنات

- تكملة

- إكمال

- مجمع

- معقد

- عنصر

- مكونات

- تتألف

- شامل

- إحصاء

- المفاهيم

- الخرسانة

- حالة

- إدارة

- التواصل

- نظر

- الاعتبارات

- ثابتة

- دعم

- بناء

- consultants

- تحتوي على

- الواردة

- يحتوي

- محتوى

- سياق الكلام

- محادثة

- تحادثي

- محادثة منظمة العفو الدولية

- المحادثات

- تحول

- تحويلها

- جوهر

- تصحيح

- بشكل صحيح

- المقابلة

- التكلفة

- التكاليف

- استطاع

- إلى جانب

- خلق

- يخلق

- خلق

- حالياًّ

- على

- زبون

- دعم العملاء

- العملاء

- البيانات

- الوصول إلى البيانات

- عالم البيانات

- قاعدة البيانات

- قررت

- اتخاذ القرار

- عميق

- أعمق

- تعريف

- يعرف

- الخوض

- الطلب

- عرض

- شرح

- تظاهر

- يوضح

- التبعيات

- نشر

- وصف

- وصف

- تصف

- وصف

- تصميم

- أنماط التصميم

- عملية التصميم

- تصميم

- مفصلة

- تفاصيل

- بكشف أو

- كشف

- تطوير

- التطوير التجاري

- التطورات

- رقمي

- إفشاء

- بحث

- ناقش

- مناقشات

- مسافة

- غطس

- عدة

- غوص

- do

- وثيقة

- توثيق

- وثائق

- هل

- لا

- نطاق

- المجالات

- فعل

- إلى أسفل

- سائق

- اثنان

- أثناء

- حيوي

- كل

- في وقت سابق

- في وقت مبكر

- سهولة

- سهولة الاستخدام

- بسهولة

- الطُرق الفعّالة

- على نحو فعال

- كفاءة

- فعال

- بكفاءة

- إما

- عناصر

- تضمين

- EMEA

- ظهرت

- توظيف

- تمكين

- تمكن

- تمكين

- النهاية

- اشتباك

- محرك

- الهندسة

- محركات

- تعزيز

- يعزز

- كاف

- إثراء

- مشروع

- الكيانات

- كيان

- البيئة

- أخطاء

- خاصة

- أساسي

- أنشئ

- حتى

- يتطور

- بحث

- مثال

- أمثلة

- وجود

- القائمة

- وسع

- متوقع

- الخبره في مجال الغطس

- شرح

- شرح

- ويوضح

- اكتشف

- استكشاف

- مكشوف

- مد

- إطالة

- تمديد

- احتفل على

- استخراج

- استخلاص

- مقتطفات

- واجه

- فشل

- الأسئلة الشائعة

- بعيدا

- أسرع

- الميزات

- المميزات

- ردود الفعل

- قليل

- حقل

- قم بتقديم

- ملفات

- تصفية

- مرشحات

- نهائي

- أخيرا

- مالي

- الاسم الأول

- مرونة

- مرن

- تدفق

- تركز

- التركيز

- متابعيك

- متابعات

- في حالة

- النموذج المرفق

- شكل

- شكلت

- أشكال

- الإطار

- مجانا

- تبدأ من

- جبهة

- نهاية المقدمة

- الوفاء

- بالإضافة إلى

- تماما

- وظيفة

- إضافي

- بوابة

- جمع

- العلاجات العامة

- توليد

- ولدت

- توليد

- جيل

- توليدي

- الذكاء الاصطناعي التوليدي

- دولار فقط واحصل على خصم XNUMX% على جميع

- الحصول على

- GitHub جيثب:

- معطى

- هدف

- خير

- تدريجيا

- منح

- تجمع

- مجموعات

- كان

- يملك

- وجود

- he

- مساعدة

- مساعدة

- يساعد

- هنا

- مرتفع

- أعلى

- سلط الضوء

- له

- تاريخ

- نأمل

- كيفية

- كيفية

- لكن

- HTML

- HTTPS

- الانسان

- الأفكار

- يحدد

- تحديد

- تحديد

- هوية

- if

- صورة

- صور

- تخيل

- تنفيذ

- التنفيذ

- نفذت

- تحقيق

- أهمية

- أهمية

- تحسن

- تحسن

- تحسينات

- تحسين

- in

- يشمل

- مؤشر

- مفهرس

- العالمية

- معلومات

- استخراج المعلومات

- في البداية

- الابتكار

- الابتكارات

- إدخال

- المدخلات

- إلهام

- إلهام

- موحى

- تثبيت

- مثل

- بدلًا من ذلك

- دمج

- ذكي

- تفاعل

- داخلي

- إلى

- تقديم

- أدخلت

- استثمر

- تحقيق

- استثمار

- تنطوي

- IT

- انها

- نفسها

- وظيفة

- رحلة

- JPG

- جسون

- احتفظ

- القفل

- مفاتيح

- المعرفة

- معروف

- لغة

- كبير

- إلى حد كبير

- اسم العائلة

- الى وقت لاحق

- آخر

- تطلق

- طبقة

- تعلم

- الأقل

- ليد

- الطول

- مستوى

- الرافعة المالية

- مثل

- مما سيحدث

- القيود

- LINK

- لينكدين:

- قائمة

- LLM

- الأحمال

- الخدمات اللوجستية

- صناعة الخدمات اللوجستية

- طويل

- يحب

- آلة

- آلة التعلم

- صنع

- الرئيسية

- المحافظة

- الحفاظ على

- جعل

- تمكن

- مدير

- كثير

- مباراة

- مطابقة

- ناضج

- مايو..

- me

- معنى

- الإجراءات

- تعرف علي

- يذكر

- مجرد

- عيون

- الرسالة

- البيانات الوصفية

- طريقة

- طرق

- متري

- المقاييس

- الحد الأدنى

- مضلل

- مفقود

- ML

- MLOps

- نموذج

- عارضات ازياء

- الاعتدال

- تقدم

- وحدة

- الأكثر من ذلك

- علاوة على ذلك

- أكثر

- متعدد

- يجب

- أسماء

- طبيعي

- معالجة اللغات الطبيعية

- ضروري

- حاجة

- بحاجة

- إحتياجات

- الجيران

- صاف

- صافي الإيرادات

- أبدا

- جديد

- التالي

- البرمجة اللغوية العصبية

- بدون اضاءة

- مفكرة

- Notion

- موضوع

- كشف الكائن

- of

- عرضت

- الوهب

- حاليا

- غالبا

- on

- ONE

- جارية

- فقط

- جاكيت

- المصدر المفتوح

- عمليات

- الأمثل

- مزيد من الخيارات

- or

- طلب

- أصلي

- أخرى

- أخرى

- لنا

- خارج

- النتائج

- الخطوط العريضة

- أوجز

- الناتج

- النتائج

- على مدى

- الكلي

- تغلب

- الخاصة

- صفقة

- الباندا

- جزء

- أجزاء

- نمط

- أنماط

- نفذ

- أداء

- إذن

- منظور

- الأدوية

- قطعة

- خط أنابيب

- عادي

- تخطيط

- أفلاطون

- الذكاء افلاطون البيانات

- أفلاطون داتا

- معقول

- البوينت

- سياسة

- الرائج

- شعبية

- مأهول

- ممكن

- ربما

- منشور

- كيو

- محتمل

- يحتمل

- مدعوم

- قوي

- ممارسة

- دقة

- إعداد

- يقدم

- قدم

- الهدايا

- الحفاظ على

- منع

- يمنع

- سابقا

- امتياز

- حل المشاكل

- مشاكل

- عملية المعالجة

- معالجة

- ينتج عنه

- إنتاج

- المنتج

- الإنتــاج

- وعد

- واعد

- HAS

- اقترح

- المقترح

- يقترح

- النماذج

- ثبت

- تزود

- ويوفر

- جمهور

- بايثون

- سؤال وجواب

- الاستفسارات

- سؤال

- الأسئلة المتكررة

- سريع

- بسرعة

- تصنيف

- سريع

- الخام

- الوصول

- التي تم الوصول إليها

- رد فعل

- نادي القراءة

- استعداد

- حقيقي

- العالم الحقيقي

- في الوقت الحقيقي

- سبب

- معقول

- تلقى

- يستلم

- الأخيرة

- مؤخرا

- الاعتراف

- نوصي

- توصية مجاناً

- تخفيض

- الرجوع

- منطقة

- ذات الصلة

- الموثوقية

- اعتمد

- بقايا

- التقارير

- مستودع

- مثل

- طلب

- تطلب

- مطلوب

- المتطلبات

- يتطلب

- بحث

- استجابة

- ردود

- REST

- نتيجة

- النتائج

- عائد أعلى

- إيرادات

- الإيرادات

- مراجعة

- حق

- المخاطر

- النوع

- القواعد

- يجري

- تشغيل

- يدير

- sagemaker

- نفسه

- التدرجية

- تفحص

- مسح

- عالم

- سيناريو

- بحث

- محرك البحث

- الثاني

- القسم

- أقسام

- أمن

- التدابير الأمنية

- انظر تعريف

- طلب

- رأيت

- اختيار

- اختيار

- دلالات

- يرسل

- كبير

- أرسلت

- تسلسل

- الخدمة

- خدماتنا

- هي

- ينبغي

- إظهار

- أظهرت

- أظهرت

- مماثل

- الاشارات

- مبسط

- تبسيط

- معا

- منذ

- عزباء

- مهارات

- So

- حتى الآن

- تطبيقات الكمبيوتر

- هندسة البرمجيات

- فقط

- حل

- الحلول

- حل

- بعض

- أحيانا

- مصدر

- مصادر

- الفضاء

- متخصص

- تتخصص

- محدد

- سرعة

- الإنشقاقات

- كومة

- مراحل

- بداية

- ابتداء

- قيادة

- خطوة

- خطوات

- متجر

- تخزين

- صريح

- استراتيجيات

- الإستراتيجيات

- ضرب

- السعي

- بناء

- منظم

- ستوديو

- ناجح

- هذه

- اقترح

- مناسب

- تلخيص

- تزويد

- سلسلة التوريد

- الدعم

- الدعم

- بالتأكيد

- بناء الجملة

- نظام

- جدول

- تناسب

- أخذ

- يأخذ

- مهمة

- المهام

- التكنولوجيا

- تقنيات

- التكنولوجية

- التكنولوجيا

- اقول

- عشرة

- نص

- نصي

- شكر

- أن

- •

- المعلومات

- من مشاركة

- منهم

- then

- هناك.

- وبالتالي

- وبالتالي

- تشبه

- هم

- اعتقد

- تفكير

- هؤلاء

- ثلاثة

- عبر

- الوقت

- عملاق

- إلى

- اليوم

- أداة

- أدوات

- تيشرت

- 5 الأعلى

- نحو

- نحو

- أثر

- تقليدي

- قادة الإيمان

- تحول

- معالجة

- صحيح

- جدير بالثقة

- اثنان

- نوع

- أنواع

- عادة

- ui

- التي تقوم عليها

- فهم

- حتى

- تحديث

- بناء على

- us

- تستخدم

- مستعمل

- مستخدم

- تجربة المستخدم

- المستخدمين

- يستخدم

- استخدام

- التحقق من صحة

- قيمنا

- القيم

- تشكيلة

- مختلف

- متعدد الجوانب

- فيديو

- مقاطع فيديو

- نقاط الضعف

- يمشي

- طريق..

- we

- الويب

- خدمات ويب

- حسن

- كان

- ابحث عن

- متى

- في حين

- سواء

- التي

- في حين

- لماذا

- ويكيبيديا

- سوف

- مع

- في غضون

- بدون

- أعمال

- سوف

- جاري الكتابة

- X

- عام

- سنوات

- أنت

- حل متجر العقارات الشامل الخاص بك في جورجيا

- زفيرنت