أصبح الذكاء الاصطناعي (AI) موضوعًا مهمًا وشائعًا في مجتمع التكنولوجيا. مع تطور الذكاء الاصطناعي ، شهدنا ظهور أنواع مختلفة من نماذج التعلم الآلي (ML). نهج واحد ، والمعروف باسم النمذجة الفرقة، يكتسب زخمًا سريعًا بين علماء البيانات والممارسين. في هذا المنشور ، نناقش ماهية نماذج المجموعات ولماذا يمكن أن يكون استخدامها مفيدًا. نقدم بعد ذلك مثالاً على كيفية تدريب مجموعاتك المخصصة وتحسينها ونشرها باستخدام الأمازون SageMaker.

يشير التعلم الجماعي إلى استخدام نماذج وخوارزميات تعلم متعددة للحصول على تنبؤات أكثر دقة من أي خوارزمية تعلم فردية. لقد أثبتت فعاليتها في التطبيقات المتنوعة وإعدادات التعلم مثل الأمن السيبراني [1] واكتشاف الاحتيال والاستشعار عن بعد والتنبؤ بأفضل الخطوات التالية في اتخاذ القرارات المالية والتشخيص الطبي وحتى رؤية الكمبيوتر ومعالجة اللغة الطبيعية (NLP) مهام. نميل إلى تصنيف المجموعات من خلال التقنيات المستخدمة لتدريبها ، وتكوينها ، والطريقة التي تدمج بها التنبؤات المختلفة في استنتاج واحد. تشمل هذه الفئات:

- تعزيز - تدريب العديد من المتعلمين الضعفاء بالتتابع ، حيث يُعطى كل توقع غير صحيح من المتعلمين السابقين في التسلسل وزنًا ومدخلات أعلى للمتعلم التالي ، وبالتالي تكوين متعلم أقوى. تتضمن الأمثلة AdaBoost و Gradient Boosting و XGBoost.

- التعبئة - يستخدم نماذج متعددة لتقليل تباين نموذج واحد. تشمل الأمثلة الغابة العشوائية والأشجار الإضافية.

- التراص (المزج) - غالبًا ما يستخدم نماذج غير متجانسة ، حيث يتم تجميع تنبؤات كل مقدر فردي معًا واستخدامها كمدخل إلى مقدر نهائي يتعامل مع التنبؤ. غالبًا ما تستخدم عملية تدريب المقدر النهائي هذا التحقق المتبادل.

هناك طرق متعددة لدمج التنبؤات في واحدة ينتجها النموذج أخيرًا ، على سبيل المثال ، باستخدام مقدر ميتا مثل المتعلم الخطي ، وهي طريقة تصويت تستخدم نماذج متعددة لعمل توقع يعتمد على تصويت الأغلبية لمهام التصنيف ، أو مجموعة متوسط الانحدار.

على الرغم من أن العديد من المكتبات والأطر توفر تطبيقات لنماذج المجموعات ، مثل XGBoost أو CatBoost أو الغابة العشوائية scikit-Learn ، فإننا نركز في هذا المنشور على إحضار النماذج الخاصة بك واستخدامها كمجموعة تكديس. ومع ذلك ، بدلاً من استخدام موارد مخصصة لكل نموذج (تدريب مخصص وضبط الوظائف واستضافة نقاط النهاية لكل نموذج) ، نقوم بتدريب مجموعة مخصصة (نماذج متعددة) وضبطها ونشرها باستخدام وظيفة تدريب SageMaker واحدة ووظيفة ضبط واحدة ، و نشر إلى نقطة نهاية واحدة ، وبالتالي تقليل التكلفة المحتملة والتكاليف التشغيلية.

BYOE: أحضر مجموعتك الخاصة

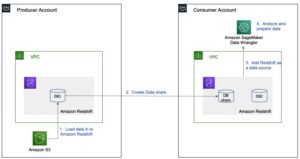

هناك عدة طرق لتدريب ونشر نماذج المجموعات غير المتجانسة باستخدام SageMaker: يمكنك تدريب كل نموذج في وظيفة تدريب منفصلة وتحسين كل نموذج على حدة باستخدام الضبط التلقائي لنموذج Amazon SageMaker. عند استضافة هذه النماذج ، يوفر SageMaker العديد من الطرق الفعالة من حيث التكلفة لاستضافة نماذج متعددة على نفس البنية التحتية للمستأجر. يمكن العثور على أنماط النشر التفصيلية لهذا النوع من الإعدادات في نماذج الاستضافة في Amazon SageMaker ، الجزء 1: أنماط التصميم الشائعة لبناء تطبيقات ML على Amazon SageMaker. تتضمن هذه الأنماط استخدام نقاط نهاية متعددة (لكل نموذج مدرب) أو واحد نقطة نهاية متعددة النماذج، أو حتى أغنية واحدة نقطة نهاية متعددة الحاويات حيث يمكن استدعاء الحاويات بشكل فردي أو تقييدها في خط أنابيب. تتضمن كل هذه الحلول مقدرًا تلويًا (على سبيل المثال في ملف AWS لامدا الدالة) التي تستدعي كل نموذج وتنفذ وظيفة المزج أو التصويت.

ومع ذلك ، قد يؤدي تشغيل وظائف تدريبية متعددة إلى زيادة التكاليف التشغيلية والتكلفة ، خاصة إذا كانت مجموعتك تتطلب التدريب على نفس البيانات. وبالمثل ، فإن استضافة نماذج مختلفة على نقاط نهاية أو حاويات منفصلة والجمع بين نتائج التنبؤ الخاصة بها للحصول على دقة أفضل يتطلب استدعاءات متعددة ، وبالتالي يقدم إدارة وتكلفة وجهود مراقبة إضافية. على سبيل المثال ، يدعم SageMaker ملفات تجميع نماذج ML باستخدام خادم الاستدلال Triton، لكن هذا الحل يتطلب دعم النماذج أو مجموعات النماذج من خلال واجهة Triton الخلفية. بالإضافة إلى ذلك ، يلزم بذل جهود إضافية من العميل لإعداد خادم Triton وتعلم إضافي لفهم كيفية عمل خلفيات Triton المختلفة. لذلك ، يفضل العملاء طريقة أكثر وضوحًا لتنفيذ الحلول حيث يحتاجون فقط إلى إرسال الاستدعاء مرة واحدة إلى نقطة النهاية ولديهم المرونة للتحكم في كيفية تجميع النتائج لإنشاء المخرجات النهائية.

حل نظرة عامة

لمعالجة هذه المخاوف ، نسير في مثال على تدريب المجموعات باستخدام وظيفة تدريب واحدة ، وتحسين المعلمات الفائقة للنموذج ونشرها باستخدام حاوية واحدة إلى نقطة نهاية بدون خادم. نستخدم نموذجين لمكدس المجموعة لدينا: CatBoost و XGBoost (وكلاهما يعمل على تعزيز المجموعات). لبياناتنا ، نستخدم مجموعة بيانات مرض السكري [2] من مكتبة scikit-Learn: تتكون من 10 ميزات (العمر والجنس وكتلة الجسم وضغط الدم وستة قياسات لمصل الدم) ، ويتنبأ نموذجنا بتطور المرض بعد عام واحد من جمع الميزات الأساسية (الانحدار) نموذج).

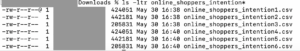

يمكن العثور على مستودع الكود الكامل على GitHub جيثب:.

تدريب نماذج متعددة في وظيفة SageMaker واحدة

لتدريب نماذجنا ، نستخدم وظائف تدريب SageMaker في وضع Script. باستخدام وضع Script ، يمكنك كتابة تدريب مخصص (ورمز الاستدلال لاحقًا) أثناء استخدام حاويات إطار عمل SageMaker. تمكّنك حاويات الإطار من استخدام البيئات الجاهزة التي تديرها AWS والتي تتضمن جميع التكوينات والوحدات النمطية الضرورية. لتوضيح كيف يمكنك تخصيص حاوية إطار العمل ، على سبيل المثال ، نستخدم حاوية SKLearn سابقة الإنشاء ، والتي لا تتضمن حزمتي XGBoost و CatBoost. هناك خياران لإضافة هذه الحزم: إما تمديد الحاوية المدمجة لتثبيت CatBoost و XGBoost (ثم نشره كحاوية مخصصة) ، أو استخدام ميزة وضع البرنامج النصي لمهمة التدريب من SageMaker ، والتي تتيح لك توفير requirements.txt ملف عند إنشاء مقدر التدريب. تقوم وظيفة تدريب SageMaker بتثبيت المكتبات المدرجة في ملف requirements.txt ملف أثناء وقت التشغيل. بهذه الطريقة ، لن تحتاج إلى إدارة مستودع صور Docker الخاص بك ويوفر المزيد من المرونة لتشغيل البرامج النصية التدريبية التي تحتاج إلى حزم Python إضافية.

يُظهر مقطع التعليمات البرمجية التالي الكود الذي نستخدمه لبدء التدريب. ال entry_point تشير المعلمة إلى برنامج التدريب الخاص بنا. نستخدم أيضًا اثنين من الميزات الجذابة لـ SageMaker SDK API:

- أولاً ، نحدد المسار المحلي لدليل المصدر والتبعيات في ملف

source_dirوdependenciesالمعلمات ، على التوالي. سيقوم SDK بضغط هذه الدلائل وتحميلها إلى ملفات خدمة تخزين أمازون البسيطة (Amazon S3) و SageMaker ستجعلهما متاحين في نسخة التدريب ضمن دليل العمل/opt/ml/code. - ثانيًا ، نستخدم SDK

SKLearnمقدر مع إصدار Python وإطار العمل المفضل لدينا ، بحيث يقوم SageMaker بسحب الحاوية المقابلة. لقد حددنا أيضًا مقياس تدريب مخصص "validation:rmse، والتي ستنبعث في سجلات التدريب وتلتقطها SageMaker. في وقت لاحق ، نستخدم هذا المقياس كمقياس موضوعي في وظيفة الضبط.

hyperparameters = {"num_round": 6, "max_depth": 5}

estimator_parameters = {

"entry_point": "multi_model_hpo.py",

"source_dir": "code",

"dependencies": ["my_custom_library"],

"instance_type": training_instance_type,

"instance_count": 1,

"hyperparameters": hyperparameters,

"role": role,

"base_job_name": "xgboost-model",

"framework_version": "1.0-1",

"keep_alive_period_in_seconds": 60,

"metric_definitions":[

{'Name': 'validation:rmse', 'Regex': 'validation-rmse:(.*?);'}

]

}

estimator = SKLearn(**estimator_parameters)بعد ذلك ، نكتب نص التدريب الخاص بنا (multi_model_hpo.py). يتبع البرنامج النصي الخاص بنا تدفقًا بسيطًا: التقاط المعلمات الفائقة الذي تم تكوين الوظيفة به و تدريب نموذج CatBoost و نموذج XGBoost. نقوم أيضًا بتنفيذ ملف صليب ك أضعاف وظيفة التحقق من الصحة. انظر الكود التالي:

if __name__ == "__main__":

parser = argparse.ArgumentParser() # Sagemaker specific arguments. Defaults are set in the environment variables.

parser.add_argument("--output-data-dir", type=str, default=os.environ["SM_OUTPUT_DATA_DIR"])

parser.add_argument("--model-dir", type=str, default=os.environ["SM_MODEL_DIR"])

parser.add_argument("--train", type=str, default=os.environ["SM_CHANNEL_TRAIN"])

parser.add_argument("--validation", type=str, default=os.environ["SM_CHANNEL_VALIDATION"])

.

.

.

"""

Train catboost

"""

K = args.k_fold

catboost_hyperparameters = {

"max_depth": args.max_depth,

"eta": args.eta,

}

rmse_list, model_catboost = cross_validation_catboost(train_df, K, catboost_hyperparameters)

.

.

.

"""

Train the XGBoost model

""" hyperparameters = {

"max_depth": args.max_depth,

"eta": args.eta,

"objective": args.objective,

"num_round": args.num_round,

} rmse_list, model_xgb = cross_validation(train_df, K, hyperparameters)بعد تدريب النماذج ، نحسب متوسط تنبؤات CatBoost و XGBoost. النتائج، pred_mean، هو توقع مجموعتنا النهائي. ثم نحدد mean_squared_error ضد مجموعة التحقق من الصحة. val_rmse يستخدم لتقييم المجموعة بأكملها أثناء التدريب. لاحظ أننا نطبع أيضًا قيمة RMSE بنمط يناسب regex الذي استخدمناه في ملف metric_definitions. في وقت لاحق ، سيستخدم SageMaker Automatic Model Tuning ذلك لالتقاط القياس الموضوعي. انظر الكود التالي:

pred_mean = np.mean(np.array([pred_catboost, pred_xgb]), axis=0)

val_rmse = mean_squared_error(y_validation, pred_mean, squared=False)

print(f"Final evaluation result: validation-rmse:{val_rmse}")أخيرًا ، يحفظ البرنامج النصي الخاص بنا كلا من التحف النموذجية في مجلد الإخراج الموجود في /opt/ml/model.

عند اكتمال مهمة تدريبية ، يقوم برنامج SageMaker بحزم ونسخ محتوى ملف /opt/ml/model الدليل ككائن واحد بتنسيق TAR مضغوط إلى موقع S3 الذي حددته في تكوين الوظيفة. في حالتنا ، يقوم SageMaker بتجميع النموذجين في ملف TAR وتحميله إلى Amazon S3 في نهاية مهمة التدريب. انظر الكود التالي:

model_file_name = 'catboost-regressor-model.dump'

# Save CatBoost model

path = os.path.join(args.model_dir, model_file_name)

print('saving model file to {}'.format(path))

model.save_model(path)

.

.

.

# Save XGBoost model

model_location = args.model_dir + "/xgboost-model"

pickle.dump(model, open(model_location, "wb"))

logging.info("Stored trained model at {}".format(model_location))باختصار ، يجب أن تلاحظ أنه في هذا الإجراء قمنا بتنزيل البيانات مرة واحدة وقمنا بتدريب نموذجين باستخدام وظيفة تدريب واحدة.

ضبط تلقائي لنموذج المجموعة

نظرًا لأننا نبني مجموعة من نماذج ML ، فإن استكشاف جميع تباديل المعلمات الفائقة المحتملة غير عملي. عروض SageMaker ضبط تلقائي للموديل (AMT)، التي تبحث عن أفضل معلمات تشعبية للنموذج من خلال التركيز على مجموعات القيم الواعدة ضمن النطاقات التي تحددها (الأمر متروك لك لتحديد النطاقات المناسبة لاستكشافها). يدعم SageMaker طرق تحسين متعددة لتختار من بينها.

نبدأ بتحديد جزأين من عملية التحسين: القياس الموضوعي والمعلمات الفائقة التي نريد ضبطها. في مثالنا ، نستخدم RMSE للتحقق كمقياس مستهدف ونقوم بضبطه eta و max_depth (للمعلمات التشعبية الأخرى ، يرجى الرجوع إلى معلمات XGBoost الفائقة و معلمات تشعبية CatBoost):

from sagemaker.tuner import (

IntegerParameter,

ContinuousParameter,

HyperparameterTuner,

) hyperparameter_ranges = {

"eta": ContinuousParameter(0.2, 0.3),

"max_depth": IntegerParameter(3, 4)

}

metric_definitions = [{"Name": "validation:rmse", "Regex": "validation-rmse:([0-9.]+)"}]

objective_metric_name = "validation:rmse"نحتاج أيضًا إلى التأكد في نص التدريب أن المعلمات التشعبية الخاصة بنا ليست مضمنة ويتم سحبها من وسيطات وقت تشغيل SageMaker:

catboost_hyperparameters = {

"max_depth": args.max_depth,

"eta": args.eta,

}يكتب SageMaker أيضًا المعلمات التشعبية إلى ملف JSON ويمكن القراءة منه /opt/ml/input/config/hyperparameters.json في حالة التدريب.

مثل CatBoost ، نلتقط أيضًا المعلمات الفائقة لطراز XGBoost (لاحظ ذلك objective و num_round لم يتم ضبطها):

catboost_hyperparameters = {

"max_depth": args.max_depth,

"eta": args.eta,

}أخيرًا ، أطلقنا وظيفة ضبط المعلمة الفائقة باستخدام التكوينات التالية:

tuner = HyperparameterTuner(

estimator,

objective_metric_name,

hyperparameter_ranges,

max_jobs=4,

max_parallel_jobs=2,

objective_type='Minimize'

)

tuner.fit({"train": train_location, "validation": validation_location}, include_cls_metadata=False)عند اكتمال المهمة ، يمكنك استرداد القيم لأفضل وظيفة تدريبية (مع الحد الأدنى من RMSE):

job_name=tuner.latest_tuning_job.name

attached_tuner = HyperparameterTuner.attach(job_name)

attached_tuner.describe()["BestTrainingJob"]لمزيد من المعلومات حول AMT ، يرجى الرجوع إلى قم بإجراء ضبط تلقائي للنموذج باستخدام SageMaker.

قابل للفتح

لنشر مجموعتنا المخصصة ، نحتاج إلى توفير برنامج نصي للتعامل مع طلب الاستدلال وتهيئة استضافة SageMaker. في هذا المثال ، استخدمنا ملفًا واحدًا يتضمن كلاً من كود التدريب والاستنتاج (multi_model_hpo.py). يستخدم SageMaker الكود الموجود ضمن if _ name _ == "_ main _" للتدريب والوظائف model_fn, input_fnو predict_fn عند نشر النموذج وخدمته.

نص الاستدلال

كما هو الحال مع التدريب ، نستخدم حاوية إطار عمل SageMaker SKLearn مع البرنامج النصي للاستدلال الخاص بنا. سينفذ البرنامج النصي ثلاث طرق مطلوبة بواسطة SageMaker.

أولا، model_fn يقرأ الأسلوب ملفاتنا النموذجية المحفوظة ويحملها في الذاكرة. في حالتنا ، تُعيد الطريقة مجموعتنا كـ all_model، وهي قائمة Python ، ولكن يمكنك أيضًا استخدام قاموس بأسماء النماذج كمفاتيح.

def model_fn(model_dir):

catboost_model = CatBoostRegressor()

catboost_model.load_model(os.path.join(model_dir, model_file_name))

model_file = "xgboost-model"

model = pickle.load(open(os.path.join(model_dir, model_file), "rb"))

all_model = [catboost_model, model]

return all_modelثانيا، input_fn تقوم الطريقة بإلغاء تسلسل بيانات إدخال الطلب ليتم تمريرها إلى معالج الاستدلال الخاص بنا. لمزيد من المعلومات حول معالجات الإدخال ، ارجع إلى تكييف حاوية الاستدلال الخاصة بك.

def input_fn(input_data, content_type):

dtype=None

payload = StringIO(input_data)

return np.genfromtxt(payload, dtype=dtype, delimiter=",")ثالثا، predict_fn الطريقة مسؤولة عن الحصول على تنبؤات من النماذج. تأخذ الطريقة النموذج والبيانات التي يتم إرجاعها منها input_fn كمعلمات وإرجاع التنبؤ النهائي. في مثالنا ، نحصل على نتيجة CatBoost من العضو الأول في قائمة الطراز (model[0]) و XGBoost من العضو الثاني (model[1]) ، ونستخدم دالة مزج تُرجع متوسط كلا التنبؤين:

def predict_fn(input_data, model):

predictions_catb = model[0].predict(input_data)

dtest = xgb.DMatrix(input_data)

predictions_xgb = model[1].predict(dtest,

ntree_limit=getattr(model, "best_ntree_limit", 0),

validate_features=False)

return np.mean(np.array([predictions_catb, predictions_xgb]), axis=0)الآن بعد أن أصبح لدينا نماذجنا المدربة ونصوص الاستدلال ، يمكننا تهيئة البيئة لنشر مجموعتنا.

استدلال SageMaker Serverless

على الرغم من أن هناك العديد من خيارات الاستضافة في SageMaker، في هذا المثال ، نستخدم نقطة نهاية بدون خادم. تعمل نقاط النهاية التي لا تحتوي على خادم تلقائيًا على تشغيل موارد الحوسبة وتوسيع نطاقها للداخل والخارج وفقًا لحركة المرور. هذا يزيل العبء الثقيل غير المتمايز لإدارة الخوادم. يعد هذا الخيار مثاليًا لأحمال العمل التي بها فترات خمول بين فترات الازدحام المروري ويمكنها تحمل البدايات الباردة.

يعد تكوين نقطة النهاية بدون خادم أمرًا سهلاً لأننا لسنا بحاجة إلى اختيار أنواع المثيلات أو إدارة سياسات القياس. نحتاج فقط إلى توفير معاملين: حجم الذاكرة والحد الأقصى للتزامن. تقوم نقطة النهاية بدون خادم تلقائيًا بتعيين موارد الحساب المتناسبة مع الذاكرة التي تحددها. إذا اخترت حجم ذاكرة أكبر ، فإن الحاوية الخاصة بك يمكنها الوصول إلى المزيد من وحدات المعالجة المركزية الافتراضية. يجب عليك دائمًا اختيار حجم ذاكرة نقطة النهاية وفقًا لحجم النموذج الخاص بك. المعلمة الثانية التي نحتاج إلى توفيرها هي الحد الأقصى من التزامن. بالنسبة إلى نقطة نهاية واحدة ، يمكن إعداد هذه المعلمة حتى 200 (اعتبارًا من كتابة هذه السطور ، يكون الحد الأقصى لعدد نقاط النهاية التي لا تحتوي على خادم في المنطقة هو 50). يجب أن تلاحظ أن الحد الأقصى للتزامن لنقطة نهاية فردية يمنع نقطة النهاية هذه من تناول جميع الاستدعاءات المسموح بها لحسابك ، لأنه يتم اختناق أي استدعاءات لنقطة النهاية تتجاوز الحد الأقصى (لمزيد من المعلومات حول إجمالي التزامن لجميع نقاط النهاية التي لا تحتوي على خادم لكل منطقة ، يرجى الرجوع ل نقاط نهاية وحصص Amazon SageMaker).

from sagemaker.serverless.serverless_inference_config import ServerlessInferenceConfig

serverless_config = ServerlessInferenceConfig(

memory_size_in_mb=6144,

max_concurrency=1,

) الآن بعد أن قمنا بتكوين نقطة النهاية ، يمكننا أخيرًا نشر النموذج الذي تم تحديده في مهمة تحسين المعلمة الفائقة لدينا:

estimator=attached_tuner.best_estimator()

predictor = estimator.deploy(serverless_inference_config=serverless_config)تنظيف

على الرغم من أن نقاط النهاية التي لا تحتوي على خادم لها تكلفة صفرية عند عدم استخدامها ، عند الانتهاء من تشغيل هذا المثال ، يجب عليك التأكد من حذف نقطة النهاية:

predictor.delete_endpoint(predictor.endpoint)وفي الختام

في هذا المنشور ، تناولنا طريقة واحدة لتدريب مجموعة مخصصة وتحسينها ونشرها. قمنا بتفصيل عملية استخدام وظيفة تدريب واحدة لتدريب نماذج متعددة ، وكيفية استخدام الضبط التلقائي للنموذج لتحسين المعلمات التشعبية للمجموعة ، وكيفية نشر نقطة نهاية واحدة بدون خادم تمزج الاستنتاجات من نماذج متعددة.

استخدام هذه الطريقة يحل التكلفة المحتملة وقضايا التشغيل. تعتمد تكلفة وظيفة التدريب على الموارد التي تستخدمها طوال مدة الاستخدام. من خلال تنزيل البيانات مرة واحدة فقط لتدريب النموذجين ، قللنا بمقدار النصف مرحلة تنزيل بيانات المهمة والحجم المستخدم الذي يخزن البيانات ، وبالتالي قللنا التكلفة الإجمالية لوظيفة التدريب. علاوة على ذلك ، أدارت وظيفة AMT أربع وظائف تدريبية ، كل منها مع تقليل الوقت والتخزين المذكورين أعلاه ، وهذا يمثل 4 مرات في توفير التكاليف! فيما يتعلق بنشر النموذج على نقطة نهاية بدون خادم ، نظرًا لأنك تدفع أيضًا مقابل مقدار البيانات التي تتم معالجتها ، من خلال استدعاء نقطة النهاية مرة واحدة فقط لطرازين ، فإنك تدفع نصف رسوم بيانات الإدخال / الإخراج.

على الرغم من أن هذا المنشور أظهر الفوائد مع نموذجين فقط ، يمكنك استخدام هذه الطريقة لتدريب العديد من نماذج المجموعات وضبطها ونشرها لرؤية تأثير أكبر.

مراجع حسابات

[1] راج كومار ، بي آرون ؛ سيلفاكومار ، س. (2011). "تم توزيع الكشف عن هجوم رفض الخدمة باستخدام مجموعة من المصنف العصبي". اتصالات الكمبيوتر. 34 (11): 1328-1341. دوى: 10.1016 / j.comcom.2011.01.012.

[2] برادلي إيفرون ، تريفور هاستي ، إيان جونستون وروبرت تيبشيراني (2004) "انحدار الزاوية الأقل" ، حوليات الإحصاء (مع مناقشة) ، 407-499. (https://web.stanford.edu/~hastie/Papers/LARS/LeastAngle_2002.pdf)

حول المؤلف

ميلاني لي ، دكتوراه، هو أحد كبار المتخصصين في الذكاء الاصطناعي / التعلم الآلي TAM في AWS ومقرها سيدني ، أستراليا. تساعد عملاء المؤسسات على بناء حلول تستفيد من أحدث أدوات الذكاء الاصطناعي / التعلم الآلي على AWS وتقدم إرشادات حول تصميم وتنفيذ حلول التعلم الآلي باستخدام أفضل الممارسات. في أوقات فراغها ، تحب استكشاف الطبيعة في الهواء الطلق وقضاء الوقت مع العائلة والأصدقاء.

ميلاني لي ، دكتوراه، هو أحد كبار المتخصصين في الذكاء الاصطناعي / التعلم الآلي TAM في AWS ومقرها سيدني ، أستراليا. تساعد عملاء المؤسسات على بناء حلول تستفيد من أحدث أدوات الذكاء الاصطناعي / التعلم الآلي على AWS وتقدم إرشادات حول تصميم وتنفيذ حلول التعلم الآلي باستخدام أفضل الممارسات. في أوقات فراغها ، تحب استكشاف الطبيعة في الهواء الطلق وقضاء الوقت مع العائلة والأصدقاء.

أوري روزنبرغ هو المدير الفني المتخصص في الذكاء الاصطناعي والتعلم الآلي في أوروبا والشرق الأوسط وأفريقيا. مقرها خارج إسرائيل ، تعمل Uri على تمكين عملاء المؤسسات من تصميم وبناء وتشغيل أحمال عمل ML على نطاق واسع. في أوقات فراغه ، يستمتع بركوب الدراجات والمشي لمسافات طويلة وتقليل RMSEs.

أوري روزنبرغ هو المدير الفني المتخصص في الذكاء الاصطناعي والتعلم الآلي في أوروبا والشرق الأوسط وأفريقيا. مقرها خارج إسرائيل ، تعمل Uri على تمكين عملاء المؤسسات من تصميم وبناء وتشغيل أحمال عمل ML على نطاق واسع. في أوقات فراغه ، يستمتع بركوب الدراجات والمشي لمسافات طويلة وتقليل RMSEs.

- محتوى مدعوم من تحسين محركات البحث وتوزيع العلاقات العامة. تضخيم اليوم.

- PlatoData.Network Vertical Generative Ai. تمكين نفسك. الوصول هنا.

- أفلاطونايستريم. ذكاء Web3. تضخيم المعرفة. الوصول هنا.

- أفلاطون السيارات / المركبات الكهربائية ، كربون، كلينتك ، الطاقة، بيئة، شمسي، إدارة المخلفات. الوصول هنا.

- BlockOffsets. تحديث ملكية الأوفست البيئية. الوصول هنا.

- المصدر https://aws.amazon.com/blogs/machine-learning/efficiently-train-tune-and-deploy-custom-ensembles-using-amazon-sagemaker/

- :لديها

- :يكون

- :ليس

- :أين

- ] [ص

- $ UP

- 1

- 10

- 100

- 11

- 200

- 2011

- 50

- 60

- 7

- a

- من نحن

- الوصول

- وفقا

- حسابي

- دقة

- دقيق

- تضيف

- إضافي

- وبالإضافة إلى ذلك

- العنوان

- أفريقيا

- بعد

- ضد

- السن

- AI

- AI / ML

- خوارزمية

- خوارزميات

- الكل

- سمح

- يسمح

- أيضا

- دائما

- أمازون

- الأمازون SageMaker

- أمازون ويب سيرفيسز

- من بين

- كمية

- an

- و

- أي وقت

- التطبيقات

- نهج

- هي

- الحجج

- AS

- At

- مهاجمة

- أستراليا

- أوتوماتيك

- تلقائيا

- متاح

- حيث بلغ متوسطها

- بعيدا

- AWS

- الخلفية

- على أساس

- خط الأساس

- BE

- لان

- أصبح

- كان

- يجري

- مفيد

- الفوائد

- أفضل

- أفضل الممارسات

- أفضل

- ما بين

- Beyond

- مزج

- يمزج

- حظر

- دم

- ضغط الدم

- الجسدي

- تعزيز

- على حد سواء

- جلب

- وبذلك

- نساعدك في بناء

- ابني

- مدمج

- بال

- لكن

- by

- حساب

- CAN

- أسر

- القبض

- حقيبة

- الفئات

- بالسلاسل

- اسعارنا محددة من قبل وزارة العمل

- اختار

- تصنيف

- الكود

- بارد

- مجموعة شتاء XNUMX

- تركيبات

- الجمع بين

- مشترك

- مجال الاتصالات

- مجتمع

- قهري

- إكمال

- إحصاء

- الكمبيوتر

- رؤية الكمبيوتر

- اهتمامات

- الاعداد

- تكوين

- يتكون

- وعاء

- حاويات

- محتوى

- مراقبة

- المقابلة

- التكلفة

- فعاله من حيث التكلفه

- مغطى

- خلق

- على

- زبون

- العملاء

- تصميم

- الأمن السيبراني

- البيانات

- اتخاذ القرار

- مخصصة

- الافتراضات

- حدد

- تعريف

- تحديد

- شرح

- الحرمان من الخدمة

- اعتمادا

- نشر

- نشر

- نشر

- تصميم

- أنماط التصميم

- مفصلة

- كشف

- حدد

- مختلف

- الدلائل

- بحث

- مناقشة

- مرض

- عدة

- عامل في حوض السفن

- لا

- لا

- بإمكانك تحميله

- تفريغ

- مدة الأقامة

- أثناء

- كل

- الشرق

- تأثير

- فعال

- بكفاءة

- جهود

- إما

- الظهور

- تمكين

- تمكين

- النهاية

- نقطة النهاية

- ضمان

- مشروع

- البيئة

- البيئات

- خاصة

- أوروبا

- تقييم

- حتى

- تطورت

- مثال

- أمثلة

- اكتشف

- استكشاف

- احتفل على

- للعائلات

- الميزات

- المميزات

- قم بتقديم

- ملفات

- نهائي

- أخيرا

- مالي

- الاسم الأول

- مرونة

- تدفق

- تركز

- التركيز

- متابعيك

- متابعات

- في حالة

- غابة

- شكل

- وجدت

- أربعة

- الإطار

- الأطر

- احتيال

- الكشف عن الغش

- الاصدقاء

- تبدأ من

- بالإضافة إلى

- وظيفة

- وظائف

- علاوة على ذلك

- ربح

- كسب

- توليد

- دولار فقط واحصل على خصم XNUMX% على جميع

- الحصول على

- معطى

- أكبر

- توجيه

- نصفي

- مقبض

- مقابض

- يملك

- he

- ثقيل

- رفع أحمال ثقيلة

- يساعد

- لها

- أعلى

- له

- مضيف

- استضافة

- كيفية

- كيفية

- لكن

- HTML

- HTTP

- HTTPS

- تحسين Hyperparameter

- ضبط Hyperparameter

- المثالي

- الخمول

- if

- صورة

- تنفيذ

- تحقيق

- الأدوات

- أهمية

- in

- تتضمن

- يشمل

- فرد

- بشكل فردي

- معلومات

- البنية التحتية

- إدخال

- تثبيت

- مثل

- بدلًا من ذلك

- رؤيتنا

- إلى

- تقديم

- يدخل

- التذرع

- يتضرع

- إسرائيل

- مسائل

- IT

- وظيفة

- المشــاريــع

- JPG

- جسون

- مفاتيح

- نوع

- معروف

- لغة

- أكبر

- الى وقت لاحق

- إطلاق

- تعلم

- الاستفادة من

- Li

- المكتبات

- المكتبة

- تجميل

- مما سيحدث

- قائمة

- المدرج

- الأحمال

- محلي

- تقع

- موقع

- تسجيل

- تبدو

- يحب

- آلة

- آلة التعلم

- الرئيسية

- أغلبية

- جعل

- إدارة

- تمكن

- إدارة

- مدير

- إدارة

- كتلة

- أقصى

- تعني

- قياسات

- طبي

- عضو

- مكبر الصوت : يدعم، مع دعم ميكروفون مدمج لمنع الضوضاء

- دمج

- طريقة

- طرق

- متري

- وسط

- الشرق الأوسط

- ربما

- أدنى

- التقليل

- ML

- موضة

- نموذج

- عارضات ازياء

- الوحدات

- مراقبة

- الأكثر من ذلك

- أكثر

- متعدد

- الاسم

- أسماء

- طبيعي

- معالجة اللغات الطبيعية

- الطبيعة

- ضروري

- حاجة

- التالي

- البرمجة اللغوية العصبية

- يلاحظ..

- عدد

- كثير

- موضوع

- موضوعي

- of

- عروض

- غالبا

- on

- مرة

- ONE

- فقط

- طريقة التوسع

- تشغيل

- التحسين

- الأمثل

- تحسين

- خيار

- مزيد من الخيارات

- or

- OS

- أخرى

- لنا

- خارج

- في الهواء الطلق

- الناتج

- الكلي

- الخاصة

- حزم

- المعلمة

- المعلمات

- جزء

- أجزاء

- مرت

- مسار

- نمط

- أنماط

- إلى

- فترات

- مرحلة جديدة

- خط أنابيب

- أفلاطون

- الذكاء افلاطون البيانات

- أفلاطون داتا

- نقاط

- سياسات الخصوصية والبيع

- الرائج

- ممكن

- منشور

- محتمل

- الممارسات

- توقع

- تنبؤ

- تنبؤات

- متنبئ

- تتوقع

- تفضل

- المفضل

- الضغط

- يمنع

- سابق

- طباعة

- الإجراءات

- عملية المعالجة

- معالجتها

- معالجة

- إنتاج

- تقدم

- واعد

- ثبت

- تزود

- ويوفر

- بايثون

- عشوائية

- بسرعة

- عرض

- تخفيض

- عقار مخفض

- تقليص

- يشير

- اعتبار

- رجإكس

- منطقة

- عن بعد

- مستودع

- مثل

- طلب

- مطلوب

- يتطلب

- الموارد

- على التوالي

- مسؤول

- نتيجة

- النتائج

- عائد أعلى

- عائدات

- حق

- ROBERT

- النوع

- يجري

- تشغيل

- s

- sagemaker

- الضبط التلقائي لنموذج SageMaker

- نفسه

- حفظ

- إنقاذ

- حجم

- التحجيم

- العلماء

- تعلم الحروف

- مخطوطات

- الإستراحة

- الثاني

- انظر تعريف

- رأيت

- مختار

- إرسال

- كبير

- مستقل

- تسلسل

- سيروم

- Serverless

- خوادم

- الخدمة

- خدماتنا

- خدمة

- طقم

- إعدادات

- عدة

- الجنس

- هي

- ينبغي

- أظهرت

- يظهر

- وبالمثل

- الاشارات

- عزباء

- SIX

- المقاس

- So

- حل

- الحلول

- يحل

- مصدر

- متخصص

- محدد

- محدد

- أنفق

- كومة

- مرصوصة

- التراص

- ستانفورد

- بداية

- يبدأ

- دولة من بين الفن

- إحصائيات

- خطوات

- تخزين

- تخزين

- فروعنا

- صريح

- أقوى

- هذه

- ملخص

- مدعومة

- الدعم

- بالتأكيد

- سيدني

- يأخذ

- مع الأخذ

- الهدف

- المهام

- تقني

- تقنيات

- تكنولوجيا

- مستأجر

- من

- أن

- •

- من مشاركة

- منهم

- then

- هناك.

- وبالتالي

- وبالتالي

- تشبه

- هم

- هؤلاء

- على الرغم من؟

- ثلاثة

- عبر

- الوقت

- مرات

- إلى

- سويا

- أدوات

- موضوع

- الإجمالي

- جر

- حركة المرور

- قطار

- متدرب

- قادة الإيمان

- الأشجار

- تريفور

- تريتون نصف إله عند الإغريق

- اثنان

- أنواع

- مع

- فهم

- الأستعمال

- تستخدم

- مستعمل

- يستخدم

- استخدام

- التحقق من صحة

- قيمنا

- القيم

- مختلف

- الإصدار

- رؤيتنا

- حجم

- تصويت

- تريد

- وكان

- طريق..

- طرق

- we

- الويب

- خدمات ويب

- وزن

- كان

- ابحث عن

- متى

- التي

- في حين

- كامل

- لماذا

- سوف

- مع

- في غضون

- للعمل

- عامل

- أعمال

- اكتب

- جاري الكتابة

- XGBoost

- عام

- أنت

- حل متجر العقارات الشامل الخاص بك في جورجيا

- زفيرنت

- صفر