ভূমিকা

কিছুক্ষণের মধ্যে, একজন ব্যক্তি একটি বিমূর্ত ধারণা নিতে পারেন যা আনুষ্ঠানিক অধ্যয়নের জন্য আপাতদৃষ্টিতে খুব অস্পষ্ট এবং একটি মার্জিত আনুষ্ঠানিক সংজ্ঞা দিতে পারে। ক্লদ শ্যানন এর সাথে এটি করেছিলেন তথ্য, এবং আন্দ্রে কোলমোগোরভ এটি করেছিলেন যদৃচ্ছতা. গত কয়েক বছর ধরে, গবেষকরা মেশিন লার্নিং-এ ন্যায্যতার ধারণার জন্য একই কাজ করার চেষ্টা করছেন। দুর্ভাগ্যবশত, এই trickier হয়েছে. শুধুমাত্র ধারণাটি সংজ্ঞায়িত করা কঠিন নয়, তবে একটি একক সংজ্ঞার জন্য সমস্ত পছন্দসই ন্যায্যতা মেট্রিক্সকে সন্তুষ্ট করাও অসম্ভব। অরবিন্দ নারায়ণন, প্রিন্সটন ইউনিভার্সিটির একজন কম্পিউটার বিজ্ঞানী, বিভিন্ন দৃষ্টিভঙ্গিকে প্রাসঙ্গিককরণে এবং এই নতুন ক্ষেত্রটিকে নিজেকে প্রতিষ্ঠিত করতে সাহায্য করার জন্য গুরুত্বপূর্ণ ভূমিকা পালন করেছেন।

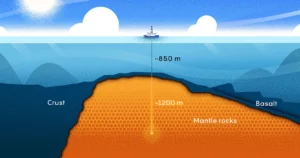

তার কর্মজীবন তত্ত্ব থেকে নীতি পর্যন্ত সমস্ত স্তরের বিমূর্ততাকে বিস্তৃত করেছে, কিন্তু অবশেষে 2006 সালে তার বর্তমান কাজের দিকে পরিচালিত যাত্রা শুরু হয়েছিল। সেই বছর, নেটফ্লিক্স একটি প্রতিযোগিতা স্পনসর করেছিল যা তাদের সুপারিশ ব্যবস্থার নির্ভুলতাকে যারা উন্নত করবে তাকে $1 মিলিয়ন পুরস্কার দেবে। 10%। Netflix ব্যবহারকারীদের একটি কথিত বেনামী ডেটা সেট এবং তাদের রেটিং প্রদান করেছে, ব্যক্তিগতভাবে শনাক্তযোগ্য তথ্য মুছে ফেলা হয়েছে। কিন্তু নারায়ণন দেখিয়েছেন যে একটি পরিশীলিত পরিসংখ্যানগত কৌশলের সাহায্যে, ডেটা সেটে একজন "বেনামী" ব্যবহারকারীর পরিচয় প্রকাশ করতে আপনার শুধুমাত্র কয়েকটি ডেটা পয়েন্টের প্রয়োজন।

তারপর থেকে, নারায়ণন অন্যান্য ক্ষেত্রগুলিতে মনোনিবেশ করেছেন যেখানে তত্ত্ব অনুশীলনের সাথে মিলিত হয়। মাধ্যমে প্রিন্সটন ওয়েব স্বচ্ছতা এবং জবাবদিহিতা প্রকল্প, তার দল গোপনীয় উপায়গুলি উন্মোচন করেছে যা ওয়েবসাইটগুলি ব্যবহারকারীদের ট্র্যাক করে এবং সংবেদনশীল ডেটা বের করে। তার দল জানতে পেরেছে যে ন্যাশনাল সিকিউরিটি এজেন্সির মতো একটি গোষ্ঠী ওয়েব ব্রাউজিং ডেটা ব্যবহার করতে পারে (বিশেষত, তৃতীয় পক্ষের দ্বারা রাখা কুকি) শুধুমাত্র ব্যবহারকারীর বাস্তব-বিশ্বের পরিচয় আবিষ্কার করতে নয়, তাদের ব্রাউজিং ইতিহাসের 62% থেকে 73% পুনর্গঠনও করতে পারে। . তারা যে দেখিয়েছে — উপর riff বিখ্যাত নিউ ইয়র্কার কার্টুন — ইন্টারনেটে, ওয়েবসাইটগুলি এখন জানে যে আপনি একটি কুকুর৷

সাম্প্রতিক বছরগুলিতে, নারায়ণন বিশেষভাবে ফিরে এসেছেন মেশিন লার্নিং — কৃত্রিম বুদ্ধিমত্তার একটি প্রয়োগ যা মেশিনকে ডেটা থেকে শেখার ক্ষমতা দেয়। যদিও তিনি এআই-এর অগ্রগতিকে স্বাগত জানিয়েছেন, তিনি উল্লেখ করেছেন যে কীভাবে এই ধরনের সিস্টেমগুলি ভাল উদ্দেশ্য নিয়েও ব্যর্থ হতে পারে এবং কীভাবে এই অন্যথায় দরকারী প্রযুক্তিগুলি বৈষম্যকে ন্যায্যতা দেওয়ার হাতিয়ার হয়ে উঠতে পারে। এই আলোকে, আপাতদৃষ্টিতে সংযোগহীন বিন্দুগুলি যা নারায়ণনের গবেষণার গতিপথকে সংজ্ঞায়িত করেছে এক ধরনের নক্ষত্রমণ্ডল গঠন করে।

কোয়ান্টা নারায়ণনের সাথে তার নাম প্রকাশ না করার কাজ, পরিসংখ্যানগত অন্তর্দৃষ্টির গুরুত্ব এবং এআই সিস্টেমের অনেক সমস্যা সম্পর্কে কথা বলেছেন। সাক্ষাত্কারটি সংক্ষিপ্ত এবং স্পষ্টতার জন্য সম্পাদনা করা হয়েছে।

ভূমিকা

আপনি কি সবসময় গণিত এবং বিজ্ঞান গবেষণা করতে চান?

আমি উভয় বিষয়ে খুব আগ্রহী, কিন্তু প্রাথমিকভাবে গণিতে বড় হয়েছি। আমি ধাঁধা সমাধানে ভালো ছিলাম এবং এমনকি আন্তর্জাতিক গণিত অলিম্পিয়াডে কিছু সাফল্যও পেয়েছি। কিন্তু ধাঁধা-সমাধান এবং গবেষণা গণিতের মধ্যে পার্থক্য সম্পর্কে আমার একটি বিশাল ভুল ধারণা ছিল।

এবং তাই প্রথম দিকে, আমি ক্রিপ্টোগ্রাফি, বিশেষ করে তাত্ত্বিক ক্রিপ্টোগ্রাফির উপর আমার গবেষণাকে কেন্দ্রীভূত করেছি, কারণ আমি তখনও এই বিভ্রমের মধ্যে পরিশ্রম করছিলাম যে আমি গণিতে খুব ভাল। এবং তারপরে আমার ক্যারিয়ারের বাকি অংশটি উপলব্ধি করার একটি যাত্রা হয়েছে যে আসলে আমার শক্তি মোটেই নয়।

এটি অবশ্যই আপনার ডি-অনামীকরণ কাজের জন্য একটি ভাল পটভূমি হিসাবে কাজ করেছে।

তুমি ঠিক বলছো. ডি-অ্যানানিমাইজেশন রিসার্চের জন্য যা অনুমতি দেয় তা হল দক্ষতা যাকে আমি পরিসংখ্যানগত অন্তর্দৃষ্টি বলি। এটা আসলে আনুষ্ঠানিক গাণিতিক জ্ঞান নয়। এটি আপনার মাথায় একটি অন্তর্দৃষ্টি থাকতে সক্ষম হচ্ছে যেমন: "আমি যদি এই জটিল ডেটা সেটটি গ্রহণ করি এবং এটিতে এই রূপান্তরটি প্রয়োগ করি, তাহলে একটি প্রশংসনীয় ফলাফল কী?"

অন্তর্দৃষ্টি প্রায়ই ভুল হতে পারে, এবং এটা ঠিক আছে. তবে অন্তর্দৃষ্টি থাকা গুরুত্বপূর্ণ কারণ এটি আপনাকে এমন পথের দিকে পরিচালিত করতে পারে যা ফলপ্রসূ হতে পারে।

ভূমিকা

Netflix ডেটাতে আপনার কাজের সাথে পরিসংখ্যানগত অন্তর্দৃষ্টি কীভাবে সাহায্য করেছে?

আমি উচ্চ-মাত্রিক ডেটার জন্য একটি বেনামী স্কিম তৈরি করার চেষ্টা করছিলাম। এটি সম্পূর্ণরূপে ব্যর্থ হয়েছে, কিন্তু ব্যর্থ হওয়ার প্রক্রিয়ায় আমি অন্তর্দৃষ্টি তৈরি করেছি যে উচ্চ-মাত্রিক ডেটা কার্যকরভাবে বেনামী করা যাবে না। অবশ্যই Netflix, তাদের প্রতিযোগিতার সাথে, দাবি করেছে যে তারা ঠিক তাই করেছে।

কোম্পানির বিপণন বিবৃতি সম্পর্কে আমার স্বাভাবিক সংশয় ছিল, তাই আমি তাদের ভুল প্রমাণ করতে অনুপ্রাণিত হয়েছিলাম। আমার উপদেষ্টা, Vitaly Shmatikov, এবং আমি কয়েক তীব্র সপ্তাহ ধরে এটিতে কাজ করেছি। একবার আমরা বুঝতে পেরেছিলাম যে কাজটি সত্যিই প্রভাব ফেলছে, আমি আরও কাজ শুরু করি।

সামগ্রিক প্রভাব কি ছিল? আপনি কি Netflix এবং অন্যান্য কোম্পানির কাছ থেকে ফিরে শুনেছেন যাদের ডেটা এতটা বেনামী নয়?

ভাল, একটি ইতিবাচক প্রভাব হল যে এটি বিজ্ঞানকে উদ্বুদ্ধ করেছে ডিফারেনশিয়াল গোপনীয়তা. তবে সংস্থাগুলি কীভাবে প্রতিক্রিয়া দেখিয়েছিল তার পরিপ্রেক্ষিতে কয়েকটি ভিন্ন প্রতিক্রিয়া দেখা দিয়েছে। অনেক ক্ষেত্রে, যে সংস্থাগুলি অন্যথায় জনসাধারণের কাছে ডেটা সেট প্রকাশ করবে তারা এখন আর তা করছে না - তারা স্বচ্ছতার প্রচেষ্টার বিরুদ্ধে লড়াই করার উপায় হিসাবে গোপনীয়তাকে অস্ত্র দিচ্ছে।

ফেসবুক এই কাজের জন্য পরিচিত। যখন গবেষকরা Facebook-এ যান এবং বলেন, “প্ল্যাটফর্মে তথ্য কীভাবে প্রচার হচ্ছে তা অধ্যয়ন করার জন্য আমাদের এই ডেটার কিছু অ্যাক্সেস দরকার,” Facebook এখন বলতে পারে, “না, আমরা আপনাকে তা দিতে পারি না। এটি আমাদের ব্যবহারকারীদের গোপনীয়তার সাথে আপস করবে।"

আপনি একবার একটি লিখেছেন কাগজ তর্ক করা যে "ব্যক্তিগতভাবে সনাক্তযোগ্য তথ্য" শব্দটি বিভ্রান্তিকর হতে পারে। কেমন করে?

আমি মনে করি নীতিনির্ধারকদের মধ্যে দুটি ভিন্ন উপায়ে শব্দটি ব্যবহার করা থেকে উদ্ভূত বিভ্রান্তি রয়েছে। একটি হল আপনার সম্পর্কে তথ্য যা খুবই সংবেদনশীল, যেমন আপনার সামাজিক নিরাপত্তা নম্বর। আরেকটি অর্থ হল তথ্য যা কিছু ডেটা সেটে সূচিত করা যেতে পারে এবং এর ফলে আপনার সম্পর্কে আরও তথ্য খুঁজে পেতে ব্যবহার করা যেতে পারে।

এই দুটির ভিন্ন অর্থ রয়েছে। প্রথম অর্থে PII ধারণার সাথে আমার কোন গরুর মাংস নেই। মানুষের সম্পর্কে কিছু তথ্য খুব সংবেদনশীল, এবং আমাদের তাদের আরও সতর্কতার সাথে আচরণ করা উচিত। কিন্তু যদিও আপনার ইমেল ঠিকানাটি বেশিরভাগ মানুষের জন্য খুব সংবেদনশীল নয়, এটি এখনও একটি অনন্য শনাক্তকারী যা আপনাকে অন্যান্য ডেটা সেটগুলিতে খুঁজে পেতে ব্যবহার করা যেতে পারে। যতক্ষণ পর্যন্ত একজন ব্যক্তির সম্বন্ধে গুণাবলীর সংমিশ্রণ বিশ্বের অন্য কারও কাছে উপলব্ধ থাকে, ততক্ষণ আপনার পরিচয় গোপন করার জন্য এটিই প্রয়োজন।

ভূমিকা

কিভাবে আপনি শেষ পর্যন্ত ন্যায্যতা অধ্যয়ন করতে আসেন?

আমি 2017 সালে একটি ন্যায্যতা এবং মেশিন লার্নিং কোর্স শিখিয়েছি। এটি আমাকে ক্ষেত্রের খোলা সমস্যা সম্পর্কে একটি ভাল ধারণা দিয়েছে। এবং এর সাথে, আমি একটি বক্তৃতা দিয়েছিলাম যার নাম "21 ফেয়ারনেস সংজ্ঞা এবং তাদের রাজনীতি" আমি ব্যাখ্যা করেছি যে প্রযুক্তিগত সংজ্ঞাগুলির বিস্তার প্রযুক্তিগত কারণে নয়, বরং এই সমস্ত কিছুর কেন্দ্রে প্রকৃত নৈতিক প্রশ্ন রয়েছে। আপনার কাছে একটি একক পরিসংখ্যানগত মাপকাঠি থাকতে পারে এমন কোন উপায় নেই যা সমস্ত আদর্শিক ইচ্ছাকে ক্যাপচার করে — আপনি যা চান তা সবই। বক্তৃতাটি ভালভাবে গ্রহণ করা হয়েছিল, তাই তারা দুজন মিলে আমাকে বোঝাল যে আমার এই বিষয়ে শুরু করা উচিত।

তুমিও একটি বক্তৃতা দিয়েছেন এআই স্নেক অয়েল সনাক্ত করার উপর, যা ভালভাবে সমাদৃত হয়েছিল। কিভাবে এটি মেশিন লার্নিং ন্যায্যতার সাথে সম্পর্কিত?

সুতরাং এর জন্য অনুপ্রেরণা ছিল যে টেক্সট-টু-ইমেজ প্রোগ্রামের মতো এআই-তে স্পষ্টতই প্রচুর প্রকৃত প্রযুক্তিগত উদ্ভাবন ঘটছে। ডাল·ই ২ বা দাবা প্রোগ্রাম আলফাজিরো. এটা সত্যিই আশ্চর্যজনক যে এই অগ্রগতি এত দ্রুত হয়েছে। যে উদ্ভাবন অনেক উদযাপন করার যোগ্য.

সমস্যাটি আসে যখন আমরা এই খুব ঢিলেঢালা এবং বিস্তৃত ছাতা শব্দটি "AI" এর মতো জিনিসগুলির জন্য ব্যবহার করি এবং সেইসাথে আরও ভরাট অ্যাপ্লিকেশন, যেমন অপরাধমূলক ঝুঁকির পূর্বাভাসের জন্য পরিসংখ্যানগত পদ্ধতি। সেই প্রেক্ষাপটে, জড়িত প্রযুক্তির ধরনটি খুব আলাদা। এই দুটি খুব ভিন্ন ধরনের অ্যাপ্লিকেশন, এবং সম্ভাব্য সুবিধা এবং ক্ষতিগুলিও খুব আলাদা। তাদের মধ্যে প্রায় কোনও সংযোগ নেই, তাই উভয়ের জন্য একই শব্দ ব্যবহার করা পুরোপুরি বিভ্রান্তিকর।

মানুষ এই চিন্তায় বিভ্রান্ত হয় যে তারা এই সমস্ত অগ্রগতি যা তারা চিত্র তৈরির সাথে দেখছে তা আসলে অগ্রগতিতে অনুবাদ করবে অপরাধমূলক ঝুঁকির ভবিষ্যদ্বাণী করা বা কোন শিশুরা স্কুল ছেড়ে দেবে তা ভবিষ্যদ্বাণী করার মতো সামাজিক কাজের দিকে। কিন্তু ব্যাপারটা মোটেও তা নয়। প্রথমত, অপরাধের জন্য কাকে গ্রেপ্তার করা হতে পারে তা ভবিষ্যদ্বাণী করার ক্ষেত্রে আমরা এলোমেলো সুযোগের চেয়ে সামান্য ভাল করতে পারি। এবং যে নির্ভুলতা সত্যিই সহজ classifiers সঙ্গে অর্জন করা হয়. সময়ের সাথে সাথে এটি আরও ভাল হচ্ছে না এবং আমরা আরও ডেটা সেট সংগ্রহ করার সাথে সাথে এটি আরও ভাল হচ্ছে না। সুতরাং এই সমস্ত পর্যবেক্ষণ চিত্র তৈরির জন্য গভীর শিক্ষার ব্যবহারের বিপরীতে, উদাহরণস্বরূপ।

আপনি কীভাবে বিভিন্ন ধরণের মেশিন লার্নিং সমস্যাগুলিকে আলাদা করবেন?

এটি একটি সম্পূর্ণ তালিকা নয়, তবে তিনটি সাধারণ বিভাগ রয়েছে। প্রথম বিভাগটি উপলব্ধি, যার মধ্যে একটি চিত্রের বিষয়বস্তু বর্ণনা করার মতো কাজ অন্তর্ভুক্ত রয়েছে। দ্বিতীয় বিভাগ হল যাকে আমি বলি "স্বয়ংক্রিয় বিচার," যেমন Facebook কখন অ্যালগরিদম ব্যবহার করতে চায় তা নির্ধারণ করতে কোন বক্তৃতাটি প্ল্যাটফর্মে থাকার জন্য খুব বিষাক্ত। এবং তৃতীয়টি মানুষের মধ্যে ভবিষ্যত সামাজিক ফলাফলের ভবিষ্যদ্বাণী করছে — কাউকে অপরাধের জন্য গ্রেপ্তার করা হবে কিনা, বা একটি বাচ্চা স্কুল ছেড়ে যাচ্ছে কিনা।

তিনটি ক্ষেত্রেই, অর্জনযোগ্য নির্ভুলতাগুলি খুব আলাদা, ভুল AI এর সম্ভাব্য বিপদগুলি খুব আলাদা, এবং অনুসরণ করা নৈতিক প্রভাবগুলি খুব আলাদা।

উদাহরণস্বরূপ, আমার শ্রেণীবিভাগে মুখ শনাক্তকরণ একটি উপলব্ধি সমস্যা। অনেক লোক মুখ শনাক্তকরণ ভুল হওয়ার বিষয়ে কথা বলে, এবং কখনও কখনও তারা সঠিক। কিন্তু আমি এটা মনে করি না কারণ মুখের স্বীকৃতির নির্ভুলতার মৌলিক সীমা আছে। সেই প্রযুক্তি উন্নত হয়েছে, এবং এটি আরও ভাল হতে চলেছে। ঠিক এই কারণেই আমাদের নৈতিক দৃষ্টিকোণ থেকে এটি সম্পর্কে উদ্বিগ্ন হওয়া উচিত — যখন আপনি এটিকে পুলিশের হাতে তুলে দেন, যারা জবাবদিহির অযোগ্য হতে পারে বা রাষ্ট্র যারা এর ব্যবহার সম্পর্কে স্বচ্ছ নয়।

ভূমিকা

কি সামাজিক ভবিষ্যদ্বাণী সমস্যা উপলব্ধি সমস্যার চেয়ে এত কঠিন করে তোলে?

উপলব্ধি সমস্যা বৈশিষ্ট্য একটি দম্পতি আছে. এক, একটি ছবিতে একটি বিড়াল আছে কিনা তা নিয়ে কোন অস্পষ্টতা নেই। তাই আপনি স্থল সত্য আছে. দ্বিতীয়ত, আপনার কাছে মূলত সীমাহীন প্রশিক্ষণ ডেটা রয়েছে কারণ আপনি ওয়েবে সমস্ত ছবি ব্যবহার করতে পারেন। এবং যদি আপনি Google বা Facebook হন, আপনি আপনার অ্যাপে আপলোড করা সমস্ত ছবি ব্যবহার করতে পারেন৷ সুতরাং এই দুটি কারণ - অস্পষ্টতা এবং ডেটা উপলব্ধতার অভাব - ক্লাসিফায়ারগুলিকে সত্যিই ভাল কার্য সম্পাদন করতে দেয়।

এটি ভবিষ্যদ্বাণী সমস্যা থেকে ভিন্ন, যে দুটি বৈশিষ্ট্য নেই। একটি তৃতীয় পার্থক্য রয়েছে যা আমার উল্লেখ করা উচিত, যা কিছু অর্থে সবচেয়ে গুরুত্বপূর্ণ: এই ভবিষ্যদ্বাণী মডেলগুলিকে কার্যকর করার নৈতিক পরিণতিগুলি আপনার ফোনে একটি ভাষা অনুবাদের সরঞ্জাম বা একটি চিত্র লেবেলিং সরঞ্জাম ব্যবহার করার থেকে খুব আলাদা।

কিন্তু কাউকে আটক করা উচিত কিনা তা নির্ধারণ করার জন্য ব্যবহৃত সরঞ্জামটির মতো এটি একই গুরুতরতা নয়। জনগণের স্বাধীনতার জন্য এর পরিণতি রয়েছে। সুতরাং বিড়ম্বনার বিষয় হল যে যে এলাকায় AI সবচেয়ে খারাপভাবে কাজ করে, সময়ের সাথে সাথে সত্যিই উন্নতি হয় নি, এবং ভবিষ্যতে উন্নতি হওয়ার সম্ভাবনা নেই সেই অঞ্চলটি হল এই সমস্ত অবিশ্বাস্যভাবে গুরুত্বপূর্ণ পরিণতি।

আপনার কাজের বেশিরভাগ ক্ষেত্রে আপনার ক্ষেত্রের বাইরের বিশেষজ্ঞদের সাথে কথা বলা প্রয়োজন। এটার মত অন্যদের সাথে সহযোগিতা করার মত কি?

আন্তঃবিভাগীয় সহযোগিতা সবচেয়ে উপভোগ্য সহযোগিতার কিছু হয়েছে। আমি মনে করি এই ধরনের যেকোনো সহযোগিতার হতাশাজনক মুহূর্ত থাকবে কারণ লোকেরা একই ভাষায় কথা বলে না।

এর জন্য আমার প্রেসক্রিপশন হল: সংস্কৃতি, তারপর ভাষা, তারপর পদার্থ। আপনি যদি তাদের সংস্কৃতি বুঝতে না পারেন - যেমন তারা কি ধরনের বৃত্তির মূল্য দেয় - এটি সত্যিই কঠিন হতে চলেছে। একজন ব্যক্তির কাছে যা মূল্যবান তা অন্যের কাছে অপ্রাসঙ্গিক মনে হতে পারে। তাই সাংস্কৃতিক দিকগুলো আগে নেভিগেট করতে হবে। তারপরে আপনি একটি সাধারণ ভাষা এবং শব্দভাণ্ডার স্থাপন শুরু করতে পারেন এবং অবশেষে সহযোগিতার উপাদানে পৌঁছাতে পারেন।

আমরা নিরাপদে এবং বিজ্ঞতার সাথে নতুন প্রযুক্তি গ্রহণ করতে পারি কিনা সে সম্পর্কে আপনি কতটা আশাবাদী?

ইস্যুটির অংশ হল জ্ঞানের ফাঁক। সিদ্ধান্ত গ্রহণকারী, সরকারী সংস্থা, কোম্পানি এবং অন্যান্য লোকেরা যারা এই AI সরঞ্জামগুলি কিনছেন তারা ভবিষ্যদ্বাণীমূলক নির্ভুলতার গুরুতর সীমাগুলি চিনতে পারেন না।

কিন্তু শেষ পর্যন্ত আমি মনে করি এটা একটা রাজনৈতিক সমস্যা। কিছু লোক খরচ কমাতে চায়, তাই তারা একটি স্বয়ংক্রিয় সরঞ্জাম চায়, যা চাকরিগুলিকে সরিয়ে দেয়। সুতরাং এই বিক্রেতারা তাদের ভবিষ্যদ্বাণীমূলক সরঞ্জাম সম্পর্কে যা বলছে তা বিশ্বাস করার জন্য একটি খুব শক্তিশালী চাপ রয়েছে।

সে দুটি ভিন্ন সমস্যা। আমার মত লোকেরা হয়তো তথ্যের ব্যবধান দূর করতে সাহায্য করতে পারে। কিন্তু রাজনৈতিক সমস্যা সমাধানের জন্য সক্রিয়তা প্রয়োজন। এর জন্য আমাদের গণতান্ত্রিক প্রক্রিয়ার সুবিধা নিতে হবে। এটা দেখে ভালো লাগছে যে অনেক লোক এটা করছে। এবং দীর্ঘমেয়াদে, আমি মনে করি আমরা AI এর ক্ষতিকর এবং অপমানজনক অ্যাপ্লিকেশনগুলির বিরুদ্ধে পিছিয়ে যেতে পারি। আমি মনে করি না এটি তাত্ক্ষণিকভাবে পরিবর্তিত হবে তবে একটি দীর্ঘ, টানা-আউট, দীর্ঘায়িত সক্রিয়তার প্রক্রিয়ার মাধ্যমে যা ইতিমধ্যে এক দশক বা তারও বেশি সময় ধরে চলছে। আমি নিশ্চিত যে এটি দীর্ঘ সময়ের জন্য অব্যাহত থাকবে।

- এসইও চালিত বিষয়বস্তু এবং পিআর বিতরণ। আজই পরিবর্ধিত পান।

- প্লেটোব্লকচেন। Web3 মেটাভার্স ইন্টেলিজেন্স। জ্ঞান প্রসারিত. এখানে প্রবেশ করুন.

- উত্স: https://www.quantamagazine.org/he-protects-privacy-and-ai-fairness-with-statistics-20230310/

- : হয়

- [পৃ

- $ 1 মিলিয়ন

- $ ইউপি

- 2017

- a

- ক্ষমতা

- সক্ষম

- সম্পর্কে

- আইটি সম্পর্কে

- বিমূর্ত

- প্রবেশ

- দায়িত্ব

- সঠিকতা

- অর্জন

- এসিএম

- কর্ম

- সক্রিয়তা

- প্রকৃতপক্ষে

- ঠিকানা

- সম্ভাষণ

- পোষ্যপুত্র গ্রহণ করা

- অগ্রগতি

- সুবিধা

- বিরুদ্ধে

- সংস্থা

- এজেন্সি

- AI

- আলগোরিদিম

- সব

- ইতিমধ্যে

- সর্বদা

- আশ্চর্যজনক

- অস্পষ্টতা

- মধ্যে

- এবং

- নামবিহীন

- অন্য

- যে কেউ

- অ্যাপ্লিকেশন

- আবেদন

- অ্যাপ্লিকেশন

- প্রয়োগ করা

- রয়েছি

- এলাকায়

- এলাকার

- ধরা

- কৃত্রিম

- কৃত্রিম বুদ্ধিমত্তা

- AS

- আ

- At

- বৈশিষ্ট্যাবলী

- অটোমেটেড

- উপস্থিতি

- সহজলভ্য

- পুরস্কার

- পিছনে

- পটভূমি

- BE

- কারণ

- পরিণত

- গরুর মাংস

- শুরু হয়

- হচ্ছে

- বিশ্বাস করা

- সুবিধা

- উত্তম

- মধ্যে

- প্রশস্ত

- ব্রাউজিং

- ক্রয়

- by

- কল

- নামক

- CAN

- না পারেন

- ক্যাচ

- পেশা

- সাবধানে

- কেস

- মামলা

- ক্যাট

- বিভাগ

- বিভাগ

- সুপ্রসিদ্ধ

- কিছু

- সুযোগ

- পরিবর্তন

- বৈশিষ্ট্য

- দাবা

- দাবি

- নির্মলতা

- শ্রেণীবিন্যাস

- পরিষ্কারভাবে

- সহযোগিতা করা

- সহযোগিতা

- সহযোগীতামূলক

- সংগ্রহ করা

- সমাহার

- আসা

- সাধারণ

- কোম্পানি

- প্রতিযোগিতা

- সম্পূর্ণরূপে

- জটিল

- আপস

- কম্পিউটার

- ধারণা

- উদ্বিগ্ন

- বিভ্রান্তিকর

- বিশৃঙ্খলা

- সংযোগ

- ফল

- বিষয়বস্তু

- প্রসঙ্গ

- অবিরত

- বিপরীত হত্তয়া

- বিস্কুট

- খরচ

- পারা

- দম্পতি

- পথ

- অপরাধ

- অপরাধী

- ক্রিপ্টোগ্রাফি

- সাংস্কৃতিক

- সংস্কৃতি

- বর্তমান

- কাটা

- ব্যয় কাটা

- বিপদ

- উপাত্ত

- ডেটা পয়েন্ট

- তথ্য সেট

- ডেটা সেট

- দশক

- নীতি নির্ধারক

- গভীর

- গভীর জ্ঞানার্জন

- সংজ্ঞায়িত

- গণতান্ত্রিক

- দাবী

- আটক

- নির্ধারণ

- উন্নত

- উইল

- DID

- পার্থক্য

- বিভিন্ন

- বিভিন্ন সমস্যা

- আবিষ্কার করা

- প্রভেদ করা

- কুকুর

- করছেন

- Dont

- ড্রপ

- গোড়ার দিকে

- কার্যকরীভাবে

- প্রচেষ্টা

- ঘটিয়েছে

- ইমেইল

- উপভোগ্য

- বিশেষত

- মূলত

- স্থাপন করা

- প্রতিষ্ঠার

- নৈতিক

- এমন কি

- অবশেষে

- ঠিক

- বিশেষজ্ঞদের

- ব্যাখ্যা

- নির্যাস

- মুখ

- মুখ স্বীকৃতি

- ফেসবুক

- কারণের

- ব্যর্থ

- ব্যর্থ

- ন্যায্য

- সততা

- কয়েক

- ক্ষেত্র

- যুদ্ধ

- পরিশেষে

- আবিষ্কার

- প্রথম

- দৃষ্টি নিবদ্ধ করা

- অনুসরণ করা

- জন্য

- ফর্ম

- আনুষ্ঠানিকভাবে

- পাওয়া

- স্বাধীনতা

- থেকে

- হতাশাজনক

- মৌলিক

- ভবিষ্যৎ

- ফাঁক

- প্রজন্ম

- পাওয়া

- পেয়ে

- দাও

- দেয়

- Go

- চালু

- ভাল

- গুগল

- সরকার

- স্থল

- গ্রুপ

- কৌশল

- হাত

- ঘটনা

- কঠিন

- ক্ষতিকর

- ক্ষতিগ্রস্ত

- আছে

- জমিদারি

- মাথা

- শোনা

- হৃদয়

- সাহায্য

- সাহায্য

- ইতিহাস

- কিভাবে

- HTTPS দ্বারা

- প্রচুর

- i

- ধারণা

- আইডেন্টিফায়ার

- পরিচয়

- ভাবমূর্তি

- চিত্র

- প্রভাব

- প্রভাব

- গুরুত্ব

- গুরুত্বপূর্ণ

- অসম্ভব

- উন্নত করা

- উন্নত

- উন্নতি

- in

- অন্যান্য

- বেঠিক

- অন্তর্ভুক্ত

- অবিশ্বাস্যভাবে

- তথ্য

- ইনোভেশন

- উদাহরণ

- তাত্ক্ষণিক

- যান্ত্রিক

- বুদ্ধিমত্তা

- উদ্দেশ্য

- আগ্রহী

- আন্তর্জাতিক

- Internet

- সাক্ষাত্কার

- জড়িত

- সমস্যা

- IT

- এর

- নিজেই

- জবস

- যাত্রা

- ছাগলছানা

- কিডস

- রকম

- জানা

- জ্ঞান

- পরিচিত

- লেবেল

- রং

- ভাষা

- শিখতে

- শিক্ষা

- বরফ

- মাত্রা

- আলো

- মত

- সীমা

- তালিকা

- দীর্ঘ

- অনেকক্ষণ

- আর

- অনেক

- মেশিন

- মেশিন লার্নিং

- মেশিন

- তৈরি করে

- অনেক

- Marketing

- গণিত

- গাণিতিক

- অর্থ

- পূরণ

- পদ্ধতি

- ছন্দোবিজ্ঞান

- হতে পারে

- মিলিয়ন

- মডেল

- মারার

- অধিক

- সেতু

- উদ্দেশ্যমূলক

- প্রেরণা

- জাতীয়

- জাতীয় নিরাপত্তা

- প্রাকৃতিক

- অগত্যা

- প্রয়োজন

- Netflix এর

- নতুন

- সংখ্যা

- of

- অর্পণ

- তেল

- on

- ONE

- খোলা

- আশাবাদী

- অন্যান্য

- অন্যরা

- অন্যভাবে

- ফলাফল

- বাহিরে

- সামগ্রিক

- দলগুলোর

- গত

- সম্প্রদায়

- জনগণের

- উপলব্ধি

- সম্পাদন করা

- সম্ভবত

- ব্যক্তি

- ব্যক্তিগতভাবে

- পরিপ্রেক্ষিত

- ফোন

- টুকরা

- মাচা

- Plato

- প্লেটো ডেটা ইন্টেলিজেন্স

- প্লেটোডাটা

- বিশ্বাসযোগ্য

- পয়েন্ট

- পুলিশ

- নীতি

- নীতি নির্ধারক

- রাজনৈতিক

- ধনাত্মক

- সম্ভাব্য

- অনুশীলন

- অবিকল

- পূর্বাভাসের

- ভবিষ্যদ্বাণী

- প্রেসক্রিপশন

- চাপ

- প্রাথমিকভাবে

- গোপনীয়তা

- সমস্যা

- সমস্যা

- প্রক্রিয়া

- কার্যক্রম

- উন্নতি

- প্রমাণ করা

- প্রদত্ত

- প্রকাশ্য

- ধাক্কা

- ফেরত পাঠাও

- করা

- স্থাপন

- পাজল

- কোয়ান্টাম্যাগাজিন

- প্রশ্ন

- এলোমেলো

- দ্রুত

- সৈনিকগণ

- প্রতিক্রিয়া

- বাস্তব জগতে

- প্রতীত

- নিরূপক

- কারণে

- গৃহীত

- সাম্প্রতিক

- স্বীকার

- চেনা

- সুপারিশ

- মুক্ত

- থাকা

- অপসারিত

- প্রয়োজনীয়

- প্রয়োজন

- গবেষণা

- গবেষক

- গবেষকরা

- বিশ্রাম

- প্রকাশ করা

- ঝুঁকি

- চালান

- নিরাপদে

- একই

- পরিকল্পনা

- স্কুল

- বিজ্ঞান

- বিজ্ঞানী

- দ্বিতীয়

- নিরাপত্তা

- এইজন্য

- অনুভূতি

- সংবেদনশীল

- গম্ভীর

- সেট

- সেট

- উচিত

- সহজ

- একক

- সংশয়বাদ

- দক্ষতা

- So

- সামাজিক

- সমাধানে

- কিছু

- কেউ

- বাস্তববুদ্ধিসম্পন্ন

- কথা বলা

- বিশেষভাবে

- বক্তৃতা

- স্পন্সরকৃত

- শুরু

- শুরু

- বিবৃতি

- যুক্তরাষ্ট্র

- পরিসংখ্যানসংক্রান্ত

- এখনো

- শক্তি

- শক্তিশালী

- অধ্যয়ন

- অধ্যয়নরত

- পদার্থ

- সাফল্য

- এমন

- পদ্ধতি

- সিস্টেম

- গ্রহণ করা

- আলাপ

- কথা বলা

- কাজ

- টীম

- কারিগরী

- প্রযুক্তি

- প্রযুক্তিঃ

- শর্তাবলী

- যে

- সার্জারির

- ক্ষেত্র

- ভবিষ্যৎ

- তথ্য

- বিশ্ব

- তাদের

- তাহাদিগকে

- তত্ত্বীয়

- যার ফলে

- এইগুলো

- কিছু

- চিন্তা

- তৃতীয়

- তৃতীয় পক্ষগুলি

- পুঙ্খানুপুঙ্খভাবে

- তিন

- দ্বারা

- সময়

- থেকে

- একসঙ্গে

- অত্যধিক

- টুল

- সরঞ্জাম

- বিষয়

- দিকে

- পথ

- প্রশিক্ষণ

- গ্রহনক্ষত্রের নির্দিষ্ট আবক্র পথ

- রুপান্তর

- অনুবাদ

- অনুবাদ

- স্বচ্ছতা

- স্বচ্ছ

- আচরণ করা

- পরিণত

- ধরনের

- পরিণামে

- ছাতা

- অধীনে

- বোঝা

- অনন্য

- বিশ্ববিদ্যালয়

- সীমাহীন

- আপলোড করা

- us

- ব্যবহার

- ব্যবহারকারী

- ব্যবহারকারী

- দামি

- মূল্য

- বিক্রেতারা

- মতামত

- উপায়..

- উপায়

- ওয়েব

- webp

- ওয়েবসাইট

- সপ্তাহ

- স্বাগতম

- আমরা একটি

- কি

- কিনা

- যে

- যখন

- হু

- যে কেউ

- উইকিপিডিয়া

- ইচ্ছা

- সঙ্গে

- হয়া যাই ?

- কাজ করছে

- কাজ

- বিশ্ব

- would

- ভুল

- বছর

- বছর

- আপনি

- আপনার

- ইউটিউব

- zephyrnet