ইন্টেল দাবি করেছে যে এটি একটি এআই মডেল তৈরি করেছে যা রিয়েল টাইমে সনাক্ত করতে পারে যে কোনও ভিডিও রঙের সূক্ষ্ম পরিবর্তনগুলি সন্ধান করে ডিপফেক প্রযুক্তি ব্যবহার করছে কিনা যা স্পষ্ট হবে যদি বিষয়টি জীবিত মানুষ হয়।

ফেকক্যাচার চিপমেকিং জায়ান্ট দ্বারা দাবি করা হয়েছে যে মিলিসেকেন্ডে ফলাফল ফেরাতে সক্ষম এবং 96 শতাংশ নির্ভুলতার হার রয়েছে৷

সেখানে হয়েছে উদ্বেগ সাম্প্রতিক বছরগুলিতে তথাকথিত ডিপফেক ভিডিওগুলির উপর, যা মানুষের নকল ফুটেজ তৈরি করতে AI অ্যালগরিদম ব্যবহার করে৷ প্রধান উদ্বেগ এটিকে কেন্দ্রীভূত করে সম্ভাব্যভাবে রাজনীতিবিদ বা সেলিব্রেটিদের এমন বক্তব্য তৈরি করতে বা এমন কিছু করার জন্য যা তারা আসলে বলেননি বা করেননি বলে মনে করা হচ্ছে।

“ডিপফেক ভিডিও এখন সর্বত্র। আপনি সম্ভবত ইতিমধ্যে তাদের দেখেছেন; সেলিব্রিটিদের ভিডিও যা তারা করেনি বা বলছে যা তারা আসলে কখনও করেনি,” বলেছেন ইন্টেল ল্যাবস স্টাফ গবেষণা বিজ্ঞানী ইল্কে ডেমির। এবং এটি কেবল সেলিব্রিটিদেরও প্রভাবিত করছে না সাধারণ নাগরিক শিকার হয়েছে।

চিপমেকারের মতে, কিছু ডিপ লার্নিং-ভিত্তিক ডিটেক্টর কাঁচা ভিডিও ডেটা বিশ্লেষণ করে বলার-গল্পের লক্ষণগুলি খুঁজে বের করার চেষ্টা করে যা এটিকে জাল হিসাবে চিহ্নিত করবে। বিপরীতে, FakeCatcher একটি ভিন্ন পন্থা নেয়, যার মধ্যে ভিজ্যুয়াল ইঙ্গিতগুলির জন্য বাস্তব ভিডিও বিশ্লেষণ করা হয় যা নির্দেশ করে যে বিষয়টি আসল।

এর মধ্যে একটি ভিডিওর পিক্সেলের রঙের সূক্ষ্ম পরিবর্তন রয়েছে যা হৃৎপিণ্ড থেকে রক্ত প্রবাহের কারণে শরীরের চারপাশে রক্ত পাম্প করছে৷ এই রক্ত প্রবাহের সংকেতগুলি সারা মুখ থেকে সংগ্রহ করা হয় এবং অ্যালগরিদমগুলি এগুলিকে স্থানিক টেম্পোরাল মানচিত্রে অনুবাদ করে, ইন্টেল বলেছে, একটি ভিডিও বাস্তব কিনা তা সনাক্ত করতে একটি গভীর শিক্ষার মডেল সক্ষম করে৷ কিছু সনাক্তকরণ সরঞ্জামগুলির জন্য ভিডিও সামগ্রী বিশ্লেষণের জন্য আপলোড করা প্রয়োজন, তারপর ফলাফলের জন্য ঘন্টার অপেক্ষা, এটি দাবি করেছে।

যাইহোক, এটি কল্পনা করা সম্ভাবনার সীমার বাইরে নয় যে ভিডিও নকল তৈরি করার উদ্দেশ্য নিয়ে যে কেউ পর্যাপ্ত সময় এবং সংস্থান দেওয়া হলে এমন অ্যালগরিদম বিকাশ করতে সক্ষম হতে পারে যা ফেকক্যাচারকে বোকা বানিয়ে দিতে পারে।

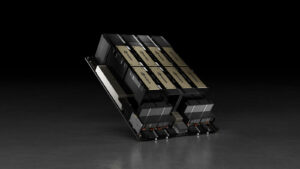

Intel স্বাভাবিকভাবেই ফেকক্যাচার তৈরিতে নিজস্ব প্রযুক্তির ব্যাপক ব্যবহার করেছে, যার মধ্যে রয়েছে OpenVINO ওপেন-সোর্স টুলকিট ডিপ লার্নিং মডেল এবং ওপেনসিভি রিয়েল-টাইম ছবি ও ভিডিও প্রক্রিয়াকরণের জন্য। বিকাশকারী দলগুলি ওপেন ভিজ্যুয়াল ক্লাউড প্ল্যাটফর্ম ব্যবহার করে ইন্টেলের Xeon স্কেলেবল প্রসেসরগুলির জন্য একটি সমন্বিত সফ্টওয়্যার স্ট্যাক প্রদান করতে। FakeCatcher সফ্টওয়্যারটি 72rd Gen Xeon Scalable প্রসেসরে একসাথে 3 টি ভিন্ন সনাক্তকরণ স্ট্রীম চালাতে পারে।

ইন্টেলের মতে, ফেকক্যাচারের জন্য বেশ কয়েকটি সম্ভাব্য ব্যবহারের ঘটনা রয়েছে, যার মধ্যে ব্যবহারকারীদের সামাজিক মিডিয়াতে ক্ষতিকারক ডিপফেক ভিডিও আপলোড করা থেকে বাধা দেওয়া এবং ম্যানিপুলেটেড সামগ্রী সম্প্রচার এড়াতে সংবাদ সংস্থাগুলিকে সহায়তা করা। ®

- AI

- ai শিল্প

- এআই আর্ট জেনারেটর

- আইআই রোবট

- কৃত্রিম বুদ্ধিমত্তা

- কৃত্রিম বুদ্ধিমত্তা সার্টিফিকেশন

- ব্যাংকিং এ কৃত্রিম বুদ্ধিমত্তা

- কৃত্রিম বুদ্ধিমত্তার রোবট

- কৃত্রিম বুদ্ধিমত্তার রোবট

- কৃত্রিম বুদ্ধিমত্তা সফ্টওয়্যার

- blockchain

- ব্লকচেইন সম্মেলন এআই

- coingenius

- কথোপকথন কৃত্রিম বুদ্ধিমত্তা

- ক্রিপ্টো সম্মেলন এআই

- ডাল-ই

- গভীর জ্ঞানার্জন

- গুগল আই

- মেশিন লার্নিং

- Plato

- প্লেটো এআই

- প্লেটো ডেটা ইন্টেলিজেন্স

- প্লেটো গেম

- প্লেটোডাটা

- প্লেটোগেমিং

- স্কেল ai

- বাক্য গঠন

- নিবন্ধনকর্মী

- zephyrnet