I de senere år har fremskridt inden for computersyn gjort det muligt for forskere, førstehjælpere og regeringer at tackle det udfordrende problem med at behandle globale satellitbilleder for at forstå vores planet og vores indvirkning på den. AWS udgivet for nylig Amazon SageMaker geospatiale muligheder for at give dig satellitbilleder og geospatiale state-of-the-art maskinlæringsmodeller (ML), hvilket reducerer barrierer for disse typer brugssager. For mere information, se Eksempel: Brug Amazon SageMaker til at bygge, træne og implementere ML-modeller ved hjælp af geospatiale data.

Mange agenturer, herunder førstehjælpere, bruger disse tilbud til at opnå storstilet situationsbevidsthed og prioritere nødhjælpsindsatser i geografiske områder, der er blevet ramt af naturkatastrofer. Disse agenturer beskæftiger sig ofte med katastrofebilleder fra lav højde og satellitkilder, og disse data er ofte umærkede og vanskelige at bruge. Avancerede computervisionsmodeller underperformer ofte, når de ser på satellitbilleder af en by, som en orkan eller naturbrand har ramt. På grund af manglen på disse datasæt er selv avancerede ML-modeller ofte ude af stand til at levere den nøjagtighed og præcision, der kræves for at forudsige standard FEMA-katastrofeklassifikationer.

Geospatiale datasæt indeholder nyttige metadata såsom bredde- og længdegradskoordinater og tidsstempler, som kan give kontekst til disse billeder. Dette er især nyttigt til at forbedre nøjagtigheden af geospatial ML til katastrofescener, fordi disse billeder i sagens natur er rodede og kaotiske. Bygninger er mindre rektangulære, vegetation har fået skader, og lineære veje er blevet afbrudt af oversvømmelser eller mudderskred. Fordi mærkning af disse massive datasæt er dyrt, manuelt og tidskrævende, er udviklingen af ML-modeller, der kan automatisere billedmærkning og annotering, kritisk.

For at træne denne model har vi brug for et mærket jordsandhedsundersæt af Datasæt fra Low Altitude Disaster Imagery (LADI).. Dette datasæt består af menneske- og maskinannoterede luftbårne billeder indsamlet af Civil Air Patrol til støtte for forskellige katastrofeberedskaber fra 2015-2019. Disse LADI-datasæt fokuserer på de atlantiske orkansæsoner og kyststater langs Atlanterhavet og den Mexicanske Golf. To vigtige forskelle er den lave højde, det skrå perspektiv af billederne og katastroferelaterede funktioner, som sjældent vises i computersyns benchmarks og datasæt. Holdene brugte eksisterende FEMA-kategorier til skader såsom oversvømmelser, affald, brand og røg eller jordskred, som standardiserede etiketkategorierne. Løsningen er så i stand til at lave forudsigelser om resten af træningsdataene og vejlede resultater med lavere konfidens til menneskelig gennemgang.

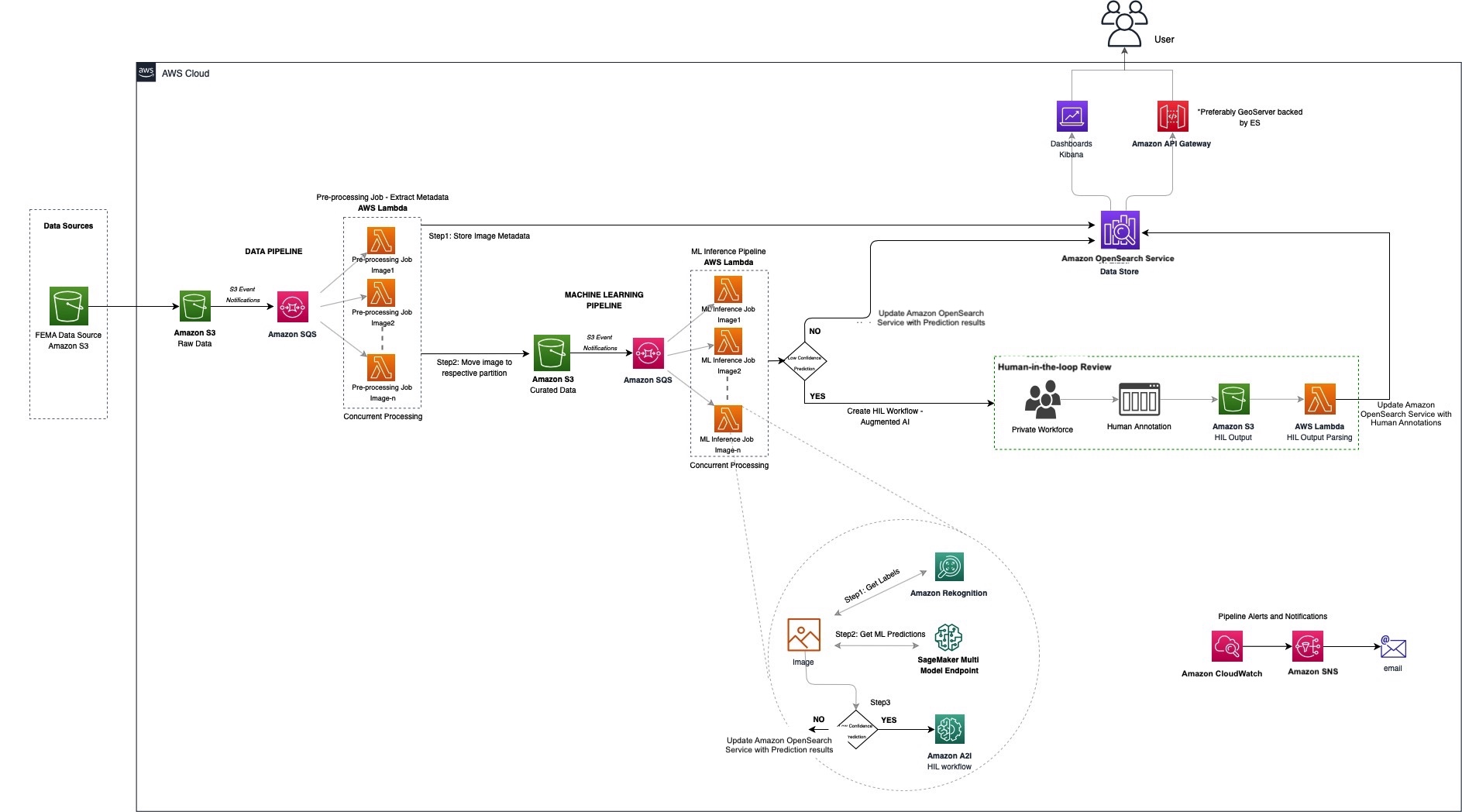

I dette indlæg beskriver vi vores design og implementering af løsningen, bedste praksis og nøglekomponenterne i systemarkitekturen.

Løsningsoversigt

Kort fortalt indebar løsningen at bygge tre pipelines:

- Datapipeline – Udtrækker billedernes metadata

- Machine learning pipeline – Klassificerer og mærker billeder

- Human-in-the-loop review pipeline – Bruger et menneskeligt team til at gennemgå resultater

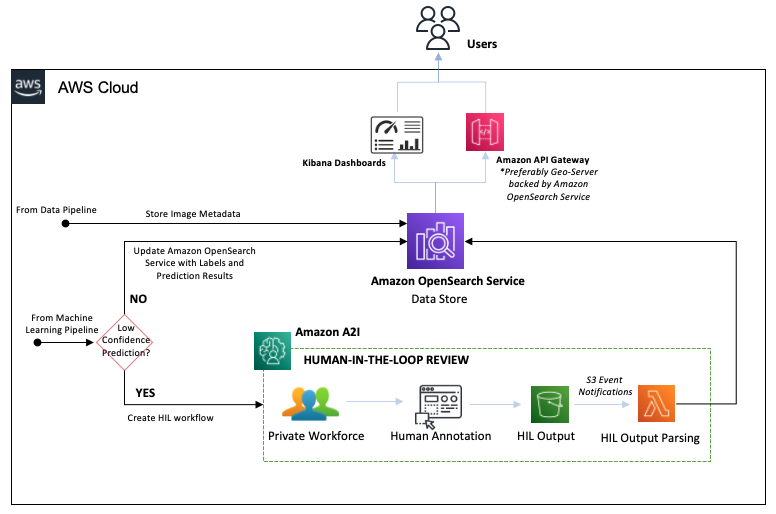

Følgende diagram illustrerer løsningsarkitekturen.

I betragtning af karakteren af et mærkningssystem som dette, designede vi en horisontalt skalerbar arkitektur, der kunne håndtere indtagelsesspidser uden overprovisionering ved at bruge en serverløs arkitektur. Vi bruger et en-til-mange mønster fra Amazon Simple Queue Service (Amazon SQS) til AWS Lambda på flere steder for at understøtte disse indtagelsesspidser, tilbyder modstandskraft.

Brug af en SQS-kø til behandling Amazon Simple Storage Service (Amazon S3)-hændelser hjælper os med at kontrollere samtidigheden af downstream-behandling (Lambda-funktioner, i dette tilfælde) og håndtere de indkommende spidser af data. At sætte indgående meddelelser i kø fungerer også som et bufferlager i tilfælde af fejl nedstrøms.

I betragtning af de meget parallelle behov, valgte vi Lambda til at behandle vores billeder. Lambda er en serverløs computertjeneste, der lader os køre kode uden at klargøre eller administrere servere, skabe arbejdsbelastningsbevidst klyngeskaleringslogik, vedligeholde hændelsesintegrationer og administrere kørselstider.

Vi anvender Amazon OpenSearch Service som vores centrale datalager for at drage fordel af dets yderst skalerbare, hurtige søgninger og integrerede visualiseringsværktøj, OpenSearch Dashboards. Det giver os mulighed for iterativt at tilføje kontekst til billedet, uden at skulle rekompilere eller skalere, og håndtere skemaudvikling.

Amazon-anerkendelse gør det nemt at tilføje billed- og videoanalyse til vores applikationer ved hjælp af gennemprøvet, meget skalerbar, deep learning-teknologi. Med Amazon Rekognition får vi en god baseline af detekterede objekter.

I de følgende afsnit dykker vi mere detaljeret ned i hver pipeline.

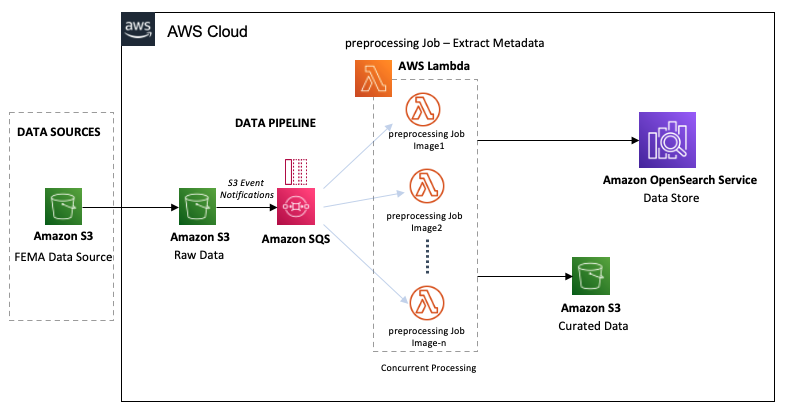

Datapipeline

Følgende diagram viser arbejdsgangen for datapipelinen.

LADI-datapipelinen starter med indtagelsen af rådatabilleder fra FEMA Common Alerting Protocol (CAP) i en S3 spand. Når vi indtager billederne i rådatabøtten, behandles de i næsten realtid i to trin:

- S3-bøtten udløser hændelsesmeddelelser for alle objektoprettelser og skaber meddelelser i SQS-køen for hvert billede, der indtages.

- SQS-køen påberåber sig samtidig de forbehandlede Lambda-funktioner på billedet.

Lambda-funktionerne udfører følgende forbehandlingstrin:

- Beregn UUID for hvert billede, og giv et unikt id for hvert billede. Dette ID vil identificere billedet i hele dets livscyklus.

- Udtræk metadata såsom GPS-koordinater, billedstørrelse, GIS-oplysninger og S3-placering fra billedet og bevar det i OpenSearch.

- Baseret på et opslag mod FIPS-koder flytter funktionen billedet til den kurerede data S3-bøtte. Vi opdeler dataene efter billedets FIPS-State-code/FIPS-County-code/Year/Month.

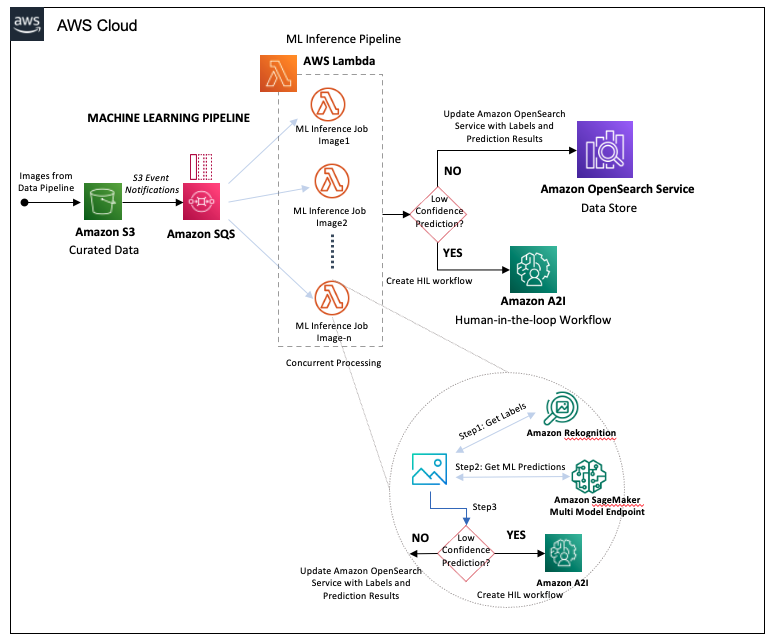

Machine learning pipeline

ML-pipelinen starter fra billederne, der lander i den kurerede data S3-bøtte i datapipeline-trinnet, hvilket udløser følgende trin:

- Amazon S3 genererer en besked til en anden SQS-kø for hvert objekt, der er oprettet i den kurerede data S3-bøtte.

- SQS-køen udløser samtidig Lambda-funktioner for at køre ML-inferensjobbet på billedet.

Lambda-funktionerne udfører følgende handlinger:

- Send hvert billede til Amazon Rekognition til genkendelse af objekter, gem de returnerede etiketter og respektive konfidensscore.

- Sammensæt Amazon Rekognition-outputtet til inputparametre for vores Amazon SageMaker multi-model slutpunkt. Dette slutpunkt er vært for vores ensemble af klassifikatorer, som er trænet til specifikke sæt skadesetiketter.

- Send resultaterne af SageMaker-endepunktet til Amazon Augmented AI (Amazon A2I).

Følgende diagram illustrerer pipeline-arbejdsgangen.

Human-in-the-loop review pipeline

Følgende diagram illustrerer human-in-the-loop (HIL) pipeline.

Med Amazon A2I kan vi konfigurere tærskler, der vil udløse en menneskelig gennemgang af et privat team, når en model giver en lav konfidens forudsigelse. Vi kan også bruge Amazon A2I til at give en løbende revision af vores models forudsigelser. Workflow-trinene er som følger:

- Amazon A2I dirigerer højsikkerhedsforudsigelser til OpenSearch Service og opdaterer billedets etiketdata.

- Amazon A2I sender forudsigelser med lav konfidens til det private team for at annotere billeder manuelt.

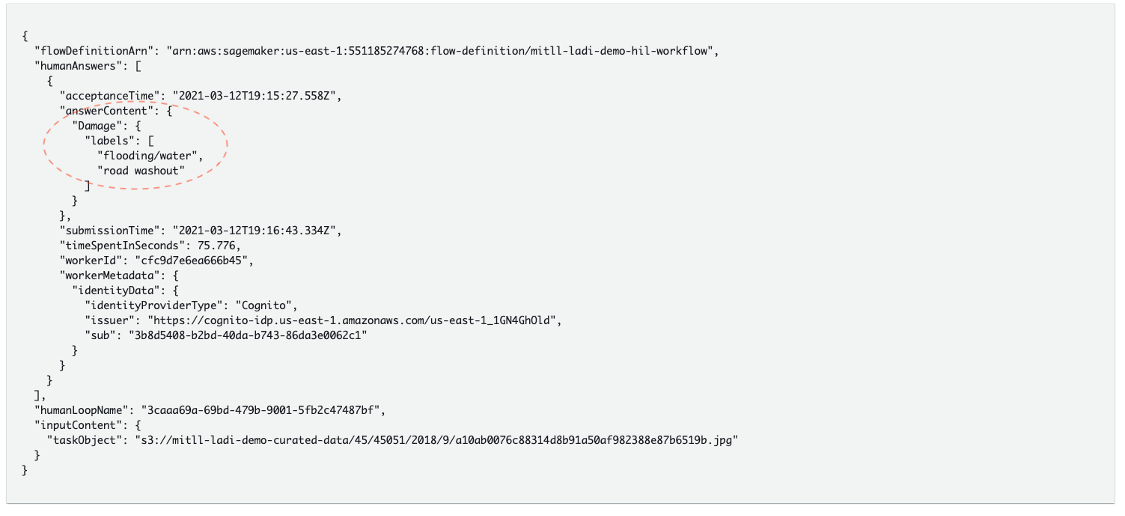

- Den menneskelige anmelder fuldfører annoteringen og genererer en human annotationsoutputfil, der er gemt i HIL Output S3-bøtten.

- HIL Output S3-bøtten udløser en Lambda-funktion, der analyserer de menneskelige annoteringsoutput og opdaterer billedets data i OpenSearch Service.

Ved at dirigere de menneskelige annoteringsresultater tilbage til datalageret kan vi genoptræne ensemblemodellerne og iterativt forbedre modellens nøjagtighed.

Med vores resultater af høj kvalitet, der nu er gemt i OpenSearch Service, er vi i stand til at udføre geospatial og tidsmæssig søgning via en REST API ved at bruge Amazon API Gateway og Geoserver. OpenSearch Dashboard gør det også muligt for brugere at søge og køre analyser med dette datasæt.

Resultater

Følgende kode viser et eksempel på vores resultater.

Med denne nye pipeline skaber vi en menneskelig bagstopper for modeller, der endnu ikke er fuldt ydende. Denne nye ML-pipeline er blevet sat i produktion til brug med en Civil Air Patrol Image Filter mikroservice der giver mulighed for filtrering af Civil Air Patrol-billeder i Puerto Rico. Dette gør det muligt for førstehjælpere at se omfanget af skader og se billeder forbundet med skaden efter orkaner. AWS Data Lab, AWS Open Data Program, Amazon Disaster Response-team og AWS human-in-the-loop-teamet arbejdede sammen med kunder om at udvikle en open source-pipeline, der kan bruges til at analysere Civil Air Patrol-data gemt i Open Data Programregistrering efter behov efter enhver naturkatastrofe. For mere information om pipeline-arkitekturen og et overblik over samarbejdet og virkningen, se videoen Fokus på katastrofeberedskab med Amazon Augmented AI, AWS Open Data Program og AWS Snowball.

Konklusion

Da klimaændringer fortsætter med at øge hyppigheden og intensiteten af storme og naturbrande, ser vi fortsat vigtigheden af at bruge ML til at forstå indvirkningen af disse begivenheder på lokalsamfund. Disse nye værktøjer kan accelerere indsatsen for katastrofeberedskab og give os mulighed for at bruge data fra disse analyser efter hændelser til at forbedre forudsigelsesnøjagtigheden af disse modeller med aktiv læring. Disse nye ML-modeller kan automatisere dataannotering, hvilket gør os i stand til at udlede omfanget af skade fra hver af disse hændelser, når vi overlejrer skadesetiketter med kortdata. Disse kumulative data kan også hjælpe med at forbedre vores evne til at forudsige skader for fremtidige katastrofebegivenheder, hvilket kan informere afværgestrategier. Dette kan igen forbedre modstandskraften i samfund, økonomier og økosystemer ved at give beslutningstagere den information, de har brug for til at udvikle datadrevne politikker til at imødegå disse nye miljøtrusler.

I dette blogindlæg diskuterede vi brugen af computersyn på satellitbilleder. Denne løsning er beregnet til at være en referencearkitektur eller en hurtigstartguide, som du kan tilpasse til dine egne behov.

Giv det en hvirvel, og lad os vide, hvordan dette løste din use case ved at give feedback i kommentarfeltet. For mere information, se Amazon SageMaker geospatiale muligheder.

Om forfatterne

Vamshi Krishna Enabothala er Sr. Applied AI Specialist Architect hos AWS. Han arbejder med kunder fra forskellige sektorer for at fremskynde effektive data, analyser og maskinlæringsinitiativer. Han brænder for anbefalingssystemer, NLP og computervisionsområder inden for AI og ML. Uden for arbejdet er Vamshi en RC-entusiast, der bygger RC-udstyr (fly, biler og droner) og nyder også havearbejde.

Vamshi Krishna Enabothala er Sr. Applied AI Specialist Architect hos AWS. Han arbejder med kunder fra forskellige sektorer for at fremskynde effektive data, analyser og maskinlæringsinitiativer. Han brænder for anbefalingssystemer, NLP og computervisionsområder inden for AI og ML. Uden for arbejdet er Vamshi en RC-entusiast, der bygger RC-udstyr (fly, biler og droner) og nyder også havearbejde.

Morgan Dutton er en Senior Technical Program Manager hos Amazon Augmented AI og Amazon SageMaker Ground Truth-teamet. Hun arbejder med virksomheder, akademiske og offentlige kunder for at fremskynde indførelse af maskinlæring og human-in-the-loop ML-tjenester.

Morgan Dutton er en Senior Technical Program Manager hos Amazon Augmented AI og Amazon SageMaker Ground Truth-teamet. Hun arbejder med virksomheder, akademiske og offentlige kunder for at fremskynde indførelse af maskinlæring og human-in-the-loop ML-tjenester.

Sandeep Verma er en Sr. Prototyping Architect med AWS. Han nyder at dykke dybt ned i kundernes udfordringer og bygge prototyper til kunderne for at accelerere innovationen. Han har en baggrund i AI/ML, grundlægger af New Knowledge, og generelt passioneret omkring tech. I sin fritid elsker han at rejse og stå på ski med sin familie.

Sandeep Verma er en Sr. Prototyping Architect med AWS. Han nyder at dykke dybt ned i kundernes udfordringer og bygge prototyper til kunderne for at accelerere innovationen. Han har en baggrund i AI/ML, grundlægger af New Knowledge, og generelt passioneret omkring tech. I sin fritid elsker han at rejse og stå på ski med sin familie.

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- Platoblokkæde. Web3 Metaverse Intelligence. Viden forstærket. Adgang her.

- Kilde: https://aws.amazon.com/blogs/machine-learning/accelerate-disaster-response-with-computer-vision-for-satellite-imagery-using-amazon-sagemaker-and-amazon-augmented-ai/

- 100

- 7

- 98

- a

- evne

- I stand

- Om

- akademisk

- fremskynde

- nøjagtighed

- aktioner

- aktiv

- handlinger

- adresse

- Vedtagelse

- fremskridt

- Fordel

- mod

- agenturer

- AI

- AI / ML

- LUFT

- Alle

- tillader

- Amazon

- Amazon Augmented AI

- Amazon-anerkendelse

- Amazon SageMaker

- Amazon SageMaker Ground Truth

- Analyser

- analyse

- analytics

- analysere

- ,

- En anden

- api

- applikationer

- anvendt

- Anvendt AI

- arkitektur

- områder

- forbundet

- revision

- augmented

- automatisere

- bevidsthed

- AWS

- tilbage

- baggrund

- bagstopper

- barrierer

- Baseline

- fordi

- Benchmarks

- BEDSTE

- bedste praksis

- Blog

- buffer

- bygge

- Bygning

- kasket

- biler

- tilfælde

- tilfælde

- kategorier

- central

- udfordringer

- udfordrende

- lave om

- kontrollere

- valgte

- By

- Klima

- Klima forandring

- Cluster

- kode

- samarbejde

- kommentarer

- Fælles

- Fællesskaber

- Fuldender

- komponenter

- Compute

- computer

- Computer Vision

- tillid

- indeholder

- sammenhæng

- fortsæt

- fortsætter

- kontrol

- skabe

- oprettet

- Oprettelse af

- byggemuligheder

- kritisk

- kurateret

- kunde

- Kunder

- tilpasse

- instrumentbræt

- data

- datastyret

- datasæt

- beskæftiger

- beslutningstagere

- dyb

- dyb læring

- levere

- Efterspørgsel

- indsætte

- beskrive

- Design

- konstrueret

- detail

- opdaget

- Detektion

- udvikle

- Udvikling

- forskellige

- svært

- katastrofe

- katastrofer

- drøftet

- Drones

- hver

- økonomier

- økosystemer

- indsats

- smergel

- aktiveret

- muliggør

- Endpoint

- Enterprise

- entusiast

- Hele

- miljømæssige

- udstyr

- især

- Endog

- begivenhed

- begivenheder

- evolution

- eksempel

- eksisterende

- dyrt

- Uddrag

- familie

- FAST

- featured

- Funktionalitet

- tilbagemeldinger

- File (Felt)

- filtrere

- filtrering

- Brand

- Fornavn

- Fokus

- efter

- følger

- grundlægger

- Gratis

- Frekvens

- fra

- fuldt ud

- funktion

- funktioner

- fremtiden

- Gevinst

- generelt

- genererer

- generere

- geografisk

- Geospatial ML

- få

- given

- Give

- Global

- godt

- regeringer

- gps

- Ground

- vejlede

- håndtere

- have

- hjælpe

- hjælpsom

- hjælper

- Høj

- høj kvalitet

- stærkt

- Hit

- værter

- Hvordan

- HTML

- HTTPS

- menneskelig

- orkan

- ID

- identifikator

- identificere

- billede

- billeder

- KIMOs Succeshistorier

- implementering

- betydning

- Forbedre

- forbedring

- in

- Herunder

- Indgående

- Forøg

- oplysninger

- initiativer

- Innovation

- indgang

- integreret

- integrationer

- afbrudt

- påberåber sig

- involverede

- IT

- Job

- Nøgle

- Kend

- viden

- lab

- etiket

- mærkning

- Etiketter

- Mangel

- landing

- storstilet

- læring

- forlader

- Lets

- livscyklus

- lokale

- placering

- leder

- kig op

- Lav

- maskine

- machine learning

- Vedligeholdelse

- lave

- maerker

- leder

- styring

- manuel

- manuelt

- kort

- Maps

- massive

- besked

- beskeder

- Metadata

- Mexico

- afbødning

- ML

- model

- modeller

- mere

- bevæger sig

- Multi-model slutpunkt

- flere

- Natural

- Natur

- Behov

- behov

- Ny

- NLP

- meddelelser

- objekt

- Objektdetektion

- objekter

- ocean

- tilbud

- igangværende

- åbent

- åbne data

- open source

- uden for

- oversigt

- egen

- Parallel

- parametre

- lidenskabelige

- Mønster

- Udfør

- perspektiv

- pipeline

- planet

- plato

- Platon Data Intelligence

- PlatoData

- Indlæg

- praksis

- Precision

- forudsige

- forudsigelse

- Forudsigelser

- Prioriter

- private

- Problem

- behandle

- Behandlet

- forarbejdning

- produktion

- Program

- protokol

- prototyper

- prototyping

- gennemprøvet

- give

- leverer

- offentlige

- Puerto

- Puerto Rico

- sætte

- Hurtig

- Raw

- nylige

- for nylig

- Anbefaling

- reducere

- register

- frigivet

- relief

- påkrævet

- forskere

- modstandskraft

- dem

- svar

- REST

- Resultater

- gennemgå

- RICO

- R

- veje

- Kør

- sagemaker

- satellit

- skalerbar

- skalering

- scener

- Søg

- sæsoner

- Sektion

- sektioner

- sektor

- Sektorer

- senior

- Serverless

- Servere

- tjeneste

- Tjenester

- sæt

- Shows

- Simpelt

- Størrelse

- Røg

- Snapshot

- løsninger

- Kilder

- specialist

- specifikke

- spikes

- standard

- starte

- starter

- state-of-the-art

- Stater

- Trin

- Steps

- opbevaring

- butik

- opbevaret

- storme

- strategier

- sådan

- support

- systemet

- Systemer

- Tag

- hold

- hold

- tech

- Teknisk

- Teknologier

- oplysninger

- trusler

- tre

- tid

- tidskrævende

- til

- værktøj

- værktøjer

- Tog

- uddannet

- Kurser

- Traveling

- udløse

- TUR

- typer

- forstå

- enestående

- opdateringer

- opdatering

- us

- brug

- brug tilfælde

- brugere

- forskellige

- via

- video

- Specifikation

- vision

- visualisering

- som

- vilje

- uden

- Arbejde

- arbejdede

- virker

- ville

- år

- udbytter

- Du

- Din

- youtube

- zephyrnet