Dette indlæg er skrevet sammen med Marc Neumann, Amor Steinberg og Marinus Krommenhoek fra BMW Group.

BMW Group – med hovedkontor i München, Tyskland – drives af 149,000 medarbejdere verden over og producerer i over 30 produktions- og montagefaciliteter i 15 lande. I dag er BMW Group verdens førende producent af premium biler og motorcykler og udbyder af premium finansielle tjenester og mobilitetstjenester. BMW Group sætter trends inden for produktionsteknologi og bæredygtighed som innovationsleder med et intelligent materialemix, et teknologisk skift mod digitalisering og ressourceeffektiv produktion.

I en stadig mere digital og hurtigt skiftende verden er BMW Groups forretnings- og produktudviklingsstrategier stærkt afhængige af datadrevet beslutningstagning. Med det er behovet for dataforskere og maskinlæringsingeniører (ML) vokset betydeligt. Disse dygtige fagfolk har til opgave at bygge og implementere modeller, der forbedrer kvaliteten og effektiviteten af BMWs forretningsprocesser og muliggør informerede ledelsesbeslutninger.

Datavidenskabsmænd og ML-ingeniører kræver dygtigt værktøj og tilstrækkelig databehandling til deres arbejde. Derfor etablerede BMW en centraliseret ML/deep learning-infrastruktur på stedet for flere år siden og opgraderede den løbende. For at bane vejen for væksten af kunstig intelligens var BMW Group nødt til at tage et spring med hensyn til skalerbarhed og elasticitet og samtidig reducere driftsomkostninger, softwarelicenser og hardwarestyring.

I dette indlæg vil vi tale om, hvordan BMW Group i samarbejde med AWS Professional Services byggede sin Jupyter Managed (JuMa) service for at løse disse udfordringer. JuMa er en service fra BMW Groups AI-platform til dets dataanalytikere, ML-ingeniører og dataforskere, der giver et brugervenligt arbejdsområde med et integreret udviklingsmiljø (IDE). Den er drevet af Amazon SageMaker Studio og leverer JupyterLab for Python og Posit Workbench for R. Dette tilbud gør det muligt for BMW ML-ingeniører at udføre kodecentreret dataanalyse og ML, øger udviklerproduktiviteten ved at levere selvbetjeningskapacitet og infrastrukturautomatisering og integreres tæt med BMWs centraliserede IT-værktøjslandskab.

JuMa er nu tilgængelig for alle dataforskere, ML-ingeniører og dataanalytikere hos BMW Group. Tjenesten strømliner ML-udviklings- og produktionsarbejdsgange (MLOps) på tværs af BMW ved at levere et omkostningseffektivt og skalerbart udviklingsmiljø, der muliggør problemfrit samarbejde mellem datavidenskab og ingeniørteams verden over. Dette resulterer i hurtigere eksperimentering og kortere idévalideringscyklusser. Desuden JuMa-infrastrukturen, som er baseret på AWS serverløs og administrerede tjenester, hjælper med at reducere operationelle omkostninger for DevOps-teams og giver dem mulighed for at fokusere på at muliggøre use cases og accelerere AI-innovation hos BMW Group.

Udfordringer ved at udvikle en AI-platform på stedet

Før introduktionen af JuMa-tjenesten, brugte BMW-teams verden over to lokale platforme, der gav teams JupyterHub og RStudio-miljøer. Disse platforme var for begrænsede med hensyn til CPU, GPU og hukommelse til at tillade skalerbarheden af AI hos BMW Group. At skalere disse platforme med styring af mere lokal hardware, flere softwarelicenser og supportgebyrer ville kræve betydelige forudgående investeringer og en stor indsats for at vedligeholde det. For at tilføje til dette var begrænsede selvbetjeningsmuligheder tilgængelige, hvilket krævede en høj operationel indsats for dets DevOps-hold. Endnu vigtigere var brugen af disse platforme forkert tilpasset BMW Groups IT cloud-first strategi. For eksempel savnede teams, der brugte disse platforme, en nem migrering af deres AI/ML-prototyper til industrialiseringen af løsningen, der kører på AWS. I modsætning hertil var datavidenskabs- og analyseteamene, der allerede bruger AWS direkte til eksperimenter, også nødvendige for at tage sig af opbygningen og driften af deres AWS-infrastruktur og samtidig sikre overholdelse af BMW Groups interne politikker, lokale love og regler. Dette omfattede en række konfigurations- og styringsaktiviteter fra bestilling af AWS-konti, begrænsning af internetadgang, brug af tilladte listede pakker til at holde deres Docker-billeder opdateret.

Oversigt over løsning

JuMa er en fuldt administreret multi-lejer, sikkerhedshærdet AI platform service bygget på AWS med SageMaker Studio i kernen. Ved at stole på AWS-serverløse og administrerede tjenester som de vigtigste byggesten i infrastrukturen, behøver JuMa DevOps-teamet ikke at bekymre sig om at patche servere, opgradere lager eller administrere andre infrastrukturkomponenter. Tjenesten håndterer alle disse processer automatisk, hvilket giver en kraftfuld teknisk platform, der generelt er opdateret og klar til brug.

JuMa-brugere kan nemt bestille et arbejdsområde via en selvbetjeningsportal for at skabe et sikkert og isoleret udviklings- og eksperimenteringsmiljø for deres teams. Efter at et JuMa-arbejdsområde er klargjort, kan brugerne starte JupyterLab eller Posit workbench-miljøer i SageMaker Studio med blot et par klik og starte udviklingen med det samme ved hjælp af de værktøjer og rammer, de er mest bekendt med. JuMa er tæt integreret med en række BMW Central IT-tjenester, herunder identitets- og adgangsstyring, roller og rettighedsstyring, BMW Cloud Data Hub (BMW's datasø på AWS) og lokale databaser. Sidstnævnte hjælper AI/ML-teams med problemfri adgang til de nødvendige data, da de er autoriseret til at gøre det, uden at skulle bygge datapipelines. Desuden kan notesbøgerne integreres i virksomhedens Git-lagre for at samarbejde ved hjælp af versionskontrol.

Løsningen abstraherer alle tekniske kompleksiteter forbundet med AWS-kontoadministration, konfiguration og tilpasning for AI/ML-teams, hvilket giver dem mulighed for fuldt ud at fokusere på AI-innovation. Platformen sikrer, at arbejdsområdets konfiguration opfylder BMWs sikkerheds- og overholdelseskrav ud af kassen.

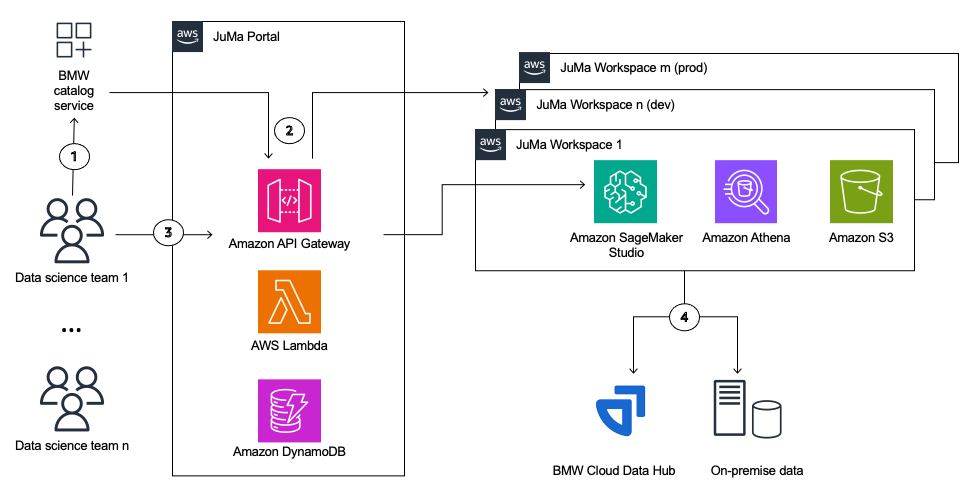

Følgende diagram beskriver kontekstvisningen på højt niveau af arkitekturen.

Brugerrejse

BMW AI/ML-teammedlemmer kan bestille deres JuMa-arbejdsplads ved hjælp af BMWs standardkatalogservice. Efter godkendelse af linjelederen klargøres det bestilte JuMa-arbejdsområde af platformen fuldautomatisk. Arbejdsgangen til klargøring af arbejdsområde inkluderer følgende trin (som nummereret i arkitekturdiagrammet).

- Et dataforskerteam bestiller et nyt JuMa-arbejdsområde i BMWs katalog. JuMa klargør automatisk en ny AWS-konto til arbejdsområdet. Dette sikrer fuld isolation mellem arbejdsområderne, der følger den forbundne modelkontostruktur, der er nævnt i SageMaker Studio Administration Best Practices.

- JuMa konfigurerer et arbejdsområde (som er en Sagemaker domæne), der kun tillader foruddefinerede Amazon SageMaker funktioner, der kræves til eksperimentering og udvikling, specifikke brugerdefinerede kerner og livscykluskonfigurationer. Det opsætter også de nødvendige undernet og sikkerhedsgrupper, der sikrer, at de bærbare computere kører i et sikkert miljø.

- Efter at arbejdsområderne er klargjort, logger de autoriserede brugere på JuMa-portalen og får adgang til SageMaker Studio IDE i deres arbejdsområde ved hjælp af en SageMaker-forsignet URL. Brugere kan vælge mellem at åbne et SageMaker Studio privat rum eller et fælles plads. Delte rum tilskynder til samarbejde mellem forskellige medlemmer af et team, der kan arbejde parallelt på de samme notesbøger, hvorimod private rum giver mulighed for et udviklingsmiljø for ensomme arbejdsbyrder.

- Ved at bruge BMWs dataportal kan brugere anmode om adgang til lokale databaser eller data gemt i BMWs Cloud Data Hub, hvilket gør det tilgængeligt i deres arbejdsområde til udvikling og eksperimentering, fra dataforberedelse og analyse til modeltræning og validering.

Efter at en AI-model er udviklet og valideret i JuMa, kan AI-teams bruge MLOPs-tjenesten på BMW AI-platformen til at implementere den til produktion hurtigt og ubesværet. Denne service giver brugerne en produktionskvalitets ML-infrastruktur og pipelines på AWS ved hjælp af SageMaker, som kan konfigureres på få minutter med blot et par klik. Brugere skal blot hoste deres model på den tilvejebragte infrastruktur og tilpasse pipelinen til at imødekomme deres specifikke behov. På denne måde dækker AI-platformen hele AI-livscyklussen hos BMW Group.

JuMa funktioner

Efter best practice architecting på AWS blev JuMa-tjenesten designet og implementeret i henhold til AWS velstruktureret rammeværk. Arkitektoniske beslutninger for hver Well-Architected søjle er beskrevet detaljeret i de følgende afsnit.

Sikkerhed og overholdelse

For at sikre fuld isolation mellem lejerne får hvert arbejdsområde sin egen AWS-konto, hvor de autoriserede brugere i fællesskab kan samarbejde om analyseopgaver samt om at udvikle og eksperimentere med AI/ML-modeller. JuMa-portalen håndhæver selv isolering ved kørsel ved hjælp af politikbaseret isolering med AWS identitets- og adgangsstyring (IAM) og JuMa-brugerens kontekst. For mere information om denne strategi, se Run-time, politikbaseret isolering med IAM.

Dataforskere kan kun få adgang til deres domæne gennem BMW-netværket via forudsignede URL'er genereret af portalen. Direkte internetadgang er deaktiveret inden for deres domæne. Deres Sagemaker-domæneprivilegier er bygget vha Amazon SageMaker Rolle Manager personas for at sikre mindst privilegeret adgang til AWS-tjenester, der er nødvendige for udviklingen, såsom SageMaker, Amazonas Athena, Amazon Simple Storage Service (Amazon S3), og AWS Lim. Denne rolle implementerer ML autoværn (såsom dem, der er beskrevet i Styring og kontrol), herunder håndhævelse af ML-træning, der skal finde sted i begge Amazon Virtual Private Cloud (Amazon VPC) eller uden internet og tillader kun brug af JuMas brugerdefinerede kontrollerede og opdaterede SageMaker-billeder.

Fordi JuMa er designet til udvikling, eksperimentering og ad-hoc-analyse, implementerer det opbevaringspolitikker for at fjerne data efter 30 dage. For at få adgang til data, når det er nødvendigt og gemme dem i lang tid, integreres JuMa problemfrit med BMW Cloud Data Hub og BMW on-premises databaser.

Endelig støtter JuMa flere regioner til at overholde særlige lokale juridiske situationer, som for eksempel kræver, at den behandler data lokalt for at muliggøre BMWs datasuverænitet.

Operationel ekspertise

Både JuMa platformens backend og arbejdsområder er implementeret med AWS serverløs og administrerede tjenester. Brug af disse tjenester hjælper med at minimere indsatsen fra BMW-platformsteamet ved at vedligeholde og betjene end-to-end-løsningen, der stræber efter at være en no-ops service. Både arbejdsområdet og portalen overvåges vha amazoncloudwatch logfiler, målinger og alarmer for at kontrollere nøglepræstationsindikatorer (KPI'er) og proaktivt underrette platformteamet om eventuelle problemer. Derudover AWS røntgen distribueret sporingssystem bruges til at spore anmodninger gennem flere komponenter og annotere CloudWatch-logfiler med arbejdsrumsrelevant kontekst.

Alle ændringer i JuMa-infrastrukturen styres og implementeres gennem automatisering ved hjælp af infrastruktur som kode (IaC). Dette hjælper med at reducere manuel indsats og menneskelige fejl, øge konsistensen og sikre reproducerbare og versionskontrollerede ændringer på tværs af begge JuMa-platformens backend-arbejdsområder. Specifikt er alle arbejdsområder klargjort og opdateret gennem en onboarding-proces bygget ovenpå AWS-trinfunktioner, AWS CodeBuildog Terraform. Derfor kræves der ingen manuel konfiguration for at indbygge nye arbejdsområder på JuMa-platformen.

Omkostningsoptimering

Ved at bruge AWS-serverløse tjenester sikrer JuMa skalerbarhed efter behov, forhåndsgodkendte instansstørrelser og en pay-as-you-go-model for de ressourcer, der bruges under udviklings- og eksperimenteringsaktiviteterne i henhold til AI/ML-teams behov. For yderligere at optimere omkostningerne overvåger og identificerer JuMa-platformen ledige ressourcer i SageMaker Studio og lukker dem ned automatisk for at forhindre udgifter til ikke-udnyttede ressourcer.

Bæredygtighed

JuMa erstatter BMW's to lokale platforme til analyse og deep learning-arbejdsbelastninger, der forbruger en betydelig mængde elektricitet og producerer CO2-emissioner, selv når de ikke er i brug. Ved at migrere AI/ML-arbejdsbelastninger fra lokale til AWS vil BMW reducere sin miljøpåvirkning ved at nedlægge de lokale platforme.

Ydermere hjælper mekanismen til automatisk nedlukning af ledige ressourcer, dataopbevaringspolitikker og rapporterne om brug af arbejdsområdet til dets ejere implementeret i JuMa yderligere med at minimere det miljømæssige fodaftryk ved at køre AI/ML-arbejdsbelastninger på AWS.

Ydeevne effektivitet

Ved at bruge SageMaker Studio drager BMW-teams fordel af en nem anvendelse af de nyeste SageMaker-funktioner, der kan hjælpe med at accelerere deres eksperimenter. De kan f.eks. bruge Amazon SageMaker JumpStart evner til at bruge de seneste præ-trænede, open source-modeller. Derudover hjælper det med at reducere AI/ML-teamets indsats, der bevæger sig fra eksperimentering til løsningsindustrialisering, fordi udviklingsmiljøet leverer de samme AWS-kernetjenester, men begrænset til udviklingsmuligheder.

Pålidelighed

SageMaker Studio-domæner er implementeret i en VPC-kun-tilstand for at administrere internetadgang og tillader kun adgang til tilsigtede AWS-tjenester. Netværket er implementeret i to tilgængelighedszoner for at beskytte mod et enkelt fejlpunkt, hvilket opnår større modstandsdygtighed og tilgængelighed af platformen for dens brugere.

Ændringer til JuMa-arbejdsområder implementeres og testes automatisk til udviklings- og integrationsmiljøer ved hjælp af IaC- og CI/CD-pipelines, før kundemiljøer opgraderes.

Endelig data gemt i Amazon Elastic File System (Amazon EFS) for SageMaker Studio-domæner beholdes, efter at volumener er slettet til sikkerhedskopiering.

Konklusion

I dette indlæg beskrev vi, hvordan BMW Group i samarbejde med AWS ProServe udviklede en fuldt administreret AI-platformstjeneste på AWS ved hjælp af SageMaker Studio og andre AWS-serverløse og administrerede tjenester.

Med JuMa er BMW's AI/ML-teams bemyndiget til at låse op for ny forretningsværdi ved at accelerere eksperimentering samt time-to-market for disruptive AI-løsninger. Desuden kan BMW ved at migrere fra sin lokale platform reducere den samlede operationelle indsats og omkostninger og samtidig øge bæredygtigheden og den overordnede sikkerhedsposition.

Besøg Amazon SageMaker Studio.

Om forfatterne

Marc Neumann er leder af den centrale AI Platform hos BMP Group. Han er ansvarlig for at udvikle og implementere strategier til at bruge AI-teknologi til forretningsværdiskabelse på tværs af BMW Group. Hans primære mål er at sikre, at brugen af kunstig intelligens er bæredygtig og skalerbar, hvilket betyder, at den konsekvent kan anvendes på tværs af organisationen for at drive langsigtet vækst og innovation. Gennem sit lederskab sigter Neumann mod at positionere BMW Group som førende inden for AI-drevet innovation og værdiskabelse i bilindustrien og videre.

Marc Neumann er leder af den centrale AI Platform hos BMP Group. Han er ansvarlig for at udvikle og implementere strategier til at bruge AI-teknologi til forretningsværdiskabelse på tværs af BMW Group. Hans primære mål er at sikre, at brugen af kunstig intelligens er bæredygtig og skalerbar, hvilket betyder, at den konsekvent kan anvendes på tværs af organisationen for at drive langsigtet vækst og innovation. Gennem sit lederskab sigter Neumann mod at positionere BMW Group som førende inden for AI-drevet innovation og værdiskabelse i bilindustrien og videre.

Amor Steinberg er en maskinlæringsingeniør hos BMW Group og serviceleder for Jupyter Managed, en ny service, der har til formål at levere et kodecentreret analyse- og maskinlæringsarbejdsbord til ingeniører og dataforskere hos BMW Group. Hans tidligere erfaring som DevOps-ingeniør hos finansielle institutioner satte ham i stand til at opnå en unik forståelse af de udfordringer, som banker står over for i EU, og holde balancen mellem stræben efter teknologisk innovation, overholdelse af love og regler og maksimering af sikkerheden for kunderne.

Amor Steinberg er en maskinlæringsingeniør hos BMW Group og serviceleder for Jupyter Managed, en ny service, der har til formål at levere et kodecentreret analyse- og maskinlæringsarbejdsbord til ingeniører og dataforskere hos BMW Group. Hans tidligere erfaring som DevOps-ingeniør hos finansielle institutioner satte ham i stand til at opnå en unik forståelse af de udfordringer, som banker står over for i EU, og holde balancen mellem stræben efter teknologisk innovation, overholdelse af love og regler og maksimering af sikkerheden for kunderne.

Marinus Krommenhoek er Senior Cloud Solution Architect og softwareudvikler hos BMW Group. Han er begejstret for at modernisere it-landskabet med state-of-the-art tjenester, der tilføjer høj værdi og er nemme at vedligeholde og betjene. Marinus er en stor fortaler for mikrotjenester, serverløse arkitekturer og agilt arbejde. Han har en erfaring med at arbejde med distribuerede teams over hele kloden inden for store virksomheder.

Marinus Krommenhoek er Senior Cloud Solution Architect og softwareudvikler hos BMW Group. Han er begejstret for at modernisere it-landskabet med state-of-the-art tjenester, der tilføjer høj værdi og er nemme at vedligeholde og betjene. Marinus er en stor fortaler for mikrotjenester, serverløse arkitekturer og agilt arbejde. Han har en erfaring med at arbejde med distribuerede teams over hele kloden inden for store virksomheder.

Nicolas Jacob Bær er Principal Cloud Application Architect hos AWS ProServe med et stærkt fokus på data engineering og machine learning, baseret i Schweiz. Han arbejder tæt sammen med virksomhedskunder for at designe dataplatforme og bygge avancerede analyser og ML use cases.

Nicolas Jacob Bær er Principal Cloud Application Architect hos AWS ProServe med et stærkt fokus på data engineering og machine learning, baseret i Schweiz. Han arbejder tæt sammen med virksomhedskunder for at designe dataplatforme og bygge avancerede analyser og ML use cases.

Joaquin Rinaudo er Principal Security Architect hos AWS ProServe. Han brænder for at bygge løsninger, der hjælper udviklere med at forbedre deres softwarekvalitet. Før AWS arbejdede han på tværs af flere domæner i sikkerhedsindustrien, fra mobil sikkerhed til cloud og compliance-relaterede emner. I sin fritid nyder Joaquin at tilbringe tid med familien og læse science fiction-romaner.

Joaquin Rinaudo er Principal Security Architect hos AWS ProServe. Han brænder for at bygge løsninger, der hjælper udviklere med at forbedre deres softwarekvalitet. Før AWS arbejdede han på tværs af flere domæner i sikkerhedsindustrien, fra mobil sikkerhed til cloud og compliance-relaterede emner. I sin fritid nyder Joaquin at tilbringe tid med familien og læse science fiction-romaner.

Shukhrat Khodjaev er Senior Global Engagement Manager hos AWS ProServe. Han har specialiseret sig i at levere slagkraftige big data og AI/ML-løsninger, der gør det muligt for AWS-kunder at maksimere deres forretningsværdi gennem dataudnyttelse.

Shukhrat Khodjaev er Senior Global Engagement Manager hos AWS ProServe. Han har specialiseret sig i at levere slagkraftige big data og AI/ML-løsninger, der gør det muligt for AWS-kunder at maksimere deres forretningsværdi gennem dataudnyttelse.

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk dig selv. Adgang her.

- PlatoAiStream. Web3 intelligens. Viden forstærket. Adgang her.

- PlatoESG. Kulstof, CleanTech, Energi, Miljø, Solenergi, Affaldshåndtering. Adgang her.

- PlatoHealth. Bioteknologiske og kliniske forsøgs intelligens. Adgang her.

- Kilde: https://aws.amazon.com/blogs/machine-learning/accelerating-ai-ml-development-at-bmw-group-with-amazon-sagemaker-studio/

- :har

- :er

- :ikke

- :hvor

- $OP

- 000

- 100

- 120

- 15 %

- 30

- 7

- 971

- a

- Om

- abstracts

- fremskynde

- accelererende

- adgang

- Ifølge

- Konto

- kontoadministration

- Konti

- opnå

- tværs

- aktiviteter

- tilføje

- Derudover

- adresse

- administration

- Vedtagelse

- fremskreden

- fortaler

- Efter

- mod

- adræt

- siden

- AI

- AI platform

- AI / ML

- målsætninger

- Alle

- tillade

- tilladt

- tillade

- tillader

- allerede

- også

- Amazon

- Amazon SageMaker

- Amazon SageMaker Studio

- Amazon Web Services

- beløb

- an

- analyse

- Analytikere

- analytics

- ,

- og infrastruktur

- enhver

- Anvendelse

- anvendt

- godkendelse

- arkitektonisk

- arkitektur

- ER

- AS

- Assembly

- forbundet

- forsikre

- At

- autoriseret

- auto

- automatisk

- Automation

- automotive

- bilindustrien

- tilgængelighed

- til rådighed

- væk

- AWS

- AWS Professional Services

- Bagende

- backup

- Balance

- Banker

- baseret

- BE

- fordi

- før

- gavner det dig

- BEDSTE

- mellem

- Beyond

- Big

- Big data

- Blocks

- BMW

- både

- Boks

- bygge

- Bygning

- bygget

- virksomhed

- men

- by

- CAN

- kapaciteter

- kapacitet

- stand

- hvilken

- tilfælde

- tilfælde

- katalog

- central

- centraliseret

- udfordringer

- Ændringer

- skiftende

- kontrollere

- Vælg

- nøje

- Cloud

- kode

- samarbejde

- samarbejde

- kompleksiteter

- Compliance

- overholde

- komponenter

- Compute

- Konfiguration

- betydelig

- konsekvent

- forbruge

- sammenhæng

- kontinuerligt

- kontrast

- kontrol

- Core

- Corporate

- Omkostninger

- lande

- Dækker

- skabe

- skabelse

- skik

- kunde

- Kunder

- tilpasning

- tilpasse

- cykler

- data

- Dataanalyse

- Data Lake

- Dataforberedelse

- datalogi

- dataforsker

- datastyret

- databaser

- Dato

- Dage

- Beslutningstagning

- afgørelser

- dyb

- dyb læring

- leverer

- indsætte

- indsat

- implementering

- beskrevet

- Design

- konstrueret

- detail

- udviklet

- Udvikler

- udviklere

- udvikling

- Udvikling

- forskellige

- digital

- digitalisering

- direkte

- direkte

- deaktiveret

- forstyrrende

- distribueret

- do

- Docker

- Er ikke

- domæne

- Domæner

- ned

- køre

- drevet

- i løbet af

- hver

- let

- effektivitet

- indsats

- ubesværet

- indsats

- enten

- elektricitet

- Emissioner

- medarbejdere

- bemyndiget

- muliggøre

- aktiveret

- muliggør

- muliggør

- tilskynde

- ende til ende

- håndhævelse

- engagement

- ingeniør

- Engineering

- Ingeniører

- sikre

- sikrer

- sikring

- Enterprise

- virksomheder

- entusiastiske

- Hele

- Miljø

- miljømæssige

- miljøer

- fejl

- etableret

- europæisk

- europæiske Union

- Endog

- eksempel

- udgifter

- erfaring

- ansigter

- letter

- faciliteter

- Manglende

- bekendt

- familie

- hurtigere

- Funktionalitet

- Gebyrer

- få

- File (Felt)

- finansielle

- Finansielle institutioner

- Fokus

- efter

- Fodspor

- Til

- rammer

- Gratis

- fra

- fuld

- fuldt ud

- yderligere

- Endvidere

- samle

- generelt

- genereret

- Tyskland

- Git

- given

- Global

- kloden

- mål

- regeringsførelse

- GPU

- større

- gruppe

- Gruppens

- Dyrkning

- voksen

- Vækst

- Håndterer

- Hardware

- he

- hoved

- hovedsæde

- stærkt

- hjælpe

- hjælper

- Høj

- høj værdi

- højt niveau

- ham

- hans

- host

- Hvordan

- HTML

- http

- HTTPS

- Hub

- menneskelig

- idé

- identificerer

- Identity

- tomgang

- billeder

- straks

- KIMOs Succeshistorier

- effektfuld

- implementeret

- gennemføre

- redskaber

- vigtigere

- Forbedre

- in

- medtaget

- omfatter

- Herunder

- Forøg

- Stigninger

- stigende

- stigende

- Indikatorer

- industrien

- oplysninger

- informeret

- Infrastruktur

- Innovation

- instans

- institutioner

- integreret

- Integrerer

- integration

- Intelligent

- beregnet

- interne

- Internet

- Internetadgang

- ind

- indføre

- Investeringer

- isolerede

- isolation

- spørgsmål

- IT

- ITS

- selv

- jacob

- jpg

- lige

- Holde

- holde

- holdt

- Nøgle

- sø

- landskab

- stor

- Store virksomheder

- seneste

- lancere

- Love

- Love og forskrifter

- føre

- leder

- Leadership" (virkelig menneskelig ledelse)

- førende

- Leap

- LÆR

- læring

- mindst

- Politikker

- licenser

- Licenser

- livscyklus

- Limited

- begrænsende

- Line (linje)

- Børsnoterede

- lokale

- lokalt

- log

- Lang

- langsigtet

- maskine

- machine learning

- Main

- vedligeholde

- Vedligeholdelse

- vedligeholdelse

- lave

- Making

- administrere

- lykkedes

- ledelse

- leder

- styring

- manuel

- Fabrikant

- materiale

- Maksimer

- maksimere

- betyder

- mekanisme

- Mød

- opfylder

- Medlemmer

- Hukommelse

- nævnte

- Metrics

- microservices

- migrere

- migration

- minutter

- savnet

- blande

- ML

- MLOps

- Mobil

- mobil Sikkerhed

- mobilitet

- tilstand

- model

- modeller

- modernisering

- overvåges

- skærme

- mere

- Desuden

- mest

- motorcykler

- flytning

- flere

- Behov

- behov

- behøve

- behov

- netværk

- Ny

- ingen

- nu

- nummererede

- of

- tilbyde

- on

- On-Demand

- Ombord

- onboarding

- kun

- åbent

- open source

- åbning

- betjene

- drift

- operationelle

- Optimer

- or

- ordrer

- ordrer

- organisation

- Andet

- ud

- i løbet af

- samlet

- egen

- ejere

- pakker

- Parallel

- lidenskabelige

- forbi

- lappe

- bane

- per

- Udfør

- ydeevne

- Søjle

- pipeline

- perron

- Platforme

- plato

- Platon Data Intelligence

- PlatoData

- Punkt

- politikker

- Portal

- position

- Indlæg

- strøm

- vigtigste

- praksis

- Premium

- forberedelse

- forhindre

- primære

- Main

- Forud

- private

- privilegium

- privilegier

- behandle

- Processer

- producere

- Produkt

- produktudvikling

- produktion

- produktivitet

- professionel

- professionelle partnere

- beskytte

- prototyper

- give

- forudsat

- udbyder

- giver

- leverer

- formål

- Python

- kvalitet

- hurtigt

- R

- rækkevidde

- hurtigt

- Læsning

- klar

- modtager

- optage

- reducere

- reducere

- henvise

- om

- regioner

- regler

- stole

- stole

- Fjern

- Rapporter

- anmode

- anmodninger

- kræver

- påkrævet

- Krav

- Ressourcer

- ansvarlige

- begrænset

- Resultater

- tilbageholdelse

- rettigheder

- roller

- roller

- Kør

- kører

- runtime

- sagemaker

- samme

- Skalerbarhed

- skalerbar

- skalering

- Videnskab

- Videnskabsmand

- forskere

- sømløs

- problemfrit

- sektioner

- sikker

- sikkerhed

- Selvbetjening

- senior

- Serverless

- Servere

- tjeneste

- Tjenester

- sæt

- sæt

- flere

- delt

- skifte

- nedlukning

- lukker

- signifikant

- betydeligt

- Simpelt

- ganske enkelt

- enkelt

- situationer

- størrelser

- faglært

- So

- Software

- løsninger

- Løsninger

- Kilde

- suverænitet

- Space

- rum

- særligt

- specialiseret

- specifikke

- specifikt

- udgifterne

- standard

- starte

- state-of-the-art

- Trin

- Steps

- opbevaring

- butik

- opbevaret

- strategier

- Strategi

- strømliner

- stræben

- stærk

- struktur

- Studio

- undernet

- sådan

- tilstrækkeligt

- support

- Understøtter

- Bæredygtighed

- bæredygtig

- Schweiz

- systemet

- Tag

- Tal

- opgaver

- hold

- Holdkammerater

- hold

- Teknisk

- teknologisk

- Teknologier

- semester

- terraform

- afprøvet

- at

- Linjen

- deres

- Them

- derfor

- Disse

- de

- denne

- dem

- Gennem

- hele

- stramt

- tid

- til

- i dag

- også

- værktøjer

- top

- Emner

- mod

- Trace

- Sporing

- Kurser

- Tendenser

- to

- forståelse

- union

- enestående

- låse

- up-to-date

- opdateret

- opgraderet

- URL

- Brug

- brug

- brug tilfælde

- anvendte

- brugervenlig

- brugere

- ved brug af

- valideret

- validering

- værdi

- Værdiskabelse

- udgave

- undersøgt

- via

- Specifikation

- Virtual

- Besøg

- mængder

- var

- Vej..

- we

- web

- webservices

- GODT

- var

- hvornår

- når

- ud fra følgende betragtninger

- som

- mens

- vilje

- med

- inden for

- uden

- Arbejde

- arbejdede

- workflow

- arbejdsgange

- arbejder

- virker

- world

- Verdens

- verdensplan

- bekymre sig

- ville

- år

- Din

- zephyrnet

- zoner