Amazon SageMaker har annoncerede understøttelsen af tre nye gennemførelseskriterier for Amazon SageMaker automatisk model tuning, hvilket giver dig et ekstra sæt håndtag til at kontrollere stopkriterierne for tuning-jobbet, når du finder den bedste hyperparameterkonfiguration til din model.

I dette indlæg diskuterer vi disse nye gennemførelseskriterier, hvornår de skal bruges, og nogle af de fordele, de medfører.

SageMaker automatisk model tuning

Automatisk modeltuning, også kaldet justering af hyperparameter, finder den bedste version af en model målt ved den metrik, vi vælger. Det opretter mange træningsjob på det leverede datasæt ved hjælp af den valgte algoritme og de specificerede hyperparametre. Hvert træningsjob kan afsluttes tidligt, når den objektive metrik ikke forbedres væsentligt, hvilket er kendt som tidlig stop.

Indtil nu var der begrænsede måder at kontrollere det overordnede tuningjob på, såsom at angive det maksimale antal træningsjob. Valget af denne parameterværdi er dog i bedste fald heuristisk. En større værdi øger tuning-omkostningerne, og en mindre værdi giver muligvis ikke den bedste version af modellen til enhver tid.

SageMaker automatisk model tuning løser disse udfordringer ved at give dig flere færdiggørelseskriterier for tuning jobbet. Det anvendes på tuning-niveauet snarere end på hvert enkelt træningsjobniveau, hvilket betyder, at det fungerer på et højere abstraktionslag.

Fordele ved at justere jobafslutningskriterier

Med bedre kontrol over, hvornår tuning-jobbet stopper, får du fordelen af omkostningsbesparelser ved ikke at have jobbet kørt i længere perioder og være beregningsmæssigt dyrt. Det betyder også, at du kan sikre, at jobbet ikke stopper for tidligt, og at du får en model af tilstrækkelig god kvalitet, der opfylder dine mål. Du kan vælge at stoppe tuning-jobbet, når modellerne ikke længere forbedres efter et sæt iterationer, eller når den estimerede resterende forbedring ikke retfærdiggør beregningsressourcerne og -tiden.

Ud over det eksisterende maksimale antal uddannelsesjobafslutningskriterier Max Antal Træningsjobs, automatisk modeltuning introducerer muligheden for at stoppe tuning baseret på en maksimal tuningtid, forbedringsovervågning og konvergensdetektion.

Lad os undersøge hvert af disse kriterier.

Maksimal tuning tid

Tidligere havde du mulighed for at definere et maksimalt antal træningsjob som en ressourcegrænseindstilling for at styre tuning-budgettet med hensyn til beregningsressource. Dette kan dog føre til unødvendigt længere eller kortere træningstider end nødvendigt eller ønsket.

Med tilføjelsen af kriterierne for maksimal tuningstid kan du nu allokere dit træningsbudget i form af tid til at køre tuning-jobbet og automatisk afslutte jobbet efter en specificeret tidsperiode defineret i sekunder.

Som det ses ovenfor, bruger vi MaxRuntimeInSeconds for at definere indstillingstiden i sekunder. Indstilling af tuning-tidsgrænsen hjælper dig med at begrænse varigheden af tuning-jobbet og også de forventede omkostninger ved eksperimentet.

De samlede omkostninger før enhver kontraktlig rabat kan estimeres med følgende formel:EstimatedComputeSeconds= MaxRuntimeInSeconds * MaxParallelTrainingJobs * InstanceCost

Den maksimale kørselstid i sekunder kan bruges til at binde omkostninger og kørselstid. Med andre ord er det et budgetkontrolgennemførelseskriterie.

Denne funktion er en del af et ressourcekontrolkriterie og tager ikke højde for modellernes konvergens. Som vi ser senere i dette indlæg, kan dette kriterium bruges i kombination med andre stopkriterier for at opnå omkostningskontrol uden at ofre nøjagtigheden.

Ønsket målværdi

Et andet tidligere indført kriterium er at definere det målrettede mål på forhånd. Kriterierne overvåger ydeevnen af den bedste model baseret på en specifik objektiv metrik og stopper tuning, når modellerne når den definerede tærskel i forhold til en specificeret objektiv metrik.

Med TargetObjectiveMetricValue kriterier, kan vi instruere SageMaker om at stoppe med at tune modellen, efter at den objektive metrik for den bedste model har nået den angivne værdi:

I dette eksempel bliver vi bedt SageMaker om at stoppe med at tune modellen, når den objektive metrik for den bedste model har nået 0.95.

Denne metode er nyttig, når du har et specifikt mål, som du vil have din model til at nå, såsom et vist niveau af nøjagtighed, præcision, genkaldelse, F1-score, AUC, log-tab og så videre.

Et typisk use case for dette kriterium ville være for en bruger, der allerede er bekendt med modellens ydeevne ved givne tærskler. En bruger i udforskningsfasen kan først tune modellen med en lille delmængde af et større datasæt for at identificere en tilfredsstillende evalueringsmetrisk tærskel, der skal målrettes, når man træner med det fulde datasæt.

Forbedringsovervågning

Dette kriterium overvåger modellernes konvergens efter hver iteration og stopper justeringen, hvis modellerne ikke forbedres efter et defineret antal træningsjob. Se følgende konfiguration:

I dette tilfælde indstiller vi MaxNumberOfTrainingJobsNotImproving til 10, hvilket betyder, at hvis den objektive metrik holder op med at forbedres efter 10 træningsjob, stoppes justeringen, og den bedste model og metrik rapporteres.

Forbedringsovervågning bør bruges til at tune en afvejning mellem modelkvalitet og overordnet arbejdsgangsvarighed på en måde, der sandsynligvis kan overføres mellem forskellige optimeringsproblemer.

Konvergensdetektion

Konvergensdetektion er et færdiggørelseskriterie, der lader automatisk modeljustering bestemme, hvornår tuning skal stoppes. Generelt vil automatisk modeltuning stoppe med at tune, når den vurderer, at der ikke kan opnås nogen væsentlig forbedring. Se følgende konfiguration:

Kriterierne er bedst egnede, når du i første omgang ikke ved, hvilke stopindstillinger du skal vælge.

Det er også nyttigt, hvis du ikke ved, hvilken målmålsmetrik, der er rimelig for en god forudsigelse i betragtning af problemet og datasættet i hånden, og hellere vil have tuning-jobbet færdigt, når det ikke længere forbedres.

Eksperimenter med en sammenligning af gennemførelseskriterier

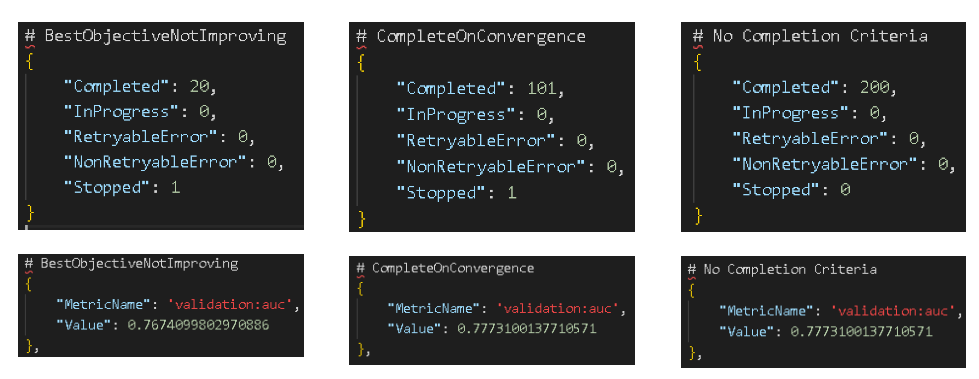

I dette eksperiment, givet en regressionsopgave, kører vi 3 tuning-eksperimenter for at finde den optimale model inden for et søgeområde på 2 hyperparametre med i alt 200 hyperparameterkonfigurationer ved hjælp af direkte marketing datasæt.

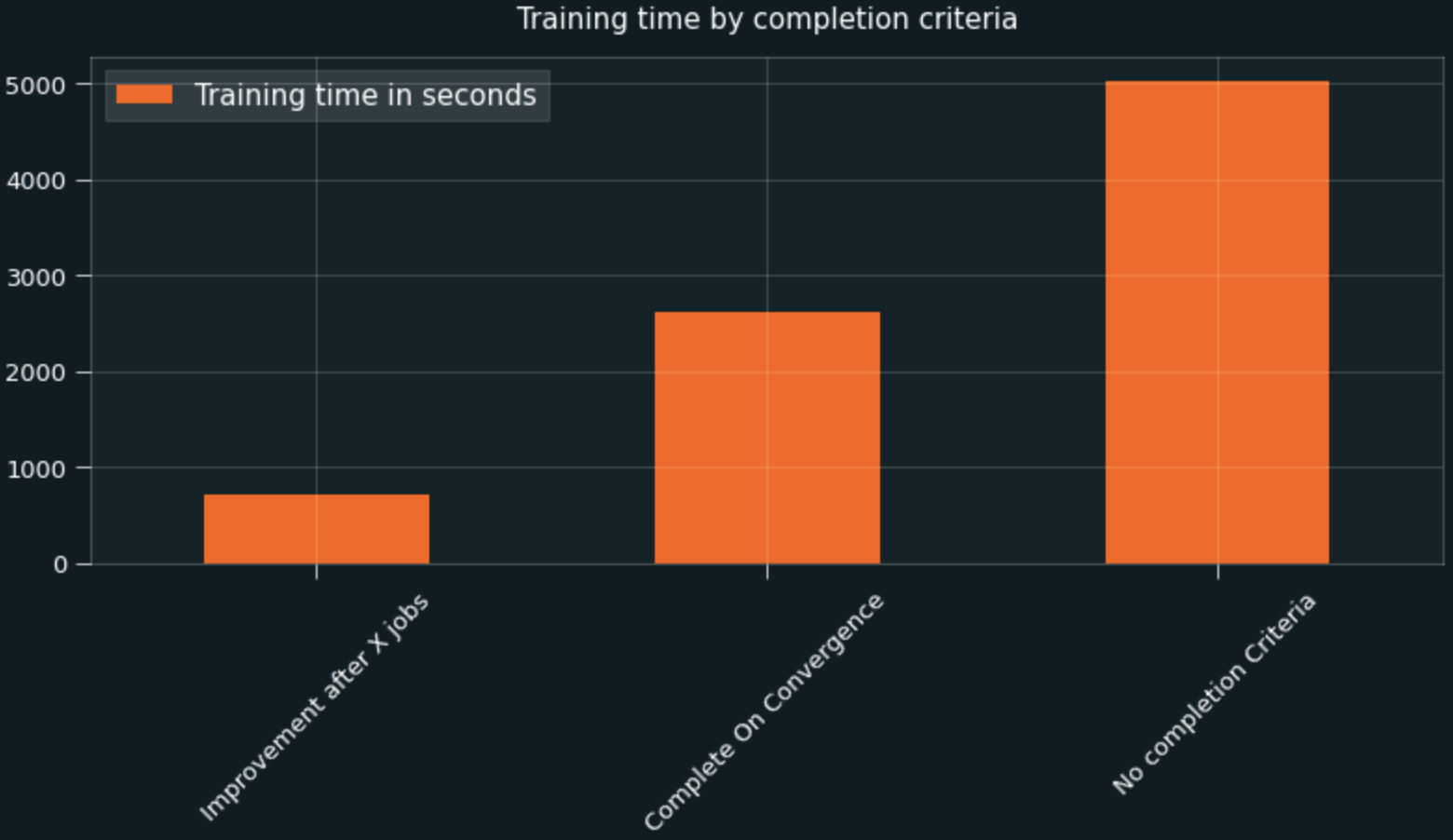

Med alt andet lige blev den første model tunet med BestObjectiveNotImproving færdiggørelseskriterier, den anden model blev tunet med CompleteOnConvergence og den tredje model blev tunet uden definerede færdiggørelseskriterier.

Når vi beskriver hvert job, kan vi observere, at indstillingen BestObjectiveNotImproving kriterier har ført til den mest optimale ressource og tid i forhold til den objektive metrik med væsentligt færre løb.

CompleteOnConvergence kriterier var også i stand til at stoppe med at tune halvvejs gennem eksperimentet, hvilket resulterede i færre træningsjob og kortere træningstid sammenlignet med ikke at sætte et kriterium.

Selvom der ikke blev fastsat et afslutningskriterie, resulterede det i et dyrt eksperiment, men definitionen af MaxRuntimeInSeconds som en del af ressourcegrænsen ville være en måde at minimere omkostningerne på.

Resultaterne ovenfor viser, at når Amazon SageMaker definerer et færdiggørelseskriterie, er Amazon SageMaker i stand til intelligent at stoppe tuning-processen, når den opdager, at modellen er mindre tilbøjelig til at forbedre sig ud over det aktuelle resultat.

Bemærk, at de færdiggørelseskriterier, der understøttes i SageMaker automatiske modelindstilling, ikke udelukker hinanden og kan bruges samtidigt, når en model indstilles.

Når mere end ét færdiggørelseskriterie er defineret, fuldføres tuning-jobbet, når et af kriterierne er opfyldt.

For eksempel kan en kombination af et ressourcebegrænsningskriterie som maksimal tuningtid med et konvergenskriterie, såsom forbedringsovervågning eller konvergensdetektion, producere en optimal omkostningskontrol og en optimal objektiv metrik.

Konklusion

I dette indlæg diskuterede vi, hvordan du nu intelligent kan stoppe dit tuning-job ved at vælge et sæt færdiggørelseskriterier, der for nylig er introduceret i SageMaker, såsom maksimal tuning-tid, forbedringsovervågning eller konvergensdetektion.

Vi demonstrerede med et eksperiment, at intelligent stop baseret på forbedringsobservation på tværs af iteration kan føre til et væsentligt optimeret budget og tidsstyring sammenlignet med ikke at definere et færdiggørelseskriterie.

Vi viste også, at disse kriterier ikke udelukker hinanden og kan bruges samtidigt, når man tuner en model, for at drage fordel af både budgetkontrol og optimal konvergens.

For flere detaljer om, hvordan du konfigurerer og kører automatisk modelindstilling, se Angiv indstillingerne for tuning af hyperparametre.

Om forfatterne

Doug Mbaya er en Senior Partner Solution arkitekt med fokus på data og analyse. Doug arbejder tæt sammen med AWS-partnere og hjælper dem med at integrere data- og analyseløsninger i skyen.

Doug Mbaya er en Senior Partner Solution arkitekt med fokus på data og analyse. Doug arbejder tæt sammen med AWS-partnere og hjælper dem med at integrere data- og analyseløsninger i skyen.

Chaitra Mathur er Principal Solutions Architect hos AWS. Hun guider kunder og partnere i at bygge meget skalerbare, pålidelige, sikre og omkostningseffektive løsninger på AWS. Hun brænder for Machine Learning og hjælper kunder med at omsætte deres ML-behov til løsninger ved hjælp af AWS AI/ML-tjenester. Hun har 5 certificeringer inklusive ML Specialty certificeringen. I sin fritid nyder hun at læse, yoga og bruge tid sammen med sine døtre.

Chaitra Mathur er Principal Solutions Architect hos AWS. Hun guider kunder og partnere i at bygge meget skalerbare, pålidelige, sikre og omkostningseffektive løsninger på AWS. Hun brænder for Machine Learning og hjælper kunder med at omsætte deres ML-behov til løsninger ved hjælp af AWS AI/ML-tjenester. Hun har 5 certificeringer inklusive ML Specialty certificeringen. I sin fritid nyder hun at læse, yoga og bruge tid sammen med sine døtre.

Iaroslav Shcherbatyi er Machine Learning Engineer hos AWS. Han arbejder hovedsageligt på forbedringer af Amazon SageMaker-platformen og hjælper kunder med at bruge dens funktioner bedst muligt. I sin fritid kan han godt lide at gå i fitnesscenter, dyrke udendørs sport som skøjteløb eller vandreture og at indhente ny AI-forskning.

Iaroslav Shcherbatyi er Machine Learning Engineer hos AWS. Han arbejder hovedsageligt på forbedringer af Amazon SageMaker-platformen og hjælper kunder med at bruge dens funktioner bedst muligt. I sin fritid kan han godt lide at gå i fitnesscenter, dyrke udendørs sport som skøjteløb eller vandreture og at indhente ny AI-forskning.

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- Platoblokkæde. Web3 Metaverse Intelligence. Viden forstærket. Adgang her.

- Kilde: https://aws.amazon.com/blogs/machine-learning/amazon-sagemaker-automatic-model-tuning-now-supports-three-new-completion-criteria-for-hyperparameter-optimization/

- 10

- 100

- 11

- 7

- 9

- a

- I stand

- Om

- over

- Konto

- nøjagtighed

- opnå

- opnået

- tværs

- Desuden

- Yderligere

- Fordel

- Efter

- AI

- ai forskning

- AI / ML

- algoritme

- Alle

- allerede

- Amazon

- Amazon SageMaker

- beløb

- analytics

- ,

- anvendt

- Automatisk Ur

- automatisk

- AWS

- baseret

- før

- være

- gavner det dig

- fordele

- BEDSTE

- Bedre

- mellem

- Beyond

- Bound

- bringe

- budget

- Bygning

- kaldet

- tilfælde

- brydning

- vis

- Certificering

- certificeringer

- udfordringer

- Vælg

- valgt

- nøje

- Cloud

- kombination

- sammenlignet

- sammenligning

- fuldføre

- Afsluttet

- Fuldender

- færdiggørelse

- Compute

- Konfiguration

- kontrol

- Konvergens

- Koste

- omkostningsbesparelser

- omkostningseffektiv

- Omkostninger

- kunne

- kriterier

- Nuværende

- Kunder

- data

- definerede

- definere

- demonstreret

- ønskes

- detaljer

- Detektion

- forskellige

- Rabat

- diskutere

- drøftet

- Er ikke

- Dont

- hver

- Tidligt

- aktiveret

- ingeniør

- sikre

- anslået

- skøn

- evaluering

- at alt

- eksempel

- Eksklusiv

- eksisterende

- dyrt

- eksperiment

- udforskning

- udforske

- bekendt

- Feature

- Funktionalitet

- Finde

- finde

- fund

- Fornavn

- Fokus

- efter

- Formula

- fuld

- generelt

- få

- given

- Give

- Go

- mål

- godt

- Guides

- gym

- have

- hjælpe

- hjælper

- højere

- stærkt

- besidder

- Hvordan

- How To

- Men

- HTML

- HTTPS

- Hyperparameter optimering

- Tuning af hyperparameter

- ICE

- identificere

- Forbedre

- forbedringer

- forbedring

- in

- I andre

- Herunder

- Stigninger

- individuel

- i første omgang

- integrere

- Intelligent

- introduceret

- Introducerer

- IT

- iteration

- iterationer

- Job

- Karriere

- Kend

- kendt

- større

- lag

- føre

- læring

- Led

- Lets

- Niveau

- Sandsynlig

- GRÆNSE

- Limited

- længere

- maskine

- machine learning

- ledelse

- mange

- Marketing

- max

- Maksimer

- maksimal

- midler

- opfylder

- metode

- metrisk

- Metrics

- minimering

- ML

- model

- modeller

- overvågning

- skærme

- mere

- mest

- flere

- gensidigt

- behov

- Ny

- nummer

- objektiv

- målsætninger

- observere

- ONE

- opererer

- optimal

- optimering

- optimeret

- Option

- Andet

- samlet

- parameter

- del

- partner

- partnere

- lidenskabelige

- ydeevne

- perioder

- fase

- perron

- plato

- Platon Data Intelligence

- PlatoData

- Indlæg

- Precision

- forudsigelse

- tidligere

- Main

- Problem

- problemer

- behandle

- producere

- fremskrevet

- forudsat

- leverer

- kvalitet

- nå

- nået

- Læsning

- rimelige

- relation

- pålidelig

- rapporteret

- forskning

- ressource

- Ressourcer

- resultere

- resulterer

- Resultater

- Kør

- at ofre

- sagemaker

- SageMaker Automatisk Model Tuning

- Besparelser

- skalerbar

- Søg

- Anden

- sekunder

- sikker

- udvælgelse

- valg

- senior

- Tjenester

- sæt

- indstilling

- indstillinger

- bør

- Vis

- signifikant

- betydeligt

- lille

- mindre

- So

- løsninger

- Løsninger

- Løser

- nogle

- Space

- Specialty

- specifikke

- specificeret

- udgifterne

- spins

- Sport

- Stands

- stoppet

- standsning

- stopper

- sådan

- support

- Understøttet

- Understøtter

- Tag

- mål

- Opgaver

- vilkår

- deres

- Tredje

- tre

- tærskel

- Gennem

- tid

- gange

- til

- også

- I alt

- Kurser

- Oversætte

- typisk

- brug

- brug tilfælde

- Bruger

- validering

- værdi

- udgave

- måder

- Hvad

- som

- WHO

- vilje

- inden for

- uden

- ord

- virker

- ville

- Udbytte

- Yoga

- Du

- Din

- zephyrnet