Generativ kunstig intelligens (AI)-applikationer bygget op omkring store sprogmodeller (LLM'er) har vist potentialet til at skabe og accelerere økonomisk værdi for virksomheder. Eksempler på applikationer omfatter samtalesøgning, kundesupportagent assistance, kundesupportanalyse, selvbetjente virtuelle assistenter, chatbots, rich media generation, indhold moderering, kodende ledsagere for at fremskynde sikker, højtydende softwareudvikling, dybere indsigt fra multimodale indholdskilder, acceleration af din organisations sikkerhedsundersøgelser og begrænsninger, og meget mere. Mange kunder leder efter vejledning i, hvordan man administrerer sikkerhed, privatliv og overholdelse, når de udvikler generative AI-applikationer. Forståelse og håndtering af LLM-sårbarheder, trusler og risici i design- og arkitekturfaserne hjælper teams med at fokusere på at maksimere de økonomiske og produktivitetsfordele, generativ AI kan give. At være opmærksom på risici fremmer gennemsigtighed og tillid til generative AI-applikationer, tilskynder til øget observerbarhed, hjælper med at opfylde overholdelseskrav og letter informeret beslutningstagning for ledere.

Målet med dette indlæg er at give AI og machine learning (ML) ingeniører, dataforskere, løsningsarkitekter, sikkerhedsteams og andre interessenter mulighed for at have en fælles mental model og ramme til at anvende bedste sikkerhedspraksis, så AI/ML-teams kan bevæge sig hurtigt uden at bytte sikkerhed for hastighed. Specifikt søger dette indlæg at hjælpe AI/ML og dataforskere, som måske ikke tidligere har været udsat for sikkerhedsprincipper, med at få en forståelse af kernesikkerhed og bedste praksis for privatliv i forbindelse med udvikling af generative AI-applikationer ved hjælp af LLM'er. Vi diskuterer også almindelige sikkerhedsproblemer, der kan underminere tilliden til AI, som identificeret af Åbn Worldwide Application Security Project (OWASP) Top 10 for LLM-applikationer, og vis måder, du kan bruge AWS til at øge din sikkerhedsstilling og selvtillid, mens du innoverer med generativ AI.

Dette indlæg giver tre guidede trin til at udforme risikostyringsstrategier, mens du udvikler generative AI-applikationer ved hjælp af LLM'er. Vi dykker først ned i de sårbarheder, trusler og risici, der opstår ved implementering, implementering og brug af LLM-løsninger, og giver vejledning i, hvordan man begynder at innovere med sikkerhed i tankerne. Vi diskuterer derefter, hvordan det at bygge på et sikkert fundament er afgørende for generativ AI. Til sidst forbinder vi disse med et eksempel på LLM-arbejdsbelastning for at beskrive en tilgang til arkitektur med dybdegående forsvar på tværs af tillidsgrænser.

Ved slutningen af dette indlæg, AI/ML-ingeniører, datavidenskabsmænd og sikkerhedsorienterede teknologer vil være i stand til at identificere strategier til at opbygge lagdelte forsvar for deres generative AI-applikationer, forstå, hvordan man kortlægger OWASP Top 10 for LLMs sikkerhedsproblemer til nogle tilsvarende kontroller og opbygger grundlæggende viden mod besvare følgende top AWS-kundespørgsmålstemaer til deres applikationer:

- Hvad er nogle af de almindelige sikkerheds- og privatlivsrisici ved brug af generativ AI baseret på LLM'er i mine applikationer, som jeg kan påvirke mest med denne vejledning?

- Hvad er nogle måder at implementere sikkerheds- og privatlivskontrol i udviklingslivscyklussen for generative AI LLM-applikationer på AWS?

- Hvilke operationelle og tekniske bedste praksisser kan jeg integrere i, hvordan min organisation opbygger generative AI LLM-applikationer for at styre risici og øge tilliden til generative AI-applikationer, der bruger LLM'er?

Forbedre sikkerhedsresultater, mens du udvikler generativ AI

Innovation med generativ kunstig intelligens ved brug af LLM'er kræver at starte med sikkerhed i tankerne for at udvikle organisatorisk modstandskraft, bygge på et sikkert fundament og integrere sikkerhed med en dybdegående sikkerhedstilgang. Sikkerhed er en fælles ansvar mellem AWS og AWS kunder. Alle principperne i AWS Shared Responsibility Model gælder for generative AI-løsninger. Opfrisk din forståelse af AWS Shared Responsibility Model, som den gælder for infrastruktur, tjenester og data, når du bygger LLM-løsninger.

Start med sikkerhed i tankerne for at udvikle organisatorisk robusthed

Start med sikkerhed i tankerne for at udvikle organisatorisk modstandsdygtighed til at udvikle generative AI-applikationer, der opfylder dine sikkerheds- og overholdelsesmål. Organisatorisk robusthed trækker på og udvider definition af resiliens i AWS Well-Architected Framework at inkludere og forberede en organisations evne til at komme sig efter forstyrrelser. Overvej din sikkerhedsposition, styring og operationelle ekspertise, når du vurderer den overordnede parathed til at udvikle generativ AI med LLM'er og din organisatoriske modstandsdygtighed over for eventuelle potentielle påvirkninger. Efterhånden som din organisation fremmer sin brug af nye teknologier såsom generativ AI og LLM'er, bør den overordnede organisatoriske modstandsdygtighed betragtes som en hjørnesten i en lagdelt defensiv strategi for at beskytte aktiver og forretningsområder mod utilsigtede konsekvenser.

Organisatorisk robusthed betyder væsentligt for LLM-applikationer

Selvom alle risikostyringsprogrammer kan drage fordel af modstandsdygtighed, er organisatorisk robusthed væsentligt for generativ AI. Fem af de OWASP-identificerede top 10-risici for LLM-applikationer er afhængige af at definere arkitektoniske og operationelle kontroller og håndhæve dem i en organisatorisk skala for at håndtere risici. Disse fem risici er usikker outputhåndtering, forsyningskædesårbarheder, offentliggørelse af følsomme oplysninger, overdreven handlefrihed og overdreven tillid. Begynd at øge den organisatoriske modstandskraft ved at socialisere dine teams for at betragte AI, ML og generativ AI-sikkerhed som et kerneforretningskrav og topprioritet gennem hele produktets livscyklus, fra idéstart til forskning, til applikationens udvikling, implementering og brug. Ud over bevidsthed bør dine teams tage skridt til at tage højde for generativ AI i styrings-, forsikrings- og overholdelsesvalideringspraksis.

Byg organisatorisk robusthed omkring generativ AI

Organisationer kan begynde at vedtage måder at opbygge deres kapacitet og muligheder for AI/ML og generativ AI-sikkerhed i deres organisationer. Du bør begynde med at udvide dine eksisterende sikkerheds-, forsikrings-, compliance- og udviklingsprogrammer til at tage højde for generativ AI.

Følgende er de fem nøgleområder af interesse for organisatorisk AI, ML og generativ AI-sikkerhed:

- Forstå AI/ML-sikkerhedslandskabet

- Inkluder forskellige perspektiver i sikkerhedsstrategier

- Tag handling proaktivt for at sikre forsknings- og udviklingsaktiviteter

- Afstem incitamenter med organisatoriske resultater

- Forbered dig på realistiske sikkerhedsscenarier i AI/ML og generativ AI

Udvikl en trusselsmodel gennem hele din generative AI-livscyklus

Organisationer, der bygger med generativ AI, bør fokusere på risikostyring, ikke risikoeliminering, og inkludere trusselsmodellering i og planlægning af forretningskontinuitet planlægning, udvikling og drift af generative AI-arbejdsbelastninger. Arbejd baglæns fra produktionsbrug af generativ AI ved at udvikle en trusselmodel for hver applikation ved hjælp af traditionelle sikkerhedsrisici såvel som generative AI-specifikke risici. Nogle risici kan være acceptable for din virksomhed, og en trusselsmodelleringsøvelse kan hjælpe din virksomhed med at identificere, hvad din acceptable risikovillighed er. For eksempel kræver din virksomhed muligvis ikke 99.999 % oppetid på en generativ AI-applikation, så den ekstra restitutionstid, der er forbundet med gendannelse vha. AWS backup med Amazon S3 Glacier kan være en acceptabel risiko. Omvendt kan dataene i din model være ekstremt følsomme og stærkt regulerede, så afvigelse fra AWS Key Management Service (AWS KMS) kundestyret nøgle (CMK) rotation og brug af AWS netværksfirewall at hjælpe med at håndhæve Transport Layer Security (TLS) for ind- og udgående trafik for at beskytte mod dataeksfiltrering kan være en uacceptabel risiko.

Evaluer risiciene (iboende versus resterende) ved at bruge den generative AI-applikation i en produktionsindstilling for at identificere de rigtige grundlæggende og applikationsniveaukontroller. Planlæg tilbagerulning og retablering fra produktionssikkerhedshændelser og serviceafbrydelser såsom hurtig injektion, træningsdataforgiftning, modeldenial of service og modeltyveri tidligt, og definer de afhjælpninger, du vil bruge, når du definerer applikationskrav. At lære om de risici og kontroller, der skal på plads, vil hjælpe med at definere den bedste implementeringstilgang til at bygge en generativ AI-applikation og give interessenter og beslutningstagere information til at træffe informerede forretningsbeslutninger om risiko. Hvis du ikke er bekendt med den overordnede AI- og ML-arbejdsgang, så start med at gennemgå 7 måder at forbedre sikkerheden for dine maskinlæringsopgaver at øge kendskabet til de sikkerhedskontroller, der er nødvendige for traditionelle AI/ML-systemer.

Ligesom at bygge en hvilken som helst ML-applikation, indebærer opbygning af en generativ AI-applikation at gennemgå et sæt forsknings- og udviklingsfaser. Du kan eventuelt gennemgå AWS Generative AI Security Scoping Matrix at hjælpe med at opbygge en mental model for at forstå de vigtigste sikkerhedsdiscipliner, som du bør overveje, afhængigt af hvilken generativ AI-løsning du vælger.

Generative AI-applikationer, der bruger LLM'er, udvikles og betjenes typisk efter bestilte trin:

- Ansøgningskrav – Identificer use case forretningsmål, krav og succeskriterier

- Modelvalg – Vælg en fundamentmodel, der stemmer overens med kravene til use case

- Modeltilpasning og finjustering – Forbered data, konstruer prompter, og finjuster modellen

- Modelvurdering – Evaluer grundlagsmodeller med brug af case-specifikke metrics og vælg den bedst ydende model

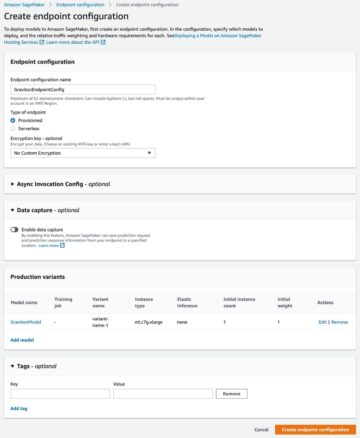

- Implementering og integration – Implementer den valgte fundamentmodel på din optimerede infrastruktur og integrer med din generative AI-applikation

- Applikationsovervågning – Overvåg applikations- og modelydeevne for at muliggøre rodårsagsanalyse

Sørg for, at teams forstår den kritiske karakter af sikkerhed som en del af design- og arkitekturfaserne af din softwareudviklings livscyklus på dag 1. Det betyder, at du skal diskutere sikkerhed på hvert lag af din stak og livscyklus og placere sikkerhed og privatliv som redskaber til at nå forretningsmål. Arkitekt kontrollerer for trusler, før du starter din LLM-applikation, og overvej, om de data og oplysninger, du vil bruge til modeltilpasning og finjustering, berettiger til at kontrollere implementeringen i forsknings-, udviklings- og træningsmiljøerne. Som en del af kvalitetssikringstests skal du introducere syntetiske sikkerhedstrusler (såsom forsøg på at forgifte træningsdata eller forsøg på at udtrække følsomme data gennem ondsindet prompt engineering) for at teste dit forsvar og din sikkerhedsstilling med jævne mellemrum.

Derudover bør interessenter etablere en konsekvent gennemgangskadence for produktions-AI, ML og generative AI-arbejdsbelastninger og sætte organisatorisk prioritet på at forstå afvejninger mellem menneskelig og maskinel kontrol og fejl før lancering. Validering og sikring af, at disse afvejninger respekteres i de implementerede LLM-applikationer, vil øge sandsynligheden for succes med risikoreduktion.

Byg generative AI-applikationer på sikre cloud-fundamenter

Hos AWS er sikkerhed vores topprioritet. AWS er designet til at være den mest sikre globale cloud-infrastruktur, hvorpå man kan bygge, migrere og administrere applikationer og arbejdsbelastninger. Dette understøttes af vores dybe sæt af over 300 cloud-sikkerhedsværktøjer og tilliden fra vores millioner af kunder, inklusive de mest sikkerhedsfølsomme organisationer som regering, sundhedspleje og finansielle tjenester. Når du bygger generative AI-applikationer ved hjælp af LLM'er på AWS, opnår du sikkerhedsfordele fra sikkert, pålideligt og fleksibelt AWS Cloud computing-miljø.

Brug en global AWS-infrastruktur til sikkerhed, privatliv og overholdelse

Når du udvikler dataintensive applikationer på AWS, kan du drage fordel af en global AWS-regionsinfrastruktur, der er designet til at levere funktioner til at opfylde dine kernekrav til sikkerhed og overholdelse. Dette forstærkes af vores AWS Digital Suverænitetsløfte, vores forpligtelse til at tilbyde dig det mest avancerede sæt suverænitetskontroller og funktioner, der er tilgængelige i skyen. Vi er forpligtet til at udvide vores muligheder for at give dig mulighed for at opfylde dine digital suverænitet behov, uden at gå på kompromis med ydeevnen, innovationen, sikkerheden eller omfanget af AWS Cloud. For at forenkle implementeringen af bedste praksis for sikkerhed og privatliv bør du overveje at bruge referencedesign og infrastruktur som koderessourcer, f.eks. AWS Security Reference Architecture (AWS SRA) og AWS Privacy Reference Architecture (AWS PRA). Læs mere om udforme privatlivsløsninger, suverænitet ved designog overholdelse af AWS og bruge tjenester som f.eks AWS-konfig, AWS artefaktog AWS revisionschef for at understøtte dine behov for privatliv, overholdelse, revision og observerbarhed.

Forstå din sikkerhedsposition ved hjælp af AWS Well-Architected og Cloud Adoption Frameworks

AWS tilbyder best practice-vejledning udviklet af mange års erfaring med at støtte kunder i at udforme deres cloud-miljøer med AWS velstruktureret rammeværk og i at udvikle sig til at realisere forretningsværdi fra cloud-teknologier med AWS Cloud Adoption Framework (AWS CAF). Forstå sikkerhedspositionen for dine AI-, ML- og generative AI-arbejdsbelastninger ved at udføre en gennemgang af et godt architected Framework. Anmeldelser kan udføres ved hjælp af værktøjer som f.eks AWS velstruktureret værktøj, eller med hjælp fra dit AWS-team igennem AWS Enterprise Support. AWS velbyggede værktøj integrerer automatisk indsigt fra AWS Trusted Advisor at evaluere, hvilke best practices der er på plads, og hvilke muligheder der findes for at forbedre funktionalitet og omkostningsoptimering. AWS Well-Architected Tool tilbyder også skræddersyede linser med specifikke bedste praksisser såsom Machine Learning Lens for at du regelmæssigt kan måle dine arkitekturer i forhold til bedste praksis og identificere områder til forbedring. Tjek din rejse på vejen til værdirealisering og cloud-modenhed ved at forstå, hvordan AWS-kunder vedtager strategier for at udvikle organisatoriske evner i AWS Cloud Adoption Framework for Artificial Intelligence, Machine Learning og Generative AI. Du kan også finde fordele ved at forstå dit overordnede cloud-beredskab ved at deltage i en AWS Cloud Readiness Assessment. AWS tilbyder yderligere muligheder for engagement – spørg dit AWS-kontoteam for at få flere oplysninger om, hvordan du kommer i gang med Generativt AI Innovationscenter.

Fremskynd din sikkerhed og AI/ML-læring med vejledning, træning og certificering af bedste praksis

AWS kuraterer også anbefalinger fra Bedste praksis for sikkerhed, identitet og overholdelse , AWS sikkerhedsdokumentation for at hjælpe dig med at identificere måder at sikre dine trænings-, udviklings-, test- og driftsmiljøer på. Hvis du lige er startet, så dyk dybere ned i sikkerhedstræning og certificering, overvej at starte med AWS Security Fundamentals og AWS Sikkerhedslæringsplan. Du kan også bruge AWS Sikkerhedsmodenhedsmodel for at hjælpe dig med at finde og prioritere de bedste aktiviteter i forskellige faser af modenhed på AWS, startende med hurtige gevinster, gennem grundlæggende, effektive og optimerede stadier. Når du og dine teams har en grundlæggende forståelse af sikkerhed på AWS, anbefaler vi kraftigt at gennemgå Hvordan man griber trusselsmodellering an og derefter lede en trusselsmodelleringsøvelse med dine teams begyndende med Workshop for trusselsmodellering for bygherrer træningsprogram. Der er mange andre AWS sikkerhedstrænings- og certificeringsressourcer tilgængelige.

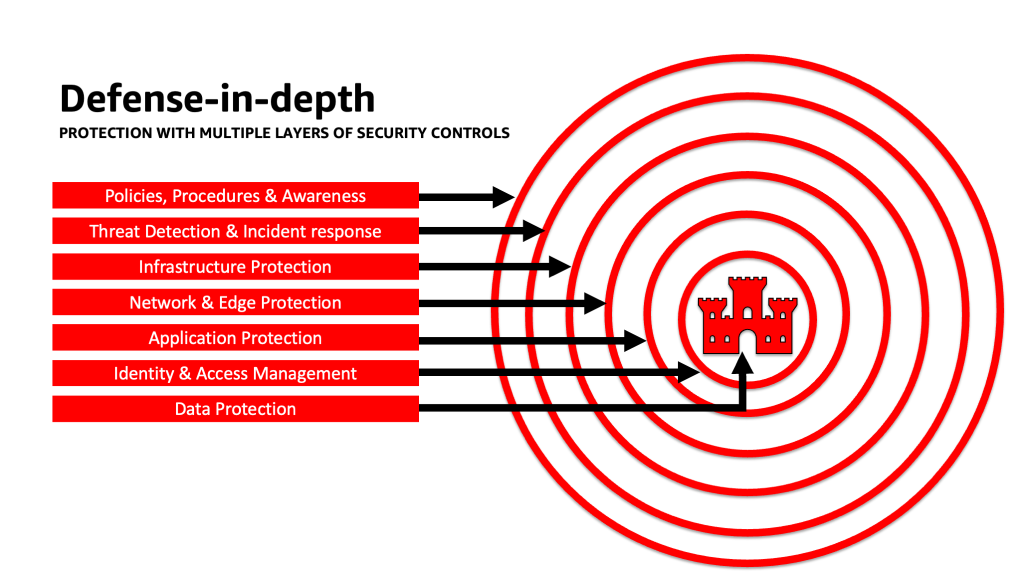

Anvend en dybdegående forsvarstilgang til at sikre LLM-applikationer

Anvendelse af en dybdegående forsvarstilgang til dine generative AI-arbejdsbelastninger, data og information kan hjælpe med at skabe de bedste betingelser for at nå dine forretningsmål. Defens-in-depth-sikkerhed bedste praksis afbøder mange af de almindelige risici, som enhver arbejdsbyrde står over for, og hjælper dig og dine teams med at accelerere din generative AI-innovation. En dybdegående sikkerhedsstrategi bruger flere redundante forsvar til at beskytte dine AWS-konti, arbejdsbelastninger, data og aktiver. Det hjælper med at sikre, at hvis en sikkerhedskontrol er kompromitteret eller fejler, findes der yderligere lag for at hjælpe med at isolere trusler og forhindre, detektere, reagere og gendanne sikkerhedshændelser. Du kan bruge en kombination af strategier, herunder AWS-tjenester og -løsninger, på hvert lag for at forbedre sikkerheden og modstandsdygtigheden af dine generative AI-arbejdsbelastninger.

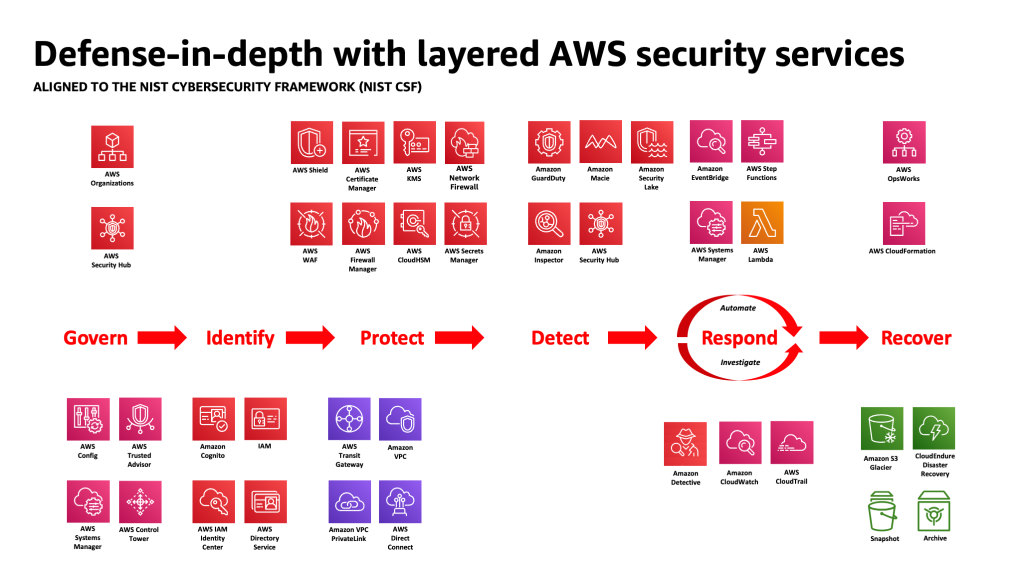

Mange AWS-kunder tilpasser sig industristandardrammer, såsom NIST Cybersecurity Framework. Denne ramme hjælper med at sikre, at dine sikkerhedsforsvar har beskyttelse på tværs af søjlerne Identify, Protect, Detect, Response, Recover og senest tilføjet, Govern. Denne ramme kan derefter nemt kortlægges til AWS Security-tjenester og dem fra integrerede tredjeparter, for at hjælpe dig med at validere tilstrækkelig dækning og politikker for enhver sikkerhedshændelse, din organisation støder på.

Forsvar i dybden: Sikre dit miljø, og tilføj derefter forbedrede AI/ML-specifikke sikkerheds- og privatlivsfunktioner

En dybtgående forsvarsstrategi bør starte med først at beskytte dine konti og organisation og derefter lægge lag på de ekstra indbyggede sikkerheds- og privatlivsforbedrede funktioner i tjenester som f.eks. Amazonas grundfjeld , Amazon SageMaker. Amazon har over 30 tjenester i sikkerheds-, identitets- og compliance-porteføljen som er integreret med AWS AI/ML-tjenester og kan bruges sammen til at hjælpe med at sikre dine arbejdsbelastninger, konti, organisation. For at forsvare sig korrekt mod OWASP Top 10 for LLM, bør disse bruges sammen med AWS AI/ML-tjenesterne.

Start med at implementere en politik med mindste privilegier ved at bruge tjenester som f.eks IAM Access Analyzer til se efter alt for tilladelige konti, roller og ressourcer for at begrænse adgangen ved hjælp af kortvarige legitimationsoplysninger. Dernæst skal du sikre dig, at alle data i hvile er krypteret med AWS KMS, herunder overvejer brugen af CMK'er, og alle data og modeller er versioneret og sikkerhedskopieret vha. Amazon Simple Storage Service (Amazon S3) versionering og anvendelse af uforanderlighed på objektniveau med Amazon S3 Objektlås. Beskyt alle data i transit mellem tjenester, der bruger AWS Certificate Manager og / eller AWS Private CA, og hold det inden for VPC'er ved hjælp af AWS PrivateLink. Definer strenge regler for dataindgang og -udgang for at hjælpe med at beskytte mod manipulation og eksfiltrering ved hjælp af VPC'er med AWS netværksfirewall politikker. Overvej at indsætte AWS Web Application Firewall (AWS WAF) foran til beskytte webapplikationer og API'er fra ondsindede bots, SQL-injektionsangreb, cross-site scripting (XSS), og kontoovertagelser med Bekæmpelse af svindel. Logning med AWS CloudTrail, Amazon Virtual Private Cloud (Amazon VPC) flowlogs, og Amazon Elastic Kubernetes Service (Amazon EKS) revisionslogfiler hjælper med at give retsmedicinsk gennemgang af hver transaktion, der er tilgængelig for tjenester som f.eks Amazon-detektiv. Du kan bruge Amazon inspektør at automatisere sårbarhedsopdagelse og -styring for Amazon Elastic Compute Cloud (Amazon EC2) instanser, containere, AWS Lambda funktioner, og identificere netværkets tilgængelighed for dine arbejdsbelastninger. Beskyt dine data og modeller mod mistænkelig aktivitet ved hjælp af Amazon Guard Dutys ML-drevne trusselsmodeller og efterretningsfeeds og aktiverer dets ekstra funktioner til EKS Protection, ECS Protection, S3 Protection, RDS Protection, Malware Protection, Lambda Protection og mere. Du kan bruge tjenester som f.eks AWS Security Hub at centralisere og automatisere dine sikkerhedstjek for at opdage afvigelser fra bedste sikkerhedspraksis og fremskynde efterforskning og automatisere udbedring af sikkerhedsfund med playbooks. Du kan også overveje at implementere en nul tillid arkitektur på AWS for yderligere at øge finkornede autentificerings- og autorisationskontroller for, hvad menneskelige brugere eller maskine-til-maskine-processer kan få adgang til efter anmodning. Overvej også at bruge Amazon Security Lake til automatisk at centralisere sikkerhedsdata fra AWS-miljøer, SaaS-udbydere, lokaler og cloud-kilder til en specialbygget datasø, der er gemt på din konto. Med Security Lake kan du få en mere komplet forståelse af dine sikkerhedsdata på tværs af hele din organisation.

Efter dit generative AI-arbejdsmiljø er blevet sikret, kan du lag på AI/ML-specifikke funktioner, som f.eks. Amazon SageMaker Data Wrangler at identificere potentiel bias under dataforberedelse og Amazon SageMaker Clarify at detektere bias i ML data og modeller. Du kan også bruge Amazon SageMaker Model Monitor at evaluere kvaliteten af SageMaker ML-modeller i produktionen og give dig besked, når der er afvigelse i datakvalitet, modelkvalitet og funktionstilskrivning. Disse AWS AI/ML-tjenester, der arbejder sammen (herunder SageMaker, der arbejder med Amazon Bedrock) med AWS Security-tjenester kan hjælpe dig med at identificere potentielle kilder til naturlig bias og beskytte mod ondsindet datamanipulation. Gentag denne proces for hver af OWASP Top 10 for LLM sårbarheder for at sikre, at du maksimerer værdien af AWS-tjenester for at implementere forsvar i dybden for at beskytte dine data og arbejdsbelastninger.

Som AWS Enterprise Strategist Clarke Rodgers skrev i sit blogindlæg "CISO-indsigt: Hver AWS-tjeneste er en sikkerhedstjeneste", "Jeg vil påstå, at stort set alle tjenester i AWS-skyen enten muliggør et sikkerhedsresultat i sig selv eller kan bruges (alene eller sammen med en eller flere tjenester) af kunder for at opnå et sikkerheds-, risiko- eller compliance-mål." Og "Customer Chief Information Security Officers (CISO'er) (eller deres respektive teams) vil måske tage sig tid til at sikre, at de er velbevandret med alle AWS-tjenester, fordi der kan være et sikkerheds-, risiko- eller compliance-mål, der kan opfyldes, selvom en tjeneste ikke falder ind under kategorien 'Sikkerhed, identitet og overholdelse'."

Lag forsvar ved tillidsgrænser i LLM-applikationer

Når du udvikler generative AI-baserede systemer og applikationer, bør du overveje de samme bekymringer som med enhver anden ML-applikation, som nævnt i MITRE ATLAS Machine Learning Threat Matrix, såsom at være opmærksom på software- og datakomponentoprindelse (såsom at udføre en open source-softwarerevision, gennemgå softwarestyklister (SBOM'er) og analysere dataworkflows og API-integrationer) og implementere nødvendige beskyttelser mod LLM-forsyningskædetrusler. Inkluder indsigt fra industrirammer, og vær opmærksom på måder at bruge flere kilder til trusselsintelligens og risikoinformation til at justere og udvide dit sikkerhedsforsvar for at tage højde for AI, ML og generative AI-sikkerhedsrisici, der opstår og ikke er inkluderet i traditionelle rammer. Søg ledsagende information om AI-specifikke risici fra industri, forsvar, statslige, internationale og akademiske kilder, fordi nye trusler dukker op og udvikler sig i dette rum regelmæssigt, og ledsagende rammer og guider opdateres ofte. For eksempel, når du bruger en RAG-model (Retrieval Augmented Generation), hvis modellen ikke indeholder de data, den har brug for, kan den anmode om det fra en ekstern datakilde til brug under inferencing og finjustering. Kilden, som den forespørger på, kan være uden for din kontrol og kan være en potentiel kilde til kompromis i din forsyningskæde. En dybtgående forsvarstilgang bør udvides til eksterne kilder for at etablere tillid, autentificering, autorisation, adgang, sikkerhed, privatliv og nøjagtighed af de data, den får adgang til. For at dykke dybere, læs "Byg en sikker virksomhedsapplikation med Generative AI og RAG ved hjælp af Amazon SageMaker JumpStart"

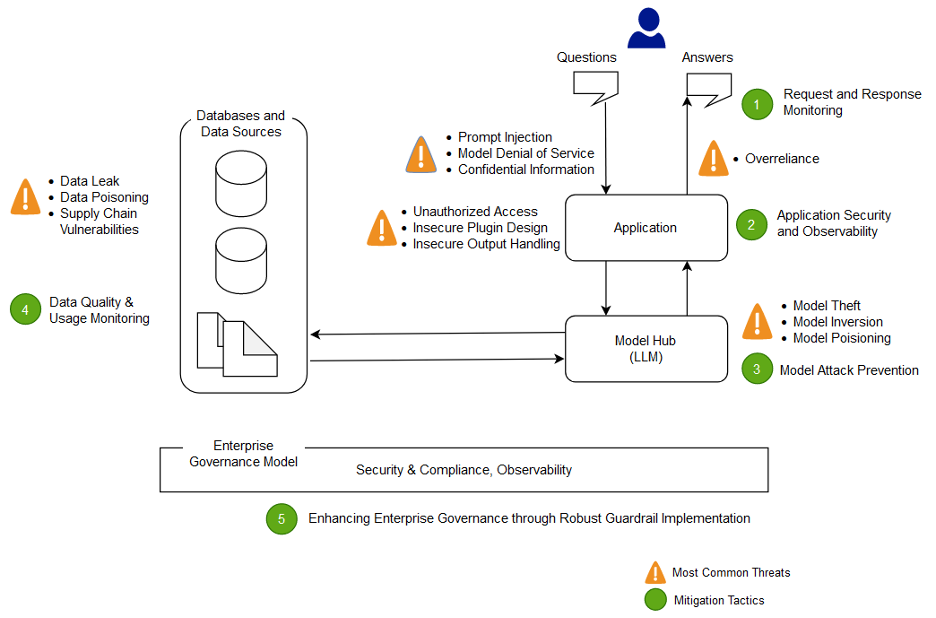

Analyser og dæmp risikoen i dine LLM-applikationer

I dette afsnit analyserer og diskuterer vi nogle risikoreduktionsteknikker baseret på tillidsgrænser og interaktioner eller særskilte områder af arbejdsbyrden med tilsvarende passende kontrolomfang og risikoprofil. I denne eksempelarkitektur af en chatbot-applikation er der fem tillidsgrænser, hvor kontroller demonstreres, baseret på hvordan AWS-kunder almindeligvis bygger deres LLM-applikationer. Din LLM-applikation kan have flere eller færre definerbare tillidsgrænser. I følgende eksempelarkitektur er disse tillidsgrænser defineret som:

- Brugergrænsefladeinteraktioner (anmodning og svar)

- Applikationsinteraktioner

- Model interaktioner

- Datainteraktioner

- Organisatorisk interaktion og brug

Brugergrænsefladeinteraktioner: Udvikle anmodnings- og responsovervågning

Detekter og reager på cyberhændelser relateret til generativ AI rettidigt ved at evaluere en strategi til at håndtere risici fra input og output fra den generative AI-applikation. For eksempel kan det være nødvendigt at bruge yderligere overvågning for adfærd og dataudstrømning til at detektere afsløring af følsomme oplysninger uden for dit domæne eller din organisation, i tilfælde af at det bruges i LLM-applikationen.

Generative AI-applikationer bør stadig opretholde standard sikkerhedspraksis, når det kommer til at beskytte data. Etabler en sikker dataperimeter , sikre følsomme data lagre. Krypter data og information, der bruges til LLM-applikationer i hvile og under transport. Beskyt data, der bruges til at træne din model mod at træne dataforgiftning ved at forstå og kontrollere, hvilke brugere, processer og roller der har tilladelse til at bidrage til datalagrene, samt hvordan datastrømme i applikationen, overvåge for bias afvigelser og bruge versionering og uforanderlig lagring i lagertjenester såsom Amazon S3. Etabler strenge dataind- og udgående kontrol ved hjælp af tjenester som AWS Network Firewall og AWS VPC'er for at beskytte mod mistænkelig input og potentialet for dataeksfiltrering.

Under træningen, genoptræningen eller finjusteringsprocessen skal du være opmærksom på eventuelle følsomme data, der bruges. Efter at data er blevet brugt under en af disse processer, bør du planlægge et scenarie, hvor enhver bruger af din model pludselig bliver i stand til at udtrække data eller information igen ved at bruge hurtige injektionsteknikker. Forstå risici og fordele ved at bruge følsomme data i dine modeller og konklusioner. Implementer robuste godkendelses- og autorisationsmekanismer til at etablere og administrere finkornede adgangstilladelser, som ikke er afhængige af LLM-applikationslogik for at forhindre offentliggørelse. Brugerkontrolleret input til en generativ AI-applikation er blevet demonstreret under nogle forhold at være i stand til at levere en vektor til at udtrække information fra modellen eller eventuelle ikke-brugerkontrollerede dele af inputtet. Dette kan ske via prompt-injektion, hvor brugeren giver input, der får modellens output til at afvige fra LLM-applikationens forventede autoværn, herunder at give ledetråde til de datasæt, som modellen oprindeligt blev trænet på.

Implementer adgangskvoter på brugerniveau for brugere, der leverer input og modtager output fra en model. Du bør overveje tilgange, der ikke tillader anonym adgang under forhold, hvor modeltræningsdata og -oplysninger er følsomme, eller hvor der er risiko fra en modstander, der træner en faksimile af din model baseret på deres input og dit tilpassede modeloutput. Generelt, hvis en del af inputtet til en model består af vilkårlig brugerleveret tekst, skal du overveje outputtet for at være modtageligt for hurtig indsprøjtning, og i overensstemmelse hermed sikre, at brugen af outputtet inkluderer implementerede tekniske og organisatoriske modforanstaltninger for at afbøde usikker outputhåndtering, overdreven handlefrihed og overdreven tillid. I eksemplet tidligere relateret til filtrering for ondsindet input ved hjælp af AWS WAF, kan du overveje at bygge et filter foran din applikation for sådan potentiel misbrug af prompter, og udvikle en politik for, hvordan du håndterer og udvikler dem, efterhånden som din model og data vokser. Overvej også en filtreret gennemgang af outputtet, før det returneres til brugeren for at sikre, at det opfylder standarderne for kvalitet, nøjagtighed eller indholdsmoderering. Du ønsker måske at tilpasse dette yderligere til din organisations behov med et ekstra lag af kontrol på input og output foran dine modeller for at afbøde mistænkelige trafikmønstre.

Applikationsinteraktioner: Applikationssikkerhed og observerbarhed

Gennemgå din LLM-applikation med opmærksomhed på, hvordan en bruger kan bruge din model til at omgå standardautorisation til et downstream-værktøj eller værktøjskæde, som de ikke har tilladelse til at få adgang til eller bruge. En anden bekymring på dette lag involverer adgang til eksterne datalagre ved at bruge en model som en angrebsmekanisme ved hjælp af ubegrænsede tekniske eller organisatoriske LLM-risici. For eksempel, hvis din model er uddannet til at få adgang til bestemte datalagre, der kan indeholde følsomme data, bør du sikre dig, at du har korrekte autorisationstjek mellem din model og datalagrene. Brug uforanderlige attributter om brugere, der ikke kommer fra modellen, når du udfører godkendelsestjek. Ubegrænset usikker outputhåndtering, usikkert plugin-design og overdreven agentur kan skabe forhold, hvor en trusselsaktør kan bruge en model til at narre autorisationssystemet til at eskalere effektive privilegier, hvilket fører til en downstream-komponent, der tror, at brugeren er autoriseret til at hente data eller tage en specifik handling.

Når du implementerer et generativt AI-plugin eller -værktøj, er det bydende nødvendigt at undersøge og forstå adgangsniveauet, der gives, samt at undersøge de adgangskontroller, der er blevet konfigureret. Brug af ubetinget usikre generative AI-plugins kan gøre dit system modtageligt for forsyningskædens sårbarheder og trusler, hvilket potentielt kan føre til ondsindede handlinger, herunder at køre fjernkode.

Modelinteraktioner: Modelangrebsforebyggelse

Du bør være opmærksom på oprindelsen af alle modeller, plugins, værktøjer eller data, du bruger, for at evaluere og afbøde sårbarheder i forsyningskæden. For eksempel tillader nogle almindelige modelformater indlejring af vilkårlig kørebar kode i selve modellerne. Brug pakkespejle, scanning og yderligere inspektioner, som er relevante for din organisations sikkerhedsmål.

De datasæt, du træner og finjusterer dine modeller på, skal også gennemgås. Hvis du yderligere automatisk finjusterer en model baseret på brugerfeedback (eller anden slutbrugerkontrollerbar information), skal du overveje, om en ondsindet trusselsaktør kunne ændre modellen vilkårligt baseret på at manipulere deres svar og opnå træningsdataforgiftning.

Datainteraktioner: Overvåg datakvalitet og -brug

Generative AI-modeller som LLM'er fungerer generelt godt, fordi de er blevet trænet på en stor mængde data. Selvom disse data hjælper LLM'er med at udføre komplekse opgaver, kan de også udsætte dit system for risiko for træningsdataforgiftning, som opstår, når upassende data inkluderes eller udelades i et træningsdatasæt, der kan ændre en models adfærd. For at mindske denne risiko bør du se på din forsyningskæde og forstå datagennemgangsprocessen for dit system, før det bruges i din model. Selvom træningspipelinen er en primær kilde til dataforgiftning, bør du også se på, hvordan din model får data, såsom i en RAG-model eller datasø, og om kilden til disse data er tillid til og beskyttet. Brug AWS Security-tjenester såsom AWS Security Hub, Amazon GuardDuty og Amazon Inspector til at hjælpe med løbende at overvåge for mistænkelig aktivitet i Amazon EC2, Amazon EKS, Amazon S3, Amazon Relationel Database Service (Amazon RDS), og netværksadgang, der kan være indikatorer for nye trusler, og brug Detective til at visualisere sikkerhedsundersøgelser. Overvej også at bruge tjenester som f.eks Amazon Security Lake at fremskynde sikkerhedsundersøgelser ved at skabe en specialbygget datasø til automatisk at centralisere sikkerhedsdata fra AWS-miljøer, SaaS-udbydere, på stedet og cloud-kilder, som bidrager til dine AI/ML-arbejdsbelastninger.

Organisatoriske interaktioner: Implementer enterprise governance-værn til generativ AI

Identificer risici forbundet med brugen af generativ AI til dine virksomheder. Du bør opbygge din organisations risikotaksonomi og udføre risikovurderinger for at træffe informerede beslutninger, når du implementerer generative AI-løsninger. Udvikle en forretningskontinuitetsplan (BCP) der inkluderer AI, ML og generative AI-arbejdsbelastninger, og som kan indføres hurtigt for at erstatte den tabte funktionalitet af en påvirket eller offline LLM-applikation for at opfylde dine SLA'er.

Identificer process- og ressourcehuller, ineffektivitet og uoverensstemmelser, og forbedre bevidstheden og ejerskabet på tværs af din virksomhed. Trusselsmodel alle generative AI-arbejdsbelastninger for at identificere og afbøde potentielle sikkerhedstrusler, der kan føre til forretningspåvirkende resultater, herunder uautoriseret adgang til data, lammelsesangreb og ressourcemisbrug. Udnyt det nye AWS Threat Composer Modeling Tool for at hjælpe med at reducere tid til værdi, når du udfører trusselsmodellering. Overvej senere i dine udviklingscyklusser at inkludere at introducere sikkerhed kaos engineering fejlinjektionseksperimenter for at skabe betingelser i den virkelige verden for at forstå, hvordan dit system vil reagere på ukendte ting og opbygge tillid til systemets modstandsdygtighed og sikkerhed.

Inkluder forskellige perspektiver i udviklingen af sikkerhedsstrategier og risikostyringsmekanismer for at sikre overholdelse og dækning for AI/ML og generativ sikkerhed på tværs af alle jobroller og funktioner. Bring en sikkerhedstankegang til bordet fra starten og forskningen af enhver generativ AI-applikation for at tilpasse sig kravene. Hvis du har brug for ekstra assistance fra AWS, så spørg din AWS-kontoadministrator om at sikre, at der er lige support ved at anmode AWS Solutions Architects fra AWS Security og AI/ML om at hjælpe sammen.

Sørg for, at din sikkerhedsorganisation rutinemæssigt træffer foranstaltninger for at fremme kommunikation omkring både risikobevidsthed og risikostyringsforståelse blandt generative AI-interessenter såsom produktchefer, softwareudviklere, datavidenskabsmænd og executive leadership, hvilket tillader trusselsintelligens og kontrolvejledning til at nå de teams, der evt. blive påvirket. Sikkerhedsorganisationer kan understøtte en kultur af ansvarlig afsløring og iterativ forbedring ved at deltage i diskussioner og bringe nye ideer og information til generative AI-interessenter, der relaterer til deres forretningsmål. Lær mere om vores forpligtelse til ansvarlig AI og yderligere ansvarlige AI-ressourcer at hjælpe vores kunder.

Få fordele ved at muliggøre en bedre organisatorisk holdning for generativ AI ved at fjerne blokering af tid til værdi i de eksisterende sikkerhedsprocesser i din organisation. Evaluer proaktivt, hvor din organisation kan kræve processer, der er alt for byrdefulde i betragtning af den generative AI-sikkerhedskontekst, og forfin disse for at give udviklere og videnskabsfolk en klar vej til at starte med de korrekte kontroller på plads.

Vurder, hvor der kan være muligheder for at afstemme incitamenter, afskrække og give et klart blik for de ønskede resultater. Opdatering kontrollerer vejledning og forsvar for at imødekomme de skiftende behov for AI/ML og generativ AI-applikationsudvikling for at reducere forvirring og usikkerhed, der kan koste udviklingstid, øge risikoen og øge virkningen.

Sikre, at interessenter, der ikke er sikkerhedseksperter, både er i stand til at forstå, hvordan organisatorisk styring, politikker og risikostyringstrin gælder for deres arbejdsbelastninger, samt anvender risikostyringsmekanismer. Forbered din organisation på at reagere på realistiske hændelser og scenarier, der kan forekomme med generative AI-applikationer, og sørg for, at generative AI-byggerroller og responsteams er opmærksomme på eskaleringsstier og -handlinger i tilfælde af bekymring for enhver mistænkelig aktivitet.

Konklusion

For succesfuldt at kommercialisere innovation med enhver ny og spirende teknologi kræver det, at man starter med en sikkerhedsorienteret tankegang, bygger på et sikkert infrastrukturgrundlag og tænker på, hvordan man kan integrere sikkerheden yderligere på hvert niveau af teknologistakken tidligt med en dybdegående forsvarssikkerhed nærme sig. Dette inkluderer interaktioner på flere lag af din teknologistabel og integrationspunkter i din digitale forsyningskæde for at sikre organisatorisk robusthed. Selvom generativ AI introducerer nogle nye sikkerheds- og privatlivsudfordringer, kan du hjælpe med at beskytte din organisation mod mange almindelige problemer og skiftende trusler, hvis du følger grundlæggende bedste praksisser for sikkerhed såsom at bruge dybdegående forsvar med lagdelte sikkerhedstjenester. Du bør implementere lagdelte AWS-sikkerhedstjenester på tværs af dine generative AI-arbejdsbelastninger og større organisation og fokusere på integrationspunkter i dine digitale forsyningskæder for at sikre dine cloudmiljøer. Så kan du bruge de forbedrede sikkerheds- og privatlivsfunktioner i AWS AI/ML-tjenester såsom Amazon SageMaker og Amazon Bedrock til at tilføje yderligere lag af forbedret sikkerhed og privatlivskontrol til dine generative AI-applikationer. Indlejring af sikkerhed fra starten vil gøre det hurtigere, nemmere og mere omkostningseffektivt at innovere med generativ AI, samtidig med at overholdelse forenkles. Dette vil hjælpe dig med at øge kontrol, tillid og observerbarhed til dine generative AI-applikationer for dine medarbejdere, kunder, partnere, regulatorer og andre berørte interessenter.

Yderligere referencer

- Branchestandardrammer for AI/ML-specifik risikostyring og sikkerhed:

Om forfatterne

Christopher Rae er en Principal Worldwide Security GTM Specialist med fokus på at udvikle og udføre strategiske initiativer, der accelererer og skalerer overtagelsen af AWS-sikkerhedstjenester. Han brænder for krydsfeltet mellem cybersikkerhed og nye teknologier med mere end 20 års erfaring i globale strategiske lederroller, der leverer sikkerhedsløsninger til medie-, underholdnings- og telekomkunder. Han genoplader ved at læse, rejse, mad og vin, opdage ny musik og rådgive startups i de tidlige stadier.

Christopher Rae er en Principal Worldwide Security GTM Specialist med fokus på at udvikle og udføre strategiske initiativer, der accelererer og skalerer overtagelsen af AWS-sikkerhedstjenester. Han brænder for krydsfeltet mellem cybersikkerhed og nye teknologier med mere end 20 års erfaring i globale strategiske lederroller, der leverer sikkerhedsløsninger til medie-, underholdnings- og telekomkunder. Han genoplader ved at læse, rejse, mad og vin, opdage ny musik og rådgive startups i de tidlige stadier.

Elijah Winter er en Senior Security Engineer i Amazon Security, med en BS i Cyber Security Engineering og fyldt med kærlighed til Harry Potter. Elijah udmærker sig ved at identificere og adressere sårbarheder i AI-systemer og blande teknisk ekspertise med et strejf af trolddom. Elijah designer skræddersyede sikkerhedsprotokoller til AI-økosystemer, der bringer en magisk flair til digitale forsvar. Elijah er drevet af integritet og har en sikkerhedsbaggrund i både offentlige og kommercielle organisationer med fokus på at beskytte tillid.

Elijah Winter er en Senior Security Engineer i Amazon Security, med en BS i Cyber Security Engineering og fyldt med kærlighed til Harry Potter. Elijah udmærker sig ved at identificere og adressere sårbarheder i AI-systemer og blande teknisk ekspertise med et strejf af trolddom. Elijah designer skræddersyede sikkerhedsprotokoller til AI-økosystemer, der bringer en magisk flair til digitale forsvar. Elijah er drevet af integritet og har en sikkerhedsbaggrund i både offentlige og kommercielle organisationer med fokus på at beskytte tillid.

Ram Vittal er Principal ML Solutions Architect hos AWS. Han har over 3 årtiers erfaring med at bygge og bygge distribuerede, hybride og cloud-applikationer. Han brænder for at bygge sikker og skalerbar AI/ML og big data-løsninger for at hjælpe virksomhedskunder med deres cloud-adoption og optimeringsrejse for at forbedre deres forretningsresultater. I sin fritid kører han på motorcykel og går tur med sin 3-årige Sheepadoodle!

Ram Vittal er Principal ML Solutions Architect hos AWS. Han har over 3 årtiers erfaring med at bygge og bygge distribuerede, hybride og cloud-applikationer. Han brænder for at bygge sikker og skalerbar AI/ML og big data-løsninger for at hjælpe virksomhedskunder med deres cloud-adoption og optimeringsrejse for at forbedre deres forretningsresultater. I sin fritid kører han på motorcykel og går tur med sin 3-årige Sheepadoodle!

Navneet Tuteja er dataspecialist hos Amazon Web Services. Før Navneet kom til AWS, arbejdede Navneet som facilitator for organisationer, der søger at modernisere deres dataarkitekturer og implementere omfattende AI/ML-løsninger. Hun har en ingeniøruddannelse fra Thapar University, samt en mastergrad i statistik fra Texas A&M University.

Navneet Tuteja er dataspecialist hos Amazon Web Services. Før Navneet kom til AWS, arbejdede Navneet som facilitator for organisationer, der søger at modernisere deres dataarkitekturer og implementere omfattende AI/ML-løsninger. Hun har en ingeniøruddannelse fra Thapar University, samt en mastergrad i statistik fra Texas A&M University.

Emily Soward er dataforsker med AWS Professional Services. Hun har en Master of Science with Distinction in Artificial Intelligence fra University of Edinburgh i Skotland, Storbritannien med vægt på Natural Language Processing (NLP). Emily har tjent i anvendte videnskabelige og ingeniørroller med fokus på AI-aktiveret produktforskning og -udvikling, operationel ekspertise og styring af AI-arbejdsbelastninger, der kører i organisationer i den offentlige og private sektor. Hun bidrager til kundevejledning som AWS Senior Speaker og for nylig som forfatter til AWS Well-Architected in the Machine Learning Lens.

Emily Soward er dataforsker med AWS Professional Services. Hun har en Master of Science with Distinction in Artificial Intelligence fra University of Edinburgh i Skotland, Storbritannien med vægt på Natural Language Processing (NLP). Emily har tjent i anvendte videnskabelige og ingeniørroller med fokus på AI-aktiveret produktforskning og -udvikling, operationel ekspertise og styring af AI-arbejdsbelastninger, der kører i organisationer i den offentlige og private sektor. Hun bidrager til kundevejledning som AWS Senior Speaker og for nylig som forfatter til AWS Well-Architected in the Machine Learning Lens.

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk dig selv. Adgang her.

- PlatoAiStream. Web3 intelligens. Viden forstærket. Adgang her.

- PlatoESG. Kulstof, CleanTech, Energi, Miljø, Solenergi, Affaldshåndtering. Adgang her.

- PlatoHealth. Bioteknologiske og kliniske forsøgs intelligens. Adgang her.

- Kilde: https://aws.amazon.com/blogs/machine-learning/architect-defense-in-depth-security-for-generative-ai-applications-using-the-owasp-top-10-for-llms/

- :har

- :er

- :ikke

- :hvor

- $OP

- 1

- 10

- 100

- 125

- 140

- 150

- 30

- 300

- 7

- a

- evne

- I stand

- Om

- akademisk

- fremskynde

- acceptabel

- adgang

- Adgang til data

- Adgang

- derfor

- Konto

- Konti

- nøjagtighed

- opnå

- opnå

- tværs

- Handling

- aktioner

- aktiviteter

- aktivitet

- tilpasning

- tilføje

- tilføjet

- Desuden

- Yderligere

- adresse

- adressering

- adhærens

- vedtage

- Vedtagelsen

- Vedtagelse

- fremskreden

- fremskridt

- Fordel

- rådgive

- Efter

- mod

- agentur

- Agent

- AI

- AI modeller

- AI-systemer

- AI / ML

- tilpasse

- justeret

- Justerer

- Alle

- tillade

- tilladt

- tillade

- alene

- også

- Skønt

- Amazon

- Amazon EC2

- Amazon RDS

- Amazon SageMaker

- Amazon Web Services

- blandt

- beløb

- an

- analysere

- analysere

- ,

- og infrastruktur

- anonym

- En anden

- besvarelse

- enhver

- api

- appetit

- anvendelig

- Anvendelse

- Application Development

- applikationssikkerhed

- applikationer

- anvendt

- gælder

- Indløs

- Anvendelse

- tilgang

- tilgange

- passende

- arkitekter

- arkitektonisk

- arkitektur

- ER

- områder

- argumentere

- opstå

- omkring

- kunstig

- kunstig intelligens

- Kunstig intelligens (AI)

- AS

- spørg

- Vurdering

- vurderinger

- Aktiver

- Assistance

- assistenter

- forbundet

- sikkerhed

- At

- angribe

- Angreb

- forsøger

- opmærksomhed

- attributter

- revision

- augmented

- Godkendelse

- forfatter

- tilladelse

- autoriseret

- automatisere

- automatisk

- til rådighed

- opmærksom på

- bevidsthed

- AWS

- AWS kunde

- AWS Professional Services

- tilbage

- Backed

- baggrund

- baseret

- grundlæggende

- grundlag

- BE

- fordi

- bliver

- været

- før

- begynde

- adfærd

- adfærd

- være

- tro

- gavner det dig

- fordele

- BEDSTE

- bedste praksis

- Bedre

- mellem

- skævhed

- Big

- Big data

- Bill

- blanding

- Blog

- både

- grænser

- bringe

- Bringe

- bygge

- Builder

- bygherrer

- Bygning

- bygger

- bygget

- indbygget

- virksomhed

- virksomheder

- by

- bypass

- CAN

- Kan få

- kapaciteter

- Kapacitet

- tilfælde

- Boligtype

- Årsag

- årsager

- centralisere

- vis

- certifikat

- Certificering

- kæde

- kæder

- udfordringer

- lave om

- Chaos

- chatbot

- Kontrol

- chef

- klar

- Cloud

- cloud adoption

- cloud computing

- sky infrastruktur

- Cloud Security

- kode

- kombination

- Kom

- kommer

- kommerciel

- kommercialisere

- engagement

- engageret

- Fælles

- almindeligt

- Kommunikation

- følgesvend

- ledsagere

- selskab

- fuldføre

- komplekse

- Compliance

- komponent

- Komponere

- forstå

- omfattende

- kompromis

- Kompromitteret

- at gå på kompromis

- Compute

- computing

- Bekymring

- pågældende

- Bekymringer

- betingelser

- Adfærd

- tillid

- konfigureret

- forvirring

- sammenholdt

- Tilslut

- Konsekvenser

- Overvej

- betragtes

- Overvejer

- konsekvent

- består

- indeholder

- Beholdere

- indhold

- sammenhæng

- kontinuitet

- kontinuerligt

- bidrage

- bidrager

- kontrol

- styring

- kontrol

- omvendt

- Core

- hjørnesten

- korrigere

- Tilsvarende

- Koste

- omkostningseffektiv

- kunne

- dækning

- skabe

- Oprettelse af

- kritisk

- Medarbejder kultur

- kuraterer

- kunde

- Kunder

- tilpasse

- tilpassede

- Cyber

- cybersikkerhed

- Cybersecurity

- cykler

- data

- Data Lake

- Dataforberedelse

- dataforsker

- manipulation af data

- Database

- datasæt

- dag

- årtier

- Beslutningstagning

- beslutningstagere

- afgørelser

- dyb

- dybere

- Forsvar

- defensiv

- definere

- definerede

- definere

- Degree

- leverer

- dykke

- demonstreret

- Denial of Service

- Afhængigt

- indsætte

- indsat

- implementering

- implementering

- dybde

- beskrive

- Design

- designs

- ønskes

- opdage

- udvikle

- udviklet

- udviklere

- udvikling

- Udvikling

- afvige

- afvigelse

- forskellige

- digital

- discipliner

- videregivelse

- opdage

- opdagelse

- diskutere

- diskuterer

- diskussioner

- forstyrrelser

- distinkt

- skelnen

- distribueret

- dyk

- forskelligartede

- forskellige perspektiver

- Er ikke

- domæne

- Dont

- trækker

- drevet

- i løbet af

- hver

- tidligere

- Tidligt

- tidlig stadie

- lettere

- nemt

- Økonomisk

- økonomisk værdi

- økosystemer

- Effektiv

- effektiv

- enten

- indlejring

- emerge

- smergel

- nye teknologier

- Emerging Technology

- vægt

- medarbejdere

- bemyndige

- muliggøre

- muliggør

- muliggør

- tilskynder

- krypteret

- ende

- håndhæve

- håndhæve

- ingeniør

- Engineering

- Ingeniører

- forbedret

- sikre

- Enterprise

- Underholdning

- Hele

- Miljø

- miljøer

- lige

- fejl

- optrapning

- væsentlig

- etablere

- oprettelse

- evaluere

- evaluere

- evaluering

- Endog

- begivenhed

- begivenheder

- Hver

- udvikle sig

- udviklende

- undersøge

- eksempel

- eksempler

- Excellence

- overdreven

- udførelse

- udøvende

- Dyrke motion

- eksfiltration

- eksisterer

- eksisterende

- ekspanderende

- forventet

- erfaring

- eksperimenter

- ekspertise

- eksperter

- Eksponering

- udvide

- udvidet

- strækker

- udvider

- ekstern

- ekstra

- ekstrakt

- ekstremt

- ansigter

- letter

- facilitator

- mislykkes

- Fall

- Kendskab

- FAST

- hurtigere

- Feature

- Funktionalitet

- tilbagemeldinger

- færre

- filtrere

- filtrering

- finansielle

- finansielle tjenesteydelser

- Finde

- finde

- fund

- firewall

- Fornavn

- fem

- fleksibel

- flow

- strømme

- Fokus

- fokuserede

- følger

- efter

- mad

- Til

- Forensic

- Foster

- Fosters

- Foundation

- grundlæggende

- Framework

- rammer

- hyppigt

- fra

- forsiden

- funktionalitet

- funktioner

- fundamental

- yderligere

- Gevinst

- huller

- Generelt

- generelt

- generation

- generative

- Generativ AI

- få

- få

- given

- Global

- mål

- Mål

- gå

- styre

- regeringsførelse

- Regering

- statslige

- bevilget

- Vokser

- vejledning

- vejlede

- guidet

- Guides

- havde

- håndtere

- Håndtering

- Have

- he

- sundhedspleje

- hjælpe

- hjælpe

- hjælper

- Høj ydeevne

- stærkt

- hans

- bedrift

- besidder

- Hvordan

- How To

- HTML

- http

- HTTPS

- Hub

- menneskelig

- Hybrid

- i

- idé

- ideer

- identificeret

- identificere

- identificere

- Identity

- if

- uforanderlighed

- uforanderlige

- KIMOs Succeshistorier

- påvirket

- Påvirkninger

- bydende nødvendigt

- gennemføre

- implementering

- implementeret

- gennemføre

- Forbedre

- in

- Incitamenter

- starten

- omfatter

- medtaget

- omfatter

- Herunder

- uoverensstemmelser

- Forøg

- øget

- stigende

- Indikatorer

- industrien

- ineffektivitet

- oplysninger

- informationssikkerhed

- informeret

- Infrastruktur

- infunderet

- iboende

- initiativer

- innovere

- fornyelse

- Innovation

- indgang

- indgange

- usikker

- indvendig

- indsigt

- indsigt

- integrere

- integreret

- Integrerer

- integration

- integrationer

- integritet

- Intelligens

- interaktioner

- interesse

- grænseflade

- internationalt

- vejkryds

- ind

- indføre

- Introducerer

- indføre

- undersøgelse

- Undersøgelser

- involverer

- spørgsmål

- IT

- ITS

- selv

- Job

- sammenføjning

- rejse

- jpg

- lige

- Holde

- Nøgle

- Nøgleområder

- Kingdom

- viden

- sø

- Sprog

- stor

- større

- endelig

- senere

- lancere

- lag

- lagdelt

- lag

- føre

- ledere

- Leadership" (virkelig menneskelig ledelse)

- førende

- LÆR

- læring

- mindst

- linse

- linser

- Niveau

- livscyklus

- ligesom

- sandsynlighed

- Line (linje)

- linjer

- LLM

- logning

- logik

- Se

- leder

- tabte

- kærlighed

- maskine

- machine learning

- lave

- ondsindet

- malware

- administrere

- lykkedes

- ledelse

- leder

- Ledere

- styring

- manipulere

- Håndtering

- måde

- mange

- kort

- Master

- herres

- materialer

- Matters

- modenhed

- maksimere

- Kan..

- midler

- måle

- mekanisme

- mekanismer

- Medier

- Mød

- opfylder

- mentale

- nævnte

- mødte

- Metrics

- måske

- migrere

- millioner

- tankerne

- Mindset

- misbruge

- afbøde

- afbødning

- ML

- model

- modellering

- modeller

- mådehold

- modernisere

- Overvåg

- overvågning

- mere

- mest

- motorcykel

- bevæge sig

- meget

- flere

- Musik

- skal

- my

- Natural

- Natural Language Processing

- Natur

- nødvendig

- Behov

- behov

- behov

- netværk

- Ny

- næste

- NIST

- NLP

- objekt

- objektiv

- målsætninger

- of

- off

- tilbyde

- Tilbud

- officerer

- offline

- on

- ONE

- åbent

- open source

- betjenes

- operationelle

- Produktion

- Muligheder

- optimering

- optimeret

- or

- ordrer

- organisation

- organisatorisk

- organisationer

- oprindelse

- oprindeligt

- oprindelser

- Andet

- vores

- ud

- Resultat

- udfald

- output

- udgange

- uden for

- i løbet af

- samlet

- ejerskab

- pakke

- del

- deltager

- parter

- partnere

- dele

- lidenskabelige

- sti

- stier

- mønstre

- ydeevne

- udføres

- udfører

- Tilladelser

- perspektiver

- faser

- søjler

- pipeline

- Place

- fly

- planlægning

- plato

- Platon Data Intelligence

- PlatoData

- plugin

- Plugins

- punkter

- gift

- politikker

- politik

- positionering

- Indlæg

- potentiale

- potentielt

- praksis

- praksis

- forberedelse

- Forbered

- forhindre

- tidligere

- Prime

- Main

- principper

- Forud

- prioritering

- prioritet

- Beskyttelse af personlige oplysninger

- private

- den private sektor

- privilegium

- privilegier

- behandle

- Processer

- forarbejdning

- Produkt

- produktion

- produktivitet

- professionel

- Profil

- Program

- Programmer

- projekt

- prompter

- passende

- korrekt

- beskytte

- beskyttet

- beskyttelse

- beskyttelse

- protokoller

- give

- udbydere

- giver

- leverer

- offentlige

- sætte

- kvalitet

- forespørgsler

- spørgsmål

- Hurtig

- hurtigt

- klud

- nå

- Reagerer

- Læs

- Readiness

- Læsning

- virkelige verden

- realistisk

- erkendelse af

- indse

- modtagende

- for nylig

- anbefaler

- anbefalinger

- Recover

- opsving

- reducere

- henvisningen

- raffinere

- region

- fast

- regelmæssigt

- reguleret

- Regulators

- relaterede

- relevant

- pålidelig

- stole

- oprydning

- fjern

- udbytte

- gentag

- erstatte

- anmode

- anmoder

- kræver

- krav

- Krav

- Kræver

- forskning

- forskning og udvikling

- modstandskraft

- ressource

- Ressourcer

- respekteret

- dem

- Svar

- svar

- reaktioner

- ansvar

- ansvarlige

- REST

- begrænse

- hentning

- gennemgå

- revideret

- gennemgå

- Anmeldelser

- forlystelser

- højre

- Risiko

- risikovillighed

- risikostyring

- risici

- robust

- Rodgers

- roller

- rod

- rutinemæssigt

- regler

- kører

- s

- SaaS

- sagemaker

- samme

- skalerbar

- Scale

- scanning

- scenarie

- scenarier

- Videnskab

- videnskabelig

- Videnskabsmand

- forskere

- rækkevidde

- Anvendelsesområde

- Søg

- Sektion

- sektor

- sikker

- Sikret

- fastgørelse

- sikkerhed

- sikkerhedsmæssige fordele

- Sikkerhed begivenheder

- sikkerhedsrisici

- Sikkerhedsrisici

- Søg

- søger

- søger

- Vælg

- valgt

- senior

- følsom

- serveret

- tjeneste

- Tjenester

- sæt

- indstilling

- delt

- hun

- bør

- Vis

- Syn

- lignende

- Simpelt

- forenkle

- forenkle

- So

- socialisering

- Software

- softwareregning

- Softwareudviklere

- softwareudvikling

- løsninger

- Løsninger

- nogle

- Kilde

- Kilder

- suverænitet

- Space

- Højttaler

- specialist

- specifikke

- specifikt

- hastighed

- stable

- etaper

- interessenter

- standard

- standarder

- starte

- påbegyndt

- Starter

- Nystartede

- statistik

- Steps

- Stadig

- opbevaring

- opbevaret

- forhandler

- Strategisk

- strategier

- Strateg

- Strategi

- Streng

- kraftigt

- væsentligt

- succes

- Succesfuld

- sådan

- forsyne

- forsyningskæde

- Forsyningskæder

- support

- Støtte

- sikker

- modtagelig

- mistænksom

- syntetisk

- systemet

- Systemer

- bord

- skræddersyet

- Tag

- tager

- Tandem

- opgaver

- taksonomi

- hold

- hold

- Teknisk

- teknikker

- Teknologier

- teknologer

- Teknologier

- telecom

- prøve

- Test

- tests

- Texas

- tekst

- at

- The Source

- tyveri

- deres

- Them

- temaer

- selv

- derefter

- Der.

- Disse

- de

- Tænker

- Tredje

- tredje partier

- denne

- dem

- trussel

- trusler

- tre

- Gennem

- hele

- tid

- rettidig

- til

- sammen

- værktøj

- værktøjer

- top

- Top 10

- mod

- Trading

- traditionelle

- Trafik

- Tog

- uddannet

- Kurser

- transaktion

- transit

- Gennemsigtighed

- transportere

- Traveling

- Stol

- betroet

- typisk

- uberettiget

- Usikkerhed

- under

- Underminere

- forstå

- forståelse

- ukendt

- Forenet

- Storbritannien

- universitet

- ufortrødent

- Opdatering

- opdateret

- Opretholde

- oppetid

- brug

- brug tilfælde

- anvendte

- Bruger

- brugere

- bruger

- ved brug af

- udnytte

- udnyttet

- Ved hjælp af

- VALIDATE

- validering

- validering

- værdi

- Versed

- via

- Virtual

- næsten

- Visualiser

- vs

- Sårbarheder

- sårbarhed

- gåture

- ønsker

- tegningsretter

- var

- måder

- we

- web

- Webapplikation

- webapplikationer

- webservices

- GODT

- Hvad

- hvornår

- hvorvidt

- som

- mens

- WHO

- Hele

- vilje

- VIN

- Vinder

- med

- inden for

- uden

- Arbejde

- arbejdede

- workflow

- arbejdsgange

- arbejder

- verdensplan

- ville

- skrev

- XSS

- år

- Du

- Din

- zephyrnet