At vedligeholde maskinlæring (ML) arbejdsgange i produktionen er en udfordrende opgave, fordi det kræver at skabe kontinuerlig integration og kontinuerlig levering (CI/CD) pipelines for ML-kode og modeller, modelversionering, overvågning af data og konceptdrift, modeloplæring og en manual godkendelsesproces for at sikre, at nye versioner af modellen opfylder både ydeevne- og overholdelseskrav.

I dette indlæg beskriver vi, hvordan man opretter en MLOps-arbejdsgang til batch-inferens, der automatiserer jobplanlægning, modelovervågning, genoptræning og registrering, samt fejlhåndtering og underretning ved at bruge Amazon SageMaker, Amazon Eventbridge, AWS Lambda, Amazon Simple Notification Service (Amazon SNS), HashiCorp Terraform og GitLab CI/CD. Det præsenterede MLOps-workflow giver en genanvendelig skabelon til styring af ML-livscyklussen gennem automatisering, overvågning, auditerbarhed og skalerbarhed og reducerer derved kompleksiteten og omkostningerne ved at opretholde batch-inferens-arbejdsbelastninger i produktionen.

Løsningsoversigt

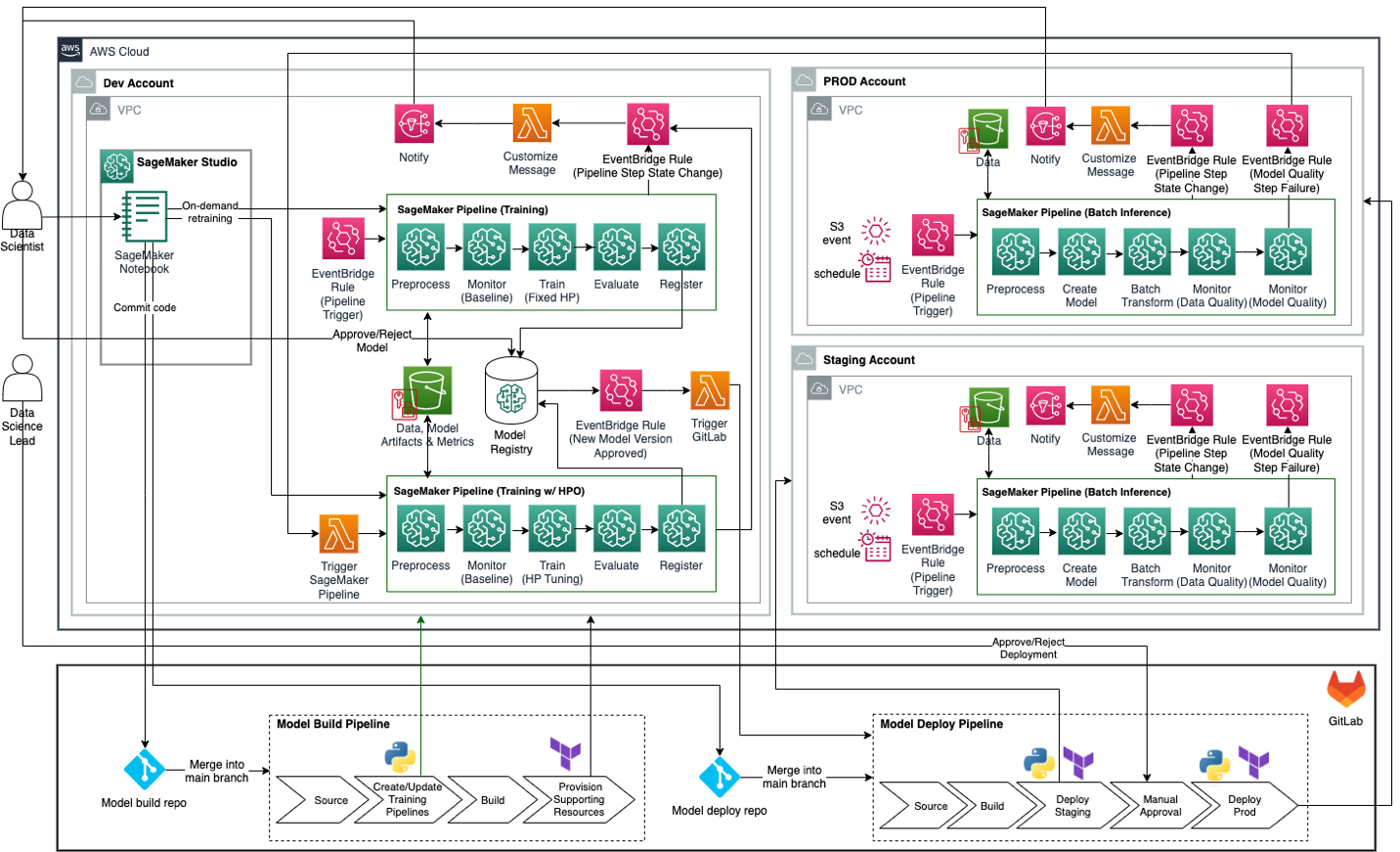

Følgende figur illustrerer den foreslåede mål-MLOps-arkitektur for virksomhedsbatch-inferens for organisationer, der bruger GitLab CI/CD og Terraform-infrastruktur som kode (IaC) i forbindelse med AWS-værktøjer og -tjenester. GitLab CI/CD fungerer som makro-orkestrator og orkestrerer model build , model deploy pipelines, som omfatter sourcing, bygning og levering Amazon SageMaker Pipelines og understøttende ressourcer ved hjælp af SageMaker Python SDK og Terraform. SageMaker Python SDK bruges til at oprette eller opdatere SageMaker-pipelines til træning, træning med hyperparameteroptimering (HPO) og batch-inferens. Terraform bruges til at oprette yderligere ressourcer såsom EventBridge-regler, Lambda-funktioner og SNS-emner til overvågning af SageMaker-pipelines og afsendelse af meddelelser (f.eks. når et pipeline-trin mislykkes eller lykkes). SageMaker Pipelines fungerer som orkestrator for ML-modeltræning og inferensarbejdsgange.

Dette arkitekturdesign repræsenterer en flerkontostrategi, hvor ML-modeller bygges, trænes og registreres i et centralt modelregister inden for en datavidenskabsudviklingskonto (som har flere kontroller end en typisk applikationsudviklingskonto). Derefter implementeres inferenspipelines til iscenesættelse og produktionskonti ved hjælp af automatisering fra DevOps-værktøjer såsom GitLab CI/CD. Det centrale modelregister kan eventuelt også placeres på en delt servicekonto. Henvise til Driftsmodel for bedste praksis vedrørende en multi-konto strategi for ML.

I de følgende underafsnit diskuterer vi forskellige aspekter af arkitekturdesignet i detaljer.

Infrastruktur som kode

IaC tilbyder en måde at administrere it-infrastruktur gennem maskinlæsbare filer, hvilket sikrer effektiv versionskontrol. I dette indlæg og den medfølgende kodeeksempel demonstrerer vi, hvordan du bruger HashiCorp Terraform med GitLab CI/CD til at administrere AWS-ressourcer effektivt. Denne tilgang understreger de vigtigste fordele ved IaC, der tilbyder en gennemsigtig og gentagelig proces inden for IT-infrastrukturstyring.

Modeltræning og omskoling

I dette design kører SageMaker træningspipeline efter en tidsplan (via EventBridge) eller baseret på en Amazon Simple Storage Service (Amazon S3) hændelsesudløser (for eksempel når en triggerfil eller nye træningsdata, i tilfælde af et enkelt træningsdataobjekt, placeres i Amazon S3) for regelmæssigt at omkalibrere modellen med nye data. Denne pipeline introducerer ikke strukturelle eller materielle ændringer til modellen, fordi den bruger faste hyperparametre, der er blevet godkendt under gennemgangsprocessen for virksomhedsmodeller.

Træningspipelinen registrerer den nyuddannede modelversion i Amazon SageMaker Model Registry hvis modellen overskrider en foruddefineret modelpræstationstærskel (f.eks. RMSE for regression og F1-score for klassificering). Når en ny version af modellen registreres i modelregistret, udløser det en meddelelse til den ansvarlige dataforsker via Amazon SNS. Dataforskeren skal derefter gennemgå og manuelt godkende den seneste version af modellen i Amazon SageMaker Studio UI eller via et API-kald ved hjælp af AWS kommandolinjegrænseflade (AWS CLI) eller AWS SDK for Python (Boto3), før den nye version af modellen kan bruges til slutninger.

SageMaker træningspipeline og dens understøttende ressourcer er skabt af GitLab model build pipeline, enten via en manuel kørsel af GitLab-pipelinen eller automatisk, når kode flettes ind i main gren af model build Git repository.

Batch-inferens

SageMaker batch-inferens-pipeline kører efter en tidsplan (via EventBridge) eller også baseret på en S3-hændelsestrigger. Batch-inferens-pipelinen trækker automatisk den seneste godkendte version af modellen fra modelregistret og bruger den til inferens. Batch-inferens-pipelinen inkluderer trin til kontrol af datakvalitet i forhold til en baseline, der er oprettet af træningspipelinen, såvel som modelkvalitet (modelydeevne), hvis jordsandhedsetiketter er tilgængelige.

Hvis batch-inferenspipelinen opdager datakvalitetsproblemer, vil den underrette den ansvarlige dataforsker via Amazon SNS. Hvis den opdager problemer med modelkvaliteten (f.eks. er RMSE større end en forudbestemt tærskel), vil pipelinetrinnet for modelkvalitetstjekket mislykkes, hvilket igen vil udløse en EventBridge-begivenhed for at starte træningen med HPO-pipeline.

SageMaker batch-inferenspipeline og dens understøttende ressourcer er skabt af GitLab model deploy pipeline, enten via en manuel kørsel af GitLab-pipelinen eller automatisk, når kode flettes ind i main gren af model deploy Git repository.

Model tuning og retuning

SageMaker-træningen med HPO-pipeline udløses, når modelkvalitetskontroltrinnet i batch-inferenspipelinen mislykkes. Modelkvalitetstjekket udføres ved at sammenligne modelforudsigelser med de faktiske jordsandhedsmærker. Hvis modelkvalitetsmetrikken (f.eks. RMSE for regression og F1-score for klassificering) ikke opfylder et forudbestemt kriterium, markeres trinet til modelkvalitetskontrol som mislykket. SageMaker-træningen med HPO-pipeline kan også udløses manuelt (i SageMaker Studio UI eller via et API-kald ved hjælp af AWS CLI eller SageMaker Python SDK) af den ansvarlige dataforsker, hvis det er nødvendigt. Fordi modelhyperparametrene ændres, skal den ansvarlige dataforsker indhente godkendelse fra virksomhedsmodelgennemgangsudvalget, før den nye modelversion kan godkendes i modelregistret.

SageMaker-træningen med HPO-pipeline og dens understøttende ressourcer er skabt af GitLab model build pipeline, enten via en manuel kørsel af GitLab-pipelinen eller automatisk, når kode flettes ind i main gren af model build Git repository.

Modelovervågning

Datastatistik og begrænsninger-baselines genereres som en del af træningen og træningen med HPO-pipelines. De gemmes på Amazon S3 og registreres også hos den trænede model i modelregistret, hvis modellen består evalueringen. Den foreslåede arkitektur for batch-inferenspipelinen bruger Amazon SageMaker Model Monitor til kontrol af datakvalitet, mens du bruger brugerdefinerede Amazon SageMaker-behandling trin til kontrol af modelkvalitet. Dette design afkobler data- og modelkvalitetstjek, hvilket igen giver dig mulighed for kun at sende en advarselsmeddelelse, når datadrift er registreret; og udløs træningen med HPO-pipeline, når der opdages en overtrædelse af modelkvaliteten.

Modelgodkendelse

Efter at en nyuddannet model er registreret i modelregistret, modtager den ansvarlige datalog en anmeldelse. Hvis modellen er blevet trænet af træningspipelinen (genkalibrering med nye træningsdata, mens hyperparametre er faste), er der ikke behov for godkendelse fra virksomhedsmodelgennemgangsudvalget. Dataforskeren kan uafhængigt gennemgå og godkende den nye version af modellen. På den anden side, hvis modellen er blevet trænet af træningen med HPO-pipeline (genindstilling ved at ændre hyperparametre), skal den nye modelversion gennemgå virksomhedens gennemgangsprocessen, før den kan bruges til slutning i produktionen. Når gennemgangsprocessen er afsluttet, kan dataforskeren fortsætte og godkende den nye version af modellen i modelregistret. Ændring af status for modelpakken til Approved vil udløse en Lambda-funktion via EventBridge, som igen vil udløse GitLab model deploy pipeline via et API-kald. Dette vil automatisk opdatere SageMaker batch-inferens-pipeline for at bruge den seneste godkendte version af modellen til inferens.

Der er to hovedmåder til at godkende eller afvise en ny modelversion i modelregistret: ved at bruge AWS SDK til Python (Boto3) eller fra SageMaker Studio UI. Som standard er både træningspipeline og træning med HPO pipelinesæt ModelApprovalStatus til PendingManualApproval. Den ansvarlige dataforsker kan opdatere godkendelsesstatus for modellen ved at ringe til update_model_package API fra Boto3. Henvise til Opdater godkendelsesstatus for en model for detaljer om opdatering af godkendelsesstatus for en model via SageMaker Studio UI.

Data I/O design

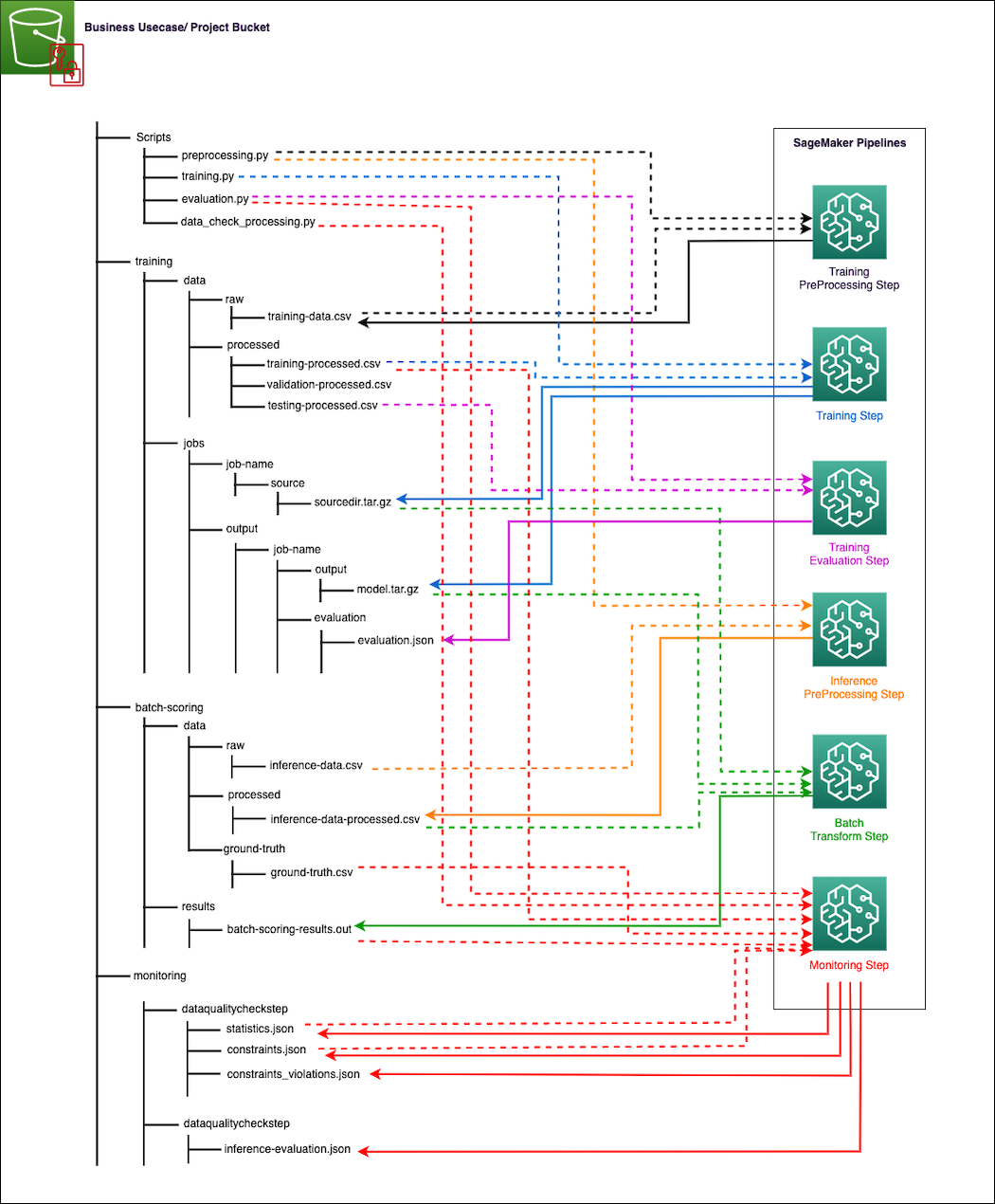

SageMaker interagerer direkte med Amazon S3 for at læse input og gemme output fra individuelle trin i trænings- og inferenspipelines. Følgende diagram illustrerer, hvordan forskellige Python-scripts, rå og behandlede træningsdata, rå og behandlede slutningsdata, slutningsresultater og jordsandhedsetiketter (hvis tilgængelige for modelkvalitetsovervågning), modelartefakter, trænings- og slutningsevalueringsmetrikker (modelkvalitetsovervågning), samt datakvalitetsbaselines og overtrædelsesrapporter (til overvågning af datakvalitet) kan organiseres i en S3-spand. Pilenes retning i diagrammet angiver, hvilke filer der er input eller output fra deres respektive trin i SageMaker-pipelines. Pile er blevet farvekodet baseret på pipeline-trintype for at gøre dem nemmere at læse. Pipelinen vil automatisk uploade Python-scripts fra GitLab-lageret og gemme outputfiler eller modelartefakter fra hvert trin i den relevante S3-sti.

Dataingeniøren er ansvarlig for følgende:

- Upload af mærkede træningsdata til den relevante sti i Amazon S3. Dette inkluderer tilføjelse af nye træningsdata regelmæssigt for at sikre, at træningspipeline og træning med HPO pipeline har adgang til nyere træningsdata til henholdsvis modelgenoptræning og -justering.

- Upload af inputdata til inferens til den passende sti i S3-bucket før en planlagt kørsel af inferenspipelinen.

- Uploader jordsandhedsetiketter til den passende S3-sti til modelkvalitetsovervågning.

Data scientisten er ansvarlig for følgende:

- Forberedelse af jordsandhedsetiketter og leverer dem til dataingeniørteamet til upload til Amazon S3.

- At tage de modelversioner, der er trænet af uddannelsen med HPO-pipeline, gennem virksomhedsgennemgangsprocessen og opnå de nødvendige godkendelser.

- Manuel godkendelse eller afvisning af nyuddannede modelversioner i modelregistret.

- Godkendelse af produktionsporten for inferensrørledningen og understøttelse af ressourcer, der skal fremmes til produktion.

Prøvekode

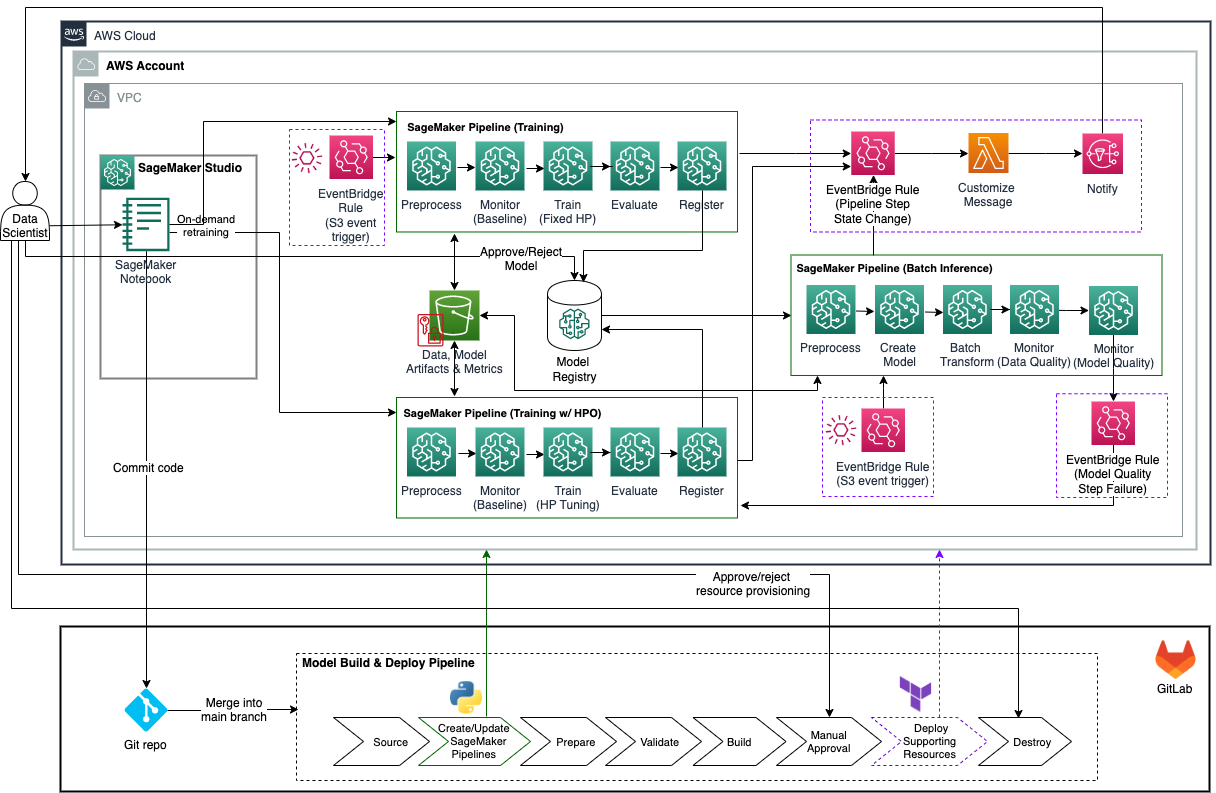

I dette afsnit præsenterer vi en prøvekode til batch-inferensoperationer med en enkeltkontoopsætning som vist i det følgende arkitekturdiagram. Eksempelkoden kan findes i GitHub repository, og kan tjene som udgangspunkt for batch-slutninger med modelovervågning og automatisk genoptræning ved hjælp af kvalitetsporte, der ofte kræves for virksomheder. Eksempelkoden adskiller sig fra målarkitekturen på følgende måder:

- Den bruger en enkelt AWS-konto til at bygge og implementere ML-modellen og understøttende ressourcer. Henvise til Organisering af dit AWS-miljø ved hjælp af flere konti for vejledning om opsætning af flere konti på AWS.

- Den bruger en enkelt GitLab CI/CD-pipeline til opbygning og implementering af ML-modellen og understøttende ressourcer.

- Når en ny version af modellen er trænet og godkendt, trigges GitLab CI/CD-pipeline ikke automatisk og skal køres manuelt af den ansvarlige dataforsker for at opdatere SageMaker batch-inferenspipeline med den seneste godkendte version af modellen.

- Det understøtter kun S3-hændelsesbaserede triggere til at køre SageMaker-trænings- og inferenspipelines.

Forudsætninger

Du bør have følgende forudsætninger, før du implementerer denne løsning:

- En AWS-konto

- SageMaker Studio

- En SageMaker-udførelsesrolle med Amazon S3 læse/skrive og AWS Key Management Service (AWS KMS) krypter/dekrypter tilladelser

- En S3-bøtte til lagring af data, scripts og modelartefakter

- terraform version 0.13.5 eller nyere

- GitLab med en fungerende Docker-løber til at køre pipelines

- AWS CLI

- jq

- unzip

- Python3 (Python 3.7 eller nyere) og følgende Python-pakker:

- boto3

- sagemaker

- pandaer

- pyyaml

Depotstruktur

GitHub repository indeholder følgende mapper og filer:

/code/lambda_function/– Denne mappe indeholder Python-filen til en Lambda-funktion, der forbereder og sender meddelelser (via Amazon SNS) om SageMaker-pipelines trintilstandsændringer/data/– Denne mappe indeholder de rå datafiler (trænings-, inferens- og grundsandhedsdata)/env_files/– Denne mappe indeholder Terraform-inputvariabler-filen/pipeline_scripts/– Denne mappe indeholder tre Python-scripts til oprettelse og opdatering af træning, inferens og træning med HPO SageMaker-pipelines, samt konfigurationsfiler til at specificere hver pipelines parametre/scripts/– Denne mappe indeholder yderligere Python-scripts (såsom forbehandling og evaluering), der refereres til af træningen, slutningen og træningen med HPO-pipelines.gitlab-ci.yml– Denne fil specificerer GitLab CI/CD pipeline-konfigurationen/events.tf– Denne fil definerer EventBridge-ressourcer/lambda.tf– Denne fil definerer Lambda-meddelelsesfunktionen og den tilhørende AWS identitets- og adgangsstyring (IAM) ressourcer/main.tf– Denne fil definerer Terraform-datakilder og lokale variabler/sns.tf– Denne fil definerer Amazon SNS-ressourcer/tags.json– Denne JSON-fil giver dig mulighed for at erklære brugerdefinerede tag-nøgle-værdi-par og tilføje dem til dine Terraform-ressourcer ved hjælp af en lokal variabel/variables.tf– Denne fil erklærer alle Terraform-variablerne

Variabler og konfiguration

Følgende tabel viser de variabler, der bruges til at parametrisere denne løsning. Der henvises til ./env_files/dev_env.tfvars fil for flere detaljer.

| Navn | Beskrivelse |

bucket_name |

S3-bøtte, der bruges til at gemme data, scripts og modelartefakter |

bucket_prefix |

S3-præfiks for ML-projektet |

bucket_train_prefix |

S3 præfiks for træningsdata |

bucket_inf_prefix |

S3-præfiks for inferensdata |

notification_function_name |

Navn på Lambda-funktionen, der forbereder og sender meddelelser om SageMaker-pipelines' trintilstandsændringer |

custom_notification_config |

Konfigurationen til at tilpasse meddelelsesmeddelelsen til specifikke SageMaker-pipeline-trin, når en specifik pipeline-kørselsstatus detekteres |

email_recipient |

E-mailadresselisten til modtagelse af SageMaker pipelines' meddelelser om trintilstandsændringer |

pipeline_inf |

Navn på SageMaker-inferenspipeline |

pipeline_train |

Navn på SageMaker træningspipeline |

pipeline_trainwhpo |

Navn på SageMaker træning med HPO pipeline |

recreate_pipelines |

Hvis indstillet til true, vil de tre eksisterende SageMaker pipelines (træning, inferens, træning med HPO) blive slettet, og nye vil blive oprettet, når GitLab CI/CD køres |

model_package_group_name |

Navn på modelpakkegruppen |

accuracy_mse_threshold |

Maksimal værdi af MSE før der kræves en opdatering af modellen |

role_arn |

IAM-rolle ARN for SageMaker-pipeline-udførelsesrollen |

kms_key |

KMS nøgle ARN til Amazon S3 og SageMaker kryptering |

subnet_id |

Subnet ID til SageMaker netværkskonfiguration |

sg_id |

Sikkerhedsgruppe-id til SageMaker-netværkskonfiguration |

upload_training_data |

Hvis indstillet til true, vil træningsdata blive uploadet til Amazon S3, og denne upload-operation vil udløse kørsel af træningspipeline |

upload_inference_data |

Hvis indstillet til true, vil inferensdata blive uploadet til Amazon S3, og denne upload-operation vil udløse kørslen af inferenspipelinen |

user_id |

SageMaker-brugerens medarbejder-id, der tilføjes som et tag til SageMaker-ressourcer |

Implementer løsningen

Udfør følgende trin for at implementere løsningen på din AWS-konto:

- Klon GitHub-lageret ind i din arbejdsmappe.

- Gennemgå og modificer GitLab CI/CD-pipeline-konfigurationen, så den passer til dit miljø. Konfigurationen er angivet i

./gitlab-ci.ymlfil. - Se README-filen for at opdatere de generelle løsningsvariabler i

./env_files/dev_env.tfvarsfil. Denne fil indeholder variabler for både Python-scripts og Terraform-automatisering.- Tjek de yderligere SageMaker Pipelines-parametre, der er defineret i YAML-filerne under

./batch_scoring_pipeline/pipeline_scripts/. Gennemgå og opdater om nødvendigt parametrene.

- Tjek de yderligere SageMaker Pipelines-parametre, der er defineret i YAML-filerne under

- Gennemgå SageMaker pipeline oprettelsesscripts i

./pipeline_scripts/samt de scripts, der refereres til af dem i./scripts/folder. Eksempler på scripts i GitHub-repoen er baseret på Abalone-datasæt. Hvis du vil bruge et andet datasæt, skal du sørge for at opdatere scripts, så de passer til dit specifikke problem. - Læg dine datafiler i

./data/mappe ved hjælp af følgende navnekonvention. Hvis du bruger Abalone-datasættet sammen med de medfølgende eksempelscripts, skal du sikre dig, at datafilerne er uden overskrift, træningsdataene inkluderer både uafhængige variabler og målvariabler med den oprindelige rækkefølge af kolonner bevaret, slutningsdataene inkluderer kun uafhængige variabler og grundsandheden fil indeholder kun målvariablen.training-data.csvinference-data.csvground-truth.csv

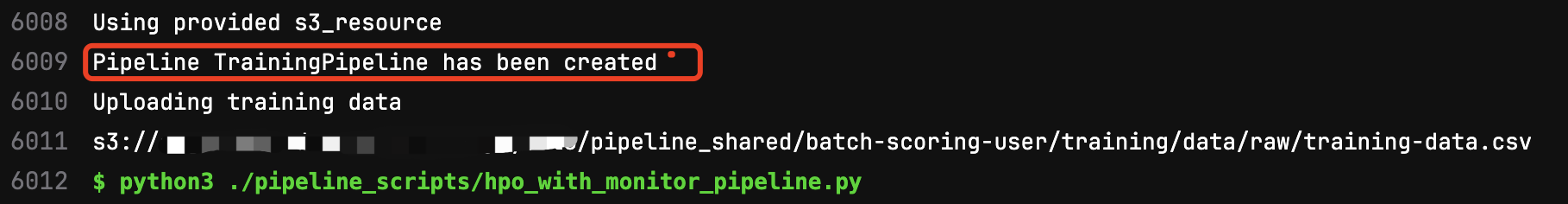

- Commit og skub koden til depotet for at udløse GitLab CI/CD-pipeline-kørslen (første kørsel). Bemærk, at den første pipeline-kørsel vil mislykkes på

pipelinefase, fordi der endnu ikke er nogen godkendt modelversion, som inferenspipeline-scriptet kan bruge. Gennemgå trinloggen og bekræft en ny SageMaker-pipeline med navnetTrainingPipelineer blevet oprettet.

-

- Åbn SageMaker Studio UI, gennemgå og kør derefter træningspipeline.

- Efter den vellykkede kørsel af træningspipelinen, godkend den registrerede modelversion i modelregistret, og kør derefter hele GitLab CI/CD-pipelinen igen.

- Gennemgå Terraform-planens output i

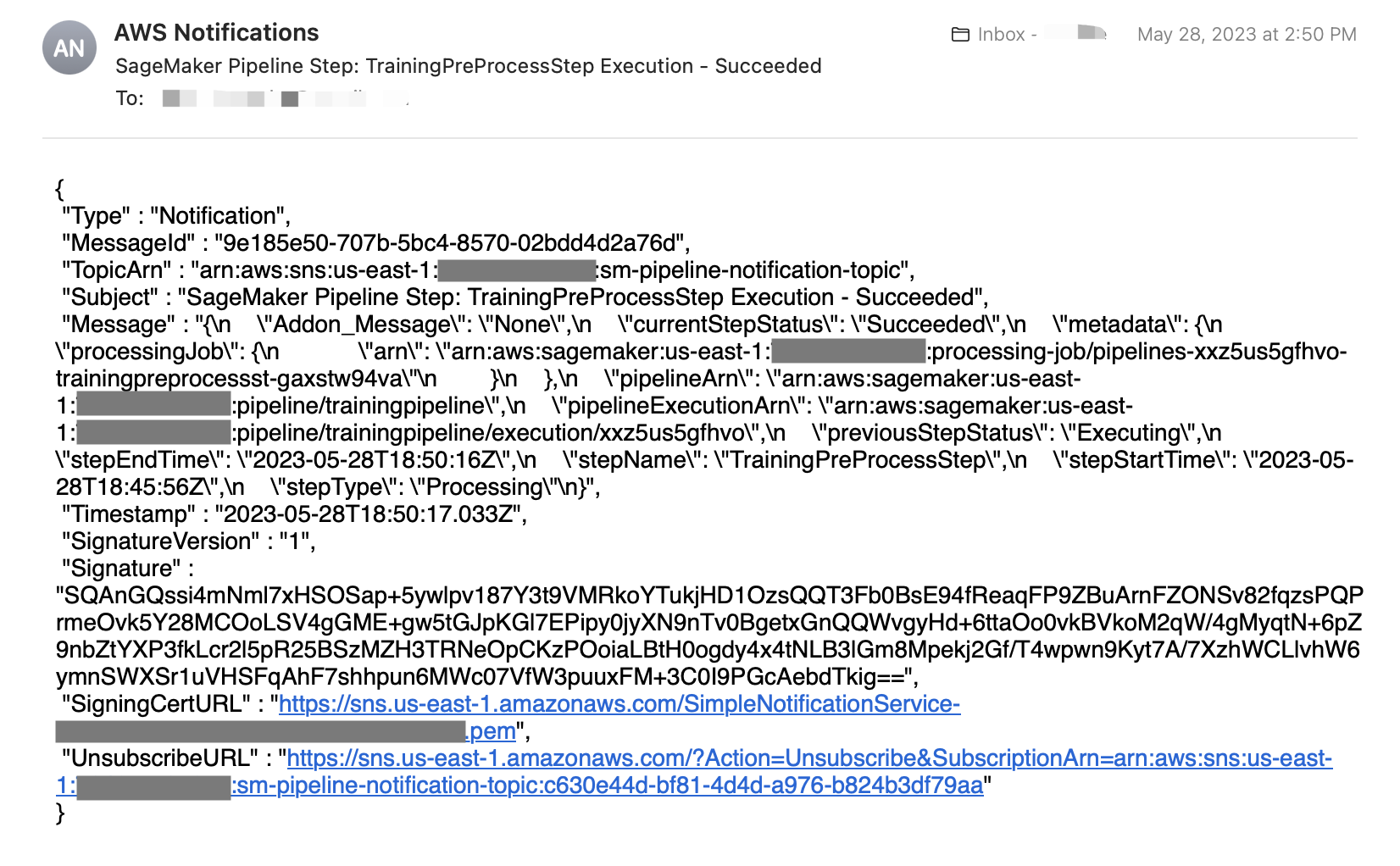

buildscene. Godkend manualenapplyfase i GitLab CI/CD-pipelinen for at genoptage pipeline-kørslen og autorisere Terraform til at oprette overvågnings- og notifikationsressourcerne på din AWS-konto. - Til sidst skal du gennemgå SageMaker-pipelines' kørselsstatus og output i SageMaker Studio-brugergrænsefladen og tjekke din e-mail for meddelelser, som vist på det følgende skærmbillede. Standardmeddelelsens brødtekst er i JSON-format.

SageMaker rørledninger

I dette afsnit beskriver vi de tre SageMaker-pipelines i MLOps-arbejdsgangen.

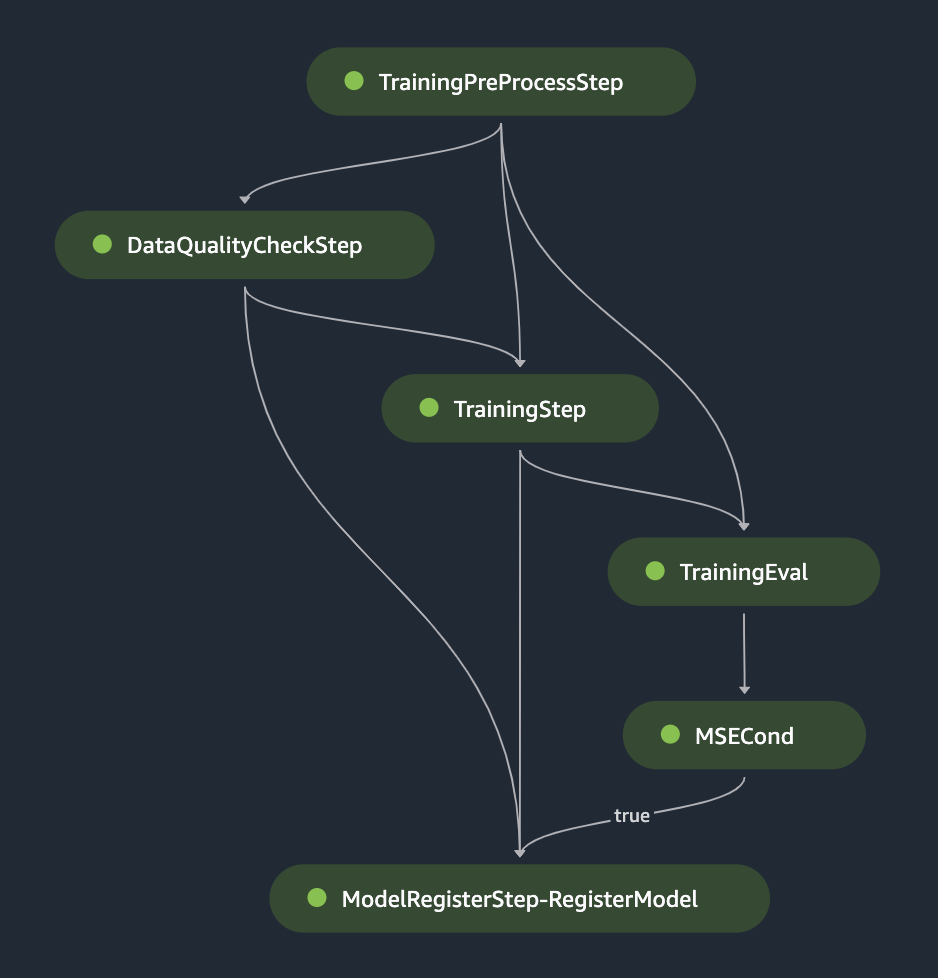

Træningspipeline

Træningspipeline består af følgende trin:

- Forbehandlingstrin, herunder funktionstransformation og kodning

- Datakvalitetstjektrin til generering af datastatistikker og begrænsninger ved brug af træningsdata

- Træningstrin

- Træningsevalueringstrin

- Betingelsestrin for at kontrollere, om den trænede model opfylder en forudbestemt ydeevnetærskel

- Modelregistreringstrin for at registrere den nyligt trænede model i modelregistret, hvis den trænede model opfylder den påkrævede ydeevnetærskel

Både skip_check_data_quality , register_new_baseline_data_quality parametre er indstillet til True i træningspipeline. Disse parametre instruerer pipelinen til at springe over datakvalitetskontrollen og blot oprette og registrere nye datastatistikker eller begrænsninger ved hjælp af træningsdataene. Følgende figur viser en vellykket afvikling af træningspipelinen.

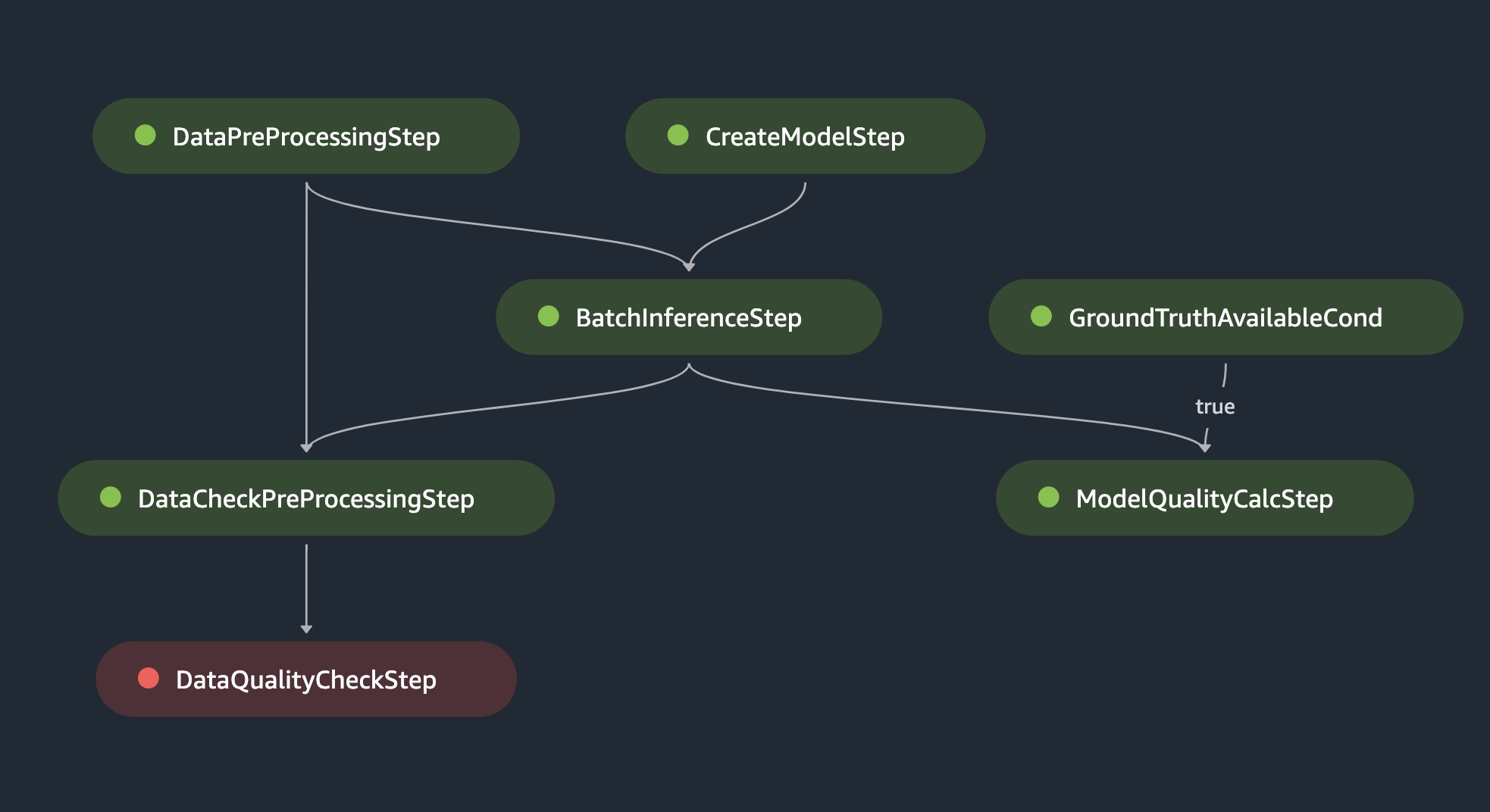

Batch-inferenspipeline

Batch-inferenspipelinen er sammensat af følgende trin:

- Oprettelse af en model fra den seneste godkendte modelversion i modelregistret

- Forbehandlingstrin, herunder funktionstransformation og kodning

- Batch-inferenstrin

- Forbehandlingstrin for datakvalitetstjek, som opretter en ny CSV-fil, der indeholder både inputdata og modelforudsigelser, der skal bruges til datakvalitetskontrollen

- Datakvalitetstjektrin, som kontrollerer inputdataene mod basisstatistikker og begrænsninger forbundet med den registrerede model

- Betingelsestrin for at kontrollere, om jordsandhedsdata er tilgængelige. Hvis jordsandhedsdata er tilgængelige, udføres modelkvalitetskontrollen

- Modelkvalitetsberegningstrin, som beregner modellens ydeevne baseret på jordsandhedsetiketter

Både skip_check_data_quality , register_new_baseline_data_quality parametre er indstillet til False i slutningspipeline. Disse parametre instruerer pipelinen til at udføre et datakvalitetstjek ved hjælp af datastatistikken eller begrænsningerne, der er knyttet til den registrerede model (supplied_baseline_statistics_data_quality , supplied_baseline_constraints_data_quality) og spring over at oprette eller registrere nye datastatistikker og begrænsninger under inferens. Den følgende figur illustrerer en kørsel af batch-inferens-pipelinen, hvor datakvalitetstjektrinet mislykkedes på grund af modellens dårlige ydeevne på inferensdataene. I dette særlige tilfælde vil træningen med HPO pipeline blive udløst automatisk for at finjustere modellen.

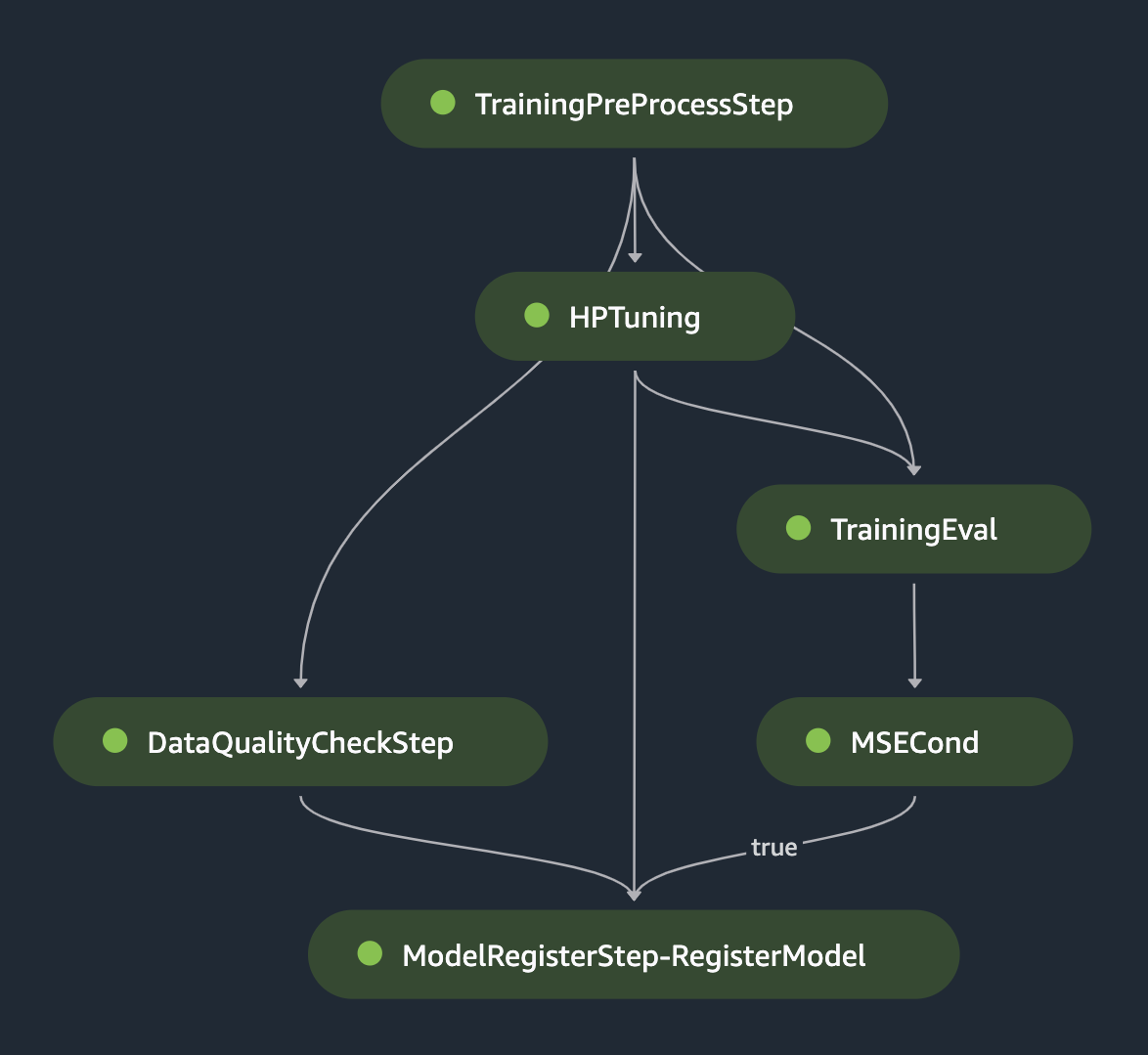

Træning med HPO pipeline

Træningen med HPO pipeline er sammensat af følgende trin:

- Forbehandlingstrin (funktionstransformation og kodning)

- Datakvalitetstjektrin til generering af datastatistikker og begrænsninger ved brug af træningsdata

- Trin til justering af hyperparametre

- Træningsevalueringstrin

- Betingelsestrin for at kontrollere, om den trænede model opfylder en forudbestemt nøjagtighedstærskel

- Modelregistreringstrin, hvis den bedst trænede model opfylder den krævede nøjagtighedstærskel

Både skip_check_data_quality , register_new_baseline_data_quality parametre er indstillet til True i uddannelsen med HPO pipeline. Følgende figur viser en vellykket afvikling af træningen med HPO-pipeline.

Ryd op

Udfør følgende trin for at rydde op i dine ressourcer:

- Ansæt den

destroyfase i GitLab CI/CD-pipelinen for at eliminere alle ressourcer leveret af Terraform. - Brug AWS CLI til liste , Fjern eventuelle resterende pipelines, der er oprettet af Python-scripts.

- Slet eventuelt andre AWS-ressourcer, såsom S3-bøtten eller IAM-rollen, der er oprettet uden for CI/CD-pipelinen.

Konklusion

I dette indlæg demonstrerede vi, hvordan virksomheder kan skabe MLOps-arbejdsgange til deres batch-inferensjob ved hjælp af Amazon SageMaker, Amazon EventBridge, AWS Lambda, Amazon SNS, HashiCorp Terraform og GitLab CI/CD. Den præsenterede arbejdsgang automatiserer data- og modelovervågning, modeloplæring samt batchjobkørsel, kodeversionering og infrastrukturklargøring. Dette kan føre til betydelige reduktioner i kompleksitet og omkostninger ved at opretholde batch-inferensjob i produktionen. For flere oplysninger om implementeringsdetaljer, se GitHub repo.

Om forfatterne

Hasan Shojaei er en Sr. Data Scientist med AWS Professional Services, hvor han hjælper kunder på tværs af forskellige brancher såsom sport, forsikring og finansielle tjenester med at løse deres forretningsmæssige udfordringer gennem brug af big data, machine learning og cloud-teknologier. Forud for denne rolle ledede Hasan flere initiativer til at udvikle nye fysikbaserede og datadrevne modelleringsteknikker til topenergiselskaber. Uden for arbejdet brænder Hasan for bøger, vandreture, fotografering og historie.

Hasan Shojaei er en Sr. Data Scientist med AWS Professional Services, hvor han hjælper kunder på tværs af forskellige brancher såsom sport, forsikring og finansielle tjenester med at løse deres forretningsmæssige udfordringer gennem brug af big data, machine learning og cloud-teknologier. Forud for denne rolle ledede Hasan flere initiativer til at udvikle nye fysikbaserede og datadrevne modelleringsteknikker til topenergiselskaber. Uden for arbejdet brænder Hasan for bøger, vandreture, fotografering og historie.

Wenxin Liu er Sr. Cloud Infrastructure Architect. Wenxin rådgiver virksomhedsvirksomheder om, hvordan de kan accelerere cloud-adoption og understøtter deres innovationer i skyen. Han elsker kæledyr og brænder for snowboarding og rejser.

Wenxin Liu er Sr. Cloud Infrastructure Architect. Wenxin rådgiver virksomhedsvirksomheder om, hvordan de kan accelerere cloud-adoption og understøtter deres innovationer i skyen. Han elsker kæledyr og brænder for snowboarding og rejser.

Vivek Lakshmanan er Machine Learning Engineer hos Amazon. Han har en kandidatgrad i Software Engineering med speciale i Data Science og flere års erfaring som MLE. Vivek er begejstret for at anvende banebrydende teknologier og bygge AI/ML-løsninger til kunder i skyen. Han brænder for statistik, NLP og modelforklarlighed i AI/ML. I sin fritid nyder han at spille cricket og tage på roadtrips.

Vivek Lakshmanan er Machine Learning Engineer hos Amazon. Han har en kandidatgrad i Software Engineering med speciale i Data Science og flere års erfaring som MLE. Vivek er begejstret for at anvende banebrydende teknologier og bygge AI/ML-løsninger til kunder i skyen. Han brænder for statistik, NLP og modelforklarlighed i AI/ML. I sin fritid nyder han at spille cricket og tage på roadtrips.

Andy Cracchiolo er en Cloud Infrastructure Architect. Med mere end 15 år i it-infrastruktur er Andy en dygtig og resultatdreven it-professionel. Ud over at optimere it-infrastruktur, drift og automatisering har Andy en dokumenteret track record i at analysere it-drift, identificere uoverensstemmelser og implementere procesforbedringer, der øger effektiviteten, reducerer omkostningerne og øger overskuddet.

Andy Cracchiolo er en Cloud Infrastructure Architect. Med mere end 15 år i it-infrastruktur er Andy en dygtig og resultatdreven it-professionel. Ud over at optimere it-infrastruktur, drift og automatisering har Andy en dokumenteret track record i at analysere it-drift, identificere uoverensstemmelser og implementere procesforbedringer, der øger effektiviteten, reducerer omkostningerne og øger overskuddet.

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk dig selv. Adgang her.

- PlatoAiStream. Web3 intelligens. Viden forstærket. Adgang her.

- PlatoESG. Automotive/elbiler, Kulstof, CleanTech, Energi, Miljø, Solenergi, Affaldshåndtering. Adgang her.

- PlatoHealth. Bioteknologiske og kliniske forsøgs intelligens. Adgang her.

- ChartPrime. Løft dit handelsspil med ChartPrime. Adgang her.

- BlockOffsets. Modernisering af miljømæssig offset-ejerskab. Adgang her.

- Kilde: https://aws.amazon.com/blogs/machine-learning/mlops-for-batch-inference-with-model-monitoring-and-retraining-using-amazon-sagemaker-hashicorp-terraform-and-gitlab-ci-cd/

- :har

- :er

- :ikke

- :hvor

- $OP

- 100

- 125

- 13

- 15 år

- 15 %

- 26 %

- 29

- 500

- 7

- a

- Om

- fremskynde

- adgang

- gennemført

- Konto

- Konti

- nøjagtighed

- tværs

- faktiske

- tilføjet

- tilføje

- Desuden

- Yderligere

- adresse

- Vedtagelse

- mod

- AI / ML

- Alle

- tillader

- sammen

- også

- Amazon

- Amazon SageMaker

- Amazon Web Services

- an

- analysere

- ,

- og infrastruktur

- enhver

- api

- Anvendelse

- Application Development

- Anvendelse

- tilgang

- passende

- godkendelse

- godkendelser

- Godkend

- godkendt

- arkitektur

- ER

- AS

- aspekter

- forbundet

- At

- auditabilitet

- bemyndige

- auto

- automater

- Automatisk Ur

- automatisk

- Automation

- til rådighed

- AWS

- AWS Lambda

- AWS Professional Services

- baseret

- Baseline

- BE

- fordi

- været

- før

- gavner det dig

- BEDSTE

- bedste praksis

- Big

- Big data

- board

- krop

- Bøger

- både

- Branch

- Bygning

- bygget

- virksomhed

- by

- beregner

- beregning

- ringe

- ringer

- CAN

- tilfælde

- central

- udfordringer

- udfordrende

- lave om

- Ændringer

- skiftende

- kontrollere

- kontrol

- Kontrol

- klassificering

- Cloud

- cloud adoption

- sky infrastruktur

- kode

- Kolonner

- Virksomheder

- sammenligne

- fuldføre

- kompleksiteter

- Compliance

- sammensat

- Konceptet

- Konfiguration

- sammenholdt

- begrænsninger

- indeholder

- kontinuerlig

- kontrol

- kontrol

- Konventionen

- Omkostninger

- kunne

- skabe

- oprettet

- skaber

- Oprettelse af

- skabelse

- cricket

- skik

- Kunder

- banebrydende

- data

- datalogi

- dataforsker

- datastyret

- erklærer

- Standard

- definerede

- definerer

- Degree

- levering

- demonstrere

- demonstreret

- indsætte

- indsat

- implementering

- beskrive

- Design

- detail

- detaljer

- opdaget

- udvikle

- Udvikling

- forskellige

- retning

- direkte

- mapper

- opdager

- diskutere

- Docker

- gør

- Er ikke

- grund

- i løbet af

- hver

- lettere

- effektivt

- effektivitet

- effektiv

- enten

- eliminere

- Medarbejder

- energi

- ingeniør

- Engineering

- forbedringer

- sikre

- sikring

- Enterprise

- virksomheder

- Hele

- Miljø

- fejl

- evaluering

- begivenhed

- eksempel

- overstiger

- ophidset

- udførelse

- eksisterende

- erfaring

- f1

- FAIL

- mislykkedes

- mislykkes

- Feature

- Figur

- File (Felt)

- Filer

- finansielle

- finansielle tjenesteydelser

- Fornavn

- fast

- efter

- Til

- format

- fundet

- fra

- funktion

- funktioner

- Gates

- Generelt

- genereret

- generere

- Git

- GitHub

- Go

- gå

- større

- Ground

- gruppe

- vejledning

- hånd

- Håndtering

- Have

- he

- hjælper

- hans

- historie

- Hvordan

- How To

- HTML

- http

- HTTPS

- Hyperparameter optimering

- ID

- identificere

- Identity

- if

- illustrerer

- implementering

- gennemføre

- in

- omfatter

- omfatter

- Herunder

- Forøg

- uafhængig

- uafhængigt

- angiver

- individuel

- industrier

- oplysninger

- Infrastruktur

- initiativer

- innovationer

- indgang

- indgange

- forsikring

- integration

- interagerer

- ind

- indføre

- spørgsmål

- IT

- ITS

- Job

- Karriere

- jpg

- json

- lige

- Nøgle

- Etiketter

- seneste

- føre

- læring

- Led

- livscyklus

- Line (linje)

- Liste

- lokale

- log

- maskine

- machine learning

- Main

- Vedligeholdelse

- lave

- administrere

- ledelse

- styring

- manuel

- manuelt

- markeret

- herres

- materiale

- Mød

- opfylder

- besked

- beskeder

- metrisk

- Metrics

- ML

- MLOps

- model

- modellering

- modeller

- ændre

- overvågning

- mere

- flere

- Som hedder

- navngivning

- nødvendig

- Behov

- behov

- behov

- netværk

- Ny

- nyligt

- NLP

- ingen

- underretning

- meddelelser

- roman

- objekt

- opnå

- opnå

- of

- tilbyde

- Tilbud

- tit

- on

- dem

- kun

- drift

- Produktion

- optimering

- optimering

- or

- ordrer

- organisationer

- Organiseret

- original

- Andet

- output

- uden for

- pakke

- pakker

- par

- parametre

- del

- særlig

- gennemløb

- lidenskabelige

- sti

- Udfør

- ydeevne

- udføres

- fotografering

- pipeline

- fly

- planlagt

- plato

- Platon Data Intelligence

- PlatoData

- spiller

- Punkt

- fattige

- Indlæg

- praksis

- Forudsigelser

- Forbereder

- forudsætninger

- præsentere

- forelagt

- Forud

- Problem

- Fortsæt

- behandle

- Behandlet

- produktion

- professionel

- overskud

- fremmes

- foreslog

- gennemprøvet

- forudsat

- giver

- leverer

- Sweatre & trøjer

- Skub ud

- Python

- kvalitet

- Raw

- Læs

- Læsning

- modtager

- modtagende

- nylige

- optage

- reducere

- reducere

- om

- register

- registreret

- registrering

- registre

- Registrering

- register

- regelmæssigt

- resterende

- gentagelig

- Rapporter

- Repository

- repræsenterer

- påkrævet

- Krav

- Kræver

- Ressourcer

- dem

- henholdsvis

- ansvarlige

- Resultater

- Genoptag

- genanvendelige

- gennemgå

- vej

- roller

- regler

- Kør

- runner

- kører

- løber

- sagemaker

- SageMaker Inference

- SageMaker Pipelines

- Skalerbarhed

- planlægge

- planlægning

- Videnskab

- Videnskabsmand

- score

- scripts

- SDK

- Sektion

- send

- afsendelse

- sender

- tjener

- tjener

- Tjenester

- sæt

- setup

- flere

- delt

- bør

- vist

- Shows

- signifikant

- Simpelt

- enkelt

- Software

- software Engineering

- løsninger

- Løsninger

- SOLVE

- Kilder

- Sourcing

- specifikke

- specificeret

- Sport

- Stage

- iscenesættelse

- starte

- Starter

- Tilstand

- statistik

- Status

- Trin

- Steps

- opbevaring

- butik

- lagring

- Strategi

- strukturel

- Studio

- vellykket

- Succesfuld

- sådan

- Dragt

- Støtte

- Understøtter

- bord

- TAG

- tager

- mål

- Opgaver

- hold

- teknikker

- Teknologier

- skabelon

- terraform

- end

- at

- deres

- Them

- derefter

- Der.

- derved

- Disse

- de

- denne

- tre

- tærskel

- Gennem

- tid

- til

- værktøjer

- top

- Emner

- spor

- historik

- uddannet

- Kurser

- Transformation

- gennemsigtig

- Traveling

- udløse

- udløst

- Sandheden

- TUR

- to

- typen

- typisk

- ui

- under

- understregninger

- Opdatering

- opdatering

- uploadet

- Uploading

- brug

- anvendte

- Bruger

- bruger

- ved brug af

- udnytte

- udnyttet

- værdi

- variabel

- verificere

- udgave

- versioner

- via

- KRÆNKELSE

- advarsel

- Vej..

- måder

- we

- web

- webservices

- GODT

- hvornår

- hvorvidt

- som

- mens

- WHO

- vilje

- med

- inden for

- Arbejde

- workflow

- arbejdsgange

- arbejder

- yaml

- år

- endnu

- Du

- Din

- zephyrnet