Moderne chatbots kan fungere som digitale agenter, hvilket giver en ny mulighed for at levere 24/7 kundeservice og support på tværs af mange brancher. Deres popularitet stammer fra evnen til at svare på kundeforespørgsler i realtid og håndtere flere forespørgsler samtidigt på forskellige sprog. Chatbots tilbyder også værdifuld datadrevet indsigt i kundeadfærd, mens de skaleres ubesværet, efterhånden som brugerbasen vokser; derfor præsenterer de en omkostningseffektiv løsning til at engagere kunder. Chatbots bruger de avancerede naturlige sprogfunktioner i store sprogmodeller (LLM'er) til at svare på kundespørgsmål. De kan forstå samtalesprog og reagere naturligt. Chatbots, der blot besvarer grundlæggende spørgsmål, har dog begrænset nytte. For at blive betroede rådgivere skal chatbots give gennemtænkte, skræddersyede svar.

En måde at muliggøre mere kontekstuelle samtaler på er ved at linke chatbotten til interne vidensbaser og informationssystemer. Integrering af proprietære virksomhedsdata fra interne videnbaser gør det muligt for chatbots at kontekstualisere deres svar til hver brugers individuelle behov og interesser. For eksempel kan en chatbot foreslå produkter, der matcher en shoppers præferencer og tidligere køb, forklare detaljer på et sprog tilpasset brugerens ekspertiseniveau eller yde kontosupport ved at få adgang til kundens specifikke optegnelser. Evnen til intelligent at inkorporere information, forstå naturligt sprog og give skræddersyede svar i et samtaleflow gør det muligt for chatbots at levere reel forretningsværdi på tværs af forskellige brugssager.

Det populære arkitekturmønster af Retrieval Augmented Generation (RAG) bruges ofte til at øge brugerforespørgselskontekst og -svar. RAG kombinerer mulighederne for LLM'er med grundlaget i fakta og viden fra den virkelige verden, der kommer fra hentning af relevante tekster og passager fra korpus af data. Disse hentede tekster bruges derefter til at informere og jorde outputtet, hvilket reducerer hallucinationer og forbedrer relevansen.

I dette indlæg illustrerer vi kontekstuel forbedring af en chatbot ved at bruge Vidensbaser for Amazon Bedrock, en fuldt administreret serverløs tjeneste. Vidensbaserne for Amazon Bedrock-integration giver vores chatbot mulighed for at give mere relevante, personlige svar ved at linke brugerforespørgsler til relaterede informationsdatapunkter. Internt, Amazonas grundfjeld bruger indlejringer gemt i en vektordatabase til at øge brugerforespørgselskonteksten under kørsel og aktivere en administreret RAG-arkitekturløsning. Vi bruger Amazon-breve til aktionærer datasæt til at udvikle denne løsning.

Retrieval Augmented Generation

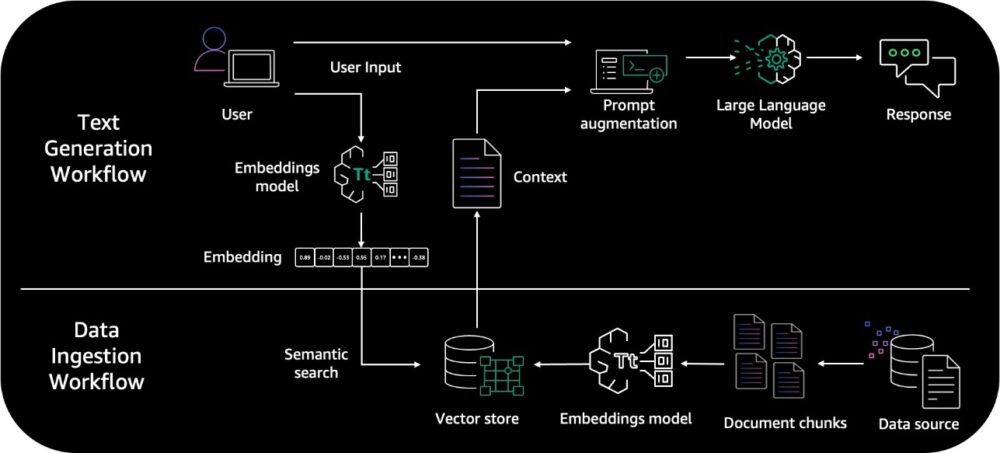

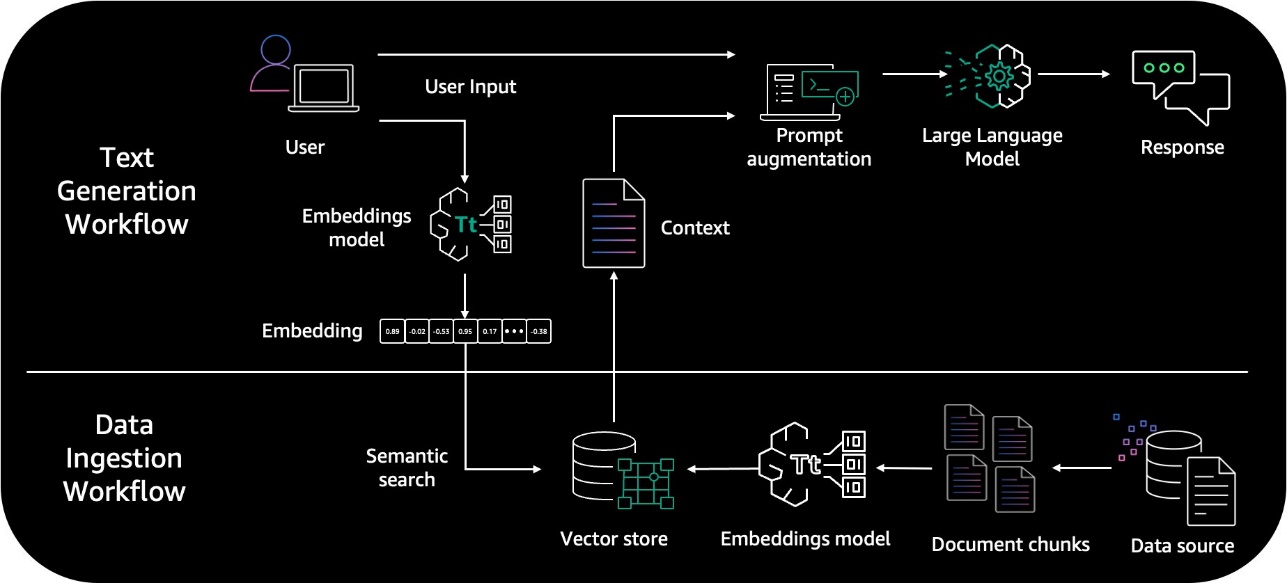

RAG er en tilgang til generering af naturligt sprog, der inkorporerer informationssøgning i genereringsprocessen. RAG-arkitektur involverer to vigtige arbejdsgange: dataforbehandling gennem indtagelse og tekstgenerering ved hjælp af forbedret kontekst.

Workflowet for dataindtagelse bruger LLM'er til at skabe indlejringsvektorer, der repræsenterer teksters semantiske betydning. Indlejringer oprettes til dokumenter og brugerspørgsmål. Dokumentindlejringerne opdeles i bidder og gemmes som indekser i en vektordatabase. Tekstgenereringsarbejdsgangen tager derefter et spørgsmåls indlejringsvektor og bruger den til at hente de mest lignende dokumentstykker baseret på vektorlighed. Det forstærker prompter med disse relevante bidder for at generere et svar ved hjælp af LLM. For flere detaljer henvises til Grundlæggende om genfinding Augmented Generation, Embeddings og Vector Databases afsnit i Forhåndsvisning – Forbind grundmodeller til din virksomheds datakilder med agenter for Amazon Bedrock.

Følgende diagram illustrerer RAG-arkitekturen på højt niveau.

Selvom RAG-arkitekturen har mange fordele, involverer den flere komponenter, herunder en database, genfindingsmekanisme, prompt og generativ model. Håndtering af disse indbyrdes afhængige dele kan introducere kompleksitet i systemudvikling og implementering. Integrationen af genfinding og generering kræver også yderligere ingeniørindsats og beregningsressourcer. Nogle open source-biblioteker leverer indpakninger for at reducere denne overhead; dog kan ændringer i biblioteker introducere fejl og tilføje ekstra overhead til versionsstyring. Selv med open source-biblioteker kræves der en betydelig indsats for at skrive kode, bestemme optimal chunk-størrelse, generere indlejringer og mere. Dette opsætningsarbejde alene kan tage uger afhængigt af datavolumen.

Derfor kunne en administreret løsning, der håndterer disse udifferentierede opgaver, strømline og accelerere processen med at implementere og administrere RAG-applikationer.

Vidensbaser for Amazon Bedrock

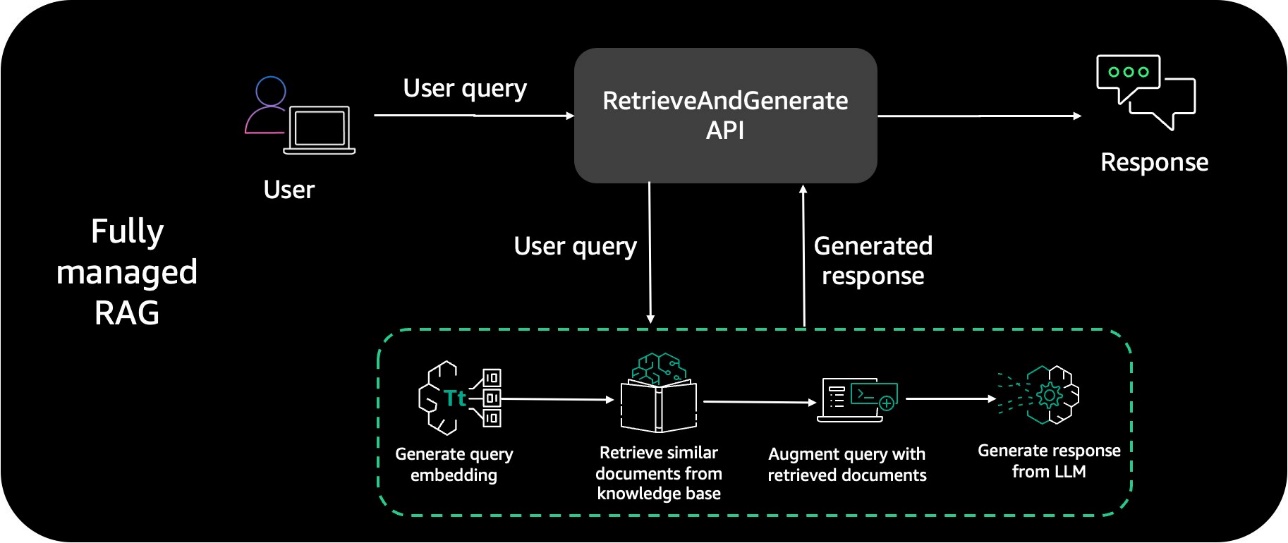

Knowledge Bases for Amazon Bedrock er en serverløs mulighed for at bygge kraftfulde samtale-AI-systemer ved hjælp af RAG. Det tilbyder fuldt administrerede dataindtagelse og tekstgenereringsarbejdsgange.

Til dataindtagelse håndterer den automatisk oprettelse, lagring, styring og opdatering af tekstindlejringer af dokumentdata i vektordatabasen. Det opdeler dokumenterne i håndterbare bidder for effektiv hentning. Klumperne konverteres derefter til indlejringer og skrives til et vektorindeks, samtidig med at du kan se kildedokumenterne, når du besvarer et spørgsmål.

Til tekstgenerering leverer Amazon Bedrock RetrieveAndGenerate API til at skabe indlejringer af brugerforespørgsler og henter relevante bidder fra vektordatabasen for at generere nøjagtige svar. Den understøtter også kildetilskrivning og korttidshukommelse, der er nødvendig for RAG-applikationer.

Dette giver dig mulighed for at fokusere på dine kerneforretningsapplikationer og fjerner de udifferentierede tunge løft.

Løsningsoversigt

Løsningen præsenteret i dette indlæg bruger en chatbot oprettet ved hjælp af en Strømbelyst applikation og inkluderer følgende AWS-tjenester:

Følgende diagram er et almindeligt løsningsarkitekturmønster, du kan bruge til at integrere enhver chatbot-applikation til vidensbaser for Amazon Bedrock.

Denne arkitektur omfatter følgende trin:

- En bruger interagerer med Streamlit chatbot-grænsefladen og sender en forespørgsel på naturligt sprog

- Dette udløser en Lambda-funktion, som påberåber sig vidensbaserne

RetrieveAndGenerateAPI. Internt bruger Knowledge Bases en Amazon Titan indlejringsmodel og konverterer brugerforespørgslen til en vektor og finder bidder, der semantisk ligner brugerforespørgslen. Brugerprompten er så udvidet med de bidder, der hentes fra videnbasen. Spørgsmålet ved siden af den ekstra kontekst sendes derefter til en LLM for generering af svar. I denne løsning bruger vi Antropiske Claude Instant som vores LLM til at generere brugersvar ved hjælp af yderligere kontekst. Bemærk, at denne løsning understøttes i regioner, hvor antropiske Claude på Amazon Bedrock er til rådighed. - Et kontekstuelt relevant svar sendes tilbage til chatbot-applikationen og brugeren.

Forudsætninger

Amazon Bedrock-brugere skal anmode om adgang til fundamentmodeller, før de er tilgængelige til brug. Dette er en engangshandling og tager mindre end et minut. For denne løsning skal du aktivere adgang til Titan Embeddings G1 – Text og Claude Instant – v1.2-modellen i Amazon Bedrock. For mere information, se Modeladgang.

Klon GitHub-repoen

Løsningen præsenteret i dette indlæg er tilgængelig i det følgende GitHub repo. Du skal klone GitHub-lageret til din lokale maskine. Åbn et terminalvindue og kør følgende kommando. Bemærk, at dette er en enkelt git clone-kommando.

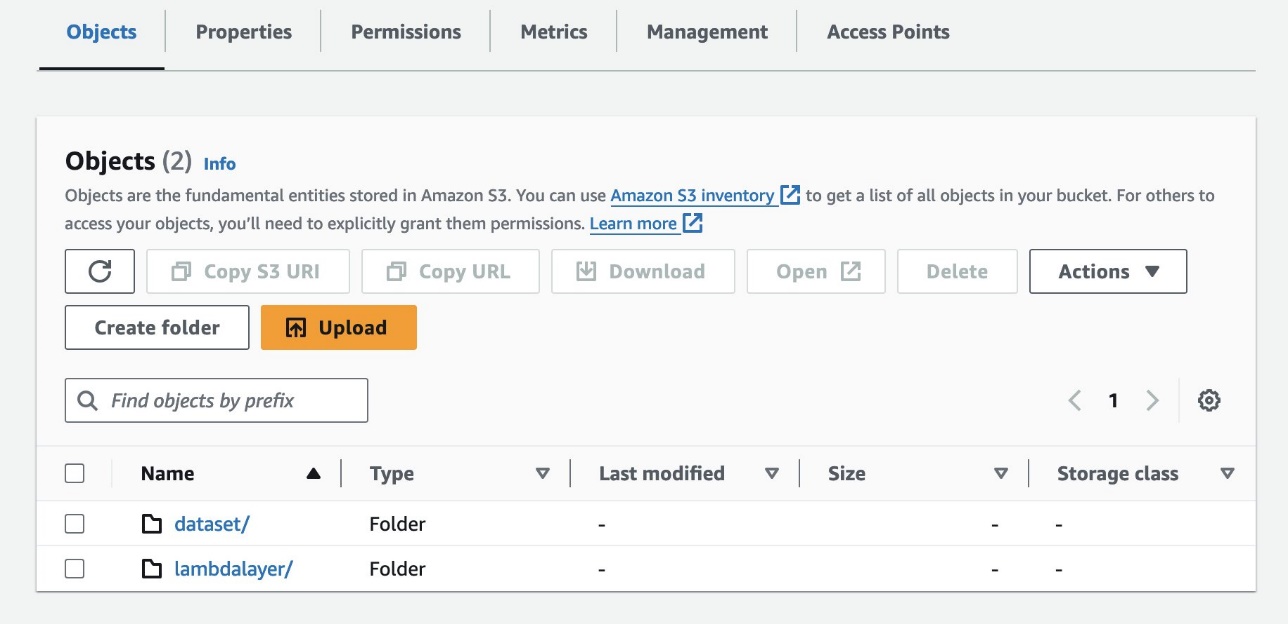

Upload dit vidensdatasæt til Amazon S3

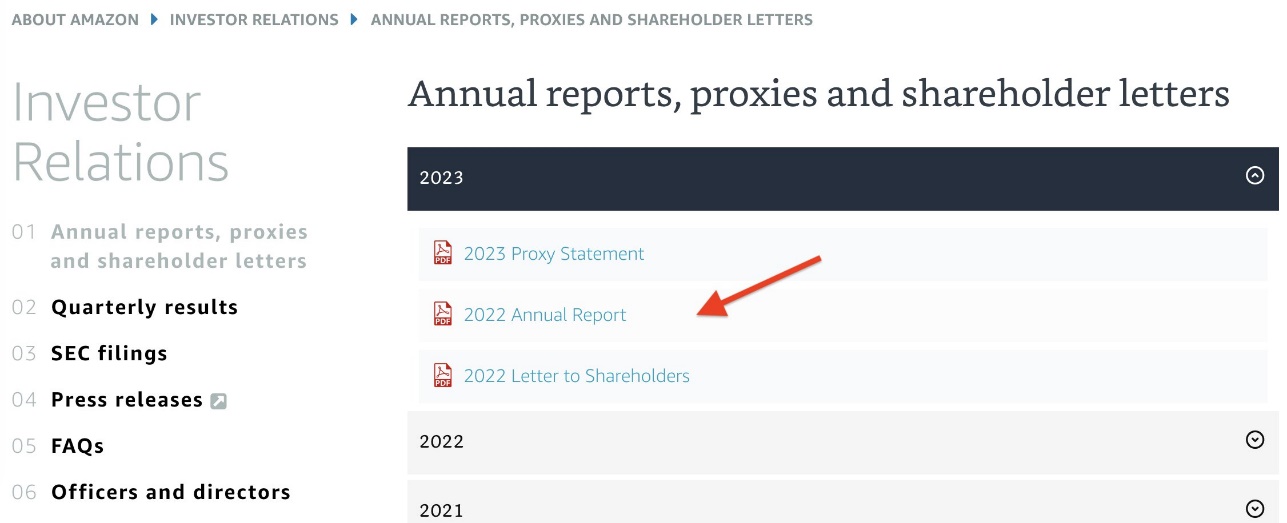

Vi downloader datasættet til vores vidensbase og uploader det til en S3-bøtte. Dette datasæt vil fodre og forsyne videnbasen. Udfør følgende trin:

- Naviger til Årsrapporter, fuldmagter og aktionærbreve datalager og download de sidste par års Amazon-aktionærbreve.

- På Amazon S3-konsollen skal du vælge spande i navigationsruden.

- Vælg Opret spand.

- Navngiv spanden

knowledgebase-<your-awsaccount-number>. - Lad alle andre bøtteindstillinger være standard, og vælg Opret.

- Naviger til

knowledgebase-<your-awsaccount-number>spand. - Vælg oprette mappe og navngiv det datasæt.

- Lad alle andre mappeindstillinger være standard, og vælg Opret.

- Naviger tilbage til bøtten hjem og vælg oprette mappe for at oprette en ny mappe og navngive den

lambdalayer. - Lad alle andre indstillinger være standard, og vælg Opret.

- Naviger til

datasetmappe. - Upload de årsrapporter, fuldmagter og aktionærbreves datasætfiler, du downloadede tidligere til denne bøtte, og vælg Upload.

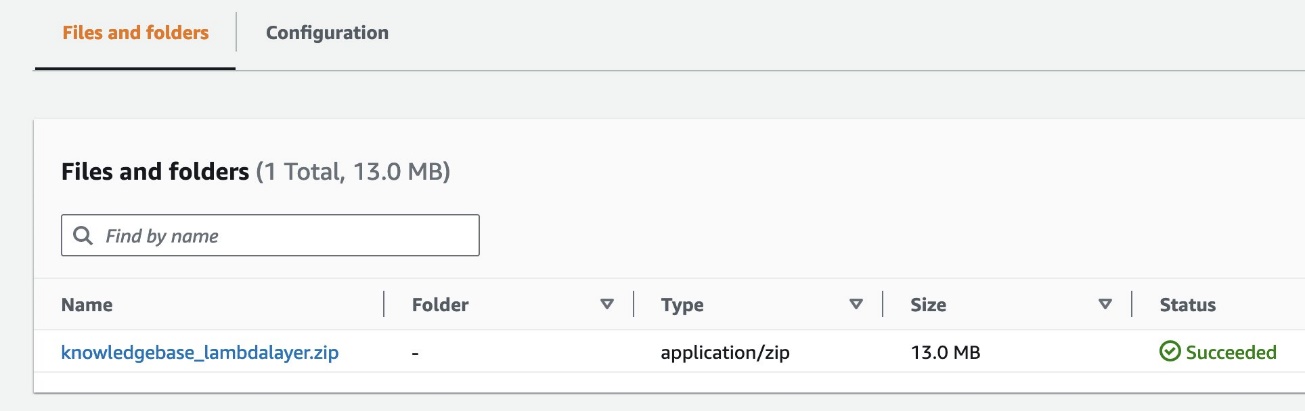

- Naviger til

lambdalayermappe. - Upload

knowledgebase-lambdalayer.zipfil tilgængelig under/lambda/layermappe i GitHub-reposen, du klonede tidligere, og vælg Upload. Du vil bruge denne Lambda-lagkode senere til at oprette Lambda-funktionen.

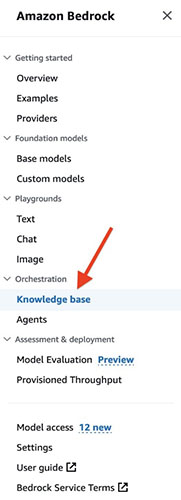

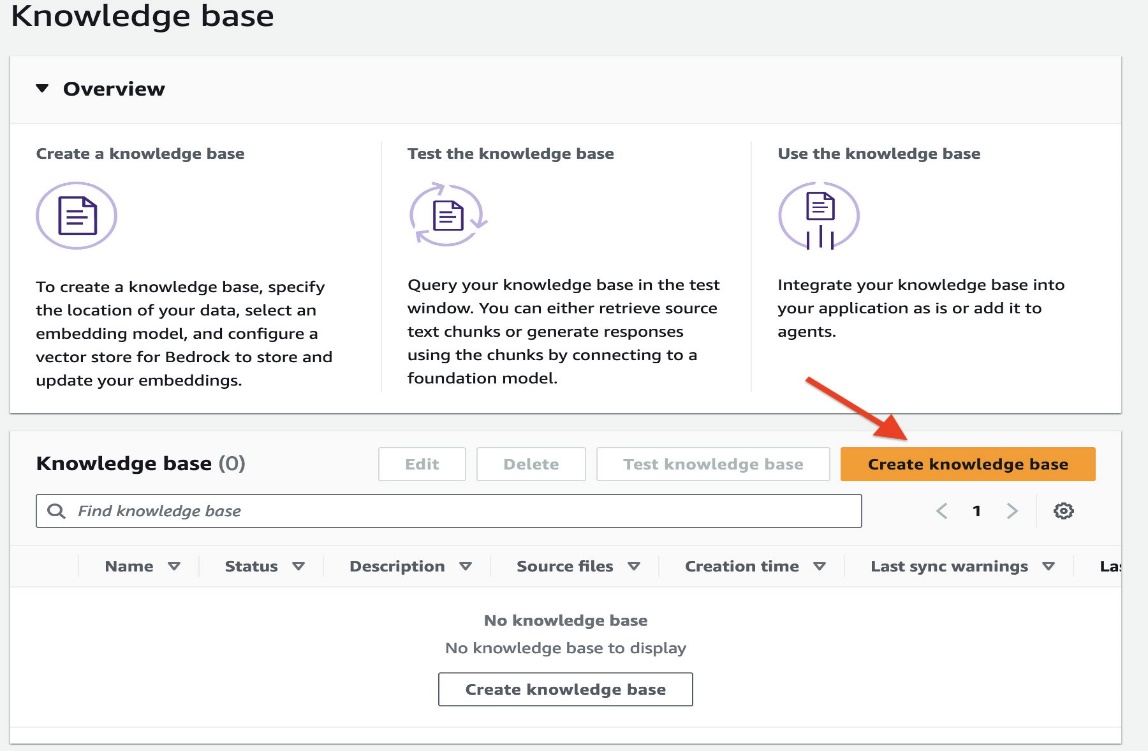

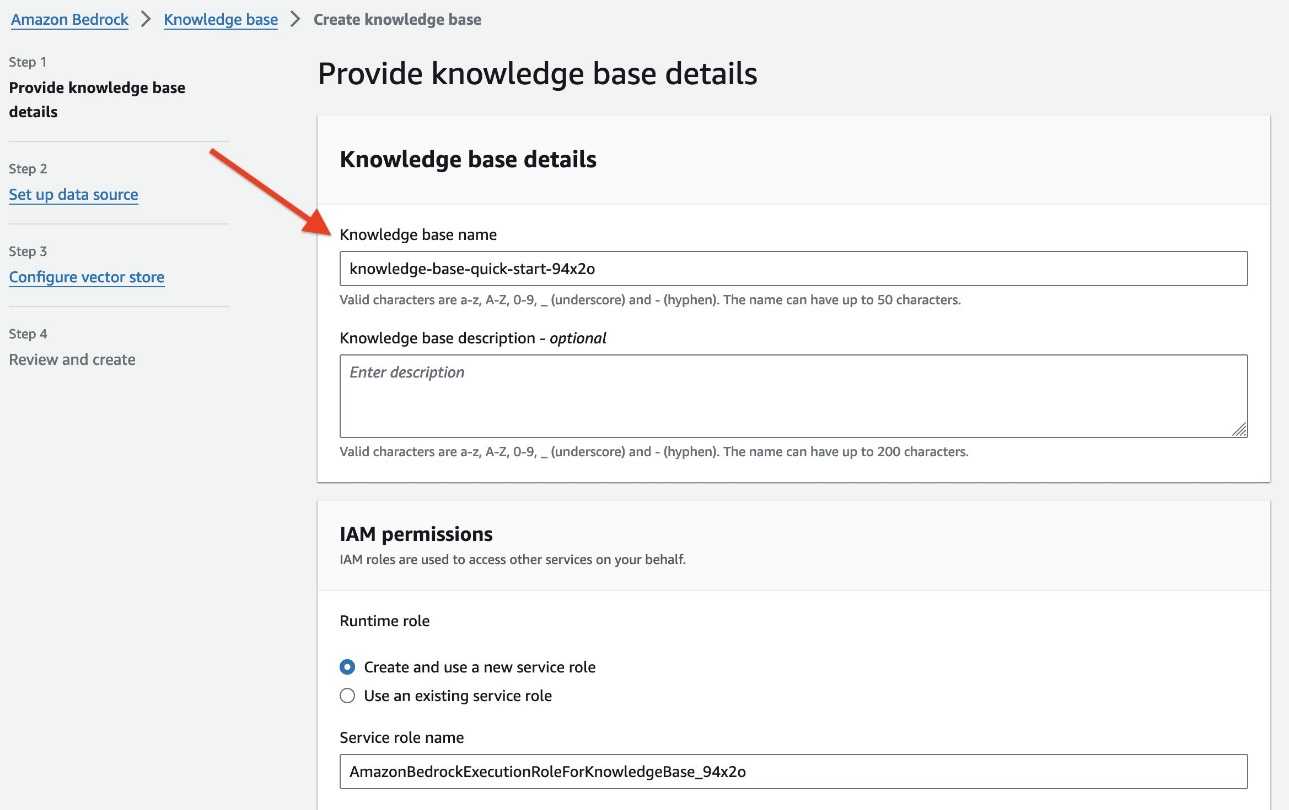

Skab en vidensbase

I dette trin opretter vi en vidensbase ved hjælp af Amazon-aktionærbrevsdatasættet, som vi uploadede til vores S3-spand i det forrige trin.

- På Amazon Bedrock-konsollen, under Orchestration i navigationsruden skal du vælge Vidensdatabase.

- Vælg Skab vidensbase.

- I Vidensbase detaljer skal du indtaste et navn og en valgfri beskrivelse.

- I IAM-tilladelser sektion, vælg Opret og brug en ny servicerolle og indtast et navn til rollen.

- Tilføj tags efter behov.

- Vælg Næste.

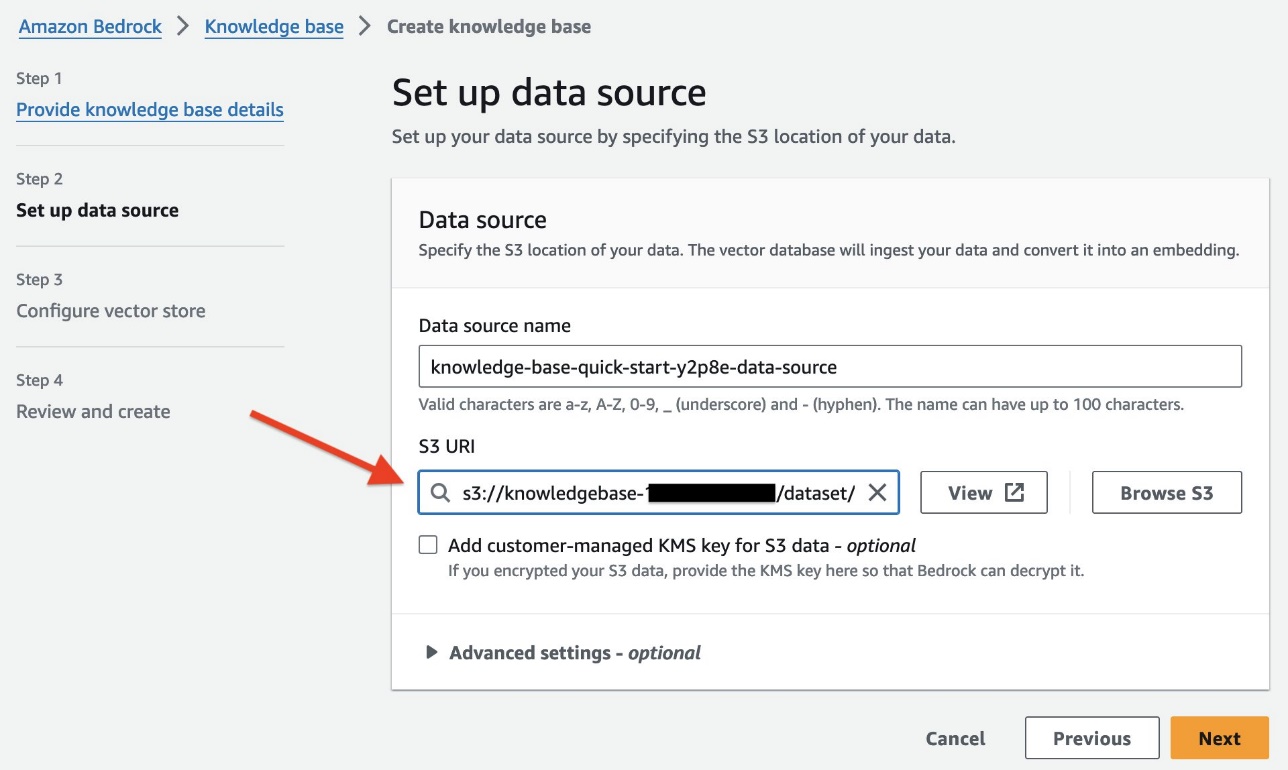

- Forlade Datakildenavn som standardnavn.

- Til S3 URI, vælg Gennemse S3 for at vælge S3 skovlen

knowledgebase-<your-account-number>/dataset/.Du skal pege på den bucket og datamappen, du oprettede i de foregående trin. - I Avancerede indstillinger sektion, skal du forlade standardværdierne (hvis du vil, kan du ændre standard chunking-strategien og angive chunkstørrelsen og overlejringen i procent).

- Vælg Næste.

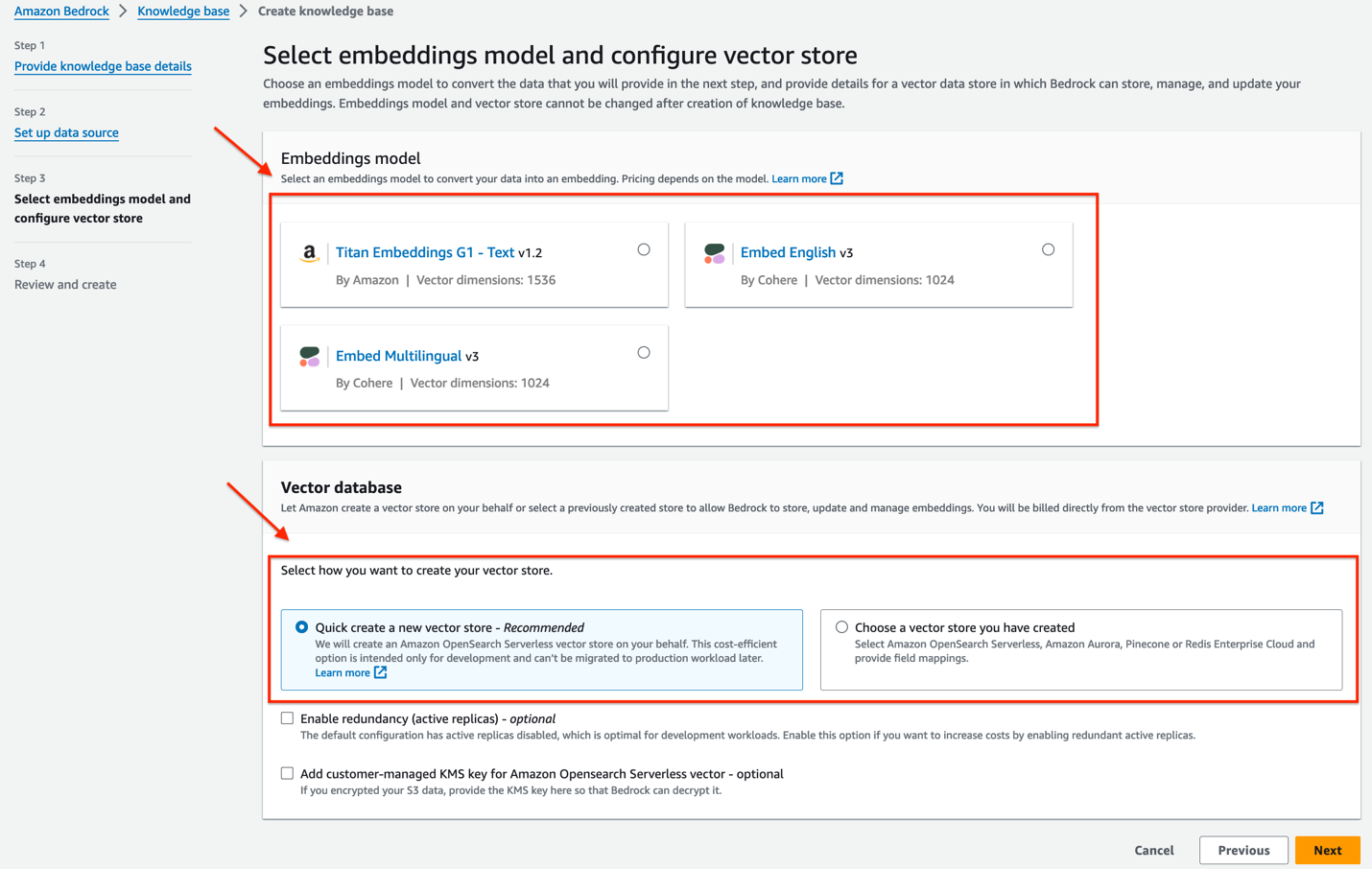

- Til Indstøbningsmodel, Vælg Titan Embedding G1 – Tekst.

- Til Vektor database, kan du enten vælge Opret hurtigt en ny vektorbutik or Vælg en vektorbutik, du har oprettet. Bemærk, at for at bruge vektorlageret efter eget valg, skal du have et vektorlager forudkonfigureret til at bruge. Vi understøtter i øjeblikket fire vektormotortyper: vektormotoren til Amazon OpenSearch Serverless, Amazon Aurora, Pinecone og Redis Enterprise Cloud. Til dette indlæg vælger vi Hurtig oprettelse af en ny vektorbutik, som som standard opretter en ny OpenSearch Serverless vektorbutik på din konto.

- Vælg Næste.

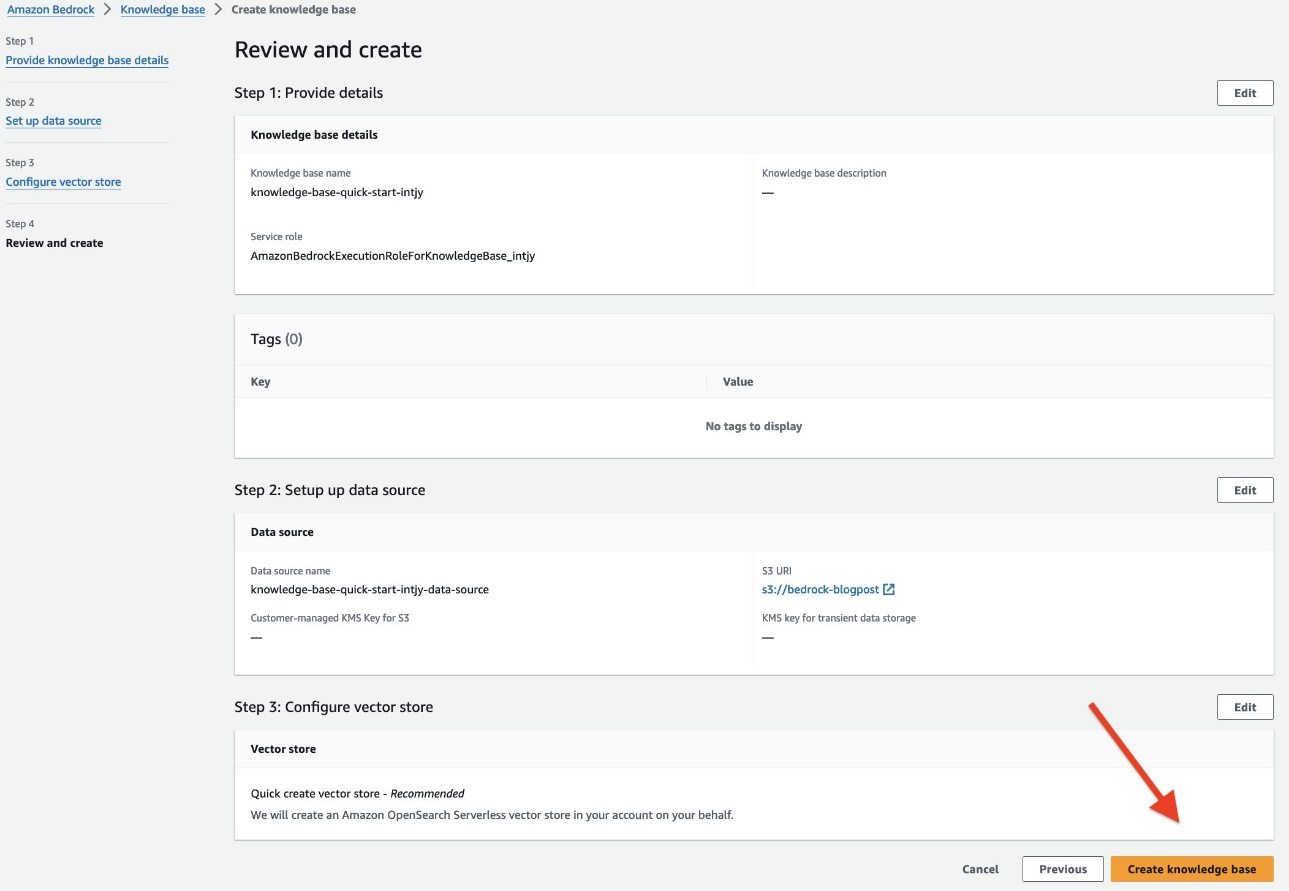

- På Gennemgå og opret side, gennemgå alle oplysningerne, eller vælg Tidligere for at ændre eventuelle muligheder.

- Vælg Skab vidensbase.

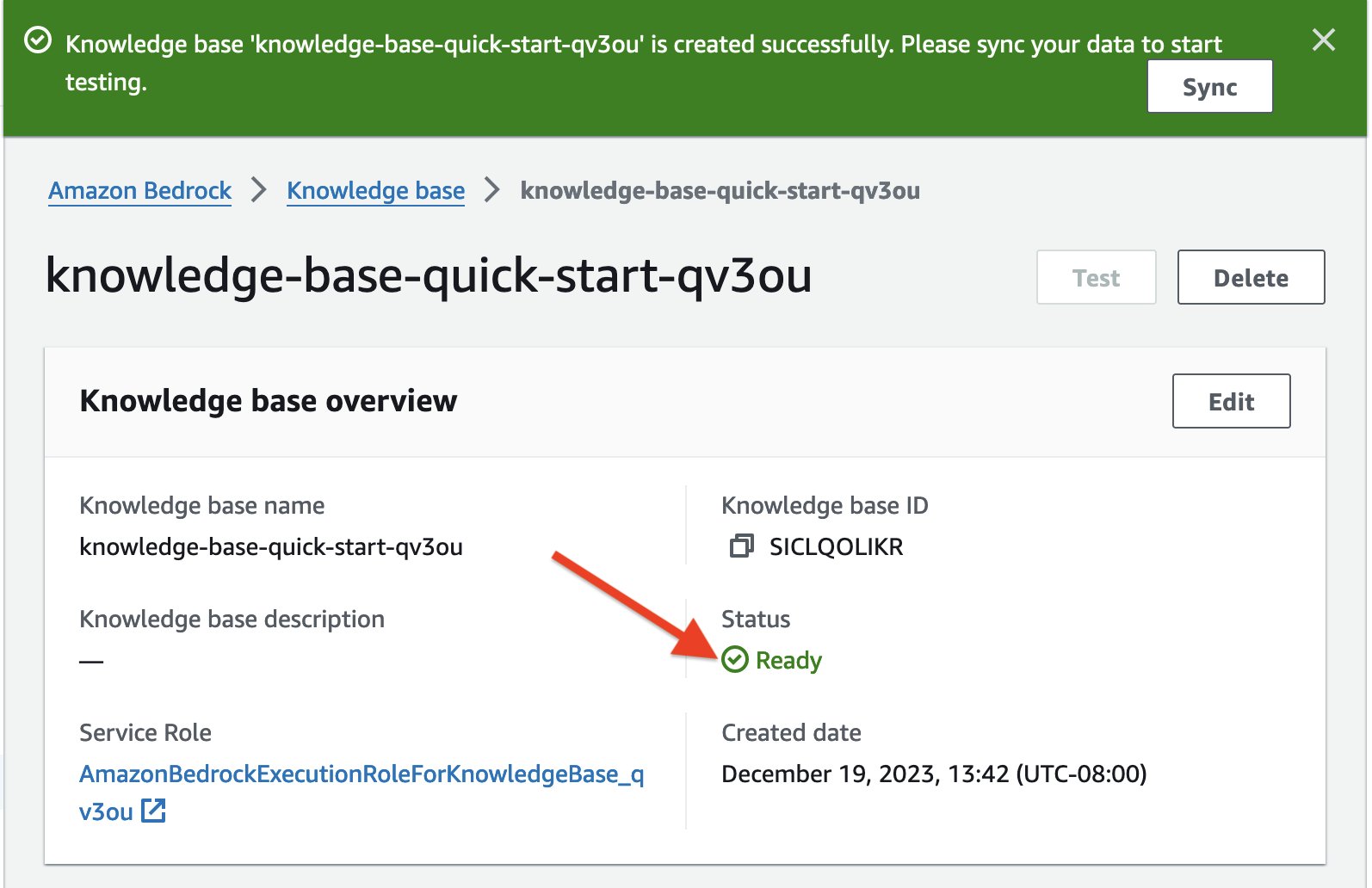

Bemærk, at processen for oprettelse af videnbase begynder, og status er I gang. Det vil tage et par minutter at oprette vektorbutikken og videnbasen. Naviger ikke væk fra siden, ellers vil oprettelsen mislykkes.

Bemærk, at processen for oprettelse af videnbase begynder, og status er I gang. Det vil tage et par minutter at oprette vektorbutikken og videnbasen. Naviger ikke væk fra siden, ellers vil oprettelsen mislykkes. - Når videnbasens status er i

Readystat, noter videnbase-id'et. Du vil bruge det i de næste trin til at konfigurere Lambda-funktionen.

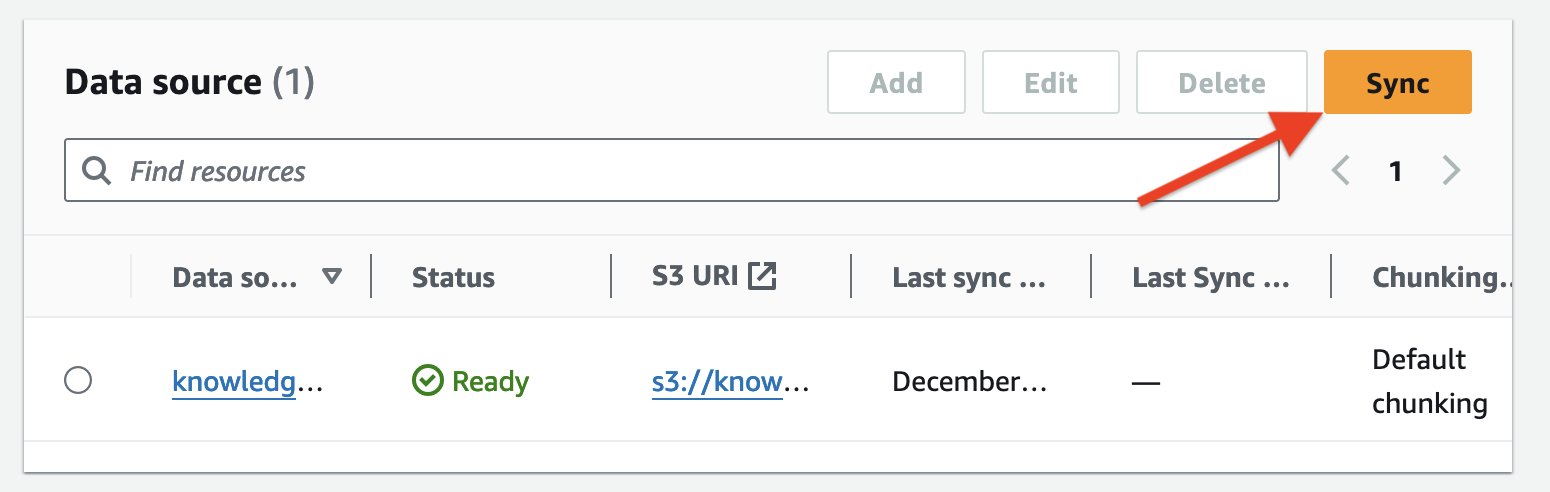

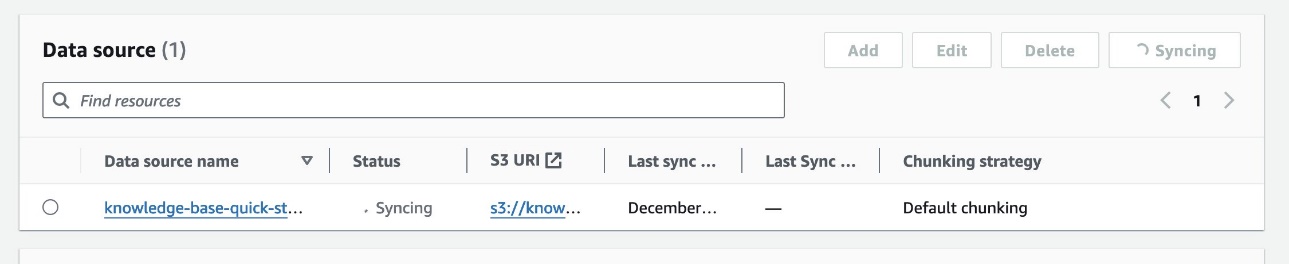

- Nu hvor videnbasen er klar, skal vi synkronisere vores Amazon-aktionærers brevdata til den. I den Datakilde sektionen på siden med vidensbasedetaljer, skal du vælge Synkroniser for at udløse dataindtagelsesprocessen fra S3-bøtten til videnbasen.

Denne synkroniseringsproces opdeler dokumentfilerne i mindre bidder af den tidligere specificerede chunk-størrelse, genererer vektorindlejringer ved hjælp af den valgte tekstindlejringsmodel og gemmer dem i vektorlageret, der administreres af Knowledge Bases for Amazon Bedrock.

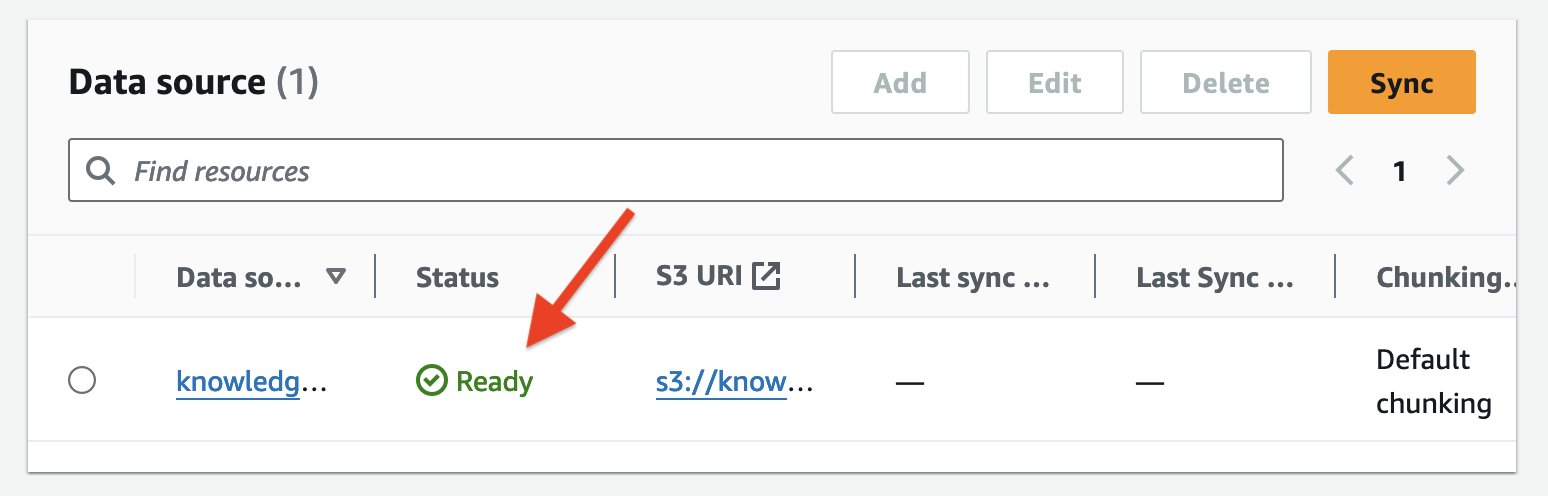

Når datasætsynkroniseringen er fuldført, ændres status for datakilden til Ready stat. Bemærk, at hvis du tilføjer yderligere dokumenter i S3-datamappen, skal du synkronisere videnbasen igen.

Tillykke, din vidensbase er klar.

Bemærk, at du også kan bruge Knowledge Bases til Amazon Bedrock service API'er og AWS kommandolinjegrænseflade (AWS CLI) til programmæssigt at skabe en videnbase. Du bliver nødt til at køre forskellige sektioner af Jupyter-notebook'en, der findes under /notebook mappe i GitHub-reposen.

Opret en Lambda-funktion

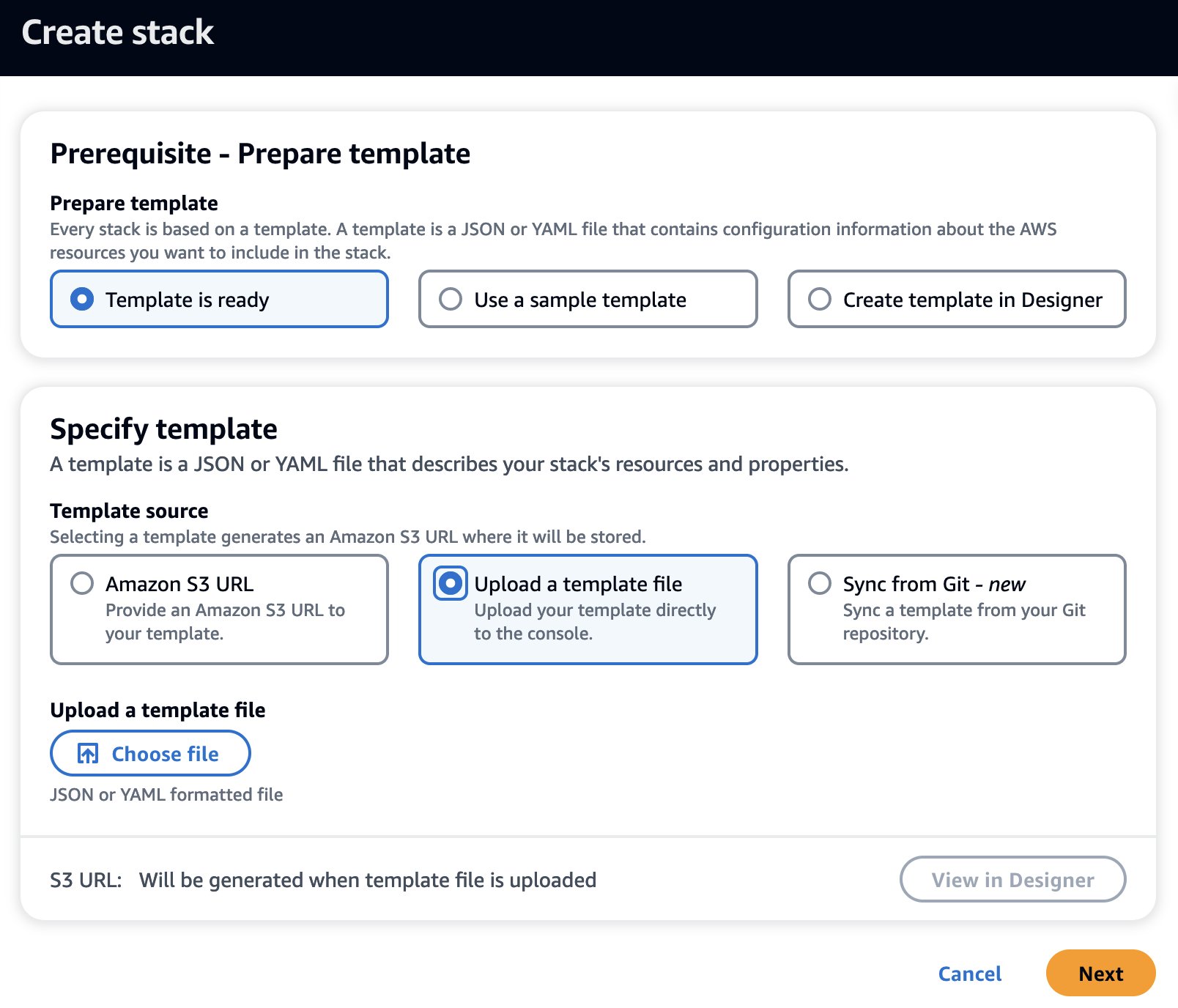

Denne Lambda-funktion implementeres ved hjælp af en AWS CloudFormation skabelon tilgængelig i GitHub-reposen under /cfn folder. Skabelonen kræver to parametre: S3-bøttenavnet og videnbase-id'et.

- På AWS CloudFormation-tjenestens hjemmeside skal du vælge Opret stak for at oprette en ny stak.

- Type Skabelonen er klar forum Forbered skabelon.

- Type Upload skabelonfilen forum Skabelonkilde.

- Vælg Vælg fil, naviger til den GitHub-repo, du klonede tidligere, og vælg .yaml-filen under

/cfnmappe. - Vælg Næste.

- Til Staknavn, indtast et navn.

- I parametre sektion, skal du indtaste videnbase-id'et og S3-indsamlingsnavnet, som du noterede tidligere.

- Vælg Næste.

- Lad alle standardindstillinger være som de er, vælg Næste, og vælg Indsend.

- Bekræft, at CloudFormation-skabelonen kørte korrekt, og at der ikke er nogen fejl.

Tillykke, du har oprettet en Lambda-funktion, relaterede roller og politikker med succes.

Test den kontekstuelle chatbot-applikation

For at teste din chatbot-applikation skal du udføre følgende trin:

- Åbn en ny terminal eller et kommandolinjevindue på din maskine.

- Kør følgende kommando for at installere AWS SDK til Python (Boto3). Boto3 gør det ligetil at integrere en Python-applikation, et bibliotek eller et script med AWS-tjenester.

- Kør følgende kommando for at installere og konfigurere et lokalt Python-udviklingsmiljø til at køre Streamlit-applikationen:

- Naviger til

/streamlitmappe i GitHub-depotmappen, du klonede tidligere. - Kør følgende kommando for at instansiere chatbot-applikationen:

Dette skulle åbne en webbaseret chatapplikation, der drives af Streamlit i din standardwebbrowser.

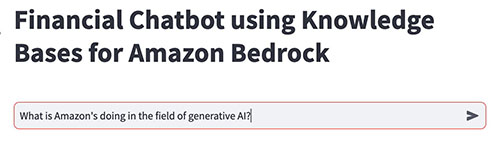

- Brug denne Streamlit chatbot-applikation til at stille spørgsmål om naturlige sprog for at starte samtalerne drevet af Knowledge Bases for Amazon Bedrock.

Når du sender en prompt, udløser Streamlit-appen Lambda-funktionen, som aktiverer vidensbaserne RetrieveAndGenerate API til at søge og generere svar.

Følgende tabel indeholder nogle eksempler på spørgsmål og relaterede videnbasesvar. Prøv nogle af disse spørgsmål ved at bruge prompter.

| Spørgsmål | svar |

| Hvad laver Amazon inden for generativ AI? | Amazon har arbejdet på deres egne store sprogmodeller (LLM'er) til generativ kunstig intelligens og mener, at det vil transformere og forbedre enhver kundeoplevelse. De planlægger at fortsætte med at investere betydeligt i disse modeller på tværs af alle deres forbruger-, sælger-, brand- og skaberoplevelser. |

| Hvad er AWS år-til-år omsætning i 2022? | AWS-omsætningen voksede med 29% år-over-år i 2022 på en omsætningsbase på 62 milliarder USD. |

| Hvor mange dage har Amazon bedt medarbejdere om at komme for at arbejde på kontoret? | Amazon har bedt virksomhedens medarbejdere om at vende tilbage til kontoret mindst tre dage om ugen fra maj 2022. |

| Hvor mange procent voksede AWS-omsætningen år-til-år i 2022? | AWS havde en omsætning på 29 % år-til-år ('YoY') i 2022. |

| Sammenlignet med Graviton2-processorer, hvilken ydeevneforbedring leverede Graviton3-chips ifølge passagen? | I 2022 leverede AWS deres Graviton3-chips, der leverede 25 % bedre ydeevne end Graviton2-processorerne. |

| Hvilken var den første inferenschip, der blev lanceret af AWS ifølge passagen? | AWS lancerede deres første inferenschips ("Inferentia") i 2019, og de har sparet virksomheder som Amazon for over hundrede millioner dollars i kapitaludgifter. |

| Ifølge konteksten, i hvilket år steg Amazons årlige omsætning fra $245B til $434B? | Amazons årlige omsætning steg fra $245B i 2019 til $434B i 2022. |

| Fortæl mig igen, hvad var omsætningen i 2019? | Amazons omsætning i 2019 var $245 milliarder. |

| og 2021? | Amazons omsætning i 2021 var $469.8 milliarder, en stigning på 22% i forhold til 2020. |

| Og mind mig igen, hvornår blev den første inferenschip lanceret? | Amazons første inferenschip var Inferentia, som blev lanceret i 2019. |

Under det første opkald til Lambda-funktionen vil RetrieveAndGenerate API returnerer en sessionId, som derefter sendes af Streamlit-appen sammen med den efterfølgende brugerprompt som input til RetrieveAndGenerate API for at fortsætte samtalen i samme session. Det RetrieveAndGenerate API styrer korttidshukommelsen og bruger chathistorikken, så længe det samme sessionId sendes som input i de efterfølgende opkald.

Tillykke, du har med succes oprettet og testet en chatbot-applikation ved hjælp af Knowledge Bases for Amazon Bedrock.

Ryd op

Undladelse af at slette ressourcer såsom S3-bøtten, OpenSearch Serverless-samlingen og videnbasen vil medføre gebyrer. For at rydde op i disse ressourcer skal du slette CloudFormation-stakken, slette S3-bøtten (inklusive alle dokumentmapper og filer, der er gemt i denne bøtte), slette OpenSearch Serverless-samlingen, slette videnbasen og slette alle roller, politikker og tilladelser, som du oprettet tidligere.

Konklusion

I dette indlæg gav vi et overblik over kontekstuelle chatbots og forklarede, hvorfor de er vigtige. Vi beskrev kompleksiteten involveret i dataindtagelse og tekstgenereringsarbejdsgange for en RAG-arkitektur. Derefter introducerede vi, hvordan Knowledge Bases for Amazon Bedrock skaber et fuldt administreret serverløst RAG-system, inklusive et vektorlager. Endelig leverede vi en løsningsarkitektur og eksempelkode i en GitHub repo at hente og generere kontekstuelle svar til en chatbot-applikation ved hjælp af en vidensbase.

Ved at forklare værdien af kontekstuelle chatbots, udfordringerne ved RAG-systemer og hvordan Knowledge Bases for Amazon Bedrock adresserer disse udfordringer, havde dette indlæg til formål at vise, hvordan Amazon Bedrock sætter dig i stand til at bygge sofistikerede samtale-AI-applikationer med minimal indsats.

For mere information, se Amazon Bedrock Developer Guide , Knowledge Base API'er.

Om forfatterne

Manish Chugh er en Principal Solutions Architect hos AWS med base i San Francisco, Californien. Han har specialiseret sig i maskinlæring og generativ kunstig intelligens. Han arbejder med organisationer lige fra store virksomheder til tidlige startups om problemer relateret til maskinlæring. Hans rolle involverer at hjælpe disse organisationer med at udforme skalerbare, sikre og omkostningseffektive arbejdsbelastninger på AWS. Han præsenterer jævnligt ved AWS-konferencer og andre partnerevents. Uden for arbejdet nyder han at vandre på East Bay-stier, cykle på landevej og se (og spille) cricket.

Manish Chugh er en Principal Solutions Architect hos AWS med base i San Francisco, Californien. Han har specialiseret sig i maskinlæring og generativ kunstig intelligens. Han arbejder med organisationer lige fra store virksomheder til tidlige startups om problemer relateret til maskinlæring. Hans rolle involverer at hjælpe disse organisationer med at udforme skalerbare, sikre og omkostningseffektive arbejdsbelastninger på AWS. Han præsenterer jævnligt ved AWS-konferencer og andre partnerevents. Uden for arbejdet nyder han at vandre på East Bay-stier, cykle på landevej og se (og spille) cricket.

Mani Khanuja er en Tech Lead – Generative AI Specialists, forfatter til bogen Applied Machine Learning and High Performance Computing på AWS og medlem af bestyrelsen for Women in Manufacturing Education Foundation Board. Hun leder maskinlæringsprojekter inden for forskellige domæner såsom computersyn, naturlig sprogbehandling og generativ AI. Hun taler ved interne og eksterne konferencer såsom AWS re:Invent, Women in Manufacturing West, YouTube-webinarer og GHC 23. I sin fritid kan hun godt lide at gå lange løbeture langs stranden.

Mani Khanuja er en Tech Lead – Generative AI Specialists, forfatter til bogen Applied Machine Learning and High Performance Computing på AWS og medlem af bestyrelsen for Women in Manufacturing Education Foundation Board. Hun leder maskinlæringsprojekter inden for forskellige domæner såsom computersyn, naturlig sprogbehandling og generativ AI. Hun taler ved interne og eksterne konferencer såsom AWS re:Invent, Women in Manufacturing West, YouTube-webinarer og GHC 23. I sin fritid kan hun godt lide at gå lange løbeture langs stranden.

Pallavi Nargund er Principal Solutions Architect hos AWS. I sin rolle som cloud-teknologienabler arbejder hun med kunder for at forstå deres mål og udfordringer og give præskriptiv vejledning til at nå deres mål med AWS-tilbud. Hun brænder for kvinder i teknologi og er et kernemedlem af Women in AI/ML hos Amazon. Hun taler ved interne og eksterne konferencer såsom AWS re:Invent, AWS Summits og webinarer. Uden for arbejdet nyder hun frivilligt arbejde, havearbejde, cykle og vandre.

Pallavi Nargund er Principal Solutions Architect hos AWS. I sin rolle som cloud-teknologienabler arbejder hun med kunder for at forstå deres mål og udfordringer og give præskriptiv vejledning til at nå deres mål med AWS-tilbud. Hun brænder for kvinder i teknologi og er et kernemedlem af Women in AI/ML hos Amazon. Hun taler ved interne og eksterne konferencer såsom AWS re:Invent, AWS Summits og webinarer. Uden for arbejdet nyder hun frivilligt arbejde, havearbejde, cykle og vandre.

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk dig selv. Adgang her.

- PlatoAiStream. Web3 intelligens. Viden forstærket. Adgang her.

- PlatoESG. Kulstof, CleanTech, Energi, Miljø, Solenergi, Affaldshåndtering. Adgang her.

- PlatoHealth. Bioteknologiske og kliniske forsøgs intelligens. Adgang her.

- Kilde: https://aws.amazon.com/blogs/machine-learning/build-a-contextual-chatbot-application-using-knowledge-bases-for-amazon-bedrock/

- :har

- :er

- :hvor

- $OP

- 100

- 125

- 2019

- 2020

- 2021

- 2022

- 23

- 27

- 500

- 7

- 8

- 9

- a

- evne

- Om

- fremskynde

- adgang

- Adgang

- Ifølge

- Konto

- præcis

- opnå

- tværs

- Handling

- tilføje

- Yderligere

- adresser

- fremskreden

- fordele

- rådgivere

- igen

- midler

- AI

- AI-systemer

- AI / ML

- Rettet

- Alle

- tillade

- tillader

- alene

- sammen

- langs med

- også

- Amazon

- Amazon Web Services

- an

- ,

- årligt

- ÅRLIG OMSÆTNING

- besvare

- besvarelse

- Antropisk

- enhver

- api

- API'er

- app

- Anvendelse

- applikationer

- anvendt

- tilgang

- arkitektur

- ER

- AS

- At

- forøge

- augmented

- tilføjelserne

- Aurora

- forfatter

- automatisk

- til rådighed

- Avenue

- væk

- AWS

- AWS CloudFormation

- AWS re: Invent

- tilbage

- bund

- baseret

- grundlæggende

- Bugt

- Beach

- bliver

- været

- før

- Begyndelse

- begynder

- adfærd

- mener

- Bedre

- Billion

- board

- bestyrelse

- bog

- brand

- browser

- bygge

- virksomhed

- Business Applications

- by

- CA

- ringe

- Opkald

- CAN

- kapaciteter

- kapital

- tilfælde

- CD

- udfordringer

- lave om

- Ændringer

- afgifter

- chatte

- chatbot

- chatbots

- Betaling

- chip

- Chips

- valg

- Vælg

- ren

- cli

- Cloud

- SKY-TEKNOLOGI

- kode

- samling

- kombinerer

- Kom

- kommer

- Fælles

- Virksomheder

- selskab

- fuldføre

- kompleksiteter

- komponenter

- beregningsmæssige

- computer

- Computer Vision

- computing

- konferencer

- Tilslut

- Konsol

- forbruger

- sammenhæng

- kontekstuelle

- kontekstualisere

- fortsæt

- Samtale

- konversation

- samtale AI

- samtaler

- konverteret

- Core

- Corporate

- omkostningseffektiv

- kunne

- skabe

- oprettet

- skaber

- Oprettelse af

- skabelse

- skaberen

- cricket

- For øjeblikket

- kunde

- kundeadfærd

- Kundeoplevelse

- Kundeservice

- Kunder

- tilpassede

- data

- datapunkter

- datastyret

- Database

- Dage

- Standard

- levere

- leveret

- leverer

- Afhængigt

- indsat

- implementering

- beskrevet

- beskrivelse

- detaljer

- Bestem

- udvikle

- Udvikler

- Udvikling

- diagram

- DID

- forskellige

- digital

- direktører

- forskelligartede

- dokumentet

- dokumenter

- gør

- dollars

- Domæner

- Dont

- ned

- downloade

- hver

- tidligere

- tidlig stadie

- Øst

- Uddannelse

- effektiv

- indsats

- ubesværet

- enten

- indlejring

- medarbejdere

- muliggøre

- muliggør

- muliggør

- engagerende

- Engine (Motor)

- Engineering

- forbedret

- styrke

- Indtast

- Enterprise

- virksomheder

- Miljø

- fejl

- Endog

- begivenheder

- Hver

- eksempel

- erfaring

- Oplevelser

- ekspertise

- Forklar

- forklarede

- forklarer

- ekstern

- fakta

- FAIL

- få

- felt

- File (Felt)

- Filer

- Endelig

- fund

- Fornavn

- flow

- Fokus

- efter

- Til

- Foundation

- fire

- Francisco

- Gratis

- fra

- fuldt ud

- funktion

- g1

- generere

- genererer

- generation

- generative

- Generativ AI

- Git

- GitHub

- Giv

- Go

- Mål

- voksede

- Ground

- Grow

- Vokser

- vejledning

- havde

- håndtere

- Håndterer

- Have

- he

- tunge

- tunge løft

- hjælpe

- hende

- Høj

- højt niveau

- hans

- historie

- Home

- Hvordan

- Men

- HTML

- http

- HTTPS

- hundrede

- ID

- if

- illustrere

- illustrerer

- gennemføre

- vigtigt

- Forbedre

- forbedring

- in

- omfatter

- Herunder

- indarbejde

- inkorporerer

- Forøg

- øget

- indeks

- indekser

- individuel

- industrier

- informere

- oplysninger

- Informationssystemer

- indgang

- Forespørgsler

- indsigt

- installere

- øjeblikkelig

- integrere

- Integration

- integration

- interagerer

- interesser

- grænseflade

- interne

- internt

- ind

- indføre

- introduceret

- investere

- påberåber sig

- involverede

- involverer

- IT

- jpg

- Nøgle

- viden

- Sprog

- Sprog

- stor

- Store virksomheder

- Efternavn

- senere

- lanceret

- lag

- føre

- Leads

- læring

- mindst

- Forlade

- mindre

- brev

- Niveau

- biblioteker

- Bibliotek

- løft

- ligesom

- synes godt om

- Limited

- Line (linje)

- Linking

- LLM

- lokale

- Lang

- maskine

- machine learning

- Main

- maerker

- håndterbar

- lykkedes

- administrerer

- styring

- Produktion

- mange

- Match

- Kan..

- me

- betyder

- mekanisme

- medlem

- Hukommelse

- blot

- million

- millioner dollars

- mindste

- minut

- minutter

- model

- modeller

- ændre

- mere

- mest

- flere

- navn

- Natural

- Natural Language Processing

- Naviger

- Navigation

- Behov

- behov

- behov

- Ny

- næste

- ingen

- Ingen

- Bemærk

- notesbog

- bemærkede

- objektiv

- of

- tilbyde

- tilbud

- Tilbud

- Office

- tit

- on

- ONE

- åbent

- open source

- optimal

- Option

- Indstillinger

- or

- organisationer

- Andet

- Ellers

- vores

- ud

- output

- uden for

- i løbet af

- overliggende

- oversigt

- egen

- side

- brød

- parametre

- partner

- dele

- passage

- passager

- Bestået

- lidenskabelige

- forbi

- Mønster

- procentdel

- ydeevne

- Tilladelser

- Personlig

- fly

- plato

- Platon Data Intelligence

- PlatoData

- spiller

- Punkt

- punkter

- politikker

- Populær

- popularitet

- Indlæg

- magt

- strøm

- vigtigste

- præferencer

- præsentere

- forelagt

- gaver

- tidligere

- Main

- problemer

- behandle

- forarbejdning

- processorer

- Produkter

- Progress

- projekter

- prompter

- proprietære

- give

- forudsat

- giver

- leverer

- indkøb

- Python

- forespørgsler

- query

- spørgsmål

- Spørgsmål

- Hurtig

- klud

- spænder

- RE

- klar

- ægte

- virkelige verden

- realtid

- optegnelser

- reducere

- reducere

- henvise

- regioner

- regelmæssigt

- relaterede

- relevans

- relevant

- fjerner

- Rapporter

- Repository

- repræsentere

- anmode

- påkrævet

- Kræver

- Ressourcer

- Svar

- svar

- reaktioner

- hentning

- afkast

- indtægter

- gennemgå

- vej

- roller

- roller

- Kør

- løber

- runtime

- samme

- prøve

- San

- San Francisco

- gemt

- skalerbar

- skalering

- script

- SDK

- Søg

- Sektion

- sektioner

- sikker

- se

- Vælg

- valgt

- semantiske

- sendt

- tjener

- Serverless

- tjeneste

- Tjenester

- Session

- sæt

- indstillinger

- setup

- aktionær

- Aktionærer

- hun

- kort sigt

- bør

- udstillingsvindue

- signifikant

- lignende

- samtidigt

- enkelt

- Størrelse

- mindre

- løsninger

- Løsninger

- nogle

- sofistikeret

- Kilde

- Kilder

- Taler

- specialister

- specialiseret

- specifikke

- specificeret

- delt

- splits

- stable

- starte

- Nystartede

- Tilstand

- Status

- stængler

- Trin

- Steps

- butik

- opbevaret

- forhandler

- lagring

- ligetil

- Strategi

- strømline

- indsende

- efterfølgende

- væsentligt

- Succesfuld

- sådan

- tyder

- Topmøder

- support

- Understøttet

- Understøtter

- synkronisere.

- systemet

- Systemer

- bord

- skræddersyet

- Tag

- tager

- opgaver

- tech

- Teknologier

- skabelon

- terminal

- prøve

- afprøvet

- tekst

- end

- at

- oplysninger

- The Source

- deres

- Them

- derefter

- Der.

- derfor

- Disse

- de

- denne

- dem

- tre

- Gennem

- tid

- titan

- til

- Transform

- udløse

- betroet

- prøv

- to

- typer

- under

- forstå

- opdatering

- uploadet

- brug

- anvendte

- Bruger

- brugere

- bruger

- ved brug af

- nytte

- v1

- Værdifuld

- værdi

- Værdier

- forskellige

- vision

- bind

- ønsker

- var

- ser

- Vej..

- we

- web

- webbrowser

- webservices

- web-baseret

- Webinarer

- uge

- uger

- Vest

- Hvad

- hvornår

- som

- mens

- hvorfor

- vilje

- vindue

- med

- Dame

- kvinder inden for teknologi

- Arbejde

- workflow

- arbejdsgange

- arbejder

- virker

- skriver

- skriv kode

- skriftlig

- yaml

- år

- år

- Du

- Din

- youtube

- zephyrnet