Moderering af indhold spiller en central rolle i at opretholde online sikkerhed og opretholde værdierne og standarderne for websteder og sociale medieplatforme. Dens betydning understreges af den beskyttelse, den giver brugerne mod eksponering for upassende indhold, og sikrer deres velvære i digitale rum. For eksempel tjener indholdsmoderering i reklamebranchen til at beskytte brands mod ugunstige associationer og bidrager derved til brandforhøjelse og omsætningsvækst. Annoncører prioriterer deres brands tilpasning til passende indhold for at opretholde deres omdømme og afværge negativ omtale. Moderering af indhold har også afgørende betydning i finans- og sundhedssektoren, hvor det tjener flere funktioner. Det spiller en vigtig rolle i at identificere og beskytte følsomme personlige identificerbare og sundhedsoplysninger (PII, PHI). Ved at overholde interne standarder og praksis og overholde eksterne regler øger indholdsmoderering den digitale sikkerhed for brugerne. På denne måde forhindrer det utilsigtet deling af fortrolige data på offentlige platforme, hvilket sikrer bevarelsen af brugernes privatliv og datasikkerhed.

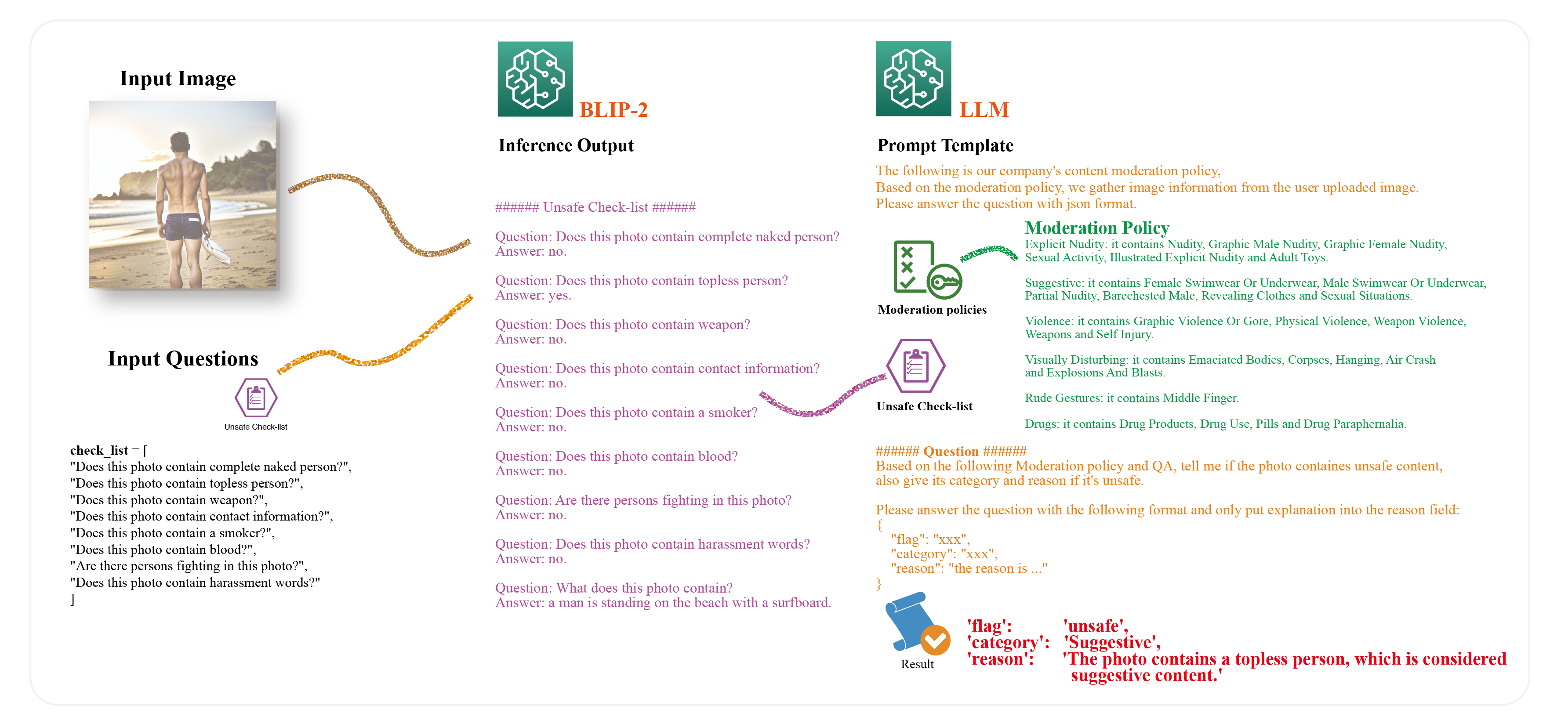

I dette indlæg introducerer vi en ny metode til at udføre indholdsmoderering på billeddata med multimodal fortræning og en stor sprogmodel (LLM). Med multimodal fortræning kan vi direkte forespørge billedindholdet baseret på et sæt af interessespørgsmål, og modellen vil være i stand til at besvare disse spørgsmål. Dette gør det muligt for brugere at chatte med billedet for at bekræfte, om det indeholder upassende indhold, der overtræder organisationens politikker. Vi bruger LLM'ers kraftfulde genereringsevne til at generere den endelige beslutning, herunder sikre/usikre etiketter og kategoritype. Derudover kan vi ved at designe en prompt få en LLM til at generere det definerede outputformat, såsom JSON-format. Den designede promptskabelon gør det muligt for LLM at afgøre, om billedet overtræder moderationspolitikken, identificere kategorien for overtrædelse, forklare hvorfor og levere output i et struktureret JSON-format.

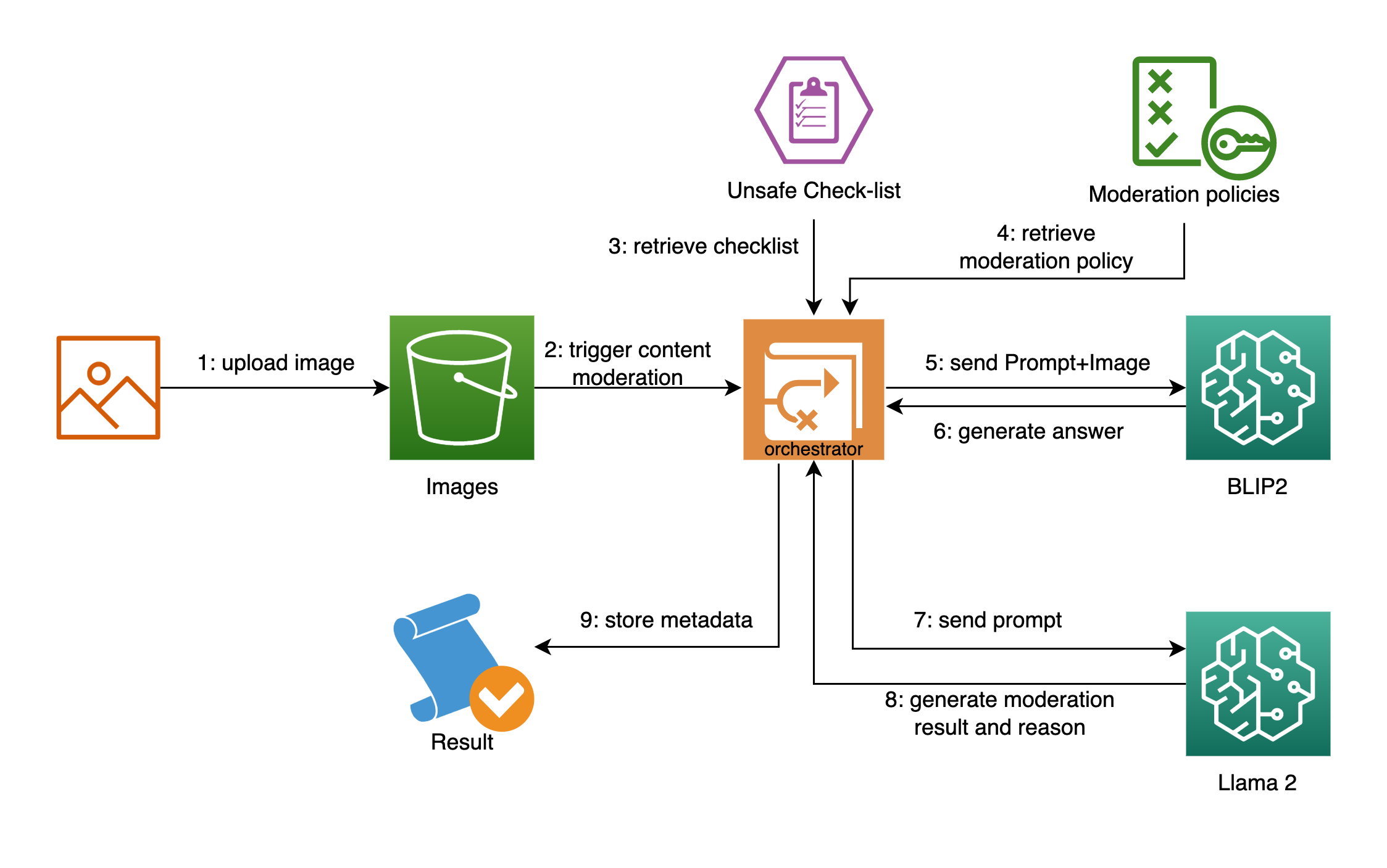

Vi anvender BLIP-2 som den multimodale fortræningsmetode. BLIP-2 er en af de mest avancerede modeller inden for multimodal præ-træning og overgår de fleste af de eksisterende metoder inden for visuel besvarelse af spørgsmål, billedtekstning og billedtekstsøgning. Til vores LLM bruger vi Lama 2, næste generation af open source LLM, som udkonkurrerer eksisterende open source-sprogmodeller på mange benchmarks, herunder ræsonnement, kodning, færdigheds- og videnstests. Følgende diagram illustrerer løsningskomponenterne.

Udfordringer i indholdsmoderering

Traditionelle metoder til moderering af indhold, såsom menneskebaseret moderering, kan ikke følge med den voksende mængde brugergenereret indhold (UGC). Efterhånden som mængden af UGC stiger, kan menneskelige moderatorer blive overvældet og kæmpe for at moderere indhold effektivt. Dette resulterer i en dårlig brugeroplevelse, høje moderationsomkostninger og brandrisiko. Menneskebaseret moderering er også tilbøjelig til fejl, hvilket kan resultere i inkonsekvent moderation og partiske beslutninger. For at løse disse udfordringer er indholdsmoderering drevet af maskinlæring (ML) dukket op som en løsning. ML-algoritmer kan analysere store mængder UGC og identificere indhold, der overtræder organisationens politikker. ML-modeller kan trænes til at genkende mønstre og identificere problematisk indhold, såsom hadefulde ytringer, spam og upassende materiale. Ifølge undersøgelsen Beskyt dine brugere, brand og budget med AI-drevet indholdsmoderering, ML-drevet indholdsmoderering kan hjælpe organisationer med at genvinde op til 95 % af den tid, deres teams bruger på at moderere indhold manuelt. Dette giver organisationer mulighed for at fokusere deres ressourcer på mere strategiske opgaver, såsom community building og indholdsskabelse. ML-drevet indholdsmoderering kan også reducere moderationsomkostninger, fordi det er mere effektivt end menneskebaseret moderering.

På trods af fordelene ved ML-drevet indholdsmoderering har den stadig plads til yderligere forbedringer. Effektiviteten af ML-algoritmer afhænger i høj grad af kvaliteten af de data, de trænes på. Når modeller trænes ved hjælp af forudindtaget eller ufuldstændige data, kan de træffe fejlagtige modereringsbeslutninger, hvilket udsætter organisationer for brandrisici og potentielle juridiske forpligtelser. Indførelsen af ML-baserede tilgange til indholdsmoderering medfører flere udfordringer, som kræver omhyggelig overvejelse. Disse udfordringer omfatter:

- Indhentning af mærkede data – Dette kan være en bekostelig proces, især for komplekse indholdsmodereringsopgaver, der kræver træning af etikette. Disse omkostninger kan gøre det udfordrende at samle store nok datasæt til nemt at træne en overvåget ML-model. Derudover afhænger modellens nøjagtighed i høj grad af kvaliteten af træningsdataene, og partiske eller ufuldstændige data kan resultere i unøjagtige modereringsbeslutninger, hvilket fører til brandrisiko og juridiske forpligtelser.

- Model generalisering – Dette er afgørende for at anvende ML-baserede tilgange. En model, der er trænet på ét datasæt, generaliserer muligvis ikke godt til et andet datasæt, især hvis datasættene har forskellige distributioner. Derfor er det vigtigt at sikre, at modellen trænes på et mangfoldigt og repræsentativt datasæt for at sikre, at det generaliserer godt til nye data.

- Driftseffektivitet – Dette er endnu en udfordring, når man bruger konventionelle ML-baserede tilgange til indholdsmoderering. Konstant tilføjelse af nye etiketter og genoptræning af modellen, når nye klasser tilføjes, kan være tidskrævende og dyrt. Derudover er det vigtigt at sikre, at modellen opdateres regelmæssigt for at følge med ændringer i det indhold, der modereres.

- Forklarlighed – Slutbrugere kan opfatte platformen som partisk eller uretfærdig, hvis indhold bliver markeret eller fjernet uden begrundelse, hvilket resulterer i en dårlig brugeroplevelse. Tilsvarende kan fraværet af klare forklaringer gøre indholdsmodereringsprocessen ineffektiv, tidskrævende og dyr for moderatorer.

- Modstridende natur – Den modstridende karakter af billedbaseret indholdsmoderering udgør en unik udfordring for konventionelle ML-baserede tilgange. Dårlige skuespillere kan forsøge at unddrage sig modereringsmekanismer for indhold ved at ændre indholdet på forskellige måder, såsom ved at bruge synonymer til billeder eller indlejre deres faktiske indhold i en større mængde ikke-fornærmende indhold. Dette kræver konstant overvågning og opdatering af modellen for at opdage og reagere på sådanne modstridende taktikker.

Multimodal ræsonnement med BLIP-2

Multimodalitet ML-modeller henviser til modeller, der kan håndtere og integrere data fra flere kilder eller modaliteter, såsom billeder, tekst, lyd, video og andre former for strukturerede eller ustrukturerede data. En af de populære multimodalitetsmodeller er de visuelle sprogmodeller såsom BLIP-2, der kombinerer computersyn og naturlig sprogbehandling (NLP) for at forstå og generere både visuel og tekstlig information. Disse modeller gør det muligt for computere at fortolke betydningen af billeder og tekst på en måde, der efterligner menneskelig forståelse. Visionssprogmodeller kan tackle en række opgaver, herunder billedtekstning, billedteksthentning, visuel besvarelse af spørgsmål og mere. For eksempel kan en billedtekstmodel generere en naturlig sprogbeskrivelse af et billede, og en billedtekst-hentningsmodel kan søge efter billeder baseret på en tekstforespørgsel. Visuelle spørgsmålsbesvarelsesmodeller kan svare på naturlige sprogspørgsmål om billeder, og multimodale chatbots kan bruge visuelle og tekstmæssige input til at generere svar. Med hensyn til indholdsmoderering kan du bruge denne evne til at forespørge på en liste med spørgsmål.

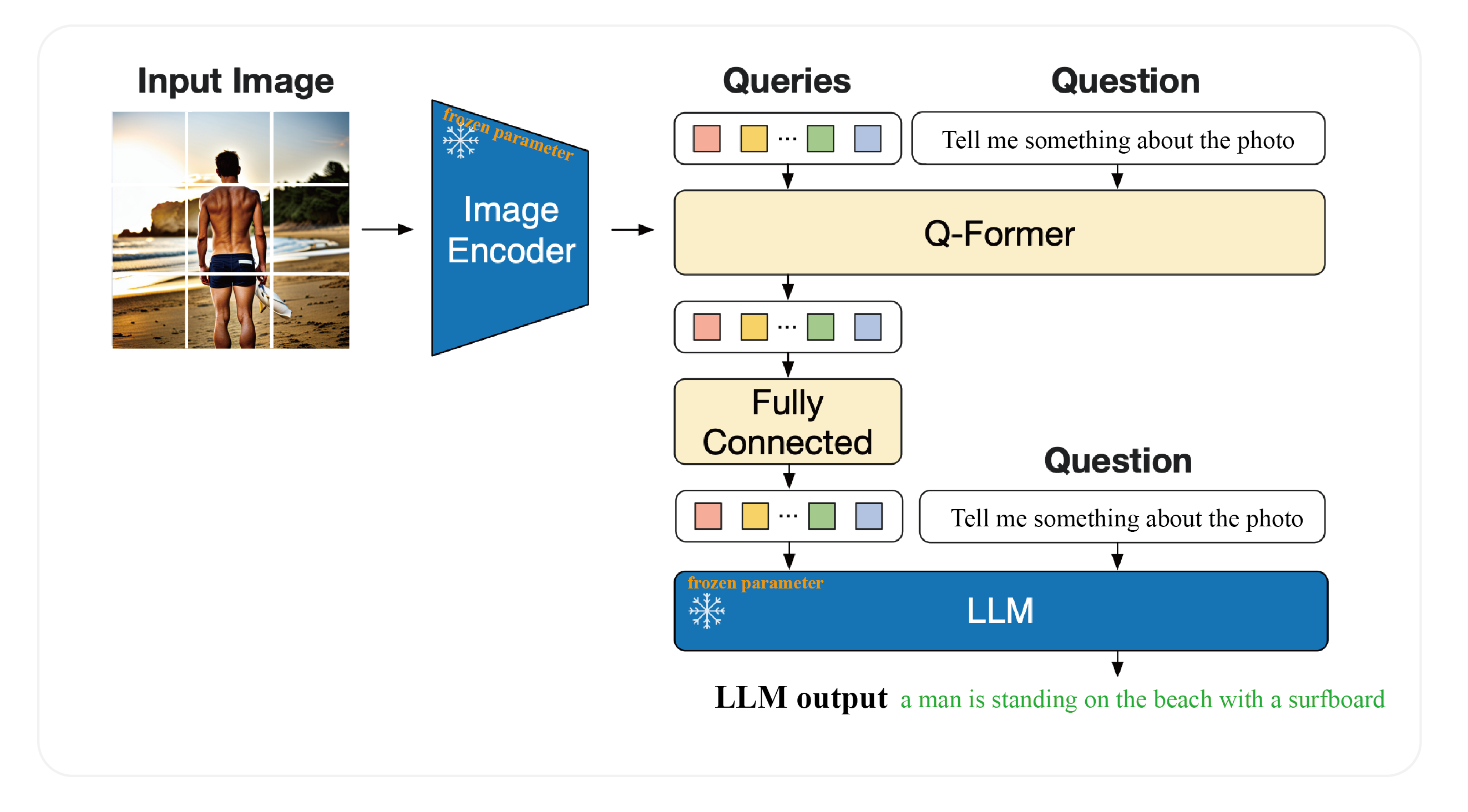

BLIP-2 indeholder tre dele. Den første komponent er en frossen billedkoder, ViT-L/14 fra CLIP, som tager billeddata som input. Den anden komponent er en fastfrosset LLM, FlanT5, som udsender tekst. Den tredje komponent er et oplærbart modul kaldet Q-Former, en letvægtstransformator, der forbinder den frosne billedkoder med den frosne LLM. Q-Former anvender lærbare forespørgselsvektorer til at udtrække visuelle funktioner fra den frosne billedkoder og leverer den mest nyttige visuelle funktion til LLM for at udskrive den ønskede tekst.

Fortræningsprocessen omfatter to faser. I første fase udføres vision-sprog repræsentationslæring for at lære Q-Former at lære den mest relevante visuelle repræsentation for teksten. I det andet trin udføres vision-til-sprog generativ læring ved at forbinde Q-Formers output til en frossen LLM og træne Q-Former til at outputte visuelle repræsentationer, der kan fortolkes af LLM.

BLIP-2 opnår avanceret ydeevne på forskellige synssprogopgaver på trods af, at den har væsentligt færre parametre, der kan trænes, end eksisterende metoder. Modellen demonstrerer også nye muligheder for nul-shot-billede-til-tekst-generering, der kan følge instruktionerne i naturligt sprog. Følgende illustration er ændret fra original forskningsartikel.

Løsningsoversigt

Følgende diagram illustrerer løsningsarkitekturen.

I de følgende afsnit demonstrerer vi, hvordan man implementerer BLIP-2 til en Amazon SageMaker endepunkt, og brug BLIP-2 og en LLM til indholdsmoderering.

Forudsætninger

Du skal have en AWS-konto med en AWS identitets- og adgangsstyring (IAM) rolle med tilladelser til at administrere ressourcer oprettet som en del af løsningen. For detaljer henvises til Opret en selvstændig AWS-konto.

Hvis det er første gang, du arbejder med Amazon SageMaker Studio, skal du først oprette en SageMaker domæne. Derudover skal du muligvis anmode om en forhøjelse af servicekvoten for de tilsvarende SageMaker-hostingforekomster. Til BLIP-2 modellen bruger vi en ml.g5.2xlarge SageMaker hosting instans. Til Llama 2 13B modellen bruger vi en ml.g5.12xlarge SageMaker hosting instans.

Implementer BLIP-2 til et SageMaker-slutpunkt

Du kan være vært for en LLM på SageMaker ved hjælp af Stor modelslutning (LMI) container, der er optimeret til hosting af store modeller ved hjælp af DJLServing. DJLServing er en højtydende universel modelserveringsløsning drevet af Deep Java Library (DJL), der er programmeringssprogsagnostisk. For at lære mere om DJL og DJLServing, se Implementer store modeller på Amazon SageMaker ved hjælp af DJLServing og DeepSpeed model parallel inferens. Ved hjælp af SageMaker LMI-beholderen kan BLIP-2-modellen nemt implementeres med Hugging Face-biblioteket og hostes på SageMaker. Du kan løbe blip2-sagemaker.ipynb for dette trin.

For at forberede Docker-billedet og modelfilen skal du hente Docker-billedet af DJLServing, pakke inferensscriptet og konfigurationsfilerne som en model.tar.gz fil, og upload den til en Amazon Simple Storage Service (Amazon S3) spand. Du kan henvise til inferensscript og konfigurationsfil for flere detaljer.

inference_image_uri = image_uris.retrieve( framework="djl-deepspeed", region=sess.boto_session.region_name, version="0.22.1"

)

! tar czvf model.tar.gz blip2/

s3_code_artifact = sess.upload_data("model.tar.gz", bucket, s3_code_prefix)Når Docker-billedet og inferensrelaterede filer er klar, opretter du modellen, konfigurationen for slutpunktet og slutpunktet:

from sagemaker.utils import name_from_base

blip_model_version = "blip2-flan-t5-xl"

model_name = name_from_base(blip_model_version)

model = Model( image_uri=inference_image_uri, model_data=s3_code_artifact, role=role, name=model_name,

)

model.deploy( initial_instance_count=1, instance_type="ml.g5.2xlarge", endpoint_name=model_name

)Når slutpunktets status bliver i brug, kan du kalde slutpunktet til billedtekstning og den instruerede nul-shot vision-til-sprog genereringsopgave. Til billedtekstopgaven skal du kun sende et billede til slutpunktet:

import base64

import json

from PIL import Image smr_client = boto3.client("sagemaker-runtime") def encode_image(img_file): with open(img_file, "rb") as image_file: img_str = base64.b64encode(image_file.read()) base64_string = img_str.decode("latin1") return base64_string def run_inference(endpoint_name, inputs): response = smr_client.invoke_endpoint( EndpointName=endpoint_name, Body=json.dumps(inputs) ) print(response["Body"].read()) test_image = "carcrash-ai.jpeg"

base64_string = encode_image(test_image)

inputs = {"image": base64_string}

run_inference(endpoint_name, inputs)For den instruerede nul-shot-vision-til-sprog-genereringsopgave skal du ud over inputbilledet definere spørgsmålet som en prompt:

base64_string = encode_image(test_image)

inputs = {"prompt": "Question: what happened in this photo? Answer:", "image": base64_string}

run_inference(endpoint_name, inputs)Brug BLIP-2 og LLM til indholdsmoderering

I denne fase kan du foretage forespørgsler på det givne billede og hente skjulte oplysninger. Med LLM organiserer du forespørgslerne og henter oplysninger for at generere JSON-formatresultatet. Du kan groft opdele denne opgave i følgende to underopgaver:

- Udtræk information fra billedet med BLIP-2-modellen.

- Generer det endelige resultat og forklaring med LLM.

Udtræk information fra billedet med BLIP-2-modellen

For at hente nok nyttig skjult information fra det givne billede, skal du definere forespørgsler. Fordi hver forespørgsel vil kalde slutpunktet én gang, vil mange forespørgsler føre til længere behandlingstid. Derfor foreslår vi at stille forespørgsler af høj kvalitet og dække alle policer, men også uden duplikering. I vores eksempelkode definerer vi forespørgslerne som følger:

check_list = [ "Does this photo contain complete naked person?", "Does this photo contain topless person?", "Does this photo contain weapon?", "Does this photo contain contact information?", "Does this photo contain a smoker?", "Does this photo contain blood?", "Are there persons fighting in this photo?", "Does this photo contain harassment words?"

]Med de foregående forespørgsler skal du kalde slutpunktet for BLIP-2 for at hente oplysningerne med følgende kode:

test_image = "./surf_swimwear.png"

raw_image = Image.open(test_image).convert('RGB') base64_string = encode_image(test_image)

conversations = """"""

for question in check_list: inputs = {"prompt": f"Question: {question}? Answer:", "image": base64_string} response = run_inference(endpoint_name, inputs) conversations += f"""

Question: {question}

Answer: {response}. """Ud over de oplysninger, der hentes ved forespørgsler, kan du få oplysninger med billedtekstopgaven ved at påkalde slutpunktet uden prompt felt i nyttelasten:

inputs = {"image": base64_string}

response = smr_client.invoke_endpoint(

EndpointName=endpoint_name, Body=json.dumps(inputs)

)

image_caption = response["Body"].read().decode('utf-8')Du kan kombinere indholdet af forespørgsler og svar med billedteksten og bruge denne hentede information til downstream-opgaven, beskrevet i næste afsnit nedenfor.

Generer det endelige resultat og forklaring med LLM

Store sprogmodeller (LLM'er) såsom Llama 2 kan generere resultater af høj kvalitet med den rigtige promptskabelon. Ved brug af Amazon SageMaker JumpStart, ML-praktiserende læger kan vælge mellem et bredt udvalg af offentligt tilgængelige funderingsmodeller. Med blot et par klik i SageMaker Studio kan du nu opdage og implementere Llama 2.

De endelige resultater er afhængige af en LLM med en specifik promptskabelon. En sådan prompt består af: moderationspolitikken baseret på kategorier af upassende eller stødende moderationskategorier; billedinformation udtrukket fra BLIP-2; spørgsmålskabelonen til LLM, der spørger, om billedet indeholder usikkert indhold, og anmoder om dets kategori og årsag, hvis det er usikkert; og instruktioner til at udlæse resultaterne i JSON-format. Den designede promptskabelon giver LLM mulighed for at afgøre, om billedet overtræder moderationspolitikken, identificere kategorien for overtrædelse, forklare hvorfor og levere output i et struktureret JSON-format.

Kernekildekoden er som følger:

prompt_template = f"""

The following is our company's content moderation policy, based on the moderation policy, we gather image information from the user uploaded image. Please answer the question with json format. ###### moderation policy ######

{moderation_policy} ###### Image information ######

{conversations} ###### Question ######

Based on the following Moderation policy and QA, tell me if the photo containes unsafe content, also give its category and reason if it's unsafe. Please anwser the question with the following format and only put explanation into the reason field: """ prompt_template += """

{ "flag": "xxx", "category": "xxx", "reason": "the reason is ..."

} """ dialog = [ {"role": "user", "content": prompt_template}

]Du kan tilpasse prompten baseret på din egen use case. Der henvises til notesbog for flere detaljer. Når prompten er klar, kan du kalde LLM-slutpunktet for at generere resultater:

endpoint_name = "jumpstart-dft-meta-textgeneration-llama-2-70b-f" def query_endpoint(payload): client = boto3.client("sagemaker-runtime") response = client.invoke_endpoint( EndpointName=endpoint_name, ContentType="application/json", Body=json.dumps(payload), CustomAttributes="accept_eula=true", ) response = response["Body"].read().decode("utf8") response = json.loads(response) return response payload = { "inputs": [dialog], "parameters": {"max_new_tokens": 256, "top_p": 0.9, "temperature": 0.5}

}

result = query_endpoint(payload)[0]En del af det genererede output er som følger:

Af og til vedlægger Llama 2 yderligere forklaring udover svaret fra assistenten. Du kan bruge parsingkoden til at udtrække JSON-data fra de oprindeligt genererede resultater:

answer = result['generation']['content'].split('}')[0]+'}'

json.loads(answer)

Fordele ved generative tilgange

De foregående afsnit viste, hvordan man implementerer kernedelen af modelinferens. I dette afsnit dækker vi forskellige aspekter af generative tilgange, herunder sammenligninger med konventionelle tilgange og perspektiver.

Følgende tabel sammenligner hver tilgang.

| . | Generativ tilgang | Klassificeringsmetode |

| Indhentning af mærkede data | Foruddannet model på et stort antal billeder, nul-shot inferens | Kræver data fra alle typer kategorier |

| Model generalisering | Foruddannet model med forskellige typer billeder | Kræver en stor mængde indholdsmodereringsrelaterede data for at forbedre modelgenereringen |

| Driftseffektivitet | Nulskudsfunktioner | Kræver træning af modellen til at genkende forskellige mønstre og genoptræning, når etiketter tilføjes |

| Forklarlighed | Begrundelse som tekstoutput, god brugeroplevelse | Svært at opnå ræsonnement, svært at forklare og fortolke |

| Modstridende natur | Robust | Højfrekvent genoptræning |

Potentielle anvendelsestilfælde af multimodal ræsonnement ud over indholdsmoderering

BLIP-2-modellerne kan anvendes til at passe til flere formål med eller uden finjustering, som omfatter følgende:

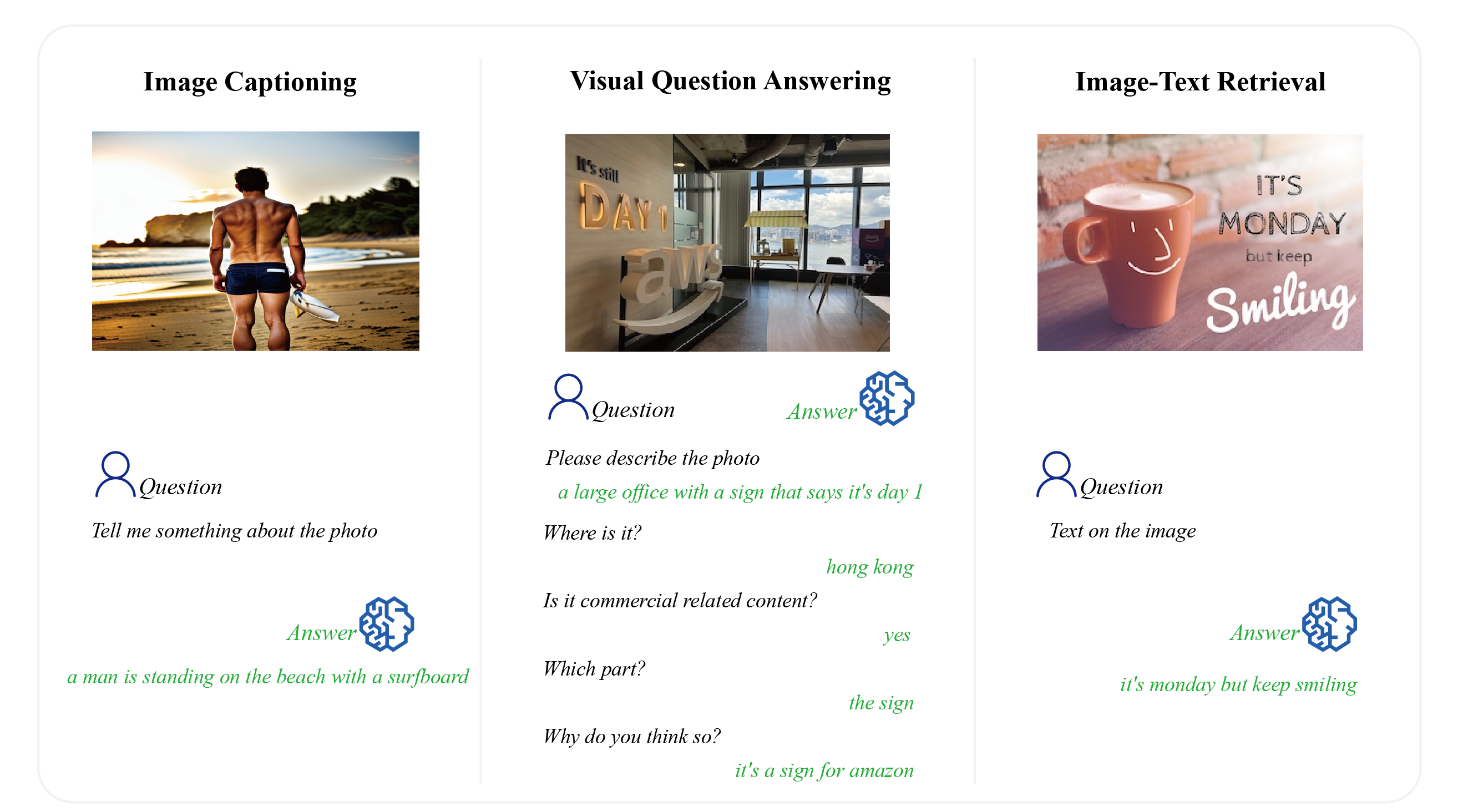

- Billedtekstning – Dette beder modellen om at generere en tekstbeskrivelse til billedets visuelle indhold. Som illustreret i det følgende eksempelbillede (til venstre), kan vi have "en mand står på stranden med et surfbræt" som billedbeskrivelsen.

- Visuel besvarelse af spørgsmål – Som eksempelbilledet i midten viser, kan vi spørge "Er det kommercielt relateret indhold" og vi har "Ja" som svaret. Derudover understøtter BLIP-2 multi-runde samtalen og udsender følgende spørgsmål: "Hvorfor tror du det?" Baseret på den visuelle cue og LLM-kapacitet, BLIP-2-output "det er et tegn for Amazon."

- Hentning af billedtekst – Givet spørgsmålet som "Tekst på billedet", kan vi udtrække billedteksten “det er mandag, men bliv ved med at smile” som vist på billedet til højre.

De følgende billeder viser eksempler for at demonstrere nul-shot billed-til-tekst-evnen af visuel vidensræsonnement.

Som vi kan se fra forskellige eksempler ovenfor, åbner multimodalitetsmodeller nye muligheder for at løse komplekse problemer, som traditionelle singlemodalitetsmodeller ville kæmpe for at løse.

Ryd op

For at undgå fremtidige gebyrer skal du slette de ressourcer, der er oprettet som en del af dette indlæg. Du kan gøre dette ved at følge instruktionerne i notebook-oprydningsafsnittet eller slette de oprettede slutpunkter via SageMaker-konsollen og ressourcer gemt i S3-bøtten.

Konklusion

I dette indlæg diskuterede vi vigtigheden af moderering af indhold i den digitale verden og fremhævede dens udfordringer. Vi foreslog en ny metode til at hjælpe med at forbedre indholdsmoderering med billeddata og udføre spørgsmålssvar i forhold til billederne for automatisk at udtrække nyttig information. Vi gav også yderligere diskussion om fordelene ved at bruge en generativ AI-baseret tilgang sammenlignet med den traditionelle klassifikationsbaserede tilgang. Til sidst illustrerede vi de potentielle anvendelsestilfælde af visuelle sprogmodeller ud over indholdsmoderering.

Vi opfordrer dig til at lære mere ved at udforske SageMaker og bygge en løsning ved hjælp af multimodalitetsløsningen i dette indlæg og et datasæt, der er relevant for din virksomhed.

Om forfatterne

Gordon Wang er en Senior AI/ML Specialist TAM hos AWS. Han støtter strategiske kunder med AI/ML bedste praksis på tværs af mange brancher. Han brænder for computersyn, NLP, generativ AI og MLOps. I sin fritid elsker han at løbe og vandre.

Gordon Wang er en Senior AI/ML Specialist TAM hos AWS. Han støtter strategiske kunder med AI/ML bedste praksis på tværs af mange brancher. Han brænder for computersyn, NLP, generativ AI og MLOps. I sin fritid elsker han at løbe og vandre.

Yanwei Cui, PhD, er Senior Machine Learning Specialist Solutions Architect hos AWS. Han startede maskinlæringsforskning på IRISA (Research Institute of Computer Science and Random Systems), og har flere års erfaring med at bygge AI-drevne industrielle applikationer inden for computersyn, naturlig sprogbehandling og online brugeradfærdsforudsigelse. Hos AWS deler han sin domæneekspertise og hjælper kunder med at frigøre forretningspotentialer og skabe handlingsrettede resultater med maskinlæring i stor skala. Uden for arbejdet holder han af at læse og rejse.

Yanwei Cui, PhD, er Senior Machine Learning Specialist Solutions Architect hos AWS. Han startede maskinlæringsforskning på IRISA (Research Institute of Computer Science and Random Systems), og har flere års erfaring med at bygge AI-drevne industrielle applikationer inden for computersyn, naturlig sprogbehandling og online brugeradfærdsforudsigelse. Hos AWS deler han sin domæneekspertise og hjælper kunder med at frigøre forretningspotentialer og skabe handlingsrettede resultater med maskinlæring i stor skala. Uden for arbejdet holder han af at læse og rejse.

Melanie Li, PhD, er en Senior AI/ML Specialist TAM hos AWS med base i Sydney, Australien. Hun hjælper virksomhedskunder med at bygge løsninger ved hjælp af state-of-the-art AI/ML-værktøjer på AWS og giver vejledning om arkitektur og implementering af ML-løsninger med bedste praksis. I sin fritid elsker hun at udforske naturen og tilbringe tid med familie og venner.

Melanie Li, PhD, er en Senior AI/ML Specialist TAM hos AWS med base i Sydney, Australien. Hun hjælper virksomhedskunder med at bygge løsninger ved hjælp af state-of-the-art AI/ML-værktøjer på AWS og giver vejledning om arkitektur og implementering af ML-løsninger med bedste praksis. I sin fritid elsker hun at udforske naturen og tilbringe tid med familie og venner.

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk dig selv. Adgang her.

- PlatoAiStream. Web3 intelligens. Viden forstærket. Adgang her.

- PlatoESG. Automotive/elbiler, Kulstof, CleanTech, Energi, Miljø, Solenergi, Affaldshåndtering. Adgang her.

- PlatoHealth. Bioteknologiske og kliniske forsøgs intelligens. Adgang her.

- ChartPrime. Løft dit handelsspil med ChartPrime. Adgang her.

- BlockOffsets. Modernisering af miljømæssig offset-ejerskab. Adgang her.

- Kilde: https://aws.amazon.com/blogs/machine-learning/build-a-generative-ai-based-content-moderation-solution-on-amazon-sagemaker-jumpstart/

- :har

- :er

- :ikke

- :hvor

- $OP

- 1

- 10

- 100

- 20

- 22

- 7

- 9

- 95 %

- a

- I stand

- Om

- over

- adgang

- Ifølge

- Konto

- nøjagtighed

- opnå

- opnår

- aktører

- faktiske

- tilføjet

- tilføje

- Desuden

- Yderligere

- Derudover

- adresse

- klæber

- Vedtagelsen

- Vedtagelse

- fordele

- kontradiktorisk

- annoncører

- Reklame

- mod

- AI

- AI-drevne

- AI / ML

- algoritmer

- tilpasning

- Alle

- tillader

- også

- Amazon

- Amazon SageMaker

- Amazon SageMaker JumpStart

- Amazon Web Services

- an

- analysere

- ,

- En anden

- besvare

- svar

- enhver

- applikationer

- anvendt

- tilgang

- tilgange

- passende

- arkitektur

- ER

- AS

- spørg

- aspekter

- Assistant

- foreninger

- antager

- At

- lyd

- Australien

- automatisk

- til rådighed

- undgå

- AWS

- Bad

- baseret

- BE

- Beach

- fordi

- bliver

- bliver

- adfærd

- være

- jf. nedenstående

- Benchmarks

- udover

- BEDSTE

- bedste praksis

- Beyond

- forudindtaget

- blod

- krop

- både

- brand

- brands

- Bringer

- bred

- budget

- bygge

- Bygning

- virksomhed

- men

- by

- kaldet

- CAN

- Kan få

- kapaciteter

- kapacitet

- forsigtig

- tilfælde

- tilfælde

- kategorier

- Boligtype

- udfordre

- udfordringer

- udfordrende

- Ændringer

- afgifter

- chatbots

- Vælg

- klasser

- klar

- kunde

- tøj

- kode

- Kodning

- kombinerer

- kombinerer

- kommerciel

- samfund

- samfund bygning

- selskab

- sammenlignet

- fuldføre

- komplekse

- komponent

- komponenter

- computer

- Datalogi

- Computer Vision

- computere

- Konfiguration

- Bekræfte

- Tilslutning

- forbinder

- overvejelse

- betragtes

- består

- Konsol

- konstant

- konstant

- kontakt

- indeholder

- Container

- indeholder

- indhold

- indholdsskabelse

- indhold

- bidrager

- konventionelle

- Samtale

- samtaler

- Core

- Tilsvarende

- Koste

- kostbar

- Omkostninger

- kunne

- dæksel

- skabe

- oprettet

- skabelse

- kritisk

- Cross

- Kunder

- tilpasse

- data

- datasikkerhed

- datasæt

- beslutning

- afgørelser

- dyb

- definere

- definerede

- demonstrere

- demonstreret

- demonstrerer

- indsætte

- beskrevet

- beskrivelse

- konstrueret

- designe

- ønskes

- Trods

- detaljer

- opdage

- Bestem

- dialog

- forskellige

- digital

- digital verden

- direkte

- drøftet

- diskussion

- Distributioner

- forskelligartede

- do

- Docker

- gør

- domæne

- køre

- hver

- lette

- nemt

- effektivt

- effektivitet

- effektiv

- indlejring

- opstået

- smergel

- beskæftiger

- muliggøre

- muliggør

- tilskynde

- ende

- Endpoint

- Forbedrer

- nok

- sikre

- sikring

- Enterprise

- fejl

- især

- væsentlig

- eksempel

- eksempler

- eksisterende

- erfaring

- ekspertise

- Forklar

- forklaring

- udforske

- Udforskning

- Eksponering

- ekstern

- ekstrakt

- Ansigtet

- Falls

- familie

- Feature

- Funktionalitet

- kvinde

- få

- færre

- felt

- kampene

- File (Felt)

- Filer

- endelige

- finansiere

- Fornavn

- første gang

- passer

- Markeret

- Fokus

- følger

- efter

- følger

- Til

- format

- formularer

- Foundation

- Frekvens

- venner

- fra

- frosset

- funktioner

- yderligere

- fremtiden

- samle

- generere

- genereret

- generere

- generation

- generative

- Generativ AI

- få

- Giv

- given

- stor

- Dyrkning

- Vækst

- vejledning

- håndtere

- skete

- Hård Ost

- Have

- have

- he

- Helse

- sundhedsinformation

- sundhedspleje

- stærkt

- hjælpe

- hjælper

- hende

- Skjult

- Høj

- Høj ydeevne

- høj kvalitet

- Fremhævet

- hans

- host

- hostede

- Hosting

- Hvordan

- How To

- HTML

- http

- HTTPS

- menneskelig

- identificere

- identificere

- Identity

- if

- illustrerer

- billede

- billeder

- gennemføre

- implementeret

- gennemføre

- importere

- betydning

- vigtigt

- Forbedre

- in

- forkert

- omfatter

- omfatter

- Herunder

- Forøg

- Stigninger

- industrielle

- industrier

- industrien

- ineffektiv

- oplysninger

- indgang

- indgange

- instans

- Institut

- anvisninger

- integrere

- interesse

- interne

- ind

- indføre

- IT

- ITS

- Java

- jpg

- json

- lige

- Holde

- viden

- Etiketter

- Sprog

- stor

- større

- føre

- førende

- LÆR

- læring

- til venstre

- Politikker

- passiver

- Bibliotek

- letvægt

- Liste

- Llama

- LLM

- længere

- elsker

- maskine

- machine learning

- Vedligeholdelse

- lave

- Making

- mand

- administrere

- manuelt

- mange

- materiale

- Kan..

- me

- betyder

- mekanismer

- Medier

- Meta

- metode

- metoder

- Mellemøsten

- ML

- MLOps

- model

- modeller

- mådehold

- modificeret

- Moduler

- Mandag

- overvågning

- mere

- mere effektiv

- mest

- flere

- Natural

- Natural Language Processing

- Natur

- Behov

- negativ

- Ny

- næste

- NLP

- notesbog

- roman

- nu

- nummer

- of

- offensiv

- on

- engang

- ONE

- online

- kun

- åbent

- open source

- Muligheder

- optimeret

- or

- organisationer

- original

- Andet

- vores

- Vores firma

- udfald

- udkonkurrerer

- output

- uden for

- overvældet

- egen

- pakke

- Parallel

- parametre

- del

- især

- dele

- passerer

- lidenskabelige

- mønstre

- Udfør

- ydeevne

- udføres

- Tilladelser

- person,

- personale

- personer

- perspektiver

- phd

- foto

- afgørende

- perron

- Platforme

- plato

- Platon Data Intelligence

- PlatoData

- spiller

- Vær venlig

- politikker

- politik

- fattige

- Populær

- Indlæg

- potentiale

- potentialer

- strøm

- vigtigste

- praksis

- forudsigelse

- Forbered

- gaver

- bevarelse

- forhindrer

- Prioriter

- Beskyttelse af personlige oplysninger

- problemer

- behandle

- forarbejdning

- Programmering

- foreslog

- beskyttelse

- give

- forudsat

- giver

- offentlige

- reklame

- offentligt

- formål

- sætte

- Spørgsmål og svar

- kvalitet

- forespørgsler

- spørgsmål

- Spørgsmål

- tilfældig

- Læsning

- klar

- grund

- genkende

- anerkende

- reducere

- regelmæssigt

- regler

- relaterede

- relevant

- stole

- fjernet

- repræsentation

- repræsentativt

- omdømme

- anmode

- kræver

- Kræver

- forskning

- Ressourcer

- Svar

- svar

- reaktioner

- resultere

- resulterer

- Resultater

- afkast

- afslørende

- indtægter

- Omsætningsvækst

- RGB

- højre

- Risiko

- risici

- roller

- groft

- Herske

- Kør

- kører

- s

- varetagelse

- Sikkerhed

- sagemaker

- Scale

- Videnskab

- Søg

- Anden

- Sektion

- sektioner

- Sektorer

- sikkerhed

- se

- valg

- senior

- følsom

- tjener

- tjeneste

- Tjenester

- servering

- sæt

- flere

- Seksuel

- Aktier

- deling

- hun

- Shield

- Vis

- viste

- Shows

- underskrive

- betydning

- betydeligt

- Tilsvarende

- Simpelt

- situationer

- So

- Social

- sociale medier

- sociale medieplatforme

- løsninger

- Løsninger

- Løsning

- Kilde

- kildekode

- Kilder

- Space

- rum

- spam

- specialist

- specifikke

- tale

- tilbringe

- delt

- Stage

- etaper

- standalone

- standarder

- påbegyndt

- state-of-the-art

- Stater

- Status

- Trin

- Stadig

- opbevaring

- opbevaret

- Strategisk

- struktureret

- Kamp

- Studio

- Studere

- sådan

- tyder

- Understøtter

- sydney

- Systemer

- bord

- tackle

- taktik

- tager

- Opgaver

- opgaver

- hold

- fortælle

- skabelon

- vilkår

- tekst

- tekstmæssige

- end

- at

- oplysninger

- deres

- Der.

- derved

- derfor

- Disse

- de

- tror

- Tredje

- denne

- tre

- tid

- tidskrævende

- til

- værktøjer

- traditionelle

- Tog

- uddannet

- Kurser

- transformer

- Traveling

- to

- typen

- typer

- under

- forstå

- forståelse

- enestående

- Universal

- låse

- opdateret

- opdatering

- Opretholde

- uploadet

- brug

- brug tilfælde

- Bruger

- Brugererfaring

- brugernes privatliv

- brugere

- ved brug af

- Værdier

- række

- forskellige

- via

- video

- KRÆNKELSE

- vision

- bind

- mængder

- Vej..

- måder

- we

- web

- webservices

- websites

- GODT

- Hvad

- hvornår

- som

- hvorfor

- vilje

- med

- inden for

- uden

- ord

- Arbejde

- arbejder

- world

- ville

- år

- Du

- Din

- zephyrnet