Brugergenereret indhold (UGC) vokser eksponentielt, såvel som kravene og omkostningerne for at holde indhold og onlinefællesskaber sikre og kompatible. Moderne web- og mobilplatforme giver næring til virksomheder og driver brugerengagement gennem sociale funktioner, fra startups til store organisationer. Medlemmer af onlinefællesskabet forventer sikre og inkluderende oplevelser, hvor de frit kan forbruge og bidrage med billeder, videoer, tekst og lyd. Den stadigt stigende volumen, variationen og kompleksiteten af UGC gør traditionelle arbejdsgange for menneskelig moderation udfordrende at skalere for at beskytte brugerne. Disse begrænsninger tvinger kunderne ind i ineffektive, dyre og reaktive afhjælpningsprocesser, der indebærer en unødvendig risiko for brugerne og virksomheden. Resultatet er en dårlig, skadelig og ikke-inkluderende fællesskabsoplevelse, der frakobler brugerne og påvirker samfundets og forretningsmålene negativt.

Løsningen er skalerbare arbejdsgange for indholdsmoderering, der er afhængige af kunstig intelligens (AI), machine learning (ML), deep learning (DL) og naturlig sprogbehandling (NLP). Disse konstruktioner oversætter, transskriberer, genkender, detekterer, maskerer, redigerer og bringer strategisk menneskelige talenter ind i moderationsworkflowet for at udføre de nødvendige handlinger for at holde brugerne sikre og engagerede, samtidig med at nøjagtigheden og proceseffektiviteten øges og driftsomkostningerne sænkes.

Dette indlæg gennemgår, hvordan man opbygger arbejdsgange for indholdsmoderering ved hjælp af AWS AI-tjenester. For at lære mere om forretningsbehov, virkning og omkostningsreduktioner, som automatiseret indholdsmoderering medfører til sociale medier, spil, e-handel og reklameindustrier, se Brug AWS AI-tjenester til at automatisere indholdsmoderering og overholdelse.

Løsningsoversigt

Du behøver ikke ekspertise i ML for at implementere disse arbejdsgange og kan skræddersy disse mønstre til dine specifikke forretningsbehov! AWS leverer disse muligheder gennem fuldt administrerede tjenester, der fjerner operationel kompleksitet og udifferentierede tunge løft, og uden et datavidenskabsteam.

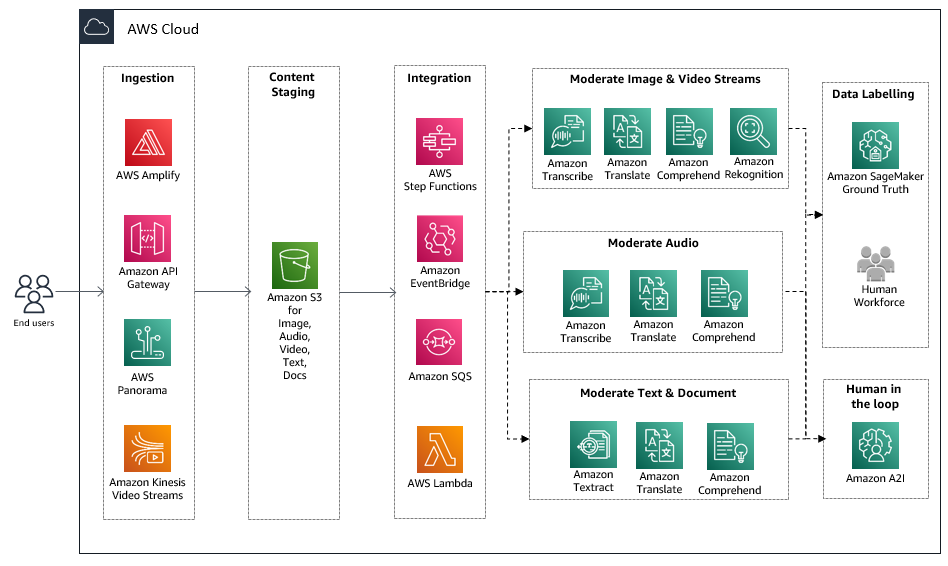

I dette indlæg demonstrerer vi, hvordan man effektivt modererer rum, hvor kunder diskuterer og anmelder produkter ved hjælp af tekst, lyd, billeder, video og endda PDF-filer. Følgende diagram illustrerer løsningsarkitekturen.

Forudsætninger

Som standard demonstrerer disse mønstre en serverløs metode, hvor du kun betaler for det, du bruger. Du betaler fortsat for beregningsressourcerne, som f.eks AWS Fargate beholdere, og opbevaring, som f.eks Amazon Simple Storage Service (Amazon S3), indtil du sletter disse ressourcer. De omtalte AWS AI-tjenester følger også en forbrugsprismodel pr. operation.

Ikke-produktionsmiljøer kan teste hvert af disse mønstre i Free Tier, forudsat at din konto er berettiget.

Moderat almindelig tekst

Først skal du implementere indholdsmoderering for almindelig tekst. Denne procedure tjener som grundlag for mere sofistikerede medietyper og indebærer to trin på højt niveau:

- Oversæt teksten.

- Analyser teksten.

Globale kunder ønsker at samarbejde med sociale platforme på deres modersmål. At opfylde denne forventning kan tilføje kompleksitet, fordi designteams skal konstruere en arbejdsgang eller trin for hvert sprog. I stedet kan du bruge Amazon Oversæt at konvertere tekst til over 70 sprog og varianter i over 15 regioner. Denne funktion gør det muligt for dig at skrive analyseregler for et enkelt sprog og anvende disse regler på tværs af det globale onlinefællesskab.

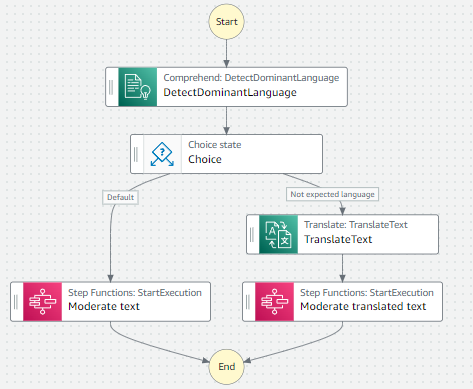

Amazon Translate er en neural maskinoversættelsestjeneste, der leverer hurtig, højkvalitets, overkommelig og tilpasselig sprogoversættelse. Du kan integrere det i dine arbejdsgange for at opdage det dominerende sprog og oversætte teksten. Følgende diagram illustrerer arbejdsgangen.

API'erne fungerer som følger:

- DetectDominantLanguage API bestemmer det dominerende sprog for inputteksten. For en liste over sprog, som Amazon Comprehend kan registrere, se Dominerende sprog.

- Oversæt tekst API oversætter inputtekst fra kildesproget til målsproget med valgfri bandeord maskering. For en liste over tilgængelige sprog og sprogkoder, se Understøttede sprog og sprogkoder.

- StartExecution , StartSyncExecution API'er starter en AWS-trinfunktioner statsmaskine.

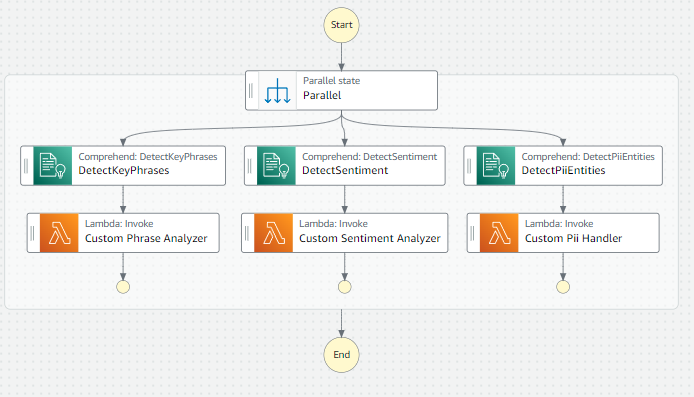

Dernæst kan du bruge NLP til at afdække sammenhænge i tekst, som at opdage nøglesætninger, analysere følelser og opdage personligt identificerbare oplysninger (PII). Amazon Comprehend API'er udvinder disse værdifulde indsigter og videregiver dem til brugerdefinerede funktionsbehandlere.

Kører de handlere indenfor AWS Lambda funktioner skalerer din kode elastisk uden at tænke på servere eller klynger. Alternativt kan du behandle indsigter fra Amazon Comprehend med mikroservices arkitekturmønstre. Uanset kørselstid fokuserer din kode på at bruge resultaterne, ikke at analysere tekst.

Følgende diagram illustrerer arbejdsgangen.

Lambda-funktioner interagerer med følgende API'er:

- DetectEntities API opdager og grupperer navnene på objekter fra den virkelige verden såsom personer og steder i teksten. Du kan bruge et tilpasset ordforråd til at fjerne upassende og virksomhedsspecifikke enhedstyper.

- OpdagSentiment API identificerer den overordnede følelse af teksten som positiv, negativ eller neutral. Du kan træne brugerdefinerede klassificeringsorganer til at genkende de branchespecifikke situationer af interesse og uddrage tekstens konceptuelle betydning.

- DetectPIIEntities API identificerer PII i din tekst, såsom adresse, bankkontonummer eller telefonnummer. Outputtet indeholder typen af PII-entitet og dens tilsvarende placering.

Moderat lydfiler

For at moderere lydfiler skal du transskribere filen til tekst og derefter analysere den. Denne proces har to varianter afhængigt af, om du behandler individuelle filer (synkron) eller live-lydstreams (asynkron). Synkrone arbejdsgange er ideelle til batchbehandling, hvor den, der ringer, modtager ét komplet svar. I modsætning hertil kræver lydstreams periodisk prøveudtagning med flere transskriptionsresultater.

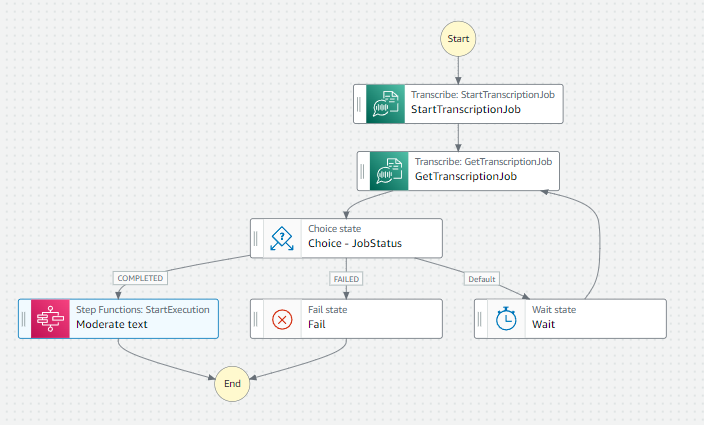

Amazon Transcrib er en automatisk talegenkendelsestjeneste, der bruger ML-modeller til at konvertere lyd til tekst. Du kan integrere det i synkrone arbejdsgange ved starte et transskriptionsjob og periodisk forespørger om jobbets status. Når jobbet er fuldført, kan du analysere outputtet ved hjælp af almindelig tekstmoderering fra det forrige trin.

Følgende diagram illustrerer arbejdsgangen.

API'erne fungerer som følger:

- Start TransskriptionJob API starter et asynkront job til at transskribere tale til tekst.

- Få TranscriptionJob API returnerer oplysninger om et transskriptionsjob. For at se status for jobbet skal du kontrollere

TranscriptionJobStatusMark. Hvis statusegenskaben erCOMPLETED, kan du finde resultaterne på det sted, der er angivet iTranscriptFileUriMark. Hvis du aktiverer indholdsredigering, vises den redigerede transskription iRedactedTranscriptFileUri.

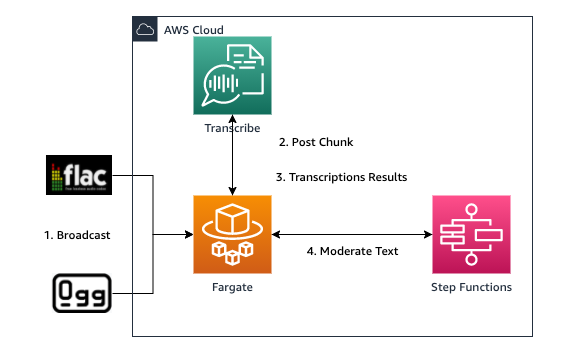

Live lydstreams har brug for et andet mønster, der understøtter en leveringsmodel i realtid. Streaming kan omfatte forudindspillede medier, såsom film, musik og podcasts, og realtidsmedier, såsom live nyhedsudsendelser. Du kan transskribere lydstykker øjeblikkeligt ved hjælp af Amazon Transscribe streaming over HTTP/2 og WebSockets protokoller. Efter at have sendt en del til tjenesten, modtager du en eller flere transskriptionsresultatobjekter beskriver de delvise og komplette transkriptionssegmenter. Segmenter, der kræver moderering, kan genbruge almindelig tekst-arbejdsgangen fra forrige afsnit. Følgende diagram illustrerer denne proces.

StartStreamingTranscription API starter en tovejs HTTP/2-stream, hvor lyd streames til Amazon Transcribe og streamer transskriptionsresultaterne til din applikation.

Moderer billeder og fotos

Moderering af billeder kræver registrering af upassende, uønsket eller stødende indhold, der indeholder nøgenhed, suggestivitet, vold og andre kategorier fra billeder og fotoindhold.

Amazon-anerkendelse giver dig mulighed for at strømline eller automatisere dine billed- og videomodereringsworkflows uden at kræve ML-ekspertise. Amazon Rekognition returnerer en hierarkisk taksonomi af moderationsrelaterede etiketter. Disse oplysninger gør det nemt at definere detaljerede forretningsregler i henhold til dine standarder og praksis, brugersikkerhed og retningslinjer for overholdelse. ML-erfaring er ikke påkrævet for at bruge disse muligheder. Amazon Rekognition kan registrere og læse teksten i et billede og returnere afgrænsningsfelter for hvert fundet ord. Amazon Rekognition understøtter tekstgenkendelse skrevet på engelsk, arabisk, russisk, tysk, fransk, italiensk, portugisisk og spansk!

Du kan bruge maskinforudsigelserne til helt at automatisere specifikke modereringsopgaver. Denne egenskab gør det muligt for menneskelige moderatorer at fokusere på arbejde af højere orden. Derudover kan Amazon Rekognition hurtigt gennemgå millioner af billeder eller tusindvis af videoer ved hjælp af ML og markere den undergruppe af aktiver, der kræver yderligere handling. Forfiltrering hjælper med at give en omfattende, men omkostningseffektiv moderationsdækning, samtidig med at den reducerer mængden af indhold, som menneskelige teams modererer.

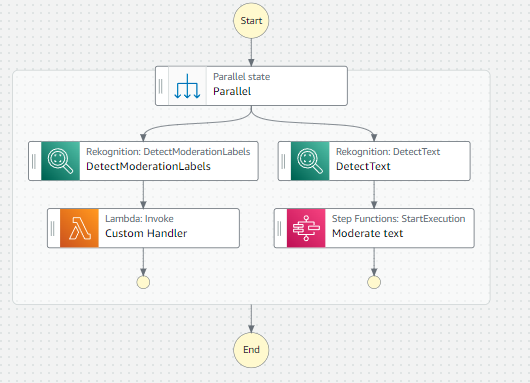

Følgende diagram illustrerer arbejdsgangen.

API'erne fungerer som følger:

- DetectModerationLabels API registrerer usikkert indhold i specificerede JPEG- eller PNG-formaterede billeder. Brug DetectModerationLabels til at moderere billeder afhængigt af dine krav. For eksempel vil du måske filtrere billeder, der indeholder nøgenhed, men ikke billeder, der indeholder suggestivt indhold.

- Opdag tekst API registrerer tekst i inputbilledet og konverterer den til maskinlæsbar tekst.

Moderat rich text-dokumenter

Dernæst kan du bruge amazontekst at udtrække håndskrevet tekst og data fra scannede dokumenter. Denne proces begynder med at påberåbe sig Start Dokumentanalyse handling for at parse Microsoft Word- og Adobe PDF-filer. Du kan overvåge jobbets fremskridt med Hent Dokumentanalyse handling.

Analyseresultatet specificerer hver afdækket side, afsnit, tabel og nøgleværdipar i dokumentet. Antag for eksempel, at en sundhedsudbyder kun skal maskere patientnavne i feltet med beskrivelse af krav. I så fald kan analyserapporten magt intelligente dokumentbehandlingspipelines der modererer og redigerer det specifikke datafelt. Følgende diagram illustrerer rørledningen.

API'erne fungerer som følger:

- Start Dokumentanalyse API starter den asynkrone analyse af et inputdokument for relationer mellem detekterede elementer såsom nøgleværdi-par, tabeller og udvalgselementer

- Hent Dokumentanalyse API får resultaterne for en Amazon Textract asynkron operation, der analyserer tekst i et dokument

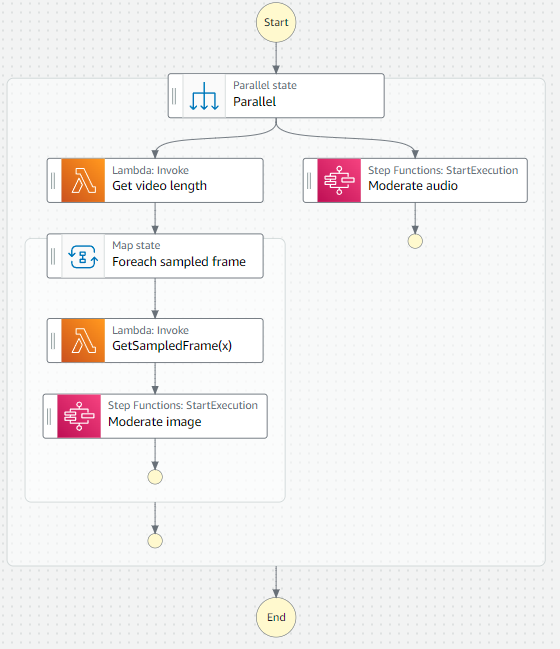

Moderat videoer

En standardtilgang til moderering af videoindhold er gennem en frame-sampling-procedure. Mange use cases behøver ikke at kontrollere hver frame, og at vælge en hver 15-30 sekunder er tilstrækkelig. Samplede videorammer kan genbruge tilstandsmaskinen til at moderere billeder fra det forrige afsnit. På samme måde kan den eksisterende proces til moderering af lyd understøtte filens hørbare indhold. Følgende diagram illustrerer denne arbejdsgang.

påberåbe API kører en Lambda-funktion og venter synkront på svaret.

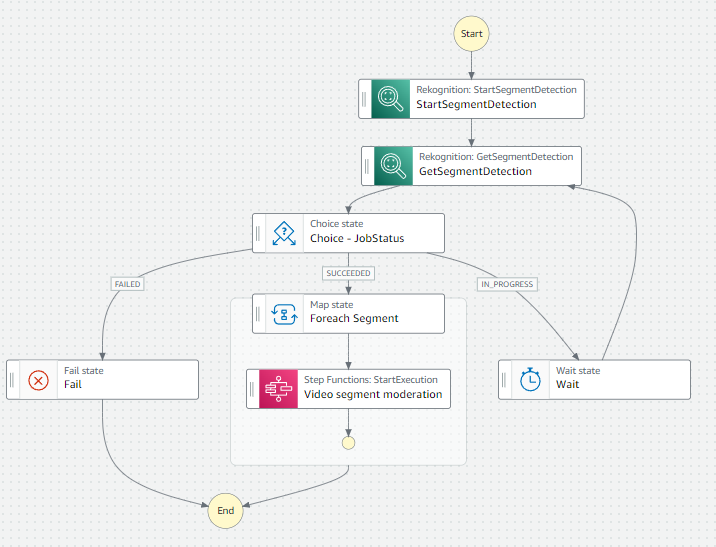

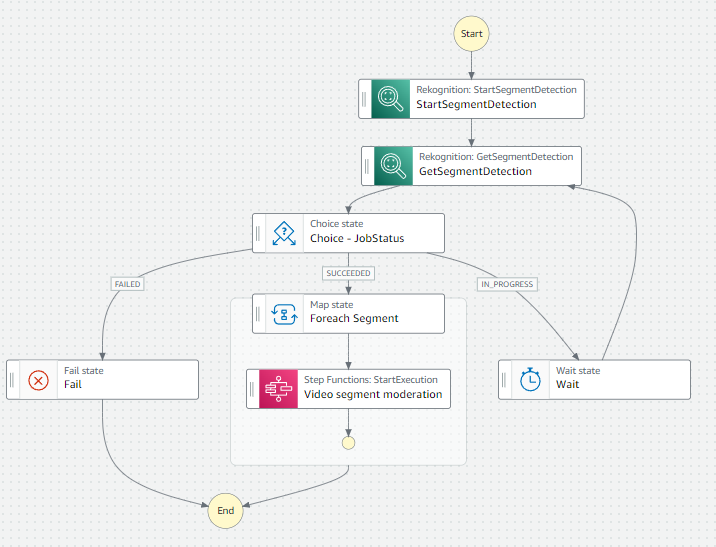

Antag, at mediefilen er en hel film med flere scener. I så fald kan du bruge Amazon Rekognition Segment API, en sammensat API til detektering af tekniske signaler eller skuddetektion. Dernæst kan du bruge disse tidsforskydninger til at parallelbehandle hvert segment med det forrige videomodereringsmønster, som vist i følgende diagram.

API'erne fungerer som følger:

- StartSegmentationDetection API starter asynkron detektering af segmentdetektion i en lagret video

- GetSegmentationDetection API får segmentdetektionsresultaterne af en Amazon Rekognition Video-analyse startet af StartSegmentDetection API

At udtrække individuelle billeder fra filmen kræver ikke, at objektet hentes fra Amazon S3 flere gange. En naiv løsning involverer at læse videoen ind i hukommelsen og paginere til slutningen. Dette mønster er ideelt til korte klip, og hvor vurderinger ikke er tidsfølsomme.

En anden strategi indebærer at flytte filen én gang til Amazon Elastic File System (Amazon EFS), et fuldt administreret, skalerbart, delt filsystem til andre AWS-tjenester, såsom Lambda. Med Amazon EFS til Lambda, kan du effektivt distribuere data på tværs af funktionsankaldelser. Hver invokation håndterer effektivt en lille del og frigør potentialet for massivt parallel behandling og hurtigere behandlingstider.

Ryd op

Når du har eksperimenteret med metoderne i dette indlæg, bør du slette alt indhold i S3-bøtter for at undgå fremtidige omkostninger. Hvis du implementerede disse mønstre med forudsatte computerressourcer som f.eks Amazon Elastic Compute Cloud (Amazon EC2) eller Amazon Elastic Container Service (Amazon ECS), bør du stoppe disse tilfælde for at undgå yderligere gebyrer.

Konklusion

Brugergenereret indhold og dets værdi for spil, sociale medier, e-handel og finansielle organisationer og sundhedstjenester vil fortsætte med at vokse. Alligevel skal startups og store organisationer skabe effektive modereringsprocesser for at beskytte brugere, information og virksomheden, samtidig med at driftsomkostningerne sænkes. Denne løsning viser, hvordan AI-, ML- og NLP-teknologier effektivt kan hjælpe dig med at moderere indhold i stor skala. Du kan tilpasse AWS AI-tjenester til at imødekomme dine specifikke modereringsbehov! Disse fuldt administrerede funktioner fjerner operationelle kompleksiteter. Denne fleksibilitet integrerer strategisk kontekstuel indsigt og menneskeligt talent i dine modereringsprocesser.

For yderligere information, ressourcer og for at komme i gang gratis i dag, besøg Hjemmeside for AWS indholdsmoderering.

Om forfatterne

Nate Bachmeier er en AWS Senior Solutions Architect, der nomadisk udforsker New York, én cloud-integration ad gangen. Han har specialiseret sig i migrering og modernisering af applikationer. Udover dette er Nate fuldtidsstuderende og har to børn.

Nate Bachmeier er en AWS Senior Solutions Architect, der nomadisk udforsker New York, én cloud-integration ad gangen. Han har specialiseret sig i migrering og modernisering af applikationer. Udover dette er Nate fuldtidsstuderende og har to børn.

Ram Pathangi er Solutions Architect hos Amazon Web Services i San Francisco Bay Area. Han har hjulpet kunder inden for landbrug, forsikring, bank, detailhandel, sundhedspleje og biovidenskab, gæstfrihed og højteknologiske vertikaler med at drive deres forretninger med succes på AWS Cloud. Han har specialiseret sig i databaser, analyse og maskinlæring.

Ram Pathangi er Solutions Architect hos Amazon Web Services i San Francisco Bay Area. Han har hjulpet kunder inden for landbrug, forsikring, bank, detailhandel, sundhedspleje og biovidenskab, gæstfrihed og højteknologiske vertikaler med at drive deres forretninger med succes på AWS Cloud. Han har specialiseret sig i databaser, analyse og maskinlæring.

Roop Bains er Solutions Architect hos AWS med fokus på AI/ML. Han brænder for at hjælpe kunder med at innovere og nå deres forretningsmål ved hjælp af kunstig intelligens og maskinlæring. I sin fritid nyder Roop at læse og vandre.

Roop Bains er Solutions Architect hos AWS med fokus på AI/ML. Han brænder for at hjælpe kunder med at innovere og nå deres forretningsmål ved hjælp af kunstig intelligens og maskinlæring. I sin fritid nyder Roop at læse og vandre.

- "

- 100

- 70

- Om

- ABSTRACT

- Konto

- tværs

- Handling

- aktioner

- Desuden

- Yderligere

- adresse

- Reklame

- Landbrug

- AI

- AI-tjenester

- Amazon

- Amazon Web Services

- beløb

- analyse

- analytics

- api

- API'er

- Anvendelse

- applikationer

- tilgang

- arkitektur

- OMRÅDE

- kunstig

- kunstig intelligens

- Kunstig intelligens (AI)

- Kunstig intelligens og maskinlæring

- Aktiver

- lyd

- automatisere

- Automatiseret

- Automatisk Ur

- til rådighed

- AWS

- Bank

- bankkonto

- Bank

- Bugt

- bygge

- virksomhed

- virksomheder

- Caller

- kapaciteter

- bære

- tilfælde

- udfordrende

- afgifter

- clips

- Cloud

- kode

- samarbejde

- Kom

- Fællesskaber

- samfund

- kompleksiteter

- Compliance

- kompatibel

- omfattende

- Compute

- Tilslutninger

- forbruge

- forbrug

- Container

- Beholdere

- indeholder

- indhold

- fortsæt

- bidrage

- Tilsvarende

- omkostningseffektiv

- Omkostninger

- skabe

- skik

- Kunder

- tilpasses

- data

- datalogi

- databaser

- leverer

- levering

- demonstrere

- Afhængigt

- Design

- opdaget

- Detektion

- forskellige

- diskutere

- dokumenter

- Er ikke

- køre

- e-handel

- ecommerce

- effektivitet

- effektiv

- effektivt

- muliggøre

- engagement

- Engelsk

- enhed

- eksempel

- eksisterende

- forvente

- erfaring

- Oplevelser

- eksperiment

- ekspertise

- eksponentielt

- FAST

- hurtigere

- Funktionalitet

- finansielle

- Fleksibilitet

- flow

- Fokus

- fokuserer

- følger

- efter

- fundet

- Foundation

- FRAME

- Francisco

- Gratis

- Fransk

- Brændstof

- funktion

- yderligere

- fremtiden

- spil

- Global

- Gruppens

- Grow

- retningslinjer

- Helse

- sundhedspleje

- hjælpe

- hjælpe

- hjælper

- høj kvalitet

- Hvordan

- How To

- HTTPS

- menneskelig

- billede

- KIMOs Succeshistorier

- gennemføre

- implementeret

- omfatter

- stigende

- individuel

- industrier

- oplysninger

- indgang

- indsigt

- forsikring

- integrere

- integration

- Intelligens

- interesse

- IT

- Job

- Nøgle

- børn

- Etiketter

- Sprog

- Sprog

- stor

- LÆR

- læring

- Life Sciences

- løft

- Liste

- placering

- maskine

- machine learning

- maerker

- lykkedes

- maske

- betyder

- Medier

- møde

- Medlemmer

- Hukommelse

- microsoft

- måske

- millioner

- ML

- Mobil

- model

- modeller

- Overvåg

- mere

- film

- Film

- flytning

- flere

- Musik

- navne

- Natural

- negativ

- New York

- nyheder

- nummer

- online

- betjene

- drift

- organisationer

- Andet

- samlet

- lidenskabelige

- Mønster

- Betal

- Mennesker

- sætninger

- Platforme

- Podcasts

- fattige

- Portugisisk

- positiv

- potentiale

- magt

- Forudsigelser

- tidligere

- prissætning

- behandle

- Processer

- forarbejdning

- Produkter

- ejendom

- beskytte

- protokoller

- give

- hurtigt

- Læsning

- realtid

- modtage

- genkende

- reducere

- Relationer

- indberette

- kræver

- påkrævet

- Krav

- Ressourcer

- svar

- Resultater

- detail

- afkast

- afkast

- gennemgå

- Anmeldelser

- Risiko

- regler

- Kør

- sikker

- Sikkerhed

- San

- San Francisco

- skalerbar

- Scale

- scener

- Videnskab

- VIDENSKABER

- sekunder

- segment

- segmenter

- stemningen

- Serverless

- tjeneste

- Tjenester

- delt

- Kort

- vist

- Tilsvarende

- Simpelt

- lille

- Social

- sociale medier

- løsninger

- Løsninger

- sofistikeret

- rum

- specialiseret

- standard

- standarder

- starte

- påbegyndt

- starter

- Nystartede

- Tilstand

- Status

- opbevaring

- Strategi

- strøm

- streaming

- studerende

- Succesfuld

- support

- Understøtter

- systemet

- Talent

- mål

- opgaver

- hold

- Teknisk

- Teknologier

- prøve

- The Source

- Tænker

- tusinder

- Gennem

- tid

- i dag

- sammen

- traditionelle

- Transcript

- Oversættelse

- typer

- afdække

- brug

- brugere

- værdi

- række

- vertikaler

- video

- Videoer

- bind

- web

- webservices

- Hvad

- hvorvidt

- mens

- inden for

- uden

- Arbejde