Falske nyheder, defineret som nyheder, der formidler eller inkorporerer falsk, opdigtet eller bevidst vildledende information, har eksisteret så tidligt som trykpressens fremkomst. Den hurtige spredning af falske nyheder og desinformation online bedrager ikke kun offentligheden, men kan også have en dyb indvirkning på samfundet, politik, økonomi og kultur. Eksempler omfatter:

- Opdyrke mistillid til medierne

- Undergraver den demokratiske proces

- Spredning af falsk eller miskrediteret videnskab (for eksempel anti-vax-bevægelsen)

Fremskridt inden for kunstig intelligens (AI) og maskinlæring (ML) har gjort det endnu nemmere at udvikle værktøjer til at skabe og dele falske nyheder. Tidlige eksempler inkluderer avancerede sociale bots og automatiserede konti, der overdriver den indledende fase af spredning af falske nyheder. Generelt er det ikke trivielt for offentligheden at afgøre, om sådanne konti er personer eller bots. Derudover er sociale bots ikke ulovlige værktøjer, og mange virksomheder køber dem lovligt som en del af deres marketingstrategi. Derfor er det ikke nemt at bremse brugen af sociale bots systematisk.

Nylige opdagelser inden for generativ AI gør det muligt at producere tekstindhold i et hidtil uset tempo ved hjælp af store sprogmodeller (LLM'er). LLM'er er generative AI-tekstmodeller med over 1 milliard parametre, og de er lettet i syntesen af tekst af høj kvalitet.

I dette indlæg undersøger vi, hvordan du kan bruge LLM'er til at tackle det fremherskende problem med at opdage falske nyheder. Vi foreslår, at LLM'er er tilstrækkeligt avancerede til denne opgave, især hvis forbedrede promptteknikker som f.eks Chain-of-Thought , Reagere bruges i forbindelse med værktøjer til informationssøgning.

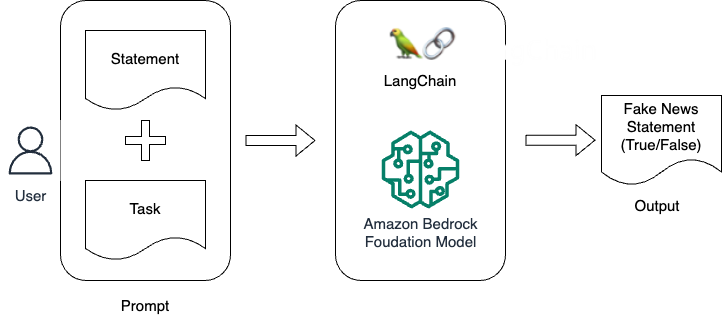

Vi illustrerer dette ved at skabe en Langkæde applikation, der, givet en nyhed, informerer brugeren om, hvorvidt artiklen er sand eller falsk ved hjælp af naturligt sprog. Løsningen bruger også Amazonas grundfjeld, en fuldt administreret tjeneste, der gør basismodeller (FM'er) fra Amazon og tredjepartsmodeludbydere tilgængelige via AWS Management Console og API'er.

LLM'er og falske nyheder

Fænomenet med falske nyheder begyndte at udvikle sig hurtigt med fremkomsten af internettet og mere specifikt sociale medier (Nielsen et al., 2017). På sociale medier kan falske nyheder hurtigt deles i en brugers netværk, hvilket får offentligheden til at danne sig en forkert kollektiv mening. Derudover udbreder folk ofte falske nyheder impulsivt og ignorerer indholdets faktualitet, hvis nyhederne resonerer med deres personlige normer (Tsipursky et al. 2018). Forskning inden for samfundsvidenskab har antydet, at kognitiv bias (bekræftelsesbias, bandwagon-effekt og valgstøttende bias) er en af de mest afgørende faktorer for at træffe irrationelle beslutninger med hensyn til både skabelse og forbrug af falske nyheder (Kim et al., 2021). Dette indebærer også, at nyhedsforbrugere kun deler og forbruger information i retning af at styrke deres overbevisning.

Kraften ved generativ AI til at producere tekstuelt og rigt indhold i et hidtil uset tempo forværrer problemet med falske nyheder. Et eksempel, der er værd at nævne, er deepfake-teknologi – der kombinerer forskellige billeder på en original video og genererer en anden video. Udover den desinformationshensigt, som menneskelige aktører bringer til blandingen, tilføjer LLM'er et helt nyt sæt udfordringer:

- Faktiske fejl – LLM'er har en øget risiko for at indeholde faktuelle fejl på grund af karakteren af deres træning og evne til at være kreativ, mens de genererer de næste ord i en sætning. LLM-træning er baseret på gentagne gange at præsentere en model med ufuldstændig input, derefter bruge ML træningsteknikker, indtil den korrekt udfylder hullerne, og derved lære sprogstruktur og en sprogbaseret verdensmodel. Derfor, selvom LLM'er er gode mønstermatchere og re-kombinere ("stokastiske papegøjer"), fejler de en række simple opgaver, der kræver logisk ræsonnement eller matematisk deduktion, og kan hallucinere svar. Derudover er temperatur en af LLM-inputparametrene, der styrer modellens adfærd, når det næste ord i en sætning genereres. Ved at vælge en højere temperatur vil modellen bruge et ord med lavere sandsynlighed, hvilket giver et mere tilfældigt svar.

- langvarige – Genererede tekster har en tendens til at være lange og mangler en klart defineret granularitet for individuelle fakta.

- Manglende faktatjek – Der er ingen standardiseret værktøj til rådighed til faktatjek under processen med tekstgenerering.

Samlet set har kombinationen af menneskelig psykologi og begrænsninger af AI-systemer skabt en perfekt storm for spredningen af falske nyheder og misinformation online.

Løsningsoversigt

LLM'er demonstrerer fremragende evner inden for sproggenerering, -forståelse og få-skudslæring. De er trænet i et stort korpus af tekst fra internettet, hvor kvaliteten og nøjagtigheden af udvundet naturligt sprog måske ikke er sikret.

I dette indlæg giver vi en løsning til at opdage falske nyheder baseret på både Chain-of-Thought og Re-Act (Reasoning and Acting) prompte tilgange. Først diskuterer vi disse to hurtige ingeniørteknikker, derefter viser vi deres implementering ved hjælp af LangChain og Amazon Bedrock.

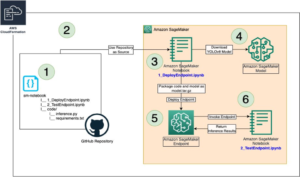

Følgende arkitekturdiagram skitserer løsningen for vores falske nyhedsdetektor.

Arkitekturdiagram til opdagelse af falske nyheder.

Vi bruger en delmængde af FEVER datasæt indeholdende en erklæring og grundsandheden om erklæringen, der angiver falske, sande eller ukontrollerbare påstande (Thorne J. et al., 2018).

Arbejdsgangen kan opdeles i følgende trin:

- Brugeren vælger et af udsagn for at kontrollere, om det er falsk eller sandt.

- Udtalelsen og opdagelsesopgaven med falske nyheder er inkorporeret i prompten.

- Spørgsmålet sendes til LangChain, som påkalder FM i Amazon Bedrock.

- Amazon Bedrock returnerer et svar på brugerens anmodning med udsagnet True or False.

I dette indlæg bruger vi Claude v2-modellen fra Anthrophic (anthropic.claude-v2). Claude er en generativ LLM baseret på Anthropics forskning i at skabe pålidelige, fortolkbare og styrbare AI-systemer. Skabt ved hjælp af teknikker som forfatningsmæssig AI og harmløshedstræning, udmærker Claude sig ved tankevækkende dialog, indholdsskabelse, kompleks ræsonnement, kreativitet og kodning. Men ved at bruge Amazon Bedrock og vores løsningsarkitektur har vi også fleksibiliteten til at vælge blandt andre FM'er leveret af Amazon, AI21labs, Sammenhængog Stabilitet.ai.

Du kan finde implementeringsdetaljerne i de følgende afsnit. Kildekoden er tilgængelig i GitHub-depotet.

Forudsætninger

Til denne tutorial skal du bruge en bash-terminal med Python 3.9 eller højere installeret på enten Linux, Mac eller et Windows-undersystem til Linux og en AWS-konto.

Vi anbefaler også at bruge enten en Amazon SageMaker Studio notesbog, en AWS Cloud9 eksempel eller en Amazon Elastic Compute Cloud (Amazon EC2) forekomst.

Implementer registrering af falske nyheder ved hjælp af Amazon Bedrock API

Løsningen bruger Amazon Bedrock API, som kan tilgås ved hjælp af AWS kommandolinjegrænseflade (AWS CLI), den AWS SDK til Python (Boto3), eller en Amazon SageMaker notesbog. Der henvises til Amazon Bedrock brugervejledning for mere information. Til dette indlæg bruger vi Amazon Bedrock API via AWS SDK til Python.

Konfigurer Amazon Bedrock API-miljø

For at konfigurere dit Amazon Bedrock API-miljø skal du udføre følgende trin:

- Download den seneste Boto3 eller opgrader den:

- Sørg for at konfigurere AWS-legitimationsoplysningerne ved hjælp af

aws configurekommando eller videregive dem til Boto3-klienten. - Installer den seneste version af Langkæde:

Du kan nu teste din opsætning ved hjælp af følgende Python shell-script. Scriptet instansierer Amazon Bedrock-klienten ved hjælp af Boto3. Dernæst kalder vi list_foundation_models API for at få listen over fundamentmodeller, der er tilgængelige til brug.

Efter at have kørt den foregående kommando, bør du få listen over FM'er fra Amazon Bedrock.

LangChain som en hurtig kædeløsning

For at opdage falske nyheder for en given sætning følger vi nul-skuds Chain-of-Thought-ræsonnementsprocessen (Wei J. et al., 2022), som er sammensat af følgende trin:

- I første omgang forsøger modellen at skabe en erklæring om nyhederne.

- Modellen opretter en punktliste over påstande.

- For hver påstand bestemmer modellen, om påstanden er sand eller falsk. Bemærk, at ved at bruge denne metodologi, bygger modellen udelukkende på sin interne viden (vægte beregnet i førtræningsfasen) for at nå frem til en dom. Oplysningerne verificeres ikke mod eksterne data på dette tidspunkt.

- Givet fakta, svarer modellen SAND eller FALSK for det givne udsagn i prompten.

For at opnå disse trin bruger vi LangChain, en ramme til udvikling af applikationer drevet af sprogmodeller. Denne ramme giver os mulighed for at udvide FM'erne ved at kæde forskellige komponenter sammen for at skabe avancerede use cases. I denne løsning bruger vi det indbyggede SimpleSequentialChain i LangChain for at skabe en simpel sekventiel kæde. Dette er meget nyttigt, fordi vi kan tage output fra én kæde og bruge det som input til en anden.

Amazon Bedrock er integreret med LangChain, så du behøver kun at instantiere det ved at passere model_id ved instansiering af Amazon Bedrock-objektet. Om nødvendigt kan modelinferensparametrene leveres gennem model_kwargs argument, såsom:

- maxTokenCount – Det maksimale antal tokens i det genererede svar

- stopSekvenser – Stopsekvensen brugt af modellen

- temperatur – En værdi, der går mellem 0-1, hvor 0 er den mest deterministiske og 1 er den mest kreative

- top – En værdi, der går mellem 0-1 og bruges til at kontrollere tokens valg baseret på sandsynligheden for de potentielle valg

Hvis det er første gang, du bruger en Amazon Bedrock-grundmodel, skal du sørge for at anmode om adgang til modellen ved at vælge fra listen over modeller på Modeladgang side på Amazon Bedrock-konsollen, som i vores tilfælde er claude-v2 fra Anthropic.

Den følgende funktion definerer Chain-of-Thought-promptkæden, som vi nævnte tidligere til at opdage falske nyheder. Funktionen tager Amazon Bedrock-objektet (llm) og brugerprompten (q) som argumenter. LangChain's PromptTemplate funktionalitet bruges her til at foruddefinere en opskrift til generering af prompter.

Den følgende kode kalder den funktion, vi definerede tidligere, og giver svaret. Udtalelsen er TRUE or FALSE. TRUE betyder, at den afgivne erklæring indeholder korrekte fakta, og FALSE betyder, at udsagnet indeholder mindst ét ukorrekt faktum.

Et eksempel på et udsagn og en modelsvar findes i følgende output:

ReAct og værktøjer

I det foregående eksempel identificerede modellen korrekt, at udsagnet er falsk. At sende forespørgslen igen viser imidlertid modellens manglende evne til at skelne rigtigheden af fakta. Modellen har ikke værktøjerne til at verificere sandheden af udsagn ud over sin egen træningshukommelse, så efterfølgende kørsler af den samme prompt kan føre til, at den fejlmærker falske udsagn som sande. I den følgende kode har du en anden kørsel af det samme eksempel:

En teknik til at garantere sandfærdighed er ReAct. React (Yao S. et al., 2023) er en hurtig teknik, der udvider fundamentmodellen med en agents handlingsrum. I dette indlæg, såvel som i ReAct-papiret, implementerer handlingsrummet informationssøgning ved hjælp af søge-, opslags- og afslutningshandlinger fra en simpel Wikipedia-web-API.

Årsagen til at bruge ReAct i forhold til Chain-of-Thought er at bruge ekstern vidensøgning til at udvide fundamentmodellen for at opdage, om en given nyhed er falsk eller sand.

I dette indlæg bruger vi LangChains implementering af ReAct gennem agenten ZERO_SHOT_REACT_DESCRIPTION. Vi ændrer den tidligere funktion for at implementere ReAct og bruge Wikipedia ved at bruge load_tools-funktionen fra langkæde.agenter.

Vi skal også installere Wikipedia-pakken:

!pip install Wikipedia

Nedenfor er den nye kode:

Følgende er outputtet af den foregående funktion givet den samme sætning, der blev brugt før:

Ryd op

For at spare omkostninger skal du slette alle de ressourcer, du har implementeret som en del af selvstudiet. Hvis du lancerede AWS Cloud9 eller en EC2-instans, kan du slette den via konsollen eller ved hjælp af AWS CLI. På samme måde kan du slette den SageMaker-notesbog, du muligvis har oprettet via SageMaker-konsollen.

Begrænsninger og beslægtet arbejde

Området for opdagelse af falske nyheder forskes aktivt i det videnskabelige samfund. I dette indlæg brugte vi Chain-of-Thought og ReAct-teknikker, og i evalueringen af teknikkerne fokuserede vi kun på nøjagtigheden af prompt-teknikklassificeringen (hvis en given udsagn er sand eller falsk). Derfor har vi ikke overvejet andre vigtige aspekter, såsom hastigheden af svaret, og heller ikke udvidet løsningen til yderligere videnbasekilder udover Wikipedia.

Selvom dette indlæg fokuserede på to teknikker, Chain-of-Thought og ReAct, har et omfattende arbejde undersøgt, hvordan LLM'er kan opdage, eliminere eller afbøde falske nyheder. Lee et al. har foreslået brugen af en encoder-decoder-model, der anvender NER (navngivet entitetsgenkendelse) til at maskere de navngivne entiteter for at sikre, at det maskerede token rent faktisk bruger den viden, der er kodet i sprogmodellen. Chern et.al. udviklet FacTool, som bruger Chain-of-Thought-principper til at udtrække krav fra prompten og følgelig indsamle relevante beviser for påstandene. LLM bedømmer derefter påstandens faktualitet givet den hentede liste over beviser. Du E. et al. præsenterer en komplementær tilgang, hvor flere LLM'er foreslår og debatterer deres individuelle svar og begrundelsesprocesser over flere runder for at nå frem til et fælles endeligt svar.

Baseret på litteraturen ser vi, at effektiviteten af LLM'er til at opdage falske nyheder øges, når LLM'erne udvides med ekstern viden og multi-agent samtalekapacitet. Disse tilgange er dog mere beregningsmæssigt komplekse, fordi de kræver flere modelopkald og interaktioner, længere prompter og lange netværkslagkald. I sidste ende udmønter denne kompleksitet sig i øgede samlede omkostninger. Vi anbefaler, at man vurderer forholdet mellem omkostninger og ydeevne, før man implementerer lignende løsninger i produktionen.

Konklusion

I dette indlæg dykkede vi ned i, hvordan man bruger LLM'er til at tackle det fremherskende problem med falske nyheder, som er en af de største udfordringer i vores samfund i dag. Vi startede med at skitsere udfordringerne ved falske nyheder med vægt på dets potentiale til at påvirke offentlighedens følelser og forårsage samfundsforstyrrelser.

Vi introducerede derefter konceptet med LLM'er som avancerede AI-modeller, der trænes på en betydelig mængde data. På grund af denne omfattende træning kan disse modeller prale af en imponerende sprogforståelse, der gør dem i stand til at producere menneskelignende tekst. Med denne kapacitet demonstrerede vi, hvordan LLM'er kan udnyttes i kampen mod falske nyheder ved at bruge to forskellige promptteknikker, Chain-of-Thought og ReAct.

Vi understregede, hvordan LLM'er kan lette faktatjektjenester i et uovertruffent omfang, givet deres evne til at behandle og analysere store mængder tekst hurtigt. Dette potentiale for realtidsanalyse kan føre til tidlig opdagelse og indeslutning af falske nyheder. Vi illustrerede dette ved at lave et Python-script, der, givet en erklæring, fremhæver for brugeren, om artiklen er sand eller falsk ved brug af naturligt sprog.

Vi afsluttede med at understrege begrænsningerne ved den nuværende tilgang og sluttede med en håbefuld bemærkning og understregede, at LLM'er med de korrekte sikkerhedsforanstaltninger og løbende forbedringer kunne blive uundværlige værktøjer i kampen mod falske nyheder.

Vi vil meget gerne høre fra dig. Fortæl os, hvad du synes i kommentarfeltet, eller brug problemforummet i GitHub-depotet.

Ansvarsfraskrivelse: Koden i dette indlæg er kun beregnet til uddannelses- og eksperimenterende formål. Det bør ikke stoles på for at opdage falske nyheder eller misinformation i virkelige produktionssystemer. Der gives ingen garantier for nøjagtigheden eller fuldstændigheden af detektering af falske nyheder ved hjælp af denne kode. Brugere bør udvise forsigtighed og udføre due diligence, før de anvender disse teknikker i følsomme applikationer.

For at komme i gang med Amazon Bedrock, besøg Amazon Bedrock-konsol.

Om forfatterne

Anamaria Todor er en Principal Solutions Architect med base i København, Danmark. Hun så sin første computer, da hun var 4 år gammel og gav aldrig slip på datalogi, videospil og teknik siden. Hun har arbejdet i forskellige tekniske roller, fra freelancer, full-stack udvikler, til dataingeniør, teknisk lead og CTO, hos forskellige virksomheder i Danmark med fokus på spil- og reklamebranchen. Hun har været hos AWS i over 3 år, hvor hun har arbejdet som Principal Solutions Architect, hovedsageligt med fokus på life sciences og AI/ML. Anamaria har en bachelor i anvendt ingeniørvidenskab og datalogi, en kandidatgrad i datalogi og over 10 års AWS-erfaring. Når hun ikke arbejder eller spiller videospil, coacher hun piger og kvindelige professionelle i at forstå og finde deres vej gennem teknologi.

Anamaria Todor er en Principal Solutions Architect med base i København, Danmark. Hun så sin første computer, da hun var 4 år gammel og gav aldrig slip på datalogi, videospil og teknik siden. Hun har arbejdet i forskellige tekniske roller, fra freelancer, full-stack udvikler, til dataingeniør, teknisk lead og CTO, hos forskellige virksomheder i Danmark med fokus på spil- og reklamebranchen. Hun har været hos AWS i over 3 år, hvor hun har arbejdet som Principal Solutions Architect, hovedsageligt med fokus på life sciences og AI/ML. Anamaria har en bachelor i anvendt ingeniørvidenskab og datalogi, en kandidatgrad i datalogi og over 10 års AWS-erfaring. Når hun ikke arbejder eller spiller videospil, coacher hun piger og kvindelige professionelle i at forstå og finde deres vej gennem teknologi.

Marcel Castro er en Senior Solutions Architect med base i Oslo, Norge. I sin rolle hjælper Marcel kunder med arkitektur, design og udvikling af cloud-optimeret infrastruktur. Han er medlem af AWS Generative AI Ambassador-teamet med det mål at drive og støtte EMEA-kunder på deres generative AI-rejse. Han har en ph.d. i datalogi fra Sverige og en master- og bachelorgrad i elektroteknik og telekommunikation fra Brasilien.

Marcel Castro er en Senior Solutions Architect med base i Oslo, Norge. I sin rolle hjælper Marcel kunder med arkitektur, design og udvikling af cloud-optimeret infrastruktur. Han er medlem af AWS Generative AI Ambassador-teamet med det mål at drive og støtte EMEA-kunder på deres generative AI-rejse. Han har en ph.d. i datalogi fra Sverige og en master- og bachelorgrad i elektroteknik og telekommunikation fra Brasilien.

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk dig selv. Adgang her.

- PlatoAiStream. Web3 intelligens. Viden forstærket. Adgang her.

- PlatoESG. Kulstof, CleanTech, Energi, Miljø, Solenergi, Affaldshåndtering. Adgang her.

- PlatoHealth. Bioteknologiske og kliniske forsøgs intelligens. Adgang her.

- Kilde: https://aws.amazon.com/blogs/machine-learning/harness-large-language-models-in-fake-news-detection/

- :har

- :er

- :ikke

- :hvor

- $ 100 millioner

- $OP

- 1

- 10

- 100

- 12

- 13

- 14

- 20

- 2022

- 21.

- 26 %

- 27

- 32

- 36

- 7

- 9

- a

- evne

- Om

- over

- AC

- akademisk

- akademisk forskning

- Academy

- adgang

- af udleverede

- tilgængelig

- Konto

- Konti

- nøjagtighed

- opnå

- resultater

- tværs

- handler

- Handling

- aktioner

- aktivt

- aktører

- faktisk

- tilføje

- Desuden

- Yderligere

- fremskreden

- advent

- Reklame

- igen

- mod

- Agent

- midler

- AI

- AI modeller

- AI-systemer

- AI / ML

- AL

- Alle

- tillader

- alene

- også

- Skønt

- Amazon

- Amazon EC2

- Amazon Web Services

- Ambassadør

- amerikansk

- blandt

- beløb

- an

- analyse

- analysere

- Ancient

- ,

- Årligt

- En anden

- besvare

- svar

- Antropisk

- enhver

- api

- API'er

- kommer til syne

- Anvendelse

- applikationer

- anvendt

- udpeget

- tilgang

- tilgange

- cirka

- arkitektur

- ER

- argument

- argumenter

- omkring

- artikel

- kunstig

- kunstig intelligens

- Kunstig intelligens (AI)

- Arts

- AS

- aspekter

- Vurdering

- vurderinger

- antagelser

- sikker

- astronomi

- At

- Forsøg på

- forøge

- augmented

- tilføjelserne

- Automatiseret

- til rådighed

- uddelt

- AWS

- AWS Cloud9

- bund

- baseret

- bash

- Battle

- BE

- fordi

- bliver

- blive

- været

- før

- adfærd

- bag

- være

- overbevisninger

- udover

- mellem

- Beyond

- skævhed

- Billion

- biologi

- biomedicinsk

- krop

- både

- bots

- Brasilien

- bringe

- Broken

- indbygget

- forretningsmand

- men

- by

- ringe

- Opkald

- CAN

- kapaciteter

- kapacitet

- Kapacitet

- tilfælde

- tilfælde

- Årsag

- forsigtighed

- Århundrede

- kæde

- kæder

- udfordringer

- chang

- kontrollere

- kemi

- kinesisk

- valg

- Vælg

- krav

- fordringer

- klasse

- klassificering

- tydeligt

- kunde

- Luk

- Cloud9

- coaching

- kode

- Kodning

- kognitive

- indsamler

- kollektive

- Kollegium

- COLUMBIA

- kombination

- kommentarer

- Fælles

- almindeligt

- samfund

- Virksomheder

- sammenligning

- komplementære

- fuldføre

- komplekse

- kompleksitet

- komponenter

- sammensat

- Compute

- computer

- Datalogi

- Konceptet

- indgået

- Bekræfte

- bekræftelse

- sammenholdt

- følgelig

- betragtes

- konsekvent

- består

- Konsol

- forbruge

- Forbrugere

- forbrug

- Indeslutning

- indeholder

- indhold

- indholdsskabelse

- kontinuerlig

- bidrag

- kontrol

- kontrol

- Samtale

- korrigere

- korrekt

- Koste

- Omkostninger

- kunne

- lande

- land

- skabe

- oprettet

- skaber

- Oprettelse af

- skabelse

- Kreativ

- kreativitet

- Legitimationsoplysninger

- CTO

- Medarbejder kultur

- kantsten

- Nuværende

- Kunder

- data

- debat

- afgørelser

- definerede

- definerer

- Degree

- demokratisk

- demonstreret

- demonstrerer

- demonstrerer

- Danmark

- Afdeling

- indsat

- implementering

- Design

- detaljer

- opdage

- Detektion

- Bestem

- bestemmer

- udviklet

- Udvikler

- udvikling

- Udvikling

- udvikling

- Dialog

- forskellige

- diligence

- retning

- diskutere

- misinformation

- Skærm

- forstyrrelser

- skelne

- mistillid

- Doctor

- gør

- Er ikke

- ned

- dr

- køre

- grund

- i løbet af

- e

- E&T

- hver

- tidligere

- Tidligt

- tjene

- optjent

- jorden

- lettere

- let

- Økonomi

- økonomi

- uddannelsesmæssige

- pædagoger

- effekt

- effektivitet

- enten

- eliminere

- andetsteds

- EMEA

- fremkomsten

- vægt

- muliggør

- sluttede

- ingeniør

- Engineering

- forbedringer

- sikre

- indtastning

- enheder

- enhed

- Miljø

- lighed

- fejl

- især

- etableret

- evaluere

- Endog

- begivenheder

- udviklende

- eksempel

- eksempler

- udelukkende

- Dyrke motion

- erfaring

- Forklar

- udforske

- udforsket

- omfattende

- ekstern

- ekstrakt

- lette

- lettes

- Faktisk

- faktorer

- fakta

- FAIL

- falsk

- falske nyheder

- falsk

- berømt

- kvinde

- felt

- kæmpe

- fylder

- endelige

- finansielle

- Finde

- finde

- slut

- Fornavn

- første gang

- Fleksibilitet

- fokuserede

- fokuserer

- fokusering

- følger

- efter

- Til

- formular

- formel

- forum

- Foundation

- grundlæggende

- Grundlagt

- Framework

- fra

- fu

- fuldt ud

- funktion

- funktionalitet

- Spil

- spil

- huller

- Køn

- Ligestilling

- Generelt

- generere

- genereret

- generere

- generation

- generative

- Generativ AI

- få

- piger

- GitHub

- given

- Go

- mål

- stor

- Ground

- garantier

- havde

- seletøj

- Have

- he

- høre

- hjælpe

- hjælper

- hende

- link.

- høj kvalitet

- højere

- højdepunkter

- stærkt

- hans

- historie

- besidder

- ære

- håbefuld

- boliger

- Hvordan

- How To

- Men

- HTML

- http

- HTTPS

- menneskelig

- i

- IBM

- identificeret

- if

- Ulovlig

- illustrere

- billeder

- KIMOs Succeshistorier

- gennemføre

- implementering

- redskaber

- importere

- vigtigt

- imponerende

- forbedret

- in

- manglende evne

- omfatter

- omfatter

- Herunder

- Incorporated

- inkorporerer

- øget

- Stigninger

- angiver

- individuel

- industrier

- oplysninger

- oplyser

- Infrastruktur

- initial

- indgang

- indvendig

- installere

- installeret

- instans

- Institut

- institutioner

- integreret

- Intelligens

- hensigt

- interaktioner

- interne

- Internet

- ind

- introduceret

- påberåber sig

- involverede

- spørgsmål

- spørgsmål

- IT

- ITS

- rejse

- jpg

- json

- dommere

- kenneth

- Kend

- viden

- kendt

- Mangel

- Sprog

- stor

- Sent

- seneste

- latin

- lanceret

- lag

- føre

- førende

- læring

- mindst

- lovligt

- lad

- Livet

- Life Sciences

- ligesom

- begrænsninger

- Line (linje)

- links

- linux

- Liste

- Børsnoterede

- litteratur

- LLM

- logisk

- længere

- kig op

- kærlighed

- mac

- maskine

- machine learning

- lavet

- hovedsageligt

- fastholder

- større

- lave

- maerker

- Making

- lykkedes

- ledelse

- mange

- Marketing

- maske

- herres

- matematiske

- matematik

- maksimal

- Kan..

- midler

- betød

- Medier

- medicinsk

- medicin

- medlem

- Medlemmer

- Hukommelse

- nævnte

- Metode

- Michigan

- million

- miner

- misinformation

- misvisende

- MIT

- afbøde

- blande

- ML

- model

- modeller

- ændre

- mere

- mest

- bevægelse

- flere

- my

- Som hedder

- Nasa

- national

- Natural

- Natur

- Behov

- behov

- netværk

- aldrig

- Ny

- nyheder

- næste

- ingen

- Nobelprisvurdering

- normer

- Norge

- bemærkelsesværdig

- notesbog

- nu

- nummer

- objekt

- observation

- oktober

- of

- tilbydes

- tit

- Gammel

- on

- ONE

- online

- kun

- Produktion

- Udtalelse

- or

- ordrer

- original

- Andet

- Ellers

- vores

- konturer

- Disposition

- output

- udestående

- i løbet af

- samlet

- egen

- ejede

- Tempo

- pakke

- side

- sider

- Papir

- parametre

- del

- passerer

- Bestået

- Passing

- Patenter

- sti

- Mønster

- Mennesker

- perfekt

- Udfør

- personale

- fase

- phd

- fænomen

- filosofi

- Fysik

- stykke

- afgørende

- plato

- Platon Data Intelligence

- PlatoData

- spiller

- Punkt

- politik

- mulig

- Indlæg

- potentiale

- magt

- strøm

- forelagt

- gaver

- trykke

- fremherskende

- tidligere

- tidligere

- primært

- Main

- principper

- trykning

- Printing Press

- Forud

- præmier

- Problem

- behandle

- Processer

- producere

- produktion

- professionelle partnere

- dyb

- Program

- foreslå

- foreslog

- give

- forudsat

- udbydere

- giver

- leverer

- Psykologi

- offentlige

- køb

- formål

- Python

- kvalitet

- mængde

- hurtigt

- Radio

- tilfældig

- intervaller

- rangeret

- hurtige

- hurtigt

- forholdet

- nå

- Reagerer

- virkelige verden

- realtid

- grund

- modtage

- modtaget

- opskrift

- anerkendelse

- anbefaler

- henvise

- refererer

- relaterede

- relativt

- relevant

- pålidelig

- GENTAGNE GANGE

- Repository

- anmode

- kræver

- påkrævet

- forskning

- resonans

- Ressourcer

- Svar

- svar

- reaktioner

- ansvarlige

- afkast

- afkast

- Rich

- Risiko

- roller

- roller

- runder

- Kør

- kører

- løber

- s

- sikkerhedsforanstaltninger

- sagemaker

- samme

- Gem

- så

- Scale

- Skole

- School of Engineering

- Videnskab

- VIDENSKABER

- videnskabelig

- forskere

- script

- SDK

- Søg

- Sektion

- sektioner

- se

- udvælgelse

- senior

- følsom

- dømme

- stemningen

- Sequence

- tjeneste

- Tjenester

- sæt

- setup

- Del

- delt

- Aktier

- deling

- hun

- Shell

- bør

- Vis

- lignende

- Tilsvarende

- Simpelt

- siden

- søster

- So

- Social

- sociale medier

- samfundsmæssigt

- Samfund

- løsninger

- Løsninger

- nogle

- Kilde

- kildekode

- Kilder

- Space

- spænding

- specifikt

- hastighed

- spredes

- Spredning

- Stage

- standard

- Stanford

- Stanford University

- påbegyndt

- Statement

- udsagn

- Stater

- Steps

- Stands

- Storm

- Strategi

- styrkelse

- struktur

- Studerende

- Studere

- efterfølgende

- væsentlig

- Succesfuld

- sådan

- tyder

- RESUMÉ

- Tillæg

- support

- sikker

- Sway

- Sverige

- hurtigt

- syntese

- Systemer

- tackle

- Tag

- tager

- Opgaver

- opgaver

- hold

- Teknisk

- teknik

- teknikker

- teknologisk

- Teknologier

- telekommunikation

- skabelon

- terminal

- vilkår

- prøve

- tekst

- tekstmæssige

- at

- oplysninger

- The Source

- verdenen

- deres

- Them

- derefter

- Der.

- derved

- derfor

- Disse

- de

- tror

- tredjepart

- denne

- dem

- tænkte

- Gennem

- hele

- TIE

- tid

- tidslinje

- til

- sammen

- token

- Tokens

- værktøjer

- uddannet

- Kurser

- sand

- Sandheden

- tutorial

- to

- Ultimativt

- understreget

- forståelse

- Forenet

- Forenede Stater

- Universiteter

- universitet

- uden sidestykke

- uden fortilfælde

- indtil

- opgradering

- på

- us

- brug

- anvendte

- Bruger

- brugere

- bruger

- ved brug af

- Ved hjælp af

- værdi

- forskellige

- Vast

- Bedømmelse

- verificeres

- verificere

- udgave

- meget

- via

- video

- videospil

- Besøg

- var

- we

- web

- webservices

- GODT

- Hvad

- hvornår

- hvorvidt

- som

- mens

- WHO

- Hele

- hvorfor

- Wikipedia

- vilje

- vinduer

- med

- inden for

- kvinde

- Dame

- Vandt

- ord

- ord

- Arbejde

- arbejdede

- workflow

- arbejder

- world

- værd

- Forkert

- år

- Du

- Din

- zephyrnet