I 2021 den medicinalindustrien genererede 550 milliarder dollars i omsætning i USA. Farmaceutiske virksomheder sælger en række forskellige, ofte nye, lægemidler på markedet, hvor der nogle gange kan forekomme utilsigtede, men alvorlige bivirkninger.

Disse hændelser kan rapporteres hvor som helst, fra hospitaler eller i hjemmet, og skal overvåges ansvarligt og effektivt. Traditionel manuel behandling af uønskede hændelser gøres udfordrende af den stigende mængde sundhedsdata og -omkostninger. Samlet set forventes $384 milliarder som omkostningerne ved lægemiddelovervågningsaktiviteter for den overordnede sundhedsindustri inden 2022. For at understøtte overordnede lægemiddelovervågningsaktiviteter ønsker vores lægemiddelkunder at bruge kraften i maskinlæring (ML) til at automatisere detektering af uønskede hændelser fra forskellige datakilder , såsom feeds på sociale medier, telefonopkald, e-mails og håndskrevne noter, og udløser passende handlinger.

I dette indlæg viser vi, hvordan man udvikler en ML-drevet løsning vha Amazon SageMaker til påvisning af uønskede hændelser ved hjælp af det offentligt tilgængelige datasæt om uønskede lægemidler på Hugging Face. I denne løsning finjusterer vi en række forskellige modeller på Hugging Face, der var fortrænede på medicinske data, og bruger BioBERT-modellen, som var fortrænet på Pubmed datasæt og yder det bedste ud af de prøvede.

Vi implementerede løsningen ved hjælp af AWS Cloud Development Kit (AWS CDK). Vi dækker dog ikke detaljerne ved at bygge løsningen i dette indlæg. For mere information om implementeringen af denne løsning, se Byg et system til at fange uønskede hændelser i realtid ved hjælp af Amazon SageMaker og Amazon QuickSight.

Dette indlæg dykker ned i flere nøgleområder og giver en omfattende udforskning af følgende emner:

- De dataudfordringer, som AWS Professional Services støder på

- Landskabet og anvendelsen af store sprogmodeller (LLM'er):

- Transformers, BERT og GPT

- Knusende ansigt

- Den finjusterede LLM-løsning og dens komponenter:

- Forberedelse af data

- Model træning

Dataudfordring

Dataskævhed er ofte et problem, når man kommer med klassifikationsopgaver. Du vil ideelt set gerne have et afbalanceret datasæt, og denne use case er ingen undtagelse.

Vi adresserer denne skævhed med generativ AI modeller (Falcon-7B og Falcon-40B), som blev bedt om at generere hændelsesprøver baseret på fem eksempler fra træningssættet for at øge den semantiske diversitet og øge stikprøvestørrelsen af mærkede uønskede hændelser. Det er en fordel for os at bruge Falcon-modellerne her, fordi i modsætning til nogle LLM'er på Hugging Face, giver Falcon dig det træningsdatasæt, de bruger, så du kan være sikker på, at ingen af dine testsæt-eksempler er indeholdt i Falcon-træningssættet og undgå data forurening.

Den anden dataudfordring for sundhedskunder er HIPAA-overholdelseskrav. Kryptering i hvile og under transport skal indarbejdes i løsningen for at opfylde disse krav.

Transformers, BERT og GPT

Transformatorarkitekturen er en neural netværksarkitektur, der bruges til NLP-opgaver (natural language processing). Det blev først introduceret i avisen “Opmærksomhed er alt hvad du behøver” af Vaswani et al. (2017). Transformatorarkitekturen er baseret på opmærksomhedsmekanismen, som gør det muligt for modellen at lære langtrækkende afhængigheder mellem ord. Transformere, som beskrevet i det originale papir, består af to hovedkomponenter: indkoderen og dekoderen. Indkoderen tager inputsekvensen som input og producerer en sekvens af skjulte tilstande. Dekoderen tager derefter disse skjulte tilstande som input og producerer outputsekvensen. Opmærksomhedsmekanismen bruges i både indkoderen og dekoderen. Opmærksomhedsmekanismen gør det muligt for modellen at tage hensyn til specifikke ord i inputsekvensen, når den genererer outputsekvensen. Dette giver modellen mulighed for at lære langtrækkende afhængigheder mellem ord, hvilket er afgørende for mange NLP-opgaver, såsom maskinoversættelse og tekstresumé.

En af de mere populære og nyttige af transformatorarkitekturerne, Bidirectional Encoder Representations from Transformers (BERT), er en sprogrepræsentationsmodel, der var indført i 2018. BERT er trænet i sekvenser, hvor nogle af ordene i en sætning er maskeret, og den skal udfylde disse ord under hensyntagen til både ordene før og efter de maskerede ord. BERT kan finjusteres til en række NLP-opgaver, herunder besvarelse af spørgsmål, naturlig sprogslutning og følelsesanalyse.

Den anden populære transformerarkitektur, der har taget verden med storm, er Generative Pre-trained Transformer (GPT). Den første GPT-model var introduceret i 2018 af OpenAI. Det fungerer ved at være trænet til strengt at forudsige det næste ord i en sekvens, kun opmærksom på konteksten før ordet. GPT-modeller trænes på et massivt datasæt af tekst og kode, og de kan finjusteres til en række NLP-opgaver, herunder tekstgenerering, besvarelse af spørgsmål og opsummering.

Generelt er BERT bedre til opgaver, der kræver dybere forståelse af ordenes kontekst, hvorimod GPT er bedre egnet til opgaver, der kræver generering af tekst.

Knusende ansigt

Hugging Face er en kunstig intelligens-virksomhed, der er specialiseret i NLP. Det giver en platform med værktøjer og ressourcer, der gør det muligt for udviklere at bygge, træne og implementere ML-modeller med fokus på NLP-opgaver. Et af de vigtigste tilbud fra Hugging Face er dets bibliotek, transformers, som omfatter præ-trænede modeller, der kan finjusteres til forskellige sprogopgaver såsom tekstklassificering, oversættelse, opsummering og besvarelse af spørgsmål.

Hugging Face integreres problemfrit med SageMaker, som er en fuldt administreret tjeneste, der gør det muligt for udviklere og dataforskere at bygge, træne og implementere ML-modeller i stor skala. Denne synergi gavner brugerne ved at levere en robust og skalerbar infrastruktur til at håndtere NLP-opgaver med de avancerede modeller, som Hugging Face tilbyder, kombineret med de kraftfulde og fleksible ML-tjenester fra AWS. Du kan også få adgang til Hugging Face-modeller direkte fra Amazon SageMaker JumpStart, hvilket gør det bekvemt at starte med færdigbyggede løsninger.

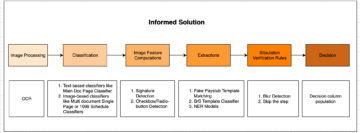

Løsningsoversigt

Vi brugte Hugging Face Transformers-biblioteket til at finjustere transformermodeller på SageMaker til opgaven med klassificering af uønskede hændelser. Træningsjobbet er bygget ved hjælp af SageMaker PyTorch-estimatoren. SageMaker JumpStart har også nogle komplementære integrationer med Hugging Face, der gør det nemt at implementere. I dette afsnit beskriver vi de vigtigste trin involveret i dataforberedelse og modeltræning.

Forberedelse af data

Vi brugte data om bivirkninger (ade_corpus_v2) inden for Hugging Face-datasættet med en 80/20 trænings-/testdeling. Den nødvendige datastruktur til vores modeltræning og inferens har to kolonner:

- Én kolonne til tekstindhold som modelinputdata.

- Endnu en kolonne til etiketklassen. Vi har to mulige klasser for en tekst:

Not_AE,Adverse_Event.

Modeltræning og -eksperimentering

For effektivt at udforske rummet af mulige Hugging Face-modeller for at finjustere vores kombinerede data om uønskede hændelser, konstruerede vi et SageMaker hyperparameter optimization (HPO) job og videregav forskellige Hugging Face-modeller som en hyperparameter sammen med andre vigtige hyperparametre såsom træningsbatchstørrelse, sekvenslængde, modeller og indlæringshastighed. Træningsjobbene brugte en ml.p3dn.24xlarge instans og tog i gennemsnit 30 minutter pr. job med den instanstype. Træningsmålinger blev fanget selv om Amazon SageMaker-eksperimenter værktøj, og hvert træningsjob forløb gennem 10 epoker.

Vi angiver følgende i vores kode:

- Træningsbatchstørrelse – Antal prøver, der behandles sammen, før modelvægtene opdateres

- Sekvenslængde – Maksimal længde af inputsekvensen, som BERT kan behandle

- Læringsgrad – Hvor hurtigt modellen opdaterer sine vægte under træning

- Modeller – Hugging Face fortrænede modeller

Resultater

Den model, der klarede sig bedst i vores use case var monologg/biobert_v1.1_pubmed model hostet på Hugging Face, som er en version af BERT-arkitekturen, der er blevet fortrænet på Pubmed-datasættet, som består af 19,717 videnskabelige publikationer. Fortræning af BERT på dette datasæt giver denne model ekstra ekspertise, når det kommer til at identificere kontekst omkring medicinsk relaterede videnskabelige termer. Dette øger modellens ydeevne til detektionsopgaven for uønskede hændelser, fordi den er blevet fortrænet i medicinsk specifik syntaks, der ofte vises i vores datasæt.

Følgende tabel opsummerer vores evalueringsmetrics.

| Model | Precision | Recall | F1 |

| Base BERT | 0.87 | 0.95 | 0.91 |

| BioBert | 0.89 | 0.95 | 0.92 |

| BioBERT med HPO | 0.89 | 0.96 | 0.929 |

| BioBERT med HPO og syntetisk genereret bivirkning | 0.90 | 0.96 | 0.933 |

Selvom disse er relativt små og trinvise forbedringer i forhold til basis BERT-modellen, viser dette ikke desto mindre nogle levedygtige strategier til at forbedre modellens ydeevne gennem disse metoder. Syntetisk datagenerering med Falcon ser ud til at rumme en masse løfter og potentiale for ydeevneforbedringer, især da disse generative AI-modeller bliver bedre med tiden.

Ryd op

For at undgå at pådrage sig fremtidige gebyrer skal du slette eventuelle ressourcer, der er oprettet som den model og modelslutpunkter, du har oprettet med følgende kode:

Konklusion

Mange medicinalvirksomheder vil i dag gerne automatisere processen med at identificere uønskede hændelser fra deres kundeinteraktioner på en systematisk måde for at hjælpe med at forbedre kundernes sikkerhed og resultater. Som vi viste i dette indlæg, klassificerer den finjusterede LLM BioBERT med syntetisk genererede bivirkninger tilføjet til dataene de uønskede hændelser med høje F1-score og kan bruges til at bygge en HIPAA-kompatibel løsning til vores kunder.

Som altid modtager AWS gerne din feedback. Efterlad venligst dine tanker og spørgsmål i kommentarfeltet.

Om forfatterne

Zack Peterson er dataforsker i AWS Professional Services. Han har været hands on at levere maskinlæringsløsninger til kunder i mange år og har en kandidatgrad i økonomi.

Zack Peterson er dataforsker i AWS Professional Services. Han har været hands on at levere maskinlæringsløsninger til kunder i mange år og har en kandidatgrad i økonomi.

Dr. Adewale Akinfaderin er senior data scientist i Healthcare and Life Sciences hos AWS. Hans ekspertise er i reproducerbare og end-to-end AI/ML-metoder, praktiske implementeringer og at hjælpe globale sundhedskunder med at formulere og udvikle skalerbare løsninger på tværfaglige problemer. Han har to kandidatgrader i fysik og en doktorgrad i ingeniør.

Dr. Adewale Akinfaderin er senior data scientist i Healthcare and Life Sciences hos AWS. Hans ekspertise er i reproducerbare og end-to-end AI/ML-metoder, praktiske implementeringer og at hjælpe globale sundhedskunder med at formulere og udvikle skalerbare løsninger på tværfaglige problemer. Han har to kandidatgrader i fysik og en doktorgrad i ingeniør.

Ekta Walia Bhullar, PhD, er en senior AI/ML-konsulent hos forretningsenheden AWS Healthcare and Life Sciences (HCLS) Professional Services. Hun har stor erfaring med anvendelse af AI/ML inden for sundhedsområdet, især inden for radiologi. Uden for arbejdet, når hun ikke diskuterer AI i radiologi, kan hun lide at løbe og vandre.

Ekta Walia Bhullar, PhD, er en senior AI/ML-konsulent hos forretningsenheden AWS Healthcare and Life Sciences (HCLS) Professional Services. Hun har stor erfaring med anvendelse af AI/ML inden for sundhedsområdet, især inden for radiologi. Uden for arbejdet, når hun ikke diskuterer AI i radiologi, kan hun lide at løbe og vandre.

Han mand er en Senior Data Science & Machine Learning Manager med AWS Professional Services baseret i San Diego, CA. Han har en ph.d. i ingeniørvidenskab fra Northwestern University og har flere års erfaring som ledelseskonsulent med rådgivning til kunder inden for fremstilling, finansielle tjenesteydelser og energi. I dag arbejder han lidenskabeligt med nøglekunder fra en række branchevertikaler for at udvikle og implementere ML og generative AI-løsninger på AWS.

Han mand er en Senior Data Science & Machine Learning Manager med AWS Professional Services baseret i San Diego, CA. Han har en ph.d. i ingeniørvidenskab fra Northwestern University og har flere års erfaring som ledelseskonsulent med rådgivning til kunder inden for fremstilling, finansielle tjenesteydelser og energi. I dag arbejder han lidenskabeligt med nøglekunder fra en række branchevertikaler for at udvikle og implementere ML og generative AI-løsninger på AWS.

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk dig selv. Adgang her.

- PlatoAiStream. Web3 intelligens. Viden forstærket. Adgang her.

- PlatoESG. Kulstof, CleanTech, Energi, Miljø, Solenergi, Affaldshåndtering. Adgang her.

- PlatoHealth. Bioteknologiske og kliniske forsøgs intelligens. Adgang her.

- Kilde: https://aws.amazon.com/blogs/machine-learning/deploy-large-language-models-for-a-healthtech-use-case-on-amazon-sagemaker/

- :har

- :er

- :ikke

- :hvor

- $OP

- 1

- 10

- 100

- 16

- 19

- 2017

- 2018

- 2021

- 2022

- 30

- 32

- 7

- a

- adgang

- Konto

- ACM

- aktioner

- aktiviteter

- tilføjet

- adresse

- fordelagtige

- negativ

- rådgive

- Efter

- AI

- AI modeller

- AI / ML

- AL

- Alle

- tillader

- sammen

- også

- altid

- Amazon

- Amazon SageMaker

- Amazon Web Services

- beløb

- an

- analyse

- ,

- besvarelse

- enhver

- overalt

- Anvendelse

- passende

- arkitektur

- arkitekturer

- ER

- områder

- omkring

- kunstig

- kunstig intelligens

- AS

- At

- deltage

- opmærksomhed

- automatisere

- til rådighed

- gennemsnit

- undgå

- opmærksom på

- AWS

- AWS Professional Services

- afbalanceret

- bund

- baseret

- BE

- fordi

- været

- før

- være

- fordele

- BEDSTE

- Bedre

- mellem

- tovejs

- Billion

- boosts

- både

- grænser

- bygge

- Bygning

- bygget

- virksomhed

- men

- by

- CA

- Opkald

- CAN

- fanget

- tilfælde

- udfordre

- udfordringer

- udfordrende

- afgifter

- klasse

- klasser

- klassificering

- kunder

- Cloud

- kode

- Kolonne

- Kolonner

- kombineret

- kommer

- kommer

- kommentarer

- Virksomheder

- selskab

- komplementære

- Compliance

- komponenter

- omfattende

- består

- konstrueret

- konsulent

- indeholdt

- indhold

- sammenhæng

- Praktisk

- Koste

- Omkostninger

- dæksel

- skabe

- oprettet

- kunde

- Kunder

- data

- Dataforberedelse

- datalogi

- dataforsker

- Datastruktur

- dybere

- definere

- Degree

- leverer

- dykker

- demonstrerer

- afhængigheder

- indsætte

- beskrive

- Detektion

- udvikle

- udviklere

- Udvikling

- Diego

- forskellige

- direkte

- diskuterer

- Mangfoldighed

- domæne

- Dont

- medicin

- Narkotika

- i løbet af

- E&T

- hver

- Økonomi

- effektivt

- emails

- muliggøre

- muliggør

- kryptering

- ende til ende

- energi

- Engineering

- epoker

- især

- væsentlig

- evaluering

- begivenhed

- begivenheder

- eksempler

- undtagelse

- erfaring

- ekspertise

- udforskning

- udforske

- omfattende

- Omfattende oplevelse

- ekstra

- f1

- Ansigtet

- tilbagemeldinger

- udfylde

- finansielle

- finansielle tjenesteydelser

- Fornavn

- fem

- fleksibel

- fokuserede

- efter

- Til

- fra

- fuldt ud

- fremtiden

- Generelt

- generere

- genereret

- generere

- generation

- generative

- Generativ AI

- få

- giver

- Global

- eksamen

- håndtere

- hænder

- Have

- he

- Helse

- sundhedspleje

- sundhedssektoren

- Health Tech

- hjælpe

- hjælpe

- link.

- Skjult

- Høj

- Hike

- hans

- hold

- Home

- sygehuse

- hostede

- Hvordan

- How To

- Men

- HTTPS

- Hyperparameter optimering

- ideelt

- identificere

- gennemføre

- implementering

- implementeringer

- implementeret

- importere

- vigtigt

- Forbedre

- forbedringer

- in

- omfatter

- Herunder

- Incorporated

- Forøg

- stigende

- inkremental

- industrien

- oplysninger

- Infrastruktur

- indgang

- instans

- Integrerer

- integrationer

- Intelligens

- interaktioner

- ind

- introduceret

- involverede

- IT

- ITS

- Job

- Karriere

- jpg

- Nøgle

- Nøgleområder

- etiket

- grim

- landskab

- Sprog

- stor

- LÆR

- læring

- Forlade

- Længde

- Bibliotek

- Livet

- Life Sciences

- ligesom

- synes godt om

- LLM

- Lot

- maskine

- machine learning

- lavet

- Main

- større

- maerker

- Making

- mand

- lykkedes

- ledelse

- leder

- manuel

- Produktion

- mange

- Marked

- massive

- herres

- Maksimer

- maksimal

- mekanisme

- Medier

- medicinsk

- medicinske data

- Mød

- metoder

- Metrics

- minutter

- ML

- model

- modeller

- overvåges

- mere

- skal

- navn

- Natural

- Natural Language Processing

- netværk

- neurale

- neurale netværk

- Ikke desto mindre

- næste

- NLP

- ingen

- Ingen

- Noter

- roman

- nummer

- forekomme

- of

- tilbud

- Tilbud

- tit

- on

- ONE

- kun

- optimering

- or

- ordrer

- original

- Andet

- vores

- ud

- udfald

- output

- uden for

- i løbet af

- samlet

- overordnet

- Papir

- Bestået

- per

- ydeevne

- udføres

- udfører

- Pharmaceutical

- phd

- telefon

- telefonopkald

- Fysik

- perron

- plato

- Platon Data Intelligence

- PlatoData

- Vær venlig

- Populær

- mulig

- Indlæg

- potentiale

- magt

- vigtigste

- Praktisk

- forudsige

- forberedelse

- Problem

- problemer

- behandle

- Behandlet

- forarbejdning

- producerer

- professionel

- fremskrevet

- løfte

- giver

- leverer

- publikationer

- offentligt

- pytorch

- spørgsmål

- Spørgsmål

- hurtigt

- rækkevidde

- Sats

- reaktion

- realtid

- henvise

- regulært udtryk

- relaterede

- relativt

- rapporteret

- repræsentation

- kræver

- påkrævet

- Krav

- Ressourcer

- ansvarligt

- REST

- robust

- Kør

- Sikkerhed

- sagemaker

- prøve

- San

- San Diego

- skalerbar

- Scale

- Videnskab

- VIDENSKABER

- videnskabelig

- Videnskabsmand

- forskere

- problemfrit

- Sektion

- synes

- sælger

- semantiske

- senior

- dømme

- stemningen

- Sequence

- alvorlig

- tjeneste

- Tjenester

- sæt

- flere

- hun

- Vis

- viste

- Shows

- Størrelse

- skævt

- lille

- So

- Social

- sociale medier

- løsninger

- Løsninger

- nogle

- sommetider

- Kilder

- Space

- specialiseret

- specifikke

- detaljerne

- delt

- starte

- state-of-the-art

- Stater

- Steps

- Storm

- ligetil

- strategier

- struktur

- sådan

- support

- sikker

- synergi

- syntaks

- syntetisk

- syntetiske data

- syntetisk

- systemet

- bord

- taget

- tager

- tager

- Opgaver

- opgaver

- vilkår

- prøve

- tekst

- Tekstklassificering

- at

- verdenen

- deres

- derefter

- Disse

- de

- denne

- dem

- selvom?

- Gennem

- tid

- til

- i dag

- sammen

- tog

- værktøj

- værktøjer

- Emner

- traditionelle

- Tog

- uddannet

- Kurser

- transformer

- transformers

- transit

- Oversættelse

- forsøgte

- udløse

- to

- typen

- forståelse

- enhed

- universitet

- I modsætning til

- opdateringer

- us

- brug

- brug tilfælde

- anvendte

- nyttigt

- brugere

- ved brug af

- række

- forskellige

- udgave

- vertikaler

- levedygtig

- ønsker

- var

- Vej..

- we

- web

- webservices

- Hilser velkommen

- var

- hvornår

- ud fra følgende betragtninger

- som

- med

- inden for

- ord

- ord

- Arbejde

- arbejder

- virker

- world

- ville

- år

- Du

- Din

- zephyrnet