Dette indlæg er skrevet sammen med Kostia Kofman og Jenny Tokar fra Booking.com.

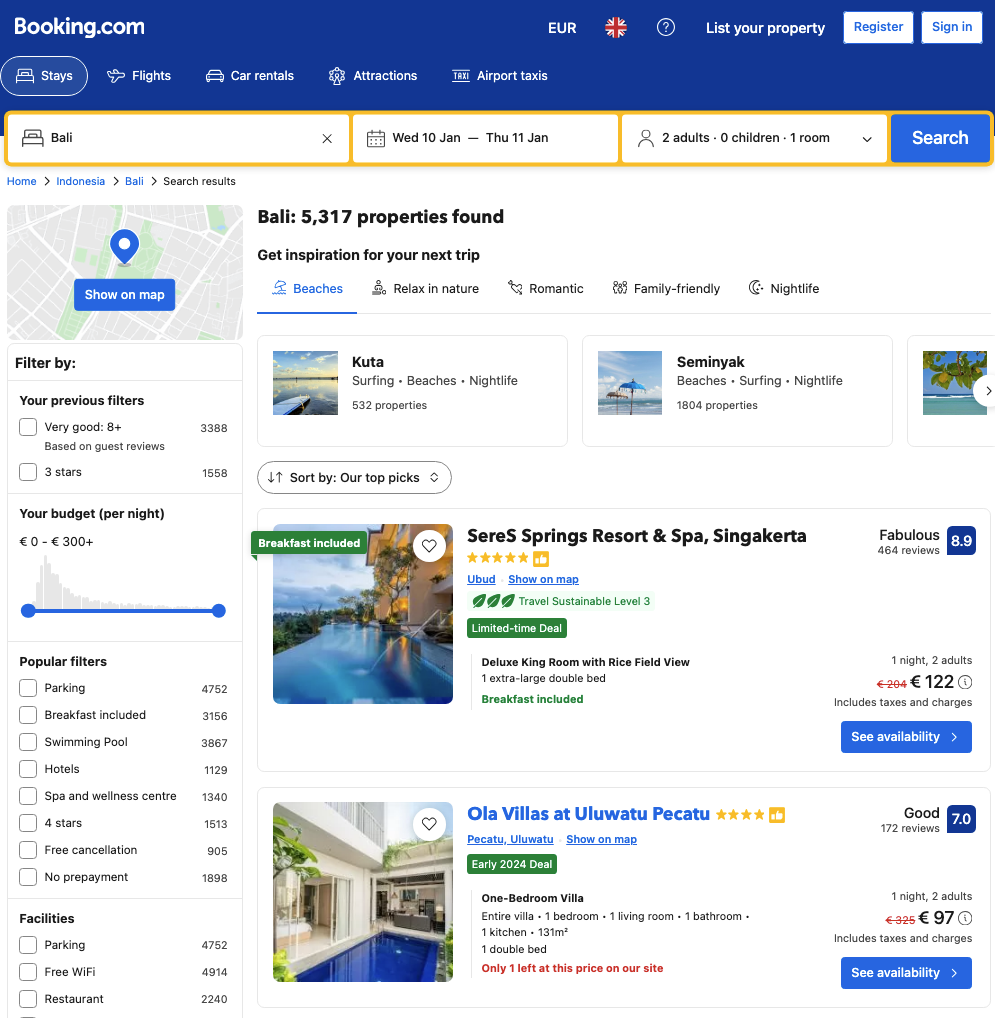

Som en global leder inden for online rejsebranchen, Booking.com søger altid innovative måder at forbedre sine tjenester og give kunderne skræddersyede og sømløse oplevelser. Ranking-teamet hos Booking.com spiller en central rolle i at sikre, at søge- og anbefalingsalgoritmerne er optimeret til at levere de bedste resultater for deres brugere.

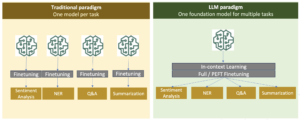

Ved at dele interne ressourcer med andre interne teams stødte Ranking Team Machine learning (ML)-forskerne ofte på lange ventetider for at få adgang til ressourcer til modeltræning og -eksperimentering – hvilket udfordrede deres evne til hurtigt at eksperimentere og innovere. I erkendelse af behovet for en moderniseret ML-infrastruktur, begyndte Ranking-teamet en rejse for at bruge kraften i Amazon SageMaker at bygge, træne og implementere ML-modeller i stor skala.

Booking.com samarbejdede med AWS Professional Services at bygge en løsning til at fremskynde time-to-market for forbedrede ML-modeller gennem følgende forbedringer:

- Reducerede ventetider på ressourcer til træning og eksperimenter

- Integration af essentielle ML-funktioner såsom hyperparameterjustering

- En reduceret udviklingscyklus for ML-modeller

Reducerede ventetider ville betyde, at teamet hurtigt kunne iterere og eksperimentere med modeller og få indsigt i et meget hurtigere tempo. Brug af SageMaker on-demand tilgængelige forekomster gav mulighed for en tidoblet ventetid. Væsentlige ML-funktioner såsom hyperparameterjustering og modelforklarlighed manglede på stedet. Holdets moderniseringsrejse introducerede disse funktioner igennem Amazon SageMaker Automatisk Model Tuning , Amazon SageMaker Clarify. Endelig var holdets ambition at modtage øjeblikkelig feedback på hver ændring, der blev foretaget i koden, hvilket reducerede feedbacksløjfen fra minutter til et øjeblik og derved reducere udviklingscyklussen for ML-modeller.

I dette indlæg dykker vi ned i den rejse, som Ranking-teamet på Booking.com har gennemført, da de udnyttede SageMakers muligheder for at modernisere deres ML-eksperimenteringsramme. Ved at gøre det overvandt de ikke kun deres eksisterende udfordringer, men forbedrede også deres søgeoplevelse, hvilket i sidste ende gavner millioner af rejsende verden over.

Tilgang til modernisering

Ranking-teamet består af flere ML-forskere, som hver især skal udvikle og teste deres egen model offline. Når en model anses for vellykket i henhold til offline-evalueringen, kan den flyttes til produktions A/B-test. Hvis det viser online forbedringer, kan det implementeres til alle brugere.

Målet med dette projekt var at skabe et brugervenligt miljø for ML-forskere, så de nemt kan køre tilpasses Amazon SageMaker Model Building Pipelines at teste deres hypoteser uden behov for at kode lange og komplicerede moduler.

En af de mange udfordringer, man stod over for, var at tilpasse den eksisterende lokale pipeline-løsning til brug på AWS. Løsningen involverede to nøglekomponenter:

- Ændring og udvidelse af eksisterende kode – Den første del af vores løsning involverede ændring og udvidelse af vores eksisterende kode for at gøre den kompatibel med AWS-infrastruktur. Dette var afgørende for at sikre en glidende overgang fra on-premises til cloud-baseret behandling.

- Udvikling af klientpakke – Der blev udviklet en klientpakke, der fungerer som en indpakning omkring SageMaker API'er og den tidligere eksisterende kode. Denne pakke kombinerer de to, hvilket gør det muligt for ML-forskere nemt at konfigurere og implementere ML-pipelines uden kodning.

SageMaker pipeline konfiguration

Tilpasning er nøglen til modelbygningspipeline, og det blev opnået gennem config.ini, en omfattende konfigurationsfil. Denne fil tjener som kontrolcenter for alle input og adfærd i pipelinen.

Tilgængelige konfigurationer indeni config.ini omfatte:

- Pipeline detaljer – Behandleren kan definere pipelinens navn, specificere hvilke trin der skal køres, bestemme hvor output skal gemmes i Amazon Simple Storage Service (Amazon S3), og vælg hvilke datasæt der skal bruges

- AWS-kontooplysninger – Du kan bestemme, hvilken region rørledningen skal løbe i, og hvilken rolle der skal bruges

- Trinspecifik konfiguration – For hvert trin i pipelinen kan du angive detaljer såsom antallet og typen af forekomster, der skal bruges, sammen med relevante parametre

Følgende kode viser et eksempel på en konfigurationsfil:

config.ini er en versionsstyret fil administreret af Git, der repræsenterer den minimale konfiguration, der kræves for en vellykket træningspipelinekørsel. Under udviklingen kan lokale konfigurationsfiler, der ikke er versionskontrollerede, bruges. Disse lokale konfigurationsfiler behøver kun at indeholde indstillinger, der er relevante for en specifik kørsel, hvilket introducerer fleksibilitet uden kompleksitet. Klienten til oprettelse af pipeline er designet til at håndtere flere konfigurationsfiler, hvor den seneste har forrang over tidligere indstillinger.

SageMaker pipeline trin

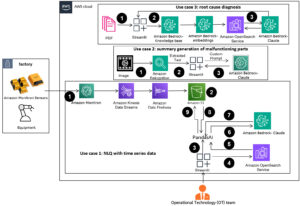

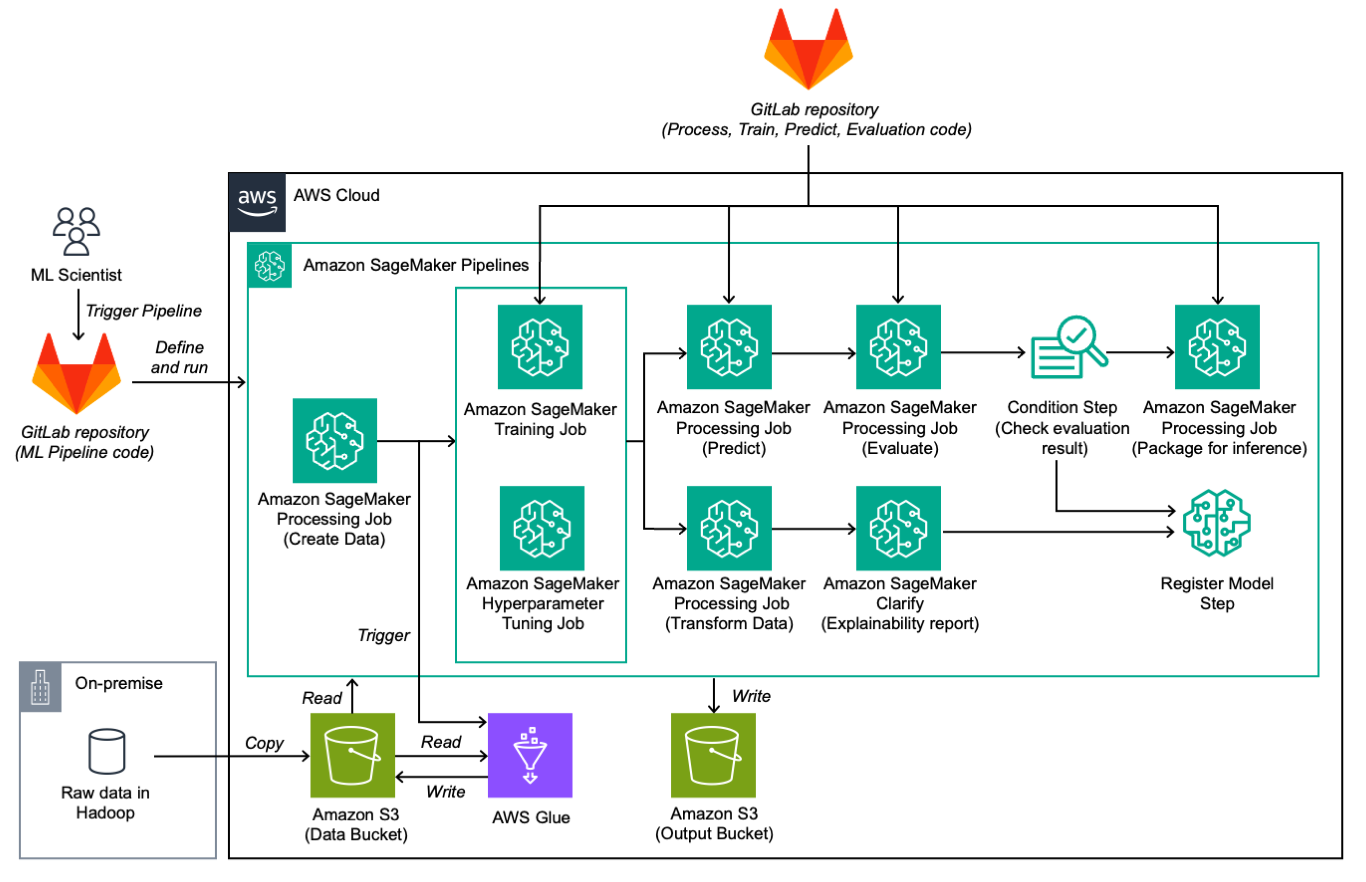

Rørledningen er opdelt i følgende trin:

- Træn og test dataforberedelse – Terabytes af rådata kopieres til en S3-bøtte, behandlet vha AWS Lim job til Spark-behandling, hvilket resulterer i data struktureret og formateret til kompatibilitet.

- Tog – Træningstrinnet bruger TensorFlow-estimatoren til SageMaker træningsjob. Træning foregår på en distribueret måde ved hjælp af Horovod, og den resulterende modelartefakt gemmes i Amazon S3. Til justering af hyperparameter kan et hyperparameteroptimeringsjob (HPO) startes ved at vælge den bedste model baseret på den objektive metrik.

- Forudsige – I dette trin bruger et SageMaker Processing-job den lagrede modelartefakt til at lave forudsigelser. Denne proces kører parallelt på tilgængelige maskiner, og forudsigelsesresultaterne gemmes i Amazon S3.

- Evaluer – Et PySpark-behandlingsjob evaluerer modellen ved hjælp af et brugerdefineret Spark-script. Evalueringsrapporten gemmes derefter i Amazon S3.

- Betingelse – Efter evaluering tages der stilling til modellens kvalitet. Denne beslutning er baseret på en betingelsesmetrik, der er defineret i konfigurationsfilen. Hvis evalueringen er positiv, registreres modellen som godkendt; ellers er det registreret som afvist. I begge tilfælde registreres evaluerings- og forklaringsrapporten, hvis den genereres, i modelregistret.

- Pakkemodel til slutning – Ved hjælp af et behandlingsjob, hvis evalueringsresultaterne er positive, pakkes modellen, gemmes i Amazon S3 og gøres klar til upload til den interne ML-portal.

- Forklar – SageMaker Clarify genererer en forklaringsrapport.

Der bruges to forskellige depoter. Det første lager indeholder definitionen og byggekoden for ML-pipelinen, og det andet lager indeholder koden, der kører i hvert trin, såsom behandling, træning, forudsigelse og evaluering. Denne dual-repository tilgang giver mulighed for større modularitet og gør det muligt for videnskabs- og ingeniørteams at iterere uafhængigt på ML-kode og ML-pipeline-komponenter.

Følgende diagram illustrerer løsningens arbejdsgang.

Automatisk model tuning

Træning af ML-modeller kræver en iterativ tilgang af flere træningseksperimenter for at opbygge en robust og effektiv endelig model til forretningsbrug. ML-forskerne skal vælge den passende modeltype, bygge de korrekte inputdatasæt og justere det sæt hyperparametre, der styrer modelindlæringsprocessen under træning.

Udvælgelsen af passende værdier for hyperparametre til modeltræningsprocessen kan i væsentlig grad påvirke modellens endelige ydeevne. Der er dog ingen entydig eller defineret måde at bestemme, hvilke værdier der er passende for en specifik use case. Det meste af tiden skal ML-forskere køre flere træningsjob med lidt forskellige sæt hyperparametre, observere modeltræningsmetrikken og derefter prøve at vælge mere lovende værdier til den næste iteration. Denne proces med tuning af modelydelse er også kendt som hyperparameteroptimering (HPO), og kan til tider kræve hundredvis af eksperimenter.

Ranking-teamet plejede at udføre HPO manuelt i deres lokale miljø, fordi de kun kunne starte et meget begrænset antal træningsjob parallelt. Derfor skulle de køre HPO sekventielt, teste og vælge forskellige kombinationer af hyperparameterværdier manuelt og regelmæssigt overvåge fremskridt. Dette forlængede modeludviklings- og tuning-processen og begrænsede det samlede antal HPO-eksperimenter, der kunne køre på en gennemførlig tid.

Med skiftet til AWS var Ranking-teamet i stand til at bruge funktionen til automatisk modelindstilling (AMT) i SageMaker. AMT gør det muligt for Ranking ML-forskere automatisk at starte hundredvis af træningsjob inden for hyperparameterintervaller af interesse for at finde den bedst ydende version af den endelige model i henhold til den valgte metrik. Ranking-teamet kan nu vælge mellem fire forskellige automatiske tuning-strategier til deres hyperparametervalg:

- Netsøgning – AMT vil forvente, at alle hyperparametre er kategoriske værdier, og den vil starte træningsjob for hver enkelt kategorisk kombination og udforske hele hyperparameterrummet.

- Tilfældig søgning – AMT vil tilfældigt vælge kombinationer af hyperparameterværdier inden for de angivne områder. Fordi der ikke er nogen afhængighed mellem forskellige træningsjob og parameterværdivalg, kan flere parallelle træningsjob lanceres med denne metode, hvilket fremskynder den optimale parameterudvælgelsesproces.

- Bayesiansk optimering – AMT bruger Bayesiansk optimeringsimplementering til at gætte det bedste sæt hyperparameterværdier, og behandler det som et regressionsproblem. Den vil overveje tidligere testede hyperparameterkombinationer og dens indvirkning på modeltræningsjobbene med det nye parametervalg, optimere til smartere parametervalg med færre eksperimenter, men det vil også kun starte træningsjob sekventielt for altid at kunne lære af tidligere træninger.

- Hyperbånd – AMT vil bruge mellemliggende og endelige resultater af de træningsjob, den kører, til dynamisk at omallokere ressourcer til træningsjob med hyperparameterkonfigurationer, der viser mere lovende resultater, mens de automatisk stopper dem, der underpræsterer.

AMT på SageMaker gjorde det muligt for Ranking-teamet at reducere den tid, der blev brugt på hyperparameterjusteringsprocessen til deres modeludvikling, ved at gøre det muligt for dem for første gang at køre flere parallelle eksperimenter, bruge automatiske tuning-strategier og udføre tocifrede træningsjob inden for få dage, noget, der ikke var muligt i lokalerne.

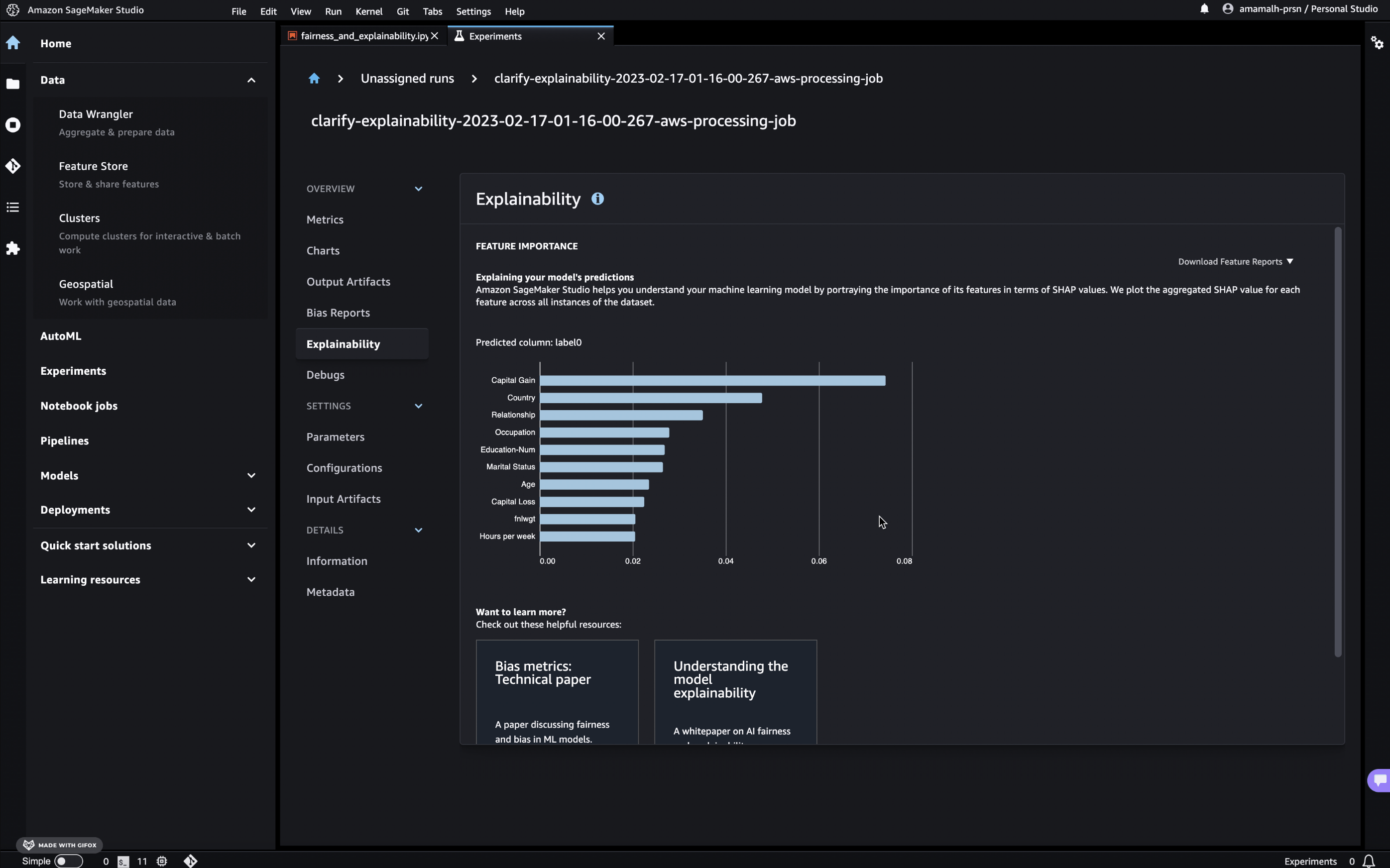

Modelforklarlighed med SageMaker Clarify

Modelforklarlighed gør det muligt for ML-udøvere at forstå arten og adfærden af deres ML-modeller ved at give værdifuld indsigt til feature engineering og valgbeslutninger, hvilket igen forbedrer kvaliteten af modelforudsigelserne. Ranking-teamet ønskede at evaluere deres forklaringsindsigt på to måder: forstå, hvordan funktionsinput påvirker modeloutput på tværs af hele deres datasæt (global fortolkning), og også være i stand til at opdage inputfunktionspåvirkning for en specifik modelforudsigelse på et datapunkt af interesse ( lokal fortolkning). Med disse data kan Ranking ML-forskere træffe informerede beslutninger om, hvordan de yderligere kan forbedre deres modelydelse og redegøre for de udfordrende forudsigelsesresultater, som modellen lejlighedsvis ville give.

SageMaker Clarify giver dig mulighed for at generere modelforklaringsrapporter vha Shapley Additive forklaringer (SHAP), når du træner dine modeller på SageMaker, hvilket understøtter både global og lokal modelfortolkning. Ud over rapporter om modelforklarlighed, understøtter SageMaker Clarify kørsel af analyser for før-trænings-bias-metrikker, post-træning-bias-metrikker og partielle afhængighedsplot. Jobbet vil blive kørt som et SageMaker Processing-job inden for AWS-kontoen, og det integreres direkte med SageMaker-pipelines.

Den globale fortolkningsrapport vil automatisk blive genereret i joboutputtet og vist i Amazon SageMaker Studio miljø som en del af træningsforsøget. Hvis denne model derefter er registreret i SageMaker-modelregistret, vil rapporten desuden blive knyttet til modelartefakten. Ved at bruge begge disse muligheder var Ranking-teamet i stand til nemt at spore forskellige modelversioner og deres adfærdsændringer.

For at udforske inputfunktions indvirkning på en enkelt forudsigelse (lokale fortolkningsværdier) aktiverede Ranking-teamet parameteren save_local_shap_values i SageMaker Clarify-jobbene og var i stand til at indlæse dem fra S3-spanden til yderligere analyser i Jupyter-notesbøgerne i SageMaker Studio.

De foregående billeder viser et eksempel på, hvordan en modelforklarlighed ville se ud for en vilkårlig ML-model.

Træningsoptimering

Fremkomsten af deep learning (DL) har ført til, at ML er blevet mere og mere afhængig af beregningskraft og enorme mængder data. ML-udøvere står ofte over for forhindringen med at bruge ressourcer effektivt, når de træner disse komplekse modeller. Når du kører træning på store computerklynger, opstår der forskellige udfordringer med at optimere ressourceudnyttelsen, herunder problemer som I/O-flaskehalse, forsinkelser i kernelanceringen, hukommelsesbegrænsninger og underudnyttede ressourcer. Hvis konfigurationen af træningsjobbet ikke er finjusteret til effektivitet, kan disse forhindringer resultere i suboptimal hardwarebrug, forlænget træningsvarighed eller endda ufuldstændige træningsforløb. Disse faktorer øger projektomkostningerne og forsinker tidslinjer.

Profilering af CPU- og GPU-brug hjælper med at forstå disse ineffektiviteter, bestemme hardwareressourceforbruget (tid og hukommelse) for de forskellige TensorFlow-operationer i din model, løse ydeevneflaskehalse og i sidste ende få modellen til at køre hurtigere.

Rangeringshold brugte rammeprofileringsfunktionen til Amazon SageMaker Debugger (nu forældet til fordel for Amazon SageMaker Profiler) for at optimere disse træningsjob. Dette giver dig mulighed for at spore alle aktiviteter på CPU'er og GPU'er, såsom CPU- og GPU-brug, kernekørsel på GPU'er, kernelanceringer på CPU'er, synkroniseringsoperationer, hukommelsesoperationer på tværs af GPU'er, latenser mellem kernelanceringer og tilsvarende kørsler og dataoverførsel mellem CPU'er og GPU'er.

Rangeringsholdet brugte også TensorFlow Profiler træk ved TensorBoard, som yderligere var med til at profilere TensorFlow modeluddannelsen. SageMaker er nu yderligere integreret med TensorBoard og bringer visualiseringsværktøjerne fra TensorBoard til SageMaker, integreret med SageMaker træning og domæner. TensorBoard giver dig mulighed for at udføre modelfejlfindingsopgaver ved hjælp af TensorBoard visualiseringsplugins.

Ved hjælp af disse to værktøjer optimerede Ranking-teamet deres TensorFlow-model og var i stand til at identificere flaskehalse og reducere den gennemsnitlige træningstrintid fra 350 millisekunder til 140 millisekunder på CPU og fra 170 millisekunder til 70 millisekunder på GPU, hastigheder på 60 % og 59 pct.

Forretningsmæssige resultater

Migreringsindsatsen var centreret omkring forbedring af tilgængelighed, skalerbarhed og elasticitet, hvilket tilsammen bragte ML-miljøet mod et nyt niveau af operationel ekspertise, eksemplificeret ved den øgede modeltræningsfrekvens og færre fejl, optimerede træningstider og avancerede ML-kapaciteter.

Model træningsfrekvens og fejl

Antallet af månedlige modeltræningsjob femdobledes, hvilket førte til væsentligt hyppigere modeloptimeringer. Ydermere førte det nye ML-miljø til en reduktion i fejlraten for pipeline-kørsler, der faldt fra ca. 50 % til 20 %. Den mislykkede jobbehandlingstid faldt drastisk, fra over en time i gennemsnit til ubetydelige 5 sekunder. Dette har kraftigt øget driftseffektiviteten og reduceret ressourcespild.

Optimeret træningstid

Migrationen medførte effektivitetsforøgelser gennem SageMaker-baseret GPU-træning. Dette skift reducerede modeltræningstiden til en femtedel af dens tidligere varighed. Tidligere brugte træningsprocesserne til deep learning-modeller omkring 60 timer på CPU; dette blev strømlinet til cirka 12 timer på GPU. Denne forbedring sparer ikke kun tid, men fremskynder også udviklingscyklussen, hvilket muliggør hurtigere iterationer og modelforbedringer.

Avancerede ML-funktioner

Centralt for migreringens succes er brugen af SageMaker-funktionssættet, der omfatter hyperparameterjustering og modelforklarlighed. Desuden tillod migreringen problemfri eksperimentsporing vha Amazon SageMaker-eksperimenter, hvilket muliggør mere indsigtsfuld og produktiv eksperimentering.

Vigtigst af alt understøttede det nye ML-eksperimenteringsmiljø den succesfulde udvikling af en ny model, der nu er i produktion. Denne model er dyb læring snarere end træ-baseret og har introduceret mærkbare forbedringer i online-modellens ydeevne.

Konklusion

Dette indlæg gav et overblik over AWS Professional Services og Booking.com-samarbejdet, der resulterede i implementeringen af en skalerbar ML-ramme og med succes reducerede time-to-market for ML-modeller i deres Ranking-team.

Ranking-teamet hos Booking.com lærte, at migrering til skyen og SageMaker har vist sig gavnlig, og at tilpasning af maskinlæringsoperationer (MLOps) gør det muligt for deres ML-ingeniører og videnskabsmænd at fokusere på deres håndværk og øge udviklingshastigheden. Teamet deler erfaringerne og arbejdet med hele ML-fællesskabet på Booking.com gennem samtaler og dedikerede sessioner med ML-praktikere, hvor de deler koden og mulighederne. Vi håber, at dette indlæg kan tjene som en anden måde at dele viden på.

AWS Professional Services er klar til at hjælpe dit team med at udvikle skalerbar og produktionsklar ML i AWS. For mere information, se AWS Professional Services eller kontakt din kontoadministrator for at komme i kontakt.

Om forfatterne

Laurens van der Maas er Machine Learning Engineer hos AWS Professional Services. Han arbejder tæt sammen med kunder, der bygger deres maskinlæringsløsninger på AWS, har specialiseret sig i distribueret træning, eksperimentering og ansvarlig AI og brænder for, hvordan maskinlæring ændrer verden, som vi kender den.

Laurens van der Maas er Machine Learning Engineer hos AWS Professional Services. Han arbejder tæt sammen med kunder, der bygger deres maskinlæringsløsninger på AWS, har specialiseret sig i distribueret træning, eksperimentering og ansvarlig AI og brænder for, hvordan maskinlæring ændrer verden, som vi kender den.

Daniel Zagyva er Data Scientist hos AWS Professional Services. Han har specialiseret sig i at udvikle skalerbare maskinlæringsløsninger i produktionskvalitet til AWS-kunder. Hans erfaring strækker sig på tværs af forskellige områder, herunder naturlig sprogbehandling, generativ AI og maskinlæringsoperationer.

Daniel Zagyva er Data Scientist hos AWS Professional Services. Han har specialiseret sig i at udvikle skalerbare maskinlæringsløsninger i produktionskvalitet til AWS-kunder. Hans erfaring strækker sig på tværs af forskellige områder, herunder naturlig sprogbehandling, generativ AI og maskinlæringsoperationer.

Kostia Kofman er Senior Machine Learning Manager hos Booking.com, der leder Search Ranking ML-teamet, der fører tilsyn med Booking.coms mest omfattende ML-system. Med ekspertise inden for personalisering og rangering trives han med at udnytte banebrydende teknologi til at forbedre kundeoplevelsen.

Kostia Kofman er Senior Machine Learning Manager hos Booking.com, der leder Search Ranking ML-teamet, der fører tilsyn med Booking.coms mest omfattende ML-system. Med ekspertise inden for personalisering og rangering trives han med at udnytte banebrydende teknologi til at forbedre kundeoplevelsen.

Jenny Tokar er Senior Machine Learning Engineer hos Booking.com's Search Ranking-team. Hun har specialiseret sig i at udvikle end-to-end ML pipelines karakteriseret ved effektivitet, pålidelighed, skalerbarhed og innovation. Jennys ekspertise giver hendes team mulighed for at skabe banebrydende rangordningsmodeller, der betjener millioner af brugere hver dag.

Jenny Tokar er Senior Machine Learning Engineer hos Booking.com's Search Ranking-team. Hun har specialiseret sig i at udvikle end-to-end ML pipelines karakteriseret ved effektivitet, pålidelighed, skalerbarhed og innovation. Jennys ekspertise giver hendes team mulighed for at skabe banebrydende rangordningsmodeller, der betjener millioner af brugere hver dag.

Aleksandra Dokic er Senior Data Scientist hos AWS Professional Services. Hun nyder at støtte kunder med at bygge innovative AI/ML-løsninger på AWS, og hun er begejstret for forretningstransformationer gennem kraften i data.

Aleksandra Dokic er Senior Data Scientist hos AWS Professional Services. Hun nyder at støtte kunder med at bygge innovative AI/ML-løsninger på AWS, og hun er begejstret for forretningstransformationer gennem kraften i data.

Luba Protsiva er Engagement Manager hos AWS Professional Services. Hun har specialiseret sig i at levere data- og GenAI/ML-løsninger, der gør det muligt for AWS-kunder at maksimere deres forretningsværdi og accelerere innovationshastigheden.

Luba Protsiva er Engagement Manager hos AWS Professional Services. Hun har specialiseret sig i at levere data- og GenAI/ML-løsninger, der gør det muligt for AWS-kunder at maksimere deres forretningsværdi og accelerere innovationshastigheden.

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk dig selv. Adgang her.

- PlatoAiStream. Web3 intelligens. Viden forstærket. Adgang her.

- PlatoESG. Kulstof, CleanTech, Energi, Miljø, Solenergi, Affaldshåndtering. Adgang her.

- PlatoHealth. Bioteknologiske og kliniske forsøgs intelligens. Adgang her.

- Kilde: https://aws.amazon.com/blogs/machine-learning/how-booking-com-modernized-its-ml-experimentation-framework-with-amazon-sagemaker/

- :har

- :er

- :ikke

- :hvor

- $OP

- 1

- 100

- 12

- 130

- 140

- 16

- 350

- 60

- 7

- 70

- a

- evne

- I stand

- Om

- fremskynde

- adgang

- Ifølge

- Konto

- opnået

- tværs

- aktiviteter

- handlinger

- tilpasse

- Desuden

- Derudover

- fremskreden

- påvirke

- Efter

- AI

- AI / ML

- algoritmer

- Alle

- tilladt

- tillader

- sammen

- også

- altid

- Amazon

- Amazon SageMaker

- Amazon Web Services

- beløb

- beløb

- an

- Analyser

- ,

- En anden

- API'er

- tilgang

- passende

- godkendt

- cirka

- vilkårlig

- ER

- områder

- opstå

- omkring

- AS

- aspiration

- At

- Automatisk Ur

- automatisk

- tilgængelighed

- til rådighed

- gennemsnit

- AWS

- AWS Professional Services

- tilbage

- baseret

- Bayesiansk

- BE

- fordi

- blive

- adfærd

- adfærdsmæssige

- adfærd

- gavnlig

- gavn

- BEDSTE

- mellem

- skævhed

- booking

- Booking.com

- både

- flaskehalse

- Bringer

- bragte

- bygge

- Bygning

- virksomhed

- men

- by

- CAN

- kapaciteter

- tilfælde

- tilfælde

- center

- centreret

- udfordringer

- udfordrende

- lave om

- Ændringer

- skiftende

- kendetegnet

- Vælg

- valgt

- kunde

- nøje

- Cloud

- kode

- Kodning

- samarbejdet

- samarbejde

- kollektivt

- KOM

- kombination

- kombinationer

- kombinerer

- almindeligt

- samfund

- kompatibilitet

- kompatibel

- komplekse

- kompleksitet

- kompliceret

- komponenter

- beregningsmæssige

- computerkraft

- Compute

- betingelse

- Konfiguration

- Overvej

- består

- begrænsninger

- forbruges

- forbrug

- indeholder

- indeholder

- kontrol

- korrigere

- Tilsvarende

- Omkostninger

- kunne

- håndværk

- skabe

- skabelse

- afgørende

- skik

- kunde

- Kunder

- tilpasses

- banebrydende

- banebrydende teknologi

- cyklus

- data

- Dataforberedelse

- dataforsker

- datasæt

- dag

- Dage

- beslutte

- beslutning

- afgørelser

- er faldet

- dedikeret

- anses

- dyb

- dyb læring

- definere

- definerede

- definition

- forsinkelse

- forsinkelser

- levere

- leverer

- dykke

- afhængighed

- Afhængighed

- indsætte

- indsat

- forældet

- konstrueret

- detaljer

- Bestem

- udvikle

- udviklet

- udvikling

- Udvikling

- diagram

- forskellige

- direkte

- opdage

- vises

- distinkt

- distribueret

- distribueret træning

- Divided

- gør

- Domæner

- færdig

- drastisk

- Dropper

- varighed

- i løbet af

- dynamisk

- hver

- nemt

- effektivitet

- effektivt

- indsats

- indledt

- bemyndiger

- muliggøre

- aktiveret

- muliggør

- muliggør

- omfatter

- ende til ende

- engagement

- ingeniør

- Engineering

- Ingeniører

- forbedre

- styrke

- sikring

- Hele

- Miljø

- epoker

- væsentlig

- evaluere

- evaluering

- Endog

- Hver

- hver dag

- eksempel

- Excellence

- ophidset

- eksemplificerede

- eksisterende

- forvente

- fremskynder

- erfaring

- Oplevelser

- eksperiment

- eksperimenter

- ekspertise

- Forklar

- udforske

- Udforskning

- strækker

- udvider

- udvidelse

- omfattende

- Ansigtet

- konfronteret

- faktorer

- mislykkedes

- Manglende

- fejl

- falsk

- hurtigere

- favorisere

- gennemførlig

- Feature

- Funktionalitet

- tilbagemeldinger

- færre

- File (Felt)

- Filer

- endelige

- Endelig

- Finde

- Fornavn

- første gang

- Fleksibilitet

- Fokus

- efter

- Til

- fire

- Framework

- Frekvens

- hyppig

- fra

- yderligere

- Endvidere

- vinder

- generere

- genereret

- genererer

- generative

- Generativ AI

- få

- Git

- Global

- mål

- GPU

- GPU'er

- større

- gætte

- havde

- håndtere

- Hardware

- udnyttet

- Have

- he

- hjælpe

- hjulpet

- hjælper

- hende

- hans

- håber

- time

- HOURS

- Hvordan

- How To

- Men

- HTML

- http

- HTTPS

- Hundreder

- hyler

- Hyperparameter optimering

- Tuning af hyperparameter

- identificere

- if

- illustrerer

- billeder

- umiddelbar

- KIMOs Succeshistorier

- implementering

- vigtigere

- Forbedre

- forbedret

- forbedringer

- forbedrer

- in

- omfatter

- Herunder

- Forøg

- øget

- Stigninger

- stigende

- uafhængigt

- industrien

- ineffektivitet

- indflydelse

- oplysninger

- informeret

- Infrastruktur

- indledt

- innovere

- Innovation

- innovativ

- indgang

- indgange

- indvendig

- indsigtsfuld

- indsigt

- øjeblikkelig

- integreret

- Integrerer

- interesse

- interne

- ind

- introduceret

- indføre

- involverede

- spørgsmål

- IT

- iteration

- iterationer

- ITS

- Job

- Karriere

- rejse

- jpg

- Nøgle

- Kend

- viden

- kendt

- mangler

- Sprog

- stor

- seneste

- lancere

- lanceret

- lanceringer

- leder

- førende

- LÆR

- lærte

- læring

- Led

- Niveau

- løftestang

- ligesom

- Limited

- forbundet

- belastning

- lokale

- Lang

- Se

- ligner

- maskine

- machine learning

- Maskiner

- lavet

- lave

- lykkedes

- leder

- måde

- manuelt

- Maksimer

- betyde

- Hukommelse

- metode

- metrisk

- Metrics

- migrere

- migration

- millioner

- millisekunder

- mindste

- minutter

- ML

- MLOps

- model

- modeller

- modernisere

- Moduler

- Overvåg

- månedligt

- mere

- mest

- bevæge sig

- flyttet

- meget

- flere

- navn

- Natural

- Natural Language Processing

- Natur

- Behov

- Ny

- næste

- ingen

- nu

- nummer

- objektiv

- observere

- forhindringer

- of

- offline

- tit

- on

- On-Demand

- ONE

- online

- kun

- operationelle

- Produktion

- optimal

- optimering

- optimeringer

- Optimer

- optimeret

- optimering

- Indstillinger

- or

- Andet

- Ellers

- vores

- ud

- output

- udgange

- i løbet af

- samlet

- tilsyn

- oversigt

- egen

- Tempo

- pakke

- emballeret

- Parallel

- parameter

- del

- lidenskabelige

- Udfør

- ydeevne

- udfører

- Personalisering

- pipeline

- afgørende

- plato

- Platon Data Intelligence

- PlatoData

- spiller

- Plugins

- Punkt

- Portal

- positiv

- Indlæg

- magt

- praksis

- forud

- forudsige

- forudsigelse

- Forudsigelser

- forberedelse

- tidligere

- tidligere

- Problem

- behandle

- Behandlet

- Processer

- forarbejdning

- produktion

- produktiv

- professionel

- Profil

- profilering

- Progress

- projekt

- lovende

- bevist

- give

- forudsat

- leverer

- kvalitet

- hurtigt

- intervaller

- Ranking

- hurtigt

- Sats

- hellere

- Raw

- nå

- klar

- modtage

- anerkende

- Anbefaling

- registreres

- reducere

- Reduceret

- reducere

- reduktion

- om

- region

- register

- registreret

- register

- regelmæssigt

- Afvist..

- relevant

- pålidelighed

- indberette

- Rapporter

- Repository

- repræsenterer

- kræver

- påkrævet

- Kræver

- løse

- ressource

- Ressourcer

- henholdsvis

- ansvarlige

- resultere

- resulterer

- Resultater

- Rise

- robust

- roller

- Kør

- kører

- løber

- sagemaker

- SageMaker Pipelines

- Skalerbarhed

- skalerbar

- Scale

- Videnskab

- Videnskabsmand

- forskere

- script

- sømløs

- Søg

- Anden

- sekunder

- se

- søger

- Vælg

- udvælgelse

- valg

- senior

- tjener

- tjener

- Tjenester

- sessioner

- sæt

- sæt

- indstillinger

- flere

- Del

- deling

- hun

- skifte

- bør

- Vis

- Shows

- betydeligt

- Simpelt

- enkelt

- lidt anderledes

- smartere

- udjævne

- So

- løsninger

- Løsninger

- noget

- Space

- Spark

- specialiseret

- specifikke

- hastighed

- brugt

- Trin

- Steps

- standsning

- opbevaring

- opbevaret

- strategier

- strømlinet

- kraftigt

- struktureret

- Studio

- suboptimal

- succes

- vellykket

- Succesfuld

- sådan

- Understøttet

- Støtte

- Understøtter

- synkronisere.

- systemet

- skræddersyet

- tager

- Talks

- opgaver

- hold

- hold

- Teknologier

- tensorflow

- prøve

- afprøvet

- Test

- end

- at

- verdenen

- deres

- Them

- derefter

- Der.

- derved

- derfor

- Disse

- de

- denne

- dem

- trives

- Gennem

- tid

- tidslinjer

- gange

- til

- værktøjer

- mod

- spor

- Sporing

- Tog

- Kurser

- træninger

- overførsel

- transformationer

- overgang

- rejse

- rejseindustri

- rejsende

- behandling

- sand

- prøv

- tuning

- TUR

- to

- typen

- Ultimativt

- forstå

- enestående

- Brug

- brug

- brug tilfælde

- anvendte

- brugervenlig

- brugere

- bruger

- ved brug af

- udnyttet

- Værdifuld

- værdi

- Værdier

- forskellige

- Vast

- VeloCity

- udgave

- versioner

- meget

- visualisering

- vente

- ønskede

- var

- Vej..

- måder

- we

- web

- webservices

- var

- hvornår

- som

- mens

- WHO

- vilje

- med

- inden for

- uden

- Arbejde

- workflow

- virker

- world

- verdensplan

- ville

- Du

- Din

- zephyrnet