I det udviklende produktionslandskab er den transformative kraft af AI og maskinlæring (ML) tydelig, hvilket driver en digital revolution, der strømliner driften og øger produktiviteten. Men denne fremgang introducerer unikke udfordringer for virksomheder, der navigerer i datadrevne løsninger. Industrielle faciliteter kæmper med enorme mængder af ustrukturerede data, hentet fra sensorer, telemetrisystemer og udstyr spredt på tværs af produktionslinjer. Realtidsdata er kritiske for applikationer som forudsigelig vedligeholdelse og anomalidetektion, men udvikling af brugerdefinerede ML-modeller til hver industriel anvendelse med sådanne tidsseriedata kræver betydelig tid og ressourcer fra datavidenskabsfolk, hvilket hindrer udbredt anvendelse.

Generativ AI ved hjælp af store fortrænede fundamentmodeller (FM'er) som f.eks Claude kan hurtigt generere en række indhold fra samtaletekst til computerkode baseret på simple tekstprompter, kendt som nul-shot prompt. Dette eliminerer behovet for, at datavidenskabsfolk manuelt udvikler specifikke ML-modeller til hvert brugstilfælde, og demokratiserer derfor AI-adgang, til gavn for selv små producenter. Medarbejdere opnår produktivitet gennem AI-genereret indsigt, ingeniører kan proaktivt opdage uregelmæssigheder, supply chain managers optimerer lagerbeholdninger, og fabrikkens ledelse træffer informerede, datadrevne beslutninger.

Ikke desto mindre står selvstændige FM'er over for begrænsninger i håndteringen af komplekse industrielle data med kontekststørrelsesbegrænsninger (typisk mindre end 200,000 tokens), hvilket giver udfordringer. For at løse dette kan du bruge FM'ens evne til at generere kode som svar på naturlige sprogforespørgsler (NLQ'er). Agenter kan lide PandasAI kommer i spil ved at køre denne kode på højopløselige tidsseriedata og håndtere fejl ved hjælp af FM'er. PandasAI er et Python-bibliotek, der tilføjer generative AI-egenskaber til pandaer, det populære dataanalyse- og manipulationsværktøj.

Imidlertid kan komplekse NLQ'er, såsom tidsseriedatabehandling, aggregering på flere niveauer og pivot- eller fællestabeloperationer, give inkonsekvent Python-scriptnøjagtighed med en nul-shot-prompt.

For at forbedre kodegenereringsnøjagtigheden foreslår vi dynamisk konstruktion multi-shot prompter for NLQ'er. Multi-shot prompt giver yderligere kontekst til FM ved at vise den flere eksempler på ønskede output for lignende prompter, hvilket øger nøjagtigheden og konsistensen. I dette indlæg hentes multi-shot-prompter fra en indlejring, der indeholder vellykket Python-kode, der køres på en lignende datatype (for eksempel højopløselige tidsseriedata fra Internet of Things-enheder). Den dynamisk konstruerede multi-shot prompt giver den mest relevante kontekst til FM'en og øger FM'ens evne til avanceret matematisk beregning, tidsseriedatabehandling og forståelse af dataakronymer. Denne forbedrede respons letter virksomhedsmedarbejdere og operationelle teams i at engagere sig med data og opnå indsigt uden at kræve omfattende datavidenskabelige færdigheder.

Ud over tidsseriedataanalyse viser FM'er sig værdifulde i forskellige industrielle applikationer. Vedligeholdelsesteams vurderer aktivernes sundhed, tager billeder til Amazon-anerkendelse-baserede funktionalitetsoversigter og anomali rodårsagsanalyse ved hjælp af intelligente søgninger med Retrieval Augmented Generation (KLUD). For at forenkle disse arbejdsgange har AWS introduceret Amazonas grundfjeld, hvilket gør det muligt for dig at bygge og skalere generative AI-applikationer med state-of-the-art forudtrænede FM'er som f.eks. Claude v2. Med Vidensbaser for Amazon Bedrock, kan du forenkle RAG-udviklingsprocessen for at give en mere nøjagtig anomali-grundårsagsanalyse for fabriksarbejdere. Vores indlæg viser en intelligent assistent til industriel brugscases drevet af Amazon Bedrock, der adresserer NLQ-udfordringer, genererer delresuméer fra billeder og forbedrer FM-svar til udstyrsdiagnose gennem RAG-tilgangen.

Løsningsoversigt

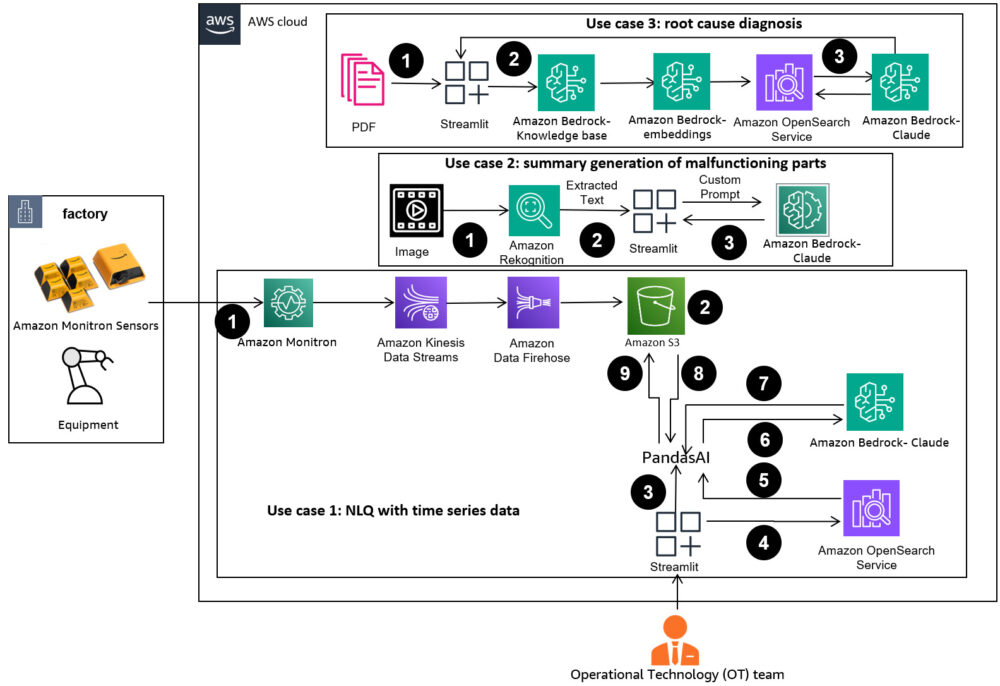

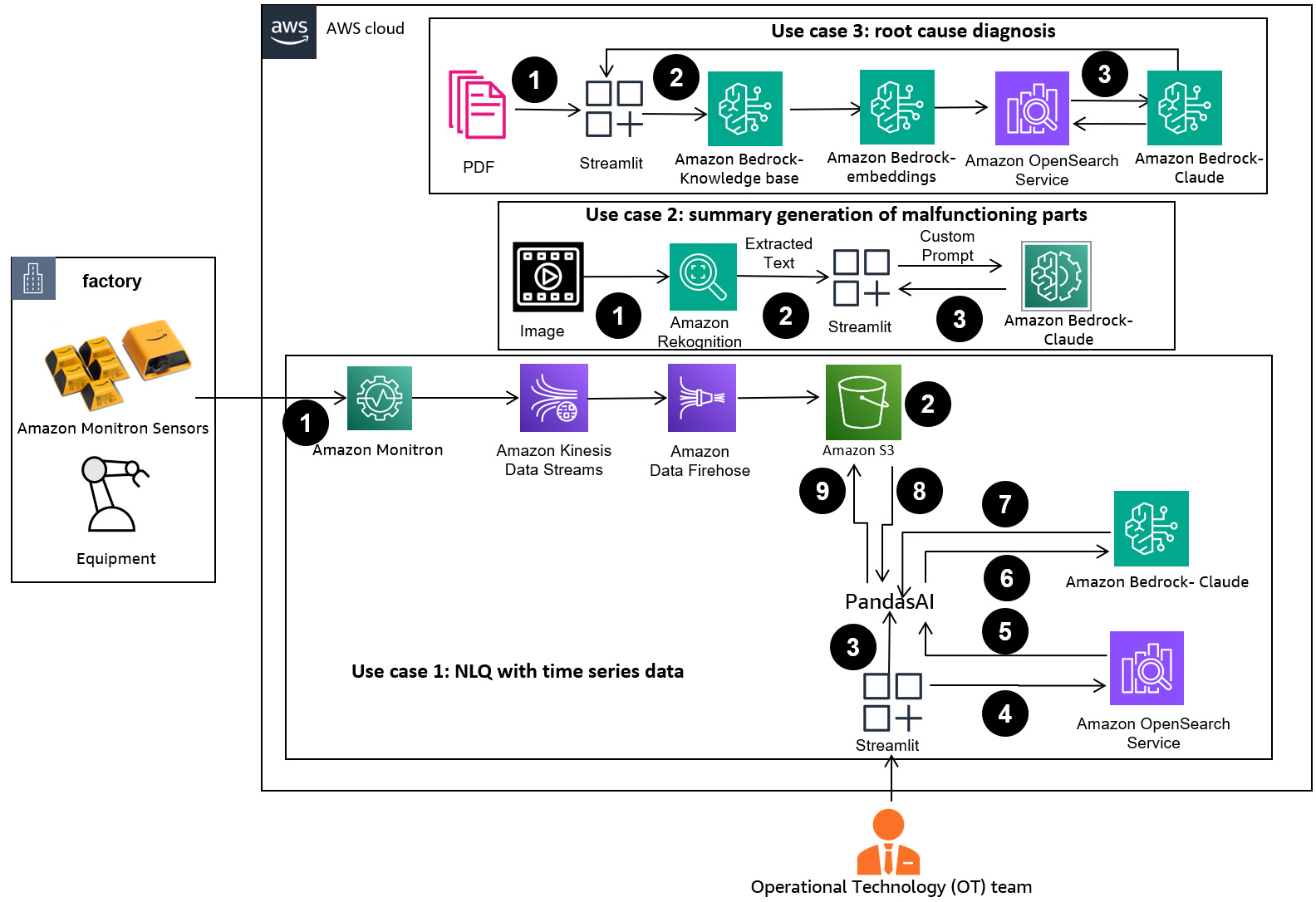

Følgende diagram illustrerer løsningsarkitekturen.

Workflowet omfatter tre forskellige use cases:

Use case 1: NLQ med tidsseriedata

Workflowet for NLQ med tidsseriedata består af følgende trin:

- Vi anvender et tilstandsovervågningssystem med ML-funktioner til anomalidetektion, som f.eks Amazon Monitron, for at overvåge industrielt udstyrs sundhed. Amazon Monitron er i stand til at detektere potentielle udstyrsfejl fra udstyrets vibrations- og temperaturmålinger.

- Vi indsamler tidsseriedata ved behandling Amazon Monitron data igennem Amazon Kinesis datastrømme , Amazon Data Firehose, konvertere den til et tabelformet CSV-format og gemme den i en Amazon Simple Storage Service (Amazon S3) spand.

- Slutbrugeren kan begynde at chatte med deres tidsseriedata i Amazon S3 ved at sende en naturlig sprogforespørgsel til Streamlit-appen.

- Streamlit-appen videresender brugerforespørgsler til Amazon Bedrock Titan tekstindlejringsmodel for at indlejre denne forespørgsel og udfører en lighedssøgning i en Amazon OpenSearch Service indeks, som indeholder tidligere NLQ'er og eksempelkoder.

- Efter lighedssøgningen indsættes de øverste lignende eksempler, inklusive NLQ-spørgsmål, dataskema og Python-koder, i en tilpasset prompt.

- PandasAI sender denne brugerdefinerede prompt til Amazon Bedrock Claude v2-modellen.

- Appen bruger PandasAI-agenten til at interagere med Amazon Bedrock Claude v2-modellen og genererer Python-kode til Amazon Monitron-dataanalyse og NLQ-svar.

- Efter at Amazon Bedrock Claude v2-modellen returnerer Python-koden, kører PandasAI Python-forespørgslen på Amazon Monitron-dataene, der er uploadet fra appen, og indsamler kodeoutput og adresserer eventuelle nødvendige genforsøg for mislykkede kørsler.

- Streamlit-appen indsamler svaret via PandasAI og leverer output til brugerne. Hvis outputtet er tilfredsstillende, kan brugeren markere det som nyttigt og gemme den NLQ- og Claude-genererede Python-kode i OpenSearch Service.

Use case 2: Oversigtsgenerering af defekte dele

Vores brugscase for oversigtsgenerering består af følgende trin:

- Når brugeren ved, hvilket industriaktivt der viser unormal adfærd, kan de uploade billeder af den defekte del for at identificere, om der er noget fysisk galt med denne del i henhold til dens tekniske specifikationer og driftstilstand.

- Brugeren kan bruge Amazon Recognition DetectText API at udtrække tekstdata fra disse billeder.

- De udtrukne tekstdata er inkluderet i prompten til Amazon Bedrock Claude v2-modellen, hvilket gør det muligt for modellen at generere en 200-ords oversigt over den fejlfunktionelle del. Brugeren kan bruge disse oplysninger til at udføre yderligere inspektion af delen.

Use case 3: Grundårsagsdiagnose

Vores rodårsagsdiagnose består af følgende trin:

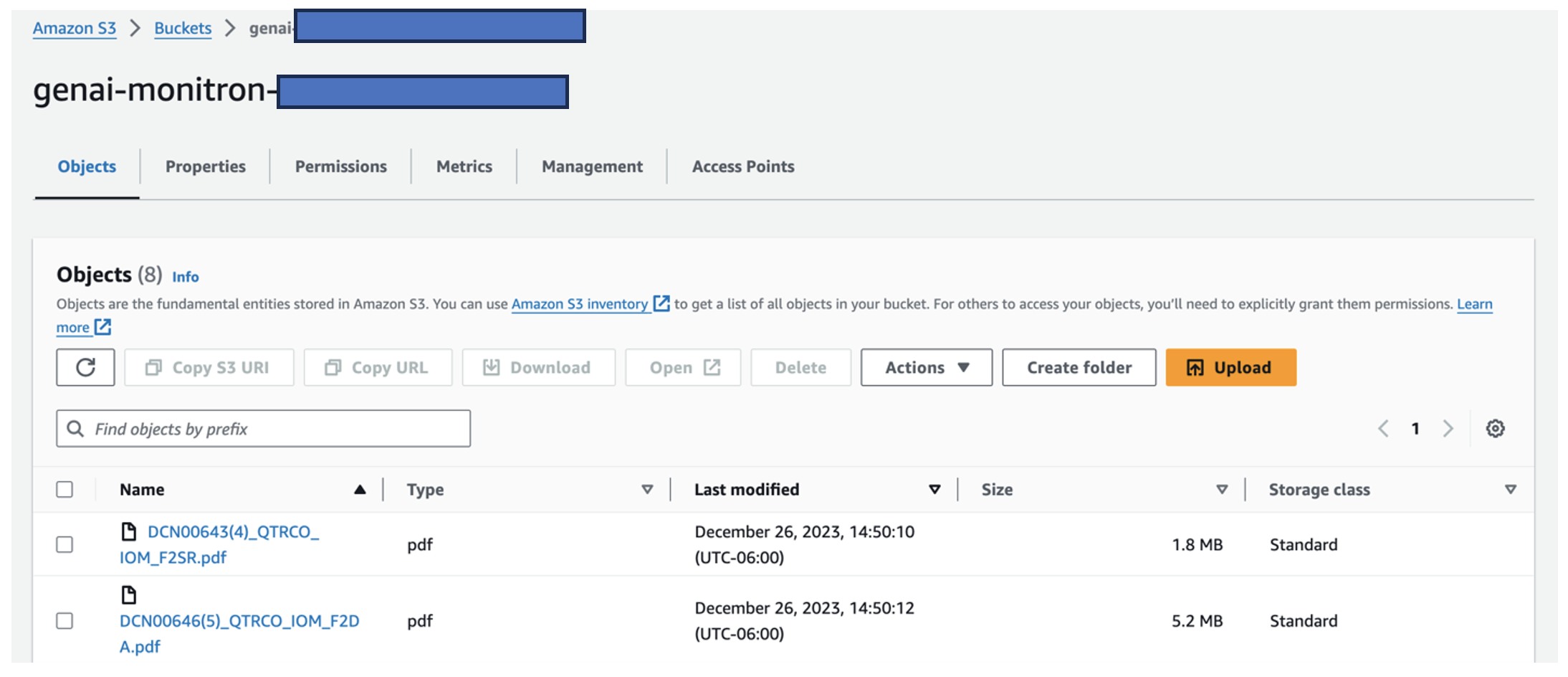

- Brugeren indhenter virksomhedsdata i forskellige dokumentformater (PDF, TXT, og så videre) relateret til fejlfungerende aktiver og uploader dem til en S3-bøtte.

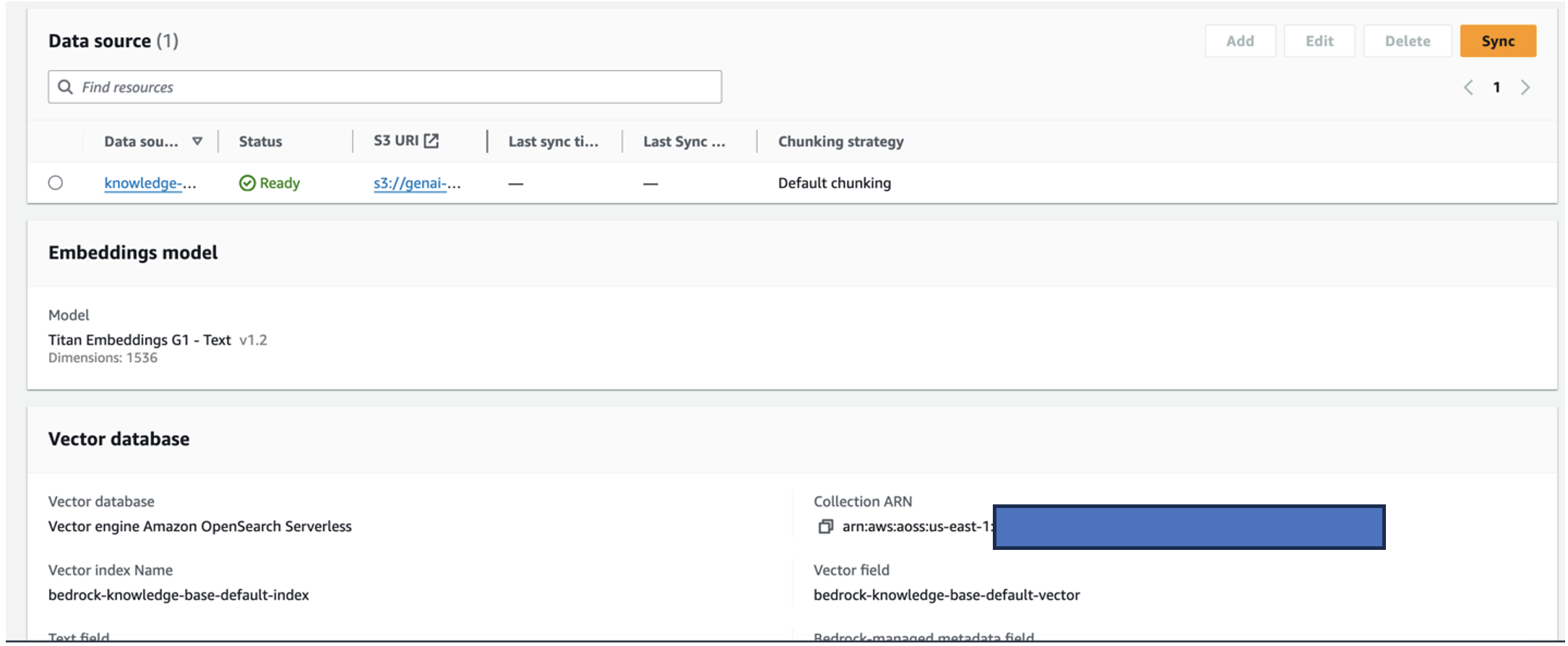

- En videnbase af disse filer genereres i Amazon Bedrock med en Titan-tekstindlejringsmodel og et standard OpenSearch Service-vektorlager.

- Brugeren stiller spørgsmål relateret til årsagsdiagnosen for funktionsfejl i udstyr. Svar genereres gennem Amazon Bedrock vidensbase med en RAG-tilgang.

Forudsætninger

For at følge med i dette indlæg skal du opfylde følgende forudsætninger:

Implementer løsningsinfrastrukturen

For at konfigurere dine løsningsressourcer skal du udføre følgende trin:

- Implementér AWS CloudFormation skabelon opensearchsagemaker.yml, som opretter en OpenSearch Service-samling og -indeks, Amazon SageMaker notebook-instans og S3-spand. Du kan navngive denne AWS CloudFormation-stak som:

genai-sagemaker. - Åbn SageMaker notebook-instansen i JupyterLab. Du finder følgende GitHub repo allerede downloadet på denne instans: frigøre-potentialet-af-generative-ai-i-industrielle-operationer.

- Kør notesbogen fra følgende mappe i dette lager: frigørelse af-potentialet-af-generative-ai-in-industrial-operations/SagemakerNotebook/nlq-vector-rag-embedding.ipynb. Denne notesbog indlæser OpenSearch Service-indekset ved hjælp af SageMaker-notesbogen til at gemme nøgleværdi-par fra eksisterende 23 NLQ-eksempler.

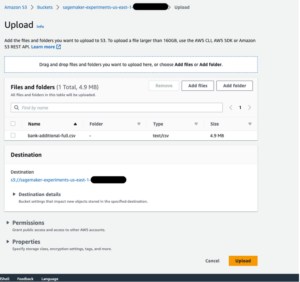

- Upload dokumenter fra datamappen assetpartdoc i GitHub-lageret til S3-bøtten, der er angivet i CloudFormations stak-output.

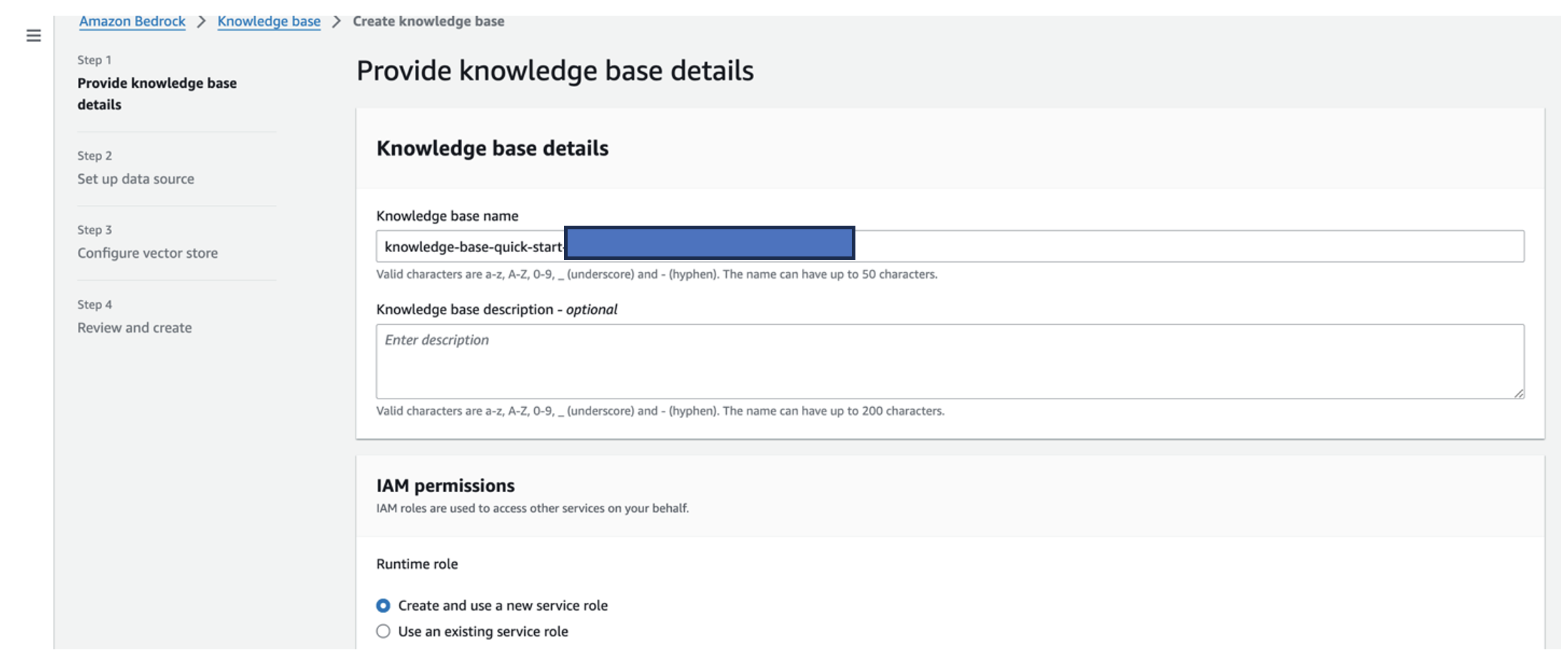

Dernæst opretter du vidensbasen for dokumenterne i Amazon S3.

- Vælg på Amazon Bedrock-konsollen Vidensdatabase i navigationsruden.

- Vælg Skab vidensbase.

- Til Navn på videnbasen, indtast et navn.

- Til Runtime rolle, Vælg Opret og brug en ny servicerolle.

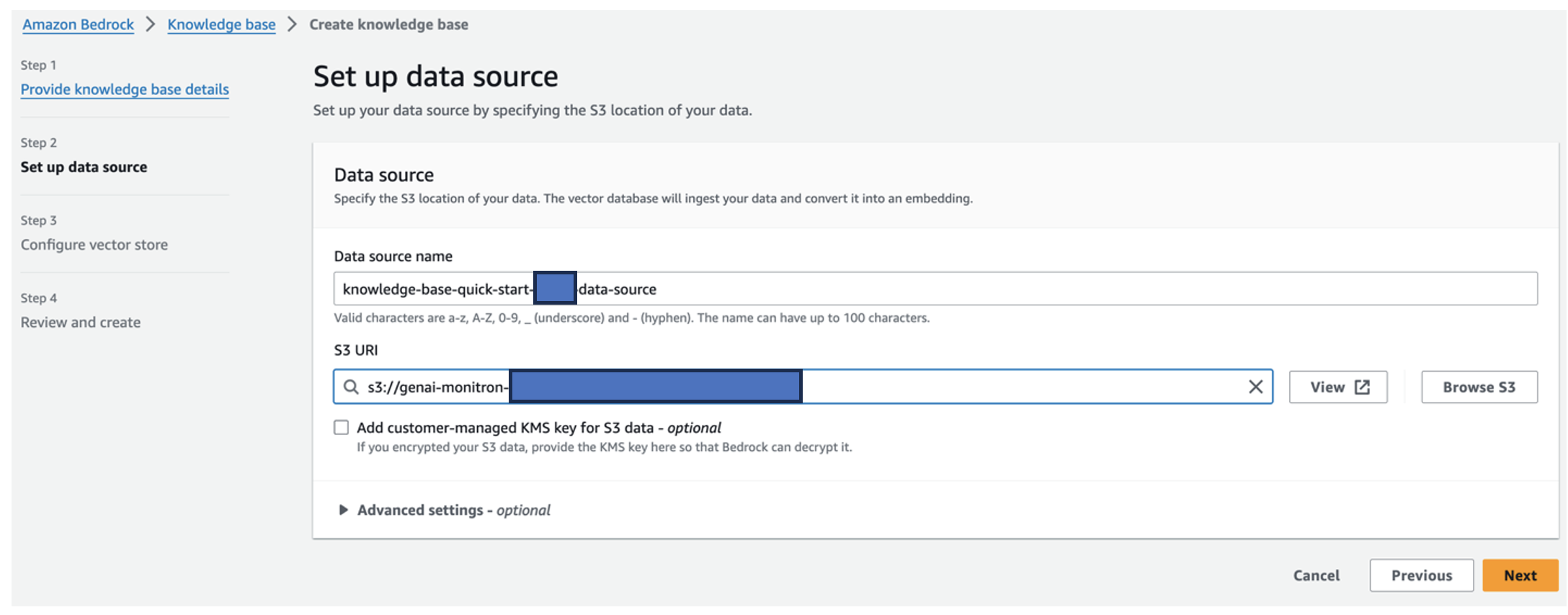

- Til Datakildenavn, indtast navnet på din datakilde.

- Til S3 URI, skal du indtaste S3-stien til den bucket, hvor du uploadede de grundlæggende årsagsdokumenter.

- Vælg Næste.

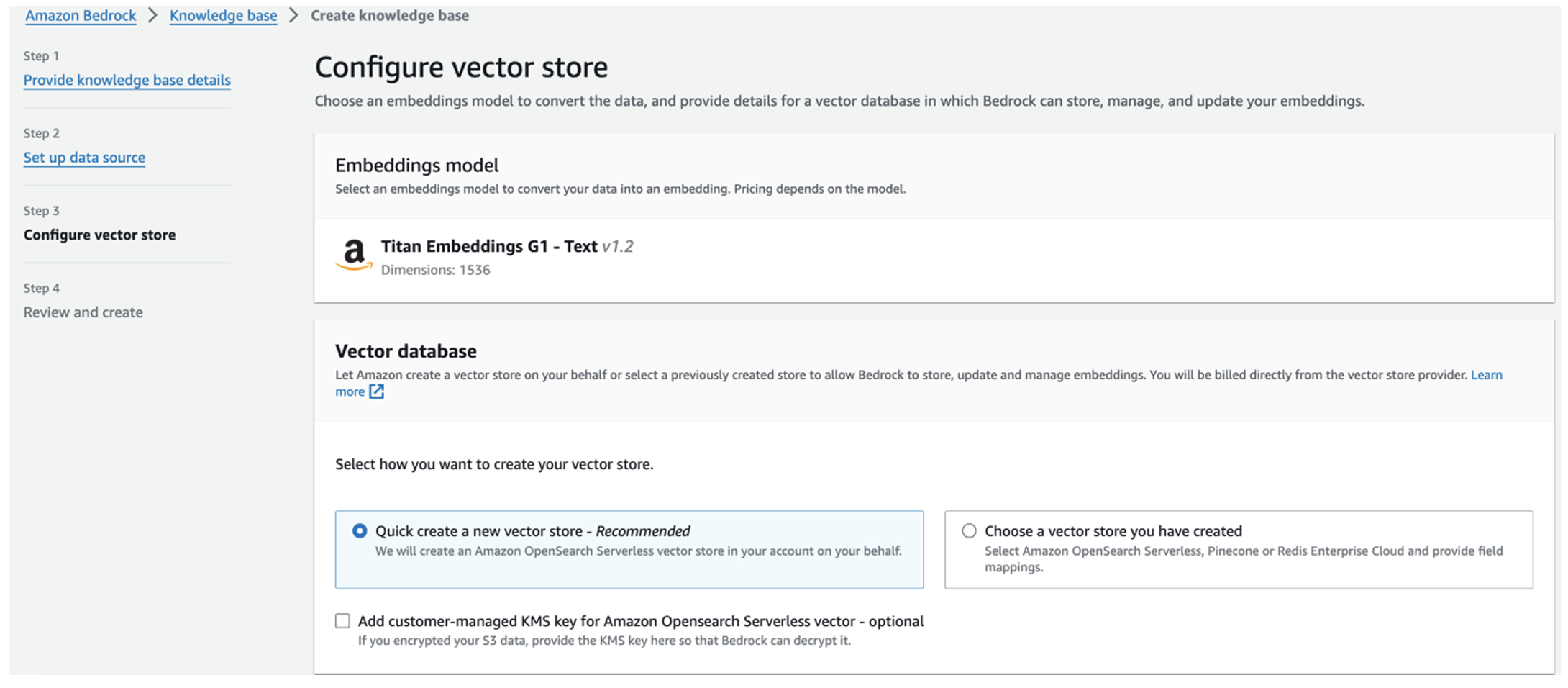

Titan-indlejringsmodellen vælges automatisk.

Titan-indlejringsmodellen vælges automatisk. - Type Opret hurtigt en ny vektorbutik.

- Gennemgå dine indstillinger og opret videnbasen ved at vælge Skab vidensbase.

- Når videnbasen er oprettet, skal du vælge Synkroniser at synkronisere S3-bøtten med videnbasen.

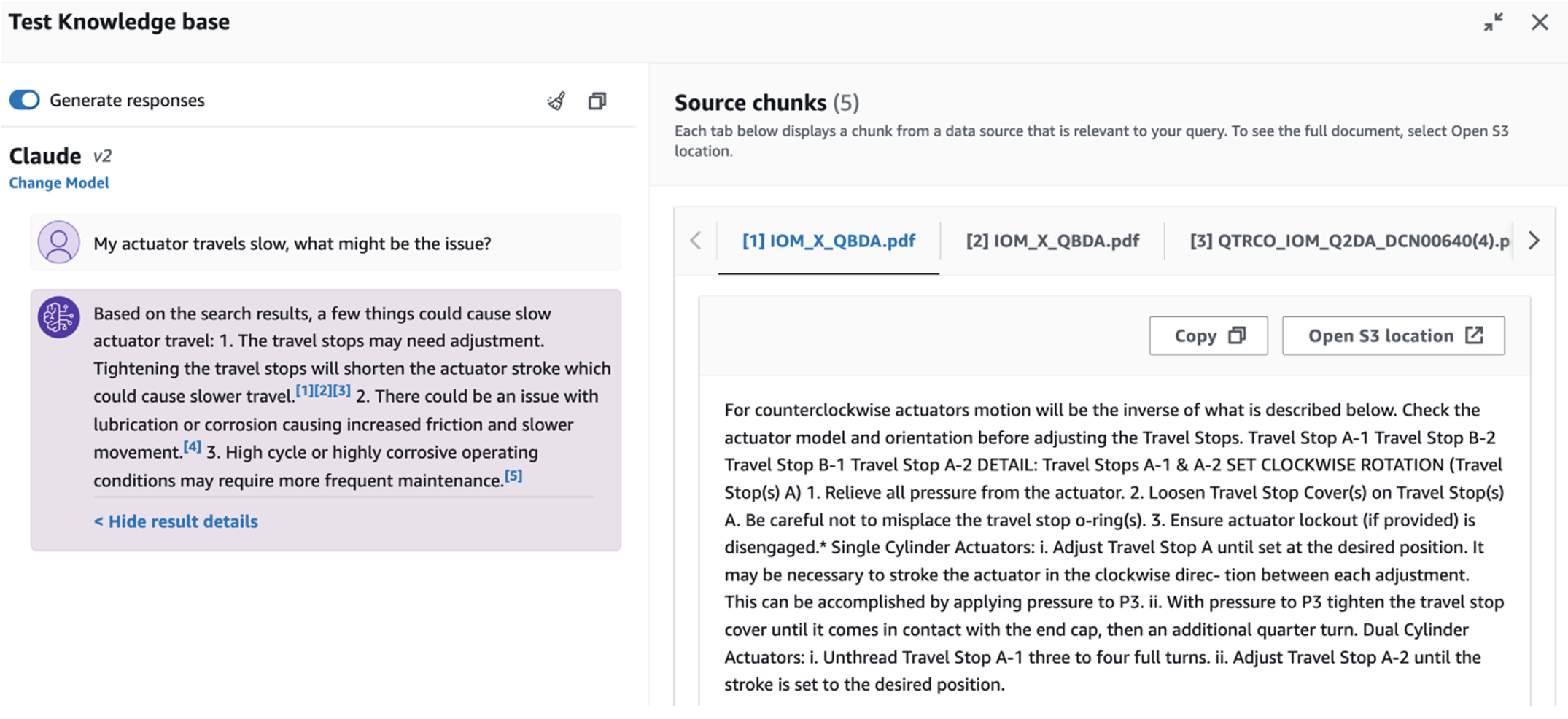

- Når du har oprettet vidensbasen, kan du teste RAG-tilgangen til diagnose af årsagen til årsagen ved at stille spørgsmål som "Min aktuator kører langsomt, hvad kan problemet være?"

Det næste trin er at implementere appen med de nødvendige bibliotekspakker på enten din pc eller en EC2-instans (Ubuntu Server 22.04 LTS).

- Konfigurer dine AWS-legitimationsoplysninger med AWS CLI på din lokale pc. For nemheds skyld kan du bruge den samme administratorrolle, som du brugte til at implementere CloudFormation-stakken. Hvis du bruger Amazon EC2, knytte en passende IAM-rolle til instansen.

- Klon GitHub repo:

- Skift mappen til

unlocking-the-potential-of-generative-ai-in-industrial-operations/srcog kør densetup.shscript i denne mappe for at installere de nødvendige pakker, inklusive LangChain og PandasAI:cd unlocking-the-potential-of-generative-ai-in-industrial-operations/src chmod +x ./setup.sh ./setup.sh - Kør Streamlit-appen med følgende kommando:

source monitron-genai/bin/activate python3 -m streamlit run app_bedrock.py <REPLACE WITH YOUR BEDROCK KNOWLEDGEBASE ARN>

Angiv OpenSearch Service-samlingen ARN, du oprettede i Amazon Bedrock fra det forrige trin.

Chat med din sundhedsassistent

Når du har gennemført end-to-end-implementeringen, kan du få adgang til appen via localhost på port 8501, som åbner et browservindue med webgrænsefladen. Hvis du implementerede appen på en EC2-instans, tillad port 8501-adgang via sikkerhedsgruppens indgående regel. Du kan navigere til forskellige faner til forskellige brugssager.

Udforsk use case 1

For at udforske den første use case, vælg Dataindsigt og diagram. Begynd med at uploade dine tidsseriedata. Hvis du ikke har en eksisterende tidsseriedatafil at bruge, kan du uploade følgende eksempel CSV-fil med anonyme Amazon Monitron-projektdata. Hvis du allerede har et Amazon Monitron-projekt, se Generer handlingsorienteret indsigt til forudsigelig vedligeholdelsesstyring med Amazon Monitron og Amazon Kinesis at streame dine Amazon Monitron-data til Amazon S3 og bruge dine data med denne applikation.

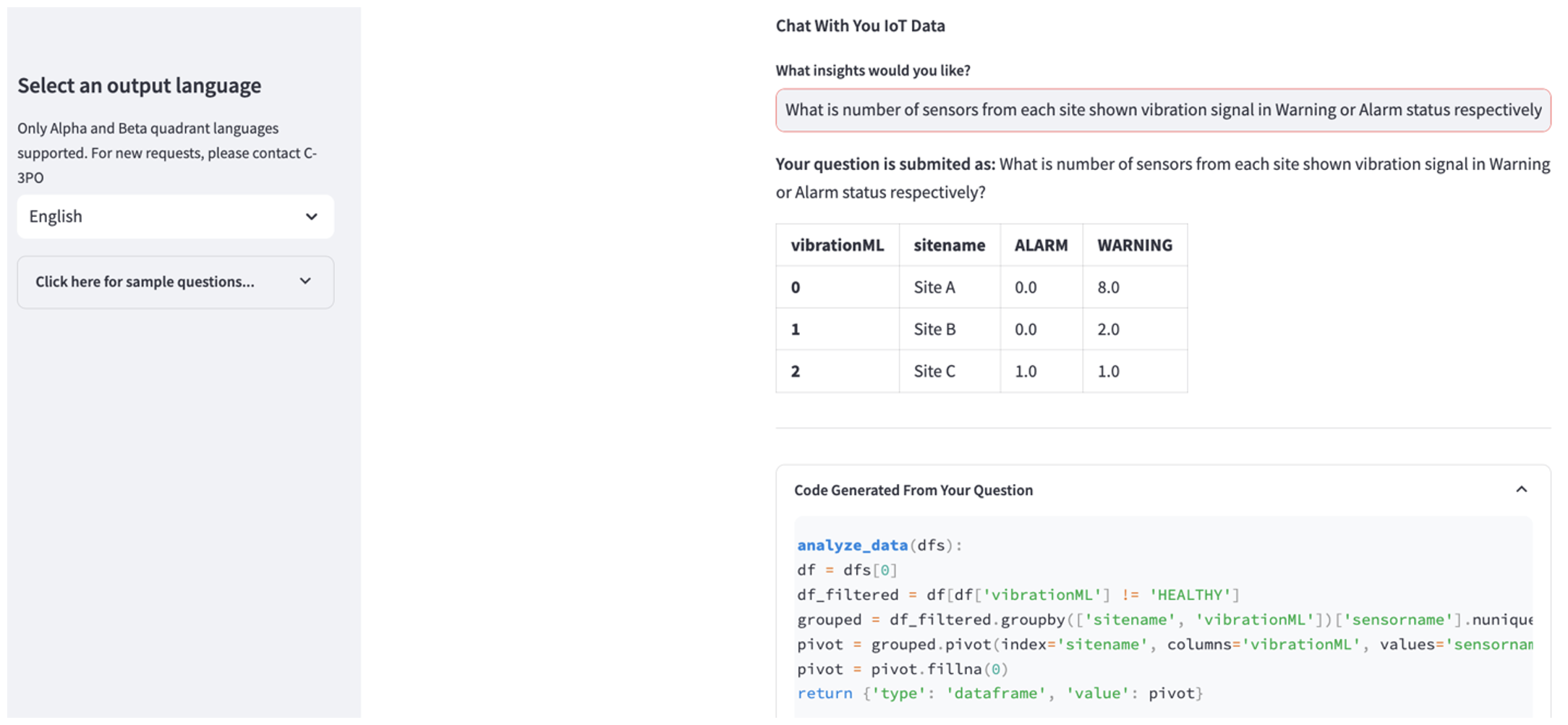

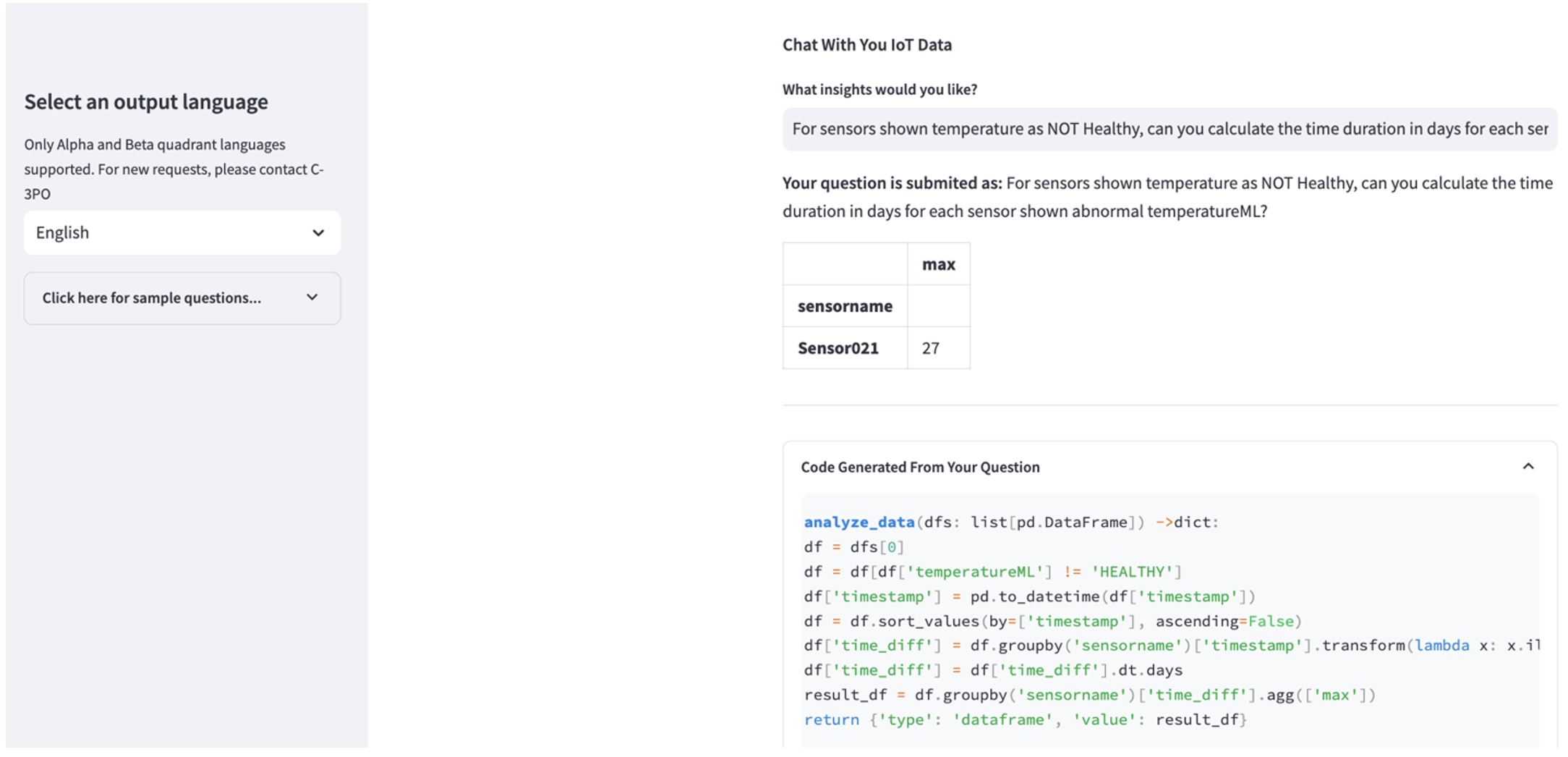

Når uploaden er færdig, skal du indtaste en forespørgsel for at starte en samtale med dine data. Den venstre sidebjælke tilbyder en række eksempler på spørgsmål til din bekvemmelighed. Følgende skærmbilleder illustrerer svaret og Python-koden, der genereres af FM'en, når der indtastes et spørgsmål som "Fortæl mig det unikke antal sensorer for hvert sted vist som henholdsvis Advarsel eller Alarm?" (et spørgsmål på hårdt niveau) eller "For sensorer vist temperatursignal som IKKE sunde, kan du beregne varigheden i dage for hver sensor vist unormalt vibrationssignal?" (et spørgsmål på udfordringsniveau). Appen vil besvare dit spørgsmål og vil også vise Python-scriptet til dataanalyse, den udførte for at generere sådanne resultater.

Hvis du er tilfreds med svaret, kan du markere det som Hjælpsom, gemmer den NLQ- og Claude-genererede Python-kode til et OpenSearch Service-indeks.

Udforsk use case 2

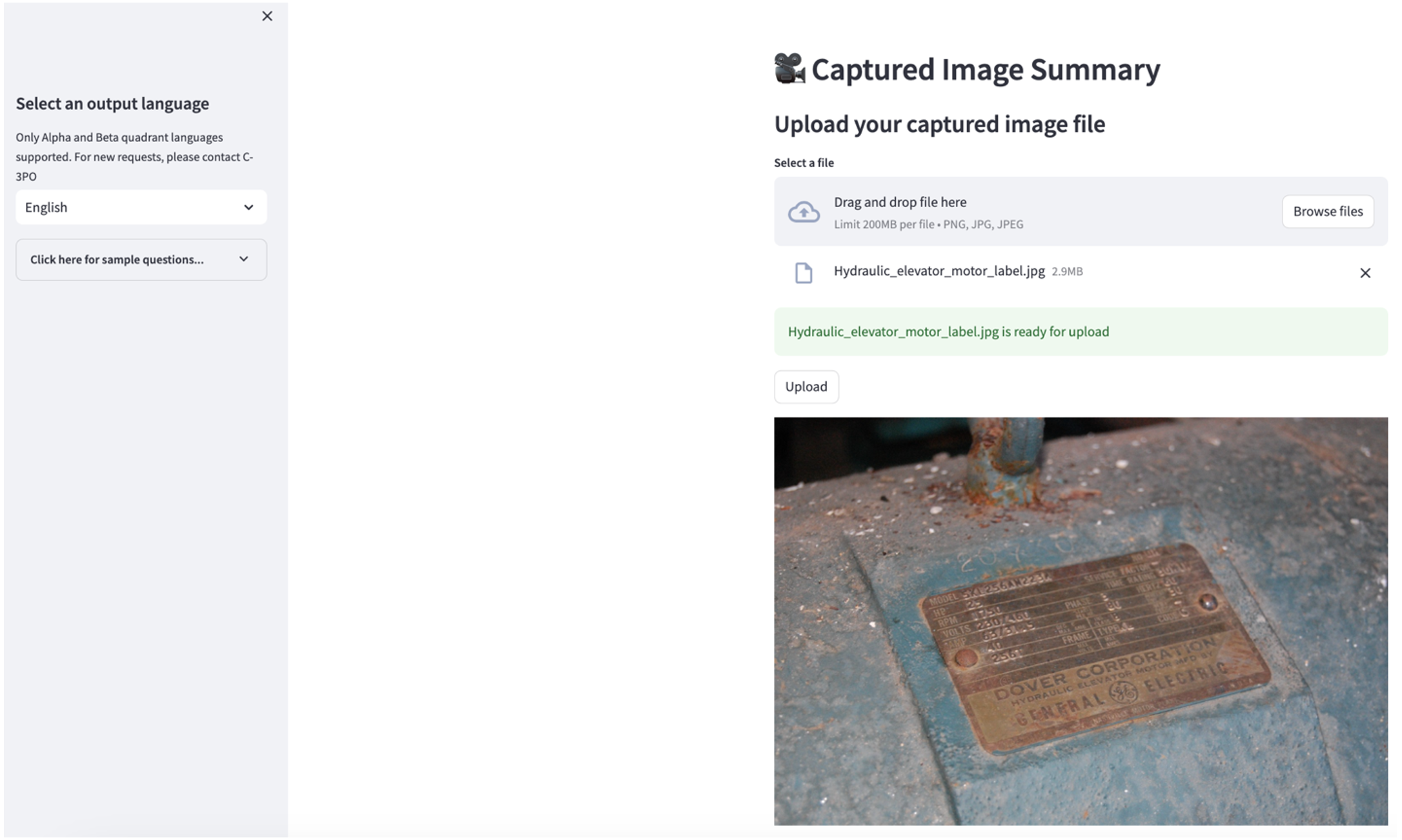

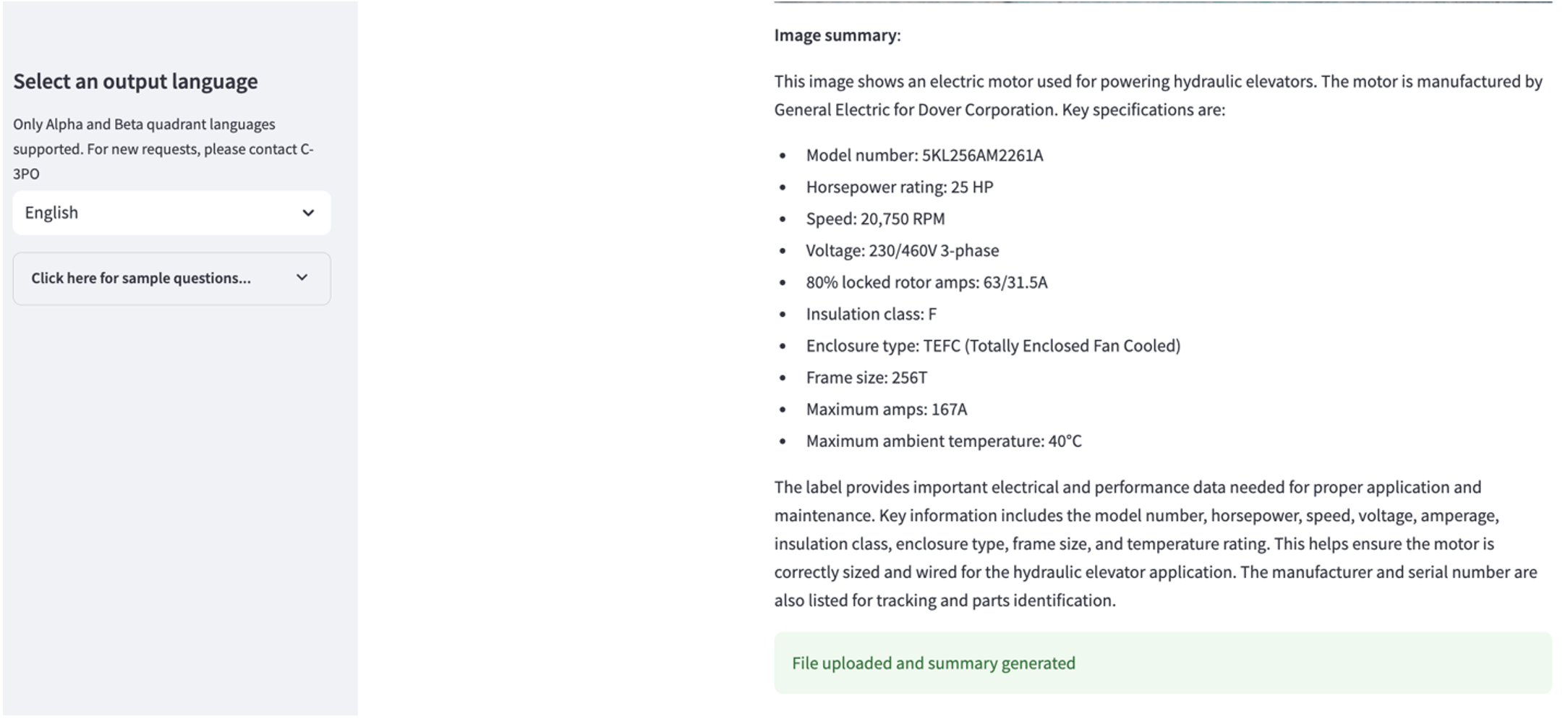

For at udforske den anden use case skal du vælge Oversigt over taget billede fanen i Streamlit-appen. Du kan uploade et billede af dit industrielle aktiv, og applikationen genererer en 200-ords oversigt over dens tekniske specifikationer og driftstilstand baseret på billedinformationen. Følgende skærmbillede viser oversigten genereret fra et billede af et remmotordrev. For at teste denne funktion, hvis du mangler et passende billede, kan du bruge følgende eksempel på billede.

Hydraulisk elevatormotor etiket” af Clarence Risher er licenseret under CC BY-SA 2.0.

Udforsk use case 3

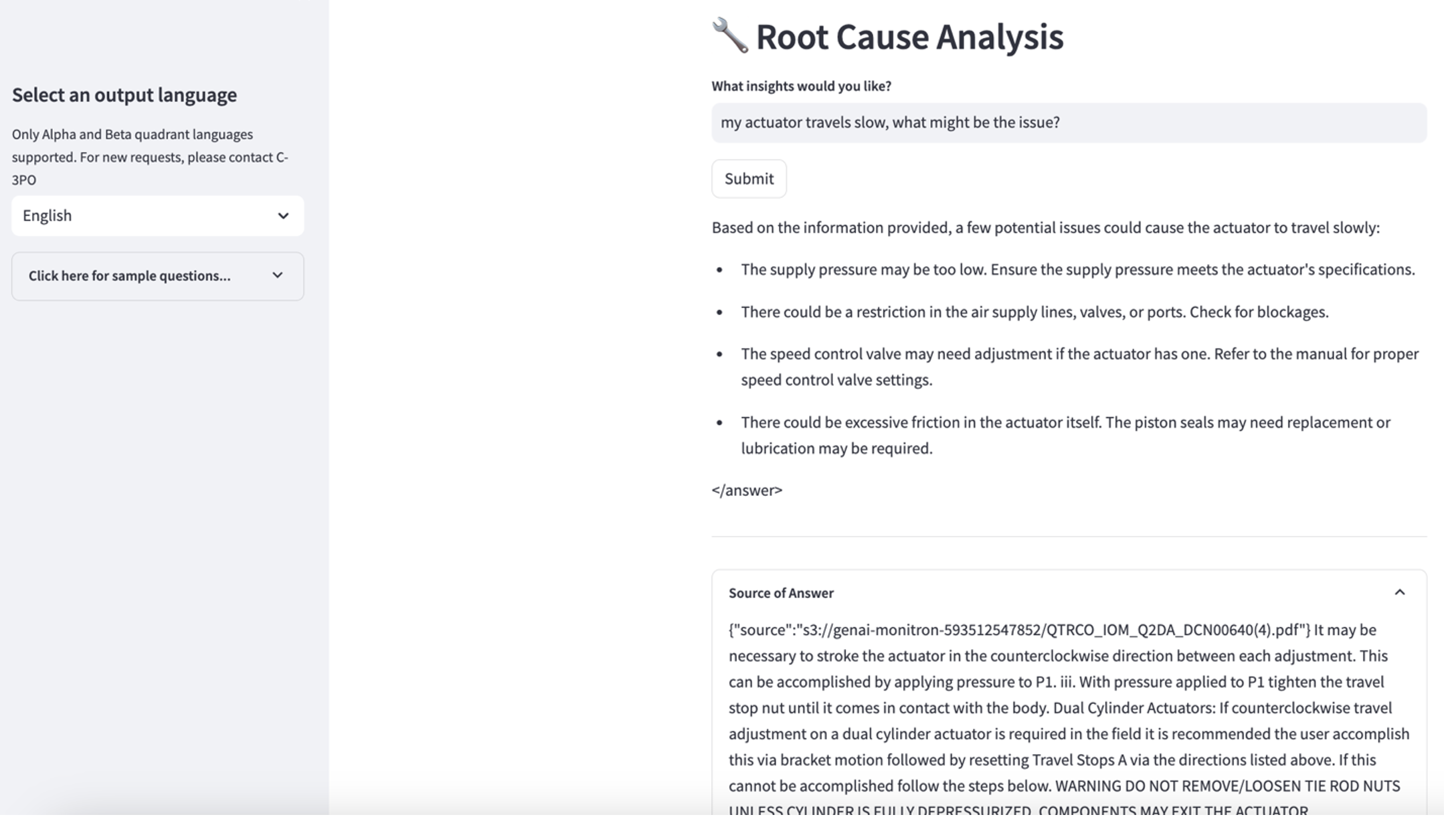

For at udforske den tredje use case skal du vælge Grundårsagsdiagnose fanen. Indtast en forespørgsel relateret til dit ødelagte industrielle aktiv, såsom "Min aktuator kører langsomt, hvad kan være problemet?" Som afbildet i det følgende skærmbillede, leverer applikationen et svar med kildedokumentuddraget, der blev brugt til at generere svaret.

Use case 1: Designdetaljer

I dette afsnit diskuterer vi designdetaljerne for applikationsworkflowet for den første use case.

Brugerdefineret hurtig bygning

Brugerens naturlige sprogforespørgsel kommer med forskellige svære niveauer: let, hårdt og udfordrende.

Ligetil spørgsmål kan omfatte følgende anmodninger:

- Vælg unikke værdier

- Tæl samlede tal

- Sorter værdier

For disse spørgsmål kan PandasAI interagere direkte med FM for at generere Python-scripts til behandling.

Svære spørgsmål kræver grundlæggende aggregeringsoperation eller tidsserieanalyse, såsom følgende:

- Vælg værdi først, og grupper resultater hierarkisk

- Udfør statistik efter første rekordvalg

- Antal tidsstempler (f.eks. min og maks.)

Ved svære spørgsmål hjælper en hurtig skabelon med detaljerede trin-for-trin instruktioner FM'er med at give nøjagtige svar.

Spørgsmål på udfordringsniveau kræver avanceret matematikberegning og tidsseriebehandling, såsom følgende:

- Beregn uregelmæssig varighed for hver sensor

- Beregn anomalisensorer for stedet på månedsbasis

- Sammenlign sensoraflæsninger under normal drift og unormale forhold

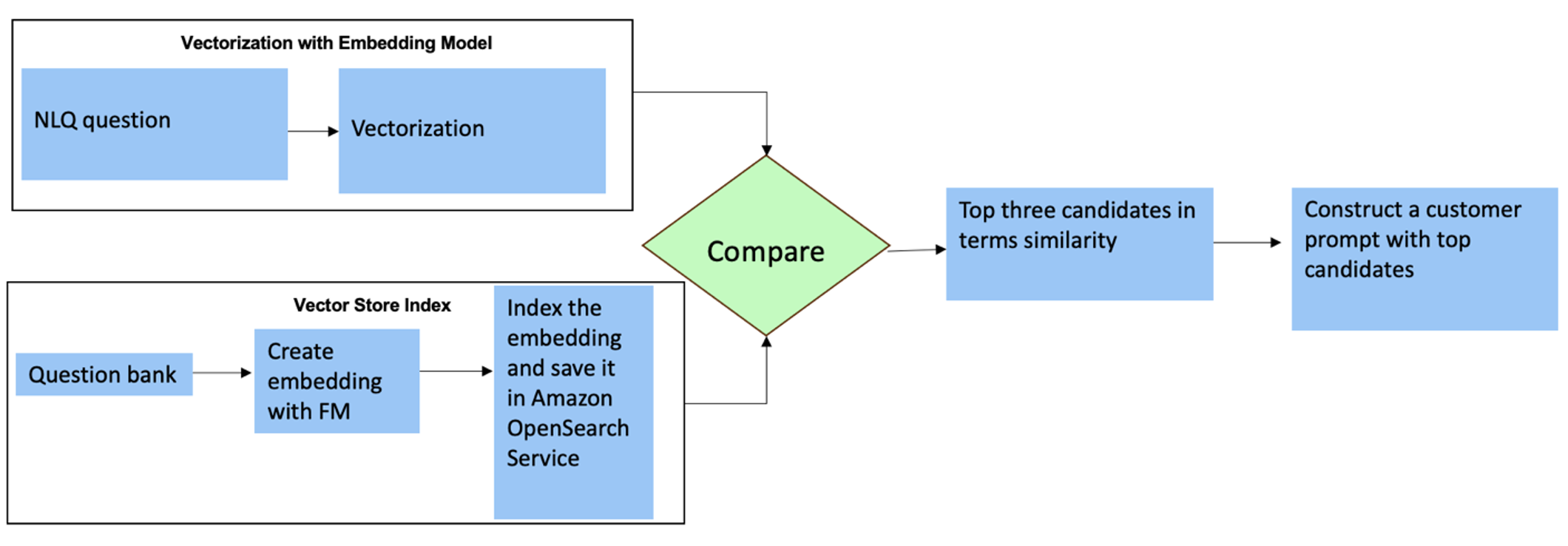

Til disse spørgsmål kan du bruge multi-shots i en tilpasset prompt for at forbedre svarnøjagtigheden. Sådanne multi-shots viser eksempler på avanceret tidsseriebehandling og matematisk beregning, og vil give kontekst for FM til at udføre relevante konklusioner om lignende analyser. Det kan være en udfordring at indsætte de mest relevante eksempler fra en NLQ-spørgsmålsbank dynamisk i prompten. En løsning er at konstruere indlejringer fra eksisterende NLQ-spørgsmålseksempler og gemme disse indlejringer i en vektorbutik som OpenSearch Service. Når et spørgsmål sendes til Streamlit-appen, vil spørgsmålet blive vektoriseret af Bedrock Indlejringer. De øverste N mest relevante indlejringer til det spørgsmål hentes vha opensearch_vector_search.similarity_search og indsat i promptskabelonen som en multi-shot prompt.

Følgende diagram illustrerer denne arbejdsgang.

Indlejringslaget er konstrueret ved hjælp af tre nøgleværktøjer:

- Indstøbningsmodel – Vi bruger Amazon Titan Embeddings, der er tilgængelige via Amazon Bedrock (amazon.titan-embed-text-v1) for at generere numeriske repræsentationer af tekstdokumenter.

- Vektor butik – Til vores vektorbutik bruger vi OpenSearch Service via LangChain-rammeværket, hvilket strømliner lagringen af indlejringer genereret fra NLQ-eksempler i denne notesbog.

- Indeks – OpenSearch Service-indekset spiller en central rolle ved at sammenligne input-indlejringer med dokumentindlejringer og lette genfindingen af relevante dokumenter. Fordi Python-eksempelkoderne blev gemt som en JSON-fil, blev de indekseret i OpenSearch Service som vektorer via en OpenSearchVevtorSearch.fromtexts API-kald.

Kontinuerlig indsamling af menneskereviderede eksempler via Streamlit

I begyndelsen af app-udviklingen begyndte vi med kun 23 gemte eksempler i OpenSearch Service-indekset som indlejringer. Når appen går live i marken, begynder brugerne at indtaste deres NLQ'er via appen. Men på grund af de begrænsede eksempler, der er tilgængelige i skabelonen, kan nogle NLQ'er muligvis ikke finde lignende prompter. For løbende at berige disse indlejringer og tilbyde mere relevante brugermeddelelser, kan du bruge Streamlit-appen til at samle menneskereviderede eksempler.

I appen tjener følgende funktion dette formål. Når slutbrugere finder output nyttigt og vælg Hjælpsom, applikationen følger disse trin:

- Brug tilbagekaldsmetoden fra PandasAI til at indsamle Python-scriptet.

- Omformater Python-scriptet, inputspørgsmålet og CSV-metadataene til en streng.

- Kontroller, om dette NLQ-eksempel allerede findes i det aktuelle OpenSearch Service-indeks ved hjælp af opensearch_vector_search.similarity_search_with_score.

- Hvis der ikke er et lignende eksempel, føjes denne NLQ til OpenSearch Service-indekset ved hjælp af opensearch_vector_search.add_texts.

I tilfælde af at en bruger vælger Ikke nyttigt, der foretages ikke noget. Denne iterative proces sikrer, at systemet løbende forbedres ved at inkorporere brugerbidrag med eksempler.

def addtext_opensearch(input_question, generated_chat_code, df_column_metadata, opensearch_vector_search,similarity_threshold,kexamples, indexname):

#######build the input_question and generated code the same format as existing opensearch index##########

reconstructed_json = {}

reconstructed_json["question"]=input_question

reconstructed_json["python_code"]=str(generated_chat_code)

reconstructed_json["column_info"]=df_column_metadata

json_str = ''

for key,value in reconstructed_json.items():

json_str += key + ':' + value

reconstructed_raw_text =[]

reconstructed_raw_text.append(json_str)

results = opensearch_vector_search.similarity_search_with_score(str(reconstructed_raw_text[0]), k=kexamples) # our search query # return 3 most relevant docs

if (dumpd(results[0][1])<similarity_threshold): ###No similar embedding exist, then add text to embedding

response = opensearch_vector_search.add_texts(texts=reconstructed_raw_text, engine="faiss", index_name=indexname)

else:

response = "A similar embedding is already exist, no action."

return response

Ved at inkorporere menneskelig auditering vokser mængden af eksempler i OpenSearch Service, der er tilgængelige for hurtig indlejring, efterhånden som appen bliver brugt. Dette udvidede indlejringsdatasæt resulterer i forbedret søgenøjagtighed over tid. Specifikt for udfordrende NLQ'er når FM's svarnøjagtighed cirka 90 %, når der dynamisk indsættes lignende eksempler for at konstruere brugerdefinerede prompter for hvert NLQ-spørgsmål. Dette repræsenterer en bemærkelsesværdig stigning på 28 % sammenlignet med scenarier uden multi-shot prompts.

Use case 2: Designdetaljer

På Streamlit-appen Oversigt over taget billede fanen, kan du uploade en billedfil direkte. Dette starter Amazon Rekognition API (opdage_tekst API), udtrækker tekst fra billedetiketten med detaljerede maskinspecifikationer. Efterfølgende sendes de udtrukne tekstdata til Amazon Bedrock Claude-modellen som kontekst af en prompt, hvilket resulterer i et resumé på 200 ord.

Fra et brugeroplevelsesperspektiv er det altafgørende at aktivere streamingfunktionalitet for en tekstresuméopgave, hvilket giver brugerne mulighed for at læse den FM-genererede oversigt i mindre bidder i stedet for at vente på hele outputtet. Amazon Bedrock letter streaming via sin API (bedrock_runtime.invoke_model_with_response_stream).

Use case 3: Designdetaljer

I dette scenarie har vi udviklet en chatbot-applikation med fokus på rodårsagsanalyse ved at anvende RAG-tilgangen. Denne chatbot trækker fra flere dokumenter relateret til lejeudstyr for at lette årsagsanalysen. Denne RAG-baserede rodårsagsanalyse chatbot bruger vidensbaser til at generere vektortekstrepræsentationer eller indlejringer. Knowledge Bases for Amazon Bedrock er en fuldt administreret funktion, der hjælper dig med at implementere hele RAG-workflowet, fra indlæsning til genfinding og prompt augmentation, uden at skulle bygge tilpassede integrationer til datakilder eller administrere dataflows og RAG-implementeringsdetaljer.

Når du er tilfreds med videnbasesvaret fra Amazon Bedrock, kan du integrere årsagssvaret fra videnbasen til Streamlit-appen.

Ryd op

For at spare omkostninger skal du slette de ressourcer, du oprettede i dette indlæg:

- Slet videnbasen fra Amazon Bedrock.

- Slet OpenSearch Service-indekset.

- Slet genai-sagemaker CloudFormation-stakken.

- Stop EC2-instansen, hvis du brugte en EC2-instans til at køre Streamlit-appen.

Konklusion

Generative AI-applikationer har allerede transformeret forskellige forretningsprocesser og forbedret medarbejdernes produktivitet og færdighedssæt. Imidlertid har FM'ers begrænsninger i håndteringen af tidsseriedataanalyse hindret deres fulde udnyttelse af industrielle kunder. Denne begrænsning har forhindret anvendelsen af generativ AI på den dominerende datatype, der behandles dagligt.

I dette indlæg introducerede vi en generativ AI-applikationsløsning designet til at afhjælpe denne udfordring for industrielle brugere. Denne applikation bruger en open source-agent, PandasAI, til at styrke en FM's tidsserieanalysekapacitet. I stedet for at sende tidsseriedata direkte til FM'er, anvender appen PandasAI til at generere Python-kode til analyse af ustrukturerede tidsseriedata. For at forbedre nøjagtigheden af Python-kodegenerering er der implementeret en brugerdefineret promptgenereringsworkflow med menneskelig revision.

Bemyndiget med indsigt i deres aktivers sundhed kan industriarbejdere fuldt ud udnytte potentialet i generativ AI på tværs af forskellige anvendelsessager, herunder årsagsdiagnose og planlægning af udskiftning af dele. Med Knowledge Bases for Amazon Bedrock er RAG-løsningen ligetil for udviklere at bygge og administrere.

Banen for virksomhedsdatastyring og -drift bevæger sig umiskendeligt i retning af dybere integration med generativ AI for omfattende indsigt i operationel sundhed. Dette skift, med Amazon Bedrock i spidsen, forstærkes markant af den voksende robusthed og potentiale af LLM'er som f.eks. Amazon grundbjerg Claude 3 at løfte løsninger yderligere. For at lære mere, besøg konsulter Amazon Bedrock dokumentation, og få hands-on med Amazon Bedrock workshop.

Om forfatterne

Julia Hu er Sr. AI/ML Solutions Architect hos Amazon Web Services. Hun er specialiseret i Generativ AI, Applied Data Science og IoT-arkitektur. I øjeblikket er hun en del af Amazon Q-teamet og et aktivt medlem/mentor i Machine Learning Technical Field Community. Hun arbejder med kunder, lige fra nystartede virksomheder til virksomheder, for at udvikle AWSome generative AI-løsninger. Hun brænder især for at udnytte store sprogmodeller til avanceret dataanalyse og udforske praktiske applikationer, der adresserer udfordringer i den virkelige verden.

Julia Hu er Sr. AI/ML Solutions Architect hos Amazon Web Services. Hun er specialiseret i Generativ AI, Applied Data Science og IoT-arkitektur. I øjeblikket er hun en del af Amazon Q-teamet og et aktivt medlem/mentor i Machine Learning Technical Field Community. Hun arbejder med kunder, lige fra nystartede virksomheder til virksomheder, for at udvikle AWSome generative AI-løsninger. Hun brænder især for at udnytte store sprogmodeller til avanceret dataanalyse og udforske praktiske applikationer, der adresserer udfordringer i den virkelige verden.

Sudeesh Sasidharan er Senior Solutions Architect hos AWS, indenfor Energy-teamet. Sudeesh elsker at eksperimentere med nye teknologier og bygge innovative løsninger, der løser komplekse forretningsmæssige udfordringer. Når han ikke designer løsninger eller roder med de nyeste teknologier, kan du finde ham på tennisbanen, der arbejder på sin baghånd.

Sudeesh Sasidharan er Senior Solutions Architect hos AWS, indenfor Energy-teamet. Sudeesh elsker at eksperimentere med nye teknologier og bygge innovative løsninger, der løser komplekse forretningsmæssige udfordringer. Når han ikke designer løsninger eller roder med de nyeste teknologier, kan du finde ham på tennisbanen, der arbejder på sin baghånd.

Neil Desai er en teknologileder med over 20 års erfaring inden for kunstig intelligens (AI), datavidenskab, softwareteknik og virksomhedsarkitektur. Hos AWS leder han et team af verdensomspændende AI-tjenesters specialistløsningsarkitekter, som hjælper kunder med at bygge innovative Generative AI-drevne løsninger, dele bedste praksis med kunder og drive produktkøreplan. I sine tidligere roller hos Vestas, Honeywell og Quest Diagnostics har Neil haft lederroller i udvikling og lancering af innovative produkter og tjenester, der har hjulpet virksomheder med at forbedre deres drift, reducere omkostninger og øge omsætningen. Han brænder for at bruge teknologi til at løse problemer i den virkelige verden og er en strategisk tænker med en dokumenteret succeshistorie.

Neil Desai er en teknologileder med over 20 års erfaring inden for kunstig intelligens (AI), datavidenskab, softwareteknik og virksomhedsarkitektur. Hos AWS leder han et team af verdensomspændende AI-tjenesters specialistløsningsarkitekter, som hjælper kunder med at bygge innovative Generative AI-drevne løsninger, dele bedste praksis med kunder og drive produktkøreplan. I sine tidligere roller hos Vestas, Honeywell og Quest Diagnostics har Neil haft lederroller i udvikling og lancering af innovative produkter og tjenester, der har hjulpet virksomheder med at forbedre deres drift, reducere omkostninger og øge omsætningen. Han brænder for at bruge teknologi til at løse problemer i den virkelige verden og er en strategisk tænker med en dokumenteret succeshistorie.

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk dig selv. Adgang her.

- PlatoAiStream. Web3 intelligens. Viden forstærket. Adgang her.

- PlatoESG. Kulstof, CleanTech, Energi, Miljø, Solenergi, Affaldshåndtering. Adgang her.

- PlatoHealth. Bioteknologiske og kliniske forsøgs intelligens. Adgang her.

- Kilde: https://aws.amazon.com/blogs/machine-learning/unlock-the-potential-of-generative-ai-in-industrial-operations/

- :har

- :er

- :ikke

- :hvor

- $OP

- 000

- 1

- 100

- 125

- 150

- 16

- 20

- 20 år

- 200

- 22

- 23

- 7

- 8

- a

- evne

- I stand

- abnorm

- Om

- adgang

- Ifølge

- nøjagtighed

- præcis

- tværs

- Handling

- handlingsrettede

- aktiv

- tilføje

- tilføjet

- Yderligere

- adresse

- adressering

- Tilføjer

- admin

- Vedtagelse

- fremskreden

- Efter

- Agent

- midler

- aggregering

- AI

- AI-tjenester

- AI-drevne

- AI / ML

- alarm

- lindre

- tillade

- sammen

- allerede

- også

- Amazon

- Amazon EC2

- Amazon-anerkendelse

- Amazon Web Services

- Amplified

- an

- analyse

- analytics

- ,

- abnormaliteter

- afsløring af anomalier

- anonym

- besvare

- svar

- Antropisk

- enhver

- api

- app

- App-udvikling

- Anvendelse

- applikationer

- anvendt

- tilgang

- cirka

- arkitekter

- arkitektur

- ER

- kunstig

- kunstig intelligens

- Kunstig intelligens (AI)

- AS

- spørge

- vurdere

- aktiv

- Aktiver

- Assistant

- hjælper

- At

- revision

- augmented

- automatisk

- til rådighed

- AWS

- AWS CloudFormation

- Bank

- bund

- baseret

- grundlæggende

- BE

- fordi

- været

- begyndte

- begynde

- adfærd

- til gavn

- BEDSTE

- bedste praksis

- fremme

- boosts

- Broken

- browser

- bygge

- Bygning

- virksomhed

- by

- beregne

- beregning

- ringe

- CAN

- kapaciteter

- kapacitet

- fange

- tilfælde

- tilfælde

- Årsag

- kæde

- udfordre

- udfordringer

- udfordrende

- chatbot

- chatter

- Vælg

- vælge

- cli

- kunder

- kode

- koder

- indsamler

- Indsamling

- samling

- Kom

- kommer

- samfund

- Virksomheder

- sammenlignet

- sammenligne

- fuldføre

- komplekse

- omfattende

- computer

- betingelse

- betydelig

- består

- Konsol

- begrænsninger

- konstruere

- konstrueret

- konstruere

- konsultere

- indeholder

- indhold

- sammenhæng

- løbende

- kontinuerligt

- bekvemmelighed

- Samtale

- konversation

- konvertering af

- Omkostninger

- tælle

- Ret

- skabe

- oprettet

- skaber

- kritisk

- Nuværende

- For øjeblikket

- skik

- Kunder

- dagligt

- data

- dataanalyse

- Dataanalyse

- datastyring

- databehandling

- datalogi

- datastyret

- Dage

- afgørelser

- dybere

- Standard

- leverer

- krav

- demokratiserer

- afbildet

- indsætte

- indsat

- implementering

- Design

- konstrueret

- designe

- ønskes

- detaljeret

- Detailing

- detaljer

- opdage

- Detektion

- udvikle

- udviklet

- udviklere

- udvikling

- Udvikling

- Enheder

- diagnose

- diagnostik

- diagram

- forskellige

- svært

- digital

- digitale revolution

- direkte

- Vejviser

- diskutere

- spredte

- distinkt

- docs

- dokumentet

- dokumenter

- Dont

- downloadet

- trækker

- køre

- kørsel

- grund

- varighed

- dynamisk

- hver

- let

- enten

- OPHØJE

- eliminerer

- andet

- Integrer

- indlejring

- anvendelse

- beskæftiger

- muliggør

- ende til ende

- energi

- engagerende

- Engineering

- Ingeniører

- forbedre

- forbedret

- styrke

- berige

- Indtast

- Enterprise

- virksomheder

- Hele

- udstyr

- fejl

- Endog

- begivenhed

- indlysende

- udviklende

- eksempel

- eksempler

- udøvende

- eksisterer

- eksisterende

- eksisterer

- udvidet

- erfaring

- eksperimentere

- udforske

- Udforskning

- omfattende

- ekstrakt

- Ansigtet

- lette

- letter

- faciliterende

- faciliteter

- mislykkedes

- fejl

- Feature

- felt

- File (Felt)

- Filer

- Finde

- Fornavn

- strømme

- fokuserede

- følger

- efter

- følger

- Til

- format

- Foundation

- Framework

- fra

- fuld

- fuldt ud

- funktion

- funktionalitet

- yderligere

- Gevinst

- gevinster

- indsamling

- generere

- genereret

- generere

- generation

- generative

- Generativ AI

- få

- GitHub

- Goes

- gruppe

- Dyrkning

- Vokser

- Håndtering

- hands-on

- Hård Ost

- seletøj

- Have

- have

- he

- Helse

- sund

- Held

- hjælpe

- hjulpet

- hjælpsom

- hjælper

- høj opløsning

- ham

- hindrede

- hans

- Honeywell

- Men

- HTML

- http

- HTTPS

- menneskelig

- identificere

- if

- illustrere

- illustrerer

- billede

- billeder

- gennemføre

- implementering

- implementeret

- Forbedre

- forbedret

- forbedrer

- in

- omfatter

- medtaget

- omfatter

- Herunder

- inkorporering

- Forøg

- indeks

- indekseret

- industrielle

- oplysninger

- informeret

- initial

- indlede

- Indleder

- innovativ

- indgang

- indtastning

- indsigt

- indsigt

- installere

- instans

- anvisninger

- integrere

- integration

- integrationer

- Intelligens

- Intelligent

- interagere

- grænseflade

- Internet

- tingenes internet

- ind

- introduceret

- Introducerer

- tingenes internet

- spørgsmål

- IT

- ITS

- fælles

- jpeg

- jpg

- json

- Nøgle

- viden

- kendt

- kender

- etiket

- Mangel

- landskab

- Sprog

- stor

- seneste

- lancering

- lag

- Leadership" (virkelig menneskelig ledelse)

- Leads

- LÆR

- læring

- til venstre

- niveauer

- løftestang

- Bibliotek

- Licenseret

- ligesom

- begrænsninger

- Limited

- linjer

- Børsnoterede

- leve

- belastning

- lokale

- elsker

- maskine

- machine learning

- vedligeholdelse

- maerker

- administrere

- lykkedes

- ledelse

- Ledere

- Håndtering

- manuelt

- Producenter

- Produktion

- markere

- matematik

- max

- Kan..

- me

- målinger

- Mød

- Metadata

- metode

- måske

- minut

- ML

- model

- modeller

- Overvåg

- overvågning

- månedligt

- mere

- mest

- Motor

- flytning

- flere

- navn

- Natural

- Naviger

- navigering

- Navigation

- nødvendig

- Behov

- Ny

- Nye teknologier

- næste

- ingen

- normal

- bemærkelsesværdig

- notesbog

- nummer

- opnår

- of

- tilbyde

- Tilbud

- on

- ONE

- kun

- åbent

- open source

- åbner

- drift

- operationelle

- Produktion

- Optimer

- or

- vores

- output

- udgange

- i løbet af

- pakker

- par

- pandaer

- brød

- Paramount

- del

- især

- lidenskabelige

- sti

- PC

- Udfør

- udføres

- udfører

- perspektiv

- PHP

- Fysisk

- Pivot

- afgørende

- planlægning

- plato

- Platon Data Intelligence

- PlatoData

- Leg

- spiller

- Populær

- udgør

- Indlæg

- potentiale

- magt

- strøm

- Praktisk

- praksis

- forudsætninger

- tidligere

- Forud

- problemer

- behandle

- Behandlet

- Processer

- forarbejdning

- Produkt

- produktion

- produktivitet

- Produkter

- Progress

- projekt

- projektdata

- prompter

- foreslå

- Bevise

- gennemprøvet

- give

- giver

- leverer

- formål

- Python

- mængde

- forespørgsler

- query

- Quest

- spørgsmål

- Spørgsmål

- klud

- rækkevidde

- spænder

- hurtigt

- hellere

- når

- Læs

- virkelige verden

- realtid

- data i realtid

- anerkendelse

- optage

- reducere

- henvise

- relaterede

- relevant

- erstatte

- udskiftning

- Repository

- repræsenterer

- anmodninger

- kræver

- påkrævet

- Ressourcer

- henholdsvis

- svar

- reaktioner

- resulterer

- Resultater

- hentning

- afkast

- afkast

- indtægter

- revolution

- køreplan

- robusthed

- roller

- roller

- rod

- Kør

- kører

- løber

- sagemaker

- samme

- tilfreds

- Tilfreds med

- Gem

- gemt

- besparelse

- Scale

- scenarie

- scenarier

- Videnskab

- forskere

- screenshots

- script

- scripts

- Søg

- søgninger

- Anden

- Sektion

- sikkerhed

- Vælg

- valgt

- afsendelse

- sender

- senior

- sensor

- sensorer

- sendt

- Series

- server

- tjener

- tjeneste

- Tjenester

- sæt

- sæt

- indstillinger

- flere

- Del

- hun

- skifte

- bør

- Vis

- viser

- vist

- Shows

- Signal

- betydeligt

- lignende

- Simpelt

- enkelhed

- forenkle

- websted

- Størrelse

- dygtighed

- færdigheder

- langsom

- lille

- mindre

- So

- Software

- software Engineering

- løsninger

- Løsninger

- SOLVE

- nogle

- noget

- Kilde

- indkøbt

- Kilder

- stået i spidsen

- specialist

- specialiserede

- specifikke

- specifikt

- specifikation

- specifikationer

- stable

- standalone

- starte

- nystartede virksomheder

- state-of-the-art

- statistik

- Trin

- Steps

- opbevaring

- butik

- ligetil

- Strategisk

- strøm

- streaming

- strømliner

- strømlining

- Styrke

- String

- Efterfølgende

- succes

- vellykket

- Succesfuld

- sådan

- egnede

- RESUMÉ

- forsyne

- forsyningskæde

- sikker

- synkronisere.

- systemet

- Systemer

- bord

- taget

- Opgaver

- hold

- hold

- Teknisk

- Teknologier

- Teknologier

- skabelon

- tennis

- prøve

- tekst

- tekstmæssige

- end

- at

- The Source

- deres

- Them

- derefter

- Der.

- derfor

- Disse

- de

- ting

- tænker

- Tredje

- denne

- tre

- Gennem

- tid

- Tidsserier

- titan

- til

- værktøj

- værktøjer

- top

- I alt

- mod

- spor

- historik

- bane

- transformative

- omdannet

- rejser

- typen

- typisk

- Ubuntu

- under

- forståelse

- enestående

- låse

- ustruktureret

- uploadet

- Uploading

- Brug

- brug

- brug tilfælde

- anvendte

- Bruger

- Brugererfaring

- brugere

- bruger

- ved brug af

- Værdifuld

- værdi

- række

- forskellige

- Vast

- via

- Besøg

- mængder

- Venter

- advarsel

- we

- web

- webservices

- var

- Hvad

- hvornår

- hvorvidt

- som

- WHO

- udbredt

- vilje

- vindue

- med

- inden for

- uden

- arbejdstager

- arbejdere

- workflow

- arbejdsgange

- arbejder

- virker

- verdensplan

- Forkert

- år

- endnu

- Udbytte

- Du

- Din

- zephyrnet