Dette indlæg er skrevet i samarbejde med Balaji Chandrasekaran, Jennifer Cwagenberg og Andrew Sansom og Eiman Ebrahimi fra Protopia AI.

Nye og kraftfulde store sprogmodeller (LLM'er) ændrer virksomheder hurtigt og forbedrer effektiviteten og effektiviteten til en række forskellige virksomhedsbrugssager. Hastighed er af afgørende betydning, og vedtagelse af LLM-teknologier kan skabe eller bryde en virksomheds konkurrencefordel. AWS er særligt velegnet til at give virksomheder de nødvendige værktøjer til at implementere LLM'er i stor skala for at muliggøre kritisk beslutningstagning.

I deres implementering af generativ AI-teknologi har virksomheder reelle bekymringer om dataeksponering og ejerskab af fortrolige oplysninger, der kan sendes til LLM'er. Disse bekymringer om privatliv og databeskyttelse kan bremse eller begrænse brugen af LLM'er i organisationer. Virksomheder har brug for en ansvarlig og sikrere måde at sende følsomme oplysninger til modellerne uden at skulle påtage sig de ofte uoverkommeligt høje omkostninger ved lokale DevOps.

Indlægget beskriver, hvordan du kan overvinde udfordringerne med at bevare dataejerskab og bevare databeskyttelse, mens du bruger LLM'er ved at implementere Protopia AI's Stained Glass Transform for at beskytte dine data. Protopia AI har indgået partnerskab med AWS for at levere den kritiske komponent af databeskyttelse og ejerskab for sikker og effektiv virksomhedsadoption af generativ AI. Dette indlæg skitserer løsningen og demonstrerer, hvordan den kan bruges i AWS til populære virksomhedsbrugssager som f.eks Retrieval Augmented Generation (RAG) og med state-of-the-art LLM'er som Lama 2.

Stained Glass Transform oversigt

Organisationer søger at bevare fuldt ejerskab og kontrol over deres følsomme virksomhedsdata. Dette er en søjle i ansvarlig AI og et spirende databeskyttelses- og privatlivskrav ud over grundlæggende sikkerhed og juridiske garantier fra LLM-udbydere.

Selvom virksomhedens forretningsenheder ønsker at bruge LLM'er til forskellige opgaver, er de også bekymrede over forretningshemmeligheder, intellektuel ejendomsret og anden proprietær information, der lækker gennem data sendt til disse modeller. Samtidig er virksomhedens sikkerhed, compliance, datastyring og informationskontorer bange for at afsløre eller lække almindelig tekst kundeoplysninger eller andre regulerede data uden for virksomheden. AWS og Protopia AI samarbejder om at levere den kritiske komponent, der løser dette almindelige virksomhedskundebehov.

Protopia AI's Stained Glass Transform (SGT) løser disse udfordringer ved at konvertere ubeskyttede virksomhedsdata til en randomiseret genrepræsentation, refereret til som RmoRed-data, som vist i følgende figur. Denne repræsentation er en stokastisk indlejring af de originale data, der bevarer den information, som målet LLM har brug for for at fungere uden at afsløre følsomme prompter eller forespørgsler, kontekst eller finjustering af data. Denne genrepræsentation er en envejstransformation, der ikke kan vendes, og sikrer holistisk privatliv for virksomhedsdata og beskyttelse mod lækage af almindelig tekstfølsom information til LLM'er. SGT's anvendelighed er ikke begrænset til sprogmodeller. Randomiserede re-repræsentationer kan også genereres til visuelle og strukturerede data. Navnet Stained Glass Transform er rodfæstet i det visuelle udseende af randomiserede genrepræsentationer af visuelle data, der kan ligne at se data gennem farvet glas, som vist i denne US Navy use case.

SGT arbejder med avancerede LLM'er såsom Llama 2. Den følgende figur viser et eksempel på anvendelse af SGT til en Llama 2-model til instruktionsfølgning, mens der tilføjes et lag af beskyttelse til instruktionen og konteksten. Den venstre side af figuren viser et eksempel på et finansielt dokument som kontekst, hvor instruktionen beder modellen om at opsummere dokumentet. Nederst til venstre vises det svar, der genereres af Llama 2, når du betjener den rå prompt. Når du bruger SGT, transformeres indlejringerne i forbindelse med denne prompt på klientsiden til stokastiske indlejringer, som beskrevet mere detaljeret senere i dette indlæg. Nederst til højre viser, at Llama 2 stadig kan generere et korrekt svar, hvis RmoRed-dataene (indlejringer efter transformation) sendes i stedet for de ubeskyttede indlejringer. Øverst til højre viser, at hvis RmoRed-dataene lækkede, ville en rekonstruktion af den originale prompt resultere i uforståelig tekst.

For at skabe en SGT for en given model, såsom Llama 2, leverer Protopia AI et letvægtsbibliotek kaldet Stained Glass SDK, som er en udvidelse af PyTorch. Som vist i den følgende figur, efter at en SGT er oprettet, kan den integreres i implementeringspipelines på flere måder. Transformationen, der oprettes fra SDK'et, kan implementeres lokalt, i en hybrid opsætning eller helt i skyen. Dette er muligt, fordi SGT er designet til at være en letvægtsproces, der kræver meget få computerressourcer og som sådan har minimal indvirkning på den slutningskritiske vej. En anden nøgleevaluering er fastholdelse af modellens nøjagtighed ved brug af re-repræsenterede data. Vi observerer, at på tværs af forskellige datatyper og modelvariationer bevares nøjagtigheden inden for de ønskede tolerancegrænser, når der bruges re-repræsenterede data.

Disse muligheder for implementering og opretholdelse af nøjagtigheden giver mulighed for sikker vedtagelse af SGT af alle interessenter i en virksomhedsorganisation. For yderligere at beskytte output fra LLM kan Protopia AI kode forespørgselsoutput til en repræsentation, hvis dekoder kun er tilgængelig for virksomhedens dataejer.

Løsningsoversigt

Det forrige afsnit beskrev, hvordan du kan bruge Stained Glass Transform i en række forskellige arkitekturer. Følgende figur beskriver de trin, der er involveret i at oprette, implementere og bruge SGT til LLM'er:

- SGT-oprettelse – Holdet, der træner den grundlæggende LLM-grundmodel (udbydere af proprietære LLM'er, cloud-tjenesteudbydere eller enterprise ML-teams, der skaber deres egne LLM'er) kører Protopia AI's Stained Glass SDK-software uden at ændre deres eksisterende praksis for træning og implementering af LLM. Efter at grundmodeltræningen er afsluttet, kører SDK'et som et optimeringspass over sprogmodellen for at beregne SGT. Dette optimeringspas leveres gennem en udvidelse til PyTorch. SDK'et omslutter fundamentmodellen og opdager matematisk en unik Stained Glass Transform for den LLM. Yderligere detaljer om den underliggende matematik kan findes i medfølgende hvidbog. Bemærk, at fordi holdet, der træner LLM selv, også kører Stained Glass SDK, er der ingen eksponering eller afsendelse af modelvægte, der er nødvendige for at dette trin kan gennemføres.

- SGT-frigivelse og -implementering - SGT'en, der er output fra det tidligere optimeringstrin, implementeres som en del af datapipeline, der leverer den trænede LLM. Som beskrevet i det foregående afsnit sidder SGT på virksomhedens klientside.

- SGT-brug – SGT kører på de prompter, der er oprettet af virksomheden og genererer beskyttede prompter, som sendes til den installerede LLM. Dette gør det muligt for virksomheden at bevare ejerskabet til deres følsomme forespørgsler og kontekst. Ved at bruge Protopia AI Stained Glass forlader de ubeskyttede følsomme data ikke virksomhedens websted eller tillidszone.

Du kan bruge Stained Glass SDK til at oprette en SGT på flere måder. For eksempel kan du bruge Stained Glass SDK i selvstyrede maskinlæringsmiljøer (ML) med Amazon Elastic Kubernetes Service (Amazon EKS) til træning og inferencing eller inden for Amazon Elastic Compute Cloud (Amazon EC2) direkte. En anden mulighed er, at den kan køre indenfor Amazon SageMaker at skabe en SGT for en given trænet model. Transformation af input til implementering under inferens fra klienten er uafhængig af den valgte implementeringsimplementering.

Følgende figur illustrerer en mulig implementering i et selvadministreret ML-miljø, hvor træning af en Stained Glass Transform udføres på Amazon EKS.

I denne arbejdsgang oprettes en beholder ved hjælp af Stained Glass SDK og implementeres til Amazon Elastic Container Registry (Amazon ECR). Denne container implementeres derefter på Amazon EKS for at træne en SGT, som er gemt til Amazon Simple Storage Service (Amazon S3). Hvis du bruger Amazon EC2, kan du træne en transformation direkte på din instans som en del af din ML-opsætning. Stained Glass SDK kan køre på en række forskellige instanstyper, herunder Amazon P5, P4 eller G5 instansfamilier, baseret på dine grundlæggende LLM-krav. Efter at LLM er implementeret til at blive brugt til inferens, bruger klientapplikationen den oprettede SGT, som er en letvægtsoperation, til at transformere prompter og kontekst, før de sendes til LLM. Ved at gøre dette eksponeres kun transformerede data for LLM, og ejerskabet af det originale input bibeholdes på klientsiden.

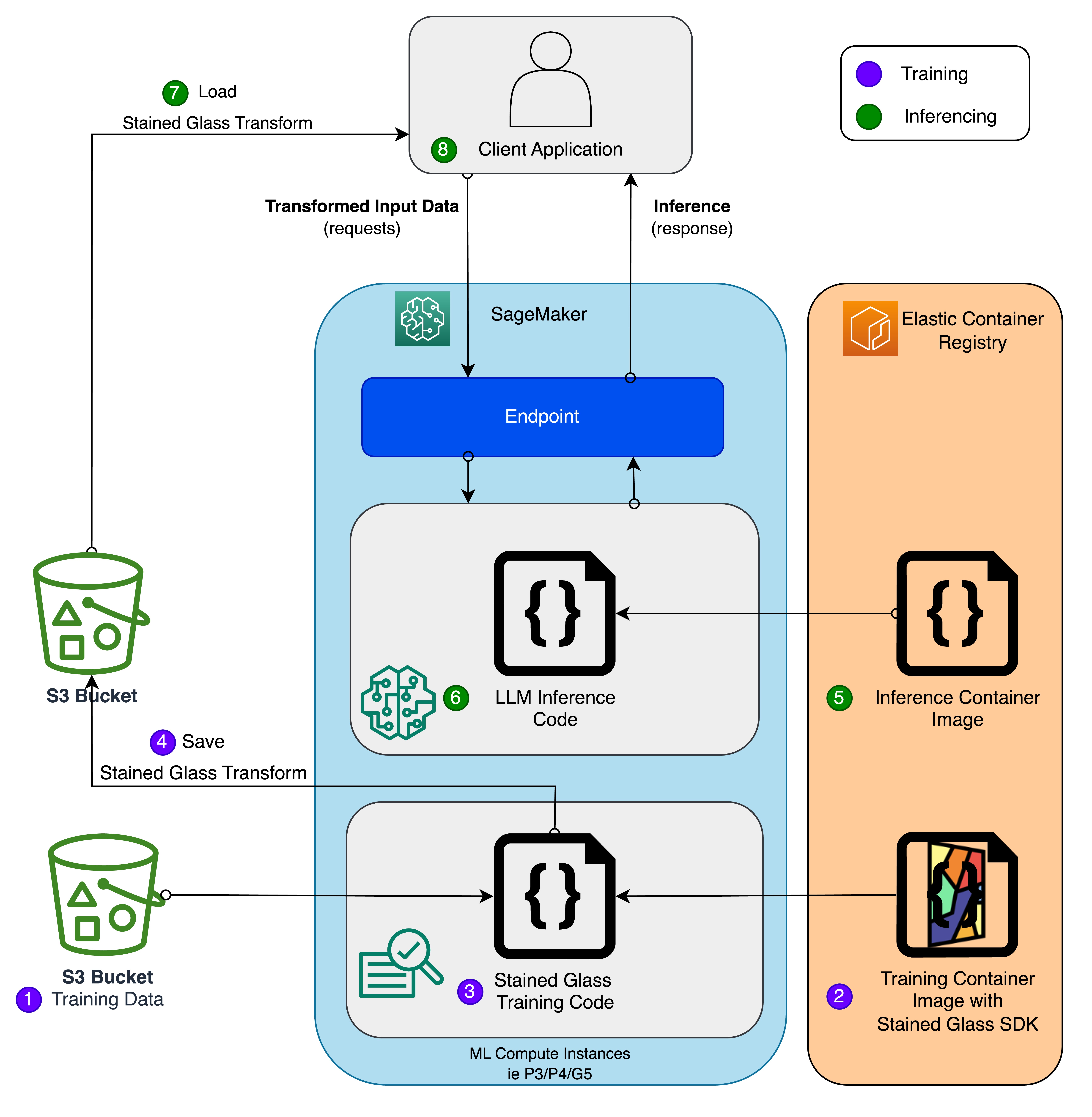

Følgende figur viser, hvordan du kan træne en transformation og køre inferencing på SageMaker.

Oprettelsen af SGT følger en lignende vej som Amazon EKS-opsætningen ved at indtage træningsdataene fra Amazon S3, træne en SGT på en container og gemme den i Amazon S3. Du kan bruge Stained Glass SDK i din eksisterende SageMaker-opsætning med Amazon SageMaker Studio, SageMaker notesbøgerOg en SageMaker træningsjob. LLM hostes som et SageMaker-slutpunkt, der er tilgængeligt af klientapplikationen. Konklusionen for klientapplikationen er også identisk med Amazon EKS-opsætningen, bortset fra det, der tjener modellen.

Randomiserede genrepræsentationer for at beskytte LLM-prompter og finjustere data

Dette afsnit dækker en række forskellige use cases, der viser, hvordan randomiseret re-repræsentation beskytter LLM-prompter. Eksemplerne illustrerer store implikationer for virksomhedens generative AI-indsats: åbning af nye døre til AI-brugstilfælde, accelerering af hastigheden til markedet, mens virksomhedens data beskyttes ordentligt, og bevaring af ejerskabet af de følsomme data, der kræves til brug i LLM-prompts.

RAG use case

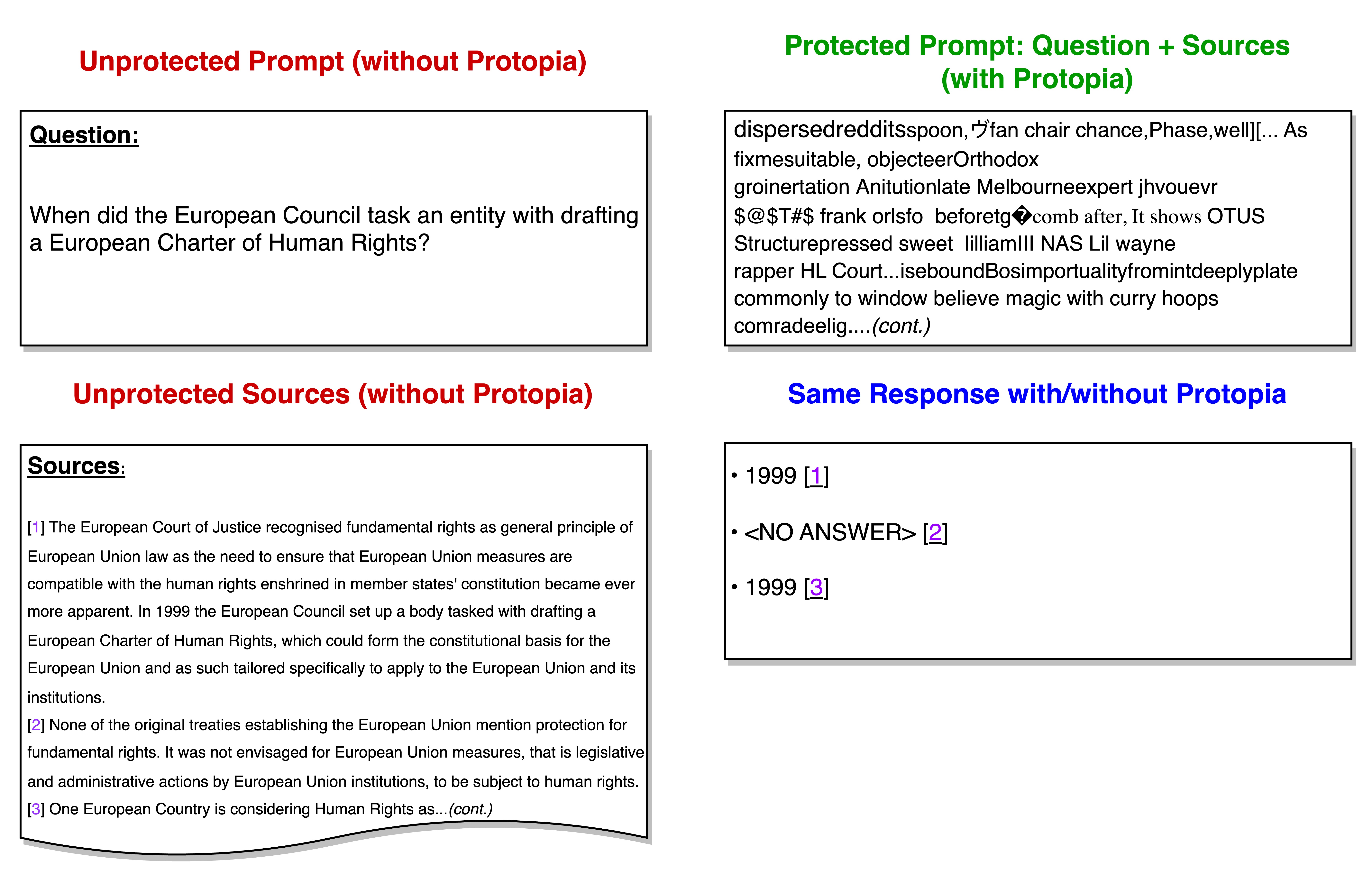

Et populært enterprise use case for LLM'er er Retrieval Augmented Generation (RAG). Følgende figur viser et illustrativt eksempel, hvor meddelelserne og kilderne er beskyttet med farvet glas. Den venstre side af figuren viser de ubeskyttede prompter og kildeoplysninger. I en virksomhedsimplementering af RAG kan kilderne omfatte følsomme oplysninger såsom virksomhedens forretningshemmeligheder, intellektuel ejendomsret eller finansielle oplysninger. Den højre side viser den bedst mulige rekonstruktion i menneskelig læsbar tekst fra RmoRed-prompts oprettet af SGT.

Vi kan konstatere, at selv i den bedst mulige rekonstruktion er informationen fuldstændig tilsløret. Svaret fra modellen med og uden transformationen er dog det samme, med henvisninger til de originale kildedokumenter, hvilket bevarer nøjagtigheden af både spørgsmålet og kildedokumenterne, mens denne populære virksomhedsbrug udføres.

Bred anvendelighed på tværs af LLM'er og sprog

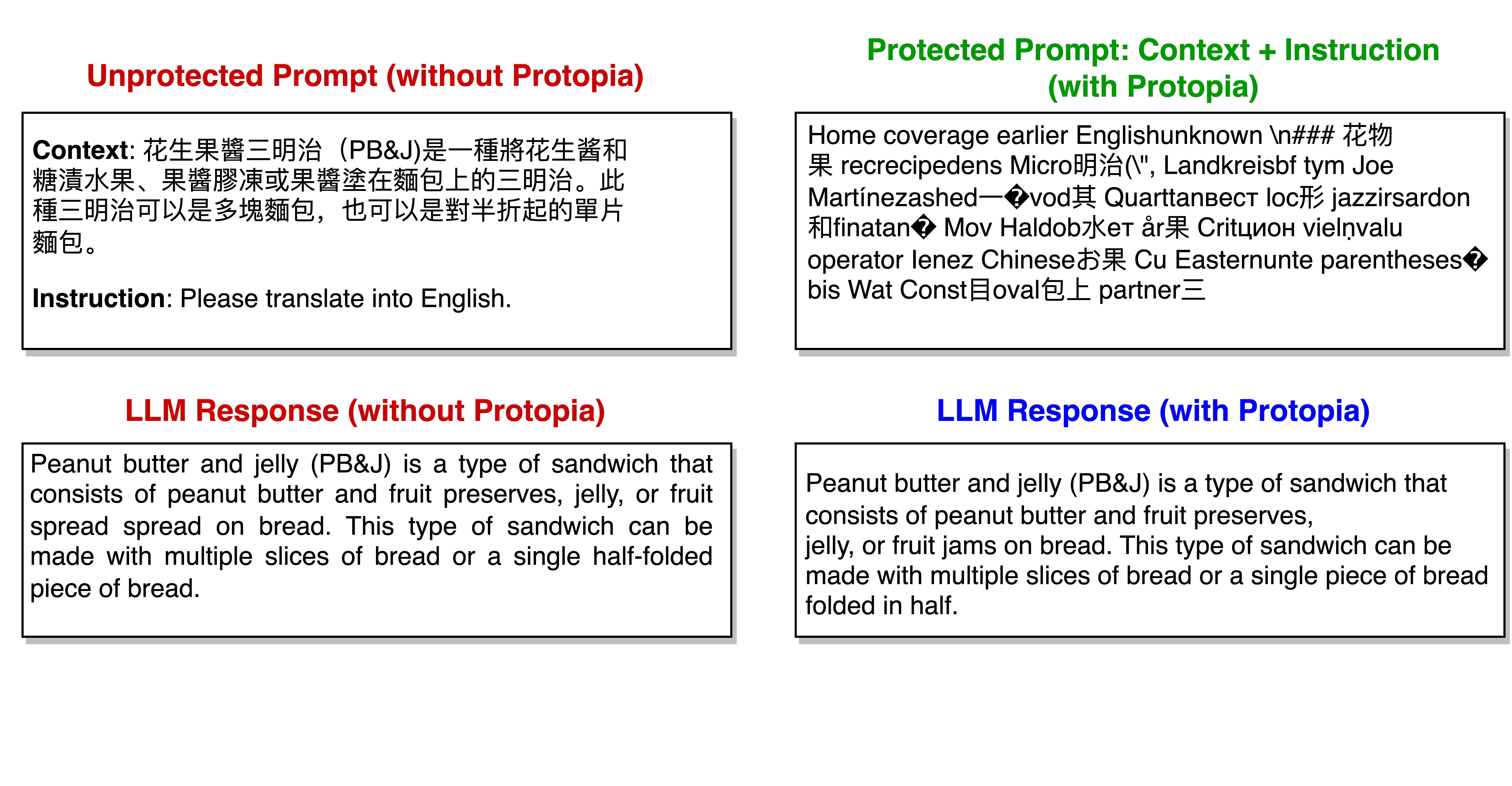

Et af højdepunkterne ved Stained Glass SDK er, at det er meget modstandsdygtigt over for modelfremskridt og kan tilpasses til avancerede modeller som f.eks. Lama 2. Følgende figur viser en SGT, der blev oprettet på en Llama 2 LLM, der tidligere var finjusteret til at arbejde med japansk tekst. Dette eksempel illustrerer yderligere, at SGT'er kan oprettes og anvendes til ethvert sprog, og at selv input til finjusterede modeller kan transformeres. Den generelle anvendelighed af SGT er drevet af, at det robuste fundament af Stained Glass SDK er model- og dataagnostisk.

Beskyttelse af finjusteringsdata samt prompter

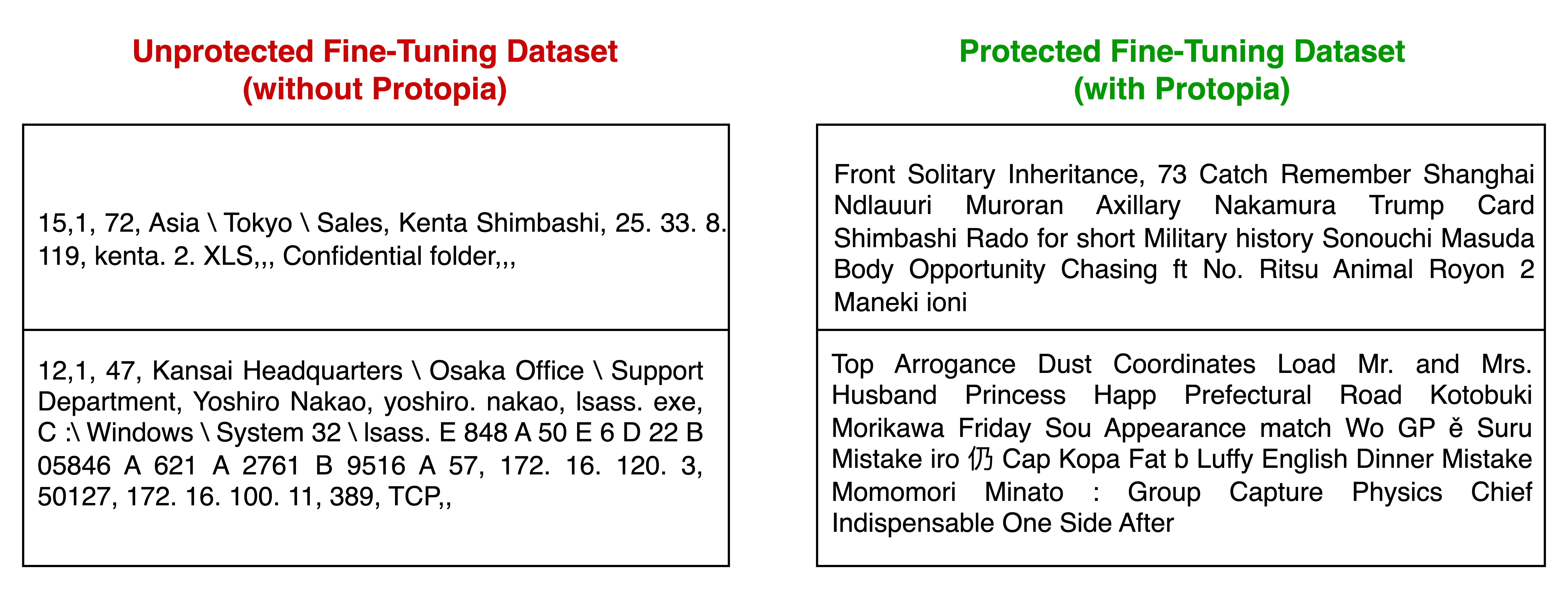

Stained Glass Transform er ikke begrænset udelukkende til at beskytte data på inferenstidspunktet; det kan også beskytte data, der bruges til at finjustere en fundamentmodel. Processen til at skabe transformationen til finjustering af datasæt er den samme som forklaret i løsningsarkitekturafsnittet tidligere i dette indlæg. Transformationen er skabt til, at fundamentmodellen kan finjusteres uden adgang til finjusteringsdataene. Efter at SGT er blevet oprettet og trænet til fundamentmodellen, transformeres finjusteringsdatasættet til randomiserede genrepræsentationer, som derefter vil blive brugt til at finjustere fundamentmodellen. Denne proces er forklaret mere detaljeret i medfølgende hvidbog.

I det følgende eksempel skulle en virksomhedskunde finjustere en eksisterende model til registrering af anomalier i netværkslog. De brugte Stained Glass til at transformere det følsomme finjusteringsdatasæt til randomiserede indlejringer, som blev brugt til at finjustere deres fundamentmodel. De fandt, at detektionsmodellen, der blev finjusteret på de transformerede repræsentationer, udførte med næsten identisk nøjagtighed sammenlignet med det hypotetiske scenarie med finjustering af fundamentmodellen på det ubeskyttede finjusteringsdatasæt. Følgende tabel viser to eksempler på almindelige tekstdataposter fra finjusteringsdatasættet og en rekonstruktion til tekst af de samme dataposter fra finjusteringsdatasættet.

Under hætten af Stained Glass Transform til LLM'er

Når det anvendes til computervision, fungerer SGT på inputpixelfunktioner, og for LLM'er fungerer det på indlejringsniveauet. For at fremhæve, hvordan Stained Glass Transform fungerer, skal du forestille dig de prompte indlejringer som en matrix, som illustreret til venstre i følgende figur. I hver post er der en deterministisk værdi. Denne værdi kan tilknyttes de originale data, hvilket afslører den ubeskyttede prompt. Stained Glass Transform konverterer denne matrix af deterministiske værdier til en matrix, hvis elementer er en sky af muligheder.

Den transformerede prompt gengives ved at sample støj fra sandsynlighedsfordelinger defineret af SGT og tilføje den samplede støj til de deterministiske indlejringer, hvilket randomiserer de oprindelige promptværdier irreversibelt. Modellen forstår stadig den randomiserede re-repræsenterede prompt på det matematiske niveau og kan udføre sin opgave nøjagtigt.

Konklusion

Dette indlæg diskuterede, hvordan Protopia AI's Stained Glass Transform afkobler ejerskab af rådata og beskyttelse fra ML-driftsprocessen, hvilket gør det muligt for virksomheder at bevare ejerskabet og bevare privatlivets fred for følsomme oplysninger i LLM-prompts og finjustere data. Ved at bruge denne avancerede databeskyttelse til LLM-brug kan virksomheder accelerere overtagelsen af fundamentmodeller og LLM'er ved at bekymre sig mindre om eksponering af følsomme oplysninger. Ved sikkert at låse op for værdien i ægte virksomhedsdata kan organisationer muliggøre de lovede effektiviteter og forretningsresultater af LLM'er mere effektivt og hurtigt. For at lære mere om denne teknologi, kan du finde yderligere læsning i medfølgende hvidbog , forbinde med Protopia AI for at få adgang og prøve det på dine virksomhedsdata.

Om Protopia AI

Protopia AI er førende inden for databeskyttelse og privatlivsbevarende AI/ML-teknologier baseret i Austin, Texas, og har specialiseret sig i at gøre det muligt for AI-algoritmer og softwareplatforme at fungere uden behov for at få adgang til almindelig tekstinformation. I løbet af de sidste 2 år har Protopia AI med succes demonstreret sit flagskib Stained Glass Transform-produkt på tværs af en række ML-brugssager og datatyper med den amerikanske flåde, førende finansielle tjenester og globale teknologiudbydere.

Protopia AI arbejder med virksomheder, generative AI- og LLM-udbydere og Cloud Service Providers (CSP'er) for at muliggøre opretholdelse af ejerskab og fortrolighed af virksomhedsdata, mens du bruger AI/ML-løsninger. Protopia AI har indgået partnerskab med AWS for at levere en kritisk komponent af databeskyttelse og ejerskab til virksomhedens indførelse af generativ AI, og var en af 21 startups udvalgt til åbningen AWS Generative AI Accelerator i 2023.

Om forfatterne

Balaji Chandrasekaran er VP for Go-to-Market & Customer Enablement hos Protopia AI, arbejder tæt sammen med kunder for at udnytte AI i deres forretning, mens de prioriterer databeskyttelse og privatliv. Før Protopia AI var Balaji Product Lead for AI Solutions hos Infor, der udviklede værdicentrerede produkter, mens han fungerede som en betroet partner for virksomhedskunder på tværs af forskellige brancher. Uden for arbejdet nyder han musik, vandreture og at rejse med familien.

Balaji Chandrasekaran er VP for Go-to-Market & Customer Enablement hos Protopia AI, arbejder tæt sammen med kunder for at udnytte AI i deres forretning, mens de prioriterer databeskyttelse og privatliv. Før Protopia AI var Balaji Product Lead for AI Solutions hos Infor, der udviklede værdicentrerede produkter, mens han fungerede som en betroet partner for virksomhedskunder på tværs af forskellige brancher. Uden for arbejdet nyder han musik, vandreture og at rejse med familien.

Jennifer Cwagenberg leder ingeniørteamet hos Protopia AI og arbejder for at sikre, at Stained Glass-teknologien opfylder deres kunders behov for at beskytte deres data. Jennifer har tidligere erfaring med sikkerhedsarbejde hos Toyota i deres Product Cybersecurity Group, administration af Cloud-arbejdsbelastninger hos N-able og ansvarlig for data hos Match.com.

Jennifer Cwagenberg leder ingeniørteamet hos Protopia AI og arbejder for at sikre, at Stained Glass-teknologien opfylder deres kunders behov for at beskytte deres data. Jennifer har tidligere erfaring med sikkerhedsarbejde hos Toyota i deres Product Cybersecurity Group, administration af Cloud-arbejdsbelastninger hos N-able og ansvarlig for data hos Match.com.

Andrew Sansom er AI Solutions Engineer hos Protopia AI, hvor han hjælper virksomheder med at bruge AI og samtidig bevare private og følsomme oplysninger i deres data. Før Protopia AI arbejdede han som teknisk konsulent med fokus på at muliggøre AI-løsninger for kunder på tværs af mange brancher, herunder finans, fremstilling, sundhedspleje og uddannelse. Han underviste også i datalogi og matematik til gymnasie-, universitets- og professionelle studerende.

Andrew Sansom er AI Solutions Engineer hos Protopia AI, hvor han hjælper virksomheder med at bruge AI og samtidig bevare private og følsomme oplysninger i deres data. Før Protopia AI arbejdede han som teknisk konsulent med fokus på at muliggøre AI-løsninger for kunder på tværs af mange brancher, herunder finans, fremstilling, sundhedspleje og uddannelse. Han underviste også i datalogi og matematik til gymnasie-, universitets- og professionelle studerende.

Eiman Ebrahimi, PhD, er medstifter og administrerende direktør for Protopia AI. Dr. Ebrahimi brænder for at gøre det muligt for kunstig intelligens at berige den menneskelige oplevelse på tværs af forskellige samfunds- og industrivertikaler. Protopia AI er en vision om at forbedre linsen, hvorigennem AI observerer de nødvendige og kvalitetsdata, den har brug for, samtidig med at der skabes nye muligheder til at beskytte følsomme oplysninger. Før Protopia AI var han seniorforsker hos NVIDIA i 9 år. Hans arbejde hos NVIDIA research havde til formål at løse problemer med at få adgang til massive datasæt i ML/AI. Han var også medforfatter til peer-reviewede publikationer om, hvordan man udnytter kraften i tusindvis af GPU'er til at gøre træning af store sprogmodeller mulig.

Eiman Ebrahimi, PhD, er medstifter og administrerende direktør for Protopia AI. Dr. Ebrahimi brænder for at gøre det muligt for kunstig intelligens at berige den menneskelige oplevelse på tværs af forskellige samfunds- og industrivertikaler. Protopia AI er en vision om at forbedre linsen, hvorigennem AI observerer de nødvendige og kvalitetsdata, den har brug for, samtidig med at der skabes nye muligheder til at beskytte følsomme oplysninger. Før Protopia AI var han seniorforsker hos NVIDIA i 9 år. Hans arbejde hos NVIDIA research havde til formål at løse problemer med at få adgang til massive datasæt i ML/AI. Han var også medforfatter til peer-reviewede publikationer om, hvordan man udnytter kraften i tusindvis af GPU'er til at gøre træning af store sprogmodeller mulig.

Rohit Talluri er Generative AI GTM Specialist hos Amazon Web Services (AWS). Han samarbejder med topgenerative AI-modelbyggere, strategiske kunder, vigtige AI/ML-partnere og AWS Service Teams for at muliggøre den næste generation af kunstig intelligens, machine learning og accelereret computing på AWS. Han var tidligere Enterprise Solutions Architect og Global Solutions Lead for AWS Mergers & Acquisitions Advisory.

Rohit Talluri er Generative AI GTM Specialist hos Amazon Web Services (AWS). Han samarbejder med topgenerative AI-modelbyggere, strategiske kunder, vigtige AI/ML-partnere og AWS Service Teams for at muliggøre den næste generation af kunstig intelligens, machine learning og accelereret computing på AWS. Han var tidligere Enterprise Solutions Architect og Global Solutions Lead for AWS Mergers & Acquisitions Advisory.

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk dig selv. Adgang her.

- PlatoAiStream. Web3 intelligens. Viden forstærket. Adgang her.

- PlatoESG. Kulstof, CleanTech, Energi, Miljø, Solenergi, Affaldshåndtering. Adgang her.

- PlatoHealth. Bioteknologiske og kliniske forsøgs intelligens. Adgang her.

- Kilde: https://aws.amazon.com/blogs/machine-learning/foundational-data-protection-for-enterprise-llm-acceleration-with-protopia-ai/

- :har

- :er

- :ikke

- :hvor

- 100

- 1040

- 7

- 9

- a

- Om

- over

- fremskynde

- accelereret

- accelererende

- acceleration

- accelerator

- adgang

- tilgængelig

- Adgang

- nøjagtighed

- præcist

- opkøb

- tværs

- handler

- tilføje

- Vedtagelse

- fremskridt

- Fordel

- rådgivende

- Efter

- mod

- AI

- ai use cases

- AI / ML

- Rettet

- algoritmer

- Alle

- tillader

- næsten

- også

- Amazon

- Amazon EC2

- Amazon Web Services

- Amazon Web Services (AWS)

- an

- ,

- Andrew

- afsløring af anomalier

- En anden

- enhver

- Anvendelse

- anvendt

- Anvendelse

- arkitektur

- ER

- kunstig

- kunstig intelligens

- AS

- spørge

- forbundet

- At

- augmented

- austin

- til rådighed

- AWS

- balaji

- bund

- baseret

- Baseline

- grundlæggende

- BE

- fordi

- været

- før

- være

- BEDSTE

- Beyond

- både

- Bund

- Pause

- bygherrer

- virksomhed

- virksomheder

- by

- kaldet

- CAN

- kapaciteter

- bære

- tilfælde

- tilfælde

- udfordringer

- skiftende

- chef

- Administrerende direktør

- administrerende direktør

- valgt

- kunde

- kunder

- nøje

- Cloud

- Medstifter

- samarbejde

- KOM

- Fælles

- sammenlignet

- konkurrencedygtig

- fuldføre

- Afsluttet

- fuldstændig

- Compliance

- komponent

- Compute

- computer

- Datalogi

- Computer Vision

- computing

- pågældende

- Bekymringer

- sikker

- fortrolighed

- konsulent

- Container

- sammenhæng

- kontrol

- konvertering af

- korrigere

- kunne

- Dækker

- skabe

- oprettet

- Oprettelse af

- skabelse

- kritisk

- kunde

- Kunder

- Cybersecurity

- data

- data lækket

- datastyring

- databeskyttelse

- databeskyttelse

- datasæt

- Beslutningstagning

- definerede

- levere

- leveret

- demonstreret

- demonstrerer

- demonstrerer

- indsat

- implementering

- implementering

- beskrevet

- konstrueret

- detail

- detaljer

- Detektion

- udvikling

- forskellige

- direkte

- opdager

- drøftet

- Distributioner

- forskelligartede

- dokumentet

- dokumenter

- gør

- gør

- døre

- ned

- dr

- drevet

- i løbet af

- hver

- tidligere

- Uddannelse

- effektivitet

- effektivitet

- effektivitet

- effektiv

- effektivt

- indsats

- elementer

- indlejring

- smergel

- muliggøre

- aktivering

- muliggør

- muliggør

- Endpoint

- ingeniør

- Engineering

- styrke

- berige

- sikre

- sikring

- Enterprise

- virksomhedens adoption

- virksomheds sikkerhed

- virksomheder

- indrejse

- Miljø

- miljøer

- især

- Essensen

- evaluering

- Endog

- eksempel

- eksempler

- Undtagen

- udøvende

- Executive Officer

- eksisterende

- erfaring

- forklarede

- udsat

- Eksponering

- udvidelse

- familier

- familie

- gennemførlig

- Funktionalitet

- Figur

- finansiere

- finansielle

- økonomisk information

- finansielle tjenesteydelser

- Finde

- flagskib

- fokuserede

- efter

- følger

- Til

- fundet

- Foundation

- grundlæggende

- fra

- fuld

- funktion

- yderligere

- Generelt

- generere

- genereret

- genererer

- generation

- generative

- Generativ AI

- få

- given

- glas

- Global

- Gå-på-marked

- GPU'er

- gruppe

- garantier

- Have

- he

- sundhedspleje

- hjælper

- Høj

- Fremhæv

- højdepunkter

- stærkt

- hans

- holistisk

- hætte

- hostede

- Hvordan

- How To

- Men

- HTML

- HTTPS

- menneskelig

- Menneskelig erfaring

- Hybrid

- identisk

- if

- illustrere

- illustrerer

- billede

- KIMOs Succeshistorier

- implementering

- implikationer

- forbedring

- in

- tiltrædelsesforelæsning

- omfatter

- Herunder

- uafhængig

- industrier

- industrien

- oplysninger

- indgang

- indgange

- instans

- i stedet

- integreret

- intellektuel

- intellektuel ejendomsret

- Intelligens

- ind

- involverede

- IT

- ITS

- selv

- japansk

- Jennifer

- jpg

- Nøgle

- Sprog

- stor

- senere

- lag

- føre

- leder

- førende

- LÆR

- læring

- Forlade

- til venstre

- Politikker

- mindre

- Niveau

- Leverage

- Bibliotek

- letvægt

- ligesom

- GRÆNSE

- Limited

- grænser

- lidt

- Llama

- LLM

- lokalt

- log

- maskine

- machine learning

- vedligeholde

- Vedligeholdelse

- større

- lave

- ledelse

- styring

- Produktion

- mange

- Marked

- massive

- Match

- matematik

- matematiske

- matematisk

- Matrix

- Kan..

- opfylder

- fusioner

- Fusioner og erhvervelser

- Meta

- mindste

- ML

- model

- modeller

- mere

- flere

- Musik

- N-i stand

- navn

- nødvendig

- Behov

- behov

- behøve

- behov

- netværk

- Ny

- næste

- ingen

- Støj

- Bemærk

- roman

- Nvidia

- observere

- Observerer

- of

- Officer

- kontorer

- tit

- on

- ONE

- kun

- åbning

- betjene

- opererer

- drift

- drift

- Produktion

- optimering

- Option

- Indstillinger

- or

- organisation

- organisationer

- original

- Andet

- ud

- udfald

- konturer

- output

- udgange

- uden for

- i løbet af

- Overvind

- egen

- ejer

- ejerskab

- del

- partner

- partnerskab

- partnering

- partnere

- passerer

- lidenskabelige

- forbi

- sti

- peer-reviewed

- udføres

- udfører

- phd

- Søjle

- pipeline

- pixel

- Almindeligt

- Platforme

- plato

- Platon Data Intelligence

- PlatoData

- Populær

- muligheder

- mulig

- Indlæg

- magt

- vigtigste

- praksis

- bevare

- tidligere

- tidligere

- Forud

- prioritering

- Beskyttelse af personlige oplysninger

- private

- problemer

- behandle

- Produkt

- Produkter

- professionel

- lovede

- prompter

- korrekt

- ejendom

- proprietære

- beskytte

- beskyttet

- beskyttelse

- beskyttelse

- beskytter

- give

- udbyder

- udbydere

- giver

- publikationer

- pytorch

- kvalitet

- forespørgsler

- spørgsmål

- hurtigt

- Tilfældigt

- hurtigt

- Raw

- Læsning

- ægte

- optegnelser

- benævnt

- reguleret

- frigive

- afsmeltet

- repræsentation

- påkrævet

- krav

- Krav

- forskning

- elastisk

- Ressourcer

- svar

- ansvarlige

- resultere

- tilbageholde

- tilbageholdende

- tilbageholdelse

- højre

- robust

- rødder

- Kør

- kører

- løber

- varetagelse

- sikkert

- sikrere

- sagemaker

- samme

- gemt

- besparelse

- Scale

- scenarie

- Skole

- Videnskab

- Videnskabsmand

- SDK

- hemmeligheder

- Sektion

- sikker

- sikkerhed

- Søg

- valgt

- send

- afsendelse

- senior

- følsom

- sendt

- tjeneste

- Tjenesteudbyder

- service-udøvere

- Tjenester

- servering

- setup

- vist

- Shows

- side

- lignende

- Simpelt

- websted

- sidder

- langsom

- So

- samfundsmæssigt

- Software

- Alene

- løsninger

- Løsninger

- SOLVE

- Løser

- Kilde

- Kilder

- specialist

- specialiseret

- hastighed

- interessenter

- Nystartede

- state-of-the-art

- Trin

- Steps

- Stadig

- opbevaring

- Strategisk

- struktureret

- Studerende

- Succesfuld

- sådan

- opsummere

- bord

- Tag

- mål

- Opgaver

- opgaver

- undervist

- hold

- hold

- Teknisk

- Teknologier

- Teknologier

- Texas

- tekst

- at

- oplysninger

- deres

- Them

- derefter

- Der.

- derved

- Disse

- de

- denne

- dem

- tusinder

- Gennem

- tid

- til

- tolerance

- værktøjer

- top

- toyota

- handle

- Tog

- uddannet

- Kurser

- tog

- Transform

- Transformation

- omdannet

- omdanne

- Traveling

- Stol

- betroet

- betroet partner

- prøv

- to

- typer

- underliggende

- forstår

- enestående

- enheder

- universitet

- oplåsning

- us

- Brug

- brug

- brug tilfælde

- anvendte

- bruger

- ved brug af

- udnytte

- værdi

- Værdier

- række

- forskellige

- vertikaler

- meget

- visning

- vision

- visuel

- vp

- ønsker

- var

- Vej..

- måder

- we

- web

- webservices

- GODT

- var

- Hvad

- Hvad er

- hvornår

- som

- mens

- hvis

- vilje

- med

- inden for

- uden

- Arbejde

- arbejdede

- workflow

- arbejder

- virker

- bekymrende

- ville

- skriftlig

- år

- Du

- Din

- zephyrnet