At skabe skalerbare og effektive maskinlæringspipelines (ML) er afgørende for at strømline udviklingen, implementeringen og styringen af ML-modeller. I dette indlæg præsenterer vi en ramme til automatisering af oprettelsen af en rettet acyklisk graf (DAG) for Amazon SageMaker Pipelines baseret på simple konfigurationsfiler. Det rammekode og eksempler præsenteret her dækker kun modeltræningspipelines, men kan også let udvides til batch-inferensrørledninger.

Denne dynamiske ramme bruger konfigurationsfiler til at orkestrere forbehandlings-, trænings-, evaluerings- og registreringstrin for både enkeltmodel- og multimodelbrugssager baseret på brugerdefinerede Python-scripts, infrastrukturbehov (inklusive Amazon Virtual Private Cloud (Amazon VPC) undernet og sikkerhedsgrupper, AWS identitets- og adgangsstyring (IAM) roller, AWS Key Management Service (AWS KMS) nøgler, containerregister og instanstyper), input og output Amazon Simple Storage Service (Amazon S3) stier og ressourcemærker. Konfigurationsfiler (YAML og JSON) giver ML-udøvere mulighed for at specificere udifferentieret kode til orkestrering af træningspipelines ved hjælp af deklarativ syntaks. Dette gør det muligt for datavidenskabsfolk hurtigt at bygge og iterere på ML-modeller og giver ML-ingeniører mulighed for at køre gennem kontinuerlig integration og kontinuerlig levering (CI/CD) ML-pipelines hurtigere, hvilket reducerer tid til produktion for modeller.

Løsningsoversigt

Den foreslåede rammekode starter med at læse konfigurationsfilerne. Det opretter derefter dynamisk en SageMaker Pipelines DAG baseret på de trin, der er erklæret i konfigurationsfilerne, og interaktionerne og afhængighederne mellem trin. Denne orkestreringsramme henvender sig til både single-model og multi-model use cases og giver et jævnt flow af data og processer. Følgende er de vigtigste fordele ved denne løsning:

- Automation – Hele ML-arbejdsgangen, fra dataforbehandling til modelregistrering, er orkestreret uden manuel indgriben. Dette reducerer den tid og indsats, der kræves til modeleksperimentering og operationalisering.

- Reproducerbarhed – Med en foruddefineret konfigurationsfil kan dataforskere og ML-ingeniører reproducere hele arbejdsgangen og opnå ensartede resultater på tværs af flere kørsler og miljøer.

- Skalerbarhed - Amazon SageMaker bruges i hele pipelinen, hvilket gør det muligt for ML-praktikere at behandle store datasæt og træne komplekse modeller uden infrastrukturproblemer.

- Fleksibilitet – Rammen er fleksibel og kan rumme en bred vifte af ML use cases, ML frameworks (såsom XGBoost og TensorFlow), multi-model træning og multi-step træning. Hvert trin i trænings-DAG kan tilpasses via konfigurationsfilen.

- Modelstyring - Den Amazon SageMaker Model Registry integration giver mulighed for at spore modelversioner og derfor fremme dem til produktion med tillid.

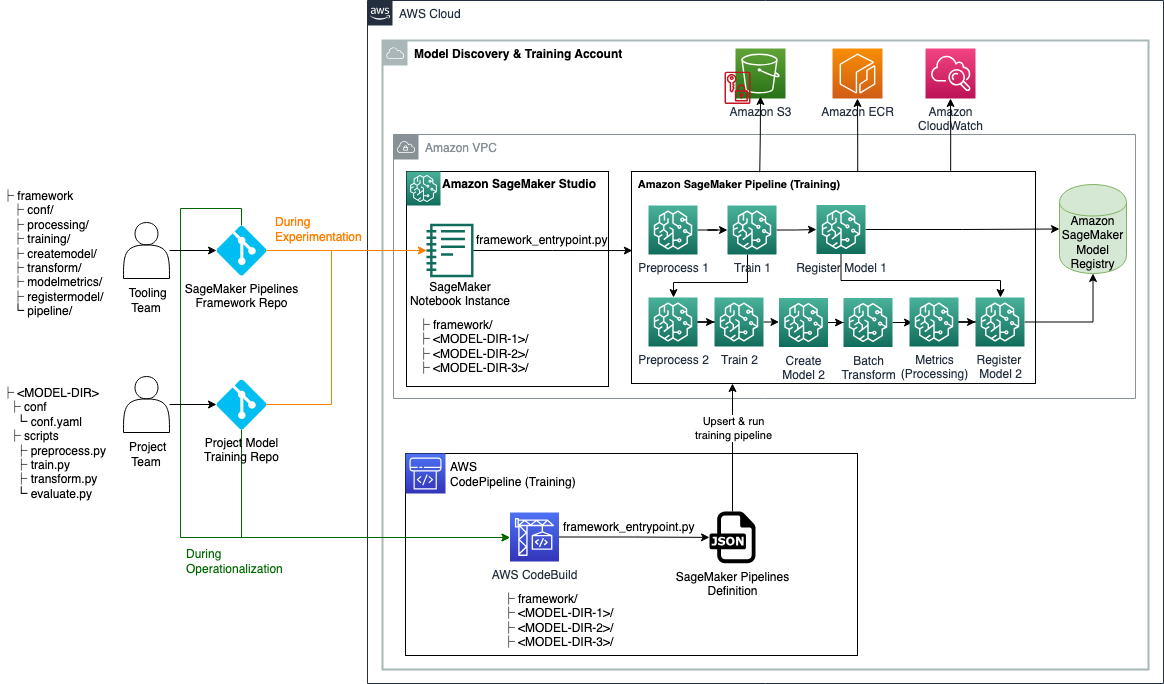

Følgende arkitekturdiagram viser, hvordan du kan bruge den foreslåede ramme under både eksperimentering og operationalisering af ML-modeller. Under eksperimenter kan du klone det rammekodelager, der er angivet i dette indlæg og dine projektspecifikke kildekodelagre til Amazon SageMaker Studio, og indstil dit virtuelle miljø (detaljeret senere i dette indlæg). Du kan derefter gentage forbehandlings-, trænings- og evalueringsscripts samt konfigurationsvalg. For at oprette og afvikle en SageMaker Pipelines trænings-DAG kan du kalde rammens indgangspunkt, som vil læse alle konfigurationsfilerne, oprette de nødvendige trin og orkestrere dem baseret på den specificerede trinrækkefølge og afhængigheder.

Under operationalisering kloner CI-pipelinen rammekodelageret og projektspecifikke træningslagre til et AWS CodeBuild job, hvor rammens entry point script kaldes for at oprette eller opdatere SageMaker Pipelines trænings-DAG, og derefter køre den.

Depotstruktur

GitHub repository indeholder følgende mapper og filer:

- /framework/conf/ – Denne mappe indeholder en konfigurationsfil, der bruges til at indstille fælles variabler på tværs af alle modelleringsenheder, såsom undernet, sikkerhedsgrupper og IAM-rolle under kørsel. En modelleringsenhed er en sekvens på op til seks trin til træning af en ML-model.

- /framework/createmodel/ – Denne mappe indeholder et Python-script, der opretter en SageMaker model objekt baseret på modelartefakter fra en SageMaker Pipelines træningstrin. Modelobjektet bruges senere i en SageMaker batch transformation job til at evaluere modellens ydeevne på et testsæt.

- /framework/modelmetrics/ – Denne mappe indeholder et Python-script, der opretter en Amazon SageMaker-behandling job til at generere en modelmetrik JSON-rapport for en trænet model baseret på resultaterne af et SageMaker batch-transformationsjob udført på testdata.

- /framework/pipeline/ – Denne mappe indeholder Python-scripts, der bruger Python-klasser defineret i andre framework-mapper til at oprette eller opdatere en SageMaker Pipelines DAG baseret på de angivne konfigurationer. Model_unit.py-scriptet bruges af pipeline_service.py til at oprette en eller flere modelleringsenheder. Hver modelleringsenhed er en sekvens på op til seks trin til træning af en ML-model: proces, træne, skabe model, transformere, metrikker og registermodel. Konfigurationer for hver modelleringsenhed skal specificeres i modellens respektive lager. Pipeline_service.py indstiller også afhængigheder blandt SageMaker Pipelines-trin (hvordan trin inden for og på tværs af modelleringsenheder sekvenseres eller kædes) baseret på sagemakerPipeline-sektionen, som skal defineres i konfigurationsfilen for et af modellagrene (ankermodellen). Dette giver dig mulighed for at tilsidesætte standardafhængigheder udledt af SageMaker Pipelines. Vi diskuterer konfigurationsfilstrukturen senere i dette indlæg.

- /framework/processing/ – Denne mappe indeholder et Python-script, der opretter et SageMaker Processing-job baseret på det angivne Docker-billede og indgangs-script.

- /ramme/registermodel/ – Denne mappe indeholder et Python-script til registrering af en trænet model sammen med dens beregnede metrics i SageMaker Model Registry.

- /ramme/træning/ – Denne mappe indeholder et Python-script, der opretter et SageMaker-træningsjob.

- /framework/transform/ – Denne mappe indeholder et Python-script, der opretter et SageMaker batch-transformationsjob. I forbindelse med modeltræning bruges dette til at beregne præstationsmetrikken for en trænet model på testdata.

- /ramme/hjælpeprogrammer/ – Denne mappe indeholder hjælpescripts til læsning og tilslutning af konfigurationsfiler samt logning.

- /framework_entrypoint.py – Denne fil er indgangspunktet for rammekoden. Den kalder en funktion defineret i mappen /framework/pipeline/ for at oprette eller opdatere en SageMaker Pipelines DAG og køre den.

- /eksempler/ – Denne mappe indeholder flere eksempler på, hvordan du kan bruge denne automatiseringsramme til at skabe enkle og komplekse trænings-DAG'er.

- /env.env – Denne fil giver dig mulighed for at indstille almindelige variabler såsom undernet, sikkerhedsgrupper og IAM-rolle som miljøvariable.

- /requirements.txt – Denne fil specificerer Python-biblioteker, der kræves til rammekoden.

Forudsætninger

Du bør have følgende forudsætninger, før du implementerer denne løsning:

- En AWS-konto

- SageMaker Studio

- En SageMaker-rolle med Amazon S3 læse/skrive og AWS KMS kryptere/dekryptere tilladelser

- En S3-bøtte til lagring af data, scripts og modelartefakter

- Eventuelt AWS kommandolinjegrænseflade (AWS CLI)

- Python3 (Python 3.7 eller nyere) og følgende Python-pakker:

- boto3

- sagemaker

- PyYAML

- Yderligere Python-pakker brugt i dine brugerdefinerede scripts

Implementer løsningen

Udfør følgende trin for at implementere løsningen:

- Organiser dit modeltræningslager i henhold til følgende struktur:

- Klon rammekoden og din modelkildekode fra Git-lagrene:

-

- Klon

dynamic-sagemaker-pipelines-frameworkrepo i en træningsmappe. I den følgende kode antager vi, at træningsmappen kaldesaws-train: - Klon modellens kildekode under den samme mappe. For multi-model træning, gentag dette trin for så mange modeller, som du har brug for at træne.

- Klon

For enkeltmodeltræning skal dit bibliotek se sådan ud:

For multi-model træning skal din mappe se ud som følgende:

- Opsæt følgende miljøvariabler. Stjerner angiver miljøvariabler, der er påkrævet; resten er valgfrit.

| Miljøvariabel | Beskrivelse |

SMP_ACCOUNTID* |

AWS-konto, hvor SageMaker-pipelinen køres |

SMP_REGION* |

AWS-region, hvor SageMaker-pipelinen køres |

SMP_S3BUCKETNAME* |

S3 spand navn |

SMP_ROLE* |

SageMaker rolle |

SMP_MODEL_CONFIGPATH* |

Relativ sti til konfigurationsfilerne for enkelt- eller flermodeller |

SMP_SUBNETS |

Undernet-id'er til SageMaker-netværkskonfiguration |

SMP_SECURITYGROUPS |

Sikkerhedsgruppe-id'er til SageMaker-netværkskonfiguration |

Til tilfælde af enkeltmodelbrug, SMP_MODEL_CONFIGPATH vil være <MODEL-DIR>/conf/conf.yaml. For multi-model brugssager, SMP_MODEL_CONFIGPATH vil være */conf/conf.yaml, som giver dig mulighed for at finde alle conf.yaml filer ved hjælp af Pythons glob-modul og kombiner dem til en global konfigurationsfil. Under eksperimentering (lokal test) kan du angive miljøvariabler inde i filen env.env og derefter eksportere dem ved at køre følgende kommando i din terminal:

Bemærk, at værdierne af miljøvariabler i env.env skal placeres inden for anførselstegn (f.eks. SMP_REGION="us-east-1"). Under operationalisering bør disse miljøvariabler indstilles af CI-pipelinen.

- Opret og aktiver et virtuelt miljø ved at køre følgende kommandoer:

- Installer de nødvendige Python-pakker ved at køre følgende kommando:

- Rediger din modeltræning

conf.yamlfiler. Vi diskuterer konfigurationsfilstrukturen i næste afsnit. - Ring fra terminalen til rammens indgangspunkt for at oprette eller opdatere og køre SageMaker Pipeline-trænings-DAG:

- Se og fejlfind SageMaker Pipelines, der kører på Rørledninger fanen i SageMaker Studio UI.

Konfigurationsfilstruktur

Der er to typer konfigurationsfiler i den foreslåede løsning: rammekonfiguration og modelkonfiguration. I dette afsnit beskriver vi hver enkelt i detaljer.

Rammekonfiguration

/framework/conf/conf.yaml fil indstiller de variabler, der er fælles på tværs af alle modelleringsenheder. Dette inkluderer SMP_S3BUCKETNAME, SMP_ROLE, SMP_MODEL_CONFIGPATH, SMP_SUBNETS, SMP_SECURITYGROUPSog SMP_MODELNAME. Se trin 3 i installationsinstruktionerne for beskrivelser af disse variabler, og hvordan du indstiller dem via miljøvariabler.

Model konfiguration

For hver model i projektet skal vi specificere følgende i <MODEL-DIR>/conf/conf.yaml fil (stjerner angiver nødvendige sektioner; resten er valgfri):

- /conf/models* – I dette afsnit kan du konfigurere en eller flere modelleringsenheder. Når rammekoden køres, vil den automatisk læse alle konfigurationsfiler under kørsel og tilføje dem til konfigurationstræet. Teoretisk kan du angive alle modelleringsenheder i samme

conf.yamlfil, men det anbefales at specificere hver modelleringsenhedskonfiguration i dens respektive mappe eller Git-lager for at minimere fejl. Enhederne er som følger:- {model-name}* – Modellens navn.

- kildemappe* - En fælles

source_dirsti til brug for alle trin i modelleringsenheden. - forproces – Dette afsnit specificerer forbehandlingsparametre.

- tog* – Dette afsnit specificerer træningsjobparametre.

- transformere* – Dette afsnit specificerer SageMaker Transform-jobparametre til at lave forudsigelser på testdataene.

- evaluere – Dette afsnit specificerer SageMaker Processing-jobparametre til generering af en modelmetrik JSON-rapport for den trænede model.

- register* – Dette afsnit specificerer parametre for registrering af den trænede model i SageMaker Model Registry.

- /conf/sagemakerPipeline* – Dette afsnit definerer SageMaker Pipelines flow, herunder afhængigheder mellem trin. For enkeltmodelbrug er dette afsnit defineret i slutningen af konfigurationsfilen. For multi-model brugssager

sagemakerPipelinesektionen skal kun defineres i konfigurationsfilen for en af modellerne (enhver af modellerne). Vi omtaler denne model som anker model. Parametrene er som følger:- pipelineName* – Navnet på SageMaker-pipelinen.

- modeller* – Indlejret liste over modelleringsenheder:

- {model-name}* – Model-id, som skal matche en {model-name}-id i /conf/models-sektionen.

- skridt* -

- step_name* – Trinnavnet skal vises i SageMaker Pipelines DAG.

- step_class* – (Union[Processing, Training, CreateModel, Transform, Metrics, RegisterModel])

- step_type* – Denne parameter er kun nødvendig for forbehandlingstrin, for hvilke den skal indstilles til forbehandling. Dette er nødvendigt for at skelne mellem forproces og evaluere trin, som begge har en

step_classaf forarbejdning. - enable_cache – ([Union[True, False]]). Dette angiver, om der skal aktiveres SageMaker Pipelines caching for dette trin.

- chain_input_source_step – ([liste[trinnavn]]). Du kan bruge dette til at indstille kanaludgangene for et andet trin som input til dette trin.

- chain_input_additional_prefix – Dette er kun tilladt for trin i transformationen

step_class, og kan bruges sammen medchain_input_source_stepparameter for at udpege den fil, der skal bruges som input til transformationstrinnet.

- skridt* -

- {model-name}* – Model-id, som skal matche en {model-name}-id i /conf/models-sektionen.

- afhængigheder – Dette afsnit specificerer den rækkefølge, som SageMaker Pipelines-trinene skal køres i. Vi har tilpasset Apache Airflow-notationen til dette afsnit (f.eks.

{step_name} >> {step_name}). Hvis denne sektion efterlades tom, er eksplicitte afhængigheder angivet afchain_input_source_stepparameter eller implicitte afhængigheder definerer SageMaker Pipelines DAG-flowet.

Bemærk, at vi anbefaler at have ét træningstrin pr. modelleringsenhed. Hvis der er defineret flere træningstrin for en modelleringsenhed, tager de efterfølgende trin implicit det sidste træningstrin for at oprette modelobjektet, beregne metrikker og registrere modellen. Hvis du har brug for at træne flere modeller, anbefales det at oprette flere modelleringsenheder.

Eksempler

I dette afsnit demonstrerer vi tre eksempler på ML-modeltrænings-DAG'er oprettet ved hjælp af den præsenterede ramme.

Enkeltmodel træning: LightGBM

Dette er et enkelt-model eksempel for en klassifikation use case, hvor vi bruger LightGBM i script-tilstand på SageMaker. Det datasæt består af kategoriske og numeriske variabler til at forudsige den binære etiket Omsætning (for at forudsige, om emnet foretager et køb eller ej). Det forbehandling af script bruges til at modellere dataene til træning og test og derefter placere den i en S3-spand. S3-stierne leveres derefter til træningstrin i konfigurationsfilen.

Når træningstrinnet kører, indlæser SageMaker filen på containeren kl /opt/ml/input/data/{channelName}/, tilgængelig via miljøvariablen SM_CHANNEL_{channelName} på beholderen (channelName= 'tog' eller 'test').Det træningsscript gør følgende:

- Indlæs filerne lokalt fra lokale containerstier ved hjælp af NumPy belastning modul.

- Indstil hyperparametre for træningsalgoritmen.

- Gem den trænede model på den lokale containersti

/opt/ml/model/.

SageMaker tager indholdet under /opt/ml/model/ for at skabe en tarball, der bruges til at implementere modellen til SageMaker til hosting.

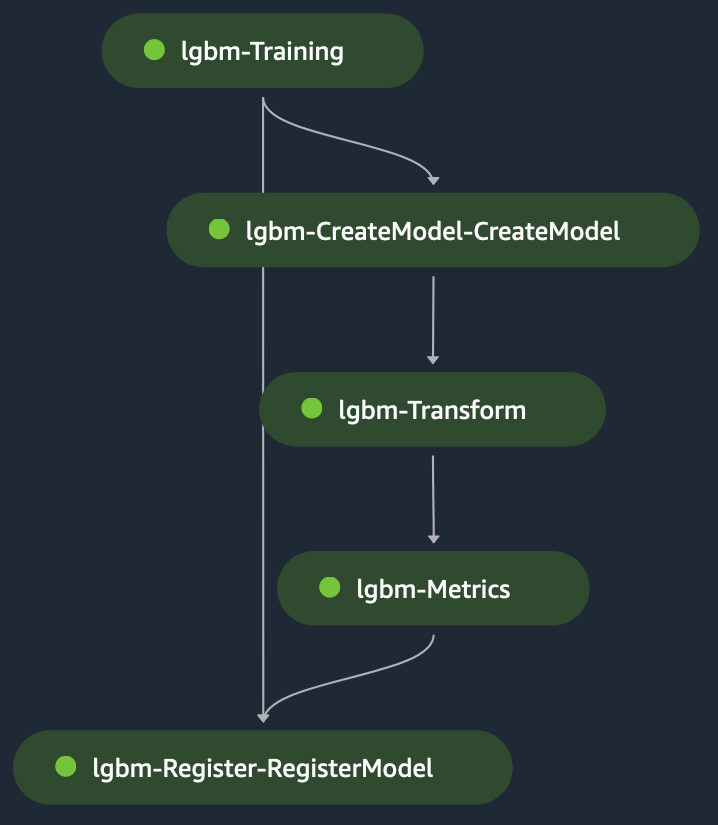

Transformeringstrinnet tager som input det iscenesatte testfil som input og den trænede model til at lave forudsigelser på den trænede model. Outputtet af transformationstrinnet er lænket til metric-trinnet for at evaluere modellen i forhold til grundsandhed, som eksplicit leveres til metric-trinnet. Til sidst kædes outputtet fra metriktrinnet implicit til registertrinnet for at registrere modellen i SageMaker Model Registry med information om modellens ydeevne produceret i metriktrinnet. Følgende figur viser en visuel gengivelse af trænings-DAG. Du kan henvise til scripts og konfigurationsfilen for dette eksempel i GitHub repo.

Enkeltmodel træning: LLM finjustering

Dette er endnu et enkelt-model træningseksempel, hvor vi orkestrerer finjustering af en Falcon-40B large language model (LLM) fra Hugging Face Hub til en tekstopsummering brugssag. Det forbehandling af script indlæser samsum datasæt fra Hugging Face, indlæser tokenizeren til modellen og behandler tog-/testdataopdelingerne for at finjustere modellen på disse domænedata i falcon-text-summarization-preprocess-trinnet.

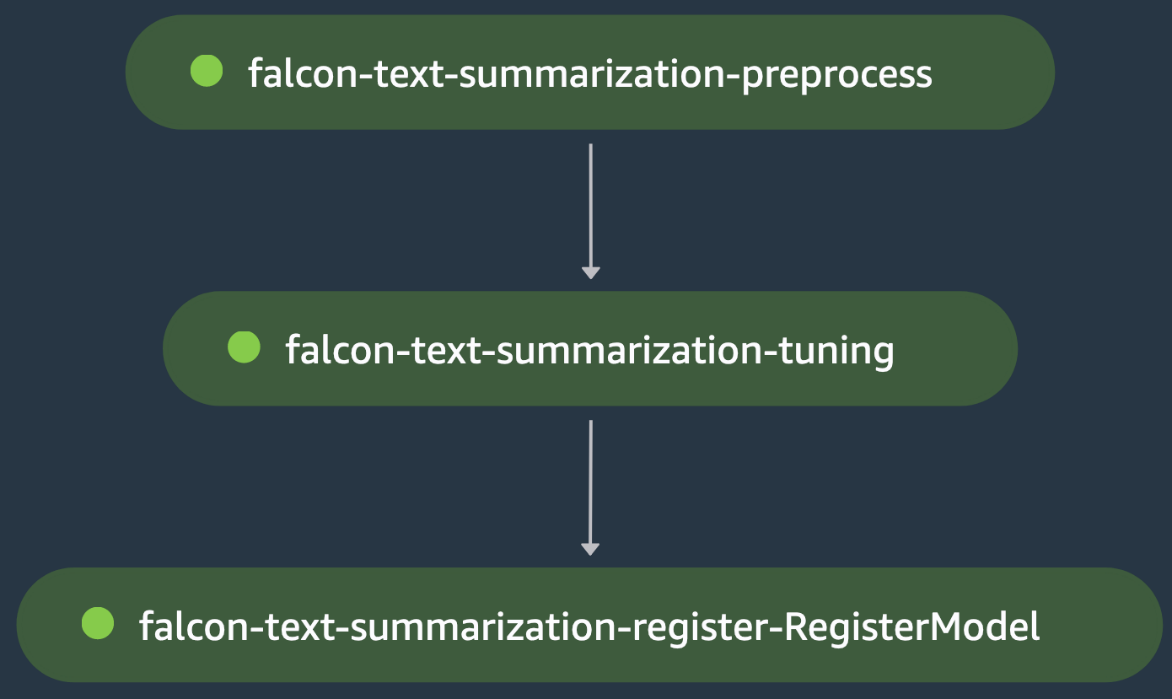

Outputtet er lænket til falke-tekst-opsummering-tuning-trinnet, hvor træningsscript indlæser Falcon-40B LLM fra Hugging Face Hub og starter accelereret finjustering vha. LoRA på toget split. Modellen evalueres i samme trin efter finjustering, som gatekeepers evalueringstabet til at mislykkes falcon-text-summarization-tuning-trinnet, hvilket får SageMaker-pipelinen til at stoppe, før den er i stand til at registrere den finjusterede model. Ellers kører falcon-text-summarization-tuning-trinnet med succes, og modellen registreres i SageMaker Model Registry. Følgende figur viser en visuel repræsentation af LLM-finindstillings-DAG. Scripts og konfigurationsfil for dette eksempel er tilgængelige i GitHub repo.

Multimodel træning

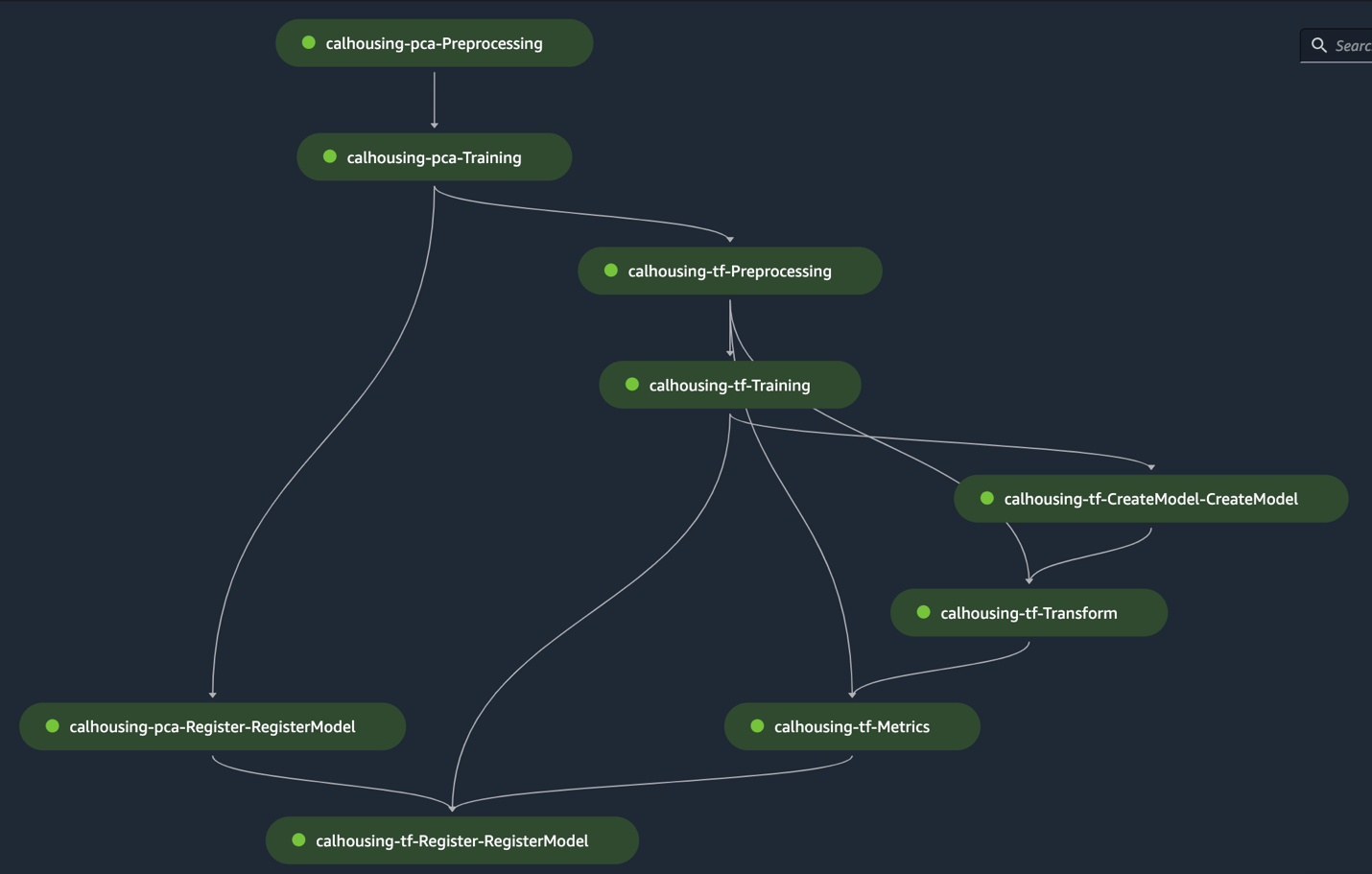

Dette er et multi-model træningseksempel, hvor en principal component analyse (PCA) model trænes til dimensionsreduktion, og en TensorFlow Multilayer Perceptron model trænes til Californiens boligpris forudsigelse. TensorFlow-modellens forbehandlingstrin bruger en trænet PCA-model til at reducere dimensionaliteten af dens træningsdata. Vi tilføjer en afhængighed i konfigurationen for at sikre, at TensorFlow-modellen er registreret efter PCA-modelregistrering. Følgende figur viser en visuel repræsentation af multi-model trænings DAG-eksemplet. Scripts og konfigurationsfiler til dette eksempel er tilgængelige i GitHub repo.

Ryd op

Udfør følgende trin for at rydde op i dine ressourcer:

- Brug AWS CLI til liste , Fjern eventuelle resterende pipelines, der er oprettet af Python-scripts.

- Slet eventuelt andre AWS-ressourcer, såsom S3-bøtten eller IAM-rollen, der er oprettet uden for SageMaker Pipelines.

Konklusion

I dette indlæg præsenterede vi en ramme til automatisering af SageMaker Pipelines DAG-oprettelse baseret på konfigurationsfiler. Den foreslåede ramme tilbyder en fremadskuende løsning på udfordringen med at orkestrere komplekse ML-arbejdsbelastninger. Ved at bruge en konfigurationsfil giver SageMaker Pipelines fleksibiliteten til at bygge orkestrering med minimal kode, så du kan strømline processen med at skabe og administrere både enkelt- og multimodel-pipelines. Denne tilgang sparer ikke kun tid og ressourcer, men fremmer også MLOps bedste praksis, hvilket bidrager til den overordnede succes for ML-initiativer. For flere oplysninger om implementeringsdetaljer, se GitHub repo.

Om forfatterne

Luis Felipe Yepez Barrios, er en Machine Learning Engineer med AWS Professional Services, fokuseret på skalerbare distribuerede systemer og automatiseringsværktøjer for at fremskynde videnskabelig innovation inden for Machine Learning (ML). Desuden hjælper han virksomhedskunder med at optimere deres maskinlæringsløsninger gennem AWS-tjenester.

Luis Felipe Yepez Barrios, er en Machine Learning Engineer med AWS Professional Services, fokuseret på skalerbare distribuerede systemer og automatiseringsværktøjer for at fremskynde videnskabelig innovation inden for Machine Learning (ML). Desuden hjælper han virksomhedskunder med at optimere deres maskinlæringsløsninger gennem AWS-tjenester.

Jinzhao Feng, er maskinlæringsingeniør hos AWS Professional Services. Han fokuserer på arkitektur og implementering af generative AI-løsninger og klassiske ML-pipeline-løsninger i stor skala. Han er specialiseret i FMOps, LLMOps og distribueret træning.

Jinzhao Feng, er maskinlæringsingeniør hos AWS Professional Services. Han fokuserer på arkitektur og implementering af generative AI-løsninger og klassiske ML-pipeline-løsninger i stor skala. Han er specialiseret i FMOps, LLMOps og distribueret træning.

Barske Asnani, er maskinlæringsingeniør hos AWS. Hans baggrund er i Applied Data Science med fokus på operationalisering af Machine Learning-arbejdsbelastninger i skyen i stor skala.

Barske Asnani, er maskinlæringsingeniør hos AWS. Hans baggrund er i Applied Data Science med fokus på operationalisering af Machine Learning-arbejdsbelastninger i skyen i stor skala.

Hasan Shojaei, er Sr. Data Scientist med AWS Professional Services, hvor han hjælper kunder på tværs af forskellige brancher med at løse deres forretningsmæssige udfordringer gennem brug af big data, machine learning og cloud-teknologier. Forud for denne rolle ledede Hasan flere initiativer til at udvikle nye fysikbaserede og datadrevne modelleringsteknikker til topenergiselskaber. Uden for arbejdet brænder Hasan for bøger, vandreture, fotografering og historie.

Hasan Shojaei, er Sr. Data Scientist med AWS Professional Services, hvor han hjælper kunder på tværs af forskellige brancher med at løse deres forretningsmæssige udfordringer gennem brug af big data, machine learning og cloud-teknologier. Forud for denne rolle ledede Hasan flere initiativer til at udvikle nye fysikbaserede og datadrevne modelleringsteknikker til topenergiselskaber. Uden for arbejdet brænder Hasan for bøger, vandreture, fotografering og historie.

Alec Jenab, er en Machine Learning Engineer, der har specialiseret sig i at udvikle og operationalisere maskinlæringsløsninger i stor skala til virksomhedskunder. Alec brænder for at bringe innovative løsninger til markedet, især inden for områder, hvor maskinlæring på en meningsfuld måde kan forbedre slutbrugeroplevelsen. Uden for arbejdet nyder han at spille basketball, snowboarde og opdage skjulte perler i San Francisco.

Alec Jenab, er en Machine Learning Engineer, der har specialiseret sig i at udvikle og operationalisere maskinlæringsløsninger i stor skala til virksomhedskunder. Alec brænder for at bringe innovative løsninger til markedet, især inden for områder, hvor maskinlæring på en meningsfuld måde kan forbedre slutbrugeroplevelsen. Uden for arbejdet nyder han at spille basketball, snowboarde og opdage skjulte perler i San Francisco.

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk dig selv. Adgang her.

- PlatoAiStream. Web3 intelligens. Viden forstærket. Adgang her.

- PlatoESG. Kulstof, CleanTech, Energi, Miljø, Solenergi, Affaldshåndtering. Adgang her.

- PlatoHealth. Bioteknologiske og kliniske forsøgs intelligens. Adgang her.

- Kilde: https://aws.amazon.com/blogs/machine-learning/automate-amazon-sagemaker-pipelines-dag-creation/

- :er

- :ikke

- :hvor

- $OP

- 120

- 160

- 7

- 8

- 9

- a

- I stand

- Om

- accelereret

- adgang

- tilgængelig

- imødekomme

- Ifølge

- Konto

- opnå

- tværs

- aktivere

- acykliske

- tilføje

- Efter

- mod

- AI

- algoritme

- Alle

- tillade

- tilladt

- tillader

- sammen

- også

- Amazon

- Amazon SageMaker

- Amazon SageMaker Pipelines

- Amazon Web Services

- blandt

- an

- analyse

- Anchor

- ,

- En anden

- enhver

- Apache

- anvendt

- tilgang

- arkitektur

- ER

- områder

- AS

- hjælper

- antage

- At

- automatisere

- automatisk

- Automatisering

- Automation

- til rådighed

- AWS

- AWS Professional Services

- baggrund

- baseret

- Basketball

- BE

- før

- fordele

- BEDSTE

- bedste praksis

- Big

- Big data

- Bøger

- både

- Bringe

- bygge

- virksomhed

- men

- by

- beregne

- beregnet

- ringe

- kaldet

- Opkald

- CAN

- tilfælde

- tilfælde

- gearet

- årsager

- lænket

- udfordre

- udfordringer

- Kanal

- valg

- klasser

- klassificering

- ren

- cli

- kunder

- Cloud

- kode

- kombinerer

- Fælles

- Virksomheder

- komplekse

- komponent

- Bekymringer

- tillid

- Konfiguration

- sammenholdt

- konsekvent

- består

- Container

- Beholdere

- indeholder

- indhold

- sammenhæng

- kontinuerlig

- bidrager

- dæksel

- skabe

- oprettet

- skaber

- Oprettelse af

- skabelse

- afgørende

- skik

- Kunder

- tilpassede

- DAG

- data

- datalogi

- dataforsker

- datastyret

- datasæt

- erklærede

- Standard

- definere

- definerede

- definerer

- levering

- demonstrere

- afhængigheder

- Afhængighed

- indsætte

- implementering

- implementering

- beskrive

- detail

- detaljeret

- detaljer

- udvikle

- udvikling

- Udvikling

- diagram

- forskellige

- rettet

- mapper

- Vejviser

- opdage

- diskutere

- vises

- skelne

- distribueret

- distribuerede systemer

- distribueret træning

- Docker

- gør

- domæne

- i løbet af

- dynamisk

- dynamisk

- hver

- effektiv

- indsats

- bemyndiger

- muliggøre

- muliggør

- muliggør

- ende

- energi

- ingeniør

- Ingeniører

- sikre

- Enterprise

- Hele

- indrejse

- Miljø

- miljøer

- fejl

- især

- evaluere

- evalueret

- evaluere

- evaluering

- Hver

- eksempel

- eksempler

- fremskynde

- erfaring

- udtrykkeligt

- eksport

- udvidet

- Ansigtet

- FAIL

- falsk

- hurtigere

- felt

- Figur

- File (Felt)

- Filer

- Endelig

- Finde

- Fleksibilitet

- fleksibel

- flow

- Fokus

- fokuserede

- fokuserer

- efter

- følger

- Til

- formular

- fremadrettet

- Framework

- rammer

- Francisco

- fra

- funktion

- Endvidere

- generere

- generative

- Generativ AI

- Git

- Global

- regeringsførelse

- graf

- større

- gruppe

- Gruppens

- Have

- have

- he

- hjælper

- link.

- Skjult

- hans

- historie

- Hosting

- boliger

- Hvordan

- How To

- HTML

- http

- HTTPS

- Hub

- identifikator

- Identity

- id'er

- if

- billede

- implementering

- gennemføre

- Forbedre

- in

- I andre

- omfatter

- Herunder

- angiver

- angiver

- industrier

- udledte

- oplysninger

- Infrastruktur

- initiativer

- Innovation

- innovativ

- indgang

- indvendig

- installere

- instans

- anvisninger

- integration

- interaktioner

- indgriben

- ind

- IT

- ITS

- Job

- sammenføjning

- jpg

- json

- Nøgle

- nøgler

- etiket

- Sprog

- stor

- Efternavn

- senere

- læring

- Led

- til venstre

- biblioteker

- ligesom

- Line (linje)

- Liste

- LLM

- belastning

- belastninger

- lokale

- lokalt

- logning

- Se

- ligner

- off

- maskine

- machine learning

- lave

- maerker

- Making

- ledelse

- styring

- manuel

- mange

- Marked

- Match

- metrisk

- Metrics

- mindste

- minimere

- ML

- MLOps

- tilstand

- model

- modellering

- modeller

- Moduler

- mere

- flere

- navn

- nødvendig

- Behov

- behov

- behov

- netværk

- næste

- ingen

- roman

- objekt

- of

- Tilbud

- on

- ONE

- kun

- optimering

- or

- orkestreret

- orkestrering

- orkestrering

- Andet

- Ellers

- output

- udgange

- uden for

- samlet

- overstyring

- pakker

- parameter

- parametre

- lidenskabelige

- sti

- stier

- per

- ydeevne

- udføres

- fotografering

- pipeline

- plato

- Platon Data Intelligence

- PlatoData

- spiller

- Punkt

- Indlæg

- praksis

- foruddefineret

- forudsige

- Forudsigelser

- forudsætninger

- præsentere

- forelagt

- pris

- Main

- Forud

- private

- behandle

- Processer

- forarbejdning

- produceret

- produktion

- professionel

- projekt

- fremmer

- Fremme

- foreslog

- forudsat

- giver

- køb

- Python

- hurtigt

- rækkevidde

- Læs

- let

- Læsning

- anbefaler

- anbefales

- reducere

- reducerer

- reduktion

- henvise

- region

- register

- registreret

- registrering

- Registrering

- register

- resterende

- gentag

- indberette

- Repository

- repræsentation

- påkrævet

- Krav

- ressource

- Ressourcer

- dem

- REST

- Resultater

- indtægter

- gennemgå

- roller

- roller

- Kør

- kører

- løber

- runtime

- sagemaker

- SageMaker Pipelines

- samme

- San

- San Francisco

- skalerbar

- Scale

- Videnskab

- videnskabelig

- Videnskabsmand

- forskere

- script

- scripts

- Sektion

- sektioner

- sikkerhed

- Sequence

- Tjenester

- sæt

- sæt

- flere

- bør

- Shows

- Simpelt

- SIX

- udjævne

- So

- løsninger

- Løsninger

- SOLVE

- Kilde

- kildekode

- specialiserede

- specialiseret

- specificeret

- delt

- splits

- starter

- Trin

- Steps

- Stands

- opbevaring

- lagring

- strømline

- strømlining

- struktur

- Studio

- emne

- undernet

- efterfølgende

- succes

- Succesfuld

- sådan

- tilført

- syntaks

- Systemer

- Tag

- tager

- teknikker

- Teknologier

- tensorflow

- terminal

- prøve

- Test

- tekst

- at

- Registret

- deres

- Them

- derefter

- derfor

- Disse

- denne

- tre

- Gennem

- hele

- tid

- til

- top

- Sporing

- Tog

- uddannet

- Kurser

- Transform

- træ

- sand

- to

- typer

- ui

- under

- enhed

- enheder

- Opdatering

- brug

- brug tilfælde

- anvendte

- Bruger

- Brugererfaring

- bruger

- ved brug af

- nytte

- Værdier

- variabel

- versioner

- via

- Virtual

- visuel

- we

- web

- webservices

- GODT

- hvornår

- hvorvidt

- som

- WHO

- bred

- Bred rækkevidde

- vilje

- med

- inden for

- uden

- Arbejde

- workflow

- XGBoost

- yaml

- Du

- Din

- zephyrnet