I en verden af datadrevet beslutningstagning, tidsserie prognose er nøglen til at gøre det muligt for virksomheder at bruge historiske datamønstre til at forudse fremtidige resultater. Uanset om du arbejder med risikostyring, handel, vejrudsigelse, forudsigelse af energiefterspørgsel, overvågning af vitale tegn eller trafikanalyse, er evnen til at forudsige præcist afgørende for succes.

I disse applikationer kan tidsseriedata have tunghalede distributioner, hvor haler repræsentere ekstreme værdier. Nøjagtig prognose i disse regioner er vigtig for at bestemme, hvor sandsynligt en ekstrem hændelse er, og om der skal slås alarm. Disse outliers påvirker imidlertid estimeringen af basisfordelingen betydeligt, hvilket gør robuste prognoser udfordrende. Finansielle institutioner er afhængige af robuste modeller til at forudsige outliers såsom markedskrak. Inden for energi-, vejr- og sundhedssektorer muliggør nøjagtige prognoser for sjældne, men højeffekthændelser såsom naturkatastrofer og pandemier effektiv planlægning og ressourceallokering. Forsømmelse af haleadfærd kan føre til tab, forpassede muligheder og kompromitteret sikkerhed. Prioritering af nøjagtighed ved halerne hjælper med at føre til pålidelige og handlingsrettede prognoser. I dette indlæg træner vi en robust tidsserieprognosemodel, der er i stand til at fange sådanne ekstreme begivenheder ved hjælp af Amazon SageMaker.

For effektivt at træne denne model, etablerer vi en MLOps-infrastruktur for at strømline modeludviklingsprocessen ved at automatisere dataforbehandling, feature engineering, hyperparameter tuning og modelvalg. Denne automatisering reducerer menneskelige fejl, forbedrer reproducerbarheden og accelererer modeludviklingscyklussen. Med en træningspipeline kan virksomheder effektivt inkorporere nye data og tilpasse deres modeller til skiftende forhold, hvilket er med til at sikre, at prognoser forbliver pålidelige og opdaterede.

Efter at tidsserieprognosemodellen er trænet, giver implementering af den inden for et slutpunkt mulighed for forudsigelse i realtid. Dette giver dig mulighed for at træffe velinformerede og lydhøre beslutninger baseret på de seneste data. Desuden muliggør implementering af modellen i et slutpunkt skalerbarhed, fordi flere brugere og applikationer kan få adgang til og bruge modellen samtidigt. Ved at følge disse trin kan virksomheder udnytte kraften i robuste tidsserieprognoser til at træffe informerede beslutninger og være på forkant i et hurtigt skiftende miljø.

Oversigt over løsning

Denne løsning viser træningen af en tidsserieprognosemodel, der er specielt designet til at håndtere afvigelser og variabilitet i data ved hjælp af en Temporal Convolutional Network (TCN) med en Spliced Binned Pareto (SBP) distribution. For mere information om en multimodal version af denne løsning, se Videnskaben bag NFL Next Gen Stats' nye beståelsesmåling. For yderligere at illustrere effektiviteten af SBP-fordelingen sammenligner vi den med den samme TCN-model, men bruger i stedet en Gauss-fordeling.

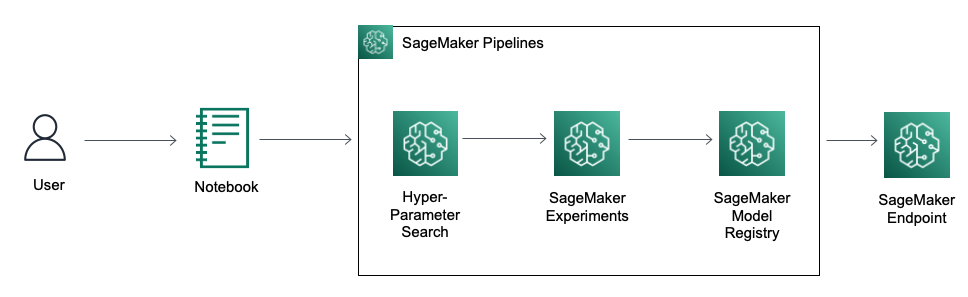

Denne proces drager betydelig fordel af MLOps funktioner af SageMaker, som strømliner datavidenskabens arbejdsgang ved at udnytte den kraftfulde cloud-infrastruktur i AWS. I vores løsning bruger vi Amazon SageMaker Automatisk Model Tuning til hyperparametersøgning, Amazon SageMaker-eksperimenter til styring af eksperimenter, Amazon SageMaker Model Registry at administrere modelversioner, og Amazon SageMaker Pipelines at orkestrere processen. Vi implementerer derefter vores model til et SageMaker-slutpunkt for at opnå forudsigelser i realtid.

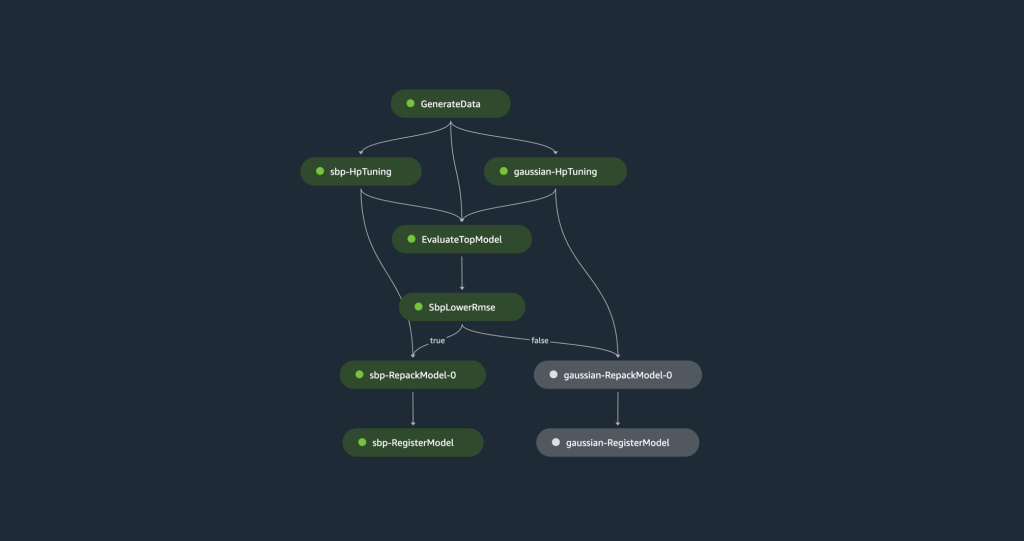

Følgende diagram illustrerer træningspipelinens arkitektur.

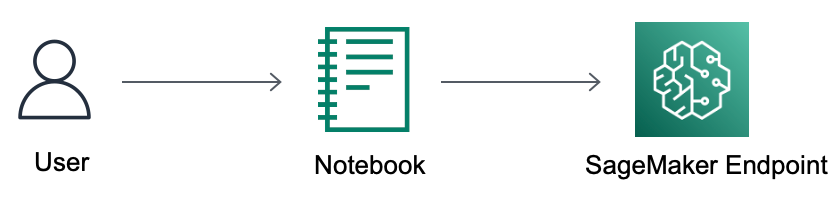

Følgende diagram illustrerer slutningspipelinen.

Du kan finde den komplette kode i GitHub repo. For at implementere løsningen skal du køre cellerne ind SBP_main.ipynb.

Klik her for at åbne AWS-konsollen og følg med.

SageMaker pipeline

SageMaker Pipelines tilbyder en brugervenlig Python SDK at skabe integreret maskinlæring (ML) arbejdsgange. Disse arbejdsgange, repræsenteret som Directed Acyclic Graphs (DAG'er), består af trin med forskellige typer og afhængigheder. Med SageMaker Pipelines kan du strømline ende-til-ende-processen med træning og evaluering af modeller, hvilket øger effektiviteten og reproducerbarheden i dine ML-arbejdsgange.

Træningspipelinen begynder med at generere et syntetisk datasæt, der er opdelt i trænings-, validerings- og testsæt. Træningssættet bruges til at træne to TCN-modeller, hvoraf den ene bruger Splejset Binned-Pareto distribution og den anden anvender Gaussisk distribution. Begge modeller gennemgår hyperparameterjustering ved hjælp af valideringssættet for at optimere hver model. Derefter udføres en evaluering i forhold til testsættet for at bestemme modellen med den laveste rodmiddelkvadratfejl (RMSE). Modellen med den bedste nøjagtighedsmetrik uploades til modelregistret.

Følgende diagram illustrerer pipeline-trinene.

Lad os diskutere trinene mere detaljeret.

Datagenerering

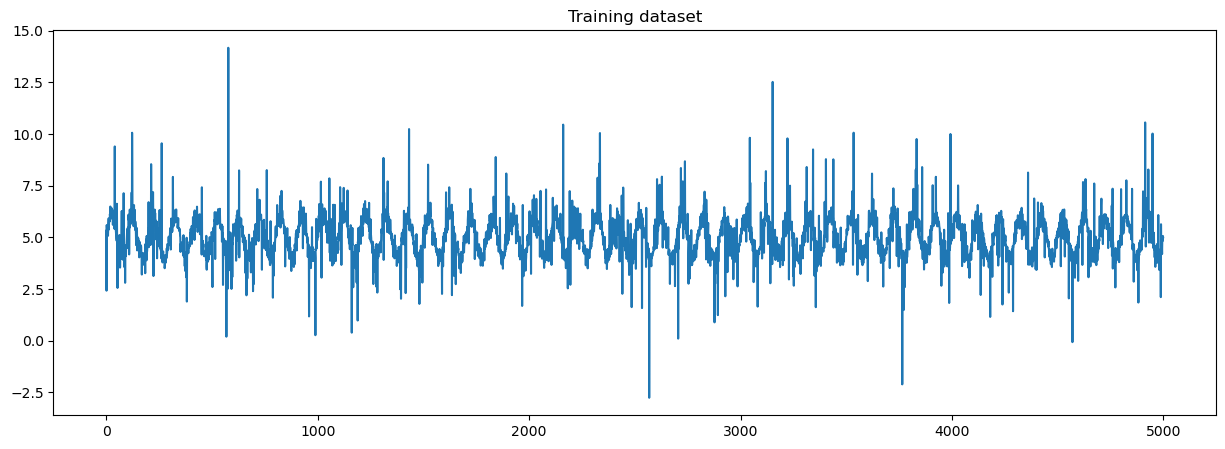

Det første trin i vores pipeline genererer et syntetisk datasæt, som er karakteriseret ved en sinusformet bølgeform og asymmetrisk tunghalestøj. Dataene blev oprettet ved hjælp af en række parametre, såsom frihedsgrader, en støjmultiplikator og en skalaparameter. Disse elementer påvirker formen af datafordelingen, modulerer den tilfældige variabilitet i vores data og justerer spredningen af vores datadistribution.

Dette databehandlingsjob udføres ved hjælp af en PyTorchProcessor, som kører PyTorch-kode (gener_data.py) i en container, der administreres af SageMaker. Data og andre relevante artefakter til fejlretning er placeret som standard Amazon Simple Storage Service (Amazon S3)-bøtte tilknyttet SageMaker-kontoen. Logfiler for hvert trin i pipelinen kan findes i amazoncloudwatch.

Følgende figur er et eksempel på de data, der genereres af pipelinen.

Du kan erstatte inputtet med en lang række tidsseriedata, såsom symmetrisk, asymmetrisk, lethalet, tunghalet eller multimodal distribution. Modellens robusthed gør det muligt at anvende den til en bred vifte af tidsserieproblemer, forudsat at tilstrækkelige observationer er tilgængelige.

Model træning

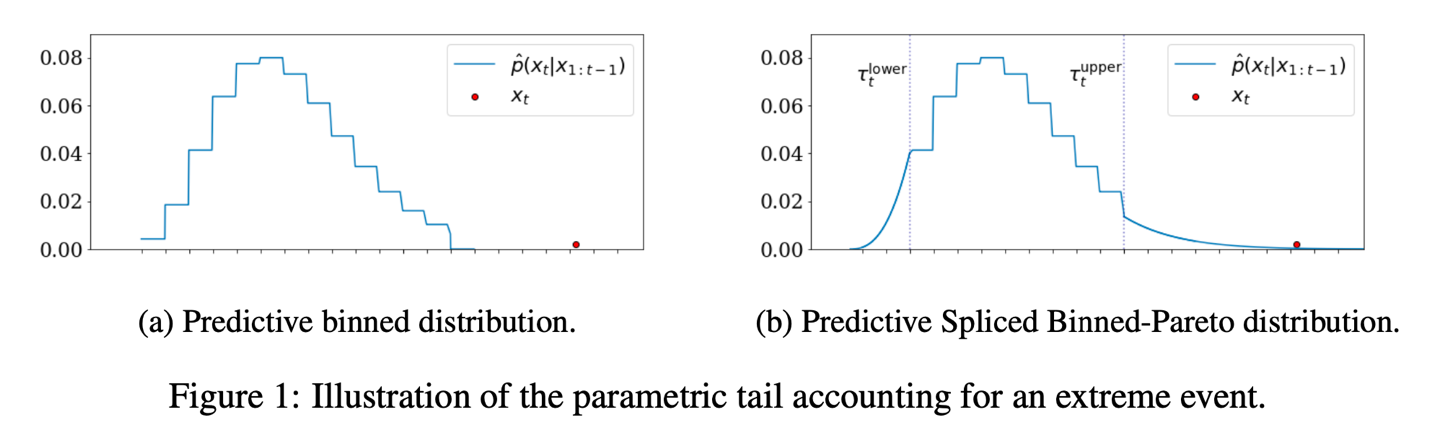

Efter datagenerering træner vi to TCN'er: en ved hjælp af SBP-distribution og anden ved hjælp af Gauss-distribution. SBP-distribution anvender en diskret bined-fordeling som sin forudsigende base, hvor den reelle akse er opdelt i diskrete bins, og modellen forudsiger sandsynligheden for, at en observation falder inden for hver bin. Denne metode gør det muligt at fange asymmetrier og flere tilstande, fordi sandsynligheden for hver beholder er uafhængig. Et eksempel på den indlagte fordeling er vist i den følgende figur.

Den forudsigelige bind-fordeling til venstre er robust over for ekstreme begivenheder, fordi log-sandsynligheden ikke er afhængig af afstanden mellem det forudsagte middelværdi og det observerede punkt, der adskiller sig fra parametriske fordelinger som Gaussisk eller Students t. Derfor vil den ekstreme hændelse repræsenteret af den røde prik ikke påvirke fordelingens indlærte middelværdi. Den ekstreme begivenhed vil dog have nul sandsynlighed. For at fange ekstreme hændelser danner vi en SBP-fordeling ved at definere den nedre hale ved den 5. kvantil og den øvre hale ved den 95. kvantil, og erstatter begge haler med vægtede Generaliserede Pareto Distributions (GPD), som kan kvantificere sandsynligheden for hændelsen. TCN vil udlæse parametrene for den indlagte distributionsbase og GPD-haler.

Hyperparametersøgning

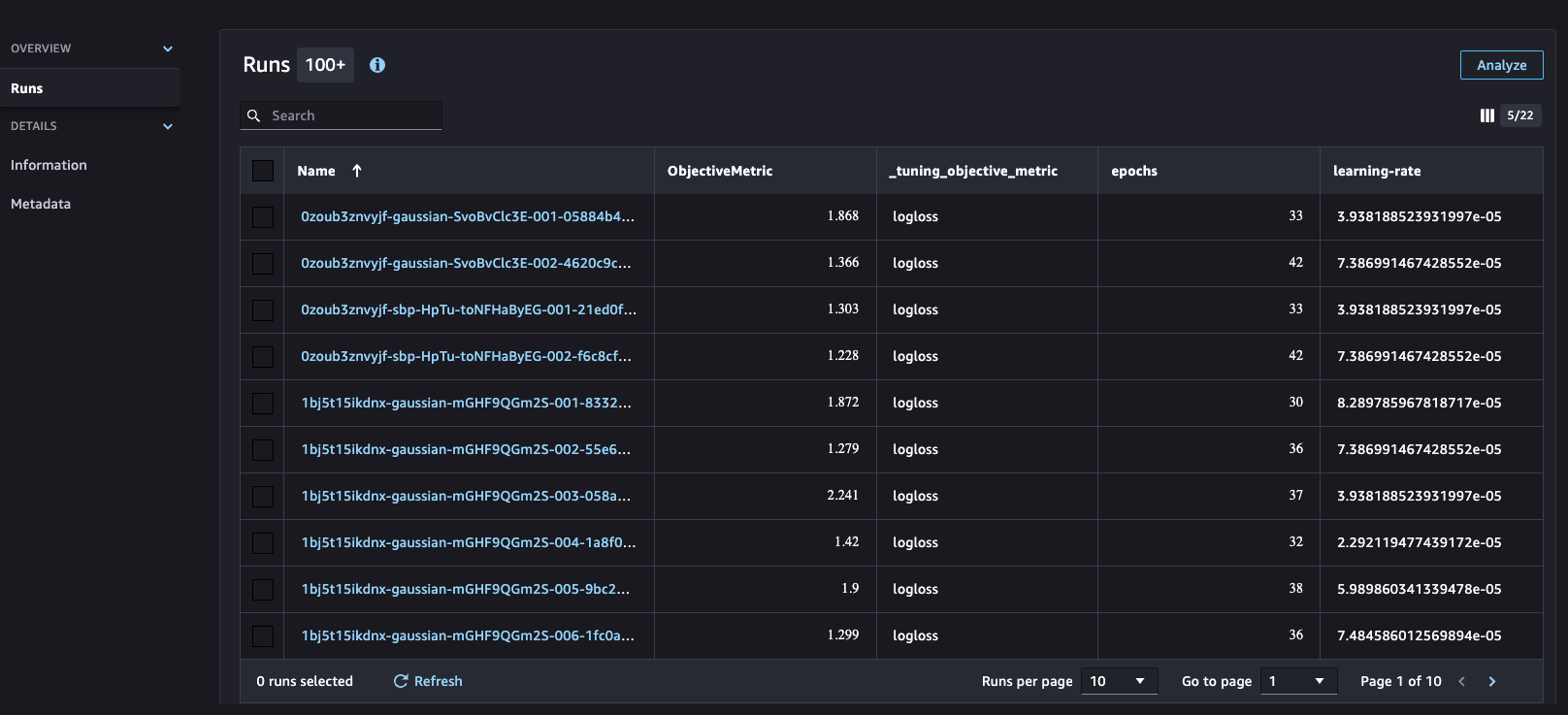

For optimalt output bruger vi automatisk model tuning at finde den bedste version af en model igennem justering af hyperparameter. Dette trin er integreret i SageMaker Pipelines og giver mulighed for parallel kørsel af flere træningsjob, ved at anvende forskellige metoder og foruddefinerede hyperparameterområder. Resultatet er valget af den bedste model baseret på den specificerede modelmetrik, som er RMSE. I vores pipeline tuner vi specifikt indlæringshastigheden og antallet af træningsepoker for at optimere vores models ydeevne. Med hyperparameter tuning-kapaciteten i SageMaker øger vi sandsynligheden for, at vores model opnår optimal nøjagtighed og generalisering til den givne opgave.

På grund af den syntetiske natur af vores data, beholder vi kontekstlængde og ledetid som statiske parametre. Kontekstlængde refererer til antallet af historiske tidstrin, der er indtastet i modellen, og Lead Time repræsenterer antallet af tidstrin i vores prognosehorisont. For eksempelkoden justerer vi kun indlæringshastigheden og antallet af epoker for at spare tid og omkostninger.

SBP-specifikke parametre holdes konstant baseret på omfattende test fra forfatterne på det originale papir på tværs af forskellige datasæt:

- Antal skraldespande (100) – Denne parameter bestemmer antallet af beholdere, der bruges til at modellere distributionens basis. Det holdes på 100, hvilket har vist sig at være mest effektivt på tværs af flere brancher.

- Percentilhale (0.05) – Dette angiver størrelsen af de generaliserede Pareto-fordelinger ved halen. Ligesom den foregående parameter er dette blevet udtømmende testet og fundet at være mest effektivt.

Eksperimenter

Hyperparameterprocessen er integreret med SageMaker-eksperimenter, som hjælper med at organisere, analysere og sammenligne iterative ML-eksperimenter, hvilket giver indsigt og letter sporing af de bedst ydende modeller. Maskinlæring er en iterativ proces, der involverer adskillige eksperimenter, der omfatter datavariationer, algoritmevalg og hyperparameterjustering. Disse eksperimenter tjener til gradvist at forfine modellens nøjagtighed. Det store antal træningskørsler og modeliterationer kan dog gøre det udfordrende at identificere de bedst ydende modeller og foretage meningsfulde sammenligninger mellem nuværende og tidligere eksperimenter. SageMaker Experiments løser dette ved automatisk at spore vores hyperparameter tuning jobs og give os mulighed for at få yderligere detaljer og indsigt i tuning processen, som vist i det følgende skærmbillede.

Modelvurdering

Modellerne gennemgår træning og hyperparameter tuning og evalueres efterfølgende via evaluate.py manuskript. Dette trin bruger testsættet, adskilt fra hyperparameterindstillingsstadiet, til at måle modellens nøjagtighed i den virkelige verden. RMSE bruges til at vurdere nøjagtigheden af forudsigelserne.

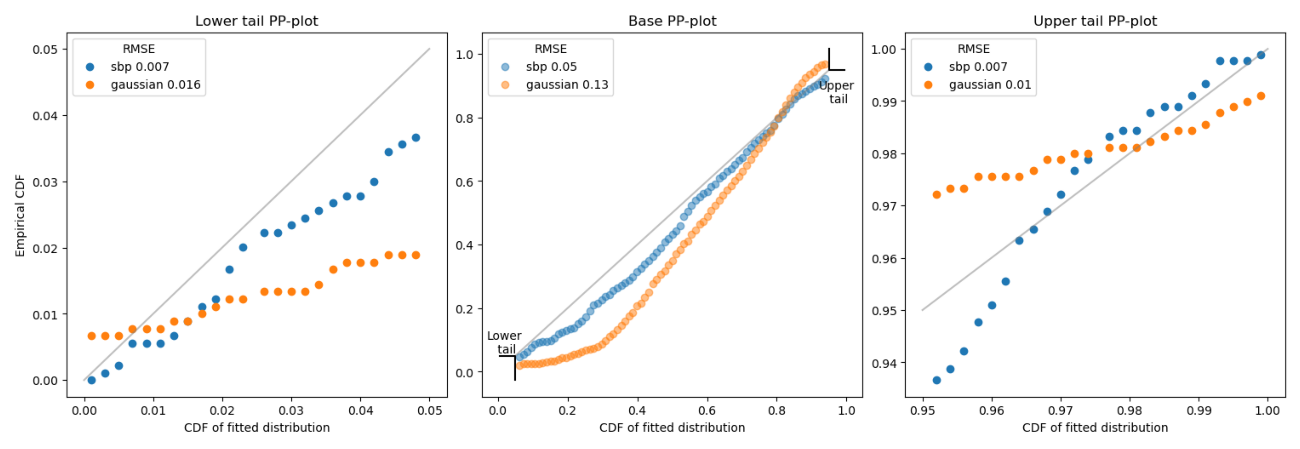

Til sammenligning af fordelingen anvender vi et sandsynlighed-sandsynlighed (PP) plot, som vurderer tilpasningen mellem de faktiske vs. forudsagte fordelinger. Punkternes nærhed til diagonalen indikerer en perfekt pasform. Vores sammenligninger mellem SBP's og Gaussians forudsagte fordelinger mod den faktiske fordeling viser, at SBP's forudsigelser stemmer mere overens med de faktiske data.

Som vi kan observere, har SBP lavere RMSE på basen, nedre hale og øvre hale. SBP-fordelingen forbedrede nøjagtigheden af den Gaussiske fordeling med 61 % på basen, 56 % på den nedre hale og 30 % på den øvre hale. Samlet set har SBP-fordelingen væsentligt bedre resultater.

Modelvalg

Vi bruger et betingelsestrin i SageMaker Pipelines til at analysere modelevalueringsrapporter og vælger modellen med den laveste RMSE for forbedret distributionsnøjagtighed. Den valgte model konverteres til et SageMaker-modelobjekt, der gør den klar til implementering. Dette involverer at skabe en modelpakke med afgørende parametre og pakke den ind i en ModelStep.

Modelregistrering

Den valgte model uploades derefter til SageMaker Model Registry, som spiller en afgørende rolle i styringen af modeller klar til produktion. Det gemmer modeller, organiserer modelversioner, fanger væsentlige metadata og artefakter såsom containerbilleder og styrer godkendelsesstatus for hver model. Ved at bruge registreringsdatabasen kan vi effektivt implementere modeller til tilgængelige SageMaker-miljøer og etablere et fundament for kontinuerlig integration og kontinuerlig udrulning (CI/CD) pipelines.

Inferens

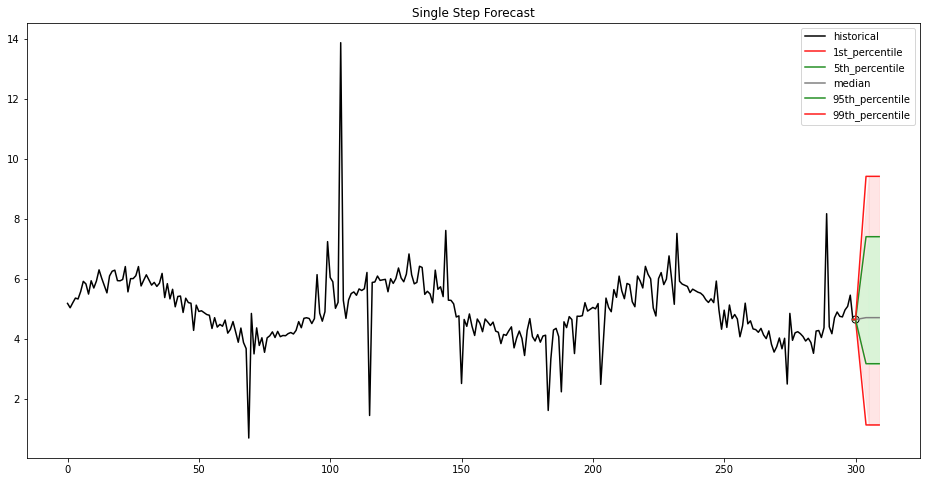

Efter afslutningen af vores træningspipeline bliver vores model derefter implementeret ved hjælp af SageMaker hostingtjenester, som muliggør oprettelsen af et slutningsendepunkt til forudsigelser i realtid. Dette endepunkt muliggør problemfri integration med applikationer og systemer, hvilket giver on-demand adgang til modellens forudsigelige muligheder gennem en sikker HTTPS-grænseflade. Forudsigelser i realtid kan bruges i scenarier som aktiekurs og energiefterspørgselsprognose. Vores endepunkt giver en enkelt-trins prognose for de angivne tidsseriedata, præsenteret som percentiler og medianen, som vist i følgende figur og tabel.

| 1st percentil | 5th percentil | median | 95th percentil | 99th percentil |

| 1.12 | 3.16 | 4.70 | 7.40 | 9.41 |

Ryd op

Når du har kørt denne løsning, skal du sørge for at rydde op i alle unødvendige AWS-ressourcer for at undgå uventede omkostninger. Du kan rydde op i disse ressourcer ved hjælp af SageMaker Python SDK, som kan findes i slutningen af notesbogen. Ved at slette disse ressourcer forhindrer du yderligere gebyrer for ressourcer, du ikke længere bruger.

Konklusion

At have en nøjagtig prognose kan i høj grad påvirke en virksomheds fremtidige planlægning og kan også give løsninger på en række problemer i forskellige brancher. Vores udforskning af robuste tidsserieprognoser med MLOps på SageMaker har demonstreret en metode til at opnå en nøjagtig prognose og effektiviteten af en strømlinet træningspipeline.

Vores model, drevet af et Temporal Convolutional Network med Spliced Binned Pareto-distribution, har vist nøjagtighed og tilpasningsevne til outliers ved at forbedre RMSE med 61 % på basen, 56 % på den nedre hale og 30 % på den øvre hale over det samme TCN med Gaussisk fordeling. Disse tal gør det til en pålidelig løsning til prognosebehov i den virkelige verden.

Pipelinen demonstrerer værdien af at automatisere MLOps-funktioner. Dette kan reducere manuel menneskelig indsats, muliggøre reproducerbarhed og fremskynde modelimplementering. SageMaker funktioner såsom SageMaker Pipelines, automatisk model tuning, SageMaker Experiments, SageMaker Model Registry og endepunkter gør dette muligt.

Vores løsning anvender en miniature TCN, der optimerer blot nogle få hyperparametre med et begrænset antal lag, som er tilstrækkelige til effektivt at fremhæve modellens ydeevne. For mere komplekse brugssager kan du overveje at bruge PyTorch eller andre PyTorch-baserede biblioteker til at konstruere et mere tilpasset TCN, der stemmer overens med dine specifikke behov. Derudover ville det være en fordel at udforske andre SageMaker funktioner for at forbedre din pipelines funktionalitet yderligere. For at automatisere implementeringsprocessen fuldt ud, kan du bruge AWS Cloud Development Kit (AWS CDK) eller AWS CloudFormation.

For mere information om tidsserieprognoser på AWS, se følgende:

Du er velkommen til at efterlade en kommentar med eventuelle tanker eller spørgsmål!

Om forfatterne

Nick Biso er Machine Learning Engineer hos AWS Professional Services. Han løser komplekse organisatoriske og tekniske udfordringer ved hjælp af data science og engineering. Derudover bygger og implementerer han AI/ML-modeller på AWS Cloud. Hans passion strækker sig til hans tilbøjelighed til at rejse og forskellige kulturelle oplevelser.

Nick Biso er Machine Learning Engineer hos AWS Professional Services. Han løser komplekse organisatoriske og tekniske udfordringer ved hjælp af data science og engineering. Derudover bygger og implementerer han AI/ML-modeller på AWS Cloud. Hans passion strækker sig til hans tilbøjelighed til at rejse og forskellige kulturelle oplevelser.

Alston Chan er softwareudviklingsingeniør hos Amazon Ads. Han bygger maskinlæringspipelines og anbefalingssystemer til produktanbefalinger på detaljesiden. Uden for arbejdet nyder han spiludvikling og klatring.

Alston Chan er softwareudviklingsingeniør hos Amazon Ads. Han bygger maskinlæringspipelines og anbefalingssystemer til produktanbefalinger på detaljesiden. Uden for arbejdet nyder han spiludvikling og klatring.

Maria Masood har specialiseret sig i at bygge datapipelines og datavisualiseringer på AWS Commerce Platform. Hun har ekspertise i Machine Learning, der dækker naturlig sprogbehandling, computersyn og tidsserieanalyse. Maria er en bæredygtighedsentusiast i hjertet, og nyder havearbejde og lege med sin hund under sin nedetid.

Maria Masood har specialiseret sig i at bygge datapipelines og datavisualiseringer på AWS Commerce Platform. Hun har ekspertise i Machine Learning, der dækker naturlig sprogbehandling, computersyn og tidsserieanalyse. Maria er en bæredygtighedsentusiast i hjertet, og nyder havearbejde og lege med sin hund under sin nedetid.

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk dig selv. Adgang her.

- PlatoAiStream. Web3 intelligens. Viden forstærket. Adgang her.

- PlatoESG. Kulstof, CleanTech, Energi, Miljø, Solenergi, Affaldshåndtering. Adgang her.

- PlatoHealth. Bioteknologiske og kliniske forsøgs intelligens. Adgang her.

- Kilde: https://aws.amazon.com/blogs/machine-learning/robust-time-series-forecasting-with-mlops-on-amazon-sagemaker/

- :har

- :er

- :ikke

- :hvor

- $OP

- 100

- 5.

- 7

- a

- evne

- Om

- fremskynde

- accelererer

- adgang

- tilgængelig

- gennemført

- Konto

- nøjagtighed

- præcis

- præcist

- opnår

- tværs

- faktiske

- acykliske

- tilpasse

- Desuden

- Derudover

- adresser

- annoncer

- mod

- forude

- AI / ML

- alarm

- algoritme

- tilpasse

- Justerer

- allokering

- tillade

- tillader

- sammen

- også

- Amazon

- Amazon SageMaker

- Amazon Web Services

- an

- analyse

- analysere

- ,

- foregribe

- enhver

- anvendelig

- applikationer

- godkendelse

- arkitektur

- ER

- AS

- vurdere

- vurderer

- aktiv

- forbundet

- At

- forfattere

- automatisere

- Automatisk Ur

- automatisk

- Automatisering

- Automation

- til rådighed

- undgå

- AWS

- AWS Professional Services

- Axis

- bund

- baseret

- BE

- fordi

- været

- adfærd

- bag

- gavnlig

- fordele

- BEDSTE

- Bedre

- mellem

- skævhed

- BIN

- både

- bred

- Bygning

- bygger

- virksomheder

- men

- .

- by

- CAN

- kapaciteter

- kapacitet

- stand

- fange

- fanger

- Optagelse

- tilfælde

- Celler

- udfordringer

- udfordrende

- skiftende

- kendetegnet

- afgifter

- valg

- klik

- Klatring

- nøje

- Cloud

- sky infrastruktur

- kode

- KOMMENTAR

- Handel

- sammenligne

- sammenligning

- fuldføre

- færdiggørelse

- komplekse

- Kompromitteret

- computer

- Computer Vision

- betingelse

- betingelser

- gennemført

- Overvej

- Konsol

- konstant

- konstruere

- Container

- sammenhæng

- kontinuerlig

- konverteret

- Koste

- Omkostninger

- dækker

- skabe

- oprettet

- Oprettelse af

- skabelse

- kritisk

- afgørende

- kulturelle

- Nuværende

- tilpassede

- cyklus

- data

- databehandling

- datalogi

- datastyret

- datasæt

- Dato

- Beslutningstagning

- afgørelser

- Standard

- definere

- Efterspørgsel

- Forespørgsel om efterspørgsel

- demonstreret

- demonstrerer

- betegner

- afhængigheder

- afhængig

- indsætte

- indsat

- implementering

- implementering

- udruller

- konstrueret

- detail

- detaljer

- Bestem

- bestemmer

- bestemmelse

- Udvikling

- forskellige

- forskellige

- rettet

- katastrofer

- diskutere

- afstand

- distinkt

- fordeling

- Distributioner

- forskelligartede

- Divided

- Dog

- DOT

- nedetid

- i løbet af

- hver

- Effektiv

- effektivt

- effektivitet

- effektivitet

- effektiv

- effektivt

- indsats

- elementer

- anvendelse

- beskæftiger

- bemyndiger

- muliggøre

- muliggør

- muliggør

- omfatter

- ende

- ende til ende

- Endpoint

- energi

- ingeniør

- Engineering

- forbedre

- styrke

- sikre

- entusiast

- Miljø

- miljøer

- epoker

- fejl

- væsentlig

- etablere

- evalueret

- evaluere

- evaluering

- begivenhed

- begivenheder

- udviklende

- eksempel

- Oplevelser

- eksperimenter

- ekspertise

- udforskning

- udforske

- udvider

- omfattende

- ekstrem

- faciliterende

- Faldende

- Feature

- Funktionalitet

- få

- Figur

- tal

- finansielle

- Finansielle institutioner

- Finde

- Fornavn

- passer

- følger

- efter

- Til

- Forecast

- prognoser

- formular

- fundet

- Foundation

- Gratis

- Frihed

- fra

- fuldt ud

- funktionalitet

- yderligere

- Endvidere

- fremtiden

- Gevinst

- spil

- spiludvikling

- Målestok

- Gen

- genereret

- genererer

- generere

- generation

- given

- Go

- regulerer

- GPD

- tilskud

- grafer

- håndtere

- seletøj

- udnyttelse

- Have

- he

- sundhedspleje

- Hjerte

- hjælper

- hende

- link.

- fremhæve

- stærkt

- hans

- historisk

- horisont

- Hosting

- Hvordan

- Men

- HTML

- HTTPS

- menneskelig

- Tuning af hyperparameter

- identificere

- illustrerer

- billeder

- KIMOs Succeshistorier

- gennemføre

- vigtigt

- forbedret

- forbedrer

- forbedring

- in

- indarbejde

- Forøg

- uafhængig

- angiver

- industrier

- indflydelse

- oplysninger

- informeret

- Infrastruktur

- indgang

- indsigt

- indsigt

- i stedet

- institutioner

- integreret

- integration

- grænseflade

- ind

- involverer

- IT

- iterationer

- ITS

- Job

- Karriere

- jpg

- lige

- holde

- holdt

- Nøgle

- Sprog

- stor

- lag

- føre

- lærte

- læring

- Forlade

- til venstre

- Længde

- biblioteker

- ligesom

- sandsynlighed

- Sandsynlig

- Limited

- placeret

- længere

- tab

- lavere

- laveste

- maskine

- machine learning

- lave

- Making

- administrere

- lykkedes

- ledelse

- styring

- manuel

- Mary

- Marked

- marked nedbrud

- betyde

- meningsfuld

- Metadata

- metode

- Metode

- metoder

- metrisk

- savnet

- ML

- MLOps

- model

- modeller

- modes

- overvågning

- mere

- mest

- flere

- Natural

- Natural Language Processing

- Natur

- behov

- forsømme

- netværk

- Ny

- næste

- næste gener

- NFL

- ingen

- Støj

- notesbog

- nummer

- talrige

- objekt

- observere

- opnå

- of

- Tilbud

- on

- On-Demand

- ONE

- kun

- åbent

- Muligheder

- optimal

- Optimer

- optimering

- or

- organisatorisk

- organiserer

- original

- Andet

- vores

- udfald

- output

- uden for

- i løbet af

- samlet

- pakke

- emballage

- side

- pandemier

- Papir

- Parallel

- parameter

- parametre

- Pareto

- Passing

- lidenskab

- forbi

- mønstre

- perfekt

- ydeevne

- pipeline

- planlægning

- perron

- plato

- Platon Data Intelligence

- PlatoData

- spiller

- spiller

- Punkt

- punkter

- mulig

- Indlæg

- magt

- strøm

- vigtigste

- forudsige

- forudsagde

- forudsigelse

- Forudsigelser

- forudser

- forelagt

- forhindre

- tidligere

- pris

- prioritering

- problemer

- behandle

- forarbejdning

- Produkt

- produktion

- professionel

- gennemprøvet

- give

- forudsat

- giver

- leverer

- Python

- pytorch

- rejse

- tilfældig

- rækkevidde

- hurtigt

- Sats

- klar

- Klargøring

- ægte

- virkelige verden

- realtid

- nylige

- Anbefaling

- anbefalinger

- Rød

- reducere

- reducerer

- henvise

- refererer

- raffinere

- regioner

- register

- relevant

- pålidelig

- stole

- forblive

- erstatte

- Rapporter

- repræsentere

- repræsenteret

- repræsenterer

- ressource

- Ressourcer

- henholdsvis

- lydhør

- resultere

- Resultater

- Risiko

- risikostyring

- robust

- robusthed

- klippe

- roller

- rod

- Kør

- løber

- Sikkerhed

- sagemaker

- SageMaker Pipelines

- samme

- Gem

- Skalerbarhed

- Scale

- scenarier

- Videnskab

- script

- SDK

- sømløs

- Søg

- Sektorer

- sikker

- valgt

- valg

- Series

- tjener

- Tjenester

- sæt

- sæt

- Shape

- hun

- Vis

- vist

- underskrive

- betydeligt

- Simpelt

- samtidigt

- Størrelse

- Software

- softwareudvikling

- løsninger

- Løsninger

- Løser

- specialiseret

- specifikke

- specifikt

- specificeret

- delt

- spredes

- squared

- Stage

- Status

- forblive

- Trin

- Steps

- bestand

- opbevaring

- forhandler

- strømline

- strømlinet

- Efterfølgende

- succes

- sådan

- tilstrækkeligt

- sikker

- Bæredygtighed

- syntetisk

- Systemer

- bord

- Opgaver

- Teknisk

- prøve

- afprøvet

- Test

- at

- verdenen

- deres

- derefter

- derfor

- Disse

- denne

- Gennem

- tid

- Tidsserier

- til

- Sporing

- Trading

- Trafik

- Tog

- uddannet

- Kurser

- rejse

- to

- typer

- gennemgå

- Uventet

- unødvendig

- uploadet

- us

- brug

- anvendte

- brugervenlig

- brugere

- ved brug af

- udnytte

- udnytter

- Ved hjælp af

- validering

- værdi

- Værdier

- række

- forskellige

- udgave

- versioner

- via

- vision

- afgørende

- vs

- var

- we

- Vejr

- web

- webservices

- hvorvidt

- som

- bred

- vilje

- med

- inden for

- Arbejde

- workflow

- arbejdsgange

- arbejder

- world

- ville

- Du

- Din

- zephyrnet

- nul