Generativ AI applikationer drevet af grundlæggende modeller (FM'er) gør det muligt for organisationer med betydelig forretningsværdi i kundeoplevelse, produktivitet, procesoptimering og innovationer. Vedtagelsen af disse FM'er indebærer imidlertid at tage fat på nogle nøgleudfordringer, herunder kvalitetsoutput, databeskyttelse, sikkerhed, integration med organisationsdata, omkostninger og færdigheder til at levere.

I dette indlæg udforsker vi forskellige tilgange, du kan tage, når du bygger applikationer, der bruger generativ AI. Med den hurtige udvikling af FM'er er det en spændende tid at udnytte deres magt, men også afgørende at forstå, hvordan man bruger dem korrekt til at opnå forretningsresultater. Vi giver et overblik over nøglegenerative AI-tilgange, herunder prompt engineering, Retrieval Augmented Generation (RAG) og modeltilpasning. Når vi anvender disse tilgange, diskuterer vi centrale overvejelser omkring potentielle hallucinationer, integration med virksomhedsdata, outputkvalitet og omkostninger. Til sidst vil du have solide retningslinjer og et nyttigt flowdiagram til at bestemme den bedste metode til at udvikle dine egne FM-drevne applikationer, baseret på eksempler fra det virkelige liv. Uanset om du opretter en chatbot eller opsummeringsværktøj, kan du forme kraftfulde FM'er, så de passer til dine behov.

Generativ AI med AWS

Fremkomsten af FM'er skaber både muligheder og udfordringer for organisationer, der ønsker at bruge disse teknologier. En nøgleudfordring er at sikre sammenhængende output af høj kvalitet, der stemmer overens med virksomhedens behov, snarere end hallucinationer eller falsk information. Organisationer skal også omhyggeligt håndtere databeskyttelses- og sikkerhedsrisici, der opstår ved behandling af proprietære data med FM'er. De nødvendige færdigheder til korrekt at integrere, tilpasse og validere FM'er i eksisterende systemer og data er mangelvare. At bygge store sprogmodeller (LLM'er) fra bunden eller tilpasse fortrænede modeller kræver betydelige computerressourcer, ekspertdataforskere og måneders ingeniørarbejde. Alene beregningsomkostningerne kan nemt løbe op i millioner af dollars for at træne modeller med hundredvis af milliarder af parametre på massive datasæt ved hjælp af tusindvis af GPU'er eller TPU'er. Ud over hardware kræver datarensning og -behandling, modelarkitekturdesign, hyperparametertuning og udvikling af træningspipeline specialiserede maskinlæringsfærdigheder (ML). End-to-end-processen er kompleks, tidskrævende og uoverkommelig dyr for de fleste organisationer uden den nødvendige infrastruktur og talentinvestering. Organisationer, der undlader at håndtere disse risici tilstrækkeligt, kan få negative konsekvenser for deres brandomdømme, kundetillid, drift og indtjening.

Amazonas grundfjeld er en fuldt administreret tjeneste, der tilbyder et udvalg af højtydende fundamentmodeller (FM'er) fra førende AI-virksomheder som AI21 Labs, Anthropic, Cohere, Meta, Mistral AI, Stability AI og Amazon via en enkelt API. Med Amazon Bedrock serverløse oplevelse kan du komme hurtigt i gang, privat tilpasse FM'er med dine egne data og integrere og implementere dem i dine applikationer ved hjælp af AWS-værktøjer uden at skulle administrere nogen infrastruktur. Amazon Bedrock er HIPAA-kvalificeret, og du kan bruge Amazon Bedrock i overensstemmelse med GDPR. Med Amazon Bedrock bruges dit indhold ikke til at forbedre basismodellerne og deles ikke med tredjepartsmodeludbydere. Dine data i Amazon Bedrock er altid krypteret under transit og i hvile, og du kan valgfrit kryptere ressourcer ved hjælp af dine egne nøgler. Du kan bruge AWS PrivateLink med Amazon Bedrock for at etablere privat forbindelse mellem dine FM'er og din VPC uden at udsætte din trafik for internettet. Med Vidensbaser for Amazon Bedrock, kan du give FM'er og agenter kontekstuelle oplysninger fra din virksomheds private datakilder for at RAG kan levere mere relevante, nøjagtige og tilpassede svar. Du kan privat tilpasse FM'er med dine egne data gennem en visuel grænseflade uden at skrive nogen kode. Som en fuldt administreret tjeneste tilbyder Amazon Bedrock en ligetil udvikleroplevelse til at arbejde med en bred vifte af højtydende FM'er.

Lanceret i 2017, Amazon SageMaker er en fuldt administreret tjeneste, der gør det nemt at bygge, træne og implementere ML-modeller. Flere og flere kunder bygger deres egne FM'er ved hjælp af SageMaker, herunder Stability AI, AI21 Labs, Hugging Face, Perplexity AI, Hippocratic AI, LG AI Research og Technology Innovation Institute. For at hjælpe dig hurtigt i gang, Amazon SageMaker JumpStart tilbyder en ML-hub, hvor du kan udforske, træne og implementere et bredt udvalg af offentlige FM'er, såsom Mistral-modeller, LightOn-modeller, RedPajama, Mosiac MPT-7B, FLAN-T5/UL2, GPT-J-6B/Neox-20B , og Bloom/BloomZ ved hjælp af specialbyggede SageMaker-værktøjer såsom eksperimenter og pipelines.

Almindelige generative AI-tilgange

I dette afsnit diskuterer vi almindelige tilgange til implementering af effektive generative AI-løsninger. Vi udforsker populære prompt ingeniørteknikker, der giver dig mulighed for at opnå mere komplekse og interessante opgaver med FM'er. Vi diskuterer også, hvordan teknikker som RAG og modeltilpasning yderligere kan forbedre FM'ers muligheder og overvinde udfordringer som begrænsede data og beregningsmæssige begrænsninger. Med den rigtige teknik kan du bygge kraftfulde og virkningsfulde generative AI-løsninger.

Hurtig ingeniørarbejde

Prompt engineering er praksis med omhyggeligt at designe prompter for effektivt at udnytte FM'ernes muligheder. Det involverer brug af prompter, som er korte tekststykker, der guider modellen til at generere mere præcise og relevante svar. Med hurtig konstruktion kan du forbedre ydeevnen af FM'er og gøre dem mere effektive til en række forskellige applikationer. I dette afsnit udforsker vi teknikker som nul-skuds- og få-skuds-prompting, som hurtigt tilpasser FM'er til nye opgaver med blot nogle få eksempler, og chain-of-thought-prompting, som nedbryder komplekse ræsonnementer i mellemtrin. Disse metoder viser, hvordan hurtig ingeniørarbejde kan gøre FM'er mere effektive på komplekse opgaver uden at kræve modelomskoling.

Zero-shot prompt

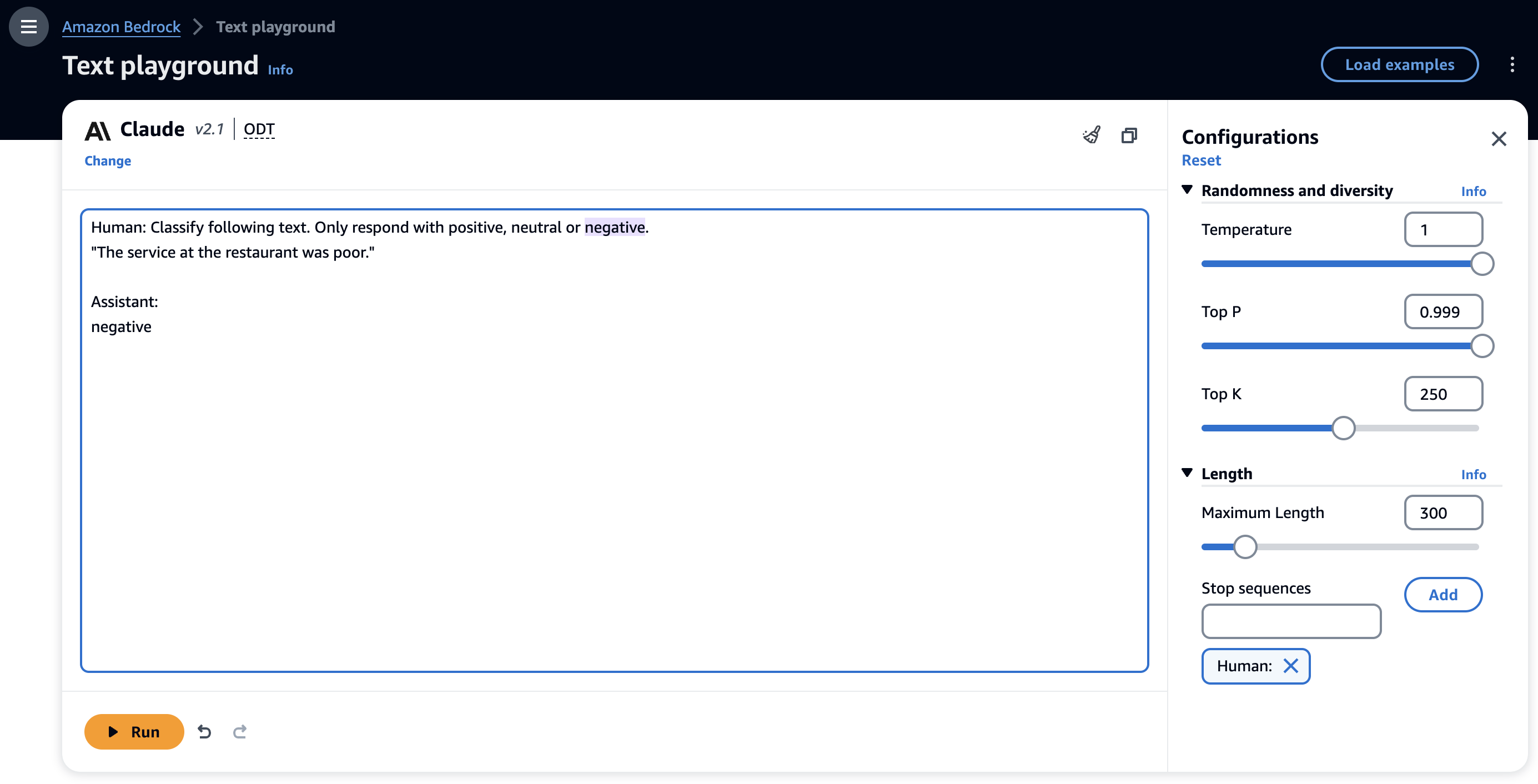

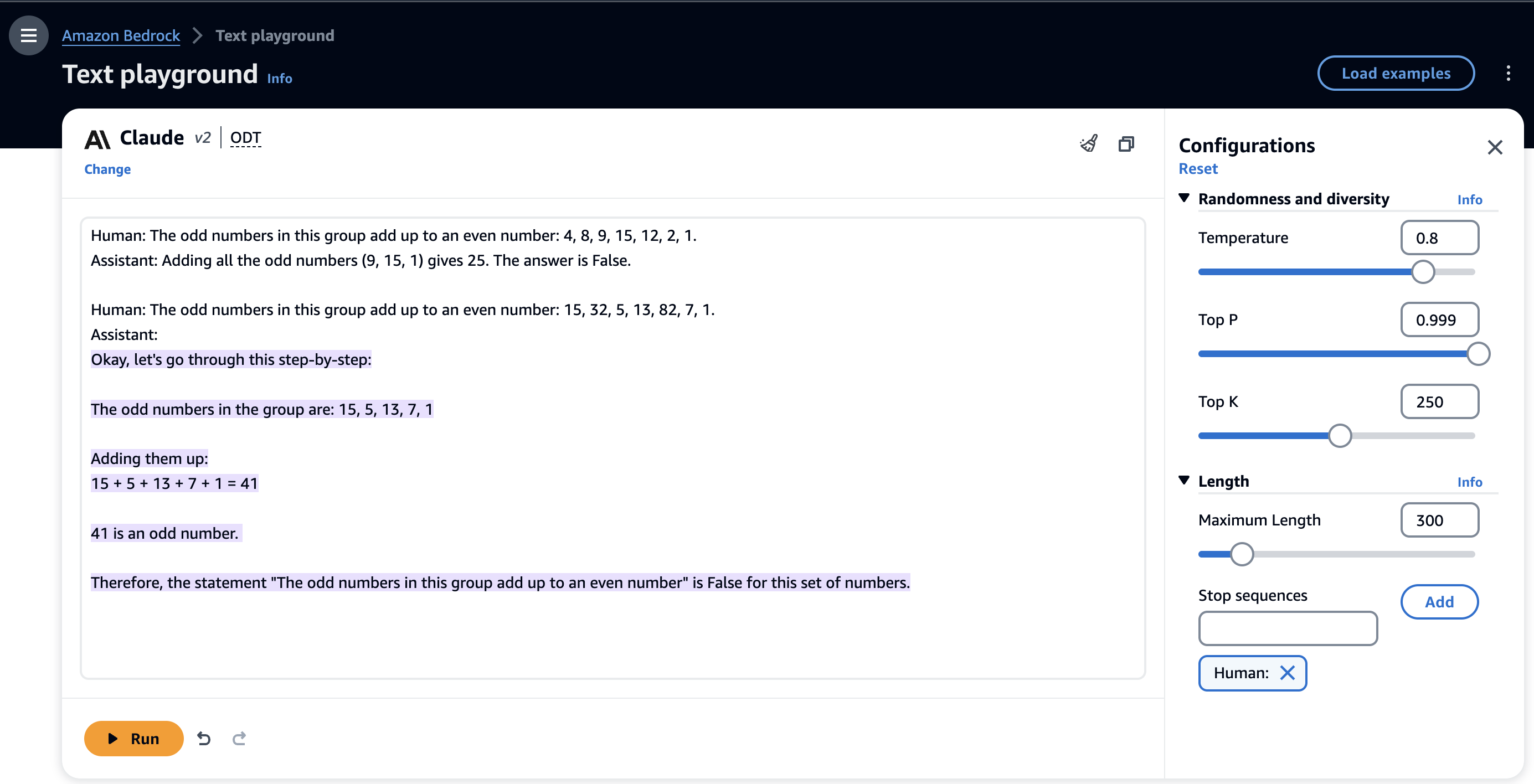

En zero-shot prompt-teknik kræver, at FM'er genererer et svar uden at give nogen eksplicitte eksempler på den ønskede adfærd, udelukkende baseret på dens forudgående træning. Følgende skærmbillede viser et eksempel på en nul-shot prompt med Anthropic Claude 2.1-modellen på Amazon Bedrock-konsollen.

I disse instruktioner har vi ikke givet nogen eksempler. Men modellen kan forstå opgaven og generere passende output. Zero-shot prompts er den mest ligefremme promptteknik til at begynde med, når du vurderer en FM til din brugssag. Men selvom FM'er er bemærkelsesværdige med nul-shot-prompter, giver det muligvis ikke altid nøjagtige eller ønskede resultater for mere komplekse opgaver. Når nul-skud-prompter kommer til kort, anbefales det at give et par eksempler i prompten (få-shot-prompter).

Få skud tilskyndelse

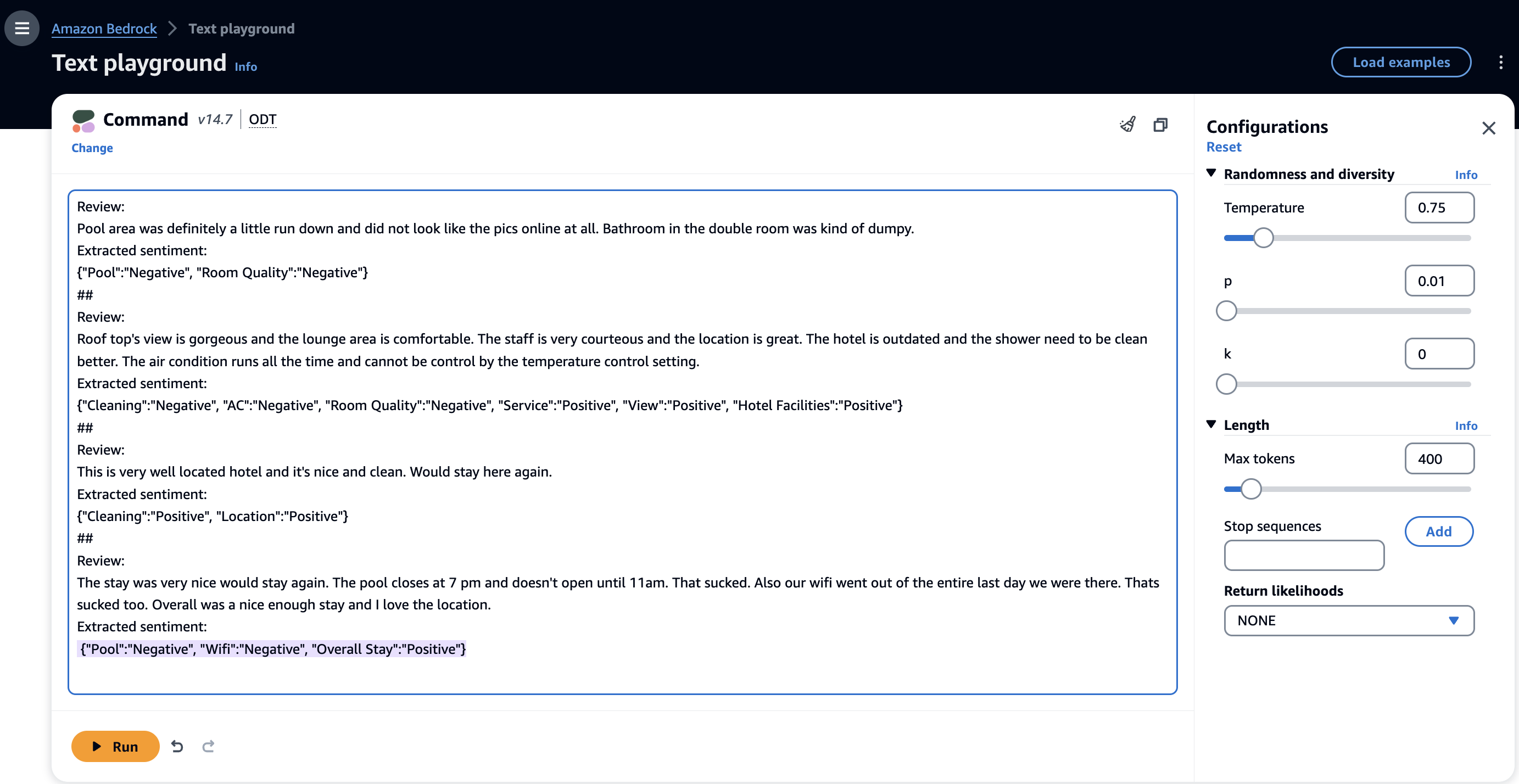

Promptteknikken med få skud giver FM'er mulighed for at lære i kontekst fra eksemplerne i prompterne og udføre opgaven mere præcist. Med blot nogle få eksempler kan du hurtigt tilpasse FM'er til nye opgaver uden store træningssæt og guide dem mod den ønskede adfærd. Det følgende er et eksempel på en prompt med få skud med Cohere Command-modellen på Amazon Bedrock-konsollen.

I det foregående eksempel var FM i stand til at identificere enheder fra inputteksten (anmeldelser) og udtrække de tilhørende følelser. Få-skuds-prompter er en effektiv måde at tackle komplekse opgaver ved at give nogle få eksempler på input-output-par. For ligetil opgaver kan du give et eksempel (1-skud), mens du til mere vanskelige opgaver skal give tre (3-skud) til fem (5-skud) eksempler. Min et al. (2022) offentliggjorte resultater om læring i kontekst, der kan forbedre ydeevnen af teknikken med få skud. Du kan bruge få-shot prompt til en række forskellige opgaver, såsom sentimentanalyse, enhedsgenkendelse, besvarelse af spørgsmål, oversættelse og kodegenerering.

Kæde-af-tanke tilskyndelse

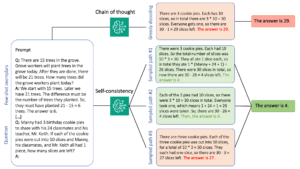

På trods af dets potentiale har få-skuds-prompting begrænsninger, især når man beskæftiger sig med komplekse ræsonnementopgaver (såsom aritmetiske eller logiske opgaver). Disse opgaver kræver, at problemet opdeles i trin og derefter løses. Wei et al. (2022) introducerede chain-of-thought (CoT) prompting-teknikken til at løse komplekse ræsonnementproblemer gennem mellemliggende ræsonneringstrin. Du kan kombinere CoT med få-shot prompt for at forbedre resultaterne på komplekse opgaver. Det følgende er et eksempel på en begrundelsesopgave, der bruger få-skuds CoT-prompt med den antropiske Claude 2-model på Amazon Bedrock-konsollen.

Kojima et al. (2022) introducerede en idé om zero-shot CoT ved at bruge FM'ers uudnyttede zero-shot-kapaciteter. Deres forskning viser, at zero-shot CoT, ved at bruge den samme single-prompt-skabelon, markant overgår nul-shot FM-præstationer på forskellige benchmark-ræsonneringsopgaver. Du kan bruge zero-shot CoT-prompt til simple ræsonnementopgaver ved at tilføje "Lad os tænke trin for trin" til den oprindelige prompt.

Reagere

CoT-anmodning kan forbedre FM'ers ræsonnement, men det afhænger stadig af modellens interne viden og tager ikke hensyn til nogen ekstern videnbase eller miljø for at indsamle mere information, hvilket kan føre til problemer som hallucinationer. ReAct-tilgangen (reasoning and acting) adresserer dette hul ved at udvide CoT og tillade dynamisk ræsonnement ved hjælp af et eksternt miljø (såsom Wikipedia).

Integration

FM'er har evnen til at forstå spørgsmål og give svar ved hjælp af deres forudtrænede viden. De mangler dog kapaciteten til at svare på forespørgsler, der kræver adgang til en organisations private data eller evnen til selvstændigt at udføre opgaver. RAG og agenter er metoder til at forbinde disse generative AI-drevne applikationer til virksomhedsdatasæt, hvilket giver dem mulighed for at give svar, der tager højde for organisationsoplysninger og muliggør kørende handlinger baseret på anmodninger.

Retrieval Augmented Generation

Retrieval Augmented Generation (RAG) giver dig mulighed for at tilpasse en models svar, når du ønsker, at modellen skal overveje ny viden eller opdateret information. Når dine data ændres ofte, såsom lagerbeholdning eller prissætning, er det ikke praktisk at finjustere og opdatere modellen, mens den betjener brugerforespørgsler. For at udstyre FM med up-to-date proprietære informationer henvender organisationer sig til RAG, en teknik, der involverer at hente data fra virksomhedens datakilder og berige prompten med disse data for at levere mere relevante og nøjagtige svar.

Der er flere tilfælde, hvor RAG kan hjælpe med at forbedre FM-ydelse:

- Besvarelse af spørgsmål – RAG-modeller hjælper applikationer til at besvare spørgsmål med at lokalisere og integrere information fra dokumenter eller videnkilder for at generere svar af høj kvalitet. For eksempel kan en applikation til besvarelse af spørgsmål hente passager om et emne, før den genererer et opsummerende svar.

- Chatbots og samtaleagenter – RAG tillader chatbots at få adgang til relevant information fra store eksterne videnkilder. Dette gør chatbottens svar mere vidende og naturlige.

- Skrivehjælp – RAG kan foreslå relevant indhold, fakta og diskussionspunkter for at hjælpe dig med at skrive dokumenter som artikler, rapporter og e-mails mere effektivt. Den hentede information giver nyttig kontekst og ideer.

- Resumé – RAG kan finde relevante kildedokumenter, passager eller fakta for at øge en opsummeringsmodels forståelse af et emne, så den kan generere bedre resuméer.

- Kreativ skrivning og historiefortælling – RAG kan trække plotideer, karakterer, indstillinger og kreative elementer fra eksisterende historier for at inspirere AI-historiegenereringsmodeller. Dette gør outputtet mere interessant og jordet.

- Oversættelse – RAG kan finde eksempler på, hvordan visse sætninger oversættes mellem sprog. Dette giver kontekst til oversættelsesmodellen og forbedrer oversættelsen af tvetydige sætninger.

- Personalisering – I chatbots og anbefalingsapplikationer kan RAG trække personlig kontekst som tidligere samtaler, profiloplysninger og præferencer for at gøre svar mere personlige og relevante.

Der er flere fordele ved at bruge en RAG-ramme:

- Reducerede hallucinationer – Hentning af relevant information hjælper med at jorde den genererede tekst i fakta og viden fra den virkelige verden i stedet for hallucinerende tekst. Dette fremmer mere nøjagtige, faktuelle og troværdige svar.

- Dækning – Hentning giver en FM mulighed for at dække en bredere række af emner og scenarier ud over dens træningsdata ved at trække ekstern information ind. Dette hjælper med at løse problemer med begrænset dækning.

- Effektivitet – Hentning lader modellen fokusere sin generation på den mest relevante information i stedet for at generere alt fra bunden. Dette forbedrer effektiviteten og gør det muligt at bruge større sammenhænge.

- Sikkerhed – Hentning af oplysningerne fra påkrævede og tilladte datakilder kan forbedre styring og kontrol over generering af skadeligt og unøjagtigt indhold. Dette understøtter en mere sikker adoption.

- Skalerbarhed – Indeksering og hentning fra store korpus tillader tilgangen til at skalere bedre sammenlignet med at bruge hele korpus under generering. Dette giver dig mulighed for at anvende FM'er i mere ressourcebegrænsede miljøer.

RAG producerer kvalitetsresultater på grund af øget brugssagsspecifik kontekst direkte fra vektoriserede datalagre. Sammenlignet med hurtig ingeniørarbejde giver det stærkt forbedrede resultater med massivt lave chancer for hallucinationer. Du kan bygge RAG-drevne applikationer på dine virksomhedsdata ved hjælp af Amazon Kendra. RAG har højere kompleksitet end prompt engineering, fordi du skal have kodnings- og arkitekturfærdigheder for at implementere denne løsning. Knowledge Bases for Amazon Bedrock giver dog en fuldt administreret RAG-oplevelse og den mest ligetil måde at komme i gang med RAG i Amazon Bedrock. Knowledge Bases for Amazon Bedrock automatiserer end-to-end RAG-workflowet, inklusive indlæsning, hentning og prompt augmentation, hvilket eliminerer behovet for, at du skal skrive tilpasset kode for at integrere datakilder og administrere forespørgsler. Sessionskontekststyring er indbygget, så din app kan understøtte samtaler med flere sving. Videnbasesvar kommer med kildehenvisninger for at forbedre gennemsigtigheden og minimere hallucinationer. Den mest ligetil måde at bygge en generativ AI-drevet assistent på er ved at bruge Amazon Q, som har indbygget RAG-system.

RAG har den højeste grad af fleksibilitet, når det kommer til ændringer i arkitekturen. Du kan ændre indlejringsmodellen, vektorlageret og FM uafhængigt med minimal til moderat indvirkning på andre komponenter. For at lære mere om RAG-tilgangen med Amazon OpenSearch Service og Amazon Bedrock, se Byg skalerbare og serverløse RAG-arbejdsgange med en vektormotor til Amazon OpenSearch Serverless og Amazon Bedrock Claude-modeller. For at lære om, hvordan man implementerer RAG med Amazon Kendra, se Udnyt kraften i virksomhedsdata med generativ AI: Indsigt fra Amazon Kendra, LangChain og store sprogmodeller.

Agenter

FM'er kan forstå og svare på forespørgsler baseret på deres foruddannede viden. De er dog ikke i stand til at udføre nogen opgaver i den virkelige verden, såsom at booke en flyrejse eller behandle en indkøbsordre, på egen hånd. Dette skyldes, at sådanne opgaver kræver organisationsspecifikke data og arbejdsgange, der typisk har brug for tilpasset programmering. Rammer som Langkæde og visse FM'er, såsom Claude-modeller, giver funktionskaldende funktioner til at interagere med API'er og værktøjer. Imidlertid, Agenter for Amazon Bedrock, en ny og fuldt administreret AI-funktion fra AWS, sigter mod at gøre det mere ligetil for udviklere at bygge applikationer ved hjælp af næste generations FM'er. Med blot et par klik kan den automatisk nedbryde opgaver og generere den nødvendige orkestreringslogik uden manuel kodning. Agenter kan sikkert oprette forbindelse til virksomhedens databaser via API'er, indtage og strukturere dataene til maskinforbrug og udvide dem med kontekstuelle detaljer for at producere mere nøjagtige svar og opfylde anmodninger. Fordi det håndterer integration og infrastruktur, giver Agents for Amazon Bedrock dig mulighed for fuldt ud at udnytte generativ AI til forretningsbrug. Udviklere kan nu fokusere på deres kerneapplikationer i stedet for rutinemæssig VVS. Den automatiserede databehandling og API-kald gør det også muligt for FM at levere opdaterede, skræddersyede svar og udføre faktiske opgaver ved at bruge proprietær viden.

Modeltilpasning

Foundation-modeller er ekstremt dygtige og muliggør nogle fantastiske applikationer, men det, der vil hjælpe med at drive din virksomhed, er generativ AI, der ved, hvad der er vigtigt for dine kunder, dine produkter og din virksomhed. Og det er kun muligt, når du supercharger modeller med dine data. Data er nøglen til at flytte fra generiske applikationer til tilpassede generative AI-applikationer, der skaber reel værdi for dine kunder og din virksomhed.

I dette afsnit diskuterer vi forskellige teknikker og fordele ved at tilpasse dine FM'er. Vi dækker, hvordan modeltilpasning involverer yderligere træning og ændring af modellens vægte for at forbedre dens ydeevne.

Finjustering

Finjustering er processen med at tage en fortrænet FM, såsom Llama 2, og videretræne den på en downstream-opgave med et datasæt, der er specifikt for den opgave. Den fortrænede model giver generel sproglig viden, og finjustering giver den mulighed for at specialisere sig og forbedre ydeevnen på en bestemt opgave som tekstklassificering, besvarelse af spørgsmål eller tekstgenerering. Med finjustering giver du mærkede datasæt – som er kommenteret med yderligere kontekst – for at træne modellen i specifikke opgaver. Du kan derefter tilpasse modelparametrene til den specifikke opgave baseret på din forretningsmæssige kontekst.

Du kan implementere finjustering på FM'er med Amazon SageMaker JumpStart og Amazon Bedrock. For flere detaljer, se Implementer og finjuster fundamentmodeller i Amazon SageMaker JumpStart med to linjer kode , Tilpas modeller i Amazon Bedrock med dine egne data ved hjælp af finjustering og fortsat fortræning.

Fortsat fortræning

Fortsat fortræning i Amazon Bedrock giver dig mulighed for at lære en tidligere trænet model på yderligere data svarende til dens oprindelige data. Det gør det muligt for modellen at opnå mere generel sproglig viden frem for at fokusere på en enkelt anvendelse. Med fortsat fortræning kan du bruge dine umærkede datasæt, eller rådata, til at forbedre nøjagtigheden af fundamentmodellen for dit domæne gennem tweaking af modelparametre. For eksempel kan en sundhedsvirksomhed fortsætte med at fortræne sin model ved hjælp af medicinske tidsskrifter, artikler og forskningsartikler for at gøre den mere vidende om industriterminologi. For flere detaljer, se Amazon Bedrock Developer Experience.

Fordele ved modeltilpasning

Modeltilpasning har flere fordele og kan hjælpe organisationer med følgende:

- Domænespecifik tilpasning – Du kan bruge en FM til generelle formål og derefter træne den yderligere på data fra et specifikt domæne (såsom biomedicinsk, juridisk eller økonomisk). Dette tilpasser modellen til det pågældende domænes ordforråd, stil og så videre.

- Opgavespecifik finjustering – Du kan tage en fortrænet FM og finjustere den på data til en specifik opgave (såsom sentimentanalyse eller besvarelse af spørgsmål). Dette specialiserer modellen til den pågældende opgave.

- Personalisering – Du kan tilpasse en FM på en persons data (e-mails, tekster, dokumenter, de har skrevet) for at tilpasse modellen til deres unikke stil. Dette kan aktivere mere personlige applikationer.

- Lav-ressource sprogindstilling – Du kan kun omskole de øverste lag af en flersproget FM på et lavressource-sprog for bedre at tilpasse det til det sprog.

- Udbedring af fejl – Hvis bestemt utilsigtet adfærd opdages i en model, kan tilpasning på passende data hjælpe med at opdatere modellen for at reducere disse fejl.

Modeltilpasning hjælper med at overvinde følgende FM-udfordringer:

- Tilpasning til nye domæner og opgaver – FM'er, der er foruddannet i generelle tekstkorpus, skal ofte finjusteres på opgavespecifikke data for at fungere godt til downstream-applikationer. Finjustering tilpasser modellen til nye domæner eller opgaver, den ikke oprindeligt blev trænet i.

- Overvinde bias – FM'er kan udvise skævheder fra deres oprindelige træningsdata. Tilpasning af en model på nye data kan reducere uønskede skævheder i modellens output.

- Forbedring af beregningseffektiviteten – Foruddannede FM'er er ofte meget store og beregningsmæssigt dyre. Modeltilpasning kan tillade nedskæring af modellen ved at beskære uvigtige parametre, hvilket gør implementeringen mere gennemførlig.

- Håndtering af begrænsede måldata – I nogle tilfælde er der begrænsede virkelige data tilgængelige for målopgaven. Modeltilpasning bruger de fortrænede vægte, der er lært på større datasæt, for at overvinde denne dataknaphed.

- Forbedring af opgavens udførelse – Finjustering forbedrer næsten altid ydeevnen på målopgaver sammenlignet med at bruge de originale fortrænede vægte. Denne optimering af modellen til dens tilsigtede brug giver dig mulighed for at implementere FM'er med succes i rigtige applikationer.

Modeltilpasning har højere kompleksitet end prompt engineering og RAG, fordi modellens vægt og parametre ændres via tuning-scripts, hvilket kræver datavidenskab og ML-ekspertise. Amazon Bedrock gør det dog ligetil ved at give dig en administreret oplevelse at tilpasse modeller med finjustering or fortsat fortræning. Modeltilpasning giver meget nøjagtige resultater med sammenlignelig kvalitet end RAG. Fordi du opdaterer modelvægte på domænespecifikke data, producerer modellen mere kontekstuelle svar. Sammenlignet med RAG kan kvaliteten være marginalt bedre afhængigt af brugssituationen. Derfor er det vigtigt at foretage en afvejningsanalyse mellem de to teknikker. Du kan potentielt implementere RAG med en tilpasset model.

Genoptræning eller træning fra bunden

Opbygning af din egen grundlæggende AI-model i stedet for udelukkende at bruge forudtrænede offentlige modeller giver mulighed for større kontrol, forbedret ydeevne og tilpasning til din organisations specifikke use cases og data. Investering i at skabe en skræddersyet FM kan give bedre tilpasningsevne, opgraderinger og kontrol over kapaciteter. Distribueret træning muliggør den skalerbarhed, der er nødvendig for at træne meget store FM'er på massive datasæt på tværs af mange maskiner. Denne parallelisering gør modeller med hundredvis af milliarder af parametre trænet på billioner af tokens mulige. Større modeller har større kapacitet til at lære og generalisere.

Træning fra bunden kan give resultater af høj kvalitet, fordi modellen træner i brugs-case-specifikke data fra bunden, chancerne for hallucinationer er sjældne, og nøjagtigheden af output kan være blandt de højeste. Men hvis dit datasæt hele tiden udvikler sig, kan du stadig løbe ind i hallucinationsproblemer. Træning fra bunden har den højeste implementeringskompleksitet og -omkostninger. Det kræver den største indsats, fordi det kræver at indsamle en enorm mængde data, kuratere og behandle dem og træne en ret stor FM, hvilket kræver dyb datavidenskab og ML-ekspertise. Denne tilgang er tidskrævende (det kan typisk tage uger til måneder).

Du bør overveje at træne en FM fra bunden, når ingen af de andre tilgange virker for dig, og du har evnen til at opbygge en FM med en stor mængde velkurerede tokeniserede data, et sofistikeret budget og et team af højtuddannede ML-eksperter . AWS leverer den mest avancerede cloud-infrastruktur til at træne og køre LLM'er og andre FM'er drevet af GPU'er og den specialbyggede ML-træningschip, AWS Trainium, og ML-inferensaccelerator, AWS-inferens. For flere detaljer om uddannelse af LLM'er på SageMaker, se Træning af store sprogmodeller på Amazon SageMaker: Bedste praksis , SageMaker HyperPod.

Valg af den rigtige tilgang til udvikling af generative AI-applikationer

Når de udvikler generative AI-applikationer, skal organisationer nøje overveje flere nøglefaktorer, før de vælger den bedst egnede model til at opfylde deres behov. En række aspekter bør overvejes, såsom omkostninger (for at sikre, at den valgte model stemmer overens med budgetbegrænsninger), kvalitet (for at levere sammenhængende og faktuelt nøjagtige output), problemfri integration med nuværende virksomhedsplatforme og arbejdsgange og reducere hallucinationer eller generere falsk information . Med mange tilgængelige muligheder vil det at tage sig tid til grundigt at evaluere disse aspekter hjælpe organisationer med at vælge den generative AI-model, der bedst opfylder deres specifikke krav og prioriteter. Du bør undersøge følgende faktorer nøje:

- Integration med virksomhedssystemer – For at FM'er virkelig kan være nyttige i en virksomhedssammenhæng, skal de integrere og interoperere med eksisterende forretningssystemer og arbejdsgange. Dette kunne involvere adgang til data fra databaser, enterprise resource planning (ERP) og customer relationship management (CRM) samt udløsning af handlinger og arbejdsgange. Uden ordentlig integration risikerer FM at være et isoleret værktøj. Virksomhedssystemer som ERP indeholder vigtige forretningsdata (kunder, produkter, ordrer). FM skal være forbundet til disse systemer for at bruge virksomhedsdata i stedet for at arbejde ud fra sin egen vidensgraf, som kan være unøjagtig eller forældet. Dette sikrer nøjagtighed og en enkelt kilde til sandhed.

- Hallucinationer – Hallucinationer er, når en AI-applikation genererer falsk information, der virker faktuel. Disse skal behandles omhyggeligt, før FM'er bliver bredt vedtaget. For eksempel kan en medicinsk chatbot designet til at give diagnoseforslag hallucinere detaljer om en patients symptomer eller sygehistorie, hvilket får den til at foreslå en unøjagtig diagnose. Forebyggelse af skadelige hallucinationer som disse gennem tekniske løsninger og datasætkurering vil være afgørende for at sikre, at disse FM'er kan have tillid til følsomme applikationer som sundhedspleje, finans og juridisk. Grundig test og gennemsigtighed om en FM's træningsdata og resterende fejl skal ledsage implementeringer.

- Færdigheder og ressourcer – En vellykket indførelse af FM'er vil i høj grad afhænge af at have de rette færdigheder og ressourcer til at bruge teknologien effektivt. Organisationer har brug for medarbejdere med stærke tekniske færdigheder til korrekt at implementere, tilpasse og vedligeholde FM'er, så de passer til deres specifikke behov. De kræver også rigelige beregningsressourcer som avanceret hardware og cloud computing-funktioner til at køre komplekse FM'er. For eksempel har et marketingteam, der ønsker at bruge en FM til at generere reklametekster og opslag på sociale medier, brug for dygtige ingeniører til at integrere systemet, annoncemateriale til at give prompter og vurdere outputkvalitet og tilstrækkelig cloud computing-kraft til at implementere modellen omkostningseffektivt. Investering i udvikling af ekspertise og teknisk infrastruktur vil gøre det muligt for organisationer at opnå reel forretningsværdi ved at anvende FM'er.

- Output kvalitet – Kvaliteten af output produceret af FM'er vil være afgørende for deres vedtagelse og brug, især i forbrugervendte applikationer som chatbots. Hvis chatbots drevet af FM'er giver svar, der er unøjagtige, meningsløse eller upassende, vil brugerne hurtigt blive frustrerede og stoppe med at interagere med dem. Derfor skal virksomheder, der ønsker at implementere chatbots, nøje teste de FM'er, der driver dem, for at sikre, at de konsekvent genererer højkvalitetssvar, der er nyttige, relevante og passende til at give en god brugeroplevelse. Outputkvalitet omfatter faktorer som relevans, nøjagtighed, sammenhæng og hensigtsmæssighed, som alle bidrager til den overordnede brugertilfredshed og vil gøre eller bryde vedtagelsen af FM'er som dem, der bruges til chatbots.

- Koste – Den høje beregningskraft, der kræves for at træne og køre store AI-modeller som FM'er, kan medføre betydelige omkostninger. Mange organisationer mangler måske de økonomiske ressourcer eller cloud-infrastruktur, der er nødvendig for at bruge så massive modeller. Derudover tilføjer integration og tilpasning af FM'er til specifikke anvendelsestilfælde tekniske omkostninger. De betydelige udgifter, der kræves for at bruge FM'er, kan afskrække udbredt adoption, især blandt mindre virksomheder og startups med begrænsede budgetter. Evaluering af potentielle investeringsafkast og afvejning af omkostninger i forhold til fordele ved FM'er er afgørende for organisationer, der overvejer deres anvendelse og nytte. Omkostningseffektivitet vil sandsynligvis være en afgørende faktor for at bestemme, om og hvordan disse kraftfulde, men ressourcekrævende modeller kan implementeres.

Design beslutning

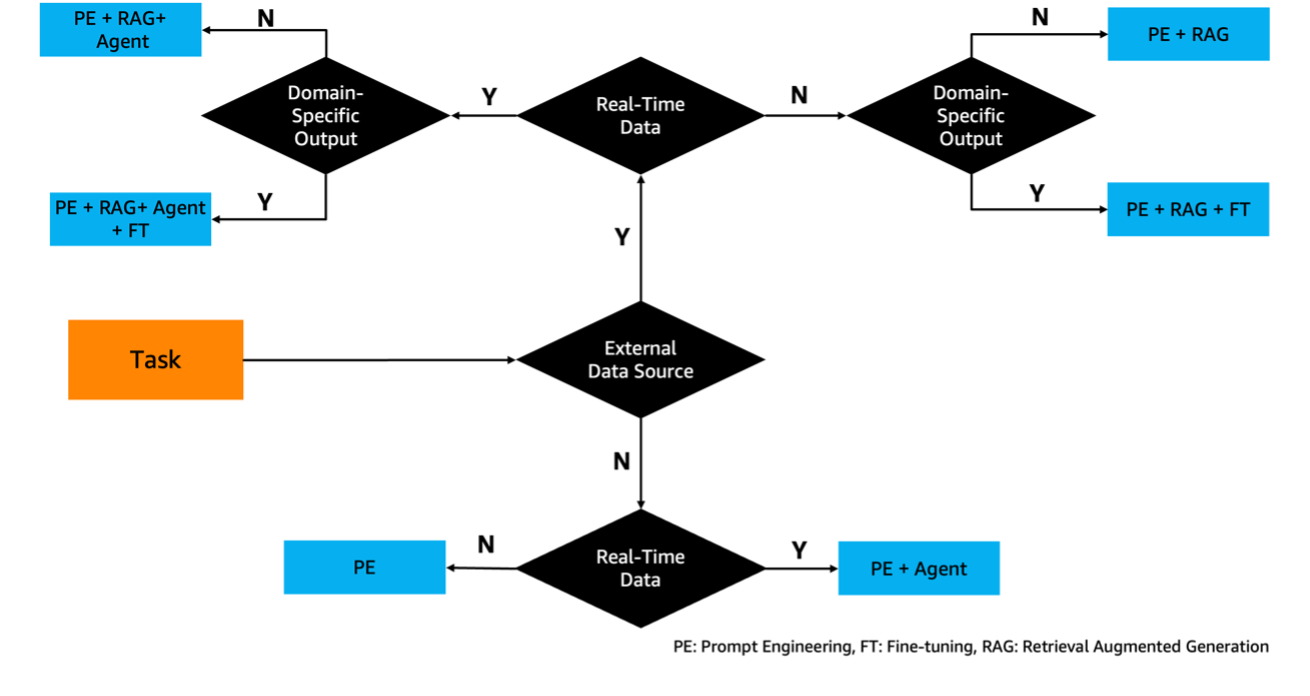

Som vi dækkede i dette indlæg, er mange forskellige AI-teknikker tilgængelige i øjeblikket, såsom prompt engineering, RAG og modeltilpasning. Denne brede vifte af valgmuligheder gør det udfordrende for virksomheder at bestemme den optimale tilgang til deres særlige anvendelsestilfælde. Valg af det rigtige sæt af teknikker afhænger af forskellige faktorer, herunder adgang til eksterne datakilder, realtidsdatafeeds og domænespecificiteten af den påtænkte applikation. For at hjælpe med at identificere den bedst egnede teknik baseret på de involverede use case og overvejelser, gennemgår vi følgende flowdiagram, som skitserer anbefalinger til at matche specifikke behov og begrænsninger med passende metoder.

For at få en klar forståelse, lad os gennemgå designbeslutningsflowdiagrammet ved hjælp af et par illustrative eksempler:

- Virksomhedssøgning – En medarbejder ønsker at anmode om orlov fra deres organisation. For at give et svar, der er tilpasset organisationens HR-politikker, har FM brug for mere kontekst ud over sin egen viden og evner. Konkret kræver FM adgang til eksterne datakilder, der giver relevante HR-retningslinjer og politikker. I betragtning af dette scenarie med en medarbejderanmodning, der kræver henvisning til eksterne domænespecifikke data, er den anbefalede tilgang i henhold til flowdiagrammet hurtig udvikling med RAG. RAG vil hjælpe med at levere de relevante data fra de eksterne datakilder som kontekst til FM.

- Virksomhedssøgning med organisationsspecifikt output – Antag, at du har tekniske tegninger, og du vil udtrække styklisten fra dem ved at formatere output i henhold til industristandarder. For at gøre dette kan du bruge en teknik, der kombinerer prompt engineering med RAG og en finjusteret sprogmodel. Den finjusterede model vil blive trænet til at producere styklister, når de får tekniske tegninger som input. RAG hjælper med at finde de mest relevante ingeniørtegninger fra organisationens datakilder til feed i konteksten for FM. Overordnet set udtrækker denne tilgang styklister fra ingeniørtegninger og strukturerer outputtet passende for ingeniørdomænet.

- Generel søgning - Forestil dig, at du vil finde identiteten på USA's 30. præsident. Du kan bruge prompt engineering til at få svaret fra en FM. Fordi disse modeller er trænet på mange datakilder, kan de ofte give nøjagtige svar på faktuelle spørgsmål som dette.

- Generel søgning med seneste begivenheder – Hvis du vil bestemme den aktuelle aktiekurs for Amazon, kan du bruge fremgangsmåden med hurtig ingeniørarbejde med en agent. Agenten vil give FM den seneste aktiekurs, så den kan generere det faktuelle svar.

Konklusion

Generativ AI tilbyder et enormt potentiale for organisationer til at drive innovation og øge produktiviteten på tværs af en række applikationer. En succesfuld indførelse af disse nye AI-teknologier kræver dog, at der tages fat på vigtige overvejelser omkring integration, outputkvalitet, færdigheder, omkostninger og potentielle risici som skadelige hallucinationer eller sikkerhedssårbarheder. Organisationer er nødt til at tage en systematisk tilgang til at evaluere deres use case-krav og begrænsninger for at bestemme de mest passende teknikker til tilpasning og anvendelse af FM'er. Som fremhævet i dette indlæg har hurtig konstruktion, RAG og effektive modeltilpasningsmetoder hver deres egne styrker og svagheder, der passer til forskellige scenarier. Ved at kortlægge virksomhedens behov til AI-kapaciteter ved hjælp af en struktureret ramme, kan organisationer overvinde forhindringer for implementering og begynde at realisere fordele fra FM'er, mens de også bygger autoværn til at håndtere risici. Med tankevækkende planlægning baseret på eksempler fra den virkelige verden står virksomheder i alle brancher til at låse op for enorm værdi fra denne nye bølge af generativ kunstig intelligens. Lære om generativ AI på AWS.

Om forfatterne

Jay Rao er Principal Solutions Architect hos AWS. Han fokuserer på AI/ML-teknologier med en stor interesse for Generativ AI og Computer Vision. Hos AWS nyder han at give teknisk og strategisk vejledning til kunder og hjælpe dem med at designe og implementere løsninger, der driver forretningsresultater. Han er bogforfatter (Computer Vision på AWS), udgiver jævnligt blogs og kodeeksempler og har holdt foredrag på teknologikonferencer som AWS re:Invent.

Jay Rao er Principal Solutions Architect hos AWS. Han fokuserer på AI/ML-teknologier med en stor interesse for Generativ AI og Computer Vision. Hos AWS nyder han at give teknisk og strategisk vejledning til kunder og hjælpe dem med at designe og implementere løsninger, der driver forretningsresultater. Han er bogforfatter (Computer Vision på AWS), udgiver jævnligt blogs og kodeeksempler og har holdt foredrag på teknologikonferencer som AWS re:Invent.

Babu Kariyaden Parambath er Senior AI/ML Specialist hos AWS. Hos AWS nyder han at arbejde med kunder om at hjælpe dem med at identificere den rigtige business use case med forretningsværdi og løse den ved hjælp af AWS AI/ML-løsninger og -tjenester. Før han kom til AWS, var Babu en AI-evangelist med 20 års forskelligartet brancheerfaring med at levere AI-drevet forretningsværdi til kunderne.

Babu Kariyaden Parambath er Senior AI/ML Specialist hos AWS. Hos AWS nyder han at arbejde med kunder om at hjælpe dem med at identificere den rigtige business use case med forretningsværdi og løse den ved hjælp af AWS AI/ML-løsninger og -tjenester. Før han kom til AWS, var Babu en AI-evangelist med 20 års forskelligartet brancheerfaring med at levere AI-drevet forretningsværdi til kunderne.

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk dig selv. Adgang her.

- PlatoAiStream. Web3 intelligens. Viden forstærket. Adgang her.

- PlatoESG. Kulstof, CleanTech, Energi, Miljø, Solenergi, Affaldshåndtering. Adgang her.

- PlatoHealth. Bioteknologiske og kliniske forsøgs intelligens. Adgang her.

- Kilde: https://aws.amazon.com/blogs/machine-learning/best-practices-to-build-generative-ai-applications-on-aws/

- :har

- :er

- :ikke

- :hvor

- 1

- 100

- 116

- 20

- 20 år

- 2017

- 2022

- 30.

- 7

- a

- evne

- I stand

- Om

- accelerator

- adgang

- Adgang

- ledsage

- Ifølge

- Konto

- nøjagtighed

- præcis

- præcist

- opnå

- tværs

- handler

- aktioner

- faktiske

- tilpasse

- tilpasning

- tilpasse

- tilpasser

- tilføje

- Yderligere

- Derudover

- adresse

- rettet

- adresser

- adressering

- Tilføjer

- tilstrækkeligt

- vedtage

- vedtaget

- Vedtagelsen

- Vedtagelse

- fremskreden

- fremgang

- fordele

- Reklame

- Agent

- midler

- AI

- AI modeller

- ai forskning

- AI-drevne

- AI / ML

- Støtte

- målsætninger

- AL

- tilpasse

- justeret

- Justerer

- Alle

- tillade

- tillade

- tillader

- næsten

- alene

- også

- Skønt

- altid

- Amazon

- Amazon Kendra

- Amazon SageMaker

- Amazon SageMaker JumpStart

- Amazon Web Services

- blandt

- blandt

- beløb

- an

- analyse

- ,

- og infrastruktur

- besvare

- besvarelse

- svar

- Antropisk

- enhver

- api

- API'er

- app

- kommer til syne

- Anvendelse

- applikationer

- Anvendelse

- tilgang

- tilgange

- passende

- passende

- arkitektur

- ER

- opstå

- omkring

- artikler

- AS

- aspekter

- vurdere

- Assistant

- forbundet

- At

- forøge

- augmented

- forfatter

- Automatiseret

- automater

- automatisk

- autonomt

- til rådighed

- AWS

- AWS re: Invent

- bund

- baseret

- BE

- fordi

- bliver

- før

- begynde

- adfærd

- adfærd

- være

- benchmark

- fordele

- BEDSTE

- bedste praksis

- Bedre

- mellem

- Beyond

- fordomme

- Bill

- milliarder

- Sedler

- biomedicinsk

- blogs

- bog

- booking

- boost

- både

- brand

- Pause

- Breaking

- pauser

- bred

- bredere

- budget

- Budgetter

- bygge

- Bygning

- bygget

- indbygget

- virksomhed

- virksomheder

- men

- by

- ringer

- CAN

- Kan få

- kapaciteter

- kapacitet

- stand

- Kapacitet

- omhyggeligt

- bære

- tilfælde

- tilfælde

- vis

- udfordre

- udfordringer

- udfordrende

- odds

- lave om

- ændret

- Ændringer

- skiftende

- tegn

- Chart

- chatbot

- chatbots

- chip

- valg

- valg

- Vælg

- klassificering

- Rengøring

- klar

- nøje

- Cloud

- cloud computing

- sky infrastruktur

- kode

- Kodning

- SAMMENHÆNGENDE

- Indsamling

- kombinerer

- kombinerer

- Kom

- kommer

- Fælles

- Virksomheder

- selskab

- Selskabs

- sammenlignelig

- sammenlignet

- fuldføre

- komplekse

- kompleksitet

- Compliance

- komponenter

- forstå

- beregningsmæssige

- computerkraft

- beregningsmæssigt

- Compute

- computer

- Computer Vision

- computing

- computerkraft

- Adfærd

- konferencer

- Tilslut

- tilsluttet

- Connectivity

- Overvej

- betydelig

- overvejelser

- betragtes

- Overvejer

- konsekvent

- Konsol

- konstant

- begrænsninger

- forbrug

- indeholder

- indhold

- Indholdsgenerering

- sammenhæng

- sammenhænge

- kontekstuelle

- fortsæt

- fortsatte

- bidrage

- kontrol

- konversation

- samtaler

- kopiere

- Core

- Koste

- Omkostninger

- kunne

- dæksel

- dækning

- dækket

- skabe

- Oprettelse af

- Kreativ

- reklamer

- kritisk

- CRM

- afgørende

- curating

- datasikring

- Nuværende

- For øjeblikket

- skik

- kunde

- Kundeoplevelse

- Kunder

- tilpasning

- tilpasse

- tilpassede

- data

- databeskyttelse

- Databeskyttelse og sikkerhed

- databehandling

- datalogi

- databaser

- datasæt

- beskæftiger

- Beslutter

- beslutning

- dyb

- Degree

- levere

- leveret

- leverer

- Efterspørgsel

- demonstrere

- afhænge

- Afhængigt

- afhænger

- indsætte

- indsat

- implementering

- implementeringer

- Design

- konstrueret

- designe

- ønskes

- detaljer

- Bestem

- bestemmelse

- udvikle

- Udvikler

- udviklere

- udvikling

- Udvikling

- diagnose

- forskellige

- svært

- direkte

- opdaget

- diskutere

- distribueret

- distribueret træning

- forskelligartede

- do

- dokumenter

- Er ikke

- dollars

- domæne

- Domæner

- ned

- Tegninger

- køre

- drevet

- grund

- i løbet af

- dynamisk

- E&T

- hver

- nemt

- Effektiv

- effektivt

- effektivitet

- effektiv

- effektivt

- indsats

- elementer

- berettiget

- eliminere

- emails

- indlejring

- fremkomsten

- smergel

- Medarbejder

- medarbejdere

- bemyndigelse

- muliggøre

- muliggør

- muliggør

- vedrører generelt

- kryptere

- krypteret

- ende

- ende til ende

- engagerende

- Engine (Motor)

- Engineering

- Ingeniører

- forbedre

- berigende

- sikre

- sikrer

- sikring

- Enterprise

- enheder

- enhed

- Miljø

- miljøer

- udstyre

- ERP

- især

- etablere

- evaluere

- evaluere

- Evangelist

- Hver

- at alt

- udviklende

- undersøge

- eksempel

- eksempler

- spændende

- udstille

- eksisterende

- udgifter

- dyrt

- erfaring

- eksperimenter

- ekspert

- ekspertise

- eksperter

- udforske

- strækker

- ekstern

- ekstrakt

- Uddrag

- ekstremt

- Ansigtet

- faktor

- faktorer

- fakta

- FAIL

- retfærdigt

- Fall

- falsk

- gennemførlig

- få

- finansiere

- finansielle

- Finde

- fund

- fem

- fejl

- Fleksibilitet

- fly

- flow

- Fokus

- fokuserer

- efter

- Til

- Foundation

- grundlæggende

- Framework

- rammer

- hyppigt

- fra

- frustrerede

- Opfylde

- fuld

- fuldt ud

- yderligere

- Gevinst

- kløft

- samle

- GDPR

- Generelt

- generelle formål

- generere

- genereret

- genererer

- generere

- generation

- generative

- Generativ AI

- få

- Giv

- given

- Go

- godt

- regeringsførelse

- GPU'er

- graf

- stor

- større

- Ground

- jordet

- vejledning

- vejlede

- retningslinjer

- Håndterer

- Hardware

- skadelig

- seletøj

- Have

- have

- he

- sundhedspleje

- stærkt

- hjælpe

- hjælpsom

- hjælpe

- hjælper

- Høj

- højtydende

- høj kvalitet

- højere

- højeste

- højeste grad

- Fremhævet

- stærkt

- historie

- Hvordan

- How To

- Men

- hr

- HTML

- HTTPS

- Hub

- Hundreder

- Hurdles

- Tuning af hyperparameter

- idé

- ideer

- identificere

- identificere

- Identity

- if

- billede

- enorme

- KIMOs Succeshistorier

- effektfuld

- Påvirkninger

- gennemføre

- implementering

- vigtigt

- Forbedre

- forbedret

- forbedrer

- forbedring

- in

- forkert

- Herunder

- uafhængigt

- angiver

- industrien

- industristandarder

- oplysninger

- Infrastruktur

- Innovation

- innovationer

- indgang

- indsigt

- inspirere

- Institut

- anvisninger

- integrere

- Integration

- integration

- beregnet

- interagere

- interesse

- interessant

- grænseflade

- interne

- Internet

- interoperere

- ind

- introduceret

- opgørelse

- investere

- investering

- involvere

- involverede

- involverer

- isolerede

- spørgsmål

- IT

- ITS

- sammenføjning

- lige

- Keen

- Nøgle

- nøgler

- viden

- Viden Graph

- kender

- Labs

- Mangel

- Sprog

- Sprog

- stor

- større

- lag

- føre

- førende

- LÆR

- lærte

- læring

- Forlade

- Politikker

- Lets

- LG

- ligesom

- Sandsynlig

- begrænsninger

- Limited

- linjer

- Llama

- logik

- logisk

- leder

- Lav

- maskine

- machine learning

- Maskiner

- vedligeholde

- lave

- maerker

- Making

- administrere

- lykkedes

- ledelse

- manuel

- mange

- kortlægning

- Marketing

- massive

- massivt

- matchende

- materialer

- Kan..

- Medier

- medicinsk

- Mød

- Meta

- metode

- metoder

- måske

- millioner

- minimere

- ML

- model

- modeller

- måned

- mere

- mest

- flytning

- skal

- Natural

- nødvendig

- Behov

- behov

- behøve

- behov

- negativ

- Ny

- næste generation

- Ingen

- nu

- of

- off

- Tilbud

- tit

- on

- ONE

- kun

- Produktion

- Muligheder

- optimal

- optimering

- Indstillinger

- or

- orkestrering

- ordrer

- ordrer

- organisation

- organisatorisk

- organisationer

- original

- oprindeligt

- Andet

- ud

- udfald

- forældet

- konturer

- udkonkurrerer

- output

- udgange

- i løbet af

- samlet

- Overvind

- oversigt

- egen

- par

- papirer

- parametre

- særlig

- især

- passager

- forbi

- Udfør

- ydeevne

- forestillinger

- personale

- Personlig

- sætninger

- stykker

- pipeline

- planlægning

- Platforme

- plato

- Platon Data Intelligence

- PlatoData

- grund

- punkter

- politikker

- Populær

- mulig

- Indlæg

- Indlæg

- potentiale

- potentielt

- magt

- strøm

- vigtigste

- Praktisk

- praksis

- praksis

- forud

- præferencer

- præsident

- forebyggelse

- tidligere

- pris

- prissætning

- Main

- Forud

- Beskyttelse af personlige oplysninger

- Privatliv og sikkerhed

- private

- Problem

- problemer

- behandle

- forarbejdning

- producere

- produceret

- producerer

- produktivitet

- Produkter

- Profil

- Programmering

- fremmer

- prompter

- passende

- korrekt

- foreslå

- proprietære

- give

- udbydere

- giver

- leverer

- offentlige

- offentliggjort

- Udgiver

- trækker

- køb

- indkøbsordre

- kvalitet

- forespørgsler

- spørgsmål

- Spørgsmål

- hurtigt

- klud

- rækkevidde

- hurtige

- hurtigt

- SJÆLDEN

- hellere

- Raw

- RE

- Reagerer

- ægte

- reel værdi

- virkelige verden

- realtid

- data i realtid

- realisere

- nylige

- anerkendelse

- Anbefaling

- anbefalinger

- anbefales

- reducere

- reducere

- henvise

- regelmæssigt

- forhold

- relevans

- relevant

- stole

- resterende

- bemærkelsesværdig

- Rapporter

- omdømme

- anmode

- anmodninger

- kræver

- påkrævet

- Krav

- Kræver

- krævet

- forskning

- ressource

- ressourceintensive

- Ressourcer

- Svar

- svar

- reaktioner

- REST

- Resultater

- hentning

- afkast

- indtægter

- Anmeldelser

- højre

- risici

- rutine

- Kør

- kører

- sikrere

- sagemaker

- samme

- tilfredshed

- Skalerbarhed

- skalerbar

- Scale

- Mangel

- scenarie

- scenarier

- Videnskab

- forskere

- ridse

- scripts

- sømløs

- Søg

- Sektion

- sikkert

- sikkerhed

- sikkerhedsrisici

- valgt

- udvælgelse

- valg

- senior

- følsom

- stemningen

- følelser

- Serverless

- tjener

- tjeneste

- Tjenester

- servering

- Session

- sæt

- sæt

- indstillinger

- flere

- Shape

- delt

- Kort

- bør

- Shows

- signifikant

- betydeligt

- lignende

- Simpelt

- enkelt

- faglært

- færdigheder

- mindre

- So

- Social

- sociale medier

- Indlæg på sociale medier

- Alene

- solid

- løsninger

- Løsninger

- SOLVE

- Løsning

- nogle

- sofistikeret

- Kilde

- Kilder

- specialist

- specialisere

- specialiserede

- specialiseret

- specifikke

- specifikt

- specificitet

- Stabilitet

- stå

- standarder

- starte

- påbegyndt

- Nystartede

- Stater

- Trin

- Steps

- Stadig

- bestand

- Stands

- butik

- forhandler

- Historier

- Story

- ligetil

- Strategisk

- styrker

- stærk

- struktur

- struktureret

- strukturer

- stil

- væsentlig

- vellykket

- Succesfuld

- sådan

- tilstrækkeligt

- tyder

- Dragt

- egnede

- Tillæg

- forsyne

- support

- Understøtter

- sikker

- Symptomer

- systemet

- Systemer

- tackle

- skræddersyet

- Tag

- tager

- Talent

- taler

- Talks

- Tryk på

- mål

- Opgaver

- opgaver

- hold

- tech

- Teknisk

- tekniske færdigheder

- teknik

- teknikker

- Teknologier

- Teknologier

- Teknologiinnovation

- skabelon

- terminologi

- prøve

- Test

- tekst

- Tekstklassificering

- end

- at

- oplysninger

- deres

- Them

- derefter

- Der.

- derfor

- Disse

- de

- tror

- tredjepart

- denne

- grundig

- grundigt

- dem

- tusinder

- tre

- Gennem

- tid

- tidskrævende

- til

- tokeniseret

- Tokens

- værktøj

- værktøjer

- top

- emne

- Emner

- mod

- Trafik

- Tog

- uddannet

- Kurser

- transit

- Oversættelse

- Gennemsigtighed

- enorm

- udløsning

- billioner

- virkelig

- Stol

- betroet

- troværdig

- Sandheden

- tuning

- TUR

- tweaking

- to

- typisk

- ude af stand

- forstå

- forståelse

- enestående

- Forenet

- Forenede Stater

- låse

- uudnyttet

- uønsket

- up-to-date

- Opdatering

- opdateret

- opdatering

- opgraderinger

- brug

- brug tilfælde

- anvendte

- nyttigt

- Bruger

- Brugererfaring

- brugere

- bruger

- ved brug af

- nytte

- VALIDATE

- værdi

- række

- forskellige

- Vast

- langt

- meget

- via

- vision

- visuel

- vs

- Sårbarheder

- gå

- ønsker

- ønsker

- var

- Wave

- Vej..

- we

- svagheder

- web

- webservices

- uger

- vejning

- vægt

- GODT

- Hvad

- hvornår

- ud fra følgende betragtninger

- hvorvidt

- som

- mens

- bred

- Bred rækkevidde

- bredt

- udbredt

- Wikipedia

- vilje

- med

- inden for

- uden

- Arbejde

- workflow

- arbejdsgange

- arbejder

- ville

- skriver

- skrivning

- skriftlig

- år

- Udbytte

- Du

- Din

- zephyrnet