Efterhånden som teknologier til kunstig intelligens (AI) og Machine Learning (ML) er blevet mainstream, har mange virksomheder haft succes med at bygge kritiske forretningsapplikationer drevet af ML-modeller i stor skala i produktionen. Men da disse ML-modeller træffer kritiske forretningsbeslutninger for virksomheden, er det vigtigt for virksomheder at tilføje ordentlige autoværn gennem deres ML-livscyklus. Guardrails sikrer, at sikkerheden, privatlivets fred og kvaliteten af koden, konfigurationen og data- og modelkonfigurationen, der bruges i modellens livscyklus, er versioneret og bevaret.

Implementering af disse autoværn bliver sværere for virksomheder, fordi ML-processerne og aktiviteterne i virksomhederne bliver mere komplekse på grund af inddragelsen af dybt involverede processer, der kræver bidrag fra flere interessenter og personer. Ud over dataingeniører og dataforskere har der været inklusion af operationelle processer for at automatisere og strømline ML-livscyklussen. Derudover kræver stigningen af forretningsinteressenter og i nogle tilfælde juridiske og overholdelsesgennemgange kapaciteter til at tilføje gennemsigtighed til styring af adgangskontrol, aktivitetssporing og rapportering på tværs af ML-livscyklussen.

Den ramme, der giver systematisk synlighed i udvikling, validering og brug af ML-modeller, kaldes ML-governance. Under AWS re:Invent 2022, AWS introducerede nye ML-styringsværktøjer forum Amazon SageMaker som forenkler adgangskontrol og øger gennemsigtigheden over dine ML-projekter. Et af de tilgængelige værktøjer som en del af ML-styringen er Amazon SageMaker-modelkort, som har evnen til at skabe en enkelt kilde til sandhed for modelinformation ved at centralisere og standardisere dokumentation gennem hele modellens livscyklus.

SageMaker modelkort giver dig mulighed for at standardisere, hvordan modeller dokumenteres, og derved opnå synlighed i en models livscyklus, lige fra design, bygning, træning og evaluering. Modelkort er beregnet til at være en enkelt kilde til sandhed for forretningsmæssige og tekniske metadata om modellen, som pålideligt kan bruges til revisions- og dokumentationsformål. De giver et faktaark over den model, der er vigtig for modelstyring.

Når du skalerer dine modeller, projekter og teams, anbefaler vi som bedste praksis, at du vedtager en multikontostrategi, der giver projekt- og teamisolering til udvikling og implementering af ML-modeller. For mere information om forbedring af styringen af dine ML-modeller, se Forbedre styringen af dine maskinlæringsmodeller med Amazon SageMaker.

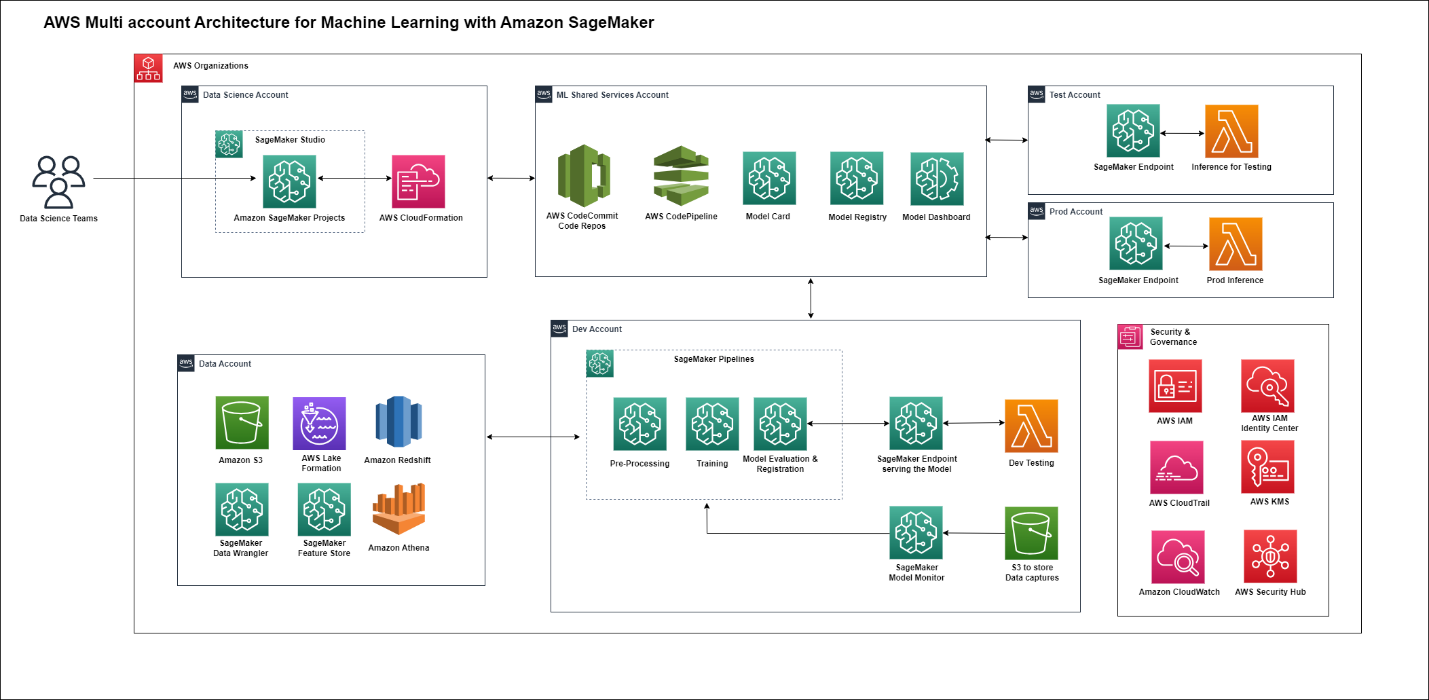

Arkitektur oversigt

Arkitekturen er implementeret som følger:

- Data Science Account - Data Scientists udfører deres eksperimenter i SageMaker Studio og opbygge en MLOps-opsætning til at implementere modeller til iscenesættelse/produktionsmiljøer ved hjælp af SageMaker projekter.

- ML Shared Services-konto – MLO'erne, der er oprettet fra Data Science-kontoen, udløser kontinuerlig integration og kontinuerlig levering (CI/CD) pipelines ved hjælp af AWS CodeCommit , AWS CodePipeline.

- Udviklerkonto – CI/CD-pipelines vil yderligere udløse ML-pipelines i denne konto, der dækker dataforbehandling, modeltræning og efterbehandling som modelevaluering og -registrering. Output af disse rørledninger vil implementere modellen i SageMaker-endepunkter at blive forbrugt til slutningsformål. Afhængigt af dine styringskrav kan Data Science & Dev-konti flettes til en enkelt AWS-konto.

- Datakonto – ML-pipelines, der kører i Dev-kontoen, trækker dataene fra denne konto.

- Test- og produktionskonti – CI/CD-pipelines fortsætter udrulningen efter Dev-kontoen for at konfigurere SageMaker-slutpunktskonfigurationen i disse konti.

- Sikkerhed og styring – Tjenester som AWS Identity and Access Management (IAM), AWS IAM Identity Center, AWS CloudTrail, AWS Key Management Service (AWS KMS), Amazon CloudWatch og AWS Security Hub vil blive brugt på tværs af disse konti som en del af sikkerhed og styring.

Følgende diagram illustrerer denne arkitektur.

For mere information om indstilling af skalerbar multi-konto ML-arkitektur, se MLOps-grundlag for virksomheder med Amazon SageMaker.

Vores kunder har brug for evnen til at dele modelkort på tværs af konti for at forbedre synlighed og styring af deres modeller gennem information, der deles på modelkortet. Nu, med deling af modelkort på tværs af konti, kan kunderne nyde fordelene ved multi-konto strategi, mens de har adgang til de tilgængelige modelkort i deres organisation, så de kan fremskynde samarbejdet og sikre styring.

I dette indlæg viser vi, hvordan du opsætter og får adgang til modelkort på tværs af Model Development Lifecycle (MDLC) konti ved hjælp af den nye funktion til deling på tværs af konti på modelkortet. Først vil vi beskrive et scenarie og en arkitektur for opsætning af funktionen til deling på tværs af konti på modelkortet, og derefter dykke dybt ned i hver komponent af, hvordan man opsætter og får adgang til delte modelkort på tværs af konti for at forbedre synlighed og modelstyring.

Løsningsoversigt

Når du bygger ML-modeller, anbefaler vi, at du opsætter en multi-konto-arkitektur for at give arbejdsbelastningsisolering, hvilket forbedrer sikkerheden, pålideligheden og skalerbarheden. For dette indlæg vil vi antage at bygge og implementere en model for Customer Churn use case. Arkitekturdiagrammet, der følger, viser en af de anbefalede tilgange – centraliseret modelkort – til styring af et modelkort i en multi-account Machine Learning Model-Development Lifecycle (MDLC) arkitektur. Du kan dog også bruge en anden tilgang, et nav-og-eger-modelkort. I dette indlæg vil vi kun fokusere på en centraliseret modelkorttilgang, men de samme principper kan udvides til en hub-and-spoke tilgang. Den største forskel er, at hver eger-konto vil opretholde deres egen version af modelkort, og den vil have processer til at samle og kopiere til en centraliseret konto.

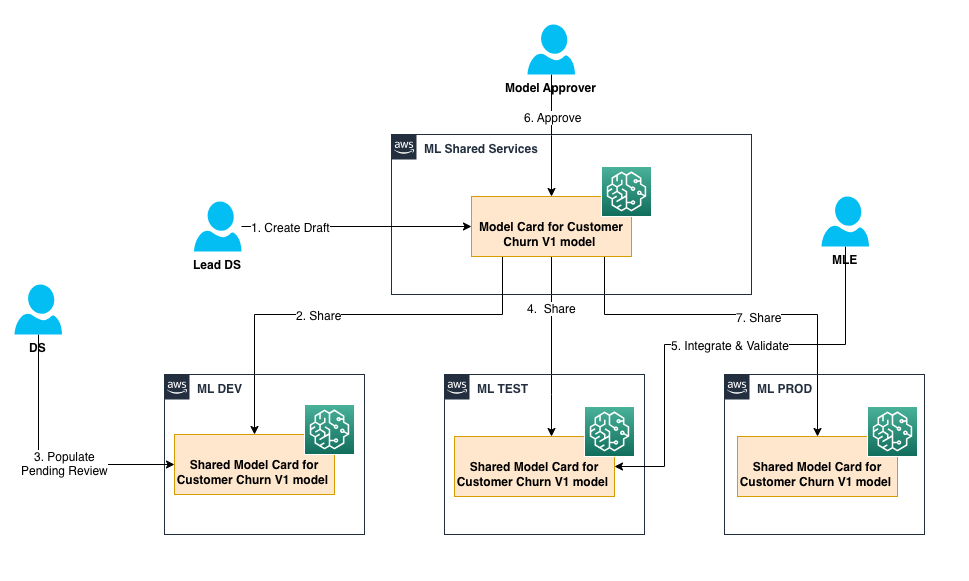

Følgende diagram illustrerer denne arkitektur.

Arkitekturen er implementeret som følger:

- Lead Data Scientist får besked om at løse Customer Churn-brugssagen ved hjælp af ML, og de starter ML-projektet ved at oprette et modelkort til Customer Churn V1-modellen i Draft-status i ML Shared Services-kontoen

- Gennem automatisering deles det modelkort med ML Dev Account

- Data Scientist bygger modellen og begynder at udfylde oplysninger via API'er i modelkortet baseret på deres eksperimenteringsresultater, og modelkortets status er indstillet til Afventer gennemgang

- Gennem automatisering deles det modelkort med ML-testkontoen

- ML Engineer (MLE) kører integrations- og valideringstest i ML testkonto og modellen i det centrale register er markeret Pending Approval

- Modelgodkender gennemgår modelresultaterne med den understøttende dokumentation i det centrale modelkort og godkender modelkortet til produktionsimplementering.

- Gennem automatisering deles det modelkort med ML Prod-kontoen i skrivebeskyttet tilstand.

Forudsætninger

Før du går i gang, skal du sørge for at have følgende forudsætninger:

- to AWS konti.

- I begge AWS-konti, en IAM-føderationsrolle med administratoradgang til at gøre følgende:

- Opret, rediger, se og slet modelkort i Amazon SageMaker.

- Opret, rediger, se og slet ressourceandel i AWS RAM.

For mere information henvises til Eksempel på IAM-politikker for AWS RAM.

Opsætning af modelkortdeling

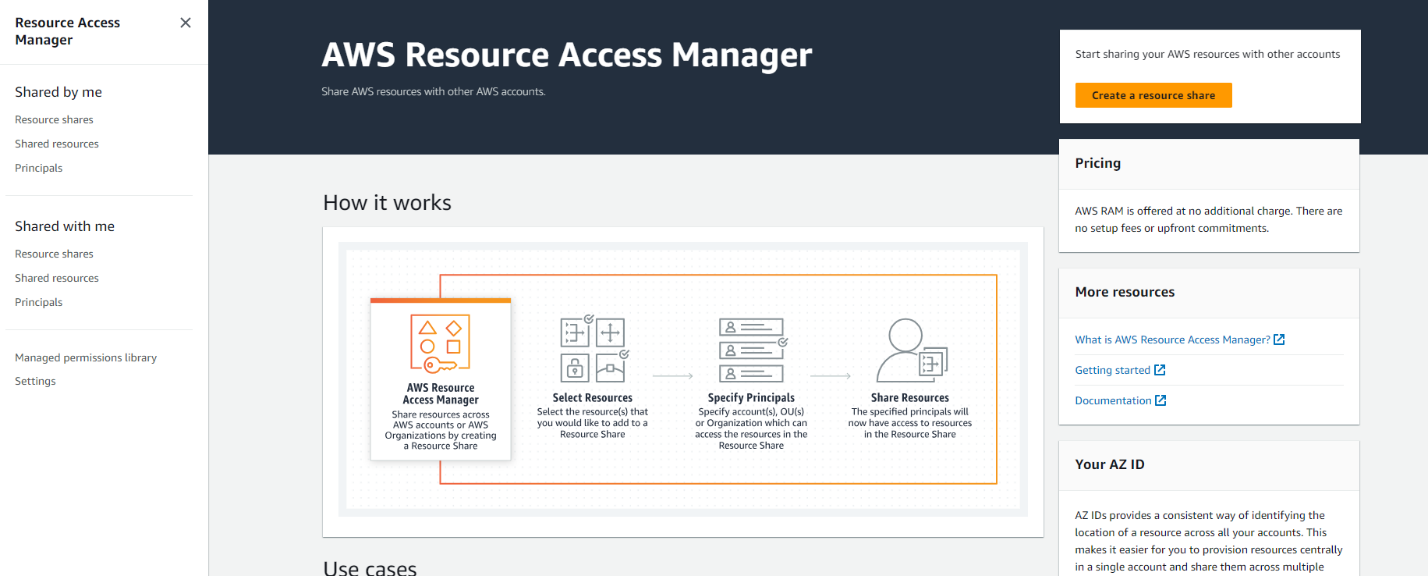

Den konto, hvor modelkortene oprettes, er modelkortkontoen. Brugere på modelkortkontoen deler dem med de delte konti, hvor de kan opdateres. Brugere på modelkortkontoen kan dele deres modelkort igennem AWS Resource Access Manager (AWS RAM). AWS RAM hjælper dig med at dele ressourcer på tværs af AWS-konti.

I det følgende afsnit viser vi, hvordan man deler modelkort.

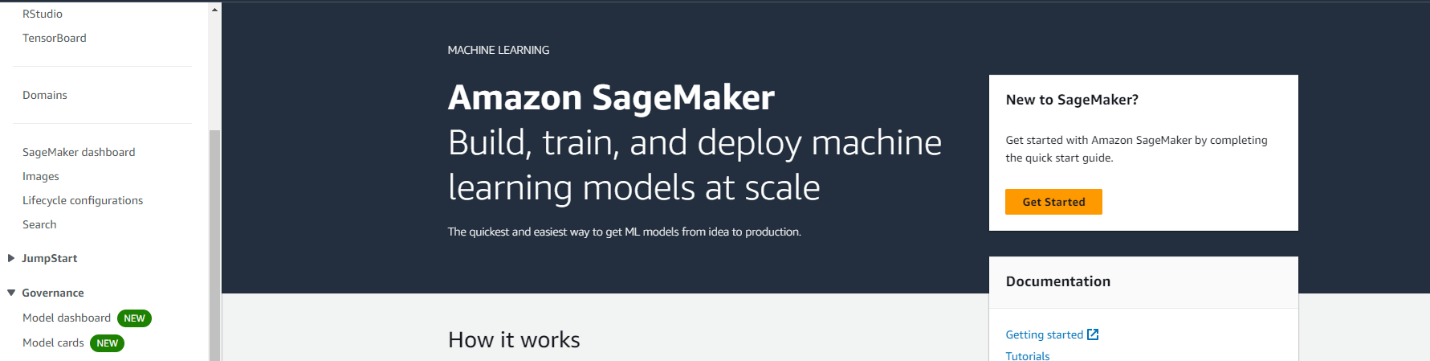

Først skal du oprette et modelkort til en Customer Churn-brugssag som tidligere beskrevet. På Amazon SageMaker-konsollen skal du udvide sektionen Governance og vælge Modelkort.

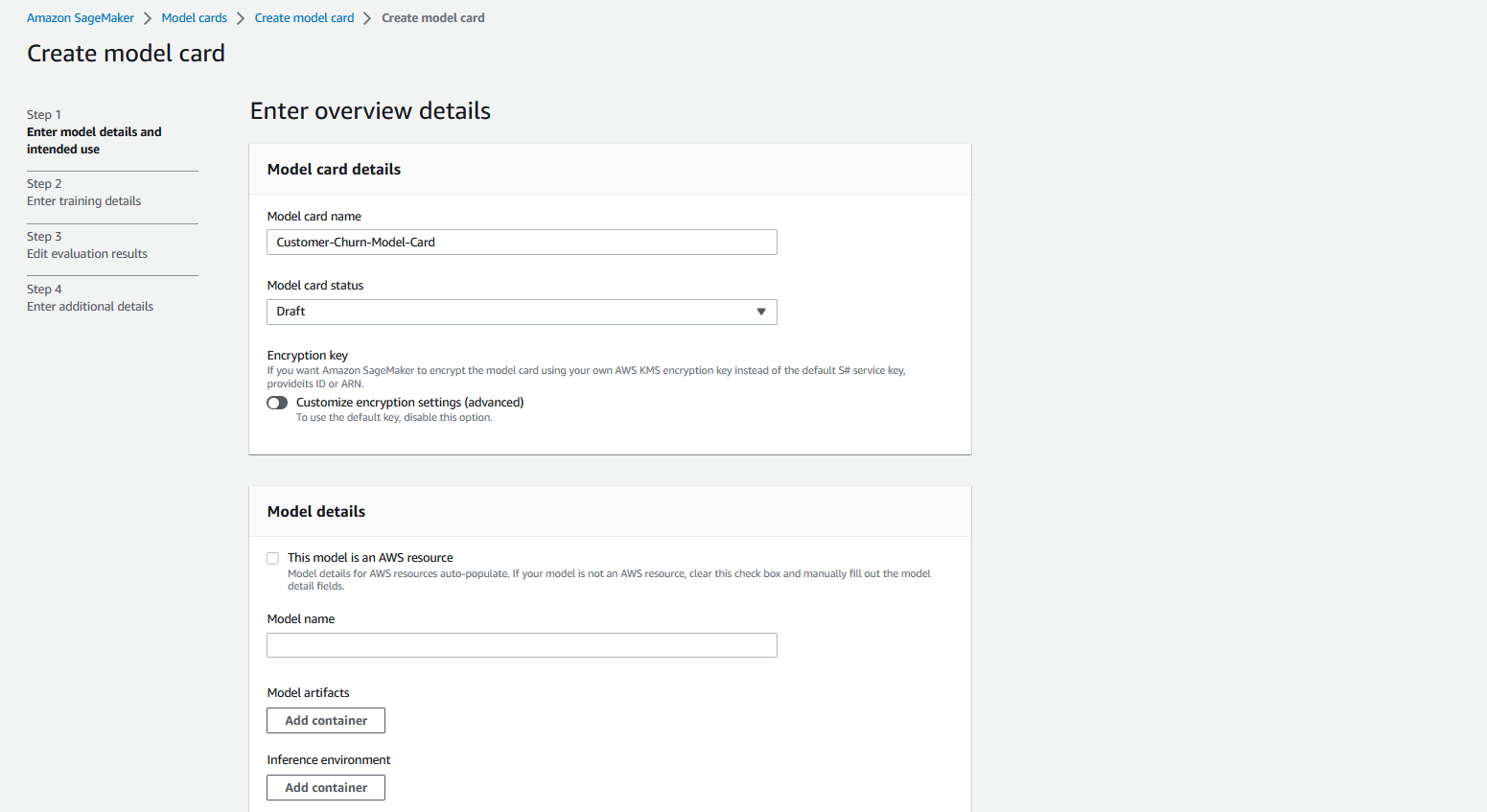

Vi laver modelkortet i Udkast til status med navnet Kunde-Churn-Model-Card. For mere information, se Lav et modelkort. I denne demonstration kan du lade resten af felterne stå tomme og oprette modelkortet.

Alternativt kan du bruge følgende AWS CLI-kommando til at oprette modelkortet:

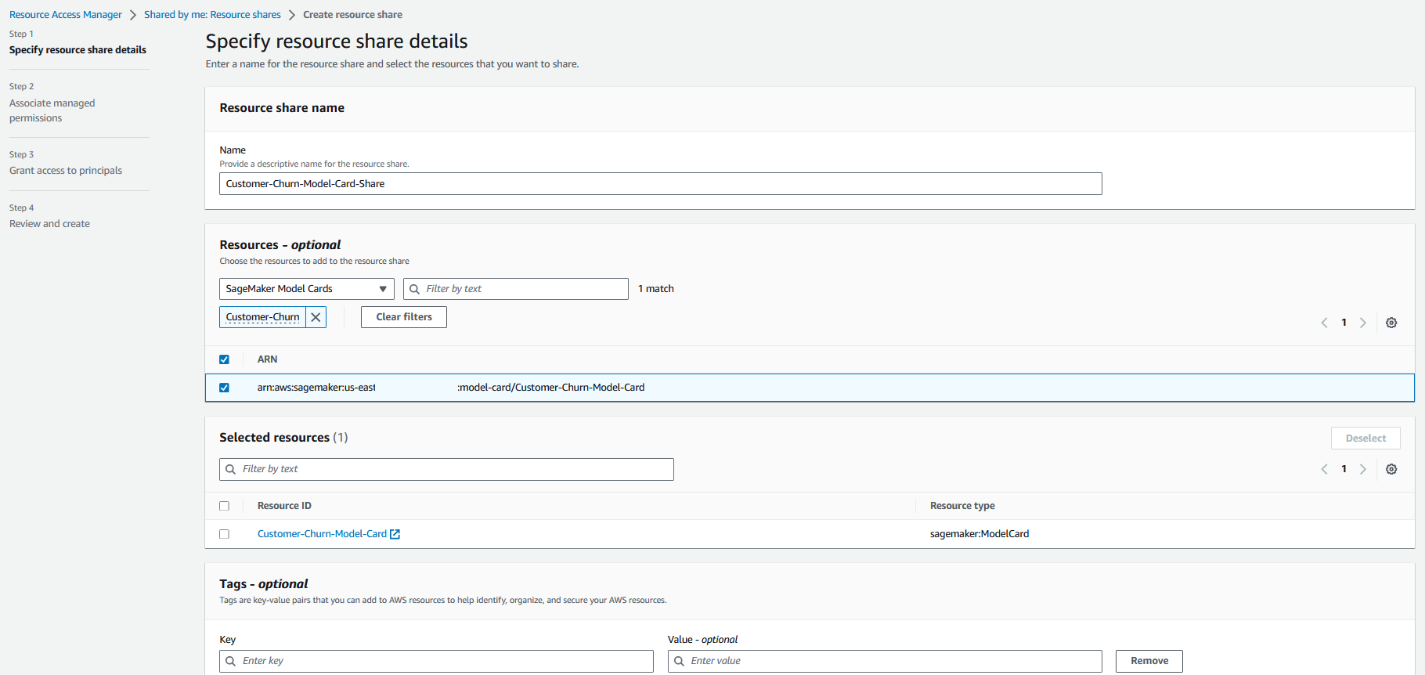

Opret nu andelen på tværs af konti ved hjælp af AWS RAM. I AWS RAM-konsollen skal du vælge Opret en ressourceandel.

Indtast et navn for ressourceandelen, for eksempel "Kunde-Churn-Model-Card-Share". I ressourcerne – valgfri sektion, vælg ressourcetypen som SageMaker modelkort. Modelkortet, vi oprettede i det foregående trin, vises i listen.

Vælg den model, og den vises i afsnittet Valgte ressourcer. Vælg den ressource igen som vist i de følgende trin, og vælg Næste.

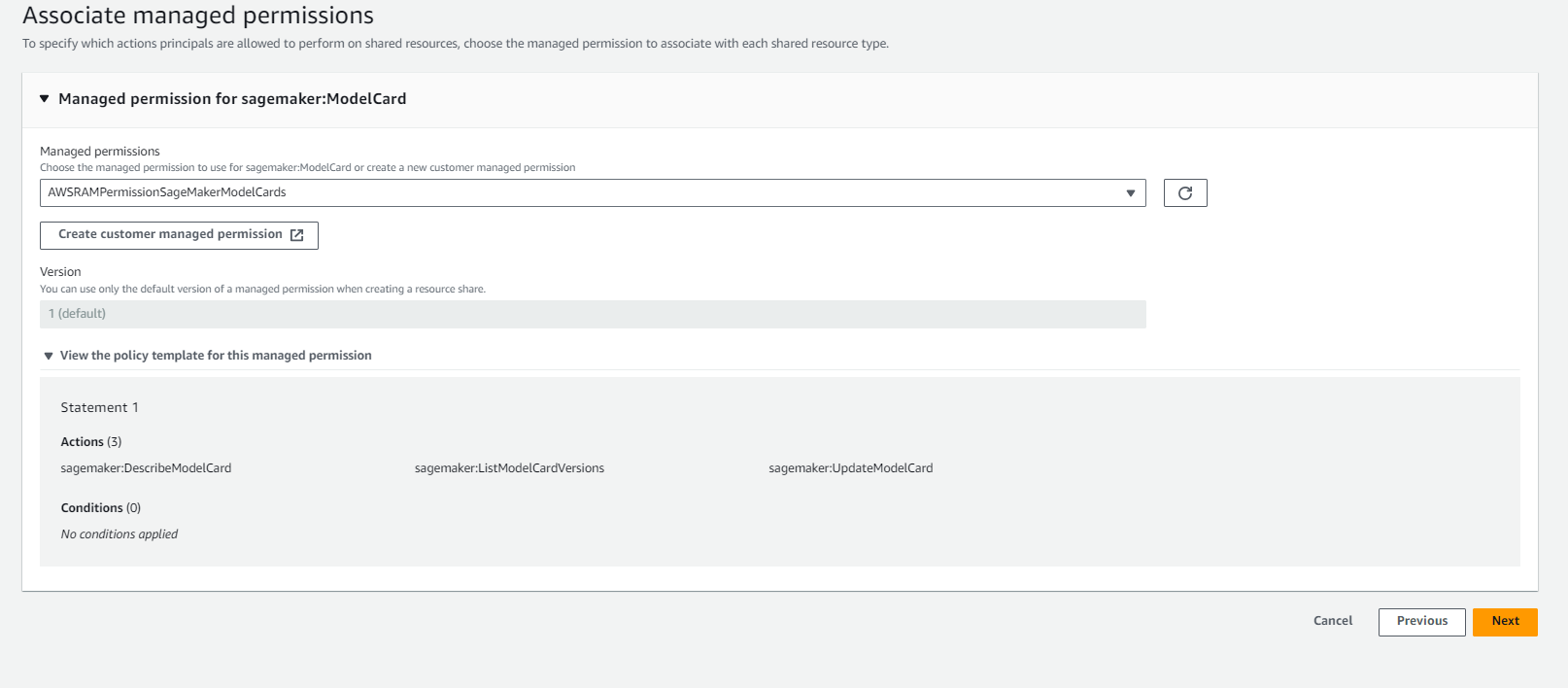

På næste side kan du vælge de administrerede tilladelser. Du kan oprette tilpassede tilladelser eller bruge standardindstillingen "AWSRAMPermissionSageMakerModelCards”Og vælg Næste. For mere information, se Håndtering af tilladelser i AWS RAM.

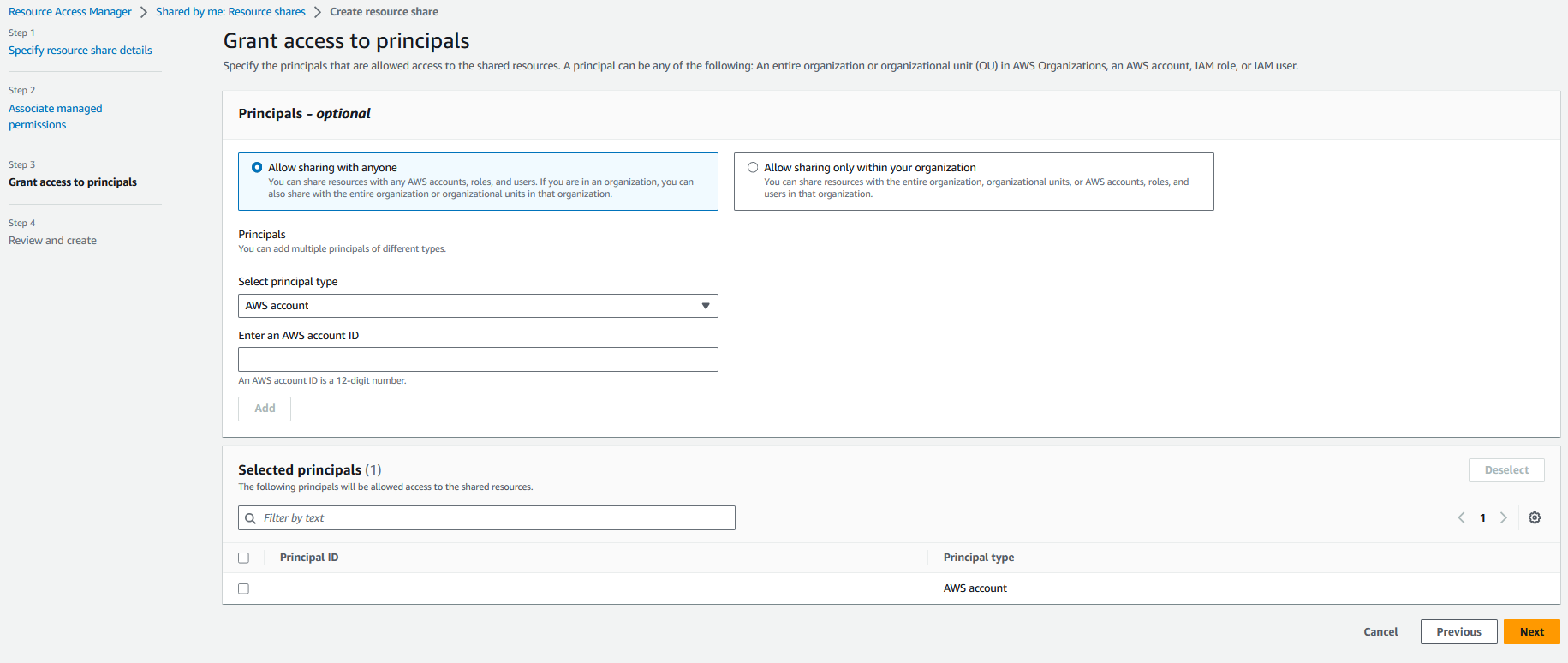

På næste side kan du vælge Rektorer. Vælg under Vælg hovedtype AWS konto og indtast ID'et på kontoen for den del af modelkortet. Vælg Tilføj og fortsæt til næste side.

På den sidste side skal du gennemgå oplysningerne og vælge "Opret ressourcedeling". Alternativt kan du bruge følgende AWS CLI kommando for at oprette en ressourceandel:

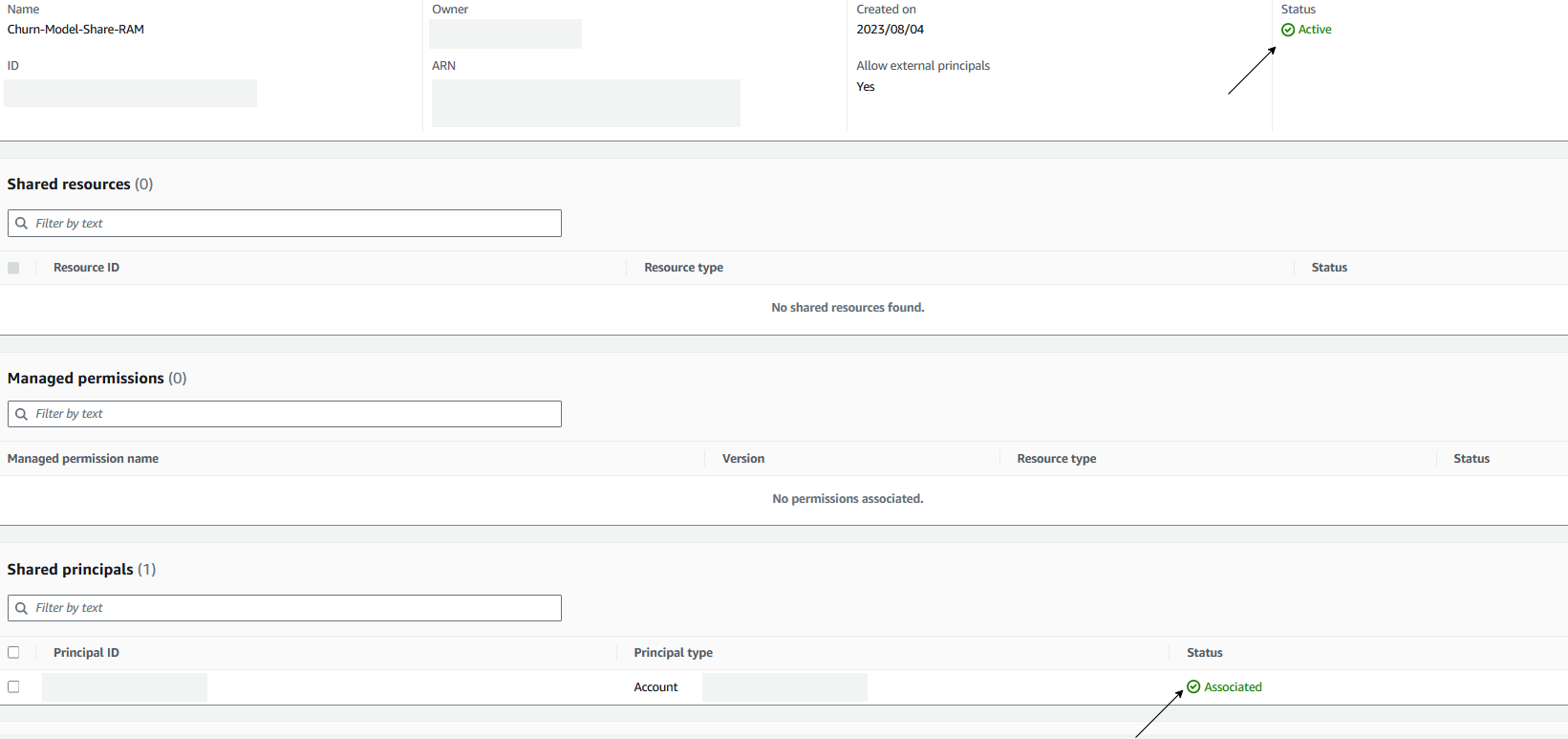

På AWS RAM-konsollen ser du attributterne for ressourceandelen. Sørg for, at delte ressourcer, administrerede tilladelser og delte principper er i "Associated”Status.

Når du har brugt AWS RAM til at oprette en ressourceshare, kan de principper, der er angivet i ressourceandelen, få adgang til sharens ressourcer.

- Hvis du slår AWS RAM-deling til med AWS-organisationer, og dine rektorer, som du deler med, er i samme organisation som delingskontoen, kan disse rektorer få adgang, så snart deres kontoadministrator giver dem tilladelser.

- Hvis du ikke slår AWS RAM-deling til med organisationer, kan du stadig dele ressourcer med individuelle AWS-konti, der er i din organisation. Administratoren på den forbrugende konto modtager en invitation til at deltage i ressourceandelen, og de skal acceptere invitationen, før de principaler, der er angivet i ressourceandelen, kan få adgang til de delte ressourcer.

- Du kan også dele med konti uden for din organisation, hvis ressourcetypen understøtter det. Administratoren på den forbrugende konto modtager en invitation til at deltage i ressourceandelen, og de skal acceptere invitationen, før de principaler, der er angivet i ressourceandelen, kan få adgang til de delte ressourcer.

For mere information om AWS RAM, se Vilkår og koncepter for AWS RAM.

Adgang til delte modelkort

Nu kan vi logge ind på den delte AWS-konto for at få adgang til modelkortet. Sørg for, at du får adgang til AWS-konsollen ved hjælp af IAM-tilladelser (IAM-rolle), som tillader adgang til AWS RAM.

Med AWS RAM kan du se de ressourceandele, du er blevet tilføjet til, de delte ressourcer, du har adgang til, og de AWS-konti, der har delt ressourcer med dig. Du kan også forlade en ressourcedeling, når du ikke længere har brug for adgang til dens delte ressourcer.

Sådan får du vist modelkortet i den delte AWS-konto:

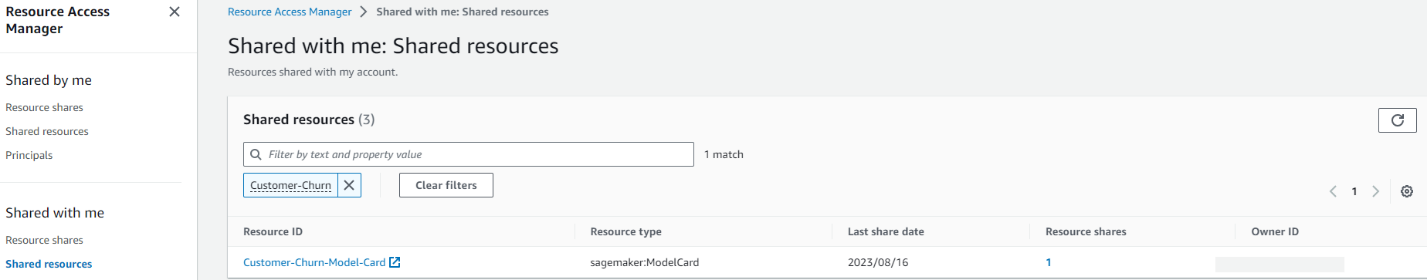

- Naviger til Delt med mig: Delte ressourcer side i AWS RAM-konsollen.

- Sørg for, at du opererer i den samme AWS-region, hvor delingen blev oprettet.

- Modellen, der deles fra modelkontoen, vil være tilgængelig på listen. Hvis der er en lang liste over ressourcer, kan du anvende et filter til at finde specifikke delte ressourcer. Du kan anvende flere filtre for at indsnævre din søgning.

- Følgende oplysninger er tilgængelige:

- Ressource ID – Ressourcens ID. Dette er navnet på modelkortet, som vi oprettede tidligere i modelkortkontoen.

- Ressourcetype – Typen af ressource.

- Sidste delingsdato – Den dato, hvor ressourcen blev delt med dig.

- Ressourceandele – Antallet af ressourceandele, som ressourcen er inkluderet i. Vælg værdien for at se ressourceandele.

- Ejer ID – ID'et på den rektor, der ejer ressourcen.

Du kan også få adgang til modelkortet ved at bruge AWS CLI-indstillingen. For AWS IAM-politikken, der er konfigureret med de korrekte legitimationsoplysninger, skal du sørge for, at du har tilladelser til at oprette, redigere og slette modelkort i Amazon SageMaker. For mere information, se Konfigurer AWS CLI.

Du kan bruge følgende AWS IAM-tilladelsespolitik som skabelon:

Du kan køre følgende AWS CLI-kommando for at få adgang til detaljerne på det delte modelkort.

Nu kan du foretage ændringer på dette modelkort fra denne konto.

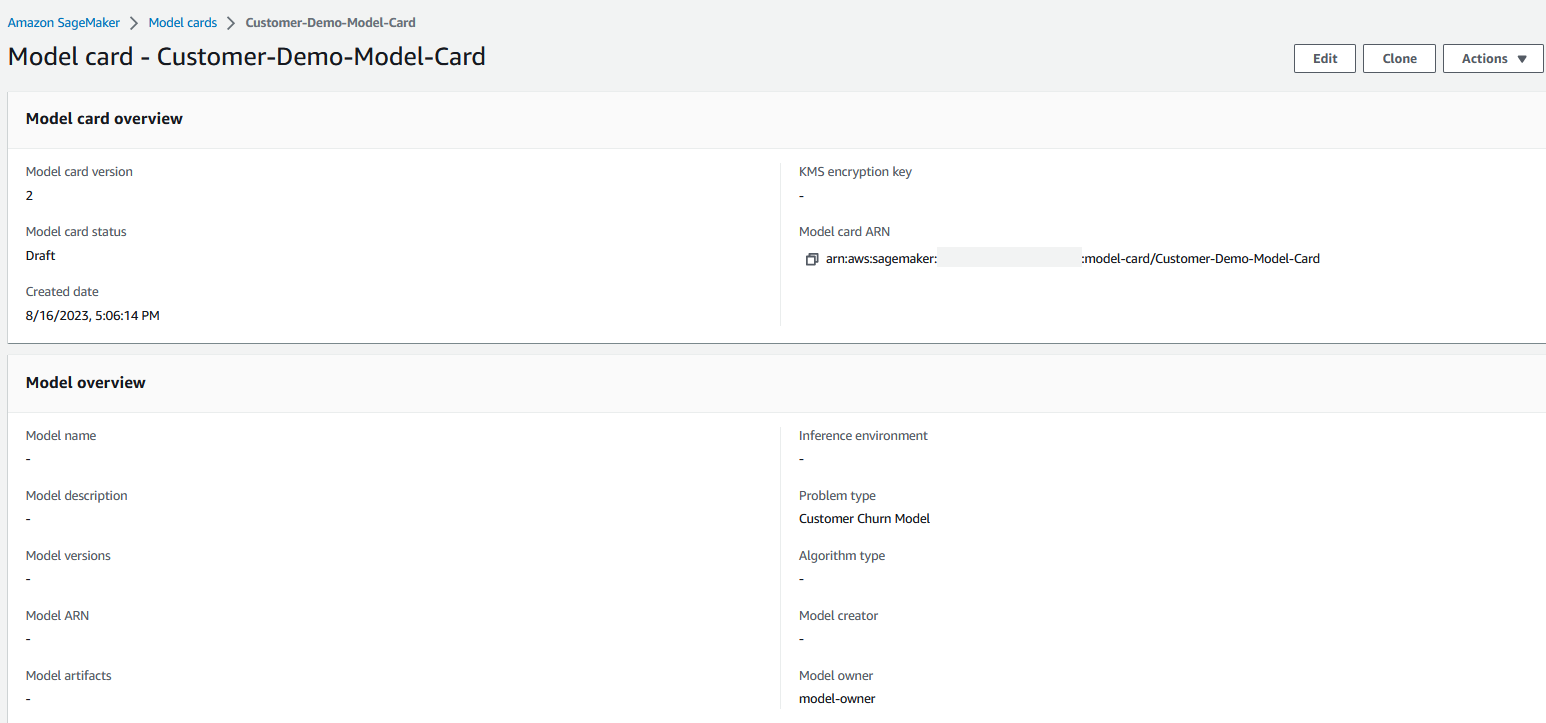

Når du har foretaget ændringer, skal du gå tilbage til modelkortkontoen for at se de ændringer, vi har foretaget på denne delte konto.

Problemtypen er blevet opdateret til "Customer Churn Model” som vi havde leveret som en del af AWS CLI-kommandoinputtet.

Ryd op

Du kan nu slette det modelkort, du har oprettet. Sørg for, at du sletter AWS RAM-ressourceandelen, som du oprettede for at dele modelkortet.

Konklusion

I dette indlæg gav vi et overblik over multi-konto arkitektur til at skalere og styre dine ML-arbejdsbelastninger sikkert og pålideligt. Vi diskuterede arkitekturmønstrene for opsætning af modelkortdeling og illustrerede, hvordan centraliserede modelkortdelingsmønstre fungerer. Endelig opsætter vi modelkortdeling på tværs af flere konti for at forbedre synlighed og styring i din modeludviklingslivscyklus. Vi opfordrer dig til at prøve den nye funktion til deling af modelkort og give os din feedback.

Om forfatterne

Vishal Naik er Sr. Solutions Architect hos Amazon Web Services (AWS). Han er en bygherre, der nyder at hjælpe kunder med at opfylde deres forretningsbehov og løse komplekse udfordringer med AWS-løsninger og bedste praksis. Hans kernefokusområde omfatter Machine Learning, DevOps og Containers. I sin fritid elsker Vishal at lave kortfilm om tidsrejser og skiftende universtemaer.

Vishal Naik er Sr. Solutions Architect hos Amazon Web Services (AWS). Han er en bygherre, der nyder at hjælpe kunder med at opfylde deres forretningsbehov og løse komplekse udfordringer med AWS-løsninger og bedste praksis. Hans kernefokusområde omfatter Machine Learning, DevOps og Containers. I sin fritid elsker Vishal at lave kortfilm om tidsrejser og skiftende universtemaer.

Ram Vittal er Principal ML Solutions Architect hos AWS. Han har over 20 års erfaring med at arkitekte og bygge distribuerede, hybride og cloud-applikationer. Han brænder for at bygge sikker og skalerbar AI/ML og big data-løsninger for at hjælpe virksomhedskunder med deres cloud-adoption og optimeringsrejse for at forbedre deres forretningsresultater. I sin fritid kører han på motorcykel og går tur med sin 2-årige sheep-a-doodle!

Ram Vittal er Principal ML Solutions Architect hos AWS. Han har over 20 års erfaring med at arkitekte og bygge distribuerede, hybride og cloud-applikationer. Han brænder for at bygge sikker og skalerbar AI/ML og big data-løsninger for at hjælpe virksomhedskunder med deres cloud-adoption og optimeringsrejse for at forbedre deres forretningsresultater. I sin fritid kører han på motorcykel og går tur med sin 2-årige sheep-a-doodle!

- SEO Powered Content & PR Distribution. Bliv forstærket i dag.

- PlatoData.Network Vertical Generative Ai. Styrk dig selv. Adgang her.

- PlatoAiStream. Web3 intelligens. Viden forstærket. Adgang her.

- PlatoESG. Automotive/elbiler, Kulstof, CleanTech, Energi, Miljø, Solenergi, Affaldshåndtering. Adgang her.

- PlatoHealth. Bioteknologiske og kliniske forsøgs intelligens. Adgang her.

- ChartPrime. Løft dit handelsspil med ChartPrime. Adgang her.

- BlockOffsets. Modernisering af miljømæssig offset-ejerskab. Adgang her.

- Kilde: https://aws.amazon.com/blogs/machine-learning/use-amazon-sagemaker-model-cards-sharing-to-improve-model-governance/

- :har

- :er

- :hvor

- $OP

- 10

- 100

- 20

- 20 år

- 2022

- 361

- 7

- 700

- 9

- a

- Om

- fremskynde

- Acceptere

- adgang

- tilgængelighed

- Adgang

- udrette

- Konto

- Konti

- opnå

- tværs

- Handling

- aktiviteter

- aktivitet

- tilføje

- tilføjet

- Desuden

- Derudover

- vedtage

- Vedtagelse

- Efter

- igen

- aggregat

- AI

- AI / ML

- tillade

- også

- Amazon

- Amazon SageMaker

- Amazon Web Services

- Amazon Web Services (AWS)

- an

- ,

- En anden

- API'er

- vises

- applikationer

- Indløs

- tilgang

- tilgange

- arkitektur

- ER

- OMRÅDE

- kunstig

- kunstig intelligens

- Kunstig intelligens (AI)

- AS

- antage

- At

- attributter

- revision

- automatisere

- Automation

- til rådighed

- AWS

- AWS Identity and Access Management (IAM)

- AWS re: Invent

- tilbage

- baseret

- BE

- fordi

- bliver

- blive

- været

- før

- fordele

- BEDSTE

- bedste praksis

- Big

- Big data

- både

- bygge

- Builder

- Bygning

- bygger

- virksomhed

- Business Applications

- men

- by

- kaldet

- CAN

- kapaciteter

- kapacitet

- kort

- Kort

- tilfælde

- tilfælde

- center

- central

- centraliseret

- udfordringer

- Ændringer

- Vælg

- Cloud

- cloud adoption

- kode

- samarbejde

- komplekse

- Compliance

- komponent

- begreber

- Adfærd

- Konfiguration

- konfigureret

- Konsol

- forbruges

- Beholdere

- fortsæt

- kontinuerlig

- bidrag

- kontrol

- Core

- korrigere

- dækker

- skabe

- oprettet

- skabelse

- Legitimationsoplysninger

- kritisk

- skik

- kunde

- Kunder

- data

- datalogi

- dataforsker

- Dato

- afgørelser

- dyb

- Standard

- levering

- Afhængigt

- indsætte

- implementering

- implementering

- beskrive

- beskrevet

- designe

- detaljer

- dev

- Udvikling

- forskel

- drøftet

- distribueret

- dyk

- do

- dokumentation

- Dont

- udkast

- grund

- i løbet af

- hver

- tidligere

- effekt

- muliggøre

- tilskynde

- Endpoint

- ingeniør

- Ingeniører

- Forbedrer

- nyde

- sikre

- Indtast

- Enterprise

- virksomheder

- miljøer

- evaluering

- eksempel

- Udvid

- erfaring

- eksperimenter

- Faktisk

- Feature

- Føderation

- tilbagemeldinger

- Fields

- film

- filtrere

- Filtre

- Endelig

- Finde

- Fornavn

- Fokus

- efter

- følger

- Til

- Foundation

- Framework

- fra

- yderligere

- få

- få

- giver

- Go

- regeringsførelse

- styrende

- bevilget

- tilskud

- havde

- hårdere

- Have

- have

- he

- hjælpe

- hjælpe

- hjælper

- hans

- Hvordan

- How To

- Men

- HTML

- HTTPS

- Hub

- Hybrid

- ID

- Identity

- if

- illustrerer

- implementeret

- vigtigt

- Forbedre

- forbedring

- in

- medtaget

- omfatter

- inklusion

- individuel

- oplysninger

- indgang

- integration

- Intelligens

- beregnet

- ind

- introduceret

- invitation

- involverede

- isolation

- IT

- ITS

- deltage

- rejse

- jpg

- Nøgle

- Kend

- Efternavn

- læring

- Forlade

- Politikker

- lad

- livscyklus

- ligesom

- Liste

- notering

- log

- Lang

- længere

- elsker

- maskine

- machine learning

- lavet

- Main

- Mainstream

- vedligeholde

- lave

- Making

- lykkedes

- ledelse

- leder

- styring

- mange

- markeret

- me

- Metadata

- ML

- MLOps

- tilstand

- model

- modeller

- mere

- motorcykel

- multi

- flere

- skal

- navn

- smal

- Behov

- behov

- Ny

- næste

- ingen

- nu

- nummer

- of

- on

- ONE

- kun

- drift

- operationelle

- optimering

- Option

- or

- organisation

- organisationer

- ud

- udfald

- output

- uden for

- i løbet af

- oversigt

- egen

- ejer

- side

- del

- lidenskabelige

- mønstre

- verserende

- Tilladelser

- plato

- Platon Data Intelligence

- PlatoData

- politikker

- politik

- Indlæg

- strøm

- praksis

- praksis

- forudsætninger

- tidligere

- tidligere

- Main

- skoleledere

- principper

- Beskyttelse af personlige oplysninger

- Problem

- Processer

- forarbejdning

- produktion

- projekt

- projekter

- passende

- give

- forudsat

- giver

- formål

- kvalitet

- RAM

- RE

- Skrivebeskyttet tilstand

- modtage

- modtager

- anbefaler

- anbefales

- henvise

- region

- Registrering

- register

- pålidelighed

- resten

- Rapportering

- kræver

- Krav

- ressource

- Ressourcer

- Resultater

- gennemgå

- Anmeldelser

- roller

- Kør

- kører

- løber

- sagemaker

- samme

- Skalerbarhed

- skalerbar

- Scale

- skalering

- scenarie

- Videnskab

- Videnskabsmand

- forskere

- Søg

- Sektion

- sikker

- sikkert

- sikkerhed

- se

- valgt

- tjeneste

- Tjenester

- sæt

- indstilling

- setup

- Del

- delt

- Aktier

- deling

- ark

- Kort

- Vis

- vist

- Shows

- siden

- enkelt

- So

- Løsninger

- SOLVE

- nogle

- snart

- Kilde

- specifikke

- specificeret

- interessenter

- standardisering

- starte

- påbegyndt

- starter

- Statement

- Status

- Trin

- Steps

- Stadig

- Strategi

- strømline

- vellykket

- Støtte

- Understøtter

- sikker

- bølge

- hold

- hold

- Teknisk

- Teknologier

- skabelon

- prøve

- tests

- at

- oplysninger

- deres

- Them

- temaer

- derefter

- Der.

- derved

- Disse

- de

- denne

- dem

- Gennem

- hele

- tid

- tidsrejser

- til

- værktøjer

- Sporing

- Kurser

- Gennemsigtighed

- rejse

- udløse

- Sandheden

- prøv

- TUR

- typen

- under

- Universe

- opdateret

- us

- Brug

- brug

- brug tilfælde

- anvendte

- brugere

- ved brug af

- v1

- validering

- værdi

- udgave

- via

- Specifikation

- Vishal

- synlighed

- var

- we

- web

- webservices

- hvornår

- som

- mens

- WHO

- vilje

- med

- inden for

- Arbejde

- år

- Du

- Din

- zephyrnet